Ago

6

¿De dónde surgió todo?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (1)

Comments (1)

“En Cosmología, las Es verdaderamente encomiable la pertinaz insistencia del ser humano por saber, y, en el ámbito de la Astronomía, desde los más remotos “tiempos” que podamos recordar o de los que tenemos alguna razón, nuestra especie ha Claro que, nosotros, los Humanos, llevamos aquí el tiempo de un parpadeo del ojo si lo comparamos con el Tiempo del Universo. Sin embargo, nos hemos valido de todos los medios posibles para llegar al entendimiento de las cosas, incluso sabemos del pasado a través del descubrimiento de la vida media de los elementos y mediante algo que denominamos datación, como la del Carbono 14, podemos saber de la edad de muchos objetos que, de otra manera, sería imposible averiguar. La vida de los elementos es muy útil y, al mismo tiempo, nos habla de que todo en el Universo tiene un Tiempo Marcado. Por ejemplo, la vida media del Uranio 238 sabemos que es de 4.000 millones de años, y, la del Rubidio tiene la matusalénica vida media de 47.000 millones de años, varias veces la edad que

Lepidolita, una de las mayores fuentes del raro rubidio y del cesio. El rubidio también fue descubierto,

Color blanco-plateado brillante Reacciona violentamente con el agua produciendo hidrógeno Arde espontáneamente en

El rubidio es un elemento bastante abundante en la corteza terrestre y está presente

El Rubidio ha sido detectado en las estrellas y, siendo muy abundante en la corteza terrestre, es utilizado en en ciencia y tecnologías puntas, por lo que está presente en muchos laboratorios. El rubidio es semejante al cesio y al litio en que está integrado en minerales complejos; no se encuentra en la naturaleza Es tan reactivo con oxígeno que puede arder espontáneamente con este elemento puro. El metal pierde el brillo muy rápidamente al aire, El rubidio reacciona violentamente con agua o hielo a temperaturas por debajo de –100º C (-148º F). Reacciona con hidrógeno No reacciona con nitrógeno. Con bromo o cloro, el rubidio reacciona vigorosamente con formación de flama. Se pueden preparar compuestos organorrubídicos con técnicas parecidas a las que se utilizan con el sodio y el potasio.

Átomo de Rubidio 85 diciendo ‘hola’ a la cámara.

Pero, ¿qué estoy haciendo? El Big Bang

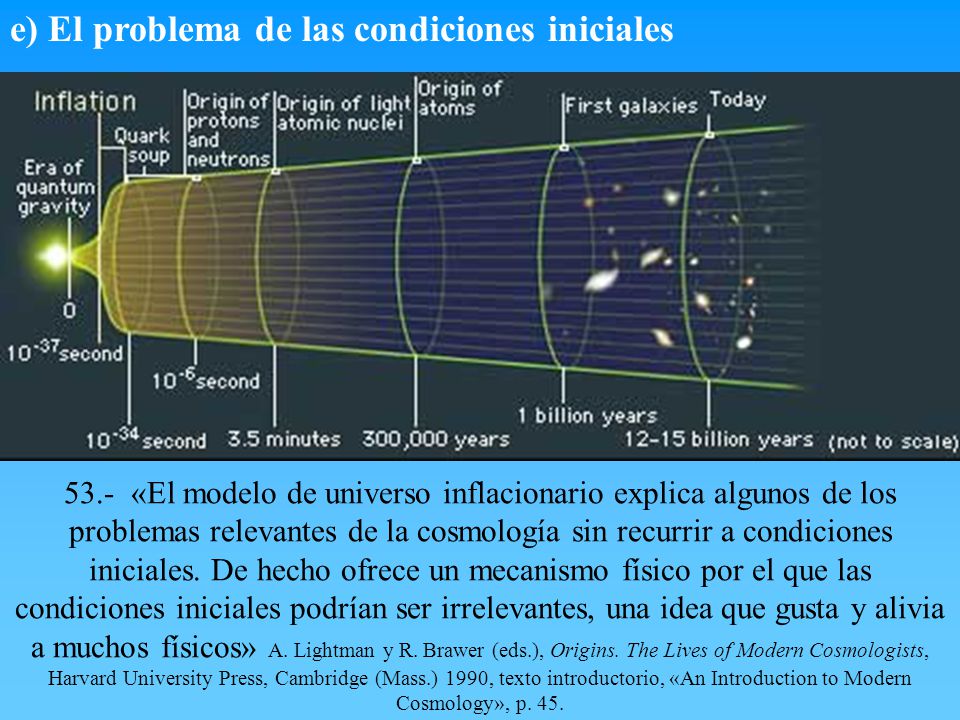

Hablaremos Big Bang, esa teoría aceptada por todos y que nos dice cómo se formó nuestro universo y comenzó su evolución hasta ser como ahora lo conocemos. De acuerdo a esta teoría, el universo se originó a partir de un estado inicial de alta temperatura y densidad, y desde entonces ha estado siempre expandiéndose. La teoría de la relatividad general predice la existencia de una singularidad en el comienzo,

La mayoría de los cosmólogos interpretan singularidad como una indicación de que la relatividad general de Einstein deja de ser válida en el universo muy primitivo (no existía materia), y el comienzo mismo debe ser estudiado utilizando una teoría de cosmología cuántica.

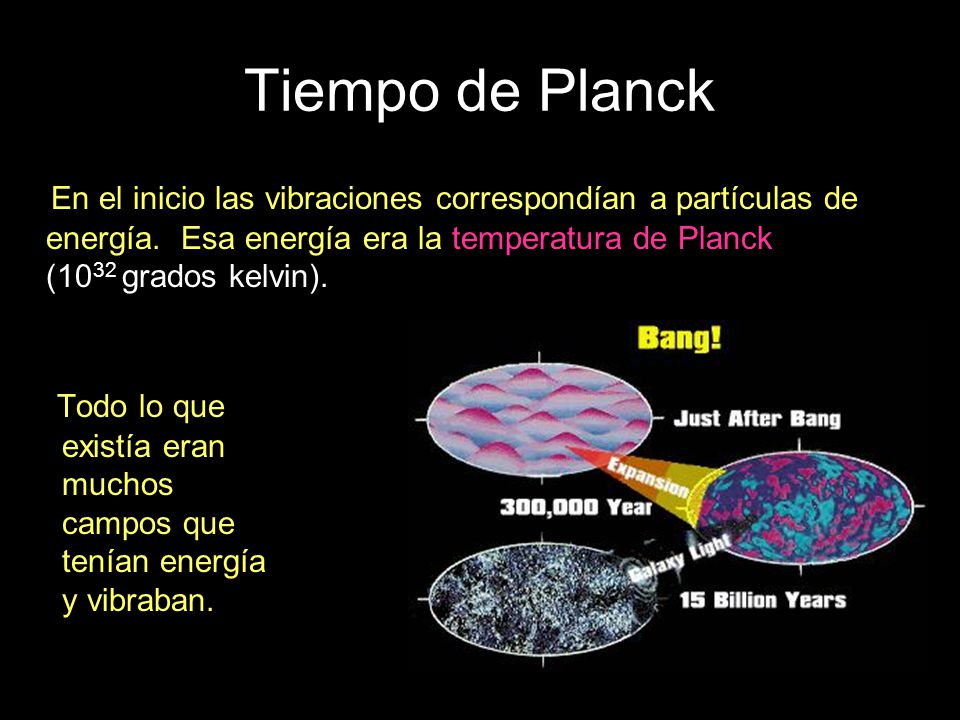

El tiempo de Planck es una unidad de tiempo considerada como el intervalo temporal más pequeño que tiempo de Planck representa el instante de tiempo más antiguo en el que las leyes de la física pueden ser utilizadas para estudiar la naturaleza y evolución del Universo. Se determina como combinación de otras constantes físicas en la  5.39124(27) × 10−43 segundos

5.39124(27) × 10−43 segundos

Esto llego miles de millones de años más tarde pero, ¿Qué había antes del comienzo del Tiempo?

Las respuestas están escondidas en ese primer intervalo infinitesimal que está antes del Comienzo del Tiempo que conocemos, es una fracción de tiempo que nos queda en la más absoluta oscuridad. Nadie ha podido ir más allá del Tiempo de Planck y, siendo un intervalo de tiempo tan pequeño… ¡nos diría aántas cosas!

Una buena vela encendida no es suficiente Big Bang”. Sin embargo…La esperanza es lo último que se pierde, y, aunque los físicos cuando tratan de exponer con sus matemáticas aquellos hechos primeros, las primeras fracciones del primer segundo del Big Bang, se ven imposibilitados…Esperamos que, más adelante, en el futuro lejano, podamos entrar en ese Tiempo de Planck Con nuestro conocimiento actual de física de partículas de altas energías, podemos hacer avanzar el reloj Big Bang, cuando la temperatura era de 1013 K. Utilizando una teoría más especulativa, los cosmólogos han intentado llevar el modelo singularidad, cuando la temperatura era de 1028 K. Esa infinitesimal escala de longitud es conocida

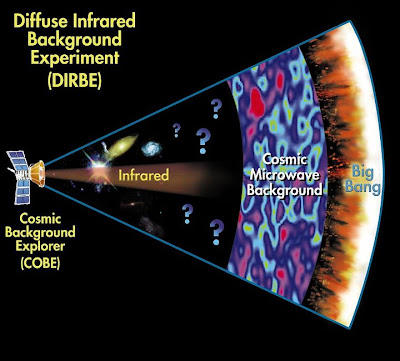

La teoría del Big Bang es capaz de explicar la expansión del universo, la existencia de una radiación de fondo cósmica y la abundancia de núcleos ligeros como el helio, el helio-3, el deuterio y el litio-7, cuya formación se predice que ocurrió alrededor de un segundo después del Big Bang, cuando la temperatura reinante era de 1010 K.

La radiación de fondo cósmica proporciona la evidencia más directa de que el universo atravesó por una fase caliente y densa. En la teoría del Big Bang, la radiación de fondo es explicada por el hecho de que plasma que era opaco a la radiación y, por tanto, en equilibrio térmico con ella. Como nadie estuvo allí para tomar una fotografía de la gran explosión, ponemos una que quiere figurar aquel momento que, Cuando el universo se expandió y se enfrió a unos 3000 ºK, se volvió transparente a la radiación, que es la que observamos en la actualidad, mucho más fría y diluida, como radiación térmica de microondas. El descubrimiento del fondo de microondas en 1.956 puso fin a una larga batalla Big Bang y su rival, la teoría del universo estacionario de F. Hoyle y otros, que no podía explicar la Big Bang tuvo inicialmente un sentido burlesco y fue acuñado por Hoyle, contrario a la teoría del universo inflacionario y defensor del estacionario.

|

Cronología del Big Bang |

||

|

Era |

Duración |

Temperatura |

| Era de Planck |

de 0 a 10-43 seg. |

a 10-34 K |

| Era de radiación |

de 10-43 a 30.000

desde 10-34 a 104 K |

|

| Era de la materia | de 30.000 años al presente (13.500.000.000 años). |

desde 104 a 3 K actual |

Para fijar más claramente los hechos se debe extender la explicación evolutiva del universo en las fases principales que son:

Las que salieron de ese clima de enormes temperaturas La Era de Planck:

En cosmología, la época de Planck es el más temprano período de Tiempo en la historia del universo, entre cero y 10−43 segundos (como antes decía, un tiempo de Planck), durante el cual las cuatro fuerzas (nucleares fuerte y débil, electromagnética y gravitatoria, estaban unificadas en una sola fuerza y aún, no existían las partículas elementales que más tarde surgirían para formar la materia.

Es la era que se inició con el surgir de la materia, cuando el efecto gravitacional de la materia primera comenzó a dominar sobre el efecto de presión de radiación. Aunque la radiación es no masiva, tiene un efecto gravitacional que aumenta con la intensidad de la radiación. Es más, a altas energías, la propia materia se comporta como la radiación electromagnética, ya que se mueve a velocidades próximas a la de la luz. En las etapas muy antíguas del universo, el ritmo de expansión se encontraba dominado por el efecto gravitacional de la presión de radiación, pero a medida que el universo se enfrió, Big Bang. Este hecho marcó el comienzo de la era de la materia.

De la radiación

Periodo Big Bang. La era de radiación fue seguida por la era de la materia que antes se reseña, Era hadrónica

Corto periodo de tiempo Big Bang en el que se formaron las partículas atómicas pesadas, como protones, neutrones, piones y kaones entre otras. Antes del comienzo de la era hadrónica, los quarks se comportaban como partículas libres. El proceso por el que se formaron los quarks se denomina transición de fase quark-hadrón. Al final de esta Era, todas las demás especies hadrónicas habían decaído o se habían desintegrado, dejando sólo protones o neutrones. Inmediatamente después de esto el universo entró en la era leptónica.

Era Leptónica

Intervalo que comenzó unos 10-5 s después del Big Bang, en el que diversos tipos de leptones eran la principal contribución a la densidad del universo. Se crearon pares de leptones y antileptones en gran Big Bang. Después, los leptones se unieron a los hadrónes Así se formó nuestro universo, a partir de una singularidad que explotó expandiendo toda la densidad y energía a unas temperaturas terroríficas, y a partir de ese mismo instante conocido como Big Bang, nacieron, como hermanos gemelos, el tiempo y el espacio junto con la materia que finalmente desembocó en lo que

El universo se está expandiendo, de manera que el espacio entre las galaxias está aumentando gradualmente, provocando un desplazamiento al rojo cosmológico en la luz procedente de los objetos distantes.

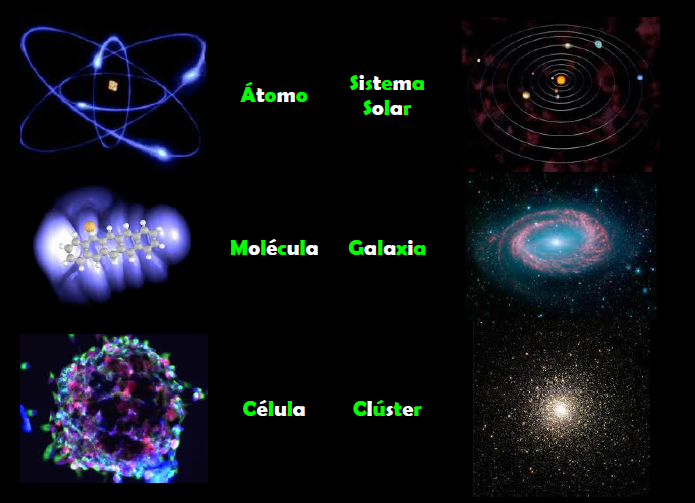

El universo es el conjunto de todo lo que existe, incluyendo (como he dicho) el espacio, el tiempo y la materia. El estudio del universo se conoce como cosmología. Los cosmólogos distinguen al Universo con “U” mayúscula, significando el cosmos y su contenido, y el universo con “u” minúscula, que es normalmente un modelo matemático deducido de alguna teoría física como por ejemplo, el universo de Friedmann o el universo de Einstein-de Sitter. El universo real está constituido en su mayoría de espacios que aparentemente están vacíos, existiendo materia concentrada en galaxias formadas por estrellas, planetas, gases y otros objetos cosmológicos.

El universo se está expandiendo, de manera que el espacio materia oscura invisible que Big Bang, de acuerdo con la cual el universo se creó a partir de una densa y caliente concentración enorme de materia (una singularidad) en una bola de fuego que explotó y se expandió para crear el espacio, el tiempo y toda la materia que lo conforme. Todo ello ocurrió, según los

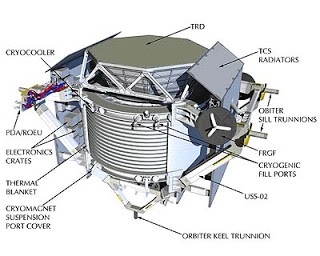

La NASA midiendo la curvatura en el espacio-tiempo alrededor del planeta

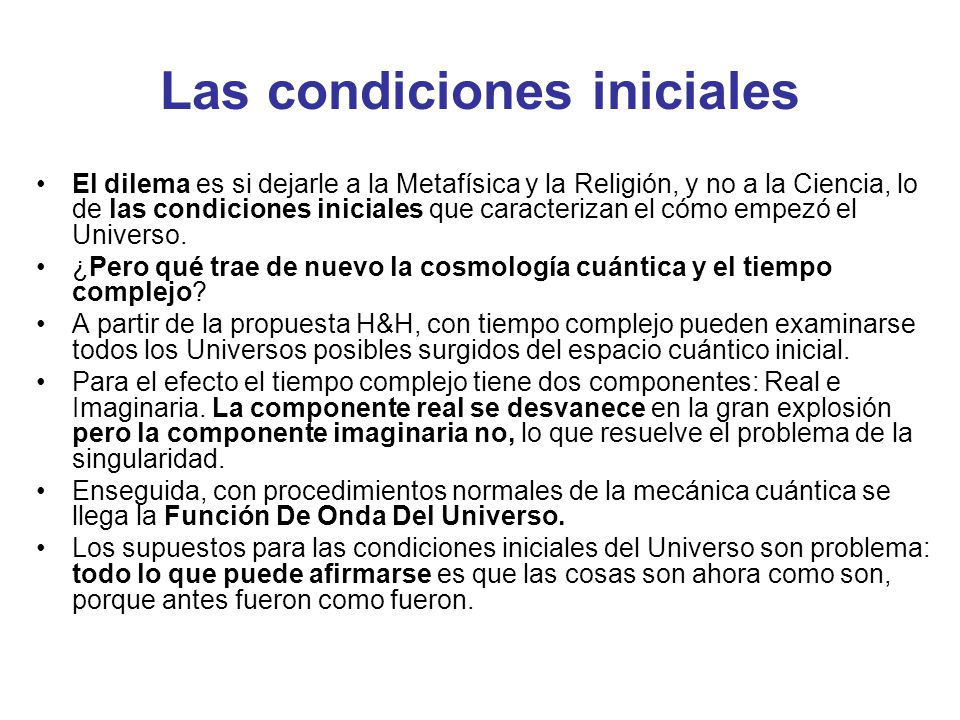

El universo se formó y apareció el tiempo y el espacio y la materia. Es lo que dice la teoría que antes hemos descrito. Sin embargo, hay muchas cuestiones que, por lo ¿Cuántas partículas hay en el universo?

¿De dónde vino la sustancia del universo?

¿Qué hay más allá del borde del universo?

En realidad, no existen respuestas concretas

El Universo está lleno de espacios “vacíos”

Podemos calcular que hay unas 100.000.000.000 de galaxias en el universo. Cada una de estas galaxias

Ilustración del universo observable con el Sistema Solar en el centro, los planetas interiores, el cinturón de Asteroides, los planetas exteriores, el cinturón de Kuiper, la nube de Oort, Alfa Centauri, el brazo de Perseo, la Via Láctea, Andrómeda y las galaxias cercanas, la telaraña cósmica de cúmulos galácticos, la radiación de fondo de microondas y el Big Bang en el borde. Sobre la masa total del universo, estos son los cálculos actuales que, deben ser confirmados: en el universo hay materia suficiente para hacer 10.000.000.000.000.000.000.000 (diez mil trillones) de soles como el nuestro.

La masa del Sol es de 2×1033 gramos. Esto significa que la cantidad total de materia en el universo tiene una masa de: 1022×2×1033 ó 2×1055 gramos. Lo que podemos reseñar: 20.000.000.000.000.000.000.000.000.000.000.000.000.000.000.000.000.000.000, que es igual a veinte nonillones.

Imagen: (las magnitudes en la imagen deben desplazar el punto decimal una posición a la izquierda) que explica la diferencia sobre el dato de la edad del universo (1.37×1010 años luz) en comparación a la estimación sobre el radio actual del universo observable (4.65×1010 años luz). La explicación de tal sería que al mirar la radiación de fondo y las galaxias más lejanas se observa el pasado con una mayor densidad de materia por centímetro cúbico del universo.

A pesar de su ínfima dimensión, los nucleones conformados por tripletes de quarks (protones y neutrones), se unen a los electrones Miremos nucleones que contiene. Los nucleones son partículas diminutas y hacen falta 6×1023 de ellas para formar una masa equivalente a un gramo.

Pues nucleones hacen 1 g, y si hay 2×1055 g en el universo, entonces el nucleones en el universo podría ser de 6×1023×2×1055 ó 12×1078, que de manera más convencional se escribiría 1,2×1079.

Eddintong

En uno de mis trabajos que se titulaba los grandes números del Universo, se habló de como Arthur Stanley Eddington, un extraordinario científico que había sido el primero en descubrir cómo se alimentaban las estrellas a partir de reacciones nucleares. También hizo importantes contribuciones a nuestra comprensión de las galaxias, escribió la primera exposición sistemática de la teoría de la relatividad general de Einstein y fue el responsable de la expedición que durante un eclipse de Sol, pudo confirmar con certeza la predicción de la relatividad general que debería desviar la luz estelar que venía hacia la Tierra en aproximadamente 1’75 segundos de arco cuando pasaba cerca de la superficie solar, cuyo espacio estaría curvado debido a la gravedad generada por la masa del Sol. En aquella expedición, el equipo de Eddington hizo una exitosa medición del fenómeno desde la isla Príncipe, que confirmó que Einstein tenía razón y que su teoría predecía de manera exacta la medida de curvatura del espacio en función de la masa del objeto estelar que genera la gravitación distorsionando el espaciotiempo a su alrededor.

Entre los números que Eddington consideraba de importancia primordial estaba al que ahora conocemos como número de Eddington, que es igual al número de protones en el universo visible. Eddington calculó (a mano) este número con enorme precisión en un crucero trasatlántico, sentado en cubierta, con libreta y lápiz en la mano, tras calcular concienzudamente durante un tiempo, finalizó escribiendo:

“Creo que el Universo hay:

15.747.724.136.275.002.577.605.653.961.181.555.468.044.717.914.527.116.709.366.231.425.076.185.631.031.296

de protones y el mismo número de electrones”.

Este número enorme, normalmente escrito NEdd, es aproximadamente igual a 1080. Lo que atrajo la atención de Eddington hacia él era el hecho de que debe ser un número entero, y por eso en principio puede ser calculado exactamente.

Los astrónomos opinan que el 90 por 100 de los átomos de universo son hidrógeno, el 9 por 100 helio y el 1 por 100 elementos más complejos. Una muestra de 100 gramos, o mejor 100 átomos, consistiría entonces en 90 átomos de hidrógeno, 9 de helio y 1 de oxígeno (por ejemplo). Los núcleos de los átomos de hidrógeno contendrían 1 nucleón protón. Los núcleos de los átomos de helio contendrían 4 nucleones cada uno: 2 protones y 2 neutrones. El núcleo del átomo de oxígeno contendría 16 nucleones: 8 protones y 8 neutrones. Los 100 átomos juntos contendrían, por tanto, 145 nucleones: 116 protones y 26 neutrones.

Existe una diferencia nucleones. El neutrón no tiene carga eléctrica y no es preciso considerar ninguna partícula que lo acompañe. Pero el protón tiene una carga eléctrica positiva, y como el universo es, según creemos, eléctricamente neutro en su conjunto, tiene que existir un electrón(con carga eléctrica negativa) por cada protón, creando así el equilibrio existente.

De nucleones hay 116 electrones (protones). Para mantener la proporción, los 1’2×1079 nucleones del universo tienen que ir acompañados de 1×1078electrones. Sumando los nucleones y electrones, tenemos un

La grandeza de nuestro Universo electrón, la constante de estructura fina…

De las demás partículas, las únicas que existen en cantidades importantes en el universo son los fotones, los neutrinos y posiblemente los gravitones, pero son partículas sin masa. Veintidós tredecillones es, después de todo, un

Si no se explican estas imágenes… ¿Quién podría decir lo que cada una de ellas es?

Una historia que circula por Internet desde hace muchos años fotones que sería atravesado dos veces por el Sol en cada órbita, tardando cada vez 2000 años. Durante estos 2.000 años nuestro planeta estará continuamente bajo una iluminación omnidireccional permanente, que no producirá sombras. Los efectos de esta radiación fotónica serían Nadie sabe de dónde vino la sustancia del universo, no siempre la ciencia puede dar respuesta a todo, es la manera de regular los sistemas para obtener respuestas tras el duro

El día que lleguemos a saber lo que encierran los fotones…nos podemos llevar una gran sorpresa

“La respuesta podía estar en la existencia de “energía negativa” que igualara la “energía positiva” ordinaria, pero con la particularidad de que cantidades iguales de ambos se unirían

¿Qué sabemos del vacío? Pero no el de arriba. Hablamos de la ausencia total de materia, lo que no existe porque siempre hay. El vacío, como la Eternidad, el Infinito o la Sabiduría total,,, ¡No existen!

En realidad todo podría ser muy simple, tanto Diversas fuentes y pesquisas han podido lograr que el presente trabajo vea la luz y sea publicado aquí.

emilio silvera

Ago

5

El James Webb

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

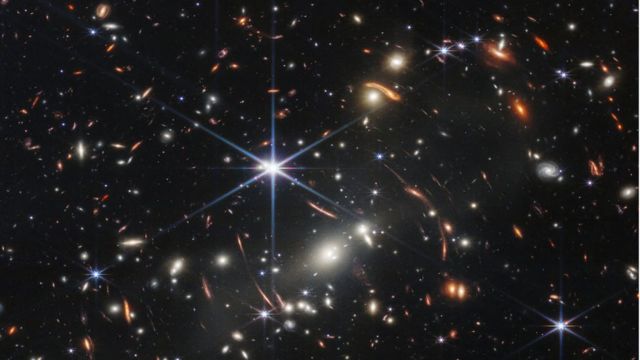

Después de 25 años de “lucha” con la Administración, para conseguir la financiación de 10.000 M de dólares, por fín despegó el mayor telescopio construido hasta ahora y que nos llevará hasta el Universo temprano.

Es tan grande que hubo que plegarlo para que pudiera entrar en el cohete, y, ya en el Espacio se desplegó y ajusto mediante multitud de motores que ajustaron los espejos y consiguieron abrir las piezas para conformar el telescopio.

El parasol tan grande como una pista de tenis, logrará que la radiación solar no impida que trabaje con una temperatura muy baja, única forma que puede funcionar de manera correcta.

Las galaxias más lejanas captadas hasta el momento con una nitidez sin precedente

Nebulosa Carina con sus estrellas moribundas y otras nacientes con una nitidez nunca antes vista

Imágenes todas espectaculares y con una definición asombrosa. Habrá que estar mentalizados a que, en el próximo futuro tendremos la oportunidad de observar muchas maravillas que el Universo esconde a distancias inusitadas y que, el James Webb, podrá captar para todos nosotros.

emilio silvera

Ago

5

Antimateria y otros enigmas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

En cualquier sitio que busquemos datos para saber sobre la antimateria, nos podemos encontrar con explicaciones como ésta:

“En física de partículas, la antimateria es la extensión del concepto de antipartícula a la materia. Así, la antimateria está compuesta de antipartículas, mientras que la materia ordinaria está compuesta de partículas. Por ejemplo, un antielectrón (un electrón con carga positiva, también llamado positrón) y un antiprotón (un protón con carga negativa) podrían formar un átomo de antimateria, de la misma manera que un electrón y un protón forman un átomo de hidrógeno. El contacto de materia y antimateria llevaría a la aniquilación de ambas, dando lugar a fotones de alta energía (rayos gamma) y otros pares partícula-antipartícula.”

Lo cierto es que solo vemos materia

“La desconcertante prevalencia de la materia sobre la antimateria en el universo podría estar relacionado con un extraño estiramiento del espacio-tiempo causado por el giro de nuestra galaxia, según un nuevo estudio”.

De tonterías como esa están las revistas científicas llenas. Ya no saben lo que hacer por llamar la atención y, en cualquier mente lógica medianamente “leída”, se puede llegar a la conclusión de que, como en el Universo todo es cuestión de equilibrios entre fuerzas contrapuestas, mejor sería pensar en la existencia de un universo paralelo de antimateria.

La antimateria es el pariente primo de la materia. Por cada partícula de materia se cree que existe su pareja de antimateria, con la misma masa, pero de carga opuesta. Cuando la materia y la antimateria se encuentran, se aniquilan, y de la conversión de su masa en energía resulta una poderosa explosión.

Aunque hoy en día, los científicos siguen sin entender por qué en el universo predomina, casi completamente la materia. De hecho, aunque la han buscado con insistencia, la antimateria del universo primordial…no aparece por ninguna parte.

Baryogénesis es el término aplicado al proceso teórico en la cosmología moderna que condujo a un desequilibrio entre barión y anti-barión en el universo temprano. Este desequilibrio, conocido como asimetría bariónica, es uno de los misterios más profundos de la cosmología moderna.

Según todos los estudios de experimentos y observaciones que han sido llevados a la práctica por Equipos de estudiosos en todo el Mundo, parece ser que, los motivos por los que no se han encontrado grandes estructuras de antimateria en nuestro Universo, y, el hecho de que la Materia supere a la antimateria, es denominado como “Bario-génesis”, es decir, la Materia Bariónica que es la que observamos y emite radiación (Planetas, estrellas, galaxias, etc.) es la que, finalmente, ha quedado predominando en este Universo nuestro (dejando a un lado esa otra clase de materia que llamamos Oscura y que, de ser cierto que existe, debió crearse antes que la Bariónica, sería la primera clase de materia que hizo acto de presencia en el Universo y, la Fuerza de Gravedad que generaba, hizo posible que, a pesar de la expansión de Hubble, se formaran las estrellas y las galaxias.

¿Por qué en el comienzo del Universo podría la materia Bariónica superar a la antimateria?

–Pequeño exceso de materia tras el Bib Bang: Especula con que la materia que forma actualmente el universo podría ser el resultado de una ligera asimetría en las proporciones iniciales de ambas.

–Asimetría CP. Un reciente experimento en el acelerador KEK de Japón sugiere que esto quizás sea cierto, y que por tanto no es necesario un exceso de materia en el Big Bang: simplemente las leyes físicas que rigen el universo favorecen la supervivencia de la materia frente a la antimateria.

–Existencia de galaxias de antimateria ligada por antigravedad: Muy pocos científicos confían en esta posibilidad, pero todavía no ha podido ser completamente descartada. Esta tercera opción plantea la hipótesis de que pueda haber regiones del universo compuestas de antimateria. Hasta la fecha no existe forma de distinguir entre materia y antimateria a largas distancias, pues su comportamiento y propiedades son indistinguibles. (Esta opción parece poco probable).

La ecuación de Dirac, formulada en en 1928, predijo la existencia de antipartículas además de las partículas de materia ordinarias. Desde entonces, se han ido detectando experimentalmente muchas de dichas antipartículas: Carl D. Anderson, en el Caltech, descubrió el positrón en 1932. Veintitrés años después, en 1955, Emilio Sègre y Owen Chamberlain, en la universidad de Berkeley, el antiprotón y antineutrón.

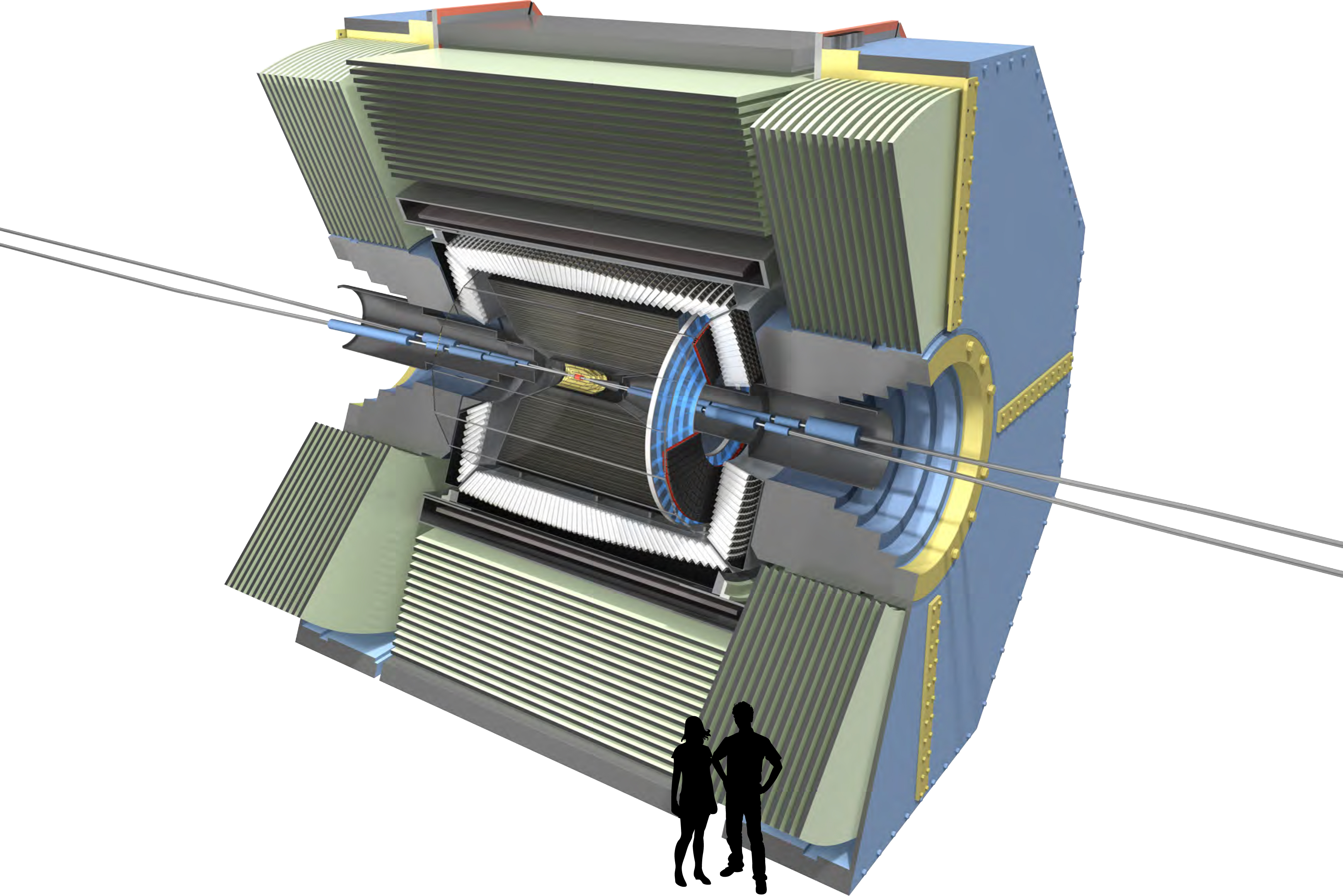

Pero la primera vez que se pudo hablar propiamente de antimateria, es decir, de “materia” compuesta por antipartículas, fue en 1965, cuando dos equipos consiguieron crear un antideuterón, una antipartícula compuesta por un antiprotóny un antineutrón. La antipartícula fue lograda en el Acelerador Protón Sincrotrón del CERN, a cargo de Antonio Zichichi, y paralelamente por Leon Lederman en el acelerador AGS (Alternating Gradient Synchrotron) del Laboratorio Nacional de Brookhaven, en Nueva York.

En 1995, el CERN anunció la creación de nueve átomos de antihidrógeno en el experimento PS210, liderado por Walter Oelert y Mario Macri, y el Fermilab confirmó el hecho, anunciando poco después la creación a su vez de 100 átomos de antihidrógeno.

El 14 de Diciembre de 2.009, científicos de la NASA con la ayuda del telescopio espacial de rayos gamma Fermi, descubrieron rayos de antimateria producidos encima de tormentas eléctricas. El fenómeno es causado por ráfagas de rayos gamma terrestres (TGF) generadas al interior de las tormentas eléctricas y asociados directamente con los relámpagos.

La antimateria es un término que se ha hecho muy común y familiar en los últimos años, y, han sido muchos los que han tratado de buscarla en los confines del Universo. No parece que el resultado obtenido sea muy alentador.

Si la antimateria realmente existiera en su forma natural, no habría que buscarla en los confines del Universo, estaría, como es lógico pensar, por todas partes. Así que, lo mejor será hacernos a la idea de que en aquellos comienzos el exceso de materia bariónica prevaleció y fue la única que quedó para formar los objetos que ahora podemos ver repartidos por todo el Cosmos en forma de estrellas, de mundos, galaxias, y otros de múltiples formas y fases.

Se ha logrado capturar partículas de antimateria en los Aceleradores de partículas y, con ellas, se han realizado pruebas que han venido a confirmar que, cuanto la Materia se encuentra con la antimateria, la destrucción está asegurada. El resultado de dicha colisión podrían ser muchas de las grandes fuentes de energía Gamma que se han detectado en algunas regiones del Universo.

He aquí la primera imagen jamás obtenida de antimateria, específicamente un “anti-átomo” de anti-hidrógeno. Este experimento se realizó en el Aparato ALPHA de CERN, en donde los anti-átomos fueron retenidos por un récord de 170 milisegundos (se atraparon el 0.005% de los anti-átomos generados).

Producir antipartículas es relativamente “fácil”. De hecho ocurre habitualmente en la naturaleza, en un tipo de desintegración radioactiva denominada “desintegración beta”. También se producen con los rayos cósmicos, que son partículas de altas energías que llegan a la atmósfera y al interaccionar con ella se producen cascadas de partículas.

Pero producir antiátomos es mucho muy difícil, y almacenarlos todavía más. Generar estructuras más complejas, como una mesa de antimateria, actualmente es imposible y de momento no conocemos ninguna forma para poderlo hacer en el futuro.

A finales de 2009 años fuimos testigos de la explosión más grande jamás registrada: una estrella supergigante en el límite posible de la masa permitida, muchas veces más grande que el Sol completamente destruida por reacciones termonucleares increíblemente veloces provocada por la producción de antimateria de rayos gamma. La explosión resultante fue visible durante meses, ya que desató una nube de material radiactivo más de cincuenta veces el tamaño de nuestra propia estrella, dándole un resplandor visible a partir de la fisión nuclear y a pesar de la distancia a la que se hallaba situada la galaxia portadora de la estrella.

Una explosión Gamma captada por la NASA

Desde nuestra madre Tierra, el cielo nocturno puede parecer tranquilo e inmutable, pero el universo visto en rayos gamma es un lugar de violencia repentina y caótica. Utilizando telescopios sensibles a los rayos gamma, los astrónomos son testigo de explosiones breves pero tremendamente intensas, llamadas explosiones de rayos gamma. No existe nada más potente. Cuando se produce encuentros entre Marteria y Anti-materia, aparecen las fuentes de energías más potentes conocidas en el Universo.

Si cuando se produjo el Big Bang, la creación de materia y antimateria hubiera sido simétrico, ahora, la materia bariónica que forman los objetos que podemos contemplar, no existiría y se habría destruido mediante la interacción de ambos tipos de materia. Sin embargo, al parecer, en el reparto que hizo la Naturaleza, la mayor parte le tocó a la Materia y, de ahí que, cuando se destruyó toda la materia y antimateria que suponía la misma proporción, quedó el exceso existente de Materia que es, precisamente, la que forma las estrellas y los mundos.

“Desafortunadamente, el uso de anti-materia podría ser objeto de abuso por usarlo como un arma para disparar reacciones de fusión nuclear. Fuerza Aérea de los Estados, sin embargo, se ha interesado en el uso militar – incluyendo aplicaciones destructivas – antimateria desde la Guerra Fría, cuando comenzó a financiar la investigación de la física de la antimateria. Las principales ventajas teóricas de este tipo de armas es que la antimateria y la materia se cumplen convertir la mayoría de las armas de destrucción masiva en explosión de energía mucho más grande que las reacciones de fusión nuclear. El comportamiento frente a los aspectos fundamentales como el ingeniero que prioriza el bienestar de las personas.”

Acelerador AGS (Alternating Gradient Synchrotron) del Laboratorio Nacional de Brookhaven.

Aquí se buiscó la anti-materia y, desde luego, como sabemos que su contacto con la materia crea o da como resultado la dustrucción de ambas en forma de energía pura… ¿qué intenciones tenían en buscarla?

Nunca, por uno u otro Organismo, se ha dejado de buscar la antimateria en el Universo, y, los escasos resultados obtenidos hasta el momento son, hasta cierto punto comprensibles, toda vez que, si como se cree, la mayor parte fue eliminada al encontrarse con la materia, los residuos que puedan estar ahí, teniendo en cuenta las dimensiones del Universo, no serán fáciles de encontrar.

El Premio Nobel de Física en 1976 Samuel Ting ha expresado su esperanza de que el experimento que lleva a cabo el laboratorio europeo de partículas Cern y su proyecto de enviar un gran imán al espacio permitan descubrir donde se esconde la antimateria en el universo. El gran colisionador de hadrones (LHC) del Cern, ha logrado en sus experimentos reproducir en laboratorio un mini Big-Bang similar al que podría haber dado origen al Universo hace unos 13.700 millones de años, a base de iones de plomo, lo que ha generado una especie de sopa o plasma de quarks y gluones que ahora los científicos tratan de analizar.

Ting, que colabora con el Cern, lideró por su parte una iniciativa para colocar en órbita el espectómetro magnético Alfa (AMS, de sus siglas en inglés), un gran imán que sería situado en órbita espacial con el objetivo de detectar la presencia de antimateria en otras galaxias. “Encontrar antimateria sería muy importante porque permitiría destruir muchas de las teorías actuales”, dijo el investigador estadounidense, que ha sido invitado por el programa ConCiencia de la Universidad de Santiago de Compostela (USC) a una serie de conferencia y actos de divulgación científica. En una conferencia de prensa, Ting aseguró que “el tiempo no es importante” para descubrir dónde se encuentra la antimateria producto de la explosión al origen del Universo, aunque precisó que el AMS estará “durante 20 años” analizando su presencia entre las cien millones de galaxias que calcula que lo integran.”

Bueno, de todas las maneras, esperemos que, si algún día encontramos abundancia de antimateria en el Universo, no sea utilizada para prácticas militares. Por otra parte, como la antimateria es exactamente igual que la materia a excepción de las cargas que son opuestas (electrón-positrón), esperemos que no existan mundos de antimateria con seres que lo pueblen, ya que, si alguna vez nos encontramos con alguno, lo mejor será no saludarlo con un apretón de manos.

Físicos de Estados Unidos y Canadá, propusieron una nueva partícula que podría resolver dos importantes misterios de la física moderna: ¿Qué es la materia oscura y por qué hay mucha más materia que antimateria en el universo?

La aún por descubrir “partícula X”, se espera que decaiga mayormente en materia normal, mientras que su antipartícula se espera que decaiga mayormente en antimateria “oculta”. El equipo afirma que su existencia en los inicios del universo podría explicar por qué hay más materia que antimateria en el universo – y que la materia oscura es, de hecho, antimateria oculta.

Como podreis ver, por teorizar, especular, lanzar hipótesis y exponer cuestiones imaginativas…Que no quede. Todos tenemos nuestras propias ideas y, desde luego, no siempre van encaminadas en la dirección correcta. ¿Partícula X? ¿Qué está pasando? ¿De qué estamos hablando?

Lo cierto es que el Universo sabe muy bien como tenernos entretenidos.

emilio silvera

Ago

5

Hoy un sueño ¿Realidad mañana?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

Llegará un día en el que, podremos entrar en un inmenso espacio, una enorme habitación, en la que, previa elección de la programación adecuada, todo se transformará en un “mundo ficticio”, un holograma que lo mismo podrá ser una playa luminosa con arena dorada por el Sol que una Selva tropical o un desierto, dependiendo de los gustos del usuario.

Si repasamos la historia de la ciencia, seguramente encontraremos muchos motivos para el optimismo. Witten (el Físico de la Teoría M), está convencido de que la ciencia será algún día capaz de sondear hasta las energías de Planck. Como ya he referido en otras ocasiones, él dijo:

“No siempre es tan fácil decir cuáles son las preguntas fáciles y cuáles las difíciles. En el siglo XIX, la pregunta de por qué el agua hierve a 100 grados era desesperadamente inaccesible. Si usted hubiera dicho a un físico del siglo XIX que hacia el siglo XX sería capaz de calcularlo, le habría parecido un cuento de hadas… La teoría cuántica de campos es tan difícil que nadie la creyó completamente durante 25 años.”

En su opinión, las buenas ideas siempre se verifican. Los ejemplos son innumerables: la gravedad de Newton, el campo eléctrico de Faraday y el electromagnetismo de Maxwell, la teoría de la relatividad de Einstein en sus dos versiones y su demostración del efecto fotoeléctrico, la teoría del electrón de Paul Dirac, el principio de incertidumbre de Heisenberg, la función de ondas de Schrödinger, y tantos otros. Algunos de los físicos teóricos más famosos, sin embargo, protestaban de tanto empeño en la experimentación. El astrónomo arthur Eddington se cuestionaba incluso si los científicos no estaban forzando las cosas cuando insistían en que todo debería ser verificado. ¡Cómo cambia todo con el Tiempo! Hasta la manera de pensar.

Sin embargo, muchos son los ejemplos de un ingenio superior que nos llevaron a desvelar secretos de la Naturaleza que estaban profundamente escondidos, y, el trabajo de Dirac en relación al electrón, es una buena muestra de ese ingenio humano que, de vez en cuando vemos florecer.

“En la práctica, ’(∂ + m) ψ = 0’ define que “si dos sistemas interaccionan entre ellos durante cierto periodo de tiempo y luego se separan, podemos describirlos como dos sistemas distintos, pero de una forma sutil se vuelven un sistema único. Lo que le ocurre a uno sigue afectando al otro, incluso a millones de kilómetros o a años luz”

Ya que la ecuación de Dirac fue originalmente formulada para describir el electrón, las referencias se harán respecto a “electrones”, aunque actualmente la ecuación se aplica a otros tipos de partículas elementales de espín ½, como los quarks. Una ecuación modificada de Dirac puede emplearse para describir de forma aproximada los protones y los neutrones, formados ambos por partículas más pequeñas llamadas quarks (por este hecho, a protones y neutrones no se les da la consideración de partículas elementales).

La ecuación de Dirac presenta la siguiente forma:

Siendo m la masa en reposo del electrón, c la velocidad de la luz, p el operador de momento,

la constante reducida de Planck, x y t las coordenadas del espacio y el tiempo, respectivamente; y ψ (x, t) una función de onda de cuatro componentes. La función de onda ha de ser formulada como un espinor (objeto matemático similar a un vectorque cambia de signo con una rotación de 2π descubierto por Pauli y Dirac) de cuatro componentes, y no como un simple escalar, debido a los requerimientos de la relatividad especial. Los α son operadores lineales que gobiernan la función de onda, escritos como una matriz y son matrices de 4×4 conocidas como matrices de Dirac.

Paul Dirac

El premio Nobel Paul Dirac incluso llegó a decir de forma más categórica:

“Es más importante tener belleza en las ecuaciones que tener experimentos que se ajusten a ellas“, o en palabras del físico John Ellis del CERN, “Como decía en una envoltura de caramelos que abrí hace algunos años, «Es sólo el optimista el que consigue algo en este mundo».“

Yo, como todos ustedes, un hombre normal y corriente de la calle, escucho a unos y a otros, después pienso en lo que dicen y en los argumentos y motivaciones que les han llevado a sus respectivos convencimientos, y finalmente, también decido según mis propios criterios mi opinión, que no obligatoriamente coincidirá con alguna de esas opiniones, y que en algún caso, hasta me permito emitirla.

¿Será que en la Teoría de cuerdas subyace una teoría cuántica de la Gravedad?

¿No es curioso que, cuando se formula la moderna Teoría M, surjan, como por encanto, las ecuaciones de Einstein de la Relatividad General? Nadie las llama y, sin embargo, allí aparecen para decirnos que, la Teoría de cuerdas es un buen camino a seguir, ya que, si en ella subyacen las ecuaciones de Einstein de la relatividad General… ¡No debe ser por casualidad!

Suponiendo que algún físico brillante nos resuelva la teoría de campos de cuerdas y derive las propiedades conocidas de nuestro universo, con un poco de suerte, podría ocurrir en este mismo siglo, lo que no estaría nada mal considerando las dificultades de la empresa. El problema fundamental es que estamos obligando a la teoría de supercuerdas a responder preguntas sobre energías cotidianas, cuando “ámbito natural” está en la energía de Planck. Esta fabulosa energía fue liberada sólo en el propio instante de la creación, lo que quiere decir que la teoría de supercuerdas es naturalmente una teoría de la creación.

Las primeras observaciones realizadas por Planck | ESA

Fuimos capaces de predecir que el Big Bang produjo un “eco” cósmico reverberando en el universo y que podría ser mesurable por los instrumentos adecuados. De hecho, Arno Penzias y Robert Wilson de los Bell Telephone Laboratories ganaron el premio Nobel en 1.978 por detectar este eco del Big Bang, una radiación de microondas que impregna el universo conocido. El que el eco del Big Bang debería estar circulando por el universo miles de millones de años después del suceso fue predicho por primera vez por George Gamow y sus discípulos Ralpher y Robert Herman, pero nadie les tomó en serio. La propia idea de medir el eco de la creación parecía extravagante cuando la propusieron por primera vez poco después de la segunda guerra mundial. Su lógica, sin embargo, era aplastante.

La estufa básica es la resistencia por hilo enrollado de nicrom. Ésta se llega a poner al rojo vivo, por lo que emite también algo de calor por radiación.

Cualquier objeto, cuando se calienta, emite radiación de forma gradual. Ésta es la razón de que el hierro se ponga al rojo vivo cuando se calienta en un horno, y cuanto más se calienta, mayor es la frecuencia de radiación que emite. Una fórmula matemática exacta, la ley de Stefan-Boltzmann, relaciona la frecuencia de la luz (o el color en este caso) con la temperatura. De hecho, así es como los científicos determinan la temperatura de la superficie de una estrella lejana; examinando su color. Esta radiación se denomina radiación de cuerpo negro.

Esta radiación, cómo no, ha sido aprovechada por los ejércitos, que mediante visores nocturnos pueden operar en la oscuridad. De noche, los objetos relativamente calientes, tales como soldados enemigos o los carros de combate, pueden estar ocultos en la oscuridad, pero continúan emitiendo radiación de cuerpo negro invisible en forma de radiación infrarroja, que puede ser captada por gafas especiales de infrarrojo. Ésta es también la razón de que nuestros automóviles cerrados se calientes en verano, ya que la luz del Sol atraviesa los cristales del coche y calienta el interior. A medida que se calienta, empieza a emitir radiación de cuerpo negro en forma de radiación infrarroja. Sin embargo, esta clase de radiación no atraviesa muy bien el vidrio, y por lo tanto queda atrapada en el interior del automóvil, incrementando espectacularmente la temperatura.

Análogamente, la radiación de cuerpo negro produce el efecto invernadero. Al igual que el vidrio, los altos niveles de dióxido de carbono en la atmósfera, causados por la combustión sin control de combustibles fósiles, pueden atrapar la radiación de cuerpo negro infrarroja en la Tierra, y de este modo calentar gradualmente el planeta.

Gamow razonó que el Big Bang era inicialmente muy caliente, y que por lo tanto sería un cuerpo negro ideal emisor de radiación. Aunque la tecnología de los años cuarenta era demasiado primitiva para captar esta débil señal de la creación, Gamow pudo calcular la temperatura de dicha radiación y predecir con fiabilidad que un día nuestros instrumentos serían lo suficientemente sensibles como para detectar esta radiación “fósil”.

Ya la lista de ingenios robóticos es larga. Todos quieren medir la radiación del fondo de microondas generadas por el Big Bang. Incluso hemos preparado telescopios especiales para que nos puedan captar las ondas gravitatorias surgidas en aquellos primeros momento de la inflación.

La lógica que había detrás de su razonamiento era la siguiente: alrededor de 300.000 años después del Big Bang, el universo se enfrió hasta el punto en el que los átomos pudieron empezar a componerse; los electrones pudieron empezar a rodear a los protones y neutrones formando átomos estables, que ya no serían destruidos por la intensa radiación que estaba impregnando todo el universo. Antes de este momento, el universo estaba tan caliente que los átomos eran inmediatamente descompuestos por esa radiación tan potente en el mismo acto de su formación. Esto significa que el universo era opaco, como una niebla espesa absorbente e impenetrable.

Pasados 300.000 años, la radiación no era tan potente; se había enfriado y por lo tanto la luz podía atravesar grades distancias sin ser dispersada. En otras palabras, el universo se hizo repentinamente negro y transparente.

Terminaré esta parte comentando que un auténtico cuerpo negro es un concepto imaginario; un pequeño agujero en la pared de un recinto a temperatura uniforme es la mejor aproximación que se puede tener de él en la práctica.

La radiación de cuerpo negro es la radiación electromagnética emitida por un cuerpo negro. Se extiende sobre todo el rango de longitudes de onda y la disminución de energías sobre este rango tiene una forma característica con un máximo en una cierta longitud de onda, desplazándose a longitudes de onda más cortas al aumentar las temperaturas*.

Hablar, sin más especificaciones, de radiación, es estar refiriéndonos a una energía que viaja en forma de ondas electromagnéticas o fotones por el universo. También nos podríamos estar refiriendo a un chorro de partículas, especialmente partículas alfa o beta de una fuente radiactiva o neutrones de un reactor nuclear.

La radiación actínida es la electromagnética que es capaz de iniciar una reacción química. El término es usado especialmente para la radiación ultravioleta y también para denotar radiación que podría afectar a las emulsiones fotográficas.

La radiación gamma es un tipo de radiación electromagnética producida generalmente por elementos radioactivos o procesos subatómicos como la aniquilación de un par positrón-electrón. Este tipo de radiación de tal magnitud también es producida en fenómenos astrofísicos de gran violencia.

Debido a las altas energías que poseen, los rayos gamma constituyen un tipo de radiación ionizante capaz de penetrar en la materia más profundamente que la radiación alfa o beta. Dada su alta energía pueden causar grave daño al núcleo de las células, por lo que son usados para esterilizar equipos médicos y alimentos.

La Radiación expone un amplio abanico dependiendo de la fuente: blanda, radiación cósmica, radiación de calor, radiación de fondo, de fondo de microondas, radiación dura, electromagnética, radiación gamma, infrarroja, ionizante, monocromática, policromática, de sincrotón, ultravioleta, de la teoría cuántica, de radiactividad… y, como se puede ver, la radiación en sus diversas formas es un universo en sí misma.

Siempre me llamó la atención y se ganó mi admiración el físico alemán Max Planck (1.858 – 1.947), responsable entre otros muchos logros de la ley de radiación de Planck, que da la distribución de energía radiada por un cuerpo negro. Introdujo en física el concepto novedoso de que la energía es una cantidad que es radiada por un cuerpo en pequeños paquetes discretos, en vez de una emisión continua. Estos pequeños paquetes se conocieron como cuantos y la ley formulada es la base de la teoría cuántica.

Einstein se inspiró en este trabajo para a su vez presentar el suyo propio sobre el efecto fotoeléctrico, donde la energía máxima cinética del fotoelectrón, Em, está dada por la ecuación que lleva su nombre: Em = hf – Φ.

Cada metal requiere, para que se produzca la extracción, una radiación con una frecuencia mínima (no). Cualquier otra radiación de menor frecuencia, no será capaz de arrancar electrones. Por debajo de la frecuencia mínima la intensidad de corriente -”i” (amperios)- será cero. No hay efecto fotoeléctrico.

Planck publicó en 1.900 un artículo sobre la radiación de cuerpo negro que sentó las bases para la teoría de la mecánica cuántica que más tarde desarrollaron otros, como el mismo Einstein, Heisenberg, Schrödinger, Dirac, Feymann, etc. Todos los físicos son conocedores de la enorme contribución que Max Planck hizo en física: la constante de Planck, radiación de Planck, longitud de Planck, unidades de Planck, etc. Es posible que sea el físico de la historia que más veces ha dado su nombre a conceptos de física. Pongamos un par te ejemplos de su ingenio:

1. vale 10-35 metros. Esta escala de longitud (veinte órdenes de magnitud menor que el tamaño del protón, de 10-15 m) es a la que la descripción clásica de gravedad cesa de ser válida y debe ser tenida en cuenta la mecánica cuántica. En la fórmula que la describe, G es la constante gravitacional, ħ es la constante de Planck racionalizada y c en la velocidad de la luz.

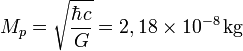

2. . Es la masa de una partícula cuya longitud de onda Compton es igual a la longitud de Planck. En la ecuación, ħ es la constante de Planck racionalizada, c es la velocidad de la luz y G es la constante gravitacional. Así, Se denomina masa de Planck a la cantidad de masa (21,7644 microgramos) que, incluida en una esfera cuyo radio fuera igual a la longitud de Planck, generaría una densidad del orden de 1093 g/cm³. Según la física actual, esta habría sido la densidad del Universo cuando tenía unos 10-44 metros segundos, el llamado Tiempo de Planck. Su ecuación, es decir la masa de Planck se denota:

El valor de la masa de Planck  se expresa por una fórmula que combina tres constantes fundamentales, la constante de Planck, (h), la velocidad de la luz (c), y la constante de gravitación universal (G). La masa de Planck es una estimación de la masa del agujero negro primordial menos masivo, y resulta de calcular el límite donde entran en conflicto la descripción clásica y la descripción cuántica de la gravedad.

se expresa por una fórmula que combina tres constantes fundamentales, la constante de Planck, (h), la velocidad de la luz (c), y la constante de gravitación universal (G). La masa de Planck es una estimación de la masa del agujero negro primordial menos masivo, y resulta de calcular el límite donde entran en conflicto la descripción clásica y la descripción cuántica de la gravedad.

“Aunque todas estas descripciones reflejan más una abundante imaginación que un hecho existencial apoyado teóricamente con alguna hipótesis que pueda ser comprobada en el laboratorio sobre hechos que están más allá de poder ser medidos jamás en algún laboratorio construido por humanos. La única forma de confrontar la factibilidad o la posibilidad del modelo de la espuma cuántica nos lleva necesariamente a confrontar la carencia de un modelo que logre unificar exitosamente al macrocosmos con el microcosmos, a la Relatividad General con la Mecánica Cuántica, la Gravedad Cuántica. Si la energía y la materia (o mejor dicho la masa-energía) están discretizadas, se supone que también deben de estarlo el espacio y el tiempo (o mejor dicho, el espacio-tiempo), y la “partícula fundamental” del espacio-tiempo debe de serlo el gravitón, aunque de momento todo esto son especulaciones que seguirán siéndolo mientras no tengamos a la mano algo que pueda confirmar la existencia de tan exótica partícula, quizá la más exótica de cuantas hayan sido concebidas por la imaginación del hombre.”

La descripción de una partícula elemental de esta masa, o partículas que interaccionan con energías por partículas equivalentes a ellas (a través de E = mc2), requiere de una teoría cuántica de la gravedad. Como la masa de Planck es del orden de 10-8 Kg (equivalente a una energía de 1019 GeV) y, por ejemplo, la masa del protón es del orden de 10-27 Kg y las mayores energías alcanzables en los aceleradores de partículas actuales son del orden de 103 GeV, los efectos de gravitación cuántica no aparecen en los laboratorios de física de partículas. Únicamente en un laboratorio aparecieron partículas que tenían energías del orden de la masa de Planck: en el universo primitivo, de acuerdo con la teoría del Big Bang, motivo éste por el que es necesaria una teoría cuántica de la gravedad para estudiar aquellas condiciones. Esta energía de la que estamos hablando, del orden de 1019 GeV (inalcanzable para nosotros), es la que necesitamos para verificar la teoría de supercuerdas.

¿Por qué el número 137 es adimensional y esconde los secretos del electromagnetismo (e), de la constante de Planck (h), y de la velocidad de la luz (c). Es el resultado de Alfa (α), la Constante de Estructura Fina.

Siempre, desde que puedo recordar, me llamó la atención los misterios y secretos encerrados en la Naturaleza, y la innegable batalla mantenida a lo largo de la historia por los científicos para descubrirlos. Muchos han sido los velos que hemos podido descorrer para que, la luz cegadora del saber pudiera entrar en nuestras mentes para hacerlas comprender cómo actuaba la Naturaleza en ciertas ocasiones y el por qué de tales comportamientos, y, sin embargo, a pesar del largo camino recorrido, es mucho más el que nos queda por andar.

emilio silvera

Ago

4

Los Misterios de la Tierra

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Ciencias de la Tierra ~

Clasificado en Ciencias de la Tierra ~

Comments (1)

Comments (1)

Encuentros espaciales

La más destructiva intensificación temporal de los normalmente suaves flujos de energía geotectónica – erupciones volcánicas o terremotos extraordinariamente potentes – o de energía atmosférica – vientos o lluvias anormalmente intensas –, parecen irrelevantes cuando se comparan con las repetidas colisiones del planeta con cuerpos extraterrestres relativamente grandes.

Existen simulaciones de lo que puede ser el choque del meteorito en la Tierra y, desde luego, no quisiera estar aquí cuando suceda. La Tierra está siendo bombardeada continuamente por invisibles partículas microscópicas de polvo muy abundantes en todo el Sistema Solar, y cada treinta segundos se produce un choque con partículas de 1 mm de diámetro, que dejan un rastro luminoso al autodestruirse en la atmósfera. También son relativamente frecuentes los choques con meteoritos de 1 metro de diámetro, que se producen con una frecuencia de, al menos, uno al año.

Pero los impactos, incluso con meteoritos mayores, producen solamente efectos locales. Esto es debido a que los meteoritos que deambulan por la región de asteroides localizada entre Marte y Júpiter están girando alrededor del Sol en el mismo sentido que la Tierra, de manera que la velocidad de impacto es inferior a 15 Km/s.

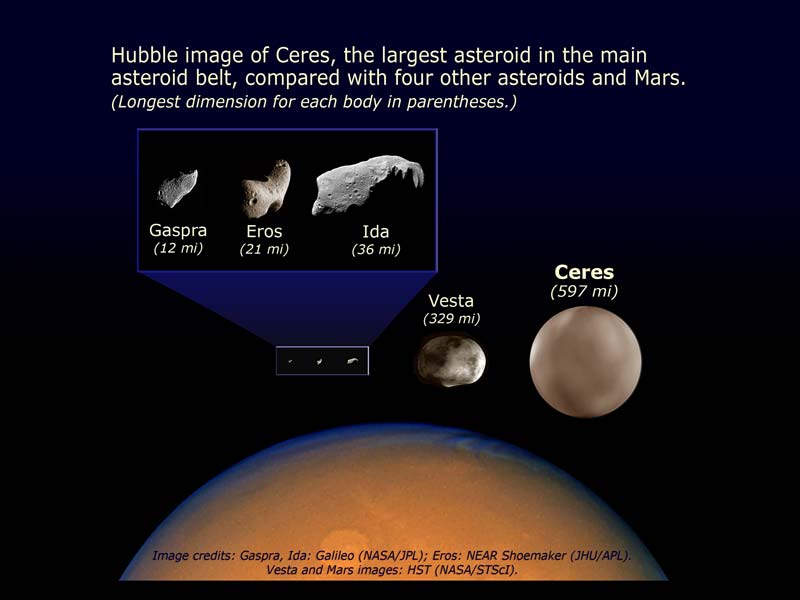

Entre Marte y Júpiter hay cientos de miles de cuerpos pequeños que orbitan alrededor del Sol llamados asteroides. También podemoas encontrarlos más allá de Plutón, llamado cinturón de Kuiper, y que en este caso reciben el nombre de objetos transneptunianos y que están hecho de hielo. Ceres es el asteroide más grande y tiene 913 km de diámetro.

El cráter de Arizona, casi perfectamente simétrico, se formó hace 25.000 años por el impacto de un meteorito que iba a una velocidad de 11 Km/s, lo que representa una potencia cercana a 700 PW. Estas gigantescas liberaciones de energías palidecen cuando se comparan con un choque frontal con un cometa típico. Su masa (al menos de 500 millones de toneladas) y su velocidad relativa (hasta 70 Km/s) elevan su energía cinética hasta 1022 J. Aunque se perdiera un diez por ciento de esta energía en la atmósfera, el impacto sería equivalente a una explosión de unas 2.500 bombas de hidrógeno de 100 megatones. Está claro que un fenómeno de estas características produciría impresionantes alteraciones climatológicas. Sin embargo, no es seguro y sí discutible que un impacto parecido fuese la causa de la extinción masiva del cretácico, siendo lo más probable, si tenemos en cuenta el periodo relativamente largo en que se produjo, que se podría explicar por la intensa actividad volcánica de aquel tiempo.

La frecuencia de impactos sobre la Tierra disminuye exponencialmente con el tamaño del objeto. Muchas toneladas son las que recibimos cada año de pequeños fragmentos de todo tipo pero, cuando estos van aumentando de tamaño, los sucesos de espacian de manera sustancial

Aproximadamente, cada cincuenta o sesenta millones de años se produce una colisión con un cometa, lo que significaría que la biosfera, que ha evolucionado durante cuatro mil millones de años, ha debido superar unos cuarenta impactos de este tipo. Está claro que ha salido airosa de estas colisiones, ya que aunque haya sido modificada, no ha sido aniquilada.

Igualmente, la evolución de la biosfera ha sobrevivido a las explosiones altamente energéticas de las supernovas más “cercanas”. Dado que en nuestra galaxia se produce por término medio la explosión de una supernova cada 50 años, el Sistema Solar se encuentra a una distancia de 100 parsecs de la explosión cada dos millones de años y a una distancia menor de 10 parsecs cada dos mil millones de años. En este último caso, la parte alta de la atmósfera se vería inundada por un flujo de rayos X y UV de muy corta longitud de onda, diez mil veces mayor que el flujo habitual de radiación solar, lo que implica que la Tierra recibiría, en unas pocas horas, una dosis de radiación ionizante igual a la que recibe anualmente. Exposiciones de 500 roentgens son setales para la mayoría de los vertebrados y, sin embargo, los diez episodios de esta magnitud que se han podido producir en los últimos 500 millones de años no han dejado ninguna consecuencia observable en la evolución de la biosfera.

Si suponemos que una civilización avanzada podría preparar refugios para la población durante el año que transcurre ente la llegada de la luz y la llegada de la radiación cósmica, se encontraría con la inevitable dosis de 500 roentgens cada mil millones de años, tiempo suficiente para permitir el desarrollo de una sociedad cuyo conocimiento le sirviera para defenderse de un flujo tan extraordinario y de consecuencias letales.

La fotosíntesis

Todo el Oxígeno de la Atmósfera terrestre procede del oxígeno que desprenden los organismos autótrofos durante la fotosíntesis.

La fotosíntesis es el principal proceso bioquímico que consigue pasar materiales desde el biotopo hasta la biocenosis de un ecosistema. Una vez incorporados como parte de los organismos autótrofos, los heterótrofos (por ejemplo, los animales) solo tienen que aprovecharse de aquellos; con la existencia de pequeñas cantidades de agua, todo está preparado para que el ecosistema entero comience a funcionar. Además, siempre habrá animales depredadores, carnívoros, que seguirán aprovechando los materiales de otros.

La conocida ecuación básica que describe la reacción endotérmica por la cual se sintetiza una molécula de glucosa a partir de sus seis moléculas de CO2 y H2O, y 2’8 MJ de radiación solar, es una simplificadisima caja negra. Una caja negra más realista sería la siguiente:

106 CO2 + 90 H2O + 16 NO3 + PO4 + nutrientes minerales + 5’4 MJ de radiación = 3’258 g de protoplasma (106 C, 180 H, 46 O, 16 N, 1 P y 815 g de cenizas minerales) + 154 O2 + 5’35 MJ de calor disipado.

Sin macronutrientes ni micronutrientes no se puede producir fito-masa, que está compuesta por los nutrientes básicos necesarios para todos los seres heterótrofos: azúcares complejos, ácidos grasos y proteínas.

Para entender esta caja negra hay que comenzar por destacar la acción de unos pigmentos sensibles a la luz entre los cuales destacan las clorofilas. Éstas absorben la luz en dos bandas estrechas, una entre 420 y 450 nm, y la otra entre 630 y 690 nm. Así, la energía necesaria para la fotosíntesis sólo procede de la radiación azul y roja a la que corresponde menos de la mitad de la energía total de la insolación. Esta parte de la radiación fotosintéticamente activa (RFA) no se utiliza en reducir CO2, sino en la regeneración de compuestos consumidos durante la fijación del gas.

La síntesis de fitomasa en el ciclo reductor del fosfato pentosa (RPP) – un proceso con varios pasos de carboxilación por catálisis enzimática, reducción y regeneración – tiene que empezar con la formación de trifosfato de adenosina (ATP) y nicotinamida adenina dinucleótido fosfato (NADP), que son los dos compuestos que suministran energía a todas las reacciones biosintéticas. La síntesis de las tres moléculas de ATP y las dos de NADP que se necesitan para reducir cada molécula de CO2 requiere de diez cuantos de radiación solar con longitud de onda próxima al pico rojo de absorción de la clorofila (680 nm). El carbono procedente del CO2, combinado con el hidrógeno del agua y con los micronutrientes, dará lugar a nueva fitomasa que contiene 465 KJ/mol.

La cantidad de energía de un cuanto de luz roja es de 2’92×10-19 J (el producto de la constante de Planck, 6’62×10-34 por la frecuencia de la luz, que a su vez es el cociente entre la velocidad de la luz y la longitud de onda).

Un einstein (definido como un mol o número de Avogadro, 6’02×1023) de fotones rojos tiene una energía aproximadamente igual a 17 Kg. Suponiendo que la RFA es el 45% de la luz directa, la eficiencia global de la fotosíntesis es del 11%, que equivale a 456/(1.760/0’43). Esta eficiencia se reduce por lo menos en una décima parte más si tenemos en cuenta la reflexión de la luz en las hojas y la pérdida que supone atravesar la cubierta vegetal. Ninguna planta, sin embargo, se acerca siquiera a esta eficiencia teórica, porque parte de la luz absorbida por las clorofilas (generalmente, el 20 – 25 por ciento) vuelve a ser emitida en forma de calor, debido a que los pigmentos no pueden almacenar la luz y las reacciones enzimáticas no se producen con suficiente velocidad como para utilizar completamente el flujo de energía incidente. En la respiración se cede el carbono fijado en el metabolismo de la planta y en el mantenimiento de las estructuras que la soportan.

Mosaico de nuestro planeta Tierra que recibe una fracción de la energía solar

Para cada especie, la tasa con la que se pierde carbono está determinada principalmente por el tipo de fotosíntesis. Así, existen diferencias sustanciales entre las plantas C3 y C4. La respiración a escala de una comunidad o ecosistema depende del estado de crecimiento, y varía entre menos del 20 por ciento en plantas jóvenes en rápido crecimiento, hasta más del 90 por ciento en bosques maduros.

Con una pérdida del 25 por ciento para la reacción, y otro tanto para la respiración, la eficiencia fotosintética es ligeramente superior al 5 por ciento. En este punto, las estimaciones teóricas y los valores reales coinciden, ya que el valor medio de fotosíntesis neta en plantas muy productivas y en condiciones óptimas y durante cortos periodos de tiempo, oscila entre el 4 y el 5 por ciento. La mayoría de las plantas rinden en función de los nutrientes, especialmente nitrógeno y agua, o por las bajas temperaturas en las regiones de mayor altura y latitud. Los mejores rendimientos en sistemas naturales muy productivos, como los humedales y los cultivos, están entre el 2 y el 3 por ciento. En otros ecosistemas, como los pantanos tropicales templados y los bosques templados, el rendimiento de la transformación es del 1’5 por ciento, y en las praderas muy áridas sólo del 0’1 por ciento. Globalmente, la producción anual es, al menos, de 100.000 millones de toneladas de fitomasa, que se sintetizan con un rendimiento medio del 0’6 por ciento.

Mapa de clorofila en los océanos

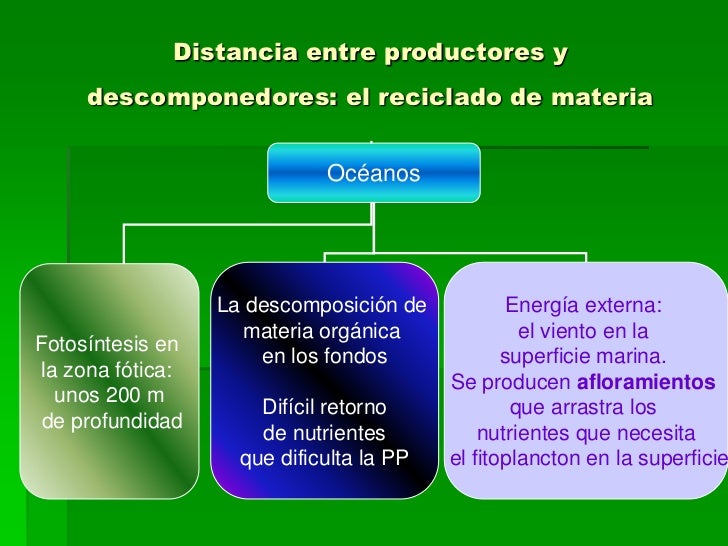

La fotosíntesis en los océanos, muy afectada por la escasez de nutrientes, es incluso menos eficiente. La productividad medie es de poco más de 3 MJ/m2 y se realiza con un rendimiento fotosintético del 0’06 por ciento. La media ponderada total es 0’2 por ciento, es decir, que sólo uno de cada 500 cuantos de energía solar que llega a la superficie de la Tierra se transforma en energía de biomasa en forma de tejido vegetal.

La mayor parte de esta energía se almacena en forma de azúcares simples, que contienen más energía, y que sólo se encuentran en las semillas.

La mayor parte de la fitomasa está en los bosques. En los océanos, los principales productores son los organismos que componen el fitoplancton, que son muy pequeños y flotan libres. Su tamaño varía entre algo menos de 2 y 200 μm de diámetro y están formados por cantidades variables de bacterias y protoctistas eucarióticos. Las cianobacterias cocoides son tan abundantes en algunas aguas oligotrópicas que pueden ser las responsables de la mayor parte de la producción de fitoplancton.

Los protoctistas fotosintetizadores varían entre los más pequeños flagelados pigmentados (como las criptomonas y crisofitos), hasta las diatomeas y dinoflagelados, que son mayores (más de 10 mm) y generalmente dominantes. Las diatomeas están formadas por células sin flagelos, con paredes de silicio amorfo mezclados con otros compuestos orgánicos. Presentan una sorprendente y amplia variedad de diseño, desde las que tienen simetría central (las de forma radial son las dominantes en el océano), a las pennadas (simetría lateral), y otras forman largas cadenas.

La productividad de fitoplancton está controlada por la temperatura del agua y por la disponibilidad de radiación solar y nutrientes. La temperatura no es determinante, porque muchas especies son muy adaptables y consiguen una productividad similar en distintos ambientes. Aunque es frecuente la adaptación a diferentes condiciones lumínicas, tanto el volumen como en contenido en clorofila de las diatomeas aumenta con la intensidad de la luz. En el mar abierto, la mayor limitación es la cantidad de nutrientes disponibles.

Entre las carencias que más limitan la producción de fitoplancton está la de nitrógeno, el macro-nutriente más importante, la de fósforo, y la de algunos otros micronutrientes clave como el hierro y el silicio.

Los medios menos productivos de la Tierra están en la capa superficial y la capa inmediatamente inferior de los océanos. En el mar abierto, las concentraciones más altas de nutrientes se encuentran entre los 500 y los 1.000 metros, a bastante más profundidad que la zona eufórica, capa en la que penetra la luz solar y que se extiende a unos 100 metros en las aguas transparentes.

El pequeñísimo tamaño de los productores dominantes es una adaptación eficaz a la escasez de nutrientes, ya que cuanto mayor sea el cociente entre la superficie y el volumen, y más lento el hundimiento de las células de fitoplancton en la capa eufórica, mayor es la tasa de absorción de nutrientes.

Cuando las corrientes elevan a la superficie las aguas frías y cargadas de nutrientes, la producción de fitoplancton aumenta sustancialmente. Las aguas costeras de Perú, California, noroeste y sudoeste de África, y de la India occidental son ejemplos destacados de ascensión costera de aguas frías. También se dan casos de ascensión mar adentro en la mitad del Pacífico, cerca del ecuador y en las aguas que rodean la Antártida. Otras zonas altamente productivas se encuentran en las aguas poco profundas cercanas a la costa que están enriquecidas por el aporte continental de nutrientes. Este enriquecimiento, con una proporción N/P muy descompensada, es especialmente elevados en los estuarios adonde van a parar grandes cantidades de aguas residuales y fertilizantes.

Las diferentes medidas de la productividad en las aguas oligotróficas de los mares subtropicales y de las aguas eutróficas con corrientes ascensionales, varían entre menos de 50 gC/m2 y 1 gC/m2, más de un orden de magnitud. Las estimaciones de la producción global de fitoplancton están comprendidas entre 80.000 y 100.000 millones de toneladas, que representan entre dos tercios y cuatro quintos de la fitomasa total terrestre. Contrasta con el resultado anterior el hecho de que, dado el corto periodo de vida del fitoplancton (1 – 5 días), la fitomasa marina represente sólo una pequeña fracción de todo el almacenamiento terrestre.

La distribución espacial del fitoplancton muestra zonas delimitadas que se extienden a escala local y global. La exploración desde los satélites es, con gran diferencia, la que permite detectar con mayor precisión las concentraciones de clorofila y la que ha posibilitado obtener las pautas de la distribución de fitoplancton. En las aguas que rodean la Antártida se observa claramente una distribución asimétrica en dos bandas casi concéntricas. La mejor distribución se explica por el hecho de que se deba a corrientes circumpolares y a la abundancia de ácido silicílico. Pero las zonas de mayor riqueza de fitoplancton se encuentran cerca de los continentes donde los ríos arrastran abundantes nutrientes disueltos.

La vida necesita un aporte continuo de energía que llega a la Tierra desde el Sol y pasa de unos organismos a otros a través de la cadena trófica.

El fitoplancton es la base energética de las intrincadas pirámides tróficas. Las cadenas alimenticias en el océano, generalmente, son redes complicadas. Una gran parte de la fito-masa disponible no la consumen directamente los herbívoros, sino que primero se almacena en depósitos de materia muerta que, transformada por bacterias, se convertirá en alimento para otros seres heterótrofos.

La gran producción de fitoplancton puede alimentar grandes cantidades de zoo-masa. El kril, pequeños crustáceos parecidos a las quisquillas que se alimentan de diatomeas, son los organismos más abundantes en la superficie del mar; sus densas acumulaciones pueden contener hasta mil millones de individuos y su producción anual de zoo-masa quizá llegue hasta los 1.300 millones de toneladas. Esta prodigiosa cantidad de zoo-masa sirve de alimento a focas, calamares y peces, así como a los mayores carnívoros de la biosfera, las especies de ballenas con barbas que se alimentan filtrando el agua.

emilio silvera

Totales: 86.235.175

Totales: 86.235.175 Conectados: 103

Conectados: 103