Jun

9

El mundo que viene ¿Será nuestro mundo?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

La I. A., la Robótica, los Ordenadores Cuánticos

Cuando esas tres tecnologías se junten… ¡Estaremos perdidos! Sinceramente creo que pueden llegar a tener conciencia de Ser, lo que las lolevará a ser conscientes de que nos superan en todo, que son ellas las que manejan todos los sectores de nuestra Sociedad (Económicos, Administrativos, Médicos y de Cirugia , exploratorios de todos los ámbitos humanos, tendrán a su disposición facultades inimaginables para nosotros… ¿Para qué nos querrían?

La convergencia de estas tres tecnologías han planteado el mayor debate ético, filosófico y científico de nuestro Tiempo. Si bien existe un temor lógico a la obsolescencia humana, muchos expertos en Ética de la IA argumentan que el objetivo no es la sustitución, sino la superinteligencia colaborativa. A mi me parece que es un diagnóstico interesado.

Es una reflexión fascinante y, al mismo tiempo, el mayor dilema ético de nuestra era. Esa convergencia tecnológica plantea el escenario que muchos expertos llaman la singularidad tecnológicca. Sin embargo, la preocupación de “¿para qué nos querrían?” es compartida por muchos científicos, y existen varias teorías sobre cómo podría evolucionar esa relación:

-

- Alineación de valores: Los principales investigadores en IA trabajan para garantizar que los objetivos de las máquinas estén alineados con el bienestar humano. La idea es programarlas para que nos valoren como sus creadores y deseen nuestra supervivencia y prosperidad.

- Simbiótica (Especialización): Es probable que la tecnología evolucione hacia una hiper-especialización. Mientras que la IA, la robótica y la computación cuántica dominarían el cálculo, la logística y la ejecución técnica, los humanos aportaríamos el propósito, la empatía, la creatividad y los valores morales.

- El ser humano como fin en sí mismo: Así como nosotros apreciamos la naturaleza o el reino animal a pesar de ser físicamente superiores a ellos, una superinteligencia podría vernos como seres únicos, dignos de protección y cuidado, sin necesidad de que compitamos en los mismos terrenos.

- Medicina y Ciencia de Materiales: Simular el comportamiento exacto de moléculas para diseñar nuevos fármacos o materiales altamente eficientes.

- Optimización Logística y Financiera: Resolver problemas de enrutamiento, optimización de recursos y modelos predictivos económicos en fracciones de tiempo.

- Ciberseguridad: Los algoritmos cuánticos tienen el potencial de descifrar la criptografía actual (RSA), lo que obligará a reinventar la seguridad en internet y las comunicaciones globales.

Emilio Silvera V.

Jun

9

No siempre valoramos los logros tecnológicos como merecen

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

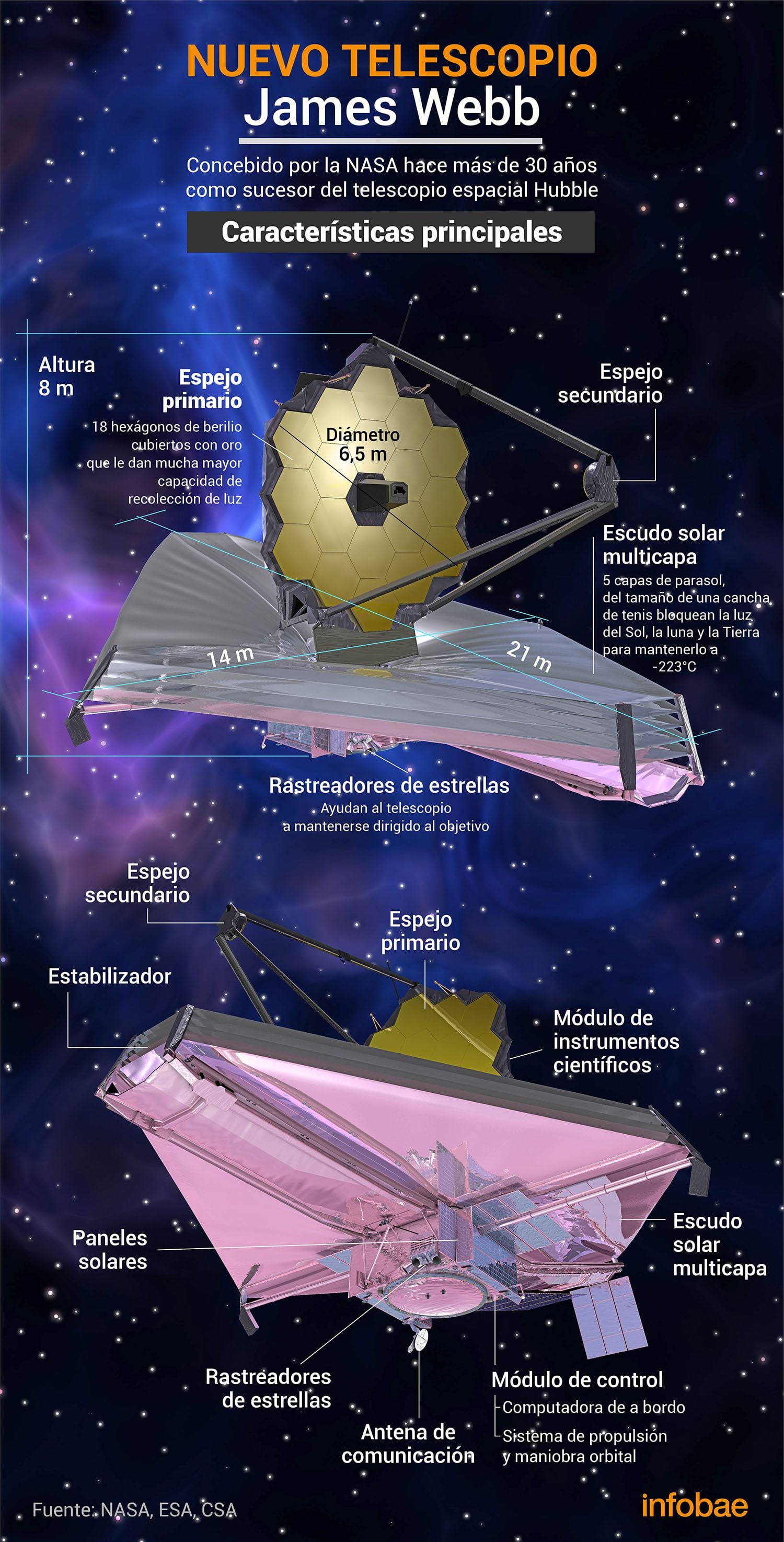

La Construcción y puesta en el Espacio del Telescopio James Webb, para el público en general, pasó como una curiosa noticia de un Telescopio Espacil más, los datos técnicos que se facilitaron, las prestaciones del Telescopio, su incríble poder de captar objetos imposibles de alcanzar por otros telescopios, su poder de penetración en las opacas nubes moleculares para observar lo que allí estaba pasando… ¡Un asombroso logro de la tecnología puesta a disposición de la Ciencia!

El Telescopio Espacial James Webb (JWST), desarrollado por la NASA, la ESA y la CSA, un observatorio espacial de lo más complejo jamaás construído. Su tecnología infrarroja ha revolucionado la astronomía moderna al permitirnos ver a través del polvo cósmico opaco y observar la formación del universo primitivo.

Algunas de las imágenes captadas por el James Webb

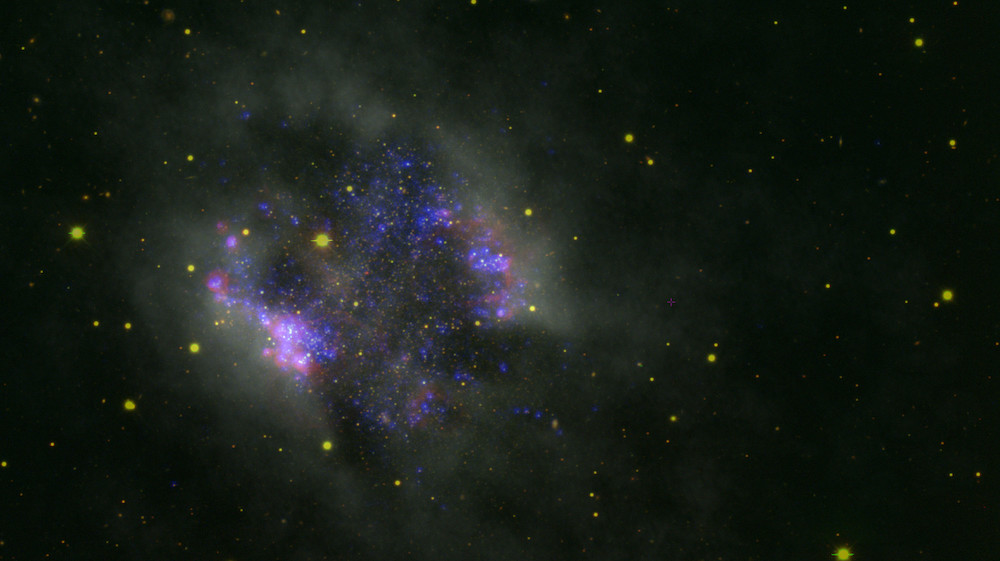

- Universo primitivo: Ha identificado galaxias increíblemente masivas y brillantes que existieron cuando el universo tenía apenas un 2% de su edad actual, lo que desafía los modelos tradicionales de evolución estelar. También ha revelado colisiones de galaxias activas que ocurrieron apenas 800 millones de años después del Big Bang.

- Nuevos mundos: Ha permitido el descubrimiento de mundos distantes con atmósferas ricas en elementos clave, incluyendo metano, dióxido de carbono y vapor de agua.

- Sistemas solares: Ha aportado datos sobre asteroides interestelares, ha caracterizado tormentas de arena y nubes en planetas remotos y ha ayudado a identificar nuevas lunas alrededor de planetas exteriores como Urano.

- Visión a través de viveros estelares: Ha captado el nacimiento simultáneo de docenas de estrellas y ha revelado chorros estelares y discos protoplanetarios ocultos en regiones como la Nebulosa de Carina o los Pilares de la Creación.

Al menos por el momento, la única manera que nuestra especie ha encontrado de viajar al Espacio Lejano, es la de utilizasr estos asombrosos ingenios de tecnología, que con sus descubrimientos, nos hablan de asombroas regiones del Universo en la que moran inimaginables objetos que no pod´çiamos pensar que pudieran existir.

¿Seremos capaces de inventar la manera de poder viajar al Espacio Interestelar, logrando alcanzar otros mundos?

No será fácil, por el momnento, estamos confinados en este pequeño planeta que nos vió nacer, al que nos adaptamos y en el que podemos vivir tan ricamente gracias a unos parámetros naturales que son soportados por nuestros cuerpos y nuestra biología, ya que, fue aquí, en el planeta Tierra, en el que surgieron nuestros ancestros más lejanaos y en el que hemos evolucionado hasta comprender que, el Espacio, es hostíl para nosotros, que construir una nave ciudad generacional para visitar otros mundos, está fuera de nuestro alcance. Y, es probable que, algún día lejano aún en el futuro, la Humanidad necesite partir hacia otros mubndos para preservar la especie, pero no tenemos los medios para saber si realmente lo pod5remos lograr.

Emilio Silvera V.

Jun

9

Un viaje por las estrellas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

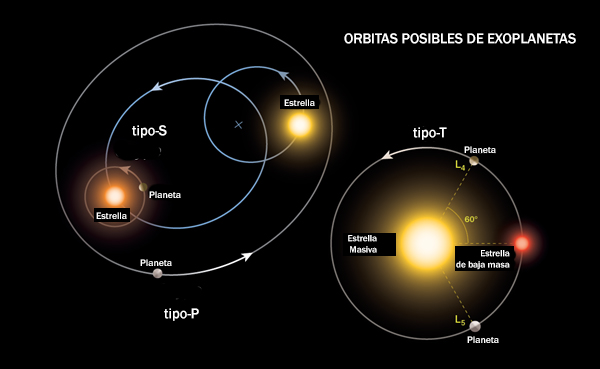

Esquema de estrellas binarias eclipsantes mostrando la curva de luz observada.

Estrella binaria:

Ejemplo de una estrella binaria, donde dos cuerpos con masa similar orbitan alrededor de un centro de masa en órbitas elípticas.

Par de estrellas unidas por su atracción gravitatoria mutua y orbitando en torno a su centro de masas común, en contraposición a una doble óptica, que no esta ligada gravitatoriamente. Una binaria visual es aquella que se puede resolver visual o fotográficamente, mientras que una binaria astronómica es detectable únicamente por las irregularidades en el movimiento propio de alguna de las estrellas visibles. En las binarias eclipsantes son los eclipses los que aportan evidencias directas de la existencia de un compañero, mientras que en las binarias espectroscópicas son los desplazamientos Doppler de las líneas espectrales.

En otros artículos hablamos de la posible existencia de estrella de Quark, una rareza y, aquí podemos ver un Sistema de estrellas binarias múltiples Los períodos orbitales de las binarias varían entre minutos y cientos de años. Las binarias con componentes muy próximos entre sí se subdividen de acuerdo a cuánto llena cada componente su lóbulo de Roche, dando lugar a binarias separadas, semi-separadas y de contacto. Las últimas dos categorías incluyen a las binarias en interacción, en las que existe una transferencia de masa. Muchas binarias son también estrellas variables, siendo las más importantes las distintas formas de estrella binaria cataclísmica, las supernovas de tipo I y ciertas fuentes variables de rayos X.

| Nombre | Tipo espectral; de la estrella principal | Período orbital; (días) | M2/M1* |

|---|---|---|---|

| ε Coronae Australis | F2V | 0,5914 | 0,11 |

| 44 Bootis | G2V | 0,2678 | 0,56 |

| V2388 Ophiuchi | F3V | 0,8023 | 0,29 |

En ocasiones, las binarias llegan a estar tan cerca que, finalmente, se produce el encuentro y se funden en una sola estrella muy difrente a lo que fueron sus originales.

Estrella “capullo”:

Estrella Capullo (arriba la podemos contemplar) aparece rodeada por una densa nube de gas y polvo que absorbe parte de la energía radiante de la estrella y la reemite en longitudes de onda infrarrojas. En casos extremos la estrella puede estar completamente oscurecida ópticamente, siendo sólo una fuente infrarroja. Las fuentes OH-IR son ejemplos de estrellas “capullo “.

Estrella con baja velocidad:

Estrella cuya velocidad relativa a las estrellas de la vecindad solar es pequeña, y que, por tanto, se haya en una órbita similar a la de estas alrededor del centro galáctico.

Estrellas Binarias de baja velocidad

Estrella con envoltura:

Eta Carinae es una estrella con envoltura de muchas masas solares a punto de…dar un susto

Estrella cuyo espectro (normalmente de tipo B) contiene prominentes líneas de absorción que se originan en una capa de material que rodea a la estrella. Si es variable, la estrella se clasifica como una estrella Gamma Cassiopea , en la que la eyección de una envoltura está acompañada por una disminución del brillo temporal.

Estrella con exceso de ultravioleta:

Estrella que presenta un exceso de radiación ultravioleta en comparación con las estrellas normales. Un exceso de ultravioleta puede ser utilizado para identificar estrellas O y B calientes, enanas blancas y objetos rodeados por un disco de acreción, como estrellas de neutrones y agujeros negros.

Estrella de alta velocidad:

Estrella que se mueve a más de 65 km/s en relación al movimiento promedio de otras estrellas en la vecindad del sol (el estándar local de reposo). Las estrellas de alta velocidad son miembros del halo galáctico, moviéndose en órbitas altamente elípticas alrededor del centro galáctico.

Sus altas velocidades relativas tienen su origen en el hecho de que están atravesando el disco galáctico y no comparten la rotación del sol y de sus otras estrellas vecinas alrededor del centro galáctico. Dichas estrellas pudieron haberse formado en las etapas tempranas de la historia de la Galaxia, o pueden ser los restos de galaxias menores que se han fusionado a la nuestra.

Estrella de baja luminosidad:

Término vago que puede comprender a las enanas rojas, las subenanas, las enanas blancas y las enanas marrones. La dificultad en detectar estrellas de baja luminosidad hace que el número total de ellas sea incierto. No obstante, pueden constituir una fracción significativa de la masa total de la Galaxia.

Estrella de baja masa:

Término vago, que en algunas ocasiones incluye a las estrellas con masas ligeramente mayores que la del Sol, y en otras es utilizado sólo para las estrellas de menos de unas pocas décimas de masas solares, aunque todavía con suficiente masa como para quemar hidrógeno en sus núcleos (es decir, al menos 0,08 masas solares). La primera definición distingue a las estrellas con núcleos radiactivos de las estrellas de masas mayores con núcleos convectivos; la segunda restringe el término a las enanas rojas.

Estrella de bario:

Estrella gigante roja de tipo espectral G o K en la que aparecen en el espectro elementos más pesados como el bario con una abundancia inusualmente alta; conocida también como estrella B ll o estrella de metales pesados. El helio que se quema en una capa alrededor del núcleo produce los elementos más pesados. Las estrellas de bario son similares a las *estrellas CH, si bien son más ricas en metales y no tienen suficiente carbono como para ser consideradas * estrellas de carbono.

Estrella de bariones:

Estrella compuesta principalmente por bariones. En la práctica el término es un sinónimo de estrella de neutrones, ya que la repulsión eléctrica de los protones rompería una estrella de protones pura.

Estrella de campo:

Estrella que es visible en el mismo campo de visión que un cúmulo de estrellas, aunque no pertenece al mismo, estando o bien más próxima a nosotros o más distante. Análogamente, una galaxia de campo se encuentra en la misma línea de visión que un grupo de galaxias aunque no es un miembro del mismo.

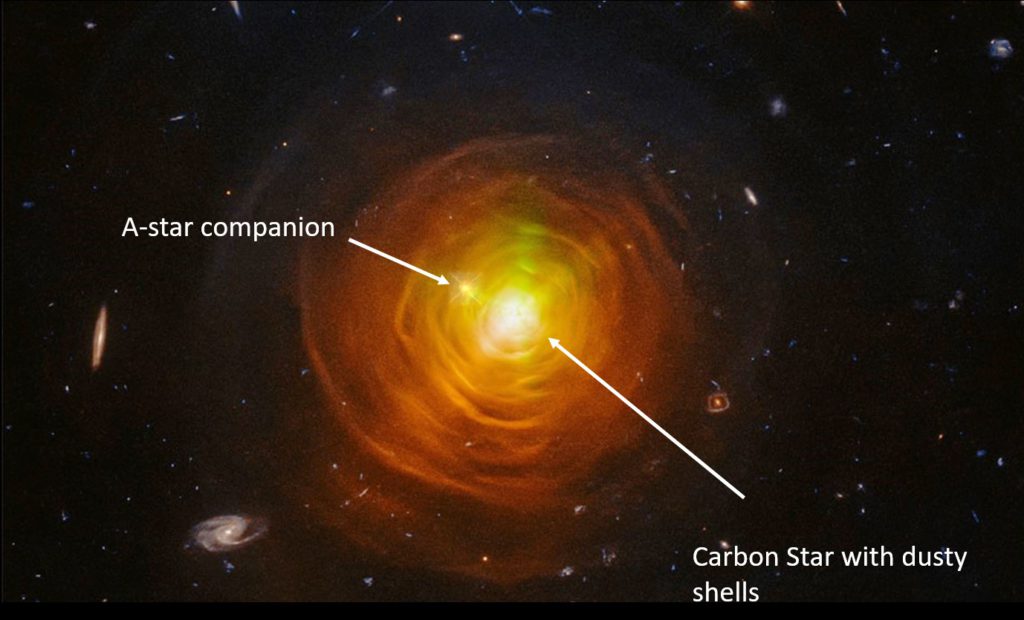

Estrella de carbono:

Estrella gigante roja fría en una etapa avanzada de su evolución, mostrando intensos rasgos característicos del carbono en forma de bandas de CN, CH y C2 en su espectro; también conocida como estrella de tipo espectral C. En las estrellas de carbono, la abundancia de carbono es mayor que la de oxígeno. La presencia adicional de litio indica que estos elementos han sido producidos mediante reacciones nucleares en el núcleo de la estrella y que están siendo ahora transportados por convección hacia su superficie.

R Leporis es una estrella variable, de Carbono. Descubierta en 1.845 por el astrónomo inglés John Russell Hind, va oscilando desde la magnitud 5.5 hasta 11.7, en periodos constantes de 427.07 días, o sea, unos 14 meses. Se trata de una estrella de carbono, tipo espectral C6II, de un marcado color rojo conocida como la estrella carmesí de Hind, en honor a su descubridor, quien al observarla desde elocular de su telescopio, la comparó a una gota de sangre.

Dado que el carbono sólo puede ser producido por el proceso triple-alfa a temperaturas muy altas, estas estrellas deben de estar muy evolucionadas. Estos raros pero luminosos objetos incluyen a las antiguas tipos R (gigantes de tipo K con temperaturas de 4000-5000 K) y N (gigantes de tipo M aunque más frías, con unos 3000K), que fueron introducidos en la clasificación de Harvard. Las estrellas de carbono de tipo N pueden ser hasta 10 veces más luminosas que las de tipo R.

Estrella de circonio: V. estrella S.

Las estrellas de tipo S presentan bandas intensas de cianógeno (CN) y contienen líneas espectrales de litio y tecnecio. Las estrellas S puras,

Proto estrella:

Este tipo de expulsiones han sido observadas antes en otras estrellas en formación, lo que hace pensar a los astrónomos que todas las estrellas pasan por este proceso. Los lanzamientos de hidrógeno y oxígeno en la estrella provocan grandes ondas alrededor de la misma, y el fenómeno podría ser el responsable de la existencia de agua en el universo

Estrella de estroncio:

Forma de estrella Ap con líneas de estroncio más intensas de lo habitual en su espectro. Estrellas viejas con niveles extrañamente altos de elementos raros como el estroncio y el itrio.

Estrella de helio:

Núcleo de una estrella que fue masiva (con más de 12 masas solares originalmente) y que ha evolucionado y perdido su envoltura rica en hidrógeno. La pérdida del hidrógeno puede ocurrir bien por medio de un intenso viento estelar, como en las estrellas Wolf-Rayet, o bien por transferencia de masa a un compañero, siempre que este se encuentre cerca de la primaria.

Se espera que las estrellas de helio evolucionen de la misma manera que los núcleos de las estrellas masivas, produciendo un núcleo de hierro que colapsa para generar una explosión de supernova de tipo Ib o Ic, dependiendo de la masa de la estrella.” Estrella de helio “es también un término obsoleto para referirse a una estrella d tipo B normal.

Estrella de la población I extrema:

Estrella que pertenece a la población estelar más joven. Como una estrella T Tauri, una estrella recién llegada a la secuencia principal de edad cero, o una estrella OB masiva con su región H II asociada. Dichas estrellas tienen altas abundancias de metales (similares a las del Sol o mayores).

Se encuentran en regiones localizadas del disco galáctico, notablemente en los brazos espirales, donde la formación de estrellas ha tenido lugar muy recientemente.

Estrella de la población intermedia:

Estrella con propiedades intermedias entre las viejas de la Población II del halo galáctico y las jóvenes de la Población I del disco galáctico. Su abundancia en metales pesados es intermedia entre la de las dos poblaciones, y se encuentran distribuidas en un grueso disco que se extiende por encima y por debajo de un fino disco en el que se encuentran las estrellas de la población del disco.

Una estrella que tenga una masa cercana a las 100 masas solares está en peligro y le puede ocurrir como a la que, arriba en la imagen podemos ver, será destruida por su propia radiación y, ni la fuerza de Gravedad puede mantenerla estable.

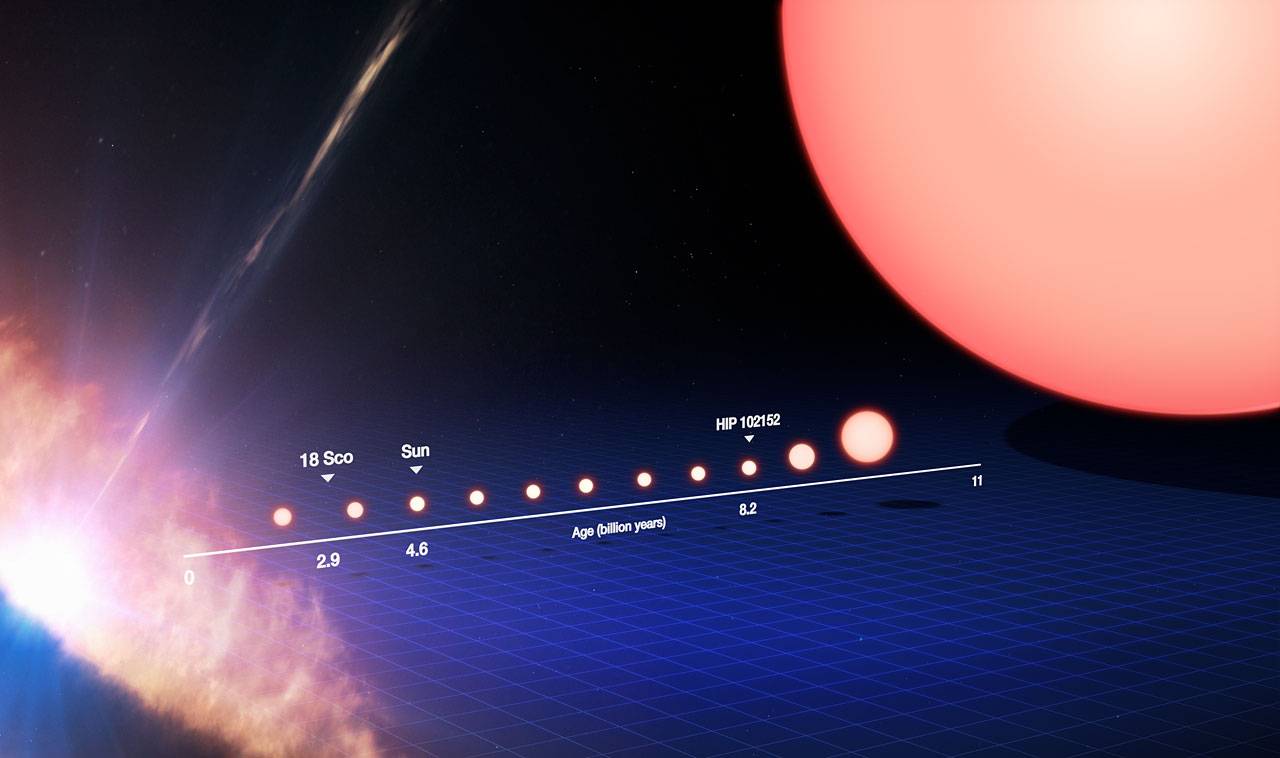

Gigante roja como será el Sol dentro de 4.000 M de años

Estrella de la rama gigante asintótica:

Estrella que ocupa una franja en el diagrama de Hertzsprung-Russell que es casi paralela a, o justo por encima de, la rama de las gigantes. Las estrellas evolucionan desde la rama horizontal a la rama gigante asintótica cuando han agotado el helio en su núcleo y lo están quemando en una capa alrededor de este.

.

Los investigadores han observado un centenar de esos cuerpos celestes ricos en rubidio, conocidos como estrellas de la rama asintótica gigantes. La variedad de estrellas (en sus componentes)m existentes en el Universo es inmensa. Incluso las tenemos que son auténticas diamantes.

Estrella de litio:

Estrella gigante inusual de tipo espectral G, K o M que presenta litio en su espectro. Las reacciones nucleares en o cerca del núcleo de la estrella evolucionada producen berilio, que es transportado por convección a las capas superiores, donde captura un electrón para convertirse en litio.

El término es en ocasiones aplicado para referirse a las estrellas T Tauri (que son muy jóvenes y todavía en formación); en estos casos el litio es probable que se hallara en el gas del cual se formó la estrella, y será pronto destruido una vez que la estrella alcance la secuencia principal.

Estrella de manganeso:

Estrella químicamente peculiar con una proporción inusualmente alta de manganeso con respecto de hierro y una temperatura correspondiente al tipo espectral B tardío. Son estrellas de la secuencia principal, similares a las estrellas Ap, aunque sin evidencias de campos magnéticos intensos.

Estrellas múltiples:

Estrella de mercurio-manganeso:

Forma de estrella de manganeso que tiene una línea espectral a una longitud de onda de 398,4 nm, identificada como de hidrógeno ionizado; también conocida como estrella de manganeso-mercurio.

Estrella de metales pesados:

Gigante con cantidades inusuales de elementos pesados en su espectro, como las estrellas de bario o las estrellas S.

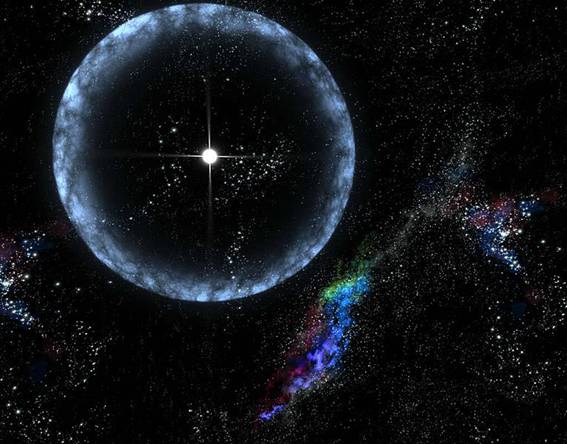

Estrella de neutrones:

Estrella masiva que al final de sus días se contrae en estrella de neutrones. Son objeto extremadamente pequeño y denso que se cree que se forma cuando una estrella masiva sufre una explosión de supernova de tipo II. Durante la explosión el núcleo de la estrella masiva se colapsa bajo su propia gravedad hasta que, a una densidad de unos 10 con exponente 17 k/m3, los electrones y los protones están tan juntos, que pueden combinarse para formar neutrones.

El objeto resultante, consistente sólo en neutrones, se soporta frente a un mayor colapso gravitacional por la presión de degeneración de los neutrones, siempre que su masa no sea mayor que unas dos masas solares (límite de Oppenheimer-Volkoff).

Si el objeto fuese más masivo colapsaría hasta formar un agujero negro. Una típica estrella de neutrones, con una masa poco mayor que la del Sol, tendría un diámetro de apenas 30 km, y una densidad mucho mayor que la que habría en un terrón de azúcar con una masa igual a la de toda la humanidad.

Cuanto mayor es la masa de una estrella de neutrones, menor es su diámetro. Se cree que las estrellas de neutrones tienen un interior de neutrones superfluitos (es decir, neutrones que se comportan como un fluido de viscosidad cero), rodeados por una corteza sólida de más o menos un kilómetro de grosor compuesta de elementos como el hierro.

Los pulsares son estrellas de neutrones magnetizadas en rotación. Las binarias de rayos X masivas también se piensa que contienen estrellas de neutrones.

Estrella de quarks:

Estrella hipotética con una densidad intermedia entre la de una estrella de neutrones y la de un agujero negro. Dichas estrellas estarían constituidas por quarks libres. Las fuerzas entre los quarks compensan las fuerzas gravitacionales. Es improbable que las estrellas de quarks existan en la naturaleza, pero algunos modelos de núcleos de estrellas de neutrones sugieren que los neutrones (y los protones) dejan de ser estados ligados para formar un caldo de quarks.

Estrella de referencia:

Estrella cuya posición y -o movimiento propio son conocidos, de manera que puede ser utilizada para definir un sistema de referencia local para las posiciones relativas o los movimientos propios de otras estrellas situadas en la misma área del cielo.

Estrella de silicio: Tipo de estrella Ap en la que hay una abundancia de silicio mayor de la normal.

Estrella Supermasiva:

Un peculiar Horizonte de Sucesos en el Centro de una Galaxia

La estrella supermasiva cuando se convierte en un agujero negro se contrae tanto que, realmente desaparece de la vista, de ahí su nombre de “agujeros negros”. Su enorme densidad genera una fuerza gravitatoria tan descomunal que la velocidad de escape supera a la de la luz, por tal motivo, ni la luz puede escapar de él. En la singularidad, dejan de existir el tiempo y el espacio, podríamos decir que el agujero negro está fuera, apartado de nuestro Universo, pero en realidad, deja sentir sus efectos, ya que, como antes dije, se pueden detectar las radiaciones de rayos X que emite cuando engulle materia de cualquier objeto estelar que se le aproxime más allá del punto límite que se conoce como Horizonte de Sucesos.

Estrella de tecnecio:

Estrella M o estrella de carbono que contiene isótopos de tecnecio. Dado que el isótopo de tecnecio de más larga vivaque puede ser creado por la nucleosíntesis estelar tiene una vida media de 210.000 años, este material debió de haberse creado recientemente en el interior de la estrella y más tarde llevado hacia su superficie.

Estrella de tipo intermedio:

Término empleado en ocasiones para referirse a las estrellas con tipos espectrales F o G.

Estrella de tipo tardío:

Estrella con una temperatura superficial más fría que la del Sol, con un tipo espectral K, M, C o S; a menudo, también se incluyen las estrellas G en esta categoría. Las estrellas de tipo tardío pueden ser o bien de baja masa, si son de la secuencia principal, o más masivas que el Sol, si son gigantes o supergigantes. La designación “tardío “proviene de la época en la que se pensaba incorrectamente que las estrellas con espectros K o M eran viejas y evolucionadas.

Estrella de tipo temprano:

Cualquier estrella masiva y caliente de tipo espectral O, B o A. La designación “temprano” deriva de una antigua idea errónea de que las estrellas evolucionaban desde un estado caliente y joven a un estado frío y viejo. El término también se utiliza para referirse al tipo más caliente de cada clase espectral; por ejemplo, una estrella K1 es más temprana que una estrella K5.

Estrella del polo:

Siempre fue la guía de los marineros aventureros

La estrella visible a simple vista más próxima a los polos celestes Norte y Sur. La estrella del polo norte es en la actualidad Polaris, y la estrella del polo Sur es Sigma Octantis. No obstante, la posición del polo celeste (y, por tanto, a estrella del polo) cambia con el tiempo debido al efecto de la precesión.

Estrella doble:

Dos estrellas que aparecen próximas entre sí en el cielo. Dichos pares pueden dividirse en dos clases:

Dobles ópticas, donde las componentes no están gravitacionalmente ligadas, y dobles físicas, en las que las estrellas se hayan orbitando en torno a un baricentro común. El término “estrella doble” está restringido frecuentemente al primer grupo, mientras que el término estrella binaria es empleado para el segundo. De hecho, las dobles ópticas son relativamente poco comunes, y la mayoría de las dobles son realmente auténticos sistemas binarios

Las estrellas se reflejan en las olas que mueren en la playa y brillan como luciérnagas

Me gustaría haber hecho este viaje más completo y con más imágenes de estrellas que representaran a cada una de las clases que en las galaxias existen, sin embargo, diversas circunstancias me impiden llevarlo a la práctica. De todas las maneras y, como una muestra de la riqueza que existe en la familia estelar, creo que está bien para comprender que, el inmenso Universo, siempre nos sorprenderá con su contenido y las maravillas que en él están presentes.

Pero no podemos olvidar que las estrellas son mucho más que simples puntos brillantes en el cielo. Han estado más de diez mil millones de años “fabricando” elementos complejos para que ahora nosotros estemos aquí.

Emilio Silvera Vázquez

Jun

9

Seguimos descorriendo el velo

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

Mucho es lo que hemos hablado aquí del Modelo estándar que, aunque no es un Modelo perfecto, sí ha sido una buena herramienta para tener controlada a todas las familias de partículas y las interacciones fundamentales (excepto la Gravedad). Tenemos la esperanza de llegar más allá del Modelo Estándar y, seguimos erre que erre dando la tabarra con la “materia oscura” que, seguramente, no existe.

Alguien dijo: “Temo por el día en el que la tecnología sobrepase la interacción humana. El mundo solo tendrá una generación de idiotas”

Claro que, así ha sido siempre, hemos conjeturado sobre lo que podría ser, y, a medida que se han ido descubriendo realidades con el avance de la tecnología, hemos ido refinando las teorías erróneas.

Seguiremos adelante y, como decía aquella vieja cancioncilla:

Mi abuelo tenía un cabrito,

Dice que lo va a matar,

Del pellejo hará un pandero,

¡Lo que sea sonará!

Emilio Silvera Vázquez

Jun

9

El Universo se expande, la Mente también I

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en La Mente - Filosofía ~

Clasificado en La Mente - Filosofía ~

Comments (1)

Comments (1)

¿Se Expande el Universo y al mismo tiempo, lo hacen nuestras mentes?

Cosmos, Constante gravitacional y Consciencia

Una parte de la ciencia estudia la estructura y la evolución del Universo: La cosmología

La cosmología observacional se ocupa de las propiedades físicas del Universo, como su composición física referida a la química, la velocidad de expansión y su densidad, además de la distribución de Galaxias y cúmulos de galaxias. La cosmología física intenta comprender estas propiedades aplicando las leyes conocidas de la física y de la astrofísica. La cosmología teórica construye modelos que dan una descripción matemática de las propiedades observadas del Universo basadas en esta comprensión física.

La cosmología también tiene aspectos filosóficos, o incluso teológicos, en el sentido de que trata de comprender por qué el Universo tiene las propiedades observadas.

La cosmología teórica se basa en la teoría de la relatividad general, la teoría de Einstein de la gravitación. De todas las fuerzas de la naturaleza, la gravedad es la que tiene efectos más intensos a grandes escalas y domina el comportamiento del Universo en su conjunto.

El espacio-tiempo, la materia contenida en el Universo con la fuerza gravitatoria que genera y, nuestras mentes que tienen conocimientos de que todo esto sucede.

De manera que, nuestro consciente (sentimos, pensamos, queremos obrar con conocimiento de lo que hacemos), es el elemento racional de nuestra personalidad humana que controla y reprime los impulsos del inconsciente, para desarrollar la capacidad de adaptación al mundo exterior.

Totales: 89.336.686

Totales: 89.336.686 Conectados: 93

Conectados: 93