Jul

14

¿Cómo que no hay agujeros negros?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General, Investigación y Ciencia ~

Clasificado en General, Investigación y Ciencia ~

Comments (0)

Comments (0)

El premio Nobel de Física en 1978 por el descubrimiento de la radiación de fondo de microondas evalúa para EL ESPAÑOL el presente y futuro de la astronomía.

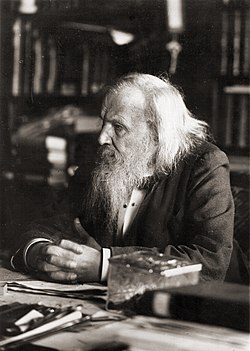

En 1964, Robert Wilson y Arno Penzias trabajaban en los Laboratorios Bell de Nueva Jersey con un nuevo tipo de antena de radio creada para detectar las señales que rebotaban en un satélite llamado Echo. Faltaban cinco años para conquistar la Luna y el satélite era, básicamente, un globo metalizado. La antena empezó a detectar un ruido que estos radiofísicos no podían identificar. El ruido estaba presente día y noche, estaba extendido por todo el espacio y era cien veces más intenso de lo que esperaban encontrar. ¿Qué demonios sería? Wilson y Penzias limpiaron la antena, que estaba cubierta por cagadas de paloma, y volvieron a mirar. El ruido seguía ahí.

Wilson y Penzias

Paralelamente, Robert Dicke estaba a punto de iniciar un experimento en la Universidad de Princeton, a 60 kilómetros de allí, para tratar de encontrar la ansiada radiación de fondo de microondas, los resquicios energéticos generados hace más de 13.000 millones de años que demostrarían que el universo se inició con un Big Bang y una rápida inflación cósmica. Pero los resultados que Dicke y su equipo buscaban ya los habían encontrado -por casualidad- Penzias y Wilson, lo que les valió alzarse con el Nobel de Física de 1978.

El astrónomo texano, que hoy tiene 80 años, ha visitado España este mes para acudir al festival Starmus, donde concedió esta entrevista a EL ESPAÑOL.

Una de las grandes polémicas de lo que llevamos de siglo es la fallida detección de las ondas gravitacionales primordiales, ese alarido del Big Bang que, supuestamente, un equipo de científicos del Centro de Astrofísica Harvard-Smithsonian había detectado en marzo de 2014. Wilson vivió de cerca aquel fiasco del experimento BICEP2, debido a que ocupa un puesto de profesor emérito en este centro.

The BICEP2 telescope is the white dish at the top right of the blue building. The dish on the left is the South Pole Telescope. (Courtesy: National Science Foundation)

El BICEP2 dijo que había hallado las ondas gravitacionales primordiales pero luego resultó ser solamente polvo. Esto cual recuerda a lo que usted tuvo que pasar hasta detectar la radiación de fondo de microondas. ¿Por qué es tan fácil en astronomía confundir la señal y el ruido?

En este caso no es ruido, ya que este “ruido” procede de lo que constituye nuestra galaxia. Primero, la radiación que hay delante tiene que ser separada para poder ver la que hay en el fondo. En principio es algo bastante directo, coges el espectro con el número de frecuencias y buscas en las bajas frecuencias la radiación Sincrotrón, que es muy brillante a estas frecuencias. Luego, en las frecuencias más altas retiras el ruido producido por el polvo espacial y lo que queda deberían ser las ondas primordiales, pero por desgracia BICEP sólo medía una longitud de onda, una sola frecuencia, por lo que no pudieron hacer esa separación.

¿No fue un poco aventurado anunciar aquello sin estar seguro?

Cuando hicieron el anuncio pensaron que el polvo sería poco y la gente del Max Planck no les dijeron lo que estaban midiendo, porque no habían acabado su análisis.

[En 2014, el equipo de astrofísicos del Instituto Max Planck, en Alemania, estaba buscando también las ondas gravitacionales primordiales, aunque con otros instrumentos y métodos. La competencia entre ambos equipos era feroz, ya que un descubrimiento así prácticamente aseguraba a los descubridores un premio Nobel.]

Tuve la posibilidad de hablar con miembros de ambos experimentos, estadounidenses y alemanes, y lo cierto es que había bastante pique entre ellos.

Sí, antes había mucha competencia y ahora hay cooperación. Eso es lo que tenía que acabar pasando. Y aquí en Canarias tienen el experimento Quijote que debería aportar algunas medidas a baja frecuencia… todo el mundo va a tener que reunirse y ponerlo todo sobre la mesa para obtener la respuesta.

Su descubrimiento de la radiación de fondo de microondas fue clave para que recientemente se detectaran las ondas gravitacionales. ¿Cree que estamos entrando en un nueva era de la astronomía?

En realidad ahora está al mismo nivel que hace 50 años… lo que podemos detectar en este punto son sólo las fusiones de agujeros negros, pero si acabamos haciendo lo de los tres satélites para medir frecuencias más bajas entonces podremos detectar un montón de gravedad.

Se refiere al experimento europeo LISA, que consistirá en tres satélites separados cinco millones de kilómetros y formando un triángulo…

Sí, ahí es cuando creo que veremos el verdadero impulso científico. Es decir, lo de las ondas gravitacionales y el LIGO es algo maravilloso, no quiero quitarle mérito ninguno, pero creo que la verdadera aplicación ocurrirá un vez lo hagamos desde el espacio.

Cuando se descubrieron las ondas gravitacionales, se dijo que ahora seríamos capaces de conocer mejor las poblaciones de agujeros negros en el universo. ¿Por qué es importante esto?

Ahora mismo, lo que sabemos es que muchas galaxias tienen un agujero negro en el centro. Pero no tenemos evidencias de que los agujeros negros existan en ningún otro sitio. Estos dos eventos registrados han sido agujeros negros de tamaño moderado. Los que hay en el centro de la galaxia, al menos en el caso de la nuestra, son un millón de veces la masa del Sol, incluso miles de millones a veces. Ahora tenemos algo que, quizá surgió de una supernova, y tiene unas cuantas decenas de masas solares, estamos encontrando dónde están esas nuevas poblaciones de agujeros negros.

Debe ser emocionante.

Sí, aunque es un poco difícil predecir qué tipo de ciencia saldrá de esto. No obstante, parece que tenemos una nueva forma de mirar al universo y eso va a ser excitante.

Usted es un experimentalista. ¿Qué tal se lleva con los cosmólogos? Se emocionan bastante con los multiversos y esas cosas, ¿verdad?

Intento aferrarme a la teoría pero encuentro enriquecedor escucharles, son gente que a menudo lo hace muy bien explicando lo que hacen. Estuve escuchando antes a Roger Penrose y bueno, no estoy de acuerdo en todo con él, pero está bien escuchar diferentes teorías… Especialmente, para mí, es un placer ver la radiación de fondo de microondas aparecer en tantos sitios.

Claro, muchos modelos sobre lo que pasó tras el Big Bang se apoyaron en su descubrimiento, debe ser halagador de algún modo.

Sí, es muy satisfactorio.

Lo normal suele ser que alguien haga una predicción y luego otros la confirmen con experimentos, pero en su caso sucedió al revés.

Bueno, íbamos buscando algo, ese algo salió mal y eso es lo mejor que nos pudo pasar.

Dic

10

Hacia el futuro

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Investigación y Ciencia ~

Clasificado en Investigación y Ciencia ~

Comments (0)

Comments (0)

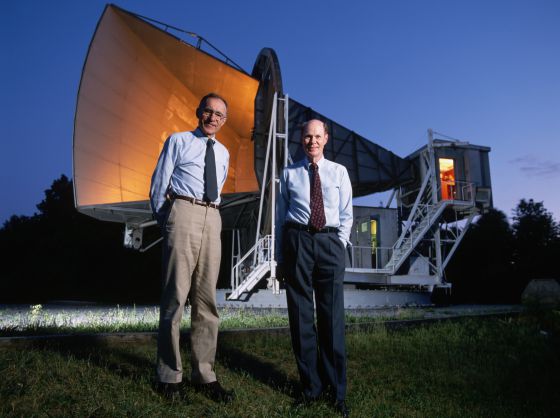

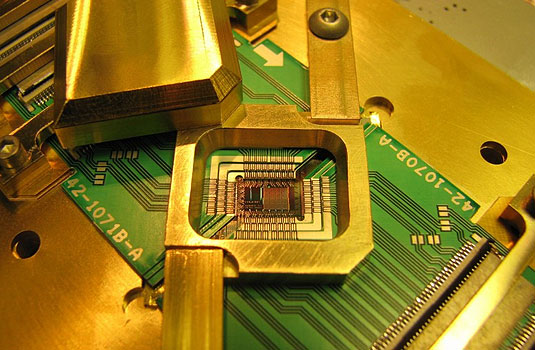

La primera vez que un grupo de físicos empezó a hablar de la posibilidad de hacer cálculos de naturaleza cuántica fue en los años 80, pero no fue hasta los 90 cuando se empezó a poner en práctica; hoy la computación cuántica está cada vez más cerca pero aún es difícil poner fecha a su comercialización.

Representación artística de la investigación de la UCM (el triángulo tiene 7 qubits y el paisaje es una red hexagonal que representa la forma en que tiene que crecer el sistema de qubits para que el ordenador cuántico sea de gran escala y robusto, es decir, libre de errores). IQOQ/ Harald Ritsch.

La misión de un ordenador cuántico, como la de uno convencional y un supercomputador, es la de hacer operaciones, cálculos que los primeros ejecutan de manera distinta: trabajan a nivel atómico y por lo tanto siguiendo las normas de la física cuántica (rama de la física encargada de estudiar objetos microscópicos, como átomos).

La física cuántica tiene propiedades extraordinarias, no observables a niveles macroscópicos, y éstas son usadas por los ordenadores cuánticos -de los que ahora solo existen prototipos- para lograr procesar datos complejos de manera más rápida y segura.

Los ordenadores cuánticos funcionan con átomos individuales, que se denominan “qubits” y no bits (como en los tradicionales).

Un bit (acrónimo en inglés de binary digit -dígito binario-) es la unidad mínima de información empleada en informática o en un dispositivo digital y se representa con dos valores, 0 y 1: todo lo que hay “debajo” de un ordenador clásico se escribe en términos de 0 o 1, detalla a Efe Miguel Ángel Martín-Delgado, catedrático de Física Teórica de la Universidad Complutense de Madrid (UCM).

Sin embargo, en la computación cuántica esto cambia, ya que un qubit, a diferencia de un bit, puede contener ambos valores al mismo tiempo, lo que posibilita una velocidad de procesamiento mayor.

Otra de las características de la computación cuántica es que puede trabajar en paralelo: un PC normal lo hace secuencialmente, primero resuelve un problema, luego otro y así sucesivamente.

Sin embargo, agrega Martín-Delgado, los ordenadores cuánticos pueden resolver un número exponencial de tareas a la vez.

Por ejemplo, para “romper” una clave encriptada un ordenador clásico tendría que escudriñar, una a una, las distintas combinaciones de números hasta dar con la contraseña, pero uno cuántico no: éste podría trabajar con miles a la vez en un segundo.

¿Y qué es lo que posibilita esta capacidad de cálculo? El algoritmo Shor.

Este algoritmo, diseñado por el matemático estadounidense Peter Shor, permite, por ejemplo, a una tercera persona que intercepta un mensaje cifrado descifrarlo en un tiempo exponencialmente más rápido que si lo hiciera con un ordenador clásico, señala Martín-Delgado.

Peter Shor publicó el trabajo con la descripción de este algoritmo en 1994, lo que supuso “el disparo de salida para que todo el mundo se empezara a interesar por la computación cuántica”.

Un año después, se hizo la primera propuesta de cómo hacer un ordenador cuántico por el español Juan Ignacio Cirac y el austríaco Peter Zoller (se conoce como la propuesta Cirac-Zoller).

Pero el ordenador cuántico no solo servirá para “desenmascarar” mensajes encriptados, sino para hacer simulaciones, secuenciar genomas más rápidamente, hacer cálculos de química cuántica, lo que podría servir para diseñar nuevos fármacos o mejorar las búsquedas.

De ahí que empresas como Google o instituciones como la NASA hayan apostado por ello.

“El ordenador cuántico va a ser predominante en el futuro de la informática: va a ser el rey”, recalca Martín-Delgado, quien apunta que el horizonte del 2020 será crucial para empezar a hacerlos realidad (dependerá de los experimentos en desarrollo).

Corrección de errores

Sin embargo, para llegar a este punto primero hay que resolver una serie de cuestiones, entre ellas los errores (los ordenadores clásicos se construyen con mecanismos para corregir errores).

Precisamente esto es lo que acaba de lograr el equipo de Martín-Delgado y de Rainer Blatt (Innsbruck).

“Hemos conseguido hacer una corrección completa de errores cuánticos en un módulo pequeño donde se hacían operaciones cuánticas”, aclara este investigador, quien acaba de publicar en Science y presentar en varios congresos de EEUU estos resultados.

Los ordenadores clásicos tienen solo un tipo de error -un error es cuando quiere escribir un 0 y pone un 1 o al contrario-, sin embargo uno cuántico, al ser más complejo, tiene tres tipos de errores: “Hemos desarrollado un método para corregir todos los errores que pueden aparecer en un computador cuántico”, concluye Markus Müller, miembro del equipo de la Complutense.

EFE-futuro

Dic

8

Rumores del pasado

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Investigación y Ciencia ~

Clasificado en Investigación y Ciencia ~

Comments (1)

Comments (1)

Faraday dando una charla sobre sus trabajos y explicándo al público lo que era la luz y la electricidad

En su juventud, Michael Faraday tuvo unos humildes comienzos como repartidor de periódicos y aprendiz de encuadernador. Sin embargo, su afición al experimento y la investigación le llevó a descubrir algunos de los secretos más guardados de la Naturaleza. De hecho, el concepto de “Campo” que tanto hoy manejan los físicos, es debido a él. Gracias a sus trabajos y los resultados obtenidos en sus miles de experimentos, pudo Maxwell (un gran físico y matemático), crear su teoría de la luz y el electromagnetismo mediante sus famosas ecuaciones vectoriales.

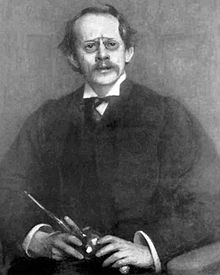

James Clark Maxwell

El trabajo más importante de Maxwell se efectuó entre 1864 y 1873, cuando dio forma matemática a las especulaciones de Faraday respecto a las líneas de fuerza magnéticas. Al hacerlo, Maxwell, pudo conseguir unas cuantas ecuaciones simples que expresaban todos los fenómenos variados de electricidad y magnetismo y las unió de un modo indisoluble. Su teoría demostraba que la electricidad y el magnetismo no podían existir aisladamente, donde esta una allí estaba el otro, por tanto, se hace referencia a su obra, generalmente, como la teoría del electromagnetismo.

La “profesionalización” e “institución” de la ciencia, entendiendo por tal que la práctica de la investigación científica se convirtiese en una profesión cada vez más abierta a personas sin medios económicos propios, que se ganaban la vida a través de la ciencia y que llegasen a atraer la atención de gobiernos e industrias, tuvo su explosión a lo largo de 1.800, y muy especialmente gracias al desarrollo de dos disciplinas, la química orgánica y el electromagnetismo. Estas disciplinas, junto a las matemáticas, la biología y las ciencias naturales (sin las cuales sería una necedad pretender que se entiende la naturaleza, pero con menos repercusiones socio-económicas), experimentaron un gran desarrollo entonces, tanto en nuevas ideas como en el número de científicos importantes: Faraday, Maxwell, Lyell, Darwin y Pasteur, son un ejemplo. Sin olvidar a otros como Mendel, Helmholtz, Koch, Virchow, Lister o Kelvin, o la matemática de Cauchy, de Gauss, Galois, Fourier, Lobachevski, Riemann, Klein, Cantor, Russell, Hilbert o Poincaré. Pero vamos a pararnos un momento en Faraday y Maxwell.

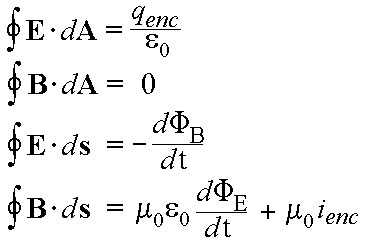

Las ecuaciones de Maxwell, por dar una simple explicación de lo que significan, hace posible que tengamos una información fidedigna de cómo se transmite la información para la televisión, Internet y la telefonía en general, cuánto tarda en llegarnos la luz de las estrellas, cuál es la base del funcionamiento de las neuronas o como funciona cualquier central de electricidad, aparte de otros miles de fenómenos que podemos estar experimentando en nuestras vidas cotidianas que están relacionados con la luz, la electricidad y el magnetismo. Y, todo ello, se explica con esas cuatro “sencillas ecuaciones”.

Para la electricidad, magnetismo y óptica, fenómenos conocidos desde la antigüedad, no hubo mejor época que el siglo XIX. El núcleo principal de los avances que se produjeron en esa rama de la física (de los que tanto se benefició la sociedad -comunicaciones telegráficas, iluminación, tranvías y metros, etc.-) se encuentra en que, frente a lo que se suponía con anterioridad, se descubrió que la electricidad y el magnetismo no eran fenómenos separados.

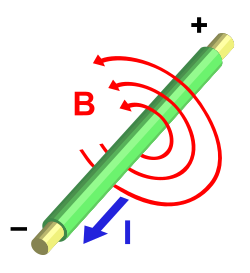

Estatua de Hans Christian Ørsted en Ørstedsparken, Copenhague, Dinamarca. Hans Christian Orsted físico y químico danés, que descubrió en 1819 que la aguja imantada de una brújula se desviaba cuando se encontraba próxima a un cable conductor por el cual fluía una corriente eléctrica. Esta desviación implica la existencia de un campo magnético en la región vecina al conductor. Asi se demostraba la existencia de un campo magnético en torno a todo conductor por el que fluye una corriente eléctrica, este descubrimiento fue crucial ya que puso en evidencia la relación existente entre la electricidad y el magnetismo.

Así que, el punto de partida para llegar a este resultado crucial fue el descubrimiento realizado en 1.820 por el danés Hans Christian Oersted (1777 – 1851) de que la electricidad produce efectos magnéticos: observó que una corriente eléctrica desvía una aguja imanada. La noticia del hallazgo del profesor danés se difundió rápidamente, y en París André-Marie Ampère (1775 – 1836) demostró experimentalmente que dos hilos paralelos por los que circulan corrientes eléctricas de igual sentido, se atraen, repeliéndose en el caso de que los sentidos sean opuestos.

La expresión diferencial

∇×H ≡ J (“Ley de Ampère“)

conocida como “Ley de Ampère“, muestra la relación que existe entre el campo H y la fuente J cuando las corrientes y los campos no cambian el tiempo, pero falla cuando los fenómenos no son estacionarios. La contribución de Maxwell se resume en haber agregado a J, el sumando ∂D/∂t correspondiente a la corriente de desplazamiento en los fenómenos no estacionarios, algo que nadie había medido y que no resultaba intuitivo. La falta de ese término deja fuera los casos dinámicos, muchos casos tan importantes como por ejemplo las Ondas Electromagnéticas !

Con esta formulación, Ampère avanzaba la expresión matemática que representaba aquellas fuerzas. Su propósito era dar una teoría de la electricidad sin más que introducir esa fuerza (para él “a distancia”).

Pero el mundo de la electricidad y el magnetismo resultó ser demasiado complejo como para que se pudiera simplificar en un gráfico sencillo, como se encargó de demostrar uno de los grandes nombres de la historia de la ciencia: Michael Faraday (1791 – 1867), un aprendiz de encuadernador que ascendió de ayudante de Humphry Davy (1778 – 1829) en la Royal Intitution londinense.

En este humilde rinconcillo trabajaba -faraday

En 1.821, poco después de saber de los trabajos de Oersted, Faraday, que también dejó su impronta en la química, demostró que un hilo por el que pasaba una corriente eléctrica podía girar de manera continua alrededor de un imán, con lo que vio que era posible obtener efectos mecánicos (movimiento) de una corriente que interacciona con un imán. Sin pretenderlo, había sentado el principio del motor eléctrico, cuyo primer prototipo sería construido en 1.831 por el físico estadounidense Joseph Henry (1797 – 1878).

Lo que le interesaba a Faraday no eran necesariamente las aplicaciones prácticas, sino principalmente los principios que gobiernan el comportamiento de la naturaleza, y en particular las relaciones mutuas entre fuerzas, de entrada, diferentes. En este sentido, dio otro paso importante al descubrir, en 1.831, la inducción electromagnética, un fenómeno que liga en general los movimientos mecánicos y el magnetismo con la producción de corriente eléctrica.

Este fenómeno, que llevaría a la dinamo, representaba el efecto recíproco al descubierto por Oersted; ahora el magnetismo producía electricidad , lo que reforzó la idea de que un lugar de hablar de electricidad y magnetismo como entes separados, sería más preciso referirse al electromagnetismo.

La intuición natural y la habilidad experimental de Faraday hicieron avanzar enormemente el estudio de todos los fenómenos electromagnéticos. De él es, precisamente, el concepto de campo que tanto juego ha dado a la física.

Sin embargo, para desarrollar una teoría consistente del electromagnetismo se necesitaba un científico distinto: Faraday era hábil experimentador con enorme intuición, pero no sabía expresar matemáticamente lo que descubría, y se limitaba a contarlo. No hubo que esperar mucho, ni salir de Gran Bretaña para que un científico adecuado, un escocés de nombre James Clerk Maxwell (1831 – 1879), hiciera acto de presencia.

Las ecuaciones de Maxwell cumplieron 150 años el pasado día 14 abril 2014. Publicado por Augusto en Divulgación, Historia de la Física. Las ecuaciones de Maxwell son un conjunto de cuatro ecuaciones (originalmente 20 ecuaciones) que describen por completo los fenómenos electromagnéticos. La gran contribución de James Clerk Maxwell fue reunir en estas ecuaciones largos años de resultados experimentales, debidos a Coulomb, Gauss, Ampere, Faraday y otros, introduciendo los conceptos de campo y corriente de desplazamiento, y unificando los campos eléctricos y magnéticos en un solo concepto: El Campo Electromagnético.

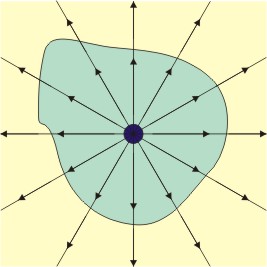

Las cuatro ecuaciones de Maxwell describen todos los fenómenos electromagnéticos, aquí se muestra la inducción magnética por medio de una corriente eléctrica en la figura situada en primer lugar. En la segunda se quiere escenificar el Flujo eléctrico de una carga puntualen una superficie cerrada. En la tercera imagen, quedan escenificadas las líneas de campo magnético que comienzan y terminan en el mismo lugar, por lo que no existe un monopolo magnético.

Maxwell desarrolló las matemáticas para expresar una teoría del magnetismo-electricidad (o al revés) que sentó las bases físicas de aquel fenómeno y contestaba a todas las preguntas de los dos aspectos de aquella misma cosa, el electromagnetismo. En sus ecuaciones vectoriales estaban todos los experimentos de Faraday, que le escribió una carta pidiéndole que le explicara, con palabras sencillas, aquellos números y letras que no podía entender.

Pero además, Maxwell también contribuyó a la física estadística y fue el primer director del Laboratorio Cavendish, unido de manera indisoluble a la física de los siglos XIX y XX (y también al de biología molecular) con sede en Cambridge.

Su conjunto de ecuaciones de, o en, derivadas parciales rigen el comportamiento de un medio (el campo electromagnético) que él supuso “transportaba” las fuerzas eléctricas y magnéticas; ecuaciones que hoy se denominan “de Maxwell”. Con su teoría de campo electromagnético, o electrodinámica, Maxwell logró, además, unir electricidad, magnetismo y óptica. Las dos primeras, como manifestaciones de un mismo substrato físico, electromagnético, que se comporta como una onda, y la luz, que es ella misma, una onda electromagnética, lo que, en su tiempo, resultó sorprendente.

Más de ciento treinta años después, todavía se podía o se puede apreciar la excitación que sintió Maxwell cuando escribió en el artículo Sobre las líneas físicas de la fuerza, 1861 – 62, en el que presentó esta idea: “Difícilmente podemos evitar la inferencia de que la luz consiste de ondulaciones transversales del mismo medio que es la causa de los fenómenos eléctricos y magnéticos.”

Todo aquello fue posible gracias a las bases sentadas por otros y a los trabajos de Faraday como experimentador infatigable, que publicaba sus resultados en artículos y los divulgaba en conferencias en la sede de la Royal Institution londinense. Todos estos artículos y conferencias fueron finalmente publicados en el libro que llamaron Philosophical transactions de la Royal Society, y Experimental researches in chemistry and physics (Richard Taylor y William Francis, Londres, 1859; dos grandes científicos unidos por la historia de la ciencia que nos abrieron puertas cerradas que nos dejaron entrar al futuro).

Claro que, si miramos hacia atrás en el tiempo, ¿cuántas historias como ésta podemos encontrar? Para cualquiera de las cosas que ahora sabemos, casi siempre, ha sido necesario aunar los pensamientos dispersos de muchos que, aunados en un sólo y completo pensamiento, ha podido formar la teoría final que nos explicaron el funcionamiento de la Naturaleza. Así ha ocurrido siempre y seguirá pasando. Einstein se tuvo que vales de ideas dispersas de Mach, Maxwell, Riemann, Lorentz y algunos otros para poder formular su bella Teoría de la Relatividad.

Faraday fue el prototipo de expèrimentador de los fenómenos físicos

A finales del siglo XIX, poca gente sabía con exactitud a qué se dedicaban los “físicos”. El término mismo era relativamente nuevo. En Cambridge, la física se enseñaba como del grado de matemáticas. En este sistema no había espacio la investigación: se consideraba que la física era una rama de las matemáticas y lo que se le enseñaba a los estudiantes era como resolver problemas.

En la década de 1.870, la competencia económica que mantenían Alemania, Francia, Estados Unidos, y Gran Bretaña se intensificó. Las Universidades se ampliaron y se construyó un Laboratorio de física experimental en Berlín.

Cambridge sufrió una reorganización. William Cavendish, el séptimo duque de Devonshire, un terrateniente y un industrial, cuyo antepasado Henry Cavendish había sido una temprana autoridad en teoría de la gravitación, accedió a financiar un Laboratorio si la Universidad prometía fundar una cátedra de física experimental. Cuando el laboratorio abrió, el duque recibió una carta en la que se le informaba (en un elegante latín) que el Laboratorio llevaría su .

Primer profesor J. J. Thomson director del laboratorio

Tras intentar conseguir sin éxito atraer primero a William Thomson, más tarde a lord Kelvin (quien otras cosas, concibió la idea del cero absoluto y contribuyó a la segunda ley de la termodinámica) y después a Hermann von Helmohltz, de Alemania (entre cuyas decenas de ideas y descubrimientos destaca una noción pionera del cuanto), finalmente se ofreció la dirección del centro a James Clerk Maxwell, un escocés graduado en Cambridge. Este fue un hecho fortuito, pero Maxwell terminaría convirtiéndose en lo que por lo general se considera el físico más destacado entre Newton y Einstein. Su principal aportación fue, por encima de todo, las ecuaciones matemáticas que permiten entender perfectamente la electricidad y el magnetismo. Estas explicaban la naturaleza de la luz, pero también condujeron al físico alemán Heinrich Hertz a identificar en 1.887, en Karlsruhe, las ondas electromagnéticas que hoy conocemos ondas de radio.

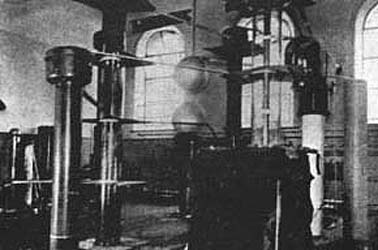

En el Laboratorio Cavendish de la Universidad de Cambridge, Cockcroft y Walton construyeron este acelerador de 500 kilovolts en 1932. Si lo comparamos con el LHC del CERN nos podemos dar de cómo la Ciencia ha ido avanzando en relativamente tan poco tiempo y, desde entonces hemos alcanzado un nivel que nos permite trabajar con 14 TeV, una energía de todo punto imposible e impensable en aquellos primeros tiempos.

Maxwell también creó un programa de investigación en Cavendish con el propósito de idear un estándar preciso de medición eléctrica, en particular la unidad de resistencia eléctrica, el ohmio. Esta era una cuestión de importancia internacional debido a la enorme expansión que había experimentado la telegrafía en la década de 1.850 y 1.860, y la iniciativa de Maxwell no solo puso a Gran Bretaña a la vanguardia de este campo, sino que también consolidó la reputación del Laboratorio Cavendish como un centro en el que se trataban problemas prácticos y se ideaban nuevos instrumentos.

Tubo de vacío usado por JJ Thomson en uno de los experimentos realizados para el electrón. Expuesto en el museo del laboratorio Cavendish. Aquellos físicos primeros que abrieron el camino a lo que más tarde sería la física moderna, tuvieron un gran mérito al poder avanzar hacia el conocimientos de las cosas, de la Naturaleza, con pocas herramientas y mucha imaginación.

A este hecho es posible atribuir del crucial papel que el laboratorio iba a desempeñar en la edad dorada de la Física, entre 1.897 y 1.933. Los científicos de Cavendish, se decía, tenían “sus cerebros en la punta de los dedos.”

Maxwell murió en 1.879 y le sucedió lord Rayleigh, quien continuó su labor, pero se retiró después de cinco años y, de manera inesperada, la dirección pasó a un joven de veintiocho años, Joseph John Thomson, que a pesar de su juventud ya se había labrado una reputación en Cambridge como un estupendo físico-matemático. Conocido universalmente como J.J., puede decirse que Thomson fue quien dio comienzo a la segunda revolución científica que creó el mundo que conocemos.

Ernest Rutherford otro experimentador

Se dedicó al estudio de las partículas radioactivas y logró clasificarlas en alfaa (α), beta (β) y gamma (γ). Halló que la radiactividad iba acompañada por una desintegración de los elementos, lo que le valió ganar el Premio Nobel de Química de 1908. Se le debe un modelo atómico con el que probó la existencia de núcleol en los átomos, en el que se reúne toda la carga positiva y casi toda la masa del átomo. Consiguió la primera transmutación artificial con la colaboración de su discípulo Frederick Soddy.

Henry Cavendish en su Laboratorio

La primera revolución científica comenzó con los descubrimientos de Copérnico, divulgados en 1.543, y los de Isaac Newton en 1.687 con su Gravedad y su obra de incomparable valor Principia Matemática, a todo esto siguió los nuevos hallazgos en la Física, la biología y la psicología.

Pero fue la Física la que abrió el camino. Disciplina en permanente cambio, debido principalmente a la de entender el átomo (esa sustancia elemental, invisible, indivisible que Demócrito expuso en la Grecia antigua).

John Dalton

En estos primeras décadas del siglo XIX, químicos como John Dalton se habían visto forzados a aceptar la teoría de los átomos como las unidades mínimas de los elementos, con miras a explicar lo que ocurría en las reacciones químicas (por ejemplo, el hecho de que dos líquidos incoloros produjeran, al mezclarse, un precipitado blanco). De similar, fueron estas propiedades químicas y el hecho de que variaran de forma sistemática, combinada con sus pesos atómicos, lo que sugirió al ruso Dimitri Mendeleyev la organización de la Tabla Periódica de los elementos, que concibió jugando, con “paciencia química”, con sesenta y tres cartas en su finca de Tver, a unos trescientos kilómetros de Moscú.

Pero además, la Tabla Periódica, a la que se ha llamado “el alfabeto del Universo” (el lenguaje del Universo), insinuaba que existían todavía elementos por .

Dimitri Mendeléiev en 1897

La tabla de Mendeleyev encajaba a la perfección con los hallazgos de la Física de partículas, con lo que vinculaba física y química de racional: era el primer paso hacia la unificación de las ciencias que caracterizaría el siglo XX.

En Cavendish, en 1.873, Maxwell refinaría la idea de átomo al introducir la idea de campo electromagnético (idea que tomó prestada de Faraday), y sostuvo que éste campo “impregnaba el vacío” y la energía eléctrica y magnética se propagaba a través de él a la velocidad de la luz. Sin embargo, Maxwell aún pensaba en el átomo como algo sólido y duro y que, básicamente, obedecían a las leyes de la mecánica.

El problema estaba en el hecho de que, los átomos, si existían, eran demasiado pequeños ser observados con la tecnología entonces disponible.

Esa situación empezaría a cambiar con Max Planck, el físico alemán que, como de su investigación de doctorado, había estudiado los conductores de calor y la segunda ley termodinámica, establecida originalmente por Rudolf Clausius, un físico alemán nacido en Polonia, aunque lord Kelvin también había hecho algún aporte.

El joven Max Planck

Clausius había presentado su ley por primera vez en 1.850, y esta estipulaba algo que cualquiera podía observar, a saber, que cuando se realiza un la energía se disipaba convertida en calor y que ese calor no puede reorganizarse en una forma útil. Esta idea, que por lo demás parecería una anotación de sentido común, tenía consecuencias importantísimas.

Dado que el calor (energía) no podía recuperarse, reorganizarse y reutilizarse, el Universo estaba dirigiéndose gradualmente un desorden completo:

cántaro roto…

Una casa que se desmorona nunca se reconstruye así misma, una botella rota nunca se recompone por decisión propia. La palabra que Clausius empleó designar este fenómeno o desorden irreversible y creciente fue “entropía”: su conclusión era que, llegado el , el Universo moriría.

En su doctorado, Planck advirtió la relevancia de esta idea. La segunda ley de la termodinámica evidenciaba que el tiempo era en verdad una fundamental del Universo, de la física. Sea lo que sea, el tiempo es un componente básico del mundo que nos rodea y se relaciona con la materia de formas que todavía no entendemos.

La noción de tiempo implica que el Universo solo funciona en un sentido, hacia delante, nunca se está quieto ni funciona hacia atrás, la entropía lo impide, su discurrir no tiene marcha atrás. ¿No será nuestro discurrir lo que siempre marcha hacia delante, y, lo que tenemos por tiempo se limita a estar ahí?

En el Laboratorio Cavendish, me viene a la memoria que fue allí, donde Thomson, en 1.897, realizó el descubrimiento que vino a coronar anteriores ideas y trabajos de Benjanmin Franklin, Euge Goldstein, Wilhelm Röntgen, Henri Becquerel y otros. El descubrimiento del electrón convirtió a la física moderna en una de las aventuras intelectuales más fascinantes e importantes del mundo contemporáneo.

Joseph John Thomson

Los “corpúsculos”, como Thomson denominó inicialmente a estas partículas, hoy conocidas como electrones, condujo de directa al trascendental avance realizado una década después por Ernest Rutherford, quien concibió el átomo como una especie de “sistema solar” en miniatura, con los electrones diminutos orbitando alrededor de un núcleo masivo como hacen los planetas alrededor del Sol. Rutherford demostró experimentalmente lo que Einstein había descubierto en su cabeza y revelado en su famosa ecuación, E = mc2 (1905), esto es que la materia y la energía eran esencialmente lo mismo.

Todo aquello fue un gran paso en la búsqueda del conocimiento de la materia. El genio, la intuición y la experimentación han sido esenciales en la lucha del ser humano con los secretos, bien guardados, de la Naturaleza.

emilio silvera

Totales: 87.728.606

Totales: 87.728.606 Conectados: 44

Conectados: 44