Agujeros Negros

Logran fotografiar por primera vez el agujero negro del centro de nuestra galaxia

IMPRESIÓN NO PERMITIDA - TEXTO SUJETO A DERECHOS DE AUTOR

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Enigmas del Corazón ~

Clasificado en Enigmas del Corazón ~

Comments (0)

Comments (0)

Investigadores del Departamento de Física Aplicada de la UPC, en España, junto con un equipo de la California State University de los Estados Unidos, han demostrado por primera vez que la transición en la alternancia cardiaca, una arritmia potencialmente mortal, comparte características con el ordenamiento ferromagnético de los metales. La investigación ayuda a entender mejor cómo se origina la muerte súbita y abre la puerta a diseñar nuevos fármacos para evitarla.

Las muertes súbitas cardíacas representan aproximadamente el 10% de los casos de muerte natural y la mayoría se deben a la fibrilación ventricular. En los Estados Unidos esto representa unas 300.000 muertes al año y en España, unas 20.000. Investigadores del Departamento de Física Aplicada de la Universitat Politècnica de Catalunya (UPC), junto con científicos de la California State University han demostrado, por primera vez, que la transición a la alternancia cardiaca, una arritmia relacionada con un mayor riesgo de muerte súbita, comparte características comunes con el ordenamiento ferromagnético de los metales. Esta nueva medida física permite entender mejor las causas de la muerte súbita y permitirá avanzar en el diseño de fármacos que puedan evitarlo. El artículo, titulado Calcium Alternans is Due to an Order-Disorder Phase Transition in Cardiac Cells, ha sido publicado en la revista científica Physical Review Letters.

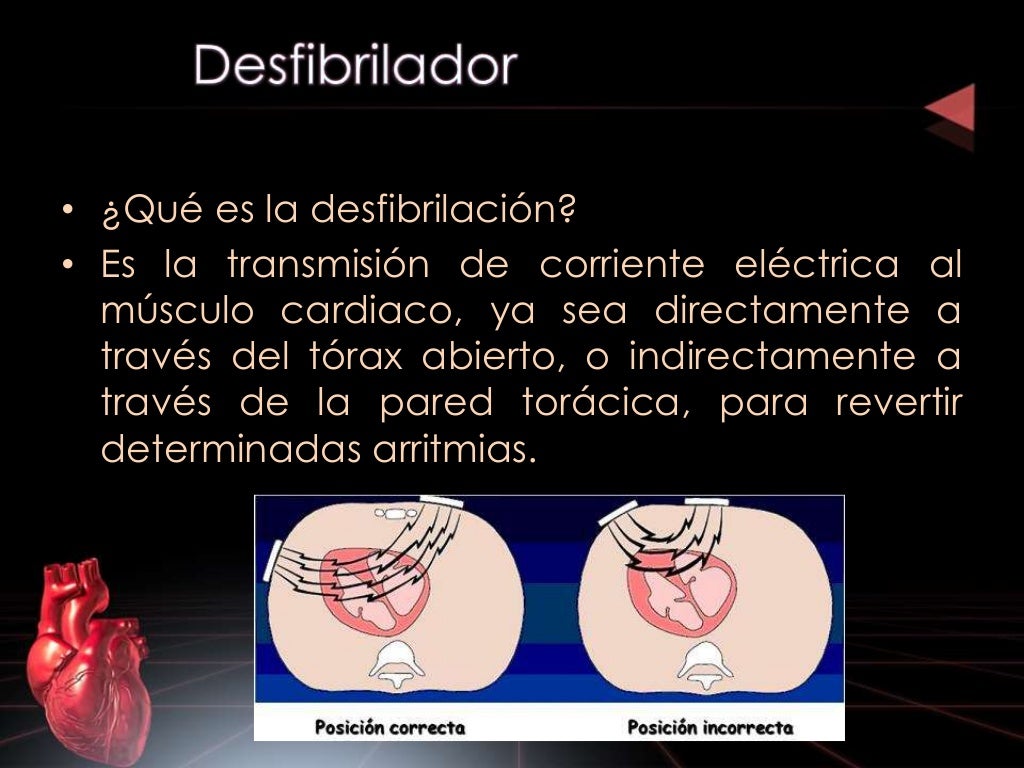

Hoy en día, las enfermedades cardíacas suponen una de las principales causas de muerte en los países desarrollados. De particular relevancia es la muerte súbita cardiaca, donde se produce una pérdida brusca de la función cardiaca. En situaciones normales, el corazón actúa como una bomba donde el orden de contraerse y bombear sangre se origina por pequeños cambios en las propiedades eléctricas de las células miocárdicas. Una parte importante de los casos de muerte súbita se deben a problemas en la sincronización de esta orden eléctrica, dando lugar a una contracción desordenada del corazón conocida como fibrilación ventricular. En este estadio, el corazón no es capaz de bombear la sangre y la muerte ocurre en pocos minutos, a menos que se administre un choque desfibrilador.

Uno de los posibles desencadenantes de la fibrilación ventricular es una arritmia conocida como alternancia cardiaca, donde la contracción del corazón se produce de manera coordinada en cada latido, pero su intensidad varía dando lugar a una contracción fuerte y débil en latidos alternativos. Para entender el origen de esta arritmia es necesario estudiar cómo se produce la contracción dentro de la célula, donde existen cientos de pequeñas subunidades compuestas por agrupaciones de canales que liberan iones de calcio cuando reciben la orden eléctrica. Esto es lo que marca la intensidad de la contracción: si liberan más calcio, la contracción es más fuerte; en cambio, si casi no liberan, hay poca contracción.

![Blas Echebarria, del Departamento de Física Aplicada de la Universitat Politècnica de Catalunya. (Foto: UPC) [Img #26821]](http://noticiasdelaciencia.com/upload/img/periodico/img_26821.jpg)

Blas Echebarria, del Departamento de Física Aplicada de la Universitat Politècnica de Catalunya. (Foto: UPC)

Los científicos Enric Álvarez-Lacalle y Blas Echebarria, del Departamento de Física Aplicada de la UPC, junto con investigadores de la California State University, han demostrado, mediante modelos de simulación, que la alternancia se produce debido a un tipo de transición que ha intrigado a los físicos desde hace décadas, una transición de desorden en el orden estudiada originalmente para entender la pérdida de las características ferromagnéticas al aumentar la temperatura por encima de un umbral límite.

Un material ferromagnético está formado por pequeños imanes que pueden enfocarse en una dirección o en otra. Si cada uno de estos imanes apunta en una dirección diferente, es decir, si el sistema está desordenado, su efecto magnético se anula. En cambio, por debajo de una cierta temperatura, todos los pequeños imanes comienzan a enfocarse hacia la misma dirección y el sistema se ordena. Esto hace que todo el conjunto se comporte como un gran imán.

En el caso del corazón, cada subunidad dentro de la célula encargada de liberar calcio puede decidir hacerlo o no. Cuando esto sucede de una manera desordenada, hay tantas células que liberan como que no, y el calcio total liberado es siempre el mismo, no varía. En cambio, en algunas situaciones se da una transición hacia un estado ordenado, como ocurre en los materiales ferromagnéticos. En este estado, todas las células deciden liberar o no liberar calcio al mismo tiempo, dando lugar a una secuencia de contracciones fuertes y débiles y, en último caso, a una transición hacia la fibrilación ventricular. La conclusión parece ser que el orden, en algunos casos, mata.

Según los científicos, entender bien cómo se produce la transición que causa la muerte súbita puede ayudar a diseñar fármacos que la eviten. Los resultados obtenidos de la investigación abren la puerta a estudiar posibles aplicaciones.

Sobre el siguiente paso de la investigación, Blas Echebarria explica que “actualmente estamos estudiando si el mismo efecto se observa en las células auriculares. Esto supondría un paso para entender la fibrilación auricular que, a pesar de no provocar la muerte súbita como la ventricular, conlleva un elevado riesgo de embolia y presenta una prevalencia muy alta, sobre todo en personas mayores de 60 años, disminuyendo su calidad de vida “. Para ello cuentan con el apoyo de científicos del Instituto de Ciencias Cardiovasculares de Cataluña (ICCC-CSIC), los experimentos de los que intentan modelizar. (Fuente: UPC)

Publica: emilio silvera

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Astronomía y Astrofísica ~

Clasificado en Astronomía y Astrofísica ~

Comments (2)

Comments (2)

El Modelo del Big Bang, que justo es reconocerlo, coincide con las observaciones realizadas, algunos, sin embargo, no lo tienen tan claro y dudan de que, a partir de un punto de infinita densidad y energía saliera todo esto que llamamos universo.

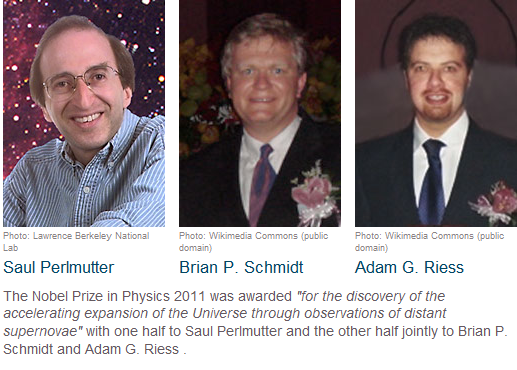

El Premio Nobelk de Física de 2011 se otorgó a los tres físicos que arriba podeis contemplar “por el descubrimiento de la expansión acelerada del universo gracias a observaciones de supernovas lejanas”. Es sin duda una de los hallazgos más extraordinarios que nos ha ofrecido la cosmología desde el descubrimiento del fondo cósmico de radiación de microondas. Gracias a estas observaciones, ahora sabemos que el universo no sólo se expande sino que lo hace de forma acelerada, en contra de lo esperado si estuviera compuesto de materia ordinaria.

(Es curioso que, después de que los premios fuesen concedidos a estos físicos, ha salido un español que, según dice y ha sido publicado, tenía registrado el trabajo, o uno similar, al que ha valido el novel de 2.011 a estos de arriba. La polémica está en marcha).

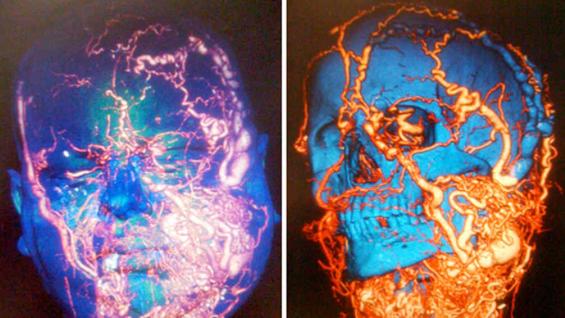

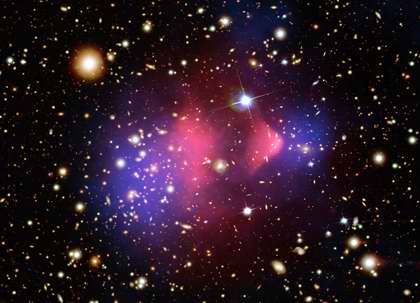

Esta imagen compuesta muestra conglomerado de galaxias 1E 0657-56. Este conglomerado se formó despues del choque de dos grandes grupos de galaxias, el suceso más energético que se conoce en el universo luego del Big Bang. Lo cierto es que, cuando ese punto (singularidad) del que surgió todo, es decir, el nacimiento del Universo, mediante el llamado Big Bang, la expansión del universo fue exponencial y ciertamente tuvo que ser máyor que c, lo cual nos lleva a pensar en cómo pudieron formarse las galaxias, si todo se estaba expandiendo a tal velocidad, la materia no tendría que haberse podido aglomerar (juntar) para formarlas. ¡Es todo tan extraño!

Los astrónomos dicen que han encontrado las mejores pruebas hasta la fecha sobre la Materia Oscura, la misteriosa sustancia invisible que se cree constituye la mayor parte de la masa del universo. En la imagen de arriba han querido significar, diferenciándola en colores, las dos clases de materia, la bariónica y la oscura que, en este caso, sería la azulada -según dicen-. Sin embargo, la imagen no refleja la proporción que dicen existe entre la una y la otra.

Para poder comprender este resultado tan extraordinario, podríamos poner un ejemplo sencillo: Por ejemplo, si lanzamos una pelota con fuerza hacia arriba, ésta sale despedida en la medida de la fuerza que la impulsó, y, llegado a un punto, la Gravedad que ejerce la Tierra sobre ella, la hará caer de nuevo. Sin embargo, si lanzamos la pelota con mucha más fuerza, ésta podría vencer la gravedad terrestre y salir al espacio exterior y escapar a velocidades cada vez menores. Sin embargo, lo que han observado los investigadores que han recibido el Nobel en 2011, es que el universo no se comporta de esta manera. En lugar de frenarse conforme se expande, el universo parece expandirse de forma acelerada. En la analogía de la pelota, es como si esta, una vez escapara de la Tierra, se alejara con una velocidad cada vez mayor. De esta realidad observada, se deduce de manera clara que, sobre el Universo, está actuando una fuerza desconocida que lo atrae y supera la atracción gravitacional de toda la materia que contiene conocida por nosotros.

Pero antes de describir las observaciones, recapitulemos sobre lo que sabemos del universo hasta ahora. La expansión del universo fue descubierta en los años 20 del pasado siglo por Vesto Slipher, Knut Lundmark, Georges Lemaítre y Edwin Hubble. El ritmo de exdpansión depende del contenido de energía, y un universo que contiene sólo materia termina frenándose gracias a la fuerza de gravedad.

Las galaxias se alejan las unas de las otras ganando velocidad

Las observaciones de la recesión de las galaxias, así como de las abundancias de elementos ligeros, pero sobre todo del fondo de radiación de microondas, nos han permitido construir una imagen del universo en expansión, a partir de un origen extremadamente caliente y denso, que se va enfriando conforme se expande. Hasta hace unas décadas se creía que esa expansión era cada vez más lenta y se especulaba sobre la posibilidad de que eventualmente el universo “recolapsara”. Sin embargo, las observaciones de la luz que nos llega de supernovas a distancias astronómicas, de hasta siete mil millones de años-luz -hechas por dos colaboraciones independientes: El Supernovae Cosmology Project, liderado por Saul Perlmutter, y el High Redshift Supernova Project, de Brian Schmidt y Adam Riess- mostraron que actualmente el ritmo de expansión está acelerándose, en lugar de decelerarse.

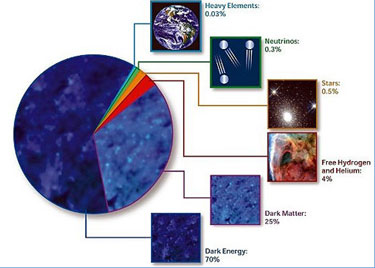

La hipótesis más común para dar cuenta de la expansión acelerada del universo es asumir la existencia de un tipo de energía exótica llamada energía oscura. De acuerdo con los cálculos cuantitativos alrededor del 70% del contenido energético del Universo consistiría en energía oscura, cuya presencia tendría un efecto similar a una constante cosmológica de tipo expansivo como el observado; sin embargo, la naturaleza exacta de este tipo de energía es desconocida.Pero, ¿qué pasa con las observaciones realizadas?

Estas observaciones han sido posible gracias a que las supernovas de tipo Ia son explosiones extraordinariamente violentas que se ven a enormes distancias y afortunadamente siguen un patrón de luminosidad característico, llegando a su máximo pocos días después de la explosión y a partir de ahí lentamnete decreciendo en luminosidad hasta que dejamos de verla. La relación entre la máxima luminosidad y el período de decrecimiento se puede calibrar con supernovas cercanas, de manera que midiendo estos períodos para muchas supernovas podemos deducir su distancvia a nosotros y de ahí el ritmo de expansión del universo desde el momento en que la supernova explotó hace miles de millones de años. Las medidas de las supernovas lejanas muestran no sólo que el universo se está expandiendo aceleradamente hoy día, sino también que en el pasado lo hacia de forma decelerada, lo que concuerda con nuestras predicciones basadas en la Teoría de Einstein.

En el contexto del Modelo estándar cosmológico, la aceleración se cree causada por la energía del vacío -a menudo llamada “energía oscura”- una componente que da cuenta de aproximadamente el 73% de toda la densidad de energía del universo. Del resto, cerca del 23%, sería debido a una forma desconocida de materia a la que llamamos “materia oscura”. Sólo alrededor del 4% de la densidad de la energía correspondería a la materia ordinaria, es decir, la que llamamos Bariónica, esa que emite radiación, la luminosa y de la que estamos nosotros constituidos, así como las estrellas, los mundos y las galaxias. Es, precisamente esa luz, la que nos permite adentrarnos en lo más profundo del universo desconocido, lejano y oscuro para poder saber, sobre estos misterios.

La energía del vacío es una clase de energía del punto cero existente en el espacio incluso en ausencia de todo tipo de materia. La energía del vacío tiene un origen puramente cuántico y es responsable de efectos físicos observables como el efecto Casimir y otros.

En nuestras vidas cotidianas, los efectos de la energía de vacío son ínfimos, diminutos, pero aún así detectables en pequeñas correcciones a los niveles de las energías de los átomos. En Teorías de campos relativistas, la energía de vacío está dada por una expresión matemáticamente idéntica y físicamente indistinguible de la famosa constante cosmológica, o por el contrario varia con el tiempo, algo que tendría consecuencias importantísimas para el destino del universo y que es un tema de investigación candente en cosmología, con varios experimentos propuestos para detectarlo.

Tipos de espacio según la densidad crítica del universo. Es decir, dependiendo del valor de Omega, tendremos un universo abierto, cerrado o plano. De momento, todos los indicios nos dicen que estamos en un universo plano que se expandirá para siempre.

En fin amigos, el tema es interesante y lo continuaremos en otro momento…

Le he robado un rato al trabajo para dejar esta página en el Blog por estimarla de interés para que todos, estén al día de los últimos descubrimientos en relación al universo en el que vivímos y de lo que los científicos nos cuentan de vez en cuando que, no siempre (creo), coincide con la realidad.

emilio silvera

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en a otros mundos ~

Clasificado en a otros mundos ~

Comments (0)

Comments (0)

Si los humanos pudiéramos escapar mañana a otro sistema solar, nuestra mejor opción sería ir a una enana roja. Estos astros mucho más pequeños y tenues que el Sol, invisibles a simple vista en el cielo nocturno, son los más abundantes en la Vía Láctea y albergan los planetas más cercanos y parecidos a la Tierra que se conocen. Ayer, el mejor destino hubiera sido el astro Trappist-1, que posiblemente alberga siete tierras, tres de ellas habitables, es decir, con posible agua líquida, a unos 40 años luz de nosotros. Los más arriesgados argumentarían que es mejor viajar a Próxima b, donde está el planeta terrestre más cercano al nuestro, a apenas cuatro años luz. Hoy, la cosas han cambiado, pues se ha descubierto el exoplaneta donde puede ser más probable encontrar indicios de vida, según sus descubridores.

Muchas son las enanas rojas que tienen en órbitas planetas como la Tierra

El nuevo planeta está a 40 años luz de la Tierra y orbita en torno a una enana roja llamada LHS 1140. En septiembre de 2014, el telescopio M-Earth, en Chile, captó una leve disminución de su luz que podía deberse al tránsito de un planeta. Este telescopio, junto a su gemelo en el hemisferio norte, tiene como objetivo observar todas las estrellas enanas que hay a menos de 100 años luz de la Tierra, a razón de 30 minutos por astro. Tras detectar la señal, el telescopio comenzó a seguir a la estrella en tiempo real mientras un sistema de inteligencia artificial seleccionaba los datos interesantes para confirmar la existencia del planeta.

Los resultados del estudio, publicados hoy en Nature y que incluyen el uso de otros telescopios, confirman que hay un planeta con un radio 1,4 veces el de la Tierra y una masa seis veces y media mayor. Estos dos datos implican que lo más probable es que este planeta tenga un núcleo de hierro denso recubierto de rocas, la misma composición que la Tierra.

Este nuevo mundo está unas 10 veces más cerca de su sol que la Tierra, pero el astro es tan tenue que la cantidad de radiación que le llega es la mitad de la que recibe nuestro planeta. Esto hace posible que el planeta tenga dos elementos indispensables para la vida: agua líquida y atmósfera.

Por ahora este es el candidato número uno a ser un planeta como la Tierra”

“Por ahora todos los datos que tenemos nos indican que este planeta debe tener un aspecto como el de la Tierra”, explica Jason Dittmann, astrónomo del Centro de Astrofísica Harvard-Smithsonian (EE UU) y coautor del estudio, quien desarrolló el sistema de inteligencia artificial que se ha empleado en el descubrimiento. “Por ahora este es el candidato número uno a ser un planeta como la Tierra”, asegura.

El planeta LHS 1140b se habría formado hace 5.000 millones de años posiblemente de una forma similar a la Tierra, aunque en un entorno mucho más hostil. Cuando las enanas rojas son jóvenes, emiten una alta radiación que puede destruir la atmósfera de los planetas rocosos en su entorno y hacerlos más parecidos a Venus que a nuestro planeta, explica Dittmann. El hecho de que este planeta sea ligeramente más grande que la Tierra podría favorecer que en el pasado albergase mares de lava que podrían haber permitido conservar una atmósfera con su aportación de vapores magmáticos.

Por ahora este puede ser el mejor candidato para observar la primera atmósfera de un mundo habitable fuera del Sistema Solar. Dittman señala que su equipo ya ha pedido tiempo de observación con el telescopio espacial Hubble para medir la dispersión de Rayleigh, el efecto que hace que la Tierra vista desde el espacio sea un punto azul pálido, y que podría confirmar la existencia de una atmósfera en el nuevo exoplaneta. Y en un año se podría usar el Telescopio Espacial James Webb para detectar oxígeno, metano y dióxido de carbono, compuestos que podrían indicar la presencia de vida, señala.

Trappist-1

El descubrimiento de este nuevo planeta es importante “comparado con Trappist-1 y Próxima b porque es el primer planeta terrestre con masa y tamaño bien determinados”, opina Guillem Anglada-Escudé, astrónomo español codescubridor del exoplaneta más cercano a la Tierra. “De momento han encontrado un solo planeta, pero es probable que haya más”, como “pasó con trappist-1, y esperamos que pase con Próxima”, explica. “Este puede ser unos de los sistemas solares importantes para la detección de atmósferas”, señala, aunque puede ser que pronto haya mejores candidatos aún. “Creo que se van a descubrir media docena más de estos planetas, alguno más cercano que Trappist-1 y este, porque hay unas 400 estrellas entre Trappist-1 y nosotros”, resalta.

“Este es el siguiente paso que estábamos esperando en la búsqueda de planetas como la Tierra”, señala José Caballero, investigador del Centro de Astrobiología. “Se descubren tantos planetas de golpe ahora porque hay muchos grupos de investigación en el mundo detrás de lo mismo”, explica. “Dentro de una década vendrán los planetas habitables alrededor de estrellas de tipo G, como el Sol”, añade.

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

La mente humana es tan compleja que no todos ante la misma cosa vemos lo mismo. Nos enseñan figuras y dibujos y nos piden que digamos (sin pensarlo) la primera cosa que nos sugiere. De entre diez personas, sólo coinciden tres, los otros siete divergen en la apreciación de lo que el dibujo o la figura les sugiere. Un paisaje puede ser descrito de muy distintas maneras según quién lo pueda contar.

Solo el 1% de las formas de vida que han vivido en la Tierra están ahora presentes, el 99%, por una u otra razón se han extinguido. Sin embargo, ese pequeño tanto por ciento de la vida actual, supone unos cinco millones de especies según algunas estimaciones. La Tierra acoge a todas esas especies u palpita de vida que prolifera por doquier. Hay seres vivos por todas partes y por todos los rincones del inmenso mosaico de ambientes que constituye nuestro planeta encontramos formas de vida, cuyos diseños parecen hechos a propósito para adaptarse a su hábitat, desde las profundidades abisales de los océanos hasta las más altas cumbres, desde las espesas selvas tropicales a las planicies de hielo de los casquetes polares. Se ha estimado la edad de 3.800 millones de años desde que aparecieron los primeros “seres vivos” sobre el planeta (dato de los primeros microfósiles). Desde entonces no han dejado de aparecer más y más especies, de las que la mayoría se han ido extinguiendo. Desde el siglo XVIII en que Carlos Linneo propuso su Systema Naturae no han cesado los intentos por conocer la Biodiversidad…, de la que por cierto nuestra especie, bautizada como Homo sapiens por el propio Linneo, es una recién llegada de apenas 200.000 años.

Ahora, hablaremos de la vida media de las partículas elementales (algunas no tanto). Cuando hablamos del tiempo de vida de una partícula nos estamos refiriendo al tiempo de vida media, una partícula que no sea absolutamente estable tiene, en cada momento de su vida, la misma probabilidad de desintegrarse. Algunas partículas viven más que otras, pero la vida media es una característica de cada familia de partículas.

También podríamos utilizar el concepto de “semivida”. Si tenemos un gran número de partículas idénticas, la semivida es el tiempo que tardan en desintegrarse la mitad de ese grupo de partículas. La semivida es 0,693 veces la vida media.

Si miramos una tabla de las partículas más conocidas y familiares (fotón, electrón muón tau, la serie de neutrinos, los mesones con sus piones, kaones, etc., y, los Hadrones bariones como el protón, neutrón, lambda, sigma, psi y omega, en la que nos expliquen sus propiedades de masa, carga, espín, vida media (en segundos) y sus principales maneras de desintegración, veríamos como difieren las unas de las otras.

Algunas partículas tienen una vida media mucho más larga que otras. De hecho, la vida media difiere enormemente. Un neutrón por ejemplo, vive 10¹³ veces más que una partícula Sigma⁺, y ésta tiene una vida 10⁹ veces más larga que la partícula sigma cero. Pero si uno se da cuenta de que la escala de tiempo “natural” para una partícula elemental (que es el tiempo que tarda su estado mecánico-cuántico, o función de ondas, en evolucionar u oscilar) es aproximadamente 10ˉ²⁴ segundos, se puede decir con seguridad que todas las partículas son bastantes estables. En la jerga profesional de los físicos dicen que son “partículas estables”.

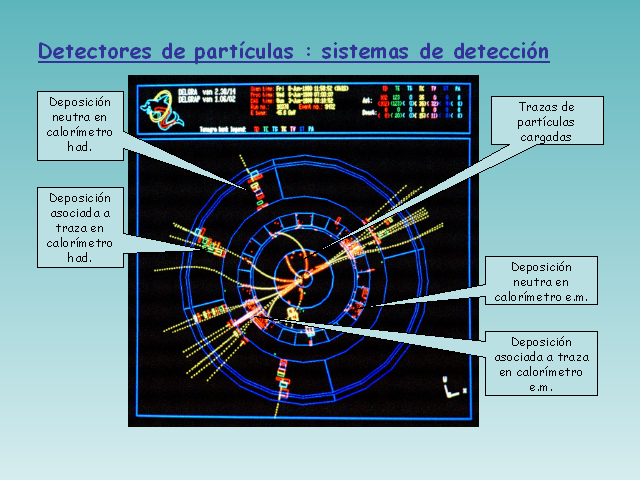

¿Cómo se determina la vida media de una partícula? Las partículas de vida larga, tales como el neutrón y el muón, tienen que ser capturadas, preferiblemente en grandes cantidades, y después se mide electrónicamente su desintegración. Las partículas comprendidas entre 10ˉ¹⁰ y 10ˉ⁸ segundos solían registrarse con una cámara de burbujas, pero actualmente se utiliza con más frecuencia la cámara de chispas. Una partícula que se mueve a través de una cámara de burbujas deja un rastro de pequeñas burbujas que puede ser fotografiado. La Cámara de chispas contiene varios grupos de de un gran número de alambres finos entrecruzados entre los que se aplica un alto voltaje. Una partícula cargada que pasa cerca de los cables produce una serie de descargas (chispas) que son registradas electrónicamente. La ventaja de esta técnica respecto a la cámara de burbujas es que la señal se puede enviar directamente a una computadora que la registra de manera muy exacta.

Una partícula eléctricamente neutra nunca deja una traza directamente, pero si sufre algún tipo de interacción que involucre partículas cargadas (bien porque colisionen con un átomo en el detector o porque se desintegren en otras partículas), entonces desde luego que pueden ser registradas. Además, realmente se coloca el aparato entre los polos de un fuerte imán. Esto hace que la trayectoria de las partículas se curve y de aquí se puede medir la velocidad de las partículas. Sin embargo, como la curva también depende de la masa de la partícula, es conveniente a veces medir también la velocidad de una forma diferente.

Una colisión entre un protón y un antiprotón registrada mediante una cámara de chispas del experimento UA5 del CERN.

En un experimento de altas energías, la mayoría de las partículas no se mueven mucho más despacio que la velocidad de la luz. Durante su carta vida pueden llegar a viajar algunos centímetros y a partir de la longitud media de sus trazas se puede calcular su vida. Aunque las vidas comprendidas entre 10ˉ¹³ y 10ˉ²⁰ segundos son muy difíciles de medir directamente, se pueden determinar indirectamente midiendo las fuerzas por las que las partículas se pueden transformar en otras. Estas fuerzas son las responsables de la desintegración y, por lo tanto, conociéndolas se puede calcular la vida de las partículas, Así, con una pericia ilimitada los experimentadores han desarrollado todo un arsenal de técnicas para deducir hasta donde sea posible todas las propiedades de las partículas. En algunos de estos procedimientos ha sido extremadamente difícil alcanzar una precisión alta. Y, los datos y números que actualmente tenemos de cada una de las partículas conocidas, son los resultados acumulados durante muchísimos años de medidas experimentales y de esa manera, se puede presentar una información que, si se valorara en horas de trabajo y coste de los proyectos, alcanzaría un precio descomunal pero, esa era, la única manera de ir conociendo las propiedades de los pequeños componentes de la materia.

Que la mayoría de las partículas tenga una vida media de 10ˉ⁸ segundos significa que son ¡extremadamente estables! La función de onda interna oscila más de 10²² veces/segundo. Este es el “latido natural de su corazón” con el cual se compara su vida. Estas ondas cuánticas pueden oscilar 10ˉ⁸ x 10²², que es 1¹⁴ o 100.000.000.000.000 veces antes de desintegrarse de una u otra manera. Podemos decir con toda la seguridad que la interacción responsable de tal desintegración es extremadamente débil.

Se habla de ondas cuánticas y también, de ondas gravitacionales. Las primeras han sido localizadas y las segundas están siendo perseguidas.

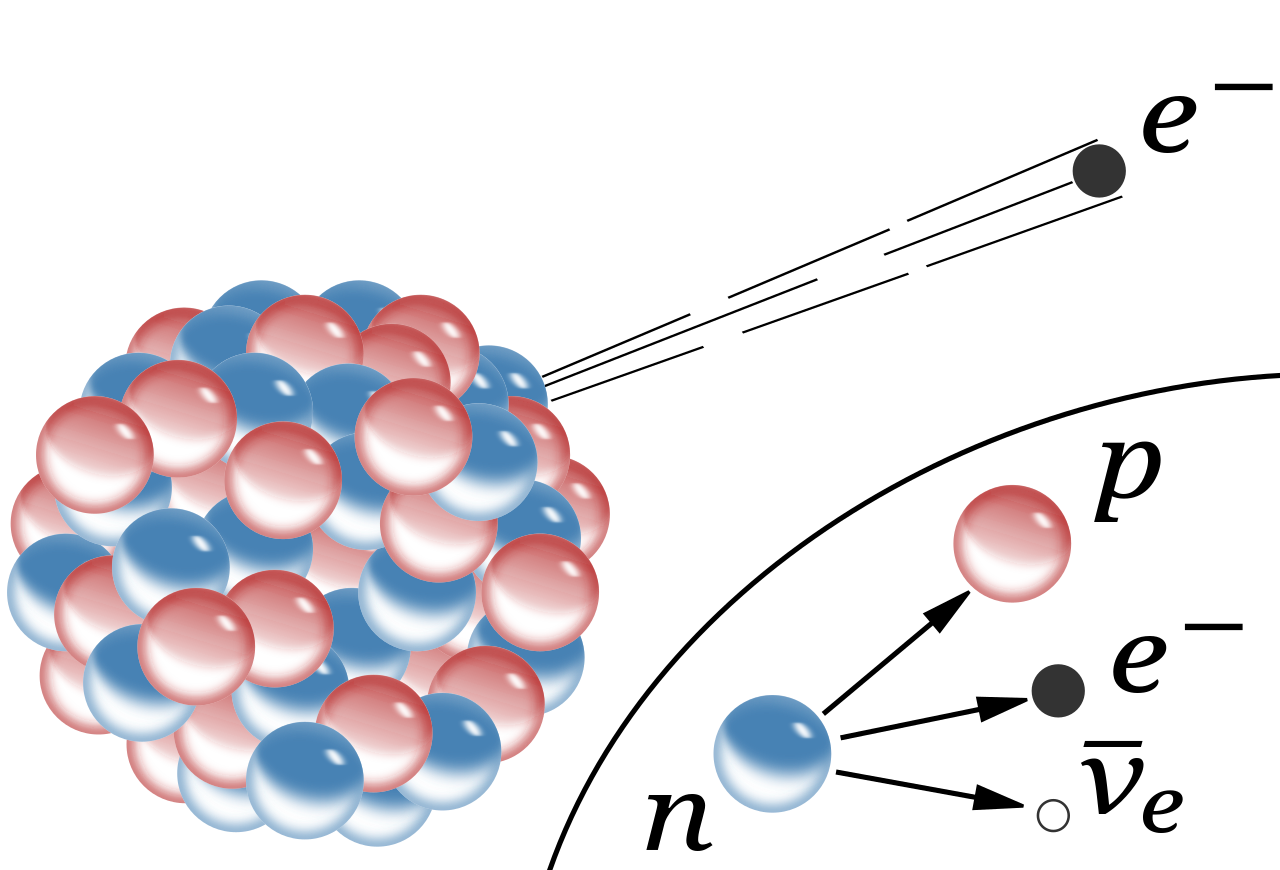

Aunque la vida de un neutrón sea mucho más larga (en promedio un cuarto de hora), su desintegración también se puede atribuir a la interacción débil. A propósito, algunos núcleos atómicos radiactivos también se desintegran por interacción débil, pero pueden necesitar millones e incluso miles de millones de años para ello. Esta amplia variación de vidas medias se puede explicar considerando la cantidad de energía que se libera en la desintegración. La energía se almacena en las masas de las partículas según la bien conocida fórmula de Einstein E = Mc². Una desintegración sólo puede tener lugar si la masa total de todos los productos resultantes es menor que la masa de la partícula original. La diferencia entre ambas masas se invierte en energía de movimiento. Si la diferencia es grande, el proceso puede producirse muy rápidamente, pero a menudo la diferencia es tan pequeña que la desintegración puede durar minutos o incluso millones de años. Así, lo que determina la velocidad con la que las partículas se desintegran no es sólo la intensidad de la fuerza, sino también la cantidad de energía disponible.

Si no existiera la interacción débil, la mayoría de las partículas serían perfectamente estables. Sin embargo, la interacción por la que se desintegran las partículas π°, η y Σ° es la electromagnética. Se observará que estas partículas tienen una vida media mucho más corta, aparentemente, la interacción electromagnética es mucho más fuerte que la interacción débil.

Durante la década de 1950 y 1960 aparecieron tal enjambre de partículas que dio lugar a esa famosa anécdota de Fermi cuando dijo: “Si llego a adivinar esto me hubiera dedicado a la botánica.”

Si la vida de una partícula es tan corta como 10ˉ²³ segundos, el proceso de desintegración tiene un efecto en la energía necesaria para producir las partículas ante de que se desintegre. Para explicar esto, comparemos la partícula con un diapasón que vibra en un determinado modo. Si la “fuerza de fricción” que tiende a eliminar este modo de vibración es fuerte, ésta puede afectar a la forma en la que el diapasón oscila, porque la altura, o la frecuencia de oscilación, está peor definida. Para una partícula elemental, esta frecuencia corresponde a su energía. El diapasón resonará con menor precisión; se ensancha su curva de resonancia. Dado que para esas partículas extremadamente inestable se miden curvas parecidas, a medida se las denomina resonancias. Sus vidas medias se pueden deducir directamente de la forma de sus curvas de resonancia.

Bariones Delta. Un ejemplo típico de una resonancia es la delta (∆), de la cual hay cuatro especies ∆ˉ, ∆⁰, ∆⁺ y ∆⁺⁺(esta última tiene doble carga eléctrica). Las masas de las deltas son casi iguales 1.230 MeV. Se desintegran por la interacción fuerte en un protón o un neutrón y un pión.

Existen tanto resonancias mesónicas como bariónicas . Las resonancias deltas son bariónicas. Las resonancias deltas son bariónicas. (También están las resonancias mesónicas rho, P).

Las resonancias parecen ser solamente una especie de versión excitada de los Hadrones estable. Son réplicas que rotan más rápidamente de lo normal o que vibran de diferente manera. Análogamente a lo que sucede cuando golpeamos un gong, que emite sonido mientras pierde energía hasta que finalmente cesa de vibrar, una resonancia termina su existencia emitiendo piones, según se transforma en una forma más estable de materia.

Por ejemplo, la desintegración de una resonancia ∆ (delta) que se desintegra por una interacción fuerte en un protón o neutrón y un pión, por ejemplo:

∆⁺⁺→р + π⁺; ∆⁰→р + πˉ; o п+π⁰

En la desintegración de un neutrón, el exceso de energía-masa es sólo 0,7 MeV, que se puede invertir en poner en movimiento un protón, un electrón y un neutrino. Un Núcleo radiactivo generalmente tiene mucha menos energía a su disposición.

El estudio de los componentes de la materia tiene una larga historia en su haber, y, muchos son los logros conseguidos y muchos más los que nos quedan por conseguir, ya que, nuestros conocimientos de la masa y de la energía (aunque nos parezca lo contrario), son aún bastante limitados, nos queda mucho por descubrir antes de que podamos decir que dominamos la materia y sabemos de todos sus componentes. Antes de que eso llegue, tendremos que conocer, en profundidad, el verdadero origen de la Luz que esconde muchos secretos que tendremos que desvelar.

Esperemos que con los futuros experimentos del LHC y de los grandes Aceleradores de partículas del futuro, se nos aclaren algo las cosas y podamos avanzar en el perfeccionamiento del Modelo Estándar de la Física de Partículas que, como todos sabemos es un Modelo incompleto que no contiene a todas las fuerzas de la Naturaleza y, cerca de una veintena de sus parámetros son aleatorios y no han sido explicados. Uno de ellos, el Bosón de Higgs, dicen que ha sido encontrado. Sin embargo, a mí particularmente me quedan muchas dudas al respecto.

emilio silvera

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Agujeros negros ~

Clasificado en Agujeros negros ~

Comments (0)

Comments (0)

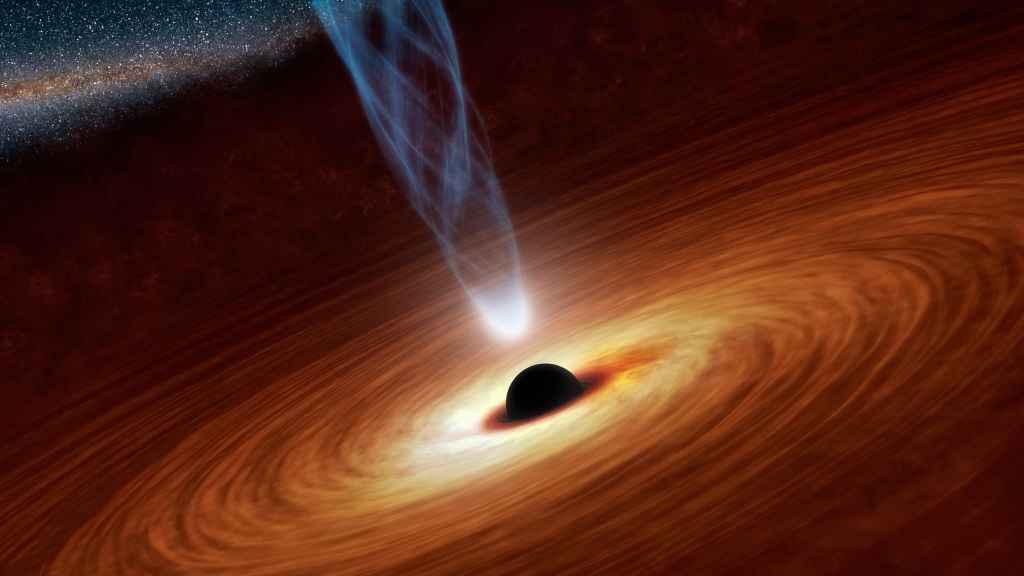

Sin embargo, la imagen que acompaña a este impactante titular es una ilustración. ¿Por qué? Más detalles -incluyendo la participación española en esta gesta científica- en el interior de la noticia.

Ilustración de un agujero negro. NASA / JPL

Ilustración de un agujero negro. NASA / JPL

El titular de esta noticia anuncia que, por primera vez, se ha logrado fotografiar un agujero negro pero la imagen que lo acompaña es simplemente una ilustración. Pero eh, no se marchen todavía: esa foto existe, ha sido tomada por el Event Horizon Telescope (EHT) a lo largo de diez días y, aparentemente, representa a Sagitario A*, el agujero negro supermasivo ubicado en el centro de nuestra Vía Láctea.

La imagen, según sus responsables, está siendo sometida a investigación, pero se espera que para finales de 2017 la anhelada foto se haga pública. Por hacer un símil fotográfico, la imagen del agujero negro es como una Polaroid que tendremos que agitar durante unos meses para ver si representa con exactitud lo que queríamos fotografiar o si se ve borrosa.

Pese a tener una masa equivalente a cuatro millones de soles, Sagitario A* fue un desconocido hasta mediados de los años setenta, cuando Bruce Balick y Robert Brown descubrieron que algo perturbaba la órbita de una estrella cercana, S2. Pese a las sospechas, no pudieron identificar inmediatamente que fuese un agujero negro.

Hubo que esperar hasta 2002, cuando el alemán Reinhard Genzel reveló que hablábamos de un agujero negro supermasivo en el centro de nuestra galaxia. “¿Pueden ser los agujeros negros y las galaxias dos sistemas que se alimentan el uno al otro con un intercambio de gas y radiación?”, declaró Genzel en entrevista con EL ESPAÑOL, “vamos teniendo evidencia ahora de que esto es así, es fascinante lo que estamos aprendiendo: parece ser una relación cercana, pero aún no sabemos si fue primero el huevo o la gallina”.

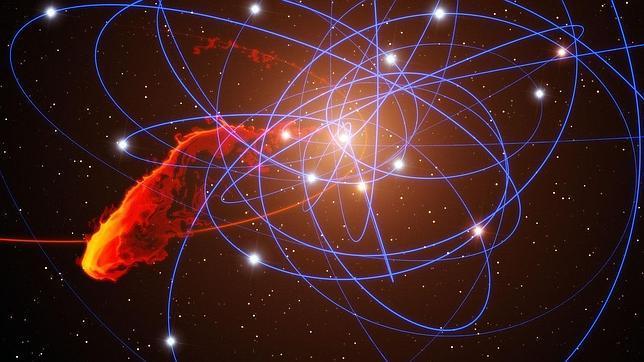

Hasta el momento, lo más cercano que tenemos para ver el citado agujero negro es esta imagen del Observatorio Europeo Austral, en el que el efecto gravitatorio de Sagitario A* lleva a una nube de polvo a moverse en dirección al agujero negro desde el punto azul (2006) al verde (2010) y finalmente al rojo (2013).

Una nube de gas desplazada del punto azul (2006) al rojo (2013) por Sagitario A*. ESO / S. Gillessen

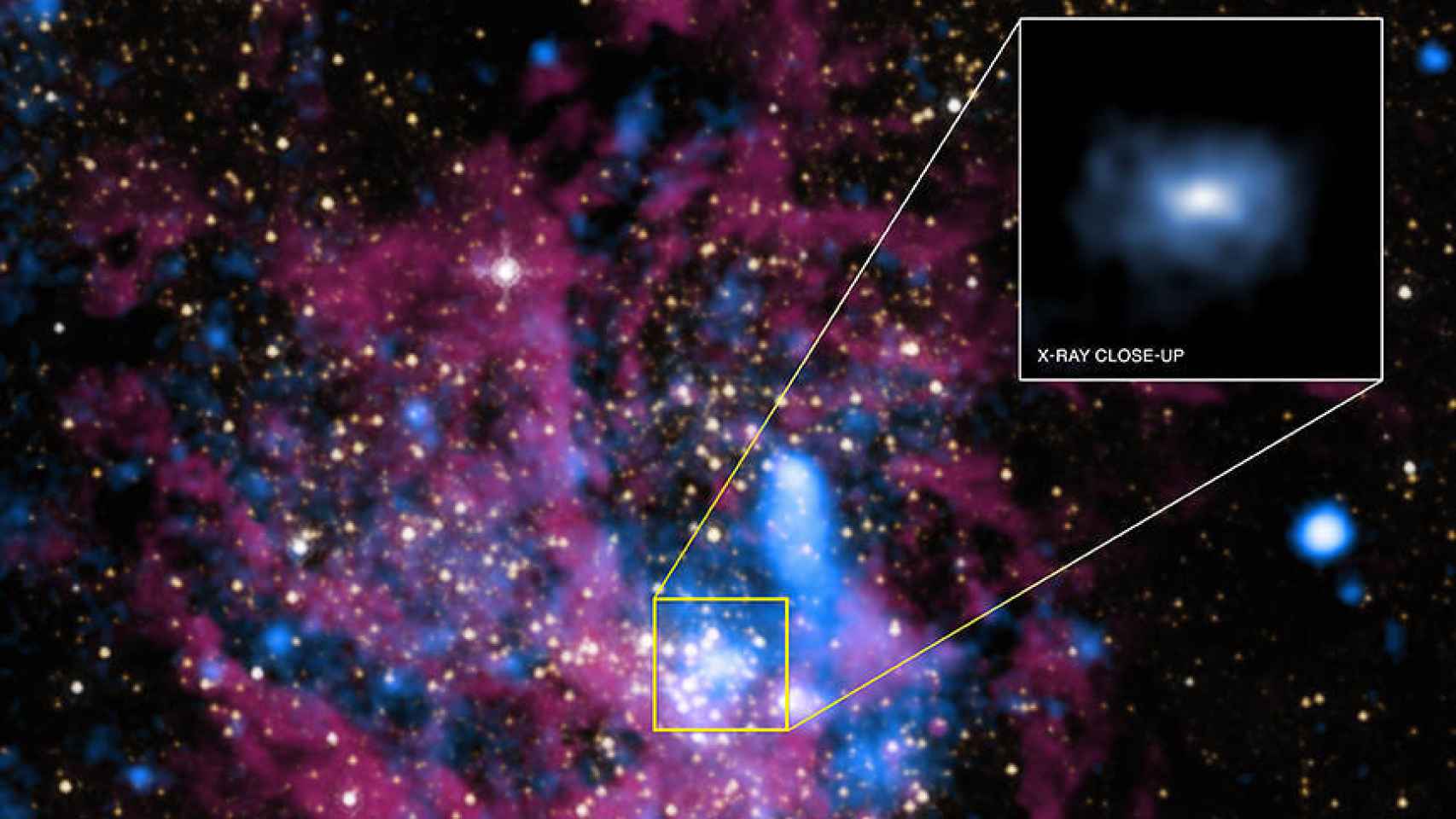

Otro reciente intento de enmarcar al esquivo agujero negro es éste, de la NASA, con telescopios de rayos X. Lo que brilla en este caso es un fogonazo de actividad que brota de las nubes de gas que rodean al agujero.

Arriba a la derecha, imagen destacada de Sagitario A*. NASA

La anhelada fotografía del agujero negro ocupa el trozo de espacio entre Sagitario A* y sus alrededores hasta la ‘cercana’ galaxia M87 y está almacenada en 4.024 discos duros. Se ha tomado desde ocho radio telescopios de alta frecuencia ubicados en altiplanos o montañas de distintas partes del mundo, entre ellos el Telescopio de 30 metros que tenemos situado en el Pico Veleta, en Sierra Nevada.

En primer lugar, porque son muy pequeños. Sagitario A* tiene una masa equivalente a cuatro millones de soles, pero su tamaño es tan sólo 17 veces mayor que nuestra estrella más cercana, y eso, a 25.000 años luz de distancia, no es nada.

A este problema hay que añadir otro, que un agujero negro es espacio vacío y que, con una concentración semejante de masa en tan poco espacio, su fuerza gravitatoria es tan grande que atrae toda la luz a su alrededor.

La combinación de varios telescopios recogiendo datos en distintos puntos del globo resolvió un problema, pero generó otro: ¿Cómo combinar tantos y tan variados conjuntos de datos sobre el espacio? Porque en realidad, si este año logramos ver finalmente la imagen de un agujero negro es gracias a un algoritmo, llamado CHIRP y generado en el Instituto Tecnológico de Massachussets (MIT) por Katie Bouman, una joven doctoranda en informática, y su equipo.

Cuando tomamos una fotografía panorámica con el móvil, lo que va haciendo la cámara es tomar distintas fotos y superponerlas como parches. CHIRP hace algo parecido, aunque con un nivel de complejidad supremo: millones de datos sobre el espacio mezclados, que se confunden con la composición de nuestra propia atmósfera y que además fueron recogidos en momentos diferentes.

Incluso si esta foto acaba siendo más cutre de lo esperado, para los astrofísicos tendrá un enorme valor porque podrá servir para comprobar si las teorías de Albert Einstein sobre la gravedad siguen siendo válidas en un espacio tan extremo como los alrededores de un agujero negro.