Agujeros Negros

Logran fotografiar por primera vez el agujero negro del centro de nuestra galaxia

IMPRESIÓN NO PERMITIDA - TEXTO SUJETO A DERECHOS DE AUTOR

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Agujeros negros ~

Clasificado en Agujeros negros ~

Comments (0)

Comments (0)

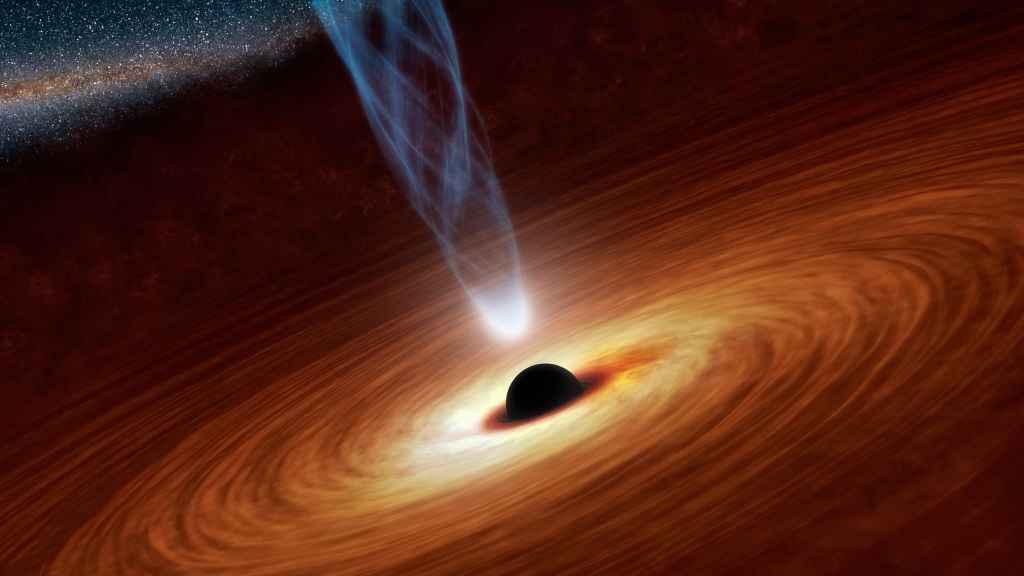

Sin embargo, la imagen que acompaña a este impactante titular es una ilustración. ¿Por qué? Más detalles -incluyendo la participación española en esta gesta científica- en el interior de la noticia.

Ilustración de un agujero negro. NASA / JPL

Ilustración de un agujero negro. NASA / JPL

El titular de esta noticia anuncia que, por primera vez, se ha logrado fotografiar un agujero negro pero la imagen que lo acompaña es simplemente una ilustración. Pero eh, no se marchen todavía: esa foto existe, ha sido tomada por el Event Horizon Telescope (EHT) a lo largo de diez días y, aparentemente, representa a Sagitario A*, el agujero negro supermasivo ubicado en el centro de nuestra Vía Láctea.

La imagen, según sus responsables, está siendo sometida a investigación, pero se espera que para finales de 2017 la anhelada foto se haga pública. Por hacer un símil fotográfico, la imagen del agujero negro es como una Polaroid que tendremos que agitar durante unos meses para ver si representa con exactitud lo que queríamos fotografiar o si se ve borrosa.

Pese a tener una masa equivalente a cuatro millones de soles, Sagitario A* fue un desconocido hasta mediados de los años setenta, cuando Bruce Balick y Robert Brown descubrieron que algo perturbaba la órbita de una estrella cercana, S2. Pese a las sospechas, no pudieron identificar inmediatamente que fuese un agujero negro.

Hubo que esperar hasta 2002, cuando el alemán Reinhard Genzel reveló que hablábamos de un agujero negro supermasivo en el centro de nuestra galaxia. “¿Pueden ser los agujeros negros y las galaxias dos sistemas que se alimentan el uno al otro con un intercambio de gas y radiación?”, declaró Genzel en entrevista con EL ESPAÑOL, “vamos teniendo evidencia ahora de que esto es así, es fascinante lo que estamos aprendiendo: parece ser una relación cercana, pero aún no sabemos si fue primero el huevo o la gallina”.

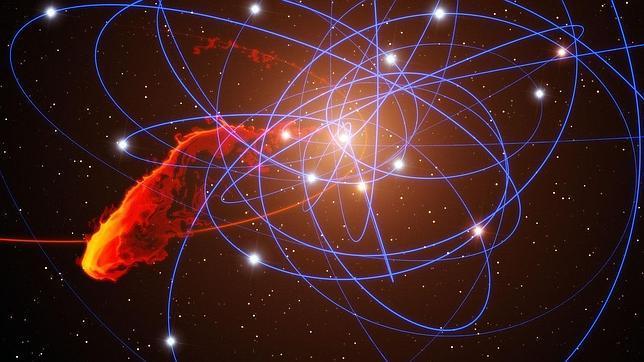

Hasta el momento, lo más cercano que tenemos para ver el citado agujero negro es esta imagen del Observatorio Europeo Austral, en el que el efecto gravitatorio de Sagitario A* lleva a una nube de polvo a moverse en dirección al agujero negro desde el punto azul (2006) al verde (2010) y finalmente al rojo (2013).

Una nube de gas desplazada del punto azul (2006) al rojo (2013) por Sagitario A*. ESO / S. Gillessen

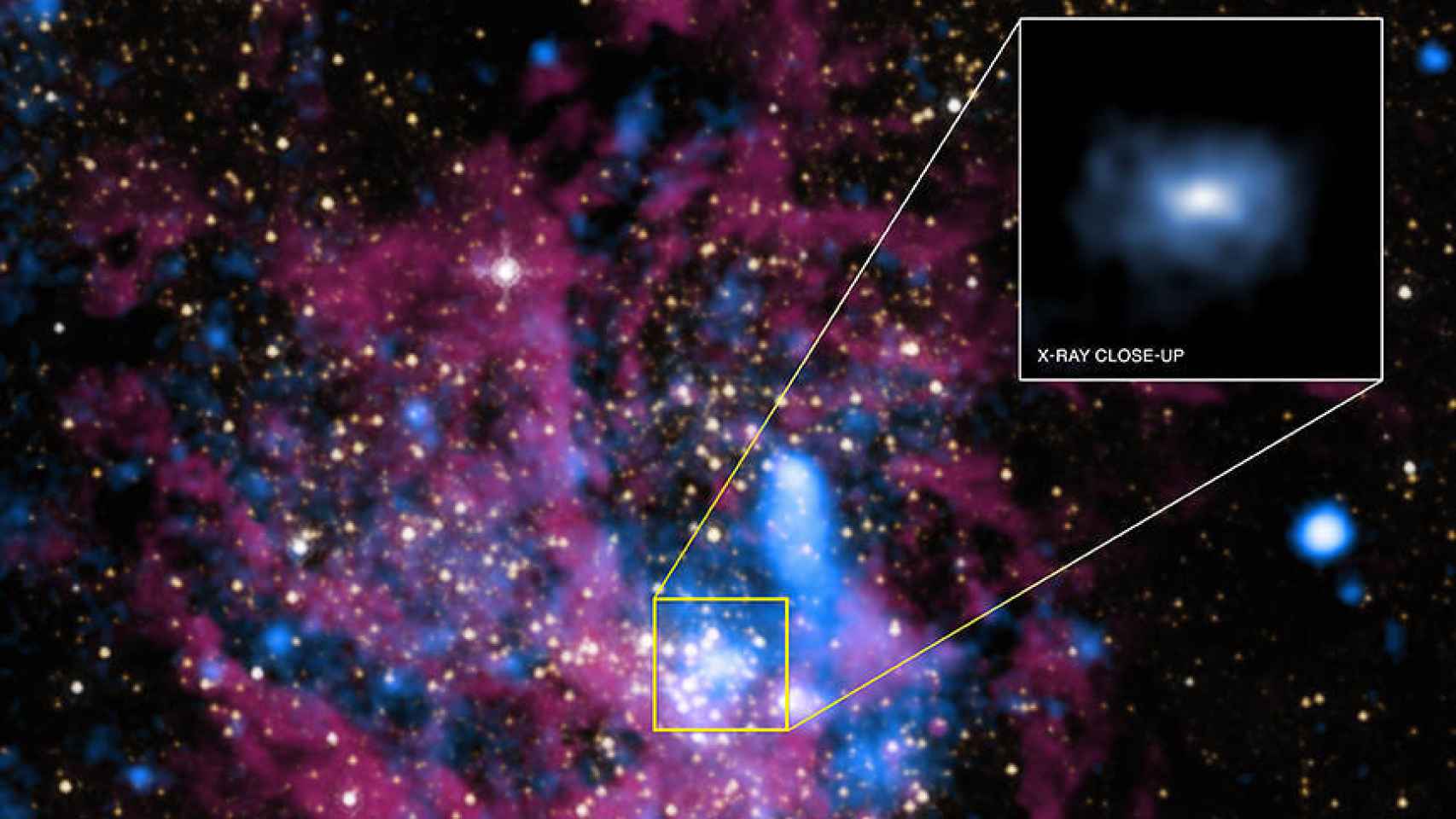

Otro reciente intento de enmarcar al esquivo agujero negro es éste, de la NASA, con telescopios de rayos X. Lo que brilla en este caso es un fogonazo de actividad que brota de las nubes de gas que rodean al agujero.

Arriba a la derecha, imagen destacada de Sagitario A*. NASA

La anhelada fotografía del agujero negro ocupa el trozo de espacio entre Sagitario A* y sus alrededores hasta la ‘cercana’ galaxia M87 y está almacenada en 4.024 discos duros. Se ha tomado desde ocho radio telescopios de alta frecuencia ubicados en altiplanos o montañas de distintas partes del mundo, entre ellos el Telescopio de 30 metros que tenemos situado en el Pico Veleta, en Sierra Nevada.

En primer lugar, porque son muy pequeños. Sagitario A* tiene una masa equivalente a cuatro millones de soles, pero su tamaño es tan sólo 17 veces mayor que nuestra estrella más cercana, y eso, a 25.000 años luz de distancia, no es nada.

A este problema hay que añadir otro, que un agujero negro es espacio vacío y que, con una concentración semejante de masa en tan poco espacio, su fuerza gravitatoria es tan grande que atrae toda la luz a su alrededor.

La combinación de varios telescopios recogiendo datos en distintos puntos del globo resolvió un problema, pero generó otro: ¿Cómo combinar tantos y tan variados conjuntos de datos sobre el espacio? Porque en realidad, si este año logramos ver finalmente la imagen de un agujero negro es gracias a un algoritmo, llamado CHIRP y generado en el Instituto Tecnológico de Massachussets (MIT) por Katie Bouman, una joven doctoranda en informática, y su equipo.

Cuando tomamos una fotografía panorámica con el móvil, lo que va haciendo la cámara es tomar distintas fotos y superponerlas como parches. CHIRP hace algo parecido, aunque con un nivel de complejidad supremo: millones de datos sobre el espacio mezclados, que se confunden con la composición de nuestra propia atmósfera y que además fueron recogidos en momentos diferentes.

Incluso si esta foto acaba siendo más cutre de lo esperado, para los astrofísicos tendrá un enorme valor porque podrá servir para comprobar si las teorías de Albert Einstein sobre la gravedad siguen siendo válidas en un espacio tan extremo como los alrededores de un agujero negro.