Ago

24

El Horizonte de los Agujeros Negros

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Agujeros negros ~

Clasificado en Agujeros negros ~

Comments (0)

Comments (0)

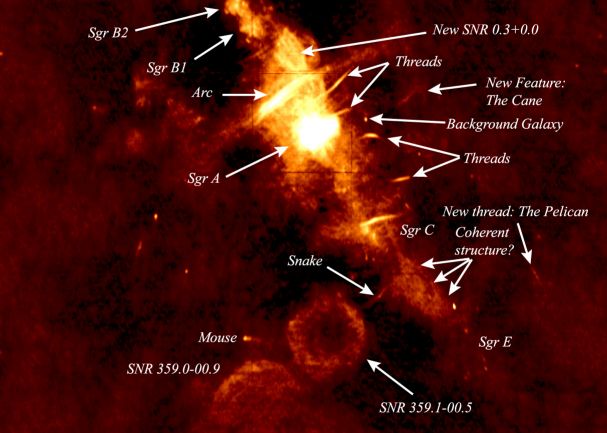

La técnica de la interferometría de muy larga base a longitudes de onda milimétricas (mm-VLBI) ha permitido obtener imágenes de los motores centrales de las galaxias activas con una resolución angular de decenas de microsegundos de arco. Para aquellos objetos más cercanos (M87, SgrA) se obtienen resoluciones lineales del orden de las decenas de Radios de Schwarzschild, lo que permite estudiar con detalle único la vecindad de los agujeros negros supermasivos.

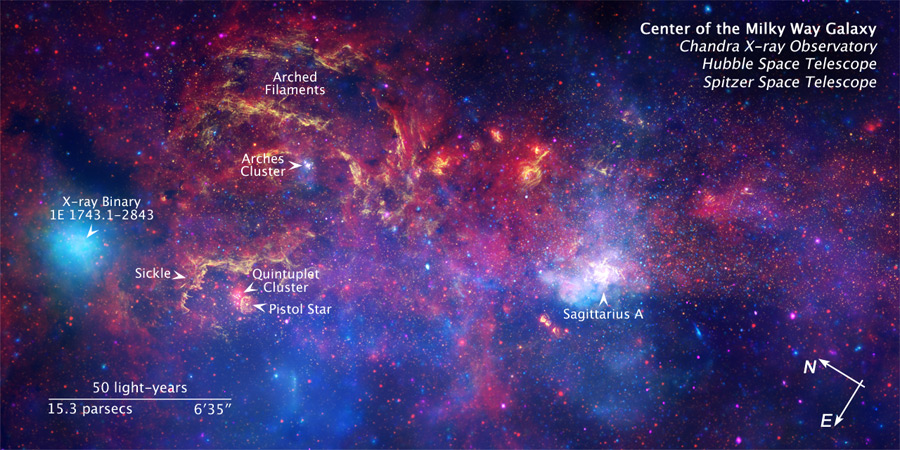

Al sintonizar hacia el centro de la Vía Láctea, los radioastrónomos exploran un lugar complejo y misterioso donde está SgrA que…¡Esconde un Agujero Nefro descomunal! Las observaciones astronómicas utilizando la técnica de Interferometría de muy larga base, a longitudes de onda milimétricas proporcionan una resolución angular única en Astronomía. De este modo, observando a 86 GHz se consigue una resolución angular del orden de 40 microsegundos de arco, lo que supone una resolución lineal de 1 año-luz para una fuente con un corrimiento al rojo z = 1, de 10 días-luz para una fuente con un corrimiento al rojo de z = 0,01 y de 10 minutos-luz (1 Unidad Astronómica) para una fuente situada a una distancia de 8 Kpc (1 parcec = 3,26 años-luz), la distancia de nuestro centro galáctico. Debemos resaltar que con la técnica de mm-VLBI disfrutamos de una doble ventaja: por un lado alcanzamos una resolución de decenas de microsegundos de arco, proporcionando imágenes muy detalladas de las regiones emisoras y, por otro, podemos estudiar aquellas regiones que son parcialmente opacas a longitudes de onda más larga.

El Telescopio Espacio Hubble capta la Imagen de un chorro de 5000 años-luz de longitud que está siendo eyectado del núcleo activo de la galaxia M87 (una radiogalaxia). La radiación sincrotrón del chorro (azul) contrasta con la luz estelar de la galaxia albergadora (amarillo). Crédito: NASA/ESA.

Las galaxias activas tienen nucleos que brillan tanto, que pueden llegar a ser más luminosos que las galaxias que los alberga. Estas galaxias activas sae caracterizan porque en sus núcleos ocurren procesos no-térmicos que liberan enormes cantidades de energía que parece provenir de una región muy pequeña y brillante situada en el corazón de la galaxia.

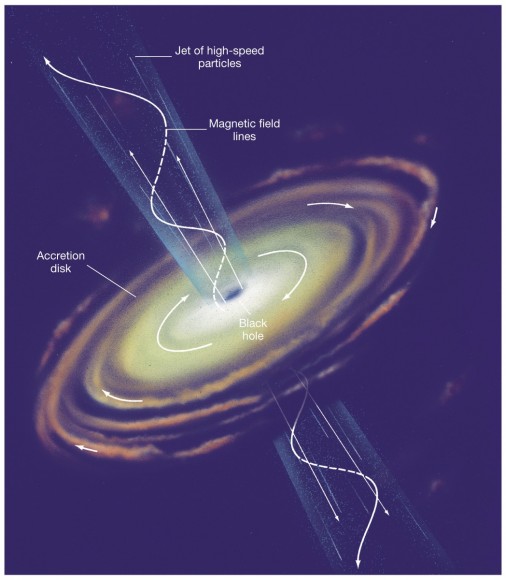

Son muchos los indicios que favorecen la hipótesis de que tales objetos son agujeros negros muy masivos (del orden de 100-1000 millones de veces la masa del Sol), con un tamaño de 1 minuto-luz o varios días-luz. La enorme fuerza gravitatoria que ejercen estos agujeros negros atrae el gas y las estrellas de las inmediaciones, formando el denominado disco de acrecimiento que está en rotación diferencial en torno al objeto masivo.

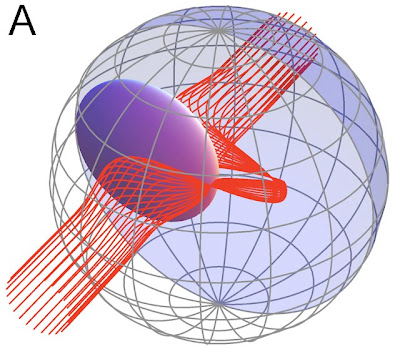

El modelo de “Agujero Negro + disco de acrecimiento” es el más satisfactorio hoy día para explicar las propiedades de los núcleos activos de galaxias. Un aspecto muy destacado en la morfología de las regiones compactas de los núcleos activos es la presencia de una intensa emisión radio en forma de chorros (los denominados Jets relativistas), que están formados por un plasma de partículas relativistas que emanan del núcleo central y viajan hasta distancias de varios megaparsec.

Jet relativista de un AGN. Creditos: Pearson Education, Inc., Upper Saddle River, New Jersey

Estos Jets son los aceleradores de partículas más energéticos del Cosmos. Sin embargo, todavía se desconoce como se generan, aceleran y coliman, si bien a través de simulaciones magnetohidrodinámicas se conoce que el campo magnético juega un papel fundamental en estos procesos. La técnica de mm-VLBI proporciona imágenes directas y nítidas de las regiones nucleares de las galaxias activas y acotan tanto el tamaño de los núcleos como la anchura de los chorros en la vecindad del agujero negro supermasivo. De hecho, las resoluciones angulares proporcionadas por mm-VLBI corresponderían a escalas lineales del orden de miles, centenares y decenas de Radios de Schwarzschild dependiendo de la distancia y la masa del agujero negro.

Existen algunos casos espectaculares, las imágenes obtenidas con mm-VLBI trazán los chorros relativistas a escalas del subparsec, cartografiando los motores centrales de las fuentes compactas con una resolución lineal tal que nos permite acercarnos a la última órbita estable en torno al agujero negro supermasivo. Podemos mencionar algunos casos espectaculares que han dejado asombrados a propiso y extraños.

Mrk 501: Es una radiogalaxia situada a un corrimiento al rojo de z = 0.oo34. La masa del agujero negro central es del orden de mil millones de masas solares, por lo que el tamaño del radio de Schwarzschild es de 0,12 días-luz. Las observaciones con mm-VLBI a 86 GHz, muestra que su núcleo es muy compacto. El tamaño del núcleo de la radiofuente se puede establecer en 0,03 pc.

M87: La galaxia M87 está situada a la una distancia de 16,75 Mpc tiene un agujero negro situado en la región nuclear con una masa del orden de los 3.000 millones de masas solares, lo que implica que el tamaño del Radio de Schwarzschild es de 0,34 días-luz, Las observaciones interferométricas a 45 y 43 GHz han mostrado la presencia de un chorro relativista, en la que se observan dos fenómenos muy relevantes: i) en la base del jet, el ángulo de apertura es muy grande, lo que indicaría que el chorro vuelve a recolimarse a una cierta distancia del Agujero Negro central; ii) el chorro presenta fuerte emisión en sus bordes (fenómeno conocido como “edge brightening”, mientras que presenta emisión muy débil en su interior.

Todo esto lleva consigo una serie de implicaciones y parámetros de tipo técnicos que no son al caso destacar aquí.

En el centro galáctico de la Vía Láctea ocurren fenómenos que han sido profundamente investigados y, allí habita un agujero negro que tiene 150 millones de kilómetros de diámetro. ¿Os podéis imaginar la cantidad de materia que la fuerza de gravedad que genera tal monstruo podrá engullir?

Las observaciones de VLBI a longitudes de onda centimétricas han mostrado que SgrA, la radiofuente compacta en el centro de nuestra Galaxia, tiene un tamaño angular que escala con la longitud de onda al cuadrado, resultado que se interpreta físicamente considerando que la estructura que detectamos para SgrA no es su estructura intrínseca sino la imagen resultado de la interacción de su emisión de radio con sus electrones interestelares de la región interna de la Galaxia (lo que técnicamente se conoce como el “disco de scattering”. Las observaciones con mm-VLBI a 86 GHz han permitido determinar por primera vez el tamaño intrínseco de SgrA que ha resultado ser de 1,01 Unidades Astronómicas.

Considerando que SgrA se encuentra a una distancia de 8 Kpc y que su masa es de 4 millones de masas solares, este tamaño lineal corresponde a 12,6 Radios de Schwarzschild. Con todo esto, vengo a decir que estamos ya en la misma vecindad de los agujeros negros y, lo único que tenemos que despejar es la incognita que nos pueda crear el efecto del que nos habla la Relatividad General cuando establece que la raqdiación proveniente de una superficie esférica a una cierta distancia del agujero negro, sufriría un proceso de lente gravitacional amplificadora dandonos un tamaño mayor que el real. Así, cualquier objeto emisor con un tamaño intrínseco inferior a 1,5 Radios de Schwarzschild tendría un diámetro aparente mayor que 5,2 R de Schwarzschild.

¡Es todo tan complejo!

emilio silvera

Ago

24

¿Dos verdades incompatibles? La Cuántica y la Relatividad

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (2)

Comments (2)

El mundo de la Física tiene planteado un gran problema y los físicos son muy conscientes de ello, conocen su existencia desde hace décadas. El problema es el siguiente:

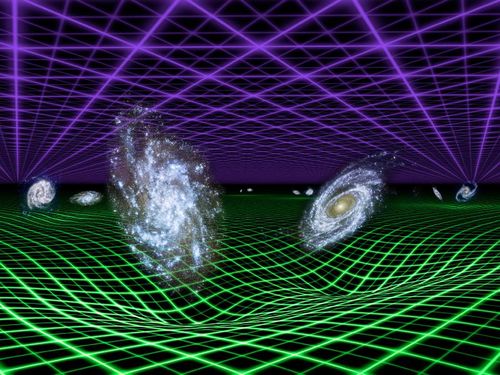

Existen dos pilares fundamentales en los cuales se apoya toda la física moderna. Uno es la relatividad general de Albert Einstein, que nos proporciona el marco teórico para la comprensión del universo a una escala máxima: estrellas, galaxias, cúmulos (o clusters) de galaxias, y aún más allá, hasta la inmensa expansión del propio universo.

El otro pilar es la mecánica cuántica, que en un primer momento vislumbro Max Planck y posteriormente fue desarrollada por el mismo Einstein, W. Heisemberg, Schrödinger, Dirac, Feynman, Niels Bohr y otros, que nos ofrece un marco teórico para comprender el universo en su escala mínima: moléculas, átomos, y así hasta las partículas subatómicas, como los electrones y quarks.

Durante años de investigación, los físicos han confirmado experimentalmente, con una exactitud casi inimaginable, la practica totalidad de las predicciones que hacen las dos teorías. Sin embargo, estos mismos instrumentos teóricos nos llevan a una conclusión inquietante: tal como se formulan actualmente, la relatividad general y la mecánica cuántica no pueden ser ambas ciertas a la vez.

Nos encontramos con que las dos teorías en las que se basan los enormes avances realizados por la física durante el último siglo (avances que han explicado la expansión de los cielos y la estructura fundamental de la materia) son mutuamente incompatibles. Cuando se juntan ambas teorías, aunque la formulación propuesta parezca lógica, aquello explota; la respuesta es un sinsentido que nos arroja un sin fin de infinitos a la cara.

Así que si tú, lector, no has oído nunca previamente hablar de este feroz antagonismo, te puedes preguntar a que será debido. No es tan difícil encontrar la respuesta. Salvo en algunos casos muy especiales, los físicos estudian cosas que son o bien pequeñas y ligeras (como los átomos y sus partes constituyentes), o cosas que son enormes y pesadas (como estrellas de neutrones y agujeros negros), pero no ambas al mismo tiempo. Esto significa que sólo necesitan utilizar la mecánica cuántica, o la relatividad general, y pueden minimizar el problema que se crea cuando las acercan demasiado; las dos teorías no pueden estar juntas. Durante más de medio siglo, este planteamiento no ha sido tan feliz como la ignorancia, pero ha estado muy cerca de serlo.

No obstante, el universo puede ser un caso extremo. En las profundidades centrales de un agujero negro se aplasta una descomunal masa hasta reducirse a un tamaño minúsculo. En el momento del Bing Bang, la totalidad del universo salió de la explosión de una bolita microscópica cuyo tamaño hace que un grano de arena parezca gigantesco. Estos contextos son diminutos y, sin embargo, tienen una masa increíblemente grande, por lo que necesitan basarse tanto en la mecánica cuántica como en la relatividad general.

Por ciertas razones, las fórmulas de la relatividad general y las de la mecánica cuántica, cuando se combinan, empiezan a agitarse, a traquetear y a tener escapes de vapor como el motor de un viejo automóvil. O dicho de manera menos figurativa, hay en la física preguntas muy bien planteadas que ocasionan esas respuestas sin sentido, a que me referí antes, a partir de la desafortunada amalgama de las ecuaciones de las dos teorías.

Siempre hemos querido saber qué pasa dentro de un Agujero Negro. Sin embargo, nadie entró nunca y regresó para poder contarlo. Según todos los indicios, lo que pueda caer dentro del agujero negro, una vez pasado el límite de irás y no volverás del horizonte de sucesos, quedará allí “triturado” hasta densidades inimaginables. No sabemos qué clase de materia es la que pueda confiormar una singularidad y qué es lo que pasa con las partículas de materia que allí pudieron llegar atraídas por la inmensa fuerza gravitatoria que el A.N. genera.

Aunque se desee mantener el profundo interior de un agujero negro y el surgimiento inicial del universo envueltos en el misterio, no se puede evitar sentir que la hostilidad entre la mecánica cuántica y la relatividad general está clamando por un nivel más profundo de comprensión.

¿Puede ser creíble que para conocer el universo en su conjunto tengamos que dividirlo en dos y conocer cada parte por separado? Las cosas grandes una ley, las cosas pequeñas otra.

No creo que eso pueda ser así. Mi opinión es que aún no hemos encontrado la llave que abre la puerta de una teoría cuántica de la gravedad, es decir, una teoría que unifique de una vez por todas las dos teorías más importantes de la física: mecánica cuántica + relatividad general.

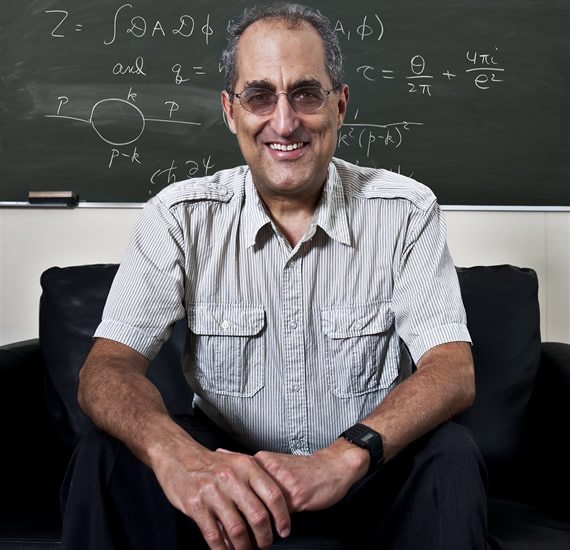

La teoría de supercuerdas ha venido a darme la razón. Los intensos trabajos de investigación llevada a cabo durante las últimas décadas demuestran que puede ser posible la unificación de las dos teorías cuántica y relativista a través de nuevas y profundas matemáticas topológicas que han tomado la dirección de nuevos planteamientos más avanzados y modernos, que pueden explicar la materia en su nivel básico para resolver la tensión existente entre las dos teorías.

En esta nueva teoría de supercuerdas se trabaja en 10, 11 ó en 26 dimensiones, se amplía el espacio ahora muy reducido y se consigue con ello, no sólo el hecho de que la mecánica cuántica y la relatividad general no se rechacen, sino que por el contrario, se necesitan la una a la otra para que esta nueva teoría tenga sentido. Según la teoría de supercuerdas, el matrimonio de las leyes de lo muy grande y las leyes de lo muy pequeño no sólo es feliz, sino inevitable.

Esto es sólo una parte de las buenas noticias, porque además, la teoría de las supercuerdas (abreviando teoría de cuerdas) hace que esta unión avance dando un paso de gigante. Durante 30 años, Einstein se dedicó por entero a buscar esta teoría de unificación de las dos teorías, no lo consiguió y murió en el empeño; la explicación de su fracaso reside en que en aquel tiempo, las matemáticas de la teoría de supercuerdas eran aún desconocidas. Sin embargo, hay una curiosa coincidencia en todo esto, me explico:

Cuando los físicos trabajan con las matemáticas de la nueva teoría de supercuerdas, Einstein, sin que nadie le llame, allí aparece y se hace presente por medio de las ecuaciones de campo de la relatividad general que, como por arte de magia, surgen de la nada y se hacen presentes en la nueva teoría que todo lo unifica y también todo lo explica; posee el poder demostrar que todos los sorprendentes sucesos que se producen en nuestro universo (desde la frenética danza de una partícula subatómica que se llama quark hasta el majestuoso baile de las galaxias o de las estrellas binarias bailando un valls, la bola de fuego del Big Bang y los agujeros negros) todo está comprendido dentro de un gran principio físico en una ecuación magistral.

Esta nueva teoría requiere conceptos nuevos y matemáticas muy avanzados y nos exige cambiar nuestra manera actual de entender el espacio, el tiempo y la materia. Llevará cierto tiempo adaptarse a ella hasta instalarnos en un nivel en el que resulte cómodo su manejo y su entendimiento. No obstante, vista en su propio contexto, la teoría de cuerdas emerge como un producto impresionante pero natural, a partir de los descubrimientos revolucionarios que se han realizado en la física del último siglo. De hecho, gracias a esta nueva y magnifica teoría, veremos que el conflicto a que antes me refería existente entre la mecánica cuántica y la relatividad general no es realmente el primero, sino el tercero de una serie de conflictos decisivos con los que se tuvieron que enfrentar los científicos durante el siglo pasado, y que fueron resueltos como consecuencia de una revisión radical de nuestra manera de entender el universo.

El primero de estos conceptos conflictivos, que ya se había detectado nada menos que a finales del siglo XIX, está referido a las desconcertantes propiedades del movimiento de la luz.

Isaac Newton y sus leyes del movimiento nos decía que si alguien pudiera correr a una velocidad suficientemente rápida podría emparejarse con un rayo de luz que se esté emitiendo, y las leyes del electromagnetismo de Maxwell decían que esto era totalmente imposible. Einstein, en 1.905, vino a solucionar el problema con su teoría de la relatividad especial y a partir de ahí le dio un vuelco completo a nuestro modo de entender el espacio y el tiempo que, según esta teoría, no se pueden considerar separadamente y como conceptos fijos e inamovibles para todos, sino que por el contrario, el espacio-tiempo era una estructura maleable cuya forma y modo de presentarse dependían del estado de movimiento del observador que lo esté midiendo.

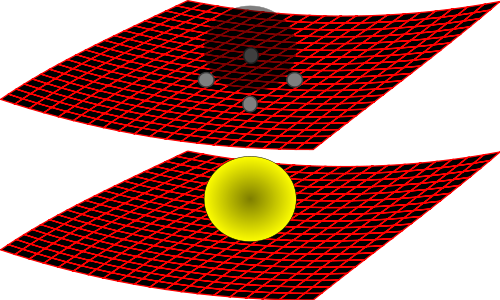

El escenario creado por el desarrollo de la relatividad especial construyó inmediatamente el escenario para el segundo conflicto. Una de las conclusiones de Einstein es que ningún objeto (de hecho, ninguna influencia o perturbación de ninguna clase) puede viajar a una velocidad superior a la de la luz. Einstein amplió su teoría en 1915 – relatividad general – y perfeccionó la teoría de la gravitación de Newton, ofreciendo un nuevo concepto de la gravedad que estaba producida por la presencia de grandes masas, tales como planetas o estrellas, que curvaban el espacio y distorsionaban el tiempo. También la Luz acusa los efectos gravitatorios.

Tales distorsiones en la estructura del espacio y el tiempo transmiten la fuerza de la gravedad de un lugar a otro. La luna no se escapa y se mantiene ahí, a 400.000 Km de distancia de la Tierra, porque está influenciada por la fuerza de gravedad que ambos objetos crean y los mantiene unidos por esa cuerda invisible que tira de la una hacia la otra y viceversa. Igualmente ocurre con el Sol y la Tierra que, separados por 150 millones de kilómetros, están influidos por esa fuerza gravitatoria que hace girar a la Tierra (y a los demás planetas del Sistema Solar) alrededor del Sol.

Así las cosas, no podemos ya pensar que el espacio y el tiempo sean un telón de fondo inerte en el que se desarrollan los sucesos del universo, al contrario; según la relatividad especial y la relatividad general, son actores que desempeñan un papel íntimamente ligado al desarrollo de los sucesos.

En el “universo” infinitesimal de las partículas ocurren cosas muy extrañas que no vemos en la vida cotidiana

El descubrimiento de la relatividad general, aunque resuelve un conflicto, nos lleva a otro. Durante tres décadas desde 1.900, en que Max Planck publicó su trabajo sobre la absorción o emisión de energía de manera discontinua y mediante paquetes discretos a los que él llamo cuantos, los físicos desarrollaron la mecánica cuántica en respuesta a varios problemas evidentes que se pusieron de manifiesto cuando los conceptos de la física del siglo XIX se aplicaron al mundo microscópico. Así que el tercer conflicto estaba servido, la incompatibilidad manifiesta entre relatividad general y mecánica cuántica.

La forma geométrica ligeramente curvada del espacio que aparece a partir de la relatividad general, es incompatible con el comportamiento microscópico irritante y frenético del universo que se deduce de la mecánica cuántica, lo cual era sin duda alguna el problema central de la física moderna.

Las dos grandes teorías de la física, la relatividad general y la mecánica cuántica, infalibles y perfectas por separado, no funcionaban cuando tratábamos de unirlas resulta algo incomprensible, y, de todo ello podemos deducir que, el problema radica en que debemos saber como desarrolar nuevas teorías que modernicen a las ya existentes que, siendo buenas herramientas, también nos resultan incompletas para lo que, en realidad, necesitamos.

emilio silvera

Ago

23

Siempre queriendo saber: ¡Nuestra curiosidad!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en ¡Los pensamientos! ~

Clasificado en ¡Los pensamientos! ~

Comments (4)

Comments (4)

Desde muy joven me gustó levantarme muy temprano para aprovechar el Tiempo. Algo me decía que había que aprovechar cada momento y, dormir demasiado nunca me gustó, siempre tenía algo que hacer, algo que buscar, algo que estudiar, algún trabajo pendiente. Así ha sido siempre desde que puedo recordar y, lo cierto es que nunca me he sentido cansado y siempre me sentí incentivado por aquello que perseguía conseguir que, la mayor parte de las veces, eran nuevos conocimientos.

Es grato levantarse cada día y, antes de marchar hacia el trabajo, dedicar un par de horas a contestar posibles comentarios y poner aquí algún nuevo trabajo y rememorar algún trabajo viejo que ya antes, pasó por aquí. En esto de dibulgar la ciencia en los apartados de la física o la astronomía, así como el recordar suscesos e historias antiguas, me viene a la memoria aquel dicho de Edith Wharton:

“Hay dos maneras de difundir la luz: ser la vela encendida o el espejo que la refleja.”

Claro que ser la Luz encendida no es fácil, la Lus no surge de manera espontánea y como por arte de magia, esa Luz, a la que me estoy refiriendo: “Los conocimientos”, es el fruto de largas horas de lectura y estudio, de trabajos inacabables, de experimentos, de andar muchos caminos, de haber juntado muchas experiencias y, entonces y sólo entonces… ¡Se enciende “la Luz”!

Hablemos de otras cuestiones.

Las branas son entidades físicas conjeturadas por la teoría M y su vástago, cosmología de branas. En la teoría M, se postula la existencia de p-branas y d-branas (ambos nombres provienen parasintéticamente de “membrana”). Las p-branas son objetos de dimensionalidad espacial p (por ejemplo, una cuerda es una 1-brana). En cosmología de branas, el término “brana” se utiliza para referirse a los objetos similares al universo cuadridimensional que se mueven en un sustrato de mayor dimensión. Las d-branas son una clase particular de p-branas.

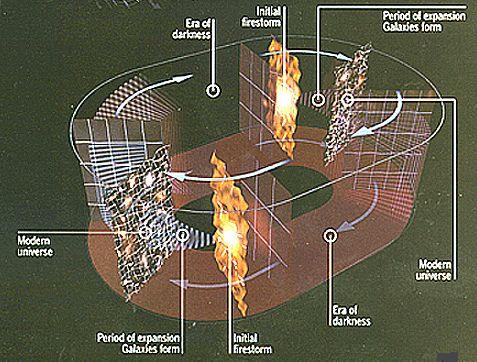

Aquí estaría representada la membrana y la “materia oscura“.

Según la teoría de cuerdas, las membranas existen en la undécima dimensión, en realidad son infinitas. Se dice que cada membrana corresponde a un un universo, por ejemplo a nuestro universo le corresponde una membrana y las otras membranas serían universos paralelos. Según algunos físicos el universo es una membrana esférica, los bordes de las membranas forman ondulaciones las cuales están en constante movimiento, se dice que estas membranas se mueven con “forma de olas” en esta dimensión (11ª). Esta dimensión es sumamente delgada e infinitamente larga, estas membranas están en movimiento como las olas en el mar, es decir, las membranas serían burbujas en olas de mar que al chocar inician el big bang; es decir, el big bang es un fenómeno que ocurre una y otra vez.

En el marco de la teoría de cuerdas, la membrana(M) es un conjunto de dimensiones presente, ampliando sus límites. Se ha llegado a explicar la causa del “Big Bang”por el choque de dos membranas, así, la explosión producida sería la causa del nacimiento y expansión del universo. La materia y la energía sólo puede transmitirse a través de las cuatro primeras dimensiones excepto la gravedad, que puede difundirse en las once. La materia de una puede alterar el espaciotiempo de otra paralela. De hecho, fenómenos similares fueron los que indujeron la teoría.

Hiperbólico (silla de montar)

Las membranas podrían estar separadas por distancias pequeñísimas unas de otras, incluso, según resultados experimentales, a millonésimas de milímetro. Gracias a este hecho se intentaría explicar por qué la gravedad parece menos fuerte de lo que en realidad es. Las formas más postuladas son la de membranas planas y paralelas entre sí y la de paraboloide hiperbólico (silla de montar).

Si las membranas son planas y paralelas, la gravedad quedaría encajonada entre ambas, fluctuando entre una y la otra, pero siempre manteniéndose constante. Por el contrario, si las membranas adoptaran la forma de silla de montar, irían perdiendo paulatinamente energía y, por tanto, materia, hasta desaparecer sumido en la difusión por las once dimensiones.

El modelo Steinhardt–Turok

En este modelo cíclico basado en la cosmología de branas, rival del modelo inflacionario, dos láminas tridimensionales o 3-branas colisionan periódicamente. Según esta teoría la parte visible del universo de cuatro dimensiones representa una de esas branas, quedando la otra brana oculta a todas las fuerzas de la naturaleza excepto la gravedad. Cada ciclo consiste en que cada una de las branas dentro de un espacio-tiempo tetradimensional y separadas por una dimensión espacial muy corta y seis enrolladas chocan con cierta periodicidad creando condiciones parecidas a las del big bang del modelo inflacionario.

Según la teoría, después de millones de años, al aproximarse el final de cada ciclo la materia y la radiación se diluyen a casi cero debido a una expansión acelerada del universo alisando las dos branas pero con pequeños rizos o fluctuaciones cuánticas aún presentes que imprimirán en el próximo choque con no uniformidades que crearán grumos o cúmulos que generarán estrellas y galaxias.

Cuando todo termina se dan las circunstancias necesarias para que todo comience de nuevo

Pero sigamos con las dimensiones y las consecuencias más interesantes de añadir dimensiones espaciales extra que hacen posible que cambien las constantes de la Naturaleza observadas. Si el mundo tiene realmente cuatro dimensiones espaciales, entonces las verdaderas constantes de la Naturaleza existen en cuatro dimensiones. Si nosotros nos movemos sólo en tres de esas dimensiones, veremos y sentiremos sólo “sombras” tridimensionales de las auténticas constantes tetradimensionales.

En un lugar de más dimensiones que no vemos, el espacio y el tiempo pueden ser encubiertos y podría dar lugar a que se formen galaxias en un plano de sombras que no podemos alcanzar a ver en nuestro mundo tridimensional. sería como si un universo paralelo al nuestro estuviera llevando un ritmo en el que, las cosas podrían ser iguales pero distintas.

Claro que esas sombras de las que hablo, no tienen por qué ser constantes. Si la dimensión extra aumenta en tamaño, igual que se están expandiendo nuestras tres dimensiones del Universo, entonces nuestras constantes tridimensionales decrecerán al mismo ritmo. Esto nos dice inmediatamente que si algunas dimensiones extra están cambiando, deberán hacerlo de una forma bastante lenta; de lo contrario nosotros no las hubiéramos llamado “constantes” en absoluto.

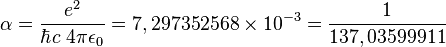

La constante de estrucvtura fina ha sido medida de mil manera

Tomemos una constante tradicional de la Naturaleza, como la constante de estructura fina, normalmente representada por el símbolo  , es la constante física fundamental que caracteriza la fuerza de la interacción electromagnética. Es una cantidad sin dimensiones, por lo que su valor numérico es independiente del sistema de unidades usado.

, es la constante física fundamental que caracteriza la fuerza de la interacción electromagnética. Es una cantidad sin dimensiones, por lo que su valor numérico es independiente del sistema de unidades usado.

La expresión que la define es:

psilon_0} =

psilon_0} =

7,297 352 568 \times 10^{-3} =

\frac{1}{137,035 999 11}

” />.

donde  es la carga elemental, la

es la carga elemental, la  es la constante reducida o racionalizada de Planck,

es la constante reducida o racionalizada de Planck,  es la velocidad de la luz en el vacío, y

es la velocidad de la luz en el vacío, y  psilon_0″ /> es la permitividad del vacío. Si el tamaño de la dimensión extra del espacio es R, entonces el valor de la “constante” de estructura fina tridimensional α, variaría en proporción a 1/R2 cuando cambia R.

psilon_0″ /> es la permitividad del vacío. Si el tamaño de la dimensión extra del espacio es R, entonces el valor de la “constante” de estructura fina tridimensional α, variaría en proporción a 1/R2 cuando cambia R.

Imaginemos que estamos en un universo en expansión de cuatro dimensiones pero sólo podemos movernos en tres de ellas. Las fuerzas de la electricidad y el magnetismo pueden “ver” las cuatro dimensiones y encontraremos que nuestra parte tridimensional de ellas se debilitará cuando la cuarta dimensión se haga mayor.

Sabemos que si la constante de estructura fina tridimensional está cambiando no puede hacerlo en ninguna parte tan rápido como se expande el Universo. Esto nos dice que cualquier cuarta dimensión debe ser muy diferentes de las otras. La idea de Klein consistía en que es a la vez muy pequeña y estática y que está confinada en el límite de Planck. Alguna fuerza extra atrapa las dimensiones extra y las mantiene pequeñas. Si no cambian de tamaño de forma significativa no tenemos por qué ver ninguna de nuestras constantes cambiando.

Un escenario posible imagina que el Universo empieza con todas sus dimensiones espaciales comportándose de una manera democrática, pero luego, algunas de las dimensiones quedan atrapadas y permanecen compactadas de manera tal que son infinitesimales, están el el límite de Planck y permanecen, como digo, estáticas y muy pequeñas desde entonces en ese lugar invisible al que no podemos llegar y que se significa con:

| Lp = | (Gh/c3) ½ = | 4’13 × 10-33 centímetros |

Las otras tres dimensiones que sí consiguieron expandirse, son las que vemos y en las que vivímos, las que forman y hacen de nuestro universo el que podemos observar hoy, en el que se han conformado las galaxias y los mundos que, en alguna ocasión, han podido surgir criaturas que, como ha pasado aquí en la Tierra, hablen de estas cuestiones complejas que no llegan a entender… del todo.

Como no dejamos de pretender alcanzar lo “inalcanzable”, allá por el año 1982, los teóricos de cuerdas sugirieron por primera vez una respuesta a un viejo problema: cómo casar la teoría cuántica con la teoría de la gravedad de Einstein. Todos los intentos previos habían fracasado miserablemente. Predecían invariablemente que alguna cantidad medida debería ser infinita. Estos “infinitos” plagaban todas las teorías con sólo tres dimensiones de espacio y una de tiempo. Sin embargo, en 1984 Michael Green y John Wchwarz demostraron que este problema podía subsanarse combinando dos ideas radicales.

Einstein, desde allí donde se pueda encontrar, estará sonriendo al comprobar con satisfacción que sus ecuaciones de campo de la relatividad general, sin que nadie las llame y como por arte de magia, surgen de la Teoría M de cuerdas en la que subyacen sus ideas. Y, al contemplar, no sin cierto grado de asombro cómo se pueden unir las dos teorías (la suya y la de Planck, la de lo muy grande y lo muy pequeño), los que le siguieron habían conseguido lo que él mismo persiguió, sin conseguirlo durante más de treinta años.

Green y Wchwarz sugerían que, si se abandona la idea de que las entidades más básicas son puntuales (se referían a las partículas subatómicas), con tamaño cero, y se permite que haya más de tres dimensiones espaciales, entonces los infinitos desaparecen milagrosamente, cancelándose. Como sucede con la anterior teoría de Kaluza-Klein. Es apasionante y misterioso el hecho de que, en esa escala tan pequeña de 10-33 cm, la longitud fundamental de Planck, se puedan encontrar “escondidas” las dimensiones que nos permiten unificar las dos teorías más importantes de nuestro tiempo.

¿Habrá un Universo en la sombra que no podemos ver? Alguna vez la imaginación me ha llevado a pensar sobre el final del Universo (todo tiene un final, nada es infinito), y, me he podido preguntar: ¿Qué habrá más alládel borde del Universo? Como la Nada no existe, es posible que después de un espacio “vacío” comience otro universo que no alcanzamos a detectar? Unos estudios recientes de un grupo de astrónomos, ha dado un resultado asombroso, parece que más allá de ese “borde” final de nuestro Universo, hay algo grande que no han podido desvelar pero… Podría ser la sombra de un universo vecino.

Claro que, tendremos que poner los pies en el suelo y centrarnos en lo que “sabemos” y “vemos”: Neutrinos, fotones, quarks, leptones, hadrones: bariones y mesones, todos, en definitiva son lo mismo, distintos estados de la materia que conforman unos y otros en determinadas ocasiones, y, en cada momento, ocupan el lugar que les destina en Universo adoptando la forma que en ese preciso instante les corresponde. Claro que, todos estos, son objetos de nuestro Universo luminoso, el otro, el Universo en la Sombra, ni sabemos si puede estar realmente ahí.

Durante mucho tiempo, los físicos han sabido que toda reacción entre partículas elementales obedece a una simetría que llamamos CPT. Esto significa que si miramos la partícula de una reacción, y luego vemos la misma reacción cuando (1) la miramos en un espejo, (2) sustituimos todas las partículas por antipartículas y (3) hacemos pasar la partícula hacia atrás, los resultados serán idénticos. En este esquema la P significa paridad (el espejo), la C significa conjugación de carga (poner las antipartículas) y T la reserva del Tiempo (pasar la partícula al revés).

La rotación define una dirección en el espacio

Las partículas y los campos del mundo cuántico poseen, además de sus propiedades dinámicas, ciertas simetrías que facilitan la comprensión de lo que sucede en ese nivel de la realidad. Las tres simetrías fundamentales están relacionadas con el espacio, el tiempo y la antimateria.

Claro que, todo lo anteriormente expuesto son sólo sugerencias del momento y que duran y tienen vigencia durante un tiempo impredecible, ya que, el tiempo sigue su marcha, el universo continúa expandiéndose y, nuestras mentes evolucionan para poder “ver” otras teorías y otros horizontes nuevos y más avanzados, complejos y profundos que nos acercan a la verdadera naturaleza del Universo que no comprendemos…, lo suficiente.

emilio silvera

Ago

23

¡El Universo! ¡Civilizaciones! ¡Los pensamientos!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en El Universo y... ¿nosotros? ~

Clasificado en El Universo y... ¿nosotros? ~

Comments (0)

Comments (0)

Bonito remanente de Supernova con sus filamentos de plasma emitiendo radiación

Cuando decimos Universo, nos estamos refiriendo a ¡tántas cosas”. En realidad, la palabra contiene en sí misma, todo lo que existe, incluyendo el Espacio, el Tiempo y la materia en todas sus formas, bien sea “inerte” o “viva” orgánica o inorgánica y, conforme a lo que sabemos, ahí está también recogida la energía en todas las formas que pueda adoptar… Creo que, incluso los pensamientos.

Cada día aquí, comentamos sobre algún aspecto de la Física o de la Astronomía (también de la vida y de los que los seres humanos hicimos a nuestro paso por este mundo), que nos puedan llevar a comprender, algo mejor, todo lo que podemos ver que ocurre a nuestro alrededor y, en nuestro entorno espacial que, con los adelantos que hemos podido conseguir, abarca ya, inmensas regiones del Universo. Sin embargo, no debemos olvidar lo que pasó.

También las galaxias evolucionan y sienten sobre ellas el paso inexorable del Tiempo

Las estrellas que forman las galaxias, los mundos que orbitan a las estrellas, las Nebulosas que son los semilleros de estrellas nuevas, los demás objetos que en el Universo son…, todos han necesitado tiempo para conformarse en lo que son y, con el paso del tiempo, todos se convirtieron en otros objetos distintos de lo que fueron. Nada permanece, todo se transofrma y, de alguna manera, todo nace, vive y muere con el inexorable transcurrir del Tiempo.

¡EL TIEMPO!

Sí, es el tiempo el factor que juega a nuestro favor y, en nuestra contra, depende de la perspectiva con que lo miremos:

A nuestro favor para conseguir nuestros logros más difíciles, para hacer posible nuestros sueños, para aprender y llegar a saber y llegar a poder responder preguntas de las que antes no teníamos ni la menor noción, para preguntar sobre alguna cosa hay que saber que ésta existe, o, puede existir. Nunca llegaremos a poder contestarlas todas y, siempre, nos quedarán preguntas que plantear y también por contestar.

En nuestra contra por el simple hecho de que, desde el primer segundo de nuestro nacimiento, comenzamos a recorrer el camino hacia nuestro final y, desde luego, nunca tendremos tiempo para hacer todas las cosas que deseamos, aprender todo lo que nos gustaría, ir a todos aquellos lugares que tantas veces pensamos y, en ocasiones, nos damos cuenta de que pudimos hacer más de lo que hicimos, o, simplemente, decir al ser querido lo que sentimos.

Algún día tendremos que saber lo que es la Luz, cuando descubramos ese misterio, estoy seguro de que muchas de las cosas que ahora no entendemos, se presentaran ante nosotros con toda claridad, comprenderemos muchos de los secretos de la Naturaleza y, también, sabremos mucho más sobre nosotros mismos. En las galaxias espirales se crean estrellas de manera continuada en las grandes Nebulosas que son el residuo de la muerte de las estrellas masivas. Nosotros mismos, como otros seres que habitan el planeta Tierra, nos replicamos para que la especie perdure. Todo eso, tanto en un plano de lo muy grande como en el más pequeño de nuestro ámbito, es, sin duda, Entropía negativa que regenera, en parte, lo que la entropía positiva hace continuamente.

Si pudiéramos visitar esos otros mundos lejanos, veríoamos con asombro que, también en ellos, prolifera la vida y existen los paisajes hermosos. El Universo es igual en todas partes y en todas las regiones, por lejos que puedan estar, ocurren las mismas cosas. Todo está gobernado por las leyes de la Naturaleza, por las mismas fuerzas y las mismas constantes y, la materia es energía allí donde quiera que esté, las estrellas situadas a miles de millones de años-luz de nosotros, como el Sol, fusiona Hidróngeno en Helio durante miles de millones de años. Los procesos naturales se repiten una y otra vez en las mismas condiciones y, siendo así (que lo es), ¿cuántos mundos llenos de vida existirán en nuestra propia Galaxia y, en todo el Universo=

Así existe esa ventaja creada por el Universo para que el Tiempo no pueda eliminarlo todo sin más. Tanto las galaxias como nosotros mismos, creamos Entropía negativa mediante la replicación de la especie, hacemos surgir al mundo otros seres humanos y los educamos desde pequeños para que sigan nuestros pasos y continúen con el trabajo que comenzó hace milenios. Y, podríamos preguntar: ¿Qué está pasando en otros mundos, en otras galaxias?

Mirando por ahí, he tratado de buscar algunas cuestiones que resuman (aunque sea de manera muy escueta) algo de lo que el mundo es, de lo que hicimos y dejaron atrás aquellas civilizaciones y aquellos pensadores del pasado, y, encontré un lugar (Olcicilizacións´s Blog)desde el que os traigo lo que sigue:

Los olmecas, transmitieron sus conocimientos a los toltecas, considerados por los estudiosos como una rama de los chichimecas, y éstos más tarde a los mayas.

Civilizaciones perdidas que construyeron mundos de fantástica belleza

![]()

Seres superiores que nos dejaron sus ideas y un mundo que posibilitó la diversidad de pensamientos

Detrás de cada imagen se esconden historias que nos gustaría conocer. Cuentan pasajes de hechos del pasado, o del presente y, algunas veces, también quieren significar lo que será el futuro. Desde siempre, además de por medio de la escritura, hemos querido representar los hechos, personajes y obras por medio de grandiosos templos, en pinturas más o menos sofisticadas y, sobre todo, en historias contadas por dramaturgos y poetas, y, sobre todo, por los historiadores que dejaron un reflejo de su tiempo en cada momento de nuestra Historia.

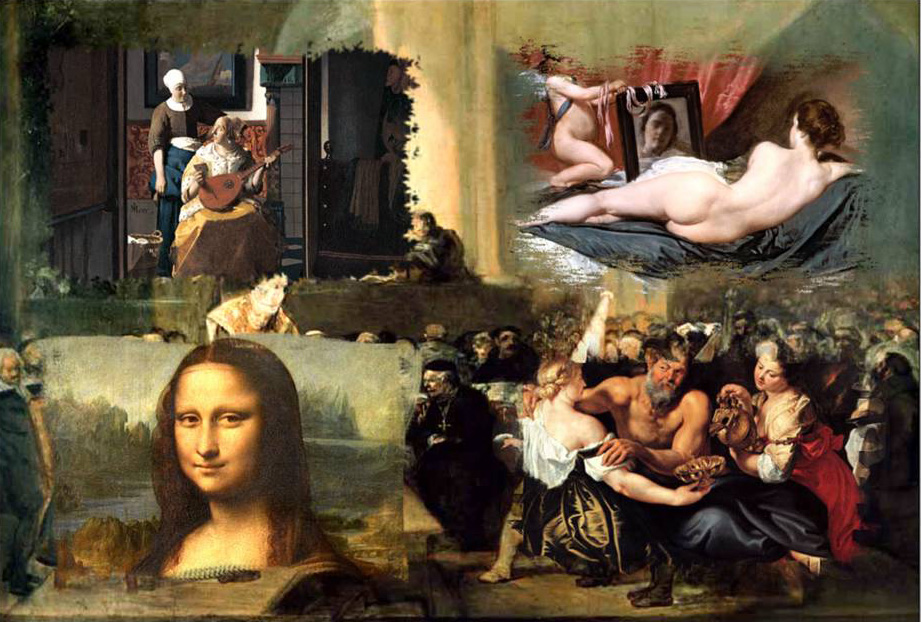

¿Quien no conoce “las historias” que se esconden detrás de éstas pinturas?

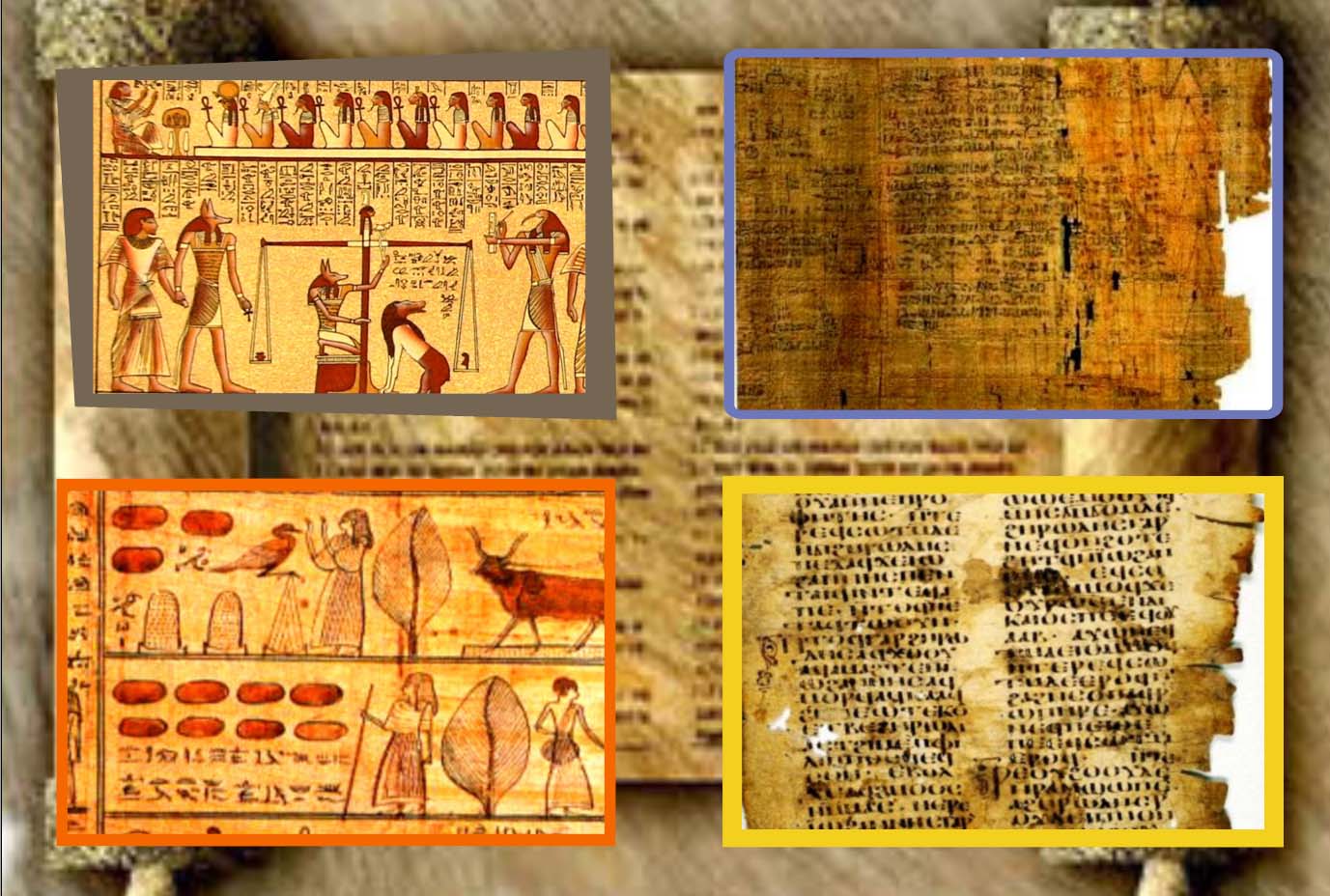

Cada Civilización quizo dejar su huella y contar su historia a… su manera

Según el Génesis: “Tenía entonces toda la tierra una sola lengua y unas mismas palabras.” En la actualidad hay unas seis mil quinientas lenguas en nuestro mundo. De ellas, solamente veinticinco pueden considerarse importantes por su extensión y por su producción escrita. La pregunta que ha preocupado siempre a pensadores y lingüistas es inmediata: ¿De dónde surgió tal diversidad? ¿Cuál fue el origen de todas las lenguas? Ya hemos hablado aquí extensamente de los orígenes de la lengua y de la escritura y, son historias apasionantes que nos llegan del pasado.

Siempre hemos tenido imaginación y, los mitos antiguos proliferan en todas aquellas civilizaciones. Entre los antiguos mitos budistas figura el de un misterioso paraíso perdido, conocido como Chang Shambhala, que se considera la fuente de la sabiduría eterna y donde vivirían seres inmortales en armonía perfecta con la naturaleza y el universo. En la India, oculto entre los Himalayas, se le llama Kalapa, mientras que la tradición china lo ubica en los montes Kunlun. Según las leyendas budistas, Kalāpa (‘atado, manojo’) es la mítica ciudad capital del reino de Shambhala(quizá algún lugar de Tíbet o de Cachemira). Allí el rey

Kulika reina sentado en un trono de leones. Se dice que Kalapa es una hermosa ciudad, con jardines de sándalo que contienen un gran mándala tridimensional de kala chakrá realizado por el rey Suchandra. Este rey vino desde el norte de Cachemira, y desarrolló la práctica del kalachakrá, que aprendió del propio Buda (siglo VI a. C.) en Dhania Kataka. La cordillera montañosa Kunlun es una de las más largas cadenas montañosas de Asia, extendiéndose a lo largo de más de 3.000 km. Corre a lo largo del borde occidental de China, hacia el Sur, al lado de la cordillera del Pamir, curvándose luego hacia el este para formar la frontera del Tíbet. Se extiende al sur de lo que se denomina actualmente la cuenca de Tarim, el famoso Takla Makan o desierto de las “casas enterradas en la arena“, y el desierto de Gobi. La cordillera tiene cerca de 200 picos de altura superior a los 6.000 metros. Los tres picos más altos son el Kongur Tagh (7.719 m), el Dingbei (7.625 m) y el famoso Mutzagata (7.546 m). Estos picos se encuentran en la cordillera Arkatag dentro del complejo de cordilleras. Hacia el sur, una rama de las montañas Kunlun da lugar a la zona de captación de las cuencas de los dos ríos más largos de China, el Yangtsé y el río Amarillo. La cordillera se formó en el lado norte de la placa India durante su colisión a finales del Triásico, con la placa Euroasiática, dando lugar al cierre del océano Paleo-Thetys. Las montañas son muy conocidas en la mitología china, y se considera que encierran el paraíso taoísta. El primero en visitar este paraíso fue, según la leyenda, el rey Mu (1001-947 a. C.) de la dinastía Zhou. Supuestamente descubrió el Palacio de Jade de Huangdi, el mítico Emperador Amarillo, y encontró a Xiwangmu, la Reina Madre del Oeste, que también tiene su mítico refugio en estas montañas.

Se cuentan algunas historias que… Hermes Trismegisto es el nombre griego de un personaje mítico que se asoció a un sincretismo del dios egipcio Dyehuty (Toth en griego) y el dios heleno Hermes, o bien al Abraham bíblico. Hermes Trismegisto significa en griego ‘Hermes, tres veces grande’. En latín es: Mercurius ter Maximus. Hermes Trismegisto es mencionado primordialmente en la literatura ocultista como el sabio egipcio, paralelo al dios Toth egipcio, que creó la alquimia y desarrolló un sistema de creencias metafísicas que hoy es conocida como hermética.

Para algunos pensadores medievales, Hermes Trismegisto fue un profeta pagano que anunció el advenimiento del cristianismo. Se le han atribuido estudios de alquimia como la Tabla de esmeralda —que fue traducida del latín al inglés por Isaac Newton— y de filosofía, como el Corpus hermeticum. No obstante, debido a la carencia de evidencias contundentes sobre su existencia, el personaje histórico se ha ido construyendo ficticiamente desde la Edad Media hasta la actualidad, sobre todo a partir del resurgimiento del esoterismo. Fueron los griegos quienes bautizaron como Hermes Trismegisto al dios Toth egipcio, el responsable del conocimiento; aquel que, según la tradición, explicó a los habitantes del Nilo que su país era una suerte de eco de las maravillas que contemplaban en su negra bóveda celeste. De hecho, una de las teorías más populares para explicar la orientación de las pirámides es que éstas imitaban, como las catedrales harían más tarde, la situación de ciertas estrellas del firmamento nocturno. Pero no la de unas estrellas cualesquiera, sino aquellas llamadas por sus milenarios textos religiosos El Duat. Bajo ese nombre se conoció en Egipto a los tres astros que integran el cinturón de Orión -nosotros las llamamos «las tres Marías»-. Los egipcios creían que eran la puerta simbólica por la que el faraón accedía a los reinos del más allá. Las pirámides, por tanto, fueron «modelos» en piedra de esa entrada; lugares de iniciación en los que el gobernante de Egipto se preparaba para el viaje más importante de su existencia: el de su muerte.

Y, hablandio de la muerta, los humanos siempre hemos tenido mucha imaginación para ese trance final de nuestras vidas y, se han dicho muchas cosas y se han contado muchas versiones.

¿Qué es la muerte? Quizá la analogía más común sea la comparación entre muerte y sueño. Morir, nos decimos, es como dormirse.

Esta figura del lenguaje es muy común en el pensamiento y lenguaje de cada día, así como en laliteratura de muchas culturas y épocas. Incluso era corriente en la Grecia clásica. En la Ilíada, por ejemplo, Homero llama al sueño «hermano de la muerte», y Platón, en su diálogo la Apología, pone las siguientes palabras en boca de Sócrates, su maestro, que acaba de ser sentenciado a muerte por un jurado ateniense: “Si la muerte es sólo dormirse sin sueños, debe ser un maravilloso premio. Imagino que si a alguien se le dijese que escogiera la noche en que durmió tan profundamente que ni siquiera soñó y la comparase con el resto de noches y días de su vida y que dijese entonces, tras la debida consideración, cuántos días y noches más felices había tenido, creo que… [cualquiera] se daría cuenta de que esas noches y días son fáciles de contar en comparación con el resto. Si la muerte es así, la considero ventajosa, pues todo el tiempo, si la miramos de esa forma, puede tomarse como una sola noche”.

En 1964, una revista de estudios orientales había publicado un artículo que trataba de una relación entre la Gran Pirámide y el Cinturón de Orión. Un egiptólogo llamado Alexander Badawy había pedido a la astrónoma norteamericana Virginia Trimble, que le ayudase a verificar su teoría de que el «pozo de ventilación» meridional de la Cámara del Rey señalaba directamente a Orión cuando se construyó la Gran Pirámide, hacia el 2550 a. de C. Virginia Trimble, basada en sus cálculo, pudo decir a Badawy que, en

efecto, el pozo de ventilación señalaba directamente al Cinturón de Orión hacia el 2550 a. de C. Una persona lo bastante delgada como para acostarse en el pozo de ventilación hubiera visto cómo el cinturón de Orión pasaba directamente por encima de ella todas las noches. Por supuesto, pasarían otras estrellas, cientos de ellas… pero ninguna de semejante magnitud. Si las pirámides de Gizeh representaban las tres estrellas del Cinturón de Orión -Zeta, Epsilón y Delta-, ¿no era posible que otras pirámides representasen a otras estrellas de Orión? De hecho, Robert Bauval se dio cuenta de que la pirámide de Nebka, en Abu Ruwash, correspondía a la estrella situada en el pie izquierdo del Cazador; y la pirámide de Zawyat al-Aryan a la estrella que estaba en su hombro derecho. Desde luego, si otras dos pirámides hubieran completado la forma de «reloj de arena», la prueba hubiese sido concluyente, pero, por desgracia, estas dos pirámides o bien nunca se habían construido o hacía ya mucho tiempo que habían desaparecido bajo la arena.

Con la originalidad de su cultura, el Antiguo Egipto ha generado una gran fascinación. Los poderes de los hierofantes o magos, las profecías, la ciencia de los sacerdotes y la aspiración a la vida eterna, junto con la conservación de las momias, las increíbles construcciones sagradas y la extraordinaria validez actual de algunos papiros milenarios, nos han maravillado a lo largo de la historia.

Jean-Franςois Champollion

Pero ¿qué es lo que le sucede al viajero cuando llega a Egipto? Sin dudas, un gran encandilamiento. El gusto por la aventura incrementa la imaginación de quien sabe abstraerse frente a lo majestuoso y lo secreto, conceptos estrechamente ligados a la cultura faraónica. En el período de la conquista árabe, las leyendas comenzaron a expandir teorías en un intento por correr el velo de misterio y significación inexplicable. Las descomunales pirámides, de proporciones matemáticas rigurosas, habrían sido concebidas con el fin de preservar esa sabiduría de los antiguos, manteniendo oculto el saber milenario. ¿Qué secretos esconden estos monumentos que dominan simbólicamente el Valle del Nilo desde hace 4500 años? Mucho más de lo imaginado. Pese al desconocimiento sobre el tema, los eruditos trataron de plasmar en manuales las formas de acceso al interior de las pirámides, regidos muchas veces por una marcada ambición de llegar a los lugares que creían repletos de riquezas y tesoros incalculables. Tal como dijo Napoleón: «¡Soldados! Desde lo alto de estas pirámides, cuarenta siglos os contemplan».

Los Tuareg, la legendaria reina attlante Tin Hionan, Tassili y la antigua civilización Uigur

Las leyendas parten de hechos reales sucedidos mucho tiempo atrás, mientras que los mitos hablan de realidades simbólicas. Es decir transmiten verdades con el lenguaje de los sueños. La historia de la Atlántida contiene leyenda y también es mítica. España es considerada dentro de la leyenda Atlante como parte directa del imperio desaparecido, con la antigua Tartessos, o bien como colonia comandada por atlantes de nombre íberos, que acabaron dando nombre a la península. Y el único país de Europa, junto con Portugal, que conservan parte del continente desaparecido: islas Canarias y Azores. En África, en 1926, el conde Byron Kûhn de Protok descubrió en sus excavaciones arqueológicas en el Sahara, lo que los tuareg llamaban la tumba de la última reina de los Atlantes Tin Hinan. En el Museo del El Bardo, en Argel, se exhibe un esqueleto de dos metros de altura. Se dice que fue una princesa huida de la Atlántida. Juan José Benítez, en algunas de cuyas obras me he basado para escribir este artículo, explica lo siguiente: “… en mi primera visita a Argel me apresuré a recorrer el museo del El Bardo, en su búsqueda. Allí estaba, casi olvidada en un rincón. La examiné con detenimiento y admiración recordando las leyendas que circulan sobre ella. Los informes de los forenses tenían razón. Aquella mujer pudo alcanzar los dos metros de altura. Era Tin-Hinan, princesa de los tuaregs y de la etnia bereber. La única mujer conocida que gobernó al levantisco pueblo del desierto. ¿O no se trataba de una mujer?”

Salomón es un personaje descrito en la Biblia como el tercer y último rey del Israel unificado (incluyendo el reino de Judá). Es célebre por su sabiduría, riqueza y poder, pues La Biblia’ ‘lo considera el hombre más sabio que existió en la Tierra. Logró reinar cuarenta años y su reinado quedaría situado entre los años 970 a.C. y el 930 a.C. aproximadamente. Construyó el Templo de Jerusalén, y se le atribuye la autoría del Libro de Eclesiastés, libro de los Proverbios y Cantar de los Cantares, todos estos libros recogidos en la Biblia. Es elprotagonista de muchas leyendas posteriores, como que fue uno de los maestros de la Cábala.

En el Tanaj (libro hebreo, a una versión del cual los cristianos llaman Antiguo Testamento) también se le llama Jedidías. En la Biblia se dice del rey Salomón que heredó un considerable imperio conquistado por su padre el rey David, que se extendía desde el Valle Torrencial, en la frontera con Egipto, hasta el río Éufrates, en Mesopotamia. Tenía una gran riqueza y sabiduría y administró su reino a través de un sistema de 12 distritos. Poseyó un gran harén, el cual incluía a «la hija del faraón». Honró a otros dioses en su vejez y consagró su reinado a grandes proyectos de construcción. La Biblia dice del rey Salomón que era «el más sabio de los hombres», que podía pronunciar un discurso sobre la biodiversidad de todas las plantas, «desde los cedros del Líbano hasta el hisopo que crece en los muros, y animales, y pájaros, y cosas que se arrastran, y peces». Entre los distintos autores que han tratado sobre Salomón y el Arca de la Alianza, se distingue Erich von Daniken, que lo relata, con su estilo atrevido, en su obra “Profeta del Pasado”, en la que me he basado para escribir este artículo.

Algunos lo explican en términos de las inundaciones anuales de la llanura Tigris-Eufrates. Conjeturan que una de tales inundaciones pudo ser especialmente severa. Campos y ciudades, hombres y animales fueron barridos por la crecida de las aguas, y los pueblos primitivos, viendo el acontecimiento como un castigo de los dioses, propagaron la leyenda del Diluvio. Sir Leonard Woolley (Londres, 1880 – 1960) fue un arqueólogo británico, conocido por sus excavacionesen la antigua ciudad sumeria de Ur (en el actual Irak) y por haber encontrado evidencia geológica del diluvio de Gilgamesh.

La historia del Diluvio es conocida por muchas culturas

Se le considera el primer arqueólogo moderno, y fue nombrado caballero en 1935 por sus contribuciones a la disciplina. Graduado de la Universidad de Oxford, tras trabajar tres años en el Museo Ashmolean de la misma ciudad, viajó al actual Sudán para participar en 1907 y 1911 en la expedición arqueológica británica en el yacimiento egipcio de Wadi Halfa. En 1912 dirigió junto a T.E. Lawrence (conocido como Lawrence de Arabia) las excavaciones de la ciudad hitita de Karkemish, en la Siria septentrional, donde permaneció dos años y cuyos hallazgos publicó entre 1921 y 1953. Posteriormente pasó a Egipto para dirigir la excavación de Tell el-Amarna, la ciudad sagrada del faraón Akhenatón.

Lo cierto amigos, es que nunca nos faltó la energía necesaria para poder llevar a cabo andaduras que, miradas en la perspectiva que el tiempo nos da, nos parecen increíbles, como increíbles nos parecen aquellos pensamientos surgidos de mentes de la antigüedad, cuando aún no se tenían verdaderos conocimeintos de ninguna de las formas científicas que ahora podemos cultivar. Sin embargo, las ideas fluían, la imaginación caminaba veloz y, las mentes intuitivas de muchos pensadores, pusieron los cimientos que hicieron un buen edificio en el que ahora, más o menos confortablemente podemos seguir viviendo para seguir la búsqueda por ellos emprendida de esa verdad que la Naturaleza esconde.

Mirar al pasado y recordar…¡es bueno!

emilio silvera

Ago

22

Más Noticias

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Noticias ~

Clasificado en Noticias ~

Comments (1)

Comments (1)

Cienci en ABC

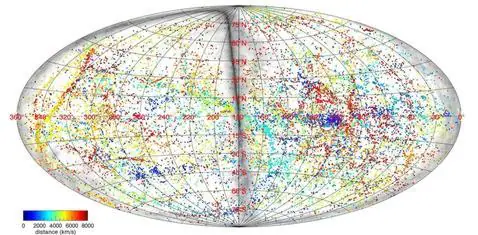

Un nuevo mapa del Universo en 3D recorre 300 millones de años luz

Alcanza más allá de la Vía Láctea para explorar los cúmulos de galaxias y la materia oscura entre ellas con una precisión sin precedentes

Un equipo internacional de investigadores, entre ellos la Universidad de Hawai en Manoa, ha trazado un mapa 3D de nuestro gigantesco «vecindario» en el Universo con un detalle como nunca antes se había conseguido. El mapa, que se presenta en un vídeo (proyecto Flujos Cósmicos), muestra no solo lo que se ve, la materia visible, sino también lo que no se ve, la materia oscura, alrededor de nuestra galaxia, la Vía Láctea, hasta una distancia de 300 millones de años luz.

La estructura a gran escala del Cosmos es una compleja red de grupos, filamentos y vacíos. Esos grandes vacíos están delimitados por los filamentos que forman supercúmulos de galaxias, las estructuras más grandes del Universo. Nuestra galaxia, la Vía Láctea, se encuentra en un supercúmulo de 100.000 galaxias.

Así como el movimiento de las placas tectónicas revela las propiedades del interior de la Tierra, los movimientos de las galaxias nos muestran información sobre los principales componentes del Universo: la energía oscura y la materia oscura. La materia oscura es materia invisible cuya presencia se puede deducir solo por su efecto sobre los movimientos de las galaxias y las estrellas, ya que no emite ni refleja luz. La energía oscura es la fuerza misteriosa que causa que se acelere la expansión del Universo.

Lo invisible

El vídeo captura con precisión no solo la distribución de la materia visible concentrada en las galaxias, sino también los componentes invisibles, los huecos y la materia oscura. La materia oscura constituye el 80% de la materia total de nuestro Universo y es la principal causa de los movimientos de las galaxias entre sí.

Según explican desde la Universidad de Hawai, con este mapa la comunidad científica tiene ahora una mejor representación de la distribución de las galaxias en movimiento a nuestro alrededor y una herramienta valiosa para la investigación en el futuro. Un artículo científico que explica la investigación detrás del vídeo se publicará en un próximo número de la revista Astronomical Journal. Ahora está disponible en Arxiv.

Totales: 87.728.472

Totales: 87.728.472 Conectados: 20

Conectados: 20