Mar

21

¡La Física! ¿Estará perdiendo el Norte?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

Curiosity descubre un antiguo Lago en Marte

¿Queremos imitar el salto cuántico viajar más rápido?

A finales del siglo XIX y principios del XX algunos podían creer que los secretos de la Naturaleza estaban todos descubiertos gracias a los hallazgos que en el pasado hicieran Newton y otros y más recientemente Maxwell, Planck, Einstein y otros muchos que, con sus trabajos nos desvelaron cómo funcionaba la gravedad, qué era en realidad la electricidad y el magnetismo y también, nos llevaron el fascinante mundo de lo muy pequeño con el cuanto de acción, h, de Planck que nos trajo poco más tarde, la mecánica cuántica.

La mecánica, la óptica, la electricidad… todo estaba descubierto y explicado. Los científicos de la época pansaban que sus futuros colegas sólo se dedicarían a realizar medidas para obtener las constantes con mayor precisión vez. Después de todo aquello, se siguió avanzando y continuamos haciéndonos preguntas creyendo que nos llevarían a las respuestas últimas.

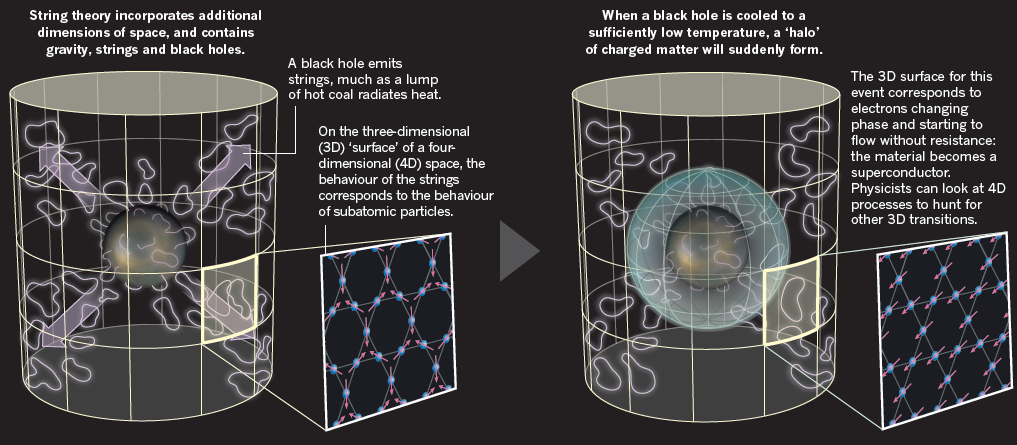

Si, por ejemplo, las supercuerdas nos conducen a las respuestas últimas, entonces, ¿en qué dirección debemos nuestra investigación?, ¿es que nos hemos introducido tanto en el mundo de lo desconocido y lo ininteligible que estamos a punto de ahogarnos en un mar de lo absurdo?, ¿estamos enterrados bajo tántas preguntas de los imposibles que deberíamos considerarnos perdidos?, ¿tiene algún sentido especular acerca de la “Teoria de Todo” en un mundo extraño de las unidades de Planck?

Bueno, si queremos ser sinceros…, podemos discrepar de algunas de las cuestiones que hoy se están debatiendo y ser críticos con otras. Sin embargo, no podremos negar los avances que realmente se están logrando en el mundo de las nuevas tecnologías que, gracias a la Física, ya están en el futuro y, en nuestras vidas cotidianas lo estamos viendo continuamente.

Por otra , nada despierta más nuestra curiosidad que lo ininteligible y, precisamente por eso, tiene tanto éxito y llama la atención teorías como la de las supercuerdas. Miremos, por ejemplo, lo que es tan curioso en el mundo de la longitud de Planck es que no podemos encontrar absolutamente ningún modelo que nos pueda dar una descripción razonablemente autoconsistente de partículas que interaccionan entre sí con fuerzas gravitatorias tan intensas y que, al mismo tiempo, obedezcan a las leyes de la mecánica cuántica. Por tanto, incluso si hubiéramos sido capaces de realizar experimentos con choques de partículas con energías planckianas, no hubiéramos sabido como comparar los resultados con una teoría. Aquí hay para los físicos: hacer una teoría. No nos importa demasiado como describa esa teoría la interacción gravitatoria, pero tenemos suficientes requisitos en la lista como para que encontrar esa candidata a ser la teoría sea una labor extremadamente difícil. La Teoría de Supercuerdas parecía estar a punto de conseguirlo, pero falló en los últimos momentos. Dicen que necesitamos la energía de Planck para poder verificarla y, si es así, nos queda espera para rato.

Mientras buscamos esas teorías que están más allá de nuestras posibilidades reales de hoy, la Ciencia no se para y sigue avanzando en otros muchos campos que, como antes decía, nos están llevando a pasos agigantados un futuro que ya está con nosotros y, lo está haciendo con tal rapidez que ni nos hemos percatado de ello.

En cuanto a esa soñada Teoria de Todo, en primer lugar debe ser matemáticamente exacta y tiene que permitirnos calcular con extrema precisión el comportamiento de las partículas bajo todas las circunstancias imaginables. Por ahí circulan una y mil “teorías” que exponen las ideas más variopintas que imaginarnos podamos pero, desgraciadamente, son inútiles para los físicos porque sus descripciones no reúnen el rigor ni la prcisión que deben estar presentes en toda buena teoría. Por otra , los físicos prefieren que la teoría trate la fuerza gravitatoria de tal manera que esté de acuerdo con la obtenida en la formulación de la teoría de la relatividad general de Einstein. Sabemos que la fuerza gravitatoria cuerpos pesados como las estrellas y los planetas obedece a esta teoría con gran exactitud (como ha sido confirmado espectacularmente en las observaciones de los púlsares, estrellas compactas que rotan a gran velocidad. Nuestra teoría candidata debería explicar estas observaciones).

No digamos de los intrincados caminos que la Física ha sobrevolado cuando se ha querido meter en la posibilidad de viajes en el Tiempo y, los físicos se encontraron con una y mil paradojas extrañas. Además, como nos ocurre con la Teoría de cuerdas, al meternos en un sendero desconocido y de intrincados peligros…nunca hemos podido llegar al final después de largos y costosos recorridos. ¿Servirá para algo los muchos esfuerzos realizados?

Por otra somos conscientes y conocedores de que las leyes de la mecánica cuántica son inexorables y, por tanto, queremos que nuestra teoría sea formulada en términos de la mecánica cuántica. Tanto la mecánica cuántica como la teoría de la relatividad tienen la propiedad de que, tan pronto como uno admita la más pequeña desviación de esos principios, ambas darían lugar a una teoría totalmente diferente, que de ninguna manera se parecería al mundo que conocemos (o pensamos conocer). “Un poco relativista” o “un poco mecanicuántico” tan poco sentido como “un poco embarazado”. Podríamos imaginar, por otra parte, que la mecánica cuántica o la relatividad general, o ambas, serían marcos demasiado restrictivos nuestra avanzada teoría, de manera que habría que extender sus principios, llegar más lejos.

La cuerda es cuántica y gravitatoria, de sus entrañas surge, por arte de magia, la partícula mensajera de la fuerza de gravedad: el gravitón. Funde de natural las dos teorías físicas más poderosas de que disponemos, la mecánica cuántica y la relatividad general, y se convierte en supercuerda -con mayores grados de libertad- es capaz de describir bosones y fermiones, partículas de fuerza y de materia. La simple vibración de una cuerda infinitesimal podría unificar todas la fuerzas y partículas fundamentales.

Parece que todo está hecho de cuerdas, incluso el espacio y el tiempo podrían emerger de las relaciones, más o menas complejas, cuerdas vibrantes. La materia-materia, que tocamos y nos parece tan sólida y compacta, ya sabíamos que está casi vacía, pero no imaginábamos que era tan sutil como una cuerda de energía vibrando. Los átomos, las galaxias, los agujeros negros, todo son marañas de cuerdas y supercuerdas vibrando en diez u once dimensiones espaciotemporales.

Está claro que no trato de explicar aquí una teoría que no comprendo y, el tratar el tema se debe a la curiosidad de tratar de indicar el camino, o, los caminos, por los que se podría llegar más lejos, al , algo más allá. De una cosa si que estoy seguro: ¡Las cuatro fuerzas fundamentales del Universo, un día fueron una sola fuerza!

En el universo existen numerosas estrellas cuyas masas son considerablemente mayores que las del Sol, debido a lo cual, la fuerza gravitotoria en su superficie es considerablemente más intensa que sobre la Tierra o sobre el Sol. La enorme cantidad de materia de una de esas estrellas causa una presión inimaginablemente alta en su interior, pero como las tenperaturasd en el interior de las estrellas es también altísima, se produce una presión contraria que evita que la estrella se colapse. La estrella, sin embargo, pierde calor continuamente. Al proncipio de su vida, en las estrellas se producen todo de reacciones nucleares que mantienen su temperatura alta y que incluso la pueden elevar, pero antes o después el combustible nuclear se acaba. Cuanto más pesada sea la estrella, mayor es la prsión y la temperatura, y más rápidamente se consume su combustible. La contrapresión disminuye progresivamente y la estrella se va colapsando bajo la presión, según dismunye el tamaño de la estrella, la fuerza gravitatoria aumenta hasta que finalmente se produce una implosión -un colapso repentino y completo- que no puede ser evitado por más tiempo: ¡ha nacido un agujero negro!

Según todos los indicios, cuando la estrella es muy masiva, la Improsión finaliza convirtiendo toda la inmensa masa de la estrella en un A. N., pero antes, explota como supernova y llena el espacio de los materiales coplejos que han sido fabricados en sus nucleares, siembra el espacio con una Nebulosa de la que, años más tarde, nacerán nuevas estrellas y nuevos mundos…Y, ¿quién sabe? ¡Si nuevas formas de Vida!

A menudo implosión libera tanto calor que las capas exteriores de la estrella explotan por la presión de la radiación, y la implosión queda interrumpida produciéndose una esfera extremadamente compacta de “material nuclear” que conocemos como una estrella de neutrones. Algunas veces, estas estrellas de neutrones rotan con una tremenda velocidad (más de 500 revoluciones/segundo), y, debido a irregularidades en la superficie, emiten una señal de radio que pulsa con esa velocidad.

Si todos estos sucesos pudieran ser observados una distancia segura, las señales emitidas por el material durante la implosión pronto serían demasiado débiles para ser detectadas y, en el caso de un afgujero negro, el objeto se vuelve de ese color y desaparece de nuestra vista convertido en una “bola de gravedad pura”, se pueden calcular sus propiedades con precisión matemática. Sólo se necesitan tres parámetros para caracterizar completamente al agujero negro: su masa, su movimiento angular (cantidad de movimiento de rotación) y su carga eléctrica.

También se calcular como se comportan los chorros de partículas cuando se aventuiran cerca del agujero negro. Hawking ya nos habló de ello y explicó con suficiente claridad, lo que pasaba era que, en contra de lo que pudiéramos pensar, el agujero emite un débil flujo de partículas en ciertas circunstancias. ¿Esas partículas son reales! Agujero Negro está emitiendo un flujo constante de partículas de todas las especies concebibles.

El Telescopio Espacial Hubble y Chandra han captado la imagen de un impresionante anillo de Agujeros negros. La fotografía corresponde al conjunto Arp 147, en el que aparecen 2 galaxias interactuando entre sí y que se ubican a una distancia de 430 millones de años luz de la Tierra. La NASA combinó datos del Chandra con imágenes del Hubble. Mientras los tonos rojos, azules y verdes fueron resultado del trabajo del Hubble; los de color magenta, del Chandra. La captura muestra un anillo formado por estrellas masivas que evolucionaron rápidamente y explotaron en supernovas, como consecuencia de una colisión galáctica. Es así como dejaron densas estrellas de neutrones y posiblemente, también agujeros negros.

En el Universo ocurren sucesos que no podemos ni imaginar, tales son las fuerzas y energías que ahí están presentes y que dan lugar a maravillas que desembocan en transiciones de fase que convierten unas cosas en otras muy distintas haciendo que la diversidad exista, que la belleza permanezca, que la monotonía no sea el camino.

Es cierto que nunca hemos podido estar tan cerca de un agujero negro como poder comprobar, in situ, la radiación Hawking que, para su formulación, sólo utilizó leyes bien establecidas de la naturaleza y que, por tanto, el resultado debería ser incuestionable, pero no es del todo cierto por dos razones:

La primera razón es que nunca ( he dicho) hemos sido capaces de observar un agujero negro de cerca y mucho de un tamaño tan pequeño que su radiación Hawking pueda ser detectada. Ni siquiera sabemos si tales miniagujeros negros existen en nuestro universo, o si sólo forman una minoría extremadamente escasa entre los objetos del cielo. Aunque pensemos conocer la teoría, no nos habría hecho ningún daño haber podido comprobar sus predicciones de una o de otra. ¿Sucede todo exactamente como pensamos actualmente que debería suceder?

Otros, como Gerald ´t Hooft, consiguieron construir otro de teorías alternativas y le dieron resultados distintos a los de Hawking, en la que el Agujero Negro podia radiar con una intensidad considerablemente mayor que la que la teoría de Stephen predecía.

Hay un aspecto relacionado con la radiación Hawking mucho más importante. El agujero negro disminuye su tamaño al emitir partículas, y la intensidad de su radiación crece rápidamente según se reduce su tamaño. Justo de llegar a los estadios finales, el tamaño del agujero negro se hará comparable a la longitud de Planck y toda la masa llegará a ser sólo un poco mayor que la masa de Planck, Las energías de las partículas emitidas corresponderan a la masa de Planck.

¡Solamente una teoría completa de la Gravedad Cuántica podrá predecir y describir exactamente lo que sucede al agujero negro en ese ! es la importancia de los Agujeros Negros la teoría de partículas elementales en la Longitud de Planck. Los agujeros negros serían un laboratorio ideal para experimentos imaginarios. Todos alcanzan, por sí mismos, el régimen de energía de los números de Planck, y una buena teoría debe ser capaz de decirnos como calcular en ese caso. casi una década, Gerad ´t Hoofft ha resaltando esa objeción en la teoría de supercuerdas: no nos dice nada de los agujeros negros y mucho de cómo un agujero negro comenzar su vida como un agujero negro de tamaño “astronómico” y acabar su vida explosivamente.

Lo cierto es que, andamos un poco perdidos y no pocos físicos (no sabemos si de manera interesada), insisten una y otra vez, en cuestiones que parecen no llevar a ninguna parte y que, según las imposibilidades que nos presentan esos caminos, no sería conveniente elegir otros derroteros para indagar nuevas físicas mientras tanto, avanzan las tecnologías, se adquieren más potentes y nuevas formas de energías que nos puedan permitir llegar a sondear las cuerdas y poder vislumbrar si, es cierto, que pueda existir alguna “materia oscura”, o, si existen bosones dadores de masa, o…¡tántas cosas más que, la lista, sería interminable! de las cosas que no sabemos.

emilio silvera

Mar

21

La Denudación y otros fenómenos naturales

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en La Naturaleza...El Universo ~

Clasificado en La Naturaleza...El Universo ~

Comments (0)

Comments (0)

Hablemos de la Denudación y de otros fenómenos naturales:

Las poderosas fuerzas geomorfológicas pueden actuar suavemente. La acción de la gravedad puede mover, en cuestión de segundos, enormes volúmenes de tierra y piedras en devastadores deslizamientos y desprendimientos. Con lluvias intensas, la erosión en barrancos y cauces puede transformar los campos y las riberas, e inundar las llanuras durante horas o incluso días. Los vientos huracanados pueden, igualmente, modificar la fisonomía de las costas, y algunas superficies pueden ser remodeladas casi instantáneamente por erupciones volcánicas y terremotos. Pero la denudación de los continentes – el proceso debido a la acción de las inclemencias del tiempo, erosión meteórica y el posterior arrastre de los materiales erosionados – es un cambio gradual con tasas habitualmente bajas, que las alteraciones no se perciben durante el transcurso de una vida.

El Bubnoff (B) – la denudación de 1 mm en mil años (o 1 μm/año) – es una unidad conveniente para medir este cambio. Las precipitaciones, por disolución, reducen las duras rocas ígneas o metamórficas con una tasa comprendida entre 0’5 y 5 B, y las calizas hasta 100 B. La denudación en terrenos generalmente secos se produce a ritmos no mayores de 10 – 15 B, y en los trópicos húmedos llega a los 20 – 30 B. Los cambios en terrenos montañosos pueden ser mucho más importantes, llegando hasta 800 B en zonas de glaciares rápidos (sudeste de Alaska) y hasta los casi 10 KB en las zonas más recientes en continua elevación (la región de Nanga Parbat en el Himalaya). Pero incluso estas altas tasas de denudación son resultado de fuerzas modestas.

![]()

Un ejemplo de importancia medioambiental y económica ilustra este lento proceso geomorfológico de baja potencia. Si no hubiera erosión, la profundidad del suelo en los campos de cultivo sería mayor, pero su capa superior se empobrecería en nutrientes, ya que la erosión meteórica, si no es demasiado intensa, es la que repone los minerales en esta capa en la que crecen las raíces, ayudando a mantener la fertilidad del terreno.

La máxima pérdida de suelo compatible con el cultivo sostenido de cosechas es aproximadamente de 11 toneladas por hectárea en la mayor parte del terreno agrícola norteamericano. Cerca de dos quintas partes de los campos de ese país se están erosionando a tasas superiores, y la tasa media nacional de erosión, solamente por agua, es de casi diez toneladas por hectárea, equivalente a 550 B (suponiendo que la densidad del suelo es de 1’8 tn/m3).

El papel dominante de las lluvias en el proceso de la denudación se hace evidente cuando se compara la energía cinética de las gotas de lluvia con la energía de la escorrentía superficial. Las mayores gotas de lluvia, con diámetro comprendido entre 5 y 6 mm, alcanzan velocidades finales de 9 m/s, lo que implica que su energía cinética durante el impacto equivale aproximadamente a 40 veces su masa. Aunque la mitad de la precipitación corriera por la superficie a un velocidad media de un metro por segundo, la energía cinética sería una cuarta parte de la masa en movimiento. Consecuentemente, la erosión resultante de la caída de la lluvia sería dos órdenes de magnitud más potente que la corriente superficial.

La energía total de la denudación global del planeta se puede calcular suponiendo que afecta al menos a 50 B de material, con una densidad media de 2’5 g/cm3 (125 tn/m3) y que la altura media continental es de 850 m. Así, la energía de los campos de la Tierra se reduciría anualmente en 135 PJ. Este flujo, 4’3 GW, es muy pequeño comparado con otros flujos energéticos del planeta, representando el 0’05 por ciento de la energía potencial perdida por las corrientes superficiales de agua, el 0’01 por ciento del calor terrestre e igual a menos de 2×10-7 veces la radiación solar absorbida por las superficies continentales. Claramente, en la denudación de los continentes se invierte una parte insignificante de la radiación solar tanto directamente, a través de la luz solar, como indirectamente, con las corrientes de agua y el viento.

Además, hay fuerzas opuestas que anulan este lento cambio. Si no fuera por el continuo levantamiento tectónico, la cordillera alpina, con sus 4.000 metros de altura, sometida a una denudación de 1 – 5 B se nivelaría en menos de cinco millones de años, y sin embargo, la edad de la cordillera es actualmente un orden de magnitud superior.

Tasas de levantamiento comprendidas entre 5 – 10 B son bastantes frecuentes, y muchas regiones están elevándose con tasas superiores a 20 KB, es decir, una tasa hasta 10 veces superior a la tasa de denudación. No obstante, parece ser que en las zonas montañosas cuyas cumbres sobrepasan la cota de nieve, con grandes precipitaciones y gran actividad glacial, la altura está más limitada por una denudación rápida que por la elevación tectónica del terreno. El noroeste del Himalaya, incluyendo la zona del famoso Nanga Parbat, es un claro ejemplo, donde muchos de sus picos sobrepasan los 7.000 m y solamente el 1 por ciento del terreno los 6.000 m.

Encuentros espaciales

Siendo temibles localmente, son sucesos de relativa poca importancia globalmente habland0

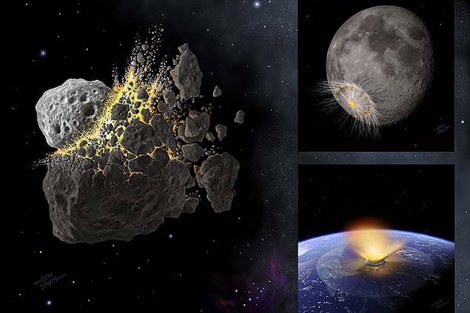

La más destructiva intensificación temporal de los normalmente suaves flujos de energía geotectónica – erupciones volcánicas o terremotos extraordinariamente potentes – o de energía atmosférica – vientos o lluvias anormalmente intensas -, parecen irrelevantes cuando se comparan con las repetidas colisiones del planeta con cuerpos extraterrestres relativamente grandes.

La caída sobre la Tierra de un Gran asteroide sí que es temible

La Tierra está siendo bombardeada continuamente por invisibles partículas microscópicas de polvo muy abundantes en todo el Sistema Solar, y cada treinta segundos se produce un choque con partículas de 1 mm de diámetro, que dejan un rastro luminoso al autodestruirse en la atmósfera. También son relativamente frecuentes los choques con meteoritos de 1 metro de diámetro, que se producen con una frecuencia de, al menos, uno al año.

Pero los impactos, incluso con meteoritos mayores, producen solamente efectos locales. Esto es debido a que los meteoritos que deambulan por la región de asteroides localizada entre Marte y Júpiter están girando alrededor del Sol en el mismo sentido que la Tierra, de manera que la velocidad de impacto es inferior a 15 Km/s.

El cráter de Arizona, casi perfectamente simétrico, se formó hace 25.000 años por el impacto de un meteorito que iba a una velocidad de 11 Km/s, lo que representa una potencia cercana a 700 PW. Estas gigantescas liberaciones de energías palidecen cuando se comparan con un choque frontal con un cometa típico. Su masa (al menos de 500 millones de toneladas) y su velocidad relativa (hasta 70 Km/s) elevan su energía cinética hasta 1022 J. Aunque se perdiera un diez por ciento de esta energía en la atmósfera, el impacto sería equivalente a una explosión de unas 2.500 bombas de hidrógeno de 100 megatones. Está claro que un fenómeno de estas características produciría impresionantes alteraciones climatológicas. Sin embargo, no es seguro y sí discutible que un impacto parecido fuese la causa de la extinción masiva del cretácico, siendo lo más probable, si tenemos en cuenta el periodo relativamente largo en que se produjo, que se podría explicar por la intensa actividad volcánica de aquel tiempo.

La frecuencia de impactos sobre la Tierra disminuye exponencialmente con el tamaño del objeto.

Aproximadamente, cada cincuenta o sesenta millones de años se produce una colisión con un cometa, lo que significaría que la biosfera, que ha evolucionado durante cuatro mil millones de años, ha debido superar unos cuarenta impactos de este tipo. Está claro que ha salido airosa de estas colisiones, ya que aunque haya sido modificada, no ha sido aniquilada.

Igualmente, la evolución de la biosfera ha sobrevivido a las explosiones altamente energéticas de las supernovas más “cercanas”. Dado que en nuestra galaxia se produce por término medio la explosión de una supernova cada 50 años, el Sistema Solar se encuentra a una distancia de 100 parsecs de la explosión cada dos millones de años y a una distancia menor de 10 parsecs cada dos mil millones de años. En este último caso, la parte alta de la atmósfera se vería inundada por un flujo de rayos X y UV de muy corta longitud de onda, diez mil veces mayor que el flujo habitual de radiación solar, lo que implica que la Tierra recibiría, en unas pocas horas, una dosis de radiación ionizante igual a la que recibe anualmente. Exposiciones de 500 roentgens son setales para la mayoría de los vertebrados y, sin embargo, los diez episodios de esta magnitud que se han podido producir en los últimos 500 millones de años no han dejado ninguna consecuencia observable en la evolución de la biosfera.

![[D'Bacod Club] Fighters Home | Love it or Leave it - Part 5](https://dl.kaskus.id/1.bp.blogspot.com/-bAVKhlG8iGM/T5-_eRqmO1I/AAAAAAAAAE8/LCrl-dcTMzU/s1600/Aurora+Borealis+Alaska.jpg)

La radiación cósmica incompatible con la vida

Si suponemos que una civilización avanzada podría preparar refugios para la población durante el año que transcurre ente la llegada de la luz y la llegada de la radiación cósmica, se encontraría con la inevitable dosis de 500 roentgens cada mil millones de años, tiempo suficiente para permitir el desarrollo de una sociedad cuyo conocimiento le sirviera para defenderse de un flujo tan extraordinario y de consecuencias letales. En realidad, somo frágiles dotados de una fortaleza descomunal.

Sí, la Naturaleza nos muestra constantemente su poder. Fenómenos que no podemos evitar y que nos hablan de unos mecanismos que no siempre comprendemos. Nuestro planeta por ejemplo, se comporta como si de un ser vivo se tratara, la llaman Gaia y realiza procesos de reciclaje y renovación por medio de terremotos y erupciones volcánicas, tsunamis y tornados debastadores que cambian el paisaje y nosotros, lo único podemos hacer es acatar el destino, ya que, ignoramos lo que está por venir.

El mundo nos parece un lugar complicado. Sin embargo, existen algunas verdades sencillas que nos parecen eternas, no varían con el paso del tiempo (los objetos caen hacia el suelo y no hacia el cielo, el Sol se levanta por el Este, nunca por el Oeste, nuestras vidas, a pesar de las modernas tecnologías, están todavía con demasiada frecuencia a merced de complicados procesos que producen cambios drásticos y repentinos. La predicción del tiempo atmosférico es más un arte que una ciencia, los terremotos y las erupciones volcánicas se producen de manera impredecible y aparentemente aleatoria, los cambios en las Sociedades fluctuan a merced de sucesos que sus componentes no pueden soportar y exigen el cambio.

La inmensa complejidad que está presente en el cerebro humano y de cómo se genera lo que llamamos “la mente”, a partir de una maraña de conexiones entre más de cien mil millones de neuronas, más que estrellas existen en nuestra Galaxia, la Vía Láctea. Es algo grande que, en realidad, no hemos alcanzado a comprender. Me hace gracia cuando alguna vez escucho decir a alguien: “Sólo utilizamos un diez por ciento de nuestro cerebro”. Lo cierto es que lo utilizamos al cien por ciento y, lo que en realidad quieren decir es que, se supone que el cerebro humano tiene un potencial tan grande que, de momento, sólo ha evolucionado hasta el diez por ciento de su capacidad futura. ¿Hasta dónde llegaremos?

emilio silvera

Totales: 77.946.102

Totales: 77.946.102 Conectados: 41

Conectados: 41