Abr

5

¿Teoría de Cuerdas? ¡Qué extraña resulta!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Todos los que nos asomamos por la ventana de la Física, sabemos, más o menos que, después de más de treinta años de historia con la Teoría de dimensiones extra, no es aún, nada fácil encontrar una respuesta sencilla a una sencilla pregunta: ¿Qué es, la Teoría de Cuerdas? Y, lógicamente, muchos científicos del ámbito de la física, están verdaderamente escandalizados con todo este movimiento del que ellos, hablan como de un montaje circense, una comedia en la que, expertos malabaristas de las matemáticas topológicas, hacen trucos de magia para que parezca lo que no es.

Sin embargo, la cosa no parece que sea tan fácil de despachar, cientos y miles de artículos avalan esa Teoría que, en muchos aspectos, parece ser la esperanza futura de la Física y la única que nos puede abrir caminos ahora cerrados que, nos llevarán más lejos, a lugares que ahora, con la física actual, no podemos visitar.

Claro que no todo son críticas, en un artículo que leí en alguna parte nos dicen: “La teoría ha sido elogiada por algunos físicos debido a su potencial para forjar el largamente buscado vínculo entre la gravedad y las fuerzas que dominan en el núcleo atómico. Pero la teoría –que propone que todas las partículas subatómicas son en realidad diminutas “cuerdas” que vibran de diferentes formas– también ha arrastrado críticas por ser incomprobable en el laboratorio, y tal vez imposible de conectar con los fenómenos del mundo real.

Algunos ven la Teoría de cuerdas como un sueño imposible

Sin embargo, los investigadores de Princeton han descubierto una nueva prueba matemática de que alguna de las predicciones de la Teoría de Cuerdas se entrelazan estrechamente con un cuerpo de la física muy respetable llamado “Teoría Gauge”, el cual se ha demostrado que subyace en las interacciones entre quarks y gluones, los menudos objetos que se combinan para formar protones, neutrones y otras partículas subatómicas más exóticas. El descubrimiento, dicen los físicos, podría dar lugar a una gran cantidad de usos de la Teoría de Cuerdas atacando problemas de la física práctica.”

Es cierto que la Física está dominada por los paradigmas impuestos desde hace cien años por la mecánica cuántica y la relatividad que son dos teorías fundamentales que parten de principios rectores a partir de los cuales las teorías se construyen de una manera casi sistemática. En estos ejemplos es fácil de identificar ese principio rector:

En la Relatividad el principio es la constancia de la velocidad de la luz o, lo que es equivalente, que la velocidad de la luz determina una cota máxima sobre la velocidad de transmisión de información. Una vez aceptado este principio, el resto se da casi por añadidura. La constancia de la velocidad de la luz implica un espacio tiempo con una determinada geometría, la equivalencia entre masa y energía, así como el resto de los resultados de la Dinámica y la Cinemática Relativistas.

Este es el tiempo que tarda la luz en llegar desde la Tierra a la Luna situada a 380.000 Km de nosotros

No podemos perder de vista el hecho cierto de que, la razón por la que la Relatividad se convierte en una auténtica Teoría autónoma es precisamente porque eleva la constancia de la velocidad de la luz a principio rector, a postulado. No se trata de explicar o modelar dinámicamente por qué la velocidad de la luz es la velocidad máxima sino que, muy por el contrario, se trata de derivar toda una cinemática, de hecho la propia naturaleza geométrica del espacio y el tiempo, a partir de dicho postulado.

El Universo de la Mecánica Cuántica nos es fantasmagórico e irreal, es un mundo aparte en el que, podemos ver cosas inusuales y sorprendentes, allí no rigen las mismas leyes que podemos constatar a nuestro alrededor en el mundo macroscópico, o, si están presentes, funcionan de otra manera que, alejada de nuestro propio mundo, no hemos llegado a comprender…del todo.

Nos decía el filósofo Karl Popper:

“La ciencia será siempre una búsqueda, jamás un descubrimiento real. Es un viaje, nunca una llegada.”

El hombre llevaba toda la razón toda vez que, emprendemos la aventura de la Ciencia y tratamos de buscar “cosas” y “comportamientos” que nos digan por qué, la Naturaleza, funciona de esta o de aquella otra manera. Vamos desvelendo escenarios y obteniendo algunas respuestas pero, el viaje no acaba nunca, a cada puerta abierta, nos encontramos con otro nuevo espacio en el que también, existen muchas puertas cerradas cuyas llavez tendremos que encontrar y, siempre será, de esa manera: ¡Un viaje intermivnable! Siempre hay alguna cosa nueva si vamos un poco más allá.

Cada uno de estos cuatro espacios de Hilbert tiene un análisis de Fourier asociado con el.

L2([a,b]) → Series de Fourier

ℓ2([0,n−1]) → Transformada Discreta de Fourier

L2(R) → Transformada de Fourier

ℓ2(Z) → Transformada Discreta de Fourier en Tiempo

Pero los cuatros están basados en el mismo principio (Espacio de Hilbert).

Nota Importante: no todos los espacios normalizados son espacios de Hilbert

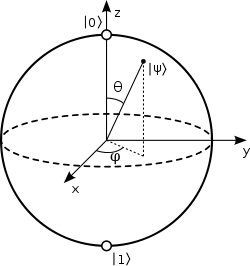

Y por tanto el espacio de Hilbert de esos estados puros se asociará con un punto en esa esfera y un sistema multiqubit será algo como lo expresado en la figura.

De forma más formal, el Espacio de Hilbert se define como un espacio de producto interior que es completo con respecto a la norma vectorial definida por el producto interior. Los espacios de Hilbert sirven para clarificar y para generalizar el concepto de series de Fourier, ciertas transformaciones lineales tales como la transformación de Fourie, y son de importancia crucial en la formulación matemática de la mecánica cuántica.

El espacio de Hilbert es una pura construcción matemática pero responde a la perfección a lo que hacía falta para elaborar la teoría cuántica. De no haberse descubierto habría habido que inventarlo para las necesidades de la teoría. El espacio de Hilbert es un espacio vectorial infinitamente grande. En su momento, esto fue una idea revolucionaria, en virtud de que todos los espacios vectoriales, inclusive los espacios matemáticos abstractos, eran finitos. Pero afortunadamente en su trabajo sobre ecuaciones integrales llevado a cabo en 1912 David Hilbert tuvo la visión suficiente para captar la necesidad de tener que postular un espacio vectorial infinitamente grande para poder proyectar todo el aparato matemático de la Mecánica Cuántica sobre una base rigurosamente formal. Y quince años después correspondió a otro matemático igualmente brillante, el matemático húngaro John Neumann, el darle en 1927 una definición axiomática al espacio vectorial de Hilbert en su ya famosa obra Mathematische Grundlagen der Quantenmechanik. Pero Hilbert no solo propuso un espacio vectorial infinitamente grande. Propuso también que los componentes de los “vectores” pudiesen ser números imaginarios o números complejos sin estar limitados a ser números reales, redefiniendo a la vez el concepto del producto interno de dos vectores para que dicho producto pudiese seguir siendo un número real con significado físico.

En el caso de la Mecánica Cuántica el principio rector es el Principio de Incertidumbre de Heisenberg. De nuevo este principio se postula como principio básico y a partir de allí se deduce como tiene que ser el espacio de estados físicos, que se convierte en un espacio de naturaleza completamente nueva como lo es un espacio de Hilbert.

Esto da lugar a fenómenos tan sorprendentes como el entrelazamiento cuántico o la estabilidad atómica.

Sí, el camino ha sido largo. En la serie de artículos Fundamentos de una teoría general de las ecuaciones integrales, Hilbert analizó las técnicas introducidas para estudiar estas ecuaciones por Poincaré y Fredholm a finales del XIX, mejorando sus resultados. En el cuarto artículo de esta serie, publicado en 1906, Hilbert prueba que las ecuaciones integrales pueden resolverse como un sistema de infinitas ecuaciones lineales con infinitas incógnitas.

Todos los objetos situados en el mismo campo gravitatorio caen con la misma aceleración si y sólo si la proporción entre masa gravitacional e inercial es igual a una constante. Por eso precisamente decimos que, en Relatividad General, el principio rector es el principio de equivalencia entre masa inercial y masa gravitatoria.

En la Teoría de Cuerdas la situación es completamente distinta. Se desconoce cual pueda ser el principio rector, si en realidad existe algún principio rector en esta teoría, y es, precisamente este desconocimiento el qure genera en nosotros perplejidad cuando se nos pide una respuesta sencilla a: ¿Qué es la Teoría de Cuerdas?

Recordemos que el nacimiento de la teoría fue, esencialmente modesto. Aquel momento en el que proliferaban los experimentos de resonancias en interacciones fuertes con espines altos resultaba desconcertante, se observó que una manera de hacer consistente la mediación de la interacción con partícuals de espín alto consistía en imponer a las amplitudes de colisión una simetría particular que se denominó dualidad. Desde entonces las cosas han cambiado de manera exponencial y se habla de otra manera y de otras cosas. Veámos que nos dice, por ejemplo, uno de los padres de la teoría de cuerdas:

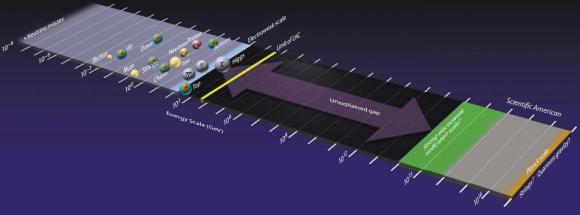

“Me gusta esta figura porque muestra muy claramente lo que conocemos en física de partículas, lo que esperamos explorar en las próximas décadas, y lo que creemos conocer, aunque nunca llegaremos a explorar de forma directa. La partícula con más masa conocida tiene menos de 200 GeV y todavía se sigue explorando entre 10 a 200 GeV en busca de nuevas partículas. Basta recordar que se acaba de descubrir una partícula con 125 GeV de masa, el bosón de Higgs, y que muchos físicos creen que la partícula responsable de la materia oscura tiene una masa en este rango. El LHC y sus sucesores en las próximas décadas explorarán las energías entre 100 y 5000 GeV (difícilmente podrán llegar más lejos). Sin embargo, hay un desierto hasta energías de 10 000 000 000 GeV (la escala de Planck) que no hemos explorado, que no podremos explorar en el siglo XXI y del que no conocemos absolutamente nada, aunque imaginamos muchas cosas.”

Si sabemos, por ejemplpo que.. la constante de Planck, h = 6,626075…x 10 exp. -34 julios segundo, debe ser exactamente la misma para cualquier objeto en cualquier sitio, …

Como facilmente podemos deducir de lo que arriba se dice, estamos muy lejos aún de llegar a un autoconsistente final en la teoría de cuerdas que, posiblemente necesite disponer de la energía de Planck (1019 GeV), para verificarla de manera que no dejara ningún lugar a dudas. Hemos podido verificar la Teoría Cuántica y tambien, las dos versiones de la Teoría de la Relatividad. Sin embargo… Las cuerdas están lejos de ser una teoría que podamos aceptar y, sólo esperanzas podemos volcar en ella, con la idea de que, en un futuro más o menos lejano, nos pudiera dar aquellas respuestas que, de momento, no encontramos.

No podemos negar que algunos resultados en esta teoría han sido sobresalientes: Las resonancias, que habían actuado como motivación, se acomodaban como modos de vibración de las cuerdas y la democracia nuclear adquiría un status más sólido al reflejar una manera de unificar partículas, con espines arbitrariamente altos, como distintos modos de vibración de un mismo objeto fundamental. Aunque estos avances fueron destacados, la teoría empezó pronto a hacer aguas. En primer lugar, las cuerdas eran tan solo una manera de modelar la física subyacente a las amplitudes duales, pero por otra parte esta estructura de objetos extendidos fundamentales producía una serie de consecuencia que no iban a encajar con los futuros resultados experimentales en interacciones fuertes.

Las amplitudes duales, aunque implementaban la idea de democracia nuclear, daban ineludiblemente lugar a un comportamiento de las amplitudes a altas energías mucho más suave del que se observaba en la realidad. Por otro lado los avances formales habían mostrado que la consistencia de la teoría exigía un espacio tiempo de dimensión 26 y que el espectro contenía al menos un taquión (una partícula con masa imaginaria). Estos defectos fueron pronto, parcialmente subsanados, dando lugar a conceptos que han ocupado un papel crucial en la Física de los últimos lustros; estoy hablando de la supersimetría y al renacimiento de las ideas de Kaluza y Klein sobre espacio-tiempo con más de cuatro dimensiones.

Seguiremos hablando de la Teoría de Cuerdas y llegaremos hasta la actual posición que ocupa ésta compleja idea que algunos físicos han venido desarrollando en los últimos cuarenta años y que, nadie sabe en qué pueda desembocar. Muchas han sido las teorías que han sido desarrolladas y, siempre, nos dieron respuestas a cuestiones que, en un principio, ni podíamos imaginar.

¿Os acordáis de la Teoría del Caos?

El efecto mariposa, un atractor extraño

El orden lleva asociado un grado importante de predicción, al caos le sucede lo contrario. Los sistemas lineales, representan el orden, son predecibles y cómodos de manejar, de ahí nuestra tendencia a generalizarlos. Ante un sinfín de situaciones generalizamos, proyectamos los datos del presente para tratar de averiguar un comportamiento futuro y casi siempre nos va bien. Pero existen sistemas que se resisten: pequeñas variaciones, incertidumbres, en los datos iniciales desembocan en situaciones finales totalmente descontroladas e impredecibles. Son los llamados sistemas caóticos.

Pues, de la misma manera, estamos tratando de desarrollar una teoría que, de alguna manera, nos pueda responder a cuestiones que son presentidas e intuidas pero que, hasta el momento, nadie ha podido explicar y, es precisamente con la Teoría de Cuerdas con lo que se quiere buscar esas respuestas profundamente escondidas en las entrañas de la naturaleza: ¡La Teoría de Cuerdas! Que podría ser una quimera o una gran solución.

emilio silvera

Abr

5

¿Nuestras vidas? La podemos llevar… ¡De tántas maneras!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Divagando ~

Clasificado en Divagando ~

Comments (0)

Comments (0)

“La paradoja de nuestro tiempo en la historia es que tenemos edificios más altos pero temperamentos más cortos, autopistas más anchas, pero puntos de vista más estrechos. Gastamos más pero tenemos menos, compramos más, pero gozamos menos. Tenemos casas más grandes y familias más pequeñas, más conveniencias, pero menos tiempo. Tenemos más grados y títulos pero menos sentido, más conocimiento, pero menos juicio, más expertos, sin embargo más problemas, más medicina, pero menos . “

Quizá el problema esté en que no sabemos donde reside lo que realmente tiene valor, tendemos a querer tener la casa más grande, el coche que más corra, la pantalla de plasma o el celular de la última generación, siempre vamos corriendo a todas partes y, salimos de noche de casa y regresamos cuando el día ha terminado pero, cuando nos acostamos sin haber visto a los niños dormidos, nos cueta coger el sueño… La hipoteca, aquel préstamo, el negocio que no marcha, la inestabilidad de la empresa…

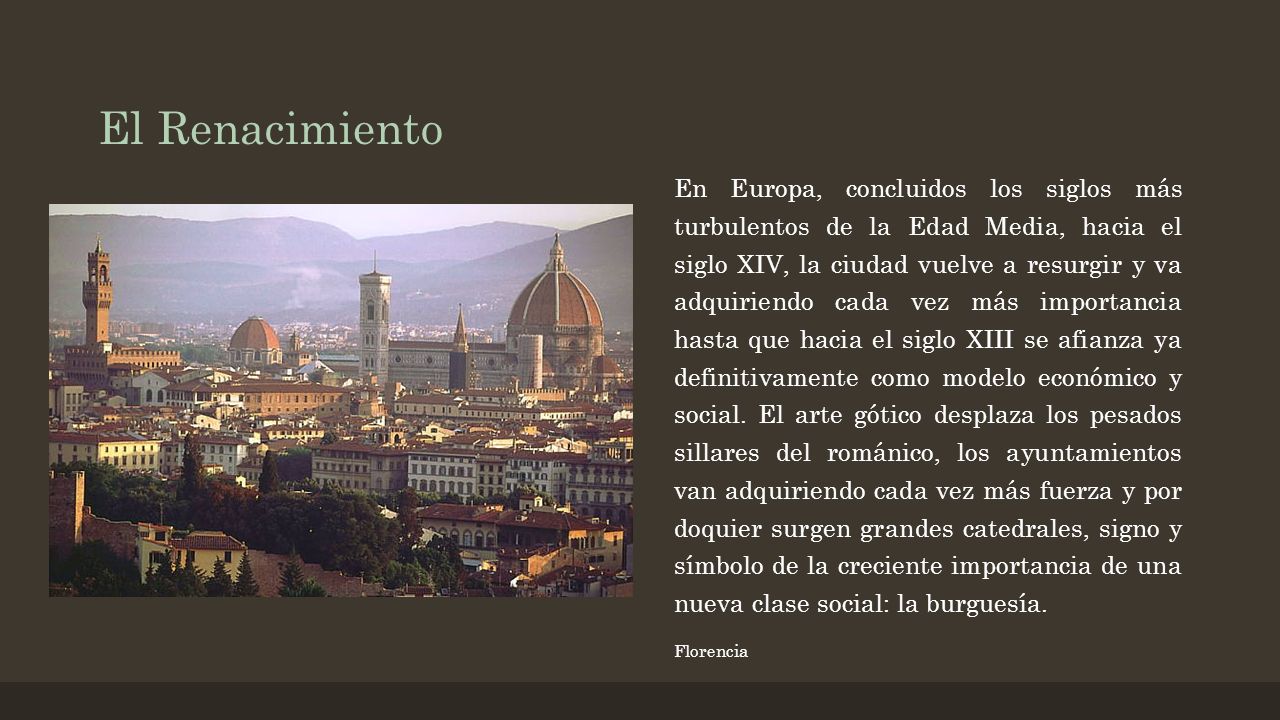

Los Tiempos cambian, las ciudades también

Dedicar algún tiempo a la familia, sacrificando los beneficios puede compensarnos a la larga, ya que, no siempre es el dinero el que nos proporciona los mejores momentos, los más auténticos. Estos momentos felices, residen siempre en lo más sencillo, lo más cercano, nuestro entorno y nuestra familia que, al fin y al cabo… ¿Qué tenemos mejor que eso?

No puedo ni recordar la cantidad de veces que me perdí, ayudar a mis hijos pequeños en la tarea del colegio. Estaba de viaje, la Oficina me ocupaba demasiado tiempo, el trabajo no me dejaba mucho tiempo libre y, sin embargo, ahora miro hacia atrás, y, nada de aquello podía compensar, de hecho no compensó nunca aquellos momentos perdidos. Que no se trata de que los perdieras tú, si no que, además, se los hicistes perder a tus hijos que, lo echaron de menos y, seguramente, así lo recordaran.

El Tiempo sólo marcha en una dirección: La flecja del Tiempo que sigue siempre adelante y, el momento que pasó, nunca podrá volver atrás, si en cada m omento no hacemos aquello que procede hacer… ¡Lo perderemos para siempre!

Así, contemplaremos el paisaje y disfrutaremos de la Naturaleza

Dar un sencillo paseo por el campo aspirando los aromas de las plantes y las flores, oyendo el canto de algún pajarillo y dejar que nuestros oidos sean acariciados por el rumor de un regajo cercano por el que, el agua transparente corre camino de un cauce mayor. ¿Cuánto vale eso?

Este viaje, aunque no se le niegue emoción… es diferente, otra cosa

No, esto no es calidad de vida. Pasarse años en esta ciudad, seguramente, acortará el tiempo que podamos estar aquí. El estrés y la agobieante forma de vida en una de estas ciudadades… ¡acabaría conmigo. La escena que arriba contemplamos es desquiciante y sin duda alguna hará mella en los seres que ahí tengan que estar cada día, en esa vorágine de actividad inusitada entre ruidosruidos insoportables.

Mejor poder dejar pasar tu tiempo en una casa tranquila con un poco de jardín, en la que los fines de semana se escuche el bullicioso ruído de los más pequeños con sus juegos que te traen recuerdos de otros tiempos pasados que, de esta manera, puedes volver a revivir en tu memoria.

Y, mientras eso ocurre, tienes la oportunidad de mirar por la cristalera mientras tecleas tus ideas en ese espacio en blanco que te deja el ordenador para que, juntando las palabras, puedas expresar las cosas que por tu imaginación van pasando.

Claro que, no siempre podemos hacer realidad nuestros deseos y, todos, sin excepción, estamos supeditados a lo que la vida nos tiene deparado que, no pocas veces, es un destino que nos forjamos nosotros mismos.

emilio silvera

Abr

4

Nebulosas Planetarias y estrellas enanas blancas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en ese misterio ~

Clasificado en ese misterio ~

Comments (0)

Comments (0)

NGC 2392 es una nebulosa planetaria en la constelación de Gérminis

En la imagen de arriba contemplamos la Nebulosa del Esquimal o del Payaso, NGC 2392, que forma un conjunto vistoso. Por su curiosa apariencia, que recuerda a la cara de una persona rodeada por una capucha, recibe también los nombres de Nebulosa Esquimal. Se encuentra, según autores, a unos 3000 o/ 5000 años-luz de la Tierra.

La edad de NGC 2392 se estima en unos 10.000 años, y está compuesta por dos lóbulos elípticos de materia saliendo de la estrella moribunda. Desde nuestra perspectiva, unos de los lóbulos está delante del otro.

Se cree que la forma de la nebulosa se debe a un anillo de material denso alrededor del ecuador de la estrella expulsado durante la fase de gigante roja. Este material denso es arrastrado a una velocidad de 115.000 km/h., impidiendo que el viento estelar, que posee una velocidad mucho mayor, empuje la materia a lo largo del ecuador. Por el contrario, este viento de gran velocidad (1,5 millones de km/h) barre material por encima y debajo de la estrella, formando burbujas alargadas. Estas burbujas, de 1 año luz de longitud y la mitad de anchura, tienen filamentos de materia más densa. No obstante, las líneas que van de dentro a afuera en el anillo exterior (en la capucha) no tienen todavía explicación, si bien su origen puede deberse a la colisión entre gases de baja y alta velocidad.

La Nebulosa del Esquimal fue descubierta por William Herschel el 17 de enero de 1787.

La Nebulosa Reloj de Arena

Una nebulosa planetaria es una nebulosa de emisión consistente en una envoltura brillante en expansión de plasma y gas ionizado, expulsada durante la fase de rama asintótica gigante que atraviesan las estrellas gigantes rojas en los últimos momentos de sus vidas.

Las nebulosas planetarias son objetos de gran importancia en astronpmía, debido a que desempeñan un papel crucial en la evolución química de las Galaxias, devolviendo al medio interestelar metales pesados y otros productos de la nucleosíntesis de las estrellas (como Carbono, Nitrógeno, xígeno, Calcio… y otros). En galaxias lejanas, las nebulosas planetarias son los únicos objetos de los que se puede obtener información útil acerca de su composición química.

La Nebulosa Ojo de Gato. Imagen en falso color (visible y rayos X) tomada por el tomada por el Hubble.

La gama y diseños de Nebulosas Planetarias es de muy amplio abanico y, en esa familia de Nubulosas podemos admirar y asombrarnos con algunas que, como la famosa Ojo de Gato (arriba), nos muestra una sinfonía de arquitectónica superpuesta que ni la mente del más avispado arquitecto habría podido soñar.

Una enana blanca es una pequeña y densa estrella que es el resultado final de la evolución de todas las estrellas (por el ejemplo el Sol), excepto las muy masivas. Según todos los estudios y observaciones, cálculos, modelos de simulación, etc., estas estrellas se forman cuando, al final de la vida de las estrellas medianas, agotan el combustible de fusión nuclear, se produce el colapso de sus núcleos estelares, y quedan expuestas, cuando las partes exteriores de la estrella son expulsadas al espacio interestelar formar una Nebulosa Planetaria. En el centro de la Nebulosa, queda denudo un puntito blanco que es, la estrella enana blanca.

El Núcleo se contrae bajo su propia gravedad hasta que, habiendo alcanzado un tamaño similar al de la Tierra , se ha vuelto tan densa (5 x 10 ^8 Kg/m3) que sólo evita su propio colapso por la preseión de degeneración de los electrones ( saben los electrones son fermiones que estando sometidos al Principio de exclusión de Pauli, no pueden ocupar niguno de ellos el mismo lugar de otro al tener el mismo número cuántico y, siendo así, cuando se juntan demasiado, se degeneran y comienzan una frenética carrera que, en su intensidad, , incluso frenar la implosión de una estrella -como es el caso de las enanas blancas).

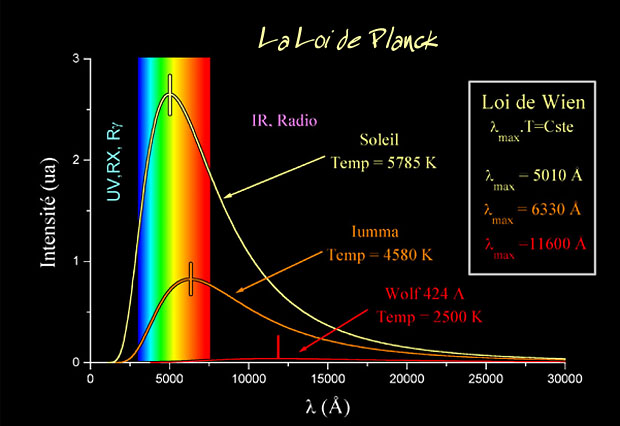

Las enanas blancas se forman con muy altas temperaturas superficiales (por encima de los 10 000 K) debido al calor atrapados en ellas, y liberado por combustiones nucleares previas y por la intensa atracción gravitacional que sólo se ve frenada por la degeneración de los electrones que, finalmente, la estabilizan como estrella enana blanca.

Este tipo de estrellas, con el paso del tiempo, se enfrían gradualmente, volviéndose más débiles y rojas. Las enanas blancas pueden constituir el 30 por ciento de las estrellas de la vecindad solar, aunque debido a sus bajas luminosidades de 10 ^-3 – 10 ^-4 veces la del Sol, pasan desapercibidas. La máxima máxima posible de una enana blanca es de 1,44 masas solares, el límite de Shandrasekhar. Un objeto de masa mayor se contraería aún más y se convertiría en una estrella de neutrones o, de tener mucha masa, en un agujero negro.

Las enanas blancas son estrellas calientes y pequeñas, generalmente del tamaño de la Tierra, por lo que su luminosidad es muy baja. Se cree que las enanas blancas son los residuos presentes en el centro de las nebulosas planetarias. Dicho de otra manera, las enanas blancas son el núcleo de las estrellas de baja masa que quedan después de que la envoltura se ha convertido en una nebulosa planetaria.

El núcleo de una enana blanca consiste de material de electrones degenerados. Sin la posibilidad de tener nuevas reacciones nucleares, y probablemente después de haber perdido sus capas externas debido al viento solar y la expulsión de una nebulosa planetaria, la enana blanca se contrae debido a la fuerza de gravedad. La contracción hace que la densidad en el núcleo aumente hasta que se den las necesarias para tener un material de electrones degenerados. Este material genera presión de degeneración, el cual contrarresta la contracción gravitacional.

Procyon B, una débil enana blanca.

Al ser estudiadas más a fondo las propiedades de las enanas blancas se encontró que al aumentar su masa, su radio disminuye. A partir de esto es que se encuentra que hay un límite superior la masa de una enana blanca, el cual se encuentra alrededor de 1.4 masas solares (MS). Si la masa es superior a 1.4 MS la presión de degeneración del núcleo no es suficiente detener la contracción gravitacional. Este se llama el límite de Chandrasekhar.

Debido a la existencia de este límite es que las estrellas de entre 1.4 MS y 11 MS deben perder masa para poder convertirse en enanas blancas. Ya explicamos que dos medios de pérdida de masa son los vientos estelares y la expulsión de nebulosas planetarias. Sin embargo, existen otras posiblidades que se puedan dar en este tipo de estrellas que son muy densas. Por ejemplo, si cerca de alguna de ellas reside otra estrella que esté lo bastante cerca, la enana blanca, poco a poco, puede ir robándole masa a la estrela compañera hasta que, llegado a un punto, ella misma se recicla y se convierte en una estrella de Neutrones.

Después de que una estrella se ha convertido en enana blanca, lo más probable es que su destino sea enfriarse y perder brillo. Debido a que las enanas blancas tienen una baja luminosidad, pierden energía lentamente, por lo que pueden permanecer en etapa en el orden de años. Una vez que se enfrían, se vuelven rocas que se quedan vagando por el Universo. Este es el triste destino de nuestro Sol.

La detección de enanas blancas es difícil, ya que son objetos con un brillo muy débil. Por otro lado, hay ciertas diferencias en las enanas blancas según su masa. Las enanas blancas menos masivas sólo alcanzan a quemar hidrógeno en helio. Es decir, el núcleo de la estrella nunca se comprime lo suficiente como alcanzar la temperatura necesaria para quemar helio en carbono. Las enanas blancas más masivas sí llevan a cabo reacciones nucleares de elementos más pesados, es decir, en su núcleo podemos encontrar carbono y oxígeno.

Allá por el año 1908, siendo Chandrasekhar un avanzado estudiante de física, vivía en Madrás, en la Bahía de Bengala (En cuyo Puerto trabajó Ramanujan), y, estando en aquella ciudad el célebre científico Arnold Sommerfeld, le pidió audiciencia y se pudo entrevistar con él que, le vino a decir que la física que estudiaba estaba pasada, que se estaban estudiando nuevos caminos de la física y, sobre todo, uno a cuya teoría se la llamaba mecánica cuántica que podía explicar el comportamiento de lo muy pequeño.

Cuando se despidieron Sommerfeld dio a Chandrasekhar la prueba de imprenta de un artículo técnico que acaba de escribir. Contenía una derivación de las leyes mecanocuánticas que gobiernan grandes conjuntos de electrones comprimidos en volúmenes pequeños, por ejemplo ( este caso) en una estrella enana blanca.

A partir de aquel artículo, Chandrasekhar buscó más información y estudió estos fenómenos estelares que desembocaban en enanas blancas. Este tipo de estrella habían descuibiertas por las astrónomos a través de sus telescopios. Lo misterioso de las enanas blancas era su densidad extraordinariamente alta de la materia en su interior, una densidad muchísimo mayor que la de cualquier otra cosa que los seres humanos hubieran encontrado antes. Chandrasekhar no tenía forma de saberlo cuando abrió un libro de Eddintong que versaba sobre la materia, pero la lucha por desvelar el misterio de alta densidad le obligaría fibnalmente a él y a Eddintong a afrontar la posibilidad de que las estrellas masivas, cuando mueren, pudieran contraerse para formar agujeros negros.

De las enanas blancas más conocidas y cercanas, tenemos a Sirio B. Sirio A y Sirio B son la sexta y la séptima estrellas en orden de proximidad a la Tierra, a 8,6 años-luz de distancia, y Sirio es la estrella más brillante en nuestro cielo. Sirio B orbita en torno a Sirio de la misma manera que lo hace la Tierra alrededor del Sol, pero Sirio B tarde 50 años en completar una órbita a Sirio y la Tierra 1 año al Sol.

Eddintong describía como habían estimado los astrónomos, a partir de observaciones con telescopios, la masa y la circunferencia de Sirio B. La masa era de 0,85 veces la masa del Sol; la circunferencia media 118.000 km. Esto significaba que la densidad media de Sirio B era de 61.000 gramos por centímetro cúbico, es decir 61.000 veces mayor que la densidad del agua. “Este argumento se conoce ya hace algunos años -nos decía Eddintong-” Sin embargo, la mayoría de los astrónomos de aquel tiempo, no se tomaban en serio tal densidad, Sin embargo, si hubieran conocido la verdad que conocemos: (Una masa de 1,05 soles, una circunferencia de 31.000 km y una densidad de 4 millones de gramos por cm3), la habrían considerado aún más absurda.

Arriba la famosa Nebulosa planetaria ojo de Gato que, en su centro luce una estrella enana blanca de energéticas radiaciones en el ultravioleta y que, a medida que se vaya enfriando, serán de rayos C y radio que, dentro de unos 100 millones de años vieja y fria, será más rojiza y se habrá convertido en un cadáver estelar.

Aquellos trabajos de Chandraskar y Eddintong desembocaron en un profundo conocimiento de las estrellas de neutrones y, se llego a saber el por qué conseguian el equilibrio que las estabilizaba a través de la salvación que, finalmente encontraban, en la mecánica cuántica, cuando los electrones degenerados por causa del Principio de esclusión de Pauli, no dejaban que la fuerza gravitatoria continuara el proceso de contracción de la estrella y así, quedaba estabilizada como estrella de neutrones.

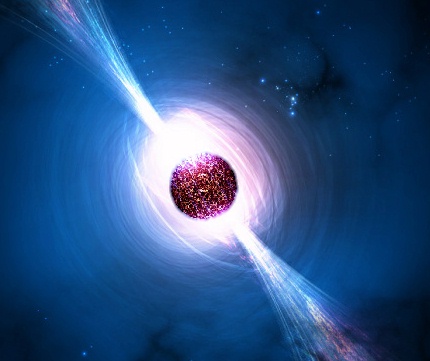

De la misma manera, se repetía el proceso estrellas más masivas que, no pudiendo ser frenadas en su implosión gravitatoria por la degeneración de los electrones, sí que podia frenarse la Gravedad, mediante la degeneración de los Neutrones. Cuando esa estrella más masiva se contraía más y más, el Principio de exclusión de pauli que impide que los fermiones estén juntos, comenzaba su trabajo e impedía que los neutrones (que son fermiones), se juntaran más, entonces, como antes los electrones, se degeneraban y comenzaban a moverse con velocidades relativistas y, tan hecho, impedía, por sí mismo que la Gravedad consiguiera comprimir más la masa de la estrella que, de manera, quedaba convertida, finalmente, en una Estrella de Neutrones.

Al formarse la estrella de neutrones la estrella se colapsa hasta formar una esfera perfecta con un radio de tan solo unos 10 kilómetros. En este punto la presión neutrónica de Fermi resultante compensa la fuerza gravitatoria y estabiliza la estrella de neutrones. Apenas una cucharilla del material que conforma una estrella de neutrones tendría una masa superior a 5 x 10 ^12 kilogramos.

Los modelos de estrellas de neutrones que se han logrado construir utilizando las leyes físicas presentan varias capas. Las estrella de neutrones presentarían una corteza de hierro muy liso de, aproximadamente, un metro de espesor. Debajo de corteza, prácticamente todo el material está compuesto por núcleos y partículas atómicas fuertemente comprimidos formando un “cristal” sólido de materia nucleica.

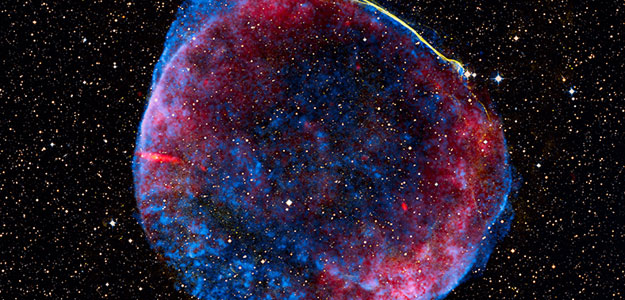

Son objetos extremadamente pequeños u densos que surgen cuando estrellas masivas sufren una explosión supernova del II, el núculeo se colapsa bajo su propia gravedad y puede llegar hasta una densidad de 10 ^17 Kg/m3. Los electrones y los protones que están muy juntos se fusionan y forman neutrones. El resultado final consiste solo en neutrones, cuyo material, conforma la estrella del mismo . Con una masa poco mayor que la del Sol, tendría un diámetro de sólo 30 Km, y una densidad mucho mayor que la que habría en un terrón de azúcar con una masa igual a la de toda la humkanidad. Cuanto mayor es la masa de una estrella de neutrones, menor será su diámetro. Está compuesta por un interior de neutrones superfluidos (es decir, neutrones que se comportan como un fluido de viscosidad cero), rodeado por más o menos una corteza sólida de 1 km de grosor compuesta de elementos como el hierro. Los púlsares son estrellas de neutrones magnetizadas en rotación. Las binarias de rayos X masivas también se piensan que contienen estrellas de neutrones.

Todos aquellos argumentos sobre el comportamiento de las enanas blancas vinieron a desembocar en la paradoja de Edddintong que, en realidad, fue resuelta por el Joven Chandrasekhar en el año 1925 al leer un artículo de R.H. Fowler “Sobre la materia densa”. La solución residía en el fallo de las leyes de la física que utilizaba Eddintong. Dichas leyes debían ser reemplazadas por la nueva mecánica cuántica, que describía la presión en el interior de Sirio B y otras enanas blancas como debida no al calor sino a un fenómeno mecanocuántico : los movimientos degenerados de los electrones, también llamado degeneración electrónica.

La degeneración electrónica es algo muy parecido a la claustrofia humana. Cuando la materia es comprimida hasta una densidad 10.000 veces mayor que la de una roca, la nube de electrones en torno a cada uno de sus núcleos atómicos se hace 10.000 veces más condensada, Así, cada electrón queda confinado en una “celda” con un volumen 10.000 veces menor que el volumen en el que previamente podía moverse. Con tan poco espacio disponible, el electrón, como nos pasaría a cualquiera de nosotros, se siente incómodo, siente claustrofobia y comienza a agitarse de manera incontrolada, golpeando con enorme fuerza las paredes de las celdas adyacentes. Nada puede deternerlo, el electrón está obligado a ello por las leyes de la mecánica cuántica. Esto está producido por el Principio de esclusión de Pauli que impide que dos fermiones estén juntos, así que, fuerza es, la que finalmente posibilita que la estrella que se comprime más y más, quede finalmente, constituida estable como una enana blanca.

emilio silvera

Abr

4

Reportajes y noticias

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Noticias ~

Clasificado en Noticias ~

Comments (0)

Comments (0)

El gen “vegetariano” que protege cerebro y corazón

Publicado por Pilar Quijada

El cerebro y el sistema nervioso tienen un alto contenido de dos ácidos grasos poliinsaturados de cadena larga: el ácido araquidónico (omega-6) y el ácido docosahexaenoico (omega-3, DHA). Los alimentos de origen animal, en especial los pescados azules, son la principal fuente de estos ácidos grasos tan importantes para el organismo en general y para el cerebro. Cuando el aporte es escaso, estos compuestos esenciales tienen que ser sintetizados metabólicamente a partir de precursores vegetales. Según un estudio de la Universidad de Cornell, la demanda fisiológica de ácido araquidónico, así como de omega-3 EPA y DHA, en países cuya dieta es fundamentalmente vegetariana es probable que haya favorecido una genética que ayuda a una síntesis mucho más eficiente de estos metabolitos clave.

La importancia de estos lípidos radica en su capacidad para aportar una fluidez óptima a las membranas celulares, presentando un efecto antagónico al colesterol, que las hace más rígidas. Además, son esenciales para la comunicación celular y la transducción de señales intracelulares, actuando a través de vías genómicas y no genómicas. A nivel no genómico participan como moduladores de la respuesta inflamatoria, inhibidores de la agregación plaquetaria y en la proliferación y diferenciación de algunos tipos celulares.

Mediante el uso de datos del Proyecto 1000 Genomas, el equipo de investigación ha demostrado que el mantenimiento de una dieta vegetariana, durante muchas generaciones a lo largo de la evolución, puede haber impulsado una mayor frecuencia de una mutación en la población india. La mutación consiste en una inserción o delección de una secuencia de ADN, capaz que regular la expresión de dos genes, FADS1 FADS2. Dos genes clave para hacer más eficiente la síntesis de los ácidos grados omega 3 y 6 a partir sus homólogos más cortos presentes en alimentos vegetales.

“Con poca comida animal en la dieta, los ácidos grasos poliinsaturados de cadena larga se deben fabricar metabólicamente a partir de precursores vegetales más cortos, denominados PUFA. En los veganos su aporte se basan casi exclusivamente en la síntesis endógena. La demanda fisiológica para el ácido araquidónico, así como ácidos grasos omega-3 EPA y DHA, en los vegetarianos es probable que esté favorecidos por la genética para lograr una síntesis más eficiente”, señalan los investigadores.

Publicado en Molecular Biology and Evolution, este es el primer trabajo de investigación evolutiva que traza una mayor frecuencia de una mutación concreta. La investigación muestra que en una población básicamente vegetariana como la de Pune, en India, la frecuencia de esa mutación es del 70%. Mientras que en personas con estilo de vida americano tradicional, principalmente de Kansas, que incluye carne en su alimentación, la mutación no llega al 20 por ciento.

Curiosamente, la supresión de esa misma secuencia podría haber sido también adaptativa en poblaciones que incluyen mucho pescado en su dieta, como los inuit de Groenlandia, y que obtienen de ella los ácidos grasos. Se trata de una nueva prueba de que “somos lo que comemos”.

Sin embargo, en las poblaciones con estas adaptaciones genéticas basadas en la alimentación, “una dieta desequilibrada en ácidos omega-6 y omega-3 pueden contribuir al aumento de las enfermedades crónicas.” Y es que, si el ácido araquidónico es esencial para el cerebro, algunos de sus metabolitos participan en la respuesta inflamatoria. De hecho, el ácido araquidónico es una diana clave en la industria farmacéutica, ya que es el principal culpable de ciertas enfermedades cardiacas, del cáncer de colon y de otras patologías relacionadas con la inflamación en grupos de alto riesgo.

En función del número de copias de esta mutación ahora descubierta (0, 1 o 2 copias de la inserción) y su influencia sobre los metabolitos de ácidos grasos, se puede hacer una medicina de precisión y la nutrición. Cambios en la dieta en poblaciones como la india, en la que la mayoría tiene esta mutación, o en zonas de África donde la alimentación es básicamente vegetariana, pueden contribuir al aumento de enfermedad crónica en algunos países en desarrollo.

Fuente: La prensa nacional

Abr

3

El Horizonte de los Agujeros Negros

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Agujeros negros ~

Clasificado en Agujeros negros ~

Comments (3)

Comments (3)

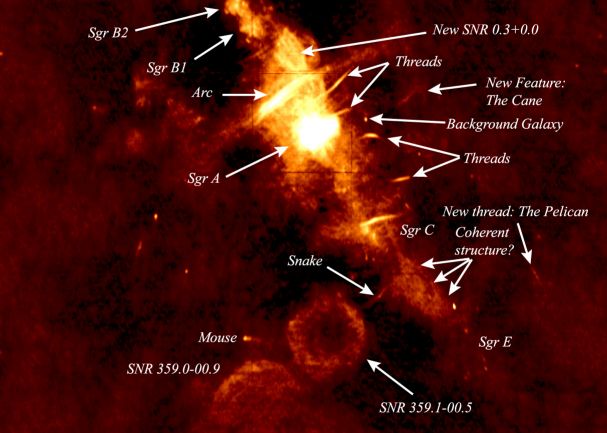

La técnica de la interferometría de muy larga base a longitudes de onda milimétricas (mm-VLBI) ha permitido obtener imágenes de los motores centrales de las galaxias activas con una resolución angular de decenas de microsegundos de arco. Para aquellos objetos más cercanos (M87, SgrA) se obtienen resoluciones lineales del orden de las decenas de Radios de Schwarzschild, lo que permite estudiar con detalle único la vecindad de los agujeros negros supermasivos.

Al sintonizar hacia el centro de la Vía Láctea, los radioastrónomos exploran un lugar complejo y misterioso donde está SgrA que…¡Esconde un Agujero Nefro descomunal! Las observaciones astronómicas utilizando la técnica de Interferometría de muy larga base, a longitudes de onda milimétricas proporcionan una resolución angular única en Astronomía. De este modo, observando a 86 GHz se consigue una resolución angular del orden de 40 microsegundos de arco, lo que supone una resolución lineal de 1 año-luz para una fuente con un corrimiento al rojo z = 1, de 10 días-luz para una fuente con un corrimiento al rojo de z = 0,01 y de 10 minutos-luz (1 Unidad Astronómica) para una fuente situada a una distancia de 8 Kpc (1 parcec = 3,26 años-luz), la distancia de nuestro centro galáctico. Debemos resaltar que con la técnica de mm-VLBI disfrutamos de una doble ventaja: por un lado alcanzamos una resolución de decenas de microsegundos de arco, proporcionando imágenes muy detalladas de las regiones emisoras y, por otro, podemos estudiar aquellas regiones que son parcialmente opacas a longitudes de onda más larga.

Imagen de un chorro de 5000 años-luz de longitud que está siendo eyectado del núcleo activo de la galaxia M87 (una radiogalaxia). La radiación sincrotrón del chorro (azul) contrasta con la luz estelar de la galaxia albergadora (amarillo). Crédito: HST/NASA/ESA.

Las galaxias activas tienen nucleos que brillan tanto, que pueden llegar a ser más luminosos que las galaxias que los alberga. Estas galaxias activas sae caracterizan porque en sus núcleos ocurren procesos no-térmicos que liberan enormes cantidades de energía que parece provenir de una región muy pequeña y brillante situada en el corazón de la galaxia.

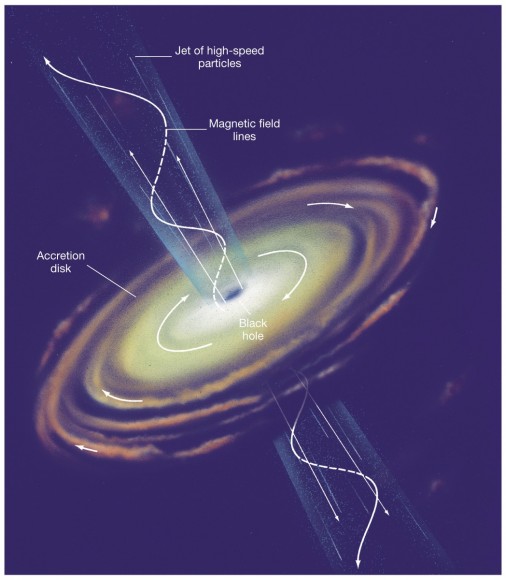

Son muchos los indicios que favorecen la hipótesis de que tales objetos son agujeros negros muy masivos (del orden de 100-1000 millones de veces la masa del Sol), con un tamaño de 1 minuto-luz o varios días-luz. La enorme fuerza gravitatoria que ejercen estos agujeros negros atrae el gas y las estrellas de las inmediaciones, formando el denominado disco de acrecimiento que está en rotación diferencial en torno al objeto masivo.

El modelo de “Agujero Negro + disco de acrecimiento” es el más satisfactorio hoy día para explicar las propiedades de los núcleos activos de galaxias. Un aspecto muy destacado en la morfología de las regiones compactas de los núcleos activos es la presencia de una intensa emisión radio en forma de chorros (los denominados Jets relativistas), que están formados por un plasma de partículas relativistas que emanan del núcleo central y viajan hasta distancias de varios megaparsec.

Jet relativista de un AGN. Creditos: Pearson Education, Inc., Upper Saddle River, New Jersey

Estos Jets son los aceleradores de partículas más energéticos del Cosmos. Sin embargo, todavía se desconoce como se generan, aceleran y coliman, si bien a través de simulaciones magnetohidrodinámicas se conoce que el campo magnético juega un papel fundamental en estos procesos. La técnica de mm-VLBI proporciona imágenes directas y nítidas de las regiones nucleares de las galaxias activas y acotan tanto el tamaño de los núcleos como la anchura de los chorros en la vecindad del agujero negro supermasivo. De hecho, las resoluciones angulares proporcionadas por mm-VLBI corresponderían a escalas lineales del orden de miles, centenares y decenas de Radios de Schwarzschild dependiendo de la distancia y la masa del agujero negro.

Existen algunos casos espectaculares, las imágenes obtenidas con mm-VLBI trazán los chorros relativistas a escalas del subparsec, cartografiando los motores centrales de las fuentes compactas con una resolución lineal tal que nos permite acercarnos a la última órbita estable en torno al agujero negro supermasivo. Podemos mencionar algunos casos espectaculares que han dejado asombrados a propios y extraños.

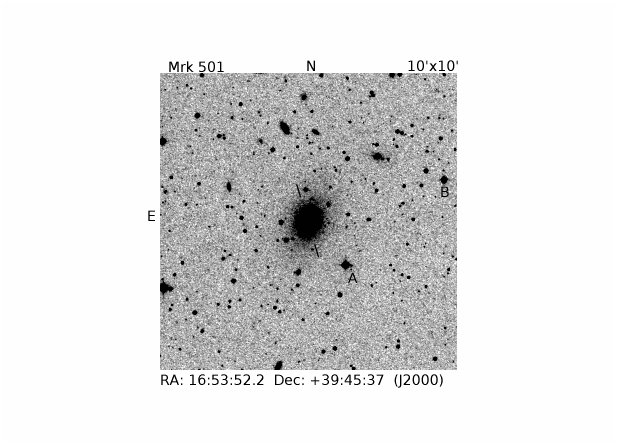

Mrk 501: Es una radiogalaxia situada a un corrimiento al rojo de z = 0.oo34. La masa del agujero negro central es del orden de mil millones de masas solares, por lo que el tamaño del radio de Schwarzschild es de 0,12 días-luz. Las observaciones con mm-VLBI a 86 GHz, muestra que su núcleo es muy compacto. El tamaño del núcleo de la radiofuente se puede establecer en 0,03 pc.

M87: La galaxia M87 está situada a la una distancia de 16,75 Mpc tiene un agujero negro situado en la región nuclear con una masa del orden de los 3.000 millones de masas solares, lo que implica que el tamaño del Radio de Schwarzschild es de 0,34 días-luz, Las observaciones interferométricas a 45 y 43 GHz han mostrado la presencia de un chorro relativista, en la que se observan dos fenómenos muy relevantes: i) en la base del jet, el ángulo de apertura es muy grande, lo que indicaría que el chorro vuelve a recolimarse a una cierta distancia del Agujero Negro central; ii) el chorro presenta fuerte emisión en sus bordes (fenómeno conocido como “edge brightening”, mientras que presenta emisión muy débil en su interior.

Todo esto lleva consigo una serie de implicaciones y parámetros de tipo técnicos que no son al caso destacar aquí.

Las observaciones de VLBI a longitudes de onda centimétricas han mostrado que SgrA, la radiofuente compacta en el centro de nuestra Galaxia, tiene un tamaño angular que escala con la longitud de onda al cuadrado, resultado que se interpreta físicamente considerando que la estructura que detectamos para SgrA no es su estructura intrínseca sino la imagen resultado de la interacción de su emisión de radio con sus electrones interestelares de la región interna de la Galaxia (lo que técnicamente se conoce como el “disco de scattering”. Las observaciones con mm-VLBI a 86 GHz han permitido determinar por primera vez el tamaño intrínseco de SgrA que ha resultado ser de 1,01 UNidades Astronómicas.

Considerando que SgrA se encuentra a una distancia de 8 Kpc y que su masa es de 4 millones de masas solares, este tamaño lineal corresponde a 12,6 Radios de Schwarzschild. Con todo esto, vengo a decir que estamos ya en la misma vecindad de los agujeros negros y, lo único que tenemos que despejar es la incognita que nos pueda crear el efecto del que nos habla la Relatividad General cuando establece que la raqdiación proveniente de una superficie esférica a una cierta distancia del agujero negro, sufriría un proceso de lente gravitacional amplificadora dandonos un tamaño mayor que el real. Así, cualquier objeto emisor con un tamaño intrínseco inferior a 1,5 Radios de Schwarzschild tendría un diámetro aparente mayor que 5,2 R de Schwarzschild.

¡Es todo tan complejo!

emilio silvera

Totales: 87.738.209

Totales: 87.738.209 Conectados: 47

Conectados: 47