Abr

13

¡La Naturaleza! ¿Quién puede pararla?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Catástrofes Naturales ~

Clasificado en Catástrofes Naturales ~

Comments (1)

Comments (1)

Hay fenómenos de la Naturaleza que, a nivel local, son devastodores y producen estragos materiales acompañados de pérdida de vidas. Hay zonas del mundo que son más propensas a sufrir estos fenómenos y, la gente que tienen allí sus habitats, padecen los efectos de estas imprevistas acciones naturales. Arriba podemos contemplar una vista aérea de Puerto Príncipe. Tras el terremoto de Haití en 2010, la ciudad quedó destruida.

Los terremotos

La inmensa mayoría de los terremotos se originan en los procesos geotectónicos a gran escala que crean, hacen chocar y hunden en las zonas de subducción, las placas oceánicas. No menos del 95 por ciento de todos los terremotos se concentran a lo largo de los bordes de las placas y cerca de nueve décimas partes de éstos se localizan en el cinturón Circum-Pacífico, donde las placas, que son relativamente rápidas, están colisionando o deslizándose contra las placas continentales más pesadas. La mayor parte del resto de terremotos están asociados a los puntos calientes, generalmente señalados por volcanes en actividad.

Cuando el epicentro se produce en la costa, las consecuencias también pueden ser devastadoras al crearse un Tsunami que arrasará la ciudad

En conjunto, los terremotos representan una fracción muy pequeña de la energía liberada por los procesos tectónicos de la Tierra. Desde 1.900, en los mayores terremotos se han liberado anualmente una energía media cercana a los 450 PJ, que no supone más del 0’03 por ciento del flujo total de calor terrestre. La liberación anual de energía sísmica de todos los terremotos que se han medido alcanza unos 300 GW, que sumada a la energía de esfuerzo invertida en deformaciones irreversibles y al calor generado por fricción a lo largo de las fallas, daría un total próximo a 1 TW, lo cual representa solamente un 2’5 por ciento del flujo de calor global.

Pero este recuento total nos dice poco de la liberación de energía y de la potencia de un solo terremoto. Aunque la mayoría son tan débiles que pasan desapercibidos para las personas, cada año se producen terremotos terriblemente destructivos, que durante el siglo XX han causado más víctimas mortales que las inundaciones, ciclones y erupciones volcánicas juntas.

En el sur de la Península Ibérica se encuentra sobre un área de subducción entre la placa Euroasiática y la placa Africana, estando en medio la placa del Mar de Alborán, concentrando el mayor índice de terremotos. Además, concretamente las zonas de mayor riesgo son las provincias de Málaga, Almería, Granada y Murcia aunque también en el Pirineo, entre Navarra y Huesca.

Los terremotos más devastadores de nuestra Península fue el de Lisboa en 1755. No obstante, en España han habido muchos otros seísmos de gran importancia: En Málaga, Arenas del Rey, Sevilla, Jaén, Grabada Y Huelva y, el último de Lorca en 2011.

La energía de estos terremotos se puede calcular a partir de la energía cinética de las ondas sísmicas generadas por la energía liberada en el esfuerzo de la deformación del suelo, pero rara vez se realizan estos cálculos directamente. Lo más frecuente es deducir la energía del terremoto a partir de la medida de su magnitud o de su momento. La medida típica de la magnitud de un terremoto fue establecida por Charles Richter en 1.935, como el logaritmo decimal de la máxima amplitud (en micrómetros) registrada con un sismómetro de tensión estándar (Word-Anderson) a 100 Km de distancia del epicentro del temblor.

Desde que en 1.942, Richter publicó la primera correlación entre la magnitud de energía sísmica liberada en un temblor, su trabajo (como por otra parte, es de lógica) ha sufrido numerosas modificaciones. La conversión sigue la forma estándar log10 E = a + bM, donde E es la energía liberada en forma de ondas sísmicas (en ergios), M es la magnitud de Richter, y a y b son los coeficientes empíricos que varían entre 6’1 – 13’5 y 1’2 – 2 respectivamente. Otras conversiones alternativas permiten obtener la energía liberada a partir del momento del terremoto, que se define como el producto de la rigidez por el desplazamiento medio de la falla y por la superficie media desplazada.

Los mayores terremotos registrados tienen magnitudes Richter comprendidas entre 8 y 8’9, con liberación de energía sísmica entre 48 PJ y 1’41 EJ. Todos hemos oído en alguna ocasión algún comentario sobre el terremoto de San Francisco de 1.906, donde los cálculos basados en tres métodos utilizados en el esfuerzo dieron valores tan distintos como 9’40 y 175 PJ, y con método cinético se obtuvo 2’5 PJ.

Los terremotos, por ser a la vez de breve duración y estar limitados espacialmente, desarrollan potencias y densidades de potencia extraordinariamente altas. La potencia de un temblor de magnitud 8 en la escala de Richter que durase solamente medio minuto, sería de 1’6 PW, y si toda esta potencia estuviera repartida uniformemente en un área de 80 Km de radio, la densidad de potencia sería tan elevada como 80 KW/m2.

Obviamente, tales flujos pueden ser terriblemente destructivos, pero ni las pérdidas de vidas humanas ni los daños materiales que ocasionan los temblores están correlacionados de una manera sencilla con la energía liberada. La densidad de población o de industrias, así como la calidad de las construcciones, constituyen un factor muchísimo más importante para determinar la mortandad o el impacto económico de los mismo. Por ejemplo, el coste en vidas humanas del gran terremoto japonés que en 1.923 arrasó Tokio, donde existía una alta densidad de casas de madera, fue unas 200 veces más elevado que el terremoto de San Francisco de 1.906 en el que se liberó cuatro veces más energía. También aquí salen perdiendo, como siempre, los pobres.

Por otra parte, no podemos olvidar que la superficie del globo terrestre está dominada por las aguas, y los seres humanos viven en la Tierra seca. Sin embargo, vienen los tsunamis. La predicción de estas catástrofes continúa siendo imposible. Se tienen datos, se localizan las zonas de más frecuencia, y conocen las fallas de desgarre y las inversas, los ciclos, etc., pero el conocimiento es aún escaso para prevenir dónde y cuándo se producirán temblores.

Las olas sísmicas que se pueden provocar por terremotos submarinos se propagan durante miles de kilómetros a velocidades de 550 – 720 Km/h, perdiendo en su viaje muy poca potencia. Estas olas, prácticamente invisibles en el mar, se levantan hasta una altura de 10 metros en agua poco profundas y pueden llegar a golpear las costas con intensidades de potencia en superficie vertical de hasta 200 – 500 MW/m2, y con impactos horizontales de intensidad y potencia entre 10 – 100 MW/m2. Son, pues, mucho más potentes que los ciclones tropicales y causan grandes daños tanto materiales como en pérdida de vidas humanas.

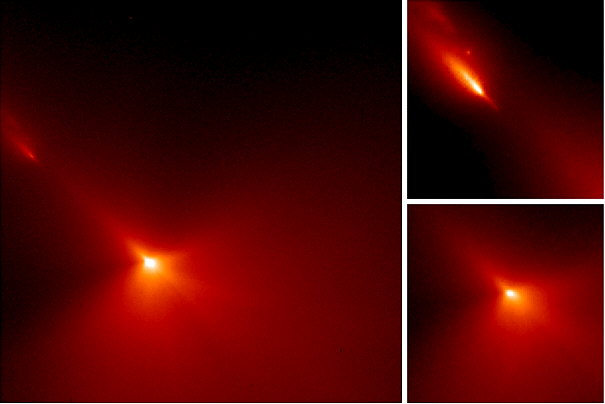

La NASA proporcionó esta asombrosa imagen del Volcan Sarychev en las Islas Kuriles, Rusia.

Los volcanes

La unívoca asociación de los volcanes activos con las zonas de subducción de las grandes placas tectónicas permite localizar casi todas las erupciones recientes alrededor del océano Pacífico y, sobre todo, en América central, Sudamérica, Filipinas, Japón y Kamchatka. Una categoría menos común incluye los volcanes asociados a los puntos calientes, donde las placas tectónicas se ven atravesadas por flujos magmáticos procedentes del manto, a la cual pertenecen los volcanes de Hawai y África central.

Las erupciones históricas más conocidas son las Théra, en Grecia (alrededor del 1.500 a. C.), del Vesubio en Italia (79 a. C.) y del Cracatoa (1.883 d. C.) en Indonesia, y el del monte St. Helens en el estado de Washington en 1.980. Éste último caso es la erupción volcánica mejor estudiada hasta la fecha. Se conoce, no solamente el volumen de los depósitos expulsados (0’18 Km3) y de lava (0’5 Km3), sino también un detallado desglose de la energía relacionada con la erupción.

El Servicio Nacional de Geología y Minería de Chile (SERNAGEOMIN) a través de su Observatorio Volcanológico de los Andes del Sur (OVDAS), informó hace instantes que “observaciones realizadas por Los flujos de calor dominan en el proceso: la energía térmica de los productos expulsados, las avalanchas, los chorros de agua, los flujos piroplásticos y las nubes de ceniza, dan un total de 1’66 EJ, cerca de veinte veces la energía cinética total de la erupción.

El 18 de mayo de 1.980, el volcán del monte St. Helens desarrolló, durante nueve horas de erupción, una energía total de 1’7 EJ, lo que equivale a una potencia media de 52 TW, es decir, unas cinco veces el consumo anual mundial de energía en el sector primario en los primeros años noventa. Aún más potentes fueron las de Bezymyannyi, Kamchatka, en 1.956 (3’9 EJ), y la de Sakurajima, Japón, en 1.914 (4’6 EJ). La mayor erupción que tuvo lugar en el siglo XIX fue la del volcán Tambora, en 1.815, que liberó más de 80 EJ de energía (basado en los depósitos de cenizas) que es un orden de magnitud superior a los anteriormente mencionados. Pero incluso la más potente erupción conocida es irrelevante comparada con las sucedieron hace varios vientos de miles de años, y que a su vez, son pequeñas comparadas con las erupciones magmáticas más antiguas.

Entre las cerca de diez calderas jóvenes, enormes cráteres formados en las gigantescas erupciones que se produjeron en el último millón de años, están la de Yellowstone (formada hace 600.000 años, con un diámetro de 70 Km y 1.000 m3 de material expulsado, principalmente piedra pómez y cenizas), y la de Toba (situada en el noroeste de Sumatra, formada hace 75.000 años, de casi 100 Km de anchura y con más de 2.000 m3 de material eyectado).

Un prolongado periodo de erupciones volcánicas que empezó hace 66 millones de años – varios cientos de millones de años de cataclismos que lanzaron a la atmósfera enormes cantidades de cenizas y produjeron dos millones de Km3 de lava, creando la inmensa Decan Traps de la India – parece ser la causa, al menos tan plausible como la colisión de la Tierra con un asteroide, de la masiva extinción que se produjo en la frontera del cretácico y el terciario.

Las cenizas de la erupción del monte St. Helens se elevaron a 20 Kms., y, otras incluso más

Aunque las erupciones históricas han supuesto una considerable pérdida en vidas humanas (cerca de 250.000 desde 1.700), pérdidas materiales enormes y han sido una de las causas más importantes de los cambios climáticos temporales, ninguna de estas consecuencias está claramente correlacionada con la energía total liberada en las mismas. Las emisiones térmicas son casi siempre dominantes, de una a tres órdenes de magnitud mayores que todos los demás flujos de energía, y se dividen en varias clases de flujos diferentes. En algunas erupciones, la mayor parte de la energía térmica liberada está asociada con la emisión de nubes de cenizas que se elevan hasta la estratosfera; así las cenizas de la erupción del monte St. Helens se elevaron a 20 Km, y otras hasta los 30 Km, e incluso más, con cambios atmosféricos locales y espectaculares puestas de Sol y uno o dos años con temperaturas más bajas de las habituales en algunas regiones. En Nueva Inglaterra, por ejemplo, no hubo verano en 1.816.

En otras erupciones, la mayor parte de la energía térmica es transportada por las corrientes piroclásticas. Estas corrientes se forman por explosión y están compuestas por partículas volcánicas, cuyos tamaños varían entre los μm y varios metros, y gases calientes. Alcanzan temperaturas cercanas a los 1.000º C, se propagan a velocidades de hasta 300 m/s y se extienden a distancias de cientos de kilómetros del lugar de origen.

En la erupción del monte Pelée, isla de Martinica en 1.902, estas nubes incandescentes acabaron con la vida de 28.000 personas. En las erupciones de los volcanes hawaianos, el principal flujo de calor está predominantemente asociado a la emisión de lavas que se desplazan lentamente; así, en la erupción del Mauna Loa en 1.950, con una energía liberada de magnitud parecida a la del monte St. Helens, no se produjeron desplazamientos de lodos, avalanchas ni nubes de cenizas.

Siendo espectaculares y a veces devastadoras, las erupciones volcánicas representan una fracción muy pequeña de la energía térmica que mueve la geotectónica terrestre. Suponiendo que en total aflora 1 Km3/año de lava continental y que las erupciones oceánicas contribuyen con otros 4 Km3/año, el calor global perdido anualmente está cerca de los 800 GW, lo cual representa solamente el 2 por ciento del flujo geotérmico terrestre global. La grandiosidad de estos fenómenos está enmascarada en ámbitos de límites regionales, que a nivel global son casi insignificantes.

Mientras que en uno de estos lugares la catástrofe se avecina, en el otro, la vida transcurre dentro de lo cotidiano, nada enturbia el desarrollo normal de nuestras vidas.

Todo esto nos viene a corroborar que, cuando la Naturaleza se despereza… ¡Nosotros a temblar! Son fuerzas y mecanismos de los que se vale el planeta para reciclarse y recomponerse, es la destrucción de la creación, toda vez que, a partir de estas inmensas catástrofes, siempre comienzan y surgen nuevas formas de vida allí donde todo era debastación.

emilio silvera

Totales: 87.819.887

Totales: 87.819.887 Conectados: 44

Conectados: 44