Feb

10

¿Qué habrá más allá del Modeo Estándar de la Física de Partículas?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Intentaremos viajar más allá del Modelo Estándar

Para entrar en materia

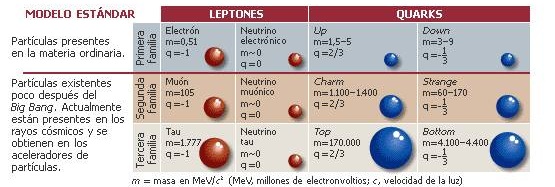

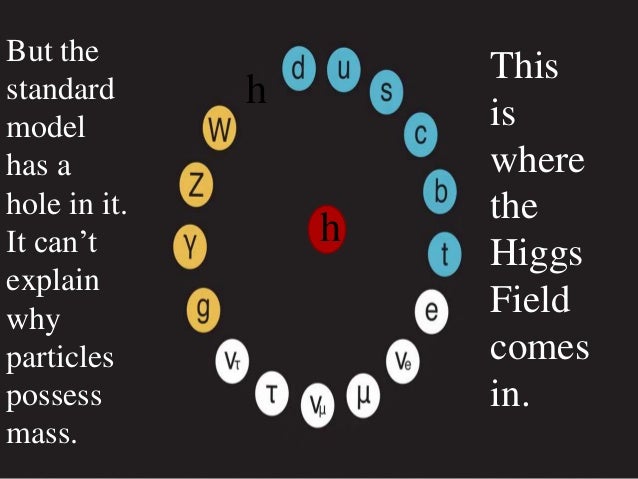

“Inicialmente, se presenta, de modo simplificado, el Modelo Estándar como una teoría sofisticada que identifica las partículas elementales y sus interacciones. Después, en el ámbito de esa teoría, se enfocan aspectos – el vacuo no es vacío; partículas desnudas y vestidas; materia oscura y viento oscuro; materia y antimateria; el campo y el bosón de Higgs; neutrinos oscilantes – que pueden ser motivadores desde el punto de vista de la enseñanza y del aprendizaje de la Física. Finalmente, se discute la probable superación de esa teoría por otra más completa.”

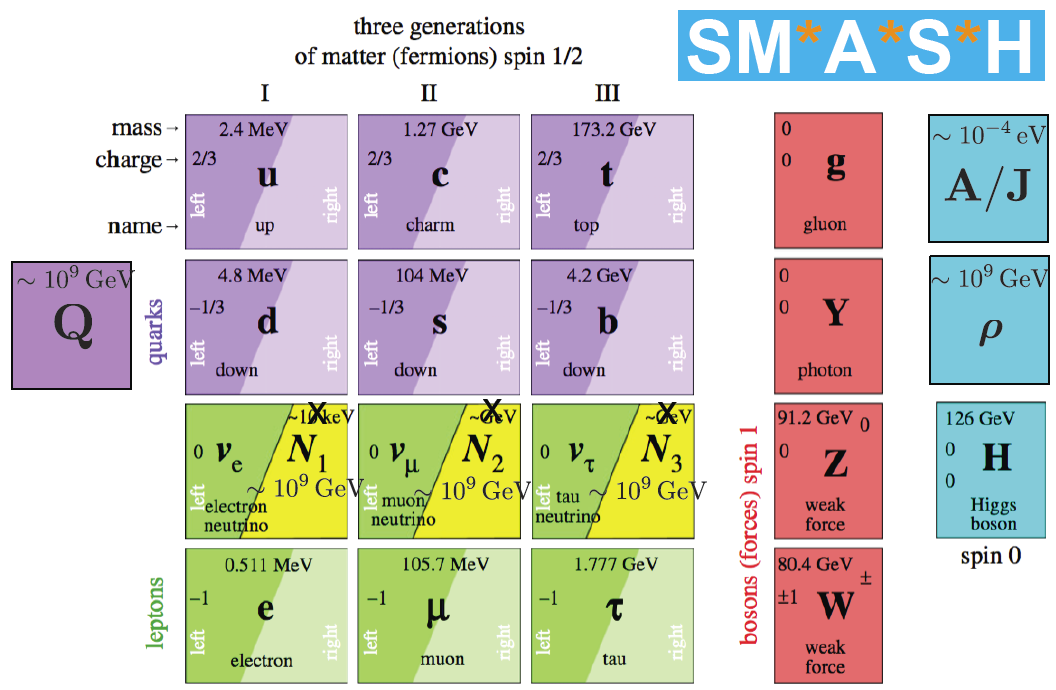

“… el Modelo Estándar es, en la historia, la más sofisticada teoría matemática sobre la naturaleza. A pesar de la palabra “modelo” en su nombre, el Modelo Estándar es una teoría comprensiva que identifica las partículas básicas y especifica cómo interactúan. Todo lo que pasa en nuestro mundo (excepto los efectos de la gravedad) es resultado de las partículas del Modelo Estándar interactuando de acuerdo con sus reglas y ecuaciones.”

La Física actual busca una teoría más amplia que el modelo estándar . Una teoría que dé una descripción completa, unificada y consistente de la estructura fundamental del universo. ¿Será la compleja Teoría de cuerdas, que integra también la interacción gravitacional?

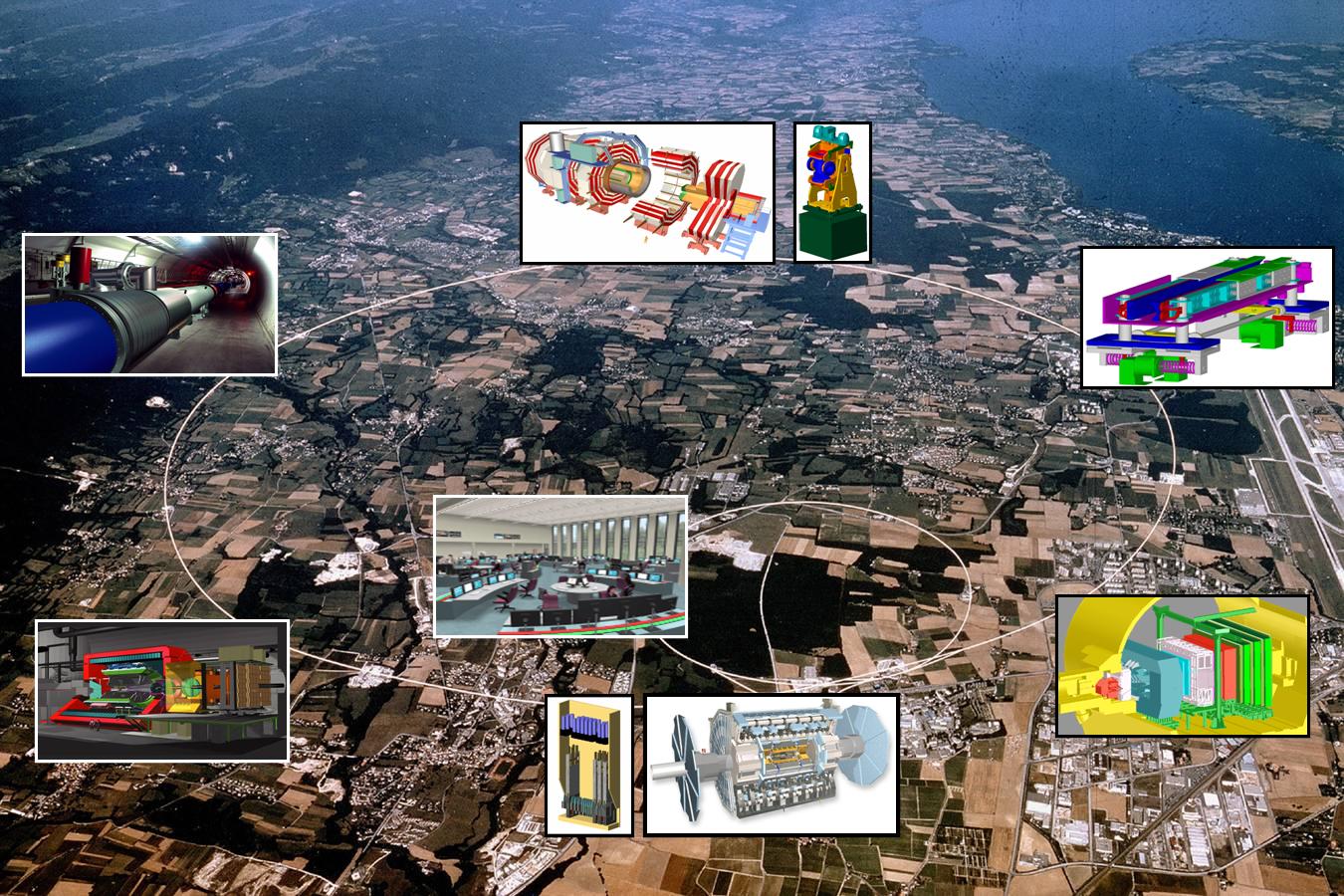

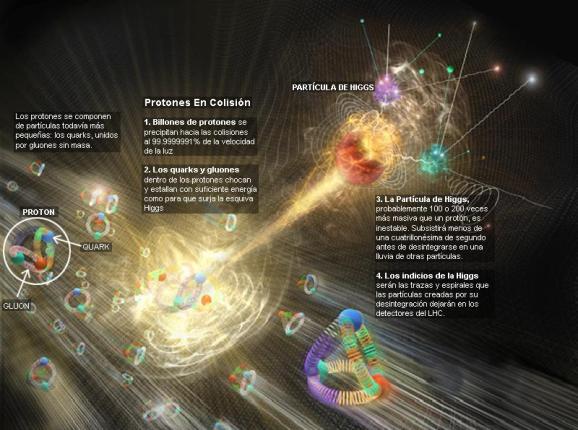

El modelo estándar es una poderosa herramienta pero no cumple todas las expectativas; no es un modelo perfecto. En primer lugar, podríamos empezar por criticar que el modelo tiene casi veinte constantes que no se pueden calcular. Desde luego, se han sugerido numerosas ideas para explicar el origen de todos estos parámetros o números inexplicables y sus valores, pero el problema de todas estas teorías es que los argumentos que dan nunca han sido enteramente convincentes. ¿Por qué se iba a preocupar la naturaleza de una fórmula mágica si en ausencia de tal fórmula no hubiera contradicciones? Lo que realmente necesitamos es algún principio fundamental nuevo, tal como el principio de la relatividad, pero no queremos abandonar todos los demás principios que ya conocemos. Ésos, después de todo, han sido enormemente útiles en el descubrimiento del modelo estándar. El mejor lugar para buscar un nuevo principio es precisamente donde se encuentran los puntos débiles de la presente teoría y, construimos máquinas como el LHC para que nos diga lo que no sabemos.

Una regla universal en la física de partículas es que para partículas con energías cada vez mayores, los efectos de las colisiones están determinados por estructuras cada vez más pequeñas en el espacio y en el tiempo. El modelo estándar es una construcción matemática que predice sin ambigüedad cómo debe ser el mundo de las estructuras aún más pequeñas. Pero existen varias razones para sospechar que sus predicciones pueden, finalmente (cuando podamos emplear más energía en un nivel más alto), resultar equivocadas.

Vistas a través del microscopio, las constantes de la naturaleza parecen estar cuidadosamente ajustadas sin ninguna otra razón aparente que hacer que las partículas parezcan lo que son. Hay algo muy erróneo aquí. Desde un punto de vista matemático no hay nada que objetar, pero la credibilidad del modelo estándar se desploma cuando se mira a escalas de tiempo y longitud extremadamente pequeñas, o lo que es lo mismo, si calculamos lo que pasaría cuando las partículas colisionan con energías extremadamente altas. ¿Y por qué debería ser el modelo válido hasta aquí? Podrían existir muchas clases de partículas súper pesadas que no han nacido porque se necesitan energías aún inalcanzables. ¿Dónde está la partícula de Higgs? ¿Cómo se esconde de nosotros el gravitón?

Parece que el Modelo estándar no admite la cuarta fuerza y tendremos que buscar más profundamente, en otras teorías que nos hablen y describan además de las partículas conocidas de otras nuevas que están por nacer y que no excluya la Gravedad. Ese es el Modelo que necesitamos para conocer mejor la Naturaleza.

Claro que las cosas no son tan sencilla y si deseamos evitar la necesidad de un delicado ajuste de las constantes de la naturaleza, creamos un nuevo problema: ¿cómo podemos modificar el modelo estándar de tal manera que el ajuste fino no sea necesario? Está claro que las modificaciones son necesarias, lo que implica que muy probablemente haya un límite más allá del cual el modelo tal como está deja de ser válido. El modelo estándar no será nada más que una aproximación matemática que hemos sido capaces de crear, de forma que todos los fenómenos que hemos observado hasta el presente están reflejados en él, pero cada vez que se pone en marcha un aparato más poderoso, tenemos que estar dispuestos a admitir que puedan ser necesarias algunas modificaciones del modelo para incluir nuevos datos que antes ignorábamos.

Más allá del modelo estándar habrá otras respuestas que nos lleven a poder hacer otras preguntas que en este momento, no sabemos ni plantear por falta de conocimientos. Si no conociéramos que los protones están formados por Quarks, ¿cómo nos podríamos preguntar si habrá algo más allá de los Quarks?

El gobierno de Estados Unidos, después de llevar gastados miles de millones de dólares, suspendió la construcción del supercolisionador superconductor de partículas asestando un duro golpe a la física de altas energías, y se esfumó la oportunidad para obtener nuevos datos de vital importancia para el avance de este modelo, que de momento es lo mejor que tenemos.

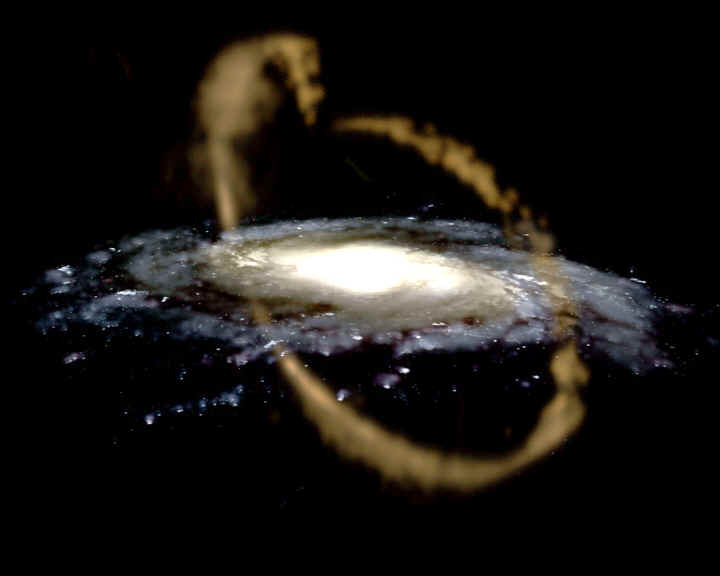

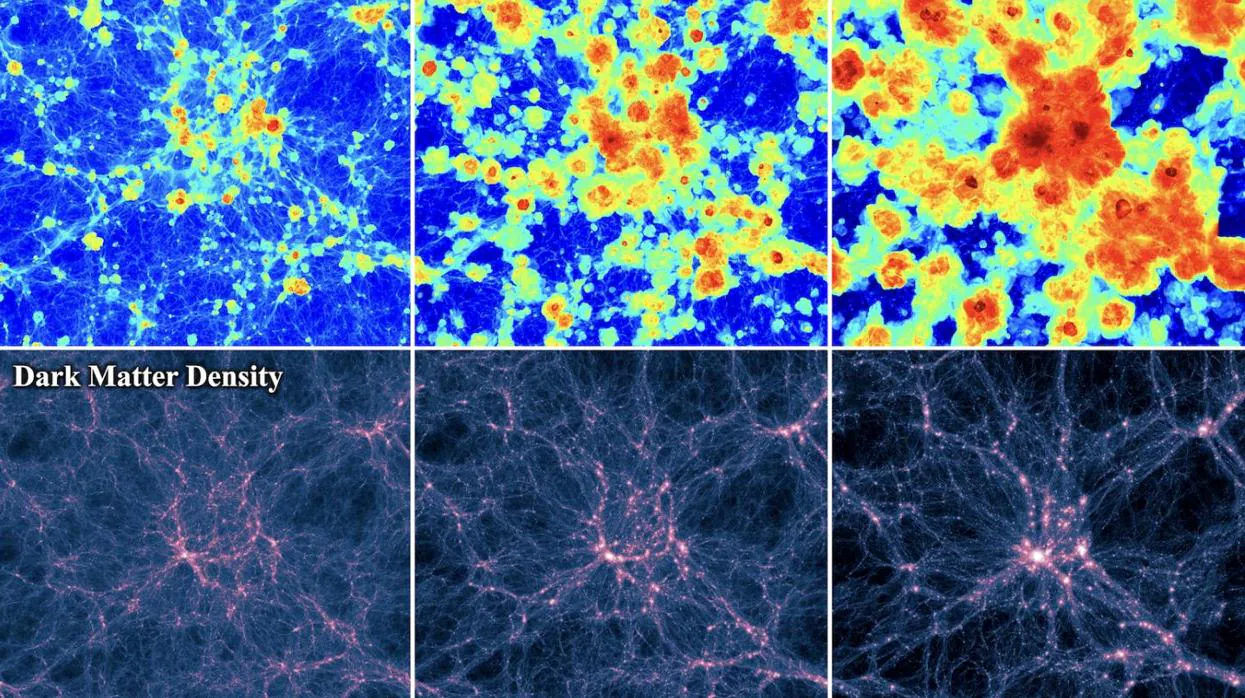

Se han estado inventando nuevas ideas, como la supersimetría y el technicolor. Los astrofísicos estarán interesados en tales ideas porque predicen una gran cantidad de nuevas partículas superpesadas, y también varios tipos de partículas que interaccionan ultradébilmente, los technipiones. Éstas podrían ser las WIMP’s (Weakly Interacting Massive Particles, o Partículas Masivas Débilmente Interactivas) que pueblan los huecos entre las galaxias, y serían así las responsables de la masa perdida que los astrofísicos siguen buscando y llaman “materia oscura”.

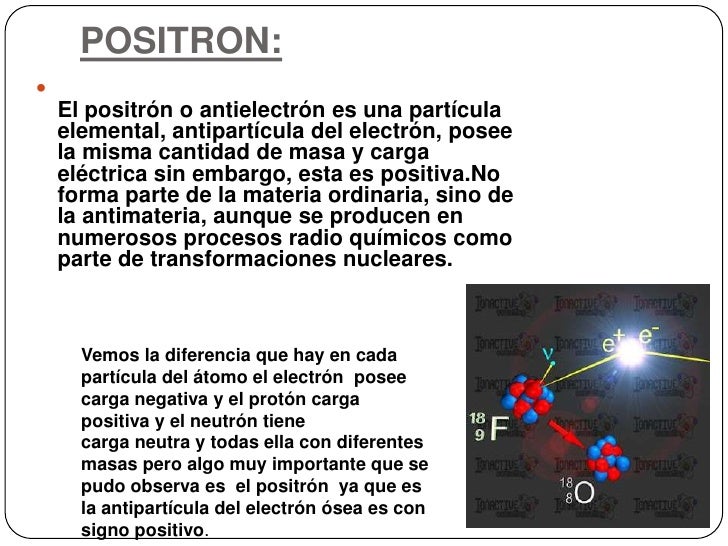

Que aparezcan “cosas” nuevas y además, imaginarlas antes, no es fácil. Recordemos cómo Paul Dirac se sintió muy incómodo cuando en 1931 dedujo, a partir de su ecuación del electrón, que debería existir una partícula con carga eléctrica opuesta. Esa partícula no había sido descubierta y le daba reparo perturbar la paz reinante en la comunidad científica con una idea tan revolucionaria, así que disfrazó un poco la noticia: “Quizá esta partícula cargada positivamente, tan extraña, sea simplemente el protón”, sugirió. Cuando poco después se identificó la auténtica antipartícula del electrón (el positrón) se sorprendió tanto que exclamó: “¡Mi ecuación es más inteligente que su inventor!”. Este último comentario es para poner un ejemplo de cómo los físicos trabajan y buscan caminos matemáticos mediante ecuaciones de las que, en cualquier momento (si están bien planteadas), surgen nuevas ideas y descubrimientos que ni se podían pensar. Así pasó también con las ecuaciones de Einstein de la relatividad general, donde Schwarzschild dedujo la existencia de los agujeros negros.

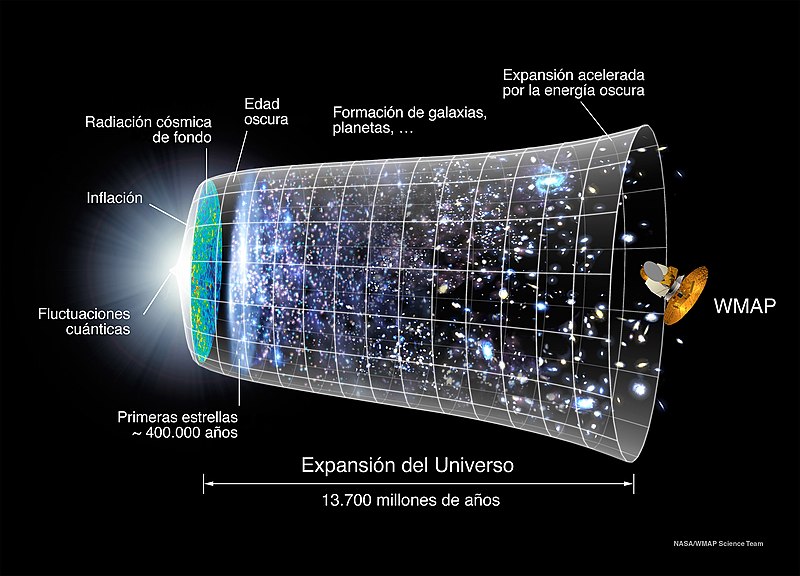

Se piensa que al principio del comienzo del tiempo, cuando surgió el Big Bang, las energías eran tan altas que allí reinaba la simetría total; sólo había una sola fuerza que todo lo englobaba. Más tarde, a medida que el universo se fue expandiendo y enfriando, surgieron las cuatro fuerzas que ahora conocemos y que todo lo rigen. Tenemos los medios, en los supercolisionadores de partículas, para viajar comenzando por 1.000 MeV, hasta finalizar en cerca de 1019 MeV, que corresponde a una escala de longitudes de aproximadamente 10–30 cm. Howard Georgi, Helen Quinn y Steven Weinberg descubrieron que ésta es la región donde las tres constantes de acoplamiento gauge se hacen iguales (U(1), SU(2) y SU(3)); resultan ser lo mismo. ¿Es una coincidencia que las tres se hagan iguales simultáneamente? ¿Es también una coincidencia que esto suceda precisamente en esa escala de longitud? Faltan sólo tres ceros más para alcanzar un punto de retorno. Howard Georgi y Sheldon Glashow descubrieron un modelo genuinamente unificado en el dominio de energías de 1019 MeV tal que, cuando se regresa de allí, espontáneamente surgen las tres fuerzas gauge tal como las conocemos. De hecho, ellos encontraron el modelo; la fórmula sería SU(5), que significa que el multiplote más pequeño debe tener cinco miembros.

Materia y Energía Oscura… Un Misterio…Sin resolver.

Y, a todo esto, ¿dónde está esa energía oculta? ¿Y donde la materia? Podemos suponer que la primera materia que se creo en el Universo fue la que llamamos (algún nom,bre había que ponerle) “Materia Oscura”, esa clase de Ilem o sustancia primera del Universo que mejor sería llamarla invisible, ya que, de no ser así, difícil sería explicar cómo se pudieron formar las primeras estrellas y galaxias de nuestro Universo, ¿dónde está el origen de la fuerza de Gravedad que lo hizo posible, sino en esa materia escondida?

¡Lo dicho! Necesitamos saber, y, deseo que de una vez por todas, se cumpla lo que dejó dicho Hilbert en su tumba de Gotinga (Alemania): “Tenemos que saber, ¡sabremos!. Pero…

¡Que sea pronto!

Emilio Silvera Vázquez

Feb

6

¿Cuerdas? ¿Otras dimensiones? ¡El Universo!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

En la teoría de cuerdas, la fuerza gravitatoria se representa mediante el intercambio de cuerdas cerradas, que barren tubos en el Espacio-Tiempo. Incluso si usamos una serie infinita de diagramas con un gran número de agujeros, nunca aparecen infinitos en la teoría, dándonos una teoría de Gravedad Cuántica.

“La Teoría de Cuerdas propone que el espacio-tiempo tiene muchas más dimensiones de las que podemos percibir (once, para ser exactos). Por eso, las “cuerdas” fundamentales pueden vibrar de muchos modos en todas estas dimensiones.”

Estas ecuaciones son la base de la formulación matemática de la Relatividad General, y, cuando se calcularon por primera vez las ligaduras que impone la cuerda sobre el Espacio-Tiempo, los físicos quedaron sorprendidos al descubrir que las ecuaciones de Einstein emergían de la cuerda.

Esto era notable; sin suponer ninguna de las ecuaciones de Einstein, los físicos asombrados descubrían que ellas emergían de la teoría de cuerdas como por encanto. Las ecuaciones de Einstein ya no resultaban ser fundamentales; podían derivarse de la teoría de cuerdas de la que formaban parte. Einstein pensaba que la geometría por sí sola explicaría un día todas las propiedades de la materia; para él la materia era sólo un nudo o vibración del Espacio-Tiempo, ni más ni menos.

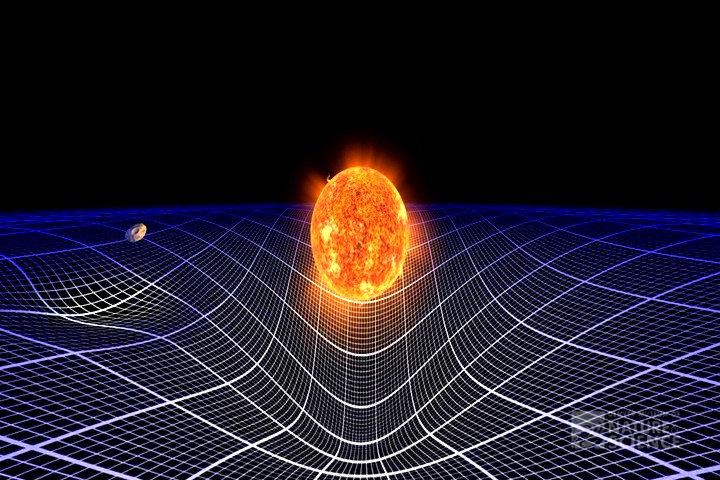

El Espacio Tiempo se expande y vibra

Los físicos cuánticos, por el contrario, pensaban de manera distinta a la de Einstein, es decir, que el tensor métrico de Riemann-Einstein podía convertirse en un gravitón, el paquete discreto de energía que transporta la fuerza gravitatoria y, en este preciso punto, aparece la cuerda, que según todos los indicios puede ser el “eslabón perdido” entre la mecánica cuántica y la relatividad general, el que permita la unificación entre ambas teorías de manera natural y complete el circulo de una teoría de “todo” que explique el universo, la materia y el espacio-tiempo con todas sus constantes universales y las fuerzas de la naturaleza que lo rigen todo.

Feb

4

Teorías, masas, partículas, dimensiones…

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

Una nos habla del Cosmos y de como el espacio se curva ante la presencia de masas, la otra, nos habla de funciones de ondas, entrelazamientos cuánticos, de diminutos objetos que conforman la materia y hacen posibles los átomos y la vida.

Entre los teóricos, el casamiento de la relatividad general y la teoría cuántica es el problema central de la física moderna. A los esfuerzos teóricos que se realizan con ese propósito se les llama “super-gravedad“, “súper-simetría“, “super-cuerdas” “teoría M” o, en último caso, “teoría de todo o gran teoría unificada“.

Ahí tenemos unas matemáticas exóticas que ponen de punta hasta los pelos de las cejas de algunos de los mejores matemáticos del mundo (¿y Perelman? ¿Por qué nos se ha implicado?). Hablan de 10, 11 y 26 dimensiones, siempre, todas ellas espaciales menos una que es la temporal. Vivimos en cuatro: tres de espacio (este-oeste, norte-sur y arriba-abajo) y una temporal. No podemos, ni sabemos o no es posible instruir, en nuestro cerebro (también tridimensional), ver más dimensiones. Pero llegaron Kaluza y Klein y compactaron, en la longitud de Planck las dimensiones que no podíamos ver.

¡Problema solucionado!

Unidades de Planck

La longitud de Planck (ℓP) u hodón (término acuñado en 1926 por Robert Lévi) es la distancia o escala de longitud por debajo de la cual se espera que el espacio deje de tener una geometría clásica. Una medida inferior previsiblemente no puede ser tratada adecuadamente en los modelos de física actuales debido a la aparición de efectos de Gravedad Cuántica.

¿Quién puede ir a la longitud de Planck para verla? A distancias comparables con la longitud de Planck, se cree que están sucediendo cosas muy curiosas que rebasan ampliamente los límites de nuestra imaginación. A diferencia de la filosofía reduccionista que propone que lo más complejo está elaborado -axiomáticamente- a partir de lo más elemental, lo que está sucediendo en la escala de Planck no parece tener nada de elemental o sencillo. Se cree que a esta escala la continuidad del espacio-tiempo en vez de ir marchando sincronizadamente al parejo con lo que vemos en el macrocosmos de hecho stá variando a grado tal que a nivel ultra-microscópico el tiempo no sólo avanza o se detiene aleatoriamente sino inclusive marcha hacia atrás, una especie de verdadera máquina del tiempo. Las limitaciones de nuestros conocimientos sobre las rarezas que puedan estar ocurriendo en esta escala en el orden de los 10-35 metros, la longitud de Planck, ha llevado a la proposición de modelos tan imaginativos y tan exóticos como la teoría de la espuma cuántica que supuestamente veríamos aún en la ausencia de materia-energía si fuésemos ampliando sucesivamente una porción del espacio-tiempo plano.

No pocos han tratado de encontrar la puerta para acceder a esas dimensiones extras que pregonan algunas teorías. Sin embargo, hasta el momento, nadie ha dado con el camino para poder llegar a ellas y traspasarlas para ver, lo que pueda existir más allá de las dimensiones que rigen en nuestro propio mundo.

La puerta de las dimensiones más altas quedó abierta y, a los teóricos, se les regaló una herramienta maravillosa. En el Hiperespacio, todo es posible. Hasta el matrimonio de la relatividad general y la mecánica cuántica, allí si es posible encontrar esa soñada teoría de la Gravedad cuántica.

Así que, los teóricos, se han embarcado a la búsqueda de un objetivo audaz: buscan una teoría que describa la simplicidad primigenia que reinaba en el intenso calor del universo en sus primeros tiempos, una teoría carente de parámetros, donde estén presentes todas las respuestas. Todo debe ser contestado a partir de una ecuación básica.

¿Dónde radica el problema?

El problema está en que la única teoría candidata no tiene conexión directa con el mundo de la observación, o no lo tiene todavía si queremos expresarnos con propiedad. La energía necesaria para ello, no la tiene ni el LHC que ha trabajado a 14 TeV, y, necesitaria disponer de la energía de Planck, es decir 1019 GeV, y dicha energía, queda lejos, muy lejos de nuestro alcance en el presente y, si alguna vez podemos disponer de ella esrtaría situada muy lejos en el futuro.

La verdad es que, la teoría que ahora tenemos, el Modelo Estándar, concuerda de manera exacta con todos los datos a bajas energías y contesta cosas sin sentido a altas energías.

¡Necesitamos algo más avanzado!

Cada partícula tiene encomendada una misión, la de Higgs, ya sabemos lo que dicen por ahí.es la dadora de masa a las demás partículas (cosa que -particularmente- no tengo nada claro).

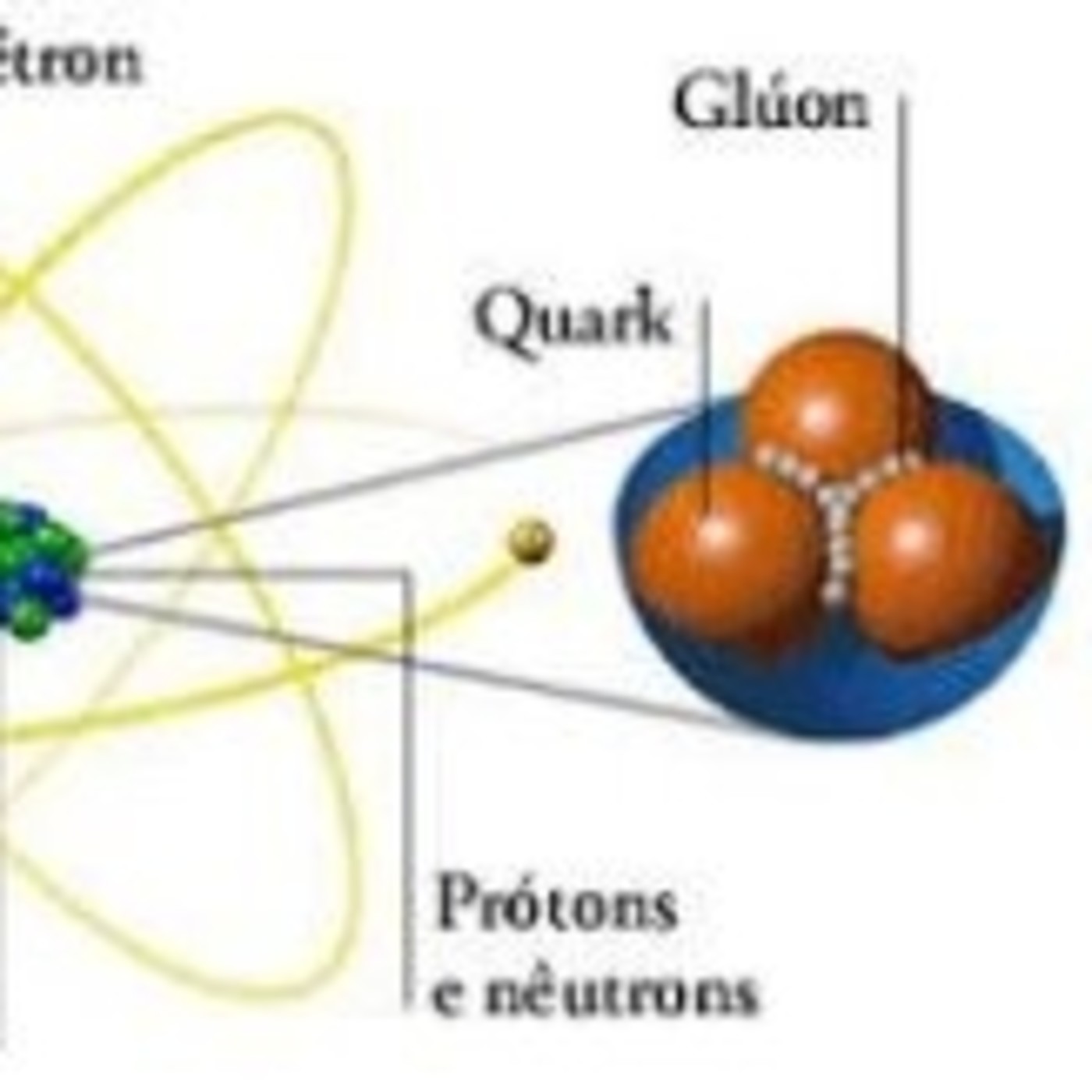

Se ha dicho que la función de la partícula de Higgs es la de dar masa a las Cuando su autor lanzó la idea al mundo, resultó además de nueva muy extraña. El secreto de todo radica en conseguir la simplicidad: el átomo resulto ser complejo lleno de esas infinitesimales partículas electromagnéticas que bautizamos con el nombre de electrones, resultó que tenía un núcleo que contenía, a pesar de ser tan pequeño, casi toda la masa del átomo. El núcleo, tan pequeño, estaba compuesto de otros objetos más pequeños aún, los quarks que estaban instalados en nubes de otras partículas llamadas gluones y, ahora, queremos continuar profundizando, sospechamos, que después de los quarks puede haber algo más.

Bueno, la idea nueva que surgió es que el espacio entero contiene un campo, el campo de Higgs, que impregna el vacío y es el mismo en todas partes. Es decir, que si miramos a las estrellas en una noche clara estamos mirando el campo de Higgs. Las partículas influidas por este campo, toman masa. Esto no es por sí mismo destacable, pues las partículas pueden tomar energía de los campos (gauge) de los que hemos comentado, del campo gravitatorio o del electromagnético. Si llevamos un bloque de plomo a lo alto de la Torre Eiffel, el bloque adquiriría energía potencial a causa de la alteración de su posición en el campo gravitatorio de la Tierra.

Masa y energía son dos aspectos de la misma cosa

Cuando los físicos hablan de la belleza de algunas ecuaciones, se refieren a las que, como ésta, dicen mucho con muy pocos caracteres. De hecho, puede que ésta sea la ecuación más famosa conocida en nuestro mundo.

Como E=mc2, ese aumento de la energía potencial equivale a un aumento de la masa, en este caso la masa del Sistema Tierra-bloque de plomo. Aquí hemos de añadirle amablemente un poco de complejidad a la venerable ecuación de Einstein. La masa, m, tiene en realidad dos partes. Una es la masa en reposo, m0, la que se mide en el laboratorio cuando la partícula está en reposo. La partícula adquiere la otra parte de la masa en virtud de su movimiento (como los protones en el acelerador de partículas, o los muones, que aumentan varias veces su masa cuando son lanzados a velocidades cercanas a c) o en virtud de su energía potencial de campo. Vemos una dinámica similar en los núcleos atómicos. Por ejemplo, si separamos el protón y el neutrón que componen un núcleo de deuterio, la suma de las masas aumenta.

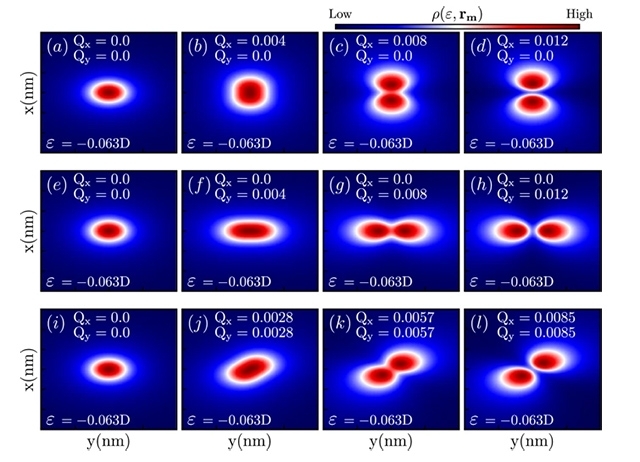

Pero la energía potencial tomada del campo de Higgs difiere en varios aspectos de la acción de los campos familiares. La masa tomada de Higgs es en realidad masa en reposo. De hecho, en la que quizá sea la versión más apasionante de la teoría del campo de Higgs, éste genera toda la masa en reposo. Otra diferencia es que la cantidad de masa que se traga del campo es distinta para las distintas partículas.

Los teóricos dicen que las masas de las partículas de nuestro modelo estándar miden con qué intensidad se acoplan éstas al campo de Higgs.

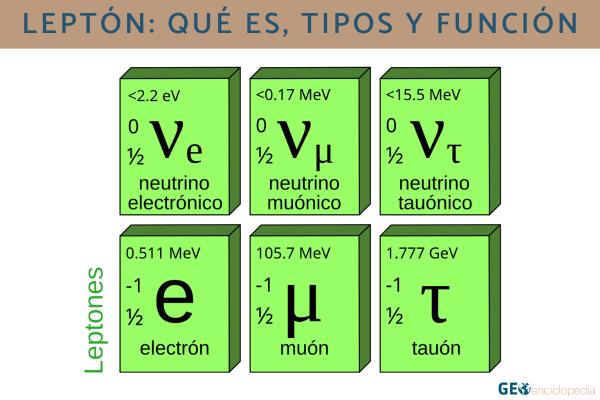

La influencia de Higgs en las masas de los quarks y de los leptones, nos recuerda el descubrimiento por Pieter Zeeman, en 1.896, de la división de los niveles de energía de un electrón cuando se aplica un campo magnético al átomo. El campo (que representa metafóricamente el papel de Higgs) rompe la simetría del espacio de la que el electrón disfrutaba.

Hasta hace bien poco no teníamos ni idea de que reglas controlan los incrementos de masa generados por el Higgs (de ahí la expectación creada por el nuevo acelerador de partículas LHC cuando la buscaba). Pero el problema es irritante: ¿por qué sólo esas masas -Las masas de los W+, W–, y Zº, y el up, el down, el encanto, el extraño, el top y el bottom, así como los leptones – que no forman ningún patrón obvio?

Positrón. Electrón con carga positiva. La interacción con el electrón puede resultar en la aniquilación de ambos, con lo que se produce un par de fotones cuya energía equivale a la masa del par electrón-positrón. Esta propiedad define al positrón como la antipartícula asociada al electrón.

Las masas van de la del electrón 0’0005 GeV, a la del top, que tiene que ser mayor que 91 GeV. Deberíamos recordar que esta extraña idea (el Higgs) se empleó con mucho éxito para formular la teoría electrodébil (Weinberg-Salam). Allí se propuso el campo de Higgs como una forma de ocultar la unidad de las fuerzas electromagnéticas y débiles. En la unidad hay cuatro partículas mensajeras sin masa -los W+, W–, Zº y fotón que llevan la fuerza electrodébil. Además está el campo de Higgs, y, rápidamente, los W y Z chupan la esencia de Higgs y se hacen pesados; el fotón permanece intacto. La fuerza electrodébil se fragmenta en la débil (débil porque los mensajeros son muy gordos) y la electromagnética, cuyas propiedades determina el fotón, carente de masa. La simetría se rompe espontáneamente, dicen los teóricos. Prefiero la descripción según la cual el Higgs oculta la simetría con su poder dador de masa.

Las masas de los W y el Z se predijeron con éxito a partir de los parámetros de la teoría electrodébil. Y las relajadas sonrisas de los físicos teóricos nos recuerdan que Gerard ^t Hooft y Veltman dejaron sentado que la teoría entera esta libre de infinitos.

Pero, encierra tantos misterios la materia que, a veces me hace pensar en que la podríamos denominar de cualuquier manera menos de inerte ¡Parece que la materia está viva!

Son muchas las cosas que desconocemos y, nuestra curiosidad nos empuja continuamente a buscar esas respuestas.

La Teoría de las masas de las partículas

El electrón y el positrón son notables por sus pequeñas masas (sólo 1/1.836 de la del protón, el neutrón, el antiprotón o antineutrón), y, por lo tanto, han sido denominados leptones (de la voz griega lentos, que significa “delgado”).

Aunque el electrón fue descubierto en 1.897 por el físico británico Josepth John Thomson (1856-1940), el problema de su estructura, si la hay, no está resuelto. Conocemos su masa y su carga negativa que responden a 9,1093897 (54) x 10-31 Kg la primera y, 1,602 177 33 (49) x 10-19 culombios, la segunda, y también su radio clásico: r0 = e2/mc2 = 2’82 x 10-13 m. No se ha descubierto aún ninguna partícula que sea menos cursiva que el electrón (o positrón) y que lleve una carga eléctrica, sea lo que fuese (sabemos como actúa y cómo medir sus propiedades, pero aun no sabemos qué es), tenga asociada un mínimo de masa, y que esta es la que se muestra en el electrón.

Lo cierto es que, el electrón, es una maravilla en sí mismo. El Universo no sería como lo conocemos si el electrón (esa cosita “insignificante”), fuese distinto a como es, bastaría un cambio infinitesimal para que, por ejemplo, nosotros no pudiéramos estar aquí ahora.

¡No por pequeño, se es insignificante! Para sus padres lo más grande del mundo

Recordémoslo, todo lo grande está hecho de cosas pequeñas.

En realidad, existen partículas que no tienen en absoluto asociada en ellas ninguna masa (es decir, ninguna masa en reposo). Por ejemplo, las ondas de luz y otras formas de radiación electromagnéticas se comportan como partículas (Einstein en su efecto fotoeléctrico y De Broglie en la difracción de electrones*.

Esta manifestación en forma de partículas de lo que, de ordinario, concebimos como una onda se denomina fotón, de la palabra griega que significa “luz”.

El fotón tiene una masa de 1, una carga eléctrica de o, pero posee un espín de 1, por lo que es un bosón. ¿Cómo se puede definir lo que es el espín? Los fotones toman parte en las reacciones nucleares, pero el espín total de las partículas implicadas antes y después de la reacción deben permanecer inmutadas (conservación del espín). La única forma que esto suceda en las reacciones nucleares que implican a los fotones radica en suponer que el fotón tiene un espín de 1. El fotón no se considera un leptón, puesto que este termino se reserva para la familia formada por el electrón, el muón y la partícula Tau con sus correspondientes neutrinos: Ve, Vu y VT.

Existen razones teóricas para suponer que, cuando las masas se aceleran (como cuando se mueven en órbitas elípticas en torno a otra masa o llevan a cabo un colapso gravitacional), emiten energía en forma de ondas gravitacionales. Esas ondas pueden así mismo poseer aspecto de partícula, por lo que toda partícula gravitacional recibe el nombre de gravitón.

Aunque sea la más débil de las cuatro fuerzas elementales… ¡Es inmensamente importante para nuestro Universo!

La fuerza gravitatoria es mucho, mucho más débil que la fuerza electromagnética. Un protón y un electrón se atraen gravitacionalmente con sólo 1/1039 de la fuerza en que se atraen electromagnéticamente. El gravitón (aún sin descubrir) debe poseer, correspondientemente, menos energía que el fotón y, por tanto, ha de ser inimaginablemente difícil de detectar.

De todos modos, el físico norteamericano Joseph Weber emprendió en 1.957 la formidable tarea de detectar el gravitón. Llegó a emplear un par de cilindros de aluminio de 153 cm. De longitud y 66 de anchura, suspendidos de un cable en una cámara de vacío. Los gravitones (que serían detectados en forma de ondas), desplazarían levemente esos cilindros, y se empleó un sistema para detectar el desplazamiento que llegare a captar la cienmillonésima parte de un centímetro.

Han llevado años captarlas, las ondas gravitatorias llevadas por el gravitón son débiles

Las débiles ondas de los gravitones, que producen del espacio profundo, deberían chocar contra todo el planeta, y los cilindros separados por grandes distancias se verán afectados de forma simultánea. En 1.969, Weber anunció haber detectado los efectos de las ondas gravitatorias. Aquello produjo una enorme excitación, puesto que apoyaba una teoría particularmente importante (la teoría de Einstein de la relatividad general). Desgraciadamente, nunca se pudo comprobar mediante las pruebas realizadas por otros equipos de científicos que duplicaran el hallazgo de Weber.

De todas formas, no creo que, a estas alturas, nadie pueda dudar de la existencia de los gravitones, el bosón mediador de la fuerza gravitatoria. La masa del gravitón es o, su carga es o, y su espín de 2. Como el fotón, no tiene antipartícula, ellos mismos hacen las dos versiones.

Tenemos que volver a los que posiblemente son los objetos más misteriosos de nuestro Universo: Los agujeros negros. Si estos objetos son lo que se dice (no parece que se pueda objetar nada en contrario), seguramente serán ellos los que, finalmente, nos faciliten las respuestas sobre las ondas gravitacionales y el esquivo gravitón.

La onda gravitacional emitida por el agujero negro produce una ondulación en la curvatura del espacio-temporal que viaja a la velocidad de la luz transportada por los gravitones.

Hay aspectos de la física que me dejan totalmente sin habla, me obligan a pensar y me transporta de este mundo material nuestro a otro fascinante donde residen las maravillas del Universo. Hay magnitudes asociadas con las leyes de la gravedad cuántica. La longitud de Planck-Wheeler, ![]() es la escala de longitud por debajo de la cual el espacio tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro.

es la escala de longitud por debajo de la cual el espacio tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro.

Me llama poderosamente la atención lo que conocemos como las fluctuaciones de vacío, esas oscilaciones aleatorias, impredecibles e in-eliminables de un campo (electromagnético o gravitatorio), que son debidas a un tira y afloja en el que pequeñas regiones del espacio toman prestada momentáneamente energía de regiones adyacentes y luego la devuelven.

El vacío no existe… ¡Siempre hay!

Ordinariamente, definimos el vacío como el espacio en el que hay una baja presión de un gas, es decir, relativamente pocos átomos o moléculas. En ese sentido, un vacío perfecto no contendría ningún átomo o molécula, pero no se puede obtener, ya que todos los materiales que rodean ese espacio tienen una presión de vapor finita. En un bajo vacío, la presión se reduce hasta 10-2 pascales, mientras que un alto vacío tiene una presión de 10-2-10-7 pascales. Por debajo de 10-7 pascales se conoce como un vacío ultra-alto.

No puedo dejar de referirme al vacio-theta (vació θ) que, es el estado de vacío de un campo gauge no abeliano (en ausencia de campos fermiónicos y campos de Higgs).

El vacío theta es el punto de partida para comprender el estado de vacío de las teoría gauge fuertemente interaccionantes, como la cromodinámica cuántica. En el vacío theta hay un número infinito de estados degenerados con efecto túnel entre estos estados. Esto significa que el vacío theta es análogo a una fundón de Bloch* en un cristal.

Se puede derivar tanto como un resultado general o bien usando técnicas de instantón. Cuando hay un fermión sin masa, el efecto túnel entre estados queda completamente suprimido.

Cuando hay campos fermiónicos con masa pequeña, el efecto túnel es mucho menor que para campos gauge puros, pero no está completamente suprimido.

Nos podríamos preguntar miles de cosas que no sabríamos contestar. Nos maravillan y asombran fenómenos naturales que ocurren ante nuestros ojos pero que tampoco sabemos, en realidad, a que son debidos. Si, sabemos ponerles etiquetas como, por ejemplo, la fuerza nuclear débil, la fisión espontánea que tiene lugar en algunos elementos como el protactinio o el torio y, con mayor frecuencia, en los elementos que conocemos como transuránicos.

“Los elementos transuránicos o elementos transuránicos son elementos químicos con número atómico mayor que 92, el número atómico del elemento Uranio. El nombre de trans-uránidos significa «más allá del uranio».”

93. Neptunio

94. Plutonio

95. Americio

96. Curio

97. Berkelio

98. Californio

99. Einstenio

100. Fermio

101. Mendelevio

102. Nobelio

103. Lawrencio

104. Rutherfordio

105. hahnium

06. Seaborgio

107. Bohrio

108. hassio

109. meitnerio

110. darmstadtio

111. roentgenio

112 copernicio

113 nihonio

114 flerovio

115 moscovio

116 livermorio

117 teneso

118 oganesón

La mayoría de los elementos generados de forma artificial se pueden obtener como elemento sintético vía reacciones nucleares o acelerador de partículas. La vida media de estos elementos suele decrecer con el número atómico. Existen, no obstante excepciones, que incluyen el dubnio y algunos isótopos del curio. El químico Glenn T. Seaborg (Premio Nobel de Química) llegó a crear leyes empíricas capaces de predecir estas anomalías. Todas ellas se categorizan en lo que viene a denominarse como “isla de estabilidad”. Los elementos transuránicos no descubiertos todavía, o que no han sido denominados de forma oficial, emplearán la nomenclatura indicada por la ITUPAC. A pesar de ello la denominación de algunos elementos transuránicos en el pasado y hoy en día son fuentes de controversia.

Si, los mencionaba en el otro trabajo pero, nunca está demás.

A medida que los núcleos se hacen más grandes, la probabilidad de una fisión espontánea aumenta. En los elementos más pesados de todos (einstenio, fermio y mendelevio), esto se convierte en el método más importante de ruptura, sobre pasando a la emisión de partículas alfa.

Emilio Silvera Vázquez

Ene

28

Estructuras fundamentales de la Naturaleza

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (3)

Comments (3)

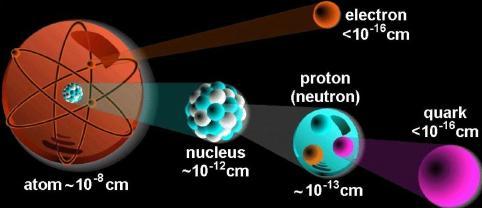

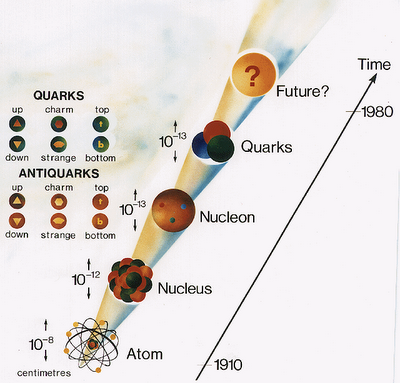

Hemos llegado a poder discernir la relación directa que vincula el tamaño, la energía de unión y la edad de las estructuras fundamentales de la Naturaleza.

Una molécula es mayor y más fácil de desmembrar que un átomo; lo mismo podemos decir de un átomo respecto al núcleo atómico, y de un núcleo con respecto a los quarks que contiene.

La cosmología sugiere que esta relación resulta del curso de la historia cósmica, que los quarks se unieron primero, en la energía extrema del Big Bang original, y que a medida que el Universo se expandió, los protones y neutrones compuestos de quarks se unieron para formar núcleos de átomos, los cuales, cargados positivamente, atrajeron a los electrones cargados con electricidad negativa estableciéndose así como átomos completos, que al unirse formaron moléculas.

Si es así, cuanto más íntimamente examinemos la Naturaleza, tanto más lejos hacia atrás vamos en el tiempo. Alguna vez he puesto el ejemplo de mirar algo que nos es familiar, el dorso de la mano, por ejemplo, e imaginemos que podemos observarlo con cualquier aumento deseado.

Con un aumento relativamente pequeño, podemos ver las células de la piel, cada una con un aspecto tan grande y complejo como una ciudad, y con sus límites delineados por la pared celular. Si elevamos el aumento, veremos dentro de la célula una maraña de ribosomas serpenteando y mitocondrias ondulantes, lisosomas esféricos y centríolos, cuyos alrededores están llenos de complejos órganos dedicados a las funciones respiratorias, sanitarias y de producción de energía que mantienen a la célula.

Ya ahí tenemos pruebas de historia. Aunque esta célula particular solo tiene unos pocos años de antigüedad, su arquitectura se remonta a más de mil millones de años, a la época en que aparecieron en la Tierra las células eucariota o eucarióticas como la que hemos examinado.

Ene

28

Si existe la perfección, estará en la Naturaleza

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (2)

Comments (2)

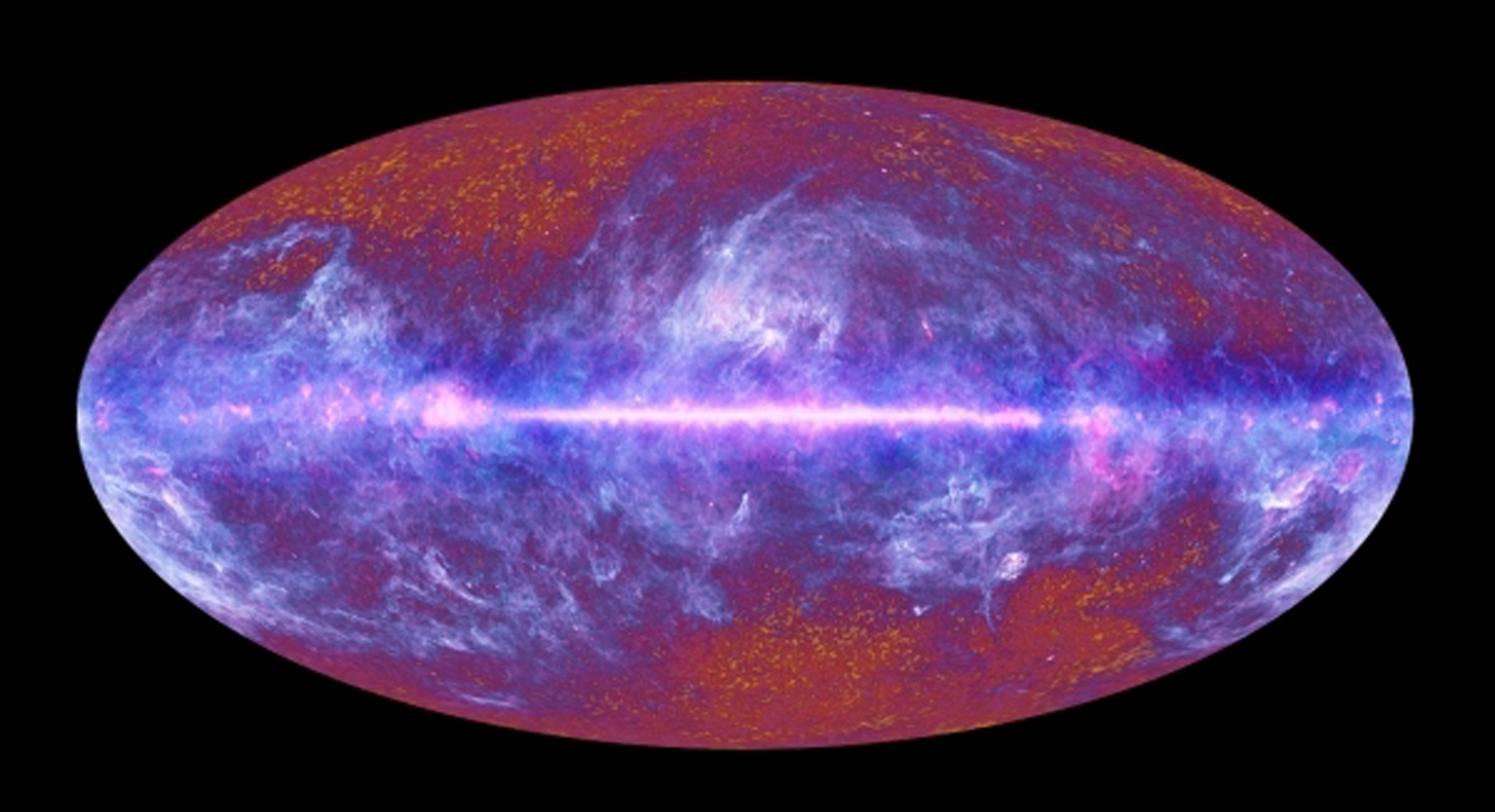

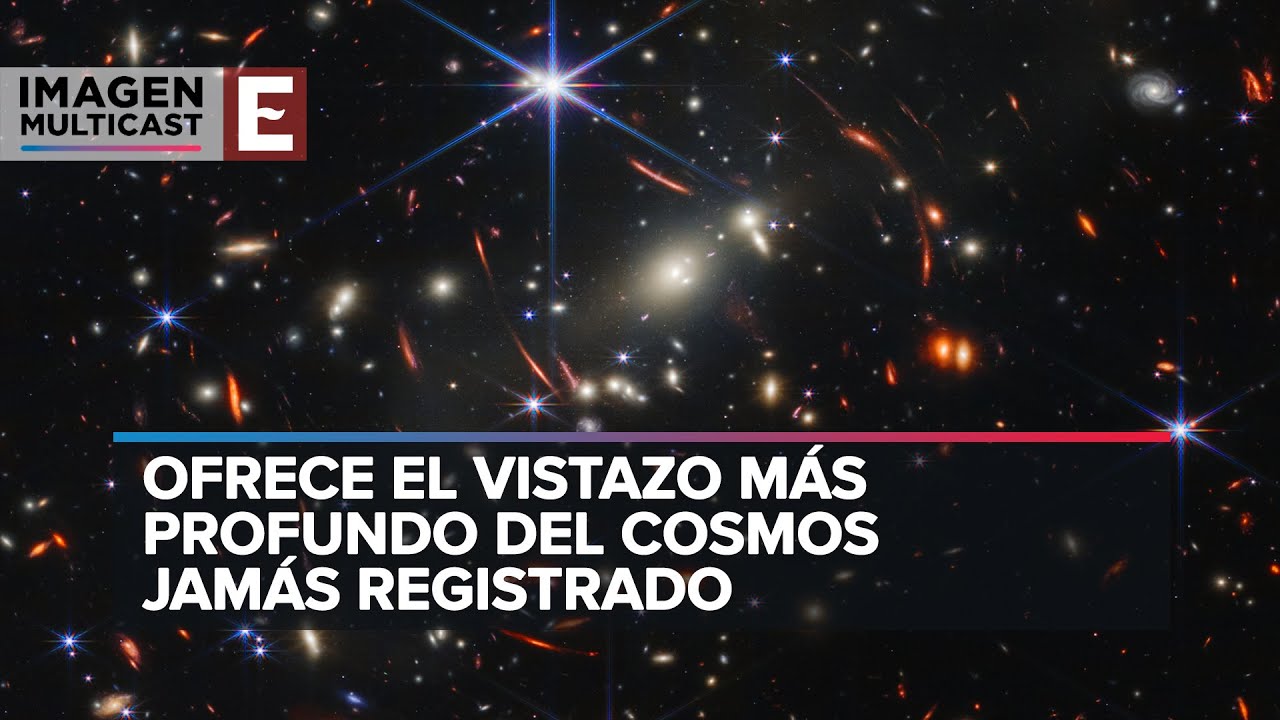

Belleza galáctica: Impresionante imagen del universo captada por el telescopio J. Webb.

El Universo está construido según un plan cuya profunda simetría está presente de algún modo en la estructura interna de nuestro intelecto. Y, desde luego, si lo pensamos profundamente, tendremos que dar la razón a Paul Valery por tales pensamientos, ya que, la Mente Humana, alcanzó cotas inimaginables.

¡Agua! El Universo está lleno de agua por todas partes y, si eso es así ¿Qué pasa con la vida?

Mientras que el Universo actual está bañado por radiación cósmica a una temperatura de 2,7 Kelvin (-270,45°C), esta temperatura rondaba los 20 K (-253,1°C) menos de mil millones de años después del Big Bang

Hubo un tiempo, en el Universo muy temprano, en el que la temperatura estaba encima de algunos cientos de veces la masa del protón, cuando la simetría aún no se había roto, y la fuerza débil y electromagnética no sólo eran la misma matemáticamente, sino realmente la misma. Un físico que hubiera podido estar allí presente, en aquellos primeros momento, no habría podido observar ninguna diferencia real entre las fuerzas producidas por el intercambio de estas cuatro partículas: la W+, la W– , la Z y el Fotón.

– El gluón es la partícula portadora de la interacción nuclear fuerte que mantiene unidos a los quarks en el núcleo. Los Gluones son bosones. Al igual que el fotón, el gluón es un bosón sin masa ni carga de Spin 1. Existen asimismo 8 tipos de Gluones, siendo cada uno de ellos una combinación color-anti-color. Los quarks y los Gluones forman partículas compuestas con carga de color total neutra (se suele decir que las partículas compuestas son blancas).

– Los bosones W+, W- y Z son las partículas portadoras de la interacción nuclear débil, una de las cuatro interacciones fundamentales de la naturaleza. Son tres tipos de partículas fundamentales muy masivas que se encargan en general de cambiar el sabor de otras partículas, los leptones y los quarks.

– El gravitón ???. A nivel de partículas fundamentales la fuerza gravitatoria es despreciable.

En resumen:

Al llegar a escalas cada vez menores, también hemos entrado en ámbitos de energías de unión cada vez mayores. Un átomo puede ser despojado de su electrón aplicando sólo unos miles de electrón-voltios de energía, más para dispersar los nucleones que conforman un núcleo atómico se requieren varios millones de electrón-voltios, y para librar los quarks que constituyen cada nucleón se necesitaría cientos de veces más energía. Así, hemos llegado a comprender que, las estructuras más pequeñas y más fundamentales están ligadas por niveles de energía mayores porque sus estructuras mismas fueron forjadas en el calor del Big bang.

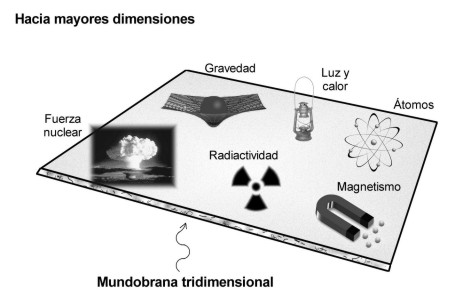

Cosmología de Branas

También hemos llegado a comprender que, las fuerzas de la naturaleza que gobiernan la electricidad, el magnetismo, la radiactividad y las reacciones nucleares están confinadas a un “mundo-brana” tridimensional, mientras que la gravedad actúa en todas las dimensiones y es consecuentemente más débil. Seguramente ese será el motivo por el cual, encontrar al Bosón mediador de la fuerza, el Gravitón, resulta tan difícil.

De manera similar, aunque menos clara, las teorías de supersimetrías conjeturaban que las cuatro fuerzas tal vez estaban ligadas por una simetría que se manifestaba en los niveles de energía aún mayores que caracterizaban al universo ya antes del Big Bang. La introducción de un eje histórico en la cosmología y la física de partículas (como decía ayer en uno de los trabajos), beneficio a ambos campos. Los físicos proporcionaron a los cosmólogos una amplia gama de herramientas útiles para saber cómo se desarrolló el universo primitivo. Evidentemente, el Big Bang no fue una muralla de fuego de la que se burló Hoyle, sino un ámbito de suscesos de altas energías que muy posiblemente pueden ser comprensibles en términos de teoría de campo relativista y cuántica.

La cosmología, por su parte, dio un tinte de realidad histórica a las teorías unificadas. Aunque ningún acelerador concebible podrían alcanzar las titánicas energías supuestas por las grandes teorías unificadas y de la supersimetría, esas exóticas ideas aún pueden ser puestas a prueba, investigando si las partículas constituyentes del universo actual son compatibles con el tipo de historia primitiva que implican las teorías. Las partículas elementales aparentemente proporcionan las claves de algunos de los misterios fundamentales de la Cosmología temprana… y resulta que la Cosmología brinda una especia de terreno de prueba para alguna de las ideas de la física de partículas elementales. Esto implica que los aceleradores de partículas, como los telescopios, funcionen como máquinas del tiempo. Un telescopio penetra en el pasado en virtud del tiempo que tarda la luz en desplazarse entre las estrellas; un acelerador recrea, aunque sea fugazmente, las condiciones que prevalecían en el Universo primitivo.

Moléculas, átomos y conexiones para formar pensamientos que nos llevaron hacia los conocimientos que hoy, tras muchos miles de millones de años de evolución del Universo, hizo posible la aparición de especies que, tras miles de años de experiencia, de observación, y, de imaginar…, llegó a conseguir la intuición necesaria para presentir que, formamos parte de un todo inmenso del que sólo somos una parte, la que piensa. También la que tiene que descubrir, los secretos de la Naturaleza, en ello, le va la existencia en el futuro.

Hemos aprendido que cuanto más íntimamente examinemos la Naturaleza, tanto más lejos hacia atrás vamos en el tiempo. Alguna vez he puesto el ejemplo de mirar algo que no es familiar, el dorso de la mano, por ejemplo, e imaginemos que podemos observarlo con cualquier aumento deseado.

Con un aumento relativamente pequeño, podemos ver las células de la piel, cada una con un aspecto tan grande y complejo como una ciudad, y con sus límites delineados por la pared celular. Si elevamos el aumento, veremos dentro de la célula una maraña de ribosomas serpenteando y mitocondrias ondulantes, lisosomas esféricos y centríolos, cuyos alrededores están llenos de complejos órganos dedicados a las funciones respiratorias, sanitarias y de producción de energía que mantienen a la célula.

Ya ahí tenemos pruebas de historia. Aunque esta célula particular solo tiene unos pocos años de antigüedad, su arquitectura se remonta a más de mil millones de años, a la época en que aparecieron en la Tierra las células eucariota o eucarióticas como la que hemos examinado.

Hemos llegado a poder discernir la relación directa que vincula el tamaño, la energía de unión y la edad de las estructuras fundamentales de la Naturaleza. Ahora, hemos llegado a comprender muchas de las cosas que, hasta hace bien poco tiempo, eran auténticos secretos que, el Universo, celosamente se guardaba, y, esa comprensión, nos llevará más lejos y nos permitirá realizar un largo camino hacia el corazón mismo de la materia, donde según parece, pueden residir infinitesimales objetos más pequeños que los Quarks, en esa distancia inalcanzable ahora que hemos llamado, el Límite de Planck.

Es una unidad teórica pero con bases sólidas: las constantes del Universo. Mide unos 10¯³⁵ metros, eso es 0.000000000000000000000000000000000016 metros o alrededor de una billonésima de una billonésima de una billonésima de un metro.

Aún estamos en el camino, no hemos podido llegar más lejos y, con la ayuda de los aceleradores hemos podido llegar hasta una diez billonésima de segundo después del Big Bang que es menos que un pestañeo con los párpados en toda la historia humana registrada. A pesar de ello, extrañamente, la investigación de la evolución del Universo recién nacido indica que ocurrieron muchas cosas aún antes, durante la primera ínfima fracción de un segundo. Todos los teóricos han tratado de elaborar una explicación coherente de los primeros momentos de la historia cósmica. Por supuesto, sus ideas fueron esquemáticas e incompletas, muchas de sus conjeturas, sin duda, se juzgaran deformadas o sencillamente erróneas, pero constituyeron una crónica mucho más aclaradora del Universo primitivo que la que teníamos antes.

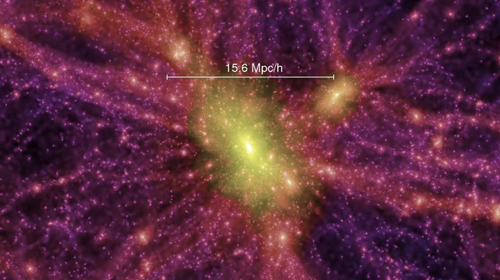

Recreación del Universo primitivo al que no hemos podido llegar en el momento mismo de su creación, nos ha sido imposible recrear ese momento que llamamos Big Bang, las matemáticas no funcionan al tratar de formular la ecuación precisa que nos muestre aquel momento.

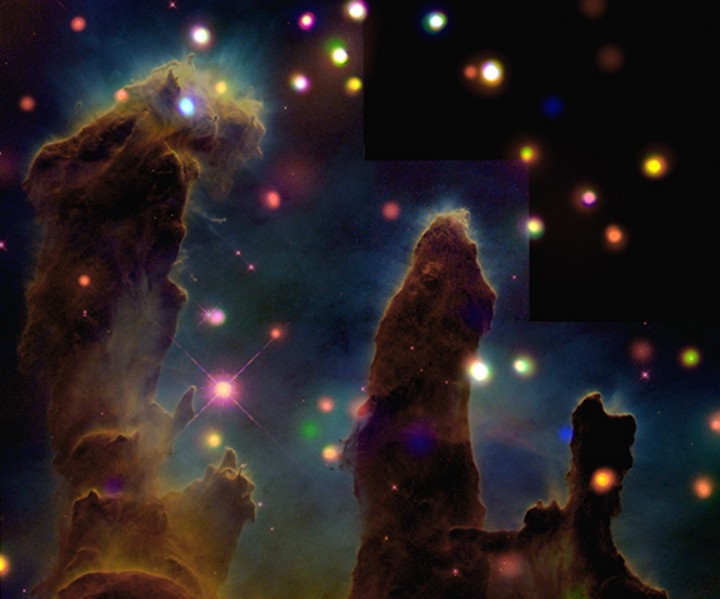

De todas las maneras, son muchas las imágenes de la Naturaleza, del Universo, que nos deja admirar su perfección. Veámos por un momento varias tomas de la Nebulosa del Águila mostrada en Observatorio.

“Aún se están formando estrellas azules en los pilares oscuros de la Nebulosa del Águila.

Es famosa gracias a una fotografía que le tomó el Telescopio Espacial Hubble en 1995, la Nebulosa del Águila muestra el fantástico proceso de formación estelar.

En la parte superior derecha de esta fotografía se encuentra el corazón del cúmulo abierto M16. Las brillantes estrellas azules de M16 se han estado formando continuamente por más de 5 millones de años y más recientemente en los pilares centrales de gas y polvo, conocidos como trompas de elefante.

La luz demora más de 7000 años en alcanzarnos desde M16y ésta mide cerca de 20 años luz, puede ser vista con binoculares hacia la constelación Serpens.”

Nebulosa del Águila distintas regiones

De lejos, todo parece una águila . Pero una mirada más cercana a la nebulosa del Águila muestra que la resplandeciente región es en…

Las fascinantes imágenes de M16 (la Nebulosa del Águila) realizadas por el Observatorio de Rayos X Chandra, nos muestran muchas… En los pilares oscuros de la Nebulosa del Águila siguen formándose aún brillantes estrellas azules.

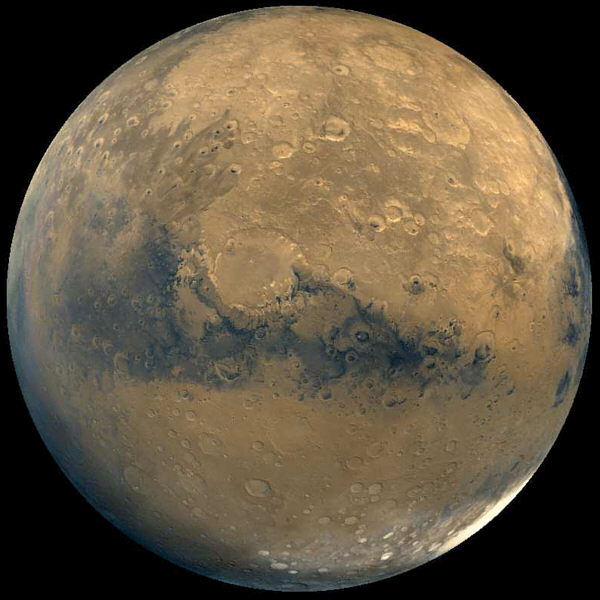

Al principio, cuando el universo era simétrico, sólo existía una sola fuerza que unificaba a todas las que ahora conocemos, la gravedad, las fuerzas electromagnéticas y las nucleares débil y fuerte, todas emergían de aquel plasma opaco de alta energía que lo inundaba todo. Más tarde, cuando el universo comenzó a enfriarse, se hizo transparente y apareció la luz, las fuerzas se separaron en las cuatro conocidas, emergieron los primeros quarks para unirse y formar protones y neutrones, los primeros núcleos aparecieron para atraer a los electrones que formaron aquellos primeros átomos.

Doscientos millones de años más tarde, se formaron las primeras estrellas y galaxias. Con el paso del tiempo, las estrellas sintetizaron los elementos pesados de nuestros cuerpos, fabricados en supernovas que estallaron, incluso antes de que se formase el Sol. Podemos decir, sin temor a equivocarnos, que una supernova anónima explotó hace miles de millones de años y sembró la nube de gas que dio lugar a nuestro sistema solar, poniendo allí los materiales complejos y necesarios para que algunos miles de millones de años más tarde, tras la evolución, apareciéramos nosotros.

¡Qué cosas! El asombro se junta con la maravilla y nos lleva a comprender que, la ignorancia, quizá sea nuestro mayor patrimonio, ya que, el saber es escaso y comprender, comprendemos con cierta lentitud, la que impone el ritmo del Universo. Todo tiene su tiempo marcado y nuestra comprensión…también.

Emilio Silvera V.

Totales: 86.573.390

Totales: 86.573.390 Conectados: 87

Conectados: 87