Nov

15

Conjeturar… ¡Tratando de saber!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

¡El Universo! ¿Sabía que nosotros íbamos a venir?

¿El Principio Antrópico? Parece conveniente hacer una pequeña reseña que nos explique que es un principio en virtud del cual la presencia de la vida humana está relacionada con las propiedades del Universo. Como antes hemos comentado de pasada, existen varias versiones del principio antrópico. La menos controvertida es el principio antrópico débil, de acuerdo con el cual la vida humana ocupa un lugar especial en el Universo porque puede evolucionar solamente donde y cuando se den las condiciones adecuadas para ello. Este efecto de selección debe tenerse en cuenta cuando se estudian las propiedades del Universo.

El principio antrópico fuerte es una versión más especulativa que afirma que las propiedades del universo (incluyendo el valor de las constantes físicas) deben ser necesariamente de un tipo que permita la existencia de vida inteligente en algún momento de su historia. A diferencia del principio débil, que simplemente observa que vivimos en un universo compatible con nuestra existencia, el principio fuerte sugiere que el universo está diseñado o debe ser de tal manera que la vida sea inevitable, lo que tiene implicaciones profundas para la cosmología y la filosofía.

Una versión más especulativa, el principio antrópico fuerte, asegura que las leyes de la física deben tener propiedades que permitan evolucionar la vida. La implicación de que el Universo fue de alguna manera diseñado para hacer posible la vida humana hace que el principio antrópico fuerte sea muy controvertido, ya que, nos quiere adentrar en dominios divinos que, en realidad, es un ámbito incompatible con la certeza comprobada de los hechos a que se atiene la ciencia, en la que la fe, no parece tener cabida. Sin embargo, algunos han tratado de hacer ver lo imposible.

“Basado en las propuestas del premio Nobel de física Paul Dirac sobre los ajustados, sincronizados y muy precisos valores de las constantes de la naturaleza, los físicos actuales comienzan a valorar aquello que han denominado el “principio antrópico¨, es decir, poco a poco, a lo largo de los años han entendido que siempre quedará un espacio de información faltante cuando intentamos teorizar o conceptualizar los inicios del universo supeditados exclusivamente sobre la capacidad contenida en las leyes de la física para explicar dichos inicios.”

El principio antrópico nos invita al juego mental de probar a “cambiar” las constantes de la Naturaleza y entrar en el juego virtual de ¿Qué hubiera pasado si…? Especulamos con lo que podría haber sucedido si algunos sucesos no hubieran ocurrido de tal a cual manera para ocurrir de ésta otra. ¿Qué hubiera pasado en el planeta Tierra si no aconteciera en el pasado la caída del meteorito que acabó con los dinosaurios? ¿Habríamos podido estar aquí hoy nosotros? ¿Fue ese cataclismo una bendición para la Humanidad y nos quitó de encima a unos terribles rivales?

Fantasean con lo que pudo ser…. Es un ejercicio bastante habitual, solo tenemos que cambiar la realidad de la historia o de los sucesos verdaderos para pretender fabricar un presente distinto. Cambiar el futuro puede resultar más fácil, nadie lo conoce y no pueden rebatirlo con certeza ¿Quién sabe lo que pasará mañana?

El problema de si las constantes físicas son constantes se las trae. Aparte del trabalenguas terminológico arrastra tras de sí unas profundas consecuencias conceptuales. Lo primero, uno de los pilares fundamentales de la relatividad especial es el postulado de que las leyes de la física son las mismas con independencia del observador. Esto fue una generalización de lo que ya se sabía cuando se comenzó a estudiar el campo electromagnético, pero todo lo que sabemos en la actualidad nos lleva a concluir que este postulado es bastante razonable.

Lo que ocurra en la Naturaleza del Universo está en el destino de la propia Naturaleza del Cosmos, de las leyes que la rigen y de las fuerzas que gobiernan sus mecanismos sometidos a principios y energías que, en la mayoría de los casos, se pueden escapar a nuestro actual conocimiento.

Lo que le pueda ocurrir a nuestra civilización además de estar supeditado al destino de nuestro planeta, de nuestro Sol y de nuestro Sistema Solar y la galaxia, también está en manos de los propios individuos que forman esa civilización y que, con sensibilidades distintas y muchas veces dispares, hace impredecibles los acontecimientos que puedan provocar individuos que participan con el poder individual, es decir, esa parcial disposición que tenemo0s del “libre albedrío”.

¿Cómo sería nuestro mundo si las constantes universales fueran diferentes?

Siempre hemos sabido especular con lo que pudo ser o con lo que podrá ser si…., lo que, la mayoría de las veces, es el signo de cómo queremos ocultar nuestra ignorancia. Bien es cierto que sabemos muchas cosas pero, también es cierto que son más numerosas las que no sabemos.

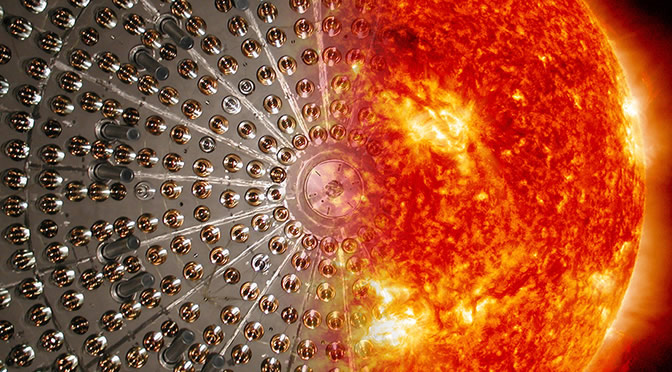

Sabiendo que el destino irremediable de nuestro mundo, el planeta Tierra, es de ser calcinado por una estrella gigante roja en la que se convertirá el Sol cuando agote la fusión de su combustible de Hidrógeno, Helio, Carbono, etc., para que sus capas exteriores de materia exploten y salgan disparadas al espacio exterior, mientras que, el resto de su masa se contraerá hacia su núcleo bajo su propio peso, a merced de la Gravedad, convirtiéndose en una estrella enana blanca de enorme densidad y de reducido diámetro. Sabiendo eso, el hombre está poniendo los medios para que, antes de que llegue ese momento (dentro de algunos miles de millones de años), poder escapar y dar el salto hacia otros mundos lejanos que, como la Tierra ahora, reúna las condiciones físicas y químicas, la atmósfera y la temperatura adecuadas para acogernos.

El Sol será una Gigante roja y, cuando eso llegue, la Tierra…

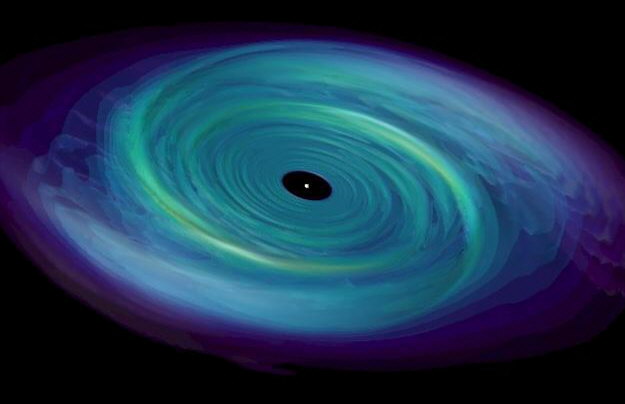

Pero el problema no es tan fácil y, se extiende a la totalidad del Universo que, aunque mucho más tarde, también está abocado a la muerte térmica, el frío absoluto si se expande para siempre como un Universo abierto y eterno. A estas alturas se ha descartado el Big Chunch y se saber que la expansión del Universo es imparable y que con el paso del tiempo las galaxias estarán más alejadas las unas de las otras hasta que, la energía, las temperaturas sean -273 ºC, un ámbito de muerte, allí nada -ni siguiera los átomos-, absolutamente nada se mueve.

Muerte térmica del Universo: De acuerdo con las leyes de la termodinámica, en el que toda la materia alcanzará finalmente la misma temperatura. En estas condiciones no existe energía disponible para realizar trabajo y la entropía del Universo se encuentra en su máximo. Este resultado fue predicho por el físico alemán Rudolf Julius Emmanuel Clausius (1822-1888), quien introdujo el concepto de entropía.

Y, nuevos cálculos sugieren que el cosmos puede estar un poco más cerca a una muerte térmica.

Para tener todo ese tumulto — estrellas en erupción, galaxias chocantes, agujeros negros que colapsan – el cosmos es un lugar sorprendentemente ordenado. Los cálculos teóricos han demostrado desde hace mucho que la entropía del universo – una medida de su desorden – no es más que una diminuta fracción de la cantidad máxima permitida.

Un nuevo cálculo de la entropía mantiene este resultado general pero sugiere que el universo está más desordenador de lo que los científicos habían pensado — y ha llegado ligeramente más lejos en su gradual camino hacia la muerte, según concluyen dos cosmólogos australianos.

Un análisis de Chas Egan de la Universidad Nacional Australiana en Canberra y Charles Lineweaver de la Universidad de Nueva Gales del Sur en Sydney indica que la entropía colectiva de todos los agujeros negros supermasivos en el centro de las galaxias es unas 100 veces mayor de lo anteriormente calculado. Debido a que los agujeros negros supermasivos son los mayores contribuyentes a la entropía cósmica, el hallazgo sugiere que la entropía del universo también es 100 veces mayor que la anterior estimación, según informaban los científicos el 23 de septiembre en ArXiv.org.”

El universo será cerrado, abierto o plano según la cantidad de materia que contiene. Los cosmólogos la llaman el omega negro y Densidad Crítica que, al parecer, coincide casi al cien por cien con la materia que contiene.

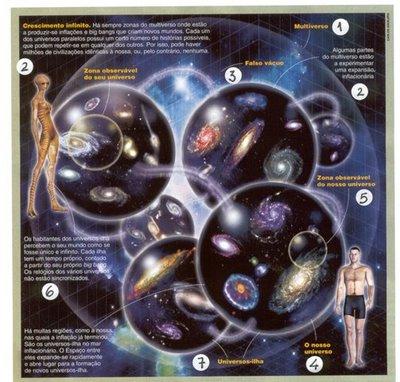

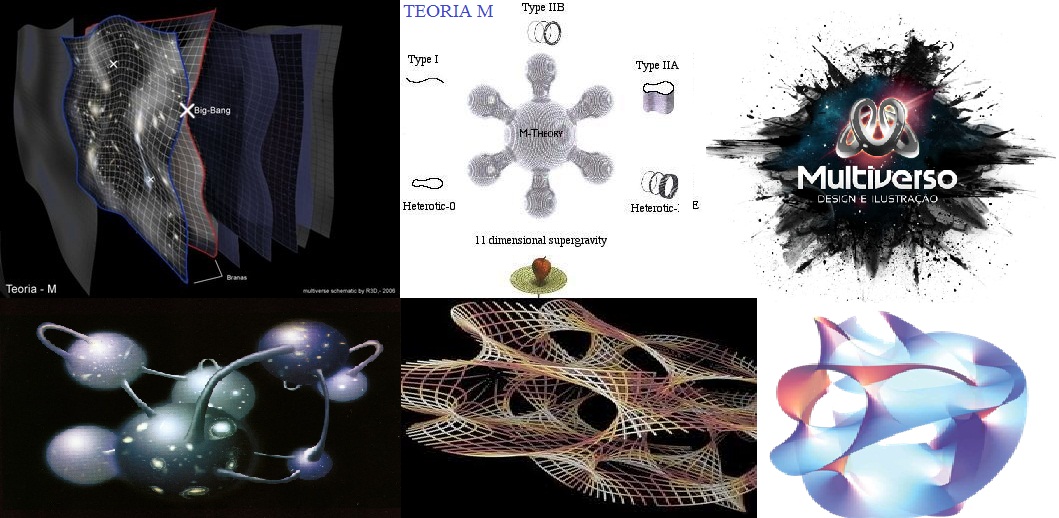

El irreversible final está entre los tres modelos que se han podido construir para el futuro del Universo, de todas las formas que lo miremos es negativo para la Humanidad (si es que puede llegar tan lejos). En tal situación, algunos ya están buscando la manera de escapar. Stephen Hawking ha llegado a la conclusión de que estamos inmersos en un multiuniverso. Como algunos otros él dice que existen múltiples universos conectados los unos a los otros. Unos tienen constantes de la Naturaleza que permiten vida igual o parecida a la nuestra, otros posibilitan formas de vida muy distintas y otros muchos no permiten ninguna clase de vida.

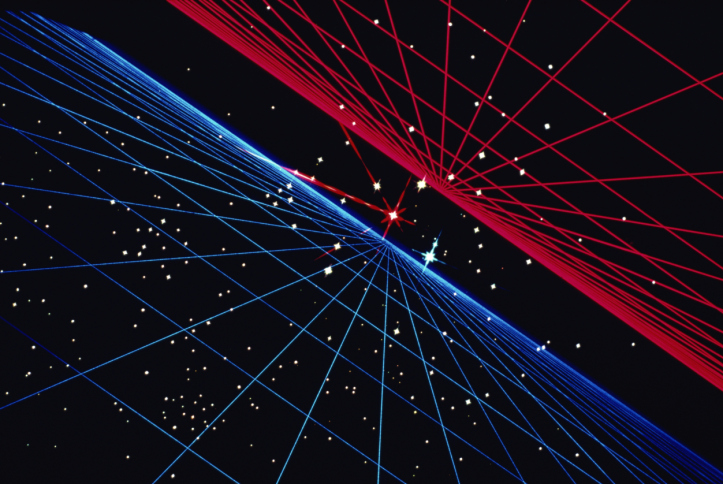

Este sistema de inflación autorreproductora nos viene a decir que cuando el Universo se expande (se infla) a su vez, esa burbuja crea otras burbujas que se inflan y a su vez continúan creando otras nuevas más allá de nuestro horizonte visible. Cada burbuja será un nuevo Universo, o mini-universo en los que reinarán escenarios diferentes o diferentes constantes y fuerzas.

El escenario que describe la imagen, ha sido explorado y el resultado hallado es que en cada uno de esos universos, como hemos dicho ya, pueden haber muchas cosas diferentes, pueden terminar con diferentes números de dimensiones espaciales o diferentes constantes y fuerzas de la Naturaleza, pudiendo unos albergar la vida y otros no. Claro que, sólo son pensamientos y conjeturas de lo que podría ser.

El reto que queda para los cosmólogos es calcular las probabilidades de que emerjan diferentes universos a partir de esta complejidad inflacionaria ¿Son comunes o raros los universos como el nuestro? Existen, como para todos los problemas planteados diversas conjeturas y consideraciones que influyen en la interpretación de cualquier teoría cosmológica futura cuántico-relativista. Hasta que no seamos capaces de exponer una teoría que incluya la relatividad general de Einstein (la Gravedad-Cosmos y la Mecánica Cuántica-Átomo, no será posible contestar a ciertas preguntas.

¿Existen en realidad, en nuestro Universo las cuerdas vibrantes de la Teoría M, o, simplemente se trata de un ejercicio mental complejo?

Todas las soluciones que buscamos parecen estar situadas en teorías más avanzadas que, al parecer, solo son posibles en dimensiones superiores, como es el caso de la teoría de supercuerdas situada en 10 ó 26 dimensiones, allí, si son compatibles la relatividad y la mecánica cuántica, hay espacio más que suficiente para dar cabida a las partículas elementales, las fuerzas gauge de Yang-Mill, el electromagnetismo de Maxwell y, en definitiva, al espacio-tiempo y la materia, la descripción verdadera del Universo y de las fuerzas que en el actúan.

Científicamente, la teoría del Hiperespacio lleva los nombres de teoría de Kaluza-Klein y súper gravedad. Pero en su formulación más avanzada se denomina teoría de supercuerdas, una teoría que desarrolla su potencial en nueve dimensiones espaciales y una de tiempo, diez dimensiones. Así pues, trabajando en dimensiones más altas, esta teoría del Hiperespacio puede ser la culminación que conoce dos milenios de investigación científica: la unificación de todas las fuerzas físicas conocidas. Como el Santo Grial de la Física, la “teoría de todo” que esquivó a Einstein que la buscó los últimos 30 años de su vida.

Parece que algo no va, algunos parámetros se presentan difusos, la Gravedad no acabamos de entenderla, el mundo infinitesimal… es raro. Durante el último medio siglo, los científicos se han sentido intrigados por la aparente diferencia entre las fuerzas básicas que mantienen unido al al Universo: la Gravedad, el electromagnetismo y las fuerzas nucleares fuerte y débil. Los intentos por parte de las mejores mentes del siglo XX para proporcionar una imagen unificadora de todas las fuerzas conocidas han fracasado. Sin embargo, la teoría del Hiperespacio permite la posibilidad de explicar todas las fuerzas de la Naturaleza y también la aparentemente aleatoria colección de partículas subatómicas, de una forma verdaderamente elegante. En esta teoría del Hiperespacio, la “materia” puede verse también como las vibraciones que rizan el tejido del espacio y del tiempo. De ello se sigue la fascinante posibilidad de que todo lo que vemos a nuestro alrededor, desde los árboles y las montañas a las propias estrellas, no son sino vibraciones del Hiperespacio.

No, no será fácil llegar a las respuestas de éstas difíciles preguntas que la física tiene planteadas. Y, sin embargo, ¿cómo podríamos describir lo que en estas teorías han llegado a causar tanta pasión en esos físicos que llevan años luchando con ellas? Recuerdo haber leído aquella conferencia apasionante que dio E. Witten en el Fermilab. Su pasión y forma de encausar los problemas, sus explicaciones, llevaron a todos los presentes a hacerse fervientes y apasionados fans de aquella maravillosa teoría, la que llaman M. Todos hablaban subyugados mucho después de que el evento hubiera terminado. Según contó León Lederman, que asistió a aquella conferencia: “Yo nunca había visto nada igual, cuando Witten concluyó su charla, hubo muchos segundos de silencio, antes de los aplausos y, tal hecho, es muy significativo.

Claro que, a medida que la teoría ha ido topándose con unas matemáticas cada vez más difíciles y una proliferación de direcciones posibles, el progreso y la intensidad que rodeaban a las supercuerdas disminuyeron hasta un nivel más sensato, y ahora, sólo podemos seguir insistiendo y esperar para observar que nos puede traer el futuro de esta teoría que, es posible (y digo sólo posible) que se pueda beneficiar, de alguna manera, de las actividades del LHC que, en algunas de sus incursiones a ese mundo fantasmagórico de lo infinitesimal, podría -y digo podría- atisbar las sombras que puedan producir las supercuerdas.

No son pocos los físicos capaces que están empeñados en demostrar esa teoría. Por ejemplo, Físicos de SLAC desarrollan una prueba de marco de trabajo dependiente para la Teoría de Cuerdas Crítica. La Teoría de Cuerdas resuelve muchas de las cuestiones que arruinan la mente de los físicos, pero tiene un problema importante — no hay actualmente ningún método conocido para comprobarla y, si las energías requeridas para ello, es la de Planck (1019 GeV), la cosa se pone fea, ya que, no está a nuestro alcance.

Está claro que, al tratar todas estas hipotéticas teorías, no pocos, han pensado que, algún día, se podría realizar el sueño de viajar por el Hiperespacio y, de esa manera, se habría logrado el medio para escapar de la Tierra cuando el momento fatídico, en el cual el Sol se convierta en gigante roja, no podamos seguir aquí.

Aunque muchas consecuencias de esta discusión son puramente teóricas, el viaje en el Hiperespacio (El Hiperespacio en ciencia ficción es una especie de región conectada con nuestro universo gracias a los agujeros de gusano, y a menudo sirve como atajo en los viajes interestelares para viajar más rápido que la luz), si llegara a ser posible, podría proporcionar eventualmente la aplicación más práctica de todas: salvar la vida inteligente, incluso a nosotros mismos de la muerte de este Universo cuando al final llegue el frío o el calor.

También en la teoría de supercuerdas está incluida ¡la Gravedad-Cuántica! Otra Ilusión… ¡De momento!

Esta nueva teoría de supercuerdas, tan prometedora del hiperespacio es un cuerpo bien definido de ecuaciones matemáticas, podemos calcular la energía exacta necesaria para doblar el espacio y el tiempo o para cerrar agujeros de Gusano que unan partes distantes de nuestro Universo. Por desgracia, los resultados son desalentadores. La energía requerida excede con mucho cualquier cosa que pueda existir en nuestro planeta. De hecho, la energía es mil billones de veces mayor que la energía de nuestros mayores colisionadores de átomos. Debemos esperar siglos, o quizás milenios, hasta que nuestra civilización desarrolle la capacidad técnica de manipular el espacio-tiempo utilizando la energía infinita que podría proporcionar un agujero negro para de esta forma poder dominar el Hiperespacio que, al parecer, es la única posibilidad que tendremos para escapar del lejano fin que se avecina. ¿Qué aún tardará mucho? Sí, pero el tiempo es inexorable y…., la debacle llegará.

Imagen de la emisión en radio de un magnetar

No existen dudas al respecto, la tarea que nos hemos impuesto es descomunal, imposible para nuestra civilización de hoy pero, ¿y la de mañana, no habrá vencido todas las barreras? Creo que, el hombre es capaz de plasmar en hechos ciertos todos sus pensamientos e ideas, solo necesita tiempo y, como nos ha demostrado DA14 en el presente, ese tiempo que necesitamos, está en manos de la Naturaleza y, nosotros, nada podemos hacer si ella, no nos lo concede. Y, si por desventura es así, todo habrá podido ser, un inmenso sueño ilusionante de lo que podría haber sido si…

¿Dónde estará el límite? ¡No hay límites! Claro que esa afirmación siempre dependerá del Tiempo.

Emilio Silvera V.

Nov

14

La vida media de las partículas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

La Mente: Ese misterio

La mente humana es tan compleja que no todos ante la misma cosa vemos lo mismo. Nos enseñan figuras y dibujos y nos piden que digamos (sin pensarlo) la primera cosa que nos sugieren. De entre diez personas, sólo coinciden tres, los otros siete divergen en la apreciación de lo que el dibujo o la figura les trae a la Mente. Un paisaje puede ser descrito de muy distintas maneras según quién nos lo pueda contar.

Solo el 1% de las formas de vida que han vivido en la Tierra están ahora presentes, el 99%, por una u otra razón se han extinguido. Sin embargo, ese pequeño tanto por ciento de la vida actual, supone unos cinco millones de especies según algunas estimaciones. La Tierra acoge a todas esas especies u palpita de vida que prolifera por doquier. Hay seres vivos por todas partes y por todos los rincones del inmenso mosaico de ambientes que constituye nuestro planeta encontramos formas de vida, cuyos diseños parecen hechos a propósito para adaptarse a su hábitat, desde las profundidades abisales de los océanos hasta las más altas cumbres, desde las espesas selvas tropicales a las planicies de hielo de los casquetes polares. Se ha estimado la edad de 3.800 millones de años desde que aparecieron los primeros “seres vivos” sobre el planeta (dato de los primeros microfósiles). Desde entonces no han dejado de aparecer más y más especies, de las que la mayoría se han ido extinguiendo. Desde el siglo XVIII en que Carlos Linneo propuso su Systema Naturae no han cesado los intentos por conocer la Biodiversidad…, de la que por cierto nuestra especie, bautizada como Homo sapiens por el propio Linneo, es una recién llegada de apenas 200.000 años.

Ahora, hablaremos de la vida media de las partículas elementales (algunas no tanto). Cuando hablamos del tiempo de vida de una partícula nos estamos refiriendo al tiempo de vida media, una partícula que no sea absolutamente estable tiene, en cada momento de su vida, la misma probabilidad de desintegrarse. Algunas partículas viven más que otras, pero la vida media es una característica de cada familia de partículas.

También podríamos utilizar el concepto de “semivida”. Si tenemos un gran número de partículas idénticas, la semivida es el tiempo que tardan en desintegrarse la mitad de ese grupo de partículas. La semivida es 0,693 veces la vida media.

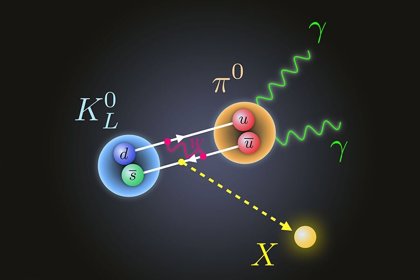

Si miramos una tabla de las partículas más conocidas y familiares (fotón, electrón muón tau, la serie de neutrinos, los mesones con sus piones, kaones, etc., y, los Hadrones bariones como el protón, neutrón, lambda, sigma, psi y omega, en la que nos expliquen sus propiedades de masa, carga, espín, vida media (en segundos) y sus principales maneras de desintegración, veríamos como difieren las unas de las otras.

Algunas partículas tienen una vida media mucho más larga que otras. De hecho, la vida media difiere enormemente. Un neutrón por ejemplo, vive 10¹³ veces más que una partícula Sigma⁺, y ésta tiene una vida 10⁹ veces más larga que la partícula sigma cero. Pero si uno se da cuenta de que la escala de tiempo “natural” para una partícula elemental (que es el tiempo que tarda su estado mecánico-cuántico, o función de ondas, en evolucionar u oscilar) es aproximadamente 10ˉ²⁴ segundos, se puede decir con seguridad que todas las partículas son bastantes estables. En la jerga profesional de los físicos dicen que son “partículas estables”.

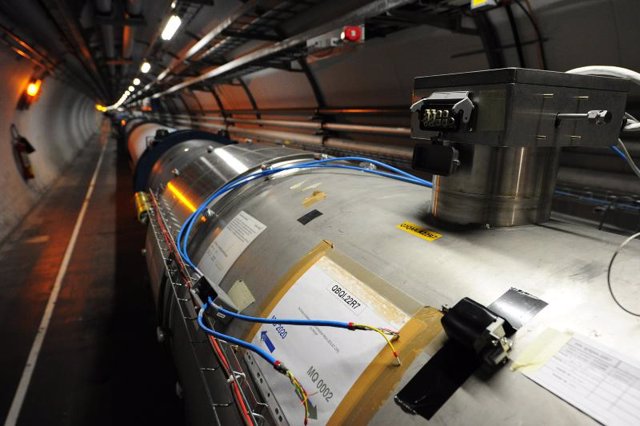

La vida media de una partícula se determina midiendo la distancia que recorre antes de desintegrarse. Para partículas de vida larga como el neutrón y el muón, se puede calcular midiendo su trayectoria en detectores como los del LHC, ya que recorren una distancia detectable antes de decaer. La vida media es una propiedad fundamental de cada partícula y se puede expresar como el tiempo que tarda la mitad de una muestra de partículas en desintegrarse, lo que se calcula a partir de la distribución de sus trayectorias.

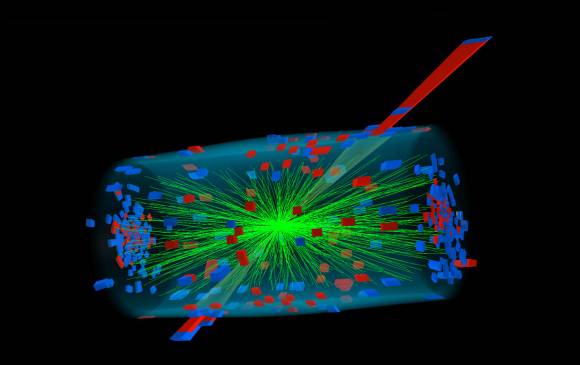

¿Cómo se determina la vida media de una partícula? Las partículas de vida larga, tales como el neutrón y el muón, tienen que ser capturadas, preferiblemente en grandes cantidades, y después se mide electrónicamente su desintegración. Las partículas comprendidas entre 10ˉ¹⁰ y 10ˉ⁸ segundos solían registrarse con una cámara de burbujas, pero actualmente se utiliza con más frecuencia la cámara de chispas. Una partícula que se mueve a través de una cámara de burbujas deja un rastro de pequeñas burbujas que puede ser fotografiado. La Cámara de chispas contiene varios grupos de de un gran número de alambres finos entrecruzados entre los que se aplica un alto voltaje. Una partícula cargada que pasa cerca de los cables produce una serie de descargas (chispas) que son registradas electrónicamente. La ventaja de esta técnica respecto a la cámara de burbujas es que la señal se puede enviar directamente a una computadora que la registra de manera muy exacta.

Una partícula eléctricamente neutra nunca deja una traza directamente, pero si sufre algún tipo de interacción que involucre partículas cargadas (bien porque colisionen con un átomo en el detector o porque se desintegren en otras partículas), entonces desde luego que pueden ser registradas. Además, realmente se coloca el aparato entre los polos de un fuerte imán. Esto hace que la trayectoria de las partículas se curve y de aquí se puede medir la velocidad de las partículas. Sin embargo, como la curva también depende de la masa de la partícula, es conveniente a veces medir también la velocidad de una forma diferente.

Una colisión entre un protón y un antiprotón registrada mediante una cámara de chispas del experimento UA5 del CERN. Lanzan haces de partículas a velocidades relativistas para hacerlas chocar y saber que sale de su interior, es la manera de conocer de qué está hecha la materia.

En un experimento de altas energías, la mayoría de las partículas no se mueven mucho más despacio que la velocidad de la luz. Durante su carta vida pueden llegar a viajar algunos centímetros y a partir de la longitud media de sus trazas se puede calcular su vida. Aunque las vidas comprendidas entre 10ˉ¹³ y 10ˉ²⁰ segundos son muy difíciles de medir directamente, se pueden determinar indirectamente midiendo las fuerzas por las que las partículas se pueden transformar en otras. Estas fuerzas son las responsables de la desintegración y, por lo tanto, conociéndolas se puede calcular la vida de las partículas, Así, con una pericia ilimitada los experimentadores han desarrollado todo un arsenal de técnicas para deducir hasta donde sea posible todas las propiedades de las partículas. En algunos de estos procedimientos ha sido extremadamente difícil alcanzar una precisión alta. Y, los datos y números que actualmente tenemos de cada una de las partículas conocidas, son los resultados acumulados durante muchísimos años de medidas experimentales y de esa manera, se puede presentar una información que, si se valorara en horas de trabajo y coste de los proyectos, alcanzaría un precio descomunal pero, esa era, la única manera de ir conociendo las propiedades de los pequeños componentes de la materia.

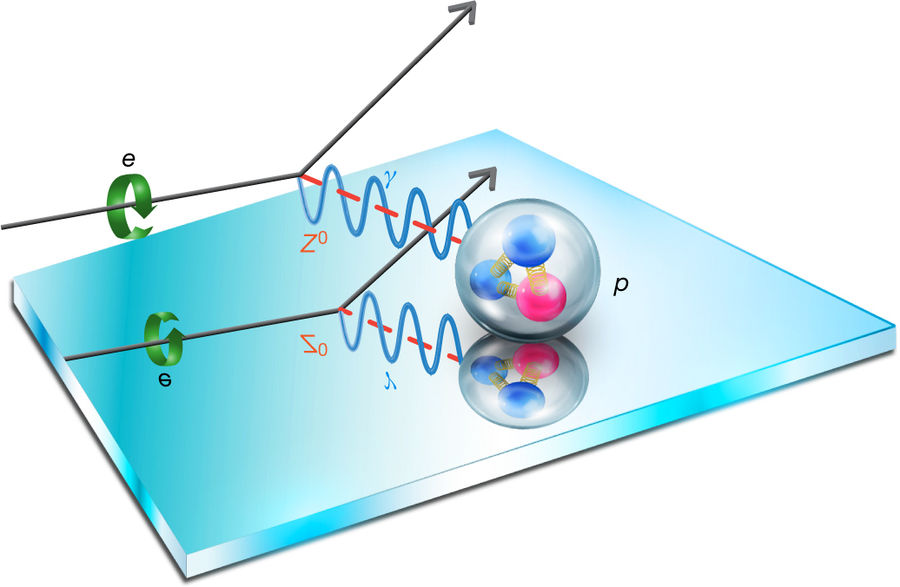

Colisionando particulas leptones tau positivos y negativos encontraron los Bosones W+ y W-.

Que la mayoría de las partículas tenga una vida media de 10ˉ⁸ segundos significa que son ¡extremadamente estables! La función de onda interna oscila más de 10²² veces/segundo. Este es el “latido natural de su corazón” con el cual se compara su vida. Estas ondas cuánticas pueden oscilar 10ˉ⁸ x 10²², que es 1¹⁴ o 100.000.000.000.000 veces antes de desintegrarse de una u otra manera. Podemos decir con toda la seguridad que la interacción responsable de tal desintegración es extremadamente débil.

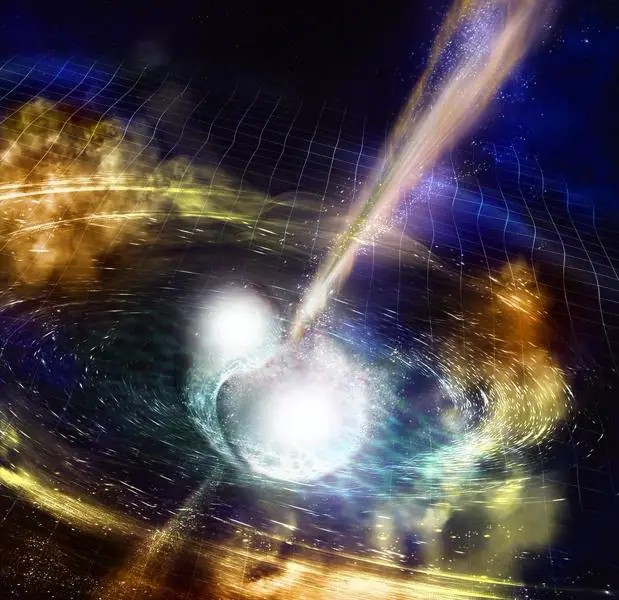

Se habla de ondas cuánticas y también, de ondas gravitacionales. Las primeras han sido localizadas y las segundas están siendo perseguidas.

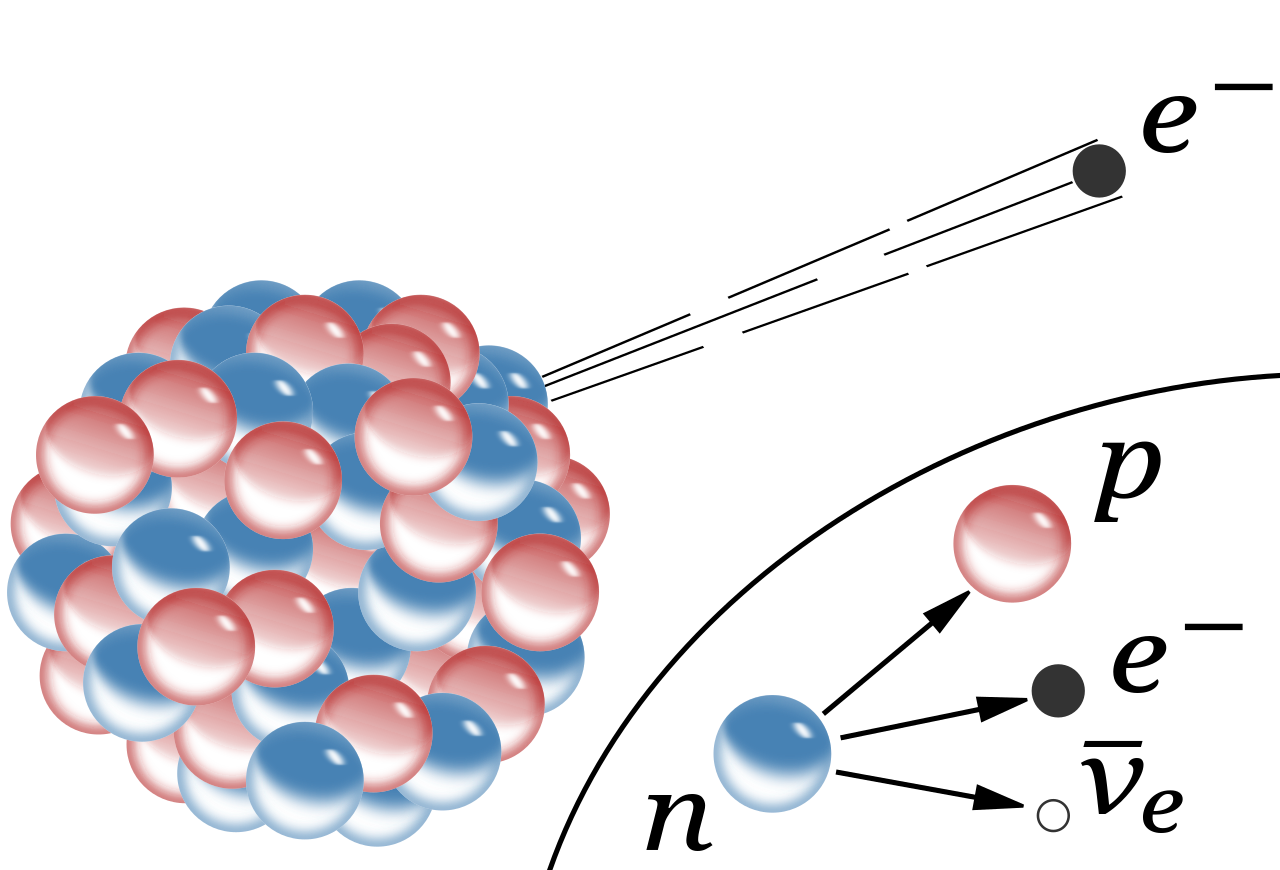

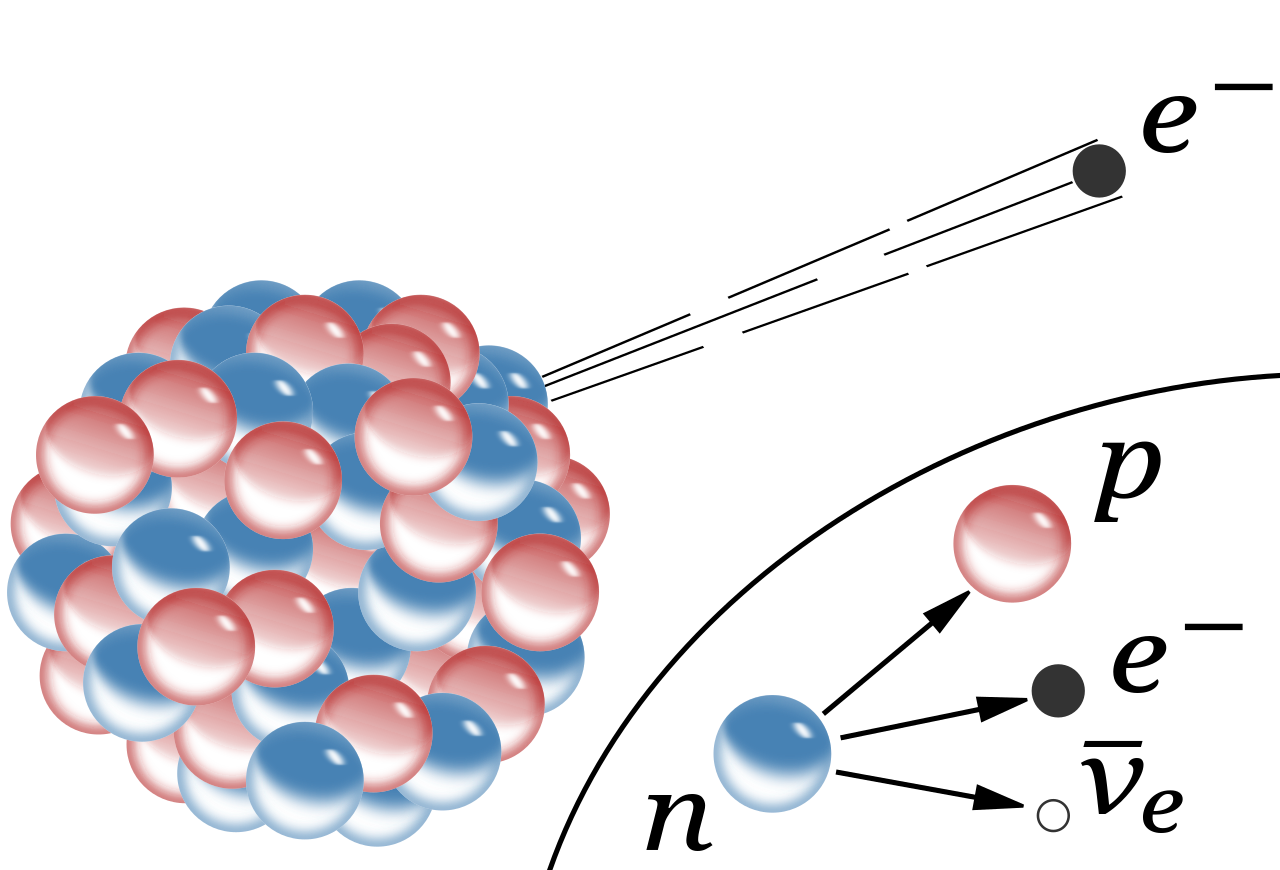

Aunque la vida de un neutrón sea mucho más larga (en promedio un cuarto de hora), su desintegración también se puede atribuir a la interacción débil. A propósito, algunos núcleos atómicos radiactivos también se desintegran por interacción débil, pero pueden necesitar millones e incluso miles de millones de años para ello. Esta amplia variación de vidas medias se puede explicar considerando la cantidad de energía que se libera en la desintegración. La energía se almacena en las masas de las partículas según la bien conocida fórmula de Einstein E = Mc². Una desintegración sólo puede tener lugar si la masa total de todos los productos resultantes es menor que la masa de la partícula original. La diferencia entre ambas masas se invierte en energía de movimiento. Si la diferencia es grande, el proceso puede producirse muy rápidamente, pero a menudo la diferencia es tan pequeña que la desintegración puede durar minutos o incluso millones de años. Así, lo que determina la velocidad con la que las partículas se desintegran no es sólo la intensidad de la fuerza, sino también la cantidad de energía disponible.

Si no existiera la interacción débil, la mayoría de las partículas serían perfectamente estables. Sin embargo, la interacción por la que se desintegran las partículas π°, η y Σ° es la electromagnética. Se observará que estas partículas tienen una vida media mucho más corta, aparentemente, la interacción electromagnética es mucho más fuerte que la interacción débil.

Durante la década de 1950 y 1960 aparecieron tal enjambre de partículas que dio lugar a esa famosa anécdota de Fermi cuando dijo: “Si llego a adivinar esto me hubiera dedicado a la botánica.”

Si la vida de una partícula es tan corta como 10ˉ²³ segundos, el proceso de desintegración tiene un efecto en la energía necesaria para producir las partículas ante de que se desintegre. Para explicar esto, comparemos la partícula con un diapasón que vibra en un determinado modo. Si la “fuerza de fricción” que tiende a eliminar este modo de vibración es fuerte, ésta puede afectar a la forma en la que el diapasón oscila, porque la altura, o la frecuencia de oscilación, está peor definida. Para una partícula elemental, esta frecuencia corresponde a su energía. El diapasón resonará con menor precisión; se ensancha su curva de resonancia. Dado que para esas partículas extremadamente inestable se miden curvas parecidas, a medida se las denomina resonancias. Sus vidas medias se pueden deducir directamente de la forma de sus curvas de resonancia.

Bariones Delta. Un ejemplo típico de una resonancia es la delta (∆), de la cual hay cuatro especies ∆ˉ, ∆⁰, ∆⁺ y ∆⁺⁺(esta última tiene doble carga eléctrica). Las masas de las deltas son casi iguales 1.230 MeV. Se desintegran por la interacción fuerte en un protón o un neutrón y un pión.

Existen tanto resonancias mesónicas como bariónicas . Las resonancias deltas son bariónicas. Las resonancias deltas son bariónicas. (También están las resonancias mesónicas rho, P).

Las resonancias parecen ser solamente una especie de versión excitada de los Hadrones estable. Son réplicas que rotan más rápidamente de lo normal o que vibran de diferente manera. Análogamente a lo que sucede cuando golpeamos un gong, que emite sonido mientras pierde energía hasta que finalmente cesa de vibrar, una resonancia termina su existencia emitiendo piones, según se transforma en una forma más estable de materia.

Por ejemplo, la desintegración de una resonancia ∆ (delta) que se desintegra por una interacción fuerte en un protón o neutrón y un pión, por ejemplo:

∆⁺⁺→р + π⁺; ∆⁰→р + πˉ; o п+π⁰

En la desintegración de un neutrón, el exceso de energía-masa es sólo 0,7 MeV, que se puede invertir en poner en movimiento un protón, un electrón y un neutrino. Un Núcleo radiactivo generalmente tiene mucha menos energía a su disposición.

El estudio de los componentes de la materia tiene una larga historia en su haber, y, muchos son los logros conseguidos y muchos más los que nos quedan por conseguir, ya que, nuestros conocimientos de la masa y de la energía (aunque nos parezca lo contrario), son aún bastante limitados, nos queda mucho por descubrir antes de que podamos decir que dominamos la materia y sabemos de todos sus componentes. Antes de que eso llegue, tendremos que conocer, en profundidad, el verdadero origen de la Luz que esconde muchos secretos que tendremos que desvelar.

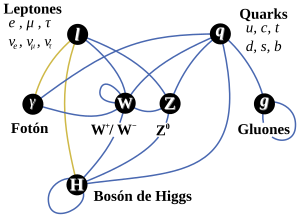

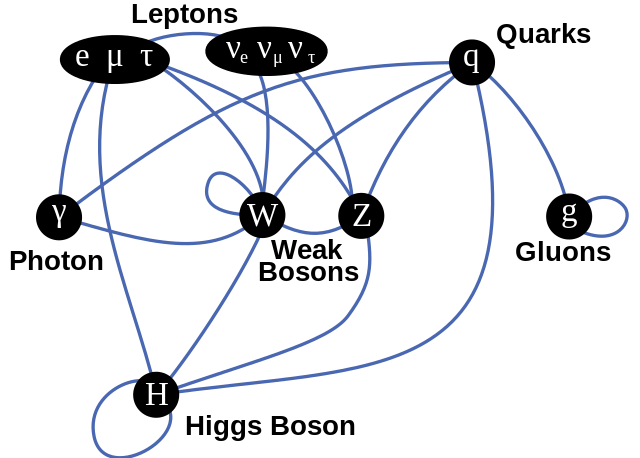

Esperemos que con los futuros experimentos del LHC y de los grandes Aceleradores de partículas del futuro, se nos aclaren algo las cosas y podamos avanzar en el perfeccionamiento del Modelo Estándar de la Física de Partículas que, como todos sabemos es un Modelo incompleto que no contiene a todas las fuerzas de la Naturaleza y, cerca de una veintena de sus parámetros son aleatorios y no han sido explicados. Uno de ellos, el Bosón de Higgs, dicen que ha sido encontrado. Sin embargo, a mí particularmente me quedan muchas dudas al respecto.

Emilio Silvera V.

Nov

13

La perfección imperfecta

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

Me refiero al Modelo estándar y, algunos han llegado a creer que sólo faltan algunos detalles técnicos y, con ellos, la física teórica está acabada. Tenemos un modelo que engloba todo lo que deseamos saber acerca de nuestro mundo físico. ¿Qué más podemos desear?

Bueno, lo que hasta el momento hemos logrado no está mal del todo pero, no llega, ni con mucho, a la perfección que la Naturaleza refleja y que, nosotros perseguimos sin llegar a poder agarrar sus múltiples entresijos y parámetros que conforman ese todo en el que, sin ninguna clase de excusas, todo debe encajar y, de momento, no es así.

Es cierto que, el Modelo estándar, es casi perfecto (en algunos momentos), pero no permanentemente perfecto. En primer lugar, podríamos empezar a quejarnos de las casi veinte constantes que no se pueden calcular. Pero si esta fuese la única queja, habría poco que hacer. Desde luego, se han sugerido numerosas ideas para explicar el origen de estos números y se han propuesto varias teorías para “predecir” sus valores. El problema con todas estas teorías es que los argumentos que dan nunca llegan a ser convincentes.

¿Por qué se iba a preocupar la Naturaleza de una fórmula mágica si en ausencia de tal fórmula no hubiera contradicciones? Lo que realmente necesitamos es algún principio fundamental nuevo, tal como el proncipio de la relatividad, pero nos resistimos a abandonar todos los demás principios que ya conocemos; ¡esos, después de todo, han sido enormemente útiles en el descubrimiento del Modelo estándar! una herramienta que posibilitado a todos los físicos del mundo, construir sus trabajos en ese fascinante mundo de la mecánica cuántica, donde partículas infinitesimales interactúan con las fuerzas y podemos ver, como se comporta la materia en determinadas circunstancias. El mejor lugar para buscar nuevos principios es precisamente donde se encuentran los puntos débiles de la presente teoría.

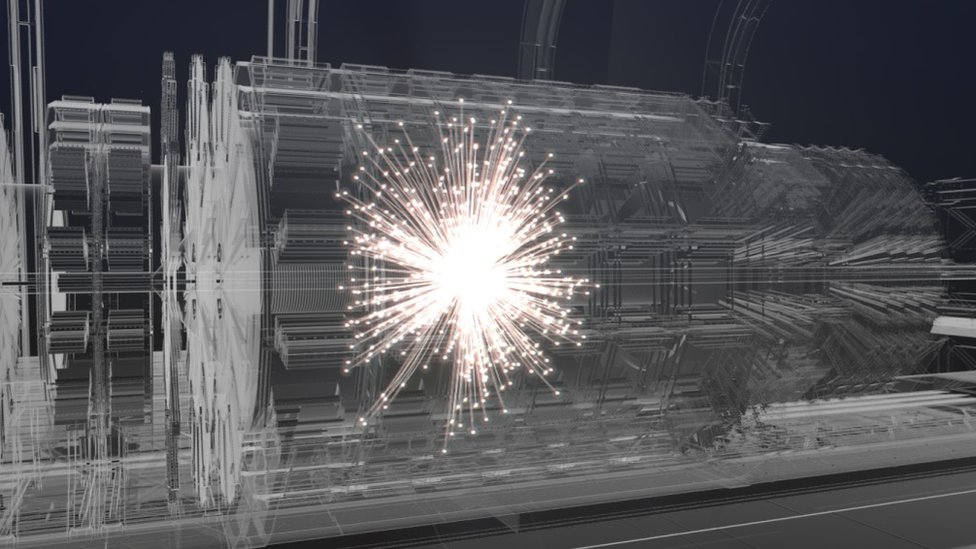

La regla universal en la física de partículas es que cuando las partículas chocan con energías cada vez mayores, los efectos de las colisiones están determinados por estructuras cada vez menores, más pequeñas en el espacio y en el tiempo. Supongamos por un momento que tenemos a nuestra disposición un Acelerador de Partículas 10.000 veces más potente que el LHC, donde las partículas pueden adquirir esas tantas veces más energías de las alcanzadas actualmente. Las colisiones que tendrían lugar nos dirían algo acerca de los detalles estructurales de esas partículas que ahora no conocemos, que serían mucho más pequeños que los que ahora podemos contemplar. En este punto se me ocurre la pregunta: ¿Seguiría siendo correcto el Modelo estándar? 0, por el contrario, a medida que nos alejemos en las profundidades de lo muy pequeño, también sus normas podrían variar al mismo tiempo que varían las dimensiones de los productos hallados. Recordad que, el mundo no funciona de la misma manera ante lo grande que ante lo infinitesimal.

El LHC cuando se puso en marcha, tardó menos de un mes en localizar el ‘bosón W’, que durante mucho tiempo estaba siendo perseguido por todos los físicos del mundo. Hacía falta un inmenso conglomerado de energía para llegar hasta él.

El Gran Colisionador de Hadrones (LHC, por sus siglas en inglés), de la Organización Europea de Física Nuclear (CERN, por sus siglas en inglés), ha obtenido en apenas un mes de funcionamiento los primeros resultados “espectaculares” en su investigación, el ‘bosón W’, que hasta ahora los científicos tardaban meses en conseguir.

De momento sólo se han utilizado 14 TeV y próximamente se llegará a los 100

¿Podéis imaginar conseguir colisiones a 70.000 TeV? ¿Qué podrías ver? Y, entonces, seguramente, las protestas de algunas de que “ese monstruo” podría abrir un agujero de gusano en el espacio tiempo…¡tendría algún fundamento! No sabemos lo que puede pasar si andamos con fuerzas que no podemos dominar.

Hoy, el Modelo estándar es una construcción matemática que predice sin ambigüedad cómo debe ser el mundo de las estructuras aun más pequeñas. Pero tenemos algunas razones para sospechar que tales predicciones resultan estar muy alejadas de la realidad, o, incluso, ser completamente falsas.

Encendamos nuestro super-microscopio imaginario y enfoquémoslo directamente en el centro de un protón o de cualquier otra partícula. Veremos hordas de partículas fundamentales desnudas pululando. Vistas a través del supermicroscopio, el modelo estándar que contiene veinte constantes naturales, describen las fuerzas que rigen la forma en que se mueven. Sin embargo, ahora esas fuerzas no sólo son bastante fuertes sino que también se cancelan entre ellas de una forma muy especial; están ajustadas para conspirar de tal manera que las partículas se comportan como partículas ordinarias cuando se vuelven a colocar el microscopio en la escala de ampliación ordinaria. Si en nuestras ecuaciones matemáticas cualquiera de estas constantes fueran reemplazadas por un número ligeramente diferente, la mayoría de las partículas obtendrían inmediatamente masas comparables a las gigantescas energías que son relevantes en el dominio de las muy altas energías. El hecho de que todas las partículas tengan masa que corresponden a energías mucho menores repentinamente llega a ser bastante poco natural.

¿Implica el ajuste fino un diseño con propósito? Hay tantos parámetros que deben tener un ajuste fino y el grado de ajuste fino es tan alto, que no parece posible ninguna otra conclusión.

Bueno, quizá en la imagen y el comentario que lleva abajo, me he podido pasar un poco. Lo que antes decía: “El hecho de que todas las partículas tengan masa que corresponden a energías mucho menores repentinamente llega a ser bastante poco natural”, es lo que se llama el “problema del ajuste fino”. Vistas a través del microscopio, las constantes de la Naturaleza parecen estar cuidadosamente ajustadas sin ninguna otra razón aparente que hacer que las partículas parezcan lo que son. Hay algo muy erróneo aquí. Desde un punto de vista matemático, no hay nada que objetar, pero la credibilidad del Modelo estándar se desploma cuando se mira a escalas de tiempo y longitud extremadamente pequeñas o, lo que es lo mismo, si calculamos lo que pasaría cuando las partículas colisionan con energías extremadamente altas.

¿Y por qué debería ser el modelo válido hasta ahí? Podrían existir muchas clases de partículas súper pesadas que no han nacido porque se necesitan energías aún inalcanzables, e ellas podrían modificar completamente el mundo que Gulliver planeaba visitar. Si deseamos evitar la necesidad de un delicado ajuste fino de las constantes de la Naturaleza, creamos un nuevo problema:

… fuerzas y podemos ver, como se comporta la materia en determinadas circunstancias. El mejor lugar para buscar nuevos principios es precisamente donde se …

¿Cómo podemos modificar el modelo estándar de tal manera que el ajuste-fino no sea necesario? Está claro que las moficiaciones son necesarias , lo que implica que muy probablemente hay un límite más allá del cual ewl modelo deja de ser válido. El Modelo estándar no será más que una aproximación matemática que hemos sido capaces de crear, tal que todos los fenómenos observados hasta el presente están de acuerdo con él, pero cada vez que ponemos en marcha un aparato más poderoso, debemos esperar que sean necesarias nuevas modificaciones para ir ajustando el modelo, a la realidad que descubrimos.

¿Cómo hemos podido pensar de otra manera? ¿Cómo hemos tenido la “arrogancia” de pensar que podemos tener la teoría “definitiva”? Mirando las cosas de esta manera, nuestro problema ahora puede muy bien ser el opuesto al que plantea la pregunta de dónde acaba el modelo estándar: ¿Cómo puede ser que el modelo estándar funcione tan extraordinariamente bien? y ¿por qué aún no hemos sido capaces de percibir nada parecido a otra generación de partículas y fuerzas que no encajen en el modelo estándar?

Nos quedan muchas cosas por descubrir

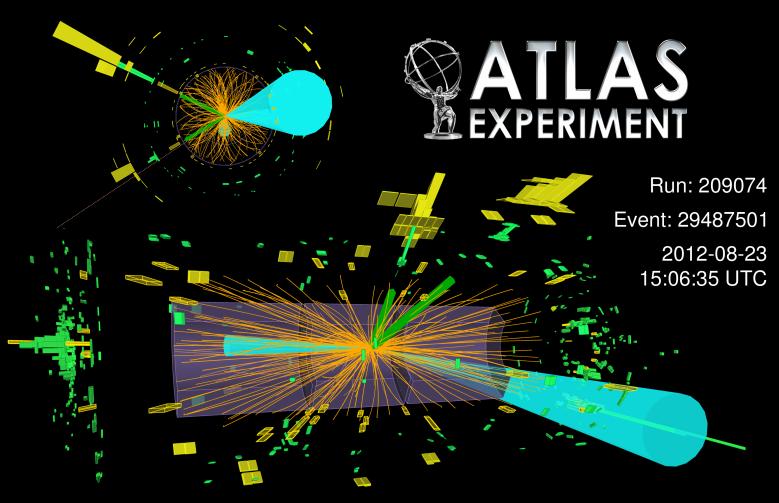

Asistentes escuchan la presentación de los resultados del experimento ATLAS, durante el seminario del Centro Europeo de Física de Partículas (CERN) para presentar los resultados de los dos experimentos paralelos que buscan la prueba de la existencia de la “partícula de Higgs”, uno de los 20 parámetros (metidos con calzador en el Modelo) que faltan por hallar para completarlo.

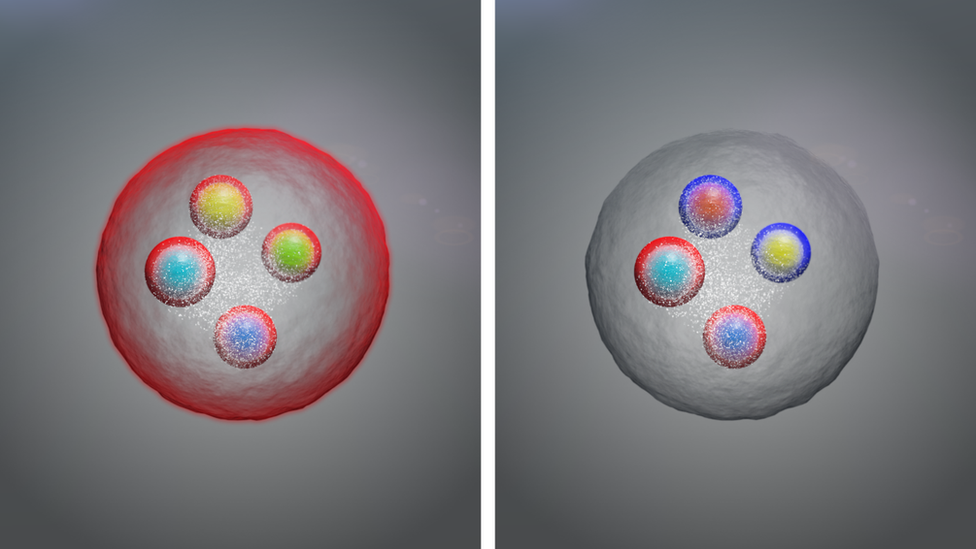

El hallazgo más reciente de una nueva partícula elemental, anunciado en julio de 2022 por el CERN, un nuevo tipo de penta-quark y un par de tetra-quarks, ambos detectados en el experimento LHCb. Además, a principios de 2025, se teorizó sobre la existencia de un nuevo tipo de partícula elemental llamada para-partícula, que podría redefinir la clasificación de fermiones y bosones.

El experimento LHCb

La pregunta “¿Qué hay más allá del Modelo estándar”? ha estado fascinando a los físicos durante años. Y, desde luego, todos sueñan con llegar a saber, qué es lo que realmente es lo que conforma el “mundo” de la materia, qué partículas, cuerdas o briznas vibrantes. En realidad, lo cierto es que, la Física que conocemos no tiene que ser, necesariamente, la verdadera física que conforma el mundo y, sí, la física que conforma “nuestro mundo”, es decir, el mundo al que hemos podido tener acceso hasta el momento y que, no necesariamente tiene que tratarse del mundo real.

O, como decía aquél: ¡Que mundo más hermoso, parece de verdad!

No todo lo que vemos es, necesariamente, un reflejo de la realidad de la Naturaleza que, puede tener escondidos más allá de nuestras percepciones, otros escenarios y otros objetos, a los que, por ahora, no hemos podido acceder, toda vez que, físicamente tenemos carencias, intelectualmente también, y, nuestros conocimientos avanzar despacio para conseguir, nuevas máquinas y tecnologías nuevas que nos posibiliten “ver” lo que ahora nos está “prohibido” y, para ello, como ocurre siempre, necesitamos energías de las que no disponemos.

Hay dos direcciones a lo largo de las cuales se podría extender el Modelo estándar, tal como lo conocemos actualmente, que básicamente se caracterizan así:

– Nuevas partículas raras y nuevas fuerzas extremadamente débiles, y

– nuevas partículas pesadas y nuevas estructuras a muy altas energías.

Esquema simplificado que ilustra la colisión entre dos protones de alta energía y la aparición de partículas de mayor masa que estos tras la colisión.

Podrían existir partículas muy difíciles de producir y de detectar y que, por esa razón, hayan pasado desapercibidas hasta ahora. La primera partícula adicional en la que podríamos pensares un neutrino rotando a derecha. Recordaremos que si se toma el eje de rotación paralelo a la dirección del movimiento los neutrinos sólo rotan a izquierdas pero, esa sería otra historia.

En un artículo que no recuerdo donde fue publicado, pude leer:

“Los interferómetros atómicos tienen ahora la sensibilidad para observar nuevas fuerzas más allá del modelo estándar de la física de partículas. Las nuevas fuerzas a corta distancia son una predicción frecuente de las teorías más allá del Modelo Estándar y la búsqueda de estas nuevas fuerzas es un canal prometedor para descubrir una nueva física”, dice Jay Wackerdel Laboratorio del Acelerador Nacional SLAC en California. La pregunta es cómo encontrarlas.”

Los neutrinos siempre me han fascinado. Siempre se han manifestado como si tuvieran masa estrictamente nula. Parece como si se movieran exactamente con la velocidad de la luz. Pero hay un límite para la precisión de nuestras medidas. Si los neutrinos fueran muy ligeros, por ejemplo, una cienmillonésima parte de la masa del electrón, seríamos incapaces de detectar en el laboratorio la diferencia entre éstos y los neutrinos de masa estrictamente nula. Pero, para ello, el neutrino tendría que tener una componente de derechas.

En este punto, los astrónomos se unen a la discusión. No es la primera vez, ni será la última, que la astronomía nos proporciona información esencial en relación a las partículas elementales. Por ejemplo, debido a las interacciones de corriente neutra (las interacciones débiles originadas por un intercambio Zº), los neutrinos son un facto crucial en la explosión supernova de una estrella. Ahora sabemos que debido a las interacciones por corriente neutra, pueden colisionar con las capas exteriores de la estrella y volarlas con una fuerza tremenda.

El Sol emite billones de neutrinos

Desde hace 75 años, los físicos saben que la energía de las estrellas es generada en su núcleo a través de una cadena de reacciones nucleares que convierten hidrógeno en helio, proceso conocido como nucleosíntesis estelar. Sin embargo, las partículas denominadas neutrinos pp, uno de los subproductos principales de la reacción que inicia esa cadena, no habían podido ser detectadas hasta ahora.

En realidad, los neutrinos nos tienen mucho que decir, todavía y, no lo sabemos todo acerca de ellos, sino que, al contrario, son muchos los datos y fenómenos que están y subyacen en ellos de los que no tenemos ni la menor idea que existan o se puedan producir. Nuestra ignorancia es grande, y, sin embargo, no nos arredra hablar y hablar de cuestiones que, la mayoría de las veces…ni comprendemos.

Aquí lo dejaré por hoy, el tema es largo y de una fascinación que te puede llevar a lugares en los que no habías pensado al comenzar a escribir, lugares maravillosos donde reinan objetos exóticos y de fascinante porte que, por su pequeñez, pueden vivir en “mundos” muy diferentes al nuestro en los que, ocurren cosas que nos llevan hacia el asombro y también, a ese mundo mágico de lo fascinante y maravilloso.

Lo que siempre digo y no dejaré de repetir… ¡Sabemos tan poco!

Emilio Silvera V.

Nov

9

El adimensional 137

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

La red de materia libre ha de ser de estructura cúbica curva, la más simple, es decir un cubo según la superficie esférica. Pero en la superficie esférica los ocho elementos del cubo se distribuyen equidistantes, de tal forma que cada dos quedan comprendidos en una superficie pr² de las 4 que componen la superficie esférica: S = 4pr².

La probabilidad de choque o interacción de esos ocho elementos con los adyacentes en igual configuración de red es de 3, los elementos más probables por encontrarse más cerca y en las tres direcciones de avance.

Los elementos que resultan de las combinaciones, se combinarán a su vez en la misma probabilidad o número, 3.

El número total de elementos recombinados hasta la materia normal para una estructura cúbica de red sería:

8 x3 composiciones de 2 elementos en primera combinación.

(8×3) x2 elem. de la primera combinación, x 3 nuevas combinaciones, x 3 elementos cada una (mayoritarios para combinaciones elementales m. normal):

24 x3³

Pero esto sería si todos los elementos poseyeran la misma probabilidad de combinarse, lo que no es así.

En su movida cada uno de ellos podría ocupar una superficie r², su abanico de avance, lo cual se cumple. Entonces tendríamos:

( 24 x3³) r²

El cuadrado esférico o esfera de red sólo podría avanzar en el sentido de una de sus caras (2 elementos) de las cuatro equivalentes a pr².

El número total de elementos combinados que correspondería a toda la esfera o cuadrado esférico habrá que dividirlo por pr²; y ya que en dicha división r² se anula:

24 x3³/p = 137, 5098

Este valor será exacto si se consideran las pequeñas oscilaciones de los elementos que les influyen en su mutua probabilidad de combinación (choque).

De manera más explícita, y considerando la vibración fundamental de los elementos:

Con la simple visualización del esquema pudiera interpretarse que una partícula da lugar a 137, lo que no es, cada una de ellas dispone en el medio de otras como materia prima para combinarse o recombinarse.

NOTA. Ya se vio en otro de nuestros trabajos cual era el origen de la oscilación intrínseca. Aquella, fundamental, que no depende de la vibración calórica o de la energía sino del giro siempre presente en las partículas y su “descentrado” debido a la inexactitud de los cuantos: su pequeña asimetría. Dicho “estremecimiento” constituye un desahogo o margen propio para cada partícula junto a las otras en las uniones, y puede identificarse con el doble de la tolerancia mínima.

Consideraciones sobre el 137

Sea como sea, este número de elementos correspondería a la totalidad de los primordiales que componen la materia “másica” a partir de una estructura elemental de red.

Aquellos elementos primordiales que no consiguiesen la combinación permanecerán en su estado libre (espuma cuántica) como componentes de la abundante energía oscura.

Pero en la globalidad, en el total de energía oscura, el conjunto de cubos esféricos podrá actuar aleatoriamente por cualquiera de sus cuatro lados. De ello se deduce que la probabilidad de combinación para toda la energía oscura será de ¼, con lo que la primera generación de partículas, la materia oscura propiamente hablando, se generaría según un 25%. La siguiente generación también se generará como un 25% del 25% de esa materia generadora, la materia oscura, con lo que su porcentaje sería del 6% aprox. sin tener en cuenta otras incidencias.

Estos porcentajes teóricos oscilaran según el margen vibratorio, o los desvíos desde la uniformidad para sitios localizados, por lo que los valores no pueden ser exactos. Pero todo ello sería corregible si dichas magnitudes se conocieran.

Por otro lado, si se supiese la diferencia dimensional entre los distintos estamentos se sabría el aumento de volumen o tamaño en la evolución hasta el presente, consiguientemente la variación de volumen y el valor de la expansión, pues, como sabemos, viene generada por la presión oscura.

Claro, que todo lo dicho se ha supuesto para “generaciones en frío”. Pero en la globalidad, seguramente los fenómenos de alta presión y temperatura, no son causa, sino consecuencia de las propias generaciones en frío, que las provoquen por su acción gravitatoria, es decir que en promedio serán las materias oscuras las responsables de la expansión, y más si se considera su dominio porcentual en el Universo.

Se observa que los ordenes de dimensión conocidos comienzan a separarse notoriamente a partir de 10^-17 o 10^-18. Seguramente se pueda decir que los órdenes de dimensión hacia abajo también varíen en forma cuadrática. En este supuesto, no sería difícil calcular el volumen de ahora partiendo de las combinaciones desde la estructura de red cúbica.

Es de suponer que el 137 como número de combinaciones sea constante, y que no sea necesario partir de la energía-materia oscura para que dicho número se cumpla, sino que sea válido allá donde existan los tres saltos combinatorios equivalentes. Igual ha de ocurrir para que el fotón libre se integre al electrón. Por ello, y en principio, suponemos para éste una estructura triple.

De la Teoría de Landau del líquido de Fermi ya puede extraerse la existencia de espinones y holones. Y la existencia de híper partículas ocurre en niveles de temperatura muy bajos según la distribución Bose-Einstein.

La onda partícula electrón:

Imaginamos como más lógica una estructura de tres anillos para el electrón. Primero, porque el movimiento extensivo por causa del espín abarcaría toda la partícula. Segundo, como forma de que, aun siendo una partícula compuesta, posea una resultante de carga negativa.

Según sea la dirección de avance, dos de los anillos se comportarían como ondas ligadas perpendiculares, neutras en conjunto (al estilo del fotón).

El tercer anillo, desapareado, perpendicular a los anteriores, como onda envolvente daría la carga electrónica (siempre que gire en la forma directa; en la retrógrada se trataría de un positrón).

Los dos primeros se constituirían de espinones (no aportan carga, sólo aportan espín, como ocurre al fotón).

El otro se compondría de holones (sólo aportan carga y no espín).

Espinones y holones serían una manera de designar sus funciones, inter-cambiantes según la dirección de desplazamiento global de la partícula, y de forma continua seguramente.

Podríamos decir que el electrón sea la suma de un súper fotón muy masivo y un anillo halo responsable de su carga.

La constante de estructura fina.

La absorción de un fotón por parte de un electrón supondrá su combinación interna desde uno a tres elementos. Como se ha visto el número total de componentes habrá de ser 137.

Por el contrario, la emisión de fotones ocurrirá por el fraccionamiento de una subpartícula electrónica que no obstante permanecería reestructurada a falta de un sólo fotón en sus prolíficos anillos de componentes casi libres.

La constante de estructura fina se puede expresar como:

O lo que es lo mismo, la energía para traer dos electrones hasta una distancia S dividida por la energía de un fotón con longitud de onda igual a 2pS.

Ello nos indica que la energía electrónica de carga es 137 veces la energía del fotón, o lo que es lo mismo, la masa o número de elementos para la emisión o absorción es de 1 a 137 (equivalencia masa y energía).

Las subpartículas propicias del electrón para emisión o absorción de fotones poseerán una masa equivalente a 137 de la del fotón.

El 137 expresaría por tanto la cuantificación combinatoria en la expansión y el resultado fraccionario en la concentración, si, en según que condiciones externas, ambos procesos son reversibles.

Autor:

Fandila Soria

Granada, – Julio- 2011

Nov

5

Buscando la Gravedad cuántica

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (14)

Comments (14)

No será nada fácil lograr el casamiento de la Relatividad con la Cuántica. El Modelo Estándar adolece de que la Gravedad no está presente, cuando tratan de juntar la Cuántica con la Gravedad… ¡Aquello rechina! Surgen infinitos que no se pueden evitar.

Entre los teóricos, el casamiento de la relatividad general y la teoría cuántica es el problema central de la física moderna. A los esfuerzos teóricos que se realizan con ese propósito se les llama “super-gravedad”, “súper-simetría”, “supercuerdas” “teoría M” o, en último caso, “teoría de todo o gran teoría unificada”.

los teóricos, el casamiento de la relatividad general y la teoría cuántica es el problema central de la física moderna. A los esfuerzos teóricos que se realizan con ese propósito se les llama “super-gravedad”, “súper-simetría”, “supercuerdas” “teoría M” o, en último caso, “teoría de todo o gran teoría unificada”.

Ahí tenemos unas matemáticas exóticas que ponen de punta hasta los pelos de las cejas de algunos de los mejores matemáticos del mundo (¿y Perelman? ¿Por qué nos se ha implicado?). Hablan de 10, 11 y 26 dimensiones, siempre, todas ellas espaciales menos una que es la temporal. Vivimos en cuatro: tres de espacio (este-oeste, norte-sur y arriba-abajo) y una temporal. No podemos, ni sabemos o no es posible instruir, en nuestro cerebro (también tridimensional), ver más dimensiones. Pero llegaron Kaluza y Klein y compactaron, en la longitud de Planck las dimensiones que no podíamos ver. ¡Problema solucionado!

los pelos de las cejas de algunos de los mejores matemáticos del mundo (¿y Perelman? ¿Por qué nos se ha implicado?). Hablan de 10, 11 y 26 dimensiones, siempre, todas ellas espaciales menos una que es la temporal. Vivimos en cuatro: tres de espacio (este-oeste, norte-sur y arriba-abajo) y una temporal. No podemos, ni sabemos o no es posible instruir, en nuestro cerebro (también tridimensional), ver más dimensiones. Pero llegaron Kaluza y Klein y compactaron, en la longitud de Planck las dimensiones que no podíamos ver. ¡Problema solucionado!

¿Quién puede ir a la longitud de Planck para

ir a la longitud de Planck para medirla?

medirla?

Ni vemos la longitud de Planck ni las dimensiones extra

La puerta de las dimensiones más altas quedó abierta y, a los teóricos, se les regaló una herramienta maravillosa. En el Hiperespacio, todo es posible. Hasta el matrimonio de la relatividad general y la mecánica cuántica, allí si es posible encontrar esa soñada teoría de la Gravedad cuántica.

el matrimonio de la relatividad general y la mecánica cuántica, allí si es posible encontrar esa soñada teoría de la Gravedad cuántica.

Así que, los teóricos, se han embarcado a la búsqueda de un objetivo audaz: buscan una teoría que describa la simplicidad primigenia que reinaba en el intenso calor del universo en sus primeros tiempos, una teoría carente de parámetros, donde estén presentes todas las respuestas. Todo debe ser contestado a partir de una ecuación básica.

¿Dónde radica el problema?

Nuestro universo es tridimensional y no podemos ver otro más allá… ¡si existe!

El problema está en que la única teoría candidata no tiene conexión directa con el mundo de la observación, o no lo tiene todavía si queremos expresarnos con propiedad. La energía necesaria para ello, no la tiene ni el nuevo acelerador de partículas LHC que con sus 14 TeV no llegaría ni siquiera a vislumbrar esas cuerdas vibrantes de las que tanto se habla.

conexión directa con el mundo de la observación, o no lo tiene todavía si queremos expresarnos con propiedad. La energía necesaria para ello, no la tiene ni el nuevo acelerador de partículas LHC que con sus 14 TeV no llegaría ni siquiera a vislumbrar esas cuerdas vibrantes de las que tanto se habla.

La verdad es que, la teoría que ahora tenemos, el Modelo Estándar, concuerda de manera exacta con todos los datos a bajas energías y contesta cosas sin sentido a altas energías.

a bajas energías y contesta cosas sin sentido a altas energías.

Con sus 20 parámetros aleatorios (parece que uno de ellos ha sido hallado -el bosón de Higgs-), el Modelo estándar de la f´çisica de partículas que incluye sólo tres de las interacicones fundamentales -las fuerzas nucleares débil y fuerte y el electromagnetismo-, ha dado un buen resultado y a permitido a los físicos trabajar ampliamente en el conocimiento del mundo, de la Naturaleza, del Universo. Sin embargo, deja muchas preguntas sin contestar y, lo cierto es que, se necesitan nuevas maneras, nuevas formas, nuevas teorías que nos lleven más allá.

¡Necesitamos algo más avanzado!

Se ha dicho que la función de la partícula de Higgs es la de dar masa a las partículas que conocemos y están incluidas en el Modelo estándar, se nos ha dicho que ha sido encontrada pero , nada se ha dicho de cómo ésta partícula transmite la masa a las demás. Faltan algunas explicaciones.

, nada se ha dicho de cómo ésta partícula transmite la masa a las demás. Faltan algunas explicaciones.

El secreto de todo radica en conseguir la simplicidad: el átomo resulto ser complejo lleno de esas infinitesimales partículas electromagnéticas que bautizamos con el nombre de electrones, resultó que tenía un núcleo que contenía, a pesar de ser tan pequeño, casi toda la masa del átomo. El núcleo, tan pequeño, estaba compuesto de otros objetos más pequeños aún, los quarks que estaban instalados en nubes de otras partículas llamadas gluones y, ahora

de electrones, resultó que tenía un núcleo que contenía, a pesar de ser tan pequeño, casi toda la masa del átomo. El núcleo, tan pequeño, estaba compuesto de otros objetos más pequeños aún, los quarks que estaban instalados en nubes de otras partículas llamadas gluones y, ahora , queremos continuar profundizando, sospechamos, que después de los quarks puede

, queremos continuar profundizando, sospechamos, que después de los quarks puede haber algo más.

haber algo más.

¿Acaso las partículas circulan por el campo de Higgs y se ven frenadas por éste que les adosa la masa?

Bueno, la idea nueva que surgió es que el espacio entero contiene un campo, el campo de Higgs, que impregna el vacío y es el mismo en todas partes. Es decir, que si miramos a las estrellas en una noche clara estamos mirando el campo de Higgs. Las partículas influidas por este campo, toman masa. Esto no es por sí mismo destacable, pues las partículas pueden tomar energía de los campos (gauge) de los que hemos comentado, del campo gravitatorio o del electromagnético. Si llevamos un bloque de plomo a lo alto de la Torre Eiffel, el bloque adquiriría energía potencial a causa de la alteración de su posición en el campo gravitatorio de la Tierra.

campo, toman masa. Esto no es por sí mismo destacable, pues las partículas pueden tomar energía de los campos (gauge) de los que hemos comentado, del campo gravitatorio o del electromagnético. Si llevamos un bloque de plomo a lo alto de la Torre Eiffel, el bloque adquiriría energía potencial a causa de la alteración de su posición en el campo gravitatorio de la Tierra.

Como E=mc2, ese aumento de la energía potencial equivale a un aumento de la masa, en este

E=mc2, ese aumento de la energía potencial equivale a un aumento de la masa, en este caso la masa del Sistema Tierra-bloque de plomo. Aquí hemos de añadirle amablemente un poco de complejidad a la venerable ecuación de Einstein. La masa, m, tiene

caso la masa del Sistema Tierra-bloque de plomo. Aquí hemos de añadirle amablemente un poco de complejidad a la venerable ecuación de Einstein. La masa, m, tiene en realidad dos partes. Una es la masa en reposo, m0, la que se mide en el laboratorio cuando

en realidad dos partes. Una es la masa en reposo, m0, la que se mide en el laboratorio cuando la partícula está en reposo. La partícula adquiere la otra parte de la masa en virtud de su movimiento (como los protones en el acelerador de partículas, o los muones, que aumentan varias veces su masa cuando son lanzados a velocidades cercanas a c) o en virtud de su energía potencial de campo. Vemos una dinámica similar en los núcleos atómicos. Por ejemplo, si separamos el protón y el neutrón que componen un núcleo de deuterio, la suma de las masas aumenta.

la partícula está en reposo. La partícula adquiere la otra parte de la masa en virtud de su movimiento (como los protones en el acelerador de partículas, o los muones, que aumentan varias veces su masa cuando son lanzados a velocidades cercanas a c) o en virtud de su energía potencial de campo. Vemos una dinámica similar en los núcleos atómicos. Por ejemplo, si separamos el protón y el neutrón que componen un núcleo de deuterio, la suma de las masas aumenta.

Pero la energía potencial tomada del campo de Higgs difiere en varios aspectos de la acción de los campos familiares. La masa tomada de Higgs es en realidad masa en reposo. De hecho, en la que quizá sea la versión más apasionante de la teoría del campo de Higgs, éste genera toda la masa en reposo. Otra diferencia es que la cantidad de masa que se traga del campo es distinta para las distintas partículas. Los teóricos dicen que las masas de las partículas de nuestro modelo estándar miden con qué intensidad se acoplan éstas al campo de Higgs.

las distintas partículas. Los teóricos dicen que las masas de las partículas de nuestro modelo estándar miden con qué intensidad se acoplan éstas al campo de Higgs.

La influencia de Higgs en las masas de los quarks y de los leptones, nos recuerda el descubrimiento por Pieter Zeeman, en 1.896, de la división de los niveles de energía de un electrón cuando se aplica un campo magnético al átomo. El campo (que representa metafóricamente el papel de Higgs) rompe la simetría del espacio de la que el electrón disfrutaba.

se aplica un campo magnético al átomo. El campo (que representa metafóricamente el papel de Higgs) rompe la simetría del espacio de la que el electrón disfrutaba.

Hasta ahora no tenemos ni idea de que reglas controlan los incrementos de masa generados por el Higgs (de ahí la expectación creada por el nuevo acelerador de partículas LHC). Pero

ahora no tenemos ni idea de que reglas controlan los incrementos de masa generados por el Higgs (de ahí la expectación creada por el nuevo acelerador de partículas LHC). Pero el problema es irritante: ¿por qué sólo esas masas –Las masas de los W+, W–, y Zº, y el up, el down, el encanto, el extraño, el top y el bottom, así como

el problema es irritante: ¿por qué sólo esas masas –Las masas de los W+, W–, y Zº, y el up, el down, el encanto, el extraño, el top y el bottom, así como los leptones – que no forman ningún patrón obvio?

los leptones – que no forman ningún patrón obvio?

No dejamos de experimentar para saber cómo es nuestro mundo, la Naturaleza, el Universo que nos acoge

saber cómo es nuestro mundo, la Naturaleza, el Universo que nos acoge

Las masas van de la del electrón 0’0005 GeV, a la del top, que tiene que ser mayor que 91 GeV. Deberíamos recordar que esta extraña idea (el Higgs) se empleó con mucho éxito para formular la teoría electrodébil (Weinberg-salam). Allí se propuso el campo de Higgs como una forma

extraña idea (el Higgs) se empleó con mucho éxito para formular la teoría electrodébil (Weinberg-salam). Allí se propuso el campo de Higgs como una forma de ocultar la unidad de las fuerzas electromagnéticas y débiles. En la unidad hay cuatro partículas mensajeras sin masa –los W+, W–, Zº y fotón que llevan la fuerza electrodébil. Además está el campo de Higgs, y, rápidamente, los W y Z chupan la esencia de Higgs y se hacen pesados; el fotón permanece intacto. La fuerza electrodébil se fragmenta en la débil (débil porque los mensajeros son muy gordos) y la electromagnética, cuyas propiedades determina el fotón, carente de masa. La simetría se rompe espontáneamente, dicen los teóricos. Prefiero la descripción según la cual el Higgs oculta la simetría con su poder dador de masa.

de ocultar la unidad de las fuerzas electromagnéticas y débiles. En la unidad hay cuatro partículas mensajeras sin masa –los W+, W–, Zº y fotón que llevan la fuerza electrodébil. Además está el campo de Higgs, y, rápidamente, los W y Z chupan la esencia de Higgs y se hacen pesados; el fotón permanece intacto. La fuerza electrodébil se fragmenta en la débil (débil porque los mensajeros son muy gordos) y la electromagnética, cuyas propiedades determina el fotón, carente de masa. La simetría se rompe espontáneamente, dicen los teóricos. Prefiero la descripción según la cual el Higgs oculta la simetría con su poder dador de masa.

Las masas de los W y el Z se predijeron con éxito a partir de los parámetros de la teoría electrodébil. Y las relajadas sonrisas de los físicos teóricos nos recuerdan que Gerard ^t Hooft y Veltman dejaron sentado que la teoría entera esta libre de infinitos.

Relatividad y Gravedad Cuántica. Universidadde Cambridge.

En esta última dirección ha publicado numerosos libros y artículos, donde aborda la asignatura pendiente de la unificación de la mecánica cuántica y la teoría del campo gravitatorio. El camino que ha seguido Penrose es encontrar una base común a ambas.

última dirección ha publicado numerosos libros y artículos, donde aborda la asignatura pendiente de la unificación de la mecánica cuántica y la teoría del campo gravitatorio. El camino que ha seguido Penrose es encontrar una base común a ambas.

Para ello ha introducido dos modelos: los “spin networks” y los “twistors”, el primero discreto, con una métrica intrínseca, no relativista, previo al concepto de espacio, el segundo continuo, con una métrica extrínseca, relativista e inmerso en un espacio-tiempo dado.

networks” y los “twistors”, el primero discreto, con una métrica intrínseca, no relativista, previo al concepto de espacio, el segundo continuo, con una métrica extrínseca, relativista e inmerso en un espacio-tiempo dado.

Claro que son varias las corrientes que quieren abrirse camino hacia otras físicas nuevas.

La Física nos lleva de vez en cuando a realizar viajes alucinantes. Se ha conseguido relacionar y hacer vibrar a dos diamantes en el proceso conocido como entrelazamiento cuántico. El misterioso proceso, al que el propio Eisntein no supo darle comprensión completa, supone el mayor avance hasta

vibrar a dos diamantes en el proceso conocido como entrelazamiento cuántico. El misterioso proceso, al que el propio Eisntein no supo darle comprensión completa, supone el mayor avance hasta la fecha y abre las puertas de la computación cuántica. Para

la fecha y abre las puertas de la computación cuántica. Para que nos hagamos una idea del hallazgo, en 1935 Einstein lo llegó a denominar como

que nos hagamos una idea del hallazgo, en 1935 Einstein lo llegó a denominar como la “acción fantasmal a distancia”. Un efecto extraño en donde se conecta un objeto con otro de manera que incluso si están separados por grandes distancias, una acción realizada en uno de los objetos afecta al otro.

la “acción fantasmal a distancia”. Un efecto extraño en donde se conecta un objeto con otro de manera que incluso si están separados por grandes distancias, una acción realizada en uno de los objetos afecta al otro.

Esa nueva teorías quiere explicarlo todo. Nada puede estar fuera de ella: El Universo que es, todo lo que existe, ahí estará

estar fuera de ella: El Universo que es, todo lo que existe, ahí estará

La teoría de supercuerdas tiene tantas sorpresas fantásticas que cualquiera que investigue en el tema reconoce que está llena de magia. Es algo que funciona con tanta belleza… Cuando cosas que no encajan juntas e incluso se repelen, si se acerca la una a la otra alguien es capaz de formular un camino mediante el cual, no sólo no se rechazan, sino que encajan a la perfección dentro de ese sistema, como ocurre ahora con la teoría M que acoge con naturalidad la teoría de la relatividad general y la teoría mecánico-cuántica; ahí, cuando

tantas sorpresas fantásticas que cualquiera que investigue en el tema reconoce que está llena de magia. Es algo que funciona con tanta belleza… Cuando cosas que no encajan juntas e incluso se repelen, si se acerca la una a la otra alguien es capaz de formular un camino mediante el cual, no sólo no se rechazan, sino que encajan a la perfección dentro de ese sistema, como ocurre ahora con la teoría M que acoge con naturalidad la teoría de la relatividad general y la teoría mecánico-cuántica; ahí, cuando eso se produce, está presente la belleza.

eso se produce, está presente la belleza.

Lo que hace que la teoría de supercuerdas sea tan interesante es que el marco estándar mediante el cual conocemos la mayor parte de la física es la teoría cuántica y resulta que ella hace imposible la gravedad. La relatividad general de Einstein, que es el modelo de la gravedad, no funciona con la teoría cuántica. Sin embargo, las supercuerdas modifican la teoría cuántica estándar de tal manera que la gravedad no sólo se convierte en posible, sino que forma parte natural del sistema; es inevitable para que éste sea completo.

de la física es la teoría cuántica y resulta que ella hace imposible la gravedad. La relatividad general de Einstein, que es el modelo de la gravedad, no funciona con la teoría cuántica. Sin embargo, las supercuerdas modifican la teoría cuántica estándar de tal manera que la gravedad no sólo se convierte en posible, sino que forma parte natural del sistema; es inevitable para que éste sea completo.

¿Por qué es tan importante encajar la gravedad y la teoría cuántica? Porque no podemos admitir una teoría que explique las fuerzas de la naturaleza y deje fuera a una de esas fuerzas. Así ocurre con el Modelo Estándar que deja aparte y no incluye a la fuerza gravitatoria que está ahí, en la Naturaleza.

La teoría de supercuerdas se perfila como la teoría que tiene implicaciones si tratamos con las cosas muy pequeñas, en el microcosmos; toda la teoría de partículas elementales cambia con las supercuerdas que penetra mucho más; llega mucho más allá de lo que ahora es posible.

La topología es, el estudio de aquellas propiedades de los cuerpos geométricos que permanecen inalteradas por transformaciones continuas. La topología es probablemente la más joven de las ramas clásicas de las matemáticas. En contraste con el álgebra, la geometría y la teoría de los números, cuyas genealogías datan de tiempos antiguos, la topología aparece en el siglo diecisiete, con el nombre de analysis situs, es decir, análisis de la posición.

de analysis situs, es decir, análisis de la posición.

De manera informal, la topología se ocupa de aquellas propiedades de las figuras que permanecen invariantes, cuando dichas figuras son plegadas, dilatadas, contraídas o deformadas, de modo que no aparezcan nuevos puntos, o se hagan coincidir puntos diferentes. La transformación permitida presupone, en otras palabras, que hay una correspondencia biunívoca entre los puntos de la figura original y los de la transformada, y que la deformación hace corresponder puntos próximos a puntos próximos. Esta última propiedad se llama continuidad, y lo que se requiere es que la transformación y su inversa sean ambas continuas: así, trabajarnos con homeomorfismos.

corresponder puntos próximos a puntos próximos. Esta última propiedad se llama continuidad, y lo que se requiere es que la transformación y su inversa sean ambas continuas: así, trabajarnos con homeomorfismos.

En cuanto a nuestra comprensión del universo a gran escala (galaxias, el Big Bang…), creo que afectará a nuestra idea presente, al esquema que hoy rige y, como la nueva teoría, el horizonte se ampliará enormemente; el cosmos se presentará ante nosotros como un todo, con un comienzo muy bien definido y un final muy bien determinado.

la nueva teoría, el horizonte se ampliará enormemente; el cosmos se presentará ante nosotros como un todo, con un comienzo muy bien definido y un final muy bien determinado.

Para cuando eso llegue, sabremos lo que es, como se genera y dónde están situados los orígenes de esa “fuerza”, “materia”, o, “energía” que ahora no sabemos ver para explicar el movimiento de las galaxias o la expansión del espacio mismo.

eso llegue, sabremos lo que es, como se genera y dónde están situados los orígenes de esa “fuerza”, “materia”, o, “energía” que ahora no sabemos ver para explicar el movimiento de las galaxias o la expansión del espacio mismo.

Emilio Silvera V.

Totales: 88.133.975

Totales: 88.133.975 Conectados: 4

Conectados: 4