Dic

25

¡Aquellos primeros momentos!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Astronomía y Astrofísica ~

Clasificado en Astronomía y Astrofísica ~

Comments (0)

Comments (0)

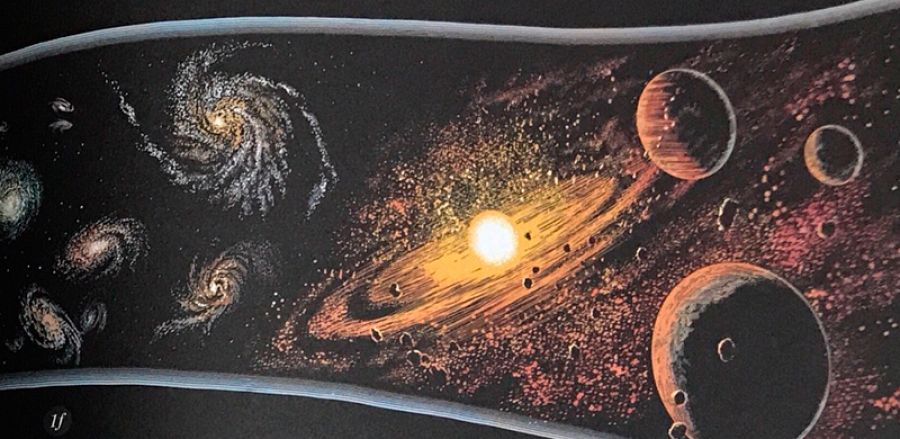

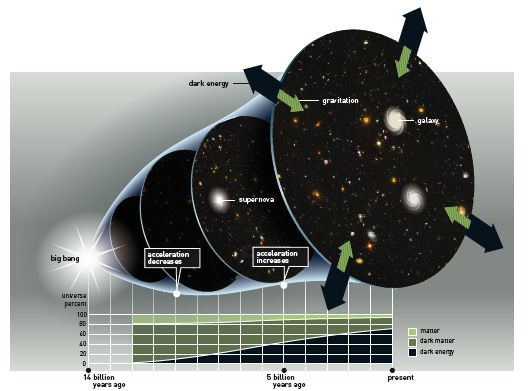

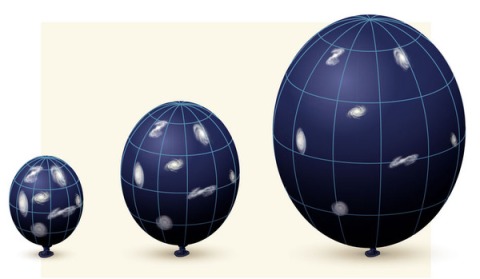

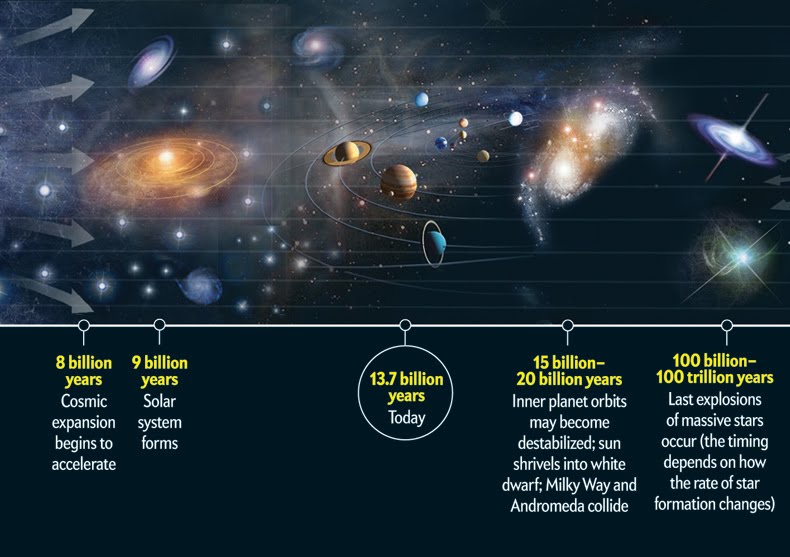

Todo en el Universo tiene un principio y un final y, el mismo universo tuvo que nacer y evolucionar para que hoy podamos contemplar, mediante nuestros sofisticados telescopios, un universo en expansión lleno de galaxias que contienen estrellas nuevas y viejas estrellas, muchas de ellas rodeadas de mundos que, aún no hemos podido determinar de qué criaturas estarán poblados muchos de ellos.

¡El Universo!

Antes de alrededor de un minuto y cuarenta segundos desde el comienzo del tiempo, no hay núcleos atómicos estables. El nivel de energía en el ambiente es mayor que la energía de unión nuclear. Por consiguiente, todos los núcleos que se forman, se destruyen de rápidamente.

Alrededor de un segundo desde el comienzo del tiempo, llegamos a la época de desacoplamiento de los neutrinos. Aunque en esa época el Universo era muy denso (y tan caliente como la explosión de una bomba de hidrógeno), ya ha empezado a parecer vacío a los neutrinos. Puesto que los neutrinos sólo reaccionan a la fuerza débil, que tiene un alcance extremadamente corto, pueden escapar de sus garras y volar indefinidamente sin experimentar ninguna otra interacción.

Aunque parezca mentira, al día de hoy no sabemos, a ciencia cierta, como se formaron las galaxias a pesar de la expansión de Hubble ¿Qué clase de materia estaba allí presente para generar la Gravedad que la retuvo y poder conformarlas?

Algunos postulan la existencia de una especie de redes cósmicas invisibles que generaban Gravedad. Aquella sustancia cósmica primigenia, muchos millones de años después, posibilitó el surgir de las primeras estrellas y de las primeras galaxias.

Así, emancipados, en lo sucesivo son libres de vagar por el Universo a su manera indiferente, volando a través de la mayor de la materia como sino existiese. (Diez trillones de neutrinos atravesarán sin causar daños el cerebro y el cuerpo del lector en el tiempo que le lleve leer esta frase. Y en el tiempo en que usted haya leído esta frase estarán más lejos que la Luna).

En menos de un siglo, el neutrino pasó de una partícula fantasma – propuesta en 1930 por el físico austríaco Wolfgang Pauli (1900-1958) a explicar el balance de energía en una forma de radioactividad, el llamado decaimiento beta, en una sonda capaz de escrutar el interior de estrellas y de la propia Tierra.

De esa manera, oleadas de neutrinos liberados en un segundo después del Big Bang persiste aún después, formando una radiación cósmica de fondo de neutrinos semejante a la radiación de fondo de microondas producida por el desacoplamiento de los fotones.

Si estos neutrinos “cósmicos” (como se los llama para diferenciarlos de los neutrinos liberados más tarde por las supernovas) pudiesen ser observador por un telescopio de neutrinos de alguna clase, proporcionarían una visión directa del Universo cuando sólo tenía un segundo.

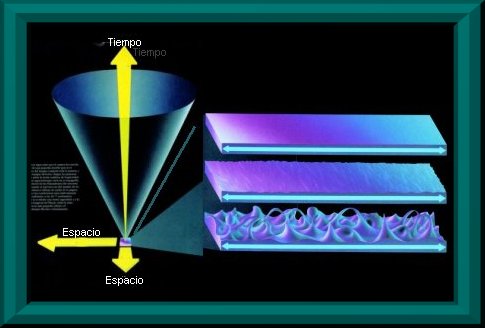

A medida que retrocedemos en el tiempo, el Universo se vuelve más denso y más caliente, y el nivel de estructura que puede existir se hace cada vez más rudimentario.

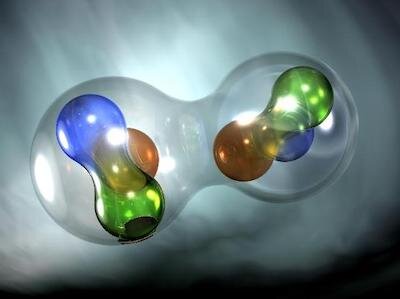

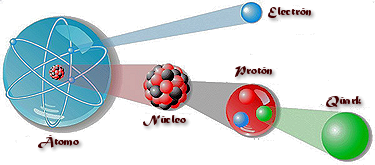

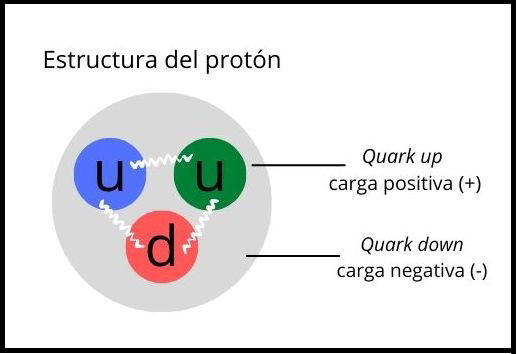

Por supuesto, en ese tiempo, no hay moléculas, ni átomos, ni núcleos atómicos, y, a 10-6 (0.000001) de segundo después del comienzo del tiempo, tampoco hay neutrones ni protones. El Universo es un océano de quarks libres y otras partículas elementales.

Si nos tomamos el de contarlos, hallaremos que por cada mil millones de anti-quarks existen mil millones y un quark. La asimetría es importante. Los pocos quarks en exceso destinados a sobrevivir a la aniquilación general quark-antiquark formaran todos los átomos de materia del Universo del último día. Se desconoce el origen de la desigualdad; presumiblemente obedezca a la ruptura de una simetría materia antimateria en alguna etapa anterior.

Nos aproximamos a un tiempo en que las estructuras básicas de las leyes naturales, y no sólo las de las partículas y campos cuya conducta dictaban, cambiaron a medida que evolucionó el Universo.

La primera transición semejante se produjo en los 10-11 de segundo después del comienzo del tiempo, cuando las funciones de las fuerzas débiles y electromagnéticas se regían por una sola fuerza, la electrodébil. hay bastante energía ambiente para permitir la creación y el mantenimiento de gran de bosones w y z.

Estas partículas –las mismas cuya aparición en el acelerador del CERN verificó la teoría electrodébil– son las mediadoras intercambiables en las interacciones de fuerzas electromagnéticas y débiles, lo que las hace indistinguibles. En ese tiempo, el Universo está gobernando sólo por tres fuerzas: la gravedad, la interacción nuclear fuerte y la electrodébil.

Más atrás de ese tiempo nos quedamos en el misterio y envueltos en una gran nebulosa de ignorancia. Cada uno se despacha a su gusto para lanzar conjeturas y teorizar sobre lo que pudo haber sido. Seguramente, en el futuro, será la teoría M (de supercuerdas) la que contestará esas preguntas sin respuestas ahora.

En los 10-35 de segundo desde el comienzo del tiempo, entramos en un ámbito en el que las cósmicas son aún menos conocidas. Si las grandes teorías unificadas son correctas, se produjo una ruptura de la simetría por la que la fuerza electronuclear unificada se escindió en las fuerzas electrodébil y las fuertes. Si es correcta la teoría de la supersimetría, la transición puede haberse producido antes, había involucrado a la gravitación.

En el universo temprano la primera materia (hidrógeno y Helio) era llevada por la fuerza de gravedad a conformarse en grandes conglomerados de gas y polvo que interaccionaban, producían calor y formaron las primeras estrellas.

Elaborar una teoría totalmente unificada es tratar de comprender lo que ocurrió en ese tiempo remoto que, según los últimos estudios está situado entre 15.000 y 18.000 millones de años, cunado la perfecta simetría que, se pensaba, caracterizó el Universo, se hizo añicos para dar lugar a los simetrías rotas que hallamos a nuestro alrededor y que, nos trajo las fuerzas y constantes Universales que, paradójicamente, hicieron posible nuestra aparición para que , sea posible que, alguien como yo esté contando lo que pasó.

Pero hasta que no tengamos tal teoría no podemos esperar comprender lo que realmente ocurrió en ese Universo bebé. Los límites de nuestras conjeturas actuales cuando la edad del Universo sólo es de 10-43de segundo, nos da la única respuesta de encontrarnos ante una puerta cerrada.

Del otro lado de esa puerta está la época de Planck, un tiempo en que la atracción gravitatoria ejercida por cada partícula era comparable en intensidad a la fuerza nuclear fuerte.

La Era de Planck, la espuma cósmica

La fuerza nuclear fuerte hizo posible la existencia de los núcleos que atraían electrones para formar átomos

Así que, llegados a este punto podemos decir que la clave teórica que podría abrir esa puerta sería una teoría unificada que incluyese la gravitación, es decir, una teoría cuántica-gravitatoria que uniese, de una vez por todas, a Planck y Einstein que, aunque eran muy amigos, no parecen que sus teorías (la Mecánica Cuántica) y (la Relatividad General) se lleven de maravilla.

Emilio Silvera Vázquez

Dic

24

¿La masa perdida? ¿O no entendemos nada?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Astronomía y Astrofísica ~

Clasificado en Astronomía y Astrofísica ~

Comments (0)

Comments (0)

Recreación artística del WHIM en la Pared del Escultor. Fuente: NASA.

La idea de la masa perdida se introdujo porque la densidad observada de la materia en el universo está cerca del valor crítico (10-29 g/cm3). Sin embargo, hasta comienzo de los ochenta, no hubo una razón teórica firme para suponer que el universo tenía efectivamente la masa crítica. En 1981, Alan Guth, publicó la primera versión de una teoría que desde entonces se ha conocido como “universo inflacionista”. desde entonces la teoría ha sufrido cierto número de modificaciones técnicas, pero los puntos centrales no han cambiado. Lo cierto es que la idea del universo inflacionista, estableció por primera vez una fuerte presunción de que la masa del universo tenía realmente el valor crítico.

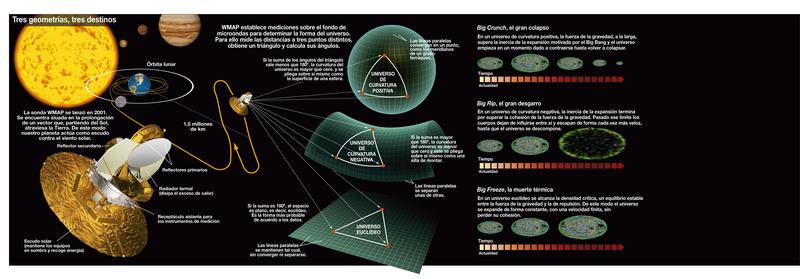

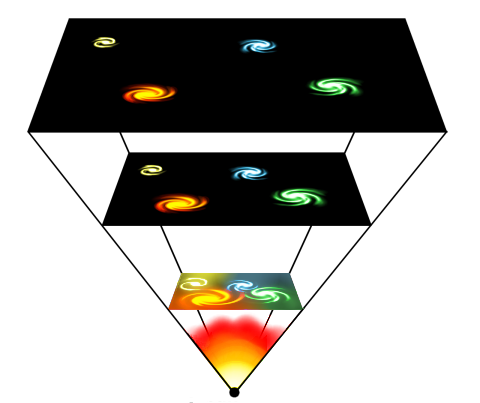

Diagrama de las tres posibles geometrías del universo: cerrado, abierto y plano, correspondiendo a valores del parámetro de densidad Ω0 mayores que, menores que o iguales a 1 respectivamente. En el universo cerrado si se viaja en línea recta se llega al mismo punto, en los otros dos no. ( Ω es lo que los cosmólogos llaman el Omega Negro, es decir, la cantidad de materia que hay en el Universo).

La predicción de Guht viene de las teorías que describen la congelación de la fuerza fuerte en el segundo 10-35 del Big Bang. Entre los muchos otros procesos en marcha en ese tiempo estaba una rápida expansión del universo, un proceso que vino a ser conocido como inflación. Es la presencia de la inflación la que nos lleva a la predicción de que el universo tiene que ser plano.

Se ha tratado de medir la Densidad Crítica del Universo para poder saber en qué clase de universo estamos y, parece que es plano.

Universo cerrado

Si Ω>1, entonces la geometría del espacio sería cerrada como la superficie de una esfera. La suma de los ángulos de un triángulo exceden 180 grados y no habría líneas paralelas. Al final, todas las líneas se encontrarían. La geometría del universo es, al menos en una escala muy grande, elíptico.

En un universo cerrado carente del efecto repulsivo de la energía oscura, la gravedad acabará por detener la expansión del universo, después de lo que empezará a contraerse hasta que toda la materia en el universo se colapse en un punto. Entonces existirá una singularidad final llamada el Big Crunch, por analogía con el Big Bang. Sin embargo, si el universo tiene una gran suma de energía oscura (como sugieren los hallazgos recientes), entonces la expansión será grande.

Universo abierto

Si Ω<1, la geometría del espacio es abierta, p.ej., negativamente curvada como la superficie de una silla de montar. Los ángulos de un triángulo suman menos de 180 grados (llamada primera fase) y las líneas paralelas no se encuentran nunca equidistantes, tienen un punto de menor distancia y otro de mayor. La geometría del universo sería hiperbólica.

Incluso sin energía oscura, un universo negativamente curvado se expandirá para siempre, con la gravedad apenas ralentizando la tasa de expansión. Con energía oscura, la expansión no sólo continúa sino que se acelera. El destino final de un universo abierto es, o la muerte térmica” o “Big Freeze” o “Big Rip”, dónde la aceleración causada por la energía oscura terminará siendo tan fuerte que aplastará completamente los efectos de las fuerzas gravitacionales, electromagnéticas y los enlaces débiles.

Universo plano

Si la densidad media del universo es exactamente igual a la densidad crítica tal que Ω=1, entonces la geometría del universo es plana: como en la geometría ecuclidiana, la suma de los ángulos de un triángulo es 180 grados y las líneas paralelas nunca se encuentran.

Sin energía oscura, un universo plano se expande para siempre pero a una tasa continuamente desacelerada: la tasa de expansión se aproxima asintóticamentre a cero. Con energía oscura, la tasa de expansión del universo es inicialmente baja, debido al efecto de la gravedad, pero finalmente se incrementa. El destino final del universo es el mismo que en un universo abierto, la muerte caliente del universo, el “Big Freeze” o el “Big Rip”. En 2005, se propuso la teoría del destino del universo Fermión-Bosón, proponiendo que gran parte del universo estaría finalmente ocupada por condensado de Bose-Einstein y la quasipartícula análoga al fermión, tal vez resultando una implosión. Muchos datos astrofísicos hasta la fecha son consistentes con un universo plano.

La teoría del Big Crunch es un punto de vista simétrico del destino final del Universo. Justo con el Big Bang empezó una expansión cosmológica, esta teoría postula que la densidad media del Universo es suficiente para parar su expansión y empezar la contracción. De ser así, se vería cómo las estrellas tienden a ultravioleta, por efecto Doppler. El resultado final es desconocido; una simple extrapolación sería que toda la materia y el espacio-tiempo en el Universo se colapsaría en una singularidad espaciotemporal adimensional, pero a estas escalas se desconocen los efectos cuánticos necesarios para ser considerados -se aconseja mirar en Gravedad-Cuántica-..

Este escenario permite que el Big Bang esté precedido inmediatamente por el Big Crunch de un Universo precedente. Si esto ocurre repetidamente, se tiene un universo oscilante. El Universo podría consistir en una secuencia infinita de Universos finitos, cada Universo finito terminando con un Big Crunch que es también el Big Bang del siguiente Universo. Teóricamente, el Universo oscilante no podría reconciliarse con la segunda ley de la termodinámica:

la entropía aumentaría de oscilación en oscilación y causaría la muerte caliente. Otras medidas sugieren que el Universo no es cerrado. Estos argumentos indujeron a los cosmólogos a abandonar el modelo del Universo oscilante. Una idea similar es adoptada por el modelo cíclico, pero esta idea evade la muerte caliente porque de una expansión de branas se diluye la entropía acumulada en el ciclo anterior.

Como podéis comprobar por todo lo anteriormente leído, siempre estamos tratando de saber en qué universo estamos y pretendemos explicar lo que pudo pasar desde aquel primer momento que no hemos podido comprender de manera exacta y científicamente autosuficiente para que sea una ley inamovible del nacimiento del universo. Simplemente hemos creado modelos que se acercan de la mejor manera a lo que pudo ser y a lo que podría ser.

Dic

20

Desvelando secretos del Universo

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Astronomía y Astrofísica ~

Clasificado en Astronomía y Astrofísica ~

Comments (0)

Comments (0)

He podido leer en una revista especializada:

Los dos telescopios MAGIC de La Palma, de 17 metros de diámetro y construidos en fibra de carbono, analizaron un estallido de rayos gamma de un rango de energía nunca antes detectado.

:format(jpg)/f.elconfidencial.com%2Foriginal%2F06e%2Fd49%2Fa57%2F06ed49a57a52e7f37b59e0445ecc130b.jpg)

“Otra fuente de explosión gamma sin identificar observada por debajo del plano galáctico, está probablemente más allá de los límites de la Vía Láctea, su naturaleza continúa siendo un misterio.”

Los sorprendentes misterios que el Universo esconde

Queda expresada nuestra enorme ignorancia sobre los muchos secretos que el Universo nos esconde, y, sin embargo, también ha quedado claro que, cada día, desvelamos algunos de esos innumerables secretos como lo demuestran el sin fin de misiones de todo tipo que en los últimos 10 años han sido puestas en marcha hacia el espacio para saber lo que en él ocurre.

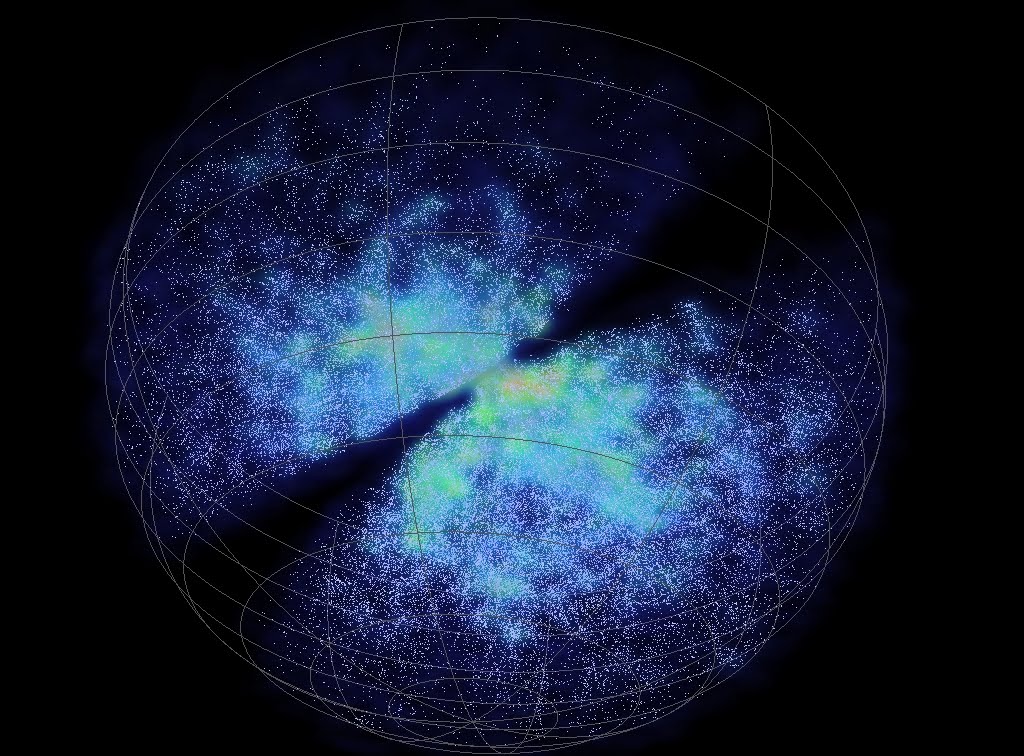

Fermi descubre dos colosales burbujas en nuestra Galaxia

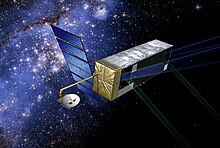

El Fermi es otro proyecto que se sumará a esos otros muchos que nos facilitan datos e información valiosa para desentrañar esos misterios y tener respuestas a muchas preguntas que no han podido ser contestadas.

Fermi nos revela imágenes de las primeras observaciones y el telescopio espacial nos dirá dónde están las fuentes de rayos gamma.

GLAST captó imágenes sorprendentes Aquí su lanzamiento al Espacio

El telescopio más nuevo de la NASA, anteriormente conocido como GLAST, una vez que pasó exitosamente su verificación orbital, comenzó una misión destinada a explorar el violento e impredecible universo de los rayos gamma.

El telescopio comenzó la misión con un nuevo nombre. La NASA decidió que a GLAST se le asignara un nuevo nombre: Telescopio Espacial de Rayos Gamma Fermi, en honor al profesor Enrico Fermi (1901 – 1954), un pionero en el campo de la física de alta energía.

Enrico Fermi

Enrico Fermi fue la primera persona que sugirió la forma en la cual las partículas cósmicas podrían ser aceleradas a grandes velocidades. Su teoría proporciona los fundamentos para entender el nuevo fenómeno que su telescopio homónimo descubrirá.

Los científicos esperan que Fermi, mediante la observación de rayos gamma energéticos, descubra muchos nuevos pulsares, revele el funcionamiento de los agujeros negros súper masivos y ayude a los físicos a buscar nuevas leyes de la Naturaleza.

Nov

23

Ya podemos “viajar” desde el núcleo atómico hasta las...

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Astronomía y Astrofísica ~

Clasificado en Astronomía y Astrofísica ~

Comments (1)

Comments (1)

Interacciones fundamentales

Existen en el Universo cuatro fuerzas fundamentales (al menos son las que hasta el momento conocemos), éstas cuatro fuerzas son las que rigen en todas las regiones del Universo y, junto a las constantes universales, hacen que el Universo sea tal como lo podemos observar. Le dan un ritmo a los objetos que lo pueblan y, ya pueden estar conformados por “materia inerte” y tratarse de seres vivos, todo responde a sus mandatos y de acuerdo a ellos se comportan.

Nada de lo que sucede en el Universo es “porque sí”, todo tiene su por qué. Nos ha costado miles de años de pensamientos, de estudios, de observaciones, de experimentos y de experiencia el llegar a conocer, en cierta medida, como funciona la Naturaleza.

Siempre nos hemos equivocado pero… ¡Nos hemos vuelto a levantar!

En un Tiempo Pasado, algunos optimistas decían: “Ya nada nuevo podemos aprender, sabemos el origen y el por qué de todas las cosas” (La cita pertenece al filósofo francés del siglo XVII, Bernard Le Bovier de Fontenelle). Aquellos pobres ilusos, en realidad, eran unos grandes ignorantes que no eran conscientes de lo mucho que nos quedaba por saber. Las preguntas siguen siendo mucho más abundantes que las respuestas.

Un famoso Presidente de la Real Sociedad de Londres, ante todos los comensales dijo: “Nunca podremos saber de qué están hechas las estrellas.”

Y en el Presente lo sabemos perfectamente

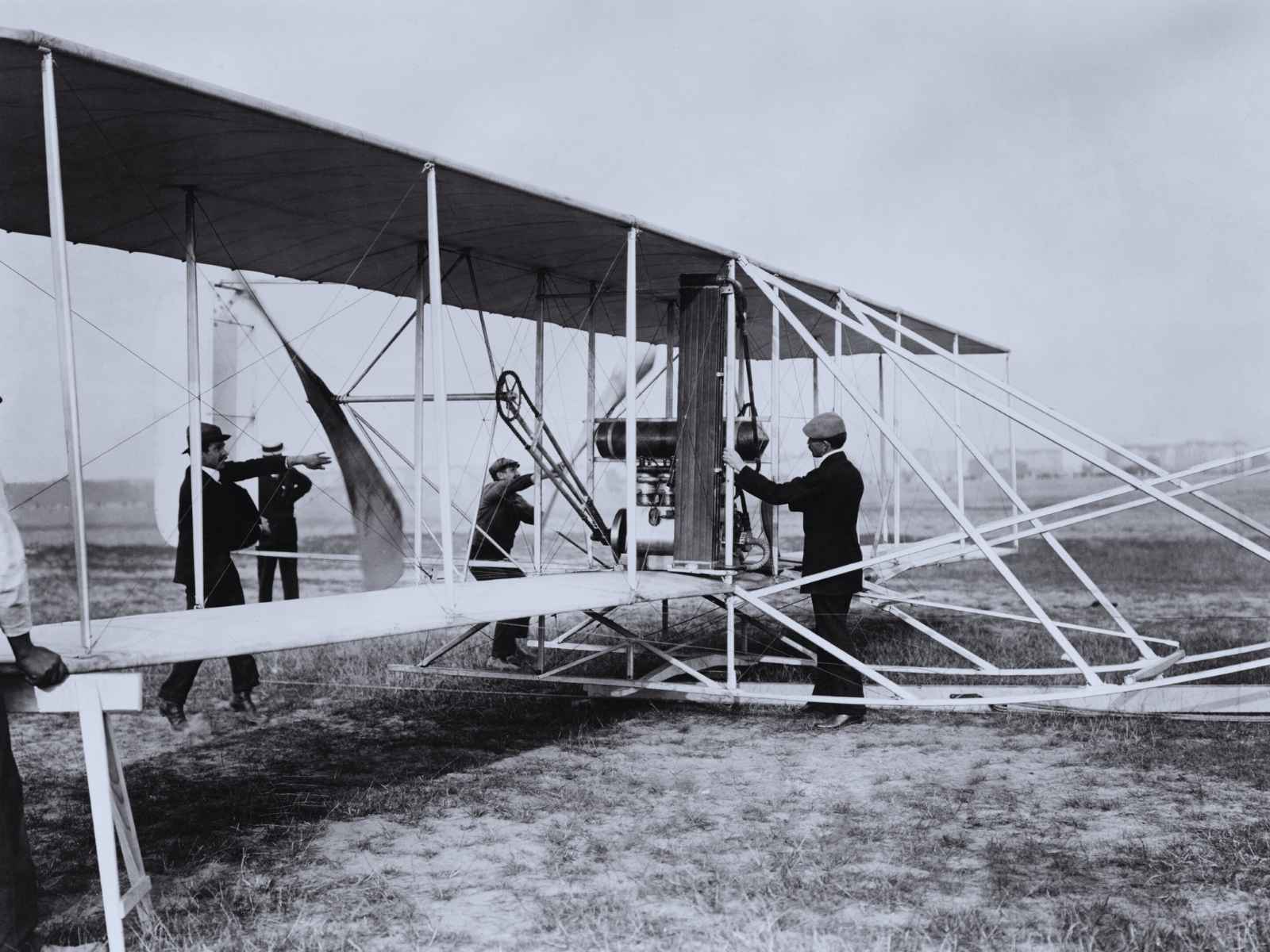

También un famoso científico de su tiempo, ante un gran gentío dijo: Nunca nada más pesado que el aire podrá volar si no es un pájaro”.

fueron pronunciada por el científico Lord Kelvin, quien sostenía que las máquinas voladoras más pesadas que el aire eran imposibles.

Poco después remontó el vuelo el avión de los hermanos Wright.

Esto nos dice que debemos ser prudentes y no negar lo que pudiera ser en un futuro, porque hoy no tengamos los medios… ¡Mañana ya veremos!

El propio Rutherford empezó a vislumbrar la respuesta a la pregunta que arriba hacemos. Entre 1.906 y 1.908 (hace más de un siglo) realizó constantes experimentos disparando partículas alfa contra una lámina sutil de metal (como oro o platino), para analizar sus átomos. La mayor

que arriba hacemos. Entre 1.906 y 1.908 (hace más de un siglo) realizó constantes experimentos disparando partículas alfa contra una lámina sutil de metal (como oro o platino), para analizar sus átomos. La mayor parte de los proyectiles atravesaron la barrera sin desviarse (como balas a través de las hojas de un árbol), pero no todos.

parte de los proyectiles atravesaron la barrera sin desviarse (como balas a través de las hojas de un árbol), pero no todos.

En la placa fotográfica que le sirvió de blanco tras el metal, Rutherford descubrió varios impactos dispersos e insospechados alrededor del punto central. Comprobó que algunas partículas habían rebotado. Era como si en vez de atravesar las hojas, algunos proyectiles hubiesen chocado contra algo más sólido. Rutherford supuso que aquella “balas” habían chocado contra una especie de núcleo denso, que ocupaba sólo una parte mínima del volumen atómico y ese núcleo de intensa densidad desviaban los proyectiles que acertaban a chocar contra él. Ello ocurría en muy raras ocasiones, lo cual demostraba que los núcleos atómicos debían ser realmente ínfimos, porque un proyectil había de encontrar por fuerza muchos millones de átomos al atravesar la lámina metálica

por fuerza muchos millones de átomos al atravesar la lámina metálica

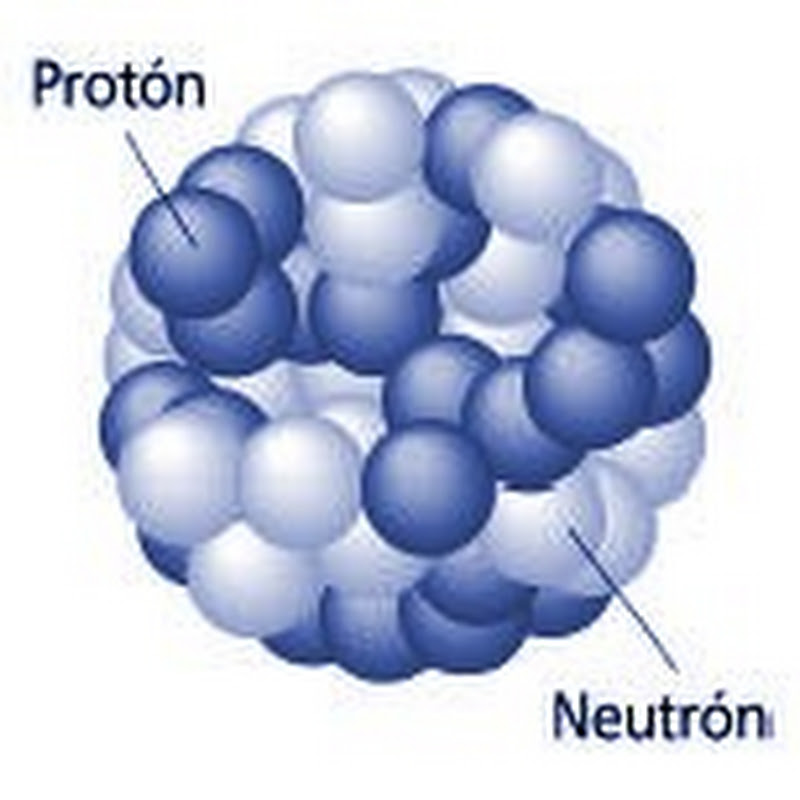

Era lógico suponer , pues, que los protones constituían ese núcleo duro. Rutherford representó los protones atómicos como elementos apiñados alrededor de un minúsculo “núcleo atómico” que servía de centro (después de todo eso, hemos podido saber

, pues, que los protones constituían ese núcleo duro. Rutherford representó los protones atómicos como elementos apiñados alrededor de un minúsculo “núcleo atómico” que servía de centro (después de todo eso, hemos podido saber que el diámetro de ese núcleo equivale a algo más de una cienmilésima del volumen total del átomo).

que el diámetro de ese núcleo equivale a algo más de una cienmilésima del volumen total del átomo).

En 1.908 se concedió a Rutherford el premio Nobel de Química por su extraordinaria labor de investigación sobre la naturaleza de la materia. Él fue el responsable de importantes descubrimientos que permitieron conocer la estructura de los átomos en esa primera avanzadilla.

de importantes descubrimientos que permitieron conocer la estructura de los átomos en esa primera avanzadilla.

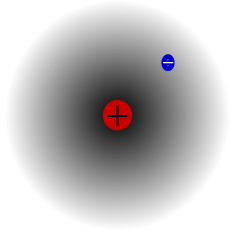

Átomo de hidrógeno, núcleo y electrón.

Desde entonces se pueden describir con términos más concretos los átomos específicos y sus diversos comportamientos. Por ejemplo, el átomo de hidrógeno posee un solo electrón. Si se elimina, el protónrestante se asocia inmediatamente a alguna molécula vecina; y cuando el núcleo desnudo de hidrógeno no encuentra por este medio un electrón que participe, actúa como un protón (es decir, una partícula subatómica), lo cual le permite penetrar en la materia y reaccionar con otros núcleos si conserva la suficiente energía.

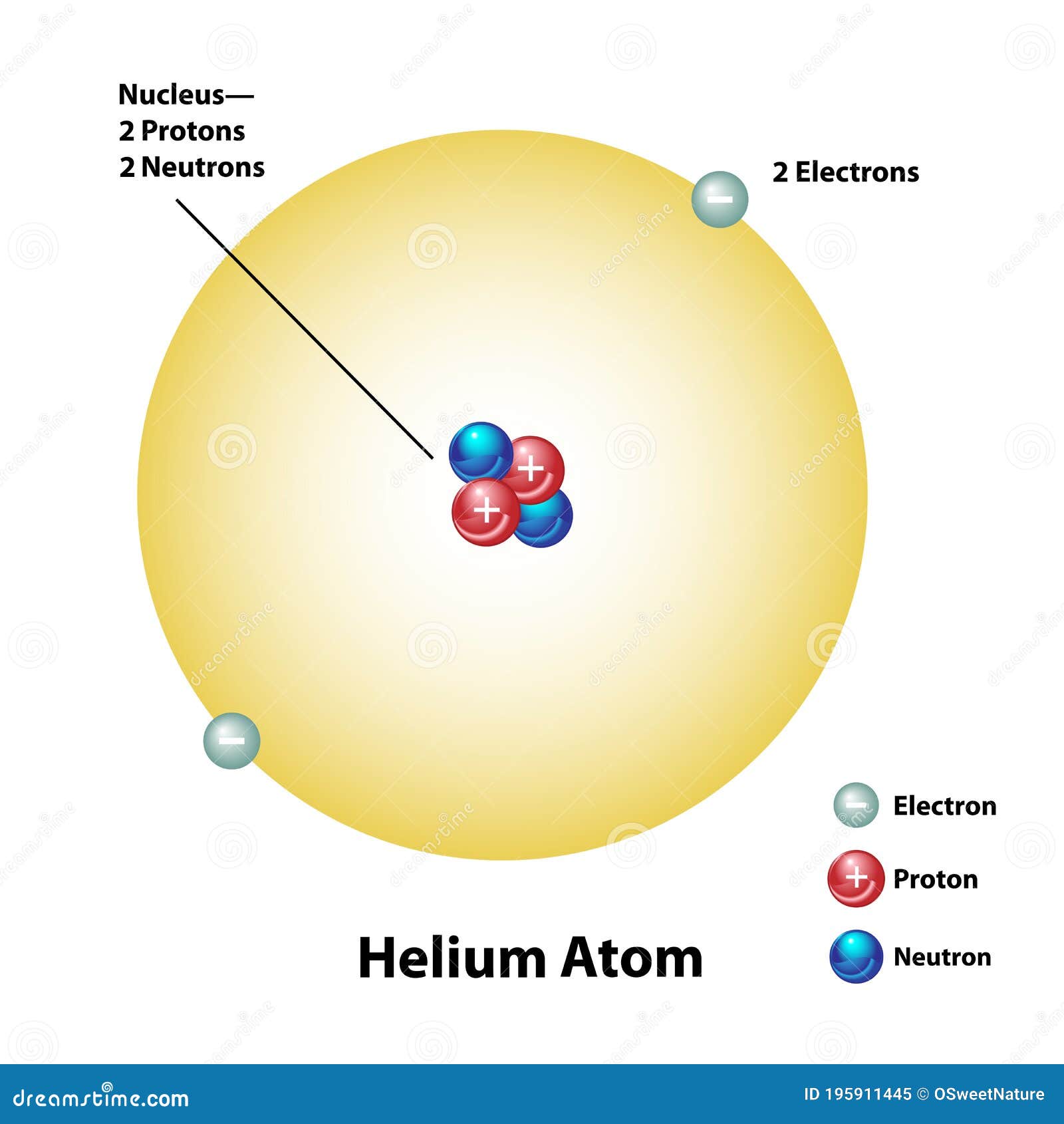

El helio, que posee dos electrones, no cede uno con tanta facilidad. Sus dos electrones forman un caparazón hermético, por lo cual el átomo es inerte. No obstante, si se despoja al helio de ambos electrones, se convierte en una partícula alfa, es decir

un caparazón hermético, por lo cual el átomo es inerte. No obstante, si se despoja al helio de ambos electrones, se convierte en una partícula alfa, es decir , una partícula subatómica portadora de dos unidades de carga positiva.

, una partícula subatómica portadora de dos unidades de carga positiva.

Hay un tercer elemento, el litio, cuyo átomo tiene tres electrones. Si se despoja de uno o dos, se transforma en ión, y si pierde los tres, queda reducida a un núcleo desnudo, con una carga positiva de tres unidades.

electrones. Si se despoja de uno o dos, se transforma en ión, y si pierde los tres, queda reducida a un núcleo desnudo, con una carga positiva de tres unidades.

Las unidades de carga positiva en el núcleo atómico deben ser numéricamente idénticas a los electrones que contiene por norma, pues el átomo suele ser un cuerpo neutro, y esta igualdad de lo positivo con lo negativo es el equilibrio. De hecho, los números atómicos de sus elementos se basan en sus unidades de carga positiva, no en las de carga negativa, porque resulta fácil hacer variar el número de electrones atómicos dentro de la formación

de electrones atómicos dentro de la formación iónica, pero en cambio se encuentran grandes dificultades si se desea alterar el número de sus protones.

iónica, pero en cambio se encuentran grandes dificultades si se desea alterar el número de sus protones.

Apenas esbozado este esquema de la construcción atómica, surgieron nuevos enigmas. El número de unidades con carga positiva en un núcleo no equilibró, en ningún caso, el peso nuclear ni la masa, exceptuando el caso del átomo de hidrógeno. Para citar un ejemplo, se averiguó que el núcleo de helio tenía una carga positiva dos veces mayor que la del núcleo de hidrógeno; pero como ya se sabía, su masa era cuatro veces mayor que la de este último. Y la situación empeoró progresivamente a medida que se descendía por la tabla de elementos, e incluso cuando se alcanzó el uranio, se encontró un núcleo con una masa igual a 238 protones, pero una carga que equivalía sólo a 92.

de unidades con carga positiva en un núcleo no equilibró, en ningún caso, el peso nuclear ni la masa, exceptuando el caso del átomo de hidrógeno. Para citar un ejemplo, se averiguó que el núcleo de helio tenía una carga positiva dos veces mayor que la del núcleo de hidrógeno; pero como ya se sabía, su masa era cuatro veces mayor que la de este último. Y la situación empeoró progresivamente a medida que se descendía por la tabla de elementos, e incluso cuando se alcanzó el uranio, se encontró un núcleo con una masa igual a 238 protones, pero una carga que equivalía sólo a 92.

¿Cómo era posible que un núcleo que contenía cuatro protones (según se suponía el núcleo de helio) tuviera sólo dos unidades de carga positiva? Según la más simple y primera conjetura emitida, la presencia en el núcleo de partículas cargadas negativamente y con peso despreciable neutralizaba dos unidades de carga. Como es natural, se pensó también en el electrón. Se podría componer el rompecabezas si se suponía que en núcleo de helio estaba integrado por cuatro protones y dos electronesneutralizadores, lo cual deja libre una carga positiva neta de dos, y así sucesivamente, hasta llegar al uranio, cuyo núcleo tendría, pues, 238 protones y 146 electrones, con 92 unidades libres de carga positiva. El hecho de que los núcleos radiactivos emitieran electrones (según se había comprobado ya, por ejemplo, en el caso de las partículas beta), reforzó esta idea general

y primera conjetura emitida, la presencia en el núcleo de partículas cargadas negativamente y con peso despreciable neutralizaba dos unidades de carga. Como es natural, se pensó también en el electrón. Se podría componer el rompecabezas si se suponía que en núcleo de helio estaba integrado por cuatro protones y dos electronesneutralizadores, lo cual deja libre una carga positiva neta de dos, y así sucesivamente, hasta llegar al uranio, cuyo núcleo tendría, pues, 238 protones y 146 electrones, con 92 unidades libres de carga positiva. El hecho de que los núcleos radiactivos emitieran electrones (según se había comprobado ya, por ejemplo, en el caso de las partículas beta), reforzó esta idea general . Dicha teoría prevaleció durante más de una década, hasta que por caminos indirectos, llegó una respuesta mejor como resultado de otras investigaciones.

. Dicha teoría prevaleció durante más de una década, hasta que por caminos indirectos, llegó una respuesta mejor como resultado de otras investigaciones.

Pero entre tanto se habían presentado algunas objeciones rigurosas contra dicha hipótesis. Por lo pronto , si el núcleo estaba constituido esencialmente de protones, mientras que los ligeros electrones no aportaban prácticamente ninguna contribución a la masa, ¿Cómo se explicaba que las masas relativas de varios núcleos no estuvieran representadas por número

, si el núcleo estaba constituido esencialmente de protones, mientras que los ligeros electrones no aportaban prácticamente ninguna contribución a la masa, ¿Cómo se explicaba que las masas relativas de varios núcleos no estuvieran representadas por número enteros? Según los pesos atómicos conocidos, el núcleo del átomo cloro, por ejemplo, tenía una masa 35’5 veces mayor que la del núcleo de hidrógeno. ¿Acaso significaba esto que contenía 35’5 protones? Ningún científico (ni entonces ni ahora) podía aceptar la existencia de medio protón.

enteros? Según los pesos atómicos conocidos, el núcleo del átomo cloro, por ejemplo, tenía una masa 35’5 veces mayor que la del núcleo de hidrógeno. ¿Acaso significaba esto que contenía 35’5 protones? Ningún científico (ni entonces ni ahora) podía aceptar la existencia de medio protón.

Este singular interrogante encontró una respuesta incluso antes de solventar el problema principal , y ello dio lugar a una interesante historia.

, y ello dio lugar a una interesante historia.

Los tres isótopos naturales del carbono: carbono-12 (6 protones y 6 neutrones), carbono-13 (6 protones y 7 neutrones) y carbono-14 (6 protones y 8 neutrones). En los tres casos es carbono, tiene el aspecto de carbono y se comporta químicamente como carbono, por tener seis protones (y forma parte de nuestro organismo, por ejemplo). Sin embargo, sus propiedades físicas varían. Por ejemplo, mientras que el carbono-12 y el carbono-13 son estables, el carbono-14 es inestable y radioactivo: emite radiación beta, uno de sus neutrones “extras” se transforma así en un protón y el núcleo se convierte en nitrógeno-14 (que tiene 7 protones y 7 neutrones), con el aspecto y las propiedades del nitrógeno (por tener 7 protones). Dado que la mitad de la masa del carbono-14 pasa a ser nitrógeno-14 cada 5.730 años aproximadamente (más o menos lo que llevamos de civilización humana), la presencia de este isótopo natural resulta especialmente útil para la datación precisa de objetos históricos.

Isótopos; construcción de bloques uniformes

Allá por 1.816, el físico inglés William Prout había insinuado ya que el átomo de hidrógeno debía entrar  en la constitución de todos los átomos. Con el tiempo se fueron desvelando los pesos atómicos, y la teoría de Prout quedó arrinconada, pues se comprobó que muchos elementos tenían pesos fraccionarios (para lo cual se tomó el oxígeno, tipificado al 16). El cloro, según dije antes, tiene un peso atómico aproximado de 35’5, o para ser exactos, 35’457. otros ejemplos son el antimonio, con un peso atómico de 121’75, el galio con 137’34, el boro con 10’811 y el cadmio con 112’40.

en la constitución de todos los átomos. Con el tiempo se fueron desvelando los pesos atómicos, y la teoría de Prout quedó arrinconada, pues se comprobó que muchos elementos tenían pesos fraccionarios (para lo cual se tomó el oxígeno, tipificado al 16). El cloro, según dije antes, tiene un peso atómico aproximado de 35’5, o para ser exactos, 35’457. otros ejemplos son el antimonio, con un peso atómico de 121’75, el galio con 137’34, el boro con 10’811 y el cadmio con 112’40.

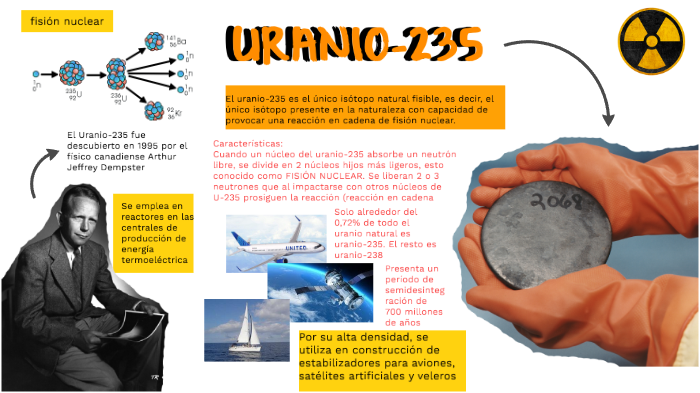

El Uranio 235 que es el único que de manera natural es apto para la fisión nuclear, es escaso, sólo el 7 por 1.000 es uranio 235, el resto , es uranio 238 que, no es combustible nuclear y, como la madera mojada, no arde. Sin embargo, si se bombardea con neutrones lentos del uranio 235, resulta que se convierte en Plutonio 239 que sí, es combustible nuclear válido. ¡Qué no idearemos para conseguir

, es uranio 238 que, no es combustible nuclear y, como la madera mojada, no arde. Sin embargo, si se bombardea con neutrones lentos del uranio 235, resulta que se convierte en Plutonio 239 que sí, es combustible nuclear válido. ¡Qué no idearemos para conseguir los objetivos!

los objetivos!

El Uranio es muy radiactivo y si está enriquecido… ¡Ya sabemos las consecuencias!

Hacia principios de siglo se hizo una serie de observaciones desconcertantes, que condujeron al esclarecimiento. El inglés William Crookes (el del tubo Crookes) logró disociar del uranio una sustancia cuya ínfima cantidad resultó ser mucho más radiactiva que el propio uranio. Apoyándose en su experimento, afirmó que el uranio no tenía radiactividad, y que ésta procedía exclusivamente de dicha impureza, que él denominó uranio X. Por otra parte, Henri Becquerel descubrió que el uranio purificado y ligeramente radiactivo adquiría mayor radiactividad con el tiempo, por causas desconocidas. Si se deja reposar durante algún tiempo, se podía

de observaciones desconcertantes, que condujeron al esclarecimiento. El inglés William Crookes (el del tubo Crookes) logró disociar del uranio una sustancia cuya ínfima cantidad resultó ser mucho más radiactiva que el propio uranio. Apoyándose en su experimento, afirmó que el uranio no tenía radiactividad, y que ésta procedía exclusivamente de dicha impureza, que él denominó uranio X. Por otra parte, Henri Becquerel descubrió que el uranio purificado y ligeramente radiactivo adquiría mayor radiactividad con el tiempo, por causas desconocidas. Si se deja reposar durante algún tiempo, se podía extraer de él repetidas veces uranio activo X. Para decirlo de otra manera, por su propia radiactividad, el uranio se convertía en el uranio X, más radiactivo aún.

extraer de él repetidas veces uranio activo X. Para decirlo de otra manera, por su propia radiactividad, el uranio se convertía en el uranio X, más radiactivo aún.

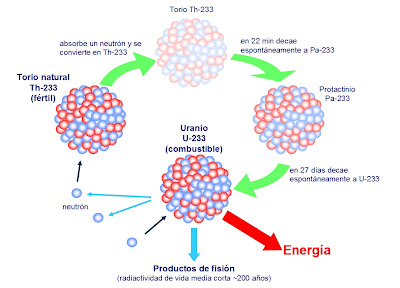

Por entonces, Rutherford, a su vez, separó del torio un torio X muy radiactivo, y comprobó también que el torio seguía produciendo más torio X. Hacia aquellas fechas se sabía ya que el más famoso de los elementos radiactivos, el radio , emitía un gas radiactivo, denominado radón. Por tanto, Rutherford y su ayudante, el químico Frederick Soddy, dedujeron que durante la emisión de sus partículas los átomos radiactivos se transformaron en otras variedades de átomos radiactivos.

, emitía un gas radiactivo, denominado radón. Por tanto, Rutherford y su ayudante, el químico Frederick Soddy, dedujeron que durante la emisión de sus partículas los átomos radiactivos se transformaron en otras variedades de átomos radiactivos.

El Radón, uno de los llamados gases nobles, es incoloro, inodoro e insípido, además de –para nuestro mal- radioactivo. Suele presentarse según el tipo de suelos de determinadas zonas y con la descomposición de uranio, concentrándose en la superficie y siendo “arrastrado” en y por el aire que respiramos, y es en grandes cantidades es un gas perjudicial para la salud… y que anticipa terremotos.

Varios químicos que investigaron tales transformaciones lograron obtener un surtido muy variado de nuevas sustancias, a las que dieron nombres tales como radio

químicos que investigaron tales transformaciones lograron obtener un surtido muy variado de nuevas sustancias, a las que dieron nombres tales como radio A, radio

A, radio B, mesotorio I, mesotorio II y actinio C. Luego los agruparon todos en tres series, de acuerdo con sus historiales atómicos. Una serie se originó del uranio disociado; otra del torio, y la tercera del actinio (si bien más tarde se encontró un predecesor del actinio, llamado protactinio).

B, mesotorio I, mesotorio II y actinio C. Luego los agruparon todos en tres series, de acuerdo con sus historiales atómicos. Una serie se originó del uranio disociado; otra del torio, y la tercera del actinio (si bien más tarde se encontró un predecesor del actinio, llamado protactinio).

En total se identificaron unos cuarenta miembros de esas series, y cada uno se distinguió por su peculiar esquema de radiación. Pero los productos finales de las tres series fueron idénticos: en último término, todas las cadenas de sustancias conducían al mismo elemento, el plomo.

finales de las tres series fueron idénticos: en último término, todas las cadenas de sustancias conducían al mismo elemento, el plomo.

Ahora bien, esas cuarenta sustancias no podían ser, sin excepción, elementos disociados. Entre el uranio (92) y el plomo (82) había sólo diez lugares en la tabla periódica, y todos ellos, salvo dos, pertenecían a elementos conocidos.

En realidad, los químicos descubrieron que aunque las sustancias diferían entre sí por su radiactividad, algunas tenían propiedades químicas idénticas. Por ejemplo, ya en 1.907 los químicos americanos Herbert Newby McCoy y W. H. Ross descubrieron que el radio-torio (uno entre los varios productos de la desintegración del torio) mostraba el mismo comportamiento químico que el torio, y el radio

de la desintegración del torio) mostraba el mismo comportamiento químico que el torio, y el radio D, el mismo que el plomo, tanto que a veces era llamado radio-plomo. De todo lo cual se infirió que tales sustancias eran en realidad variedades de mismo elemento: el radio-torio, una forma de torio; el radio-plomo, un miembro de una familia de plomos; y así sucesivamente.

D, el mismo que el plomo, tanto que a veces era llamado radio-plomo. De todo lo cual se infirió que tales sustancias eran en realidad variedades de mismo elemento: el radio-torio, una forma de torio; el radio-plomo, un miembro de una familia de plomos; y así sucesivamente.

En 1.913, Soddy esclareció esta idea y le dio más amplitud. Demostró que cuando un átomo emitía una partícula alfa, se transformaba en un elemento que ocupaba dos lugares más abajo en la lista de elementos, y que cuando emitía una partícula beta, ocupaba, después de su transformación, el lugar inmediatamente superior . Con arreglo a tal norma, el radiotorio descendía en la tabla hasta el lugar del torio, y lo mismo ocurría con las sustancias denominadas uranio X y uranio Y, es decir, que los tres serían variedades del elemento 90. Así mismo, el radio D, el radio B, el torio B y el actinio B compartirían el lugar del plomo como variedades del elemento 82.

. Con arreglo a tal norma, el radiotorio descendía en la tabla hasta el lugar del torio, y lo mismo ocurría con las sustancias denominadas uranio X y uranio Y, es decir, que los tres serían variedades del elemento 90. Así mismo, el radio D, el radio B, el torio B y el actinio B compartirían el lugar del plomo como variedades del elemento 82.

Soddy dio el nombre de isótopos (del griego iso y topos, “el mismo lugar”) a todos los miembros de una familia de sustancias que ocupaban el mismo lugar en la tabla periódica. En 1.921 se le concedió el premio Nobel de Química.

de isótopos (del griego iso y topos, “el mismo lugar”) a todos los miembros de una familia de sustancias que ocupaban el mismo lugar en la tabla periódica. En 1.921 se le concedió el premio Nobel de Química.

El modelo protón–electrón del núcleo concordó perfectamente con la teoría de Soddy sobre los isótopos. Al retirar una partícula alfa de un núcleo, se reducía en dos unidades la carga positiva de dicho núcleo, exactamente lo que necesitaba para bajar dos lugares en la tabla periódica. Por otra parte, cuando el núcleo expulsaba un electrón (partícula beta), quedaba sin neutralizar un protón adicional, y ello incrementaba en una unidad la carga positiva del núcleo, lo cual era como agregar una unidad al número atómico, y por tanto, el elemento pasaba a ocupar la posición inmediatamente superior en la tabla periódica de los elementos. ¡Maravilloso!

atómico, y por tanto, el elemento pasaba a ocupar la posición inmediatamente superior en la tabla periódica de los elementos. ¡Maravilloso!

¿Cómo se explica que cuando el torio se descompone en radio-torio después de sufrir no una, sino tres desintegraciones, el producto siga siendo torio? Pues bien, en este proceso el átomo de torio pierde una partícula alfa, luego una partícula beta, y más tarde una segunda partícula beta. Si aceptamos la teoría sobre el bloque constitutivo de los protones, ello significa que el átomo ha perdido cuatro electrones (dos de ellos contenidos presuntamente en la partícula alfa) y cuatro protones. (La situación actual difiere bastante de este cuadro , aunque en cierto modo, esto no afecta al resultado).

, aunque en cierto modo, esto no afecta al resultado).

El núcleo de torio constaba inicialmente (según se suponía) de 232 protones y 142 electrones. Al haber perdido cuatro protones y otros cuatro electrones, quedaba reducido a 228 protones y 138 electrones. No obstante, conservaba todavía el número atómico 90, es decir, el mismo de antes.

atómico 90, es decir, el mismo de antes.

Así pues, el radiotorio, a semejanza del torio, posee 90 electrones planetarios, que giran alrededor del núcleo. Puesto que las propiedades químicas de un átomo están sujetas al número de sus electrones planetarios, el torio y el radiotorio tienen el mismo comportamiento químico, sea cual fuere su diferencia en peso atómico (232 y 228 respectivamente).

de sus electrones planetarios, el torio y el radiotorio tienen el mismo comportamiento químico, sea cual fuere su diferencia en peso atómico (232 y 228 respectivamente).

Los isótopos de un elemento se identifican por su peso atómico, o número másico. Así, el torio corriente se denomina torio 232, y el radio-torio, torio 228. Los isótopos radiactivos del plomo se distinguen también por estas denominaciones: plomo 210 (radio D), plomo 214 (radio B), plomo 212 (torio B) y plomo 211 (actinio B).

Se descubrió que la noción de isótopo podía aplicarse indistintamente tanto a los elementos estables como a los radiactivos. Por ejemplo, se comprobó que las tres series radiactivas anteriormente mencionadas terminaban en tres formas distintas de plomo. La serie del uranio acababa en plomo 206, la del torio en plomo 208 y la del actinio en plomo 207. cada uno de estos era un isótopo estable y corriente del plomo, pero los tres plomos diferían por su peso atómico.

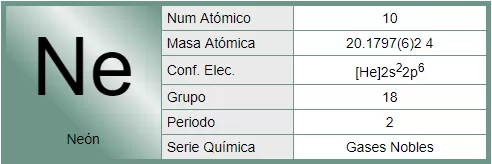

Mediante un dispositivo inventado por cierto ayudante de J. J. Thomson, llamado Francis William Aston, se demostró la existencia de los isótopos estables. En 1.919, Thomson, empleando la versión primitiva de aquel artilugio, demostró que el neón estaba constituido por dos variedades de átomos: una cuyo número de masa era 20, y otra con 22. El neón 20 era el isótopo común; el neón 22 lo acompañaba en la proporción de un átomo cada diez. Más tarde se descubrió un tercer isótopo, el neón 21, cuyo porcentaje en el neón atmosférico era de un átomo por cada 400.

de masa era 20, y otra con 22. El neón 20 era el isótopo común; el neón 22 lo acompañaba en la proporción de un átomo cada diez. Más tarde se descubrió un tercer isótopo, el neón 21, cuyo porcentaje en el neón atmosférico era de un átomo por cada 400.

Entonces fue posible, al fin, razonar el peso atómico fraccionario de los elementos. El peso atómico del neón (20, 183) representaba el peso conjunto de los tres isótopos, de pesos diferentes, que integraban el elemento en su estado natural. Cada átomo individual tenía un número másico entero, pero el promedio de sus masas (el peso atómico) era un número fraccionario.

másico entero, pero el promedio de sus masas (el peso atómico) era un número fraccionario.

Aston procedió a mostrar que varios elementos estables comunes eran, en realidad, mezclas de isótopos. Descubrió que el cloro, con un peso atómico fraccionario de 35’453, estaba constituido por el cloro 35 y el cloro 37, en la proporción de cuatro a uno. En 1.922 se le otorgó el premio Nobel de Química.

que varios elementos estables comunes eran, en realidad, mezclas de isótopos. Descubrió que el cloro, con un peso atómico fraccionario de 35’453, estaba constituido por el cloro 35 y el cloro 37, en la proporción de cuatro a uno. En 1.922 se le otorgó el premio Nobel de Química.

Sabiendo todo lo anteriormente explicado, hemos llegado a comprender cómo parte de la Astronomía que estudia las características físicas y químicas de los cuerpos celestes, la astrofísica es la parte más importante de la astronomía en la actualidad debido a que, al avanzar la física moderna: Efecto Doppler-Fizeau, el efecto Zeeman, las teorías cuánticas y las reacciones termonucleares aplicadas al estudio de los cuerpos celestes han permitido descubrir que el campo

de la astronomía en la actualidad debido a que, al avanzar la física moderna: Efecto Doppler-Fizeau, el efecto Zeeman, las teorías cuánticas y las reacciones termonucleares aplicadas al estudio de los cuerpos celestes han permitido descubrir que el campo magnético solar, el estudio de las radiaciones estelares y sus procesos de fusión nuclear, y determinar la velocidad radial de las estrellas, etc. La radiación electromagnética de los cuerpos celestes permite realizar análisis de los espectros que nos dicen de qué están hechas las estrellas y los demás cuerpos del espacio interestelar y, de esa manera, hemos ido conociendo la materia y sus secretos que cada vez, van siendo menos.

magnético solar, el estudio de las radiaciones estelares y sus procesos de fusión nuclear, y determinar la velocidad radial de las estrellas, etc. La radiación electromagnética de los cuerpos celestes permite realizar análisis de los espectros que nos dicen de qué están hechas las estrellas y los demás cuerpos del espacio interestelar y, de esa manera, hemos ido conociendo la materia y sus secretos que cada vez, van siendo menos.

Emilio Silvera V.

Nov

22

¡Las Galaxias! ¡La Entropía! ¡El Universo! ¡La Vida!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Astronomía y Astrofísica ~

Clasificado en Astronomía y Astrofísica ~

Comments (0)

Comments (0)

Vía Láctea (como otras galaxias espirales) es una zona de reducción de entropía…, así se deduce de varios estudios realizados y se puede argumentar que, las galaxias deben ser consideradas, por su dinámica muy especial, como sistemas vivos. En planteamiento más prudente se señala que el test de Lovelock constituye lo que se llama una condición “necesaria, pero no suficiente” para la existencia de vida. Si un sistema se encuentra en equilibrio termodinámico -si no supera el test de Lovelock-, podemos tener la seguridad de que está muerto. Si está vivo, debe producir una reducción de la entropía y superar dicho test.

Pero un sistema podría producir entropía negativa sin estar vivo, como en el caso de contracción por efecto de la gravedad que hemos comentado a lo largo de estos trabajos. Desde este punto de vista, no hay frontera claramente definida entre los objetos vivos y la materia “inerte”. Yo, por mi parte creo que, la materia nunca es inerte y, en cada momento, simplemente ocupa la fase que le ha tocado representar en ese punto del espacio y del tiempo.

James y Sandy Lovelock ¿Qué haríamos sin ellas?

El mero hecho de que la frontera entre la vida y la ausencia de vida sea difuso, y que el lugar en el que haya que trazar la línea sea un tema de discusión, es, sin embargo, un descubrimiento importante. Contribuye a dejar claro que en relación con la vida no hay nada insólito en el contexto del modo en que funciona el Universo.

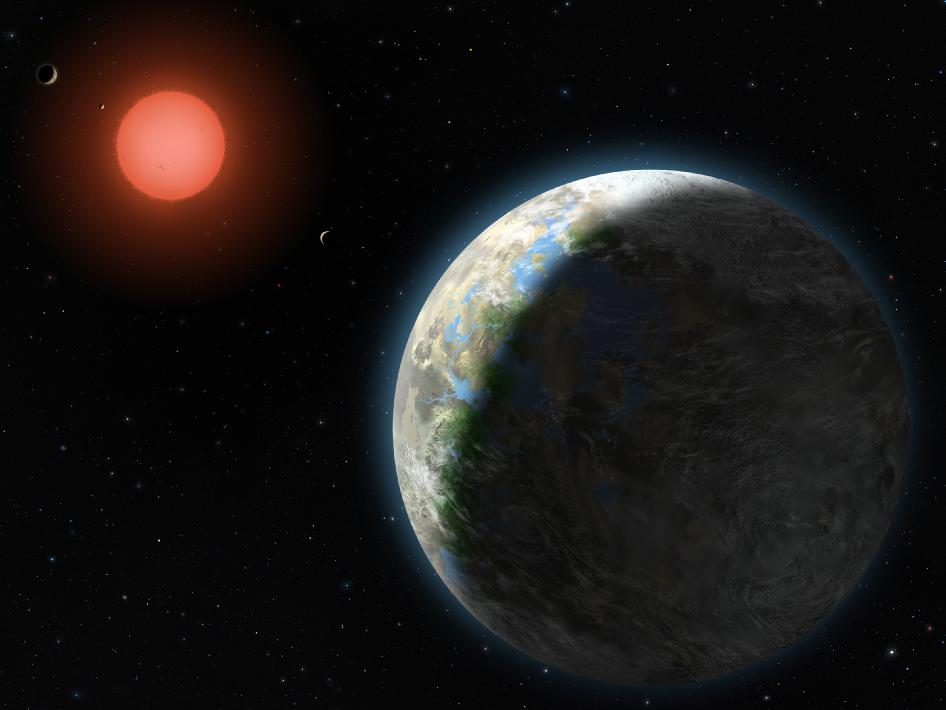

Como ya hemos visto en las explicaciones de otros trabajos expuestos aquí, es natural que los sistemas simples se organicen en redes al borde del caos y, una vez que lo hacen, es natural que la vida surja allí donde hay “una pequeña charca caliente” que sea adecuada para ello. Esto es parte de un proceso más o menos continuo, sin que haya un salto repentino en el que comience la vida. Desde ese punto de vista, lo más importante que la ciencia podría lograr sería el descubrimiento de, al menos, otro planeta en el que haya surgido la vida.

Gracias a la teoría de Lovelock sobre la naturaleza de la vida estamos a punto de poder conseguirlo, y es posible que antes de los próximos 50 años se lance al espacio un telescopio capaz de encontrar planetas con sistemas como el de Gaia, nuestra Tierra.

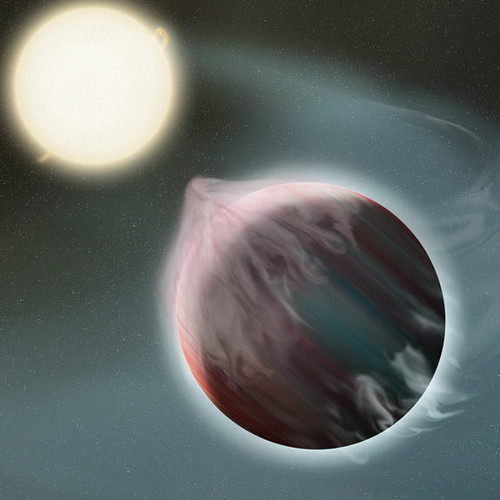

Hay dos etapas del descubrimiento de estas otras Gaias. En primer lugar debemos ser capaces de detectar otros planetas del tamaño de la Tierra que describan órbitas alrededor de otras estrellas; luego tenemos que analizar la atmósfera de esos planetas para buscar pruebas de que los procesos de reducción de la entropía están en marcha. Los primeros planetas “extrasolares” se detectaron utilizando técnicas Doppler, que ponían de manifiesto unos cambios pequeñísimos en el movimiento de las estrellas alrededor de las cuales orbitaban dichos planetas. Este efecto, que lleva el nombre del físico del siglo XIX Christian Doppler, modifica la posición de las líneas en el espectro de la luz de un objeto, desplazándolas en una cantidad que depende de lo rápido que el objeto se mueva con respecto al observador.

Zonas habitables, los astrónomos han ignorado las enanas blancas en su búsqueda de exoplanetas. Esto puede haber sido un error, de acuerdo con un nuevo estudio de zonas habitables en enanas blancas. Aunque los agujeros negrosy las estrellas de neutrones captan toda la atención como destinos finales de las estrellas, la mayor parte nunca llegarán a ese extremo. Aproximadamente el 97 por ciento de las estrellas de nuestra galaxia no son lo bastante masivas para acabar en ninguna de esas dos opciones.

En lugar de eso, los astrónomos creen que terminarán sus vidas como enanas blancas, densos y calientes trozos de materia inerte en los que las reacciones nucleares terminaron hace mucho. Estas estrellas tienen aproximadamente el tamaño de la Tierra y se mantienen en contra del colapso gravitatorio mediante el Principio de Exclusión de pauli, el cual evita que los electrones ocupen el mismo estado al mismo tiempo. Pero, a todo esto, hay que pensar en el tirón gravitatoria que una de estas estrellas podría incidir sobre cualquier planeta.

Para hacernos una idea de lo que es este tipo de observaciones, pensemos que el tirón gravitatorio que Júpiter ejerce sobre el Sol produce en éste un cambio de velocidad de unos 12,5 metros por segundo, y lo desplaza (con respecto al centro de masa del Sistema solar) a una distancia de 800.000 kilómetros, más de la mitad del diámetro de este astro, cuando el Sol y Júpiter orbitan en torno a sus recíprocos centros de masa. La velocidad de este movimiento es comparable a la de un corredor olímpico de 100 metros lisos y, para un observador situado fuera del Sistema solar, esto, por el efecto Doppler, produce un pequeñísimo desplazamiento de vaiven en la posición exacta de las líneas del espectro de luz emitida por el Sol.

Se trata del tipo de desplazamiento que se ha detectado en la luz a partir de los datos de algunas estrellas de nuestro entorno, y demuestra que en torno a ellas orbitan cuerpos celestes similares a Júpiter. Como ilustración diremos que la Tïerra induce en el Sol, mientras orbita alrededor de él, un cambio de velocidad de tan sólo 1 metro por segundo (la velocidad de un agradable paseo), y desplaza al Sol únicamente 450 kilómetros, con respecto al centro de masa del Sistema solar. No se dispone aún de la tecnología necesaria para medir un efecto tan pequeño a distancias tales como las de nuestras estrellas, y, pensemos que, la más cercana (Alfa Centauri), está situada a 4,3 a.l. de la Tierra, esta es la razón por la cual no se han detectado aún planetas similares a la Tierra.

Sistema Alfa Centauri

Hay otras técnicas que podrían servir para identificar planetas más pequeños. Si el planeta pasa directamente por delante de su estrella (una ocultación o un tránsito), se produce un empalidecimiento regular de la luz procedente de dicha estrella. Según las estadísticas, dado que las órbitas de los planetas extrasolares podrían estar inclinadas en cualquier dirección con respecto a nuestra posición, sólo el 1 por ciento de estos planetas estará en órbitas tales que podríamos ver ocultaciones y, en cualquier caso, cada tránsito dura sólo unas pocas horas (una vez al año para un planeta que tenga una órbita como la de la Tierra; una vez cada once años para uno cuya órbita sea como la de Júpiter.

El universo observable tiene un diámetro de aproximadamente 93 mil millones de años luz. Las distancias dentro del Sistema Solar se miden en unidades astronómicas (UA), donde 1 UA es la distancia media entre la Tierra y el Sol, alrededor de 150 millones de kilómetros. Para distancias más grandes fuera del Sistema Solar, se utiliza el año luz, que es la distancia que recorre la luz en un año, y es equivalente a unos 9,46 billones de kilómetros.

Cuando los humanos miramos al espacio y pensamos en sus increíbles distancias, es inevitable imaginar que sería posible encontrar algún sitio como nuestra casa. No sería lógico creer que sólo en la Tierra se han dado las condiciones para la vida. En nuestra misma Galaxia, planetas como la Tierra los hay a miles o cientos de miles.

Existen, sin embargo, proyectos que mediante el sistema de lanzar satélites al espacio que controlaran el movimiento (cada uno de ellos) de un gran número de estrellas con el fin de buscar esas ocultaciones. Si se estudian 100.000 estrellas, y 1.000 de ellas muestran tránsitos, la estadística resultante implicaría que prácticamente

toda estrella similar al Sol está acompañada por planetas. Sin embargo, aunque todas las búsquedas de este tipo son de un valor inestimable, la técnica Doppler es la que, de momento, se puede aplicar de manera más general a la búsqueda de planetas similares a la Tierra. De cualquier manera, independientemente de los planetas de este tipo que se descubran, lo que está claro es que, de momento, carecemos de la tecnología necesaria para dicha búsqueda.

La mejor perspectiva que tenemos en el momento inmediato, es la que nos ofrece el satélite de la NASA llamado SIM (Space Interforometry Mission) que mediante la técnica de interferometría (combinar los datos de varios telescopios pequeños para imitar la capacidad de observación de un telescopio mucho mayor) ver y medir la posición de las estrellas con la exactitud necesaria para descubrir las oscilaciones que delaten la presencvia de planetas como la Tierra que describen orbitas alrededor de cualquiera de las 200 estrellas más cercanas al Sol, así como por cualquiera de los planetas similares a Júpiter hasta una distancia del Sol que podría llegar hasta los 3.000 años luz.

Hacia el final de la década presente (si todo va bien), la Agencia Espacial Europea lanzará un satélite cuyo nombre será GAIA y que tendrá como misión principal, no precisamente buscar otras Gaias, sino trazar un mapa con las posiciones de los mil millones de objetos celestes más brillantes. Dado que GAIA tendrá que observar tantas estrellas, no mirará cada una muchas veces ni durante mucho tiempo, por lo que no podría detectar las oscilaciones ocasionadas por planetas similares a la Tierra; pero si podría detectar planetas del tamaño de Júpiter y, si estos planetas son tan abundantes como parece indicar los datos obtenidos hasta ahora, no es descabellado pensar que, puedan estar acompañados, como en nuestro propio Sistema solar, por otros planetas más pequeños.

Dentro de los próximos 10 años, deberíamos tener localizados decenas de miles de sistemas planetarios extrasolares en las zonas de la Vía Láctea próxima a nosotros. Sin embargo, seguiría tratándose de observaciones indirectas y, para captar los espectros de algunos de esos planetas, se necesita dar un salto más en nuestra actual tecnología que, como he dicho, resulta insuficiente para realizar ciertas investigaciones que requieren y exigen mucha más precisión.

Los nuevos proyectos y las nuevas generaciones de sofisticados aparatos de alta precisión y de IA avanzada, nos traerán, en los próximos 50 años, muchas alegrías y sorpresas que ahora, ni podemos imaginar.

Cambiemos de tema: ¿Qué es una partícula virtual?

Diagrama de Feynmann. No pocas veces hemos dicho que, en una partícula virtual las relaciones que normalmente existen entre las magnitudes físicas de cualquier partícula no tienen por qué cumplirse. En particular, nos interesan dos magnitudes, que seguro que conocéis de sobras: energía y momento.

Por partícula-antipartícula que aparece de la “nada” y luego se aniquila rápidamente sin liberar energía. Las partículas virtuales pueblan la totalidad del espacio en enormes cantidades, aunque no pueden ser observadas directamente.

En estos procesos no se viola el principio de conservación de la masa y la energía siempre que las partículas virtuales aparezcan y desaparezcan lo suficientemente rápido como para que el cambio de masa o energía no pueda ser detectado. No obstante, si los miembros de una partícula virtual se alejan demasiado como para volverse a juntar, pueden convertirse en partículas reales, según ocurre en la radiación Hawking de un agujero negro; la energía requerida para hacer a las partículas reales es extraída del agujero negro.

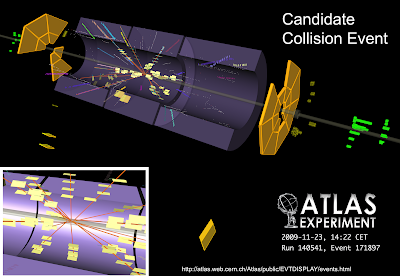

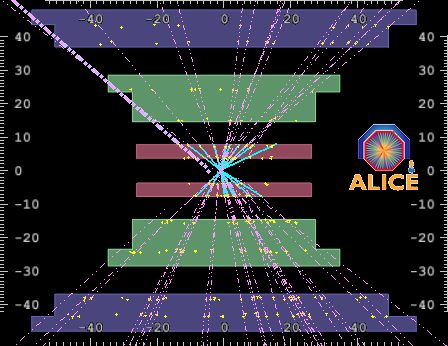

En el Gran Colisionador de Hadrones (LHC) a las 14:22 del día 23 de Noviembre del 2009, el detector ATLAS registro la primera colisión de protones en el LHC, seguido del detector CMS, y mas tarde los detectores ALICE y LHCb. Estas primeras colisiones solo son para probar la sincronización de las colisiones de haces de protones con cada uno de los detectores, lo cual resultó con éxito en cada uno de los experimentos y, marca un avance muy alentador hacia la tan esperada etapa (pasada en parte) de toma de datos donde se pueda buscar la partícula dadora de masas a las demás partículas, Super Simetría, Dimensiones Extras, y tantas otras cosas mas que surgen de la inmensa imaginación del intelecto humano.

Es sin duda un momento para recordar, especialmente para aquellos que han invertido parte de su vida en un proyecto tan grande e importante como este con la esperanza de alcanzar el conocimiento sobre la materia, la Naturaleza y el Universo mismo que, nunca pudimos soñar.

Pero, continuémos con la virtualidad de las partículas. La vida media de una partícula virtual aumenta a medida que disminuye la masa o energía involucrada. Así pues, un electrón y un positrón pueden existir durante unos 4×10-21 s, aunque un par de fotones de radio con longitud de onda de 300.000 km pueden vivir hasta un segundo.

En realidad, lo que llamamos espacio vacío, está rebosante de partículas virtuales que bullen en esa “nada” para surgir y desaparecer continuamente en millonésimas de segundo. ¡los misterios del Universo!

¿Qué es la Era de Planck? La Era de Planck es un período en la historia temprana del universo que se extiende desde el momento del Big Bang hasta aproximadamente 10–43 segundos después del evento inicial

En la teoría del Big Bang, fugaz periodo de tiempo entre el propio Big Bang y el llamado Tiempo de Planck, cuando el Universo tenía 10-43 segundo de edad y la temperatura era de 1034 k.

Durante este periodo, se piensa que los efectos de la Gravitación cuántica fueron dominantes. La comprensión teórica de esta fase es virtualmente inexistente.

Plasma.

El plasma forma las estrellas y otros objetos estelares que podemos ver, es la mayor concentración de materia del universos visible. Según algunos el cuarto estado de la materia que consiste en electrones y otras partículas subatómicas sin ninguna estructura de un orden superior a la de los núcleos atómicos.

Se trata de un Gas altamente ionizado en el que el número de electrones libres es aproximadamente igual al número de iones positivos. Como dije antes, a veces descrito como el cuarto estado de la materia, las plasmas aparecen en el espacio interestelar, en las atmósferas de las estrellas (incluyendo el Sol), en tubos de descarga y en reactores nucleares experimentales.

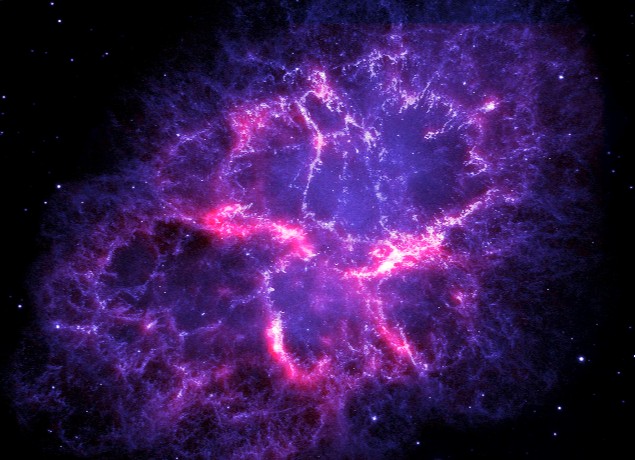

El plasma está bien presente en todos los remanentes de supernovas

Debido a que las partículas en un plasma están cargadas, su comportamiento difiere en algunos aspectos a un gas. Los plasmas pueden ser creados en un laboratorio calentando un gas a baja presión hasta que la energía cinética media de las partículas del gas sea comparable al potencial de ionización de los átomos o moléculas de gas. A muy altas temperaturas, del orden de 50.000 K en adelante, las colisiones entre las partículas del gas causan una ionización en cascada de este. Sin embargo, en algunos casos, como en lámparas fluorescentes, la temperatura permanece muy baja al estar las partículas del plasma continuamente colisionando con las paredes del recipiente, causando enfriamiento y recombinación. En esos casos la ionización es solo parcial y requiere un mayor aporte de energía.

En los reactores termonucleares, es posible mantener una enorme temperatura del plasma confinándolo lejos de las paredes del contenedor usando campos electromagnéticos.

El estudio de los plasmas se conoce como física de plasmas y, en el futuro, dará muy buenos beneficios utilizando en nuevas tecnologías como la nanotecnología que se nos viene encima y será el asombro del mundo.

Pluralidad de mundos.

Muchos mundos, como la Tierra, estarán situados en la zona habitable de sus estrellas y, el agua líquida, correra por los riachuelos y océanos. Si eso es así (que lo será), muchos mundos estarán habitados y, algún día lejano en el futuro, podremos saber de ellos con precisión antes de que se produzca el contacto.

Desde tiempos inmemoriales, grandes pensadores de los siglos pasados, dejaron constancia de sus pensamientos y creencia de que, allá arriba, en los cielos, otras estrellas contenían mundos con diversidad de vida, como en el planeta Tierra. Tales ideas, han acompañado al hombre que, no en pocas oportunidades, fueron tachados de locos.

Hoy, con los conocimientos que poseemos, lo que sería una locura es precisamente pensar lo contrario. ¡que estamos solos!

La Vía Láctea (una sola Galaxia de los cientos de miles de millones que pueblan el Universo), tiene más de 100.000 millones de estrellas. Miles de millones de Sistemas Solares. Cientos de miles de millones de planetas. Muchos miles y miles de estrellas como el Sol de tamaño mediano, amarillas de tipo G.

¿Cómo podemos pensar que solo el planeta Tierra alberga vida?

Protogalaxia.

Galaxia en proceso de formación. A pesar de la enorme técnica y sofisticación de los aparatos con que contamos para la observación del cosmos, no se ha podido encontrar ninguna proto-galaxia cercana, lo cual indica que todas o la mayoría de las galaxias se formaron hace mucho tiempo. Por otra parte, los científicos pensaban que no existía nada mas pequeño que un protón. En 1968 se descubrieron nuevas partículas dentro del protón, las cuales fueron llamadas quarks. Existen tres quarks dentro de cada protón, estos quarks se mantienen unidos entre sí mediante otras partículas llamadas gluones.

Partícula masiva del Grupo o familia de los Hadrones que se clasifica como Barión. Esta hecho por dos quarks up y un quark down y es, consecuentemente una partícula masiva con 938,3 MeV, algo menos que la del neutron. Su carga es positiva y su lugar está en el núcleo de los átomos, por lo que se les llama de manera genérica con los neutrones con la denominación de nucleones.

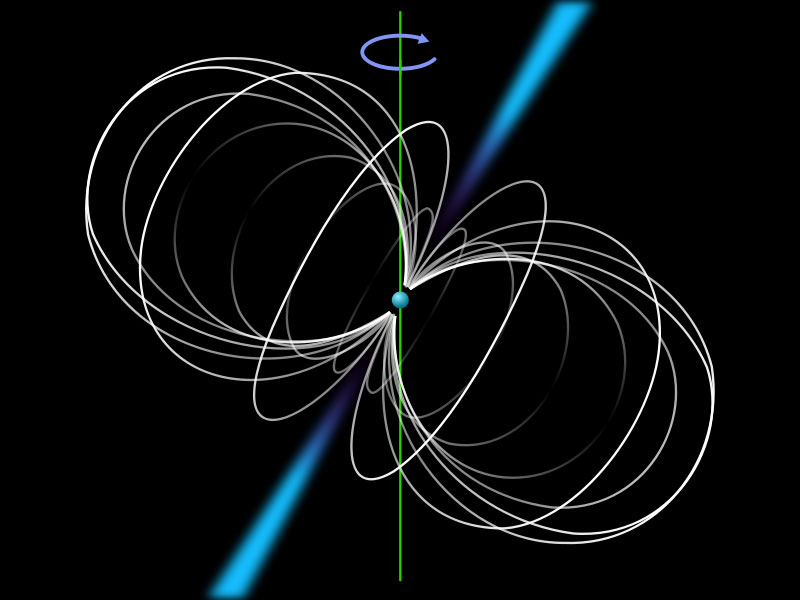

Este diagrama esquemático de un púlsar ilustra las líneas de campo magnético en blanco, el eje de rotación en verde y los dos chorros polares de radiación en azul. Un Pulsar es… Una fuente de radio desde la que se recibe un tren de pulsos altamente regular. Ha sido catalogado más de 600 púlsares desde que se descubriera el primero en 1.976. Los púlsares son estrellas de neutrones en rápida rotación, con un diámetro de 20-30 km. Las estrellas se hallan altamente magnetizadas (alrededor de 108 teslas), con el eje magnético inclinado con respecto, al eje de rotación. La emisión de radio se cree que surge por la aceleración de partículas cargadas por encima de los polos magnéticos. A medida que rota la estrella, un haz de ondas de radio barre la Tierra, siendo entonces observado el pulso, de forma similar a un faro.

Los periodos de los pulsos son típicamente de 1 s., pero varían desde los 1’56 ms (púlsares de milisegundo) hasta los cuatro con tres s. Estos periodos rotacionales van decreciendo a medida que la estrella pierde energía rotacional, aunque unos pocos púlsares jóvenes son propensos a súbitas perturbaciones conocidas como ráfagas.

Las medidas precisas de tiempos en los púlsares han revelado la existencia de púlsares binarios, y un púlsar, PSR 1257+12, se ha demostrado que está acompañado de objetos de masa planetaria. Han sido detectado objetos ópticos (destellos) procedentes de unos pocos púlsares, notablemente los púlsares del Cangrejo y Vela.

Se crean en explosiones de supernovas de estrellas supergigantes y otros a partir de enanas blancas, se piensa que puedan existir cien mil en la Vía Láctea.

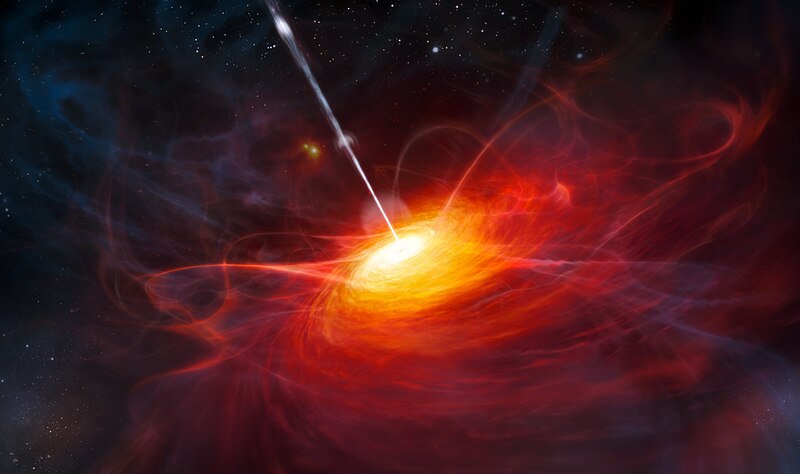

Quasars

Objeto con un alto desplazamiento al rojo y con apariencia de estrella, aunque es probablemente el núcleo activo muy luminoso de una galaxia muy distante. El nombre es una contracción del ingles quasi stellar, debido a su apariencia estelar. Los primeros quasars descubiertos eran intensos fuentes de radio. Debido a las grandes distancias indicadas por el desplazamiento al rojo del núcleo debe ser hasta 100 veces más brillante que la totalidad de una galaxia normal. Además algunos quasars varían en brillo en una escala de tiempo de semanas, indicando que esta inmensa cantidad de energía se origina en un volumen de unas pocas semanas-luz de longitud. La fuente puede, por tanto, ser un disco de acreción alrededor de un agujero negro de 107 o 108 masas solares.

Imagen de 3C273 recogida por el telescopio Hubble

El primer quasar en ser identificado como tal en 1.963 fue la radiofuente 3c 273 con un desplazamiento al rojo de 0,158, siendo todavía el quasar más brillante, óptimamente hablando, observado desde la Tierra, con magnitud 13. Miles de quasar han sido descubiertos desde entonces. Algunos tienen desplazamiento al rojo tan grandes como 4,9, implicando que lo vemos tal como eran cuando el Universo tenía sólo una décima parte de la edad actual.

En esta brevísima reseña no puede dejarse constancia de todo lo que se sabe sobre quasars, sin embargo, dejamos los rasgos más sobresalientes para que el lector obtenga un conocimiento básico de estos objetos estelares. Para finalizar la reseña diré que, algunas galaxias aparentemente normales pueden contener remanentes de actividad quasar en sus núcleos, y algunas galaxias Seyfert y galaxias Markarian tienen núcleos que son intrínsecamente tan brillantes como algunos quasars. Existen algunas evidencias de que los quasars aparecen en los núcleos de los espirales, y es esa interacción con una galaxia vecina la que proporciona gas o estrellas al núcleo formado por un agujero negro masivo, alimentando así la emisión del quásar. Salvo mejor parecer.

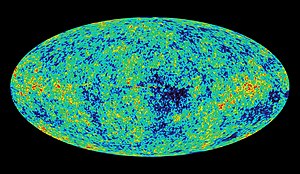

La radiación cósmica de fondo es la luz residual que quedó de ese momento, y actualmente se presenta como un fondo de microondas en todas las direcciones del cielo. La radiación cósmica de fondo fue descubierta, en 1965, por los astrónomos Arno Penzias y Robert Wilson.

Radiación cósmica de fondo.

Antes, hemos comentado por alguna parte que, se trata de emisión radio de microondas proveniente de todas las direcciones (isotrópica) y que corresponde a una curva de cuerpo negro. Estas propiedades coinciden con las predichas por la teoría del Big Bang, como habiendo sido generada por fotones liberados del Big Bang cuando el Universo tenía menos de un millón de años (Universo bebé) de antigüedad.

La teoría del Big Bang también supone la existencia de radiaciones de fondo de neutrinos y gravitatoria, aunque aun no tenemos los medios para detectarlas. Sin embargo, los indicios nos confirman que la teoría puede llevar todas las papeletas para que le toque el premio.

Últimamente se ha detectado que la radiación cósmica de fondo no está repartida por igual por todo el Universo, sino que, al contrario de lo que se podía esperar, su reparto es anisotrópico, el reparto está relacionado con la clase de materia que produjo tal radiación, su densidad. ¡Ya veremos!

De todas las maneras, ¿No es una maravilla todo el Universo? El que nosotros, estemos aquí para contarlo así lo testifica.

Emilio Silvera V.

Totales: 86.924.866

Totales: 86.924.866 Conectados: 153

Conectados: 153