Oct

18

¡La Entropía! con el paso del tiempo, todo lo destruye

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en La Entropía lo destruye todo ~

Clasificado en La Entropía lo destruye todo ~

Comments (1)

Comments (1)

Sí, es cierto. Nosotros somos parte del Universo: La que piensa

Un mundo de apariencias: El problema duro de la conciencia. Las arenas movedizas en la que nos estamos hundiendo cuando tratamos de saber sobre lo que la Mente es, una “máquina” asombrosa que crea idea y pensamientos… Y, ¡sentimientos!

A primera vista el edificio de la Ciencia aparenta estar erigido sobre suelo firme y profundos cimientos, como una Unidad congruente, monolítica, dando fe de una sola realidad. Sin embargo, la ciencia es un constructo dinámico y cambiante.

Como decía Thomas Kuhn: “Parece más bien una estructura destartalada con escasa coherencia, es producto de la observación, del razonamiento y también de muchas pasiones, siempre de seres humanos”.

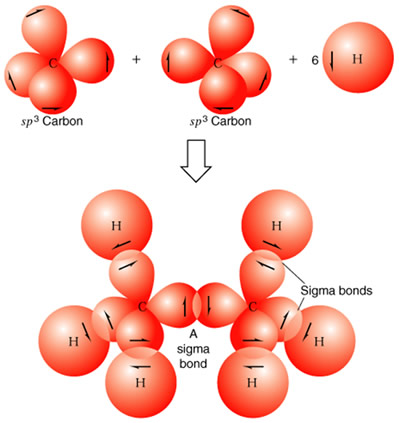

El átomo de carbono

La química de los compuestos que contienen carbono se denomina química orgánica. Originalmente se la llamaba así porque se creía que solo los organismos vivos podían fabricar o poseer estos compuestos.

Los compuestos orgánicos se basan en el carbono combinado con otros átomos de carbono y con otros elementos como el hidrógeno, el nitrógeno, el azufre , etc. Formando grandes estructuras con distinta complejidad y diversidad, el átomo de carbono unirse a otros átomos de carbono formando largas cadenas las cuales pueden ser lineales, ramificadas o bien cíclicas. Se han aislado miles de compuestos de carbono de varios sistemas biológicos, aquí algunos ejemplos:

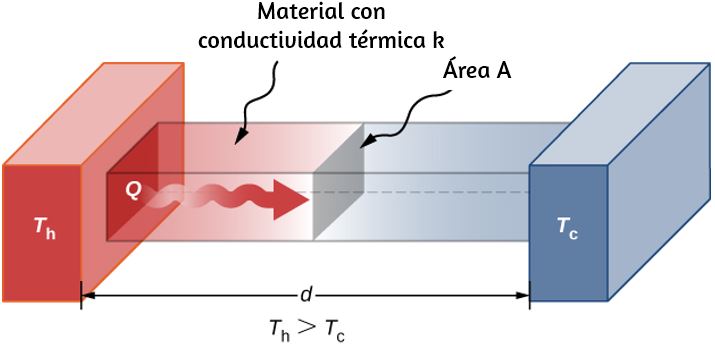

La parte caliente transmite a la fría energía calorífica hasta que se igualan

Muchas veces he dejado aquí una reseña de lo que se entiende por entropía y así sabemos que la energía sólo puede ser convertida en cuando dentro del sistema concreto que se esté utilizando, la concentración de energía no es uniforme. La energía tiende entonces a fluir desde el punto de mayor concentración al de menor concentración, hasta establecer la uniformidad. La obtención de trabajo a partir de energía consiste precisamente en aprovechar este flujo.

En realidad, la Entropía, no nos debe resultar tan extraña como esa imagen de arriba. Es algo que está presente en toda nuestra vida cotidiana. Sus efectos los podemos ver en todo lo que nos rodea y sentir en nosotros mismos. Nada permanece igual, todo cambia y se transforma: Es la Entropía destructora que hace estragos en connivencia con el tiempo.

Los personajes de la segunda imagen son los mismos que los de la primera: ¿Qué ha cambiado?

Ha cambiado que el paso del Tiempo con su “prima” la Entropía, han hecho su trabajo

Está claro que la madre ha sufrido más intensamente los efectos de la entropía que la graciosa niña que está comenzando su andadura por la vida. ¡El Tiempo! Ese inexorable transcurrir de la fatídica flecha que nos lleva, desde el mismo instante del nacimiento, hasta el inevitable final: Es la Entropía destructora, ese mecanismo del que se vale nuestro Universo para renovarlo todo, incluso la vida que, de otra manera, no podría evolucionar, y, de alguna manera, ese surgir de la vida nueva, y las nuevas estrellas y nuevos mundos que nacen en las galaxias, se podría considerar como entropía negativa, es decir, algo que está ocurriendo para que el Caos no sea total.

El agua de un río está más baja y tiene menos energía gravitatoria en el manantial del que mana en lo alto de la montaña y menos energía en el llano en la desembocadura, donde fluye suave y tranquila. Por eso fluye el agua río abajo el mar (si no fuese por la lluvia, todas las aguas continentales fluirían montaña abajo hasta el mar y el nivel del océano subiría ligeramente. La energía gravitatoria total permanecería igual, pero estaría distribuida con mayor uniformidad).

Una rueda hidráulica gira gracias al agua que corre ladera abajo: ese agua puede realizar un . El agua sobre una superficie horizontal no puede realizar trabajo, aunque esté sobre una meseta muy alta y posea una energía gravitatoria excepcional. El factor crucial es la diferencia en la concentración de energía y el flujo hacia la uniformidad.

Y lo mismo reza para cualquier clase de energía. En las máquinas de vapor hay un depósito de calor que convierte el agua en vapor, y otro depósito frío que vuelve a condensar el vapor en agua. El factor decisivo es esta diferencia de temperatura. Trabajando a un mismo y único nivel de temperatura no se puede extraer ningún , por muy alta que sea aquella.

El término “entropía” lo introdujo el físico alemán Rudolf J. E. Clausius en 1.849 representar el grado de uniformidad con que está distribuida la energía, sea de la clase que sea. Cuanto más uniforme, mayor la entropía. la energía está distribuida de manera perfectamente uniforme, la entropía es máxima para el sistema en cuestión.

Rudolf J. E. Clausius

Clausius observó que cualquier diferencia de energía dentro de un sistema tiende siempre a igualarse por sí sola. Si colocamos un objeto caliente junto a otro frío, el calor fluye de manera que se transmite del caliente al frío hasta que se igualan las temperaturas de ambos cuerpos. Si tenemos dos depósitos de agua comunicados sí y el nivel de uno de ellos es más alto que el otro, la atracción gravitatoria hará que el primero baje y el segundo suba, hasta que ambos niveles se igualen y la energía gravitatoria quede distribuida uniformemente.

Clausius afirmó, por tanto, que en la naturaleza era regla general que las diferencias en las concentraciones de energía tendían a igualarse. O dicho de otra manera:

¡Que la entropía aumenta con el tiempo! Sí, en los Sistemas Cerrados

Si consideramos el Universo como un sistema cerrado (que lo es), al igual que nosotros mismos individualmente hablando, veremos que a medida que el Tiempo transcurre las cosas cambian, nada permanece.

El estudio del flujo de energía desde puntos de alta concentración a otros de baja concentración se llevó a cabo de modo especialmente complejo en relación con la energía térmica. Por eso, el estudio del flujo de energía y de los intercambios de energía y trabajo recibió el de “termodinámica”, que en griego significa “movimiento de calor”.

La termodinámica (significa “calor” y dinámico, que significa “fuerza”) es una rama de la física que estudia los fenómenos relacionados con el calor.

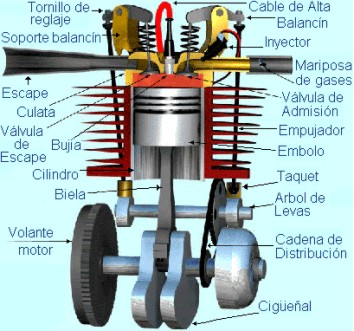

|

| Motor de combustión interna: transferencia de energía. |

Específicamente, la termodinámica se ocupa de las propiedades macroscópicas (grandes, en oposición a lo microscópico o pequeño) de la materia, especialmente las que son afectadas por el calor y la temperatura, así de la transformación de unas formas de energía en otras.

Con anterioridad se había llegado ya a la conclusión de que la energía no podía ser destruida ni creada. regla es tan fundamental que se la denomina “primer principio de la termodinámica”.

La idea sugerida por Clausius de que la entropía aumenta con el tiempo es una regla general no básica, y que denomina “segundo principio de la termodinámica.”

Según segundo principio, la entropía aumenta constantemente, lo cual significa que las diferencias en la concentración de energía también van despareciendo. Cuando todas las diferencias en la concentración de energía se han igualado por completo, no se puede extraer más , ni pueden producirse cambios.

¿Está degradándose el universo?

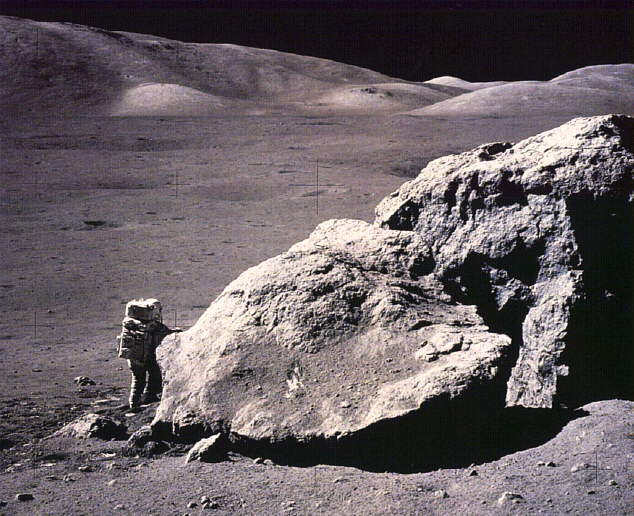

El tiempo corre y “las piezas” que conforman el Universo cambian, se destruyen y transforman

Pensemos en un reloj. Los relojes funcionan gracias a una concentración de energía en su resorte o en su batería. A medida que el resorte se destensa o la reacción química de la batería avanza, se establece un flujo de energía el punto de alta concentración al de baja concentración, y como resultado de este flujo anda el reloj. Cuando el resorte se ha destensado por completo o la batería ha finalizado su reacción química, el nivel de energía es uniforme en todo el reloj, no hay ya flujo de energía y la maquinaria se para. Podríamos decir que el reloj se ha “degradado”. Por analogía, decimos que el universo se “degradará” cuando toda la energía se haya igualado.

Si es cierto el segundo principio de la termodinámica, todas las concentraciones de energía en todos los lugares del universo se están igualando, y en ese sentido el universo se está degradando. La entropía alcanzará un máximo cuando la energía del universo esté perfectamente igualada; a partir de entonces no ocurrirá nada porque, aunque la energía seguirá allí, no habrá ya ningún flujo que haga que las cosas ocurran.

La situación parece deprimente (si el segundo principio es cierto), pero no es para alarmarse , ya que el proceso tardará billones de años en llegar a su final y el universo, tal como hoy existe, no sólo sobrevivirá a nuestro tiempo, sino que con toda probabilidad también a la humanidad misma.

De todo esto podemos obtener una consecuencia clara y precisa; de acuerdo con el segundo principio de la termodinámica, la entropía del universo está en constante aumento, es decir, la energía que contiene tiende a igualarse en todas partes. Así que, como cualquier proceso que iguala las concentraciones de energía está aumentando el desorden en el sistema, nuestro universo vez tiene un mayor desorden con los movimientos aleatorios libres de las partículas que lo componen, cuyo comportamiento no es más que una especie de medida del desorden que en el universo se produce de manera continuada.

Las tres generaciones de arriba nos habla del tiempo que pasa, de la entropía que es su compañera inseparable y, de los estragos que, en nosotros y en todas las cosas puede causar ese principio de que nada desaparece pero todo cambia.

La entropía está presente en la vida cotidiana: objetos que se descolocan, cosas que se desordenan, vestidos que se ensucian, un vaso que se cae y se rompe, los muebles que se llenan de polvo, el suelo que recoge las marcas de los pies que lo pisan, todo eso es entropía y, arreglarla, tenemos que disponer bien las cosas, recoger los objetos caídos, lavar la ropa y limpiar el suelo o quitar el polvo, con lo cual, la entropía continúa estando presente en el esfuerzo que todo ello conlleva y deteriora la , la aspiradora y nos causa a nosotros por el esfuerzo realizado (deterioro-entropía).

La entropía está ineludiblemente unida al tiempo, ambos caminan juntos. En procesos elementales en los que intervienen pocos objetos es imposible saber si el tiempo marcha delante o hacia atrás. Las leyes de la naturaleza se cumplen igual en ambos casos. Y lo mismo ocurre con las partículas subatómicas.

La figura muestra, al 50% del tamaño real, la trayectoria de un electrón entrando por la izquierda en una cámara de burbujas.

Un electrón curvándose en determinada dirección con el tiempo marchando hacia delante podría ser igualmente un positrón curvándose en la misma dirección, con el tiempo marchando hacia atrás. Si sólo consideramos esa partícula, es imposible determinar cuál de las dos posibilidades es la correcta.

En aquellos procesos elementales en que no se decir en que dirección marcha el tiempo, no hay cambio de entropía (o es tan pequeña la variación que podríamos ignorarla). Pero en los procesos corrientes, en las que intervienen muchas partículas, la entropía siempre aumenta. Que es lo mismo que decir que el desorden siempre aumenta.

Un saltador de trampolín cae en la piscina y el agua salpica arriba; cae un jarrón al suelo y se hace añicos; las hojas caen de los árboles y se desparraman por el suelo. El paso de los años nos transforman de jovenes en viejos, ¿quién puede remediar eso?

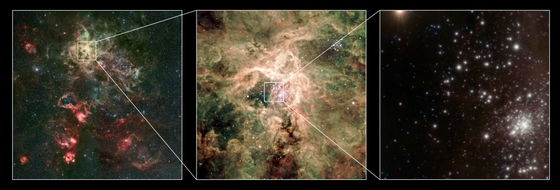

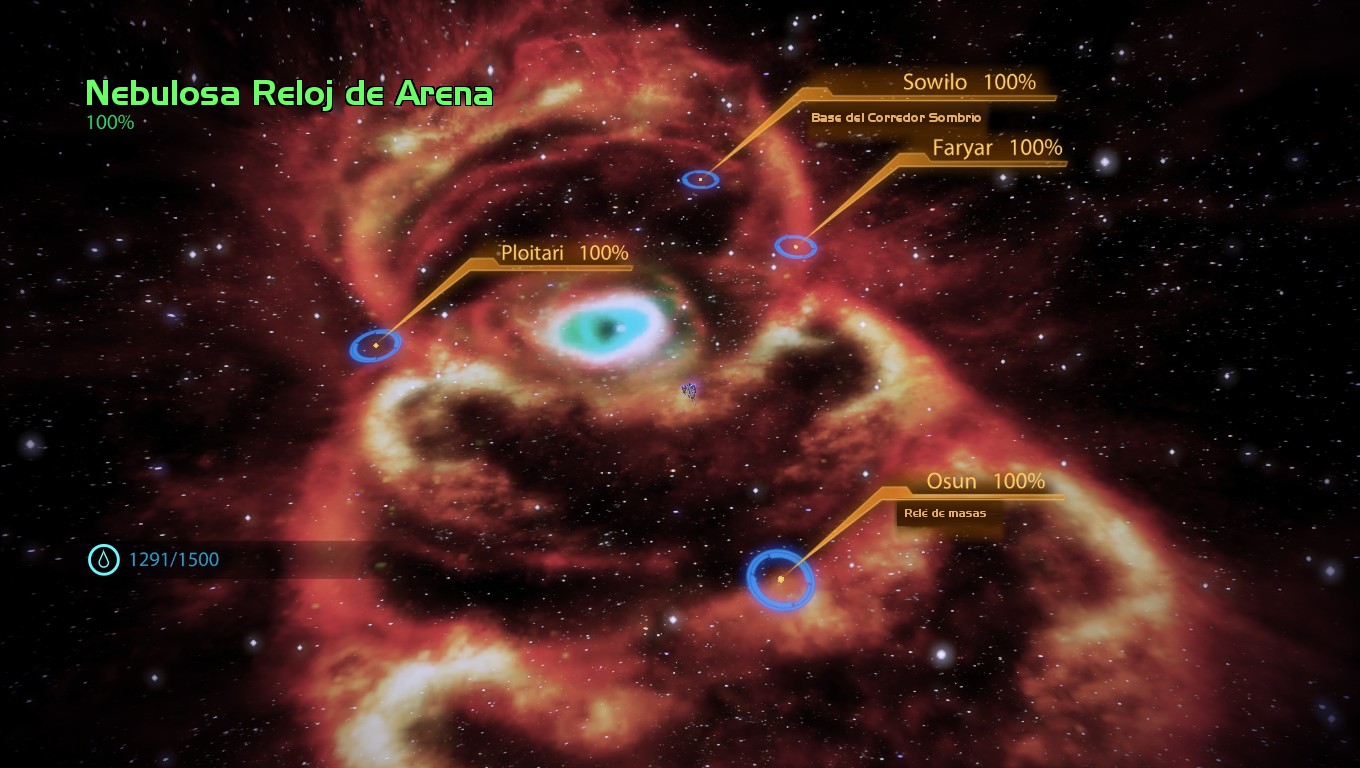

En lugares como este nacen nuevas estrellas, nuevos mundos y, en ellos… ¡Nuevas formas de Vida!

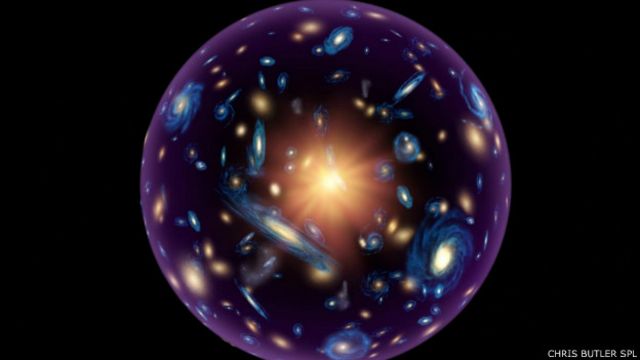

El Universo no es infinito y se renueva cíclicamente a partir del Caos destructor para que surja lo . ¡Qué me gustaría saber de donde surgió, en realidad, el Universo? ¿Será una fluctuación del vació que expulsó este universo nuestro de otro mayor? ¿Será, acaso, el mismo universo que se renueva una y otra ves? No parece que ese sea el caso. Lo cierto es que, sólo tenemos el Big bang y, sin la seguridad de que ese sea el comienzo cierto.

Que como todo, está condicionado por el paso del Tiempo

Se demostrar que todas estas cosas, y en general, todo cuanto ocurre normalmente a nuestro alrededor, lleva consigo un aumento de entropía. Estamos acostumbrados a ver que la entropía aumenta y aceptamos ese como señal de que todo se desarrolla normalmente y de que nos movemos hacia delante en el tiempo. Si de pronto viésemos que la entropía disminuye, la única manera de explicarlo sería suponer que nos estamos moviendo hacia atrás en el tiempo: las salpicaduras de agua se juntan y el saltador saliendo del agua asciende al trampolín, los trozos del jarrón se juntan y ascienden colocarse encima del mueble y las hojas desperdigadas por el suelo suben hacia el árbol y se vuelven a pegar en las ramas. Todas estas cosas muestran una disminución de la entropía, y sabemos que esto está tan fuera del orden de las cosas que la película no más remedio que estar marchando al revés.

En efecto, las cosas toman un giro extraño cuando el tiempo se invierte, que el verlo nos reír. Por eso la entropía se denomina a veces “la flecha del Tiempo”, porque su constante aumento marca lo que nosotros consideramos el “avance del tiempo”.

Quizás, algún día, la imaginación de los seres humanos, tan poderosa, pueda idear la manera de detener el Tiempo y con él, eliminar la Entropía destructora. Por disparatada que pueda parecer la idea, yo no la descartaría… del toto.

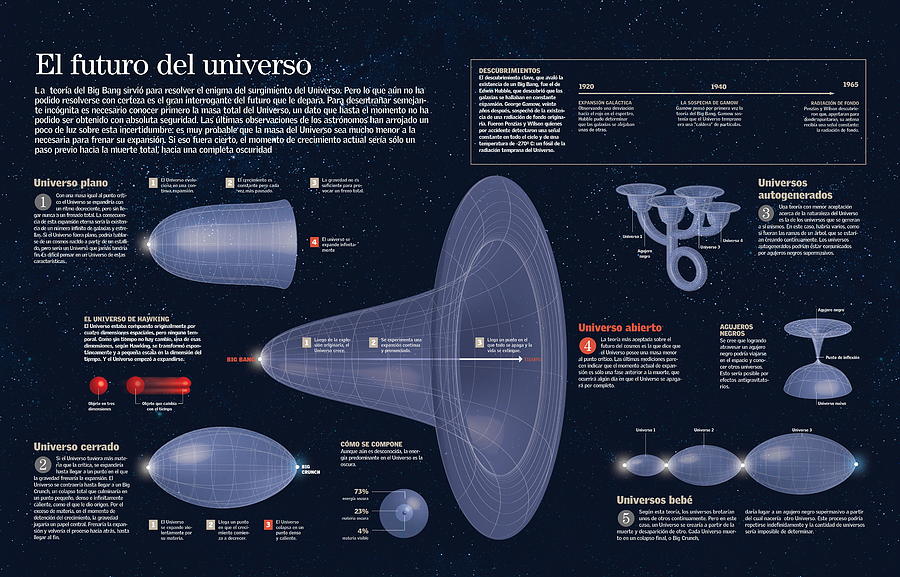

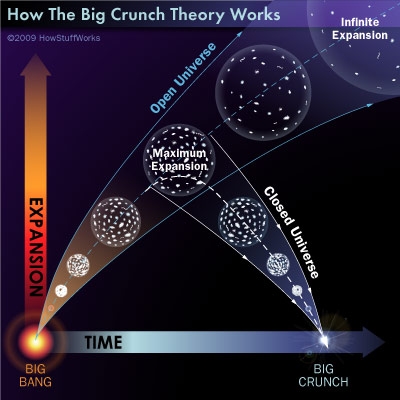

El Universo que nos acoge será plano, redondo p curvado en función del llamado “Omega Negro”, es decir, de la cantidad de materia que contenga, lo que llaman Densidad Crítica que, al parecer, está cercana a 1, es decir, a la Densidad Crítica ideal

Todo esto me lleva a pensar que, si finalmente el universo en el que estamos es un universo con la densidad crítica necesaria el universo curvo y cerrado que finaliza en un Big Crunch, en el que las galaxias se frenarán hasta parar por completo y comenzaran de a desandar el camino hacia atrás, ¿no es eso volver atrás en la flecha del tiempo y reparar la entropía?

En un comentario que les hacía, en respuesta a otros contertulios José Luis, Fandila y Kike (en el trabajo “Las galaxias y la Vida”), hace algún tiempo, les decía:

Cada nueva estrella que surge hace aumentar la entropía negativa

“Bueno, amigo Kike… ¡O quizás sí! Como bien dices, el simple hecho de replicarse significa Entropía negativa, es decir, es la manera que tenemos los de nuestra especie (otras también), de generar esa clase de entropía y, cuando en las galaxias nacen nuevas estrellas, también se está produciendo ese fenómeno que va contra la entropía y el Caos final, toda vez que, algo surge para que todo siga igual.”

Cuando nacen nuevas estrellas: ¡Entropía negativa!

Lo cierto es que sí existe la entropía negativa y, continuamente la podemos contemplar a nuestro alrededor, hay procesos que son cíclicos y reversibles como, por ejemplo y no ir más lejos… ¡el de la vida! ¿Queson otras vidas? Sí, cierto, otras vidas con los genes de la que se fue y, de esa manera, continúa la aventura que comenzó hace algunos cientos de miles de años en nuestra especie. Si eso no es entropía negativa…

Por otra parte, en cosas más simples y simplemente mecánicas, hay cosas que se repiten una y otra vez y, en nuestro entorno, la Naturaleza lo hace con las estaciones, las mareas y un sin fín de fenómenos naturales que, que pòdamos recordar, están aquí con nosotros.

Por otra , no es cierto que la temperatura del universo esté siempre en aumento, el hecho de que las galaxias se estén alejando las unas de las otras como consecuencia de la expansión, hace que cada vez sea más frío y, de hecho, se cree que la muerte térmica del universo llegará cuando alcance el cero absoluto, es decir, -273,16º Celsius, a esa temperatura ni en los átomos habrá movimiento alguno.

Es cierto que cuanto mayor sea la entropía de un sistema mayor también será el desorden y la energía disponible disminuirá. El propio universo, considerado como un sistema cerrado se verá abocado a ese escenario final, ya que, de manera irremisible, su entropía aumenta más y más y lo está llevando ahacia su muerte térmica.

Existe una energía interna de la que habla la ciencia que estudia las leyes que gobiernan la conversión de una forma de energía en otra, la dirección en la que fluye el calor y la disponibilidad de energía para que siga produciéndose . Se basa en el principio de que en un sistema aislado en cualquier lugar del universo hay una cantidad medible de energía, llamada la energía interna (U) del sistema. Esta es la suma de la energía potencial y cinética total de los átomos y moléculas del sistema que pueden ser transferida directamente como calor; excluye, por tanto, la energía nuclear y química. El valor de U sólo puede cambiar si el sistema deja de estar aislado, toda vez que, si deja de estar aislado y se junta con otro, habrá transferencia de masa, energía, calor.

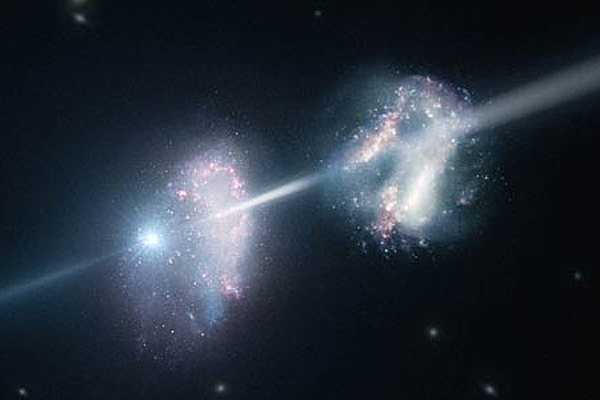

En cada uno de estos escenarios de arriba, sin excepción, se crean nuevos escenarios y se producen nuevas energías

En ese caso, tenemos que pensar en cómo se fusionan las galaxias y, a menor escala, también nosotros, de alguna manera, lo hacemos para generar nueva sabia, nueva energía y nueva vida que, de alguna manera, viene a contrarrestar los efectos de la entropía destructora que no puede impedir que esa nueva vida surja, y, de la misma manera, en las galaxias, nacen nuevas estrellas y nuevos mundos.

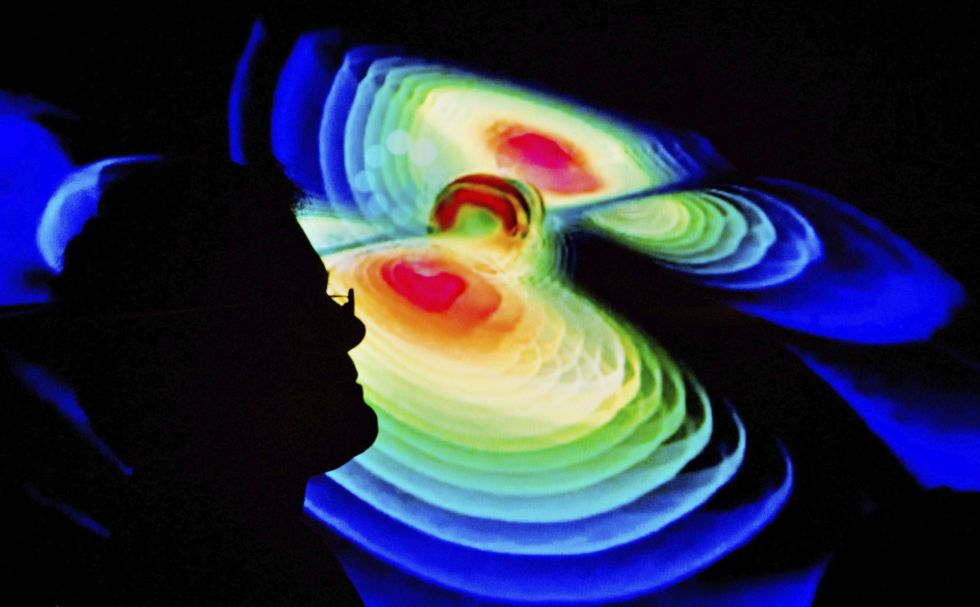

Todo esto nos puede llevar a pensar que, si nuestro universo es considerado un sistema cerrado, al final del camino, la entropía se saldrá con la suya pero… ¡Siempre hay un pero! ¿Y si nuestro universo no está sólo y se está acercando, de manera inexorable, a otro universo vecino para fusionarse con él? En ese caso, se producirán fenómenos termodinámicos que darán lugar a un escenario nuevo. No es ninguna tontería pensar en esa posibilidad, de estudios recientes ha salido el resultado asombroso de que nuestro universo parece tener vecinos.

Es cierto que los procesos naturales obedecen a la primera ley de la termodinámica (el principio de conservación de la energía). Sin embargo, aunque todos los procesos naturales obedecen a esta ley, no todos los procesos que la obedecen pueden ocurrir en la naturaleza. La mayoría de los procesos son irreversibles, es decir, solo pueden ocurrir en una dirección y la dirección que un proceso natural puede tomar es el objeto del segundo principio de la termodinámica al que antes Kike se refería y que puede ser formulado en una gran variedad de formas:

“El calor no puede ser transferido un cuerpo a un segundo cuerpo a temperatura mayor sin producirse ningún efecto, y, la entropía de un sistema sistema cerrado aumenta con el tiempo.”

Esos conceptos introducen la Temperatura y la Entropía, los parámetros que determinan la dirección en la que un proceso irreversible ocurrir. Como decíamos antes, si se llega al cero absoluto, el valor de la entropía sería cero, es decir, el cambio de la entropía sería nulo, como se cree que pasaría si el universo llega a ese final que algunos vaticinan de su muerte térmica.

Si la expansión continúa, si la temperatura sigue bajando, si llegamos al Cero Absoluto… ¡Ni los átomos se moverán! esa es, la muerte térmica del Universo.

Claro que, yo no soy tan agorero y parto de una base muy cierta: No lo sabemos todo y, lo poco que sabemos está sujeto a cambios (como nuestras teorías) a medida que vamos evolucionando y adquiriendo nuevos conocimientos. , podemos tener la impresión de que estamos a merced de esa Entropía que nos lleva al Caos y hacia la destrucción pero… (de nuevo un pero), ¿son inamovibles nuestros conocimientos actuales?

Creo en la generación de entropía negativa (por llamarla de alguna manera), y, el ejemplo de las estrellas nuevas que nacen continuamente y también, de nuestra propia descendencia… ¡Es una prueba irrefutable! De todas las maneras y, siempre digo:

“Sabemos tan poco”

emilio silvera

Oct

17

Un viaje: desde los átomos hasta las estrellas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en ¡Las estrellas! ~

Clasificado en ¡Las estrellas! ~

Comments (1)

Comments (1)

Pues yo he sido a veces un muchacho y una chica,

Un matorral y un pájaro y un pez en las olas saladas.

Esto nos decía Empédocles, el padre de aquellos primitivos elementos formados por Agua, tierra, aire y fuego que, mezclados en la debida proporción, formaban todas las cosas que podemos ver a nuestro alrededor. Claro que, él no podía llegar a imaginar hasta donde pudimos llegar después en la comprensión de la materia a partir del descubrimiento de las partículas “elementales” que formaban el átomo.

Sí, hay cosas malas y buenas pero, todas deben ser conocidas para poder, en el primer caso aprovecharlas y en el segundo prevenirlas.

Pero demos un salto en el tiempo y viajemos hasta los albores del siglo XX cuando se hacía cada vez más evidente que alguna clase de energía atómica era responsable de la potencia del Sol y del resto de las estrellas que más lejos, brillaban en la noche oscura.

Ya en 1898, sólo dos años más tarde del descubrimiento de la radiactividad por Becquerel, el geólogo americano Thomas Chrowder Chamberlin especulaba que los átomos eran complejas organizaciones y centros de enormes energías, y que las extraordinarias condiciones que hay en el centro del Sol pueden liberar una parte de su energía. Claro que, por aquel entonces, nadie sabía cual era el mecanismo y cómo podía operar, hasta que no llegamos a saber mucho más, sobre los átomos y las estrellas.

El intento de lograr tal comprensión exigió una colaboración cada vez mayor entre los astrónomos y los físicos nucleares. Su trabajo llevaría, no sólo a resolver la cuestión de la energía estelar, sino también al descubrimiento de una trenza dorada en la que la evolución cósmica se entrelaza en la historia atómica y la estelar.

La Clave: Fue comprender la estructura del átomo. Que el átomo tenía una estructura interna podía inferirse de varias líneas de investigación, entre ellas, el estudio de la radiactividad: para que los átomos emitiesen partículas, como se había hallado que lo hacían en los laboratorios de Becquerel y los Curie, y para que esas emisiones los transformasen de unos elementos en otros, como habían demostrado Rutherford y el químico inglés Frederick Soddy, los átomos debían ser algo más que simples unidades indivisibles, como implicaba su nombre (de la voz griega que significa “imposible de cortar”).

Demócrito, un griego que vivió del 460 aC a 370 aC, desarrolló una nueva teoría de la materia. … Demócrito teorizó que los átomos eran específicos del material del que formaban parte, lo que significaba que los átomos de una piedra eran únicos en la piedra y diferentes de los átomos de otros materiales, como la piel.

Él creía que los átomos eran la parte más pequeña, invisible e indivisible de la materia.

El átomo de Demócrito era mucho más de lo que él, en un principio, intuyó que sería. Hoy sabemos que está conformado por diversaspartículas de familias diferentes: unas son bariones que en el seno del átomo llamamos nucleones, otras son leptones que giran alrededor del núcleo para darle estabilidad de cargas, y, otras, de la familia de los Quarks, construyen los bariones del núcleo y, todo ello, está, además, vigilado por otras partículas llamadas bosones intermedios de la fuerza nuclear fuerte, los Gluones que, procuran mantener confinados a los Quarks.

Rutherford, en realidad, descubrió el núcleo atómico

Pero no corramos tanto, la física atómica aún debería recorrer un largo camino para llegar a comprender la estructura que acabamos de reseñar. De los tres principales componentes del átomo (el protón, el neutrón y el electrón), sólo el electrón había sido identificado (por J.J. Thomson, en los últimos años del siglo XIX). Nadie hablaba de energía “nuclear” pues ni siquiera se había demostrado la existencia de un núcleo atómico, y mucho menos de sus partículas constituyentes, el protón y el neutrón, que serían identificados, respectivamente, por Thomson en 1913 y James Chawick en 1932.

De importancia capital resultó conocer la existencia del núcleo y que éste, era 1/100.000 del total del átomo, es decir, casi todo el átomo estaba compuesto de espacios “vacíos” y, la materia así considerada, era una fracción infinitesimal del total atómico.

Rutherford, Hans Geiger y Ernest Marsden se encontraban entre los Estrabones y Tolomeos de la cartografía atómica, en Manchester , de 1909 a 1911, sondearon el átomo lanzando corrientes de “partículas alfa” subatómicas -núcleos de helio- contra delgadas laminillas de oro, plata, estaño y otros metales. La mayoría de partículas Alfa se escapaban a través de las laminillas, pero, para sombro de los experimentadores, algunas rebotaban hacia atrás.

Rutherford pensó durante largo tiempo e intensamente en este extraño resultado; era tan sorprendente, señalaba, como si una bala rebotase sobre un pañuelo de papel. Finalmente, en una cena en su casa en 1911, anunció a unos pocos amigos que había dado con una explicación: que la mayoría de la masa de un átomo reside en un diminuto núcleo masivo. Rutherford pudo calcular la carga y el diámetro máximo del núcleo atómico. Así se supo que los elementos pesados eran más pesados que los elementos ligeros porque los núcleos de sus átomos tienen mayor masa.

Todos sabemos ahora, la función que desarrollan los electrones en el átomo. Pero el ámbito de los electrones para poder llegar a la comprensión completa, tuvo que ser explorado, entre otros, por el físico danés Niels Bohr, quien demostró que ocupaban órbitas, o capas, discretas que rodean al núcleo. (Durante un tiempo Bohr consideró el átomo como un diminuto sistema solar, pero ese análisis, pronto demostró ser inadecuado; el átomo no está rígido por la mecánica newtoniana sino por la mecánica cuántica.)

Entre sus muchos otros éxitos, el modelo de Bohr revelaba la base física de la espectroscopia. El número de electrones de un átomo está determinado por la carga eléctrica del núcleo, la que a su vez se debe al número de protones del núcleo, que es la clave de la identidad química del átomo. Cuando un electrón cae de una órbita externa a una órbita interior emite un fotón. La longitud de onda de este fotón está determinada por las órbitas particulares entre las que el electrón efectúa la transición.

Esta es la razón de que un espectro que registra las longitudes de onda de los fotones, revele los elementos químicos que forman las estrellas u otros objetos que sean estudiados por el espectroscopista. En palabras de Max Planck, el fundador de la física cuántica, el modelo de Bohr del átomo nos proporciona “la llave largamente buscada de la puerta de entrada al maravilloso mundo de la espectroscopia, que desde el descubrimiento del análisis espectral (Fraunhoufer) había desafiado obstinadamente todos los intentos de conocerlo”.

Es curioso que, mirando en la oscura noche como brillan las estrellas del cielo, nos atrae su titilar engañoso (es la atmósfera terrestre la que hace que lo parezca) y su brillo, Sin embargo, pocos llegan a pensar en lo que verdaderamente está allí ocurriendo. Las transformaciones de fase por fusión no cesan. Esta transformación de materia en energía es consecuencia de la equivalencia materia-energía, enunciada por Albert Einstein en su famosa fórmula E=mc2; donde E es la energía resultante, m es la masa transformada en energía, y c es la velocidad de la luz (299.792,458 m/s kilómetros). La cantidad de energía que se libera en los procesos de fusión termonuclear es fabulosa. Un gramo de materia transformado íntegramente en energía bastaría para satisfacer los requerimientos energéticos de una familia mediana durante miles de años.

El USS Enterprise en 1964 durante la operación «Sea Orbit» en la que dio la vuelta al mundo en 65 días sin repostar, demostrando la capacidad de la tecnología basada en la equivalencia entre masa y energía.

Es un gran triunfo del ingenio humano el saber de qué, están hechas las estrellas, de qué materiales están conformadas. Recuerdo aquí a aquel Presidente de la Real Society de Londres que, en una reunión llegó a decir:

“Una cosa está clara, nunca podremos saber de qué están hechas las estrellas”.

El hombre se vistió de gloria con la, desde entonces, famosa frase. Creo que nada, con tiempo por delante, será imposible para nosotros.

Pero, por maravilloso que nos pueda parecer el haber llegado a la comprensión de que los espectros revelan saltos y tumbos de los electrones en sus órbitas de Bohr, aún nadie podía hallar en los espectros de las estrellas las claves significativas sobre lo que las hace brillar. En ausencia de una teoría convincente, se abandonó este campo a los taxonomistas, a los que seguían obstinadamente registrando y catalogando espectros de estrellas, aunque no sabían hacia donde los conduciría esto.

En el Laboratorio de la Universidad de Harvard, uno de los principales centros de la monótona pero prometedora tarea de la taxonomía estelar, las placas fotográficas que mostraban los colores y espectros de decenas de miles de estrellas se apilaban delante de “calculadoras”, mujeres solteras en su mayoría y, de entre ellas,..

Ambos astrónomos e vieron involucrados en telas políticos que nada tenían que ver con su trabajo

Henrietta Leavitt, la investigadora pionera de las estrellas variables Cefeidas que tan útiles serían a Shapley y Hubble.

“La carta sospechosa estaba dirigida a Edwin Hubble. Y había sido enviada por Harlow Shapley. El episodio involucraba entonces nada menos que a dos de los más grandes astrónomos de Estados Unidos y de más allá de sus fronteras, responsables de nuestro actual conocimiento de la estructura del Universo y del lugar que ocupa nuestro sistema solar en él.”

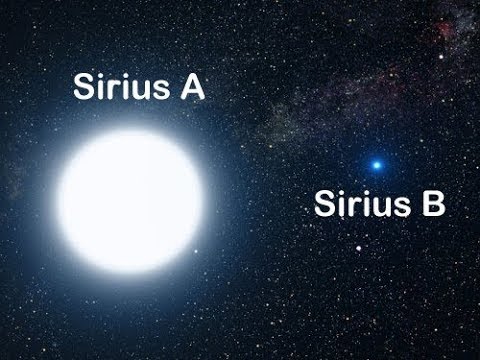

Imagen de Sirio A (estrella grande) y Sirio B (estrella pequeña abajo a la derecha) tomadas por el Telescopio Hubble (Créd. NASA). Sirio es la quinta estrella más cercana y tiene una edad de 300, millones de años. Es una estrella blanca de la secuencia principal de tipo espectral A1V con temperatura superficial de 10 000 K y situada a 8,6 años luz de la Tierra. Es una estrella binaria y, de ella, podríamos contar muchas historias. La estrella fue importante en las vidas de Civilizaciones pasadas como, por ejemplo, la egipcia.

La estrella Sirio, llamada Sopdet por los egipcios, da lugar a uno de estos sucesos singulares: su primera aparición anual al amanecer, el llamado orto helíaco

Una de las peculiaridades de este calendario de 365 días es que carece de año bisiesto. Puesto que la duración del año trópico (el de las estaciones) es prácticamente un cuarto de día mayor, esto supone que todos los eventos cíclicos, incluidos los astronómicos, se atrasen un día cada cuatro años. La estrella Sirio, llamada Sopdet por los egipcios, da lugar a uno de estos sucesos singulares: su primera aparición anual al amanecer, el llamado orto helíaco.

Fue Cannon quien, en 1915, empezó a discernir la forma en una totalidad de estrellas en las que estaba presente la diversidad, cuando descubrió que en una mayoría, las estrellas, pertenecían a una de media docena de clases espectrales distintas. Su sistema de clasificación, ahora generalizado en la astronomía estelar, ordena los espectros por el color, desde las estrellas O blanco-azuladas, pasando por las estrellas G amarillas como el Sol, hasta estrellas rojas M. Era un rasgo de simplicidad denajo de la asombrosa variedad de las estrellas.

Pronto se descubrió un orden más profundo, en 1911, cuando el ingeniero y astrónomo autodidacta danés Ejnar Hertzsprung analizó los datos de Cannon y Maury de las estrellas de dos cúmulos, las Híades y las Pléyades. Los cúmulos como estos son genuinos conjuntos de estrellas y no meras alineaciones al azar; hasta un observador inexperimentado salta entusiasmado cuando recorre con el telescopio las Pléyades, con sus estrellas color azul verdoso enredadas en telarañas de polvo de diamante, o las Híades, cuyas estrellas varían en color desde el blanco mate hasta un amarillo apagado.

Híades

Hertzsprung utilizó los cúmulos como muestras de laboratorio con las que podía buscar una relación entre los colores y los brillos intrínsecos de las estrellas. Halló tal relación: la mayoría de las estrellas de ambos cúmulos caían en dos líneas suavemente curvadas. Esto, en forma de gráfico, fue el primer esbozo de un árbol de estrellas que desde entonces ha sido llamado diagrama Hertzsprung-Russell.

El progreso en física, mientras tanto, estaba bloquedado por una barrera aparentemente insuperable. Esto era literal: el agente responsable era conocido como barrera de Coulomb, y por un tiempo frustó los esfuerzos de las físicos teóricos para copmprender como la fusión nuclear podía producir energía en las estrellas.

La línea de razonamiento que conducía a esa barrera era impecable. Las estrellas están formadas en su mayor parte por hidrógeno. (Esto se hace evidente en el estudio de sus espectros.) El núcleo del átomo de Hidrógeno consiste en un solo protón, y el protón contiene casi toda la masa del átomo. (Sabemos esto por los experimentos de Rutherford). Por tanto, el protón también debe contener casi toda la energía latente del átomo de hidrógeno. (Recordemos que la masa es igual a la energía: E = mc2).

En el calor de una estrella, los protones son esparcidos a altas velocidades -el calor intenso significa que las partículas involucradas se mueven a enormes velocidades- y, como hay muchos protones que se apiñan en el núcleo denso de una estrella, deben tener muchísimos choques. En resumen, la energía del Sol y las estrellas, puede suponerse razonablemente, implica las interacciones de los protones. Esta era la base de la conjetura de Eddintong de que la fuente de la energía estelar “difícilmente puede ser otra que la energía subatómica, la cual, como se sabe, existe en abundancia en toda materia”.

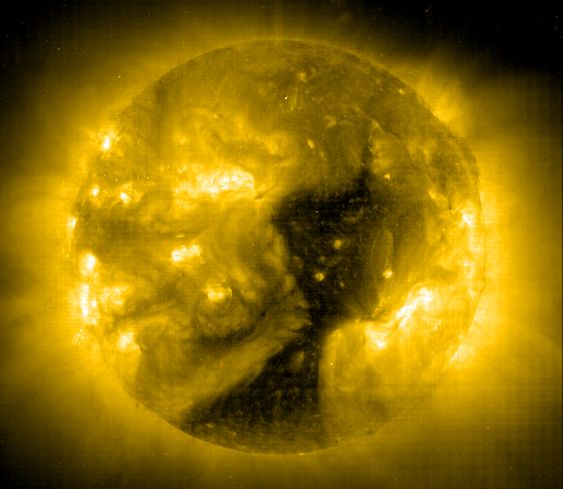

Plasma en ebullición en la superficie del Sol

Hasta el momento todo lo que hemos repasado está bien pero… ¿Qué pasa con la Barrera de Coulomb? Los protones están cargados positivamente; las partículas de igual carga se repelen entre sí; y este obstáculo parecía demasiado grande para ser superado, aun a la elevada velocidad a la que los protones se agitaban en el intenso calor del interior de las estrellas. De acuerdo con la física clásica, muy raras veces podían dos protones de una estrella ir con la rapidez suficiente para romper las murallas de sus campos de fuerza electromagnéticos y fundirse en un solo núcleo. Los cálculos decían que la tasa de colisión de protones no podía bastar para mantener las reacciones de fusión. Sin embargo, allí estaba el Sol, con el rostro radiante, riéndose de las ecuaciones que afirmaban que no podía brillar.

Afortunadamente, en el ámbito nuclear, las reglas de la Naturaleza no se rigen por las de la mecánica de la física clásica, que tienen validez para grandes objetos, como guijarros y planetas, pero pierden esa validez en el reino de lo muy pequeño. En la escala nuclear, rigen las reglas de la indeterminación cuántica. La mecánica cuántica demuestra que el futuro del protón sólo puede predecirse en términos de probabilidades: la mayoría de las veces el protón rebotará en la Barrera de Coulomb, pero de cuando en cuando, la atravesará. Este es el “efecto túnel cuántico”; que permite brillar a las estrellas.

Dejemos aquí este proceso y digamos que, realmente, la mayoría de las veces el protón rebotará en la Barrera de Coulomb, pero de cuando en cuando la …

El efecto Triple Alfa que consigue fusionar Carbono

George Gamow, ansioso de explotar las conexiones entre la astronomía y la nueva física exótica a la que era adepto, aplicó las probabilidades cuánticas a la cuestión de la fusión nuclear en las estrellas y descubrió que los protones pueden superar la Barrera de Coulomb. Esta historia es mucho más extensa y nos llevaría hasta los trabajos de Hans Bethe, Edward Teller y otros, así como, al famoso Fred Hoyle y su efecto Triple Alfa y otras maravillas que, nos cuentan la historia que existe desde los átomos a las estrellas del cielo.

emilio silvera

Oct

16

El año en que solo progresó el conocimiento

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Noticia comentada ~

Clasificado en Noticia comentada ~

Comments (0)

Comments (0)

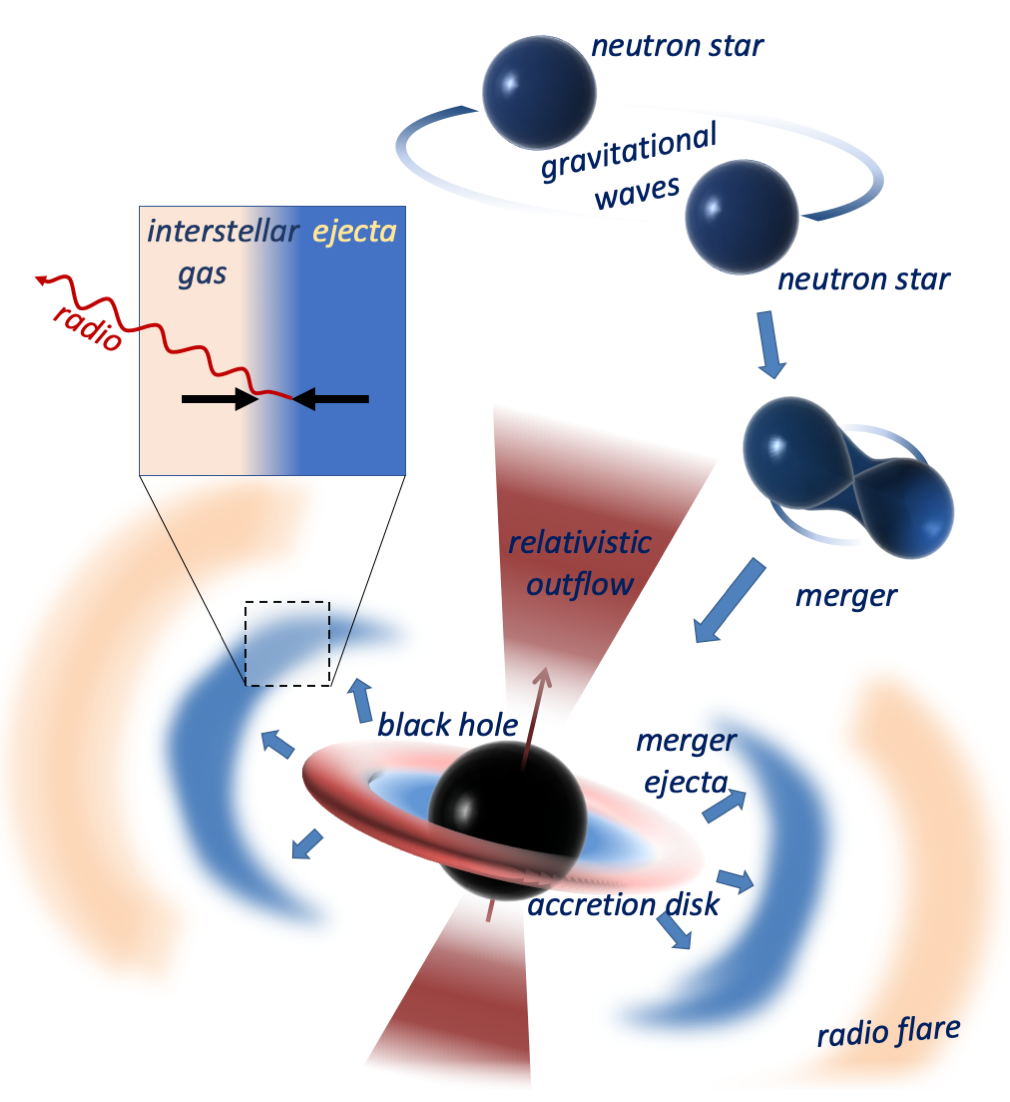

Las Ondas Gravitacionales detectadas y los grandes avances en medicina y tecnología cambiaran el mundo

En mitad de la mediocridad política y la inquietud social, 2016 ha producido grandes avances en la física, la biología y la inteligencia artificial

Revisión del instrumental de LIGO. Caltech/MIT/LIGO Lab

Sí, este ha sido el año aciago del Brexit y Donald Trump, el año en que Europa ha consolidado su desprestigio y la población siria ha sido masacrada por su propio Gobierno con la ayuda de otros, en que la xenofobia, el nacionalismo y la miopía se han impuesto sobre la razón práctica, en que el autoritarismo se ha extendido por Hungría y Polonia como una plaga medieval, el año en que el paro y la pobreza se han instalado entre nosotros con la espontaneidad de una catástrofe natural. Y en que las únicas buenas noticias han provenido de la ciencia. En mitad del caos y la desesperanza, el conocimiento ha progresado con más firmeza que nunca. Aferrémonos a eso como a una ascua ardiendo.

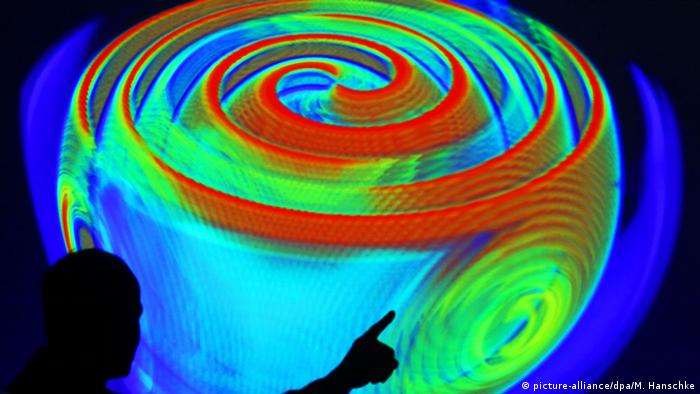

Llevamos décadas oyendo que, si el XX fue el siglo de la física, el XXI lo sería de la biología. Pero lo cierto es que la física goza en nuestros días de mejor salud que nunca. El mayor descubrimiento de 2016, según un consenso difícil de cuestionar, ha sido el de las ondas gravitatorias, una predicción de la relatividad general de Einstein que el propio Einstein consideró imposible de confirmar. Ha hecho falta un siglo, la colisión de dos agujeros negros gigantescos y un sistema de detección (el LIGO) que se cuenta entre las obras más brillantes y refinadas del intelecto humano, pero el fenómeno se ha confirmado por encima de toda duda razonable. La gravedad no es una fuerza instantánea, como pensó Newton, sino que se propaga en forma de ondulaciones del espacio-tiempo que viajan a la velocidad de la luz, como predijo Einstein. Es un paso de gigante en el conocimiento que, como es habitual, abrirá un nuevo continente de exploración y progreso.

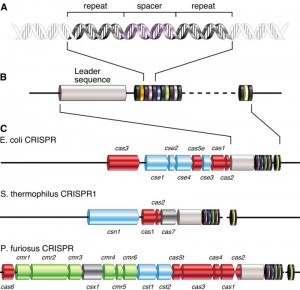

Las secuencias repetidas del CRISPR. Tomado de: Karginov FV y Hannon GJ. Mol Cell 2010

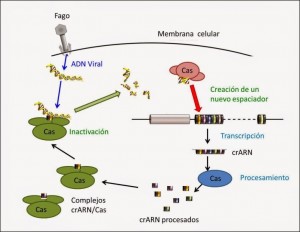

Cuando un virus entra dentro de la bacteria toma el control de la maquinaria celular y para ello interacciona con distintos componentes celulares. Pero las bacterias que tienen este sistema de defensa tienen un complejo formado por una proteína Cas unida al ARN producido a partir de las secuencias CRISPR. Entonces el material génico del virus puede interaccionar con este complejo. Si ocurre eso, el material genético viral es inactivado y posteriormente degradado. Pero el sistema va más allá. Las proteínas Cas son capaces de coger una pequeña parte del ADN viral, modificarlo e integrarlo dentro del conjunto de secuencias CRISPR. De esa forma, si esa bacteria (o su descendencia) se encuentra con ese mismo virus, ahora inactivará de forma mucho más eficiente al material genético viral. Es, por lo tanto, un verdadero sistema inmune de bacterias.

Proceso por el que el sistema CRISPR/Cas9 inactiva virus e integra parte de sus secuencias en el genoma de la bacteria.

Durante los años subsiguientes se continuó la investigación sobre este sistema, pero no fue hasta el año 2012 en el que se dio el paso clave para convertir este descubrimiento, esta observación biológica en una herramienta molecular útil en el laboratorio. En agosto de este año un equipo de investigadores dirigido por las doctoras Emmanuelle Charpentier en la Universidad de Umeå y Jennifer Doudna, en la Universidad de California en Berkeley, publicó un artículo en la revista Science el que se demostraba cómo convertir esa maquinaria natural en una herramienta de edición «programable», que servía para cortar cualquier cadena de ADN in vitro. Es decir, lograban programar el sistema para que se dirigiera a una posición específica de un ADN cualquiera (no solo vírico) y lo cortaran.

Jennifer Doudna y Emmanuelle Charpentier

La manera en que lo lograron es demasiado compleja para lo que pretende este blog. Baste simplemente decir que se utilizan unos ARNs que dirigen el sistema hacia el ADN que hay que cortar.

¿Cómo se edita el ADN con esta tecnología?

Todo comienza con el diseño de una molécula de ARN (CRISPR o ARN guía) que luego va a ser insertada en una célula. Una vez dentro reconoce el sitio exacto del genoma donde la enzima Cas9 deberá cortar.

El proceso de editar un genoma con CRISPR/Cas9 incluye dos etapas. En la primer atapa el ARN guía se asocia con la enzima Cas9. Este ARN guía es específico de una secuencia concreta del ADN, de tal manera que por las reglas de complementariedad de nucleótidos se hibridará en esa secuencia (la que nos interesa editar o corregir). Entonces actúa Cas9, que es una enzima endonucleasa (es decir, una proteína que es capaz de romper un enlace en la cadena de los ácidos nucléicos), cortando el ADN. Básicamente podemos decir que el ARN guía actúa de perro lazarillo llevando a Cas9, el ejecutor, al sitio donde ha de realizar su función.

Pero también es cierto que la biología está en un momento espléndido, y sobre todo en dos campos que prometen aplicaciones clínicas a medio plazo: la edición genómica y la reprogramación de células. En el primer caso, la estrella se llama CRISPR, y consiste en un sistema tan simple, eficaz y versátil que ha puesto la modificación del genoma humano (y de cualquier otro) al alcance de cualquier laboratorio de genética del planeta; su primera aplicación, sometida ya a una investigación muy activa, será sin duda la corrección de las mutaciones que causan las enfermedades raras: una forma por fin eficaz de terapia génica. En segundo lugar, la reprogramación de células –retrasar el reloj de una vulgar célula de la piel para convertirla en una célula madre— está logrando progresos espectaculares en la reparación de lesiones y el retraso del envejecimiento.

Sí, el Ordenador vence al campeón.

‘AlphaGo’ es el documental de Netflix que mejor explica lo que supuso la victoria de la IA de Google al campeón de Go

Pero este año no se puede hablar solo de física y biología, porque la inteligencia artificial ha irrumpido con poderío en la actualidad científica y tecnológica. Drones, robots y automóviles, por no hablar de teléfonos, relojes y casi cualquier otra cosa, exhiben ya notables habilidades cognitivas: hacen cosas que serían consideradas inteligentes si las hubiera hecho un humano (así definió la inteligencia artificial uno de sus creadores, el gran Marvin Minsky, que murió en enero de este año). Y los ordenadores se han hecho en 2016 con el título mundial de Go, una proeza mucho más espectacular que aquella de ganar a Kaspárov al ajedrez. Las discusiones filosóficas sobre la inteligencia de las máquinas parecen haberse enranciado de forma definitiva.

Inteligencia Artificial para solucionar problemas del cerebro, Ordenadores cuánticos… ¡U muchas cosas más! que, en unos pocos años (los que anden por aquí todavía) verán con asombro como cambia nuestro mundo y costumbres al pasar a otros niveles que ahora sin inimaginables para la gente corriente no versada en temas científicos.

El conocimiento ha seguido progresando entre la mediocridad política y el malestar social. Naturalmente, esto no tiene por qué seguir siendo así. Ya el Brexit puede constituir un lastre notable para la ciencia británica, y los planes xenófobos de Trump pueden convertirse en un escollo formidable para la norteamericana, pues buena parte de los grandes científicos de ese país son inmigrantes. Pero, de momento, 2016 ha ido bien para la ciencia. Es un consuelo.

Oct

16

Hay que recorrer un largo camino para saber

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en El Universo dinámico ~

Clasificado en El Universo dinámico ~

Comments (0)

Comments (0)

¡El futuro incierto!

El Futuro es el Tiempo por venir y nunca podremos saber cómo será o qué pasará en el “mañana” que está supeditado a parámetros aleatorios determinados por el Azar, lo imprevisto, lo que surge sin avisar. Y, teniendo en cuenta que un suceso “pequeño” en el inicio, puede ser un gran suceso a medida que el Tiempo transcurre, las incidencias finales pueden ser inimaginables.

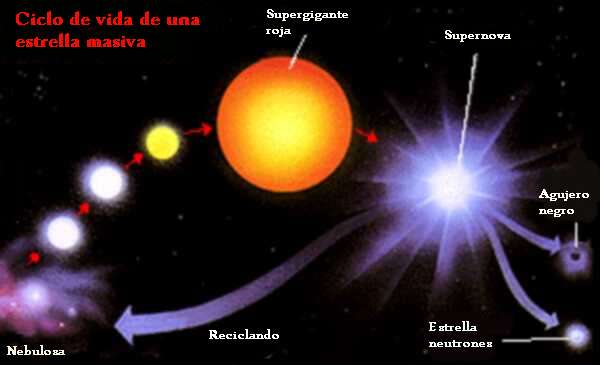

“La masa con la que nace una estrella determina su historia y, sobre todo, la duración de su vida. Llamamos estrellas masivas a todas aquellas estrellas aisladas que explotan como supernovas al final de su existencia debido al colapso gravitatorio. Para que exploten como supernovas deben tener un mínimo de alrededor de ocho masas solares. Estrellas con menos masa pueden explotar, pero no por sí mismas (deben darse otras condiciones). Y hay parámetros secundarios que pueden introducir cambios, pero la masa es determinante.”

“En cuanto al máximo, el límite está en lo que la naturaleza sea capaz de producir. Hasta hace poco se creía que este límite estaba en torno a monstruos de 150 masas solares, aunque recientes trabajos lo elevan hasta 300. No obstante, no es un dato seguro ya que, cuanto más masiva es una estrella, menos vive, con lo cual estrellas más grandes serían difíciles de observar.”

Verdaderamente si pudiéramos contemplar de cerca, el comportamiento de una estrella cuando llega el final de su vida, veríamos como es, especialmente intrigante las transiciones de fase de una estrella en implosión observada desde un sistema de referencia externo estático, es decir, vista por observadores exteriores a la estrella que permanecen siempre en la misma circunferencia fija en lugar de moverse hacia adentro con la materia de la estrella en implosión.

La estrella, vista desde un sistema externo estático, empieza su implosión en la forma en que uno esperaría. Al igual que una pesada piedra arrojada desde las alturas, la superficie de la estrella cae hacia abajo (se contrae hacia adentro), lentamente al principio y luego cada vez más rápidamente. Si las leyes de gravedad de Newton hubieran sido correctas, esta aceleración de la implosión continuaría inexorablemente hasta que la estrella, libre de cualquier presión interna, fuera aplastada en un punto de alta velocidad. Pero no era así según las fórmulas relativistas que aplicaron Oppenheimer y Snyder.

En lugar de ello, a medida que la estrella se acerca a su circunferencia crítica su contracción se frena hasta hacerse a paso lento. Cuanto más pequeña se hace la estrella, más lentamente implosiona, hasta que se congela exactamente en la circunferencia crítica y, dependiendo de su masa, explosiona como supernova para formar una inmensa nebulosa o, se tranforma en nebulosa planetaria, más pequeña.

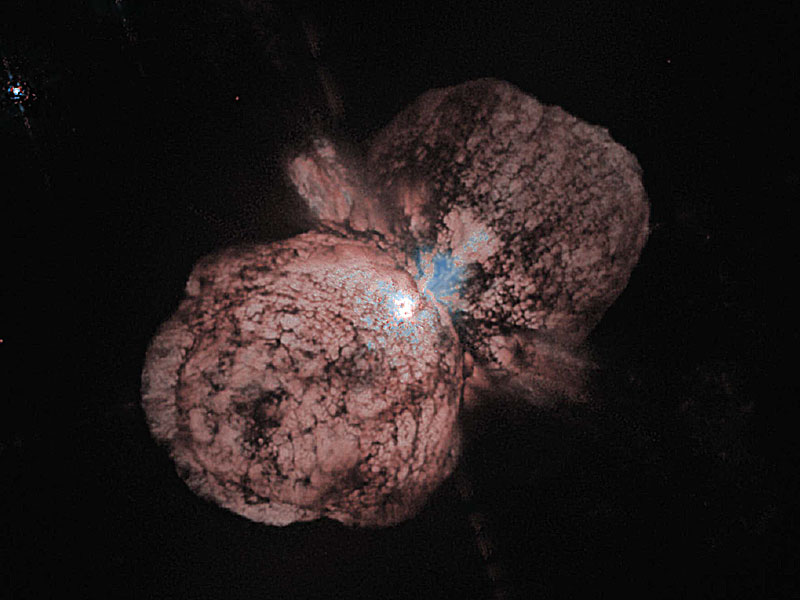

La gran erupción de Eta Carinae en la década de 1840 creó la nebulosa del Homúnculo, mostrada aquí en una imagen tomada por el Hubble. Con una longitud ahora de un año-luz, la nube en expansión contiene suficiente material para hacer por lo menos 10 copias de nuestro Sol. Los astrónomos aún no pueden explicar qué causó esta explosión. Crédito: NASA, ESA, y el Hubble SM4 ERO Team

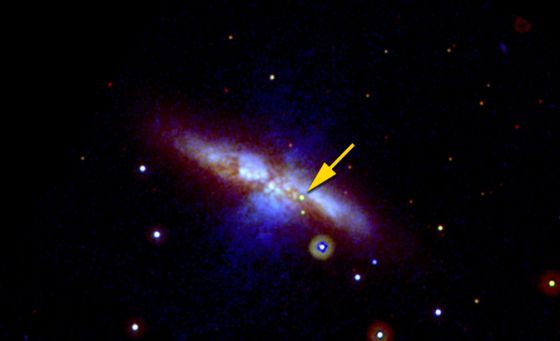

Ahí podemos observar a una estrella muy joven, de dos o tres millones de años que, en un futuro lejano será una gran Supernova. Los procesos que podríamos observar al final de la vida de una estrella gigante… ¡Son fascinantes! Ese punto azulado que vemos envuelto en una masa de gas y polvo, no es otra cosa que la estrella Eta Carinae, una variable luminosa azul hipermasiva. Su masa puede osciular entre las 100 y 150 masas solares y, como el límite para la masa de una estrella está estipulado en 120 masas solares, ésta de arriba, para no ser destruida por su propia radiación y eyecta material al Espacio Interestelar para desahogo

En la escena que antes explicabámos, por mucho tiempo que nos quedemos esperando y comtemplando el suceso, si uno está en reposo fuera de la estrella (es decir, en reposo en el sistema de referencia externo estático), uno nunca podrá ver que la estrella implosiona a través de la circunferencia crítica. Ese fue el mensaje inequívoco que Oppenheimer y Snyder nos enviaron. Para poder ver eso, habría que estar dentro de la estrella, instalado en la materia que está sufriendo la contracción y, no sabemos porque eso es así.

Cuando la estrella es muy masiva, su destino final es el de Agujero Negro

¿Se debe esta congelación de la implosión a alguna fuerza inesperada de la relatividad general en el interior de la estrella? No, en absoluto, advirtieron Oppenheimer y Snyder. Más bien se debe a la dilatación gravitatoria del tiempo (el frenado del flujo del tiempo) cerca de la circunferencia crítica. Tal como lo ven los observadores estáticos, el tiempo en la superficie de la estrella en implosión debe fluir cada vez más lentamente cuando la estrella se aproxima a la circunferencia crítica; y, consiguientemente, cualquier cosa que ocurre sobre o en el interior de la estrella, incluyendo su implosión, debe aparecer como si el movimiento se frenara poco a poco hasta congelarse.

Por extraño que esto pueda parecer, aún había otra predicción más extrañas de las fórmulas de Oppenheimer y Snyder: si bien es cierto que vista por observadores externos estáticos la implosión se congela en la circunferencia crítica, no se congela en absoluto vista por los observadores que se mueven hacia adentro con la superficie de la estrella. Si la estrella tiene una masa de algunas masas solares y empieza con un tamaño aproximado al del Sol, entonces vista desde su propia superficie implosiona hacia la circunferencia crítica en aproximadamente una hora, y luego sigue implosionando más allá de la criticalidad hacia circunferencias más pequeñas.

Allá por el año 1939, cuando Oppenheimer y Snyder descubrieron estas cosas, los físicos ya se habían acostumbrados al hecho de que el tiempo es relativo; el flujo del tiempo es diferente medido en diferentes sistemas de referencia que se mueven de diferentes formas a través del Universo. Claro que, nunca antes había encontrado nadie una diferencia tan extrema entre sistemas de referencia. Que la implosión se congele para siempre medida en el sistema externo estático, pero continúe avanzando rápidamente superando al punto de congelación medida en el sistema desde la superficie de la estrella era extraordinariamente difícil de comprender. Nadie que estudiara las matemáticas de Oppenheimer y Snyder se sentía cómodo con semejante distorsión extrema del tiempo. Pero ahí estaba, en sus fórmulas. Algunos podían agitar sus brazos con explicaciones heurísticas, pero ninguna explicación parecía muy satisfactoria. No sería completamente entendido hasta finales de los cincuenta.

En víspera del ataque a Pearl Harbour, John Wheeler trabajaba con su alumno Richard Feynman en lo que éste había bautizado como “suma de todas las historias”. En física cuántica, para calcular cómo algo que ocurre en A afecta a lo que está en B, tienes que sumar todas las alternativas físicamente posibles, aun las más peregrinas. Solo así hallas el resultado correcto. Es como si todas las historias posibles que van de A a B se produjeran al mismo tiempo. Y nos dice Wheeler que tan maravillado quedó con este resultado descubierto por Feynman, que de inmediato decidió acercarse a la casa de Einstein para contárselo. Después de pasar veinte minutos en su estudio dándole cuenta de este asombroso comportamiento de la realidad, Wheeler concluyó: “Profesor Einstein, viendo la mecánica cuántica desde esta nueva perspectiva, ¿no le parece completamente razonable aceptar la teoría?”

Enstein estuvo un rato digiriéndolo. “Todavía no puedo creerme que Dios juegue a los dados”, contestó. Y después de una pausa, añadió: “Creo que me he ganado el derecho de mantenerme en mis errores.” Einstein, como él mismo dijo en una ocasión, podía ser más terco que una mula. Así que, una vez más, no hubo manera de convencerlo de que, en su fundamento, la mecánica cuántica era correcta.

Fue Wheeler el que discrepó del trabajo de Oppenheimer y Snyder, alegando, con toda la razón que, cuando ellos habían realizado su trabajo, habría sido imposible calcular los detalles de la implosión con una presión realista (presión térmica, presión de degeneración y presión producida por la fuerza nuclear), y con reacciones nucleares, ondas de choque, calor, radiación y expulsión de masa. Sin embargo, los trabajos desde las armas nucleares de los veinte años posteriores proporcionaron justamente las herramientas necesarias.

Presión, reacciones nucleares, ondas de choque, calor radiación y expulsión de masa eran todas ellas características fundamentales de una bomba de hidrógeno; sin ellas, una bomba no explosionaría. A finales de los años cincuenta, Stirling Colgate quedó fascinado por el problema de la implosión estelar. Con el apoyo de Edward Teller, y en colaboración con Richard White y posteriormente Michael May, Colgate se propuso simular semejante implosión en un ordenador. Sin embargo, cometieron un error, mantuvieron algunas de las simplificaciones de Oppenheimer al insistir desde el principio en que la estrella fuera esférica y sin rotación, y, aunque tuvieron en cuenta todos los argumentos que preocupaban a Wheeler, aquello no quedó perfeccionado hasta después de varios años de esfuerzo y, a comienzo de los años sesenta ya estaban funcionando correctamente.

Un día a principio de los años sesenta, John Wheeler entró corriendo en la clase de relatividad de la Universidad de Princeton. Llegaba un poco tarde, pero sonreía con placer. Acababa de regresar de una visita a Livermore donde había visto los resultados de las simulaciones recientes de Colgate y su equipo. Con excitación en su voz dibujó en la pizarra un diagrama tras otro explicando lo que sus amigos de Livermore habían aprendido.

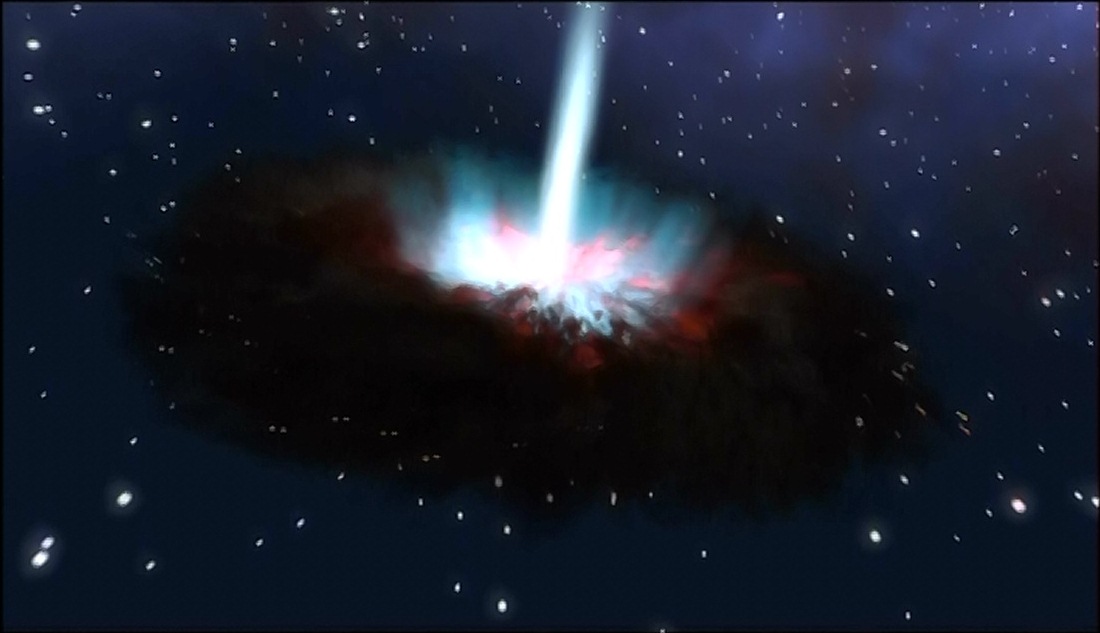

Cuando la estrella en implosión tenía una masa pequeña, desencadenaba una implosión de supernova y formaba una estrella de neutrones precisamente en la forma que Fritz Wicky había especulado treinta años antes. Sin embargo, si la estrella original era más masiva lo que allí se producía (aparte de la explosión supernova) era un agujero negro notablemente similar al altamente simplificado modelo que veinticinco años calcularon Oppenheimer y Snyder. Vista desde fuera, la implosión se frenaba y se quedaba congelada en la circunferencia crítica, pero vista por alguien en la superficie de la estrella, la implosión no se congelaba en absoluto. La superficie de la estrella se contraía a través de la circunferencia crítica y seguía hacia adentro sin vacilación.

Lo cierto fue que allí, por primera vez, se consiguió simular por ordenador la implosión que debía producir agujeros negros. Está claro que la historia de todo esto es mucho más larga y contiene muchos más detalles que me he saltado para no hacer largo el trabajo que, en realidad, sólo persigue explicar a ustedes de la manera más simple posible, el trabajo que cuesta obtener los conocimientos que no llegan (casi nunca) a través de ideas luminosas, sino que, son el resultado del trabajo de muchos.

Nebulosa planetaria y enana blanca, estrella de neutrones, hipotética estrella de Quarks, y, Agujero Negro

Hoy, sabemos mucho más de cómo finaliza sus días una estrella y, dependiendo de su masa, podemos decir de manera precisa que clase de Nebulosa formará, que clase de explosión (si la hay) se producirá, y, finalmente, si el resultado de todo ello será una estrella enana blanca que encuentra su estabilidad final por medio del Principio de exclusión de Pauli (en mecánica cuántica)que se aplica a los fermiones pero no a los Bosones (son fermiones los quarks, electrones, protones y neutrones), en virtud del cual dos partículas idénticas en un sistema, como los electrones en un átomo o quarks en un hadrón (protón o neutrón, por ejemplo), no pueden poseer un conjunto idéntico de números cuánticos.

La

estrella azul cerca del centro de esta imagen es Zeta Ophiuchi. Cuando se ve en luz visible aparece como una estrella roja relativamente débil rodeada de otras estrellas tenues y sin polvo. Sin embargo, en esta imagen infrarroja tomada con campo amplio por el Explorador Infrared Survey de la NASA, o WISE, un punto de vista completamente diferente emerge. Zeta Ophiuchi es en realidad una muy masiva y caliente estrella azul, brillante que traza su camino a través de una gran nube de polvo y gas interestelar.

Una estrella masiva alejándose de su antiguo compañero se manifiesta haciendo un imponente surco a través de polvo espacial, como si se tratase de la proa de un barco. La estrella, llamada Zeta Ophiuchi, es enorme, con una masa de cerca de 20 veces la de nuestro Sol. En esta imagen, en los que se ha traducido la luz infrarroja a colores visibles que vemos con nuestros ojos, la estrella aparece como el punto azul en el interior del arco de choque. Zeta Ophiuchi orbitó una vez alrededor de una estrella aún más grande. Pero cuando la estrella explotó en una supernova, Zeta Ophiuchi se disparó como una bala. Viaja a la friolera velocidad de 24 kilómetros por segundo arrastrando con ella un conglomerado de polvo que distorsiona la región por la que pasa.

Mientras la estrella se mueve través del espacio, sus poderosos vientos empujan el gas y el polvo a lo largo de su camino en lo que se llama un arco de choque. El material en el arco de choque está tan comprimido que brilla con luz infrarroja que WISE puede captar. El efecto es similar a lo que ocurre cuando un barco cobra velocidad a través del agua, impulsando una ola delante de él. Esta onda de choque queda completamente oculta a la luz visible. Las imágenes infrarrojas como esta son importantes para arrojar nueva luz sobre lo que ocurre en situaciones similares.

Pero, siguiendo con el tema de las implosiones de las estrellas, ¿cuál es la razón por la que la materia no se colapsa, totalmente, sobre sí misma? El mismo principio que impide que las estrellas de neutrones y las estrellas enanas blancas implosionen totalmente y que, llegado un momento, en las primeras se degeneran los neutrones y en las segundas los electrones, y, de esa manera, se frena la compresión que producía la gravedad y quedan estabilizadas gracias a un principio natural que hace que la materia normal sea en su mayor parte espacio vacio también permite la existencia de los seres vivos. El nombre técnico es: El Principio de Exclusión de Pauli y dice que dos fermiones (un tipo de partículas fundamentales) idénticos y con la misma orientación no pueden ocupar simultáneamente el mismo lugar en el espacio. Por el contrario, los bosones (otro tipo de partículas, el fotón, por ejemplo) no se comportan así, tal y como se ha demostrado recientemente por medio de la creación en el laboratorio de los condensados de Bose-Einstein.

¿Cuál es la diferencia?

Los bosones son sociables; les gusta estar juntos. Como regla general, cualquier átomo con un número par de electrones+protones+neutrones es un bosón. Así, por ejemplo, los átomos del sodio ordinario son bosones, y pueden unirse para formar condensados Bose-Einstein.

Izquierda: Los bosones son sociables; los fermiones son antisociales.

Los fermiones, por otro lado, son antisociales. No pueden juntarse en el mismo estado cuántico (por el Principio de Exclusión de Pauli de la mecánica cuántica). Cualquier átomo con un número impar de electrones+protones+neutrones, como el potasio-40, es un fermión.

Pero, estábamos diciendo: “…no pueden poseer un conjunto idéntico de números cuánticos.” A partir de ese principio, sabemos que, cuando una estrella como nuestro Sol deja de fusionar Hidrógeno en Helio que hace que la estrella deje de expandirse y quede a merced de la Gravedad, ésta implosionará bajo el peso de su propia masa, es decir, se contraerá sobre sí misma por la fuerza gravitatoria pero, llegará un momento en el cual, los electrones, debido a ese principio de exclusión de Pauli que les impide estar juntos, se degeneran y se moverán de manera aleatoria con velocidades relativista hasta el punto de ser capaces de frenar la fuerza provocada por la gravedad, y, de esa manera, quedará estabilizada finalmente una estrella enana blanca.

Si hablamos de una estrella supermasiva, su produce la implosión arrojando las capas externas al espacio interestelar mientras que el grueso de la estrella se comprime más y más sin que nada la pueda frenar, aquí no sirve el Principipo de exclusión de Pauli para los fermiones y, es tal la fuerza gravitatoria que se desencadena como consecuencia de que la estrella supergigante no puede seguir fusionando y queda a merce4d de una sola fiuerza: La Gravedad, que ésta, la comprime hasta lo inimaginable para convertir toda aquella ingente masa en una singularidad, es decir, un punto de densidad y energía “infinitas” que ni la luz puede escapar de allí, y, el tiempo se ralentiza y el espacio se curva a su alrededor.

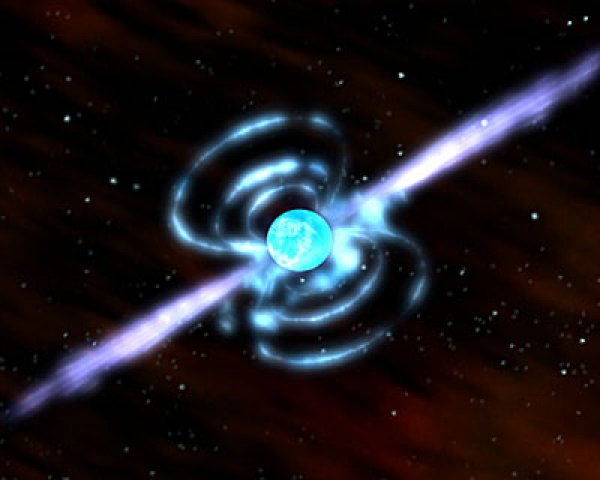

Si la estrella original es más masiva, la degeneración de los electrones no será suficiente para frenar la fuerza gravitatoria y, los electrones se fusionaran con los protones para convertirse en neutrones que, bajo el mismo principio de exclusión sufrirán la degeneración que frenará la fuerza de gravedad quedando entonces una estrella de neutrones. Por último, si la estrella es, aún más masiva, ni la degeneración de los neutrones será suficiente para frenar la inmensa fuerza gravitatoria generada por la masa de la estrella que, continuará la implosión contrayéndose cada vez más hasta desaparecer de nuestra vista convertida en un agujero negro.

¿Qué forma adoptará, qué transición de fase se produce en la materia dentro de una Singularidad?

¡Resulta todo tan complejo!

emilio silvera

Oct

15

Sabemos cómo evoluciona el Universo, observando las estrellas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Evolución ~

Clasificado en Evolución ~

Comments (0)

Comments (0)

En física, el protón es una partícula subatómica con una carga eléctrica elemental positiva 1 (1,6 × 10-19 C), igual en valor absoluto y de signo contrario a la del electrón, y una masa 1836 veces superior a la de un electrón.

Se ve el protón como estable, con un límite inferior en su vida media de unos 1035 años, aunque algunas teorías predicen que el protón puede desintegrarse en otras partículas.2 Originalmente se pensó que el protón era una partícula elemental, pero desde la década de 1970 existe una evidencia sólida de que es una partícula compuesta. Para la cromodinámica cuántica el protón es una partícula formada por la unión estable de tres quarks.

El antiprotón es la antipartícula del protón. Se conoce también como protón negativo. Se diferencia del protón en que su carga es negativa y en que no forma parte de los núcleos atómicos. El antiprotón es estable en el vacío y no se desintegra espontáneamente. Sin embargo, cuando un antiprotón colisiona con un protón, ambas partículas se transforman en mesones, cuya vida media es extremadamente breve (véase Radiactividad). Si bien la existencia de esta partícula elemental se postuló por primera vez en la década de 1930, el antiprotón no se identificó hasta 1955, en el Laboratorio de Radiación de la Universidad de California, por Emilio Segre y Owen Chamberlain, razón por la cual se les concedió el Premio Nobel de Física en 1959.”

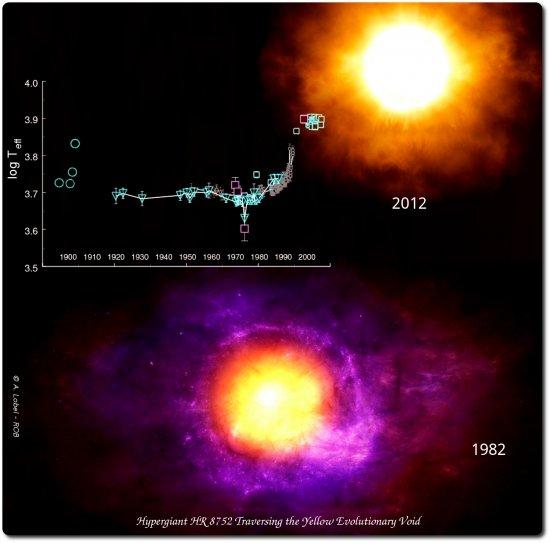

“La estrella hipergigante HR 8752 atravesando el Vacío Evolutivo Amarillo (YEV, por sus siglas en inglés) en una recreación artística. La gráfica muestra el aumento de temperatura que ha sufrido la superficie de la estrella en las últimas décadas.” /© A.Lob (1)

La estrella Hipergigante Amarila

“Es un tipo de estrella muy rara al hallarse en una fase muy temprana de su evolución, y existen dos tipos: las que están evolucionando de la secuencia principal a la fase de supergigante roja (como sucede con HD 33579 en la Gran Nube de Magallanes) y las que son consideradas como los núcleos de exestrellas supergigantes rojas, las cuales están evolucionando desde dicha fase a la de variable azul luminosa, o bien estrella Wolf-Rayet, o incluso presupernova (como sucede con Rho Cassiopeiae, IRC+10420, o HR 8752), en este caso sufriendo una gran pérdida de masa.”

“La mayor parte de los descubrimientos científicos son como fruta madura, caen, no se buscan… demasiado. El mérito está en encontrar el árbol adecuado al que arrimarse.”

Hace algún tiempo que salió la noticia en los medios: “Un equipo de científicos europeos, entre ellos investigadores del Instituto de Astrofísica de Canarias (IAC), ha hecho públicos los resultados de 30 años de investigación sobre la estrella hipergigante HR 8752, que han revelado el eslabón perdido en la evolución de este tipo de astros. Concretamente, han descubierto que, la región inestable conocida como Vacío Evolutivo Amarillo, puede cambiar profundamente la evolución de una estrella ya que, en estas tres décadas, HR 8752 ha aumentado de forma espectacular su temperatura superficial en 3.000 Kelvin (K) a su paso por esta región.” (1)

Los resultados obtenidos venían a desvelar algunos misterios que antes, no tenían explicación.

“Una hipergigante (hypergiant en inglés) es una estrella excepcionalmente grande y masiva, incluso mayor que una supergigante. Su masa puede ser de hasta 1000 veces la masa de nuestro Sol, próxima al límite máximo teórico, el cual establece que la cantidad de masa en una estrella no puede exceder las 120 M☉ (masas solares). Este límite en masa está asociado a la luminosidad de Eddington, por el que estrellas más masivas simplemente no pueden estar en equilibrio al vencer la presión de radiación interna a la fuerza gravitacional: producirían tanta energía que se desprenderían de la masa en exceso de las 120 M☉. Aun así, algunas hipergigantes aparentan tener más de 100 M☉ e, inclusive, haber tenido, inicialmente, entre 200 y 250 M☉, al contrario de lo que predicen las teorías actuales sobre la formación y evolución estelar.”

La nebulosa de la Quilla, también llamada nebulosa de Carina, nebulosa de Eta Carinae o NGC 3372

Aquí tenemos a R Leporis, una estrella de Carbono a la que se puso el nombre de la “Estrella Carmesí”, o, la “Gota de Sangre”.

R Leporis (R Lep / HD 31996 / HR 1607) es una estrella variable de la constelación de Lepus, cerca del límite con Eridanus. Visualmente es una estrella de un color rojo vívido, cuyo brillo varía entre magnitud aparente +5,5 y +11,7. Descubierta por John Russell Hind en 1845, es también conocida como Estrella carmesí de Hind.

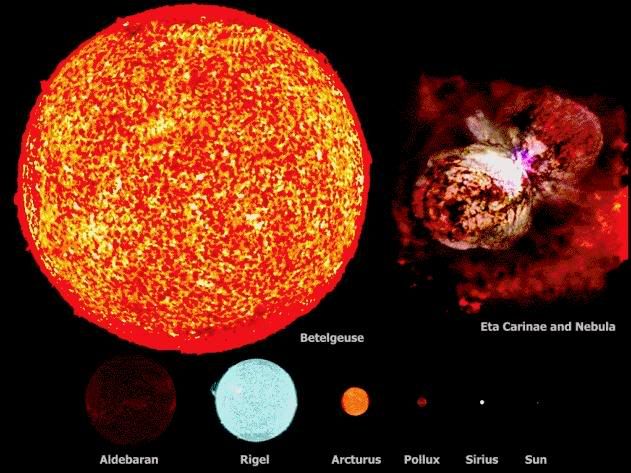

Del grupo destaca Antares, una supergigante M 1,5, 10 000 veces más luminosa que el Sol y con un diámetro que es probablemente más de 500 veces el del Sol. Nos contempla desde 520 a.l. de distancia y tiene una compañera enana. Su color es el rojo intenso.

Aldebaran, la estrella Alfa Tauri, es una Gigante K5. Aparentemente forma parte del grupo de estrella de las Hyades, aunque en realidad sólo está a 60 a.l., aprpoximadamente la mitad de la distancia del cúmulo.

Betelgeuse, la estrella Alfa Orionis, la décima más brillante del cielo, es una gigante tipo M2 que es una variable semirregular. Se dice que está a unos 400 a.l. de la Tierra y su luminosidad es 5000 veces superior a la del Sol pero, si se encuentra a la misma distancia de la Asociación de Orión (como algunos postulan), la luminosidad verdadera sería de 50 000 veces la del Sol. Su diámetro es cientos de veces el del Sol. Su brillo varía a medida que se expande y contrae en tamaño.

Arthurus es la estrella Alfa Boötis, magnitu -o,o4, la estrella más brillante al norte del ecuador celeste y la cuarta más brillante de todo el cielo. Es una gigante K 1 situada a 35 a.l.

Rigel, la estrella Beta Orionis de magnitud o,12 es una gigante B 8 situada a 1 400 a.l., su luminosidad es de unas 150 000 veces la del Sol, tiene una compañera de magnitud 6,8, que es a su vez una binaria espectroscópica.

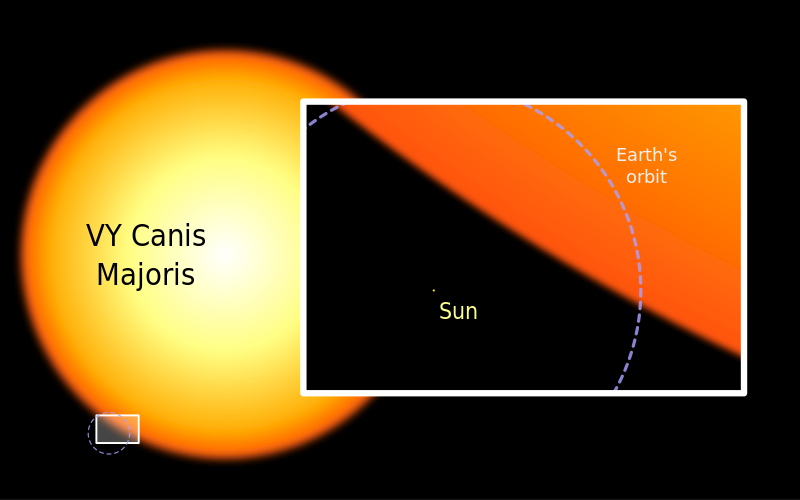

Al lado de estas gigantes, el Sol y otras estrellas resultan minúsculos como podemos ver en la imagen y, sin embargo, ya sabemos todos la importancia que nuestro Sol tiene para hacer posible la vida en la Tierra.

¡No por pequeño se es insignificante! Ya sabéis: ¡Todo lo grande está hecho de cosas pequeñas!

El grupo de tres estrellas gigantes Pismis 24-1 (CSIC).

Mucho antes de que Russell descubriera la estrella carmesí y Johannes Hevelius quedara fascinado por Mira, la estrella maravillosa, los astrónomos árabes se fijaron en una estrella de la constelación de Perseo que cambiaba de brillo cada tres días, con una pauta muy regular y acentuada. Los árabes escribieron una de las escasas páginas destacadas de la astronomía medieval, paliando de alguna manera la importante decadencia que sufrió esta ciencia en ese período en Europa y el Mediterráneo en el periodo comprendido entre Ptolomeo y Copérnico, que duró un milenio y medio.

Bueno, hablar aquí de las estrellas que conocemos bien y de sus historias resulta entretenido y nos enseña un poco de la historia estelar en objetos individuales y determinados que, por una u otra razón tienen destacadas razones para que los astrónomos se fijaran en ellos. Por ejemplo, de Eta Carinae (antes mencionada y cuya imagen tenéis arriba), es una variable irregular hipergigante, que llegó a ser la segunda estrella más brillante del cielo. Es una variable azul luminosa con magnitud absoluta de -10, y es clasificada oficialmente como una estrella S Doradus. Se encuentra dentro de un cúmulo de estrellas masivas y una masa estimada en 100 masas solares, en tiempos se llegó a creer que era la estrella más masiva de la Galaxia. El único espectro visible es el de la Nebulosa del Homúnculo que la rodea. Eta Carinae es una intensa fuente infrarroja y su importante pérdida de masa (alrededor de 0,1 masas solares por año) tiene asociadas energías próximas a las de algunas supernovas y, teniéndola a unos 8000 años-luz, lo mejor será estar vigilante, ya que, aunque son distancias inmensas…Nunca se sabe lo que un monstruo de ese calibre nos podría enviar.

Estrellas masivas como Eta Carionae, Betegeuse, Arthurus, Antares y tantas otras que ahora sabemos que existen nos llevan a saber que, cuando mueren, se pueden convertir en otros objetos distintos como, por ejemplo:

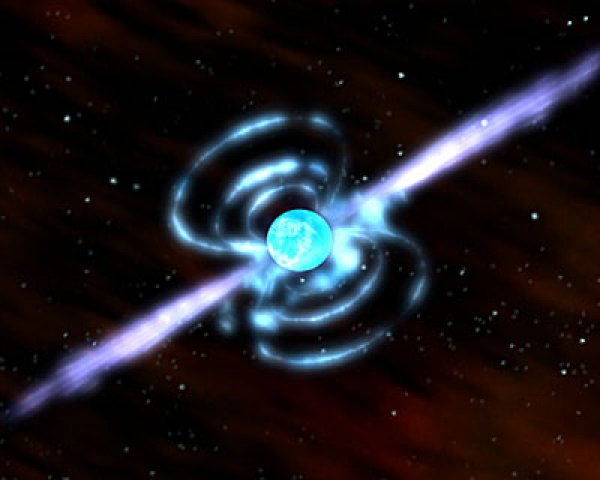

Estrellas de Neutrones

Estrellas que se forman a partir de estrellas masivas (2-3 masas solares) cuando al final de sus vidas, agotado el combustible nuclear de fusión, quedan a merced de la Gravedad que no se ve frenada por la fusión nuclear, y, en ese momento, la estrella comienza a contraerse bajo su propio peso, de forma tal que, los protones y electrones se funden y se convierten en neutrones que, al verse comprimidos tan violentamente, y, no pudiendo permitirlo por el principio de exclusión de Pauli, se degeneran y y hacen frente a la fuerza gravitatoria, consiguiendo así el equilibrio de lo que conocemos como estrella de nweutrones de intensom campo electromagnético y rápida rotación. Estos objetos, después de los Agujeros Negros, son los más densos que se conocen en el Universo, y, su masa podría pesar 1017 Kg/m3.

¿Estrella de Quarks?

Es hipotética, aún no se ha observado ninguna pero se cree que pueden estar por ahí, y, si es así, serían mucho más densas que las de neutrones, ya que, ni la degeneración de los neutrones podría parar la Fuerza de la Gravedad que sería frenada por los Quarks que también, son fermiones.

Si la estrella no es masiva, y tiene una masa como la del Sol, su final será la de convertirse en una ¡Estrella Enana Blanca!

Nebulosa planetaria y la enana blanca central

Nuestro Sol es de esta clase de estrellas y, tampoco su densidad se queda corta, ya que, alcanzan 5 x 108 Kg/m3. Aquí, cuando la estrella implosiona y comienza a comprimirse bajo su propio peso por la fuerza de Gravedad, como ocurrió con la estrella de Neutrones, aparece el Principio de Exclusión de Pauli, el cual postula que los fermiones (los electrones son fermiones) no pueden ocupar el mismo lugar estando en posesión del mismo número cuántico, y, siendo así, se degeneran y hace que, la compresión de la estrella por la Gravedad se frene y vuelve el equilibrio que la convierte en estrellas enana blanca.

El fenómeno de convertirse en enana blanca ocurre cuando la estrella original tiene una mása máxima posible de 1,44 masas solares, el límite de Shandrashekar, si fuera mayor se convertiría en estrella de neutrones. Y, siendo mayor la masa de 3-4 masas solares, su destino sería un agujero negro.

Las Nebulosas planetarias nos ofrecen una amplia gama de figuras con sus enanas blanca centrales

Nos despediremos con estas bellas imágenes de sendas Nebulosas Planetarias como, un día lejano aun en el futuro, nos mostrará nuestro Sol al llegar al término de su vida. Ese será su final: Una bonita Nebulosa Planetaria con una estrella enana blanca en en el centro.

Claro que, tampoco ese será el final para el Universo en el que, nuevas estrellas seguirán naciendo para hacer posible que, mundos como la Tierra puedan, con su luz y su calor, hacer surgir formas de vida que, como la nuestra, pueda alcanzar la consciencia de Ser y, a partir de ahí… comenzará otra nueva aventura que será digna de contar.

emilio silvera

Totales: 87.209.349

Totales: 87.209.349 Conectados: 88

Conectados: 88