Feb

3

Los núcleos, la masa, la energía…¡La Luz!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (1)

Comments (1)

Hay veces en las que nos cuentan cosas y hechos de los que nunca hemos tenido noticias y, resultan del máximo interés. Nuestra curiosidad nos llama a desentrañar los misterios y secretos que, tanto a nuestro alrededor, como en las regiones más lejanas del Universo, puedan haber ocurrido, puedan estar sucediendo ahora, o, en el futuro pudieran tener lugar, ya que, de alguna manera, todas ellas tienen que ver con nosotros que, de alguna manera, somos parte de la Naturaleza, del Universo y, lo que sucedió, lo que sucede y lo que sucederá… ¡Nos importa!

El saber ocupa un lugar en nuestras mentes.

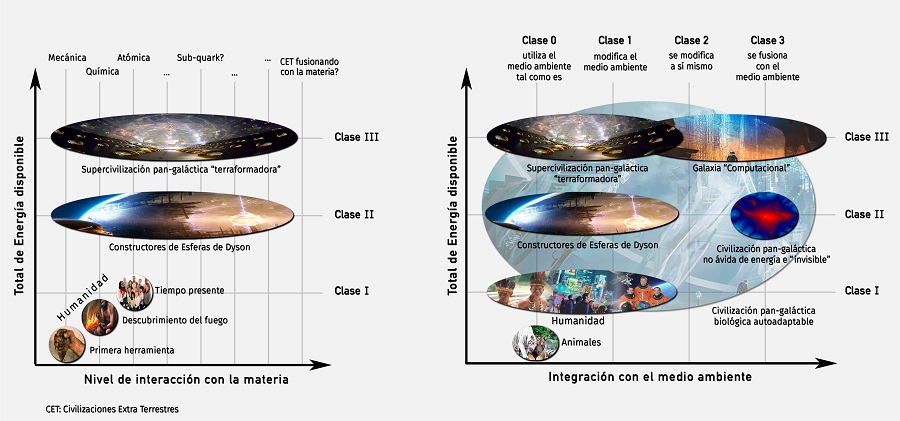

No podemos saber si la Humanidad como tal, estará aquí mucho tiempo más y, si con el tiempo y los cambios que se avecinan, nosotros los humanos, mutaremos hacia seres más completos y de mayor poder de adaptación al medio. Y, desde luego, nuestros descendientes, llegara un dia lejano en el futuro en el cual, habrán dejado la Tierra antes de que se convierta en Gigante Roja y calcine el Planeta y, habrán colonizado otros mundos. Para eso faltan mucho miles de millones de años. En la actualidad, solo estamos dando los inseguros primeros pasos por los alrededores de nuestro hogar, plantearnos ir mucho mas allá, es impensable. No tenemos ni la capacidad tecnológica ni la inteligencia necesaria para desarrollar los medios que se necesitan para poder desplazarnos a otros mundos lejanos que, posiblemente, estando situados en zona habitable como la misma Tierra, nos podrían dar el cobijo necesario para su colonización y hacer de ellos nuestros futuros hogares.

El futuro: Siempre será incierto

Pero, hablemos de Física

La partícula emitida por un núcleo radiactivo, por lo general lleva una considerable cantidad de energía. Y, ¿de dónde procede esa energía? Es el resultado de la conversión en energía de una pequeña parte del núcleo (E = mc2); en otras palabras, el núcleo siempre pierde un poco de masa en el acto de expeler la partícula.

Los físicos se vieron durante mucho tiempo turbados por el hecho de que, a menudo, la partícula beta emitida en una desintegración del núcleo no alberga energía suficiente para compensar la masa perdida por el núcleo. En realidad, los electrones no eran igualmente deficitarios. Emergían con un amplio espectro de energías, y el máximo (corregido por muy pocos electrones) era casi correcto, pero todos los demás no llegaban a alcanzarlo en mayor o menos grado. Las partículas alfa emitidas por un nucleido particular poseían iguales energías en cantidades inesperadas. En ese caso, ¿Qué era erróneo en la emisión de partículas beta?, ¿Qué había sucedido con la energía perdida?

En 1.922, Lise Maitner se hizo por primera vez esta pregunta, y hacia 1.936 Niels Bohr estaba dispuesto a abandonar el gran principio de conservación de la energía, al menos en lo concerniente a partículas subatómicas. En 1.931 Wolfgang Pauli sugirió una solución para el enigma de la energía desaparecida. Tal solución era muy simple: junto con la partícula beta del núcleo se desprendía otra, que se llevaba la energía desaparecida. Esa misteriosa segunda partícula tenía propiedades bastante extrañas; no poseía carga ni masa. Lo único que llevaba mientras se movía a la velocidad de la luz era cierta cantidad de energía. A decir verdad, aquello parecía un cuerpo ficticio creado exclusivamente para equilibrar el contraste de energías.

Habitualmente aceptamos que la física es la ciencia que estudia la estructura y propiedades de la materia y la energía, las formas de existencia de las mismas en el espacio y el tiempo, así como las leyes de rigen sus interacciones. En este definición no hay limitaciones precisas entre la naturaleza viviente e inanimada, y aunque ello no implica la reducción de todas las ciencias a la física, se deduce que las bases teóricas finales de cualquier dominio de las ciencias naturales tienen una naturaleza física.

Pero, sigamos…

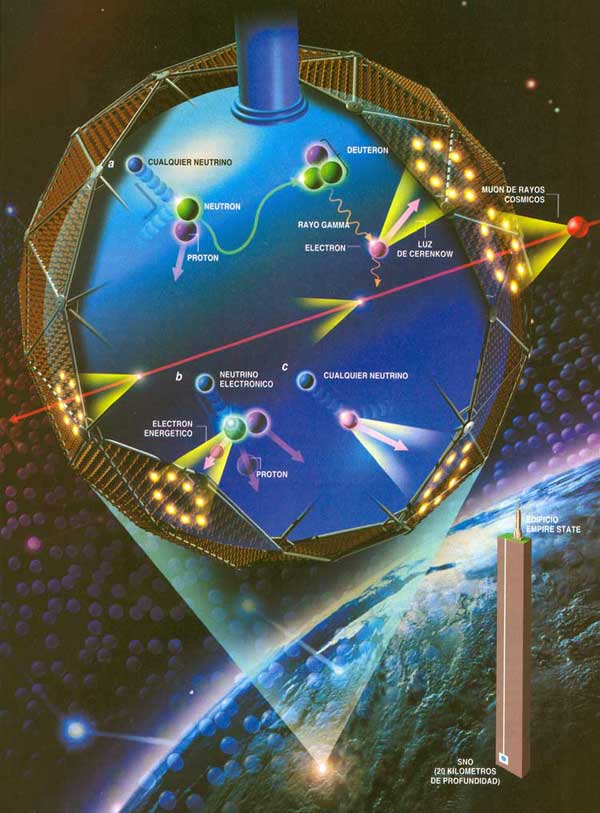

Sin embargo, tan pronto como se propuso la posibilidad de su existencia, los físicos creyeron en ella ciegamente. Y esta certeza se incrementó al descubrirse el neutrón y al saberse que se desintegraba en un protón y liberaba un electrón que, como en la decadencia beta, portaba insuficientes cantidades de energía. Enrico Fermi dio a esta partícula putativa el nombre de neutrino, palabra italiana que significa “pequeño neutro”.

El neutrón dio a los físicos otra prueba palpable de la existencia del neutrino. Como ya he comentado en otra página de este trabajo, casi todas las partículas describen un movimiento rotatorio. Esta rotación se expresa, más o menos, en múltiplos de una mitad, según la dirección del giro. Ahora bien, el protón, el neutrón y el electrón tienen rotación de una mitad. Por tanto, si el neutrón con rotación de una mitad origina un protón y un electrón, cada uno con rotación de una mitad, ¿Qué sucede con la ley sobre conservación del momento angular? Aquí hay algún error. El protón y el electrón totalizan una mitad con sus rotaciones (si ambas rotaciones siguen la misma dirección) o cero (si sus rotaciones son opuestas); pero sus rotaciones no pueden sumar jamás una mitad. Sin embargo, por otra parte, el neutrino viene a solventar la cuestión. Supongamos que la rotación del neutrón sea +½, y admitamos también que la rotación del protón sea +½ y la del electrón -½, para dar un resultado neto de cero. Demos ahora al neutrino una rotación de +½ y la balanza quedará desequilibrada.

+½ (n) = +½ (p) – ½ (e) + ½ (neutrino)

Detectando Neutrinos

En otras palabras, la existencia de neutrinos y antineutrinos debería salvar no una, sino tres, importantes leyes de conservación: la conservación de la energía, la de conservación del espín y la de conservación de partícula/antipartícula.

Pero aún queda algo por desequilibrar. Una sola partícula (el neutrón) ha formado dos partículas (el protón y el electrón), y si incluimos el neutrino, tres partículas. Parece más razonable suponer que el neutrón se convierte en dos partículas y una antipartícula. En otras palabras: lo que realmente necesitamos equilibrar no es un neutrino, sino un antineutrino.

El propio neutrino surgiría de la conversión de un protón en un neutrón. Así pues, los productos serían un neutrón (partícula), un positrón (antipartícula) y un neutrino (partícula). Esto también equilibra la balanza.

Impresionante vista de la Vía Láctea desde el Manua Kea. La Galaxia, el Universo…Todo es energía.

Es importante conservar esas leyes puesto que parece estar presentes en toda clase de relaciones nucleares que no impliques electrones o positrones, y sería muy útil si también se hallasen presentes en reacciones que incluyesen esas partículas. Las más importantes conversiones protón-neutrón son las relacionadas con las reacciones nucleares que se desarrollan en el Sol y en los astros. Por consiguiente, las estrellas emiten radiaciones rápidas de neutrinos, y se calcula que tal vez pierdan a causa de esto el 6 u 8% de su energía. Pero eso sería meternos en otra historia y, por mi parte, con la anterior explicación sólo trataba de dar una muestra del ingenio del hombre que, como habréis visto, no es poco.

Desde que puedo recordar, he sido un amante de la física. Me asombran cuestiones como la luz, su naturaleza de un conglomerado de colores, ondas y partículas, su velocidad que nos marca el límite del máximo que podemos correr en nuestro universo, y en fin, muchos otros misterios que encierra esa cosa tan cotidiana que nos rodea y lo inunda todo haciendo posible que podamos ver por donde vamos, que las plantas vivan y emitan oxígeno o que nos calentemos. Realmente, sin luz, nuestra vida no sería posible. Entonces, ¿Qué es realmente la luz?

Muchos (casi todos) opinan que es algo inmaterial. Los objetos materiales grandes o muy pequeños como las galaxias o los electrones, son materia. La luz, sin embargo, se cree que es inmaterial; dos rayos de luz se cruzan sin afectarse el uno al otro. Sin embargo, yo creo que la luz es simplemente una forma de energía lumínica, una más de las diversas formas en las que puede presentarse la materia. Nosotros mismos, en última instancia, somos luz.

Está claro que los estudiosos de la época antigua y medieval estaban por completo a oscuras acerca de la naturaleza de la luz. Especulaban sobre que consistía en partículas emitidas por objetos relucientes o tal vez por el mismo ojo. Establecieron el hecho de que la luz viajaba en línea recta, que se reflejaba en un espejo con un ángulo igual a aquel con el que el rayo choca con el espejo, y que un rayo de luz se inclina (se refracta) cuando pasa del aire al cristal, al agua o a cualquier otra sustancia transparente.

Cuando la luz entra en un cristal o en alguna sustancia transparente, de una forma oblicua (es decir, en un ángulo respecto de la vertical), siempre se refracta en una dirección que forma un ángulo menor respecto de la vertical. La exacta relación entre el ángulo original y el ángulo reflejado fue elaborada por primera vez en 1.621 por el físico neerlandés Willerbrord Snell. No publicó sus hallazgos y el filósofo francés René Descartes descubrió la ley, independientemente, en 1.637.

¿Nos suplirán un día? Seguro que en el futuro, serán otros los que hagan experimentos con la luz y busquen su verdadera naturaleza.

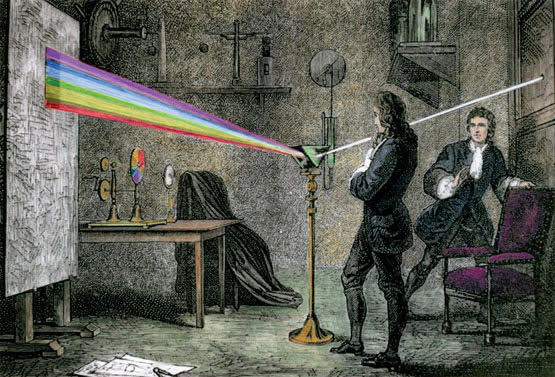

Los primeros experimentos importantes acerca de la naturaleza de la luz fueron llevados a cabo por Isaac Newton en 1.666, al permitir que un rayo de luz entrase en una habitación oscura a través de una grieta de las persianas, cayendo oblicuamente sobre una cara de un prisma de cristal triangular. El rayo se refracta cuando entra en el cristal y se refracta aún más en la misma dirección cuando sale por una segunda cara del prisma (las dos refracciones en la misma dirección se originan porque los lados del prisma se encuentran en ángulo en vez de en forma paralela, como sería el caso de una lámina ordinaria de cristal).

Newton dedujo que la luz blanca corriente era una mezcla de varias luces que excitaban por separado nuestros ojos para producir las diversas sensaciones de colores. La amplia banda de sus componentes se denominó spectrum (palabra latina que significa “espectro” fantasma).

Newton atrapó el rayo emergente sobre una pantalla blanca para ver el efecto de la refracción reforzada. Descubrió que, en vez de formar una mancha de luz blanca, el rayo se extendía en una gama de colores: rojo, anaranjado, amarillo verde, azul y violeta, en este orden. Newton dedujo de ello que la luz blanca corriente era una mezcla de varias luces que excitaban por separado nuestros ojos para producir las diversas sensaciones de colores. La amplia banda de sus componentes se denominó spectrum (palabra latina que significa espectro o fantasma). Newton llegó a la conclusión de que la luz se componía de diminutas partículas (“corpúsculos”), que viajaban a enormes velocidades. Le surgieron y se planteó algunas inquietantes cuestiones: ¿por qué se refractaban las partículas de luz verde más que las de luz amarilla? ¿Cómo se explicaba que dos rayos de luz se cruzaran sin perturbarse mutuamente, es decir, sin que se produjeran colisiones entre partículas?

En 1.678, el físico neerlandés Christian Huyghens (un científico polifacético que había construido el primer reloj de péndulo y realizado importantes trabajos astronómicos) propuso una teoría opuesta: la de que la luz se componía de minúsculas ondas. Y si sus componentes fueran ondas, no sería difícil explicar las diversas difracciones de los diferentes tipos de luz a través de un medio refractante, siempre y cuando se aceptara que la luz se movía más despacio en ese medio refractante que en el aire. La cantidad de refracción variaría con la longitud de las ondas: cuanto más corta fuese tal longitud, tanto mayor sería la refracción. Ello significaba que la luz violeta (la más sensible a este fenómeno) debía de tener una longitud de onda más corta que la luz azul; ésta, más corta que la verde, y así sucesivamente.

Lo que permitía al ojo distinguir los colores eran esas diferencias entre longitudes de onda. Y como es natural, si la luz estaba integrada por ondas, dos rayos podrían cruzarse sin dificultad alguna (las ondas sonoras y las del agua se cruzan continuamente sin perder sus respectivas identidades).

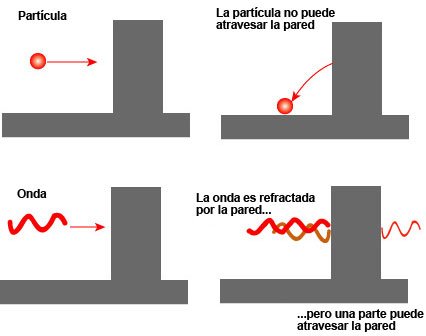

Pero la teoría de Huyghens sobre las ondas tampoco fue muy satisfactoria. No explicaba por qué se movían en línea recta los rayos luminosos, ni por qué proyectaban sombras recortadas, ni aclaraba por qué las ondas luminosas no podían rodear los obstáculos, del mismo modo que pueden hacerlo las ondas sonoras y de agua. Por añadidura, se objetaba que si la luz consistía en ondas, ¿Cómo podía viajar por el vacío, ya que cruzaba el espacio desde el Sol y las estrellas? ¿Cuál era esa mecánica ondulatoria?

Con el éxito de Newton de su ley de la Gravitación Universal, no es extraño que afirmara de forma tajante que la luz es corpuscular. Newton se opuso violentamente a la naturaleza ondulatoria de la luz, ya que no veía cómo se podía explicar con ella la propagación rectilínea de la misma. Por otro lado estaba Christian Huygens, 13 años mayor que Newton que defendía la naturaleza ondulatoria con algunas ventajas.

Ambas teorías explicaban perfectamente la reflexión y refracción de la luz. Pero diferían en una cosa. La teoría corpuscular afirmaba que las partículas de luz se acelerarían al pasar por un material de mayor densidad óptica y las ondas a menor. Esto no era comprobable por aquella época. Debido a la influencia de Newton y a la poca habilidad de Huygens para desarrollarla matemáticamente, la teoría ondulatoria quedó descartada durante un siglo.

Aproximadamente durante un siglo, contendieron entre sí estas teorías. La teoría corpuscular de Newton fue, con mucho, la más popular, en parte porque la respaldó el famoso nombre de su autor. Pero hacia 1.801, un físico y médico inglés, de nombre Thomas Young, llevó a cabo un experimento que arrastró la opinión pública al campo opuesto. Proyectó un fino rayo luminoso sobre una pantalla, haciéndolo pasar antes por dos orificios casi juntos; si la luz estuviera compuesta por partículas, cuando los dos rayos emergieran de ambos orificios, formarían presuntamente en la pantalla una región más luminosa donde se superpusieran, y regiones menos brillantes, donde no se diera tal superposición. La pantalla mostró una serie de bandas luminosas, separadas entre sí por bandas oscuras; pareció incluso que en esos intervalos de sombra, la luz de ambos rayos contribuía a intensificar la oscuridad.

Sería fácil explicarlo mediante la teoría ondulatoria; la banda luminosa representaba el refuerzo prestado por las ondas de un rayo a las ondas del otro, dicho de otra manera, entraban “en fase” dos trenes de ondas, es decir, ambos nodos, al unirse, se fortalecían el uno al otro. Por otra parte, las bandas oscuras representaban puntos en los que las ondas estaban “desfasadas” porque el vientre de una neutralizaba el nodo de la otra. En vez de aunar sus fuerzas, las ondas se interferían mutuamente, reduciendo la energía luminosa neta a las proximidades del punto cero.

Considerando la anchura de las bandas y la distancia entre los dos orificios por lo que surgen ambos rayos, se pudo calcular la longitud de las ondas luminosas, por ejemplo, de la luz roja a la violeta o de los colores intermedios. Las longitudes de onda resultaron ser muy pequeñas. Así, la de la luz roja era de unos 0’000075 cm. Hoy se expresan las longitudes de las ondas luminosas mediante una unidad muy práctica ideada por Ángstrom; esta unidad, denominada igualmente Ángstrom (Å) en honor a su autor, es la cienmillonésima parte de un centímetro. Así pues, la longitud de onda de la luz roja equivale más o menos a 7.500 Å, y la de la luz violeta a 3.900 Å, mientras que las de colores visibles en el espectro oscilan entre ambas cifras.

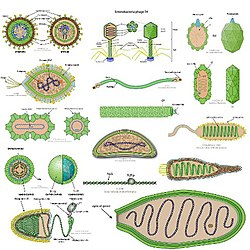

La cortedad de estas ondas es muy importante. La razón de que las ondas luminosas se desplacen en línea recta y proyecten sombras recortadas se debe a que todas son incomparablemente más pequeñas que cualquier objeto; pueden contornear un obstáculo sólo si este no es mucho mayor que la longitud de onda. Hasta las bacterias, por ejemplo, tienen un volumen muy superior al de una onda luminosa, y por tanto, la luz puede definir claramente sus contornos bajo el microscopio. Sólo los objetos cuyas dimensiones se asemejan a la longitud de onda luminosa (por ejemplo, los virus y otras partículas subatómicas) son lo suficientemente pequeños como para que puedan ser contorneados por las ondas luminosas.

Un físico francés, Agustin-Jean Fresnel, fue quien demostró por vez primera en 1.818 que si un objeto es lo suficientemente pequeño, la onda luminosa lo contorneará sin dificultad. En tal caso, la luz determina el llamado fenómeno de “difracción”. Por ejemplo, las finísimas líneas paralelas de una “reja de difracción” actúan como una serie de minúsculos obstáculos, que se refuerzan entre sí. Puesto que la magnitud de la difracción va asociada a la longitud de onda, se produce el espectro. A la inversa, se puede calcular la longitud de onda midiendo la difracción de cualquier color o porción del espectro, así como la separación de las marcas sobre el cristal.

La mano del Universo juguetea con unos puntos luminosos que quieren llegar a ser cegadores…Son nuestras Mentes, productos de la evolución del Universo que, a partir de la materia inerte, ha podido alcanzar el estadio bio-químico de la consciencia y, al ser conscientes, hemos podido descubrir que existen “números misteriosos” dentro de los cuales subyacen mensajes que tenemos que desvelar.

Fraunhofer exploró dicha reja de difracción con objeto de averiguar sus finalidades prácticas, progreso que suele olvidarse, pues queda eclipsado por su descubrimiento más famoso, los rayos espectrales. El físico americano Henry Augustus Rowland ideó la reja cóncava y desarrolló técnicas para regularlas de acuerdo con 20.000 líneas por pulgada. Ello hizo posible la sustitución del prisma por el espectroscópio.

Ante tales hallazgos experimentales, más el desarrollo metódico y matemático del movimiento ondulatorio, debido a Fresnel, pareció que la teoría ondulatoria de la luz había arraigado definitivamente, desplazando y relegando para siempre a la teoría corpuscular.

No sólo se aceptó la existencia de ondas luminosas, sino que también se midió su longitud con una precisión cada vez mayor. Hacia 1.827, el físico francés Jacques Babinet sugirió que se empleara la longitud de onda luminosa (una cantidad física inalcanzable) como unidad para medir tales longitudes, en vez de las muy diversas unidades ideadas y empleadas por el hombre. Sin embargo, tal sugerencia no se llevó a la práctica hasta 1.880 cuando el físico germano-americano Albert Abraham Michelson inventó un instrumento denominado “interferómetro”, que podía medir las longitudes de ondas luminosas con una exactitud sin precedentes. En 1.893, Michelson midió la onda de la raya roja en el espectro del cadmio y determinó que su longitud era de 1/1.553.164 m.

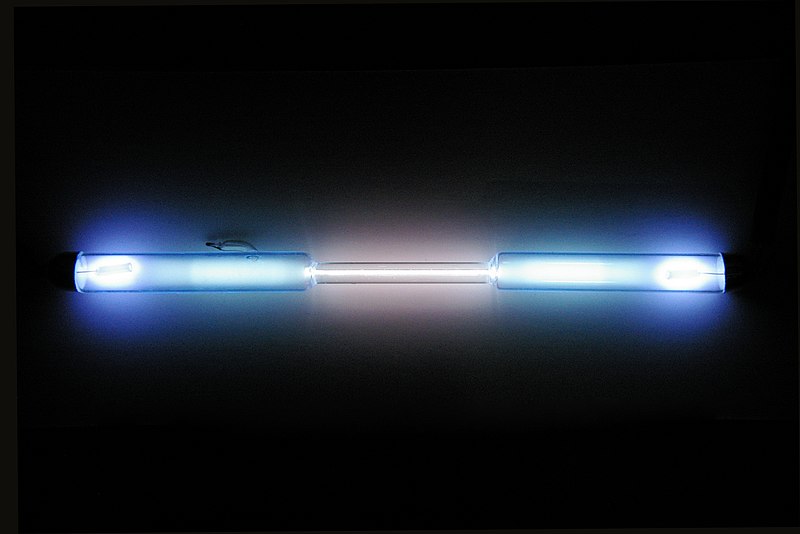

Tubo de descarga lleno de kriptón puro

Pero la incertidumbre reapareció al descubrirse que los elementos estaban compuestos por isótopos diferentes, cada uno de los cuales aportaba una raya cuya longitud de inda difería ligeramente de las restantes. En la década de 1.930 se midieron las rayas del criptón 86. Como quiera que este isótopo fuera gaseoso, se podía abordar con bajas temperaturas, para frenar el movimiento atómico y reducir el consecutivo engrosamiento de la raya.

En 1.960, el Comité Internacional de Pesos y Medidas adoptó la raya del criptón 86 como unidad fundamental de la longitud. Entonces se reestableció la longitud del metro como 1.650.763’73 veces la longitud de onda de dicha raya espectral. Ello aumentó mil veces la precisión de las medidas de longitud. Hasta entonces se había medido el antiguo metro patrón con un margen de error equivalente a una millonésima, mientras que en lo sucesivo se pudo medir la longitud de onda con un margen de error equivalente a una milmillonésima.

Emilio Silvera Vázquez

Feb

3

¿Las estrellas? ¡Sin ellas no estaríamos aquí!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en ¡Las estrellas! ~

Clasificado en ¡Las estrellas! ~

Comments (1)

Comments (1)

Podría ser una posibilidad

https://youtu.be/vf9Y1rKWnxI

Primero el mundo, mucho más tarde llegó la vida primigenia, el paso del tiempo hizo posible la evolución de las especies, y, sin tener aún una explicación auto-suficiente, fue la especie Homo la que se elevó sobre las demás, hasta tal punto que llegó a adquirir Conciencia. Consciencia de Ser, Conciencia del Bien y del Mal. Y, conjeturamos que en el inmenso Universo… ¡No estamos solos!

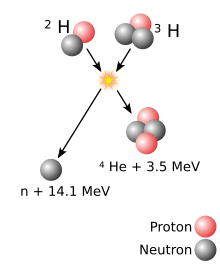

Es cierto que cuando vemos las cosas con cierta asiduidad y de forma permanente, esa cotidianidad nos hace perder la perspectiva y no pensamos en lo que realmente esas cosas pueden ser y, con las estrellas nos ocurre algo similar, ya que son algo más, mucho más, que simples puntitos luminosos que brillan en la oscuridad de la noche. Una estrella es una gran bola de gas luminoso que, en alguna etapa de su vida, produce energía por la fusión nuclear del hidrógeno para formar helio. El término estrella por tanto, no sólo incluye estrellas como nuestro Sol, que están en la actualidad quemando hidrógeno, sino también protoestrellas, aún no lo suficientemente calientes como para que dicha combustión haya comenzado, y varios tipos de objetos evolucionados como estrellas gigantes y supergigantes, que están quemando otros combustibles nucleares, o las enanas blancas y las estrellas nucleares, que están formadas por combustible nuclear gastado.

Muchos son los ejemplos de estrellas masivas (más de 100 masas solares) que, para no morir, eyectan material al espacio interestelar y siguen viviendo.

Estrellas masivas que expulsan gases, ya que, cuando la masa es muy grande, su propia radiación las puede destruir y, de esta manera, descongestionan la tensión y evitan un final anticipado. Arriba teneis una estrella supermasiva que ha expulsado gases formando una nebulosa para evitar su muerte, Eta Carinae ha hecho lo mismo. Estas son estrellas que estám congestionadas y, sólo la expulsión de material la puede aliviar y conseguir que siga brillando como estrella evitando explotar como supernova.

Se calcula que la masa máxima de una estrella es de unas 120 masas solares, por encima de la cual sería destruida por su propia radiación. La masa mínima es de 0,08 masas solares; por debajo de ella, los objetos no serían lo suficientemente calientes en sus núcleos como para que comience la combustión del hidrógeno, y se convertirían en enanas marrones.

De la misma forma que al calentar una pieza de metal cambia de color, al principio rojo, luego amarillo hasta llegar al blanco, el color de una estrella varia según su temperatura superficial. Las estrellas más frías son las rojas, y las mas calientes las azules. Estos colores suelen percibirse a simple vista, como por ejemplo Antares (la estrella principal de Scorpius) que es de color rojo, o Rigel (en Orion) de color azul. En astronomía se utiliza la escala Kelvin para indicar temperaturas, donde el cero absoluto es -273 grados Celsius.

El diagrama de Hertzsprung-Russell proporcionó a los astrónomos un registro congelado de la evolución de las estrerllas, el equivalente astrofísico del registro fósil que los geólogos estudian en los estratos rocosos. Presumiblemente, las estrellas evolucinan de algún modo, pasan la mayor parte de su tiempo en la serie principal (la mayoría de las estrellas en la actualidad, en el brevísimo tiempo que tenemos para observar, se encuentran allí), pero empiezan y terminan su vida en alguna otra parte, entre las ramas o en el mantillo. Por supuesto, no podemos esperar para ver que esto sucede, pues el tiempo de vida, aún de estrellas de vida corta, se mide en millones de años. Hallar la respuesta exigirá conocer la física del funcionamiento estelar.

El progreso en física, mientras tanto, estaba bloqueado por una barrera aparentemente insuperable. Esto era literal: el agente responsable era conocido como la Barrera de Coulomb, y por un tiempo frustró los esfuerzos de los físicos teóricos para comprender cómo la fusión nuclear podía producir energía en las estrellas.

“La barrera de Coulomb, denominado a partir de la ley de Coulomb, nombrada así del físico Charles-Augustin de Coulomb (1736–1806), es la barrera de energía debida a la interacción electrostática que el núcleo atómico debe superar para experimentar una reacción nuclear. Esta barrera de energía es proporcionada por la energía potencial electrostática:

donde:

- k es la constante de Coulomb = 8.9876×109 N m² C−2;

- ε0 es la permeabilidad en el vacío;

- q1, q2 son las cargas de las partículas que interactúan;

- r es el radio de interacción.”

Un valor positivo de U es debido a una fuerza de repulsión, así que las partículas que interactúan están a mayores niveles de energía cuando se acercan. Un valor negativo de la energía potencial U indica un estado de ligadura, debido a una fuerza atractiva. La linea de razonamiento que conducía a esta barrera era impecable. Las estrellas están formadas en su mayor parte por hidrógeno. Esto se hace evidente en el estudio de sus espectros.) El núcleo del átomo de hidrógeno consiste en un sólo protón, y el protón contiene casi toda la masa del átomo. (Sabemos esto por los experimentos de Rutherford explicados aquí en otra ocasión). Por tanto, el protón también debe contener casi toda la energía latente del átomo de hidrógeno.

Plasma de electrones

Recordemos que la masa es igual a la Energía: E = mc2. En el calor de una estrella los protones son esparcidos a altas velocidades -el calor significa que las partículas involucradas se mueven rápidamente- y, como hay muchos protones que se apiñan en el núcleo denso de una estrella, deben de tener muchísimos choques. En resumen, la energía del Sol y las estrellas, puede suponerse razonablemente, implica las interacciones de los protones. esta era la base de conjetura de Eddintong de que la fuente de la energía estelar “difícilmente puede ser otra cosa que energía subatómica, la cual, como se sabe, existe en abundancia en toda la materia”.

Hasta ese punto, todo iba bien, la ciencia estaba cerca de identificar la fusión termonuclear como el secreto de la energía solar. Pero aquí era donde intervenía la Barrera de Coulomb. Los protones están cargados positivamente; las partículas de igual carga se repelen entre sí; y este obstáculo parecía demasiado grande para ser superado, aun a la elevada velocidad a la que los protones se agitaban en el intenso calor del centro de las estrellas. De acuerdo con la física clásica, muy raras veces podían dos protones de una estrella ir con la rapidez suficiente para romper las murallas de sus campos de fuerza electromágnéticos y fundirse en un sólo núcleo. Los cálculos decían que la tasa de colisión de protones no podía bastar para mantener las reacciones de fusión. Sin embargo, allí estaba el Sol, con su rostro radiante y sonriente al ver el esfuerzo y las ecuaciones que decían que no podía brillar.

Dejemos aquí este proceso y digamos que, realmente, la mayoría de las veces el protón rebotará en la Barrera de Coulomb, pero de cuando en cuando la atravesará. Este es el “Efecto Túnel Cuántico”; que permite brillar a las estrellas. George Gamow, ansioso de explotar las conexiones entre la astronomía y la nueva física exótica a la que era adepto, aplicó las probabilidades cuánticas a la cuestión de la fusión nuclear en las estrellas y descubrió que los protones pueden superar la Barrera de Coulomb, o casi. El efecto túnel cuántico se hizo cargo de los cálculos de la desalentadora predicción clásica, que establecia la fusión de los protones a sólo una milésima de la tasa necesaria para explicar la energía liberada por el Sol, y la elevó a una décima de la tasa necesaria. Luego se tardó menos de un año para dar cuenta del deficit restante: la solución fue completada en 1929, cuando Robert Atkinson y Fritz Houterman combinaron los hallazgos de Gamow con lo que se ha llamado teoría maxwelliana de la distribución de velocidades. En la distribución maxwelliana hay siempre unas pocas partículas que se mueven mucho más rápidamente que la media y, Robert Atkinson y Fritz Houterman hallaron que estas pocas partículas veloces bastqaban para compensar la diferencia. Finalmente se hizo claro como podía romperse la Barrera de Coulomb suficientemente a menudo para que la fusión nuclear se produjese en las estrellas.

Pero la figura clave en todos estos desarrollos fue Hans Bhete, un refugiado de la Alemania nazi que había estudiado con Fermi en Roma y fue a enseñar en Cornell en EE. UU. Como su amigo Gamow, el joven Bhete era un pensador efervescente y vivaz, con tanto talento que parecía hacer su trabajo como si de un juego se tratara. Aunque no preparado en Astronomía, Bhete era un estudioso de legendaria rapidez. En 1938 ayudó al discipulo de Gamow y Edward Teller, C.L. Critchfield, a calcular una reacción que empezase con la colisión de dos protones podía generar aproximadamente la energía irradiada por el Sol, 3,86 x 1033 ergios por segundo. Así, en un lapso de menos de cuarenta años, la humanidad había progresado de la ignorancia de la existencia misma de los átomos a la comprensión del proceso de fusión termonuclear primaria que suministra energía al Sol.

Pero la reacción protón. protón no era bastante energética para explicar la luminosidad muy superior de estrellas mucho más grandes que el Sol, estrellas como las supergigantes azules de las Pléyades, que ocupan las regiones más altas del diagrama de Herptzsprung-Russell. Bhete puso remedio a esto antes de que terminase aquel el año 1938.

En abril de 1938, Bhete asistió a una conferencia organizada por Gamow y Teller que tenía el objeto de que físicos y astrónomos trabajaran juntos en la cuestión de la generación de energía en las estrellas. “Allí, los astrofísicos nos dijeron a los físicos todo que sabían sobre la constitución interna de las estrellas -recordoba Bhete-. esto era mucho (aunque) habían obtenido todos los resultados sin conocimiento de la fuente específica de energía.” De vuelta a Cornell, Bhete abordó el problema con celeridad y, en cuestión de semanas logró identificar el ciclo del Carbono, la reacción de fusión crítica que da energía a las estrellas que tiene más de una vez y media la masa del Sol.

Bhete que estaba falto de dinero, retiró el artículo que escribió sobre sus hallazgos y que ya tenía entragado en la Revista Physical Review, para entregarlo en un Concurso postulado por la Academía de Ciencias de Nueva York sobre la producción de energía en las estrellas. Por supuesto, Bhete ganó el primer Premio uy se llevó los 500 dolares que le sirvieron para que su madre pudiera emigrar a EE UU. Después lo volvió a llevar a la Revista que lo publicó y, finalmente, se lo publicaron y tal publicación le hizo ganar el Nobel. Por un tiempo, Bhete había sido el único humano que sabía por qué brillan las estrellas.

Cuando miramos al cielo y podemos contemplar extasiados esas maravillas que ahí arriba, en el espacio interestelar están brillando, y, nos da la sensación de que están haciéndonos guiños, como si quisieran mandarnos un mensaje, decirnos algo y nosotros, no pensamos en todo lo que ahí, en esos “puntitos brillantes” se está fraguando. De lo que allí ocurre, depende que los mundos tengan los materiales que en ellos están presentes y, de entre esos materiales, se destacan aquellos que por su química biológica, permiten que se pueda formar la vida a partir de unos elementos que se hicieron en los hornos nucleares de las estrellas.

Titilan como queriendo decirnos alguna cosa (efectos de la atmósfera de la Tierra)

Y sí, es curioso que, mirando en la os cura noche como brillan las estrellas del cielo, nos atrae su titilar engañoso (es la atmósfera terrestre la que hace que lo parezca) y su brillo, Sin embargo, pocos llegan a pensar en lo que verdaderamente está allí ocurriendo. Las transformaciones de fase por fusión no cesan. Esta transformación de materia en energía es consecuencia de la equivalencia materia-energía, enunciada por Albert Einstein en su famosa fórmula E=mc2; donde E es la energía resultante, m es la masa transformada en energía, y c es la velocidad de la luz (300 000 kilómetros por segundo). La cantidad de energía que se libera en los procesos de fusión termonuclear es fabulosa. Un gramo de materia transformado íntegramente en energía bastaría para satisfacer los requerimientos energéticos de una familia mediana durante miles de años.

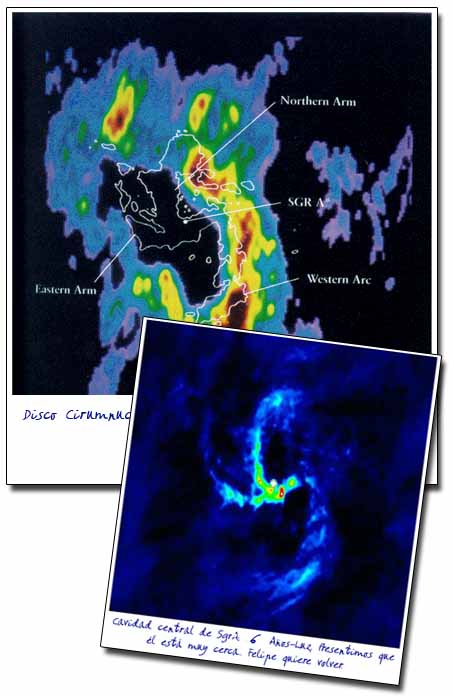

Estas líneas espectrales nos llevaron a saber de qué estaban hechas las estrellas

En física y óptica, las líneas de Fraunhofer son un conjunto de líneas espectrales nombradas en honor al físico alemán Joseph von Fraunhofer (1787-1826) que fue el primero que las estudió. Las líneas se observaron originalmente como bandas oscuras en el espectro solar.

Es un gran triunfo del ingenio humano el saber de qué, están conformadas las estrellas y qué materiales se están forjando allí, al inmenso calor de sus núcleos. Recuerdo aquí a aquel Presidente de la Real Society de Londres que, en una reunión multitudinaria, llegó a decir:

“Una cosa está clara, nunca podremos saber de qué están hechas las estrellas”.

El hombre se vistió de gloria con la (desde entonces) famosa frase. Creo que nada, con tiempo por delante, será imposible para nosotros.

La energía que llega al nivel del mar suele ser radiación infrarroja un 49 %, luz visible un 42 % y radiación ultravioleta un 9 %.

A nuestro planeta sólo llega una ínfima fracción del calor que se genera en el Sol y, sin embargo, es más que suficiente para mantener aquí la vida. El Sol tiene materia que supone la misma que tendrían 300.000 Tierras. Nuestra estrella madre está situada a una UA (150 millones de kilómetros de nosotros) y, todas esas circunstancias y otras muchas, hacen que todo sea tal como lo vemos a nuestro alrededor. Si cualquiera de esos parámetros fuera diferente o variara tan sólo unas fracciones, seguramente la Tierra sería un planeta muerto y, nosotros, no estaríamos aquí. Sin embargo… ¡Estamos! y, gracias a ello, se pueden producir descubrimientos como los que más arriba hemos relatado y han podido y pueden existir personajes de cuyas mentes surgen ideas creadoras que nos llevan a saber cómo son las cosas.

Lo cierto es que, cada día sabemos mejor como funciona la Naturaleza que, al fin y al cabo, es la que tiene todas las respuestas que necesitamos conocer.

Cerramos diciendo que, si la vida surgió en la Tierra ha sido posible gracias a la luz y al calor que nos envía el Sol. Sin las estrellas no estaríamos aquí, y, tampoco sería posible que tal maravilla esté presente en otros mundos.

Emilio Silvera Vázquez

Feb

2

Civilizaciones perdidas en la noche de los tiempos

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

Atlantis—Birthplace of Ancient Egypt

“Atlántida la‘isla de Atlas’, es el nombre de una isla mítica mencionada y descrita en los diálogos Timeo y Critias, textos del filósofo griego Platón.

En dichos diálogos, la isla aparece como una potencia militar que existió nueve mil años antes de la época del legislador ateniense Solón, quien, según Platón, es la fuente del relato. Se encontraba más allá de las Columnas de Hércules y se la describe como más grande que Libia y Asia Menor juntas.

El poderío de la Atlántida fue tal que llegó a dominar el suroeste de Europa y el norte del África, hasta ser detenida por la ciudad de Atenas. En ese mismo momento una catástrofe, que no se describe, hizo desaparecer a la vez la isla y los ejércitos rivales, «en un solo día y una noche terrible».3 El mar donde estuviera la Atlántida se tornó innavegable a causa de los bajíos, en tanto que Atenas y los pueblos de Grecia olvidaron el suceso, pues solo unos pocos sobrevivieron. En Egipto, en cambio, se preservó el recuerdo que, miles de años más tarde, llegó a conocimiento de Solón y, a partir de sus relatos y un manuscrito, a Critias, el narrador.

La descripción detallada de la isla y la mención de que se trata de una historia verdadera llevó a muchos investigadores a proponer diversas conjeturas sobre su localización y existencia. Del mismo modo, el hecho de que la fuente sea una tradición no comprobada y la evidencia de que en los diálogos se hace uso de la ironía, hizo que otros estudios considerasen a la historia como una invención literaria destinada a expresar ciertas ideas políticas de Platón.

Durante la Antigüedad y la Edad Media prevaleció la interpretación del relato como una alegoría, pero a partir de la Edad Moderna y, especialmente desde la segunda mitad del siglo XIX, durante el Romanticismo, se multiplicaron las hipótesis sobre la Atlántida, identificándola con diversas culturas del pasado o con la cuna de la civilización.”

La mítica Atlantis ha dado lugar a ríos de tinta tratando de contarnos la historia que ha ido de unos a otros desde la antigüedad. Como pasa siempre con estas cosas, la historia ha sido objeto de añadidos novelescos para hacerla más sugestiva para el público en general.

Claro que, como siempre decimos: ¡Cuando al Agua Suena!

Feb

2

¿Lo que pasó? ¿Lo que pasará? o, simple imaginación

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Astrofísica ~

Clasificado en Astrofísica ~

Comments (0)

Comments (0)

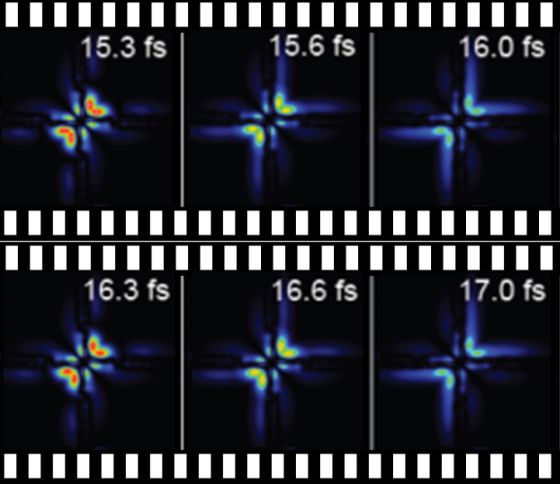

Fotograma de la película del movimiento de un par de electrones en el átomo de helio

La Causalidad fue la que hizo que el estudiante mayor y el físico se sentaran juntos, y, el suceso le cayera en gracia al Premio Nobel que le hizo la tarea.

¿Cómo podríamos resolver la estructura del Universo?

“Imaginaos ahora este instante en que los murmullos se arrastran discretamente y las espesas tinieblas llenan el navío del Universo.”

Esas palabras de Chakesperare en Enrique V (acto IV, esc. 1), nos podría valer ahora a nosotros para estrapolarlas a este tiempo y haciendo un ejercicio de imaginación, convertir esas tinieblas en la “materia oscura”, esa clase de materia que postulan los cosmólogos, que no podemos ver, que no emite radiación, que no sabemos de qué está hecha y, en realidad, tampoco sabemos donde está (sólo lo suponemos) pero, nos soluciona, de un plumazo, todos los problemas de la estructura del Universo. Esa clase de materia “transparente” que sí emite la fuerza gravitatoria podría explicar el ritmo a grandes escalas que hemos podido observar en el comportamiento de nuestro universo y que antes de la llegada de la “materia oscura”, no sabíamos, a qué era debido… “¡ahora sí lo sabemos!”. Bueno, al menos, eso dicen algunos pero, lo tienen que demostrar.

Sitios como este, en nuestro planeta, los tenemos en multitud de lugares

No pocas veces me encuentro mirando al cielo nocturno estrellado desde la orilla del Atlántico cuya superficie brilla con millones de luces titilando al reflejar el resplendor de la Luna, la inmensidad del océano que se pierde en el horizonte y, la infinitud del firmamento me podrían hacer sentir insignificante. Sin embargo, no es así como lo siento. He dicho alguna vez que todo lo grande está hecho de cosas pequeñas, y, esa afirmación, nos dá la respuesta. Formamos parte de algo muy grande: El Universo.

Estamos en un punto, o en un nivel de sabiduría aceptable pero insuficiente, es mucho el camino que nos queda por recorrer y, como dijo el sabio, la energía necesaria para explorar la décima dimensión es mil millones de veces mayor que la energía que puede producirse en nuestros mayores colisionadores de átomos. La empresa resulta difícil para seres que, como nosotros, apenas tenemos medios seguros para escapar del débil campo gravitatorio del planeta Tierra.

A veces, a solas con mis pensamientos, no puedo dejar de cabilar sobre esa idea que rige como Modelo “inamovible” al que llaman Big Bang, nos cuentan de a partir de un punto de densidad y energías “infinitas”, surgió nuestro Universo, y, en el momento del suceso, no existían ni el Espacio ni El Tiempo. El desarrollo del Modelo nos habla de energías inconmensurables y de cómo se fueron formando, a partir de las partículas elementales, otras más complejas que formaron átomos y más tarde cuerpos.

Nada puede surgir de la “nada”, si surgió, es porque había

Energías del tal calibre, que sepamos, solo han estado disponibles en el instante de la creación del Universo, en su nacimiento, en eso que llamamos Big Bang. Solamente allí estuvo presente la energía del Hiperespacio de diez dimensiones y, por eso se suele decir que, cuando se logre la teoría de cuerdas sabremos y podremos desvelar el secreto del origen del Universo.

A los físicos teóricos siempre les resultó provechoso introducir dimensiones más altas para fisgar libremente en secretos celosamente escondidos.

Según esa nueva teoría, antes del Big Bang nuestro cosmos era realmente un universo perfecto de diez dimensiones, decadimensional, un mundo en el que el viaje interdimensional era posible. Sin embargo, ese mundo decadimensional era inestable, y eventualmente se “rompió” en dos, dando lugar a dos universos separados: un universo de cuatro y otro universo de seis dimensiones.

El Universo en el que vivimos nació en ese cataclismo cósmico. Nuestro Universo tetradimensional se expandió de forma explosiva, mientras que nuestro universo gemelo hexa-dimensional se contrajo violentamente hasta que se redujo a un tamaño casi infinitesimal.

Surgió la sustancia cósmica de la que, miles de millones de años más tarde, nacería la consciencia

Eso podría explicar el origen del Big Bang, y, si la teoría es correcta, demuestra que la rápida expansión del Universo fue simple consecuencia de un cataclismo cósmico mucho mayor, la ruptura de los propios espacio y tiempo. La energía que impulsa la expansión observada del Universo se halla entonces en el colapso del espacio-tiempo de diez dimensiones. Según la teoría, las estrellas y las Galaxias distantes están alejándose de nosotras a velocidades astronómicas debido al colapso original del espacio y el tiempo de diez dimensiones.

Esta teoría predice que nuestro Universo sigue teniendo un gemelo enano, un universo compañero que se ha enrollado en una pequeña bola de seis dimensiones (en la escala de Planck) muy pequeña para ser observada.

Ese Universo decadimensional, lejos de ser un apéndice inútil de nuestro mundo, podría ser en última instancia, nuestra salvación. Claro que, si las galaxias siguen alejándose las unas de las otras, será la muerte térmica del universo, y, en ese escenario, ni los átomos se moveran.

Todo quedará quieto, congelado en los -273 ºC, la Densidad Crítica que se vislumbra nos habla de la muerte térmica del Universo

Para el cosmólogo, la única certeza es que el Universo morirá un día. Algunos creen que la muerte final del Universo llegará en la forma del big crunch. La gravitación invertirá la expansión cósmica generada por el big bang y comprimirá las estrellas y las galaxias, de nuevo, en una masa primordial. A medida que las estrellas se contraen, las temperaturas aumentan espectacularmente hasta que toda la materia y la energía del universo están concentradas en una colosal bola de plasma ardiente que será el resultado final de la destrucción del Universo tal como lo conocemos. Esta teoría parece que ha dejado de tener “creyentes” y, casi todos los expertos se decantan por la muertetérmica. Las Galaxias se alejan las unas de las otras, el universo está en continua expansión y, el frío, se apodera más y más de todo el Cosmos, así, cuando se alcancen los -273 ºC… ‘Todo se acabará!

Todas las formas de vida serán borradas de la faz de los mundo que las pudieran contener: evaporadas por las enormes temperaturas o aplastadas, ¡qué más da! No habrá escape. Y, sabiendo lo que ahora sabemos, conociendo la historia del universo mismo que, durante miles de millones de años ha estado fabricando materiales en las estrellas para que los seres vivos conscientes pudieran venir, ¿Cómo imaginar un final así? ¿Para qué tánto trabajo y tanto tiempo perdido? Seguramente, para cuando eso puede ir llegando, si es que la inteligencia sigue aquí, habrá buscado ya la manera de escapar a tal desastre y, las especies inteligentes se salvarán saltanto a otros universos, o, incluso, ¿por qué no? viajando hacia atrás en el Tiempo, hacia otras épocas de tiempos más benignas para tener otros miles de millones de años por delante y hacer las cosas, de manera diferente. ¡Una segunda oportunidad!

Bertrand Russell

Científicos y filósofos, como Charles Darwin y Bertrand Russell, han escrito lamentándose de la futilidad de nuestras míseras existencias, sabiendo que nuestra civilización morirá inexorablemente cuando llegue el fin de nuestro mundo. Las leyes de la física, aparentemente, llevan la garantía de una muerte final e irrevocable para todas las formas de vida, inteligente o no, del Universo.

Yo, como Gerald Feinberg, físico de la Universidad de Columbia (ya desaparecido), creo que sí puede haber, quizá sólo una esperanza de evitar la calamidad final. Ese atisbo de esperanza está en nosotros mismos, es decir, si somos capaces de no destruirnos antes, si procuramos comprender los mensajes que el universo nos envía continuamente, si desvelamos secretos de la Naturaleza que nos posibilitarán para hacer cosas, ahora inimaginables, entonces y solo entonces, habrá alguna esperanza.

Poder escapar a universos conexos que, como el nuestro, nos de cobijo

Gerald Feinberg especuló que la vida inteligente, llegando a dominar los misterios del espacio de más dimensiones (para lo que contaba con un poderoso aliado, el Tiempo de miles de millones de años), sabría utilizar las dimensiones extras para escapar de la catástrofe del Big Crunch. En los momentos finales del colapso de nuestro Universo, el Universo hermano se abriría de nuevo y el viaje interdimensional se haría posible mediante un túnel en el Hiperespacio hacia un Universo alternativo, evitando así la pérdida irreparable de la inteligencia de la que somos portadores.

Si algo así es posible, entonces, desde su santuario en el espacio de más dimensiones, la Humanidad, podría ser testigo de la muerte del Universo que la vio nacer y florecer.

Son muchas las cosas que no sabemos

Aunque la teoría de campos demuestra que la energía necesaria para crear estas maravillosas distorsiones del espacio y el tiempo está mucho más allá de cualquier cosa que pueda imaginar la civilización moderna, esto nos plantea dos cuestiones importantes:

¿cuánto tardaría nuestra civilización, que está creciendo exponencialmente en conocimiento y poder, en alcanzar el punto de dominar la teoría de hiperespacio?

¿Y qué sucede con otras formas de vida inteligente en el Universo, que puedan haber alcanzado ya este punto?

Lo que hace interesante esa discusión es que científicos serios han tratado de cuantificar el progreso de la civilización en un futuro lejano, cuando los viajes por el espacio sean una rutina en los sistemas estelares o incluso las galaxias vecinas hayan sido colonizadas. Aunque la escala de energía necesaria para manipular el Hiperespacio es astronómicamente grande, estos científicos señalan que el crecimiento del conocimiento científico aumentara, sin ninguna duda, de forma exponencial durante los siglos y milenios próximos, superando las capacidades de las mentes humanas para captarlo (como ocurre ahora con la teoría M, parada en seco, esperando que alguien vea las matemáticas necesarias para continuar su desarrollo).

Colaboré con el Año Internacional de la Astronomía y, por aquellos días, pude aprender muchas cosas

Somos conscientes de que el Tiempo inexorable sigue su implacable caminar y la Entropía, que sabe hacer bien su trabajo, lo transforma todo, lo que ayer era una cosa, hoy se ha convertido en otra distinsta, irreconocible, y, sin embargo, ese deterioro natural no es algo perdido, sino que, por el contrario, hasta que llega ese final, se hizo un trabajo que dará sus frutos en la mente de otros seres, en las cosas mismas que, transformadas, servirán y tendrán cometidos nuevos. Nada se pierde y todo tiene su por qué. La Naturaleza no hace nada porque sí, todo está programado y tiene un fin. Y, si eso es así (que los es), ¿que nos deparará el destino a nosotros? Habiendo llegado al nivel de cpomprensión alcanzado, no creo que el final sea el de la desaparición sin más, algo más debe estar oculto en los designios de la Naturaleza que no llegamos a comprender.

Ahora, sin temor a equivocarnos, podemos decir que tenemos en Mundo en las manos. No existen ningún rincón de la Tierra que se nos escape y con el que no podamos contactar en unos instantes. Tampoco existen aquellas largas separaciones de seres queridos en largos viajes, ni existe ningún problema para saber de alguna cosa que, incluso con imágenes podemos obtener al instante con sólo preguntar. En cuanto a los nuevos métodos de trabajo en la computación, es algo de increíblñe eficacia e impensada realidad hace sólo unos pocos años. ¿Qué decir de los nuevos materiales? La medicina ha dado un salto cualitativo gracias a los avances del CERB y el mismo LHC, los viajes espaciales ha mejorado nuestr0 confort en la vida cotidiana y del hogar…

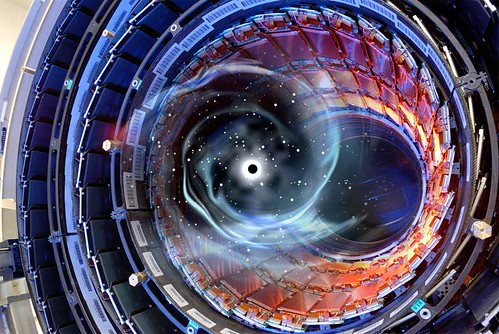

Con el LHC queremos llegar muy lejos, tanto como al corazón del Big Bang. Sin embargo, no tiene energía suficiente para ello, y, de momento, dicen haber descubierto un Pentaquark que, vaya usted a saber que es eso. De todas las maneras, hoy por hoy, es lo mejor que tenemos para profundizar en el corazón de la materia y… ¡En algún secretillo más del Universo!

Cada 10/15 años el conocimiento científico se doblará, crecerá el cien por ciento, así que, el avance superará todas las previsiones. Tecnologías que hoy solo son un sueño (la energía de fusión o en robótica, los cerebros positrónicos), serán realidad en un tiempo muy corto en el futuro. Quizá entonces podamos discutir con cierto sentido la cuestión de si podremos o no ser señores del Hiperespacio.

Viaje en el tiempo. Universos paralelos. Ventana dimensional.

¡Sueños! Claro que, si echamos una atenta mirada a la Historia veremos que, muchos sueños se hicieron realidad.

Emilio Silvera Vázquez

Feb

2

“El ser humano está detonando la sexta gran extinción”

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Entrevista, Extinciones ~

Clasificado en Entrevista, Extinciones ~

Comments (0)

Comments (0)

ENTREVISTA

Georgina Mace, catedrática de Ecología del University College de Londres

Georgina Mace entrevistada en el Diario El Mundo

Georgina Mace es una referencia mundial en el estudio de la vida. En la actualidad es Catedrática de Biodiversidad y Ecosistemas en el University College de Londres y directora del Centro para la Investigación de la Biodiversidad y el Medioambiente de esta misma institución. Pero su labor investigadora también la ha llevado a dirigir el área científica de la Sociedad Zoológica de Londres, a ser miembro de la Royal Society británica o a presidir la Sociedad para la Biología de la Conservación con sede en Washington. Además, su trabajo ha sido clave para establecer los criterios que utiliza la Unión Internacional para la Conservación de la Naturaleza (IUCN, por sus siglas en inglés) para incluir especies en su Lista Roja de especies amenazadas. Acaba de visitar Madrid para presidir el jurado del Premio Fronteras del Conocimiento en la categoría de Ecología y Biología de la Conservación de la Fundación BBVA, concedido la semana pasada al ecólogo finlandés Ilkka Hanski.

- ¿Está el planeta sufriendo su sexta gran extinción?

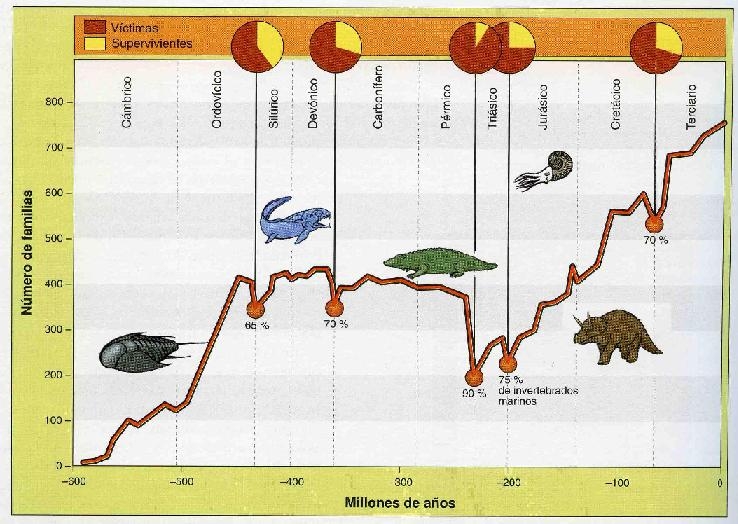

- Es una pregunta interesante. Yo creo que todas las evidencias indican que estamos a punto de la sexta gran extinción. Todas las cinco extinciones previas del pasado estuvieron causadas por el sistema terrestre o por efectos extraterrestres, pero esta que estamos viviendo está causada por nosotros, por la gente. Si miras a la tasa de extinción de especies se está acercando a lo que definimos como una extinción en masa. Si seguimos por el mismo camino que llevamos en la actualidad, entraremos definitivamente en una extinción en masa, en la sexta gran extinción, pero es una elección de las personas que vivimos en el planeta hoy en día que podamos contener o incluso revertir esa tendencia.

- ¿Todavía estamos a tiempo?

- Creo que tenemos tiempo de contener la extinción en masa. En este momento, la tasa de pérdida de biodiversidad está aumentando año a año. En mi opinión, lo que podemos hacer es mantener ese nivel actual, de modo que habría que frenar la tasa de aumento y quizá en un par de décadas podamos revertir la tendencia. Porque lo que no podemos hacer es devolver a la Tierra especies que ya se han extinguido.

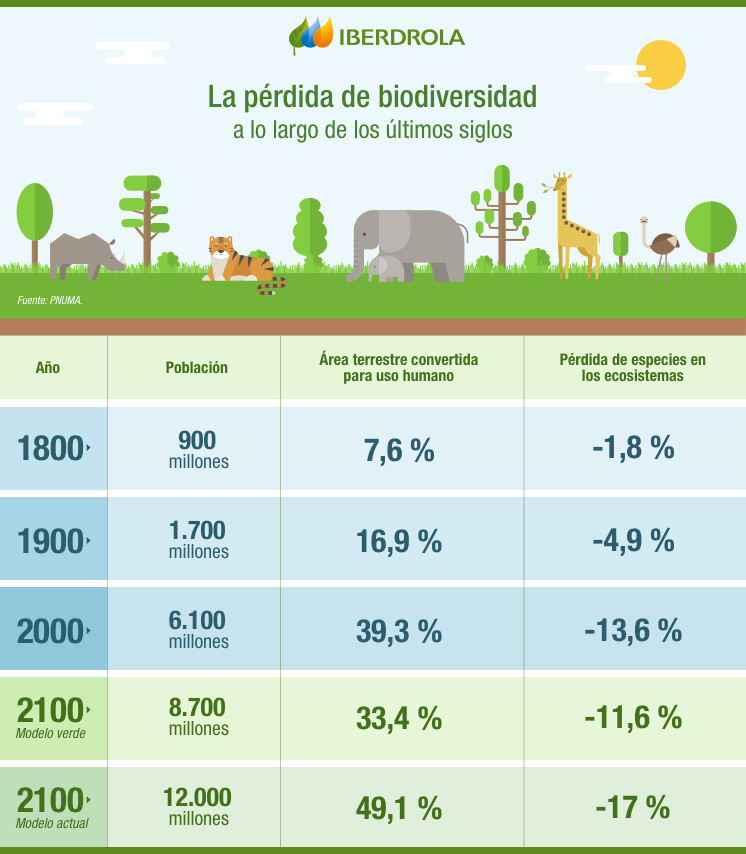

- Seremos 9.000 millones de personas en 2050. ¿Es preciso frenar la superpoblación?

- El impacto del ser humano sobre el medio ambiente es una combinación de dos cosas: el número de personas y la forma en la que viven sus vidas. Importa cuántos somos y cómo consumimos. Si miramos el equilibrio entre estas dos cosas, la vía más rápida de revertir la forma en la que la gente impacta en la Tierra es deteniendo nuestra destructiva forma de consumo. Y no es algo muy complicado de hacer. Vivimos vidas realmente derrochadoras e ineficientes desde un punto de vista medioambiental. Si somos capaces de separar la calidad de vida y un desarrollo basado en el crecimiento de nuestro impacto sobre el medio ambiente, entonces podremos mantener a más personas en la Tierra. Actuar sobre cómo vivimos nuestras vidas es para mí la primera prioridad. Por supuesto, a largo plazo también necesitamos abordar el problema del número de personas sobre la Tierra. No hay ninguna duda de que todos y cada uno de los problemas ambientales sería más sencillo de solucionar si hubiese menos gente en el planeta. Pero ese es un problema muy difícil de abordar rápidamente. Tiene que ver con las decisiones individuales, con las libertades, valores culturales,… No creo que tengamos que meternos inmediatamente con el tamaño de la población mundial, sería mejor comenzar con el consumo y con aspectos culturales muy sencillos: educar a las mujeres, luchar contra la pobreza, eliminar subsidios perversos que fomentan la destrucción de la naturaleza. Serían medidas fáciles y baratas que se podrían hacer, pero a largo plazo sí habría que reducir la tasa de crecimiento de la población de todas formas.

- Ciudades masificadas en todo el mundo

-

¿Qué pasa con los países en desarrollo que quieren vivir como los ciudadanos de EEUU o de Europa?

- Hay muy buenas evidencias de que las mejoras en nuestra calidad de la vida, como el aumento de ingresos o el acceso a la educación a un sistema de salud, han ocurrido mientras la tasa de nacimientos descendía. Así que esta transición demográfica que ha vivido Europa en los últimos 50 años está provocada por una mejora de las condiciones sociales. Abordando el problema a través de la justicia social, reducción de la pobreza o igualdad de derechos probablemente tenga un impacto a largo plazo para reducir la superpoblación.

- ¿Sería partidaria de un gran acuerdo global sobre la biodiversidad similar al que se ha alcanzado en París para frenar el cambio climático?

-

- Hay una Convención sobre la Diversidad Biológica auspiciada por las Naciones Unidas, no tiene la misma consideración que la de Cambio Climático, pero la mayoría de los países son miembros. Y tiene una serie de objetivos para la biodiversidad que deberían cumplirse por todos los países para el año 2020, como educación ambiental u otros más específicos como frenar el crecimiento de la tasa de extinción o aumentar las superficies protegidas. Creo que hay objetivos que están bien, pero desafortunadamente todo indica que no se van a lograr. Pero también tenemos los Objetivos para el Desarrollo Sostenible firmados en Nueva York en 2015, es el sustituto de los Objetivos de Milenio. Es mucho más amplio que el de la biodiversidad, aborda todo lo referente al desarrollo sostenible. Y para mi este es el trabajo más importante que tenemos por delante para los próximos cinco años, establecer ese puente entre el desarrollo y la defensa del medio ambiente.

- ¿Necesitamos objetivos vinculantes?

-

- En los últimos 20 o 30 años, desde la primera Cumbre de la Tierra de 1992, ha habido muchos intentos de hacer objetivos internacionales vinculantes, pero todos ellos se han ido a pique en la fase política. Ahora, mi impresión es que este problema se está agravando, que las posibilidades de que los políticos se vuelquen con estos objetivos vinculantes es menor hoy que en 1992. Soy más optimista con algo como lo que ha sucedido en París: un reconocimiento global de todos los países del mundo de que el cambio climático es un problema que tenemos que limitar. Eso permite comenzar procesos nacionales y movimientos en la sociedad civil para actuar.

- ¿El acuerdo de París afectará positivamente a la biodiversidad?

-

-

- Eso espero. Aunque no creo que haya sido un documento especialmente bueno para la biodiversidad. Estoy un poco preocupada por que se haya focalizado sólo en el clima y se haya olvidado del resto del medio ambiente. Y el acuerdo tiene implícita la idea de la geoingeniería, que tendrá un efecto sobre las especies. Necesitamos pensar en la biodiversidad junto con el clima.

- Se acaba de votar en el Parlamento Europeo la revisión de las directivas clave para la biodiversidad, ¿se está retrocediendo en la ambición de la UE?

- Hay dos narrativas diferentes. La primera es que la UE ha sido muy buena para la conservación de la biodiversidad, que ha puesto en marcha una batería legislativa muy potente para proteger el medio ambiente. Y yo creo que ha sido genial. Pero está habiendo un gran retroceso, en Reino Unido lo hay. Parece que la defensa del medio ambiente se ha convertido en un obstáculo para el crecimiento económico. Necesitamos ver el medio ambiente como necesario para un crecimiento justo e igualitario y no como un obstáculo. Europa es un continente muy poblado. Tenemos que encontrar nuevas formas para hacer sostenibilidad ambiental más allá de las áreas protegidas.

-

¿Sabe cuál será el coste económico que podría tener no actuar contra la pérdida de biodiversidad?

- Mucha gente lo ha intentado estimar, pero es muy difícil porque muchos de los costes son complicados de transformar en valores monetarios. Los cálculos indican que el coste de esa pérdida de biodiversidad pueden ser desde el doble hasta 100 veces lo que pagamos por ella.

-

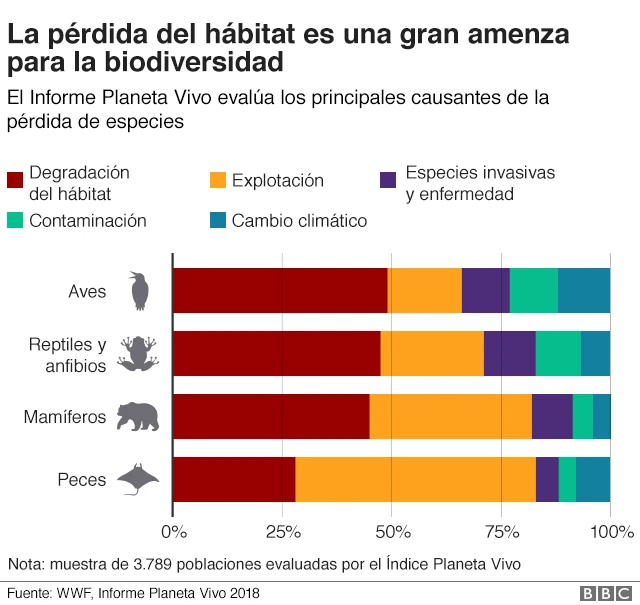

Hablamos de biodiversidad y pensamos en ballenas y tigres, pero, ¿la crisis de biodiversidad afecta a otras especies ‘invisibles’?

- ¡Claro! ¡Los polinizadores! Y toda la red de plantas e invertebrados que permiten mantener ese equilibrio entre las plagas agrícolas, vida salvaje, polinizadores… Damos eso por asegurado, pero en la actualidad ese sistema está muy perturbado. En parte porque los insecticidas también afectan a especies salvajes de plantas e insectos. La otra cosa que es muy importante y que nadie piensa en ello es la biodiversidad del suelo. Ellos son los causantes de la descomposición de la materia orgánica que aporta todo los nutrientes. Hemos añadido a los suelos tantos aditivos químicos en las últimas décadas que hemos cambiado radicalmente esa biota. Es un tema muy importante que no nos estamos tomando suficientemente en serio.

- ¿Cómo de importante es esta sexta gran extinción comparada con las previas cinco?

- Es muy importante para la gente, porque en las anteriores los seres humanos aún no existían.

- ¿Cuántas especies podrían desaparecer?

-

- Hay unas 7 millones de especies en la Tierra, la gran mayoría invertebrados y microorganismos de los cuales no se sabe demasiado. Si nos centramos en las especies en las que la gente suele pensar, los vertebrados: pájaros, mamíferos, reptiles, anfibios…, unas 60.000 especies de ellos han sido evaluadas por la IUCN por su riesgo de extinción. En esos grupos, el 10% de las cerca de 10.000 especies de aves que hay en todo el mundo está en peligro de extinción; en mamíferos, que hay unas 5.000 especies, el 25% está amenazado de extinción y en anfibios, de los que hay 5.000 especies, el 30% está en riesgo de desaparecer. El total es una cifra enorme de especies en la cuerda floja. Cuando miramos a los invertebrados, las plantas, los microorganismos… es muy difícil llegar a una estimación rigurosa. Solemos fijarnos sólo en el peligro de extinción, pero en muchas ocasiones el problema más importante es la pérdida de abundancia de estas especies. Estamos perdiendo vida salvaje mucho más rápido de lo que estamos perdiendo especies y es debido a que las estamos arrinconando en áreas cada vez más pequeñas.

Fuente: Noticias de Prensa

Totales: 87.521.274

Totales: 87.521.274 Conectados: 97

Conectados: 97