Mar

1

¿Qué será la materia?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (7)

Comments (7)

¿Estábamos muy atrasados en el conocimiento de la materia?

Bueno tenemos unas reglas que nos dicen de qué está hecha. Sin embargo, otros hablan de unas cuerdas vibrantes que serían los componentes primigenios, situados más allá de los Quarks

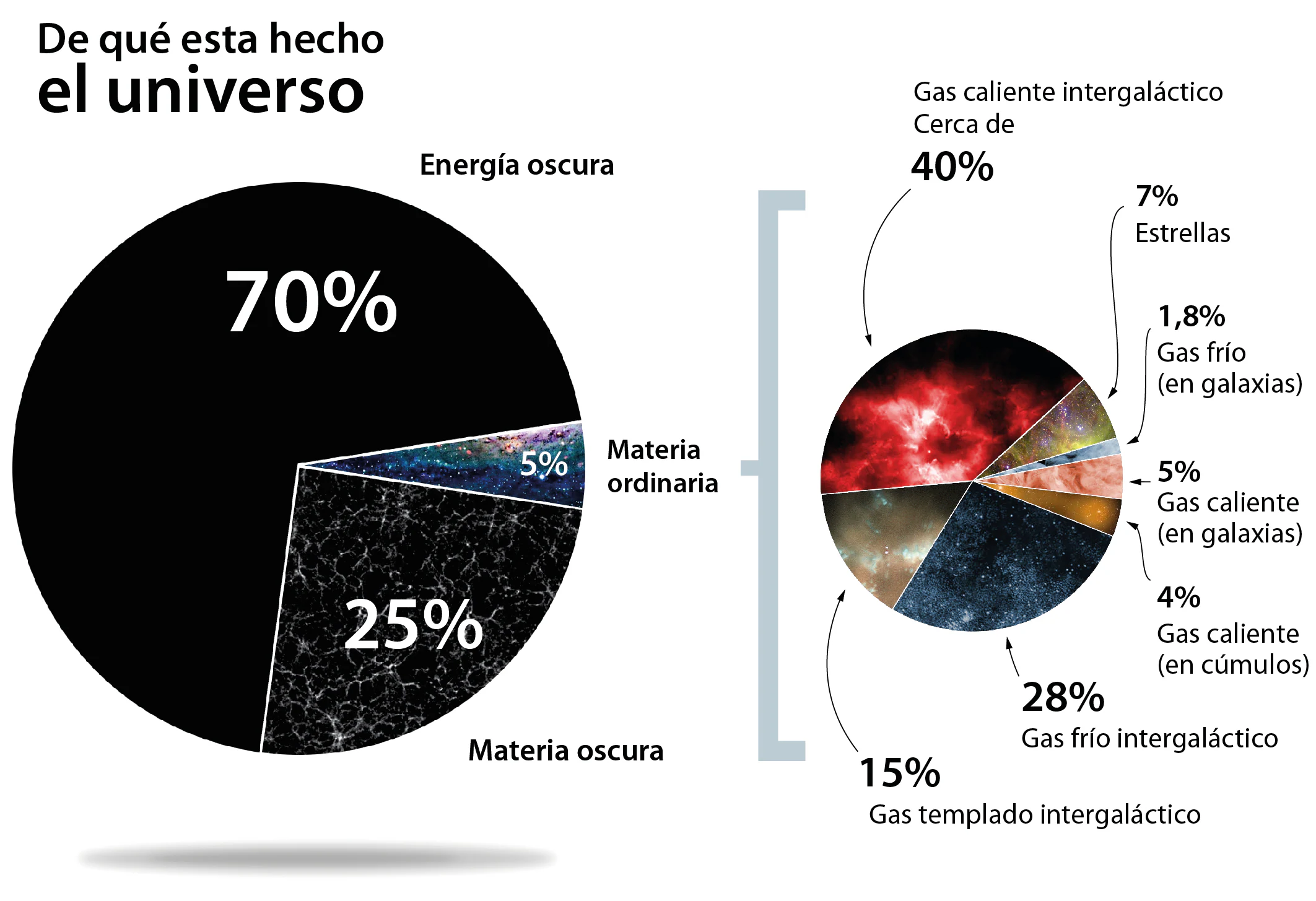

en los colegios, cuando estábamos en primaria nos decían que la materia estaba en tres estados: Sólido, Líquido y Gaseoso. No contaban con el estado más abundante de la materia en el Universo que era el Plasma.

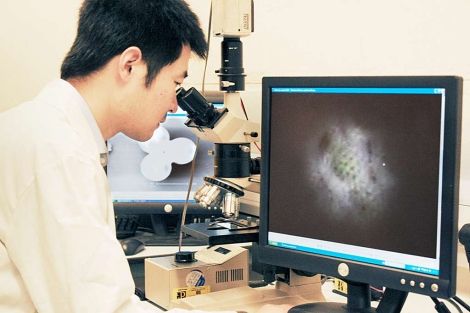

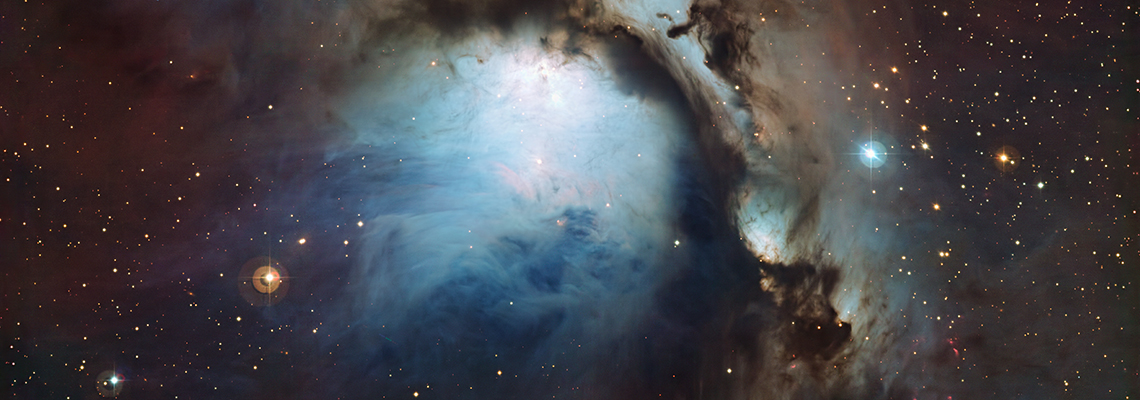

Sí, la materia conforma maravillas, la vida la mayor de ellas

No podemos dejar de asombrarnos de la presencia de la Vida en el Universo

¿Cómo pudo surgir la Vida a partir de la materia “inerte”

¿Cómo ha podido surgir la Conciencia de la materia?

Tiene y encierra tantos misterios la materia que estamos aún y años-luz de saber y conocer sobre su verdadera naturaleza. Nos podríamos preguntar miles de cosas que no sabríamos contestar. Nos maravillan y asombran fenómenos naturales que ocurren ante nuestros ojos pero que tampoco sabemos, en realidad, a que son debidos. Si, sabemos ponerles etiquetas como, por ejemplo, la fuerza nuclear débil, la fisión espontánea que tiene lugar en algunos elementos como el protactinio o el torio y, con mayor frecuencia, en los elementos que conocemos como transuránicos.

A medida que los núcleos se hacen más grandes, la probabilidad de una fisión espontánea aumenta. En los elementos más pesados de todos (einstenio, fermio y mendelevio), esto se convierte en el método más importante de ruptura, sobrepasando a la emisión de partículas alfa.

¡Parece que la materia está viva!

Son muchas las cosas que desconocemos y, nuestra curiosidad nos empuja continuamente a buscar esas respuestas.

Si se encuentran electrón y positrón… ¡Se aniquilan!

El electrón y el positrón son notables por sus pequeñas masas (sólo 1/1.836 de la del protón, el neutrón, el antiprotón o antineutrón), y, por lo tanto, han sido denominados leptones (de la voz griega lepto que significa “delgado”).

El electrón es onda y partícula

Aunque el electrón fue descubierto en 1.897 por el físico británico Josepth John Thomson (1856-1940), el problema de su estructura, si la hay, no está resuelto. Conocemos su masa y su carga negativa que responden a 9,1093897 (54)x10-31kg la primera y, 1,602 177 33 (49)x10-19 culombios, la segunda, y también su radio clásico. No se ha descubierto aún ninguna partícula que sea menos masiva que el electrón (o positrón) y que lleve una carga eléctrica, sea lo que fuese (sabemos como actúa y cómo medir sus propiedades, pero aun no sabemos qué es), tenga asociada un mínimo de masa, y que esta es la que se muestra en el electrón.

Mar

1

La perfección imperfecta

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (5)

Comments (5)

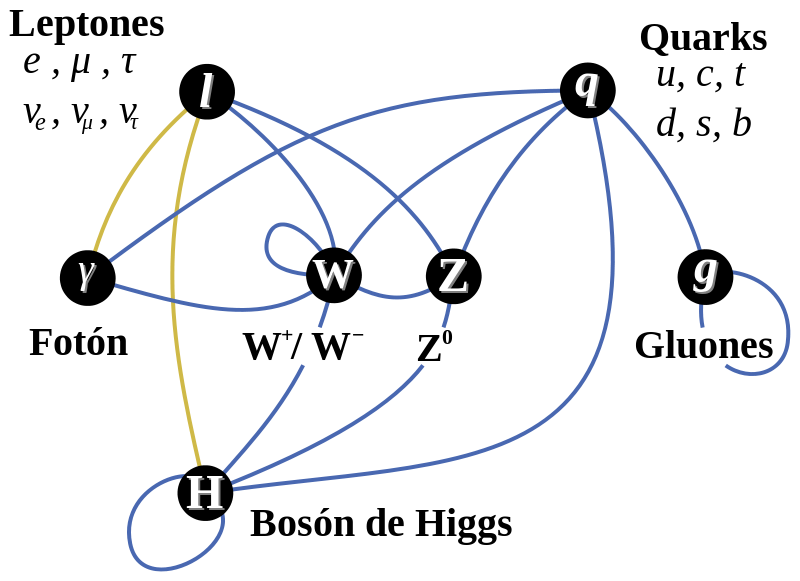

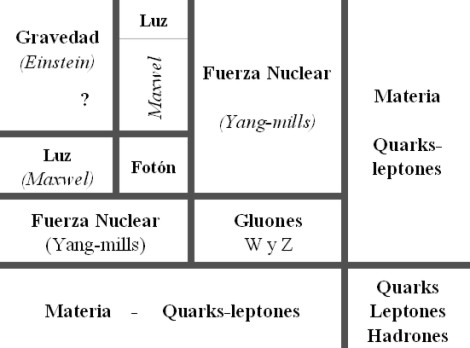

Me refiero al Modelo estándar y, algunos han llegado a creer que sólo faltan algunos detalles técnicos y, con ellos, la física teórica está acabada. Tenemos un modelo que engloba todo lo que desamos saber acerca de nuestro mundo físico. ¿Qué más podemos desear?

Bueno, lo que hasta el momento hemos logrado no está mal del todo pero, no llega, ni con mucho, a la perfección que la Naturaleza refleja y que, nosotros perseguimos sin llegar a poder agarrar sus múltiples entresijos y parámetros que conforman ese todo en el que, sin ninguna clase de excusas, todo debe encajar y, de momento, no es así.

Fuente: Prog. Part. Nucl. Phys. 106: 68-119 (2019).

Para la mayoría de los físicos el modelo estándar es una teoría efectiva: el límite a baja energía de una teoría más fundamental desconocida. El lagrangiano ℒ del modelo estándar es un operador de dimensión cuatro (ya que la acción es S = ∫ℒ d⁴x). La física más allá del modelo estándar modificará dicho lagrangiano añadiendo términos de mayor dimensión; por ejemplo, ℒ + ∑ Cᵢ ?ᵢ /Λ², donde el sumatorio recorre los 2499 operadores ?ᵢ de dimensión seis y Λ es una nueva escala de energía (que será mucho mayor que la masa del quark top). El físico John Ellis (CERN) nos recuerda que ajustar estos 2500 parámetros (los ?ᵢ y Λ) usando las colisiones del LHC y otros colisionadores es imposible. La única solución es asumir simetrías que reduzcan dicho número parámetros. En su último artículo nos propone usar las simetrías SU(3)⁵ y SU(2)²×SU(3)³. Por supuesto, hay muchas otras alternativas.

La física de partículas se suele separar en física experimental (observacional), física teórica (fundamental) y física fenomenológica; las teorías efectivas son parte de esta última, siendo su objetivo desvelar los primeros indicios (lo que inglés se llama evidences) de física más allá del modelo estándar. Hoy en día disponemos de un conocimiento en teoría cuántica de campos suficiente para desarrollar de forma sistemática todas las teorías efectivas posibles; un elemento clave a tener en cuenta son las redefiniciones de campos, una redundancia cuya eliminación nos permite obtener lo que se llama una base de operadores. Una vez obtenida podemos ajustar sus parámetros con los datos de colisiones que se recaban en los grandes colisionadores de partículas (como el LHC en el CERN).

Por desgracia, el número de parámetros de estas teorías efectivas más allá del modelo estándar es enorme. John von Neumann decía que «con cuatro parámetros puedo ajustar un elefante, y con cinco puedo lograr que mueva su trompa» [LCMF, 27 may 2010]. Ajustar muchos parámetros, incluso cuando se dispone de una vasta cantidad de observaciones, requiere lidiar con el problema estadístico de las comparaciones múltiples (que en física de partículas se suele llamar look-elsewhere effect): pueden aparecer indicios espurios (señales con más de tres sigmas de significación estadística) que solo son falsos positivos. En un espacio de 2500 parámetros es muy fácil caer en este problema; incluso cuando se usa un espacio paramétrico mucho más pequeño (por ejemplo, la extensión supersimétrica mínima del modelo estándar, el modelo MSSM, tiene 124 parámetros libres).

Nadie dijo nunca que la búsqueda de física más allá del modelo estándar fuera sencilla. Y tampoco que fuera fácil de automatizar. La intuición física (que a veces se llama «búsqueda de la belleza») juega y jugará un papel fundamental en la labor de los físicos fenomenológicos (al menos hasta que no se les pueda sustituir por futuras inteligencias artificiales). El nuevo artículo es John Ellis, «SMEFT Constraints on New Physics Beyond the Standard Model,» arXiv:2105.14942 [hep-ph] (31 May 2021), que resume los resultados de John Ellis, Maeve Madigan, …, Tevong You, «Top, Higgs, Diboson and Electroweak Fit to the Standard Model Effective Field Theory,» Journal of High Energy Physics 2021: 279 (29 Apr 2021), doi: https://doi.org/10.1007/JHEP04(2021)279, arXiv:2012.02779 [hep-ph] (04 Dec 2020). También muestro resultados del artículo de Jens Erler, Matthias Schott, «Electroweak Precision Tests of the Standard Model after the Discovery of the Higgs Boson,» Progress in Particle and Nuclear Physics 106: 68-119 (2019), doi: https://doi.org/10.1016/j.ppnp.2019.02.007, arXiv:1902.05142 [hep-ph] (13 Feb 2019).

“El número de parámetros del modelo estándar, que está basado en interacciones gauge con simetrías SU(3)×SU(2)×U(1), depende de la física de los neutrinos (ignoramos si son fermiones de Dirac o de Majorana). Si los neutrinos no tuvieran masa serían 18 parámetros (llamados electrodébiles); en esta figura se añaden dos parámetros adicionales al final que están relacionados con la cromodinámica cuántica en régimen no perturbativo. Como los neutrinos tienen masa hay que añadir sus 3 masas y los parámetros de la mezcla de sus sabores en la matriz PMNS, que serían 4 para neutrinos de Dirac y 6 para Majorana. Además, habría que añadir un parámetro relacionado con la violación de la simetría CP en la interacción fuerte (que estaría relacionado con la masa de los axiones, si estos existieran). Así el número de parámetros del modelo estándar estaría entre 25 y 28.

Es cierto que, el Modelo estándar es casi (en algunos momentos), pero no permanentemente, perfecto. En primer lugar, podríamos empezar a quejarnos de las casi veinte constantes que no se pueden calcular. Pero si esta fuese la única queja, habría poco que hacer. Desde luego, se han sugerido numerosas ideas para explicar el origen de estos números y se han propuesto varias teorías para “predecir” sus valores. El problema con todas estas teorías es que los argumentos que dan nunca llegan a ser convincentes.”

Fuente: Ciencia de la Mula Francis.

¿Por qué se iba a preocupar la Naturaleza de una fórmula mágica si en ausencia de tal fórmula no hubiera contradicciones? Lo que realmente necesitamos es algún principio fundamental nuevo, tal como el principio de la relatividad, pero nos resistimos a abandonar todos los demás principios que ya conocemos; ¡esos, después de todo, han sido enormemente útiles en el descubrimiento del Modelo estándar! una herramienta que posibilitado a todos los físicos del mundo, construir sus trabajos en ese fascinante mundo de la mecánica cuántica, donde partículas infinitesimales interactúan con las fuerzas y podemos ver, como se comporta la materia en determinadas circunstancias. El mejor lugar para buscar nuevos principios es precisamente donde se encuentran los puntos débiles de la presente teoría.

Es cierto que la materia le habla al Espacio y el espacio le habla a la materia

La regla universal en la física de partículas es que cuando las partículas chocan con energías cada vez mayores, los efectos de las colisiones están determinados por estructuras cada vez menores, más pequeñas en el espacio y en el tiempo. Supongamos por un momento que tenemos a nuestra disposición un Acelerador de Partículas 10.000 veces más potente que el LHC, donde las partículas pueden adquirir esas tantas veces más energías de las alcanzadas actualmente. Las colisiones que tendrían lugar nos dirían algo acerca de los detalles estructurales de esas partículas que ahora no conocemos, que serían mucho más pequeños que los que ahora podemos contemplar. En este punto se me ocurre la pregunta: ¿Seguiría siendo correcto el Modelo estándar? 0, por el contrario, a medida que nos alejemos en las profundidades de lo muy pequeño, también sus normas podrían variar al mismo tiempo que varían las dimensiones de los productos hallados. Recordad que, el mundo no funciona de la misma manera ante lo grande que ante lo infinitesimal.

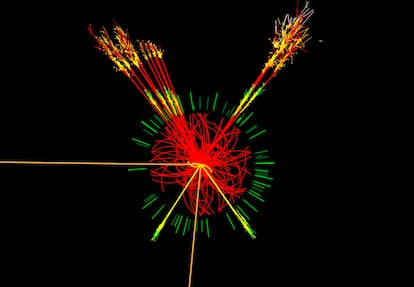

El LHC consiguió en menos de un mes el Bosón W

¿Podéis imaginar conseguir colisiones a 70.000 TeV? ¿Qué podrías ver? Y, entonces, seguramente, las protestas de algunas de que “ese monstruo” podría abrir un agujero de gusano en el espacio tiempo…¡tendría algún fundamento! No sabemos lo que puede pasar si andamos con fuerzas que no podemos dominar.

Hoy, el Modelo estándar es una construcción matemática que predice sin ambigüedad cómo debe ser el mundo de las estructuras aún más pequeñas. Pero tenemos algunas razones para sospechar que tales predicciones resultan estar muy alejadas de la realidad, o, incluso, ser completamente falsas.

Encendamos nuestro super-microscopio imaginario y enfoquémoslo directamente en el centro de un protón o de cualquier otra partícula. Veremos hordas de partículas fundamentales desnudas pululando. Vistas a través del super-microscopio, el Modelo Estándar que contiene veinte constantes naturales (o algunas más), describen las fuerzas que rigen la forma en que se mueven. Sin embargo, ahora esas fuerzas no sólo son bastante fuertes sino que también se cancelan entre ellas de una forma muy especial; están ajustadas para conspirar de tal manera que las partículas se comportan como partículas ordinarias cuando se vuelven a colocar el microscopio en la escala de ampliación ordinaria. Si en nuestras ecuaciones matemáticas cualquiera de estas constantes fueran reemplazadas por un número ligeramente diferente, la mayoría de las partículas obtendrían inmediatamente masas comparables a las gigantescas energías que son relevantes en el dominio de las muy altas energías. El hecho de que todas las partículas tengan masa que corresponden a energías mucho menores repentinamente llega a ser bastante poco natural.

Los ajustes finos del universo

“Si uno se pone a examinarlo con detalle, resulta que el universo está maravillosamente ajustado para poder permitir la vida. A esto se le llama el problema del fine tuning o ajuste fino del universo. Normalmente, por ajuste fino se suele entender el hecho de que los valores de ciertas constantes, de ser ligeramente modificados, incluso muy ligeramente modificados, tendrían como resultado que la vida compleja como nosotros sería imposible.

Hugh Ross

Quizá el ejemplo más claro sea el de los valores de las fuerzas fundamentales (gravitatoria, nuclear débil, nuclear fuerte y electromagnética). Según Hugh Ross, una fuerza gravitatoria un poco más débil impediría estrellas como nuestro Sol; todas las estrellas que podrían formarse serían bastante más masivas y consumirían su combustible muchísimo antes de que la vida compleja pudiera emerger. Por otro lado, una fuerza de la gravedad más intensa no permitiría estrellas como el Sol, todas las estrellas serían muy ligeras e incapaces de sintetizar los elementos más pesados que la vida necesita. La fuerza nuclear fuerte también está increíblemente bien ajustada: un poco más fuerte y todo el hidrógeno se habría consumido al principio del universo, impidiendo la formación de estrellas con una vida larga; un poco más débil y muchos de los elementos químicos actuales serían radiactivos, con evidentes consecuencias negativas para la vida. Pueden encontrarse más ejemplos en la página de Wikipedia sobre el problema del ajuste fino (donde he sacado mucha información). El astrofísico Martin Rees, en su libro Solo seis números, determinó que en esencia eran 6 los parámetros (constantes universales o combinación de ellas) que si hubiesen variado siquiera un mínimo habrían impedido la vida:

–

, la relación entre la fuerza electromagnética y la gravitatoria. Además de los problemas asociados con la evolución estelar ya mencionados, si N fuera más pequeña, el universo se hubiera expandido y re-contraído muy rápidamente, sin permitir la formación de entidades complejas.

–

, mide la eficiencia del hidrógeno para convertirse en helio en las reacciones nucleares en las estrellas. Cuatro átomos de hidrógeno se convierten en uno de helio y se libera un 0.7 % de energía. Si

fuera 0.006 (una variación de una parte en diez mil) solo existiría el hidrógeno, con lo que toda química mínimamente compleja sería imposible. Por encima de un valor de 0.008 no existiría hidrógeno ya que la reacción sería «demasiado eficiente» y se habría fusionado todo poco después del Big Bang (con respecto a este valor de 0.008 hay que decir que hay autores que consideran que la horquilla es un poco más amplia).

no es una constante fundamental del universo, viene determinada por el valor de la fuerza nuclear fuerte (la que mantiene ligados a los protones y neutrones, es decir, a los quarks en el interior de los átomos).

–

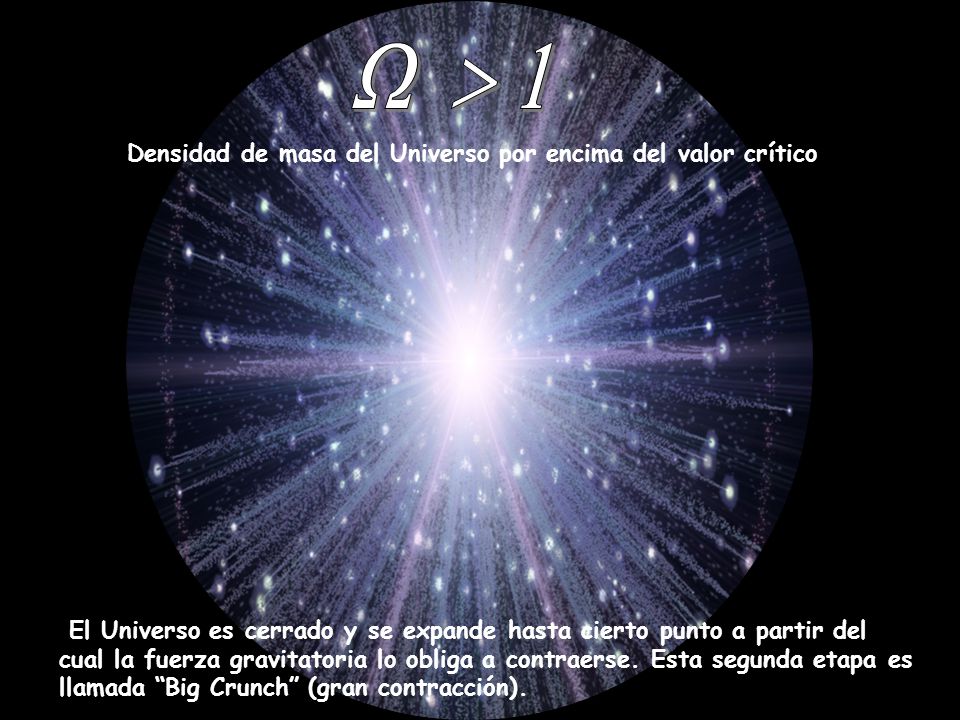

. La letra griega omega indica la densidad del universo. Es el cociente entre la fuerza de contracción (la gravedad) y la energía de expansión. Con una

el universo se habría contraído rápidamente sobre sí mismo, volviendo a un estado similar al del Big Bang; con una

la gravedad es tan débil que no se forman estrellas. El valor medido está increíblemente próximo a 1, es decir, a la planitud.

–

.

mide el valor de la constante cosmológica (la energía que hay en el vacío) dividida por la densidad crítica del universo (la

de antes, que en su valor crítico es 1). En unidades naturales (las llamadas unidades de Planck) la constante cosmológica tiene un valor increíblemente pequeño, de modo tal que la expansión del universo es irrelevante para las escalas habituales en las que vivimos (no vemos que en nuestro mundo los objetos estén cada día más lejos de donde los dejamos la noche anterior). Con un valor no tan pequeño, las estrellas no podrían formarse. Curioso: si seguimos la teoría cuántica de campos, obtenemos para la energía del vacío un valor 120 órdenes de magnitud (

) más alto que lo que medimos para la constante cosmológica; si esto fuera así no habría estrellas y el universo se estaría expandiendo a una velocidad alucinante (de hecho, no estaríamos aquí para observarlo); a esto se le llama el problema de los 120 órdenes de magnitud y se ha dicho que es la peor predicción de la historia de la Física.

–

, Rees introdujo este poco conocido parámetro para estimar cuánta energía habría que usar para disociar por completo una galaxia utilizando su masa como energía (

). Más pequeño indicaría que no se podrían formar estrellas, más grande y el universo sería demasiado violento como para poder sobrevivir en él.

–

. El número de dimensiones espaciales es, como todos sabemos, de 3. Con más o menos dimensiones la vida no podría existir; entre otros argumentos, las órbitas de los planetas, por ejemplo, solo son estables en 3 dimensiones, de lo contrario los planetas acabarían colapsando sobre las estrellas. (Esto no excluye las dimensiones microscópicas que postulan algunas teorías como la teoría de cuerdas).

Este maravilloso ajuste del universo es un problema bastante complejo de resolver. Por un lado, uno puede apelar a la presencia de un Ser Superior que ha favorecido la vida. Desde una perspectiva más secular, algunos apelan al multiverso, esto es, una infinidad de universos de entre los cuales la vida solo es capaz de prosperar en unos pocos. En esta línea va el pensamiento que se conoce como Principio Antrópico, que viene a decir algo así como que el universo es como es porque si fuera de otra manera no tendría observadores para preguntarse por qué es como es. Este razonamiento circular, tautológico, no gusta a casi nadie, y con razón. Algunos científicos, como David Deutsch, creen que existe una explicación, aunque nosotros no podemos ni imaginarla ahora mismo. Otros son algo más escépticos.”

La doble hélice, es una especie de cuerda de dos hilos enredados uno alrededor del otro, ambos constituidos por 4 moléculas llamadas: adenina (A), timina (T), guanina (G) y citosina (C). Sin el ajuste fino no podría ser posible.

¿Implica el ajuste fino un diseño con propósito? Hay tantos parámetros que deben tener un ajuste fino y el grado de ajuste fino es tan alto, que no parece posible ninguna otra conclusión.

Bueno, quizá en la imagen y el comentario que lleva abajo, me he podido pasar un poco. Lo que antes decía: “El hecho de que todas las partículas tengan masa que corresponden a energías mucho menores repentinamente llega a ser bastante poco natural”, es lo que se llama el “problema del ajuste fino”. Vistas a través del microscopio, las constantes de la Naturaleza parecen estar cuidadosamente ajustadas sin ninguna otra razón aparente que hacer que las partículas parezcan lo que son. Hay algo muy erróneo aquí. Desde un punto de vista matemático, no hay nada que objetar, pero la credibilidad del Modelo estándar se desploma cuando se mira a escalas de tiempo y longitud extremadamente pequeñas o, lo que es lo mismo, si calculamos lo que pasaría cuando las partículas colisionan con energías extremadamente altas.

¿Y por qué debería ser el modelo válido hasta ahí? Podrían existir muchas clases de partículas súper pesadas que no han nacido porque se necesitan energías aún inalcanzables, e ellas podrían modificar completamente el mundo que Gulliver planeaba visitar. Si deseamos evitar la necesidad de un delicado ajuste fino de las constantes de la Naturaleza, creamos un nuevo problema:

Tres tipo de Ajuste Fino para la vida

La evidencia para el ajuste fino del universo es de tres tipos:

- El ajuste fino de las leyes de la naturaleza.

- El ajuste fino de las constantes físicas.

- El ajuste fino de la distribución inicial de la masa-energía del universo en el momento del Big Bang.

El Ajuste Fino de las Leyes de la Naturaleza

Cuando hablamos sobre el ajuste fino de las leyes de la naturaleza queremos decir que el universo debe tener precisamente el conjunto adecuado de leyes con el fin de que exista vida altamente compleja.

Ejemplos:

- Existencia de la Gravedad.

- Existencia de la Fuerza Electromagnética.

- Existencia de la Fuerza Nuclear Fuerte.

- Existencia del Principio de Cuantificación.

- Existencia del Principio de Exclusión de Pauli.

El Ajuste Fino de las constantes físicas

Por las constantes físicas, nos referimos a los números fundamentales que se producen en las leyes de la física, los cuales muchos de éstos deben estar ajustados con precisión en un grado extraordinario para que la vida se produzca.

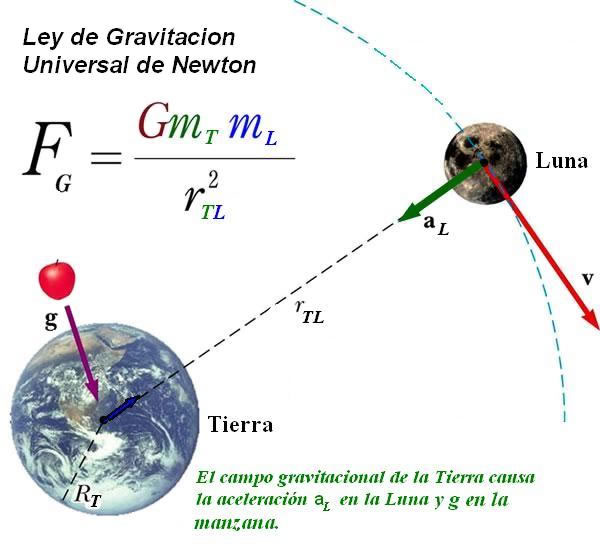

Por ejemplo, tomemos la Constante Gravitacional —designado por G— la cual determina la fuerza de la gravedad a través de la Ley de la Gravedad de Newton:

Donde F es la fuerza entre dos masas, m1 y m2, que están a una distancia r de diferencia. Si aumentas o disminuyes G entonces la fuerza de la gravedad correspondientemente aumentará o disminuirá. (El valor real de G es 6,67 x 10-11 Nm2 / kg2.)

Ahora, para darnos una idea de qué tan finamente ajustada es la fuerza de la gravedad indicada por G debemos primero mirar el rango de las fuerzas fundamentales en la naturaleza:

Observa que la Fuerza Nuclear Fuerte es de 10 000 sextillones[1] de veces la Fuerza de la Gravedad. ¿Demasiado complicado? Bien, hagamos esto más digerible. Imagina que tienes una regla lo suficientemente grande para extenderla a través de todo el universo, ahora colocaremos los puntos en donde se localizarían la Fuerza de Gravedad y la Fuerza Nuclear Fuerte. Tendríamos algo así:

Retomemos el hilo que veo pasar una mosca y la sigo, la sigo, la sigo hasta no saber donde estoy.

¿Cómo podemos modificar el Modelo Estándar de tal manera que el ajuste-fino no sea necesario? Está claro que las modificaciones son necesarias , lo que implica que muy probablemente hay un límite más allá del cual el modelo deja de ser válido. El Modelo Estándar no será más que una aproximación matemática que hemos sido capaces de crear, tal que todos los fenómenos observados hasta el presente están de acuerdo con él, pero cada vez que ponemos en marcha un aparato más poderoso, debemos esperar que sean necesarias nuevas modificaciones para ir ajustando el modelo, a la realidad que descubrimos.

El hallazgo de una partícula que crearía nueva Física

¿Cómo hemos podido pensar de otra manera? ¿Cómo hemos tenido la “arrogancia” de pensar que podemos tener la teoría “definitiva”? Mirando las cosas de esta manera, nuestro problema ahora puede muy bien ser el opuesto al que plantea la pregunta de dónde acaba el modelo estándar: ¿Cómo puede ser que el modelo estándar funcione tan extraordinariamente bien? y ¿por qué aún no hemos sido capaces de percibir nada parecido a otra generación de partículas y fuerzas que no encajen en el modelo estándar?

Asistentes escuchan la presentación de los resultados del experimento ATLAS, durante el seminario del Centro Europeo de Física de Partículas (CERN) para presentar los resultados de los dos experimentos paralelos que buscan la prueba de la existencia de la “partícula de Higgs”, base del modelo estándar de física, hoy miércoles 4 de julio en Meyrin, Suiza.

La pregunta “¿Qué hay más allá del Modelo estándar”? ha estado fascinando a los físicos durante años. Y, desde luego, todos sueñan con llegar a saber, qué es lo que realmente es lo que conforma el “mundo” de la materia, qué partículas, cuerdas o briznas vibrantes. En realidad, lo cierto es que, la Física que conocemos no tiene que ser, necesariamente, la verdadera física que conforma el mundo y, sí, la física que conforma “nuestro mundo”, es decir, el mundo al que hemos podido tener acceso hasta el momento y que, no necesariamente tiene que tratarse del mundo real.

O, como decía aquél: ¡Que mundo más hermoso, parece de verdad!

No todo lo que vemos es, necesariamente, un reflejo de la realidad de la Naturaleza que, puede tener escondidos más allá de nuestras percepciones, otros escenarios y otros objetos, a los que, por ahora, no hemos podido acceder, toda vez que, físicamente tenemos carencias, intelectualmente también, y, nuestros conocimientos avanzar despacio para conseguir, nuevas máquinas y tecnologías nuevas que nos posibiliten “ver” lo que ahora nos está “prohibido” y, para ello, como ocurre siempre, necesitamos energías de las que no disponemos.

Hay dos direcciones a lo largo de las cuales se podría extender el Modelo estándar, tal como lo conocemos actualmente, que básicamente se caracterizan así:

– Nuevas partículas raras y nuevas fuerzas extremadamente débiles, y

– nuevas partículas pesadas y nuevas estructuras a muy altas energías.

Podrían existir partículas muy difíciles de producir y de detectar y que, por esa razón, hayan pasado desapercibidas hasta ahora. La primera partícula adicional en la que podríamos pensares un neutrino rotando a derecha. Recordaremos que si se toma el eje de rotación paralelo a la dirección del movimiento los neutrinos sólo rotan a izquierdas pero, esa sería otra historia.

En un artículo editado en Ciencia Kanija, pude leer:

“Los interferómetros atómicos tienen ahora la sensibilidad para observar nuevas fuerzas más allá del modelo estándar de la física de partículas. “Las nuevas fuerzas a corta distancia son una predicción frecuente de las teorías más allá del Modelo Estándar y la búsqueda de estas nuevas fuerzas es un canal prometedor para descubrir una nueva física”, dice Jay Wackerdel Laboratorio del Acelerador Nacional SLAC en California. La pregunta es cómo encontrarlas”

Los neutrinos siempre me han fascinado. Siempre se han manifestado como si tuvieran masa estrictamente nula. Parece como si se movieran exactamente con la velocidad de la luz. Pero hay un límite para la precisión de nuestras medidas. Si los neutrinos fueran muy ligeros, por ejemplo, una cienmillonésima parte de la masa del electrón, seríamos incapaces de detectar en el laboratorio la diferencia entre éstos y los neutrinos de masa estrictamente nula. Pero, para ello, el neutrino tendría que tener una componente de derechas.

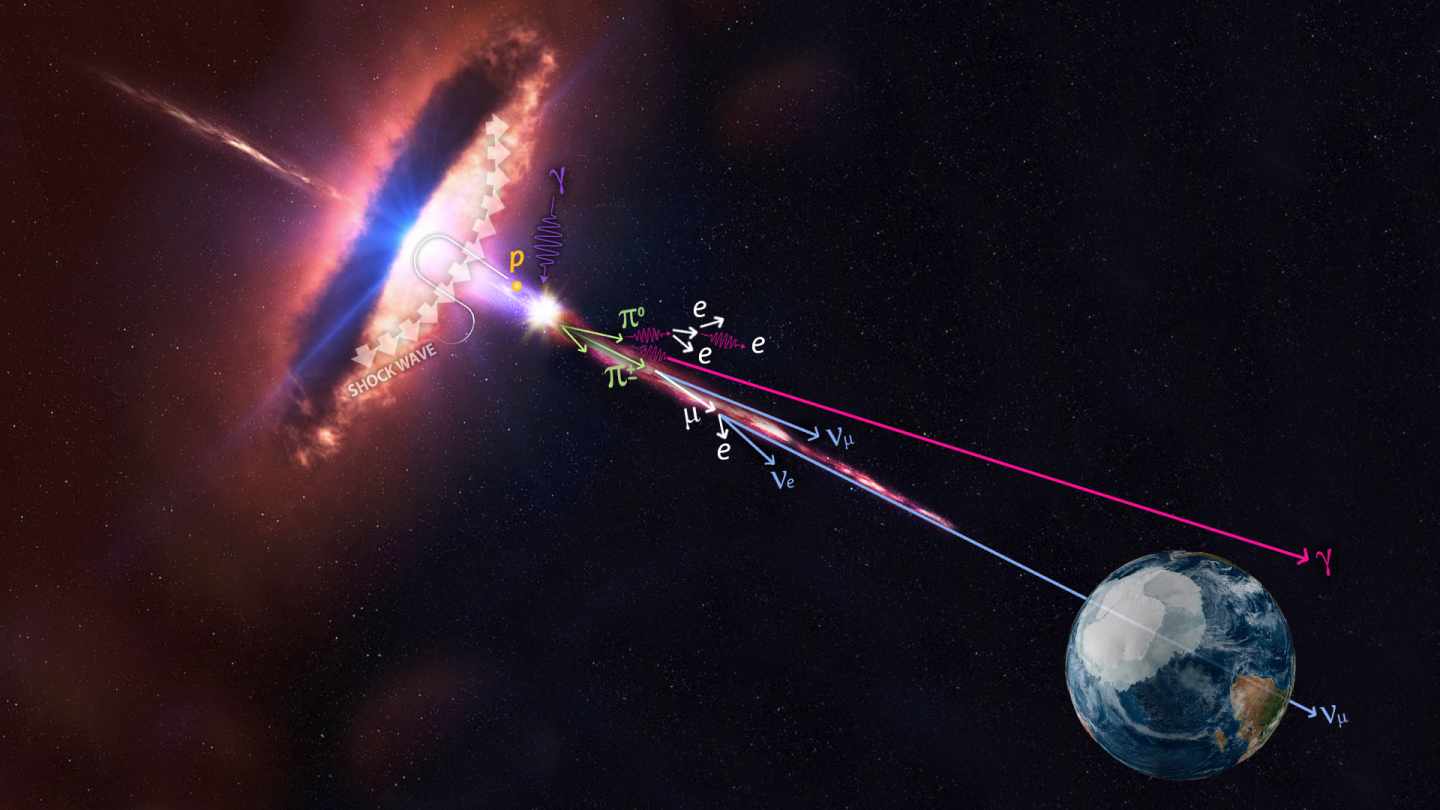

En este punto, los astrónomos se unen a la discusión. No es la primera vez, ni será la última, que la astronomía nos proporciona información esencial en relación a las partículas elementales. Por ejemplo, debido a las interacciones de corriente neutra (las interacciones débiles originadas por un intercambio Zº), los neutrinos son un facto crucial en la explosión supernova de una estrella. Ahora sabemos que debido a las interacciones por corriente neutra, pueden colisionar con las capas exteriores de la estrella y volarlas con una fuerza tremenda.

En realidad, los neutrinos nos tienen mucho que decir, todavía y, no lo sabemos todo acerca de ellos, sino que, al contrario, son muchos los datos y fenómenos que están y subyacen en ellos de los que no tenemos ni la menor idea que existan o se puedan producir. Nuestra ignorancia es grande, y, sin embargo, no nos arredra hablar y hablar de cuestiones que, la mayoría de las veces…ni comprendemos.

Aquí lo dejaré por hoy, el tema es largo y de una fascinación que te puede llevar a lugares en los que no habías pensado al comenzar a escribir, lugares maravillosos donde reinan objetos exóticos y de fascinante porte que, por su pequeñez, pueden vivir en “mundos” muy diferentes al nuestro en los que, ocurren cosas que, nos llevan hacia el asombro y también, a ese mundo mágico de lo fascinante y maravilloso.

¡Cuanta complejidad para que nuestra limitada capacidad intelectual la pueda desmenuzar! Pero, se hace lo que se puede.

Emilio Silvera Vázquez

Feb

28

¿Entenderemos alguna vez la Gravedad?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Astronomía y Astrofísica ~

Clasificado en Astronomía y Astrofísica ~

Comments (1)

Comments (1)

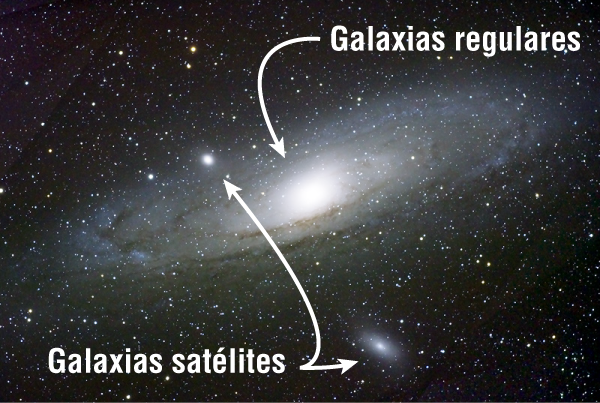

Dos nuevos estudios realizados por investigadores de Australia, Austria y Alemania han puesto en entredicho la forma en la que entendemos la física de la gravedad. Los descubrimientos, publicados en las revistas Astrophysical Journal y Monthly Notices of the Royal Astronomical Society, se basan en observaciones de galaxias enanas satélite o galaxias más pequeñas que se encuentran en el extrarradio de la gran galaxia espiral que es la Vía Láctea.

Instituto de Astronomía Argelander de la Universidad de Bonn (Alemania)

La Ley de la gravitación universal de Newton, publicada en 1687, sirve para explicar cómo actúa la gravedad en la Tierra, por ejemplo por qué cae una manzana de un árbol. El profesor Pavel Kroupa del Instituto de Astronomía Argelander de la Universidad de Bonn (Alemania) explicó que «a pesar de que su ley describe los efectos cotidianos de la gravedad en la Tierra, las cosas que podemos ver y medir, cabe la posibilidad de que no hayamos sido capaces de comprender en absoluto las leyes físicas que rigen realmente la fuerza de la gravedad».

La ley de Newton ha sido puesta en entredicho por distintos cosmólogos modernos, los cuales han redactado teorías contradictorias sobre la gravitación que intentan explicar la gran cantidad de discrepancias que se dan entre las mediciones reales de los sucesos astronómicos y las predicciones basadas en los modelos teóricos. La idea de que la «materia oscura» pueda ser la responsable de estas discrepancias ha ganado muchos adeptos durante los últimos años. No obstante, no existen pruebas concluyentes de su existencia.

En esta investigación, el profesor Kroupa y varios colegas examinaron «galaxias enanas satélite», cientos de las cuales deberían existir en la cercanía de las principales galaxias, incluida la Vía Láctea, según indican los modelos teóricos. Se cree que algunas de estas galaxias menores contienen tan sólo unos pocos millares de estrellas (se estima que la Vía Láctea, por ejemplo, contiene más de 200.000 millones de estrellas).

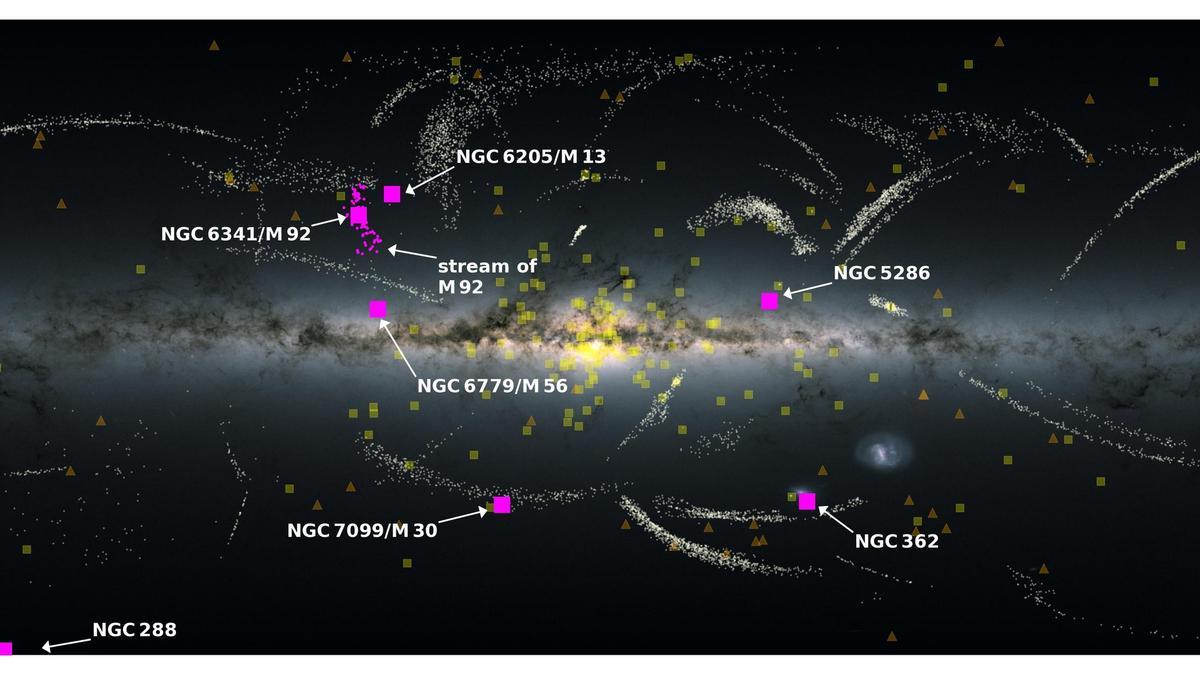

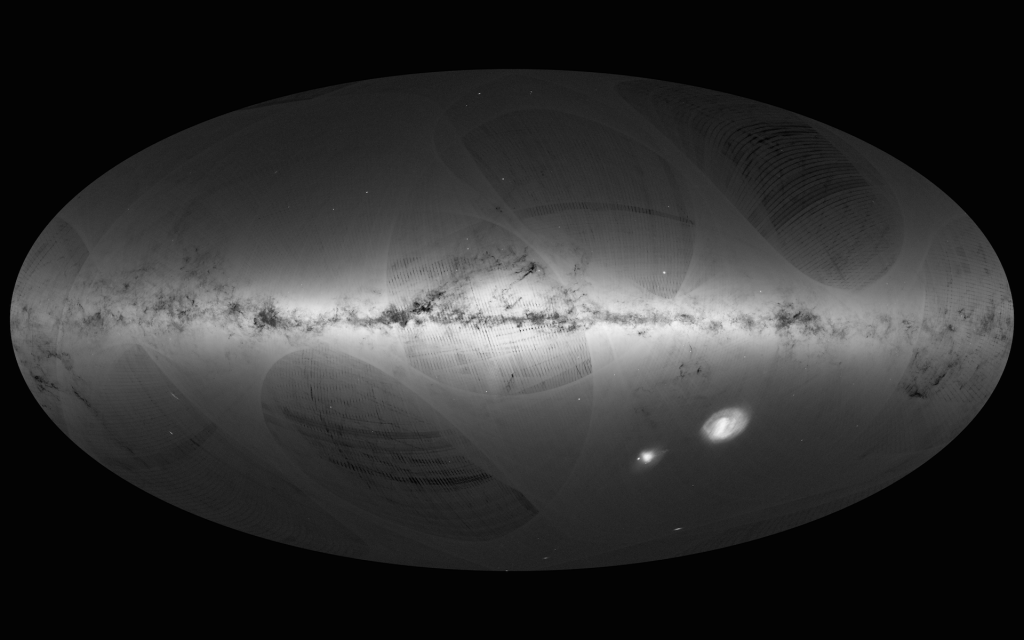

Imagen destacada: Este maravilloso mapa fue creado con el primer año de datos del telescopio Gaia. Abajo a la derecha, se pueden ver las galaxias enanas más grandes de la Vía Láctea, la Grande y la Pequeña nube de Magallanes. ¡Si miras de cerca, podrás encontrar las 11 enanas originales! Para más información sobre la imagen, entra aquí. Crédito: ESA/Gaia/DPAC.

“Nuestra galaxia de origen, la Vía Láctea, está rodeada por pequeñas galaxias «enanas». Los astrónomos están obsesionados con contar cuántas existen. ¿Por qué? En los años 1990, nos dimos cuenta que la visión prevaleciente de nuestro universo, como un compuesto principalmente de energía oscura y materia oscura, llamado LCDM para abreviar, predice que la Vía Láctea debería estar rodeada por una vasta horda de al menos cien galaxias enanas. Pero, perplejamente, vimos solo 11 galaxias enanas. Esta gran discrepancia ha alimentado mucha consternación y muchos artículos, y ha sido llamada el gran problema de las satélites faltantes.”

No obstante, a día de hoy sólo se ha logrado detectar treinta de estas galaxias alrededor de la Vía Láctea. Esta situación se atribuye al hecho de que, al contener tan pocas estrellas, su luz es demasiado débil como para que podamos observarlas desde una distancia tan lejana. Lo cierto es que este estudio tan detallado ha deparado resultados sorprendentes.

«En primer lugar, hay algo extraño en su distribución», indicó el profesor Kroupa. «Estas galaxias satélite deberían estar distribuidas uniformemente alrededor de su galaxia madre, pero no es el caso.»

Los investigadores descubrieron que la totalidad de los satélites clásicos de la Vía Láctea (las once galaxias enanas más brillantes) están situados prácticamente en un mismo plano que dibuja una especie de disco. También observaron que la mayoría de estas once galaxias rotan en la misma dirección en su movimiento circular alrededor de la Vía Láctea, de forma muy similar a como lo hacen los planetas alrededor del Sol.

Feb

26

Multitud de títulos

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (1)

Comments (1)

La complejidad del Cerebro…Los caminos de la Mente

¿Pueden llegarnos mensajes del futuro?

¿Los Agujeros Negros se evaporan?

Acercarse a la velocidad de la luz… trae consecuencias

¿Qué es un bosón? y ¿Qué es un bosón gauge?

Entradas anteriores

omos parte del Universo ¡La que piensa!

Nuestro lugar en el Universo…¿Cuál será?

De entradas como estas hemos publicado 11,520, que han sido comentadas por 19.845 visitantes, las visitas al día de hoy llegan a los 73.819,745, no puedo saber si aguantará hasta los 100 millones de visitas, recuerdo con nostalgia el comienzo y la ilusión que me hicieron aquellas primeras cien mil visitas.

Seguiremos aquí echándole horas al trabajo para que ustedes lo pasen bien.

De como llegamos hasta los Quarks

| ¿Cuánta materia vemos? |

Esto es… Despacharse a su gusto

La Inmensidad del Universo y, la “pequeñez” de los seres…

¡Estamos aquí de prestado? ¿Es la vida un accidente?

¿Es el l Tiempo el que pasa? ¿O somos nosotros?

“Pasado” “Presente” “Futuro” ¿Una ilusión llamada Tiempo?

El divagar de la mente, repasando pensamientos

Trato de ofrecer una variedad de temas que mantenga en vilo al lector visitante, pensando que se encontrará mañana.

Emilio Silvera Vázquez

Feb

26

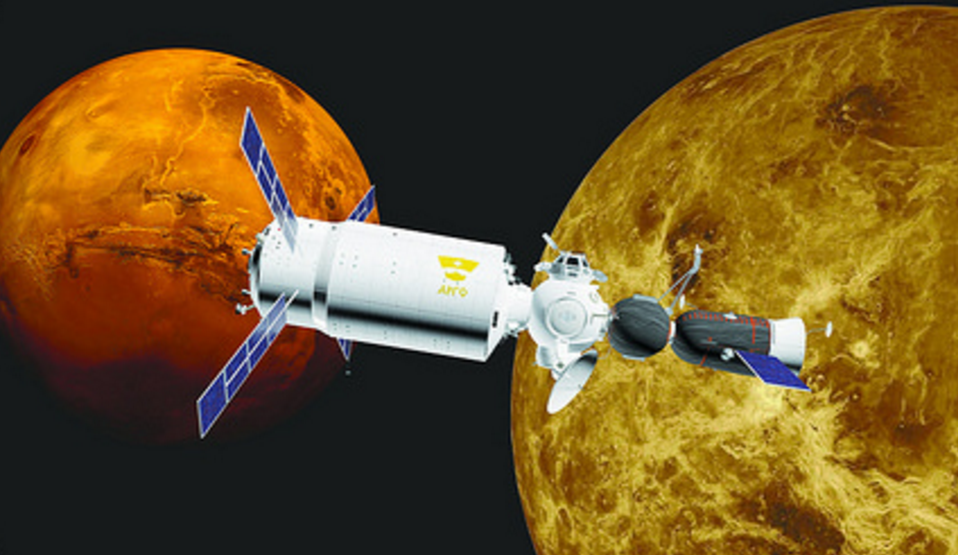

VIAJE A MARTE Los humanos que viajen a Marte pueden sufrir demencia...

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en el futuro ~

Clasificado en el futuro ~

Comments (0)

Comments (0)

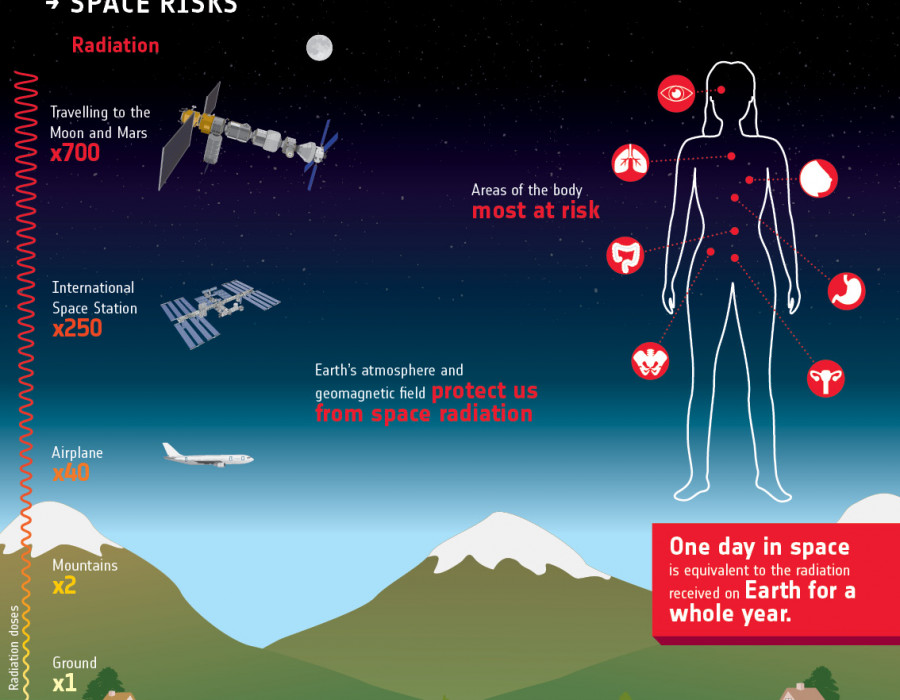

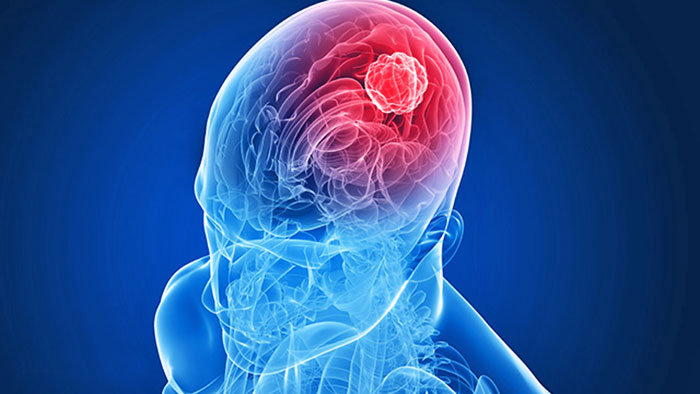

El cerebro puede verse afectado por la exposición continua a los rayos cósmicos y quizás ni siquiera recordar el viaje

:format(jpg)/f.elconfidencial.com%2Foriginal%2F9d6%2F399%2F230%2F9d6399230168a3a6006591223f18fe1b.jpg)

Recreación artística de una futura colonia en Marte – Archivo

Viajar a Marte, un reto que la NASA se prepara para conseguir a partir de 2030 y que también persiguen algunas empresas privadas, se convertirá en la hazaña del milenio, pero la gran aventura está plagada de peligros, entre ellos los que supone estar sometido a las altísimas dosis de radiación de partículas provenientes del espacio durante el trayecto. Un estudio publicado en la revista Science en 2013 decía que la exposición acumulada, para un astronauta con billete de ida y vuelta, sin contar la estancia más o menos prolongada en el Planeta rojo, equivale a hacerse 33.000 radiografías. Ahora, investigadores de la Universidad de California Irvine (UCI) se han interesado por lo que supondría esa radiación para el cerebro humano y sus conclusiones elevan aún más la alarma. Los astronautas que viajen a Marte podrían sufrir demencia crónica. Quizás, a su regreso, ni se acordarían del viaje.

La medicina espacial es una práctica médica en desarrollo que estudia la salud de los astronautas viviendo en el espacio exterior. El propósito principal de esta búsqueda académica es descubrir qué tan bien y por cuánto tiempo pueden sobrevivir las personas en las condiciones extremas del espacio, y qué tan rápido pueden re-adaptarse al ambiente terrestre a su regreso. La medicina espacial también busca desarrollar medicina preventiva para apaciguar el sufrimiento causado al vivir en un ambiente para el que los seres humanos no se encuentran bien adaptados.

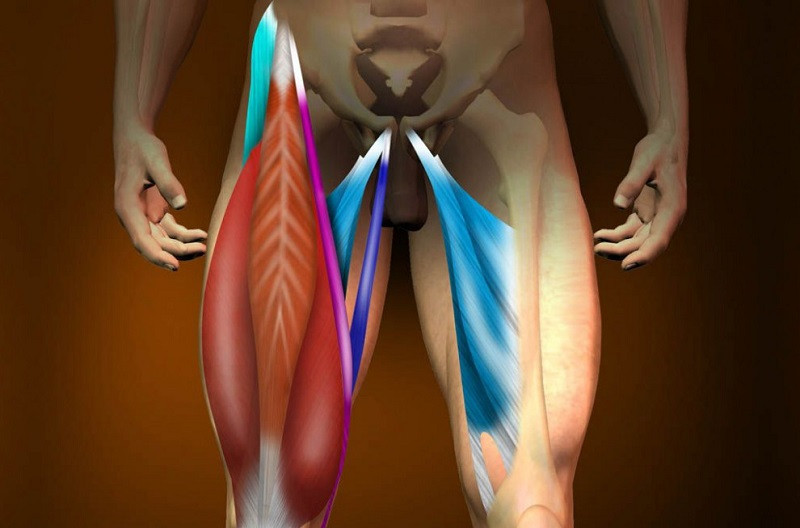

Por supuesto, no es posible eliminar todas las amenazas; el factor más importante que afecta el bienestar físico humano es la ingravidez, que también se define como microgravedad. Vivir en este tipo de ambiente impacta el cuerpo en tres maneras diferentes: pérdida de la propiocepción, cambios en la distribución de los fluidos, y el deterioro del sistema muscular.

La ESA estudia a fondo el impacto de la radiación en los viajeros del Espacio

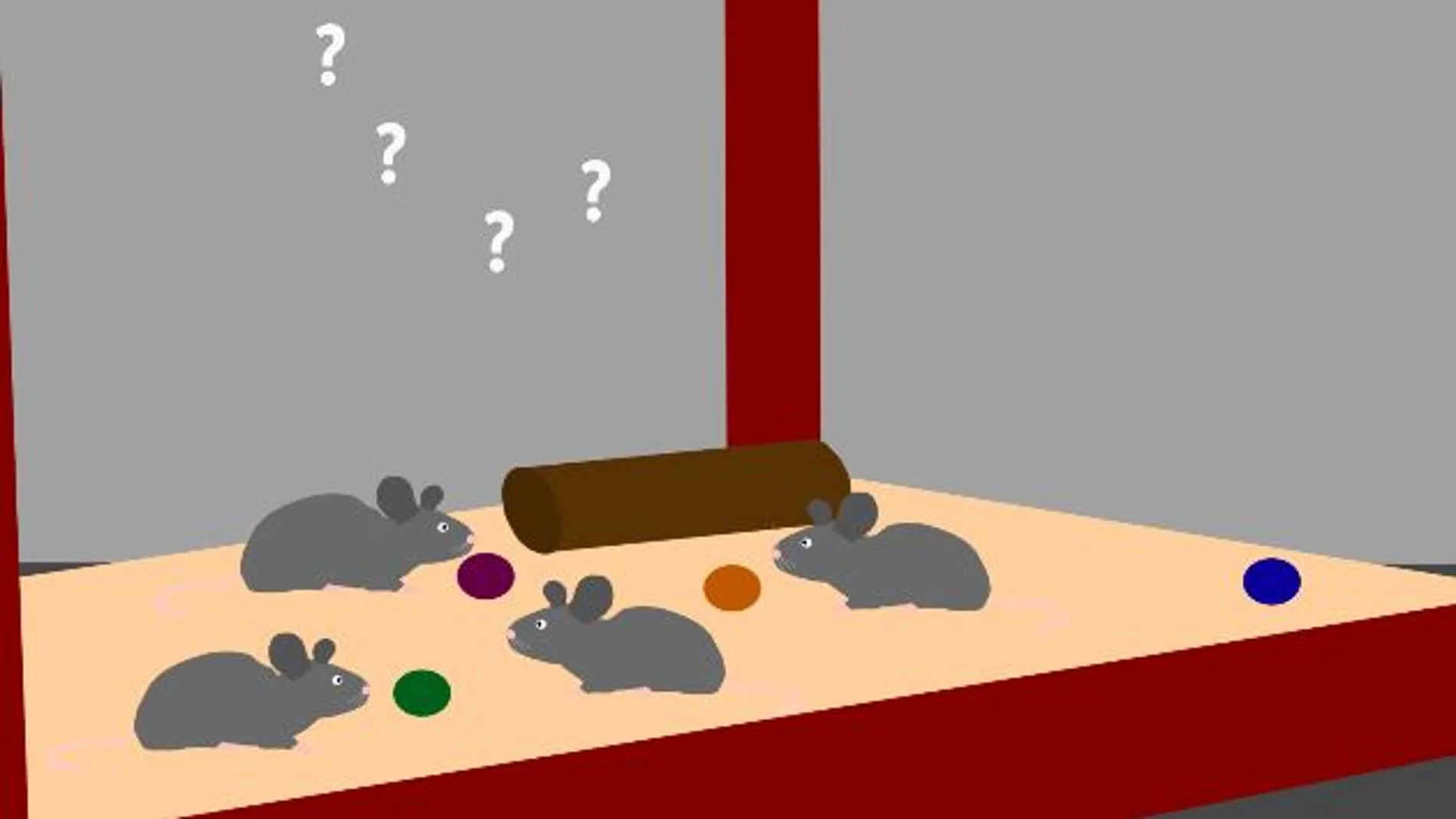

Según describe en Scientic Reports Charles Limoli, profesor de oncología radiactiva en la Escuela de Medicina de la UCI, la exposición a las partículas cargadas de alta energía -al igual que las que se encuentran en los rayos cósmicos que bombardean a los astronautas durante los vuelos espaciales prolongados- causan importantes daños cerebrales a largo plazo en roedores, lo que resulta en alteraciones cognitivas y demencia. Limoli ya dio a conocer sus resultados en 2015, pero ahora ha ampliado su estudio, comprobando los efectos con el paso del tiempo.

Fuera del artículo:

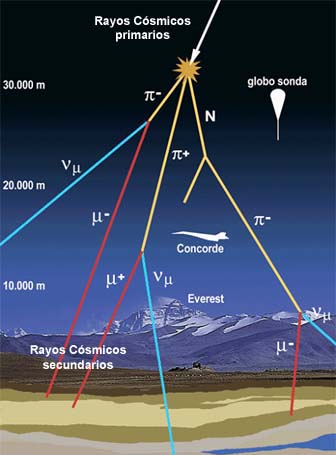

Los peligrosos rayos cósmicos primarios

«Esta no es una noticia positiva para los astronautas que hagan un viaje de dos o tres años a Marte», admite el especialista. «El entorno espacial plantea peligros específicos a los astronautas. La exposición a estas partículas puede conducir a una serie de posibles complicaciones del sistema nervioso central que pueden ocurrir durante el trayecto por el espacio y persistir mucho tiempo después, como una disminución del rendimiento, déficit de memoria, ansiedad, depresión y problemas para la toma de decisiones. Muchas de estas consecuencias adversas a la cognición pueden continuar y progresar durante toda la vida».

La radiación no le sienta bien a ningún metabolismo celular

En el experimento, los roedores fueron sometidos a una irradiación de partículas cargadas (oxígeno totalmente ionizado y titanio) en el Laboratorio de Radiación Espacial de la NASA en el Laboratorio Nacional de Brookhaven en Nueva York, y luego se enviaron al de Limoli en la UCI.

Seis meses después de la exposición (el primer estudio contemplaba los resultados seis semanas después), los investigadores todavía encontraron niveles significativos de inflamación del cerebro y daño en las neuronas de los ratones. La red neural del cerebro se veía afectada por la reducción de las dendritas y espinas de las neuronas, lo cual interrumpe la transmisión de señales entre las células del cerebro. Estas deficiencias fueron paralelas a los malos resultados de las cobayas en las tareas de comportamiento diseñadas para probar el aprendizaje y la memoria.

Miedo y ansiedad, tmbién dmencia

No digamos de la radiación en nosotros, y, la sensación de soledad, el miedo, la Ansiedad

Además, el equipo de Limoli descubrió que la radiación afecta a la «extinción del miedo», un proceso activo por el cual el cerebro suprime asociaciones desagradables y estresantes anteriores, como cuando alguien que casi se ahoga aprende a disfrutar del agua de nuevo. Estos déficits pueden hacer a los sujetos «más propensos a la ansiedad», dice Limoli, lo que podría convertirse en un grave problema en el transcurso de un viaje lleno de dificultades, ya tan estresante de por sí.

Tipos similares más graves de disfunción cognitiva son comunes en pacientes con cáncer cerebral que han recibido altas dosis en tratamientos de radiación a base de fotones.

Si bien los déficits parecidos a la demencia en los astronautas tardan meses en manifestarse, el tiempo necesario para una misión a Marte es suficiente para su desarrollo. Las personas que trabajan durante largos períodos en la Estación Espacial Internacional (ISS), sin embargo, no se enfrentan al mismo nivel de bombardeo de rayos cósmicos galácticos porque todavía están en la magnetosfera que protege la Tierra.

El trabajo de Limoli forma parte del Programa de Investigación Humana de la NASA. Investigar cómo afecta la radiación espacial a los astronautas y las maneras de mitigar esos efectos es crítico para los planes de futuras misiones a Marte y más allá.

Las soluciones parciales se están explorando. La nave espacial podría ser diseñada para incluir áreas de aumento de blindaje, tales como las utilizadas para el descanso y el sueño. Sin embargo, estas partículas cargadas de alta energía atravesarán la nave, «y realmente no hay escapatoria».

Los tratamientos preventivos ofrecen alguna esperanza. El grupo de Limoli está trabajando en estrategias farmacológicas que implican compuestos que eliminan los radicales libres y protegen la neurotransmisión.

Reportaje de prenda (con alguna introducción).

Totales: 87.547.368

Totales: 87.547.368 Conectados: 75

Conectados: 75