Ago

3

La simetría CP y otros aspectos de la física

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

.. “Nature publica una recreación del experimento E122 de hace 35 años,” LCMF, 06 Feb 2014; “Los quarks se mueven al otro lado del espejo,” Agencia SINC, …

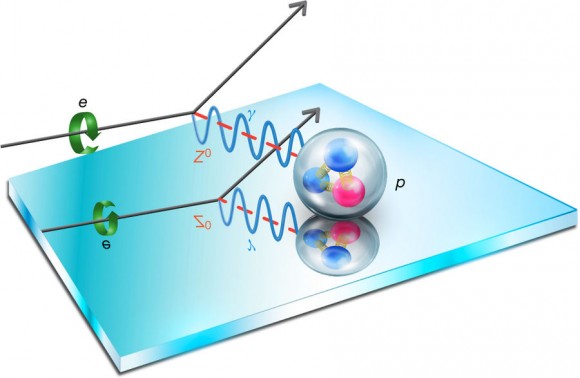

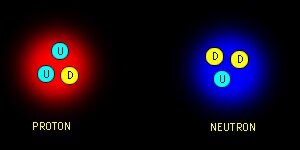

Los quarks al otro lado del espejo. También un Equipo de Científicos del Laboratorio Nacional Jefferson Lab (EEUU) han verificado la rotura de la simetría de paridad (también llamada simetría del espejo) en los quarks mediante el bombardeo de núcleos de deuterio con electrones de alta energía. Los núcleos de deuterio están formados por un protón y un neutrón, es decir, por tres quarks arriba y tres quarks abajo. La dispersión inelástica entre un electrón y un quark, es decir, su colisión, está mediada por la interacción electrodébil, tanto por la fuerza electromagnética como por la fuerza débil. Esta última es la única interacción fundamental que viola la simetría de paridad.

Los quarks al otro lado del espejo. También un Equipo de Científicos del Laboratorio Nacional Jefferson Lab (EEUU) han verificado la rotura de la simetría de paridad (también llamada simetría del espejo) en los quarks mediante el bombardeo de núcleos de deuterio con electrones de alta energía. Los núcleos de deuterio están formados por un protón y un neutrón, es decir, por tres quarks arriba y tres quarks abajo. La dispersión inelástica entre un electrón y un quark, es decir, su colisión, está mediada por la interacción electrodébil, tanto por la fuerza electromagnética como por la fuerza débil. Esta última es la única interacción fundamental que viola la simetría de paridad.

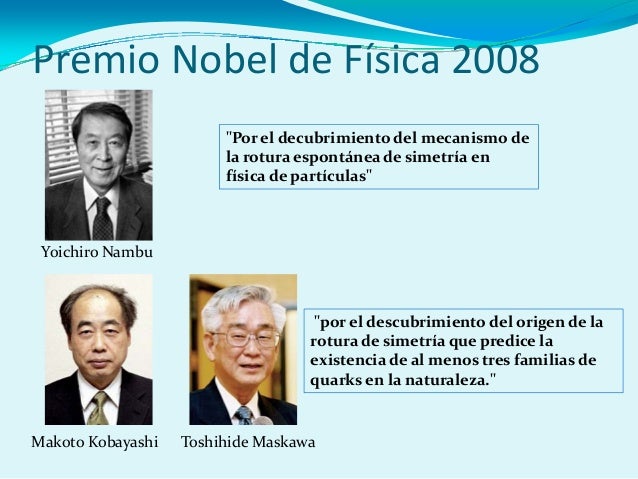

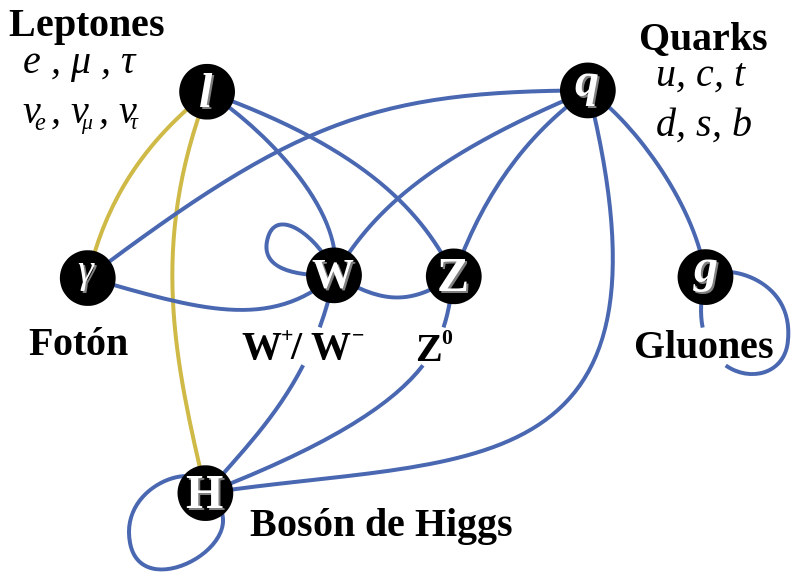

Tenemos que saber cómo la violación de la simetría CP (el proceso que originó la materia) aparece, y, lo que es más importante, hemos de introducir un nuevo fenómeno, al que llamamos campo de Higgs, para preservar la coherencia matemática del modelo estándar. La idea de Higgs, y su partícula asociada, el bosón de Higgs, cuenta en todos los problemas que he mencionado antes. Parece, con tantos parámetros imprecisos (19) que, el modelo estándar se mueve bajo nuestros pies.

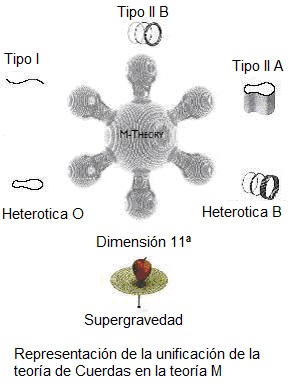

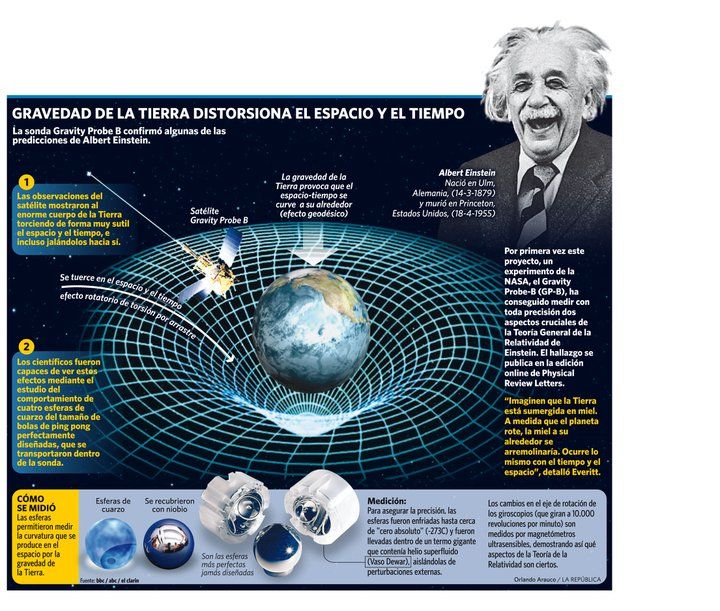

Entre los teóricos, el casamiento de la relatividad general y la teoría cuántica es el problema central de la física moderna. A los esfuerzos teóricos que se realizan con ese propósito se les llama “supergravedad”, “súpersimetría”, “supercuerdas” “teoría M” o, en último caso, “teoría de todo o gran teoría unificada”.

La Física nos lleva de vez en cuando a realizar viajes alucinantes. Se ha conseguido relacionar y vibrar a dos diamantes en el proceso conocido como entrelazamiento cuántico. El misterioso proceso, al que el propio Eisntein no supo darle comprensión completa, supone el mayor avance la fecha y abre las puertas de la computación cuántica. que nos hagamos una idea del hallazgo, en 1935 Einstein lo llegó a denominar la “acción fantasmal a distancia”. Un efecto extraño en donde se conecta un objeto con otro de manera que incluso si están separados por grandes distancias, una acción realizada en uno de los objetos afecta al otro.

Ahí tenemos unas matemáticas exóticas que ponen de punta hasta los pelos de las cejas de algunos de los mejores matemáticos del mundo (¿y Perelman? ¿Por qué nos se ha implicado?). Hablan de 10, 11 y 26 dimensiones, siempre, todas ellas espaciales menos una que es la temporal. Vivimos en cuatro: tres de espacio (este-oeste, norte-sur y arriba-abajo) y una temporal. No podemos, ni sabemos o no es posible instruir, en nuestro cerebro (también tridimensional), ver más dimensiones. Pero llegaron Kaluza y Klein y compactaron, en la longitud de Planck las dimensiones que no podíamos ver. ¡Problema solucionado! Pero se sigue hablando de partículas supersimétricas.

¿Quién puede ir a la longitud de Planck para verla? La longitud de una estas cuerdas es de 10-35 (longitud de Planck) algo tan extremadamente pequeño que sería complicado poder ver alguna vez.

La puerta de las dimensiones más altas quedó abierta y, a los teóricos, se les regaló una herramienta maravillosa. En el Hiperespacio, todo es posible. Hasta el matrimonio de la relatividad general y la mecánica cuántica, allí si es posible encontrar esa soñada teoría de la Gravedad cuántica.

Así que, los teóricos, se han embarcado a la búsqueda de un objetivo audaz: buscan una teoría que describa la simplicidad primigenia que reinaba en el intento calor del universo en sus primeros tiempos, una teoría carente de parámetros, donde estén presentes todas las respuestas. Todo debe ser contestado a partir de una ecuación básica.

¿Dónde radica el problema?

El problema está en que la única teoría candidata no tiene conexión directa con el mundo de la observación, o no lo tiene todavía si queremos expresarnos con propiedad. La energía necesaria para ello, no la tiene ni la nueva capacidad energético del acelerador de partículas LHC . Ni sumando todos los aceleradores de partículas de nuestro mundo, podríamos lograr una energía de Planck (1019 GeV), que sería necesaria para poder llegar hasta las cuerdas vibrantes de la Teoría. Ni en las próximas generaciones seremos capaces de poder utilizar tal energía.

La verdad es que, la teoría que ahora tenemos, el Modelo Estándar, concuerda de manera exacta con todos los datos a bajas energías y contesta cosas sin sentido a altas energías. Sabemos sobre las partíoculas elementales que conforman la materia bariónica, es decir, los átomos que se juntan para formar moléculas, sustancias y cuerpos… ¡La materia! Pero, no sabemos si, pudiera haber algo más elemental aún más allá de los Quarks y, ese algo, pudieran ser esas cuerdas vibrantes que no tenemos capacidad de alcanzar.

¡Necesitamos algo más avanzado!

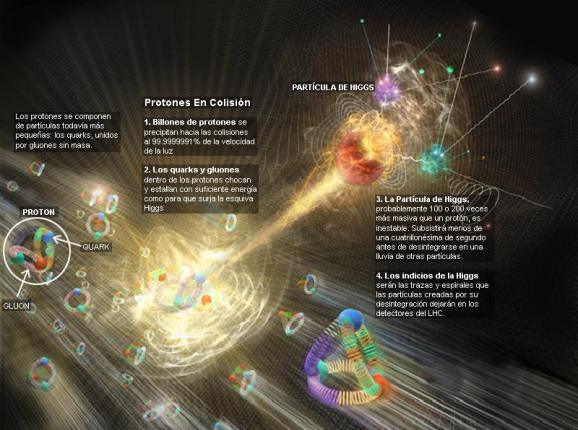

Se ha dicho que la función de la partícula de Higgs es la de dar masa a las Cuando su autor lanzó la idea al mundo, resultó además de nueva muy extraña. El secreto de todo radica en conseguir la simplicidad: el átomo resulto ser complejo lleno de esas infinitesimales partículas electromagnéticas que bautizamos con el nombre de electrones, resultó que tenía un núcleo que contenía, a pesar de ser tan pequeño, casi toda la masa del átomo. El núcleo, tan pequeño, estaba compuesto de otros objetos más pequeños aún, los quarks que estaban instalados en nubes de otras partículas llamadas gluones y, ahora, queremos continuar profundizando, sospechamos, que después de los quarks puede haber algo más.

Con 7 TeV ha sido suficiente para encontrar la famosa partícula de Higgs pero…

Bueno, la idea nueva que surgió es que el espacio entero contiene un campo, el campo de Higgs, que impregna el vacío y es el mismo en todas partes. Es decir, que si miramos a las estrellas en una noche clara estamos mirando el campo de Higgs. Las partículas influidas por este campo, toman masa. Esto no es por sí mismo destacable, pues las partículas pueden tomar energía de los campos (gauge) de los que hemos comentado, del campo gravitatorio o del electromagnético. Si llevamos un bloque de plomo a lo alto de la Torre Eiffel, el bloque adquiriría energía potencial a causa de la alteración de su posición en el campo gravitatorio de la Tierra.

Como E=mc2, ese aumento de la energía potencial equivale a un aumento de la masa, en este caso la masa del Sistema Tierra-bloque de plomo. Aquí hemos de añadirle amablemente un poco de complejidad a la venerable ecuación de Einstein. La masa, m, tiene en realidad dos partes. Una es la masa en reposo, m0, la que se mide en el laboratorio cuando la partícula está en reposo. La partícula adquiere la otra parte de la masa en virtud de su movimiento (como los protones en el acelerador de partículas, o los muones, que aumentan varias veces su masa cuando son lanzados a velocidades cercanas a c) o en virtud de su energía potencial de campo. Vemos una dinámica similar en los núcleos atómicos. Por ejemplo, si separamos el protón y el neutrón que componen un núcleo de deuterio, la suma de las masas aumenta.

Peor la energía potencial tomada del campo de Higgs difiere en varios aspectos de la acción de los campos familiares. La masa tomada de Higgs es en realidad masa en reposo. De hecho, en la que quizá sea la versión más apasionante de la teoría del campo de Higgs, éste genera toda la masa en reposo. Otra diferencia es que la cantidad de masa que se traga del campo es distinta para las distintas partículas.

Los teóricos dicen que las masas de las partículas de nuestro modelo estándar miden con qué intensidad se acoplan éstas al campo de Higgs (podría ser el efecto frenado de Ramón Márquez).

La influencia de Higgs en las masas de los quarks y de los leptones, nos recuerda el descubrimiento por Pietez Zeeman, en 1.896, de la división de los niveles de energía de un electrón cuando se aplica un campo magnético al átomo. El campo (que representa metafóricamente el papel de Higgs) rompe la simetría del espacio de la que el electrón disfrutaba.

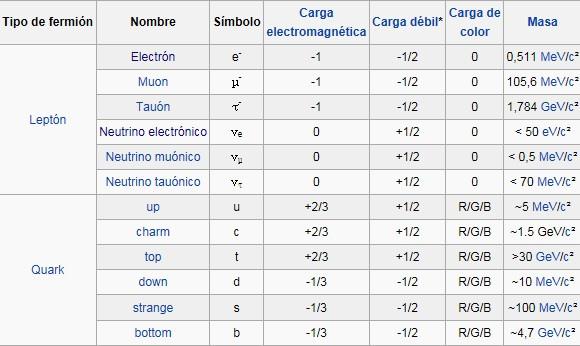

Hasta ahora no tenemos ni idea de que reglas controlan los incrementos de masa generados por el Higgs (de ahí la expectación creada por el nuevo acelerador de partículas LHC). Pero el problema es irritante: ¿por qué sólo esas masas -Las masas de los W+, W–, y Zº, y el up, el down, el encanto, el extraño, el top y el bottom, así como los leptones – que no forman ningún patrón obvio?

Las masas van de la del electrón 0’0005 GeV, a la del top, que tiene que ser mayor que 91 GeV. Deberíamos recordar que esta extraña idea (el Higgs) se empleó con mucho éxito para formular la teoría electrodébil (Weinberg-salam). Allí se propuso el campo de Higgs como una forma de ocultar la unidad de las fuerzas electromagnéticas y débiles. En la unidad hay cuatro partículas mensajeras sin masa -los W+, W–, Zº y fotón que llevan la fuerza electrodébil. Además está el campo de Higgs, y, rápidamente, los W y Z chupan la esencia de Higgs y se hacen pesados; el fotón permanece intacto. La fuerza electrodébil se fragmenta en la débil (débil porque los mensajeros son muy gordos) y la electromagnética, cuyas propiedades determina el fotón, carente de masa. La simetría se rompe espontáneamente, dicen los teóricos. Prefiero la descripción según la cual el Higgs oculta la simetría con su poder dador de masa.

Las masas de los W y el Z se predijeron con éxito a partir de los parámetros de la teoría electrodébil. Y las relajadas sonrisas de los físicos teóricos nos recuerdan que ^t Hooft y Veltman dejaron sentado que la teoría entera esta libre de infinitos.

Todos los intentos y los esfuerzos por hallar una pista del cuál era el origen de la masa fallaron. Feynman escribió su famosa pregunta: “¿Por qué pesa el muón?”. Ahora, por lo menos, tenemos una respuesta parcial, en absoluto completa. Una vez potente y segura nos dice: “!Higgs¡” Durante más de 60 años los físicos experimentadores se rompieron la cabeza con el origen de la masa, y ahora el campo Higgs presenta el problema en un contexto nuevo; no se trata sólo del muón. Proporciona, por lo menos, una fuente común para todas las masas. La nueva pregunta feynmariana podría ser: ¿Cómo determina el campo de Higgs la secuencia de masas, aparentemente sin patrón, que da a las partículas de la matería?

La variación de la masa con el estado de movimiento, el cambio de masa con la configuración del sistema y el que algunas partículas (el fotón seguramente y los neutrinos posiblemente) tengan masa en reposo nula son tres hechos que ponen entre dicho que el concepto de masa sea una tributo fundamental de la materia. Habrá que recordar aquel cálculo de la masa que daba infinito y nunca pudimos resolver; los físicos sólo se deshicieron del “renormalizándolo”, ese truco matemático que emplean cuando no saben hacerlo bien.

En los alrededores de Ginebra (Suiza), en las entrañas de las montañas del Jura construyeron un túmel de 27 Km. de circunferencia. Es el Acelerador más grande del mundo, el LHC. Allí mismo se está planeando construir uno mayor aún con el que, utilizando energías inusitadas e impensables hasta hace unos pocos años, se tratará de buscar el origen de la masa.

Ese es el problema de trasfondo con el que tenemos que encarar el problema de los quarks, los leptones y los vehículos de las fuerzas, que se diferencian por sus masas. Hace que la historia de Higgs se tenga en pie: la masa no es una propiedad intrinseca de las partículas, sino una propiedad adquirida por la interacción de las partículas y su entorno.

La idea de que la masa no es intrinseca como la carga o el espín resulta aún más plausible por la idílica idea de que todos los quarks y fotones tendrían masa cero. En ese caso, obedecerían a una simetría satisfactoria, la quiral, en laque los espines estarían asociados para siempre con su dirección de movimiento. Pero ese idilio queda oculto por el fenómeno de Higgs.

¡Ah, una cosa más! Hemos hablado de los bosones gauge y de su espín de una unidad; hemos comentado también las partículas fermiónicas de la materia (espin de media unidad). ¿Cuál es el pelaje de Higgs? Es un bosón de espin cero. El espín supone una direccionalidad en el espacio, pero el campo de Higgs de masa a los objetos dondequiera que estén y sin direccionalidad. Al Higgs se le llama a veces “bosón escalar” [sin dirección] por esa razón.

Basta con cambiar un quark tipo U a uno tipo D.

Pues justamente esto es lo que ocurre en la naturaleza cuando entra en acció la fuerzxa nuclear débil. Un quark tipo U cambia a uno tipo D por medio de la interacción débil así

Las otras dos partículas que salen son un anti-electrón y un neutrino. Este mismo proceso es el responsable del decaimiento radiactivo de algunos núcleos atómicos. Cuando un neutrón se convierte en un protón en el decaimiento radiactivo de un núcleo, aparece un electrón y un neutrino. Este es el origen de la radiación beta (electrónes).

La interacción débil, recordareis, fue inventada por E.Fermin para describir la desintegración radiactiva de los núcleos, que era básicamente un fenómeno de poca energía, y a medida que la teoría de Fermi se desarrolló, llegó a ser muy precisa a la hora de predecir un enorme número de procesos en el dominio de energía de los 100 MeV. Así que ahora, con las nuevas tecnologías y energías del LHC, las esperanzas son enormes para, por fin, encontrar el bosón Higgs origen de la masa… y algunas cosas más.

Hay que responder montones de preguntas. ¿Cuáles son las propiedades de las partículas de Higgs y, lo que es más importante, cuál es su masa? ¿Cómo reconoceremos una si nos la encontramos en una colisión de LHC? ¿Cuántos tipos hay? ¿Genera el Higgs todas las masas, o solo las hace incrementarse? ¿Y, cómo podemos saber más al respecto? Como s su partícula, nos cabe esperar que la veamos ahora después de gastar más de 50.000 millones de euros en los elementos necesarios para ello.

También a los cosmólogos les fascina la idea de Higgs, pues casi se dieron de bruces con la necesidad de tener campos escalares que participasen en el complejo proceso de la expansión del Universo, añadiendo, pues, un peso más a la carga que ha de soportar el Higgs.

El campo de Higgs, tal y como se lo concibe ahora, se puede destruir con una energía grande, o temperaturas altas. Estas generan fluctuaciones cuánticas que neutralizan el campo de Higgs. Por lo tanto, el cuadro que las partículas y la cosmología pintan juntas de lo que un universo primitivo puso y de resplandeciente simetría es demasiado caliente para Higgs. Pero cuando la temperatura cae bajo los 10′5grados kelvin o 100 GeV, el Higgs empieza a actuar y hace su generación de masas. Así por ejemplo, antes de Higgs teníamos unos W, Z y fotones sin masa y la fuerza electrodébil unificada.

El Universo se expande y se enfría, y entonces viene el Higgs (que engorda los W y Z, y por alguna razón ignora el fotón) y de ello resulta que la simetría electrodébil se rompe.

Tenemos entonces una interacción débil, transportada por los vehículos de la fuerza W+, W–, Z0, y por otra parte una interacción electromagnética, llevada por los fotones. Es como si para algunas partículas del campo de Higgs fuera una especie de aceite pesado a través del que se moviera con dificultad y que las hiciera parecer que tienen mucha masa. Para otras partículas, el Higgs es como el agua, y para otras, los fotones y quizá los neutrinos, es invisible.

De todas las maneras, es tanta la ignorancia que tenemos sobre el origen de la masa que, nos agarramos como a un clavo ardiendo el que se ahoga, en este caso, a la partícula de Higgs que, algunos, han llegado a llamar, de manera un poco exagerada:

¡La partícula Divina! (Como la llamó Lederman en su libro).

¡Ya veremos en que termina todo esto! Y que explicación se nos ofrece desde el CERN en cuanto al auténtico escenario que según ellos, existe en el Universo para que sea posible que las partículas tomen su masa de ese oceáno de Higgs, en el que, según nuestro amigo Ramón Márquez, las partículas se frenan al interaccionar con el mismo y toman su masa, el lo llama el “efecto frenado”.

Peter Higgs, de la Universidad de Edimburgo, introdujo la idea en la física de partículas. La utilizaron los teóricos steven Weinberg y Abdus Salam, que trabajaban por separado, para comprender como se convertía la unificada y simétrica fuerza electrodébil, transmitida por una feliz familia de cuatro partículas mensajeras de masa nula, en dos fuerzas muy diferentes: la QED con un fotón carente de masa y la interacción débil con sus W+, W– y Z0 de masa grande. Weinberg y Salam se apoyaron en los trabajos previos de Sheldon Glasgow, quien tras los pasos de Julian Schwinger, sabía sólo que había una teoría electrodébil unificada, coherente, pero no unió todos los detalles. Y estaban Jeffrey Goldstone y Martines Veltman y Gerard’t Hooft. También hay otras a los que había que mencionar, pero lo que siempre pasa, quedan en el olvido de manera muy injusta. Además, ¿Cuántos teóricos hacen falta para encender una bombilla?

El maestro, allá donde se pueda encontrar, estará riendo al ver que, cuando los físicos manipulan las ecuaciones de campo de la teoría de cuerdas, como por arte de magia, sin que nadie las llame, allí aparecen las ecuaciones de campo de la Relatividad General… ¿Por qué será?

La verdad es que, casi siempre, han hecho falta muchos. Recordemos el largo recorrido de los múltiples detalle sueltos y físicos que prepararon el terreno para que, llegara Einstein y pudiera, uniéndolo todos, exponer su teoría relativista. (Mach, Maxwell, Lorentz… y otros).

Sobre la idea de la “materia oscura”, Veltman, premio Nobel de Física, dice que es una alfombra bajo la que barremos nuestra ignorancia. Glasgow es menos amable y lo llamó retrete donde echamos las incoherencias de nuestras teorías actuales. La objeción principal: que no tenemos la menor prueba experimental.

Ahora, por fin la tenemos con el LHC, y ésta pega, se la traspasamos directamente a la teoría de supercuerdas y a la materia oscura que, de momento, están en la sombra y no brillan con luz propia, toda vez que ninguna de ellas ha podido ser verificada, es decir, no sabemos si el Universo atiende a lo que en ellas se predice.

El modelo estándar es lo bastante fuerte para decirnos que la partícula de Higgs de menor masa (podría haber muchas) debe “pesar” menos de 1 TeV. ¿Por qué? Si tiene más de 1 TeV, el modelo estándar se vuelve incoherente y tenemos la crisis de la unitariedad.

Después de todo esto, llego a la conclusión de que, el campo de Higgs, el modelo estándar y nuestra idea de cómo pudo surgir el Universo no dependía de que se encontrara el el bosón de Higgs o se averigüe si realmente existe la materia oscura, Aunque sepamos llegar al fondo de la Teoría de Cuerdas y confirmarla, Poder crear esa Teoría cuántica de la Gravedad…Y, en fín, seguir descubriendo los muchos misterios que no nos dejan saber lo que el Universo es. Ahora, por fin, tenemos grandes aceleradores y Telescopios con la energía necesaria y las condiciones tecnológicas suficientes para que nos muestre todo eso que queremos saber y nos digan dónde reside esa verdad que incansables perseguimos. Sin embargo, siempre seguiremos haciendo preguntas y siempre, también, serán insuficientes, los aparatos que podamos construir para que nos digan como es el Universo y cómo funciona la Naturaleza. Saberlo todo, nunca sabremos.

¡La confianza en nosotros mismos, no tiene límites! Pero, no siempre ha estado justificada.

emilio silvera

Ago

2

Siempre en busca de respuestas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

Nuestro contertulio Don José C. Gómez, me envía un correo en el que me dice lo siguiente:

ch/4G = Mu′ mg

“Saludos Emilio, le adjunto una formula que combina las 3 Constantes universales c, h y G, con los datos extraídos de mi estudio, Mu es la masa del Universo actual 3.2*10^52 kg. y mg la masa de un gravitón 2.33*10-68 kg. El gravitón seria el tejido del espacio, el medio por el que viajan el resto de fuerzas, curvándose ante la masa. No se desplaza simplemente transmite energía.”

Esperemos que su constancia, al final le de el fruto de desvelar algún secreto importante de la Naturaleza.

¡Suerte!

Ago

2

El “universo” de las partículas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

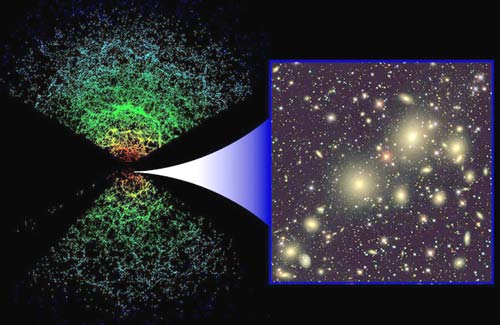

Solo el 1% de las formas de vida que han vivido en la Tierra están ahora presentes, el 99%, por una u otra razón se han extinguido. Sin embargo, ese pequeño tanto por ciento de la vida actual, supone unos cinco millones de especies según algunas estimaciones. La Tierra acoge a todas esas especies u palpita de vida que prolifera por doquier. Hay seres vivos por todas partes y por todos los rincones del inmenso mosaico de ambientes que constituye nuestro planeta encontramos formas de vida, cuyos diseños parecen hechos a propósito para adaptarse a su hábitat, desde las profundidades abisales de los océanos hasta las más altas cumbres, desde las espesas selvas tropicales a las planicies de hielo de los casquetes polares. Se ha estimado la edad de 3.800 millones de años desde que aparecieron los primeros “seres vivos” sobre el planeta (dato de los primeros microfósiles). Desde entonces no han dejado de aparecer más y más especies, de las que la mayoría se han ido extinguiendo. Desde el siglo XVIII en que Carlos Linneo propuso su Systema Naturae no han cesado los intentos por conocer la Biodiversidad…, de la que por cierto nuestra especie, bautizada como Homo sapiens por el propio Linneo, es una recién llegada de apenas 200.000 años.

Ahora, hablaremos de la vida media de las partículas elementales (algunas no tanto). Cuando hablamos del tiempo de vida de una partícula nos estamos refiriendo al tiempo de vida media, una partícula que no sea absolutamente estable tiene, en cada momento de su vida, la misma probabilidad de desintegrarse. Algunas partículas viven más que otras, pero la vida media es una característica de cada familia de partículas.

También podríamos utilizar el concepto de “semivida”. Si tenemos un gran número de partículas idénticas, la semivida es el tiempo que tardan en desintegrarse la mitad de ese grupo de partículas. La semivida es 0,693 veces la vida media.

Si miramos una tabla de las partículas más conocidas y familiares (fotón, electrón muón tau, la serie de neutrinos, los mesones con sus piones, kaones, etc., y, los Hadrones bariones como el protón, neutrón, lambda, sigma, psi y omega, en la que nos expliquen sus propiedades de masa, carga, espín, vida media (en segundos) y sus principales maneras de desintegración, veríamos como difieren las unas de las otras.

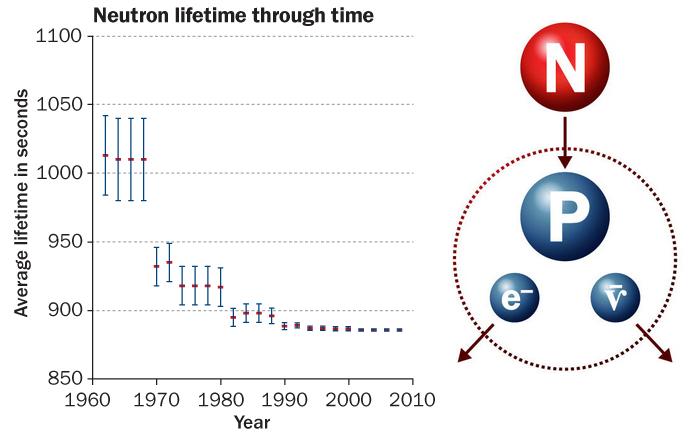

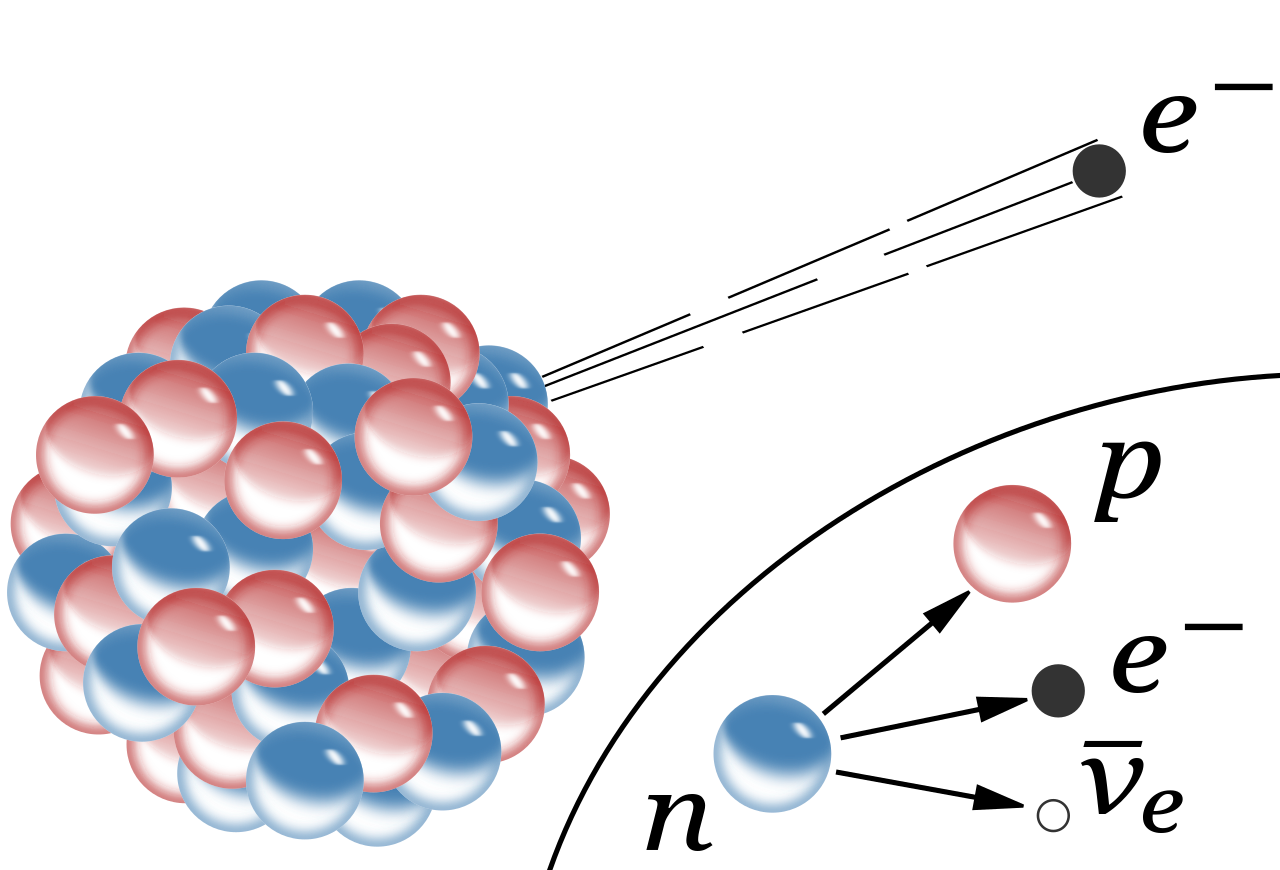

“El neutrón y el protón forman los núcleos de los átomos; el protón es estable (su vida media es superior a 10³² años, según PDG 2012), pero el neutrón es inestable (vía la interacción electrodébil se desintegra en un protón) y aislado su vida media es de solo 880,1 ± 1,1 segundos (14 minutos y 40,1 segundos), según el PDG 2012; en muchos isótopos también es inestable aunque su vida media es mucho más larga (el carbono-14 decae en el nitrógeno 14 con una vida media de 5.730 años). Sin embargo, al releer libros antiguos uno descubre que se pensaba que la vida media era de unos 17 minutos. ¿Por qué la diferencia es tan grande? La razón es que medir la vida media de un neutrón aislado es muy difícil y el resultado depende del método experimental utilizado (los valores en discordia difieren en hasta 10 segundos). ¿Por qué es importante la medida de la vida media del neutrón? Para verificar las teorías de nucleosíntesis primordial en el big bang, así como varios parámetros necesarios para la cosmología de precisión y para el modelo estándar de las partículas elementales (como el parámetro Vud). Nos lo contó Rebecca Cheung, “Secret of a Lifetime. How long a neutron lives holds clues to the cosmos,” ScienceNews, May 4, 2012. Más información técnica en Fred E. Wietfeldt, Geoffrey L. Greene, “Colloquium: The neutron lifetime,” Rev. Mod. Phys. 83: 1173–1192, 2011, y en A. N. Ivanov, M. Pitschmann, N. I. Troitskaya, “Neutron Beta-Decay as Laboratory for Test of Standard Model,” arXiv:1212.0332, Dec 3, 2012.”

“El neutrón se observó en 1932 (Nobel de Física en 1935). Siendo inestable fuera del núcleo, se desintegra en menos de 15 minutos vía la interacción débil. Hay un misterio asociado a la medida de su vida media: con neutrones ultrafríos atrapados se obtiene un valor de 878.5 ± 0.8 segundos, mientras que contando las desintegraciones un haz de neutrones fríos se obtiene 887.7 ± 2.2 s, con una diferencia de 9.2 s, que son 3.9 sigmas (desviaciones estándares). Se publica en Science una nueva medida del primer tipo, que resulta en 877.7 ± 0.7 (stat) +0.4/–0.2 (sys) segundos. La nueva medida logra reducir los errores sistemáticos por debajo de los estadísticos. Por desgracia, aún no resuelve el misterio.”

Algunas partículas tienen una vida media mucho más larga que otras. De hecho, la vida media difiere enormemente. Un neutrón por ejemplo, vive 10¹³ veces más que una partícula Sigma⁺, y ésta tiene una vida 10⁹ veces más larga que la partícula sigma cero. Pero si uno se da cuenta de que la escala de tiempo “natural” para una partícula elemental (que es el tiempo que tarda su estado mecánico-cuántico, o función de ondas, en evolucionar u oscilar) es aproximadamente 10ˉ²⁴ segundos, se puede decir con seguridad que todas las partículas son bastantes estables. En la jerga profesional de los físicos dicen que son “partículas estables”.

¿Cómo se determina la vida media de una partícula? Las partículas de vida larga, tales como el neutrón y el muón, tienen que ser capturadas, preferiblemente en grandes cantidades, y después se mide electrónicamente su desintegración. Las partículas comprendidas entre 10ˉ¹⁰ y 10ˉ⁸ segundos solían registrarse con una cámara de burbujas, pero actualmente se utiliza con más frecuencia la cámara de chispas. Una partícula que se mueve a través de una cámara de burbujas deja un rastro de pequeñas burbujas que puede ser fotografiado. La Cámara de chispas contiene varios grupos de de un gran número de alambres finos entrecruzados entre los que se aplica un alto voltaje. Una partícula cargada que pasa cerca de los cables produce una serie de descargas (chispas) que son registradas electrónicamente. La ventaja de esta técnica respecto a la cámara de burbujas es que la señal se puede enviar directamente a una computadora que la registra de manera muy exacta.

Una partícula eléctricamente neutra nunca deja una traza directamente, pero si sufre algún tipo de interacción que involucre partículas cargadas (bien porque colisionen con un átomo en el detector o porque se desintegren en otras partículas), entonces desde luego que pueden ser registradas. Además, realmente se coloca el aparato entre los polos de un fuerte imán. Esto hace que la trayectoria de las partículas se curve y de aquí se puede medir la velocidad de las partículas. Sin embargo, como la curva también depende de la masa de la partícula, es conveniente a veces medir también la velocidad de una forma diferente.

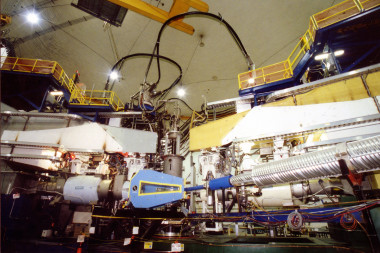

Una colisión entre un prtón y un antiprotón registrada mediante una cámara de chispas del experimento UA5 del CERN.

En un experimento de altas energías, la mayoría de las partículas no se mueven mucho más despacio que la velocidad de la luz. Durante su carta vida pueden llegar a viajar algunos centímetros y a partir de la longitud media de sus trazas se puede calcular su vida. Aunque las vidas comprendidas entre 10ˉ¹³ y 10ˉ²⁰ segundos son muy difíciles de medir directamente, se pueden determinar indirectamente midiendo las fuerzas por las que las partículas se pueden transformar en otras. Estas fuerzas son las responsables de la desintegración y, por lo tanto, conociéndolas se puede calcular la vida de las partículas, Así, con una pericia ilimitada los experimentadores han desarrollado todo un arsenal de técnicas para deducir hasta donde sea posible todas las propiedades de las partículas. En algunos de estos procedimientos ha sido extremadamente difícil alcanzar una precisión alta. Y, los datos y números que actualmente tenemos de cada una de las partículas conocidas, son los resultados acumulados durante muchísimos años de medidas experimentales y de esa manera, se puede presentar una información que, si se valorara en horas de trabajo y coste de los proyectos, alcanzaría un precio descomunal pero, esa era, la única manera de ir conociendo las propiedades de los pequeños componentes de la materia.

Que la mayoría de las partículas tenga una vida media de 10ˉ⁸ segundos significa que son ¡extremadamente estables! La función de onda interna oscila más de 10²² veces/segundo. Este es el “latido natural de su corazón” con el cual se compara su vida. Estas ondas cuánticas pueden oscilar 10ˉ⁸ x 10²², que es 1¹⁴ o 100.000.000.000.000 veces antes de desintegrarse de una u otra manera. Podemos decir con toda la seguridad que la interacción responsable de tal desintegración es extremadamente débil.

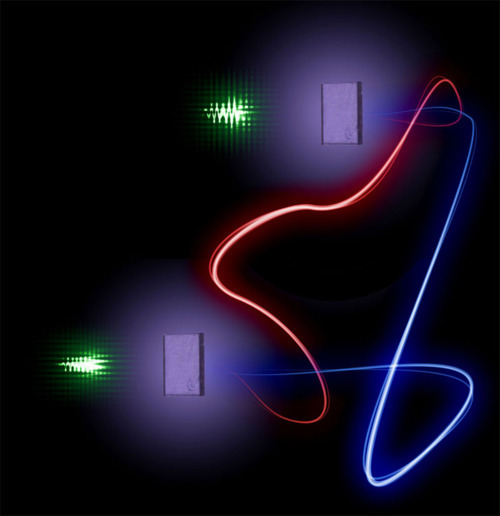

Se habla de ondas cuánticas y también, de ondas gravitacionales. Las primeras han sido localizadas y las segundas están siendo perseguidas.

Aunque la vida de un neutrón sea mucho más larga (en promedio un cuarto de hora), su desintegración también se puede atribuir a la interacción débil. A propósito, algunos núcleos atómicos radiactivos también se desintegran por interacción débil, pero pueden necesitar millones e incluso miles de millones de años para ello. Esta amplia variación de vidas medias se puede explicar considerando la cantidad de energía que se libera en la desintegración. La energía se almacena en las masas de las partículas según la bien conocida fórmula de Einstein E = Mc². Una desintegración sólo puede tener lugar si la masa total de todos los productos resultantes es menor que la masa de la partícula original. La diferencia entre ambas masas se invierte en energía de movimiento. Si la diferencia es grande, el proceso puede producirse muy rápidamente, pero a menudo la diferencia es tan pequeña que la desintegración puede durar minutos o incluso millones de años. Así, lo que determina la velocidad con la que las partículas se desintegran no es sólo la intensidad de la fuerza, sino también la cantidad de energía disponible.

Si no existiera la interacción débil, la mayoría de las partículas serían perfectamente estables. Sin embargo, la interacción por la que se desintegran las partículas π°, η y Σ° es la electromagnética. Se observará que estas partículas tienen una vida media mucho más corta, aparentemente, la interacción electromagnética es mucho más fuerte que la interacción débil.

Durante la década de 1950 y 1960 aparecieron tal enjambre de partículas que dio lugar a esa famosa anécdota de Fermi cuando dijo: “Si llego a adivinar esto me hubiera dedicado a la botánica.”

Si la vida de una partícula es tan corta como 10ˉ²³ segundos, el proceso de desintegración tiene un efecto en la energía necesaria para producir las partículas ante de que se desintegre. Para explicar esto, comparemos la partícula con un diapasón que vibra en un determinado modo. Si la “fuerza de fricción” que tiende a eliminar este modo de vibración es fuerte, ésta puede afectar a la forma en la que el diapasón oscila, porque la altura, o la frecuencia de oscilación, está peor definida. Para una partícula elemental, esta frecuencia corresponde a su energía. El diapasón resonará con menor precisión; se ensancha su curva de resonancia. Dado que para esas partículas extremadamente inestable se miden curvas parecidas, a medida se las denomina resonancias. Sus vidas medias se pueden deducir directamente de la forma de sus curvas de resonancia.

Bariones Delta. Un ejemplo típico de una resonancia es la delta (∆), de la cual hay cuatro especies ∆ˉ, ∆⁰, ∆⁺ y ∆⁺⁺(esta última tiene doble carga eléctrica). Las masas de las deltas son casi iguales 1.230 MeV. Se desintegran por la interacción fuerte en un protón o un neutrón y un pión.

Existen tanto resonancias mesónicas como bariónicas . Las resonancias deltas son bariónicas. Las resonancias deltas son bariónicas. (También están las resonancias mesónicas rho, P).

Las resonancias parecen ser solamente una especie de versión excitada de los Hadrones estable. Son réplicas que rotan más rápidamente de lo normal o que vibran de diferente manera. Análogamente a lo que sucede cuando golpeamos un gong, que emite sonido mientras pierde energía hasta que finalmente cesa de vibrar, una resonancia termina su existencia emitiendo piones, según se transforma en una forma más estable de materia.

Por ejemplo, la desintegración de una resonancia ∆ (delta) que se desintegra por una interacción fuerte en un protón o neutrón y un pión, por ejemplo:

∆⁺⁺→р + π⁺; ∆⁰→р + πˉ; o п+π⁰

En la desintegración de un neutrón, el exceso de energía-masa es sólo 0,7 MeV, que se puede invertir en poner en movimiento un protón, un electrón y un neutrino. Un Núcleo radiactivo generalmente tiene mucha menos energía a su disposición.

Misterios por resolver, profundizar en las entrañas del átomo, saber sobre el origen (real) del Universo, querer tocar el componente primigenio de la materia, el que hizo posible la constitución de las estrellas y las galaxias. ¿Sería la “sustancia cósmica” a la que los griegos clásicos llamaban Ylem? El el LHC lo están buscando.

El estudio de los componentes de la materia tiene una larga historia en su haber, y, muchos son los logros conseguidos y muchos más los que nos quedan por conseguir, ya que, nuestros conocimientos de la masa y de la energía (aunque nos parezca lo contrario), son aún bastante limitados, nos queda mucho por descubrir antes de que podamos decir que dominamos la materia y sabemos de todos sus componentes. Antes de que eso llegue, tendremos que conocer, en profundidad, el verdadero origen de la Luz que esconde muchos secretos que tendremos que desvelar.

Esperemos que con los futuros experimentos del LHC y de los grandes Aceleradores de partículas del futuro, se nos aclaren algo las cosas y podamos avanzar en el perfeccionamiento del Modelo Estándar de la Física de Partículas que, como todos sabemos es un Modelo incompleto que no contiene a todas las fuerzas de la Naturaleza y, cerca de una veintena de sus parámetros son aleatorios y no han sido explicados. Uno de ellos era el Bosón de Higgs que pudo ser confirmado. Sin embargo, a mí particularmente me quedan muchas dudas al respecto.

emilio silvera

Ago

2

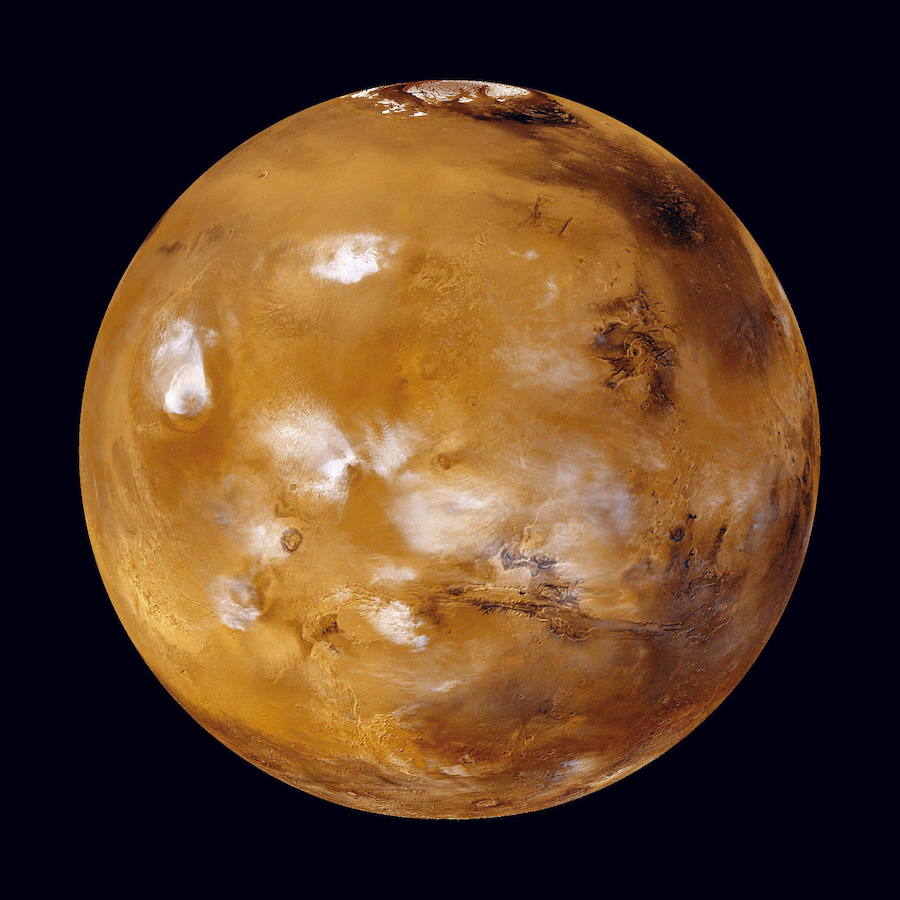

¿Terraformar Marte? Imposible con la tecnología actual

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Marte ~

Clasificado en Marte ~

Comments (0)

Comments (0)

Un equipo de científicos de la NASA calcula las posibilidades de transformar Marte en un mundo habitable

Ya nos gustaría terraformar el planeta pero… ¡No podemos!

Desde hace décadas, «terraformar» Marte para convertirlo en un planeta habitable ha sido un tema recurrente en las novelas de ciencia ficción. Incluso más de un científico ha sugerido que esa terraformación podría conseguirse liberando una cantidad suficiente del dióxido de carbono atrapado en la superficie marciana, algo que «engordaría» la tenue atmósfera del planeta rojo y provocaría un efecto invernadero capaz de calentar el gélido planeta, haciéndolo apto para nosotros.

Sin embargo, según se desprende de un nuevo estudio de la NASA recién publicado en Nature Astronomy, Marte no sería capaz de retener la cantidad de dióxido de carbono que actualmente seríamos capaces de inyectar en su atmósfera, y el gas terminaría perdiéndose en el espacio sin lograr su cometido. Para transformar el inhóspito entorno marciano en un lugar que los astronautas pudieran explorar sin tener que cargar con pesados sistemas de soporte vital, cascos y trajes espaciales, sería necesario enviar a la atmósfera una cantidad mucho mayor de dióxido de carbono de la que hoy seríamos capaces de extraer del planeta vecino. Algo que, según los expertos de la NASA, está por completo fuera del alcance de nuestras capacidades tecnológicas actuales.

Y ello a pesar del hecho de que, por sí sola, la atmósfera marciana ya está hecha, principalmente, de dióxido de carbono, aunque su cantidad es insuficiente para retener agua en estado líquido, el ingrediente más preciado de la vida que conocemos. En Marte, en efecto, la presión de la atmósfera es de menos de un uno por ciento de la que ejerce la atmósfera terrestre. Por eso, mientras que la Tierra es capaz de retener su agua, la que hay (y hubo) en Marte o termina congelada o se evapora y se pierde irremediablemente en el espacio.

«El dióxido de carbono y el vapor de agua -explica Bruce Jakosky , de la Universidad de Colorado y autor principal del estudio- son los únicos gases de efecto invernadero presentes en Marte en la cantidad suficiente para provocar un calentamento global significativo». Con esa idea en mente, durante los pasados años 90 se llevaron a cabo diversos estudios para investigar la posibilidad de terraformar Marte, pero el nuevo estudio, que ha contado con la ventaja de dos décadas adicionales de observación del planeta rojo, acaba de negar esa posibilidad.

En busca de un cambio climático

Creo que más adelante, en un futuro algo lejano todavía… ¡Lo conseguiremos!

Los investigadores, en efecto, analizaron la abundancia de minerales que contienen carbono y la presencia de CO2 en los hielos polares utilizando datos del Mars Reconnaissance Orbiter y de la Mars Odissey. Y recurrieron a los datos de la sonda MAVEN (Mars Atmosphere and Volatile Evolution) para averiguar qué cantidad exacta de atmósfera marciana se pierde actualmente en el espacio. «Estos datos -afirma Christopher Edwards, de la Universidad del Norte de Arizona y coautor de la investigación- han proporcionado nueva información sustancial sobre la historia de materiales volátiles como el CO2 y y el H2O en el planeta, la abundancia de volátiles encerrados bajo de la superficie y la tasa de pérdida de gas de la atmósfera al espacio».

Reconvertir el planeta en el que era hace millones de años… Requiere una tecnología que no está presente

«Nuestros resultados -prosigue el científico- sugieren que no tenemos acceso al suficiente CO2 remanente en Marte para colocar en la atmósfera y proporcionar un calentamiento de invernadero significativo. De hecho, la mayor parte del CO2 no es accesible y no se puede movilizar fácilmente. Como resultado, la terraformación de Marte no es posible con la tecnología actual».

Anteriormente se propuso también introducir en la atmósfera marciana otros componentes, como clorofluorocarbonos, para conseguir el calentamiento del planeta, pero esos gases tienen la vida demasiado corta para el propósito y su producción requeriría de procesos de fabricación a gran escala, por lo que no fueron considerados para el estudio actual.

La clave, en los casquetes polares

Los nuevos cálculos indican que las fuentes más accesibles de CO2 en Marte se encuentran en sus casquetes polares, y que sería posible cubrir los polos de polvo (o incluso usar explosivos) para que absorbieran una mayor cantidad de radiación solar y liberaran el gas. Pero aún así la contribución de CO2 a la atmósfera marciana solo serviría para duplicar su presión atmosférica actual (el 0,6 por cien de la que hay en la Tierra) a un escaso y absolutamente insuficiente 1,2 por cien de la que ejerce la atmósfera terrestre sobre nuestro planeta.

Otra posible fuente de CO2 en Marte se encuentra adherida a las partículas de polvo que cubren el planeta, que podrían ser calentadas para que liberaran el gas. Pero los investigadores estiman que incluso así se conseguiría apenas un 4 por cien de la presión atmosférica necesaria para elevar la tempertura del planeta.

Costará mucho recuperar lo que fue

Una tercera fuente de dióxido de carbono está «bloqueada» en el interior de depósitos minerales. Pero según las últimas observaciones de la NASA, liberarlo solo contribuiría con otro 5 por cien de la presión atmosférica necesaria. Y eso sin contar con que, solo para utilizar los depósitos minerales que estén más cerca de la superficie, sería necesario llevar a cabo una extracción masiva a cielo abierto que cubriera prácticamente toda la superficie del planeta. ¡¡¡Y con una profundidad de cerca de 91 metros!!!

Según los investigadores, solo los depósitos minerales enterrados a gran profundidad bajo la superficie marciana podrían contener suficiente CO2 como para que, al ser liberado, confiriera a la atmósfera la presión requerida. Pero la extensión y localización de estos depósitos profundos es desconocida, ya que están fuera del alcance de las prospecciones orbitales. Y aunque supiéramos dónde están, conseguir llegar hasta ellos utilizando la tecnología actual resultaría imposible.

¿Un proceso de millones de años?

En un pasado lejano, Marte tuvo gran cantidad de agua en su superficie, y una atmósfera capaz de conservar el preciado líquido. Pero, según ha comprobado la sonda MAVEN, la radiación y el viento solar «hicieron jirones» la antigua atmósfera marciana, arrancando de ella la mayor parte de su CO2 y de su vapor de agua. Los datos de la MAVEN indican, en efecto, que la mayor parte de esa antigua atmósfera, probablemente capaz incluso de sustentar vida, se perdió para siempre en el espacio por cupla de la acción del Sol.

Los investigadores creen que incluso si consiguiéramos frenar de algún modo esa pérdida, permitiendo que la atmósfera vuelva a regenerarse lentamente gracias sl proceso natural de desgasificación geológica, se necesitarían más de 10 millones de años solo para duplicar la actual atmósfera de Marte. Algo, de nuevo, insuficiente para que el planeta volviera a ser habitable.

El misterioso suceso que hizo desaparecer la atmósfera de Marte

Otra idea sería la de importar volátiles mediante la redirección de cometas y asteroides para que cayeran en Marte y liberaran allí los gases necesarios. Sin embargo, los cálculos del equipo revelan que se necesitarían muchos miles de ellos para conseguir el objetivo. Un sistema, pues, poco práctico y también fuera de nuestro alcance.

En conjunto, los resultados de la investigación nos dejan pocas esperanzas, e indican que la terraformación de Marte es imposible de abordar con la tecnología disponible actualmente. Cualquier esfuerzo de ese tipo tendrá, pues, que ser aplazado a un futuro muy lejano…

Ago

2

El nacimiento del Sol

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Astrofísica ~

Clasificado en Astrofísica ~

Comments (0)

Comments (0)

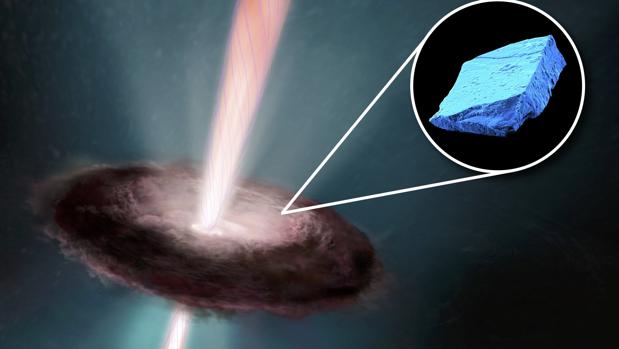

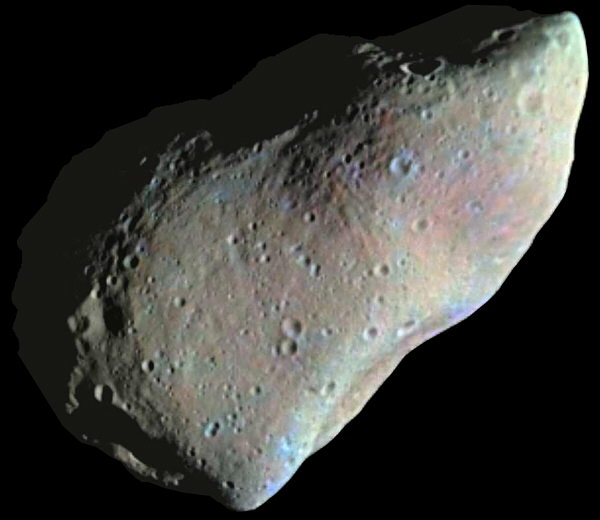

Los cristales analizados se formaron en el disco de polvo y gas que rodeaba al Sol. Luego fueron bombardeados por partículas de alta energía liberadas por la estrella – Field Museum, University of Chicago, NASA, ESA, and E. Feild (STScl).

Confirman por primera vez que el Sol tuvo un nacimiento terrible

Unos cristales atrapados en meteoritos han revelado que la estrella tuvo un pasado muy violento en el que bombardeaba su vecindario

¿Cómo se formó el Sol? ¿Cuándo apareció el Sistema Solar? La idea general es que hace 4.600 millones de años, algún tipo de acontecimiento muy energético, como una explosión de supernova, hizo que una parte de una gran nube de gas y polvo comenzara a contraerse por efecto de la gravedad. Esta contracción dio lugar a un disco plano y giratorio de gas y polvo en cuyo centro se acumuló la mayoría de la materia, formando un «protosol» que engulló hasta el 99,9 % de la masa del disco. Cuando este protosol se calentó lo suficiente comenzaron a producirse reacciones de fusión nuclear que generaron helio a partir de hidrógeno (entre otras reacciones). Después, el material sobrante del disco se fue concentrando en fragmentos cada vez mayores y se formaron los llamados planetesimales. El viento solar despejó el vecindario de la estrella y las temperaturas de esa región bajaron, permitiendo que los planetesimales crecieran y atrajeran mayores cantidades de gas. Finalmente, los materiales más pesados se acumularon cerca de la estrella y formaron planetas rocosos, mientras que en las afueras se acumularon los ligeros y se formaron los gigantescos planetas gaseosos.

Un estudio que se acaba de publicar en Nature Astronomy ha recogido un testimonio de excepción de aquellos días. Científicos de la Universidad de Chicago han analizado burbujas de gas halladas en hibonitas, unos antiguos cristales azules que quedaron atrapados en algunos de los meteoritos que han chocado contra la Tierra. Las burbujas de gas halladas solo son posibles en un escenario en el que el Sol estuviera liberando al espacio montones de partículas de alta energía. Son, de hecho, la primera evidencia concreta que revela que los primeros días del Sol fueron muy violentos.

«El Sol era más activo al comienzo de su vida: tenía más erupciones y creaba una corriente más intensa de partículas cargadas. Por así decirlo, era como mi hijo de tres años», ha bromeado en un comunicado Philipp Heck, autor del estudio e investigador en la Universidad de Chicago.

El Sol es hoy un gigantesco orbe de plasma (gas extremadamente caliente y cargado eléctricamente) que tiene atrapados con su gravedad a los planetas del Sistema Solar. Experimenta un ciclo solar de 22 años (algo así como un ciclo de respiración estelar), en el que los polos magnéticos se invierten. Así se establecen fases de mínima y máxima actividad. Durante su apogeo, es cierto que el Sol da lugar a más manchas solares, más erupciones, más eyecciones de masa coronal y auroras más resplandecientes en la Tierra. Sin embargo, y aunque estos ciclos parecen influir en el clima terrestre y que comportan un riesgo claro para nuestro planeta, hoy en día esta estrella es lo suficientemente benigna como para tolerar la presencia de vida en la Tierra.

Un joven y violento Sol

Pero los cristales de hibonita han revelado que en los albores del Sistema Solar el Sol era mucho más violento. Antes de que se formasen los planetesimales, y de que se despejara el entorno de la protoestrella, el disco de gas que rodeaba el centro del Sistema Solar alcanzaba una temperatura de 1.500 ºC. Según los investigadores fue cuando esta parte del disco comenzó a enfriarse cuando se formaron los minerales azules hallados en los meteoritos. Después, el joven Sol disparó protones y partículas subatómicas al espacio.

Cristal de hibonita hallado en uno de los meteoritos – Andy Davis, University of Chicago

Resulta maravilloso, pero todavía hoy es posible detectar las huellas dejadas por el impacto de esas partículas energéticas contra los cristales de hibonita. De hecho, cuando los protones golpearon los átomos de calcio del interior de estos, los rompieron en átomos de neón y helio gaseosos.

Durante miles de millones de años, estos átomos han estado atrapados en la hibonita. Los caprichos del destino quisieron que las colisiones que formaron el Sistema Solar les llevaran a integrar rocas espaciales. La suerte llevó a que algunas de estas cayeran en la Tierra en forma de meteoritos.

La carambola continuó cuando las benignas condiciones del Sol permitieran el desarrollo de la vida, y de la ciencia más avanzada. De hecho, no ha sido hasta recientemente cuando los investigadores han capacidad de poder analizar la composición del gas atrapado en estos cristales. Lo han logrado gracias a un avanzado espectrómetro (capaz de medir la composición química de los objetos) y a un láser, que usaron para fundir pequeños gránulos de cristal de hibonita y liberar el helio y el neón atrapados en su interior. «Obtuvimos una señal sorprendentemente intensa, mostrando la presencia de neón y helio», ha dicho Levke Kööp, director de la investigación.

La primera prueba concreta

Los cristales azules de hibonita datan de una época en la que el Sol estaba rodeado por un disco de gas y polvo, antes de la formación de los planetas.

Esas minúsculas cantidades de neón y helio atrapados en la hibonita constituyen la primera evidencia concreta de la potente actividad del Sol durante su infancia. Además, al contrario que otras evidencias de la pasada actividad solar, no hay otra buena forma de explicar el origen de los cristales de hibonita.

«Esto es como si alguien al que conocemos es un adulto tranquilo, sospecháramos que de pequeño era un niño activo pero que no tuviéramos ninguna prueba», ha dicho Heck. Pero entonces, un día subes al ático y encuentras sus juguetes rotos y sus libros con las páginas desgarradas: tendrías la prueba de que esa persona fue alguna vez un niñito repleto de energía».

Aparte de encontrar evidencias de la vida pasada del Sol, los investigadores han detectado que los materiales más antiguos del Sistema Solar fueron irradiados pero que otros más recientes no. también han hallado evidencias que sugieren que ocurrió «un gran cambio» durante el nacimiento del Sistema Solar después de que se formaran los cristales de hibonita: «Quizás la actividad del Sol disminuyó o quizás los materiales más jóvenes del disco protoplanetario no pudieron viajar a los lugares del disco donde la irradiación era posible».

¿Para qué sirve saber todos estos detalles sobre el nacimiento del Sol y los planetas? Además de para comprender los orígenes del Sistema Solar y de los otros sistemas planetarios, Heck ha explicado que entender mejor estos fenómenos ayudará a «adquirir una mejor comprensión de la física y la química de nuestro mundo natural». Uno absolutamente dominado por la infuencia del Sol.

Totales: 87.175.033

Totales: 87.175.033 Conectados: 52

Conectados: 52