Jun

3

¿Qués es la luz? hace 340 años que supimos de su velocidad

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (4)

Comments (4)

En estos lugares se vivía a base de antorchas y velas para alumbrar los lóbregos pasillos

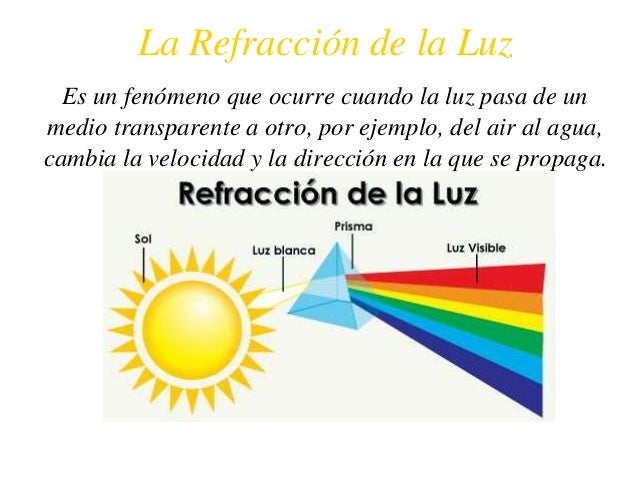

Está claro que, los estudiosos de la época antigua y medieval estaban por completo a oscuras acerca de la naturaleza de la luz. Especulaban sobre que consistía en partículas emitidas por objetos relucientes o tal vez por el mismo ojo. Establecieron el hecho de que la luz viajaba en línea recta, que se reflejaba en un espejo con un ángulo igual a aquel con el que el rayo choca con el espejo, y que un rayo de luz se inclina (se refracta) cuando pasa del aire al cristal, al agua o a cualquier otra sustancia transparente.

Cuando la luz entra en un cristal, o en alguna sustancia transparente, de una forma oblicua (es decir, en un ángulo respecto de la vertical), siempre se refracta en una dirección que forma un ángulo menor respecto de la vertical. La exacta relación entre el ángulo original y el ángulo reflejado fue elaborada por primera vez en 1.621 por el físico neerlandés Willerbrord Snell. No publicó sus hallazgos y el filósofo francés René Descartes descubrió la ley, independientemente, en 1.637.

Los primeros experimentos importantes acerca de la naturaleza de la luz fueron llevados a cabo por Isaac Newton en 1.666, al permitir que un rayo de luz entrase en una habitación oscura a través de una grieta e las persianas, cayendo oblicuamente sobre una cara de un prisma de cristal triangular. El rayo se refracta cuando entra en el cristal y se refracta aún más en la misma dirección cuando sale por una segunda cara del prisma. (Las dos refracciones en la misma dirección se originan por que los dos lados del prisma de se encuentran en ángulo en vez de en forma paralela, como sería el caso en una lámina ordinaria de cristal.)

Newton y sus experimentos con la luz

Cuando Newton empezó su lucha por establecer un método inductivo correcto en física, estaba trabajando en el campo de la óptica, no en cinemática o en astronomía. En sus primeros años, mucho antes de que los Principia le dieran la fama, llevó a cabo un estudio de la luz y los colores, un estudio que ha sido descrito como “la más excelsa investigación experimental del siglo XVII

Newton atrapó el rayo emergente sobre una pantalla blanca para ver el efecto de la refracción reforzada. Descubrió que, en vez de formar una mancha de luz blanca, el rayo se extendía en una gama de colores: rojo, anaranjado, amarillo, verde, azul, y violeta, en este orden.

Newton dedujo de ello que la luz blanca corriente era una mezcla de varias luces que excitaban por separado nuestros ojos para producir las diversas sensaciones de colores. La amplia banda de sus componentes se denominó spectrum (palabra latina que significa “espectro”, “fantasma”).

Newton llegó a la conclusión de que la luz se componía de diminutas partículas (“corpúsculos”), que viajaban a enormes velocidades.

Le surgieron y se planteó algunas inquietudes cuestiones. ¿Por qué se refractaban las partículas de luz verde más que los de luz amarilla? ¿Cómo se explicaba que dos rayos de luz se cruzaran sin perturbase mutuamente, es decir, sin que se produjeran colisiones entre partículas?

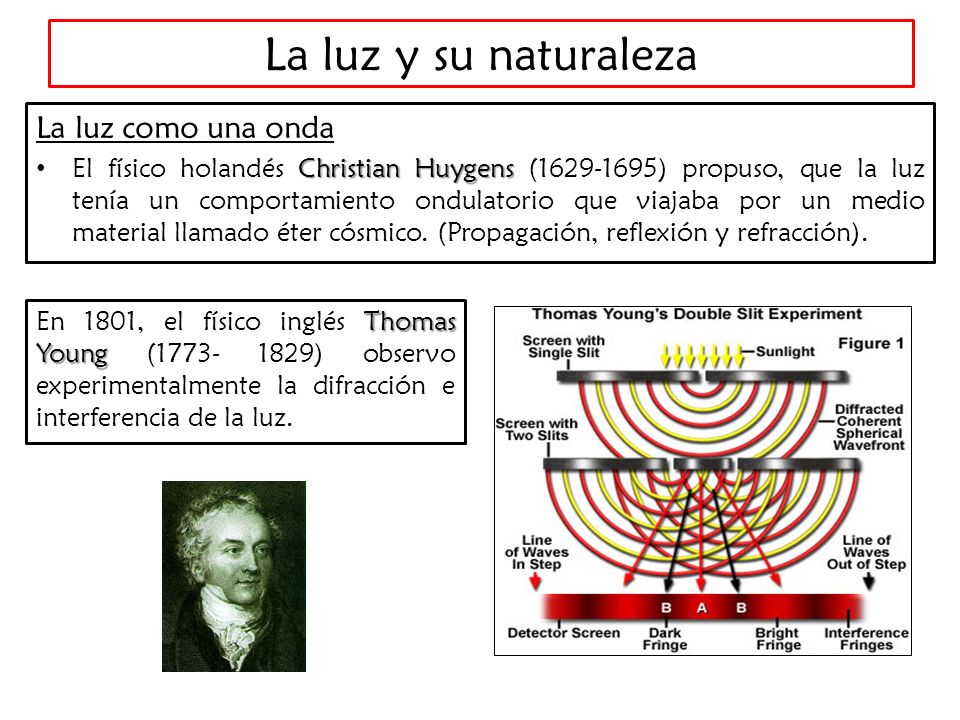

En 1.678, el físico neerlandés Christian Huyghens (un científico polifacético que había construido el primer reloj de péndulo y realizado importantes trabajos astronómicos) propuso una teoría opuesta: la de que la luz se componía de minúsculas ondas. Y si sus componentes fueran ondas, no sería difícil explicar los diversos difracciones de los diferentes tipos de luz a través de un medio refractante, siempre y cuando se aceptara que la luz se movía más despacio en ese medio refractante que en el aire. La cantidad de refracción variaría con la longitud de las ondas: cuanto más corta fuese tal longitud, tanto mayor sería la refracción. Ello significaba que la luz violeta (la más sensible a este fenómeno) debía de tener una longitud de onda mas corta que la luz azul, ésta, más corta que la verde, y así sucesivamente.

Lo que permitía al ojo distinguir los colores eran esas diferencias entre longitudes de onda. Y, como es natural, si la luz estaba integrada por ondas, dos rayos podrían cruzarse sin dificultad alguna. (Las ondas sonoras y las del agua se cruzan continuamente sin perder sus respectivas identidades.)

Pero la teoría de Huyqhens sobre las ondas tampoco fue muy satisfactoria. No explicaba por qué se movían en línea recta los rayos luminosos; ni por qué proyectaban sombras recortadas; ni aclaraba por qué las ondas luminosas no podían rodear los obstáculos, del mismo modo que pueden hacerlo las ondas sonoras y de agua. Por añadidura, se objetaba que si la luz consistía en ondas, ¿cómo podía viajar por el vacío, ya que cruzaba el espacio desde el Sol y las Estrellas? ¿cuál era esa mecánica ondulatoria?

Aproximadamente durante un siglo, contendieron entre sí estas teorías. La teoría corpuscular, de Newton, fue, con mucho, la más popular, en parte, porque la respaldó el famoso nombre de su autor. Pero hacia 1.801, un físico y médico ingles, de nombre Thomas Young, llevó a cabo un experimento que arrastró la opinión pública al campo opuesto. Proyectó un fino rayo luminoso sobre una pantalla, haciéndolo pasar antes por dos orificios casi juntos. Si la luz estuviera compuesta por partículas, cuando los dos rayos emergieran de ambos orificios, formarían presuntamente en la pantalla una región más luminosa donde se superpusieran, y regiones menos brillantes, donde no se diera tal superposición. Pero no fue esto lo que descubrió Young. La pantalla mostró una serie de bandas luminosas, separadas entre sí por bandas oscuras. Pareció incluso que, en esos intervalos de sombra, la luz de ambos rayos contribuía a intensificar la oscuridad.

Sería fácil explicarlo mediante la teoría ondulatoria. La banda luminosa representaba el refuerzo prestado por las ondas de un rayo a las ondas del otro. Dicho de otra manera: Entraba “en fase” dos trenes de ondas, es decir, ambos nodos, al unirse, se fortalecían el uno al otro. Por otra parte, las bandas oscuras representaban puntos en que las ondas estaban “desfasadas” porque el vientre de una neutralizaba el nodo de la otra. En vez de aunar sus fuerzas, las ondas se interferían mutuamente, reduciendo la energía luminosa neta a las proximidades del punto cero.

Considerando la anchura de las bandas y la distancia entre los dos edificios por los que surgen ambos rayos, se pudo calcular la longitud de las ondas luminosas, por ejemplo, de la luz roja a la violeta o los colores intermedios. Las longitudes de onda resultaron ser muy pequeñas. Así, la de la luz roja era de unos 0’000075 cm. (Hoy se expresan las longitudes de las ondas luminosas mediante una unidad muy práctica ideada por Angströn. Esta unidad, denominada, en honor a su autor Ángstrom (Á), es la cienmillonésima parte de un centímetro. Así, pues, la longitud de onda de la luz roja equivale más o menos a 7.500 Á, y la de la luz violeta, a 3.900 Å, mientras que las de colores visibles en el espectro oscilan entre ambas cifras.)

La cortedad de estas ondas es muy importante. La razón de que las ondas luminosas se desplacen en línea recta y proyecten sombras recortadas se debe a que todas son incomparablemente más pequeñas que cualquier objeto; pueden contornear un obstáculo sólo si éste no es mucho mayor que la longitud de onda. Hasta las bacterias, por ejemplo, tienen un volumen muy superior de una onda luminosa y, por tanto, la luz puede definir claramente sus contornos bajo el microscopio. Sólo los objetos cuyas dimensiones se asemejan a la longitud de la onda luminosa (por ejemplo, los virus y otras partículas submicroscópicas) son lo suficientemente pequeños como para que puedan ser contorneados por las ondas luminosas.

Un físico francés, Augustin-Jean Fresnel, fue quien demostró por vez primera, en 1.818, que si un objeto es lo suficientemente pequeño, la onda luminosa lo contorneará sin dificultad. En tal caso, la luz determina el llamado fenómeno de “difracción”. Por ejemplo, las finísimas líneas paralelas de una “reja de disfracción” actúan como una serie de minúsculos obtáculos, que se refuerzan entre si. Puesto que la magnitud de la difracción va asociada a la longitud de onda, se produce el espectro. A la inversa, se puede calcular la longitud de onda midiendo la difracción de cualquier color o porción del espectro, así como la separación de las marcas sobre el cristal.

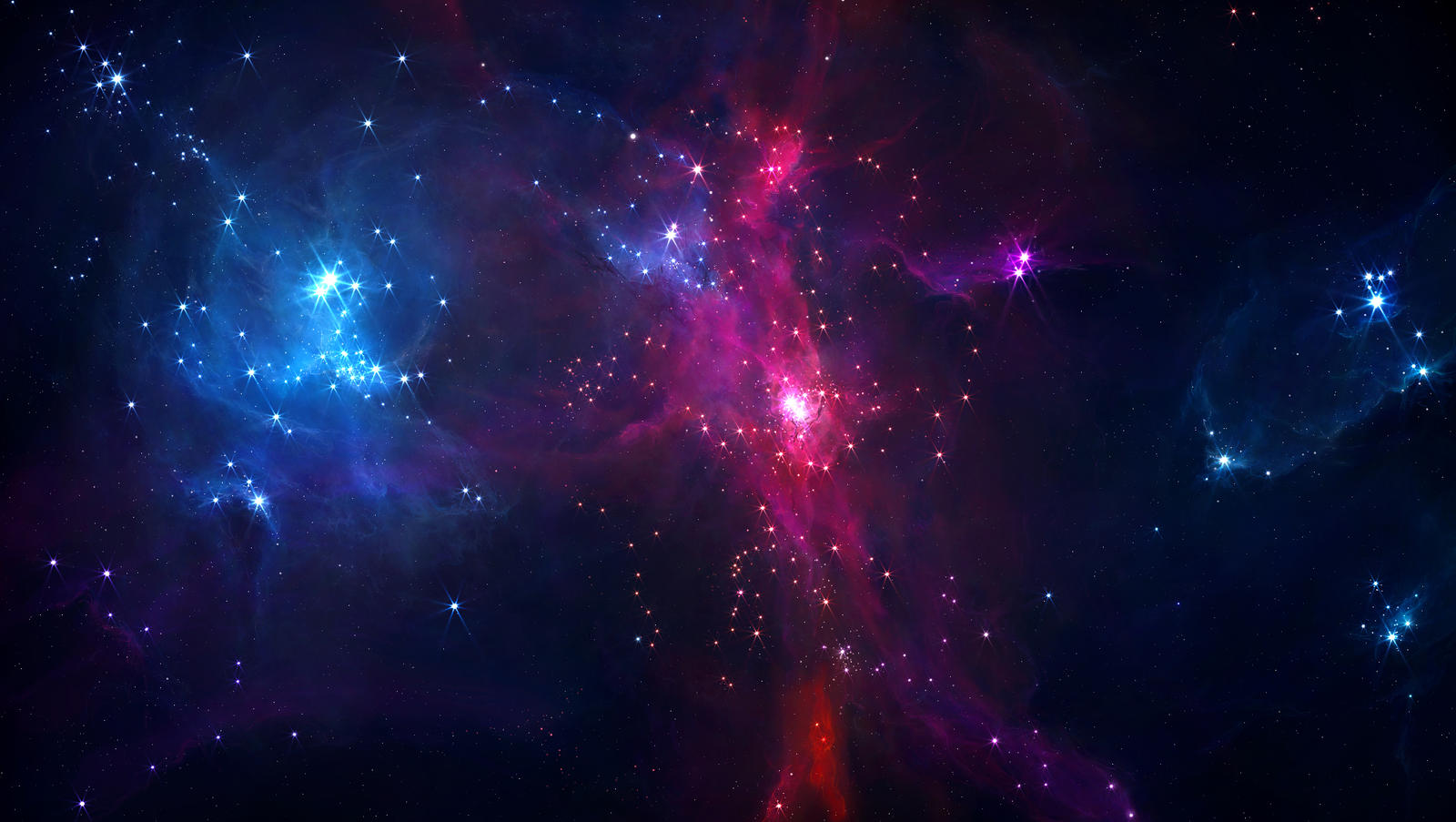

A través de los rayos espectrales se supo de qué estaban hechas las estrellas y los objetos celestes

Fraunhofer exploró dicha reja de difracción con objeto de averiguar sus finalidades prácticas, progreso que suele olvidarse, pues queda eclipsado por su descubrimiento más famoso: los rayos espectrales. El físico americano Henry Augustus Rowlane ideó la reja cóncava y desarrolló técnicas para regularlas de acuerdo con 20.000 líneas por pulgada. Ello hizo posible la sustitución del prisma por el espectroscopio.

Ante tales hallazgos experimentales, más el desarrollo metódico y matemático del movimiento ondulatorio, debido a Fresnel, pareció que la teoría ondulatoria de la luz había arraigado definitivamente, desplazando y relegando para siempre a la teoría corpuscular.

La luz tiene una naturaleza dual: se comporta como onda y partícula. Entre las propiedades de la onda luminosa se incluyen la refracción de la onda cuando …

No sólo se aceptó las existencias de ondas luminosas, sino que también se midió su longitud con una precisión cada vez mayor. Hacia 1.827, el físico francés Jacques Babinet sugirió que se empleara la longitud de onda luminosa (una cantidad física inalterable) como unidad para medir tales longitudes, en vez de las muy diversas unidades ideadas y empleadas por el hombre. Sin embargo, tal sugerencia no se llevó a la práctica hasta 1.880 cuando el físico germano-americano Albert Abraham Michelson inventó un instrumento, denominado “interferómetro”, que podía medir las longitudes de ondas luminosas con una exactitud sin precedentes. En 1.893, Michelson midió la onda de la raya roja en el espectro del cadmio y determinó que su longitud era de 1/1.553.164 m.

Pero la incertidumbre reapareció al descubrirse que los elementos estaban compuestos por isótopos diferentes, cada uno de los cuáles aportaba una raya cuya longitud de onda difería ligeramente de las restantes. En la década de 1.930 se midieron las rayas del criptón 86. Como quiera que este isótopo fuera gaseoso, se podía abordar con bajas temperaturas, para frenar el movimiento atómico y reducir el consecutivo engrosamiento de la raya.

En 1.960, el Comité Internacional de Pesos y Medidas adoptó la raya del criptón 86 como unidad fundamental de longitud. Entonces se restableció la longitud de metro como 1.650.763’73 veces la longitud de onda de dicha raya espectral. Ello aumento mil veces la precisión de las medidas de longitud. Hasta entonces se había medido el antiguo metro patrón con un margen de error equivalente a una millonésima, mientras que en lo sucesivo se pudo medir la longitud de onda con un margen de error equivalente a una milmillonésima.

Ahora, después de todo esto, sabemos algo más sobre la luz.

Pero ¿qué pasa con su velocidad?

¡Veámoslo!

Está claro que, la luz se desplaza a enormes velocidades. Si pulsamos el interruptor de apagado de la lámpara de nuestro salón, todo queda a oscuras de manera instantánea.

La velocidad del sonido es más lenta, por ejemplo, si vemos a un leñador que está cortando leña en un lugar alejado de nosotros, sólo oiremos los golpes momentos después de que caiga el hacha. Así, pues, el sonido tarda cierto tiempo en llegar a nuestros oídos. En realidad es fácil medir la velocidad de su desplazamiento: unos 1.206 km/h en el aire y a nivel del mar.

“El experimento realizado por Galileo Galilei en 1638 en el que por medio del uso de faroles, dos observadores situados a más de 1 km de distancia, pretendían medir el tiempo transcurrido desde que el primer observador emitía una señal luminosa por medio de un farol hasta que el segundo observador la veía, emitiendo instantáneamente con el otro farol una señal luminosa que era cronometrada por el primer observador.”

Galileo fue el primero en intentar medir la velocidad de la luz. Se colocó en lo alto de una colina, mientras que su ayudante, se situaba en otro lugar alto de la colina vecina; luego sacó una linterna encendida: tan pronto como su ayudante vió la luz, hizo una señal con otra linterna. Galileo repitió el experimento a distancias cada vez mayores, suponiendo que el tiempo requerido por su ayudante para responder mantendría una uniformidad constante, por lo cual, el intervalo entre la señal de su propia linterna y la de su ayudante representaría el tiempo empleado por la luz para recorrer cada distancia. Aunque la idea era lógica, la luz viajaba demasiado aprisa como para que Galileo pudiera percibir las sutiles diferencias con un método tan rudimentario.

Observaciones de Röemer

En 1.676, el astrónomo danés Olau Roemer logró cronometrar la velocidad de la luz a escala de distancias astronómicas. Estudiando los eclipses de Júpiter en sus cuatro grandes satélites, Roemer observó que el intervalo entre eclipses consecutivos era más largo cuando la Tierra se alejaba de Júpiter, y más corto cuado se movía en su órbita hacía dicho astro. Al parecer, la diferencia entre las duraciones del eclipse reflejaba la diferencia de distancias entre la Tierra y Júpiter. Y trataba, pues, de medir la distancia partiendo del tiempo empleado por la luz para trasladarse desde Júpiter hasta la Tierra. Calculando aproximadamente el tamaño de la órbita terrestre y observando la máxima discrepancia en las duraciones del eclipse que, según Roemer, representaba el tiempo que necesitaba la luz para atravesar el eje de al órbita terrestre, dicho astrónomo computó la velocidad de la luz. Su resultado, de 225.000 km/s., parece excelente si se considera que fue el primer intento, y resultó bastante asombroso como para provocar la incredulidad de sus coetáneos.

![[foto de la noticia] [foto de la noticia]](http://estaticos01.elmundo.es/elmundo/imagenes/2009/03/31/1238489169_extras_ladillos_3_2.jpg)

Sin embargo, medio siglo después se confirmaron los cálculos de Roemer en un campo totalmente distinto. Allá por 1.728, el astrónomo británico James Bradley descubrió que las estrellas parecían cambiar de posición con los movimientos terrestres; y no por el paralaje, sino porque la traslación terrestre alrededor del Sol era una fracción mensurable (aunque pequeña) de la velocidad de la luz. La analogía empleada usualmente es la de un hombre que camina con el paraguas abierto bajo un temporal. Aun cuando las gotas caigan verticalmente, el hombre debe inclinar hacia delante el paraguas, porque ha de abrirse paso entre las gotas.

Cuanto más acelere su paso, tanto más deberá inclinar el paraguas. De manera semejante la Tierra avanza entre los ligeros rayos que caen desde las estrellas, y el astrónomo debe inclinar un poco su telescopio y hacerlo en varias direcciones, de acuerdo con los cambios de la trayectoria terrestre (no olvidemos que nuestro planeta Tierra, es como una enorme nave espacial que nos lleva en un viaje eterno, alrededor del Sol, a la velocidad de 30 km/s. + -) Mediante ese desvío aparente de los astros (“aberración de la luz”), Bradley pudo evaluar la velocidad de la luz y calcularla con gran precisión.

Sus cálculos fueron de 285.000 km/s, bastante más exacto que los de Roemer, pero aún un 5’5% más bajos.

Poco a poco, con medios tecnológicos más sofisticados y más conocimientos matemáticos, los científicos fueron obteniendo medidas más exactas aún, conforme se fue perfeccionando la idea original de Galileo y sus sucesores.

En 1.849, el físico francés Armand-Hippolyte-Louis Fizeau ideó un artificio mediante el cual se proyectaba la luz sobre un espejo situado a 8 km de distancia, que devolvía el reflejo al observador. El tiempo empleado por la luz en su viaje de ida y vuelta no rebasó apenas la 1/20.000 de segundo, por Fizeau logró medirlo colocando una rueda dentada giratoria en la trayectoria del rayo luminoso. Cuando dicha rueda giraba a cierta velocidad, regulada, la luz pasaba entre los dientes y se proyectaba contra el siguiente, al ser devuelta por el espejo; así, Fizeau, colocado tras la rueda, no pudo verla. Entonces se dio más velocidad a la rueda, y el reflejo pasó por la siguiente muesca entre los dientes, sin intercepción alguna. De esa forma, regulando y midiendo la velocidad de la rueda giratoria, Fizeau pudo calcular el tiempo transcurrido y, por consiguiente, la velocidad a que se movía el rayo de luz.

Experimento de Focault

Cuando el espejo gira a una velocidad suficientemente elevada para que el tiempo de que tarda en dar una vuelta sea comparable al tiempo que tarda la luz en ir y volver en su recorrido, la señal luminosa se observa a una distancia fácilmente medible del orificio por el que sale el rayo luminoso.

En estas circunstancias es fácil determinar el ángulo que se ha desviado el rayo. Como se conoce la velocidad de rotación, se determina el tiempo que ha tardado el espejo en girar la mitad de ese ángulo. En este tiempo la luz ha recorrido y de esa cifra se obtiene el valor de la velocidad.

La velocidad del espejo fue de 400 revoluciones por segundo y la distancia entre el espejo giratorio y el espejo fijo era de 5 metros.

Un año más tarde, Jean Foucault (quien realizaría poco después su experimento con los péndulos) precisó más estas medidas empleando un espejo giratorio en ve de una rueda dentada. Entonces se midió el tiempo transcurrido desviando ligeramente el ángulo de reflexión mediante el veloz espejo giratorio. Foucault obtuvo un valor de la velocidad de la luz de 300.883 km/s. También, el físico francés utilizó su método para determinar la velocidad de la luz a través de varios líquidos. Averiguó que era notablemente inferior a la alcanzada en el aire. Esto concordaba también con la teoría ondulatoria de Huyghens.

Experimento Michelson-Morley Reposo con el éter luminífero Interferómetro de Michelson y Morley en reposo respecto al éter luminífero.

Michelson fue más preciso aún en sus medidas. Este autor, durante cuarenta años largos, a partir de 1.879, fue aplicando el sistema Fizeau-Foucault cada vez con mayor refinamiento, para medir la velocidad de la luz. Cuando se creyó lo suficientemente informado, proyectó la luz a través de vacío, en vez de hacerlo a través del aire, pues este frena ligeramente su velocidad, y, empleó para ello tuberías de acero cuya longitud era superior a 1’5 km. Según sus medidas, la velocidad de la luz en el vacío era de 299.730 km(seg. (sólo un 0’006% más bajo). Demostraría también que todas las longitudes de ondas luminosas viajan a la misma velocidad en el vacío.

En 1.972, un equipo de investigadores bajo la dirección de Kenneth M. Eveson efectuó unas mediciones aún más exactas y vio que la velocidad de la luz era de 299.727’74 km/seg. Una vez se conoció la velocidad de la luz con semejante precisión, se hizo posible usar la luz, o por lo menos formas de ella, para medir distancias.

Aunque para algunos resulte alto tedioso el tema anterior, no he podido resistirme a la tentación de exponerlo, así podrá saber algo más sobre la luz y, habrán conocido a personajes que hicieron posible el que ahora nosotros, la conozcamos mejor.

Las ondas de luz están presentes en el Espacio Interestelar

Podría continuar, hasta el final de este trabajo, hablando de la luz y sus distintas formas o aplicaciones: ondas de luz a través del espacio, de cómo se transmite la luz en el “vacío”, nos llega a través del espacio desde Galaxias situadas a miles de millones de años luz; las líneas de fuerzas electromagnéticas de Faraday y Maxwell de campos eléctricos y magnéticos cambiantes (todo ello explicado en un simple conjunto de cuatro ecuaciones, que describían casi todos los fenómenos referentes a esta materia electromagnética), o de los enigmas aún por descubrir (aunque predichos).

Ahora, en Física, se dice que la luz es una forma de radiación electromagnética a la que el ojo humano es sensible y sobre la cual depende nuestra consciencia visual del universo y sus contenidos.

Sí, el ojo humano puede ver todo objeto en el que incida la luz

Patrón de referencia

En el año 1983, el Bureau Internacional de Poids et Mesures resolvió modificar la definición del metro como unidad de longitud del Sistema Internacional, estableciendo su definición a partir de la velocidad de la luz

El metro como patrón en barras de platino e Iridio

En consecuencia, el mínimo reajuste arbitrario efectuado en la definición del metro, permite que la velocidad de la luz, lógicamente, tenga un valor exacto de 299 792 458 m/s cuando se expresa en metros/segundo. Esta modificación aprovecha de forma práctica una de las bases de la teoría de la relatividad de Einstein: la inmutabilidad de la velocidad de la luz en el vacío, sea cual sea el sistema de referencia utilizado para medirla, convirtiendo esta propiedad en uno de los patrones de los que se deducen otras unidades.

Aparte de todo lo que antes hemos explicado, no sería justo finalizar el trabajo sin exponer aquí que, en 1905, Albert Einstein, inspirado en el cuanto de Planck, realizó un importante avance en el conocimiento de lo que es la luz. Demostró que el Efecto fotoeléstrico sólo podía ser explicado con la hipótesis de que la luz consiste en un chorro de fotones de energía electromagnética discretos.

El conflicto entre la teoría ondulatoria y corpuscular de la luz fue resuelto con la evolución de la teoría cuántica y la mecánica ondulatoria que ha dejado claro que, los electrones y las otras partículas elementales tienen propiedades duales de partículas y onda.

sería mucho más largo, pero creo que está bien con lo dicho.

emilio silvera

Jun

3

¡Qué maravilla! Poder imaginar…y comprobar

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

Algunos consideran que unos 400 mini agujeros negros podrían atravesar la Tierra cada año. Además, podrían ser detectables por sus fuertes emisiones electromagnéticas. Quizás ha llegado la hora de buscarlas. Cosas como esta se leen de vez en cuando y también otras que…

“Como si de fantasmas cósmicos se tratase, es posible que agujeros negrosen miniatura atraviesen la Tierra diariamente sin crear ningún peligro, como sugiere un estudio reciente.

Esta nueva teoría pone fin al temor de que poderosas máquinas como el Gran Colisionador de Hadronespuedan crear agujeros negros capaces de tragarse el planeta.

Los autores del estudio creen que estos minúsculos agujeros negros tienen un comportamiento completamente distinto al de sus hermanos mayores, llamados agujeros negros astrofísicos o de masa estelar.

A pesar de tener la masa de aproximadamente mil coches, un mini agujero negro es más pequeño que un átomo. Con ese tamaño un agujero negro no podría atraer mucha materia y en su lugar atraparía átomos y algunas moléculas más grandes a órbitas circulares, al igual que los protones atraen a los electrones en los átomos.

Así, los autores del estudio llaman a los mini agujeros negros que atraen materia a las órbitas «equivalentes gravitatorios de los átomos».”

¿Os acordáis? Tanto miedo a que el Gran Colisionador de Hadrones (LHC) de Ginebra formara un agujero negro que podría haber atraído toda la materia a su alrededor y que pudiera haber destruido el planeta y resulta que, según un grupo de investigadores, es posible que este tipo de fenómenos, al menos los que son muy diminutos, atraviesen la Tierra cada día sin que ocurra absolutamente nada, son inofensivos y su ínfimo tamaño los hace inofensivos. Y esto, según un atrevido estudio publicado por una pareja de físicos en arXiv. org, porque quizás interactúen con la materia de forma muy diferente a como se creía hasta ahora.

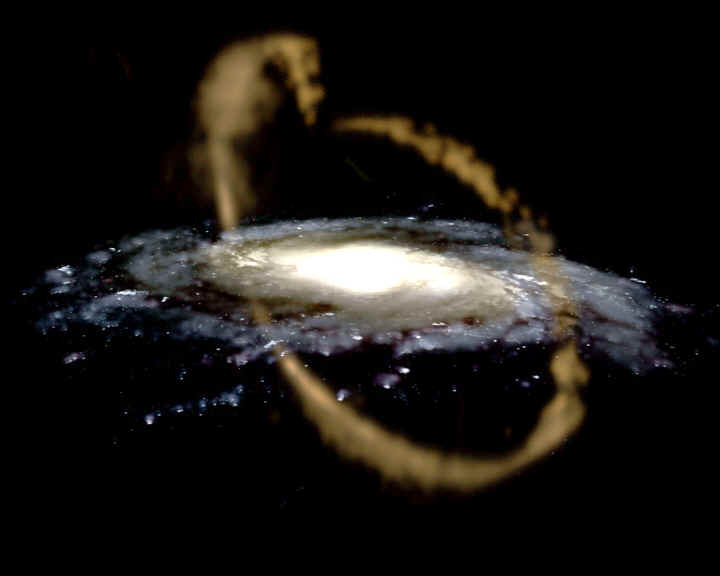

Los mini agujeros negros (si realmente existen) podrían ser diferentes a los gigantes que nos ha enseñado la astrofísica y cuya imagen todos tenemos en la cabeza. Los agujeros astrofísicos se originan cuando se colapsan las grandes estrellas para crear una región en el espacio cuya gravedad es tan potente que nada puede escapar a su atracción. Sus dimensiones son monstruosas. El que se encuentra en el centro de nuestra galaxia tiene 4 millones de veces la masa del Sol.

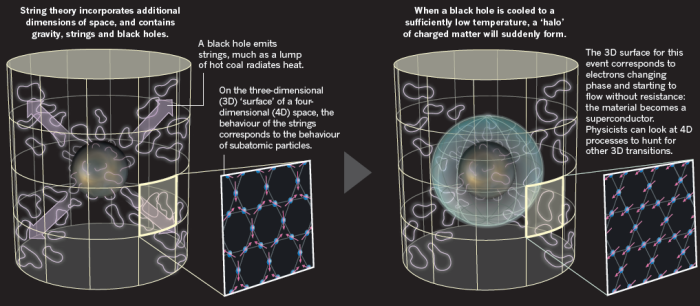

Todo esto me recuerda lecturas en las que, un gran físico, Gerard ´t Hooft, nos contaba como había dedicado gran parte de su tiempo al estudio y la investigación del comportamiento de los agujeros negros y de cómo las consideraciones obtenidas le llevaron a ese alto nivel sobre las leyes últimas de la física. Él suponía tener un pequeño agujero negro que obedecía tanto a las leyes de la mecánica cuántica como a las de la gravedad y, se preguntaba: ¿cómo se debería describir su comportamiento?

¿Se comportaría ese agujero negro como si fuera un átomo o molécula que obedece las leyes de la mecánica cuántica? No todo el mundo está de acuerdo con ese punto de vista. Algunos dicen que los agujeros negros son algo totalmente diferentes. ¿Pero que es tan diferente en ellos? Los agujeros negros emiten partículas, igual que hacen los átomos radiactivos. Entonces, ¿por qué no deberían seguir las mismas reglas? Para decirlo de otra manera más clara, ´t Hooft creía que ellos tenían que obedecer absolutamente esas leyes si tenemos que creer en alguna clase de “ley y orden” a escala de la longitud de Planck.

Uno de los resultados de sus cálculos le produjo una enorme sorpresa. ¡Se encontró prácticamente con las mismas expresiones matemáticas que las de la Teoría de cuerdas! La fórmula para la captura y emisión de partículas por un agujero negro es exactamente igual a la fórmula de Veneziano. Aquello era extraño ya que no era un tema de cuerdas.

Muchas son las sorpresas que nos darán todavía los agujeros negros que esconden muchos secretos sin desvelar, y, como otras muchas cosas del universo tienen propiedades que desconocemos.

Claro que la teoría de cuerdas está por acabar y es difícil predecir si finalmente será compatible con la teoría de la Gravedad. En cualquier caso, ambas teorías están incompletas y tienen mucho más que decir…en el futuro. Seguramente serán simplemente los comienzos de algo mucho más profundo y bello que, de una vez por todas nos explique como es, en realidad, el Universo que habitamos.

La deformación del espacio-tiempo, de la materia, las transiciones de fase aún no comprendidas, lo que hay más allá de los Quarks, esas cuerdas vibrantes que se suponen…serán el primer estadio de la materia. Si creemos a Stephen Hawking, los agujeros negros son sólo el principio de algo más profundo, de una deformación mucho más seria del “espaciotiempo espumoso”.

Allí donde está presente la espuma cuántica de la que hablaban Wheeler y Planck. Y eso no es todo. Algunos como el mismo Hawking y sobre todo Sydney Coleman de Harvard, especulan con el papel que en todo esto juegan los “agujeros de gusano”, esos conductos del espaciotiempo que nos podrían llevar hacia otras latitudes muy lejanas e incluso, hacia otras galaxias. Tales rarezas son admitidas por la teoría de Einstein y, como nuestra imaginación es imparable… Pasa lo mismo que ocurre en la mecánica cuántica, en la que todo lo que está permitido sucede obligatoriamente, es decir, si alguna configuración es posible, ésta tiene una probabilidad de que realmente ocurra.

Claro que, seguramente y al final del camino, los agujeros de gusano sólo serían una semilla que daría lugar al nacimiento de una teoría mejor, más avanzada y fiable que nos marcara el verdadero camino para burlar el muro que supone la velocidad de la luz sin tener que violar esa constante.

Muchas son las cosas que aún nos resultan misteriosas pero, ¿Qué alcanzaremos en el futuro? ¿Podremos realmente dominar y disponer de la energía de Planck que nos lleve hasta lugares inimaginables? ¿Serán nuestras mentes capaces de evolucionar hasta el extremo de que, algún día muy lejano en el futuro pudiéramos estar conectados con el ritmo vital del Universo, la energía pura que todo lo rige? Manejar esas potentes energías sería manejar los mundos, el espacio y, sobre todo, el Tiempo tan vital para nosotros.

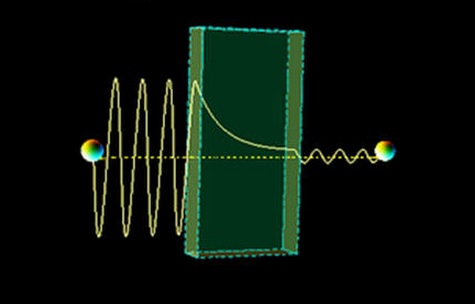

¡Atravesar la pared y salir por el otro lado! El principio de incertidumbre da lugar también a un efecto curioso conocido como efecto túnel: si se dispara un perdigón de plástico contra un muro el perdigón rebotará, porque no tiene energía suficiente para penetrarlo, pero a nivel de partículas fundamentales, la mecánica cuántica muestra inequívocamente que las funciones de onda de las partículas que constituyen el perdigón tienen todas ellas una parte diminuta que SÍ SALE a través del muro.

Está claro que si nos dejamos llevar por nuestras elucubraciones, sin querer, nos metemos en terrenos donde las ideas comienzan a ser extravagantes, entramos en el ámbito de la filosofía y, ¿por qué no? en el de la ciencia ficción pensando en lo que podría ser. Comenzamos a imaginar como viajaremos en el futuro imitando a los electrones cuando dan su “salto cuántico” y, de esa manera, iremos tan ricamente de un universo a otro al dominar esa cosmología cuántica quen nos permitirá realizar ¡tantas maravillas!

Así, las partículas microscópicas pueden tomar prestada energía suficiente para hacer lo que es imposible desde el punto de vista de la física clásica, es decir abrirse camino, como por un túnel, a través del muro aunque dado la enorme cantidad de partículas que posee el muro el efecto túnel se vuelve muy improbable pues todas y cada una de las partículas tendrían que tener la suerte de poder abrirse camino juntas

Esta escena que la hemos visto en muchas películas, sólo podría ser posible si no estuvieran los electrones rodeando a los átomos que conforman la pared. Cuando batimos palmas, por ejemplo, nuestras manos no pasan la una a través de la otra precisamente por eso, porque los electrones lo impiden y forman un caparazón electromagnético alrededor de todos los átomos que componen nuestras manos que, al batirlas chocan entre sí.

Cuando dejamos volar nuestra imaginación ayudada por los pocos conocimientos que de las cosas tenemos, podemos llegar a conclusiones realmente curiosas.

emilio silvera

May

22

¿Qué habrá más allá del Modelo Estándar de la Física de Partículas?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

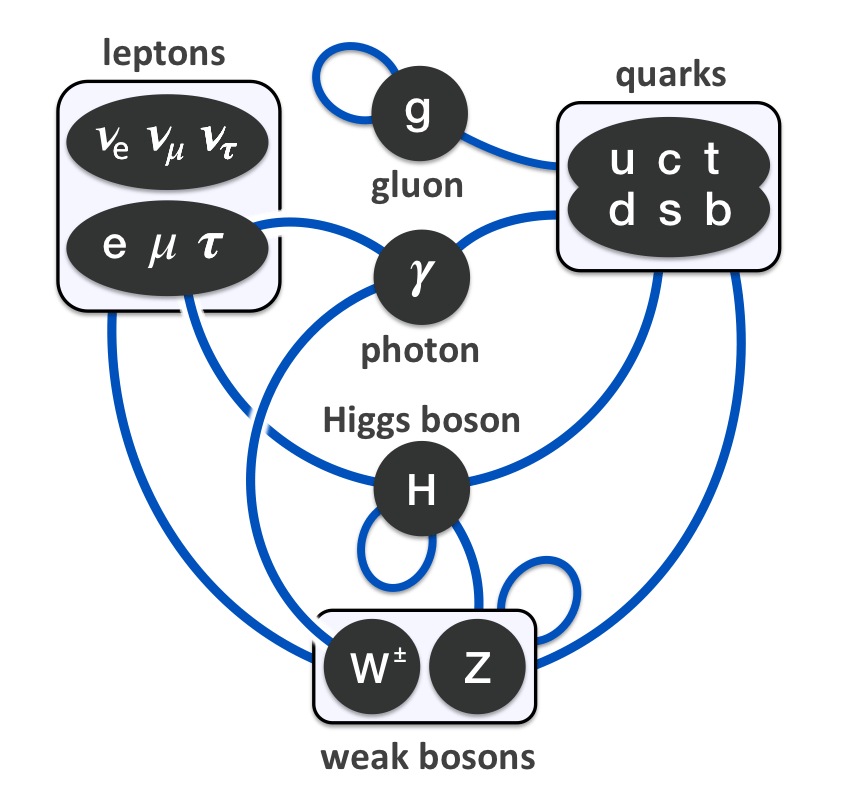

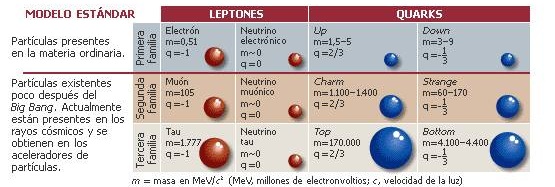

“Inicialmente, se presenta, de modo simplificado, el Modelo Estándar como una teoría sofisticada que identifica las partículas elementales y sus interacciones. Después, en el ámbito de esa teoría, se enfocan aspectos –el vacuo no es vacío; partículas desnudas y vestidas; materia oscura y viento oscuro; materia y antimateria; el campo y el bosón de Higgs; neutrinos oscilantes– que pueden ser motivadores desde el punto de vista de la enseñanza y del aprendizaje de la Física. Finalmente, se discute la probable superación de esa teoría por otra más completa.”

“… el Modelo Estándar es, en la historia, la más sofisticada teoría matemática sobre la naturaleza. A pesar de la palabra “modelo” en su nombre, el Modelo Estándar es una teoría comprensiva que identifica las partículas básicas y especifica cómo interactúan. Todo lo que pasa en nuestro mundo (excepto los efectos de la gravedad) es resultado de las partículas del Modelo Estándar interactuando de acuerdo con sus reglas y ecuaciones.”

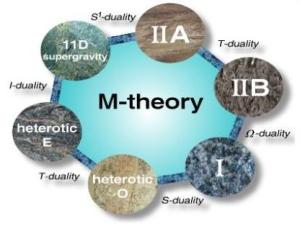

“La teoría de cuerdas es un intento por unificar estos dos mundos en un modelo matemático que funcione en todas las escalas. Pero ocurrió algo no muy deseable. En un breve espacio de tiempo surgieron 5 versiones distintas del modelo, lo que le restó credibilidad. La Teoría-M es una nueva proposición postulada por Edward Witten que unifica esas cinco teorías de las Supercuerdas. Cada una de las versiones de la teoría de cuerdas serían una proyección del del modelo M, del mismo modo que un cilindro proyecta sombras de diferentes formas dependiendo de la dirección de la luz (perdiendo una dimensión).”

La Física actual busca una teoría más amplia que el modelo estándar . Una teoría que dé una descripción completa, unificada y consistente de la estructura fundamental del universo. ¿Será la compleja Teoría de cuerdas,que integra también la interacción gravitatoria?

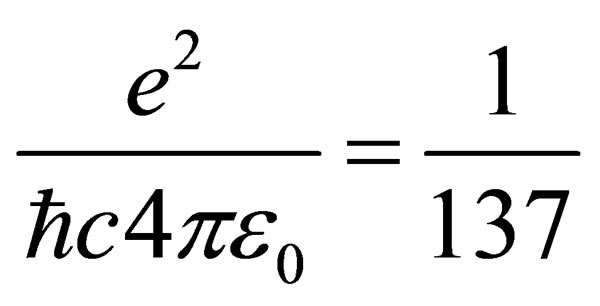

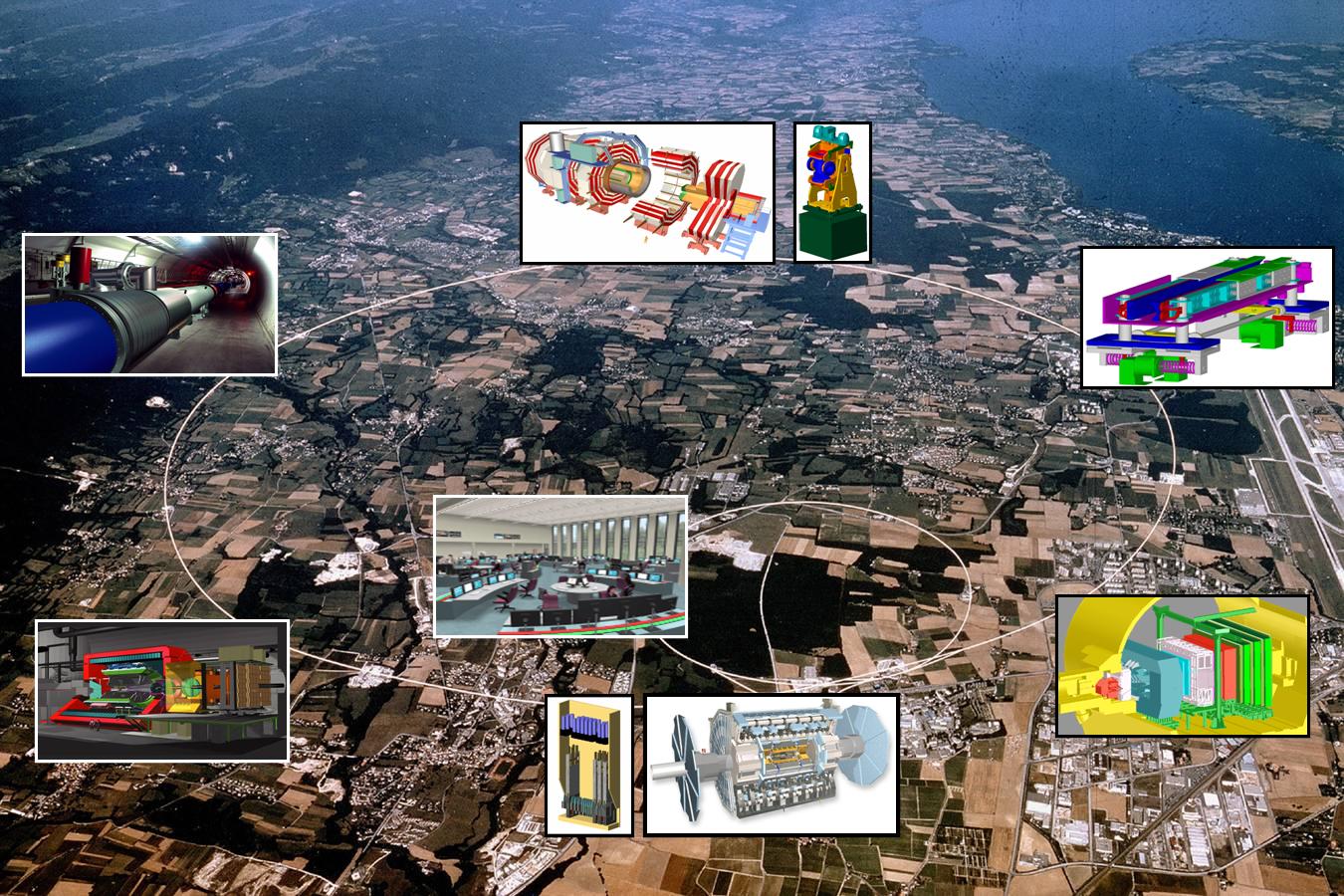

El modelo estándar es una poderosa herramienta pero no cumple todas las expectativas; no es un modelo perfecto. En primer lugar, podríamos empezar por criticar que el modelo tiene casi veinte constantes que no se pueden calcular. Desde luego, se han sugerido numerosas ideas para explicar el origen de todos estos parámetros o números inexplicables y sus valores, pero el problema de todas estas teorías es que los argumentos que dan nunca han sido enteramente convincentes. ¿Por qué se iba a preocupar la naturaleza de una fórmula mágica si en ausencia de tal fórmula no hubiera contradicciones? Lo que realmente necesitamos es algún principio fundamental nuevo, tal como el principio de la relatividad, pero no queremos abandonar todos los demás principios que ya conocemos. Ésos, después de todo, han sido enormemente útiles en el descubrimiento del modelo estándar. El mejor lugar para buscar un nuevo principio es precisamente donde se encuentran los puntos débiles de la presente teoría y, construímos máquinas como el LHC para que nos diga lo que no sabemos.

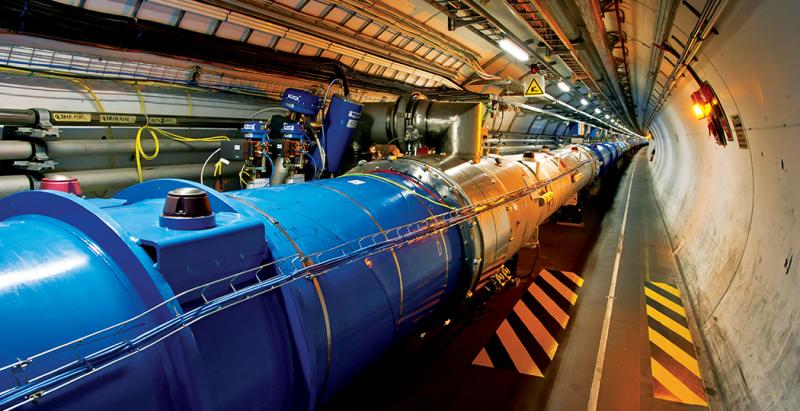

Solo en máquinas inmensas se puede llegar a desentrañar los secretos de la materia

Una regla universal en la física de partículas es que para partículas con energías cada vez mayores, los efectos de las colisiones están determinados por estructuras cada vez más pequeñas en el espacio y en el tiempo. El modelo estándar es una construcción matemática que predice sin ambigüedad cómo debe ser el mundo de las estructuras aún más pequeñas. Pero existen varias razones para sospechar que sus predicciones pueden, finalmente (cuando podamos emplear más energía en un nivel más alto), resultar equivocadas.

Vistas a través del microscopio, las constantes de la naturaleza parecen estar cuidadosamente ajustadas sin ninguna otra razón aparente que hacer que las partículas parezcan lo que son. Hay algo muy erróneo aquí. Desde un punto de vista matemático no hay nada que objetar, pero la credibilidad del modelo estándar se desploma cuando se mira a escalas de tiempo y longitud extremadamente pequeñas, o lo que es lo mismo, si calculamos lo que pasaría cuando las partículas colisionan con energías extremadamente altas. ¿Y por qué debería ser el modelo válido hasta aquí? Podrían existir muchas clases de partículas súper pesadas que no han nacido porque se necesitan energías aún inalcanzables. ¿Dónde está la partícula de Higgs? ¿Cómo se esconde de nosotros el gravitón?

Parece que el Modelo estándar no admite la cuarta fuerza y tendremos que buscar más profundamente, en otras teorías que nos hablen y describan además de las partículas conocidas de otras nuevas que están por nacer y que no excluya la Gravedad. Ese es el Modelo que necesitamos para conocer mejor la Naturaleza.

Claro que las cosas no son tan sencilla y si deseamos evitar la necesidad de un delicado ajuste de las constantes de la naturaleza, creamos un nuevo problema: ¿cómo podemos modificar el modelo estándar de tal manera que el ajuste fino no sea necesario? Está claro que las modificaciones son necesarias, lo que implica que muy probablemente haya un límite más allá del cual el modelo tal como está deja de ser válido. El modelo estándar no será nada más que una aproximación matemática que hemos sido capaces de crear, de forma que todos los fenómenos que hemos observado hasta el presente están reflejados en él, pero cada vez que se pone en marcha un aparato más poderoso, tenemos que estar dispuestos a admitir que puedan ser necesarias algunas modificaciones del modelo para incluir nuevos datos que antes ignorábamos.

Más allá del modelo estándar habrá otras respuestas que nos lleven a poder hacer otras preguntas que en este momento, no sabemos ni plantear por falta de conocimientos. Si no conociéramos que los protonesestán formados por Quarks, ¿cómo nos podríamos preguntar si habrá algo más allá de los Quarks?

El gobierno de Estados Unidos, después de llevar gastados miles de millones de dólares, suspendió la construcción del supercolisionador superconductor de partículas asestando un duro golpe a la física de altas energías, y se esfumó la oportunidad para obtener nuevos datos de vital importancia para el avance de este modelo, que de momento es lo mejor que tenemos.

Se han estado inventando nuevas ideas, como la supersimetría y el technicolor. Los astrofísicos estarán interesados en tales ideas porque predicen una gran cantidad de nuevas partículas superpesadas, y también varios tipos de partículas que interaccionan ultradébilmente, los technipiones. Éstas podrían ser las WIMP’s (Weakly Interacting Massive Particles, o Partículas Masivas Débilmente Interactivas) que pueblan los huecos entre las galaxias, y serían así las responsables de la masa perdida que los astrofísicos siguen buscando y llaman “materia oscura”.

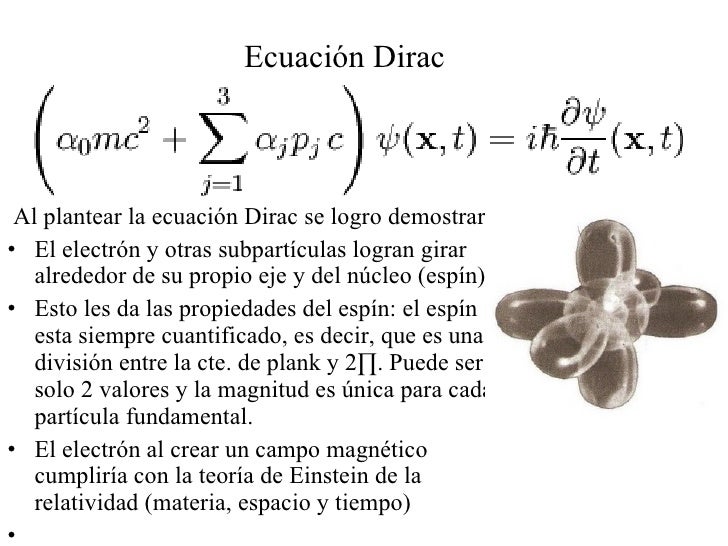

Que aparezcan “cosas” nuevas y además, imaginarlas antes, no es fácil. Recordemos cómo Paul Dirac se sintió muy incómodo cuando en 1931 dedujo, a partir de su ecuación del electrón, que debería existir una partícula con carga eléctrica opuesta. Esa partícula no había sido descubierta y le daba reparo perturbar la paz reinante en la comunidad científica con una idea tan revolucionaria, así que disfrazó un poco la noticia: “Quizá esta partícula cargada positivamente, tan extraña, sea simplemente el protón”, sugirió. Cuando poco después se identificó la auténtica antipartícula del electrón (el positrón) se sorprendió tanto que exclamó: “¡Mi ecuación es más inteligente que su inventor!”. Este último comentario es para poner un ejemplo de cómo los físicos trabajan y buscan caminos matemáticos mediante ecuaciones de las que, en cualquier momento (si están bien planteadas), surgen nuevas ideas y descubrimientos que ni se podían pensar. Así pasó también con las ecuaciones de Einstein de la relatividad general, donde Schwarzschild dedujo la existencia de los agujeros negros.

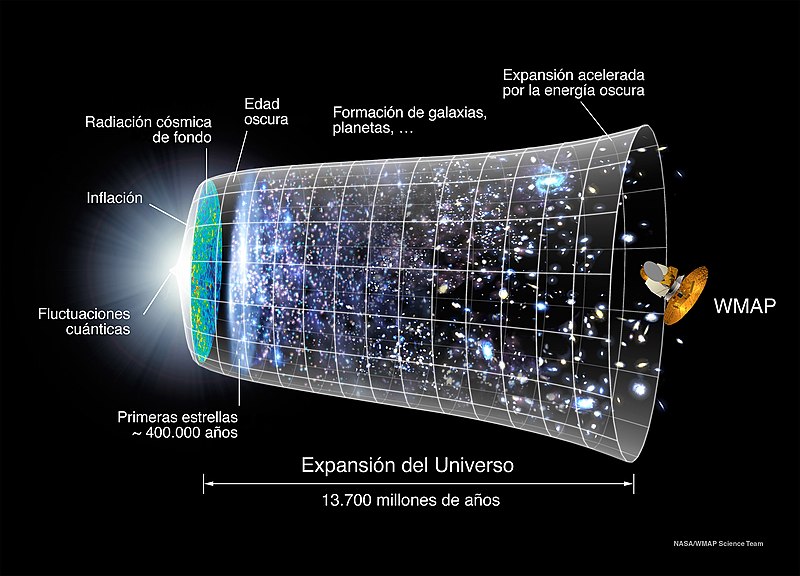

Se piensa que al principio del comienzo del tiempo, cuando surgió el Big Bang, las energías eran tan altas que allí reinaba la simetría total; sólo había una sola fuerza que todo lo englobaba. Más tarde, a medida que el universo se fue expandiendo y enfriando, surgieron las cuatro fuerzas que ahora conocemos y que todo lo rigen. Tenemos los medios, en los supercolisionadores de partículas, para viajar comenzando por 1.000 MeV, hasta finalizar en cerca de 1019 MeV, que corresponde a una escala de longitudes de aproximadamente 10–30 cm. Howard Georgi, Helen Quinn y Steven Weinberg descubrieron que ésta es la región donde las tres constantes de acoplamiento gauge se hacen iguales (U(1), SU(2) y SU(3)); resultan ser lo mismo. ¿Es una coincidencia que las tres se hagan iguales simultáneamente? ¿Es también una coincidencia que esto suceda precisamente en esa escala de longitud? Faltan sólo tres ceros más para alcanzar un punto de retorno. Howard Georgi y Sheldon Glashow descubrieron un modelo genuinamente unificado en el dominio de energías de 1019 MeV tal que, cuando se regresa de allí, espontáneamente surgen las tres fuerzas gauge tal como las conocemos. De hecho, ellos encontraron el modelo; la fórmula sería SU(5), que significa que el multiplote más pequeño debe tener cinco miembros.

Materia y Energía Oscura… Un Misterio…Sin resolver.

Y, a todo esto, ¿dónde está esa energía oculta? ¿Y donde la materia? Podemos suponer que la primera materia que se creo en el Universo fue la que llamamos (algún nom,bre había que ponerle) “Materia Oscura”, esa clase de Ilem o sustancia primera del Universo que mejor sería llamarla invisible, ya que, de no ser así, difícil sería explicar cómo se pudieron formar las primeras estrellas y galaxias de nuestro Universo, ¿dónde está el origen de la fuerza de Gravedad que lo hizo posible, sino en esa materia escondida?

¡Lo dicho! Necesitamos saber, y, deseo que de una vez por todas, se cumpla lo que dejó dicho Hilbert en su tumba de Gotinga (Alemania): “Tenemos que saber, ¡sabremos!. Pero…

¡Que sea pronto!

emilio silvera

May

16

¿Qué haríamos sin la Física?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

Bueno, lo que hasta el momento hemos logrado no está mal del todo pero, no llega, ni con mucho, a la perfección que la Naturaleza refleja y que, nosotros perseguimos sin llegar a poder agarrar sus múltiples entresijos y parámetros que conforman ese todo en el que, sin ninguna clase de excusas, todo debe encajar y, de momento, no es así. Muchos son los flecos sueltos, muchas las incógnitas, múltiples los matices que no sabemos perfilar.

Es cierto que, el Modelo estándar, en algunos momento, nos produce y nos da la sensación de que puede ser perfecto. Sin embargo, esa ilusoria perfección, no es permanente y en algunas casos efímera. En primer lugar, podríamos empezar a quejarnos de las casi veinte constantes que no se pueden calcular. Pero si esta fuese la única queja, habría poco que hacer. Desde luego, se han sugerido numerosas ideas para explicar el origen de estos números y se han propuesto varias teorías para “predecir” sus valores. El problema con todas estas teorías es que los argumentos que dan nunca llegan a ser convincentes.

Existen límites a los que aún no han podido llegar nuestras teorías, y, el Límite de Planck es el que marca las fronteras de las teorías actuales que, nunca han podido llegar tan lejos, como lo que nos dice la simple ecuación:

Un día de 1.900, se publicó un artículo de ocho páginas que sentaron las bases de la Mecánica Cuántica. Su autor, Max Planck, cambió conceptos clásicos traernos una nueva visión del universo infinitesimal (10 con exponente -35 m.) a una distancia conocida como límite de Planck , mucho más allá de donde los Quarks están confinados en tripletes formando protones y neutrones y la fuerza nuclear fuerte tiene su dominio y se deja sentir a través de los bosones portadores, los Gluones.

Hasta el mismo Planck, al ver todo aquello fue consciente de que, sus 40 años anteriores de creencias como físico, se habían ido al garete y ahora, tendrían que convivir con los nuevos conceptos en los que encontraban situaciones esxtrañas y muy alejadas de las cosas que ocurrían en el macro mundo.

Los agujeros de gusano del inter-universo que asocian un universo con otro diferente y son denominados agujeros de gusano de Schwarzschild. Esto nos permite especular si tales “pasajes” podrían usarse para viajar de un universo a otro paralelo. Otra aplicación de estos túneles cósmicos podría ser el viaje en el tiempo. En ese caso sería un atajo para desplazarse de un punto espaciotemporal a otro diferente. En la teoría de cuerdas un agujero de gusano es visualizado como la conexión dos D-branas, donde las bocas están asociadas a las branas y conectadas por un tubo de flujo. Se cree que los agujeros de gusano son una consecuencia de la espuma cuántica o espaciotemporal.

El vacío estable y absoluto de Newton, con trayectorias continuas y determinadas, ha dejado paso al vacío cuántico asociado a unas extrañas trayectorias (*) discontinuas y fracturadas, llamadas por ello trayectorias fractales (no son propiamente trayectorias). La existencia del cuanto de acción o constante de Planck (se llama acción al producto de una energía por un tiempo), base de la física cuántica, es la causa de ese cambio fundamental, y de otros muchos, con profundas consecuencias. Mediante la geometría fractal, este marco nos ofrece nuevas e interesantes perspectivas.

Planck, nos habló del “cuanto” de acción h, y nos dijo que la energía se transmite en paquetes de manera discontinua. Aquello, asombró al mundo y el mismo Planck fue consciente de que, sus creencias sobre la Física, a partir de ese momento, serían otras.

Inspirado en el de Planck, Albert Einstein desarrollo un sobre el “Efecto Fotoeléctrico ” – que le valió el Nobel de Física de 1.921 – y, contribuyó de manera activa al desarrollo de la Mecánica Cuántica que, más tarde, combatió.

La noción del entrelazamiento cuántico es una idea nada nueva que se remonta a principio del siglo XX, a 1900, cuando el físico alemán Max Planck, considerado el padre de la teoría cuántica, propuso que no podemos hablar de una cantidad infinita de energía, sino que se transmite en pequeñas cantidades o paquetes llamados cuantos. En 1905, Albert Einstein, basándose en los experimentos de otro gran físico, Philipp Lenard, sobre el efecto fotoeléctrico, propuso que las ondas de luz se pueden propagar como ondas y como partículas al mismo tiempo. De hecho, propuso al fotón como la partícula portadora de la luz.

El Principio de Incertidumbre de Heisenberg

La función de Onda de Schrödinger

La ecuación de Dirac

Los gráficos de Feynmann

Llegaron nuevos Físicos como Werner Heisenberg, Schrödinger, Dirac, Feynman y otros que, desarrollaron lo que hoy conocemos como Mecánica Cuántica. Heisenberg con su Principio de Incertidumbre nos demostró que no podíamos saberlo todo al mismo tiempo. Si queremos conocer la situación de un electrón y para ello utilizamos un microscopio electrónico, el mismo hecho de su utilización transformará el medio observado, ya que, los fotones enviados por el microscopio cambiarán la dirección de dicho electrón. De esta manera, podemos saber dónde está, pero no sabremos a donde se dirige.

Schrödinger, con su función de onda, nos dio una buena herramienta buscar la partícula mediante un sistema de alta probabilidad de su situación.

La Mecánica cuántica describe el instantáneo de un sistema (estado cuántico) con una función de onda que codifica la distribución de probabilidad de todas las propiedades medibles, u observables. Algunos observables posibles sobre un sistema dado son la energía, posición, momento y momento angular. La mecánica cuántica no asigna valores definidos a los observables, sino que hace predicciones sobre sus distribuciones de probabilidad. Las propiedades ondulatorias de la materia son explicadas por la interferencia de las funciones de onda. Estas funciones de onda pueden variar con el transcurso del tiempo. Esta evolución es determinista si sobre el sistema no se realiza ninguna medida aunque esta evolución es estocástica y se produce mediante colapso de la función de onda cuando se realiza una medida sobre el sistema. Por ejemplo, una partícula moviéndose sin interferencia en el espacio vacío puede ser descrita mediante una función de onda que es un paquete de ondas centrado alrededor de alguna posición media. Según pasa el tiempo, el centro del paquete puede trasladarse, cambiar, de modo que la partícula parece estar localizada más precisamente en otro lugar. La evolución temporal determinista de las funciones de onda es descrita por la Ecuación de Schrödinger.

La Mecánica Cuántica ha alcanzado unas cotas increíbles de consistencia y experimentalmente, es una de las teorías más acreditadas. Sin embargo, mi parecer es que siendo una herramienta muy útil para los Físicos, no es la definitiva, en un futuro próximo tendremos muchas sorpresas de la mano del LHC que en este mismo año nos dará alguna alegría importante para el mundo de la Física.

El otro gran pilar en el que se apoya la Física, se llama Relatividad Especial. Todos sabéis lo que fue para la Física el año 1.905. Esa primera de la teoría relativista de Einstein, nos legó conocimientos muy importantes, tales como que un objeto viajando a velocidades cercanas a la de la luz aumenta su masa o que el hipotético viajero de una nave espacial que viaje a ésas velocidades relativistas, habrá conseguido ralentizar su tiempo. El tiempo pasa más lento cuando la velocidad es grande. Y, el otro logro importante que fue resumido en la ecuación más famosa de la historia de la Física, fue el hecho de que la masa y la

energía son dos aspectos de la misma cosa. ¡cuánta belleza y profundidad expresado en tan poco espacio!

En un espacio de cuatro dimensiones, cada uno de los tensores representa una cantidad física que consta de 16 componentes y la cual puede ser representada …

Albert Einstein realizó una verdadera hazaña intelectual y nos legó su teoría General de la Relatividad, una teoría construida la pura geometría, excediéndose en elegancia y efectiva en su espacio de aplicación. La relación entre el cuerpo y la curvatura del espacio-tiempo, es equivalente (Gµv). Significa, la manifestación visible o invisible de la energía [m=e/c2], y en este caso, manifestada en la forma masiva del cuerpo, curva el espació-tiempo.

La Humanidad ha conseguido logros increíbles en el campo de la Física, siempre acompañada de las matemáticas, han llegado a dejar al descubierto cuestiones misteriosas y muy bien escondidas en lo más profundo de la materia y de las fuerzas fundamentales que interaccionan con ella.

nos podemos plantear preguntas que nadie sabe contestar e incluso algunas que no sabemos ni plantear, nos faltan conocimientos para hacer tales preguntas. Sin embargo, en el futuro, las respuestas llegaran.

¿Cómo podría haber preguntado Pitágoras por el significado de m=E/c2 (E=mc2), si Einstein nació más de 2.000 años más tarde?

Dualidades teoría de cuerdas y teoría M

“Los análisis bibliométricos del ISI Web of Science parecen indicar que, con 4 artículos de los 10 más candentes en la física de 2009, la teoría de cuerdas está viviendo su tercera revolución gracias a la teoría de M2-branas de Bagger-Lambert. La segunda revolución, la de la dualidad, resaltó la importancia de la teoría M, pero sólo logró que entendiéramos muy bien las D-branas. La tercera revolución parece que tiene por objeto entender bien las M-branas, de las que prácticamente no se sabía nada antes de la teoría de Bagger-Lambert. Curiosa manera tienen los físicos de cuerdas de celebrar las bodas de plata de su primera revolución. Fuente: Simon Mitton, “Is This the Third Revolution for String Theory?,” en “HAT´S HOT IN…PHYSICS, March/Aprin 2.000,” del Thomson/Reuters ISI Science Watch. Los Hot Papers son los artículos que más rápidamente están siendo citados en el ISI Web of Science. Entre los 10 hot papers de Física en 2009, los 4 sobre teoría de cuerdas están en los puestos #4, #6, #9, y #10, y todos describen propiedades de las M2-branas. Hacía 10 años ( la segunda revolución de la teoría de cuerdas) que no ocurría algo así. ¿Estamos viviendo la tercera revolución de la teoría de cuerdas?”

De la misma manera estamos hoy haciendo preguntas o formulando teorías que no pueden ser contestadas o comprobadas. La energía de Planck (1019 GeV) nos vendría muy bien para poder comprobar la teoría M que ha unificado todas las teorías existentes sobre la teoría de cuerdas. Sin embargo, nuestra civilización actual no tiene la posibilidad de alcanzar dicha energía y habrá que esperar mucho tiempo para que eso sea posible.

No podemos dejar por ello de de trabajar en ese campo de las cuerdas, es prometedor e ilusionante, allí, en las más altas dimensiones, parece que es posible hermanar a la Mecánica Cuántica y a la Relatividad General. Esta teoría nos promete por fin una teoría cuántica de la gravedad.

Esquema de la gravedad cuántica de bucles, una de las líneas de trabajo actualmente en la gravedad cuántica. Existen muchas otras y ello, viene a denotar nuestra ignorancia del tema que, en realidad, no dominamos y no dejamos de teorizar lanzando conjeturas e hipótesis que aún no se han visto cumplidas y, lo más cerca que estamos de esa teoría que consigue el casamiento de la Relatividad General con la Mecánica cuántica, está en la Teoría de cuerdas que, como sabéis, tampoco es verificable.

La “relatividad general” opera en la geometría del “espaciotiempo”; una “teoría cuántica de la gravedad” debería ser, además, una “teoría cuántica” del “espaciotiempo”.

La verdad es que, hay muy pocos lugares en el universo donde la relatividad general no sea importante. Para la vida cotidiana, para enviar sondas por el sistema solar, y para cualquier otra situación en la que es probable que nos hallemos, no necesitamos preocuparnos por la relatividad general. teoría es importante en el ámbito del Universo cuando se habla de grandes masas como estrellas y galaxias, o, planetas…cuerpos con mas de cierta importancia. Para las partículas individuales subatómicas, la fuerzas es despreciable. Sin embargo, en presencia de planetas como Júpiter, el espaciotiempo se curva.

Puede parecer ciencia ficción hablar y exponer hechos y conceptos que no pueden ser demostrados, sin embargo, Einstein esperó largos años con su teoría de la Relatividad General bien asentada en su cabeza, sin poder exponerla al mundo por no tener las matemáticas necesarias para ello, y, cuando su amigo Marcel Grossman, al que había pedido ayuda, le envió algunos documentos los que se encontraba la famosa Conferencia de Riemann, Einstein quedó paralizado ante el Tensor Métrico de Riemann, allí tenía la herramienta que estaba buscando y que le permitía formular de manera precisa los espacios curvados de la relatividad general.

Las grandes masas determinan la geometría del Universo forman espacios curvos que se comportan como calles y laberintos por los que discurren los objetos de materia que deambulan por el espaciotiempo tetradimensional de nuestro universo que, si tiene dimensiones extra, las tiene bien escondidas.

Algún día, alguien surgirá y nos traerá las matemáticas necesarias para que, la teoría M se pueda exponer de manera clara y completa. ¿Serán las funciones modulares de Ramanujan las que nos sacará del atolladero? Todos sabéis que las matemáticas topológicas de la Teoría M, son extremadamente difíciles, pocos tienen acceso a ellas, y, de momento, parece que nadie está en posesión de los conocimientos matemáticos que se precisan.

Tendremos que esperar un poco. Sin embargo, la Ciencia futura está a la vuelta de la esquina:

La nanotecnología es un campo de las ciencias aplicadas dedicado a la manipulación de material a la escala menor de un micrómetro es decir al nivel de atomos y moléculas (nanometría) lo mas habitual es que tal manipulación se produzca uno o 1000 nanometros para hacer una idea de como son los nanobotts un nanobot mide 50 nm sus capas son de 5 molecula.

Pronto veremos que la nanotecnología nos llevará a un mundo futuro que ahora, ni podemos imaginar

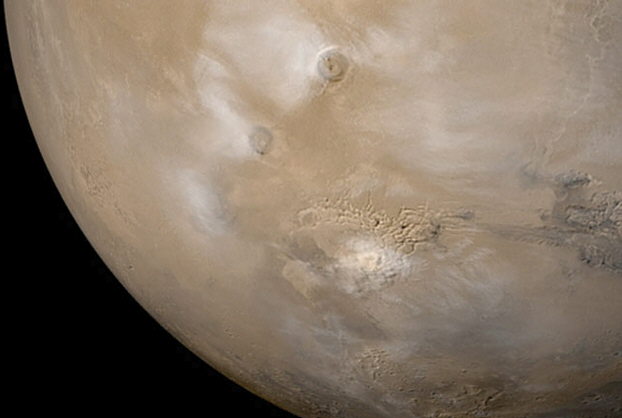

¿Qué no podremos construir con las nuevas técnicas de nanotecnología? Inundaremos los planetas lejanos de minúsculos robots que no serán detectados y nos podrán inviar información fidedigna de todo lo que queramos? Por ahí podría ir el futuro, menos coste en los lanzamientos bases lunares o marcianas y, en pequeñas naves podrían ir cientos de robots que se esparcirían por todo el pequeño o gran mundo a explorar.

nuestra curiosidad es inagotable, nos empuja a preguntar, trabajar, estudiar, investigar y profundizar en todas estas cuestiones que atrae a todos aquellos que, como yo, enamorados de la Física, saben que, algún día lejano en el futuro, nuestra Civilización alcanzará el nivel requerido para poder abrir esas puertas que tenemos cerradas y de las que no tenemos las llaves para poder abrirlas. Encima de estas puertas, los letreros dicen: Teoría M, Materia Oscura, Densidad Crítica, Universos paralelos, Viajes en el Tiempo, Singularidades, etc.

Me gustaría estar presente cuando pasados algunos siglos, nuestra especie tenga como fuente de energía inagotable la que generan los Agujeros Negros. Esa energía nos dará la posibilidad de viajar a las estrellas y de llegar al fondo de la teoría M.

Cuerdas vibrantes de cuyas resonancias surgen nuevas partículas.

No debemos olvidar que, todo lo grande está hecho de cosas pequeñas. Así es. Al menos hasta donde sabemos, los planetas, las estrellas y Galaxias y demás objetos estelares (nosotros también), están hechos de infinitesimales objetos: Quarks y Leptones. Todo lo que podemos ver en el Universo está hecho de materia bariónica, existe otra clase de materia que aún no sabemos lo que es, dónde está o se genera y de qué está hecha (esa que nuestra ignorancia denomina Materia Oscura)..

La materia primordial del Universo fue denominada por los griegos clásicos como Ylem sustancia cósmica

¡Nuestra imaginación! algo que solo ser comparada con la grandiosidad del Universo que… es casi tan grande como ella.

¿Cuánto más podrá salir de la maravilla llamada Mente?

La Mecánica Cuántica.

La Relatividad Especial y la Relatividad General.

El Modelo Estándar.

Las fuerzas Fundamentales.

Las Constantes Universales.

Las familias de partículas: Quarks (u, d, s, c, t, b), Hadrónes (bariones y mesones), los Leptones (electrón, muón, tau y sus respectivos neutrinos).

La Teoría M y la de Supersimetría, Supergravedead, la de cuerdas, la cuerda heterótica.

En su día la teoría de Kaluza-Klein (la primera de más altas dimensiones)

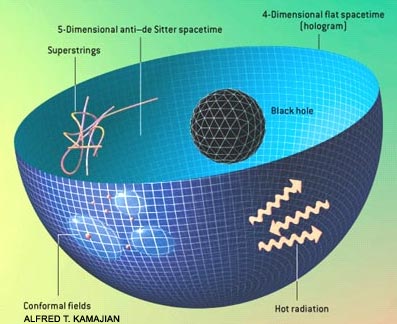

Hablamos de Universos holográficos

Y, de esta manera podríamos exponiendo ejemplos enormes de la imaginación que poseemos y que es el don que la humanidad tiene para descubrir los misterios del Universo. Einstein llamaba a esto ejercicios mentales. Está bien que nuestras mentes no tengan límites a la hora de imaginar. Creo que, a excepción de las imposibilidades y barreras impuestas por nuestro físico, todo lo demás, con el tiempo podrá ser posible. Hasta tal punto es así que, hasta podremos (ya lo hemos hecho) hacer que nuestras vidas sean más duraderas.

Alguien dijo que Genio es aquel que es capaz de plasmar en realidad sus pensamientos. Pues, amigos, en la Física han sido muchos los genios que han aportado su imaginación.

La pregunta que hay que responder aquí es lo que se entiende por Física. Por mi parte, Física es todo lo que aquí he dejado escrito y muchísimo más. Creo firmemente que la Física es el arma más poderosa con la que la Humanidad para resolver todos los problemas que tiene planteados a plazo fijo en el futuro lejano.

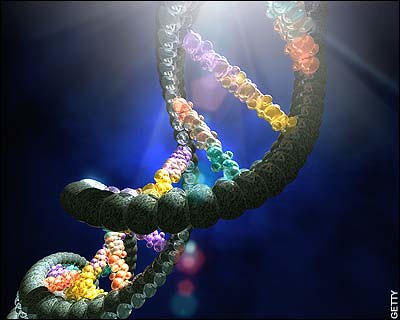

Hasta la vida es Física y Química

¿Habéis pensado alguna vez que el Sol tiene una cantidad de combustible nuclear – hidrógeno – limitado? El día que se acabe, dentro de 4.000 millones de años ¿dónde iremos? La pregunta parece tonta, sin embargo, no lo es. No debemos descansar en el avance del saber científico de la Física y las matemáticas (además de en los otros campos), ya que, en ese no parar estará la solución a todos nuestros problemas presentes y futuros, y, la llave que abrirá la puerta principal, se llama Física (siempre acompañada por la llave maestra de las matemáticas).

Y, mientras tanto, continuará el proceso de humanización que aún está por terminar…¡Nos queda tanto!

emilio silvera

May

8

¡La Física! ¡El Universo! ¡Nosotros!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

El éxito alcanzado por la Física desde finales del siglo XIX hasta esta primera década del siglo XXI no sólo ha transformado nuestra concepción del espacio-tiempo, sino que ha llegado a poner en nuestras mentes una nueva percepción de la Naturaleza: la vieja posición central que asignábamos a la materia ha cedido su lugar a los principios de simetría, algunos de ellos ocultos a la vista en el estado actual del Universo.

Está claro que, los físicos, cada día más ambiciosos en su “querer saber” y su “querer descubrir”, buscan sin descanso nuevos caminos que les lleve a desvelar ocultas maravillas que tienen su hábitat natural en lo más profundo de la Naturaleza misma de la que no sabemos, aún, entender todas sus voces.

Son muchos los obstáculos que se encuentran en ese camino que nos lleva inexorable hacia esa soñada teoría final. Los científicos discrepan de los filósofos que no siempre, están de acuerdo con el hecho de que se pueda llegar a esa teoría última que lo pueda explicar todo, y, la firme creencia de que el Universo siempre tendrá secretos para nosotros, es una constante de la filosofía que la Ciencia, no deja de combatir.

Representación en 3D de la primera colisión en ATLAS. Más imágenes en ATLAS event displays.

Estamos embarcados en una enorme aventura intelectual que eleva al ser humano a la categoría más alta que en el Universo pueda. La Física de altas energías nos llevan a conocer las entrañas de la materia y nos cuenta como se producen esas interacciones en el corazón de los átomos y aunque no sabemos cómo puedan ser las leyes finales ni cuanto será el tiempo que tardaremos en encontrar las pistas que nos guíen por el camino correcto, lo cierto es que, el progreso continúa y cada vez se construyen aceleradores más potentes y sofisticados y telescopios más modernos y con mayor capacidad para transportarnos hacia regiones profundas del Universo en las que podemos contemplar galaxias situadas muy cerca de ese comienzo que llamamos Big Bang.

Como no podía ser de otra manera dado nuestro carácter siempre dispuesto a la controversia y nuestras mentes de pensamientos diversos, la propia idea de una teoría final nos ha llevado a la más profunda discrepancia entre unos y otros. Por una parte, están los partidarios de esa teoría que nos podrá hablar de un Universo de más altas dimensiones, donde la relatividad general de Einstein y la mecánica cuántica de Planck, conviven en la soñada concordia que muchos físicos han soñado y, por la otra, están aquellos que discrepando de los primeros se agarran al pensamiento de la imposibilidad de conseguir una teoría de esas características y, ellos hablan de física-ficción.

Lo cierto es que, a pesar de lo que digan los detractores de estas ideas avanzadas (no pocas veces por envidia y por el simple hecho de que ellos no tienen la capacidad de entender los nuevos conceptos y sus complejas matemáticas), la Física prosigue su camino y en no pocos campos, la lista de los Grupos Especializados que existen en la RSEF es un ejemplo del lugar que la Física ocupa en el ámbito de la Ciencia y en la Sociedad.

Real Sociedad Española de Física

Grupos Especializados dentro de la RSEF:

De Adsorción, de Astrofísica, de Calorimetría y Análisis Térmico, de Coloides e interfases, de Cristalografía y crecimiento cristalino, de Didáctica e Historia de la Física y la Química, de la Física Atómica y Molecular, de la Física del Estado Sólido, de la Física en las Ciencias de la Vida, de Física Estadística y no Lineal, de Física de Altas Energías, de Física de la Atmósfera y del Océano, de Física de Polímeros, de Física Médica, de Física Nuclear, de Física Teórica (del que soy miembro numerario), de Información Cuántica, de Materiales Moleculares, de Reología, de Termodinámica, etc.

Todo esto demuestra el enorme interés que la Física tiene en todos y cada uno de los apartados que la puedan afectar y, lo mismo trata de conseguir un líquido de quarks y gluones que, a temperatura ambiente se convierta en el mejor superconductor, que encontrar el Bosón de Higgs para completar y mejorar el Modelo Estándar, investigar en los campos del electromagnetismo y de la radiación con la mirada puesta en la salud con fines médicos que hagan mejor nuestras vidas (tomografía por emisión de positrones computerizada: un buen uso, no un abuso, de la radiación ionizante, neuroimagen por resonancia magnética, estudio de fisiología cardíaca mediante Ecocardiografía Doppler, Radioterapia con radiación sincrotrón, radioterapia del melanoma ocular, una perspectiva de la biología y la medicina desde la teoría del caos y la geometría fractal, etc. etc.), innumerables y sustanciosas colaboraciones con la Astronomía (Astrofísica), con las ciencias de la vida (Biofísica) y, sería interminable la lista de aquellos apartados del saber de la Humanidad en los que la Física está presente.

Independientemente de los muchos proyectos en marcha (ordenadores cuánticos, energía de vacío, semiconductores magnéticos diluidos (materiales para la espintrónica), nanotecnología y nanociencia, modelos de las dinámicas de las ondulaciones en la nanoarena, materia extraña, tecnologías de la telecomunicación y de la información, capacidad de almacenar información, física de fluidos, estudios del efecto de la irradiación sobre el metano, la física de materiales, teletransportación cuántica, estudio del cristal aperiódico de la vida, interacciones fundamentales, sensores de radiación y detección de alimentos irradiados, simetrías exóticas, fibras ópticas, nanotubos… y seguir enumerando lo que la Física es y la infinidad de campos en los que interviene requeriría muchas horas y muchas páginas de las que no disponemos.

Hemos llegado a saber desde lo muy grande hasta lo muy pequeño que, estando en este mundo nuestro, parece que están en diferentes mundos, toda vez que, lo uno se sitúa en el macro mundo, mientras que lo otro está situado en ese otro “universo” infinitesimal de la cuántica. Sin embargo, ambos “mundos” no han dejado nunca de estar conectados y todo lo grande está hecho de cosas pequeñas. La técnica avanza y los conocimientos nuevos nos posibilitan hacia un futuro que ni podemos imaginar.

A todo esto, nos damos de bruce con problemas tan complejos que la idea que podemos tener hoy de la realidad que sea compatible con los más recientes resultados teóricos y experimentales de la mecánica cuántica. Yo tengo amigos banqueros, Ingenieros, oficinistas, constructores, camareros, mecánicos o marineros que, cuando se les habla de estos temas, miran para otro lado y silban. Poca gente se interesa por estos asuntos que, de su enorme importancia, no sólo depende nuestro bienestar, sino que, en esos conocimientos reside el futuro de la Humanidad.

Si profundizamos, por curiosidad, en los conocimientos que actualmente tenemos de la Astronomía y de la Física o la Química (siempre acompañadas de los números), veremos con admiración que las semillas se pusieron hace ya más de 2.500 años, cuando Tales, Anaximandro o Anaxímes sintieron la curiosidad de conocer y miraron el mundo desde la lógica y, dentro de sus posibilidades trataron de desvelar los secretos de la Naturaleza. Allí, en ese momento, nacio la Ciencia, o, incluso puede que antes en aquellos pensadores de Oriente que ya hablaron de vacío y de átomos y también, de sustancia cósmica.

A medida que el tiempo avanzó, nos dimos cuenta de que, nuestras experiencias cotidianas se alejaban del mundo real y, nuestro sentido común, no siempre nos guiaba en la correcta dirección para poder comprender el mundo. Con frecuencia nos preguntamos: ¿Qué es lo real? ¿Si dentro de nuestras mentes conformamos un “universo” a la medida de nuestras limitaciones –por falta de los datos que nos impide ver la realidad-, cómo podremos llegar a saber la clase de Universo que nos acoge? Aquí nos topamos con el determinismo.

Por lo que se refiere al Universo, caben dos posibilidades: o existe desde siempre o ha tenido un comienzo. ¿Tendría sentido pensar que existió desde siempre? Y, si no ha existido desde siempre, quiere decir que ha tenido un comienzo. ¿Qué había antes? Tal vez nada. Sin embargo, la Física nos dice que la “NADA” no existe y, en ese caso, lo único que podemos hacer es preguntarnos, ¿De dónde salió? Y si había algo que lo formó, ¿Cómo podemos hablar de un comienzo?, ¿No habría que tratar de ir hacia atrás y, buscar el verdadero origen que lo formó? Ante todo esto volvemos al hecho de que el determinismo se refiere a dos cosas a la vez:

- si todo acontecer natural y

- si todo acontecer humano

Deben estar previamente determinados por unos antecedentes y, el determinismo debe quedar, en su caso, circunscrito al acontecer natural. Si así fuera, tendríamos libertad en nuestras decisiones, pero esto implicaría que entre nuestros constituyentes debería haber una “sustancia” que se sustrae el determinismo, lo cual introduciría el interesantísimo problema del dualismo materia-mente, en la tradición de Platón, Descartes y sobre todo Kant. Aunque, finalmente, tiendo a pensar que no existe nada que no esté escrito en las leyes de la Física y de la Química. Además, si la vida es diferente en este aspecto, ¿Dónde está el borde o el final de lo que el Universo pueda o no pueda hacer? ¿En el Homo Sapiens? ¿Es la propia vida la que pone límites a la creación?

Saber para poder responder estas preguntas, la verdad, no sabemos y, es precisamente por eso, por nuestra enorme falta de conocimientos por lo que no paramos de buscar esas respuestas a preguntas que bullen dentro de nuestras mentes y, tengo la esperanza de que, un día, lejano aún en el futuro, si no al completo, si obtendremos una respuesta satisfactoria que, al menos, sacie nuestra curiosidad y, llegados a ese punto o alto nivel del saber, las cosas serán más tranquilas, los conocimientos nos llegaran escalonados y en los momentos precisos en los que la Naturaleza sepa que, ese saber, ya no nos podrá hacer daño alguno, pues, nuestra capacidad para entonces podrá manejar fuerzas y energías que hoy por hoy, nos destruirían.

emilio silvera

Totales: 85.949.293

Totales: 85.949.293 Conectados: 69

Conectados: 69