Sep

5

¿Qué será la materia?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (1)

Comments (1)

« ¿Qué habrá en los Océanos de Higgs? ¡Si existen!

En primaria, nos decían que estaba en tres estados. Se profundizaba poco más y, el desconocimiento de la materia era grande: Sólido, Líquido y Gaseoso, esa era toda la explicación que sobre la materia nos daban.

En este estado la materia, muy poco densa, no tiene ni forma ni volumen fijo. Plasma: Es un estado parecido al gas, pero compuesto por átomos ionizados, donde los electrones circulan libremente. Calentando un gas se puede obtener plasma.

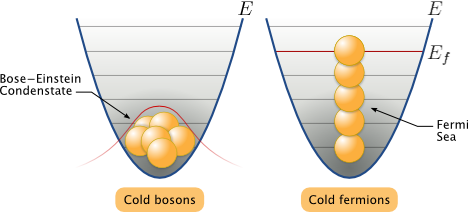

En física, condensado de Bose-Einstein es el estado de la materia que se da en ciertos materiales a temperaturas cercanas a 0 K (cero absoluto). La propiedad que lo caracteriza es que una cantidad macroscópica de las partículas del material pasan al nivel de mínima energía, denominado estado fundamental.

La Física nos habla de otros estados de la materia:

- lido. Los objetos en estado sólido se presentan de forma definida, es decir, normalmente su forma no cambia, no es posible alterarla sin aplicar una gran fuerza o cambiar el estado del objeto en cuestión. …

- Líquido. …

- Gas. …

- Plasma. …

- Condensado de Bose-Einstein. …

- Condensado de Fermi. …

- Super-sólido. …

- Super-cristal.

Tiene y encierra tantos misterios la materia que estamos aún y años-luz de saber y conocer sobre su verdadera naturaleza. Nos podríamos preguntar miles de cosas que no sabríamos contestar. Nos maravillan y asombran fenómenos naturales que ocurren ante nuestros ojos pero que tampoco sabemos, en realidad, a que son debidos. Si, sabemos ponerles etiquetas como, por ejemplo, la fuerza nuclear débil, la fisión espontánea que tiene lugar en algunos elementos como el protactinio o el torio y, con mayor frecuencia, en los elementos que conocemos como transuránicos.

A medida que los núcleos se hacen más grandes, la probabilidad de una fisión espontánea aumenta. En los elementos más pesados de todos (einstenio, fermio y mendelevio), esto se convierte en el método más importante de ruptura, sobrepasando a la emisión de partículas alfa.

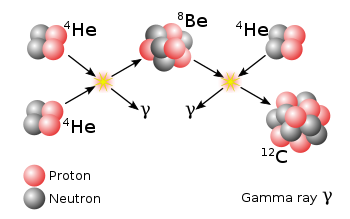

Maravillas como el proceso triple Alfa nos hace pensar que la materia está viva. La radiación ha sido muy bien estudiada y hoy se conocen sus secretos. Sin embargo, son muchas las cosas que desconocemos y, nuestra curiosidad nos empuja continuamente a buscar esas respuestas.

El electrón y el positrón son notables por sus pequeñas masas (sólo 1/1.836 de la del protón, el neutrón, el antiprotón o antineutrón), y, por lo tanto, han sido denominados leptones (de la voz griega lepto que significa “delgado”).

El electrón es onda y partícula

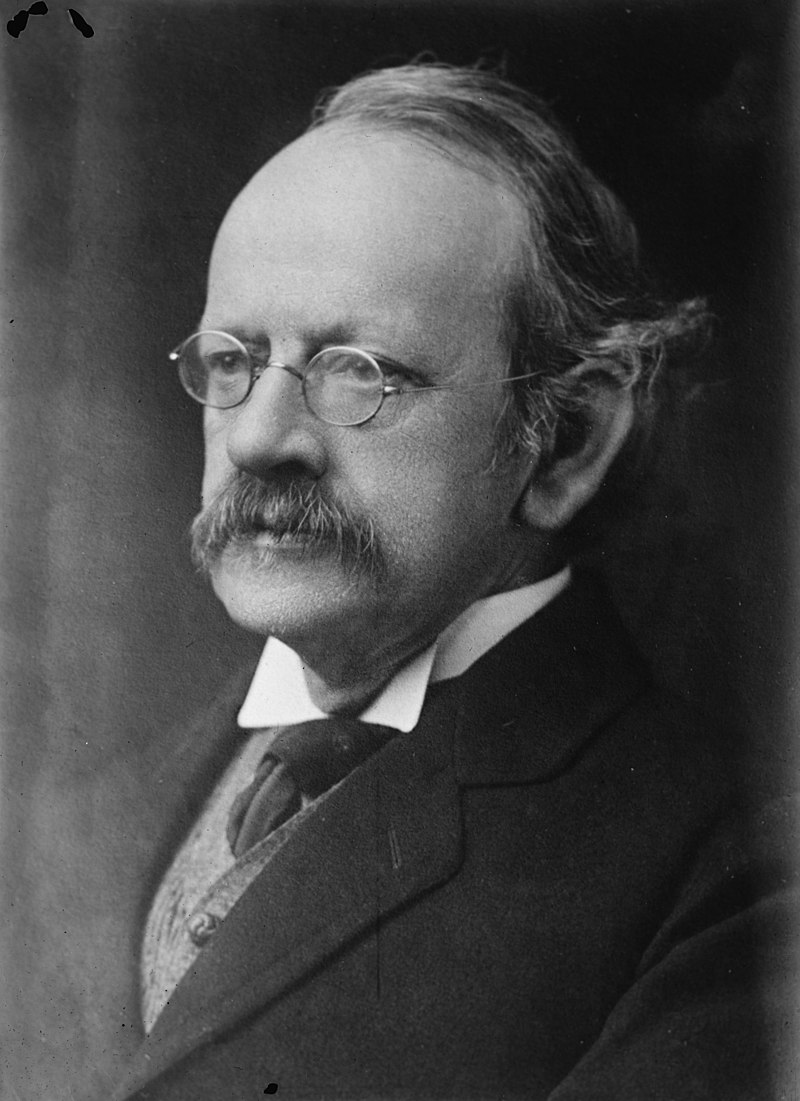

Aunque el electrón fue descubierto en 1.897 por el físico británico Josepth John Thomson (1856-1940), el problema de su estructura, si la hay, no está resuelto. Conocemos su masa y su carga negativa que responden a 9,1093897 (54)x10-31kg la primera y, 1,602 177 33 (49)x10-19 culombios, la segunda, y también su radio clásico. No se ha descubierto aún ninguna partícula que sea menos masiva que el electrón (o positrón) y que lleve una carga eléctrica, sea lo que fuese (sabemos como actúa y cómo medir sus propiedades, pero aun no sabemos qué es), tenga asociada un mínimo de masa, y que esta es la que se muestra en el electrón.

Joseph John Thomson

Lo cierto es que, el electrón, es una maravilla en sí mismo. El Universo no sería como lo conocemos si el electrón (esa cosita “insignificante”), fuese distinto a como es, bastaría un cambio infinitesimal para que, por ejemplo, nosotros no pudiéramos estar aquí ahora.

Son muchas las cosas que desconocemos y, nuestra curiosidad nos empuja continuamente a buscar esas respuestas.

El electrón y el positrón son notables por sus pequeñas masas (sólo 1/1.836 de la del protón, el neutrón, el antiprotón o antineutrón), y, por lo tanto, han sido denominados leptones (de la voz griega lepto que significa “delgado”).

Primeras imágenes de átomos en movimiento en una molécula

Investigadores de la Universidad Estatal de Ohio (Estados Unidos), han registrado, utilizando una nueva cámara ultrarrápida, la primera imagen en tiempo real de dos átomos vibrando en una molécula. La clave del experimento, que ha sido publicado en la revista ‘Nature’, fue la utilización de la energía del propio electrón de una molécula.

CAPTAN COMO UN ELECTRON SALTA DE UN ATOMO A OTRO

Un equipo de siete científicos suecos de la Facultad de Ingeniería de la Universidad de Lund consiguieron captar en vídeo por primera vez el movimiento o la distribución energética de un electrón sobre una onda de luz, tras ser desprendido previamente del átomo correspondiente.

Previamente dos físicos de la Universidad Brown habían mostrado películas de electrones que se movían a través de helio líquido en el International Symposium on Quantum Fluids and Solids del 2006. Dichas imágenes, que mostraban puntos de luz que bajaban por la pantalla fueron publicadas en línea el 31 de mayo de 2007, en el Journal of Low Temperature Physics.

En el experimento que ahora nos ocupa y dada la altísima velocidad de los electrones el equipo de investigadores ha tenido que usar una nueva tecnología que genera pulsos cortos de láser de luz intensa (“Attoseconds Pulses”), habida cuenta que un attosegundo equivalente a la trillonésima parte de un segundo”.)

¿Cuánto te puede hacer sentir? ¿No es lo más grande de tu vida?

¡No por pequeño, se es insignificante! Recordémoslo, todo lo grande está hecho de cosas pequeñas. Las inmensas galaxias son el conjunto de muchos pequeños átomos unidos para formar moléculas que a su vez se juntan y forman cuerpos. Los océanos de la Tierra, las montañas de Marte, los lagos de metano de Titán, los hielos de Europa… ¡Todo está hecho de materia bariónica! Es decir, son pequeños Quarks y Leptones que conforman los átomos de lo que todo está hecho en nuestro Universo. Bueno, al menos todo lo que podemos ver.

La familia Quarks: Tan pequeños y tan importantes

Uno de los enigmas más grandes de la física de partículas a día de hoy es por qué existen tres generaciones de partículas, tres copias idénticas pero de masa muy superior de las partículas que conforman toda la materia que observamos en el universo.

Un “simple” átomo está conformado de una manera muy compleja. Por ejemplo, un protón está hecho de tres quarks: 2 up y 1 down. Mientras tanto, un neutrón está constituido de 2 quarks down y 1 quark up. Los protones y neutrones son hadrones de la rama barión, es decir, que emiten radiación. También son fermiones y, debido a su función en el átomo, se les suele llamar nucleones. Dichos quarks existen confinados dentro de los protones y neutrones inmersos en una especie de pegamento gelatinoso formado por unas partículas de la familia de los Bosones que se llaman Gluones y son los transmisores de la Fuerza nuclear fuerte. Es decir, si los quarks se quieren separar son atrapados por esa fuerza que los retiene allí confinados.

Louis de Broglie

Estudiar el “universo” de las partículas subatómicas es fascinante y se pueden llegar a entender las maravillas que nos muestra la mecánica cuántica, ese extraño mundo que nada tiene que ver con el nuestro cotidiano situado en el macromundo. En realidad, existen partículas que no tienen en absoluto asociada en ellas ninguna masa (es decir, ninguna masa en reposo). Por ejemplo, las ondas de luz y otras formas de radiación electromagnéticas se comportan como partículas (Einstein en su efecto fotoeléctrico y De Broglie en la difracción de electrones.)

Imagen ilustrativa de la dualidad onda-partícula, en el cual se puede ver cómo un mismo fenómeno puede tener dos percepciones distintas. Esta manifestación en forma de partículas de lo que, de ordinario, concebimos como una onda se denomina fotón, de la palabra griega que significa “luz”. Recientemente he podido leer que unos científicos han logrado (de alguna manera) “congelelar” la luz y hacerla sólida. Cuando recabe más información os lo contaré con todo detalle. El fotón, el cuanto de luz, es en sí mismo una maravilla.

El fotón tiene una masa de 1, una carga eléctrica de 0, pero posee un espín de 1, por lo que es un bosón. ¿Cómo se puede definir lo que es el espín? Los fotones toman parte en las reacciones nucleares, pero el espín total de las partículas implicadas antes y después de la reacción deben permanecer inmutadas (conservación del espín). La única forma que esto suceda en las reacciones nucleares que implican a los fotones radica en suponer que el fotón tiene un espín de 1. El fotón no se considera un leptón, puesto que este termino se reserva para la familia formada por el electrón, el muón y la partícula Tau con sus correspondientes neutrinos: Ve, Vu y VT.

Existen razones teóricas para suponer que, cuando las masas se aceleran (como cuando se mueven en órbitas elípticas en torno a otra masa o llevan a cabo un colapso gravitacional), emiten energía en forma de ondas gravitacionales. Esas ondas pueden así mismo poseer aspecto de partícula, por lo que toda partícula gravitacional recibe el nombre de gravitón.

La fuerza gravitatoria es mucho, mucho más débil que la fuerza electromagnética. Un protón y un electrón se atraen gravitacionalmente con sólo 1/1039 de la fuerza en que se atraen electromagnéticamente. El gravitón (aún sin descubrir) debe poseer, correspondientemente, menos energía que el fotón y, por tanto, ha de ser inimaginablemente difícil de detectar.

El Gravitón se ríe de nosotros que no sabemos encontrarlo. ¿Qué Bosón tan guasón!

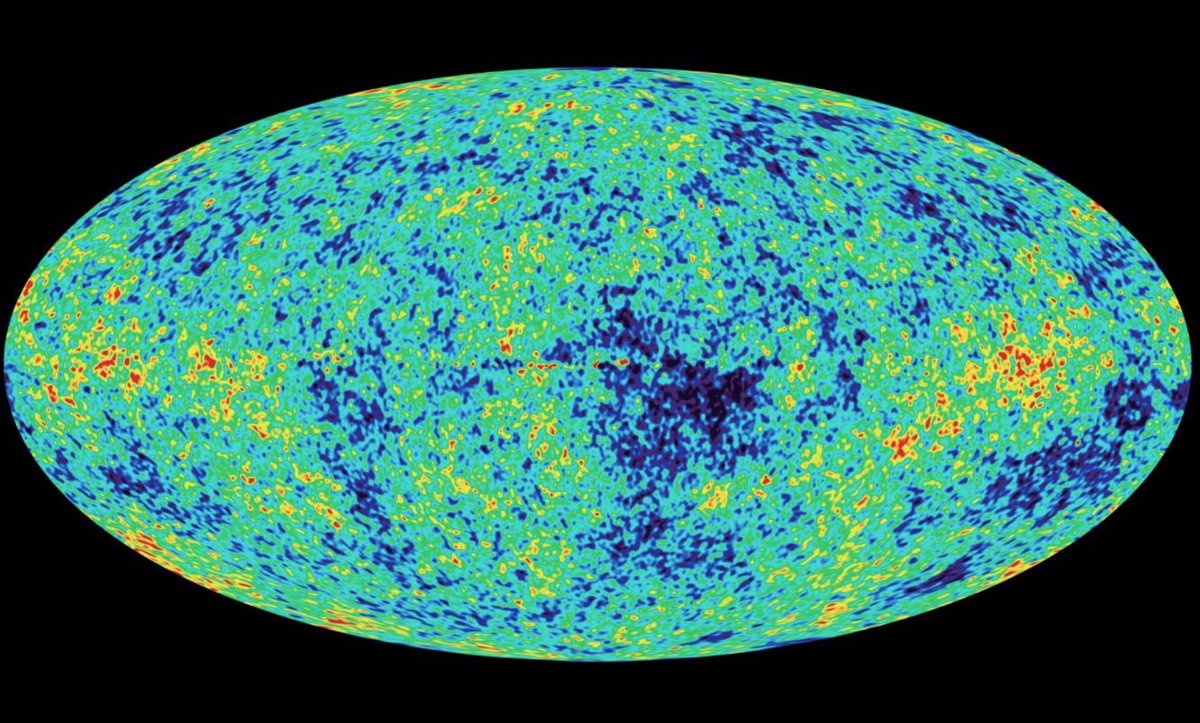

El gravitón parece estar riéndose de todos y no se deja ver. El gravitón es la partícula elemental responsable de la fuerza de la gravedad. Todavía no ha sido descubierto experimentalmente. Teóricamente debería tener masa en reposo nula. ¿Qué límites para la masa del gravitón ofrece el fondo cósmico de microondas? El gravitón es la partícula elemental responsable de la “versión” cuántica de gravedad. No ha sido descubierto aún, aunque pocos dudan de su existencia. ¿Qué propiedades tiene? Debe ser un bosón de espín 2 y como la gravedad parece ser una fuerza de largo alcance, debe tener masa en reposo muy pequeña (billones de veces más pequeña que la del electrón), posiblemente es exactamente cero (igual que parecer ser la del fotón).

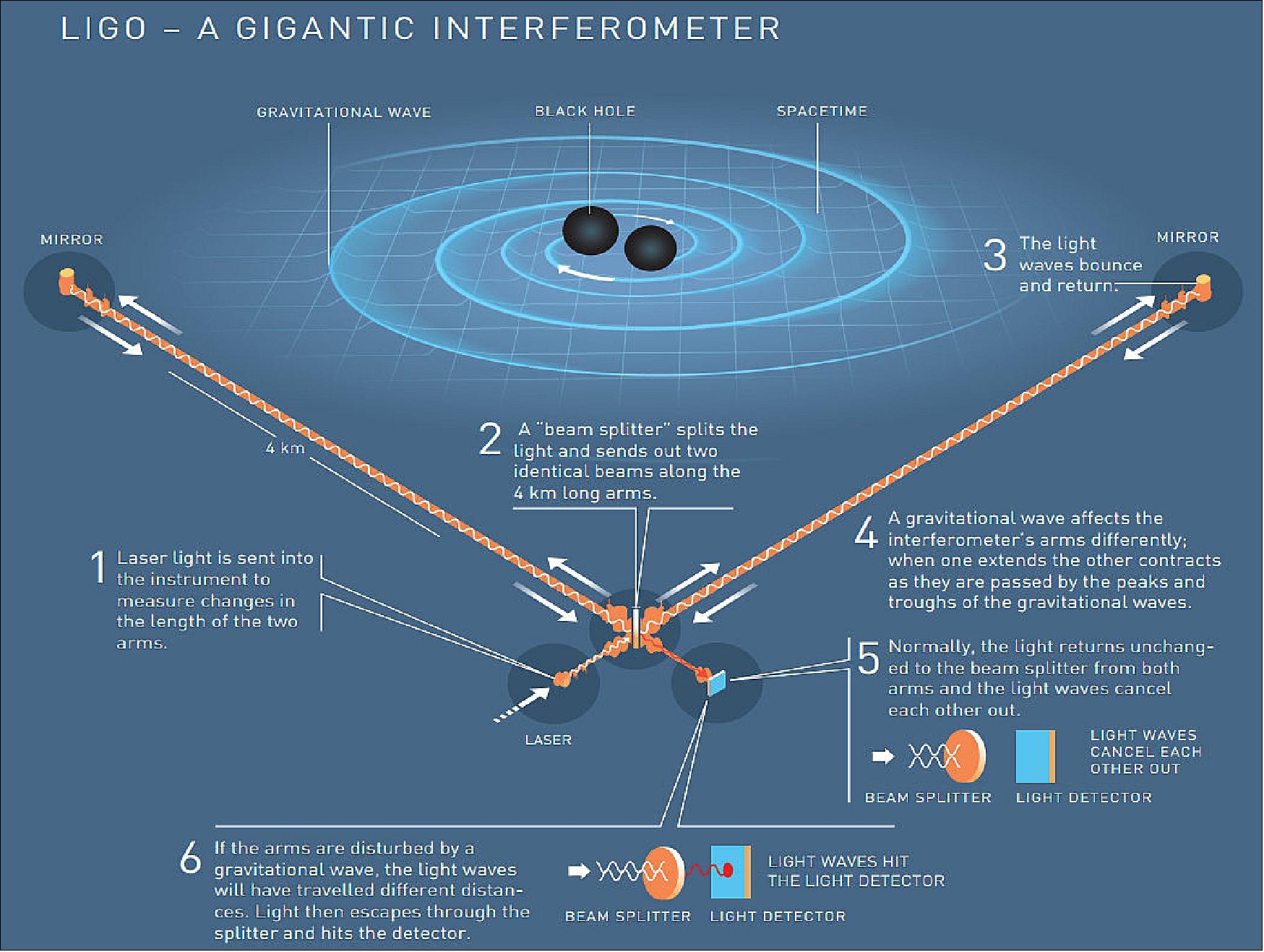

De todos modos, el físico norteamericano Joseph Weber emprendió en 1.957 la formidable tarea de detectar el gravitón. Llegó a emplear un par de cilindros de aluminio de 153 cm., de longitud y 66 de anchura, suspendidos de un cable en una cámara de vacío. Los gravitones (que serían detectados en forma de ondas), desplazarían levemente esos cilindros, y se empleó un sistema para detectar el desplazamiento que llegare a captar la cienmillonésima parte de un centímetro.

Finalmente lo consiguieron

Para detectar ondas gravitacionales necesitamos instrumentos extremadamente precisos que puedan medir distancias en escalas diminutas. Una onda gravitacional afecta longitudes en escalas de una millonésima de billonésima de metro, así que ¡necesitamos un instrumento que sea lo suficientemente sensible para “ver” a esas escalas! Parece que al fín, LIGO y otros lo han conseguido.

El interferómetro funciona enviando un haz de luz que se separa en dos haces; éstos se envían en direcciones diferentes a unos espejos donde se reflejan de regreso, entonces los haces al combinarse presentarán interferencia.

Las débiles ondas de los gravitones, que producen del espacio profundo, deberían chocar contra todo el planeta, y los cilindros separados por grandes distancias se verán afectados de forma simultánea. En 1.969, Weber anunció haber detectado los efectos de las ondas gravitatorias. Aquello produjo una enorme excitación, puesto que apoyaba una teoría particularmente importante (la teoría de Einstein de la relatividad general). Desgraciadamente, nunca se pudo comprobar mediante las pruebas realizadas por otros equipos de científicos que duplicaran el hallazgo de Weber.

De todas formas, no creo que, a estas alturas, nadie pueda dudar de la existencia de los gravitones, el bosón mediador de la fuerza gravitatoria. La masa del gravitón es 0, su carga es 0, y su espín de 2. Como el fotón, no tiene antipartícula, ellos mismos hacen las dos versiones.

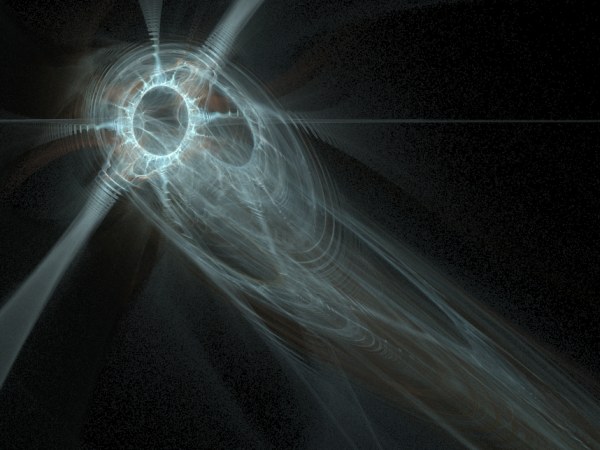

Tenemos que volver a los que posiblemente son los objetos más misteriosos de nuestro Universo: Los agujeros negros. Si estos objetos son lo que se dice (no parece que se pueda objetar nada en contrario), seguramente serán ellos los que, finalmente, nos faciliten las respuestas sobre las ondas gravitacionales y el esquivo gravitón.

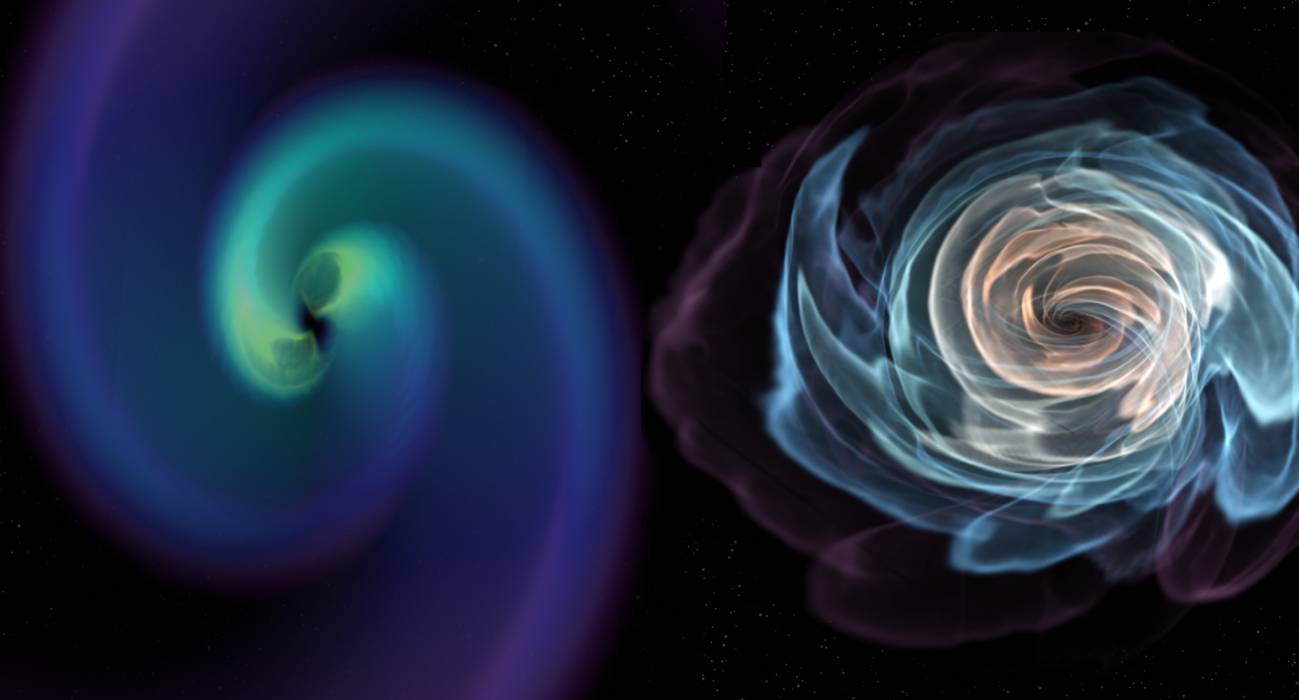

Imagen de un agujero negro en el núcleo de una galaxia arrasando otra próxima- NASA

La onda gravitacional emitida por el agujero negro produce una ondulación en la curvatura del espacio-temporal que viaja a la velocidad de la luz transportada por los gravitones. Algunos proyectos como LIGO, están a la caza de esas ondas gravitatotias y, los expertos dicen que, cuando podamos leer sus mensajes, se presentará ante nosotros todo un nuevo universo que aíun no conocemos. Ahora, todo lo que captamos, las galaxias y estrellas lejanas, son gracias a la luz que viaja desde miles de millones de años luz hasta nosotros, los telescopios la captan y nos muestran esas imágenes de objetos lejanos pero, ¿qué veremos cuando sepamos captar esas ondas gravitatorias que viajan por el Espacio a la velocidad de la luz como los fotones y, son el resultado del choque de galaxias, de agujeros negros y de estrellas de neutrones?

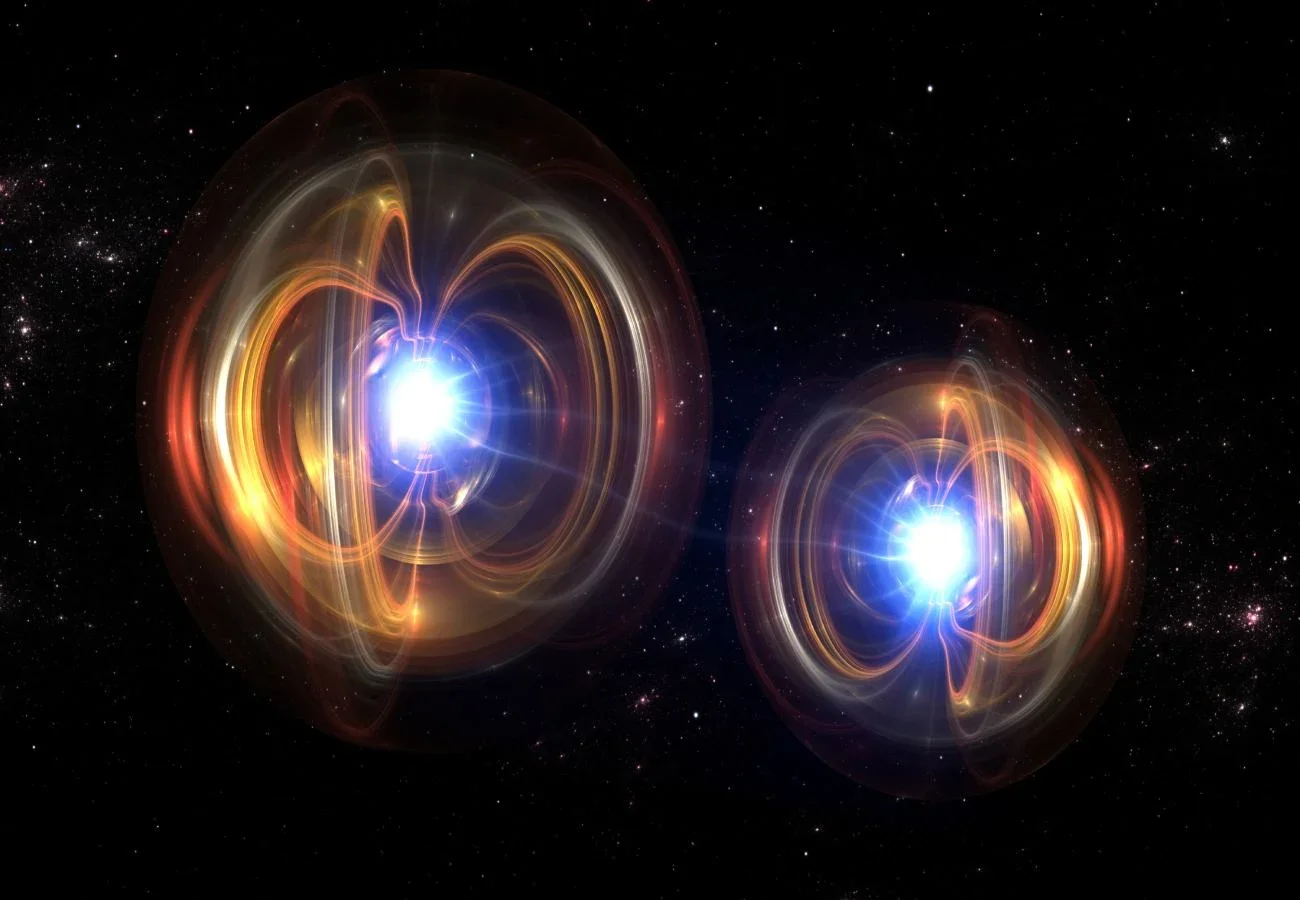

El choque de dos estrellas de neutrones producen ondas gravitatorias

Hay aspectos de la física que me dejan totalmente sin habla, me obligan a pensar y me transporta de este mundo material nuestro a otro fascinante donde residen las maravillas del Universo. Hay magnitudes asociadas con las leyes de la gravedad cuántica. La longitud de Planck-Wheeler, ![]() es la escala de longitud por debajo de la cual el espacio tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro.

es la escala de longitud por debajo de la cual el espacio tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro.

Me llama poderosamente la atención lo que conocemos como las fluctuaciones de vacío, esas oscilaciones aleatorias, impredecibles e in-eliminables de un campo (electromagnético o gravitatorio), que son debidas a un tira y afloja en el que pequeñas regiones del espacio toman prestada momentáneamente energía de regiones adyacentes y luego la devuelven. Hace un par de días que hablamos de ello.

Ordinariamente, definimos el vacío como el espacio en el que hay una baja presión de un gas, es decir, relativamente pocos átomos o moléculas. En ese sentido, un vacío perfecto no contendría ningún átomo o molécula, pero no se puede obtener, ya que todos los materiales que rodean ese espacio tienen una presión de vapor finita. En un bajo vacío, la presión se reduce hasta 10-2 pascales, mientras que un alto vacío tiene una presión de 10-2-10-7 pascales. Por debajo de 10-7 pascales se conoce como un vacío ultra-alto.

El primer gran vacío en ser detectado fue el de Boötes en 1.981; tiene un radio de unos 180 millones de años luz y su centro se encuentra a aproximadamente 500 millones de años luz de la Vía Láctea. La existencia de grandes vacíos no sorprende a la comunidad de astrónomos y cosmólogos, dada la existencia de cúmulos de galaxias y supercúmulos a escalas muy grandes. Claro que, según creo yo personalmente, ese vacío, finalmente, resultará que está demasiado lleno, hasta el punto de que su contenido nos manda mensajes que, aunque lo hemos captado, no lo sabemos descifrar.

No puedo dejar de referirme al vaciotheta (vació θ) que, es el estado de vacío de un campo gauge no abeliano (en ausencia de campos fermiónicos y campos de Higgs). En el vacío theta hay un número infinito de estados degenerados con efecto túnel entre estos estados. Esto significa que el vacío theta es análogo a una fundón de Bloch en un cristal.

Se puede derivar tanto como un resultado general o bien usando técnicas de instantón. Cuando hay un fermión sin masa, el efecto túnel entre estados queda completamente suprimido. Cuando hay campos fermiónicos con masa pequeña, el efecto túnel es mucho menor que para campos gauge puros, pero no está completamente suprimido.

Emilio Silvera V.

Ago

29

Tan sencillo y tan complejo

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Nunca podremos dejar de maravillarnos ante las “cosas” que puede realizar la Naturaleza para conseguir sus fines. y, como dice Leonard Susskind, para comprender la realidad en sus niveles más elementales, basta con conocer el comportamiento de dos elementos: el electrón y el fotón. Todo el argumento de la Electrodinámica Cuántica gira en torno a un proceso fundamental:

¡La emisión de un único fotón por un único electrón!

Cuando el movimiento de un electrón es alterado súbitamente, puede responder desprendiendo un fotón. La emisión de un fotón es el suceso básico de la mecánica cuántica. Toda la luz visible que vemos, así como las ondas de radio, la radiación infrarroja y los rayos X, está compuesta de fotones que han sido emitidos por electrones, ya sea en el Sol, el filamento de una bombilla, una antena de radio o un aparato de rayos.

Los fotones viajan por todo el Universo

El fotón es la partícula de luz portadora la interacción electromagnética. Un fotón se caracteriza por su energía o, equivalentemente, por su frecuencia. Las partículas elementales responsables de la luz y de la radiación electromagnética. ¿Dónde se producen fotones? Se emiten en varios procesos naturales. Por ejemplo, cuando una carga se acelera, se emite radiación sincrotrón. Durante una transición molecular, atómica o nuclear a un nivel de energía más bajo, se emitirán fotones de varias energías o cuando se aniquila una partícula con su antipartícula. Cuando un electrón cae de n=2 a n=1, el emite un fotón de luz ultravioleta. El fotón es una partícula cuántica elemental, sin masa, encargada de transportar la energía electromagnética entre partículas con carga eléctrica. Cada vez que un electrón pasa de un estado de excitación mayor a uno menor, se genera un fotón. La luz visible está compuesta por fotones (palabra que significa “luz”), un tipo de partículas elementales que carecen de masa. Los fotones se comportan de manera dual: como ondas y como partículas. Esta dualidad dota a la luz de propiedades físicas singulares. Los fotones transportan energía electromagnética. Esta energía incluye la luz visible que podemos ver y muchos otros tipos de formas de energía de menor y mayor energía. Los fotones son las partículas más pequeñas posibles de energía electromagnética y, por tanto, también las partículas de luz más pequeñas posibles. os fotones son emitidos por muchos procesos naturales, como cuando las partículas cargadas se ralentizan durante una transición molecular, atómica o nuclear a un nivel de energía más bajo, o cuando se aniquila una partícula con su antipartícula. Como apuntaba antes por ahí arriba: Un fotón se produce cada vez que un electrón en una órbita más alta de lo normal vuelve a su órbita normal . Durante la caída de energía alta a energía normal, el electrón emite un fotón (un paquete de energía) con características muy específicas.

¿Qué es más pequeño que un fotón?Los quarks son ciertamente unas de las partículas más pequeñas del universo. Son elementales, indivisibles y no se pueden romper en piezas menores. De hecho, se las considera puntuales como el electrón, el fotón, el gluón y el neutrino, entre otras que conforman el modelo estándar de la física de partículas.El Fotón es un Bosón, el que intermedia todas las emisiones de energía electromagnética y, desde luego, es una de las partículas más familiares, gracias a ella podemos disfrutar de los rayos del Sol, se produce la fotosíntesis y es posible la Vida en nuestro planeta.

LA PRIMERA IMAGEN DE UNA PARTÍCULASS DE LUZ

Claro que, los electrones no son las únicas partículas que pueden emitir fotones. Cualquier partícula eléctricamente cargada puede hacerlo, incluido el protón. Esto significa que los fotones pueden saltar entre dos protones o incluso entre un protón y un electrón. Este hecho es de enorme importancia para toda la ciencia y la vida en general. El intercambio continuo de fotones entre el núcleo y los electrones atómicos proporciona la fuerza que mantiene unido el átomo.

Sin estos fotones saltarines, el átomo se desharía y toda la materia dejaría de existir, y, no podemos olvidar que, también nosotros, los seres vivos… ¡Somos materia!

Decía que la Naturaleza hace las cosas más inverosímiles y de la manera más económica posible y, ha sabido crear esos objetos pequeñitos (infinitesimales como lo son las partículas subatómicas) que ha agrupado en familias. Los electrones son de la Familia de los Leptones y son fermiones, mientras que los fotones pertenecen a la familia de los Bosones. Los primeros no quieren estar juntos y se repelen cuando andan cerca los unos de los otros, mientras que los segundos, están encantados de la vida cuando se juntan muchos, de hecho, la Luz es un conjunto de fotones que, realmente, ilumina nuestras vidas.

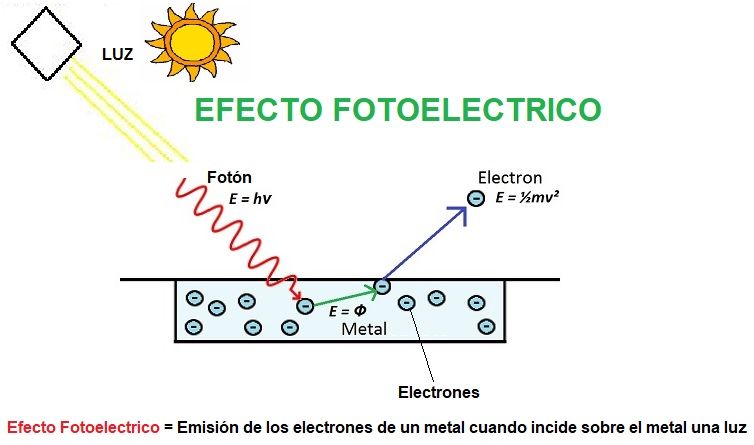

Veamos el Efecto fotoeléctrico

Este trabajo fue el que le dio el Nobel a Einstein

Conceptos de Electroestática, Electrización, conductores, aislantes, Carga, Energía y Tensión Eléctrica

El fenómeno del efecto fotoeléctrico es una forma de mostrar el carácter corpuscular de la radiación electromagnética al interactuar la radiación y la materia, para lo cual se requiere fotoconductividad que hace referencia al aumento de la conductividad eléctrica de la materia o en diodos provocada por la luz y la presencia del efecto fotovoltaico que implica una transformación parcial de la energía luminosa en energía eléctrica.

Para que ocurra el efecto fotoeléctrico descubierto por Heinrich Hertz en 1887 (Que Einstein desarrolló en su famoso trabajo de 1.905 que le valió el Nóbel de Física de 1.923), se observa la liberación de los electrones de enlaces de átomos y moléculas de la sustancia bajo acción de la luz: visible, infrarroja y ultravioleta; en sus experimentos halla un arco que se forma entre dos electrodos conectados a alta tensión alcanzando distancias mayores cuando se ilumina con luz ultravioleta que cuando se deja en la oscuridad.

Se caracteriza por:

El experimento consiste en colocar una placa metálica en un recipiente de vidrio al cual que se ha realizado un vacio, existe otra placa que hace de colectar de partículas cargadas. Al hacer incidir un haz monocromático de radiación electromagnética se produce un desprendimiento de electrones de ella. Si se presenta una diferencia de potencial positivo entre el colector y la placa los electrones serán acelerados hacia él y se registrará una corriente: fotocorriente; sin embargo si se aplica un potencial negativo al colector, los fotoelectrones serán repelidos y llegarán solamente los que alcancen una energía mayor que el potencial.

El potencial de ionización primario de un átomo es la energía mínima necesaria para arrancar un electrón de un átomo neutro aislado en su estado fundamental. Cuando el átomo pierde un electrón se forma un ión con carga positiva. Se representa como PI.

La energía mínima necesaria para arrancar un electrón (trabajo de extracción) de una lámina de plata es 7,52 10-19 J.

Es así que ∅ es la energía mínima necesaria para que un electrón escape del metal.

El electrón absorbe una energía E (energía cinética del electrón emitida).

La energía de un fotón se obtiene:

v = frecuencia de la radiación electromagnética

El trabajo daría para mucho más pero, como simplre referencia, aquí lo dejamos.

Emilio Silvera V.

Ago

20

Todo lo grande está hecho de cosas pequeñas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

“De acuerdo a la física el menor intervalo de tiempo es el Cronón o tiempo de Planck, que equivale a 10-44 segundos y se mide como el tiempo que tarda un fotón viajando a la velocidad de la luz en atravesar una distancia igual a la longitud de Planck.”

El tiempo de Planck o cronón (término acuñado en 1926 por Robert Lévi) es una unidad de tiempo, considerada como el intervalo temporal más pequeño que puede ser medido. Se denota mediante el símbolo tP. En cosmología, el tiempo de Planck representa el instante de tiempo más pequeño en el que las leyes de la física pueden ser utilizadas para estudiar la naturaleza y evolución del Universo. Se determina como combinación de otras constantes físicas en la forma siguiente:

segundos

segundos

donde:

es la constante de Planck reducida (conocida también como la constante de Dirac).

es la constante de Planck reducida (conocida también como la constante de Dirac). - G es la constante de Gravitación Universal;

- c es la velocidad de la luz en el vacío.

Los números entre paréntesis muestran la desviación estándar.

| Nombre | Dimensión | Valor (SI unidades) |

|---|---|---|

| Longitud Planck | longitud (L) | 1.616255(18)×10−35 m |

| Masa de Planck | masa (M) | 2.176434(24)×10−8 kg |

| Tiempo de Planck | tiempo (T) | 5.391247(60)×10−44 s |

| Temperatura de Planck | temperatura (Θ) | 1.416784(16)×1032 K |

Hablamos de las cosas muy pequeñas, las que no se ven

Es el tiempo que necesita el fotón (viajando a la velocidad de la luz, c, para moverse a través de una distancia igual a la longitud de Planck. Está dado por , donde G es la constante gravitacional (6, 672 59 (85) x 10-11 N m2 kg-2), ħ es la constante de Planck racionalizada (ħ = h/2л = 1,054589 x 10-34 Julios segundo), c, es la velocidad de la luz (299.792.458 m/s).

El valor del tiempo del Planck es del orden de 10-44 segundos. En la cosmología del Big Bang, hasta un tiempo Tp después del instante inicial, es necesaria usar una teoría cuántica de la gravedad para describir la evolución del Universo. Todo, desde Einstein, es relativo. Depende de la pregunta que se formule y de quién nos de la respuesta.

¿El Tiempo? Muchos Filósofos lo quisieron explicar pero… ¡No pudieron!

Si preguntamos ¿Qué es el tiempo?, tendríamos que ser precisos y especificar si estamos preguntando por esa dimensión temporal que no deja de fluir desde el Big Bang y que nos acompaña a lo largo de nuestras vidas, o nos referimos al tiempo atómico, ese adoptado por el SI, cuya unidad es el segundo y se basa en las frecuencias atómicas, definida a partir de una línea espectral particular de átomo de cesio 133, o nos referimos a lo que se conoce como tiempo civil, tiempo coordinado, tiempo de crecimiento, tiempo de cruce, tiempo de integración, tiempo de relajación, tiempo dinámico o dinámico de Baricéntrico, dinámico terrestre, tiempo terrestre, tiempo de Efemérides, de huso horario, tiempo estándar, tiempo local, tiempo luz, tiempo medio, etc. etc. Cada una de estas versiones del tiempo, tiene una respuesta diferente, ya que, no es lo mismo el tiempo propio que el tiempo sidéreo o el tiempo solar, o solar aparente, o solar medio, o tiempo terrestre, o tiempo Universal. Como se puede ver, la respuesta dependerá de cómo hagamos la pregunta.

… Y que el mismo tiempo suele borrar

En realidad, para todos nosotros el único tiempo que rige es el que tenemos a lo largo de nuestras vidas, los otros tiempos, son inventos del hombre para facilitar sus tareas de medida, de convivencia o de otras cuestiones técnicas o astronómicas pero, sin embargo, el tiempo es solo uno; ese que comenzó cuando nació el Universo y que finalizará cuando este llegue a su final.

Lo cierto es que, para las estrellas supermasivas, cuando llegan al final de su ciclo y deja de brillar por agotamiento de su combustible nuclear, en ese preciso instante, el tiempo se agota para ella. Cuando una estrella pierde el equilibrio existente entre la energía termonuclear (que tiende a expandir la estrella), y, la fuerza de gravedad (que tiende a comprimirla), al quedar sin oposición esta última, la estrella supermasiva se contrae aplastada bajo su propia masa. Queda comprimida hasta tal nivel que llega un momento que desaparece, para convertirse en un Agujero Negro, una singularidad, donde dejan de existir el “tiempo” y el espacio. A su alrededor nace un horizonte de sucesos que, si se traspasa, se es engullido por la enorme gravedad del Agujero Negro.

En la singularidad no se distorsiona, se para (Se refiere al Tiempo)

El tiempo, de ésta manera, deja de existir en estas regiones del Universo que conocemos como singularidad. El mismo Big Bang -dicen- surgió de una singularidad de energía y densidad infinitas que, al explotar, se expandió y creó el tiempo, el espacio y la materia.

Como contraposición a estas enormes densidades de las enanas blancas, estrellas de neutrones y Agujeros Negros, existen regiones del espacio que contienen menos galaxias que el promedio o incluso ninguna galaxia; a estas regiones las conocemos como vacío cósmico. Han sido detectados vacíos con menos de una décima de la densidad promedio del Universo en escalas de hasta 200 millones de años luz en exploraciones a gran escala. Estas regiones son a menudo esféricas. El primer gran vacío en ser detectado fue el de Boötes en 1.981; tiene un radio de unos 180 millones de años luz y su centro se encuentra aproximadamente a 500 millones de años luz de la Vía Láctea. La existencia de grandes vacíos no es sorprendente, dada la existencia de cúmulos de galaxias y supercúmulos a escalas muy grandes.

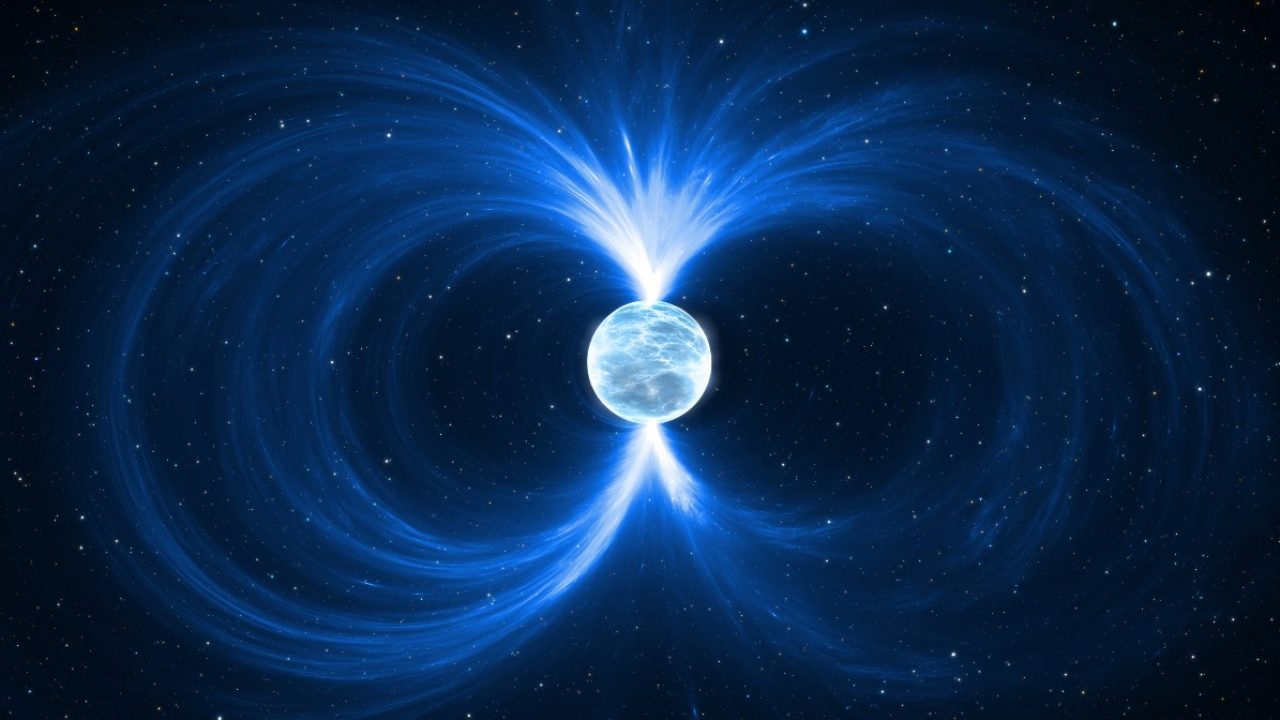

Mientras que en estas regiones la materia es muy escasa, en una sola estrella de neutrones, si pudiéramos retirar 1 cm3 de su masa, obtendríamos una cantidad de materia increíble. Su densidad es de 1017 kg/m3, los electrones y los protones están tan juntos que se combinan y forman neutrones que se degeneran haciendo estable la estrella de ese nombre que, después del agujero negro, es el objeto estelar más denso del Universo.

Es interesante ver cómo a través de las matemáticas y la geometría, han sabido los humanos encontrar la forma de medir el mundo y encontrar las formas del Universo. Pasando por Arquímedes, Pitágoras, Newton, Gauss o Riemann (entre otros), siempre hemos tratado de buscar las respuestas de las cosas por medio de las matemáticas.

“Magia es cualquier tecnología suficientemente avanzada”

Arthur C. Clarke

Pero también es magia el hecho de que, en cualquier tiempo y lugar, de manera inesperada, aparezca una persona dotada de condiciones especiales que le permiten ver, estructuras complejas matemáticas que hacen posible que la Humanidad avance considerablemente a través de esos nuevos conceptos que nos permiten entrar en espacios antes cerrados, ampliando el horizonte de nuestro saber.

Georg Friedrich Bernhard Riemann

Recuerdo aquí uno de esos extraños casos que surgió el día 10 de Junio de 1.854 con el nacimiento de una nueva geometría: La teoría de dimensiones más altas que fue introducida cuando Georg Friedrich Bernhard Riemann dio su célebre conferencia en la facultad de la Universidad de Gotinga en Alemania. Aquello fue como abrir de golpe, todas las ventanas cerradas durante 2.000 años, de una lóbrega habitación que, de pronto, se ve inundada por la luz cegadora de un Sol radiante. Riemann regaló al mundo las sorprendentes propiedades del espacio multidimensional.

Su ensayo de profunda importancia y elegancia excepcional, “sobre las hipótesis que subyacen en los fundamentos de la geometría” derribó pilares de la geometría clásica griega, que habían resistido con éxito todos los asaltos de los escépticos durante dos milenios. La vieja geometría de Euclides, en la cual todas las figuras geométricas son de dos o tres dimensiones, se venía abajo, mientras una nueva geometría riemanniana surgía de sus ruinas. La revolución riemanniana iba a tener grandes consecuencias para el futuro de las artes y las ciencias.

El Tensor métrico de Riemann y sus Espacios Curvos, le dieron otro sentido a la geometría del Universo. Einstein lo podría certificar, ya que, con el Tensor métrico de Riemann pudo(al fin) publicar la Teoría General de la Relatividad.

En menos de tres decenios, la “misteriosa cuarta dimensión” influiría en la evolución del arte, la filosofía y la Literatura en toda Europa. Antes de que hubieran pasado seis decenios a partir de la conferencia de Riemann, Einstein utilizaría la geometría riemanniana tetradimensional para explicar la creación del Universo y su evolución mediante su asombrosa teoría de la relatividad general Ciento treinta años después de su conferencia, los físicos utilizarían la geometría deca-dimensional para intentar unir todas las leyes del Universo. El núcleo de la obra de Riemann era la comprensión de las leyes físicas mediante su simplificación al contemplarlas en espacios de más dimensiones.

Riemann nació en 1.826 en Hannover, Alemania

Contradictoriamente, Riemann era la persona menos indicada para anunciar tan profunda y completa evolución en el pensamiento matemático y físico. Era huraño, solitario y sufría crisis nerviosas. De salud muy precaria que arruinó su vida en la miseria abyecta y la tuberculosis.

Riemann nació en 1.826 en Hannover, Alemania, segundo de los seis hijos de un pobre pastor luterano que trabajó y se esforzó como humilde predicador para alimentar a su numerosa familia que, mal alimentada, tendrían una delicada salud que les llevaría a una temprana muerte. La madre de Riemann también murió antes de que sus hijos hubieran crecido.

A edad muy temprana, Riemann mostraba ya los rasgos que le hicieron famoso: increíble capacidad de cálculo que era el contrapunto a su gran timidez y temor a expresarse en público. Terriblemente apocado era objeto de bromas de otros niños, lo que le hizo recogerse aún más en un mundo matemático intensamente privado que le salvaba del mundo hostil exterior.

Para complacer a su padre, Riemann se propuso hacerse estudiante de teología, obtener un puesto remunerado como pastor y ayudar a su familia. En la escuela secundaria estudió la Biblia con intensidad, pero sus pensamientos volvían siempre a las matemáticas. Aprendía tan rápidamente que siempre estaba por delante de los conocimientos de sus instructores, que encontraron imposible mantenerse a su altura. Finalmente, el director de la escuela dio a Riemann un pesado libro para mantenerle ocupado. El libro era la Teoría de números de Adrien-Marie Legendre, una voluminosa obra maestra de 859 páginas, el tratado más avanzado del mundo sobre el difícil tema de la teoría de números. Riemann devoró el libro en seis días.

Cuando el director le preguntó: “¿Hasta dónde has leído?”, el joven Riemann respondió: “Este es un libro maravilloso. Ya me lo sé todo”.

Sin creerse realmente la afirmación de su pupilo, el director le planteó varios meses después cuestiones complejas sobre el contenido del libro, que Riemann respondió correctamente.

Con mil sacrificios, el padre de Riemann consiguió reunir los fondos necesarios para que, a los 19 años pudiera acudir a la Universidad de Gotinga, donde encontró a Carl Friedrich Gauss, el aclamado por todos “Príncipe de las Matemáticas”, uno de los mayores matemáticos de todos los tiempos. Incluso hoy, si hacemos una selección por expertos para distinguir a los matemáticos más grandes de la Historia, aparecerá indudablemente Euclides, Arquímedes, Newton y Gauss.

Hannover, Alemania

Los estudios de Riemann no fueron un camino de rosas precisamente. Alemania sacudida por disturbios, manifestaciones y levantamientos, fue reclutado en el cuerpo de estudiantes para proteger al rey en el palacio real de Berlín y sus estudios quedaron interrumpidos.

En aquel ambiente el problema que captó el interés de Riemann, fue el colapso que, según el pensaba, suponía la geometría euclidiana, que mantiene que el espacio es tridimensional y “plano” (en el espacio plano, la distancia más corta entre dos puntos es la línea recta; lo que descarta la posibilidad de que el espacio pueda estar curvado, como en una esfera).

Para Riemann, la geometría de Euclides era particularmente estéril cuando se la comparaba con la rica diversidad del mundo. En ninguna parte vería Riemann las figuras geométricas planas idealizadas por Euclides. Las montañas, las olas del mar, las nubes y los torbellinos no son círculos, triángulos o cuadrados perfectos, sino objetos curvos que se doblan y retuercen en una diversidad infinita. Riemann, ante aquella realidad se rebeló contra la aparente precisión matemática de la geometría griega, cuyos fundamentos., descubrió el, estaban basados en definitiva sobre las arenas movedizas del sentido común y la intuición, no sobre el terreno firme de la lógica y la realidad del mundo.

Euclides nos habló de la obviedad de que un punto no tiene dimensión. Una línea tiene una dimensión: longitud. Un plano tiene dos dimensiones: longitud y anchura. Un sólido tiene tres dimensiones: longitud, anchura y altura. Y allí se detiene. Nada tiene cuatro dimensiones, incluso Aristóteles afirmó que la cuarta dimensión era imposible. En Sobre el cielo, escribió: “La línea tiene magnitud en una dirección, el plano en dos direcciones, y el sólido en tres direcciones, y más allá de éstas no hay otra magnitud porque los tres son todas.” Además, en el año 150 d. C. el astrónomo Ptolomeo de Alejandría fue más allá de Aristóteles y ofreció, en su libro sobre la distancia, la primera “demostración” ingeniosa de que la cuarta dimensión es imposible.

En realidad, lo único que Ptolomeo demostraba era que, era imposible visualizar la cuarta dimensión con nuestros cerebros tridimensionales (de hecho, hoy sabemos que muchos objetos matemáticos no pueden ser visualizados, aunque puede demostrarse que en realidad, existen). Ptolomeo puede pasar a la Historia como el hombre que se opuso a dos grandes ideas en la ciencia: el sistema solar heliocéntrico y la cuarta dimensión.

La ruptura decisiva con la geometría euclidiana llegó cuando Gauss pidió a su discípulo Riemann que preparara una presentación oral sobre los “fundamentos de la geometría”. Gauss estaba muy interesado en ver si su discípulo podía desarrollar una alternativa a la geometría de Euclides.

Riemann desarrolló su teoría de dimensiones más altas.

Parte real (rojo) y parte imaginaria (azul) de la línea crítica Re(s) = 1/2 de la función zeta de Riemann. Pueden verse los primeros ceros no triviales en Im(s) = ±14,135, ±21,022 y ±25,011. La hipótesis de Riemann, por su relación con la distribución de los números primos en el conjunto de los naturales, es uno de los problemas abiertos más importantes en la matemática contemporánea.

Finalmente, cuando hizo su presentación oral en 1.854, la recepción fue entusiasta. Visto en retrospectiva, esta fue, sin discusión, una de las conferencias públicas más importantes en la historia de las matemáticas. Rápidamente se entendió por toda Europa la noticia de que Riemann había roto definitivamente los límites de la geometría de Euclides que había regido las matemáticas durante los milenios.

Riemann creó el tensor métrico para que, a partir de ese momento, otros dispusieran de una poderosa herramienta que les hacía posible expresar a partir del famoso teorema de Pitágoras (uno de los grandes descubrimientos de los griegos en matemáticas que establece la relación entre las longitudes de los tres lados de un triángulo rectángulo: afirma que la suma de los cuadrados de los lados menores es igual al cuadrado del lado mayor, la hipotenusa; es decir, si a y b son los longitudes de los dos catetos, y c es la longitud de la hipotenusa, entonces a2 + b2 = c2. El teorema de Pitágoras, por supuesto, es la base de toda la arquitectura; toda estructura construida en este planeta está basada en él. Claro que, es una herramienta para utilizar en un mundo tridimensional.)

Formatos del tensor de Einstein

El tensor métrico de Riemann, o N dimensiones, fue mucho más allá y podemos decir que es el teorema para dimensiones más altas con el que podemos describir fenómenos espaciales que no son planos, tales como un remolino causado en el agua o en la atmósfera, como por ejemplo también la curvatura del espacio en presencia de grandes masas. Precisamente, el tensor de Riemann, permitió a Einstein formular su teoría de la gravedad y, posteriormente lo utilizo Kaluza y Klein para su teoría en la quinta dimensión de la que años más tarde se derivaron las teorías de super-gravedad, supersimetría y, finalmente las supercuerdas.

Para asombro de Einstein, cuando tuvo ante sus ojos la conferencia de Riemann de 1.854, que le había enviado su amigo Marcel Grossman, rápidamente se dio cuenta de que allí estaba la clave para resolver su problema. Descubrió que podía incorporar todo el cuerpo del trabajo de Riemann en la reformulación de su principio. Casi línea por línea, el gran trabajo de Riemann encontraba su verdadero lugar en el principio de Einstein de a relatividad general. Esta fue la obra más soberbia de Einstein, incluso más que su celebrada ecuación E=mc2. La reinterpretación física de la famosa conferencia de Riemann se denomina ahora relatividad general, y las ecuaciones de campo de Einstein se sitúan entre las ideas más profundas de la historia de la ciencia.

Emilio Silvera V.

Ago

18

¡La Luz! Uno de los grandes misterios del Universo

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (1)

Comments (1)

Los fotones, las partículas de las que está hecha la luz, no se comportan como muchas otras partículas porque no tienen masa. Esto hace que no interaccionen entre ellas y por tanto no se unan unas a otras para formar elementos mayores y más complejos, como sí hacen otras partículas fundamentales.

Algo sabemos sobre la luz, de qué está conformada y su velocidad en el vacío y otras peculiaridades. Sin embargo, de esas pequeñas y luminosas partículas de la familia de los Bosones… ¡Nos queda mucho que aprender!

Sin embargo, en los últimos años varios equipos científicos de todo el mundo han logrado jugar con esta característica y, de alguna forma, burlarla, deteniendo la luz y congelándola, convirtiéndola en un sólido. Se trata de un fenómeno que nos recuerda a las películas de ciencia ficción (piensen en los sables láser de La guerra de las galaxias), pero en cuyo conocimiento los investigadores avanzan cada día más. Los últimos, un equipo de la Universidad de Princeton que ha logrado convertir la luz en cristal, según sus conclusiones.

Logran almacenar luz en fibra óptica

Nos interesa explorar, y eventualmente controlar y dirigir, los flujos de energía a nivel atómico. Lo han conseguido interconectando fotones, las partículas elementales de la luz, de forma que se quedasen fijos en un lugar como si estuviesen congelados. Los resultados de sus experimentos podrían servir para desarrollar nuevos y exóticos meta-materiales, además de ayudar a avanzar en el conocimiento sobre el estudio fundamental de la materia.

“Es algo que nadie había visto antes, un nuevo comportamiento de la luz”, explica Andrew Houck, profesor asociado de ingeniería eléctrica y uno de los investigadores. “Nos interesa explorar, y eventualmente controlar y dirigir, los flujos de energía a nivel atómico”, dice Hakan Türeci, uno de los miembros del equipo.

Imagen de la luz congelada

Para lograrlo, construyeron una estructura hecha de materiales superconductores con más de cien mil millones de átomos ensamblados para funcionar como uno solo y la situaron junto a un cable superconductor por el que transitaban fotones. Esos fotones, debido a mecanismos propios de la física cuántica, adoptaron algunas de las propiedades del átomo, como por ejemplo las interacciones entre ellos, algo que normalmente no ocurre con los fotones. Así, el equipo logró que fluyesen como si fuesen parte de un líquido o que se congelasen como si fuesen un cristal sólido.

Los científicos han estudiado el comportamiento de la luz durante años, que a veces corresponde al de una onda y otras al de una partícula. Con este experimento, han podido inventarle uno nuevo. “Hemos provocado una situación en la que la luz se comporta efectivamente como una partícula, en el sentido de que dos fotones pueden interaccionar con fuerza. En un momento oscila de delante hacia atrás como si fuera un líquido, y en otro directamente se congela”, explica Türeci.

Los ordenadores actuales no ‘entienden’ la física cuántica

Se está muy cerca de poder construir al completo un ordenador cuántico y, nuestro mundo, se verá revolucionado como cuando llegó la relatividad especial de Einstein y el cuanto de acción de Planck

Esta investigación es parte del esfuerzo que científicos de todo el mundo están poniendo para intentar responder algunas preguntas fundamentales del comportamiento de las partículas subatómicas, cuestiones que no es posible contestar ni siquiera utilizando los ordenadores más potentes de los que disponemos hoy en día.

Es como resolver preguntas sobre aerodinámica observando un modelo de aeroplano en un túnel de viento, es decir, a través de una simulación física en vez de con cálculos digitalesLos equipos de computación con los que trabajan los científicos no sirven porque funcionan siguiendo la mecánica tradicional, que describe cómo es el mundo de los objetos cotidianos en una escala muy amplia, desde los planetas hasta los átomos y moléculas. Pero el mundo de los fotones y otras partículas de tamaño inferior al átomo funciona siguiendo las reglas de la mecánica cuántica, que incluye propiedades en apariencia imposibles e incomprensibles, como por ejemplo que varias partículas estén relacionadas en cuanto a su comportamiento a pesar de estar distanciadas por cientos de kilómetros.

Esa diferencia en cuanto a sus características limita la capacidad de los ordenadores de trabajar con estos componentes subatómicos. Simplemente, no puede calcular qué harán ante unos u otros estímulos. De forma que la comunidad científica lleva tiempo intentando crear un nuevo tipo de ordenador basado en las normas de la física cuántica, con el convencimiento de que así podrán responder a muchas de las preguntas que les intrigan de esta rama del conocimiento. Para crear esa nueva computadora, sin embargo, hace falta tiempo y profundizar en la investigación de estos fenómenos, creándose así un círculo que retrasa las respuestas.

Otra corriente dentro del estudio de la física cuántica, dentro de la que se enmarca el trabajo de los científicos de Princeton, apuesta por dejar de lado los ordenadores y desarrollar nuevas herramientas que imiten el comportamiento de las subpartículas. El inconveniente es que estas herramientas tendrán una utilidad más limitada que la de un ordenador cuántico, pero la ventaja está en que en teoría podrán crearse sin necesidad de responder previamente a cuestiones más complejas y avanzadas.

“Es como resolver preguntas sobre aerodinámica observando un modelo de aeroplano en un túnel de viento, es decir, a través de una simulación física en vez de con cálculos digitales”, explica una entrada en el blog Scienceblog.

También la luz, está presente en nuestros cerebros

En este caso, la herramienta desarrollada es muy pequeña y sus posibilidades son limitadas, pero los investigadores confían en poder ampliarla, así como aumentar el número de interacciones entre fotones, aumentando su capacidad de simular situaciones complejas. En el futuro esperan poder observar la luz en estados aún más extraños, como por ejemplo un superfluido o un aislante.”

Cuando sepamos lo que es la luz… ¡Sabremos lo que es el Universo… y nosotros!

Emilio Silvera V.

Ago

5

Materia de sombra, Axiones, ¿WIMPs en el Sol? ¿Y la vida?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

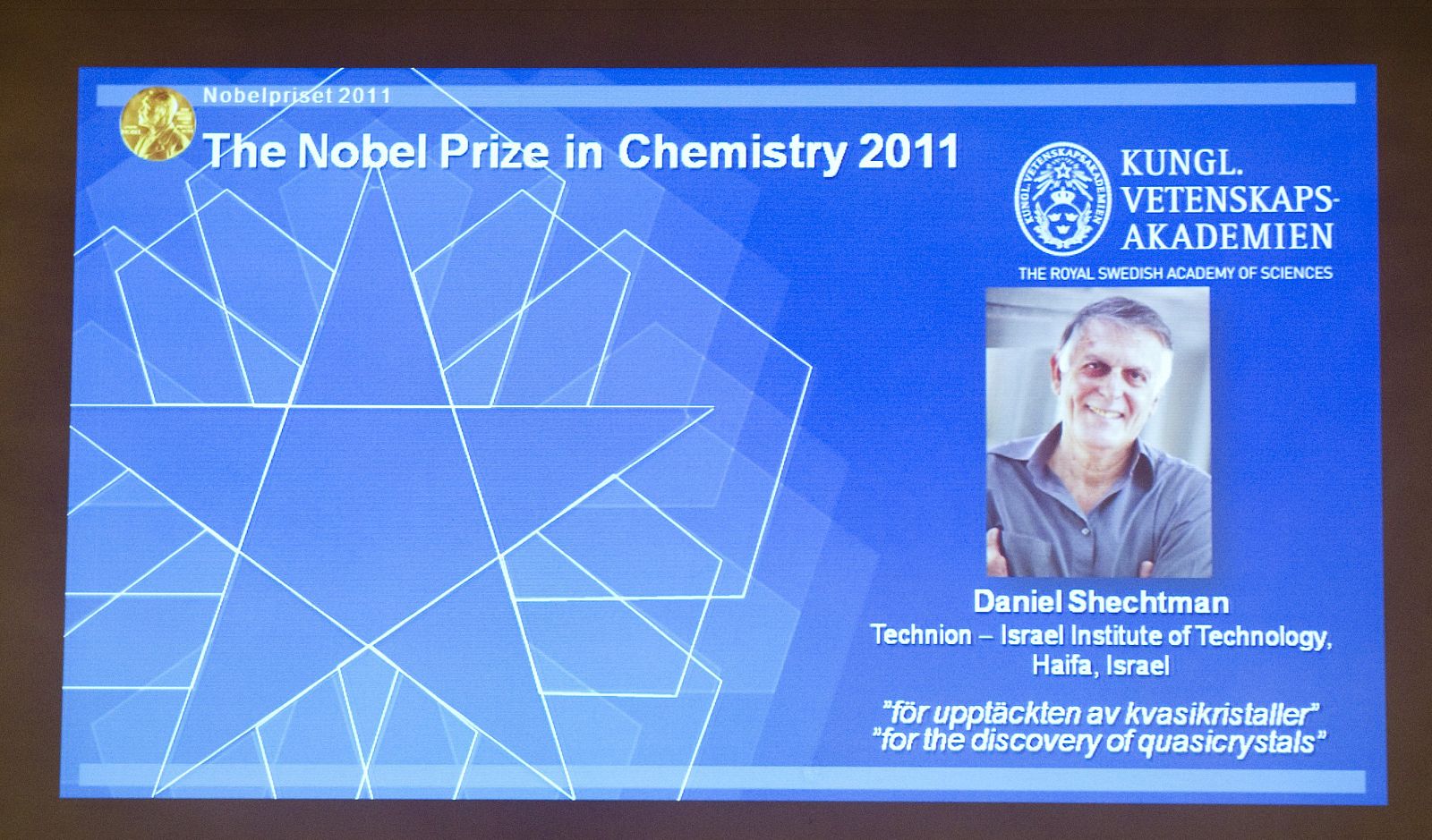

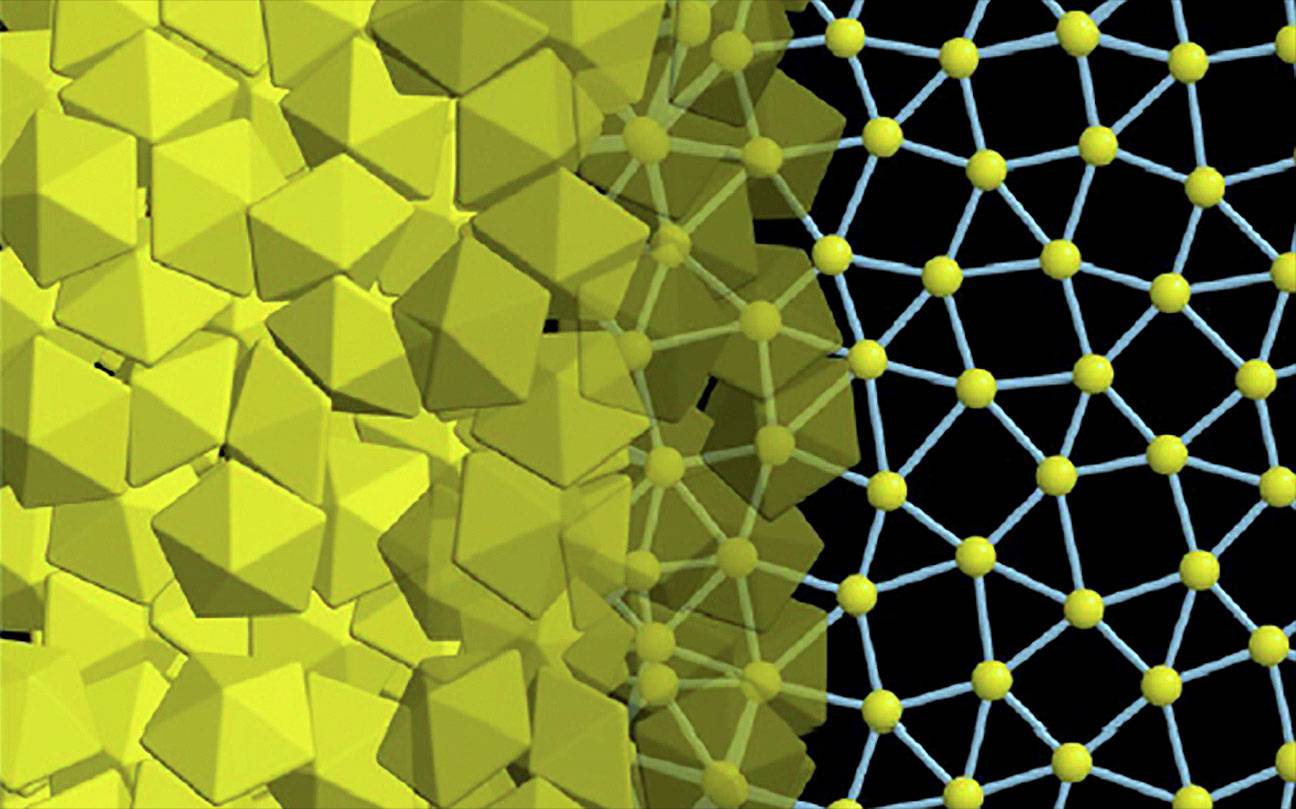

El premio nobel de química de 2011 fue concedido a Daniel Shechtman (Instituto Technion, Israel) por su descubrimiento de los cristales cuasiperiódicos (cuasicristales) en 1982. Dicho descubrimiento vino acompañado por dos grandes paradojas de carácter fundamental. La primera, de naturaleza esencialmente estructural, se resolvió en 1992 mediante una nueva definición de cristal por parte de la Unión Cristalográfica Internacional, definición inspirada en la noción de sólido aperiódico introducida por Schrödinger medio siglo antes.

Un cuasicristal es una forma estructural que es ordenada pero no periódica. Se forman patrones que llenan todo el espacio aunque tienen falta de simetría traslacional.

La segunda paradoja surgió del estudio detallado de las propiedades físico-químicas de las fases cuasicristalinas termodinámicamente estables: aleaciones formadas por metales, pero que manifiestan un comportamiento atípico, semejante al de los materiales semiconductores. En este caso, y a pesar de la intensa actividad experimental y teórica desplegada durante dos décadas, la posible solución de la paradoja sigue aún abierta.

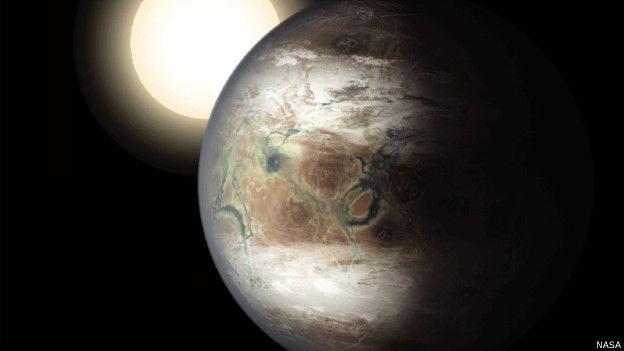

El Universo es igual en todas partes, y, los mundos, como en el sistema solar, evolucionan

Veamos que nos cuentan en…. Materia de sombra, axiones, ¿WIMPs en el Sol? ¿Y la vida?

Es curioso como a veces, la realidad de los hechos observados, vienen a derribar esas barreras que muchos ponen en sus mentes para negar lo evidente. Por ejemplo: Los extraordinarios resultados de la sonda Kepler, que en su primer año de misión ha encontrado ya 1.235 candidatos a planetas, 54 de ellos en la zona habitable de sus estrellas, ha permitido a los investigadores extrapolar el número total de mundos que podría haber sólo en la Vía Láctea, nuestra galaxia. Y ese número ronda los 50.000 millones. De los cuales, además, unos 500 millones estarían a la distancia adecuada de sus soles para permitir la existencia de agua en estado líquido, una condición necesaria para la vida.

negar lo evidente. Por ejemplo: Los extraordinarios resultados de la sonda Kepler, que en su primer año de misión ha encontrado ya 1.235 candidatos a planetas, 54 de ellos en la zona habitable de sus estrellas, ha permitido a los investigadores extrapolar el número total de mundos que podría haber sólo en la Vía Láctea, nuestra galaxia. Y ese número ronda los 50.000 millones. De los cuales, además, unos 500 millones estarían a la distancia adecuada de sus soles para permitir la existencia de agua en estado líquido, una condición necesaria para la vida.

Planetas parecidos a la Tierra, como arriba nos dicen, hay miles de millones y sólo cabe esperar que estén situados en los lugares adecuados para que la vida tenga la oportunidad de surgir acogida por el ecosistema ideal del agua líquida, una atmósfera acogedora y húmeda, temperatura ideal media y otros parámetros que la vida requiere para su existencia.

que la vida tenga la oportunidad de surgir acogida por el ecosistema ideal del agua líquida, una atmósfera acogedora y húmeda, temperatura ideal media y otros parámetros que la vida requiere para su existencia.

Un equipo de astrónomos internacionales pertenecientes al Observatorio Europeo Austral (ESO), el más importante del mundo, investiga la formación de un posible nuevo sistema planetario a partir de discos de material que rodea a una estrella joven. Según un comunicado difundido hoy por el centro astronómico que se levanta en la región norteña de Antofagasta, a través del “Very Large Telescope”(VLT), los científicos han estudiado la materia que rodea a una estrella joven.

sistema planetario a partir de discos de material que rodea a una estrella joven. Según un comunicado difundido hoy por el centro astronómico que se levanta en la región norteña de Antofagasta, a través del “Very Large Telescope”(VLT), los científicos han estudiado la materia que rodea a una estrella joven.

Según los astrónomos, los planetas se forman a partir de discos de material que rodean a las estrellas, pero la transición desde discos de polvo hasta sistemas planetarios es rápida y muy pocos son identificados en esta fase. Uno de los objetos estudiados por los astrónomos de ESO, es la estrella T Chamaleontis (T-Cha), ubicada en la pequeña constelación de Chamaleón, la cual es comparable al sol pero en sus etapas iniciales.

discos de polvo hasta sistemas planetarios es rápida y muy pocos son identificados en esta fase. Uno de los objetos estudiados por los astrónomos de ESO, es la estrella T Chamaleontis (T-Cha), ubicada en la pequeña constelación de Chamaleón, la cual es comparable al sol pero en sus etapas iniciales.

Dicha estrella se encuentra a unos 330 años luz de la Tierra y tiene 7 millones de años de edad, lo que se considera joven para una estrella. “Estudios anteriores han demostrado que T Cha es un excelente objetivo para estudiar cómo se forman los sistemas planetarios”, señala el astrónomo Johan Olofsson, del Max Planck Institute of Astronomy de Alemania.

330 años luz de la Tierra y tiene 7 millones de años de edad, lo que se considera joven para una estrella. “Estudios anteriores han demostrado que T Cha es un excelente objetivo para estudiar cómo se forman los sistemas planetarios”, señala el astrónomo Johan Olofsson, del Max Planck Institute of Astronomy de Alemania.

Algunas veces hablando de los extensos y complejos temas que subyacen en la Astronomía, lo mismo hablamos de “materia de sombre” que de “supercuerdas” y, se ha llegado a decir que existe otro universo de materia de sombra que existe en paralelo al nuestro. Los dos universos se separaron cuando la Gravedad se congeló separándose de las otras fuerzas. Las partículas de sombra interaccionan con nosotros sólo a través de la fuerza de la gravedad, lo cual las convierte en candidatas ideales para la tan traída y llevada “materia oscura”.

la Gravedad se congeló separándose de las otras fuerzas. Las partículas de sombra interaccionan con nosotros sólo a través de la fuerza de la gravedad, lo cual las convierte en candidatas ideales para la tan traída y llevada “materia oscura”.

Llegamos a los Axiones.

Un equipo de investigadores sostiene que las misteriosas corrientes de rayos X de energía ultra alta emitidas por algunas estrellas de neutrones podrían explicarse con axiones

Encontrar la hipotética partícula axión puede significar descubrir por primera vez lo que sucedió en el Universo un segundo después del Big Bang. Los axiones pueden ser el fósil cósmico que la ciencia espera. Encontrar la hipotética partícula axión puede significar descubrir por primera vez lo que sucedió en el Universo un segundo después del Big Bang

El estado actual de la cuestión es que los cosmólogos creen saber que hay una gran cantidad de materia oscura en el Universo y, han conseguido eliminar la candidatura de cualquier tipo de partícula ordinaria que conocemos. En tales circunstancias no se puede

actual de la cuestión es que los cosmólogos creen saber que hay una gran cantidad de materia oscura en el Universo y, han conseguido eliminar la candidatura de cualquier tipo de partícula ordinaria que conocemos. En tales circunstancias no se puede llegar a otra conclusión que la materia oscura debe de existir en alguna forma que todavía no hemos visto y cuyas propiedades ignoramos totalmente. Sin embargo, se atreven a decir que, la Gravedad, es el efecto que se produce cuando la “materia oscura” pierde consistencia… , o algo así. ¡Cómo son!

llegar a otra conclusión que la materia oscura debe de existir en alguna forma que todavía no hemos visto y cuyas propiedades ignoramos totalmente. Sin embargo, se atreven a decir que, la Gravedad, es el efecto que se produce cuando la “materia oscura” pierde consistencia… , o algo así. ¡Cómo son!

A los teóricos nada les gusta más que aquella situación en la cual puedan dejar volar libremente la imaginación sin miedo a que nada tan brusco como un experimento u observación acabe con su juego. En cualquier caso, han producido sugerencias extraordinarias acerca de lo que podría ser la “materia oscura” del universo.

un experimento u observación acabe con su juego. En cualquier caso, han producido sugerencias extraordinarias acerca de lo que podría ser la “materia oscura” del universo.

Lo que hay en el Universo…no siempre lo podemos comprender

Otro de los WIMPs favoritos se llama axión. Como el fotino y sus compañeros, el axión fue sugerido por consideraciones de simetría. Sin embargo, a diferencia de las partículas, sale de las Grandes Teorías Unificadas, que describen el Universo en el segundo 10ˉ³5, más que de las teorías totalmente unificadas que operan en el el tiempo de Max Planck.

Simetrías de las fuerzas y la materia

Durante mucho tiempo han sabido los físicos que toda reacción entre partículas elementales obedece a una simetría que llamamos CPT. Esto significa que si miramos la partícula de una reacción, y luego vemos la misma reacción cuando (1) la miramos en un espejo, (2) sustituimos todas las partículas por antipartículas y (3) hacemos pasar la película hacia atrás, los resultados serán idénticos. En este esquema la P significa paridad (el espejo), la C significa conjugación de carga (poner las antipartículas) y T la reversa del tiempo (pasar la película al revés).

Se pensaba que el mundo era simétrico respecto a CPT porque, al menos al nivel de las partículas elementales, era simétrico respecto a C, P y T independientemente. Ha resultado que no es éste el caso. El mundo visto en un espejo se desvía un tanto al mundo visto directamente, y lo mismo sucede al mundo visto cuando la película pasa al revés. Lo que sucede es que las desviaciones entre el mundo real y el inverso en cada uno de estos casos se cancelan una a la otra cuando miramos las tres inversiones combinadas.

combinadas.

Aunque esto es verdad, también es verdad que el mundo es casi simétrico respecto a CP actuando solos y a T actuando solo; es decir, que el mundo es casi el mismo si lo miran en un espejo y sustituyen las partículas por antipartículas que si lo miran directamente. Este “casi” es lo que preocupa a los físicos. ¿Por qué son las cosas casi perfectas, pero les falta algo?

es verdad que el mundo es casi simétrico respecto a CP actuando solos y a T actuando solo; es decir, que el mundo es casi el mismo si lo miran en un espejo y sustituyen las partículas por antipartículas que si lo miran directamente. Este “casi” es lo que preocupa a los físicos. ¿Por qué son las cosas casi perfectas, pero les falta algo?

La respuesta a esta cuestión parece que puede estar en la posible existencia de esa otra partícula apellidada axión. Se supone que el Axión es muy ligero (menos de una millonésima parte de la masa del electrón) e interacciona sólo débilmente con otra materia. Es la pequeña masa y la interacción débil lo que explica el “casi” que preocupa a los teóricos.

estar en la posible existencia de esa otra partícula apellidada axión. Se supone que el Axión es muy ligero (menos de una millonésima parte de la masa del electrón) e interacciona sólo débilmente con otra materia. Es la pequeña masa y la interacción débil lo que explica el “casi” que preocupa a los teóricos.

Las branas son entidades físicas conjeturadas por la teoría M y su vástago, cosmología de branas. En la teoría M, se postula la existencia de p-branas y d-branas (ambos nombres provienen parasintéticamente de “membrana”). Las p-branas son objetos de dimensionalidad espacial p (por ejemplo, una cuerda es una 1-brana). En cosmología de branas, el término “brana” se utiliza para referirse a los objetos similares al universo cuadri-dimensional que se mueven en un sustrato de mayor dimensión. Las d-branas son una clase particular de p-branas.

Un escenario posible imagina que el Universo empieza con todas sus dimensiones espaciales comportándose de una manera democrática, pero luego, algunas de las dimensiones quedan atrapadas y permanecen compactadas de manera tal que son infinitesimales, están el el límite de Planck y permanecen, como digo, estáticas y muy pequeñas desde entonces en ese lugar invisible al que no podemos llegar

En el mundo cuántico, todo puede ser posible

Cuando nos asomamos a la Teoría de cuerdas, entramos en un “mundo” lleno de sombras en los que podemos ver brillar, a lo lejos, un resplandor cegador. Todos los físicos coinciden en el hecho de que es una teoría muy prometedora y de la que parece se podrán obtener buenos rendimientos en el futuro pero, de momento, es imposible verificarla.

Las misteriosas funciones modulares!

El misterio de las funciones modulares podría ser explicado por quien ya no existe, Srinivasa Ramanujan, el hombre más extraño del mundo de los matemáticos. Igual que Riemann, murió antes de cumplir cuarenta años, y como Riemann antes que él, trabajó en total aislamiento en su universo particular de números y fue capaz de reinventar por sí mismo lo más valioso de cien años de matemáticas occidentales que, al estar aislado del mundo en las corrientes principales de los matemáticos, le eran totalmente desconocidos, así que los buscó sin conocerlos. Perdió muchos años de su vida en redescubrir matemáticas conocidas.

en su universo particular de números y fue capaz de reinventar por sí mismo lo más valioso de cien años de matemáticas occidentales que, al estar aislado del mundo en las corrientes principales de los matemáticos, le eran totalmente desconocidos, así que los buscó sin conocerlos. Perdió muchos años de su vida en redescubrir matemáticas conocidas.

Dispersas entre oscuras ecuaciones en sus cuadernos están estas funciones modulares, que figuran entre las más extrañas jamás encontradas en matemáticas. Ellas reaparecen en las ramas más distantes e inconexas de las matemáticas. Una función que aparece una y otra vez en la teoría de las funciones modulares se denomina (como

oscuras ecuaciones en sus cuadernos están estas funciones modulares, que figuran entre las más extrañas jamás encontradas en matemáticas. Ellas reaparecen en las ramas más distantes e inconexas de las matemáticas. Una función que aparece una y otra vez en la teoría de las funciones modulares se denomina (como ya he dicho otras veces) hoy día “función de Ramanujan” en su honor. Esta extraña función contiene un término elevado a la potencia veinticuatro.

ya he dicho otras veces) hoy día “función de Ramanujan” en su honor. Esta extraña función contiene un término elevado a la potencia veinticuatro.

¿Podéis imaginar la existencia de un Universo en permanente sombra?

La idea de un universo en sombra nos proporciona una manera sencilla de pensar en la materia oscura. El universo dividido en materia y materia se sombra en el Tiempo de Planck, y cada una evolucionó de acuerdo con sus propias leyes. Es de suponer que algún Hubble de sombra descubrió que ese universo de sombra se estaba expandiendo y es de suponer que algunos astrónomos de sombras piensan en nosotros como

una evolucionó de acuerdo con sus propias leyes. Es de suponer que algún Hubble de sombra descubrió que ese universo de sombra se estaba expandiendo y es de suponer que algunos astrónomos de sombras piensan en nosotros como candidatos para su materia oscura.

candidatos para su materia oscura.

¡Puede que incluso haya unos ustedes de sombras leyendo la versión de sombra de este trabajo!

que incluso haya unos ustedes de sombras leyendo la versión de sombra de este trabajo!

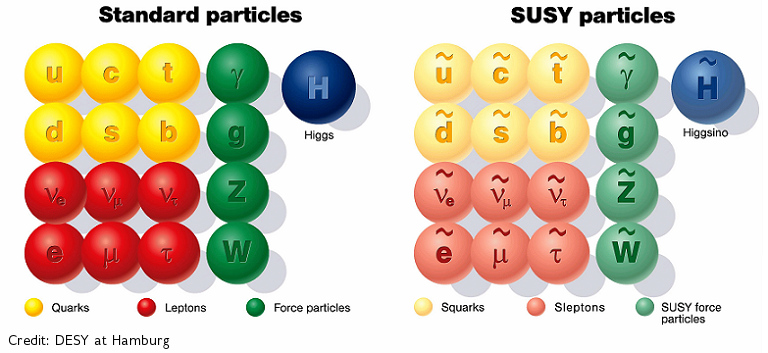

Partículas y partículas super-simétricas

Partículas son las que todos conocemos y que forman la materia, la super-simétricas, fotinos, squarks y otros, las estamos buscando sin poder hallarlas.

Estas partículas son predichas por las teorías que unifican todas las fuerzas de la naturaleza. Forman un conjunto de contrapartidas de las partículas a las que estamos habituados, pero son mucho más pesadas. Se nombran en analogía con sus compañeras: el squark es el compañero supersimétrico del quark, el fotino del fotón, etc. Las más ligeras de estas partículas podrían ser la materia oscura. Si es así, cada

son mucho más pesadas. Se nombran en analogía con sus compañeras: el squark es el compañero supersimétrico del quark, el fotino del fotón, etc. Las más ligeras de estas partículas podrían ser la materia oscura. Si es así, cada partícula probablemente pesaría al menos cuarenta veces más que el protón.

partícula probablemente pesaría al menos cuarenta veces más que el protón.

Materia de sombra, si existe, no hemos sabido dar con ella y, sin embargo, existen indicios de que está ahí

En algunas versiones de las llamadas teorías de supercuerdas hay todo un universo de materia de sombra que existe paralelo con el nuestro. Los dos universos se separaron cuando la gravedad se congeló separándose de las otras fuerzas. Las partículas de sombra interaccionan con nosotros sólo a través de la fuerza de la gravedad, lo que las convierte en candidatas ideales para la materia oscura.

la gravedad se congeló separándose de las otras fuerzas. Las partículas de sombra interaccionan con nosotros sólo a través de la fuerza de la gravedad, lo que las convierte en candidatas ideales para la materia oscura.

Axiones

El Axión es una partícula muy ligera (pero presumiblemente muy común) que, si existiera, resolvería un problema antiguo en la teoría de las partículas elementales. Se estima que tiene una masa menor que una millonésima parte de la del electrón y se supone que impregna el universo de una manera semejante al fondo de microondas. La materia oscura consistiría en agregaciones de axiones por encima del nivel general de fondo.

una masa menor que una millonésima parte de la del electrón y se supone que impregna el universo de una manera semejante al fondo de microondas. La materia oscura consistiría en agregaciones de axiones por encima del nivel general de fondo.

Construímos inmensos aparatos de ingeniosas propiedades tecnológicas para tratar de que nos busquen las WIMPs.

tratar de que nos busquen las WIMPs.

¿WIMPs en el Sol?

A lo largo de todo el trabajo se ha dado a entender que todas estas partículas candidatas a materia oscura de la que hemos estado hablando, son puramente hipotéticas. No hay pruebas de que ninguna de ellas se vaya a encontrar de hecho en la naturaleza. Sin embargo sería negligente si no mencionase un argumento –un diminuto rayo de esperanza- que tiende a apoyar la existencia de WIMPs de un tipo

se ha dado a entender que todas estas partículas candidatas a materia oscura de la que hemos estado hablando, son puramente hipotéticas. No hay pruebas de que ninguna de ellas se vaya a encontrar de hecho en la naturaleza. Sin embargo sería negligente si no mencionase un argumento –un diminuto rayo de esperanza- que tiende a apoyar la existencia de WIMPs de un tipo u otro. Este argumento tiene que ver con algunos problemas que han surgido en nuestra comprensión del funcionamiento y la estructura del Sol.

u otro. Este argumento tiene que ver con algunos problemas que han surgido en nuestra comprensión del funcionamiento y la estructura del Sol.

Protuberancias y vientos solares

Creemos que la energía del Sol viene de reacciones nucleares profundas dentro del núcleo. Si éste es el caso en realidad, la teoría nos dice que esas reacciones deberían estar produciendo neutrinos que en principio son detectables sobre la Tierra. Si conocemos la temperatura y composición del núcleo (como creemos), entonces podemos predecir exactamente cuántos neutrinos detectaremos. Durante más de veinte años se llevó a cabo un experimento en una mina de oro de Dakota del Sur para detectar esos neutrinos y, desgraciadamente, los resultados fueron desconcertantes. El número detectado fue de sólo un tercio de lo que se esperaba. Esto se conoce como el problema del neutrino solar.

creemos), entonces podemos predecir exactamente cuántos neutrinos detectaremos. Durante más de veinte años se llevó a cabo un experimento en una mina de oro de Dakota del Sur para detectar esos neutrinos y, desgraciadamente, los resultados fueron desconcertantes. El número detectado fue de sólo un tercio de lo que se esperaba. Esto se conoce como el problema del neutrino solar.

El problema de los neutrinos solares se debió a una gran discrepancia entre el número de neutrinos que llegaban a la Tierra y los modelos teóricos del interior del Sol. Este problema que duró desde

el número de neutrinos que llegaban a la Tierra y los modelos teóricos del interior del Sol. Este problema que duró desde mediados de la década de 1960 hasta el 2002, ha sido recientemente resuelto mediante un nuevo

mediados de la década de 1960 hasta el 2002, ha sido recientemente resuelto mediante un nuevo entendimiento de la física de neutrinos, necesitando una modificación en el modelo estándar de la física de partículas, concretamente en las neutrinos” href=”http://es.wikipedia.org/wiki/Oscilaci%C3%B3n_de_neutrinos”>oscilaciones de neutrinos. Básicamente, debido a que los neutrinos tienen masa, pueden cambiar del tipo de neutrino que se produce en el interior del Sol, el neutrino electrónico, en dos tipos de neutrinos, el muónico y el tauónico, que no fueron detectados.

entendimiento de la física de neutrinos, necesitando una modificación en el modelo estándar de la física de partículas, concretamente en las neutrinos” href=”http://es.wikipedia.org/wiki/Oscilaci%C3%B3n_de_neutrinos”>oscilaciones de neutrinos. Básicamente, debido a que los neutrinos tienen masa, pueden cambiar del tipo de neutrino que se produce en el interior del Sol, el neutrino electrónico, en dos tipos de neutrinos, el muónico y el tauónico, que no fueron detectados.

La segunda característica del Sol que concierne a la existencia de WIMPs se refiere al hecho de las oscilaciones solares. Cuando los astrónomos contemplan cuidadosamente la superficie solar, la ven vibrar y sacudirse; todo el Sol puede pulsar en períodos de varias horas. Estas oscilaciones son análogas a las ondas de los terremotos, y los astrónomos llaman a sus estudios “sismología solar”. Como creemos conocer la composición del Sol, tenemos que ser capaces de predecir las propiedades de estas ondas de terremotos solares. Sin embargo hay algunas duraderas discrepancias entre la teoría y la observación en este campo.

los astrónomos contemplan cuidadosamente la superficie solar, la ven vibrar y sacudirse; todo el Sol puede pulsar en períodos de varias horas. Estas oscilaciones son análogas a las ondas de los terremotos, y los astrónomos llaman a sus estudios “sismología solar”. Como creemos conocer la composición del Sol, tenemos que ser capaces de predecir las propiedades de estas ondas de terremotos solares. Sin embargo hay algunas duraderas discrepancias entre la teoría y la observación en este campo.

No hace mucho que los astrónomos han señalado que si la Galaxia está en realidad llena de materia oscura en la forma

mucho que los astrónomos han señalado que si la Galaxia está en realidad llena de materia oscura en la forma de WIMPs, entonces, durante su vida, el Sol habría absorbido un gran número de ellos. Los WIMPs, por tanto, formarían parte de la composición del Sol, una parte que no se había tenido en cuenta hasta ahora. Cuando los WIMPs son incluidos en los cálculos, resultan dos consecuencias: primero, la temperatura en el núcleo del Sol resulta ser menor de lo que se creía, de forma que son emitidos menos neutrinos, y segundo, las propiedades del cuerpo del Sol cambian de tal modo que las predicciones de las oscilaciones solares son exactas.

de WIMPs, entonces, durante su vida, el Sol habría absorbido un gran número de ellos. Los WIMPs, por tanto, formarían parte de la composición del Sol, una parte que no se había tenido en cuenta hasta ahora. Cuando los WIMPs son incluidos en los cálculos, resultan dos consecuencias: primero, la temperatura en el núcleo del Sol resulta ser menor de lo que se creía, de forma que son emitidos menos neutrinos, y segundo, las propiedades del cuerpo del Sol cambian de tal modo que las predicciones de las oscilaciones solares son exactas.

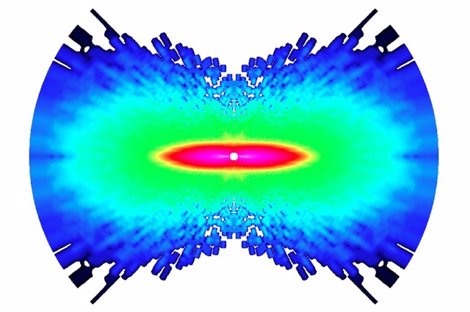

Hasta nos atrevemos a exponer una imagen que nos muestra la distribución de los WIMPs

nos atrevemos a exponer una imagen que nos muestra la distribución de los WIMPs

Este resultado es insignificante en lo que se refiere a la existencia de WIMPs, pero como no debemos despreciar las coincidencias halladas, lo más prudente será esperar a nuevos y más avanzados experimentos (SOHO y otros). Tanto el problema del neutrino como las oscilaciones se pueden explicar igualmente bien

no debemos despreciar las coincidencias halladas, lo más prudente será esperar a nuevos y más avanzados experimentos (SOHO y otros). Tanto el problema del neutrino como las oscilaciones se pueden explicar igualmente bien por otros efectos que no tienen nada que ver con los WIMPs. Por ejemplo, el tipo de oscilaciones de neutrinos podría resolverse si el neutrino solar tuviera alguna masa, aunque fuese muy pequeña, y diversos cambios en los detalles de la estructura interna del Sol podrían explicar las oscilaciones. No obstante estos fenómenos solares constituyen la única indicación que tenemos de que uno de los candidatos a la materia oscura pueda existir realmente.

por otros efectos que no tienen nada que ver con los WIMPs. Por ejemplo, el tipo de oscilaciones de neutrinos podría resolverse si el neutrino solar tuviera alguna masa, aunque fuese muy pequeña, y diversos cambios en los detalles de la estructura interna del Sol podrían explicar las oscilaciones. No obstante estos fenómenos solares constituyen la única indicación que tenemos de que uno de los candidatos a la materia oscura pueda existir realmente.

Toda esta charla sobre supersimetría y teoría últimas da a la discusión de la naturaleza de la materia oscura un tono solemne que no tiene ningún parecido con la forma en que se lleva en realidad el debate entre los cosmólogos. Una de las cosas que más me gusta de este campo es que todo el mundo parece ser capaz de conservar el sentido del humor y una distancia respecto a su propio trabajo, ya que, los buenos científicos saben que, todos los cálculos, conjeturas, hipótesis y finalmente teorías, no serán visadas en la aduana de la Ciencia, hasta que sean muy, pero que muy bien comprobadas mediante el experimento y la observación y, no una sino diez mil veces antes

charla sobre supersimetría y teoría últimas da a la discusión de la naturaleza de la materia oscura un tono solemne que no tiene ningún parecido con la forma en que se lleva en realidad el debate entre los cosmólogos. Una de las cosas que más me gusta de este campo es que todo el mundo parece ser capaz de conservar el sentido del humor y una distancia respecto a su propio trabajo, ya que, los buenos científicos saben que, todos los cálculos, conjeturas, hipótesis y finalmente teorías, no serán visadas en la aduana de la Ciencia, hasta que sean muy, pero que muy bien comprobadas mediante el experimento y la observación y, no una sino diez mil veces antes de que puedan ser aceptadas en el ámbito puramente científico.

de que puedan ser aceptadas en el ámbito puramente científico.

El el Sol podemos hallar algunas respuestas

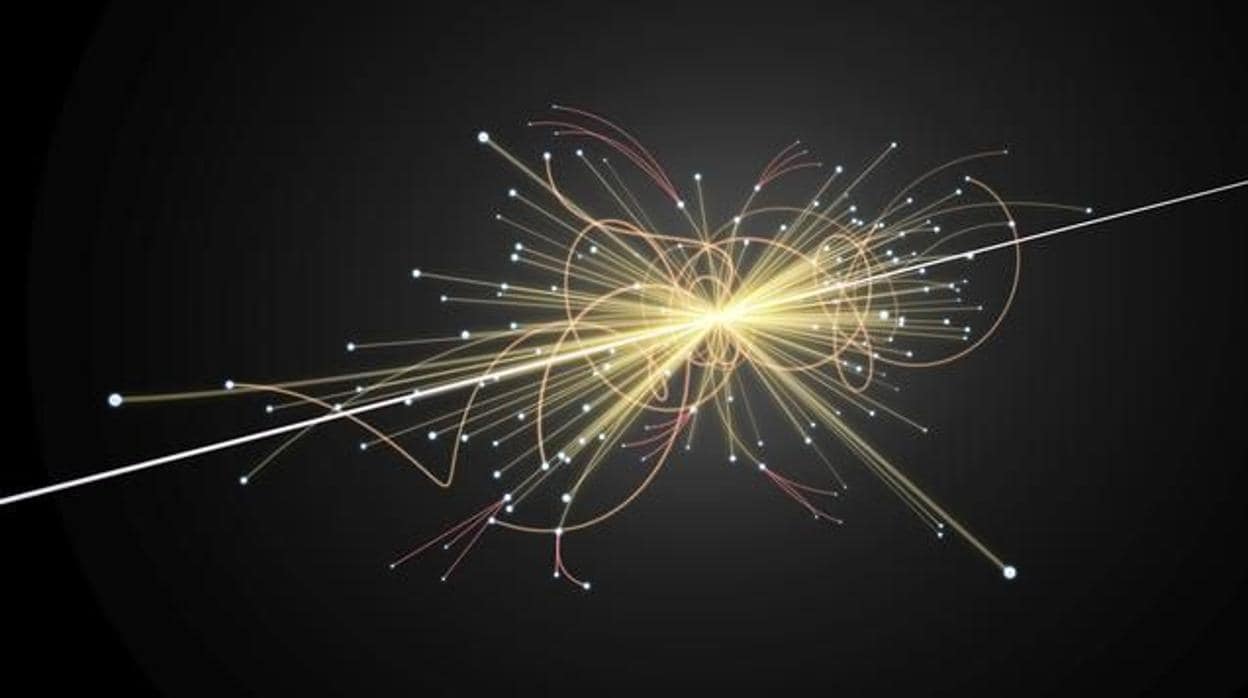

Posiblemente, el LHC nos pueda decir algo al respecto si, como no pocos esperan, de sus colisiones surgen algunas partículas supersimétricas que nos hablen de ese otro mundo oscuro que, estando en este, no hemos sabido encontrar hasta este momento. Otra posibilidad sería que la tan manoseada materia oscura no existiera y, en su lugar, se descubriera otro fenómeno o mecanismo natural desconocido hasta ahora que, incidiendo en el comportamiento de expansión del Universo, nos hiciera pensar en la existencia de la “materia oscura” para

este momento. Otra posibilidad sería que la tan manoseada materia oscura no existiera y, en su lugar, se descubriera otro fenómeno o mecanismo natural desconocido hasta ahora que, incidiendo en el comportamiento de expansión del Universo, nos hiciera pensar en la existencia de la “materia oscura” para cubrir el hueco de nuestra ignorancia.

cubrir el hueco de nuestra ignorancia.

Hace algún tiempo, en esas reuniones periódicas que se llevan a cabo entre científicos de materias relacionadas: física, astronomía, astrofísica, comología…, alguien del grupo sacó a relucir la idea de la extinción de los dinosaurios y, el hombre se refirió a la teoría (de los muchas que circulan) de que el Sol, en su rotación alrededor de la Vía Láctea, se salía periódicamente fuera del plano de la Galaxia. Cuando hacía esto, el polvo existente en ese plano podía cesar de proteger la Tierra, que entonces quedaría bañada en rayos cósmicos letales que los autores de la teoría pensaban que podían permeabilizar el cosmos. Alguien, desde el fondo de la sala lanzó: ¿Quiere decir que los dinosaurios fueron exterminados por la radiación de fotinos?

el fondo de la sala lanzó: ¿Quiere decir que los dinosaurios fueron exterminados por la radiación de fotinos?

La cosa se tomó a broma y risas marcaron el final de la reunión en la que no siempre se tratan los temas con esa seriedad que todos creen, toda vez que, los conocimientos que tenemos de las cosas son muy limitados y tomarse en serio lo que podría no ser… ¡No sería nada bueno!