Dic

23

Recordando a George J. Stoney

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

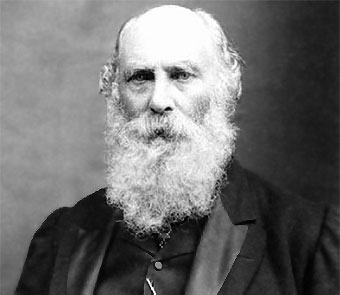

George J. Stoney, el físico irlandés y pensador excéntrico y original al que, en realidad, debemos la forma de deducir si otros planetas del sistema solar poseían o no una atmósfera gaseosa, como la Tierra, calculando si su gravedad superficial era suficientemente intensa para mantener esa atmósfera.

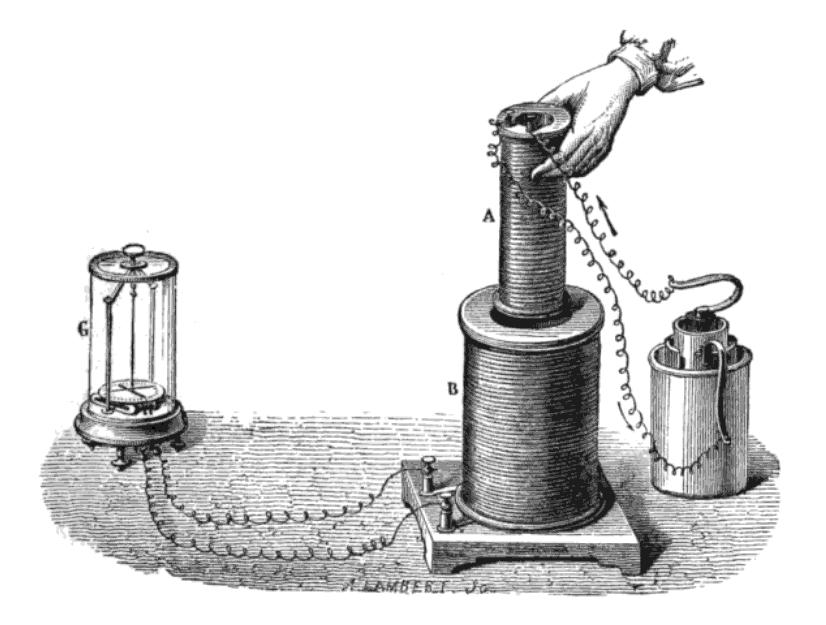

Pero su pasión real estaba reservada a su idea más preciada: el “electrón”. Stoney había deducido que debía existir un componente básico de carga eléctrica. Estudiando los experimentos de Michael Faraday sobre electrolisis, Stoney había predicho incluso cuál debía ser su valor, una predicción posteriormente confirmada por J. J. Thomson, descubridor del electrón en Cambridge en 1.897, dándole la razón a Stoney que finalmente, a esta unidad básica de la electricidad, le dio el nombre de electrón con el símbolo e en 1.891 (antes de su descubrimiento).

A. Turing y George Francis FitzGerald parientes de Stoney

Stoney, primo lejano y más viejo del famoso matemático, científico de computación y criptógrafo Alan Turing, también era tío de George Fitzgerald, después famoso por proponer la “contracción Fitzgerald-Lorentz”, un fenómeno que fue entendido finalmente en el contexto de la teoría de la relatividad especial de Einstein.

Stoney con sus hijas Edith y Florence

Stoney, podemos decir con seguridad, fue el primero que señaló el camino para encontrar lo que más tarde conoceríamos como constantes fundamentales, esos parámetros de la física que son invariantes, aunque su entorno se transforme. Ellas, las constantes, continúan inalterables como sucede, por ejemplo, con la velocidad de la luz c, que sea medida en la manera que sea, esté en reposo o esté en movimiento quien la mide o la fuente de donde parte, su velocidad será siempre la misma, 299.792.458 m/s. Algo análogo ocurre con la gravedad, G, que en todas partes mide el mismo parámetro o valor: G = 6’67259 × 10-11 m3 s-2 Kg-1. Es la fuerza de atracción que actúa entre todos los cuerpos y cuya intensidad depende de la masa de los cuerpos y de la distancia entre ellos; la fuerza gravitacional disminuye con el cuadrado de la distancia de acuerdo a la ley de la inversa del cuadrado.

Profesor de filosofía natural (así llamaban antes a la Física) en el Queen’s College Galway en 1.860, tras su retiro se trasladó a Hornsey, al norte de Londres, y continuó publicando un flujo de artículos en la revista científica de la Royal Dublín Society, siendo difícil encontrar alguna cuestión sobre la que no haya un artículo firmado por él.

Stoney recibió el encargo de hacer una exposición científica del tema que él mismo eligiera para el programa de la reunión de Belfast de la Asociación Británica. Pensando en qué tema elegir, se dio cuenta de que existían medidas y patrones e incluso explicaciones diferentes para unidades que median cosas o distancias o algún fenómeno: se preguntaba la manera de cómo definirlos mejor y como interrelacionarlos. Vio una oportunidad para tratar de simplificar esta vasta confusión de patrones humanos de medida de una manera tal que diese más peso a su hipótesis del electrón.

La escala Stoney

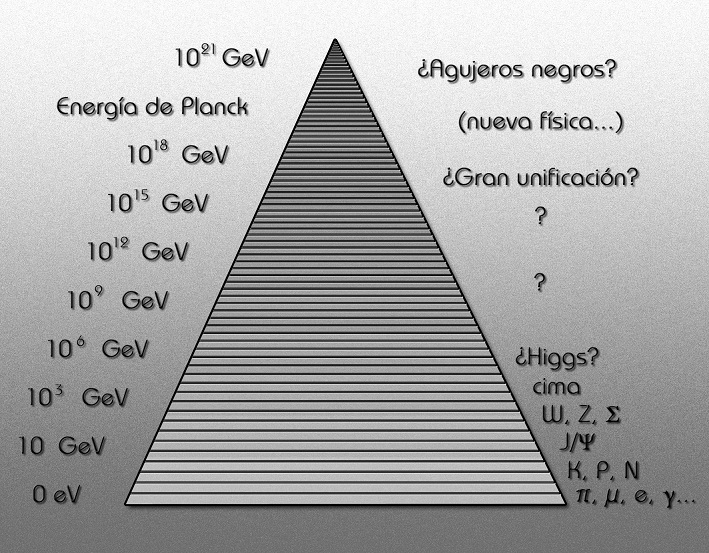

La escala de Planck, considerada como la más adecuada para explicar la teoría unificada, fue anticipada por George Johnstone Stoney.4 La escala de Stoney, (que implica una escala intermedia para explicar los efectos a gran escala como la gravedad y los efectos a pequeña escala como los electromagnéticos) comprende las unidades de escala de Stoney, sobre todo las de masa pero también de longitud y tiempo.

La masa de Stoney mS (expresada en términos contemporáneos) toma la forma:

donde ε0 es la permitividad del vacío, e es la carga elemental y G es la constante gravitacional, y donde α es la constante de estructura fina y mPes la masa de Planck.

En tal situación, Stoney centró su trabajo en unidades naturales que transcienden los patrones humanos, así que trabajó en la unidad de carga electrónica (según su concepto), inspirado en los trabajos de Faraday como hemos comentado antes. También, como unidades naturales escogió G y c que responde, como se ha explicado, a la gravedad universal y la velocidad de la luz en el vacío.

En 1874 estableció la hipótesis según la cual la electricidad era creada por unos corpúsculos elementales que llamó electrones, cuya carga intentó calcular.

En 1891, Stoney sugirió un nombre para la unidad fundamental de electricidad, fuese o no una partícula. Sugirió el nombre de electrón (nombre griego del ámbar, resina fósil que adquiere una carga eléctrica negativa al ser frotada con un paño), al analizar fenómenos electrolíticos y que se refería a las unidades de electricidad que un átomo perdía al transformarse en un ión.

George Johnstone Stoney (1826 – 1911)

En su charla de la Reunión de Belfast, Stoney se refirió al electrón como el “electrino” y dio el primer cálculo de su valor esperado. Demostró que el trío mágico de G, c y e podía combinarse de una manera, y sólo de una, de modo que a partir de ellas se creaban una unidad de masa, una unidad de longitud y una unidad de tiempo. Para la velocidad de la luz utilizó un promedio de las medidas existentes, c = 3 × 108 metros por segundo; para la constante de gravitación de Newton utilizó el valor obtenido por John Herschel, G = 6’67259 × 10-11 m3 s-2 Kg-1, y para la unidad de carga del “electrino” utilizó e = 10-20 amperios. Estas fueron las inusuales nuevas unidades que él encontró, en términos de las constantes e, c y G, y en términos de gramo, metros y segundos.

Estas son cantidades extraordinarias. Aunque una masa de 10-7 gramos no es demasiado espectacular – es similar a la de una mota de polvo – las unidades de longitud y tiempo de Stoney eran muy diferentes de cualquiera que hubieran encontrado antes los científicos. Eran fantásticamente pequeñas, rozando lo inconcebible. No había (y sigue sin haber) ninguna posibilidad de medir directamente tales longitudes y tiempos. En cierto modo, esto es lo que se podría haber esperado. Estas unidades no están construidas deliberadamente a partir de dimensiones humanas, por conveniencia humana o para utilidad humana. Están definidas por la propia fábrica de la realidad física que determina la naturaleza de la luz, la electricidad y la gravedad. No se preocupan de nosotros. Stoney triunfó de un modo brillante en su búsqueda de un sistema de unidades sobrehumanas.

“La ciencia no puede resolver el misterio final de la Naturaleza. Y esto se debe a que, en el último análisis, nosotros somos parte del misterio que estamos tratando de resolver.”

Max Planck

emilio silvera

Dic

23

La Física y el Tiempo

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (3)

Comments (3)

Para el topólogo, un nudo es una curva continua, cerrada y sin puntos dobles. Esta curva está situada en un espacio de tres dimensiones y se admite que pueda ser deformada, estirada, comprimida, aunque está “prohibido” hacerle cortes. Cuando se puede, a través de diversas manipulaciones, se pasa de un nudo a otro y se dice que son equivalentes. Claro que, algunos se abstraen en cuestiones con otras, al parecer, no relacionadas.

Un viejo amigo bromeaba diciendo que el Andante en do menor de la Sinfonía Concertante de Mozart conseguía devolverle a su intimidad anímica de partida, y que por eso, en su opinión, plasmaba de forma inefable el tiempo cíclico, o mejor aún, una CTC (“curva de género de tiempo cerrada”). Y transcurridos los doce minutos que dura ese movimiento, volvíamos a escucharlo una vez más. Mientras, discutíamossin cesar sobre el tiempo.

No es bueno perder la perspectiva

Hay un tiempo para cada cosa. Un tiempo para soñar, inconmensurable, un tiempo para vivir, siempre corto, un tiempo para filosofar, misterioso,…, y un tiempo para la ciencia, sujeto a número.

Me gustaría empezar definiendo el tiempo, pero no sé. Sesudos pensadores, como Platón y Aristóteles, lo ensayaron con brillantez. El tiempo es una imagen móvil de la eternidad. Esta imagen es eterna, pero se mueve según número, dirá Platón en el TIMEO. El tiempo es el número de movimiento según el antes y el después…El tiempo no es movimiento, sino movimiento en tanto en cuanto admite enumeración. El tiempo es una especie de número. El tiempo es obviamente aquello que se cuenta, no aquello con lo cual contamos, escribirá Aristóteles en su FÍSICA.

Alguna vez, en simbiosis con la Naturaleza, podemos sentir como se ha parado el tiempo

Son definiciones muy sugestivas, aunque teñidas de circularidad: movimiento en el tiempo, tiempo a través del movimiento. Agustín de Hipona vio esto claramente. Célebre es asimismo su declaración: Si nemo a me quaerat, scio; si quaerenti explicari velim, nescio (CONFESIONES). En uno de los análisis más penetrantes del tema, sugirió Agustín la mente como fuente de tiempo: En ti es, mente mía, donde mido los tiempos.

Time is what happens when nothing else happens, afirma Feynman; para a continuación advertir que toda definición del tiempo es necesariamente circular, y que lo importante no es decir qué es el tiempo, sino decir cómo se mide lo que llamamos tiempo. En su enciclopédico tratado sobre la gravitación, Misner, Thorne y Wheeler nos recuerdan de forma sencilla y profunda lo que toda medida del tiempo físico debe cumplir: Time is defined so that motion looks simple.

El tiempo es un concepto inventado por el hombre para ordenar, primero, sus sensaciones y actos, y luego, los fenómenos. Decían los escolásticos: Tempus est ens rationis cum fundamento in re. La primera unidad natural debió ser el día, por la ciclidad conspicua de las salidas del Sol. Los grandes avances científicos y tecnológicos a lo largo de los siglos han estado vinculados a los adelantos en la precisión con que se ha ido midiendo el tiempo. Hoy disponemos de relojes que aseguran un segundo en 20 millones de años, y el paso de la femtoquímica a la attofísica empieza a ser una realidad.

No pocas veces nos podemos ver perdidos en la vorágina de lo que llamamos tiempo, algo tan enorme que, en realidad, no sabemos lo que es. No lo hemos llegado a comprender, y, por si fuero poco, tampoco sabemos, si en realidad existe.

El tiempo antes de Einstein.

La física nació en torno al tiempo. Las regularidades en los ciclos astrales permitieron al acierto en las predicciones apoyadas en esta periodicidad, y con ello despertó sin duda la confianza del hombre en la racionalidad, inclinándole a escoger el cosmos frente al caos.

Breve historia de la medida del tiempo

La longitud de las sombras fue uno de los primeros métodos usados para fijar las horas. En el Museo Egipcio de Berlín hay un fragmento de piedra que posiblemente sea de un reloj de sol de alrededor de 1500 a.C. Los babilonios desarrollaron los relojes de sol, y se dice que el astrónomo Anaximandro de Mileto los introdujo en Grecia en el siglo VI a.C.

En el siglo II a C, Eratóstenes, de la biblioteca de Alejandría, concibió y llevó a cabo la primera medida de las dimensiones de la Tierra de la que se tiene noticia. En el Año Internacional de la Astronomía, una de las actividades que se llevaron a cabo fue, precisamente averiguar el radio terrestre por el mismo método.

Aparte de relojes de sol, en la antigüedad se usaron también relojes de arena, de agua, cirios y lámparas de aceite graduadas.

En la segunda mitad del siglo XIII aparecen los primeros relojes mecánicos. Su precisión era muy baja (10-20%). En el XIV se mejoran, con el invento del escape de rueda catalina, y ya se alcanzan precisiones de 20 a 30 minutos por día (1-2%). Por allá al año 1345 se empieza a dividir las horas en minutos y segundos.

El tiempo físico asoma en el siglo XIV, en el Merton College Oxford y luego en la Universidad de París, con Oresme. Se representa en una línea horizontal, mientras en vertical se disponen las cualidades variables. Son los primeros gráficos de función (en este caso, función del tiempo). La cinemática celeste brinda un buen reloj a través de la segunda ley de Kepler, midiendo tiempos mediante áreas. La ley armónica de Kepler permitirá medirlos a través de longitudes. Galileo desarrolló la cinemática terrestre, y sugirió el reloj de péndulo. A Huygens debemos la técnica de medida del tiempo que ha llegado a nuestros días, y que suministró relojes más precisos y transportables mediante volantes oscilatorios acoplados a resortes de calidad.

Diseño del reloj de péndulo de Huygens, 1656 (imagen de dominio público).

La importancia, no sólo científica sino económica, de disponer de relojes precisos y estables, queda reflejada en el premio ofrecido por el gobierno inglés de la reina Ana en 1714, que dispuso that a reward be settled by Parliament upon such person o persons as shall discover a more certain and practicable method of ascertainig longitude that any yet in practice. La recompensa era de 20, 000 libras para el que presentara un cronómetro capaz de determinar la longitud con error menor de 30´ de arco al término de un viaje a las Indias occidentales, equivalente a mantener el tiempo con error menor de 2 minutos tras seis semanas de viaje. Se la llevó casi medio siglo después el relojero británico John Harrison (1693-1776), con un reloj, conocido como H4, que incorporaba correcciones por variación en la temperatura, y que en un primer viaje de 81 días desde Porstmouth a Puerto Real (Jamaica) en 1761-62 se retrasó 5 s, esto es, de precisión 10⁻⁶ (10; 44).

Después se pasó a los de diapasón, de aquí a los de cuarzo, y hoy los atómicos ofrecen precisiones desde 10⁻¹² – 10⁻¹⁵ (Cs) hasta 10⁻¹⁶ (máser de H).

Una red de relojes atómicos de cesio, sincronizados mediante ondas de radio, velan actualmente por la exactitud de la hora sobre el planeta. Como señala Davies (10), ya no nos sirve como cronómetro el giro de la Tierra alrededor de su eje. Aunque durante siglos ha sido este viejo trompo un magnífico reloj de referencia, la falta de uniformidad de su giro (las mareas, por ejemplo, lo frenan incesantemente y alargan con ello el día en un par de milésimas de segundo por siglo, perceptible para los finos cronómetros actuales), y otras desviaciones estacionales, cuantitativamente similares a estos retrasos seculares, pero irregulares y de signo variable, son circunstancias que en conjunto obligan a añadir al tiempo civil un segundo intercalar cada uno o dos años (el último lo fue el 1 de enero de 1999, a las 0 horas) con el fin de remediar la asincronía entre los tiempos atómicos y los días astronómicos. El día no tiene 86 400 s justos (donde el segundo se define como la duración de 9 192 631 770 períodos de una determinada vibración de los átomos de Cs. Hoy la tecnología alcanza precisiones fabulosas: relojes que en treinta millones de años se desviarían a lo sumo en un diminuto segundo, como el NIST-F1 (Boulder, Colorado).

Por norma general y para mayor exactitud del sistema, dentro del campo visual de cualquier receptor GPS siempre hay por lo menos 8 satélites presentes. Cada uno de esos satélites mide 5 m de largo y pesa 860 kg . La energía eléctrica que requieren para su funcionamiento la adquieren a partir de dos paneles compuestos de celdas solares adosadas a sus costados. Están equipados con un transmisor de señales codificadas de alta frecuencia, un sistema de computación y un reloj atómico de cesio, tan exacto que solamente se atrasa un segundo cada 30 mil años.

La posición que ocupan los satélites en sus respectivas órbitas facilita que el receptor GPS reciba, de forma constante y simultánea, las señales de por lo menos 6 u 8 de ellos, independientemente del sitio donde nos encontremos situado. Mientras más señales capte el receptor GPS, más precisión tendrá para determinar las coordenadas donde se encuentra situado.

Incluso hay relojes de pulsera comerciales (receptores de señales de radio) con precisión de un segundo por millón de años garantizada por un reloj atómico en una lejana estación. La naturaleza de altísima precisión: la estabilidad del púlsar binario b1855+09 puede ser de unas partes en 10¹⁵ o incluso mejor.

El tiempo en Newton:

En los PRINCIPIA, Newton empieza con una renuncia a definir el tiempo: El tiempo, el espacio, el lugar y el movimiento son de todos bien conocidos. Y no los defino. Pero digo que el vulgo no concibe esas cantidades más que por su relación a cosas sensibles. Para evitar ciertos prejuicios que de aquí se originan, es conveniente distinguirlas en absolutas y relativas, verdaderas y aparentes, matemáticas y vulgares.

Isaac Newton en 1702 por Geoffrey Kneller

A continuación, sin embargo, Newton se arrepiente de su primer impulso y aclara: El tiempo absoluto, verdadero y matemático, de suyo y por su propia naturaleza fluye uniformemente sin relación a nada externo y se llama también duración: el tiempo relativo, aparente y vulgar es cualquier medida sensible y externa (exacta o no uniforme) de la duración por medio del movimiento y se usa vulgarmente en lugar del tiempo verdadero: tal como la hora, el día, el mes, el año.

¿Qué significa que el tiempo fluye? ¿Qué el tiempo “se mueve en el tiempo”? De nuevo la pescadilla mordiéndose la cola. El absolutismo del tiempo newtoniano recibió encendidas críticas. Leibniz opuso su idea de espacio y tiempos puramente relativos, el primero como un orden de coexistencia, el segundo como un orden de sucesiones de las cosas; ambos, espacio y tiempo, son phœnomena bene fundata. Los argumentos dinámicos con que Newton arropa su tesis de la naturaleza absoluta de la rotación y con ello la de un espacio absoluto, apoyo posterior para el tiempo absoluto, también hallan fuertes objeciones. Para Berkeley esas razones de Newton lo único que muestran es la importancia del giro respecto de las masas lejanas del Universo y no respecto de un espacio absoluto, que él no acepta. Ernst Mach, en la segunda mitad del XIX, insistirá decididamente en este punto de vista, y desde su positivismo acosará los absolutos newtonianos. De “medieval”, “no científico”, “metafísico”, tilda Mach a Newton: No tenemos derecho a hablar de un tiempo “absoluto”: de un tiempo independiente de todo cambio. Tal tiempo absoluto no puede medirse por comparación con ningún movimiento; por tanto no tiene valor práctico ni científico, y nadie tiene derecho a decir que sabe algo de él. Es una concepción metafísica vana.

El tiempo en Einstein:

El tiempo newtoniano, absoluto, el nos es familiar, tuvo que dejar paso al tiempo einsteniano, mutable y relativo, con tantos “ahora” por suceso cuantos estados de movimiento mutuo imaginemos.

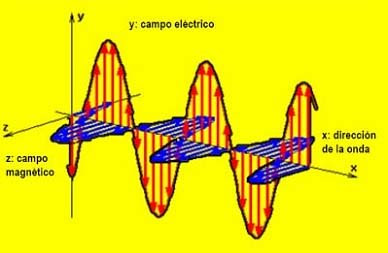

El tercero de los trabajo enviados por Albert Einstein (AE) en su Annus Mirabilis de 1905 a Annalen der Physik lleva por título “Zur Elektrodynamik Bewegter Körper” (“Sobre la electrodinámica de los cuerpos en movimiento”). Junto con el quinto, titulado “Ist der Trägheit eines Körpers von seinem Energieinhalt abhängig?” (“¿Depende la inercia de un cuerpo de su contenido de energía?”), constituyen lo que hoy se llama TEORÍA ESPECIAL DE LA RELATIVIDAD.

Da A.E. un par de razones para justificar su tercer trabajo:

- La insatisfacción que le produce la asimetría en la descripción maxwelliana de los fenómenos electromagnéticos: la acción entre un conductor y un imán depende solo del movimiento relativo entre ambos, pero la teoría de Maxwell distingue entre el caso de conductor en reposo y el caso de imán en reposo: a) En el primer caso el campo magnético móvil engendra un campo eléctrico, con una energía determinada, que a su vez produce corrientes en el conductor en reposo. b) En el segundo caso, no se produce ningún campo electrónico, sino una fuerza electromotriz en el conductor, sin energía asociada, que engendra una corriente como en el caso anterior.

- La incapacidad de la óptica y del electromagnetismo (EM) para detectar el movimiento respecto del lichtmedium, es decir, de un inercial privilegiado. Esto le sugiere que la óptica y el EM tienen las mismas ecuaciones en todos los inerciales (sistemas en los que las leyes de la mecánica de Newton son las mismas). Y AE eleva esto a un principio, que llama “Prinzip der Relativität”, y le añade un compañero, aparentemente incompatible con él: “La velocidad de la luz en vacío es siempre la misma, con independencia del estado de movimiento del cuerpo emisor”.

¿Será ese de arriba el rayo de luz de Einstein, o, por el contrario, será un asteroide que se nos viene encima?

Siendo todavía muy joven, en 1895-1896, ya le preocupaba el EM y la luz, como recordaba en 1955: “Si persiguiéramos a la velocidad de la luz un rayo de luz, veríamos una onda independiente del tiempo. ¡Tal cosa, sin embargo, no existe! Este fue el primer experimento mental, infantil, en relación con la teoría especial de la relatividad”.

Este tercer trabajo de Einstein en 1905 no contiene ninguna referencia a otros trabajos, ni suyos ni de otros (como Lorentz o Poincaré).

Consciente de que su postulado de la constancia de la velocidad de la luz choca frontalmente con la ley galileana de adición de velocidades, Albert Einstein revisa los cimientos de la Física, empezando por definir físicamente y con sumo cuidado el concepto de Gleichzeitigkeit o simultaneidad entre sucesos. Considera un sistema inercial, para el que supone válida la geometría euclidiana para calcular distancias entre objetos estacionarios a través de sus coordenadas respecto de sus ejes cartesianos. Si A, B son dos observadores estacionarios, provistos de relojes iguales, y A (B) manda una señal luminosa a B (A), quien la devuelve sin tardanza a A (B), diremos que el reloj de A está sincronizado con el reloj de B si

t(B) – t(A) = t’(A) – t(B),

donde t(A) es el tiempo marcado por el reloj de A cuando envía la señal a B, t(B) lo que marca el reloj de B al llegarle la señal de A y reemitirla, y t’(A) la lectura del reloj de A al recibir la devolución de B.

No parece el mejor método para medir la velocidad de la luz, el empleado por Galileo. Claro que, en aquellos tiempos…¿Qué se podía hacer?

Supone Albert Einstein que esta definición no lleva a contradicciones, que es en principio posible entre cualquier par de observadores estacionarios en el inercial, y que la relación de sincronización anterior es de equivalencia: Si A está sincronizada con B, también B lo está con A, y si además B lo está con C, también A y C lo están. A esto le siguen ecuaciones que quiero obviar para no dar complejidad al trabajo.

No existe “el” presente

Pasa Albert Einstein a enunciar con precisión el principio de relatividad y el postulado de la constancia de la velocidad de la luz en el vacío:

- Las leyes que rigen los cambios de los sistemas físicos son las mismas en todos los inerciales.

- Todo rayo de luz se mueve en cualquier inercial con una misma velocidad, c, independientemente del movimiento de su fuente.

Como consecuencia, demuestra que el concepto de sincronía, y por ende de simultaneidad, es relativo, no absoluto. La noción de “presente”, “ahora” o cualquier instante determinado depende del referencial inercial.

Algunos incluso hablaron de ernegía taquiónica

¿Más rápido que la luz?

¿Existen partículas que se muevan con velocidad superior a la de la luz? Sí; por ejemplo, cualquier partícula que lleve en agua, a temperatura entre 0 y 50 ºC, una velocidad ν > c / n, n = 1.3, irá más deprisa en ese medio que los fotones del espectro visible. Lo mismo ocurre con la mayoría de los rayos cósmicos que llegan a la atmósfera; son superlumínicos en relación con la velocidad de la luz en el aire. Precisamente en esta posibilidad de rebasar la velocidad de la luz en un medio reside el efecto Cerenkov.

Lo que no se conocen son taquiones, o partículas que se muevan más deprisa que la luz en el vacío. Si existieran, podrían utilizarse para mandar información al pasado. Violando el orden causa-efecto. Por ello se “decreta” su inexistencia.

En fin, que la velocidad de la luz en el vacío, al menos que sepamos, es infranqueable. Es un límite impuesto por la Naturaleza al que habrá que vencer, no superándolo (que no se puede), sino mediante una artimaña física inteligente que logre burlar dicho límite.

Aparte de algún que otro añadido, el artículo (parcialmente expuesto aquí -se obviaron partes complejas), es del Físico de la Universidad Complutense D. Alberto Galindo Tixaire. Fue publicado en el Volumen 19, número 1 de la Revista Española de Física en 2005 Año Mundial de la Física

En realidad, un Homenaje a Einstein por haber pasado más de un siglo desde aquel acontecimiento memorable de la Relatividad Especial en el año 1.905 y estar a punto de cumplirse otro siglo desde su relatividad general de 1905. Dos acontecimientos que marcaron el camino de la Física y la Cosmología.

emilio silvera

Dic

22

La Física de Partículas y el Modelo Estándar

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (2)

Comments (2)

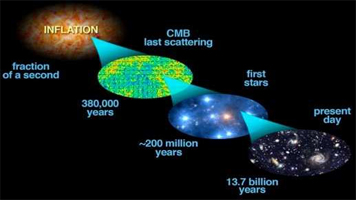

El hombre se ha preguntado durante largo tiempo, “¿de qué está hecho el mundo?” Demócrito de Abdera nos hablaba del “átomo”, la parte invisible e indivisible de la materia. Empédocles de Agrigento, nos decía que todo lo que podemos ver y está hecho de cuatro elementos: aire, agua, tierra y fuego que mezclados en la debida proporción formaban todas las cosas. Otros se referían a la sustancia cósmica a la que llamaban Ylem, aquella “semilla” primera que daría lugar a la venida de la materia. ¿No será el Ylem, lo que después llamaron éter luminífero y más tarde “materia oscura“?

Está claro que no poseían los datos suficientes para determinar de manera exacta todas aquellas cuestiones pero… ¿Quién les niega intuición? Ellos fueron los precursores de lo que muchos siglos más tarde vendría.

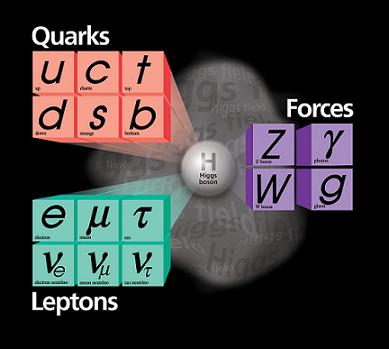

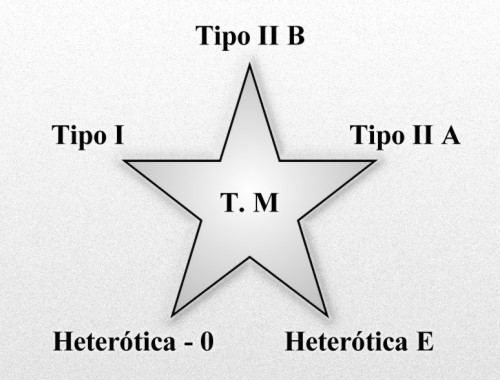

Aquí están todos los componentes de las familias de partículas que conforman la materia y las fuerzas fundamentales de la Naturaleza que, se vale de todas ellas para conseguir sus fines, y, que nuestro Universo sea tal como lo podemos observar.

Ahora sabemos que, no sólo nuestro mundo, sino todo el inmenso Universo, está hecho de pequeños objetos infinitesimales a las que hemos denominado partículas subatómicas y que forman varias familias. Unas son más elementales que otras y según, a qué familia pertenezcan y qué características puedan tener, se ocupan de ejercer una función particular para que todo funcione conforme a los planes de la Naturaleza.

Son los constituyentes fundamentales de toda la materia del Universo (por lo menos de toda la materia conocida y que podemos detectar formando estrellas y mundos, galaxias o seres vivos). Hemos podido llegar a saber que, de esas briznas de materia se forman los núcleos que, rodeados de electronesconforman los átomos de la materia.

Todo lo grande está hecho de “cosas” pequeñas

Los grupos de átomos conforman las moléculas que son las unidades fundamentales de los compuestos químicos pero, comencemos por los núcleos atómicos:

Muchas son las veces que aquí mismo he podido explicar, que los quarks u y d se hallan en el interior de los nucleones (protones y neutrones) y, por tanto, su habitat está en los núcleos atómicos donde se encuentran confinados y, en realidad, no intervienen directamente en las propiedades de los núcleos. Sin embargo, no podemos olvidar que la fuerza nuclear fuerte está ahí manteniendo confinado a los quarkspor medio de los gluones (los bosones intermediarios de la fuerza) y, eso hace que, el núcleo sea estable.

Tripletes de Quarks conforman los nucleones (protones y neutrones) y, quedan allí confinados mediante la fuerza nuclear fuerte que, mediada por los Bosones llamados Gluones, los retiene de manera tal que, si los quarks tratan de alejarse la fuerza aumenta.

Los núcleos atómicos constituyen un tipo de materia que, aisladamente, de forma individual (si exceptuamos el protón), siempre están en ambientes muy energéticos, por ejemplo, en el interior de las estrellas. En nuestro entorno terráqueo, es raro encontrar núcleos aislados, sino parcial o totalmente confinados dentro de los átomos.

Sabemos que el número de especímenes atómicos es limitado, existiendo ciertas razones para suponer que hacia el número atómico 173 los correspondientes núcleos serían inestables, no por razones intrínsecas de inestabilidad “radiactiva” nuclear, sino por razones relativistas. Ya señalé en otros escritos que, el número de especies atómicas, naturales y artificiales, es de unos pocos miles, en cambio, el número de moléculas conocidas hasta ahora comprenden unos pocos millones de especímenes, aumentando continuamente el número de ellas gracias a la síntesis que se lleva a cabo en numerosos laboratorios repartidos por todo el mundo.

Molécula de Dióxido de Carbono

Una molécula es una estructura, con individualidad propia, constituida por un conjunto de núcleos y sus electrones. La molécula más sencilla es la de Hidrógeno que tiene dos electrones, hasta las más complejas como las de las proteínas, con muchos miles de ellos, existen toda una gama de varios millones. Esta extraordinaria variedad de especies moleculares contrasta con la de las especies nucleares e incluso atómicas.

Desde el punto de vista de la información, las especies moleculares la poseen en mucho mayor grado que las nucleares o atómicas. Dejando aparte los núcleos, la información que soportan los átomos se podría atribuir a la distribución de su carga eléctrica, y en particular a los electrones más débilmente ligados. Concretando un poco más, se podría admitir que la citada información la aportan los orbitales atómicos, pues son precisamente estos orbitales los que introducen diferencias “geométricas” entre los diferentes electrones “corticales”.

Las partículas forman átomos, los átomos moléculas y las moléculas sustancias y cuerpos que están hechos por la diversa variedad de elementos que conforma la materia conocida y que, en definitiva, sólo son Quarks y Leptones.

Fermión

Es una partícula perteneciente a una familia de partículas elementales caracterizada por su momento angular intrínseco o spin. Los fermiones son nombrados después de Enrico Fermi, en el modelo estándar, existen dos tipos de fermiones elementales, que son: Los quarks y los leptones. Según la teoría cuantica, el momento angular de las partículas solo puede adoptar determinados valores, que pueden ser múltiplos enteros de una determinada constante h (Constante de Planck) o múltiplos semientereos de esa misma constante. Los fermiones, entre los que se encuentran los electrones, los protones y los neutrones, tienen múltiplos semienteros de h, por ejemplo ±1/2h o ±3/2h. Los fermiones cumplen el principio de exclusión.

El nucleo de un átomo es un fermion o boson, dependiendo de si el número total de sus protones y neutrones es par o impar respectivamente. Recientemente, los científicos han descubierto que esto causa comportamiento muy extraño en ciertos átomos cuando son sometidos a condiciones inusuales, tal como el helio demasiado frió.

Bosón

El bosón es una partícula atómica o subatómica, de spin entero o nulo, que cumple los postulados de la estadística de Bose-Einstein e incumple el principio de exclusión de Paulli (establece que dos electrones no pueden ocupar el mismo estado energético). Son bosones las partículas alfa, los fotones y los nucleidos con un número par de nucleones.

Demos una vuelta por el Modelo Estándar.

Me quiero referir al Modelo estándar de la física de partículas y de las interacciones fundamentales y, algunos, han llegado a creer que sólo faltan algunos detalles técnicos y, con ellos, la física teórica está acabada. Tenemos un modelo que engloba todo lo que deseamos saber acerca de nuestro mundo físico. ¿Qué más podemos desear? Los pobres ilusos no caen en la cuenta de que el tal Modelo, al que no podemos negarle su valía como una herramienta muy valiosa para la física, no deja de estar incompleto y, además, ha sido construido con algunos parámetros aleatorios (unos veinte) que no tienen justificación. Uno de ellos era el Bosón de Higgs y, según nos han contado los del LHC, ha sido hallado. Sin embargo, esperamos que nos den muchas explicaciones que no han estado presente en todas las algaradas y fanfarrias que dicho “hallazgo” ha producido, incluidos los premios Principe de Asturias y el Nobel. ¡Veremos en que queda todo esto al final!

Bueno, lo que hasta el momento hemos logrado no está mal del todo pero, no llega, ni con mucho, a la perfección que la Naturaleza refleja y que, nosotros perseguimos sin llegar a poder agarrar sus múltiples entrecijos y parámetros que conforman ese todo en el que, sin ninguna clase de excusas, todo debe encajar y, de momento, no es así. Muchos son los flecos sueltos, muchas las incognitas, múltiples los matices que no sabemos perfilar.

Es cierto que, el Modelo estándar, en algunos momento, nos produce y nos da la sensación de que puede ser perfecto. Sin embargo, esa ilusoria perfección, no es permanente y en algunas casos efímera. En primer lugar, podríamos empezar a quejarnos de las casi veinte constantes que no se pueden calcular. Pero si esta fuese la única queja, habría poco que hacer. Desde luego, se han sugerido numerosas ideas para explicar el origen de estos números y se han propuesto varias teorías para “predecir” sus valores. El problema con todas estas teorías es que los argumentos que dan nunca llegan a ser convincentes.

¿Por qué se iba a preocupar la Naturaleza de una fórmula mágica si en ausencia de tal fórmula no hubiera contradicciones? Lo que realmente necesitamos es algún principio fundamental nuevo, tal como el proncipio de la relatividad, pero nos resistimos a abandonar todos los demás principios que ya conocemos; ¡esos, después de todo, han sido enormemente útiles en el descubrimiento del Modelo estándar! una herramienta que ha posibilitado a todos los físicos del mundo para poder construir sus trabajos en ese fascinante mundo de la mecánica cuántica, donde partículas infinitesimales interactúan con las fuerzas y podemos ver, como se comporta la materia en determinadas circunstancias. El mejor lugar para buscar nuevos principios es precisamente donde se encuentran los puntos débiles de la presente teoría.

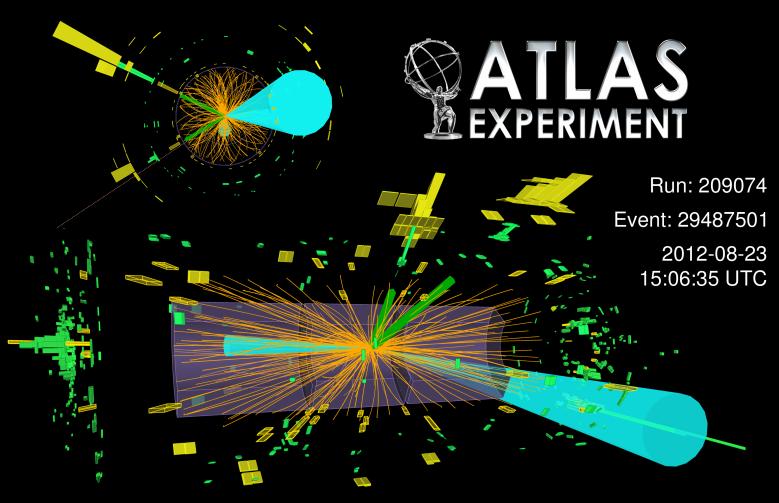

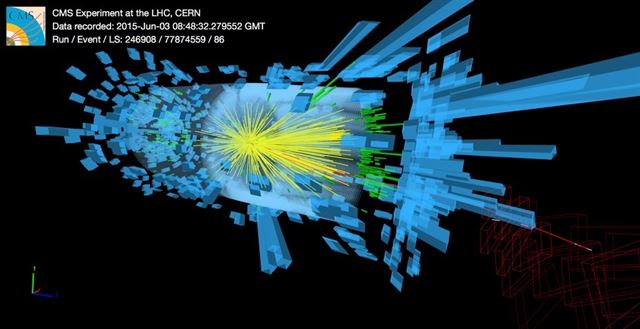

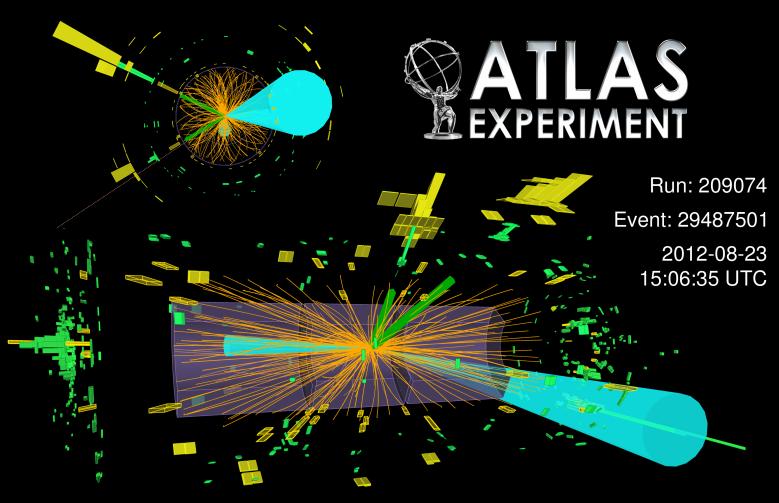

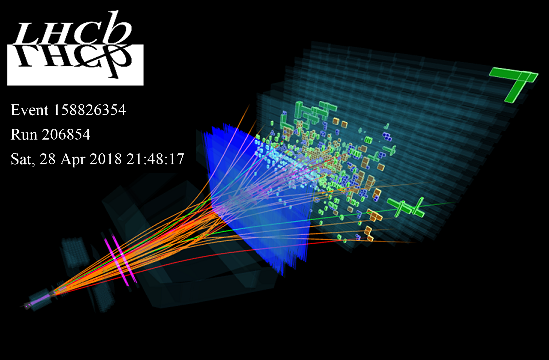

“Colisión del Bosón de Higgs desintegrándose en fermiones”. Primeras evidencias de un nuevo modo de desintegración del bosón de Higgs. Las primeras evidencias de la desintegración del recién descubierto bosón de Higgs en dos partículas denominadas tau, pertenecientes a la familia de partículas que compone la materia que vemos en el Universo. Hasta ahora los experimentos del LHC habían detectado la partícula de Higgs mediante su desintegración en otro tipo de partículas denominadas bosones, portadoras de las fuerzas que actúan en la Naturaleza, mientras las evidencias de desintegraciones en fermiones no eran concluyentes. Esta es la primera evidencia clara de este nuevo modo de desintegración del bosón de Higgs.”

En estos grandes aceleradores los físicos experimentales lanzan haces de protones por los tubos y dirigidas por imanes situados al respecto y a temperaturas muy bajas, de manera tal que dos haces, uno en sentido contrario al otro, se con gran rapidez y, cuando alcanzan la velocidad cercana a c, los hacen chocar los unos contra los otros, de manera tal que se rompen y dejar salir los componentes de los que están hechos, de esta manera estudian la materia en sus más pequeños detalles.

La regla universal en la física de partículas es que cuando las partículas chocan con energías cada vez mayores, los efectos de las colisiones están determinados por estructuras cada vez menores, más pequeñas en el espacio y en el tiempo. Supongamos por un momento que tenemos a nuestra disposición un Acelerador de Partículas 10.000 veces más potente que el LHC, donde las partículas pueden adquirir esas tantas veces más energías de las alcanzadas actualmente. Las colisiones que tendrían lugar nos dirían algo acerca de los detalles estructurales de esas partículas que ahora no conocemos, que serían mucho más pequeñas que las que ahora podemos contemplar. En este punto se me ocurre la pregunta: ¿Seguiría siendo correcto el Modelo estándar? 0, por el contrario, a medida que nos alejemos en las profundidades de lo muy pequeño, también sus normas podrían variar al mismo tiempo que varían las dimensiones de los productos hallados. Recordad que, el mundo no funciopna de la misma manera en nuestro ámbirto macroscópico que ante ese otro “universo” cuántico de lo infinitesimal.

¿Podeis imaginar conseguir colisiones a 70.000 TeV? ¿Que podríamos ver? Y, entonces, seguramente, podríamos oir en los medios la algarada de las protestas de algunos grupos: “Ese monstruo creado por el hombre puede abrir en el espacio tiempo agujeros de gusano que se tragará el mundo y nos llevará hacia otros universos” Comentarios así estarían a la orden del día. Los hay que siempre están dispuestos a protestar por todo y, desde luego, no siempre llevan razón, toda vez que, la mayoría de las veces, ignoran de qué están hablando y juzgan si el conocimiento de causa necesario para ello. De todas las maneras, sí que debemos tener sumo cuidado con el manejo de fuerzas que… ¡no siempre entendemos! Cuando el LHC se vuelvsa a poner en marcha, se utilizarán energías que llegan hasta los 14 TeV, y, esas son palabras mayores.

En el CERN quieren ahora, con la nueva potencia disponible, detectar partículas de la “materia oscura”.

¿Justifica el querer detectar las partículas que conforman la “materia oscura”, o, verificar si al menos, podemos vislumbrar la sombra de las “cuerdas” vibrantes de esa Teoría del Todo, el que se gasten ingentes cantidades de dinero en esos artilugios descomunales? Bueno, a pesar de todos los pesares, la respuesta es que SÍ, el rendimiento y el beneficio que hemos podido recibir de los aceleradores de partículas, justifica de manera amplia todo el esfuerzo realizado, toda vez que, no solo nos ha llevado a conocer muchos secretos que la Naturaleza celosamente guardaba, sino que, de sus actividades hemos tenido beneficios muy directos en ámbitos como la medicina, las comunicaciones y otros que la gente corriente desconocen.

Hoy, el Modelo estándar es una construcción matemática que predice sin ambigüedad cómo debe ser el mundo de las estructuras aún más pequeñas. Pero tenemos algunas razones para sospechar que tales predicciones resultan estar muy alejadas de la realidad, o, incluso, ser completamente falsas. Cuando tenemos la posibilidad de llegar más lejos, con sorpresa podemos descubrir que aquello en lo que habíamos creído durante años, era totalmente diferente. El “mundo” cambia a medida que nos alejamos más y más de lo grande y nos sumergimos en ese otro “mundo” de lo muy pequeño, allí donde habitan los minúsculos objetos que conforman la materia desde los cimientos mismos de la creación.

¿Será el final de todo, un Universo de Luz? Bueno ese fue el comienzo y, se si produjera de nuevo estaríamos en un Universo cíclico, todo termina para que todo comience.

Congelado el momento de la colisión de partículas dos con luz roja y azul. Ilustración de vector. Concepto de explosión. Impacto de moléculas abstractas …

Encendamos nuestro súper-microscopio imaginario y enfoquemosló directamente en el centro de un protón o de cualquier otra partícula. Veremos hordas de partículas fundamentales desnudas pululando. Vistas a través del súper-microscopio, el modelo estándar que contiene veinte constantes naturales, describen las fuerzas que rigen la forma en que se mueven. Sin embargo, ahora esas fuerzas no sólo son bastante fuertes sino que también se cancelan entre ellas de una forma muy especial; están ajustadaspara conspirar de tal manera que las partículas se comportan como partículas ordinarias cuando se vuelven a colocar el microscopio en la escala de ampliación ordinaria. Si en nuestras ecuaciones matemáticas cualquiera de estas constantes fueran reemplazadas por un número ligeramente diferente, la mayoría de las partículas obtendrían inmediatamente masas comparables a las gigantescas energías que son relevantes en el dominio de las muy altas energías. El hecho de que todas las partículas tengan masa que corresponden a energías mucho menores repentinamente llega a ser bastante poco natural.

¿Implica el ajuste fino un diseño con propósito? ¿Hay tantos parámetros que deben tener un ajuste fino y el grado de ajuste fino es tan alto, que no parece posible ninguna otra conclusión?

Antes decía: “El hecho de que todas las partículas tengan masa que corresponden a energías mucho menores repentinamente llega a ser bastante poco natural”. Es lo que se llama el “problema del ajuste fino”. Vistas a través del microscopio, las constantes de la Naturaleza parecen estar cuidadosamente ajustadas sin ninguna otra razón aparente que hacer que las partículas parezcan lo que son. Hay algo muy erróneo aquí. Desde un punto de vista matemático, no hay nada que objetar, pero la credibilidad del Modelo estándar se desploma cuando se mira a escalas de tiempo y longitud extremadamente pequeñas o, lo que es lo mismo, si calculamos lo que pasaría cuando las partículas colisionan con energías extremadamente altas.

¿Y por qué debería ser el modelo válido hasta ahí? Podrían existir muchas clases de partículas súper pesadas que no han nacido porque se necesitan energías aún inalcanzables, ellas podrían modificar completamente el mundo que Gulliver planeaba visitar. Si deseamos evitar la necesidad de un delicado ajuste fino de las constantes de la Naturaleza, creamos un nuevo problema:

Es cierto que nuestra imaginación es grande pero… No pocas veces ¡la realidad la supera!

¿Cómo podemos modificar el modelo estándar de tal manera que el ajuste-fino no sea necesario? Está claro que las modificaciones son necesarias , lo que implica que muy probablemente hay un límite más allá del cual el modelo deja de ser válido. El Modelo estándar no será más que una aproximación matemática que hemos sido capaces de crear, tal que todos los fenómenos observados hasta el presente están de acuerdo con él, pero cada vez que ponemos en marcha un aparato más poderoso, debemos esperar que sean necesarias nuevas modificaciones para ir ajustando el modelo, a la realidad que descubrimos.

¿Cómo hemos podido pensar de otra manera? ¿Cómo hemos tenido la “arrogancia” de pensar que podemos tener la teoría “definitiva”? Mirando las cosas de esta manera, nuestro problema ahora puede muy bien ser el opuesto al que plantea la pregunta de dónde acaba el modelo estándar: ¿cómo puede ser que el modelo estándar funcione tan extraordinariamente bien? y ¿por qué aún no hemos sido capaces de percibir nada parecido a otra generación de partículas y fuerzas que no encajen en el modelo estándar? La respuesta puede estar en el hecho cierto de que no disponemos de la energía necesaria para poder llegar más lejos de lo que hasta el momento hemos podido viajar con ayuda de los aceleradores de partículas.

Los asistentes escuchan la presentación de los resultados del experimento ATLAS, durante el seminario del Centro Europeo de Física de Partículas (CERN) para presentar los resultados de los dos experimentos paralelos que buscan la prueba de la existencia de la “partícula de Higgs, Una base del modelo estándar de física.

La pregunta: “¿Qué hay más allá del Modelo estándar”? ha estado facinando a los físicos durante años. Y, desde luego, todos sueñan con llegar a saber, qué es lo que realmente es lo que conforma el “mundo” de la materia, qué partículas, cuerdas o briznas vibrantes. En realidad, lo cierto es que, la Física que conocemos no tiene que ser, necesariamente, la verdadera física que conforma el mundo y, sí, la física que conforma “nuestro mundo”, es decir, el mundo al que hemos podido tener acceso hasta el momento y que no necesariamente tiene que coincidir con el mundo real que no hemos podido alcanzar.

O, como decía aquél: ¡Que mundo más hermoso, parece de verdad!

Siempre hay más de lo que el ojo ve

No todo lo que vemos es, necesariamente, un reflejo de la realidad de la Naturaleza que puede tener escondidos más allá de nuestras percepciones, otros escenarios y otros objetos, a los que, por ahora, no hemos podido acceder, toda vez que, físicamente tenemos carencias, intelectualmente también, y, nuestros conocimientos avanzar despacio para conseguir, nuevas máquinas y tecnologías nuevas que nos posibiliten “ver” lo que ahora nos está “prohibido” y, para ello, como ocurre siempre, necesitamos energías de las que no disponemos.

Hay dos direcciones a lo largo de las cuales se podría extender el Modelo estándar, tal lo conocemos actualmente, que básicamente se caracterizan así:

– Nuevas partículas raras y nuevas fuerzas extremadamente débiles, y

– nuevas partículas pesadas y nuevas estructuras a muy altas energías.

Podrían existir partículas muy difíciles de producir y de detectar y que, por esa razón, hayan pasado desapaercibidas hasta. La primera partícula adicional en la que podríamos pensar es un neutrinorotando a derecha. Recordaremos que si se toma el eje de rotación paralelo a la dirección del movimiento los neutrinos sólo rotan a izquierdas, pero… ¡esa sería otra historia!

Los neutrinos siempre me han fascinado. Siempre se han manifestado como si tuvieran masa estrictamente nula. Parece como si se movieran exactamente con la velocidad de la luz. Pero hay un límite para la precisión de nuestras medidas. Si los neutrinos fueran muy ligeros, por ejemplo, una cienmillonésima de la masa del electrón, seríamos incapaces de detectar en el laboratorio la diferencia éstos y los neutrinos de masa estrictamente nula. Pero, para ello, el neutrino tendría que tener una componente de derechas.

En este punto, los astrónomos se unen a la discusión. No es la primera vez, ni será la última, que la astronomía nos proporciona información esencial en relación a las partículas elementales. Por ejemplo, debido a las interacciones de corriente neutra (las interacciones débiles originadas por un intercambio Zº), los neutrinos son un facto crucial en la explosión supernova de una estrella. sabemos que debido a las interacciones por corriente neutra, pueden colisionar con las capas exteriores de la estrella y volarlas con una fuerza tremenda.

En realidad, los neutrinos nos tienen mucho que decir, todavía y, no lo sabemos todo acerca de ellos, sino que, al contrario, son muchos los y fenómenos que están y subyacen en ellos de los que no tenemos ni la menor idea que existan o se puedan producir. Nuestra ignorancia es grande, y, sin embargo, no nos arredra hablar y hablar de cuestiones que, la mayoría de las veces…ni comprendemos.

Aquí lo dejar´ñe por hoy, el tema es largo y de una fascinación que te puede llevar a lugares en los que no habías pensado al comenzar a escribir, lugares maravillosos donde reinan objetos exóticos y de fascinante porte que, por su pequeñez, pueden vivir en “mundos” muy diferentes al nuestro en los que, ocurren cosas que, nos llevan el asombro y también, a ese mundo mágico de lo fascinante y maravilloso.

Parece que el Modelo estándar no admite la cuarta fuerza y tendremos que buscar más profundamente, en otras teorías que nos hablen y describan además de las partículas conocidas de otras nuevas que están por nacer y que no excluya la Gravedad. Ese es el Modelo que necesitamos para conocer mejor la Naturaleza.

emilio silvera

Dic

21

Por imaginar… ¡Que no quede!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Relativista ~

Clasificado en Física Relativista ~

Comments (0)

Comments (0)

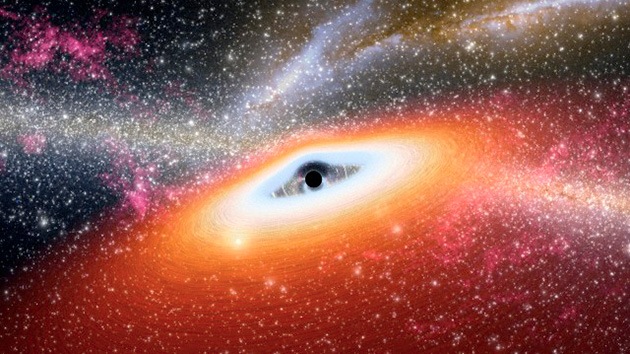

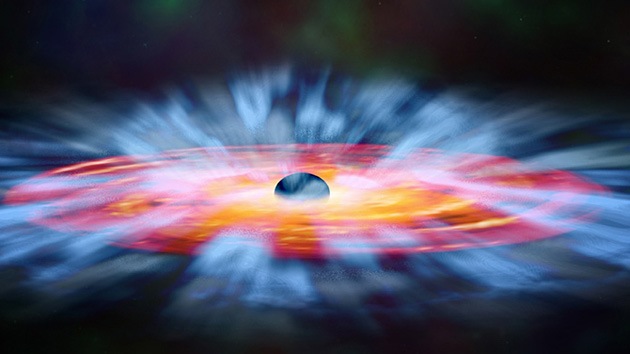

Representación de un agujero negro – Zhaoyo Li

¿Están los agujeros negros enviando materia al futuro?

Astrónomos sugieren que el Espacio-Tiempo se curva muy fuertemente cerca del centro de un agujero negro, pero que no llega a quebrarse, sino que continúa en una región en el futuro que tiene estructura de un agujero blanco.

Hace apenas unos días, publicábamos en ABC una serie de nuevas ideas que abren la posibilidad a la existencia real de agujeros blancos, objetos teóricos que funcionarían «al contrario» de los agujeros negros, expulsando materia en lugar de absorberla. Carlo Rovelli, investigador del Centro de Física Teórica del CNRS francés y de la Universidad de Aix-Marseille, sostenía que los agujeros blancos son, en realidad, una evolución de los propios agujeros negros.

Según el artículo, en uno entra la materia en nuestro Universo para hacer un viaje hacia el futuro donde aparecerá en forma de agujero blanco. Imposible, lo que se dice imposible hay pocas cosas pero… ¡Esto me parece rizar el rizo! Hay muchas razones para no creer que el destino de la materia de un agujero negro sea el de viajar al futuro (que no existe).

Y ahora, dos nuevos estudios recién publicados en Physical Review Letters y Physical Review D, respectivamente, abundan en esa posibilidad. Y sugieren que toda la materia que se traga un agujero negro podría ir a parar… al futuro.

Los agujeros negros siguen estando entre los objetos más misteriosos del Universo. Conocemos, eso sí, lo que sucede fuera de ellos, a su alrededor e incluso en el mismísimo horizonte de sucesos, la frontera invisible que marca el punto de no retorno para cualquier cosa que la cruce, incluída la luz. Pero nadie sabe a ciencia cierta lo que sucede al otro lado de ese límite, dentro de un agujero negro, ni tampoco cuál es el destino final de la materia atrapada en él.

Esto es, lo que siempre nos dijeron los físicos según la Relatividad General

Según la Teoría General de la Relatividad de Einstein, todo lo que entra en un agujero negro seguirá cayendo hacia su centro, atraído por una gravedad cada vez más fuerte, hasta llegar a comprimirse en un único punto de tal densidad que el mismísimo tejido espaciotemporal se quebraría. En ese punto, llamado singularidad, las leyes de la Física ya no tendrían efecto, el mismísimo tiempo se detendría y la realidad tal y como la conocemos se desvanecería por completo.

¿Y si hemos entendido mal los agujeros negros?

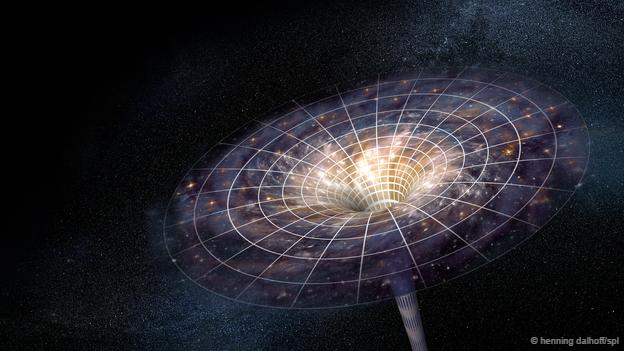

Si los agujeros negros fueran pasadizos hacia otros universos… ¡Serían agujeros de gusano!

¿Es aquí hasta donde quieren llegar con estas ideas?

Pero según Abhay Ashtekar y Javier Olmedo, de la Universidad Estatal de Pennsylvania, y Parampreet Singh, de la de Louisiana, autores de los dos artículos citados arriba, las cosas podrían ser muy diferentes. De hecho, su trabajo, igual que el de Carlo Rovelli, podría cambiar para siempre lo que creemos saber sobre los agujeros negros. Especialmente en lo que se refiere a la auténtica naturaleza de sus centros, que según estos investigadores «podríamos haber entendido mal».

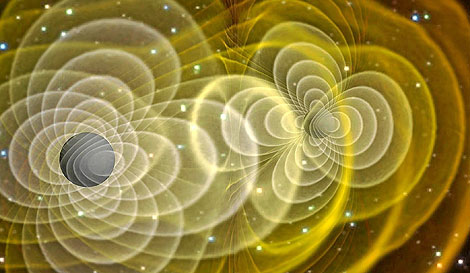

El problema principal, por supuesto, es el de la singularidad. La simple idea de que puedan existir esos puntos que, pese a tener una densidad infinita, no ocupan espacio alguno, se considera como una aberración, algo que no puede existir en la naturaleza. Hasta ahora, y bajo el paraguas de «gravedad cuántica», numerosos investigadores han formulado diversas propuestas teóricas, desarrollando unas matemáticas completamente nuevas que puedan servir para describir cómo funciona la gravedad en el microcosmos de las partículas subatómicas.

Representación gráfica del entramado de bucles que definen el espacio-tiempo según la LQC

“La gravedad cuántica de bucles o de lazos (LQG, por Loop Quantum Gravity), o también gravedad cuántica de recurrencias, es una teoría de gravedad cuántica formulada por Abhay Ashtekar en 1986,1 que mezcla las teorías aparentemente incompatibles de la mecánica cuántica y la relatividad general. Como teoría de la gravedad cuántica, es el competidor principal de la teoría de las cuerdas, aunque quienes sostienen esta última exceden en número a quienes sostienen la teoría de bucles por un factor, aproximadamente, de 10 a 1″

Uno de esos intentos es la llamada « gravedad cuántica de bucles», que entre otras cosas predice que el espacio-tiempo puede cuantificarse, de modo que existe una unidad mínima más allá de la cual el espacio-tiempo no puede subdividirse más. Pues bien, al aplicar la gravedad cuántica de bucles a los puntos centrales de los agujeros negros, los investigadores afirman que el resultado no fue una singularidad, sino algo muy diferente.

La alternativa a la singularidad

Los cálculos, en efecto, predicen que el espacio-tiempo se curva muy fuertemente cerca del centro de un agujero negro. Pero no llega a quebrarse, sino que continúa en una región en el futuro que tiene la estructura de un agujero blanco. Un agujero blanco es como un agujero negro pero al revés, es decir, que en lugar de atraer la materia hacia sí, la «dispara» hacia fuera.

Se sabe que en presencia de campos gravitacionales muy fuertes, el tiempo se ralentiza. Y los agujeros negros contienen los campos gravitacionales más fuertes del Universo. Debido a ello, una posible interpretación de este nuevo trabajo es que la materia cae en un agujero negro y luego «rebota», disparando la masa a través del cosmos. Debido a que el tiempo es muy lento cerca del centro de un agujero negro, visto desde fuera ese proceso duraría una enorme cantidad de tiempo. Si los investigadores tienen razón, en un futuro muy lejano, donde ahora hay agujeros negros, la materia estallará, esparciendo la materia por todo el cosmos a través de agujeros blancos.

El cine nos ha dejado alguna visión de lo que podría ser – Escena de Interstellar. Imagen: Warner Bros. / Syncopy / Paramount Pictures / Legendary

La idea es provocativa y muy sugerente, aunque antes de considerarse válida será necesario probarla experimentalmente. Y resulta que existen varias formas de hacerlo. Desde hace tiempo, por ejemplo, científicos de todo el mundo han venido detectando en el espacio una serie de fenómenos enormemente energéticos que se resisten a ser explicados.

Dos de ellos son los rayos cósmicos de alta energía que golpean de cuando en cuando la atmósfera de la Tierra; y los llamados « estallidos rápidos de radio», que se producen cuando se detecta una enorme cantidad de energía de radio en un periodo muy breve de tiempo. Según los investigadores, ambos fenómenos podrían ser, en principio, la firma de un agujero negro en transición hacia un agujero blanco.

;)

Lo mismo que montamos estructuras bnajo tierra para detectar neutrinos, podríamos inventar otras que nos digan, de manera cierta, si todo esto que apunta el reportaje podría ser cierto.

La idea resulta sumamente interesante, aunque no está aún lo suficientemente madura como para ser aceptada por la comunidad científica. Pero si las predicciones de la gravedad cuántica de bucles mejoran y sus resultados empiezan a parecerse más y más a los fenómenos astronómicos inexplicables observados por los astrónomos, entonces habremos dado un gran paso para comprender tanto el pasado como el futuro del Universo en que vivimos.

Reportaje de prensa de José M. Nieves

Dic

18

La Física es la llave del futuro

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (4)

Comments (4)

Sabemos menos de lo que creemos saber

Pero nos empeñamos en saber donde estamos

Hace mucho Tiempo que la Humanidad sueña con viajar al Espacio, miramos las estrellas en la noche oscura y, su titilar que parece decirnos alguna cosa, es engañoso, el fenómeno lo produce la atmósfera del planeta y nos da esa sensación. Sin embargo, nosotros, mirando esos pequeños puntitos brillantes, dentro de nuestras mentes constrímos mil historias…

Sí, el sabio llegó a la conclusión que la pequeña, perfumada, fragante y bella rosa, estaba hecha de los mismos ingredientes que una galaxia, es decir, eran los átomos que se unieron para formar moléculas y el cuerpo de la rosa, los mismos que lo harían para formar una gran galaxia. Precisamente por eso, hablar de lo grande o lo pequeño…

Nadie sabe lo que nos podemos encontrar ahí fuera. El día que se produzca ese primer contacto. ¿Cómo serán ellos? ¿Podremos entablar amistad? ¿Hasta donde llevaremos las relaciones? Pero, lo más importante… ¿Cómo llegaremos “allí”?

Alguna vez he leído alguna historia en las que había hadas en el frondoso jardín. Es cierto, no existen pruebas de que así pudiera ser. Sin embargo, tampoco las hay de que no las haya, y, el hecho cierto de que nosotros, los humanos, no la hayamos podido ver, no es prueba de su inexistencia. Hay que tener una imaginación abierta a todo y, de esa manera, evitamos sobresaltos y sorpresas inesperadas que, dicho sea de paso, pueden estar a cada paso que damos. El Universo es eso, un océano de maravillosas sorpresas que nos habla del comportamiento de las grandes energías y de la materia, unas veces disfrazada de estrella, otras de emisiones gamma y no en pocas ocasiones de agujeros negros y púlsares.

El modelo estándar de partículas fundamentales y sus interacciones

Esta imagen representa todo lo que conocemos, y que se ha podido verificar experimentalmente, sobre la estructura de la materia de la que estamos hechos nosotros y todo lo que hasta ahora hemos observado en el universo, con el nivel de precisión que podemos alcanzar utilizando los instrumentos que tenemos.

Equilibrio, estabilidad: el resultado de dos fuerzas contrapuestas que en el átomo están presentes

La materia ha evolucionado hasta límites increíbles: ¡la vida! y, aún no sabemos, lo que más allá pueda esperar. Los nuevos conocimientos y los que la humanidad tendrá dentro de un siglo (por ejemplo), nos permitirá vivir hasta cerca de los 200 años, habremos aprendido a luchar contra la entropía destructura.

Por ahí deambula uno de mis trabajos sobre este mismo tema que titulé ¡La perfección imperfecta! En referencia al Modelo Estándar que no incorpora la Gravedad, y, se ha construido un edificio que nos habla de cómo funciona el universo y, sin embargo, le falta uno de sus pilares, precisamente, ese que nos dice como es su geometría espacial en presencia de grandes masas.

“Colisión del Bosón de Higgs desintegrándose en fermiones”. Primeras evidencias de un nuevo modo de desintegración del bosón de Higgs. Las primeras evidencias de la desintegración del recién descubierto bosón de Higgs en dos partículas denominadas tau, pertenecientes a la familia de partículas que compone la materia que vemos en el Universo. Hasta ahora los experimentos del LHC habían detectado la partícula de Higgs mediante su desintegración en otro tipo de partículas denominadas bosones, portadoras de las fuerzas que actúan en la Naturaleza, mientras las evidencias de desintegraciones en fermiones no eran concluyentes. Esta es la primera evidencia clara de este nuevo modo de desintegración del bosón de Higgs.”

La regla universal en la física de partículas es que cuando las partículas chocan con energías cada vez mayores, los efectos de las colisiones están determinados por estructuras cada vez menores, más pequeñas en el espacio y en el tiempo. Supongamos por un momento que tenemos a nuestra disposición un Acelerador de Partículas 10.000 veces más potente que el LHC, donde las partículas pueden adquirir esas tantas veces más energías de las alcanzadas actualmente. Las colisiones que tendrían lugar nos dirían algo acerca de los detalles estructurales de esas partículas que ahora no conocemos, que serían mucho más pequeñas que las que ahora podemos contemplar.

Ahora el LHC se prepara para nuevas aventuras y experimentos mayores, con mayores energías. ¿Podeis imaginar conseguir colisiones a 70.000 TeV? ¿Que podríamos ver? Y, entonces, seguramente, podríamos oir en los medios la algarada de las protestas de algunos grupos: “Ese monstruo creado por el hombre puede abrir en el espacio tiempo agujeros de gusano que se tragará el mundo y nos llevará hacia otros universos”

¿Justifica el querer detectar las partículas que conforman la “materia oscura”, o, verificar si al menos, podemos vislumbrar la sombra de las “cuerdas” vibrantes de esa Teoria del Todo, el que se gasten ingentes cantidades de dinero en esos artilugios descomunales? Bueno, a pesar de todos los pesares, la respuesta es que SÍ, el rendimiento y el beneficio que hemos podido recibir de los aceleradores de partículas, justifica de manera amplia todo el esfuerzo realizado, toda vez que, no solo nos ha llevado a conocer muchos secretos que la Naturaleza celosamente guardaba, sino que, de sus actividades hemos tenido beneficios muy directos en ámbitos como la medicina, las comunicaciones y otros que la gente corriente desconocen.

¿Implica el ajuste fino un diseño con propósito? ¿Hay tantos parámetros que deben tener un ajuste fino y el grado de ajuste fino es tan alto, que no parece posible ninguna otra conclusión?

Hoy, el Modelo estándar es una construcción matemática que predice sin ambigüedad cómo debe ser el mundo de las estructuras aún más pequeñas. Pero tenemos algunas razones para sospechar que tales predicciones resultan estar muy alejadas de la realidad, o, incluso, ser completamente falsas. Cuando tenemos la posibilidad de llegar más lejos, con sorpresa podemos descubrir que aquello en lo que habíamos creído durante años, era totalmente diferente. El “mundo” cambia a medida que nos alejamos más y más de lo grande y nos sumergimos en ese otro “mundo” de lo muy pequeño, allí donde habitan los minúsculos objetos que conforman la materia desde los cimientos mismos de la creación.

Así el modelo que tenenos de la física de partículas se llama Modelo Estándard y, nos habla de las interacciones entre partículas y las fuerzas o interrelaciones que están presentes, las leyes que rigen el Universo físico y que, no hemos podido completar al no poder incluir una de las fuerzas: La Gravedad. Claro que, no es esa la única carencia del Modelo, tiene algunas más y, a estas alturas, se va necesitando un nuevo Modelo, más completo y audaz, que incluya a todas las fuerzas y que no tengá parámetros aleatorios allí donde nuestros conocimientos no llegan.

La fealdad del Modelo Estándar puede contrastarse con la simplicidad de las ecuaciones de Einstein, en las que todo se deducía de primeros principios. Para comprender el contraste estético entre el Modelo Estándar y la teoría de la relatividad general de Einstein debemos comprender que, cuando los físicos hablan de “belleza” en sus teorías, realmente quieren decir que estas “bellas” teorías deben poseer al menos dos características esenciales:

- Una simetría unificadora.

- La capacidad de explicar grandes cantidades de datos experimentales con las expresiones matemáticas más económicas.

E = mc2 . Esta es la mejor prueba de lo que decimos arriba.

El Modelo Estándar falla en ambos aspectos, mientras que la relatividad general los exhibe, ambos, de manera bien patente. Nunca una teoría dijo tanto con tan poco; su sencillez es asombrosa y su profundidad increíble.De hecho, desde que se publicó en 1.915, no ha dejado de dar frutas, y aún no se han obtenido de ella todos los mensajes que contiene.

El principio director del modelo estándar dicta que sus ecuaciones son simétricas. De igual modo que una esfera ofrece el mismo aspecto desde cualquier punto de vista, las ecuaciones del modelo estándar subsisten sin variación al cambiar la perspectiva desde la que son definidas. Las ecuaciones permanecen invariables, además, cuando esta perspectiva se desplaza en distinta magnitud a diferentes puntos del espacio y el tiempo.

Se extraña la ausencia de la cuarta fuerza, la Gravedad y hace que Modelo incompleto

Al contrario de la relatividad general, la simetría del Modelo Estándar, está realmente formada empalmando tres simetrías más pequeñas, una por cada una de las fuerzas; el modelo es espeso e incómodo en su forma. Ciertamente no es económica en modo alguno. Por ejemplo, las ecuaciones de Einstein, escritas en su totalidad, sólo ocupan unos centímetros y ni siquiera llenaría una línea de esta página. A partir de esta escasa línea de ecuaciones, podemos ir más allá de las leyes de Newton y derivar la distorsión del espacio, el Big Bang y otros fenómenos astronómicos importantes como los agujeros negros. Por el contrario, sólo escribir el Modelo Estándar en su totalidad requeriría, siendo escueto, un par de páginas y parecería un galimatías de símbolos complejos sólo entendibles por expertos.

Los científicos quieren creer que la naturaleza prefiere la economía en sus creaciones y que siempre parece evitar redundancias innecesarias al crear estructuras físicas, biológicas y químicas.

La luz antigua absorbida por átomos de hidrógeno neutro podría usarse para probar ciertas predicciones de la Teoría de Cuerdas, dicen los cosmólogos de la Universidad de Illinois. Realizar tales medidas, sin embargo, requeriría que se construyese un gigantesco conjunto de radio telescopios en la Tierra, el espacio, o la Luna.

El matemático francés Henri Poincaré lo expresó de forma aún más franca cuando escribió: “El científico no estudia la Naturaleza porque es útil; la estudia porque disfruta con ello, y disfruta con ello porque es bella”

Cuando las palabras no pueden explicar alguna cuestión compleja… ¡Ahí aparecen las matemáticas!

E. Rutherford, quien descubrió el núcleo del átomo (entre otras muchas cosas), dijo una vez: “Toda ciencia es o física o coleccionar sello”.Se refería a la enorme importancia que tiene la física para la ciencia, aunque se le olvidó mencionar que la física está sostenida por las matemáticas que la explica.

Pero, a pesar de todos sus inconvenientes, el Modelo Estándar, desde su implantación, ha cosechado un éxito tras otro, con sus inconvenientes y sus diecinueve parámetros aleatorios, lo cierto es que es lo mejor que tenemos por el momento para explicar las familias de partículas que conforman la materia y cómo actúan las fuerzas de la naturaleza, todas las fuerzas menos la gravedad; esa nos la explica a la perfección y sin fisuras las ecuaciones de Einstein de la relatividad general.

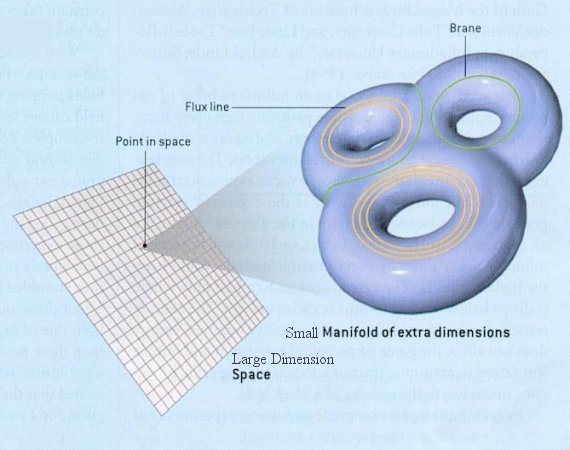

Hace tiempo que los físicos tratan de mejorar el Modelo Estándar con otras teorías más avanzadas y modernas que puedan explicar la materia y el espacio-tiempo con mayor amplitud y, sobre todo, incluyendo la gravedad.Así que retomando la teoría de Kaluza de la quinta dimensión, se propuso la teoría de supergravedad en 1.976 por los físicos Daniel Freedman, Sergio Ferrara y Peter van Nieuwenhuizen, de la Universidad del Estado de Nueva York en Stoney Brook que desarrollaron esta nueva teoría en un espacio de once dimensiones.

Para desarrollar la superteoría de Kaluza-Klein en once dimensiones, uno tiene que incrementarenormemente las componentes del interior del Tensor métrico de Riemann (que Einsteinutilizó en cuatro dimensiones, tres de espacio y una de tiempo para su relatividad general y más tarde, Kaluza, añadiendo otra dimensión de espacio, la llevó hasta la quinta dimensión haciendo así posible unir la teoría de Einstein de la gravedad, con la teoría de Maxwell del electromagnetismo), que ahora se convierte en el supertensor métrico de Riemann.

Hasta hoy, no se ha logrado, ni mucho menos, inventar una teoría de campo consistente totalmente unificadora que incluya la gravedad. Se han dado grandes pasos, pero las brechas «científicounificantes» siguen siendo amplias. El punto de partida ha sido siempre la teoría de la relatividad general y conceptos con ella relacionados, por la excelencia que manifiesta esa teoría para explicar la física gravitatoria macrocósmica. El problema que se presenta surge de la necesidad de modificar esta teoría sin perder por ello las predicciones ya probadas de la gravedad a gran escala y resolver al mismo tiempo los problemas de la gravedad cuántica en distancias cortas y de la unificación de la gravedad con las otras fuerzas de la naturaleza.

Su tensor métrico es un tensor de rango 2 que se utiliza para definir … Sin embargo, en otras teorías se ha elevado el rango y se pueden definir múltiples universos de dimensiones más altas.

El tensor métrico se podría adaptar a las necesidades de la búsqueda estableciendo la multiplicidad de dimensiones que la teoría exigía para su desarrollo.

Más allá de lo que nos permiten captar nuestros sentidos físicos, hay que tener nuestra mente abierta a la posibilidad de que puedan existir otras realidades diferentes a lo que nos dicta nuestra experiencia, realidades capaces de ser descubiertas por la fuerza del intelecto cuando nos atrevemos a cuestionar aquello que creíamos como absoluto.

Esta nueva teoría de supergravedad pretendía la unificación de todas las fuerzas conocidas con la materia, y, como en un rompecabezas, encajarlas en el Tensor de Riemann tan solo con elevar el número de dimensiones que exigía más componentes y nos daba el espacio necesario para poder ubicar en sus apartados correspondientes, todas las fuerzas fundamentales y también la materia, la que podía satisfacer, casi en su totalidad, el sueño de Einstein.

A partir de aquí, de estas ecuaciones, surgió todo. Este fue el puerto de donde salió el bajel de la de Kaluza-Gleim, la supergravedad y supersimetría, la cuerda heterótica y la Teoría de cuerdas, todo ello, rematado con la finalmente expuesta, teoría M.

La supergravedad casi consigue satisfacer el sueño de Einstein de dar una derivación puramente geométrica de todas las fuerzas y partículas del universo. Al añadir la supersimetría al Tensor métrico de Riemann, la métrica se duplica en tamaño, dándonos la supersimetría de Riemann. Las nuevas componentes del súper tensor de Riemann corresponden a quarks y leptones, casi todas las partículas y fuerzas fundamentales de la naturaleza: la teoría de la gravedad de Einstein, los campos de Yang-Mills y de Maxwell y los quarks y leptones. Pero el hecho de que ciertas partículas no estén en esta imagen nos obliga a buscar un formalismo más potente:

La materia con todas las fuerzas fundamentales de la naturaleza. Los bosones intermediarios o partículas portadoras de las fuerzas como el fotón para el electromagnetismo, los gluones para la fuerza nuclear fuerte, las partículas W y Z para la nuclear débil y, en la partícula portadora de la gravedad, el gravitón, ponemos el signo de interrogación, ya que se sabe que esta ahí en algún sitio pero hasta la fecha no ha sido detectado.

Antes de continuar con la teoría de súper cuerdas, o con su versión más avanzada la teoría M, parece conveniente recordar que hasta el momento los ladrillos del universo eran los quarks, las partículas más pequeñas detectadas en los aceleradores del CERN y FERMILAB. Pero ¿están hechos de cosas más pequeñas?, eso no lo sabemos. El Modelo Estándar, menos avanzado que las otras teorías, nos dice que los quarks son las partículas más pequeñas y forman protones y neutrones constituyendo la formación interna del átomo, el núcleo. En la actualidad, nuestros aceleradores de partículas no tienen capacidad para ahondar más allá de los quarks y averiguar si a su vez, éstos están formados por partículas aún más pequeñas.

No podemos saber (aún) que es lo que pueda haber (si es que lo hay) más allá de los Quarks, los constituyentes de la materia más pequeños conocidos hasta el momento actual. Sin embargo, no se descarta que puedan existir partículas más simples dentro de los Quarks que, al fin y al cabo, no serían tan elementales.

Por otro lado, los físicos están casi seguros de que los leptones no están compuestos de partículas más pequeñas. Sin embargo, esta sospecha no se tiene en el caso de los quarks; no se sabe qué puede haber detrás de ellos. Tan sólo se ha llegado a desconfinarlos junto con los gluones y por un breve periodo de tiempo de los protones y neutrones que los mantenían aprisionados, formando – en esos breves instantes – una materia plasmosa. No es raro oir dentro de la comunidad científica a los físicos teóricos hablando de prequarks.

Como antes hemos comentado de pasada, el Modelo Estándar agrupa las partículas en familias:

Fermiones y Bosones

Cada leptón grande, es decir, el electrón, el muón y el tau, tiene un primo pequeño. Así el electrón tiene un neutrino electrónico, el muón un neutrino muónico y el tau un neutrino tau. Como se puede ver en la tabla anterior la única diferencia entre el electrón, el muón y el tau es la masa, que va creciendo. Todos tienen carga eléctrica negativa. Los neutrinos en cambio no tienen carga y tienen una masa muy pequeña (pero tienen y es una de las razones por la que se dice que los neutrinos cambian de sabor, es decir cuando salen, por ejemplo, del sol salen en forma de neutrinos electrónicos pero cuando los detectamos en la tierra, vemos que llegan menos neutrinos electrónicos de los que deberían, porque durante el viaje han cambiado de sabor y se han convertido en neutrinos muónicos o tau).

Los bariones se componen de tres quarks o tres antiquarks. En este último caso se denominan antibariones.

Los mesones se componen de dos quarks y obligatoriamente uno es un quark y el otro un antiquark.

Claro, son muchos más. Además de los Bariones, también forman parte de la familia hadrónica los mesones y la lista de unos y otros es larga y cada individuo, como es natural, tiene sus propias características que lo hacen único.

Se llaman bosones porque, al contrario que los fermiones, éstos obedecen la estadística de Bose-Einsteinque dice que pueden existir en el mismo estado cuántico muchas bosones al mismo tiempo (recordad que en el caso de los fermiones sólo podía haber dos en el mismo estado cuántico). Algunos bosones tienen la peculiaridad de que son los portadores de las fuerzas fundamentales de la naturaleza, es decir, cada vez que ocurre una interacción entre dos partículas, lo que realmente ocurre es que intercambian un bosón. Estas fuerzas son el electromagnetismo, la fuerza débil y la fuerza fuerte (vienen a continuación). Existe otro bosón, aunque sólo a nivel teórico, conocido como el gravitón que sería el responsable de la fuerza gravitatoria. La fuerza gravitatoria no está explicada por el modelo estándar y por lo tanto el gravitón, no forma parte del mismo.

La fuerza débil es la responsable de las desintegraciones radiactivas, es decir, que una partícula se convierta en otra a través de la emisión de una o más partículas adicionales. Esta interacción es mediada por los bosones W+, W- y Z0. Estos bosones tienen la particularidad de que tienen masa, al contrario que el resto de bosones.

La fuerza fuerte hace que los quarks que componen los núcleos atómicos se mantengan unidos y no se rompan espontáneamente. El bosón encargado de hacer esto es el gluón.

La fuerza electromagnética es la que más conocemos todos, ya que se compone de la fuerza eléctrica y la fuerza magnética (en realidad es una única fuerza que se manifiesta de dos maneras diferentes, de ahí que reciba el nombre de fuerza electromagnética). El bosón portador de esta fuerza es el fotón. Nuestra experiencia diaria se basa principalmente en sufrir los efectos de esta fuerza y cada vez que vemos la luz, sentimos calor, calentamos la comida en el microondas, etc., lo que estamos haciendo es interaccionar con fotones de diversas energías.

Interacciones entre partículas

En la imagen de la izquierda se representa como un neutrón se desintegra para dar un protón, un electróny un antineutrino electrónico. Esta desintegración es conocida como desintegración beta.

En la imagen central se muestra la colisión entre un electrón y un positrón que da lugar a una desintegración de materia en energía pura, otra vez a través de la ecuación de Einstein E=mc2. La energía se convierte, por la misma ecuación, otra vez en otras partículas diferentes. En este caso se forma un mesón B0 y un antimesón B0.

Por último, en la imagen de la derecha aparece la colisión de dos protones (como los que ocurren en el LHC del CERN) para dar lugar a dos bosones Z0 y varios hadrones, es decir, varias partículas compuestas de diferentes quarks (mesones y bariones).

… Han dejado fuera del Modelo estándar a la Gravedad que se resiste a estar junto a las otras tres fuerzas. Así, continúan persiguiendo ese sueño llamado… ¡Teoría cuántica de la gravedad o Gravedad cuántica!

Y describe las interacciones que estas partículas tienen con las cuatro fuerzas fundamentales de la naturaleza, sobre todo con las nucleares fuerte y débil y la electromagnética; la gravedad se queda aparte del Modelo Estándar, ya que su incidencia con las partículas elementales es inapreciable como consecuencia de las infinitesimales masas de éstas, y ya sabemos que la gravedad se deja sentir y se hace presente cuando aparecen las grandes masas como planetas, estrellas y galaxias.

Grandes estructuras que vienen a ser como pequeños ”universos islas” en los que podemos estudiar, a menos tamaño, todo lo que en el Gran Universo puede pasar. Partiendo de la base de que las leyes del universo son las mismas en todas partes, podemos tomar cualquier región del mismo y ver que, allí está ocurriendo lo mismo que aquí ocurre, es decir, están presentes las fuerzas fundamentales: nucleares débiles y fuertes, electromagnetismo y Gravedad y, todo, absolutamente todo, funciona al ritmo que dichas leyes nos marcan.

Como el Modelo Estándar es limitado, los físicos buscan desesperadamente nuevas teorías que puedan corregir y perfeccionar este modelo. Así aparecieron las teorías de súper simetría, súper gravedad, súper cuerdas, y ahora por último, la teoría M propuesta por Edward Witten en 1.995 y que nos quiere explicar, de manera más perfecta, el universo desde su origen, cómo y por qué está conformado ese universo, las fuerzas que lo rigen, las constantes de la naturaleza que establecen las reglas, y todo ello, a partir de pequeños objetos infinitesimales, las cuerdas, que sustituyen a las partículas del modelo estándar que creíamos elementales.

Esas partículas súper simétricas que pronostican algunas teorías, aún no han sido observadas y se espera que en el LHC puedan aparecer algunas que, desde luego, si así ocurre, sería un buen adelanto para conocer el mundo que nos acoge y la Naturaleza del Universo.

Esta nueva teoría, permite además, unificar o incluir la gravedad con las otras fuerzas, como teoría cuántica de la gravedad, todo ello mediante una teoría estructurada y fundamentada con originalidad y compactificación de las cuatro fuerzas de la naturaleza y dejando un gran espacio matemático para eliminar anomalías o perturbaciones, y se propugna con coherencia quela cuerda es el elemento más básico de la estructura de la materia; lo que estaría bajo los quarks serían unas diminutos círculos semejantes a una membrana vibrante circular y de diferentes conformaciones.