Dic

24

¡La Física! Siempre presente en nuestras vidas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

En 1.849, el físico francés Armand-Hippolyte-Louis Fizeau ideó un artificio mediante el cual se proyectaba la luz sobre un espejo situado a 8 km de distancia, que devolvía el reflejo al observador. El tiempo empleado por la luz en su viaje de ida y vuelta no rebasó apenas la 1/20.000 de segundo, pero Fizeau logró medirlo colocando una rueda dentada giratoria en la trayectoria del rayo luminoso. Cuando dicha rueda giraba a cierta velocidad, regulada, la luz pasaba entre los dientes y se proyectaba contra el siguiente, al ser devuelta por el espejo; así, Fizeau, colocado tras la rueda, no pudo verla. Entonces se dio más velocidad a la rueda, y el reflejo pasó por la siguiente muesca entre los dientes, sin intercepción alguna. De esa forma, regulando y midiendo la velocidad de la rueda giratoria, Fizeau pudo calcular el tiempo transcurrido y, por consiguiente, la velocidad a que se movía el rayo de luz.

Jean-Bernard-Léon Foucault suspendió una bola de 62 libras (unos 28 kilogramos) de hierro desde la cúpula del Panteón y lo puso en movimiento, balanceándolo. Para marcar su progreso el enganchó una aguja a la bola y colocó un anillo de tierra mojada en el suelo bajo él. La audiencia observó con pavor como el péndulo inexplicablemente parecía rotar, dejando un trazo ligeramente distinto en cada balanceo. En realidad era el suelo del Panteón el que estaba ligeramente en movimiento, y Foucault había demostrado, de una forma más convincente que nunca, que la tierra gira sobre su eje. En la latitud de París, el trazo del péndulo completaría una rotación completa en el sentido horario cada 30 horas; en el hemisferio sur rotaría en sentido antihorario, y en el ecuador no rotaría nada. En el Polo Sur, como han confirmado los científicos de la era moderna, el periodo de rotación es de 24 horas.

Un año más tarde, Jean Foucault (quien realizaría poco después su experimento -arriba- con los péndulos) precisó más estas medidas empleando un espejo giratorio en ve de una rueda dentada. Entonces se midió el tiempo transcurrido desviando ligeramente el ángulo de reflexión mediante el veloz espejo giratorio. Foucault obtuvo un valor de la velocidad de la luz de 300.883 km/s. También, el físico francés utilizó su método para determinar la velocidad de la luz a través de varios líquidos. Averiguó que era notablemente inferior a la alcanzada en el aire. Esto concordaba también con la teoría ondulatoria de Huyghens (abajo).

La naturaleza de la luz. Profesor escrupuloso, aunque poco entusiasta, Newton se dedicó a estudios de óptica que le llevaron, a través de una serie de experimentos, al famoso descubrimiento de la descomposición de la luz blanca, que fue explicada por él mediante una teoría corpuscular de la luz destinada a dar jaque a la teoría ondulatoria de C. Huygens y a dominar durante todo el siglo XVIII. Experimentos, descubrimientos e hipótesis sobre la luz fueron hechos públicos en una memoria a la Royal Society. Pero las tempestuosas disputas suscitadas por esta memoria le disgustaron hasta el punto de que se abstuvo de publicar sus Lecciones de óptica (desarrolladas en la cátedra lucasiana entre 1668 y 1671), las cuales sólo vieron la luz en 1729. No obstante, en 1675 presentó a la Royal Society una importante memoria, que constituirá después la base de su Óptica, en la que, partiendo de los experimentos sobre la coloración de laminillas metálicas, expone los principios de su teoría sobre la luz. En la imagen, El descubrimiento de la refracción de la luz de Newton (1827), óleo del pintor italiano Pelagio Palagi.

Michelson, Einstein y Millikan

Michelson fue más preciso aún en sus medidas. Este autor, durante cuarenta años largos, a partir de 1.879, fue aplicando el sistema Fizeau-Foucault cada vez con mayor refinamiento, para medir la velocidad de la luz. Cuando se creyó lo suficientemente informado, proyectó la luz a través de vacío, en vez de hacerlo a través del aire, pues este frena ligeramente su velocidad, y, empleó para ello tuberías de acero cuya longitud era superior a 1’5 km. Según sus medidas, la velocidad de la luz en el vacío era de 299.730 km/seg. (Sólo un 0’006% más bajo). Demostraría también que todas las longitudes de ondas luminosas viajan a la misma velocidad en el vacío.

En 1972, un equipo de investigadores bajo la dirección de Kenneth M. Eveson efectuó unas mediciones aún más exactas y vio que la velocidad de la luz era de 299.727’74 km/seg. Una vez se conoció la velocidad de la luz con semejante precisión, se hizo posible usar la luz, o por lo menos formas de ella, para medir distancias.

Desde Galileo con sus lámparas, cada vez se han utilizado aparatos más sofisticados para medir la velocidad de la luz, y, finalmente, se consiguió medirla de manera muy exacta en 299.792.458 metros por segundo que, es el límite que algo puede alcanzar corriendo por el espacio vacío y que sólo ha conseguido la luz.

Aunque para algunos resulte alto tedioso el tema anterior, no he podido resistirme a la tentación de exponerlo, así podrá saber algo más sobre la luz y, habrán conocido a personajes que hicieron posible el que ahora nosotros, la conozcamos mejor.

Podría continuar, hasta el final de este trabajo, hablando de la luz y sus distintas formas o aplicaciones: ondas de luz a través del espacio, de cómo se transmite la luz en el “vacío”, nos llega a través del espacio desde Galaxias situadas a miles de millones de años luz; las líneas de fuerzas electromagnéticas de Faraday y Maxwell de campos eléctricos y magnéticos cambiantes (todo ello explicado en un simple conjunto de cuatro ecuaciones, que describían casi todos los fenómenos referentes a esta materia electromagnética), o de los enigmas aún por descubrir (aunque predichos).

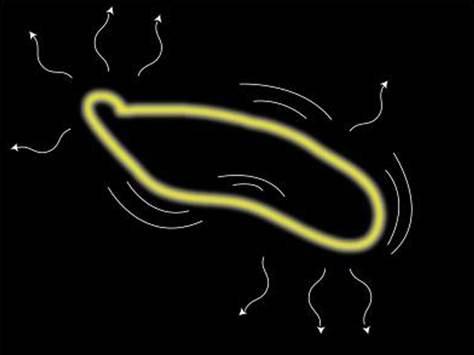

Muchos han ido a la caza de los monopolos magnéticos que, deben ser raros en el Universo, si finalmente existen. Parece que, algunos físicos han conseguido alguna cosa…no se bien qué sobre su existencia.

En 1.931, Dirac, acometiendo el asiento de una forma matemática, llegó a la conclusión de que sí los monopolos magnéticos existían, sería necesario que todas las cargas eléctricas fuesen múltiplos exactos de una carga más pequeña, como en efecto así es. Y dado que todas las cargas eléctricas son múltiplos exactos de alguna carga más pequeña, ¿no deberían en realidad existir los monopolos magnéticos?

En 1.974, un físico joven y prometedor (más tarde ganó el Nobel), Gerard’t Hooft, y un físico soviético, Alexander Poliakov, mostraron, independientemente, que podía razonarse, a partir de las grandes teorías unificadas, que los monopolos magnéticos debían así mismo existir, y que debían poseer una masa enorme. Aunque un monopolo magnético sería incluso más pequeño que un protón, debería tener una masa que sería de 10 trillones a 10 cuatrillones mayor que la del protón. Eso equivaldría a la masa de una bacteria comprimida en una diminuta partícula subatómica.

![[monopolos+m.gif]](http://4.bp.blogspot.com/_nbADpD65WD4/SqENDeBLtLI/AAAAAAAAJ0s/XB4iORp8-eQ/s1600/monopolos%2Bm.gif)

Sería la confirmación de una teoría de 1931. Si seres de otros mundos han podido verlos, habrían visto otro tipo de magnetismo los llamados “monopolos magnéticos”.

Semejantes partículas sólo podían haberse formado en el momento de la gran explosión (otra vez volvemos al origen). Desde entonces, no ha existido la suficientemente alta concentración de energía necesaria para formarla. Esas grandes partículas deberían avanzar a unos 225 km por seg., más o menos, y la combinación de una enorme masa y un pequeño tamaño le permitiría deslizarse a través de la materia sin dejar el menor rastro de presencia. Esta propiedad, de hecho, está relacionada directamente con el fracaso obtenido en su búsqueda.

Los físicos están tratando de idear un mecanismo capaz de poder detectar, con claridad, el paso de monopolos magnéticos.

Podríamos decir que, un monopolo magnético es una entidad magnética hipotética consistente en un polo Norte o Sur elemental aislado. Ha sido postulado como una fuente de campo magnético en analogía a la forma en que las partículas eléctricamente cargadas producen un campo eléctrico.

Se han diseñado numerosos experimentos ingeniosos para detectar monopolos, pero hasta ahora, ninguno ha producido un resultado definitivo. Los monopolos magnéticos son predichos en ciertas teorías gauge con bosones de Higgs. En particular, algunas teorías de gran unificación predicen monopolos muy pesados (con masas del orden de 1016 geV). Se habló de su aparición en los primeros experimentos del LHC, algunos denunciaron eso junto con la aparición de agujeros negros microscópicos pero, de momento…nada

Los monopolos magnéticos también son predichos en las teorías de Kaluza-Klein (5 dimensiones) y en teoría de supercuerdas (10 y 26 dimensione). Es decir, que se predice pero no se puede verificar, y, siendo así, quedamos anclados en el campo de la teoría.

Recuerdo que estaba hablando de los distintos aspectos de la luz, lo que no recuerdo es como he llegado a éste berenjenal de los monopolos magnéticos. Me ocurre siempre, estoy tratando un tema y termino hablando (escribiendo) de otro. No parece más que, el bolígrafo, tenga vida propia. Sin embargo, lo que ocurre en verdad es que, todo es uno, compuesto de distintas partes. Siempre estamos hablando de lo mismo, solo cambian las partes que, en cada momento, estemos estudiando.

La misteriosa materia que compondría el 23 % (se especula) de toda la materia del universo es tan esquiva que jamás ha sido observada por nadie. Así que sólo podíamos sospechar que quizá existía. La materia oscura emite, absorbe e interactúa con radiación electromagnética de manera tan débil que no puede ser observada por medios técnicos ordinarios, no refleja la luz para ser observada.

“Un equipo internacional de astrónomos de Japón, Gran Bretaña y Taiwan acaba de conseguir, por primera vez, imágenes que reflejan la distribución de materia oscura alrededor de 20 grandes cúmulos de galaxias. Los resultados se publicarán en la revista mensual de la Royal Astronomical Society. Las pruebas aún no son concluyentes, pero sí muy esperanzadoras”.

Ni en el infrarrojo, ni en los rayos X ni en el ultravioleta la materia oscura había revelado aún su auténtica naturaleza. Pero utilizando lentes gravitacionales los científicos han sido capaces de mostrar las primeras imágenes en las que se “aprecia” la misteriosa materia oscura. Bueno, eso es lo que dicen ellos.

Masa-Materia-Luz: Todo la misma cosa ¡Energía! que es el motor que hace andar al ¡El Universo!

emilio silvera

Dic

23

¡La Física! ¿Qué sería de nosotros sin ella?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (1)

Comments (1)

Incluso las frecuencias de onda cerebrales están estrechamente relacionadas con la actividad fisiológica de nuestro organismo. Esto es algo indudable, puesto que todo lo que conocemos en el mundo físico está compuesto por átomos que vibran a determinadas frecuencias. En las últimas décadas, la física cuántica nos ha revelado información muy importante acerca de nuestra realidad. Fue Richard Feynman el que dijo en cierta ocasión que si tuviera que elegir en una frase el descubrimiento más importante de la Ciencia moderna, elegiría:

El mundo está hecho de átomos”

Muchas son las veces que aquí nos hemos referido a que, 500 años antes de Cristo, ya algunos hablaban de ese hecho cierto de que “el mundo estaba hecho de átomos”. Los filósofos de la Naturaleza (como los llamaban entonces), Leucipo de Mileto y su Alumno, Demócrito de Abdera, fueron los encargados de divulgar ese increíble hecho que, según ellos decían: “Todas las cosas estaban hechas de unos objetos invisibles e indivisibles, la parte más pequeña de la materia que llamaban a-tomo o átomos. Aquella historia viene de mucho más lejos y, esos filósofos griegos tomaron prestadas las ideas de los pensadores hindúes que mucho antes que ellos hablaban de átomos y de vacío. Otro filósofo de la Naturaleza, Empédocles, nos decía:

“Pues yo he sido a veces un muchacho y una chica,

Un matorral y un pájaro y un pez en las olas saladas.”

Esto nos decía Empédocles, el padre de aquellos primitivos elementos formados por Agua, tierra, aire y fuego que, mezclados en la debida proporción, formaban todas las cosas que podemos ver a nuestro alrededor. Claro que, él no podía llegar a imaginar hasta donde pudimos llegar después en la comprensión de la materia a partir del descubrimiento de las partículas “elementales” que formaban el átomo. Pero sí, con sus palabras, nos quería decir que, la materia, una veces está conformando mundos y, en otras, estrellas y galaxias.

Sí, hay cosas malas y buenas pero todas deben ser conocidas para poder, en el primer caso aprovecharlas, y en el segundo, prevenirlas.

Pero demos un salto en el tiempo y viajémos hasta los albores del siglo XX cuando se hacía cada vez más evidente que alguna clase de energía atómica era responsable de la potencia del Sol y del resto de las estrellas que más lejos, brillaban en la noche oscura. Ya en 1898, sólo dos años despuès del descubrimiento de la radiactividad por Becquerel, el geólogo americano Thomas Chrowder Chamberlin especulaba que los átomos eran “complejas organizaciones y centros de eneromes energías”, y que “las extraordinarias condiciones que hay en el centro del Sol pueden…liberar una parte de su energía”. Claro que, por aquel entonces, nadie sabía cual era el mecanismo y cómo podía operar, hasta que no llegamos a saber mucho más sobre los átomos y las estrellas.

Conseguimos tener los átomos en nuestras manos y, aunque la imagen sea simbólica, nos muestra una realidad, toda vez que, en este mismo instante podemos construir “cosas” átomo a átomo. Hemos llegado a un nivel de manipulación de la materia que ni podíamos imaginar hasta hace tan sólo un siglo. Si aquellos Filósofos Naturales levantarán la cabeza…

El intento de lograr tal comprensión exigió una colaboración cada vez mayor entre los astrónomos y los físicos nucleares. Su trabajo llevaría, no sólo a resolver la cuestión de la energía estelar, sino también al descubrimiento de una trenza dorada en la que la evolución cósmica se entrelaza en la historia atómica y la estelar. En todos estos fenómenos y secretos que nos ocultan la Naturaleza, la Luz está presente y, en el futuro tendrá mucho que decirnos cuando de verdad, la podamos conocer.

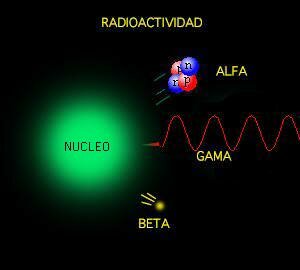

La Clave: Fue comprender la estructura del átomo. Que el átomo tenía una estructura interna podía inferirse de varias líneas de investigación, entre ellas, el estudio de la radiactividad: para que los átomos emitiesen partículas, como se había hallado que lo hacían en los laboratorios de Becquerel y los Curie, y para que esas emisiones los transformasen de unos elementos en otros, como habían demostrado Rutherford y el químico inglés Frederick Soddy, los átomos debían ser algo más que simples unidades indivisibles, como implicaba su nombre (de la voz griega que significa “imposible de cortar”).

La Clave: Fue comprender la estructura del átomo. Que el átomo tenía una estructura interna podía inferirse de varias líneas de investigación, entre ellas, el estudio de la radiactividad: para que los átomos emitiesen partículas, como se había hallado que lo hacían en los laboratorios de Becquerel y los Curie, y para que esas emisiones los transformasen de unos elementos en otros, como habían demostrado Rutherford y el químico inglés Frederick Soddy, los átomos debían ser algo más que simples unidades indivisibles, como implicaba su nombre (de la voz griega que significa “imposible de cortar”).

El átomo de Demócrito era mucho más de lo que él, en un principio intuyó que sería. Hoy sabemos que está conformado por diversas partículas de familias diferentes: unas son bariones que en el seno del átomo llamamos nucleones, otras son leptones que giran alrededor del núcleo para darle estabilidad de cargas, y, otras, de la familia de los Quarks, construyen los bariones del núcleo y, todo ello, está, además, vigilado por otras partículas llamadas bosones intermedios de la fuerza nuclear fuerte, los Gluones que, procuran mantener confinados a los Quarks.

Pero no corramos tanto, la física atómica aún debería recorrer un largo camino para llegar a comprender la estructura que acabamos de reseñar. De los trs principales componentes del átomo -el protón, el neutrón y el electrón-, sólo el electrón había sido identificado (por J.J. Thomson, en los últimos años del siglo XIX). Nadie hablaba de energía “nuclear” pues ni siquiera se había demostrado la existencia de un núcleo atómico, y mucho menos de sus partículas constituyentes, el protón y el neutrón, que serían identificados, respectivamente, por Thomson en 1913 y James Chawick en 1932.

Rutherford era uno de esos individuos poco corrientes que hizo su más importante contribución a la ciencia, él con su experimento al bombardear una plaxa de oro con partículas alfas, descubrió la existencia de un núcleo dentro del átomo y que era 1/100.000 veces menor que éste. Ganó el Nobel de Fósoca por ello.

De importancia capital resultó conocer la existencia del núcleo y que éste, era 1/100.000 del total del átomo, es decir, casi todo el átomo estaba compuesto de espacios “vacíos” y, la materia así considerada, era una fracción inifintesimal del total atómico.

Rutherford, Hans Geiger y Ernest Marsden se encontraban entre los Estrabones y Tolomeos de la cartografía atómica, en Manchester , de 1909 a 1911, sonderaron el átomo lanzando corrientes de “partículas alfa” subatómicas -núcleos de helio- contra delgadas laminillas de oro, plata, estaño y otros metales. La mayoría de partículas Alfa se escapaban a través de las laminillas, pero, para sombro de los experimentadores, algunas rebotaban hacia atrás. Rutherford pensó durante largo tiempo e intensamente en este extraño resultado; era tan sorprendente, señalaba, como si una bala rebotase sobre un pañuelo de papel. Finalmente, en una cena en su casa en 1911, anunció a unos pocos amigos que había dado con una explicación: que la mayoría de la masa de un átomo reside en un diminuto núcleo masivo. Ruthertford pudo calcular la carga y el diámetro máximo del nucleo atómico. Así se supo que los elementos pesados eran más pesados que los elementos ligeros porque los núcleos de sus átomos tienen mayor masa.

Todos sabemos ahora, la función que desarrollan los electrones en el atomo. Pero el ámbito de los electrones para poder llegar a la comprensión completa, tuvo que ser explorado, entre otros, por el físico danés Niels Bohr, quien demostró que ocupaban órbitas, o capas, discretas que rodean al núcleo. (Durante un tiempo Bohr consideró el átomo como un diminuto sistema solar, pero ese análisis, pronto demostró ser inadecuado; el átomo no está rígido por la mecánica newtoniana sino por la mecánica cuántica.)

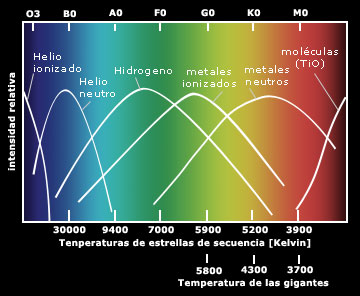

Entre sus muchos otros éxitos, el modelo de Bohr revelaba la base física de la espectroscopia. El número de electrones de un átomo está determinado por la carga eléctrica del núcleo, la que a su vez se debe al número de protones del núcleo, que es la clave de la identidad química del átomo. Cuando un electrón cae de una órbita externa a una órbita interior emite un fotón. La longitud de onda de este fotón está determinada por las órbitas particulares entre las que el electrón efectúa la transición. E esta es la razón de que un espectro que registra las longitudes de onda de los fotones, revele los elementos químicos que forman las estrellas u otros objetos que sean estudiados por el espectroscopista. En palabras de Max Planck, el fundador de la física cuántica, el modelo de Bohr del átomo nos proporciona “la llave largamente buscada de la puerta de entrada al maravilloso mundo de la espectroscopia, que desde el descubrimiento del análisis espectral (por Fraunhoufer) había desafiado obtinadamente todos los intentos de conocerlo”.

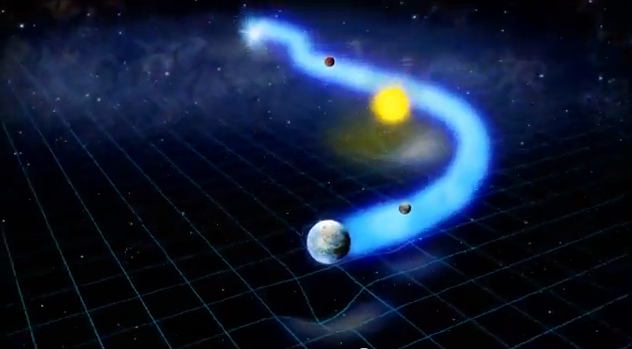

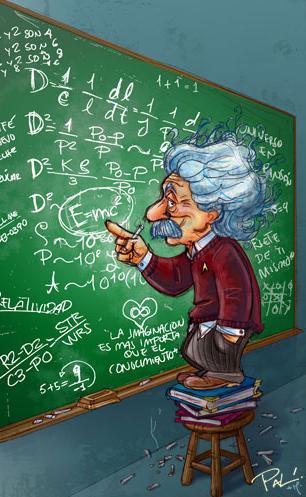

Es curioso que, mirando en la oscura noche como brillan las estrellas del cielo, nos atrae su titilar engañoso (es la atmósfera terrestre la que hace que lo parezca) y su brillo, Sin embargo, pocos llegan a pensar en lo que verdaderamente está allí ocurriendo. Las transformaciones de fase por fusión no cesan. Esta transformación de materia en energía es consecuencia de la equivalencia materia-energía, enunciada por Albert Einstein en su famosa fórmula E=mc2; donde E es la energía resultante, m es la masa transformada en energía, y c es la velocidad de la luz (300 000 kilómetros por segundo). La cantidad de energía que se libera en los procesos de fusión termonuclear es fabulosa. Un gramo de materia transformado íntegramente en energía bastaría para satisfacer los requerimientos energéticos de una familia mediana durante miles de años.

Es un gran triunfo del ingenio humano el saber de qué, están confomadas las estrellas, de qué materiales están hechas. Recuerdo aquí a aquel Presidente de la Real Society de Londres que, en una reunión multitudinaria, llegó a decir: “Una cosa está clara, nunca podremos saber de qué están hechas las estrellas”. El hombre se vistió de gloria con la, desde entonces, famosa frase. Creo que nada, con tiempo por delante, será imposible para nosotros.

Pero, por maravilloso que nos pueda parecer el haber llegado a la comprensión de que los espectros revelan saltos y tumbos de los electrones en sus órbitas de Bohr, aún nadie podía hallar en los espectros de las estrellas las claves significativas sobre lo que las hace brillar. En ausencia de una teoría convincente, se abandonó este campo a los taxonomistas, a los que seguían obstinadamente registrando y catalogando espectros de estrellas, aunque no sabían hacia donde los conduciría esto.

En el Laboratorio de la Universidad de Harvard, uno de los principales centros de la monótona pero prometedora tarea de la taxonomía estelar, las placas fotográficas que mostraban los colores y espectros de decenas de miles de estrellas se apilaban delante de “calculadoras”, mujeres solteras en su mayoría y, de entre ellas, Henrietta Leavitt, la investigadora pionera de las estrellas variables Cefeidas que tan útiles serían a Shapley y Hubble.

Imagen de Sirio A, la estrella más brillante del cielo tomada por el Telescopio Hubble (Créd. NASA). Sirio es la quinta estrella más cercana y tiene una edad de 300, millones de años. Es una estrella blanca de la secuencia principal de tipo espectral A1V con temperatura superficial de 10 000 K y situada a 8,6 años luz de la Tierra. Es una estrella binaria y, de ella, podríamos contar muchas historias. La estrella fue importante en las vidas de Civilizaciones pasadas como, por ejemplo, la egipcia.

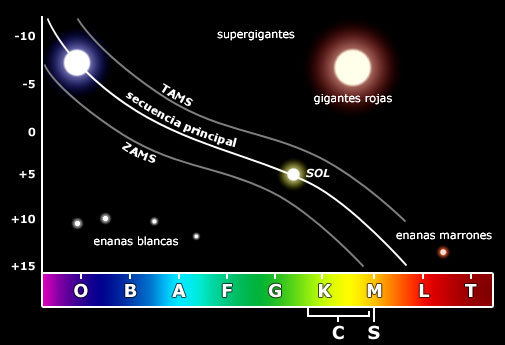

Fue Cannon quien, en 1915, empezó a discernir la forma en una totalidad de estrellas en las que estaba presente la diversidad, cuando descubrió que en una mayoría, las estrellas, pertenecían a una de media docena de clases espectrales distintas. Su sistema de clasificación, ahora generalizado en la astronomía estelar, ordena los espectros por el color, desde las estrellas O blancoazuladas, pasando por las estrellas G amarillas como el Sol, hasta estrellas rojas M. Era un rasgo de simplicidad denajo de la asombrosa variedad de las estrellas.

Pronto se descubrió un orden más profundo, en 1911, cuando el ingeniero y astrónomo autodidacta danés Ejnar Hertzsprung analizó los datos de Cannon y Maury de las estrellas de dos cúmulos, las Híades y las Pléyades. Los cúmulos como estos son genuinos conjuntos de estrellas y no meras alineaciones al azar; hasta un observador inexperimentado salta entusiamado cuando recorre con el telecopio las Pléyades, con sus estrellas color azul verdoso enredadas en telarañas de polvo de diamante, o las Híades, cuyas estrellas varían en color desde el blanco mate hasta un amarillo apagado.

Las Híades

Hertzsprung utilizó los cúmulos como muestras de laboratorio con las que podía buscar una relación entre los colores y los brillos intrínsecos de las estrellas. Halló tal relación: la mayoría de las estrellas de ambos cúmulos caían en dos líneas suavemente curvadas. Esto, en forma de gráfico, fue el primer esbozo de un árbol de estrellas que desde entonces ha sido llamado diagrama Hertzsprung-Russell.

El progreso en física, mientras tanto, estaba bloquedado por una barrera aparentemente insuperable. Esto era literal: el agente responsable era conocido como barrera de Coulomb, y por un tiempo frustó los esfuerzos de las físicos teóricos para copmprender como la fusión nuclear podía producir energía en las estrellas.

La línea de razonamiento que conducía a esa barrera era impecable. Las estrellas están formadas en su mayor parte por hidrógeno. (Esto se hace evidente en el estudio de sus espectros.) El núcleo del átomo de Hidrógeno consiste en un solo protón, y el protón contiene casi toda la masa del átomo. (Sabemos esto por los experimentos de Rutherford). Por tanto, el protón también debe contener casi toda la energía latente del átomo de hidrógeno. (Recordemos que la masa es igual a la energía: E = mc2.) En el calor de una estrella, los protones son esparcidos a altas velocidades -el calor intenso significa que las partículas involucradas se mueven a enormes velocidades- y, como hay muchos protones que se apiñan en el núcleo denso de una estrella, deben tener muchísimos choques. En resumen, la energía del Sol y las estrellas, puede suponerse razonablemente, implica las interacciones de los protones. Esta era la base de la conjetura de Eddintong de que la fuente de la energía estelar “difícilmente puede ser otra que la energía subatómica, la cual, como se sabe, existe en abundancia en toda materia”.

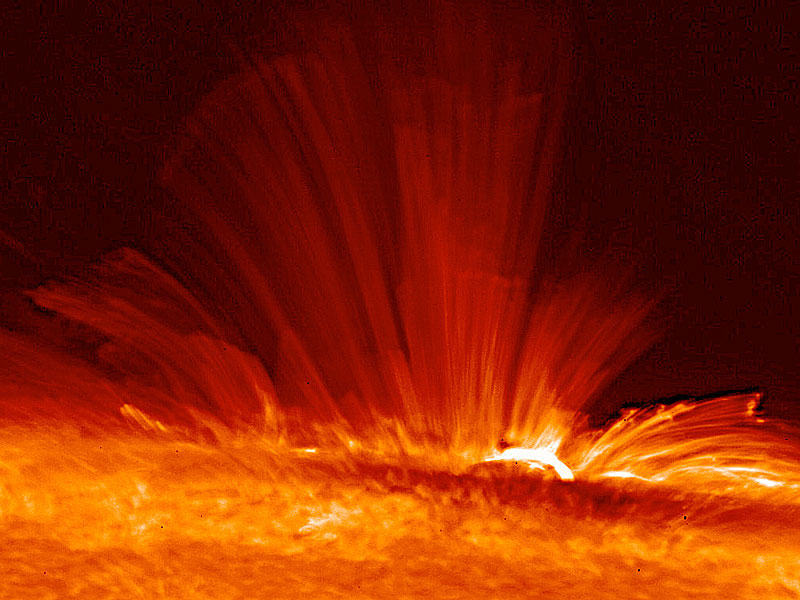

Plasma en ebullición en la superficie del Sol

Hasta el momento todo lo que hemos repasado está bien pero, ¿que pasa con la Barrera de Coulomb? Los protones están cargados positivamente; las partículasd de igual carga se repelen entre sí; y este obstáculo parecía demasiado grande para ser superado, aun a la elevada velocidad a la que los protones se agitaban en el intenso calor del interior de las estrellas. De acuerdo con la física clásica, muy raras veces podían dos protones de una estrella ir con la rapidez suficiente para romper las murallas de sus campos de fuerza electromagnéticos y fundirse en un solo núcleo. Los cálculos decían que la tasa de colisión de protones no podía bastar para mantener las reacciones de fusión. Sin embargo, allí estaba el Sol, con el rostro radiante, riéndose de las ecuaciones que afirmaban que no podía brillar.

Afortunadamente, en el ámbito nuclear, las reglas de la Naturaleza no se rigen por las de la mecánica de la física clásica, que tienen validez para grandes objetos, como guijarros y planetas, pero pierden esa validez en el reino de lo muy pequeño. En la escala nuclear, rigen las reglas de la indeterminación cuántica. La mecánica cuántica demuestra que el futuro del protón sólo puede predecirse en términos de probabilidades: la mayoría de las veces el protón rebotará en la Barrera de Coulomb, pero de cuando en cuando, la atravesará. Este es el “efecto túnel cuántico”; que permite brillar a las estrellas.

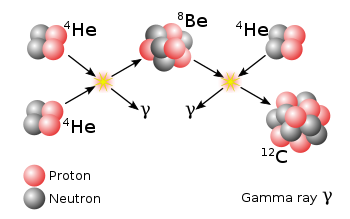

George Gamow, ansioso de explotar las conexiones entre la astronomía y la nueva física exótica a la que era adepto, aplicó las probabilidades cuánticas a la cuestión de la fusión nuclear en las estrellas y descubrió que los protones pueden superar la Barrera de Coulomb. Esta historia es mucho más extensa y nos llevaría hasta los trabajos de Hans Bethe, Edward Teller y otros, así como, al famoso Fred Hoyle y su efecto Triple Alfa y otras maravillas que, nos cuentan la historia que existe desde los átomos a las estrellas del cielo.

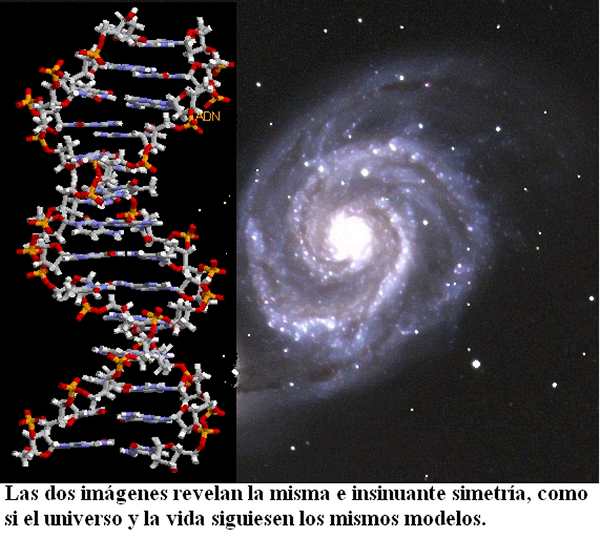

Una cuestión que no debemos olvidar nunca es que la simetría subyace en las leyes del Universo. Muchos han sido los cambios que en los últimos tiempos se han producido en la disciplina cientifica de la física y otras áreas del saber humano. Sin embargo, en todos ellos, en todos esos cambios ha estado siempre presente una característica esencia: La Simetría que es aquella propiedad que permanece invariable a pesar de los cambios. Los físicos fijándose en esa simetría han podido descubrir cuestiones importantes que permanecesían profundamente escondidas en las entrañas de la Naturaleza.

Los que hemos trillado el camino de la Física y de la Astronomía, hemos podido llegar a comprender la importancia de la simetría en la comprensión del “mundo” (una manera en la que los vistorianos expresaban su parecer sobre el universo). En todos los aspectos misteriosos y sutíles que encontramos en la naturaleza, la simetría nos arroja una luz sobre ellos que hace posible que lleguemos a comprender lo que antes no entendíamos. Muchos Físicos como Einstein, por ejmplo, con la Simetría en su cabeza llegó a comprender “su mundo” y se dio cuenta de qué cosas en el Universo no cambian a pesar de todo.

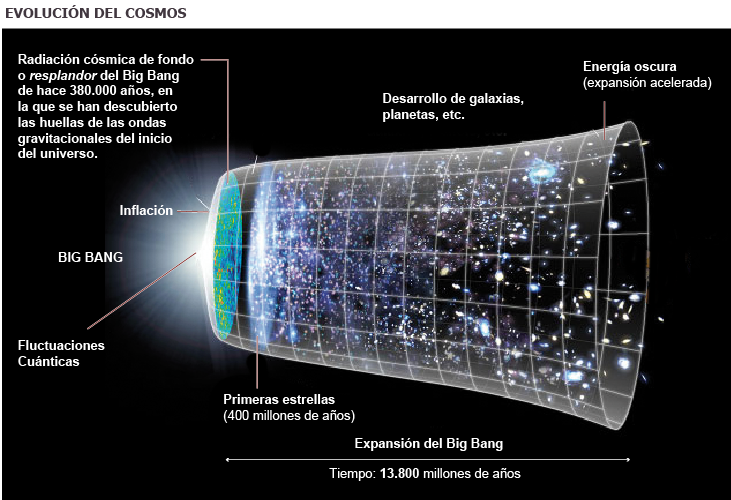

No hace mucho hemos hablado aquí de las eras por las que pas´ço el Universo primitivo hasta que, al enfriarse, se pudo estabilizar y hacerse mayor, es decir, el Universo que hoy conocemos y en los que están presentes una serie de simetrías o constantes que lo hacen reconocible para nosotros. Una de esas constantes, como tantas veces hemos podido referir aquí, es la de la Luz. El amigo Einstein supo “ver” que aquella simetría luminosa hecha de fotones, era invariable y, sin importar cual fuere la fuente ni a que velocidad pudiera moverse ésta o incluso estar parada, la luz, sin importarle nada de todo eso, seguía su camino a la misma velocidad siempre, es decir, a 299.972.458 metros por segundo cuando corría por el vacío interestelar, y, nada podría nunca sobrepasar de esa velocidad que era una constante de la Naturaleza.

Hemos tenido que construir máquinas inmensas para poder comprobar los efectos que se producen en un cuerpo cuando éste quiere ir más rápido que la luz. Lo predijo la teoría de la relatividad especial de Einstein y se ha comprobado despuès en los aceleradores de partículas: Nada va más rápido que la luz en nuestro Universo.

Es preciso ampliar un poco más las explicaciones anteriores que no dejan sentadas todas las cuestiones que el asunto plantea, y quedan algunas dudas que incitan a formular nuevas preguntas, como por ejemplo: ¿por qué se convierte la energía en masa y no en velocidad?, o ¿por qué se propaga la luz a 299.793 Km/s y no a otra velocidad?

La única respuesta que podemos dar hoy es que así es el universo que nos acoge y las leyes naturales que lo rigen, donde estamos sometidos a unas fuerzas y unas constantes universales de las que la velocidad de la luz en el vacio es una muestra.

A velocidades grandes cercanas a la de la luz (velocidades relativistas) no sólo aumenta la masa del objeto que viaja, sino que disminuye también su longitud en la misma dirección del movimiento (contracción de Lorentz) y en dicho objeto y sus ocupantes – si es una nave – se retrasa al paso del tiempo, o dicho de otra manera, el tiempo allí transcurre más despacio. A menudo se oye decir que las partículas no pueden moverse “más deprisa que la luz” y que la “velocidad de la luz” es el límite último de velocidad.

Pero decir esto es decir las cosas a medias, porque la luz viaja a velocidades diferentes dependiendo del medio en el que se mueve. Donde más deprisa se mueve la luz es en el vacío: allí lo hace a 299.792’458 Km/s. Este sí es el límite último de velocidades que podemos encontrar en nuestro universo.

En el futuro, grandes estaciones sumergidas en el océano y ciudades en otros mundos rodeadas de campos de fuerza que impedirán la radiación nosiva mientras tanto se va consiguiendo terraformar el planeta. La tecnología habrá avanzado tanto que nada de lo que hoy podamos imaginar estará fuera de nuestro alcance y, viajar a mundos situados a decenas de años-luz de la Tierra será para entonces, lo cotidiano

Eso es lo que imaginamos pero… ¿Qué maravillas tendremos dentro de 150 años? ¿Qué adelantos científicos se habrán alcanzado? ¿Qué planetas habremos colonizado? ¿Habrá sucedido ya ese primer contacto del que tanto hablamos? ¿Cuántas “Tierras” habrán sido encontradas? ¿Qué ordenadores utilizaremos? ¿Será un hecho cotidiano el viaje espacial tripulado? ¿Estaremos explotando las reservas energéticas de Titán? ¿Qué habrá pasado con la Teoría de Cuerdas? Y, ¿Habrá, por fín aparecido la dichosa relatividad/#”>materia oscura? Haciendo todas estas preguntas de lo que será o podrá ser, nos viene a la memoria todo lo que fue y que nos posibilita hacer estas preguntas.

Una cosa nos debe quedar bien clara, nada dentro de 250 años será lo mismo que ahora. Todo habrá cambiado en los distintos ámbitos de nuestras vidas y, a excepción del Amor y los sentimientos que sentiremos de la misma manera (creo), todo lo demás, habrá dado lugar a nuevas situaciones, nuevas formas de vida, nuevas sociedades, nuevas maneras y, podríamos decir que una Humanidad nueva, con otra visión y otras perspectivas.

Nuevas maneras de sondear la Naturaleza y desvelar los secretos

Pero echemos una mirada al pasado. Dejando a un lado a los primeros pensadores y filósofos, como Tales, Demócrito, Empédocles, Ptolomeo, Copérnico, Galileo, Kepler y otros muchos de tiempos pasados, tenemos que atender a lo siguiente:

Nuestra Física actual está regida y dominada por dos explosiones cegadoras ocurridas en el pasado: Una fue aquel artículo de 8 páginas que escribiera Max Planck, en ese corto trabajo dejó sentados los parámetros que rigen la Ley de la distribución de la energía radiada por un cuerpo negro. Introdujo en física el concepto novedoso de que la energía es una cantidad que es radiada por un cuerpo en pequeños paquetes discretos, en vez de en una emisión continua. Estos pequeños paquetes se conocieron como cuantos y la ley formulada es la base de la teoría cuántica.

Un amigo físico me decía: cuando escribo un libro, procuro no poner ecuaciones, cada una de ellas me quita diez lectores. Siguiendo el ejemplo, procuro hacer lo mismo (aunque no siempre es posible) pero, en esta ocasión dejaremos el desarrollo de la energía de Planck del que tantas veces se habló aquí, y, ponernos ahora a dilucidar ecuaciones no parece lo más entretenido, aunque el lenguaje de la ciencia, no pocas veces es el de los números.

En cualquier evento de Ciencia, ahí aparecen esos galimatias de los números y letras que pocos pueden comprender, dicen que es el lenguaje que se debe utilizar cuando las palabras no pueden expresar lo que se quiere decir. Y, lo cierto es que, así resulta ser.

Después de lo de Planck y su radiación de cuerpo negro, cinco años más tarde, irrumpió en escena otra revolución de la Física se produjo en 1.905, cuando Albert relatividad/Einstein con su relatividad/relatividad especial nos dio un golpecito en nuestras cabezas para despertar en ellas nuestra comprensión de las leyes que gobiernan el Universo.

Nos dijo que la velocidad de la luz es la máxima alcanzable en nuestro universo, que la masa y la energía son la misma cosa, que si se viaja a velocidades cercanas a la de la luz, el tiempo se ralentiza pero, el cuerpo aumentará su masa y se contraerá en el sentido de la misma…Y, todo eso, ha sido una y mil veces comprobado. Sin embargo, muchas son las pruebas que se realizan para descubrir los fallos de la teoría, veamos una:

Los científicos que estudian la radiación gamma de una explosión de rayos lejanos han encontrado que la velocidad de la luz no varía con la longitud de onda hasta escalas de distancia por debajo de la relatividad/longitud de Planck. Ellos dicen que esto desfavorece a algunas teorías de la gravedad cuántica que postulan la violación de la invariancia de Lorentz.

La invariancia de Lorentz se estipula que las leyes de la física son las mismas para todos los observadores, independientemente de dónde se encuentren en el universo. relatividad/Einstein utilizó este principio como un postulado de la relatividad/relatividad especial, en el supuesto de que la velocidad de la luz en el vacío, no depende de que se esté midiendo, siempre y cuando la persona esté en un sistema inercial de referencia. En más de 100 años la invariancia de Lorentz nunca ha sido insuficiente.

La Teoría de cuerdas nos habla de las vibraciones que éstas emiten y que son partículas cuánticas. En esta teoría, de manera natural, se encuentran las dos teorías más importantes del momento: La Gravedad y la Mecánica cuántica, allí, subyacen las ecuaciones de campo de la teoría de la relatividad de Einstein que, cuando los físicas de las “cuerdas” desarrollan su teoría, aparecen las ecuciones relativista, sin que nadie las llame, como por arte de magia. Y, tal aparición, es para los físicos una buena seña.

Sin embargo, los físicos siguen sometiendo a pruebas cada vez más rigurosas, incluyendo versiones modernas del famoso experimento interferométrico de Michelson y Morley. Esta dedicación a la precisión se explica principalmente por el deseo de los físicos para unir la mecánica cuántica con la relatividad/relatividad general, dado que algunas teorías de la gravedad cuántica (incluyendo la teoría de cuerdas y la gravedad cuántica de bucles) implica que la invariancia Lorentz podría romperse.

Granot y sus colegas estudiaron la radiación de una explosión de relatividad/rayos gamma (asociada con una explosión de gran energía en una galaxia distante) que fue descubierto por la NASA relatividad/Fermi Gamma-Ray Space Telescope, el 10 de mayo de este año. Se analizó la radiación en diferentes longitudes de onda para ver si había indicios de que los relatividad/fotones con energías diferentes llegaron a los detectores de relatividad/Fermi en diferentes momentos.

Tal difusión de los tiempos de llegada parece indicar que la invariancia Lorentz efectivamente había sido violada, es decir que la velocidad de la luz en el vacío depende de la energía de la luz y no es una constante universal. Cualquier dependencia de la energía sería mínima, pero aún podría resultar en una diferencia mensurable en los tiempos de llegada de relatividad/fotones debido a los miles de millones de años luz de a la que se encuentran las explosiones de relatividad/rayos gamma.

Cuando nos acercamos a la vida privada del genio… ¡también, como todos, era humano!

De la calidad de relatividad/Einstein como persona nos habla un detalle: Cuando el Presidente Chaim Weizmann de Israel murió en 1952, a relatividad/Einstein se le ofreció la presidencia, pero se negó, diciendo que no tenía “ni la habilidad natural ni la experiancia para tratar con seres humanos.” Luego escribió que se sentía muy honrado por el ofrecimiento del estado de Israel, pero a la vez triste y avergonzado de no poder aceptarla.

Pero sigamos con la segunda revolución de su teoría que se dio en dos pasos: 1905 la teoría de la relatividad/relatividad especial y en 1.915, diez años después, la teoría de la relatividad/relatividad general que varió por completo el concepto del Cosmos y nos llevó a conocer de manera más profunda y exacta la Gravedad de relatividad/Newton.

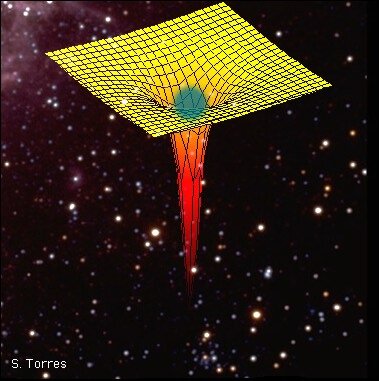

Einstein nos decía que el espacio se curva en presencia de grandes masas

En la Teoría Especial de la Relatividad, relatividad/Einstein se refirió a sistemas de referencias inerciales (no acelerados). Asume que las leyes de la física son idénticas en todos los sitemas de referencia y que la velocidad de la luz en el vacío, c, es constante en el todo el Universo y es independiente de la velocidad del obervador.

La teoría desarrolla un sistema de matemáticas con el fin de reconciliar estas afirmaciones en aparente conflicto. Una de las conclusiones de la teoría es que la masa de un cuerpo, aumenta con la velocidad (hay una ecuación quer así lo demuestra), y, tal hecho, ha sido sobradamente comprobado en los aceleradores de partículas donde un relatividad/muón, ha aumentado más de diez veces su masa al circular a velocidades cercanas a la de la luz. Y el relatividad/muón que tiene una vida de dos millonésimas de segundo, además, al desplazarse a velocidades relativistas, también ven incrementado el tiempo de sus vidas.

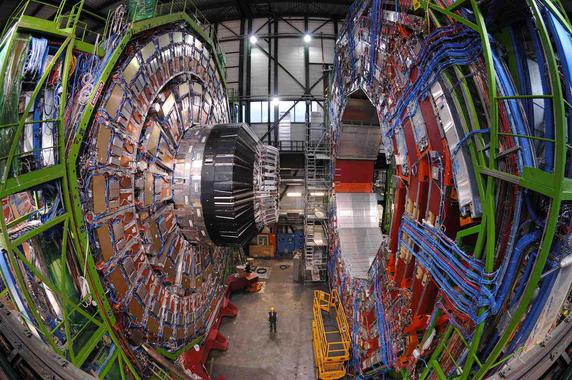

El Acelerador de Partículas LHC es una Obra inmensa que ha construido el SER Humano para saber sobre la Naturaleza de la materia y…

Todos esos impulsos son llevados a procesadores electrónicos de datos a través de cientos de miles de cables. Por último, se hace una grabación en carrete de cinta magnética codificada con ceros y unos. La cinta graba las violentas colisiones de los protones y antiprotones, en las que generan unas setenta partículas que salen disparadas en diferentes direcciones dentro de las varias secciones del detector.

El LHC es un esfuerzo internacional, donde participan alrededor de siete mil físicos de 80 países. Consta de un túnel en forma de anillo, con dimensiones interiores parecidas a las del metro subterráneo de la Ciudad de México, y una circunferencia de 27 kilómetros. Está ubicado entre las fronteras de Francia y Suiza, cerca de la ciudad de Ginebra, a profundidades que van entre los 60 y los 120 metros debido a que una parte se encuentra bajo las montañas del Jura

La ciencia, en especial la física de partículas, gana confianza en sus conclusiones por duplicación; es decir, un experimento en California se confirma mediante un acelerador de un estilo diferente que funciona en Ginebra con otro equipo distinto que incluye, en cada experimento, los controles necesarios y todas las comprobaciones para que puedan confirmar con muchas garantías, el resultado finalmente obtenido. Es un proceso largo y muy complejo, la consecuencia de muchos años de investigación de muchos equipos diferentes.

relatividad/Einstein también concluyó que si un cuerpo pierde una energía L, su masa disminuye en L/c2. relatividad/Einstein generalizó esta conclusión al importante postulado de que la masa de un cuerpo es una medida de su contenido en energía, de acuerdo con la ecuación m=E/c2 ( o la más popular E=mc2).

Otras de las conclusiones de la teoría de relatividad/Einstein en su modelo especial, está en el hecho de que para quien viaje a velocidades cercanas a c (la velocidad de la luz en el vacío), el tiempo transcurrirá más lento. Dicha afirmación también ha sido experimentalmente comprobada.

Todos estos conceptos, por nuevos y revolucionarios, no fueron aceptados por las buenas y en un primer momento, algunos físicos no estaban preparados para comprender cambios tan radicales que barrían de un plumazo, conceptos largamente arraigados.

Todo lo grande está hecho de cosas pequeñas

Fue Max Planck, el Editor de la Revista que publicó el artículo de Albert relatividad/Einstein, quien al leerlo se dió cuenta de la enorme importancia de lo que allí se decía. A partir de aquel momento, se convirtió en su valedor, y, en verdad, relatividad/Einstein, reconoció publicamente tal ayuda.

En la segunda parte de su teoría, la Relatividad General, relatividad/Einstein concluyó que el espacio y el tiempo están distorsionados por la materia y la energía, y que esta distorsión es la responsable de la gravedad que nos mantiene en la superficie de la Tierra, la misma que mantiene unidos los planetas del Sistema Solar girando alrededor del Sol y, también la que hace posible la existencia de las Galaxias.

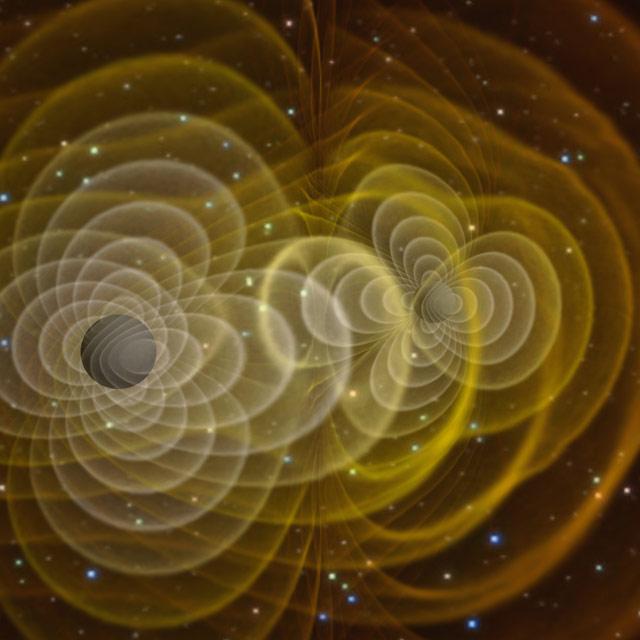

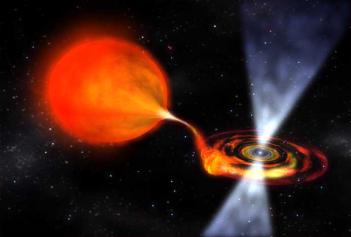

¡La Gravedad! Siempre está presente e incide en los comportamientos de la materia. La gravedad presente en un agujero negro gigante hace que en ese lugar, el tiempo deje de existir, se paralice y el espacio, se curve en una distorsión infinita. Es decir, ni espacio ni tiempo tienen lugar en la llamada singulariudad.

Nos dio un conjunto de ecuaciones a partir de los cuales se puede deducir la distorsión del tiempo y del espacio alrededor de objetos cósmicos que pueblan el Universo y que crear esta distorsión en función de su masa. Se han cumplido 100 años desde entonces y miles de físicos han tratado de extraer las predicciones encerradas en las ecuaciones de relatividad/Einstein (sin olvidar a Riemann ) sobre la distorsión del espaciotiempo.

Un relatividad/agujero negro es lo definitivo en distorsión espaciotemporal, según las ecuaciones de relatividad/Einstein: está hecho única y exclusivamente a partir de dicha distorsión. Su enorme distorsión está causada por una inmensa cantidad de energía compactada: energía que reside no en la materia, sino en la propia distorsión. La distorsión genera más distorsión sin la ayuda de la materia. Esta es la esencia del relatividad/agujero negro.

Las ecuaciones de campo de la relatividad general de Einstein… ¡Nos dicen tántas cosas!

Si tuviéramos un relatividad/agujero negro del tamaño de la calabaza más grande del mundo, de unos 10 metros de circunferencia, entonces conociendo las leyes de la geometría de Euclides se podría esperar que su diámetro fuera de 10 m.: л = 3,14159…, o aproximadamente 3 metros. Pero el diámetro del agujero es mucho mayor que 3 metros, quizá algo más próximo a 300 metros. ¿ Cómo puede ser esto ? Muy simple: las leyes de Euclides fallan en espacios muy distorsionados.

Con Einstein llegó la cosmología moderna, otra manera de mirar el Universo

Con esta teoría de la Relatividad General, entre otros pasos importantes, está el hecho de que dió lugar al nacimiento de la Cosmología que, de alguna manera, era como mirar con nueva visión a lo que l Universo podía significar, Después de relatividad/Einstein, el Universo no fue el mismo.

El análisis de la Gravitación que aquí se miuestra interpreta el Universo como un continuo espacio-tiempo de cuatro dimensiones en el el que la presencia de una masa (como decía antes) curva el espacio para crear un campo gravitacional.

De la veracidad y comprobación de las predicciones de ésta segunda parte de la Teoría Relativista, tampoco, a estas alturas cabe duda alguna, y, lo más curioso del caso es que, después de casi un siglo (1.915), aún los físicos están sacando partido de las ecuaciones de campo de la teoría relativista en su versión general o de la Gravedad.

Tan importante es el trabajo de relatividad/Einstein que, en las nuevas teorías, en las más avanzadas, como la Teoría M (que engloba las cinco versiones de la Teoría de Cuerdas), cuando la están desarrollando, como por arte de magía y sin que nadie las llame, surgen, emergen, las ecuaciones de relatividad/Einstein de la Relatividad General.

La luz se propaga en cualquier medio pero en el vacío, mantiene la mayor velocidad posible en nuestro Universo, y, hasta el momento, que se sepa, nada ha corrido más que la luz en ese medio. Algunos han publicado ésta o aquella noticia queriendo romper la estabilidad de la relatividad especial y han publicado que los neutrinos o los taquiones van más rápidos que la luz. Sin embargo, todo se quedó en eso, en una noticia sin demostración para captar la atención del momento.

La luz se propaga en el vacío a una velocidad aproximada a los 30.000 millones (3×1010) de centímetros por segundo. La cantidad c2 representa el producto c×c, es decir:

3×1010 × 3×1010, ó 9×1020.

Por tanto, c2 es igual a 900.000.000.000.000.000.000. Así pues, una masa de un gramo puede convertirse, en teoría, en 9×1020 ergios de energía.

El ergio es una unida muy pequeña de energía que equivale a: “Unidad de trabajo o energía utilizado en el sistema c.g.s y actúa definida como trabajo realizado por una fuerza de 1 dina cuando actúa a lo largo de una distancia de 1 cm: 1 ergio = 10-7 julios”. La kilocaloría, de nombre quizá mucho más conocido, es igual a unos 42.000 millones de ergios. Un gramo de materia convertido en energía daría 2’2×1010 (22 millones) de kilocalorías. Una persona puede sobrevivir cómodamente con 2.500 kilocalorías al día, obtenidas de los alimentos ingeridos. Con la energía que representa un solo gramo de materia tendríamos reservas para unos 24.110 años, que no es poco para la vida de un hombre.

Emilio Silvera

Dic

23

¡Fisica! Siempre la Física

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

¡El Universo! ¿Sería eso lo que pasó?

Como nunca dejaremos a aprender cosas nuevas, de desvelar secretos de la Naturaleza, de seguir investigando en busca de “otras verdades”, de elaborar nuevos modelos y nuevas Teorías que nos acerquen, cada vez más a la realidad del mundo (ese es, de momento, nuestro cometido), estamos abocados a tratar de saber lo que no sabemos y que, no pocas veces, creemos que sabemos. Ya lo dijo Popper:

“Cuanto más profundizo en el saber de las cosas, más consciente soy de lo poco que sé. Mis conocimientos son limitados, mi ignorancia, es infinita“.

Lo que nos lleva a la versión moderna de aquel “Sólo se que no se nada” de Sócrates.

Las sustancias formadas por una sola clase de átomos se llaman elementos químicos. La palabra “átomo” procede del griego ατομος, que significa “indivisible” y el uso de la palabra “elemento” sugiere que se ha llegado a los ladrillos básicos con los que está formada la materia. De hecho, esta es la imagen que se tenía a mediados del siglo XIX cuando se acuñaron estos términos. Sin embargo, hoy sabemos que todo esto es falso, que los átomos se pueden dividir y que, de esta manera, los elementos han dejado de ser verdaderamente elementales. Los físicos continúan con esta nomenclatura aunque sea formalmente incorrecta, ya que, la costumbre, como dicen los juristas, no pocas veces rigen la jerga de las leyes.

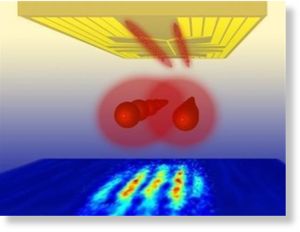

“La revolución de la mecánica cuántica empieza a materializarse, y el qubit es el principal protagonista. Siendo la unidad mínima de información de extraño mundo, permitirá procesar toda la información existente en segundos.” El futuro que nos aguarda es inimaginable y cada día que pasa aparecen nuevos logros tecnológicos que nos sitúan en otro mundo, otra sociedad, otras nuevas formas de vivir y de comprender.

Sí, son los electrones los que dan al átomo su forma esférica

A todo esto y hablando de los átomos, por fuerza, nos tenemos que acordar del electrón que da al átomo su esférica. Son partículas cargadas eléctricamente que se mueven alegremente alrededor del núcleo. El electrón es muy ligero: su masa es solamente 1/1.836 de la del núcleo más ligero (el hidrógeno). La carga eléctrica del electrón es de signo opuesto a la del núcleo, de manera que los electrones están fuertemente atraídos el núcleo y se repelen mutuamente. Si la carga eléctrica total de los electrones en un átomo iguala a la del núcleo, lo que generalmente se necesitan varios electrones, se dice que el átomo está en equilibrio o que es eléctricamente neutro.

Un experimento realizado por científicos del Centro de Viena para la Ciencia y Tecnología Cuánticas ha demostrado que, en el mundo cuántico, la transición hacia el equilibrio térmico es más interesante y más complicada de lo que se pensaba.

Según destaca el , publicado en ‘Science’, entre un ordenado inicial y un estado final estadísticamente mixto, puede emerger un “cuasi-estacionario estado intermedio”. Este estado intermedio ya exhibe algunas propiedades como el equilibrio, pero parte de las características del estado inicial permanecen visibles durante un período de tiempo muy largo.

El fenómeno se denomina “pre-termalización” y desempeña un papel importante en diversos procesos de no equilibrio en la física cuántica. Podría, por ejemplo, ayudarnos a comprender el estado del universo temprano.

La fuerza a la que obedecen los electrones, la denominada fuerza electrostática o de Coulomb, es matemáticamente bastante sencilla y, sin embargo, los electrones son los responsables de las importantes propiedades de los “enlaces químicos”. Esto se debe a que las leyes de movimiento de los electrones están regidas completamente por la “mecánica cuántica”, teoría que se completó a principios del siglo XX. Es una teoría paradójica y difícil de entender y explicar, pero al mismo tiempo es muy interesante, fantástica y revolucionaria. uno se introduce en las maravillas de la mecánica cuántica es como si hiciera un viaje a un universo que está situado fuera de este mundo nuestro, ya que, las cosas que allí se ven, desdicen todo lo que dicta nuestro sentido común de cómo tiene que ser el mundo que nos rodea.

Sincronización perfecta, ¡es una sinfonía!

No solamente los electrones, sino también los núcleos atómicos y los átomos en su conjunto obedecen y se rigen por la mecánica cuántica. La Física del siglo XX empezó exactamente en el año 1900, cuando el físico alemán Max Planck, escribió un artículo de ocho páginas y allí propuso una posible solución a un problema que había intrigando a los físicos durante años. Es el problema de la luz que emiten los cuerpos calentados a una cierta temperatura, y también la radiación infrarroja emitida, con menos intensidad, por los objetos más fríos.

Estaban bien aceptados entonces que esta radiación tenía un origen electromagnético y que se conocían las leyes de la naturaleza que regían estas ondas electromagnéticas. También se conocían las leyes para el frío y el calor, la así llamada “termodinámica”, o al menos eso parecía. Pero si usamos las leyes de la termodinámica para calcular la intensidad de la radiación, el resultado no tiene ningún sentido. Los cálculos nos dicen que se emitiría una cantidad infinita de radiación en el ultravioleta más lejano, y, luego, esto no es lo que sucede. Lo que se observa es que la intensidad de la radiación muestra un pico a una cierta longitud de onda característica, y que la intensidad disminuye tanto para las longitudes mayores como para las longitudes menores. Esta longitud característica es inversamente proporcional a la temperatura absoluta del objeto radiante (la temperatura absoluta se define por una escala de temperatura que empieza a 273 ºC bajo cero). Cuando a 1.000 ºC un objeto se pone al “rojo vivo”, el objeto está radiando en la zona de luz visible.

El espectro electromagnético se extiende la radiación de menor longitud de onda, como los rayos gamma y los rayos X, pasando por la luz ultravioleta, la luz visible y los rayos infrarrojos, hasta las ondas electromagnéticas de mayor longitud de onda, como son las ondas de radio. Se cree que el límite la longitud de onda más pequeña posible es la longitud de Planck mientras que el límite máximo sería el tamaño del Universo.

Lo que Planck propuso fue simplemente que la radiación sólo podía ser emitida en de un tamaño dado. La cantidad de energía de uno de esos paquetes, o cuantos, es inversamente proporcional a la longitud de la onda y, por lo tanto, proporcional a la frecuencia de la radiación emitida. La sencilla fórmula es:

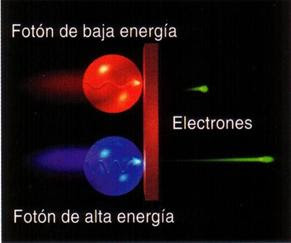

donde h es la constante de Planck (cuyo valor es 6,626 × 10−34 J·s). Sólo los fotones con una frecuencia alta (por encima de un valor umbral específico) podían provocar la corriente de electrones. Por ejemplo, la luz azul emitía unos fotones con una energía suficiente para arrancar los electrones del metal, mientras que la luz roja no. Una luz más intensa por encima del umbral mínimo puede arrancar más electrones, pero ninguna cantidad de luz por debajo del mismo podrá arrancar uno solo, por muy intenso que sea su brillo.

El esquema del Efecto fotoeléctrico nos muestra como la luz arranca electrones de la placa.

Poco tiempo después, en 1905, Einstein formuló esta teoría de una forma mucho más tajante: el sugirió que los objetos calientes no son los únicos que emiten radiación en de energía, sino que toda la radiación consiste en múltiplos de los paquetes de energía de Planck. El príncipe francés Louis-Victor de Broglie, dándole otra vuelta a la teoría, propuso que no sólo cualquier cosa que oscila tiene una energía, sino que cualquier cosa con energía se debe comportar como una “onda” que se extiende en una cierta región del espacio, y que la frecuencia, v, de la oscilación verifica la ecuación de Planck. Por lo tanto, los cuantos asociados con los rayos de luz deberían verse como una clase de partículas elementales: el fotón. Todas las demás clases de partículas llevan asociadas diferentes ondas oscilatorias de campos de fuerza.

El curioso comportamiento de los electrones en el interior del átomo, descubierto y explicado por el famoso físico danés Niels Bohr, se pudo atribuir a las ondas de De Broglie. Poco después, en 1926, Erwin Schrödinger descubrió escribir la teoría ondulatoria de Debroglie con ecuaciones matemáticas exactas. La precisión con la cual se podían realizar cálculos era asombrosa, y pronto quedó claro que el comportamiento de todos los objetos pequeños estaban exactamente determinados por la recién descubiertas “ecuaciones de onda cuánticas”.

Pocas dudas nos pueden caber a estas alturas de que la mecánica cuántica (de Planck) y, la Relatividad –tanto especial general- (de Einstein), además de ser las dos teorías más importantes de la Física de nuestro tiempo, funcionan de tal forma que uno, cuando profundiza en sus predicciones y las compara con lo que ocurre en el Universo, no por menos que, asombrarse, al comprobar como unas mentes humanas han sido capaces de llegar a estos profundos pensamientos que nos acerca a la realidad de la Naturaleza, al mismo tiempo que nos aleja de nuestra propia realidad.

Sí, están ahí pero, en realidad, no sabemos, a ciencia cierta, ni cómo se formaron las galaxias

¿Qué encontraremos cuando sea posible verificar la Teoría de cuerdas? ¿Qué hay más allá de los Quarks? ¿Sabremos alguna vez lo que es una singularidad? ¿Será verdad la existencia de esa materia oscura de la que tanto se habla? ¿Podremos al fín, encontrar esa fuente de energía que tanto necesita la Humanidad para dar ese segundo paso el futuro? ¿Tendremos, acaso, algún destino que no sea el de la irremisible extinción?

¡Preguntas! Preguntas y más preguntas que no podemos contestar. Es desesperante estar inmersos en inmenso océano de ignorancia. ¿Cuándo sabremos? El el epitafio que Hilbert ordenó esculpir en su Tumba, nos lo prometía: “Tenemos que saber, sabremos”. Si, ¿pero cuándo?

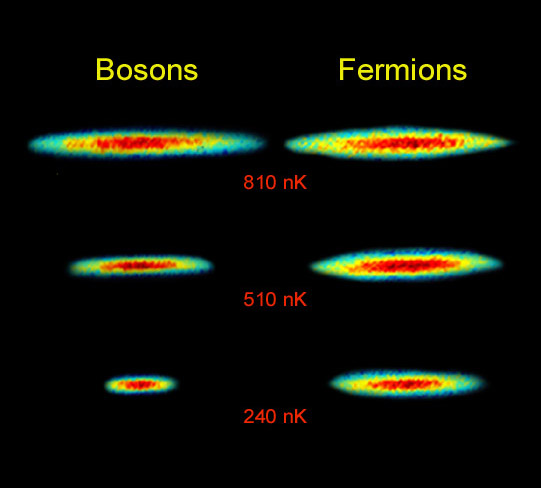

Lo cierto es que, las reglas de la mecánica cuántica tienen que ser aplicadas si queremos describir estadísticamente un sistema de partículas que obedece a reglas de ésta teoría en vez de las de la mecánica clásica. En estadística cuantica, los estados de energía se considera que están cuantizados. La estadística de Bose-Einstein se aplica si cualquier de partículas puede ocupar un estado cuántico dado. Dichas partículas (como dije antes) son los bosones que, tienden a juntarse.

Los bosones tienen un angular n h / 2p, donde n es cero o un entero y h es la constante de Planck. bosones idénticos, la función de ondas es siempre simétrica. Si solo una partícula puede ocupar un cuántico, tenemos que aplicar la estadística Fermi-Dirac y las partículas (como también antes dije) son los fermiones que tienen momento angular (n+½) h/2p y cualquier función de ondas de fermiones idénticos es siempre antisimétrica.

La mejor teoría explicar el mundo subatómico nació en 1928 cuando el teórico Paul Dirac combinó la mecánica cuántica con la relatividad especial para explicar el comportamiento del electrón. El resultado fue la mecánica cuántica relativista, que se transformó en un ingrediente primario en la teoría cuántica de campos. Con unas pocas suposiciones y ajustes, la teoría cuántica de campos ha probado ser suficientemente poderosa para formar la base del modelo estándar de las partículas y las fuerzas que rigen el universo.

La relación el espín y la estadística de las partículas está demostrada por el teorema espín-estadística. En un espacio de dos dimensiones es posible que existan partículas (o cuasipartículas) con estadística intermedia entre bosones y fermiones. Estas partículas se conocen con el de aiones; para aniones idénticos la función de ondas no es simétrica (un cambio de fase de+1) o antisimétrica (un cambio de fase de -1), sino que interpola continuamente entre +1 y -1. Los aniones pueden ser importantes en el análisis del efecto Hall cuántico fraccional y han sido sugeridos como un mecanismo para la superconductividad de alta temperatura.

Debido al principio de exclusión de Pauli no es imposible que dos fermiones ocupen el mismo espacio cuántico (al contrario de lo que ocurre con los bosones). Y, precisamente por eso, se degeneran electrones y neutrones dando lugar a la formación de estrellas enanas blancas y de neutrones que, encuentran la estabilidad frenando la fuerza de gravedad.

La condensación de Bose-Einstein es de importancia fundamental explicar el fenómeno de la superfluidez. A temperaturas muy bajas (del orden de 2×10-7k) se formar un condensado de Bose-Einstein, en el que varios miles de átomos forman una única entidad (un superátomo). efecto ha sido observado con átomos de rubidio y litio. Este efecto (condensación Bose-Einstein), ya habréis podido suponer, es llamado así en honor al físico Satyendra Naht Bose (1.894-1.974) y de Albert Einstein.

Más reciente es la obtención del Condensado de Bose-Einstein (BEC); en este caso las bases teóricas se postularon en la década de los 20 en manos de Satyendra Nath Bose y Albert Einstein. El primero describe ciertas reglas para determinar si dos fotones deberían considerarse idénticos o diferentes (Estadísticas de Bose) y Einstein aplica dichas reglas a los átomos intentando averiguar como se comportarían. Así, halla los efectos de que a muy bajas temperaturas los átomos están al mismo nivel cuántico produciendo fenómenos como la superfluidez o la superconductividad.

Distribución de momentos que confirma la existencia de un estado de agregación de la materia, el condensado de Bose-Einstein. obtenidos en un gas de átomos de rubidio, la coloración indica la cantidad de átomos a cada velocidad, con el rojo indicando la menor y el blanco indicando la mayor. Las áreas blancas y celestes indican las menores velocidades. A la izquierda se observa el diagrama inmediato anterior al condensado de Bose-Einstein y al centro el inmediato posterior. A la derecha se observa el diagrama luego de cierta evaporación, con la sustancia cercana a un condensado de Bose-Einstein puro. El pico no es infinitamente angosto debido al Principio de indeterminación de Heisenberg: dado que los átomos están confinados en una región del espacio, su distribución de velocidades posee necesariamente un cierto ancho mínimo. La distribución de la izquierda es para T > Tc (sobre 400 nanokelvins (nK)), la central para T < Tc (sobre 200 nK) y la de la derecha para T << Tc (sobre 50 nK).

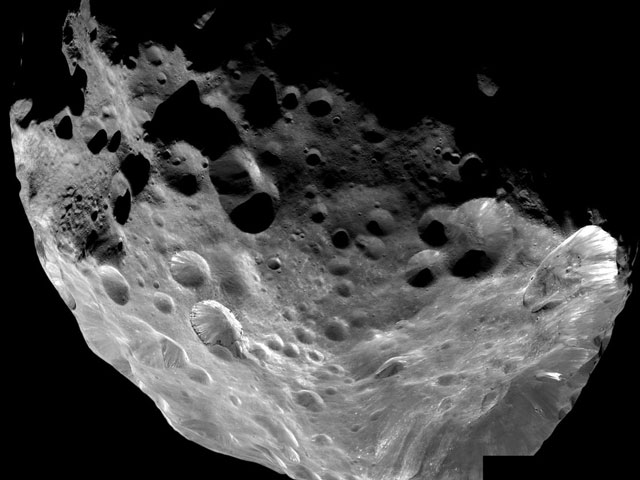

El puntito blanco del centro es la enana blanca

Las estrellas enanas blancas, de neutrones y los púlsares existen, precisamente, por el principio de exclusión de Pauli que, degenera electrones y neutrones cuando las estrellas masivas, al final de su existencia, explotan como Supernovas y´su masa se contraen sobre sí misma más y más. Si la estrella es demasiado masiva, entonces ni ese principio de exclusión puede frenar a la Gravedad y se convierte en un Agujero negro.

Así que, el principio de exclusión de Pauli tiene aplicación no sólo a los electrones, sino también a los fermiones; pero no a los bosones. Si nos fijamos en todo lo que estamos hablando aquí, nos daremos de que la mecánica cu´çantica es extraña y siendo fácil comprender como forma un campo magnético la partícula cargada que gira, no resulta tan fácil saber por qué ha de hacer lo mismo un neutrón descargado.

Lo cierto es que ocurre así. La prueba directa más evidente de ello es que cuando un rayo de neutrones incide sobre un hierro magnetizado, no se comporta de la misma que lo haría si el hierro no estuviese magnetizado. El magnetismo del neutrón sigue siendo un misterio; los físicos sospechan que contiene cargas positivas y negativas equivalentes a cero, aunque por alguna razón desconocida, lograr crear un campo magnético cuando gira la partícula.

emilio silvera

Dic

22

¿La Mecçanica Cuántica? ¡Una gran Disciplina!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Universo, Ciencia, Consciencia…¡Futuro!

El “principio antrópico”

¿Estaría programada la presencia de los seres vivos inteligentes en el Universo?

Por fuerza la cosmología conduce a cuestiones fronterizas entre ciencia experimental, filosofía y religión. No es solo el caso de los sabios antiguos. También los físicos de hoy se plantean preguntas de esa clase, sobre todo a propósito del llamado “principio antrópico”. A partir de los conocimientos actuales, este principio señala que las leyes y magnitudes físicas fundamentales parecen cuidadosamente afinadas para que la formación y el desarrollo del universo pudieran dar lugar a la vida en la Tierra y en otros planetas idóneos para acogerla.

El universo de las partículas es fascinante. Cuando las partículas primarias chocan con átomos y moléculas en el aire, aplastan sus núcleos y producen toda clase de partículas secundarias. En esta radiación secundaria (aún muy energética) la que detectamos cerca de la Tierra, por los globos enviados a la atmósfera superior, han registrado la radiación primaria. Esa radiación, al chocar con los elementos que envuelven nuestro planeta y su atmósfera, en algunos lugares de la Tierra producen las fascinantes auroras boreales y australes.

Esta espectacular aurora boreal fue captada sobre la aldea de Ersfjordbotn cerca de Tromso, en el norte de Noruega, en el amanecer del 21 de febrero. Las auroras son causadas por la interacción entre las partículas energéticas cargadas del Sol y las moléculas de gas en la atmósfera superior de la Tierra, a unos 100 kilómetros de altura.El viento solar exhalado por el sol con especial volumen hace poco a una velocidad de aproximadamente 500 kilómetros por segundo colaboró en la espectacularidad en este caso.

Al llegar a la Tierra, las partículas cargadas son atraídas por el campo magnético terrestre en los polos, donde chocan con las moléculas de gas en la atmósfera superior, haciendo que emitan luz.

El físico estadounidense Robert Andrews Millikan, que recogió una gran cantidad de información acerca de esta radiación (y que le dio el nombre de rayos cósmicos), decidió que debería haber una clase de radiación electromagnética. Su poder de penetración era tal que, parte del mismo, atravesaba muchos centímetros de plomo. Para Millikan, esto sugería que la radiación se parecía a la de los penetrantes rayos gamma, pero con una longitud de onda más corta.

Otros, sobre todo el físico norteamericano Holly Compton, no estaban de acuerdo en que los rayos cósmicos fuesen partículas. Había un medio para investigar este asunto; si se trataba de partículas cargadas, deberían ser rechazadas por el campo magnético de la Tierra al aproximarse a nuestro planeta desde el espacio exterior. Compton estudió las mediciones de la radiación cósmica en varias latitudes y descubrió que en realidad se curvaban con el campo magnético: era más débil cerca del ecuador magnético y más fuerte cerca de los polos, donde las líneas de fuerza magnética se hundían más en la Tierra.

rayos cósmicos contra las células cuando se producen grandes erupciones solares

Las partículas cósmicas primarias, cuando entran en nuestra atmósfera, llevan consigo unas energías fantásticas, muy elevadas. En general, cuanto más pesado es el núcleo, más raro resulta entre las partículas cósmicas. Núcleos tan complejos como los que forman los átomos de hierro se detectaron con rapidez; en 1.968, otros núcleos como el del uranio. Los núcleos de uranio constituyen sólo una partícula entre 10 millones. También se incluirán aquí electrones de muy elevada energía.

Ahora bien, la siguiente partícula inédita (después del neutrón) se descubrió en los rayos cósmicos. A decir verdad, cierto físico teórico había predicho ya este descubrimiento. Paul Adrien Dirac había aducido, fundándose en un análisis matemático de las propiedades inherentes a las partículas subatómicas, que cada partícula debería tener su antipartícula (los científicos desean no sólo que la naturaleza sea simple, sino también simétrica). Así pues, debería haber un antielectrón, salvo por su carga que sería positiva y no negativa, idéntico al electrón; y un antiprotón, con carga negativa en vez de positiva.

En 1.930, cuando Dirac expuso su teoría, no llamó demasiado la atención en el mundo de la ciencia. Pero, fiel a la cita, dos años después apareció el antielectrón. Por entonces, el físico americano Carl David Anderson trabajaba con Millikan en un intento por averiguar si los rayos cósmicos eran radiación electromagnética o partículas. Por aquellas fechas, casi todo el mundo estaba dispuesto a aceptar las pruebas presentadas por Compton, según las cuales, se trataría de partículas cargadas; pero Millikan no acababa de darse por satisfecho con tal solución.

Arriba una imagen que ilustra a la Heliosfera, la parte del espacio que está directamente afectada por el Sol a través del viento solar. Es la estructura magnética del viento solar quien hace de escudo contra las enérgicas partículas de los rayos cósmicos. Las variaciones en el viento solar (o en la actividad solar) cambia el flujo de los rayos cósmicos que llegan hasta la Tierra.

Anderson se propuso averiguar si los rayos cósmicos que penetraban en una cámara de ionización se curvaban bajo la acción de un potente campo magnético. Al objeto de frenar dichos rayos lo suficiente como para detectar la curvatura, si la había, puso en la cámara una barrera de plomo de 6’35 mm de espesor. Descubrió que, cuando cruzaba el plomo, la radiación cósmica trazaba una estela curva a través de la cámara; y descubrió algo más. A su paso por el plomo, los rayos cósmicos energéticos arrancaban partículas de los átomos de plomo. Una de esas partículas dejó una estela similar a la del electrón. ¡Allí estaba, pues, el antielectrón de Dirac! Anderson le dio el nombre de positrón. Tenemos aquí un ejemplo de radiación secundaria producida por rayos cósmicos. Pero aún había más, pues en 1.963 se descubrió que los positrones figuraban también entre las radiaciones primarias.

Abandonado a sus propios medios, el positrón es tan estable como el electrón (¿y por qué no habría de serlo si el idéntico al electrón, excepto en su carga eléctrica?). Además, su existencia puede ser indefinida. Ahora bien, en realidad no queda abandonado nunca a sus propios medios, ya que se mueve en un universo repleto de electrones. Apenas inicia su veloz carrera (cuya duración ronda la millonésima de segundo), se encuentra ya con uno.

Primer Congreso Solvay (1911), financiado por el “rey de la sosa cáustica”, el belga Ernest Solvay y en el que tomaron parte todas las luminarias de la ciencia. Nernst, Poincaré, Langevin, Rutherford, Lorentz, Planck y Marie Curie están en primera fila de la fotografía y no es difícil reconocer a Einstein junto a ellos. Terminado el Congreso, Marie relató a Louis de Broglie los debates sobre el fotón y su naturaleza dual, de onda y partícula. De Broglie, ante los resultados de Compton, se preguntaba en la tesis doctoral que presentó en 1924 si acaso la inversa del efecto Compton sería cierta: si las ondas son partículas ¿no serán ondas las partículas? Al recibir el premio Nobel en 1929, Louis de Broglie diría: “Para ambas, materia y radiación, la luz en especial, es necesario introducir los conceptos de partícula y de onda a la vez. En otras palabras, se tiene que suponer siempre la existencia de partículas acompañadas por ondas.”

Así, durante un momento relampagueante quedaron asociados el electrón y el positrón; ambas partículas girarán en torno a un centro de fuerza común. En 1.945, el físico americano Arthur Edwed Ruark sugirió que se diera el nombre de positronio a este sistema de dos partículas, y en 1.951, el físico americano de origen austriaco Martin Deutsch consiguió detectarlo guiándose por los rayos gamma característicos del conjunto.

Pero no nos confundamos, aunque se forme un sistema positronio, su existencia durará, como máximo, una diezmillonésima de segundo. El encuentro del electrón-positrón provoca un aniquilamiento mutuo; sólo queda energía en forma de radiación gamma. Ocurre pues, tal como había sugerido Einstein: la materia puede convertirse en energía y viceversa. Por cierto, que Anderson consiguió detectar muy pronto el fenómeno inverso: desaparición súbita de rayos gamma para dar origen a una pareja electrón-positrón. Este fenómeno se llama producción en pareja. Anderson compartió con Hess el premio Nobel de Física de 1.936.

1936. Victor Franz Hess & Carl David Anderson

Poco después, los Joliot-Curie detectaron el positrón por otros medios, y al hacerlo así realizaron, de paso, un importante descubrimiento. Al bombardear los átomos de aluminio con partículas alfa, descubrieron que con tal sistema no sólo se obtenían protones, sino también positrones. Cuando suspendieron el bombardeo, el aluminio siguió emitiendo positrones, emisión que sólo con el tiempo se debilitó. Aparentemente habían creado, sin proponérselo, una nueva sustancia radiactiva. He aquí la interpretación de lo ocurrido según los Joliot-Curie: cuando un núcleo de aluminio absorbe una partícula alfa, la adición de los dos protones transforma el aluminio (número atómico 13) en fósforo (número atómico 15). Puesto que las partículas alfa contienen cuatro nucleones en total, el número masivo se eleva 4 unidades, es decir, del aluminio 27 al fósforo 31. Ahora bien, si al reaccionar se expulsa un protón de ese núcleo, la reducción en una unidad de sus números atómicos y masivos hará surgir otro elemento, o sea, el silicio 30.

Arriba teneis el proceso conocido como triple alfa: Una maravilla de la que se vale la Naturaleza para fabricar el Carbono en las estrellas.

Puesto que la partícula alfa es el núcleo del helio, y un protón es el núcleo del hidrógeno, podemos escribir la siguiente ecuación de esta reacción nuclear:

aluminio 27 + helio 4 = silicio 30 + hidrógeno 1

Nótese que los números másicos se equilibran:

27 + 4 = 30 + 1

Adentrarse en el universo de las partículas que componen los elementos de la tabla periódica, y en definitiva, la materia conocida, es verdaderamente fantástico.

Joliot – Curie

Tan pronto como los Joliot-Curie crearon el primer isótopo radiactivo artificial, los físicos se lanzaron en tropel a producir tribus enteras de ellas. En realidad, las variedades radiactivas de cada elemento en la tabla periódica son producto de laboratorio. En la moderna tabla periódica, cada elemento es una familia con miembros estables e inestables, algunos procedentes de la naturaleza, otros sólo del laboratorio. Por ejemplo, el hidrógeno presenta tres variedades: en primer lugar, el corriente, que tienen un solo protón. En 1.932, el químico Harold Urey logró aislar el segundo. Lo consiguió sometiendo a lenta evaporación una gran cantidad de agua, de acuerdo con la teoría de que los residuos representarían una concentración de la forma más pesada del hidrógeno que se conocía, y, en efecto, cuando se examinaron al espectroscopio las últimas gotas de agua no evaporadas, se descubrió en el espectro una leve línea cuya posición matemática revelaba la presencia de hidrógeno pesado.

Núcleos de hidrógeno pesado. … También como “hidrógeno pesado”. El deuterio es un combustible fundamental de las estrellas, durante la fusión nuclear dos núcleos de deuterio se …

El núcleo de hidrógeno pesado está constituido por un protón y un neutrón. Como tiene un número másico de 2, el isótopo es hidrógeno. Urey llamó a este átomo deuterio (de la voz griega deutoros, “segundo”), y el núcleo deuterón. Una molécula de agua que contenga deuterio se denomina agua pesada, que tiene puntos de ebullición y congelación superiores al agua ordinaria, ya que la masa del deuterio es dos veces mayor que la del hidrógeno corriente. Mientras que ésta hierve a 100º C y se congela a 0º C, el agua pesada hierve a 101’42º C y se congela a 3’79º C. El punto de ebullición del deuterio es de -23’7º K, frente a los 20’4º K del hidrógeno corriente. El deuterio se presenta en la naturaleza en la proporción de una parte por cada 6.000 partes de hidrógeno corriente. En 1.934 se otorgó a Urey el premio Nobel de Química por su descubrimiento del deuterio.

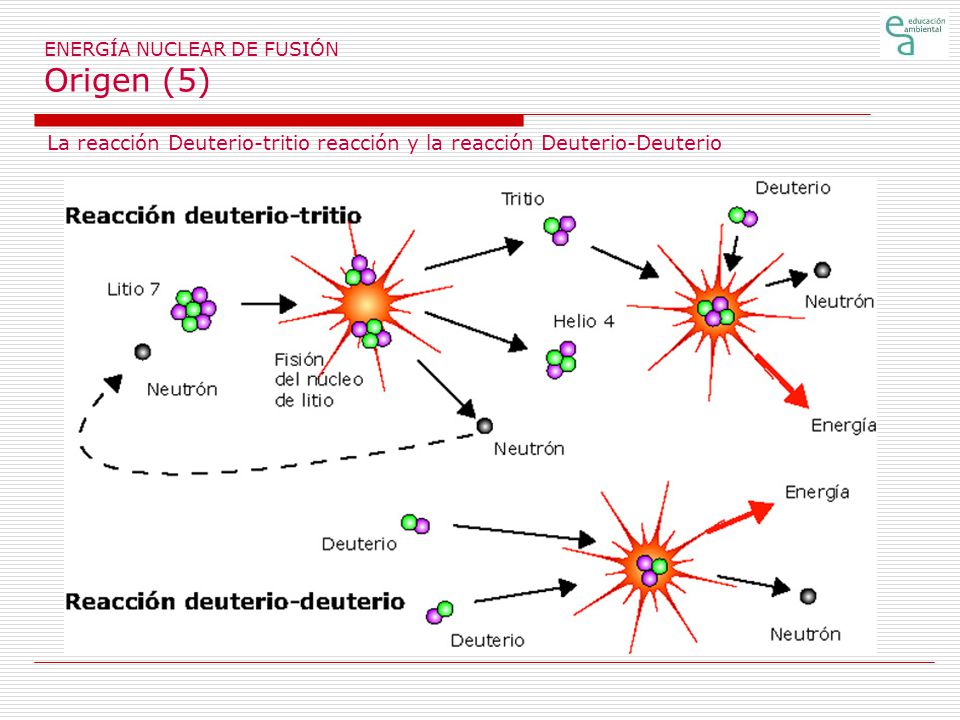

Reacciones de fusión nuclear

Reacciones de deuterio – tritio:

Esta es una de las dos reacciones de fusión nuclear más básicas que se conocen: en ella intervienen como reactivos un núcleo de deuterio (D) y uno de tritio (T). Si dichos reactivos se aproximan entre sí a velocidades adecuadas, se unen formando un núcleo compuesto (centro), que es inestable y se desintegra rápidamente produciendo un núcleo de helio (He) y un neutrón. El proceso de formación del núcleo compuesto se denomina fusión nuclear (de deuterio y tritio en el caso que estamos considerando). El tritio es radioactivo, el deuterio no. Esta es una de las dos reacciones de fusión nuclear más básicas que se conocen: en ella intervienen como reactivos un núcleo de deuterio.

El deuterio resultó ser una partícula muy valiosa para bombardear los núcleos. En 1934, el físico australiano Marcus Lawrence Edwin Oliphant y el austriaco P. Harteck atacaron el deuterio con deuterones y produjeron una tercera forma de hidrógeno, constituido por un protón y dos neutrones. La reacción se planteó así:

hidrógeno 2 + hidrógeno 2 = hidrógeno 3 + hidrógeno 1

Este nuevo hidrógeno superpesado se denominó tritio (del griego tritos, “tercero”); su ebullición a 25º K y su fusión a 20’5º K.

Reacciones de deuterio – deuterio:

En ella, dos núcleos de deuterio se fusionan formando un núcleo compuesto inestable (centro) que rápidamente decae siguiendo uno de dos posibles caminos: el ilustrado en la parte superior, que produce un núcleo de helio y un neutrón; y el indicado en la parte de abajo, donde se produce un núcleo de tritio y un protón. El camino que seguirá el núcleo compuesto para decaer, es impredecible con exactitud. Sólo puede afirmarse que el 50% de las veces, la naturaleza sigue el de arriba, y el 50% restante, el de abajo.

Reactor de fusión Tokamaka

Instalaciones donde se produce la fusión nuclear: Lograr fusión nuclear en la Tierra es complicado: se requieren reactores especiales.

Como es mi costumbre, me desvío del tema y sin poderlo evitar, mis ideas (que parecen tener vida propia), cogen los caminos más diversos. Basta con que se cruce en el camino del trabajo que realizo un fugaz recuerdo; lo sigo y me lleva a destinos distintos de los que me propuse al comenzar. Así, en este caso, me pasé a la química, que también me gusta mucho y está directamente relacionada con la física; de hecho son hermanas: la madre, las matemáticas, la única que finalmente lo podrá explicar todo.