Jun

23

¡La Física Cuántica! ¿Llegaremos a comprenderla?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (7)

Comments (7)

Es realmente maravilloso que podamos haber llegado, en el extremo de las escalas, hasta esos mundos fantáscitos que nos proporcionan los “universos” de lo muy pequeño y de lo muy grande. Lo más cotidiano para nosotros es lo que se encuentra en el macro mundo, lo que se interrelaciona directamente con nosotros, lo que podemos ver y tocar. Sin embargo, ahí está ese otro “mundo” que se nos escapa a los sentidos pero que es, tan real como el otro. Es el espacio que describe la mecánica cuántica y que nos habla de maravillas y procesos asombrosos que son, tan reales como los que contemplamos a nuestro alrededor.

No podemos ver todo lo que existe. Sin embargo, no por estar fuera de nuestra visión deja de existir, ahí está formando parte de ese otro mundo que se nos escapa, al que nuestras percepciones directas, nuestros sentidos, no pueden llegar pero que henmos podido alcanzar a “ver” mediante los ingenios que hemos podido inventar para acceder, de manera indirecta, a ese espacio que se escapa de nosotros por su pequeñez y que, no por ello deja de tener una gran importancia para nosotros y para todo el mundo que nos rodea, de hecho, de esas “pequeñas cositas” resulta estar hecho el Universo. He leído por ahí:

“La mayor parte de la gente desconoce que la mecánica cuántica, es decir, el modelo teórico y  práctico dominante hoy día en el ámbito de la ciencia, ha demostrado la interrelación entre el pensamiento y la realidad. Que cuando creemos que podemos, en realidad, podemos. Sorprendentes experimentos en los laboratorios más adelantados del mundo corroboran esta creencia.

práctico dominante hoy día en el ámbito de la ciencia, ha demostrado la interrelación entre el pensamiento y la realidad. Que cuando creemos que podemos, en realidad, podemos. Sorprendentes experimentos en los laboratorios más adelantados del mundo corroboran esta creencia.

El estudio sobre el cerebro ha avanzado mucho en las últimas décadas mediante las tomografías.

Conectando electrodos a este órgano, se determina donde se produce cada una de las actividades de la mente. La fórmula es bien sencilla: se mide la actividad eléctrica mientras se produce una actividad mental, ya sea racional, como emocional, espiritual o sentimental y así se sabe a qué área corresponde esa facultad.

Estos experimentos en neurología han comprobado algo aparentemente descabellado: cuando vemos un determinado objeto aparece actividad en ciertas partes de nuestro cerebro…. pero cuando se exhorta al sujeto a que cierre los ojos y lo imagine, la actividad cerebral es ¡idéntica! Entonces, si el cerebro refleja la misma actividad cuando “ve” que cuando “siente”, llega la gran pregunta: ¿cuál es la Realidad?

“La solución es que el cerebro no hace diferencias entre lo que ve y lo que imagina porque las mismas redes neuronales están implicadas; para el cerebro, es tan real lo que ve como lo que siente”, afirma el bioquímico y doctor en medicina quiropráctica, Joe Dispenza en el libro “¿y tú qué sabes?”. En otras palabras, que fabricamos nuestra realidad desde la forma en que procesamos nuestras experiencias, es decir, mediante nuestras emociones.”

La mecánica cuántica que conocemos en nuestros días se ha conseguido gracias a la suma de muchos esfuerzos y sería preciso entrar en la historia pasada de esta disciplina que investiga como es el mundo, como funciona la Naturaleza, para saber como se llegó a moldear esos conocimientos que nos llevan al “universo” de lo infinitesimal, de los objetos más pequeños pero que, sin ellos, no podrían existir los más grandes. Ninguna duda nos puede caber ya sobre el hecho cierto de que, la mecánica cuántica, es una de las ramas principales de la Física y está entre uno de los más grandes avances del pasado siglo XX en lo que al conocimiento humano del mundo se refiere. Nos explica el comportamiento de la materia-energía y, de hecho, sin esos conocimientos hubiera sido imposible alcanzar el nivel tecnológico del que hoy podemos disfrutar.

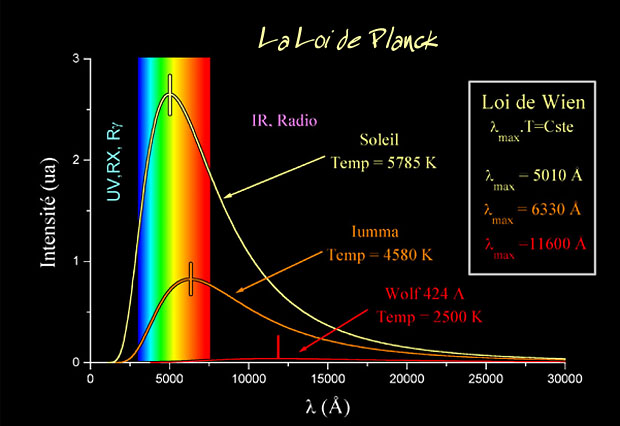

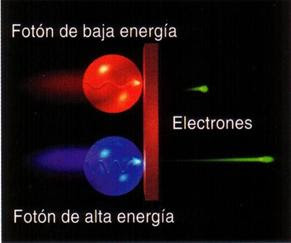

Un día de 1900, Max Planck escribió un artículo de ocho páginas que cambió el mundo de la física. En él nos habló del cuanto, unos pequeños paquetes de energía que eran emitidos por los cuerpoos calientes y, dejó sembrada la semilla de un árbol que no ha dejado de crecer desde entonces. Más tarde llegó Einstein que inspirado en aquel trabajo de Planck, fue un poco más allá y realizó aquel famoso trabajo conocido del Efecto fotoeléctrico. Desde entonces, los físicos no dejaron de ampliar y desarrollar las bases de nuestros conocimientos actuales.

La estructura de las fuerzas familiares como la Gravedad y el magnetismo fueron desarrolladas relativamente temprano. Todos conocemos la historia de Newton y sus trabajos y que, mucho después, dejó perfeccionado Einstein en relación a la fuerza gravitatoria. Las fuerzas electromagnéticas se determinaron también bastante pronto pero, no fue hasta 1927 cuando Dirac realizaría los primeros cálculos cuánticos de interacción de la radiación con la materia y en los años cuarenta y cincuenta gracias a los trabajos de, entre otros, Schwinger y Feynman, se construyó una teoría (electrodinámica cuántica) compatible con los principios básicos de la relatividad y la mecánica cuántica y con una capacidad predictiva asombrosa. Se han conseguido comprender éstos fenómenos, podríamos decir que al nivel de un acuerdo entre los cálculos teóricos y los resultados experimentales de más de diez cifras decimales, y, tal cosa, amigos míos, es un inmenso logro de la mente humana.

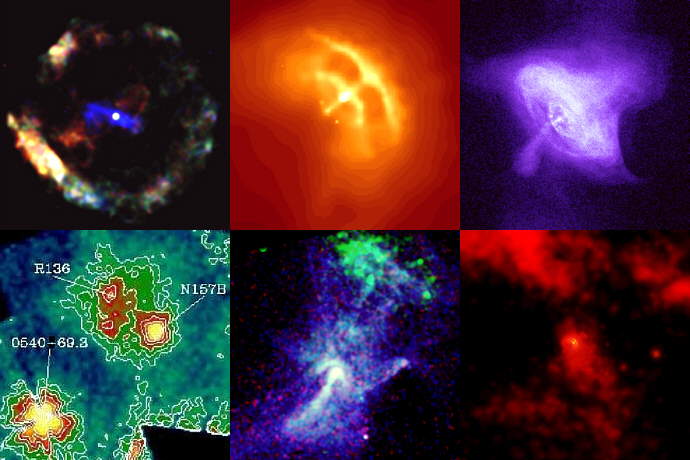

No podríamos comprender el macrocosmos sin haber descubierto antes que, en realidad, está fuertemente ligado al microcosmos, a la física subnuclear, ese mundo de lo muy pequeño que, cuando se profundiza en él, nos habla del futuro dinámico del universo y se comienza a ver con claridad como aquellas cuestiones antes no resultas, están ahí, ante nuestros ojos y para que nuestras mentes la puedan entender gracias a la dinámica activa de ese ámbito que resulta ser el campo de las partículas elementales y las fuerzas que con ellas actúan.

Las interacciones débiles y las interacciones fuertes, por su profunda lejanía, tardaron en ser comprendidas. Está claro que, el corto alcance en el que se desarrollan imposibilitaron bastante su hallazgo. Antes, los físicos no tenían acceso al mundo subatómico al que más tarde pudieron entrar de la mano de los microscopios electrónicos, los grandes aceleradores y otros ingenios de increíble alcance y precisición. Así que, a diferencia de lo que pasó con la Gravedad y el electromagnetismo, no se partía de una teoría clásica bien establecida, de manera que se tuvo que construir directamente, una teoría cuántica y relativista de ambas interacciones: la interacción nuclear débil y la interacción nuclear fuerte.

La empresa de comprender aquellas interacciones fue ardua y se tuvo que esperar hasta los año setenta para encontrar las teorías correctas y completas. En estos años se produjeron, primero la demostración por el holandés Gerard ´t Hooft, culminando los trabajos de su mentor, el también holandés, Martinus Veltman, de la autoconsistencia (llamada, por motivos técnicos, renormalización) de las teorías propuestas fenomenológicamente por Glashow, Wienberg y Salam para interacciones débiles; y segundo, el descubrimiento de la propiedad de libertad asintótica (por Gross, Wilczek y Plotzer) de las interacciones fuertes. Ambos grupos consiguieron el Nobel, pero los tres últimos no vieron premiados sus esfuerzos hasta 30 años después, en 2004, cuando se había comprobado de manera suficiente la veracidad de sus predicciones sobre la libertad de los Quarks en su confinamiento, cuando éstos, están juntos y los Gluones, se comportan como si no estuvieran allí, sólo actúan cuando tratan de separse.

En 1973, Wilczek, un estudiante graduado trabajando con David Gross en la Universidad de Princeton, descubrió la libertad asintótica que afirma que mientras más próximos estén los quarks menor es la interacción fuerte entre ellos; cuando los quarks están extremadamente próximos la interacción nuclear entre ellos es tan débil que se comportan casi como partículas libres.

Estosd avances hicieron posible obtener teorías consistentes con la relatividad y la mecánica cuántica de ambos tipos de interacciones; teorías que, además han superado con éxito las muchas confrontaciones experimentales que han sido realizadas hasta nuestros días. Aunque no hay ni cálculos teóricos, ni resultados experimentales tan exactos como en el caso de la electrodinámica cuántica, es cierto que el nivel de precisión de los cálculos con interacciones débiles llegan a cuatro y más cifras significativas y, para interacciones fuertes, estamos alcanzando el nivel del uno por ciento.

La Interacción gravitatoria que se deja notar en las grandes estructructuras se hace presente y se deja sentir, podemos ver como funciona y cuáles son sus consecuencia. Sin embargo, en el mundo de lo muy pequeño, esta interacción, continúa siendo la cenicienta en lo que se refiere a la comprensión de la estructura microscópica y la incidencia que la interacción gravitatoria pueda tener ahí y, curiosamente, es la interacción que se conoce desde hace mucho tiempo y sabemos, perfectamente de su funcionamiento en ese ámbito de lo muy grande pero, hace mutis por el foro cuando nos acercamos al mundo de las partículas, de la mecánica cuántica. Por eso se habla tanto de que necesitamos una teoría cuántica de la gravedad.

No tenemos información alguna de la fuerza de Gravedad a nivel experimental sobre la interacción gravitatoria a cortas distancias, donde sólo se puede llegar a través de inmensas energías. A lo más que hemos podido llegar es a experimentos del tipo realizado por Eötvös, midiendo la interacción gravitatoria entre dos cuerpos a distancias del orden del centímetro: las interacciones gravitatorias entre partículas elementales (quarks, electrones o incluso núcleos) es tan minúscula que son pocas las esperanzas de poderlas medir…por ahora ni en muchom tiempo futuro, y, siendo así (que lo es), nos tenemos que dedicar a emitir conjeturas y a especular con lo que podría ser.

En el siglo XIX se consiguió uno e los logros más impresionantes que nunca pudo alcanzar la Humanidad. ¡La comprensión de los fenómenos electromagnéticos. Comprensión en la que participaron (como casi siempre) muchos científicos, entre los que podemos destacar a dos británicos: el inglés Muchael Faraday, responsable de una buena parte de la investigación y de los conceptos experimentales (de él es el concepto de campo que tan importante sería para la Física), y, el escocés James Clerk Maxwell al que le debemos la síntesis teórica que condensó en unas pocas ecuaciones fundamentales, de las propiedades de las interacciones electromagnéticas a nivel clásico, esto es, macroscópico.

Los fenómenos electromagnéticos tal y como se entendían a finales del siglo XIX, se suponían debidos a la fuerza que una carga eléctrica ejerce sobre otra: tanto si las cargas son estáticas (y entonces la fuerza viene dada por la conocida ley de Coulomb) como si están en movimiento, situación en la que se generan campos magnéticos. Las vibraciones de estos campos electromagnéticos se suponían propagándose por el éter (el “éter luminífero”) y la luz se identificaba como un caso particular de estas vibraciones electromagnéticas. La corriente eléctrica se interpretaba como una especie de fluido: recuérdese que, todavía en 1896, Lord Kelvin defendía esta naturaleza continua de la electricidad.

Lo que supuso el descubrimiento de la luz eléctrica para la Humanidad, aunque ahora lo podamos ver como cosa trivial y cotidiana, en realidad vino a cambiar el mundo que se vio de pronto, sacado bruscamente de la penunmbra para sumergirse en la más maravillosa claridad del día artificial. Aquello supuso un cambio enorme para muchos de los ámbitos sociales en las ciudades y, no digamos, más tarde, en el de los hospitales, laboratorios y también en el más cotidiano mundo doméstico.

Está claro que la luz es algo tan importante enn nuestras vidas que, sin ella, nos encontramos desamparados, desnudos y, si nos referimos a la natural, la que nos manda el Sol, la cosa sería más grave ya que, sin ella, no podríamos estar aquí. De todo esto, como de cualquiera de los temas de Física que pudiéramos escoger al azar, nos podríamos estar hablando durante años…¡es tan fascinante! ¡son tan maravillosos! todos esos conocimientos que, de alguna manera, nos acercan a que podamos comprender en funcionamiento del mundo y nos cuentan el por qué ocurren las cosas de la, manera en que la vemos que pasan. Muchas son las historias que se podrían contar de todos estos sucesos que, por el camino de los descubrimientos tuvimos que recorrer.

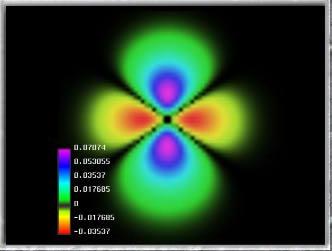

La teoría cuántica, recordémoslo, afirma que para todo objeto existe una función de onda que mide la probabilidad de encontrar dicho objeto en un cierto punto del espacio y del tiempo. La teoría cuántica afirma también que nunca se conoce realmente el estado de una partícula hasta que se haya hecho una observación. Antes de que haya una medida, la partícula puede estar en uno de entre una diversidad de estados, descritos por la función de onda de Schrödinger. Por consiguiente, antes de que pueda hacerse una observación o medida, no se puede conocer realmente el estado de la partícula. De hecho, la partícula existe en un estado ultramundano, una suma de todos los estados posibles, hasta que se hace una medida.

Cuando esta idea fue propuesta por primera vez por Niels Bohr y Werner Heisemberg, Einstein se revolvió contra ella. “¿Existe la luna sólo porque la mira un ratón?“, le gustaba preguntar. Según la teoría cuántica, en su más estricta interpretación, la Luna, antes de que sea observada, no existe realmente tal como la conocemos.

“La Luna puede estar, de hecho, en uno cualquiera de entre un número infinito de estados, incluyendo el estado de estar en el cielo, de estar explotando, o de no estar allí en absoluto. Es el proceso de medida que consiste en mirarla el que decide que la Luna está girando realmente alrededor de la Tierra“.

Decía Einstein con ironía.

Edwin Schrödinger, autor de la ecuación con su función de onda, se disgustó con estas interpretaciones de su ecuación. Para demostrar lo absurdo de la situación creada, Schrödinger colocó un gato imaginario en una caja cerrada. El gato estaba frente a una pistola, que está conectada a un contador Geiger, que a su vez está conectado a un fragmento de uranio. El átomo de uranio es inestable y sufrirá una desintegración radiactiva. Si se desintegra un núcleo de uranio, será detectado por el contador Geiger que entonces disparará la pistola, cuya bala matará al gato.

Para decidir si el gato está vivo o muerto, debemos abrir la caja y observar al gato. Sin embargo, ¿cuál es el estado del gato antes de que abramos la caja? Según la teoría cuántica, sólo podemos afirmar que el gato está descrito por una función de onda que describe la suma de un gato muerto y un gato vivo.

Para Schrödinger, la idea de pensar en gatos que no están ni muertos ni vivos era el colmo del absurdo, pero la confirmación experimental de la mecánica cuántica nos lleva inevitablemente a esta conclusión. Hasta el momento, todos los experimentos han verificado, favorablemente, la teoría cuántica.

La paradoja del gato de Schrödinger es tan extraña que uno recuerda a menudo la reacción de Alicia al ver desaparecer el gato de Cheshire en el centro del cuento de Lewis Carroll: “Allí me verás“, dijo el Gato, y desapareció, lo que no sorprendió a Alicia que ya estaba acostumbrada a observar cosas extrañas en aquel lugar fantástico. Igualmente, los físicos durante años se han acostumbrados a ver cosas “extrañas” en la mecánica cuántica.

La Mecánica cuántica, es , más fascinante el el Pais de las Maravillas de Alicia

Existen varias maneras de abordar esta dificultad de lo incomprensible en mecánica cuántica. En primer lugar, podemos suponer que Dios existe. Puesto que todas las “observaciones” implican un observador, entonces debe haber alguna “conciencia” en el universo. Algunos físicos como el premio Nobel Eugene Wigner, han insistido en que la teoría cuántica prueba la existencia de algún tipo de conciencia cósmica universal.

La segunda forma de tratar la paradoja es la preferida por la gran mayoría de los físicos en activo: ignorar el problema.

El físico Richard Feynman dijo en cierta ocasión: “Creo que es justo decir que nadie comprende la mecánica cuántica. No siga diciéndose a sí mismo, si puede evitarlo, “¿pero cómo puede ser así?” porque usted se meterá “hasta el fondo” en un callejón sin salida del que nadie ha escapado. Nadie sabe como puede ser eso“. De hecho, a menudo se ha dicho que de todas las teorías propuestas en el siglo XX, la más absurda es la teoría cuántica. Algunos dicen que la única cosa que la teoría tiene a su favor es que “es indudablemente correcta”.

¿Siempre será parte del misterio?

Sin embargo, existe una tercera forma de tratar esta paradoja, denominada teoría de los muchos universos. Esta teoría (como el principio antrópico) no gozó de mucho favor en la última década, pero está siendo revitalizada por la función de onda del universo de Stephen Hawking.

Pero, bueno… ¿cómo he llegado hasta aquí? Es cierto que… ¡Los senderos de la Física te pueden llevar a tántos sitios…!

emilio silvera

Jun

23

Velocidades increíbles

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (4)

Comments (4)

El núcleo desnudo

Si bien existe confusión e intriga acerca de su uso y factibilidad, la computación cuántica no es un sueño. De hecho, muchos expertos la ven como inevitable. En los computadores tradicionales, el procesamiento paralelo divide una tarea en partes y las delega a procesadores separados. La computación cuántica hace mas o menos lo mismo, solo que el procesamiento ocurre a nivel subatómico, donde rigen las leyes de la mecánica cuántica.

Mientras que un bit magnético tradicional puede representar solo un 1 o un 0, los bits cuánticos, o “qubits”, consistentes de atomos y partículas subatómicas ofrecen una gama de posibilidades exóticas. Un computador cuántico puede guardar datos en el espín de los electrónes, o en la posición de un cierto electrón. Un qubit, por ejemplo, puede ser 0, 1 y 0 y 1 al mismo tiempo, permitiendo la construcción de procesadores inmensamente más rápidos que los procesadores tradicionales.

En el centro del átomo se encuentra un pequeño grano compacto aproximadamente 100.000 veces más pequeño que el propio átomo: el núcleo atómico. Su masa, e incluso más aún su carga eléctrica, determinan las propiedades del átomo del cual forma parte. Debido a la solidez del núcleo parece que los átomos, que dan forma a nuestro mundo cotidiano, son intercambiables entre sí, e incluso cuando interaccionan entre ellos para formar sustancias químicas (los elementos). Pero el núcleo, a pesar de ser tan sólido, puede partirse. Si dos átomos chocan uno contra el otro con gran velocidad podría suceder que los núcleos llegaran a chocar entre sí y entonces, o bien se rompen en trozos, o se funden liberando en el proceso partículas subnucleares. La nueva física de la primera mitad del siglo XX estuvo dominada por los nuevos acertijos que estas partículas planteaban.

Pero tenemos la mecánica cuántica; ¿es que no es aplicable siempre?, ¿cuál es la dificultad? Desde luego, la mecánica cuántica es válida para las partículas subatómicas, pero hay más que eso. Las fuerzas con que estas partículas interaccionan y que mantienen el núcleo atómico unido son tan fuertes que las velocidades a las que tienen que moverse dentro y fuera del núcleo están cerca de la velocidad de la luz, c, que es de 299.792’458 Km/s. Cuando tratamos con velocidades tan altas se necesita una segunda modificación a las leyes de la física del siglo XIX; tenemos que contar con la teoría de la relatividad especial de Einstein.

Esta teoría también fue el resultado de una publicación de Einstein de 1905. en esta teoría quedaron sentadas las bases de que el movimiento y el reposo son conceptos relativos, no son absolutos, como tampoco habrá un sistema de referencia absoluto con respecto al cual uno pueda medir la velocidad de la luz.

Pero había más cosas que tenían que ser relativas. En este teoría, la masa y la energía también dependen de la velocidad, como lo hacen la intensidad del campo eléctrico y del magnético.

Einstein descubrió que la masa de una partícula es siempre proporcional a la energía que contienen, supuesto que se haya tenido en cuenta una gran cantidad de energía en reposo de una partícula cualquiera, como se denota a continuación:

E = mc2

Jun

21

¡La misteriosa Física Cuántica!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Algunos se empeñan en que, las leyes de la física se simplifican en dimensiones más altas. Y, lo cierto es que, al no haberlas visto nunca -no están en nuestro plano de universo-, nos inventamos mil y una imagen pretendiendo que las representen pero, en realidad, no lo hace, Simplemente son figuras extrañas y espacios curvos de Riemann de enrevesado diseño que son…, otra cosa.

En una de las teorías de cuerdas, la conocida como la, se tiene que desarrollar en el espacio 26–dimensional de las vibraciones de sentido contrario a las agujas del reloj de la cuerda heterótica que tiene espacio suficiente para explicar todas las simetrías encontradas en la teoría de Einstein y en la teoría cuántica. Así, por primera vez, la geometría pura ha dado una simple explicación de por qué el mundo subatómico debería exhibir necesariamente ciertas simetrías que emergen del enrollamiento del espacio de más dimensiones: Las simetrías del dominio subatómico no son sino remanentes de la simetría del espacio de más dimensiones.

Las galaxias, las estrellas y los mundos… Y muchas más cosas, respetan patrónes simétricos que hacen de cada una de sus figuras, una misma estructuración que las hacen similares en un plano general, independientemente de que cada objeto tenga sus propias peculiaridades.

Esto significa que la belleza y simetrías encontradas en la naturaleza pueden ser rastreadas en última instancia hasta el espacio multidimensional. Por ejemplo, los copos de nieve crean bellas figuras hexagonales, ninguna de las cuales es exactamente igual a otra, han heredado sus estructuras de las formas en que sus moléculas han sido dispuestas geométricamente, determinada básicamente por las cortezas electrónicas de estas moléculas, que a su vez nos llevan de nuevo a las simetrías rotacionales de la teoría cuántica, dadas por O (3).

Del bonito arcoiris ?quién no tiene la experiencia de contemplarlo? También aquí hay una bella simetría

No hay dos cristales de nieve iguales pero la simetría de todos es la misma (de aspecto exagonal aunque desde el punto de vista estrictamente cristalográfico, trigonal. La razón se encuentra en la estructura cristalina del hielo (mostrada en color en el centro) que tiene exactamente la misma simetría y la transmite a los cristales.

Podemos concluir diciendo que las simetrías que vemos a nuestro alrededor, desde un arco iris a las flores y a los cristales, pueden considerarse en última instancia como manifestaciones de fragmentos de la teoría decadimensional original. Riemann y Einstein habían confiado en llegar a una comprensión geométrica de por qué las fuerzas pueden determinar el movimiento y la naturaleza de la materia.

Dado el enorme poder de sus simetrías, no es sorprendente que la teoría de supercuerdas sea radicalmente diferente de cualquier otro tipo de física. De hecho, fue descubierta casi por casualidad. Muchos físicos han comentado que si este accidente fortuito no hubiese ocurrido, entonces la teoría no se hubiese descubierto hasta bien entrado el siglo XXI. Esto es así porque supone una neta desviación de todas las ideas ensayadas en el pasado siglo XX. No es una extensión natural de tendencias y teorías populares en este siglo que ha pasado; permanece aparte.

Las supercuerdas van más lejos que todo esto

Por el contrario, la teoría de la relatividad general de Einstein tuvo una evolución normal y lógica. En primer lugar, su autor, postula el principio de equivalencia. Luego reformuló este principio físico en las matemáticas de una teoría de campos de la gravitación basada en los campos de Faraday y en el tensor métrico de Riemann. Más tarde llegaron las “soluciones clásicas”, tales como el agujero negro y el Big Bang. Finalmente, la última etapa es el intento actual de formular una teoría cuántica de la gravedad. Por lo tanto, la relatividad general siguió una progresión lógica, desde un principio físico a una teoría cuántica.

Geometría → teoría de campos → teoría clásica → teoría cuántica.

Contrariamente, la teoría de supercuerdas ha estado evolucionando hacia atrás desde su descubrimiento accidental en 1.968. Esta es la razón de que nos parezca extraña y poco familiar, estamos aún buscando un principio físico subyacente, la contrapartida del principio de equivalencia de Einstein.

Suponemos que las cuerdas están más allá de los Quarks

Uno de los secretos más profundos de la teoría de cuerdas, que aún no es bien comprendido, es por qué está definida solo en diez , once y veintiséis dimensiones. De todas las maneras, como nos dice Michiu Kaku, ese Físico que mira hacia el futuro, habría que tener presente las funciones modulares del Ramanujan para ver sí, dentro de ellas, están las respuestas de esas preguntas que, por ahora, nadie ha sabido contestar.

Gran parte de este trabajo es original del libro Hiperespacio de Michio Kaku, y, desde luego, como él nos anuncia, la Física tiene muchas de las respuestas que buscamos, sin embargo, también como nos dice la misma Física, algunas veces esas respuestas están situadas en la parte más simple de lo que estamos estudiando y, sin embargo, nos empeñamos en ahondar, de manera innecesaria hacia lo más profundo e incomprensible para buscar lo que tenemos delante de nuestras propias narices.

Si el límite de todas las teorías están marcados por las unidades de Planck, ya sabemos hasta dónde podemos llegar y, desde luego, la verificación de la Teoría de cuerdas, si como dicen los expertos necesita de la energía de Planck (1019 GeV) para ser verificada, entonces, nos queda mucho que esperar porque, ¿cuándo podrán tener los humanos esa energía a su disposición?

Existen límites a los que aún no han podido llegar nuestras teorías, y, el Límite de Planck es el que marca las fronteras de las teorías actuales que, nunca han podido llegar tan lejos como lo que nos dice esta simple ecuación:

Gabriele Veneziano es un físico italiano Mahiko Suzuki

La teoría nació casi por casualidad en 1.968 cuando dos jóvenes físicos teóricos, Gabriel Veneziano y Mahiko Suzuki, estaban hojeando independientemente libros de matemáticas. Figúrense ustedes que estaban buscando funciones matemáticas que describieran las interacciones de partículas fuertemente interactivas. Mientras estudiaban en el CERN, el Centro Europeo de Física Teórica en Ginebra, Suiza, tropezaron independientemente con la función beta de Euler, una función matemática desarrollada en el S. XIX por el matemático Leonhard Euler. Se quedaron sorprendidos al descubrir que la función beta de Euler ajustaba casi todas las propiedades requeridas para describir interacciones fuertes de partículas elementales.

Según he leído, durante un almuerzo en el Lawrence Berkeley Laboratory en California, con una espectacular vista del Sol brillando sobre el puerto de San Francisco, Suzuki le explicó a Michio Kaku mientras almorzaban la excitación de descubrir, prácticamente por casualidad, un resultado parcialmente importante. No se suponía que la física se pudiera hacer de ese modo casual.

Tras el descubrimiento, Suzuki, muy excitado, mostró el hallazgo a un físico veterano del CERN. Tras oír a Suzuki, el físico veterano no se impresionó. De hecho le dijo a Suzuki que otro físico joven (Veneziano) había descubierto la misma función unas semanas antes. Disuadió a Suzuki de publicar su resultado. Hoy, esta función beta se conoce con el nombre de modelo Veneziano, que ha inspirado miles de artículos de investigación iniciando una importante escuela de física y actualmente pretende unificar todas las leyes de la física.

En 1970, el Modelo de Veneziano-Suzuki (que contenía un misterio), fue parcialmente explicado cuando Yoichiro Nambu, de la Universidad de Chicago, y Tetsuo Goto, de la Nihon University, descubrieron que una cuerda vibrante yace detrás de sus maravillosas propiedades.

Así que, como la teoría de cuerdas fue descubierta hacia atrás y por casualidad, los físicos aún no conocen el principio físico que subyace en la teoría de cuerdas vibrantes y sus maravillosas propiedades.

El último paso en la evolución de la teoría de cuerdas (y el primer paso en la evolución de la relatividad general) aún está pendiente de que alguien sea capaz de darlo.

Así, Witten dice:

“Los seres humanos en el planeta tierra nunca dispusieron del marco conceptual que les llevara a concebir la teoría de supercuerdas de manera intencionada, surgió por razones del azar, por un feliz accidente. Por sus propios méritos, los físicos del siglo XX no deberían haber tenido el privilegio de estudiar esta teoría muy avanzada a su tiempo y a su conocimiento. No tenían (ni tenemos ahora mismo) los conocimientos y los prerrequisitos necesarios para desarrollar dicha teoría, no tenemos los conceptos correctos y necesarios.”

Actualmente, Edwar Witten es el físico teórico que, al frente de un equipo de físicos de Princeton, lleva la bandera de la teoría de supercuerdas con aportaciones muy importantes en el desarrollo de la misma. De todas las maneras, aunque los resultados y avances son prometedores, el camino por andar es largo y la teoría de supercuerdas en su conjunto es un edificio con muchas puertas cerradas de las que no tenemos las llaves para acceder a su interior y mirar lo que allí nos aguarda.

Ni con esta colección podremos abrir la puerta que nos lleve a la Teoría cuántica de la gravedad que, según dicen, subyace en la teoría M

El problema está en que nadie es lo suficientemente inteligente para resolver la teoría de campos de cuerdas o cualquier otro enfoque no perturbativo de esta teoría. Se requieren técnicas que están actualmente más allá de nuestras capacidades. Para encontrar la solución deben ser empleadas técnicas no perturbativas, que son terriblemente difíciles. Puesto que el 99 por ciento de lo que conocemos sobre física de altas energías se basa en la teoría de perturbaciones, esto significa que estamos totalmente perdidos a la hora de encontrar la verdadera solución de la teoría.

Nosotros, como el gato, estamos ante un enredo que no sabemos como solucionar. Nos faltan los conocimientos para ello. Y, como nuestras mentes evolucionan al ritmo que tiene impuesto el Universo, tendremos esas respuestas cuando llegue el momento, cuando estémos preparados para ello. Sobre todo, el conocimiento necesario para manejar las implicaciones que de tales conocimientos se pueden derivar.

¿Por qué diez dimensiones?

Uno de los secretos más profundos de la teoría de cuerdas, que aún no es bien comprendido, es por qué está definida sólo en diez, once y veintiséis dimensiones. Si calculamos cómo se rompen y se vuelven a juntar las cuerdas en el espacio N-dimensional, constantemente descubrimos que pululan términos absurdos que destruyen las maravillosas propiedades de la teoría. Afortunadamente, estos términos indeseados aparecen multiplicados por (N-10). Por consiguiente, para hacer que desaparezcan estas anomalías, no tenemos otra elección cuántica que fijar N = 10. La teoría de cuerdas, de hecho, es la única teoría cuántica conocida que exige completamente que la dimensión del espacio-tiempo esté fijada en un número único, el diez.

Por desgracia, los teóricos de cuerdas están, por el momento, completamente perdidos para explicar por qué se discriminan las diez dimensiones. La respuesta está en las profundidades de las matemáticas, en un área denominada funciones modulares.

Al manipular los diagramas de lazos de Kikkawa, Sakita y Virasoro creados por cuerdas en interacción, allí están esas extrañas funciones modulares en las que el número 10 aparecen en los lugares más extraños.

Estas funciones modulares son tan misteriosas como el hombre que las investigó, el místico del este. Quizá si entendiéramos mejor el trabajo de este genio indio, comprenderíamos por qué vivimos en nuestro universo actual.

El misterio de las funciones modulares podría ser explicado por quien ya no existe, Srinivasa Ramanujan, el hombre más extraño del mundo de los matemáticos. Igual que Riemann, murió antes de cumplir cuarenta años, y como Riemann antes que él, trabajó en total aislamiento en su universo particular de números y fue capaz de reinventar por sí mismo lo más valioso de cien años de matemáticas occidentales que, al estar aislado del mundo en las corrientes principales de los matemáticos, le eran totalmente desconocidos, así que los buscó sin conocerlos. Perdió muchos años de su vida en redescubrir matemáticas conocidas.

En los cuardenos perdidos de Ramanujan podrían estar las respuestas. Dispersas entre oscuras ecuaciones en sus cuadernos están estas funciones modulares, que figuran entre las más extrañas jamás encontradas en matemáticas. Ellas reaparecen en las ramas más distantes e inconexas de las matemáticas. Una función que aparece una y otra vez en la teoría de las funciones modulares se denomina (como ya he dicho otras veces) hoy día “función de Ramanujan” en su honor. Esta extraña función contiene un término elevado a la potencia veinticuatro.

El número 24 aparece repetidamente en la obra de Ramanujan. Este es un ejemplo de lo que las matemáticas llaman números mágicos, que aparecen continuamente donde menos se esperan por razones que nadie entiende. Milagrosamente, la función de Ramanujan aparece también en la teoría de cuerdas. El número 24 que aparece en la función de Ramanujan es también el origen de las cancelaciones milagrosas que se dan en la teoría de cuerdas. En la teoría de cuerdas, cada uno de los veinticuatro modos de la función de Ramanujan corresponde a una vibración física de la cuerda. Cuando quiera que la cuerda ejecuta sus movimientos complejos en el espacio-tiempo dividiéndose y recombinándose, deben satisfacerse un gran número de identidades matemáticas altamente perfeccionadas. Estas son precisamente las entidades matemáticas descubiertas por Ramanujan. Puesto que los físicos añaden dos dimensiones más cuando cuentan el número total de vibraciones que aparecen en una teoría relativista, ello significa que el espacio-tiempo debe tener 24 + 2 = 26 dimensiones espacio-temporales.

Reflejos de luz polarizada sobre una superficie de un disco

Para comprender este misterioso factor de dos (que añaden los físicos), consideramos un rayo de luz que tiene dos modos físicos de vibración. La luz polarizada puede vibrar, por ejemplo, o bien horizontal o bien verticalmente. Sin embargo, un campo de Maxwell relativista Aµ tiene cuatro componentes, donde µ = 1, 2, 3, 4. Se nos permite sustraer dos de estas cuatro componentes utilizando la simetría gauge de las ecuaciones de Maxwell. Puesto que 4 – 2 = 2, los cuatro campos de Maxwell originales se han reducido a dos. Análogamente, una cuerda relativista vibra en 26 dimensiones. Sin embargo, dos de estos modos vibracionales pueden ser eliminados cuando rompemos la simetría de la cuerda, quedándonos con 24 modos vibracionales que son las que aparecen en la función de Ramanujan.

Es posible que, en las matemáticas de Ramanujan estén algunas respuestas

Cuando se generaliza la función de Ramanujan, el 24 queda reemplazado por el número 8. Por lo tanto, el número crítico para la supercuerda es 8+2=10. Este es el origen de la décima dimensión que exige la teoría. La cuerda vibra en diez dimensiones porque requiere estas funciones de Ramanujan generalizadas para permanecer auto consistente. Dicho de otra manera, los físicos no tienen la menor idea de por qué 10 y 26 dimensiones se seleccionan como dimensión de la cuerda. Es como si hubiera algún tipo de numerología profunda que se manifestara en estas funciones que nadie comprende. Son precisamente estos números mágicos que aparecen en las funciones modulares elípticas los que determinan que la dimensión del espacio-tiempo sea diez.

En el análisis final, el origen de la teoría decadimensional es tan misterioso como el propio Ramanujan. Si alguien preguntara a cualquier físico del mundo por qué la naturaleza debería existir en diez dimensiones, estaría obligado a responder “no lo sé”. Se sabe en términos difusos, por qué debe seleccionarse alguna dimensión del espacio tiempo (de lo contrario la cuerda no puede vibrar de una forma cuánticamente autoconsistente), pero no sabemos por qué se seleccionan estos números concretos.

¡Son tantas las cosas que no sabemos!

Publica: emilio silvera

PD. Le damos las gracias a Michio Kaku por sus ideas y su manera futurista de ver la Física.

Jun

21

La Física de Partículas al Servicio de la Salud

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (2)

Comments (2)

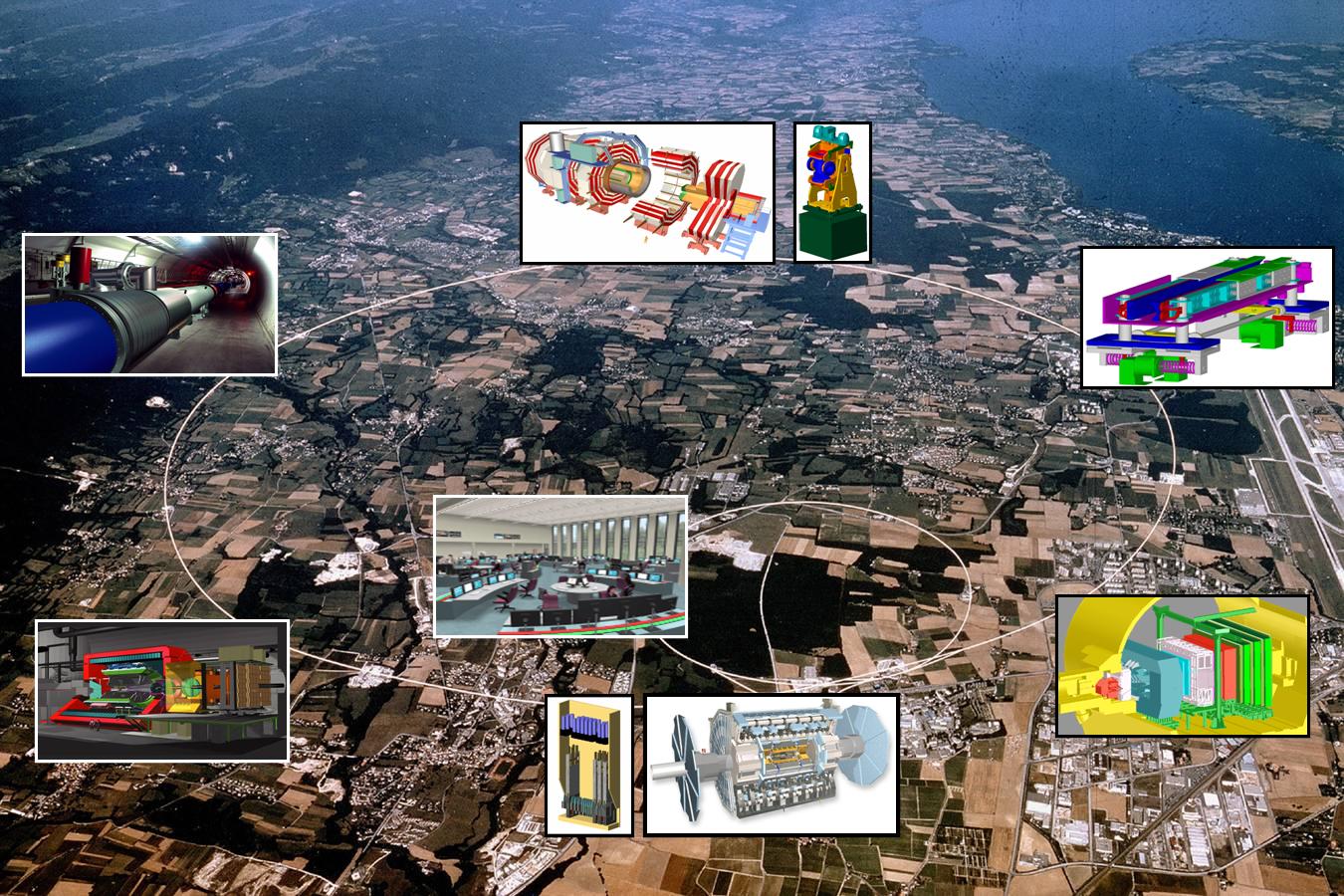

Transferencias tecnológicas del CERN a la Biomedicina. No todo en el CERN es buscar el Bosón de Higgs. Otras muchas actvividades han sido realizadas y en la actualidad se siguen otras que buscan un mejor futuro para la Humanidad.

Partículas y mucho más

Seguramente, todos los lectores de este Blog, han oído más de una vez hablar del CERN. Fundado en 1954, constituye el mayor laboratorio de física de partículas del mundo, con veinte países miembros y un personal de unas 3.000 personas entre físicos, ingenieros y personal técnico y administrativo de todo tipo. Seguramente están también al tanto de los grandes experimentos que se están preparando en este centro como el Large Hadron Collider (LHC), situado en un túnel circular de 27 km de longitud, destinado a elucidar el origen de la llamada ruptura de la simetría electrodébil y en última instancia el origen de las masas de las partículas elementales (no de la masa del protón o del neutrón como erróneamente se dice a veces en los medios de comunicación), o del proyecto CERN Neutrino Gran Sasso (CNGS), que consiste en enviar un haz de neutrinos de alta energía desde el CERN al laboratorio subterráneo italiano del Gran Sasso que se encuentra a 730 km, para estudiar las oscilaciones de estas huidizas partículas.

También es muy probable que muchos lectores asocien de manera natural la palabra acelerador de partículas a los instrumentos que utilizan los físicos modernos para estudiar y comprender mejor la estructura y el comportamiento de la materia a pequeñas escalas. Sin embargo, de los 17.000 aceleradores de partículas que se estima existen en la actualidad en todo el mundo, aproximadamente la mitad de ellos se usan en medicina y sólo una parte muy pequeña se usan para investigación fundamental. Por este y otros motivos que se discutirán más adelante, en este número especial de la Revista Española de Física dedicado a la física y las ciencias de la vida, ha parecido conveniente incluir un artículo en el que, al menos brevemente, se describieran algunas de las transferencias tecnológicas (spinoffs) importantes que la actividad del CERN aporta a dichas ciencias.

Mucho de lo que aquí se descubre, se aplica a nuestra Salud

Es bastante razonable que, como ocurre con las ciencias del espacio, mucha gente se pregunte cuál es la utilidad social de la física de partículas más allá de la adquisición de conocimientos fundamentales de la naturaleza. Sin embargo, es preciso señalar que los aceleradores y detectores de partículas del CERN y otros laboratorios similares requieren el uso, y muchas veces el desarrollo, de tecnologías de punta que obligan a una estrecha colaboración con la industria que redunda en beneficio de ambas partes. Las transferencias tecnológicas que se producen en este proceso se incorporan inmediatamente a nuestra vida diaria en áreas tales como la electrónica, procesamiento industrial y médico de imágenes, manejo y usos de la radiación , metrología, nuevos materiales, tecnologías de la computación y la información, tratamiento del cáncer, etc. En este artículo se pondrá el énfasis en aquellas actividades del CERN que han redundado de una forma más clara en beneficio de las ciencias biomédicas.

PET/TC o más allá de los rayos X

En el ámbito de la medicina los aceleradores de partículas se utilizan con dos finalidades; una para la formación de imágenes con propósitos diagnósticos y otra, para terapia, principalmente oncológica. Desde el descubrimiento de los rayos X por Röntgen en 1895, este tipo de radiación electromagnética ha proporcionado una información de valor incalculable y aún sigue proporcionándola. Sin embargo, mucho más recientemente, se han desarrollado otras técnicas complementarias de diagnóstico basadas en los llamados radiofármacos. Estas sustancias radiactivas presentan idealmente la propiedad de poder ser inyectadas en el organismo humano de forma segura y de fijarse exclusivamente a determinados tejidos. Posteriormente, a medida que van desintegrándose, emiten ciertas partículas que pueden ser detectadas y analizadas produciendo de esta forma imágenes estáticas o incluso dinámicas de los órganos en los que se depositaron los radiofármacos y, en definitiva, proporcionando información no solamente sobre la morfología de aquellos, sino también, en muchos casos, sobre su función y metabolismo.Los radiofármacos se producen utilizando haces de protones de alta intensidad y, como tienen una vida media muy baja, deben utilizarse cerca de donde se han creado. Se calcula que unos 20 millones de personas son diagnosticadas cada año mediante el uso de este tipo de sustancias.

Son técnicas no invasivas que dejan al descubierto lo que interesa ver y eliminar.

Una de las técnicas de este tipo más utilizada en la actualidad es la Positron Emission Tomography (PET). En su aplicación se utiliza normalmente un ciclotrón para irradiar alguna sustancia que se convierte en radiactiva por desintegración beta positiva (emisora de positrones). Esta sustancia se une por ejemplo a la glucosa y se inyecta al paciente. Los positrones producidos se aniquilan con los electrones circundantes dando lugar a dos fotones de energía muy bien definida, emitidos en direcciones opuestas. Estos fotones interaccionan con un material escintilador dando lugar a la emisión de otros fotones que pueden ser detectados por fotomultiplicadores o fotodiodos para formar la imagen de los tejidos que se pretenden estudiar en función de la distribución de la glucosa radiactiva. Por ejemplo, en el caso del diagnóstico del cáncer las células cancerosas suelen consumir más glucosa que las células sanas debido a su mayor vascularización y a su mayor actividad metabólica y reproductiva, produciendo por tanto una mayor emisión de fotones. Por el contrario, las zonas donde el tejido presente mayor número de células muertas brillarán menos debido a la menor concentración de glucosa radioactiva, lo cual puede ser muy útil para el diagnóstico de infartos y otras lesiones.

Tecnológias que llegan más allá

De acuerdo con David Townsend, uno de los pioneros en el desarrollo de la tecnología PET, aunque ésta no fue inventada en el CERN, una cantidad esencial e inicial de trabajo desarrollado en el CERN a partir de 1977 contribuyó de forma significativa al desarrollo del PET 3D. La tecnología PET alcanza su grado más alto de utilidad diagnóstica cuando se combina con la Computed Tomography (CT). La CT es un método de formación de imágenes tridimensionales a partir del procesamiento digital de un gran número de imágenes bidimensionales de rayos X. Inicialmente, las diferentes imágenes se obtenían alrededor de un solo eje de rotación y de ahí su nombre original de Computed Axial Tomography (CAT).

La técnica combinada PET/CT es uno de los desarrollos más excitantes de la medicina nuclear y la radiología modernas. Las reconstrucciones de imágenes CT permiten el diagnóstico precoz de tumores basándose en sus características morfológicas, mientras que la tecnología PET es capaz de diferenciar con grane eficiencia los tejidos malignos de los benignos. La fusión PET/CT permite ahora integrar las imágenes morfológica y fisiológica en una única imagen. El prototipo del scanner ART, el Partial Ring Tomograph (PRT), fue desarrollado en el CERN en 1980 y 1990 por David Townsend, Martín Wensveen y Henri Tochon-Danguy, y evaluado clínicamente en el departamento de medicina nuclear del Hospital Cantonal de Ginebra. ART puede considerarse como el precursor de la parte PET del moderno scanner PET/CT, que ha producido un impacto extraordinario en la tecnología de imágenes con fines médicos. Además, el CERN continua hoy en día contribuyendo a este campo fundamental de la medicina moderna mediante proyectos como Clear PET, Clear PEM, HPD PET etc.

Sin embargo, la importancia del CERN en el desarrollo de las tecnologías PET o CT, y en general de todo tipo de scanner, va mucho más allá. En efecto, todo este tipo de dispositivos se basa, de una forma u otra, en los detectores desarrollados a finales de los sesenta en el CERN por George Charpak. Su trabajo fue reconocido en 1992 con la concesión del Premio Nobel de Física por su invención y desarrollo de detectores de partículas, en particular de la cámara proporcional multihilos, que produjo una revolución en la técnica de exploración de las partes más íntimas de la materia. Los detectores desarrollados por Charpak se usan aún para todo tipo de investigaciones médicas y biológicas y podrían eventualmente sustituir completamente a las placas fotográficas en la radio-biología aplicada. La velocidad creciente con la que permiten registrar las imágenes en radio medicina conducen a una menor tiempo de exposición y a menores dosis de radiación indeseada recibida por los pacientes.

Hadronterapia, o las partículas contra el cáncer

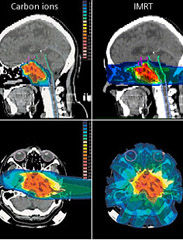

Como es bien sabido, una de las herramientas terapéuticas esenciales en el campo de la oncología es la radioterapia. Dicho tratamiento se aplica hoy en día aproximadamente a la mitad de los pacientes de cáncer. En cierto modo se puede considerar como una forma sutil de cirugía donde el bisturí es reemplazado por un haz colimado de partículas capaz de esterilizar las células malignas mediante la inactivación de su ADN, impidiendo así su reproducción. Tradicionalmente, la radioterapia se ha basado en el uso de rayos X (fotones), electrones y, más recientemente, hadrones, es decir, partículas capaces de interaccionar fuerte o nuclearmente, si bien no es ésta la propiedad más interesante de estas partículas para las aplicaciones radioterapeúticas. Los haces de rayos X y los electrones se obtienen normalmente a partir de aceleradores lineales como los del CERN, aunque mucho más pequeños, y se apuntan hacia los tumores con la energía, dirección y colimación apropiadas para optimizar su efecto destructivo sobre los mismos. Por su parte, los neutrones pierden energía en el interior del organismo de una forma diferente, lo cual les hace más indicados para el tratamiento de ciertos tipos especiales de tumores. Se obtienen a partir de las colisiones de protones, previamente acelerados en un ciclotrón, con núcleos de berilio. Este hecho hace que esta terapia sea bastante más cara que las anteriores, pero a cambio el ciclotrón puede ser usado también para la producción de radiofármacos.

Cintíficos del CERN aplivcan antimateria contra el Cáncer

El estudio de las posibilidades de utilización de haces de hadrones en la terapia del cáncer tuvo su origen en el trabajo seminal de R.R Wilson titulado Radiological Use of Fast Protons (Radiology 47, 1946). En dicho artículo se ponía de manifiesto que los protones, así como otras partículas cargadas pesadas, presentan la propiedad única de que al penetrar en el cuerpo humano depositan la mayor parte de su energía a una preofundidad que depende de su energía inicial. Este hecho permite seleccionar cuidadosamente el área que se quiere irradiar, preservando de dicha radiación al tejido sano que pudiera encontrarse a menor profundidad. Además, como las partículas se detienen a una distancia de la superficie bien definida por la energía del haz, tampoco resultarían dañadas las células situadas detrás del blanco seleccionado.

En contraste, la energía depositada por los rayos X alcanza su máximo cerca de la superficie de entrada y decae exponencialmente hasta que abandona el cuerpo humano en el lado opuesto, haciendo por tanto muy difícil seleccionar la zona que quiere irradiarse sin dañar otras áreas de células sanas. El trabajo de Wilson de 1946 condujo a toda una nueva línea de investigación experimental, principalmente en el Lawrence Berkeley Laboratory, que ha dado lugar al desarrollo de una nueva clase de terapias antitumorales basadas en la irradiación con protones y más recientemente con iones de carbono. Estas técnicas han sido aplicadas en más de 40 centros de todo el mundo, y de ellas se han beneficiado hasta la fecha más de 50.000 pacientes. No obstante, continúan investigándose nuevas formas de intentar mejorar el ratio entre la energía depositada en las células tumorales y en el tejido sano.

En la actualidad, el CERN se encuentra involucrado en diversos proyectos relacionados con la hadronterapia. Por ejemplo, en el diseño de un acelerador de protones e iones de carbono dedicado exclusivamente a usos médicos conocido como Proton Ion Medical Machine Study (PIMMS). Otro proyecto interesante es la realización de las pruebas del Linear Booster ( LIBO), capaz de acelerar una haz de protones hasta 200 Mev (los hospitales habiualmente utilizan energías en torno a los 65 MeV) y que estaría especializado en el tartamiento de tumores profundos.

Finalmente, y situándonos en un plano de investigación a un nivel más básico, es interesante señalar que en octubre de 2006 se presentaron los primeros resultados de un experimento llevado a cabo en el CERN con potencial para futuras aplicaciones en la terapia del cáncer. Se trataba del Antiproton Cell Experiment (ACE), que constituye la primera investigación realizada hasta la fecha sobre efectos biológicos de los antiprotones. Los antiprotones se comportan como los protones cuando entran en el organismo, pero generan mucha más energía en el blanco seleccionado debido a du aniquilación con los protones existentes en los núcleos de los átomos de las células, y además depositan esta energía de una forma biológicamente más efectiva.

Se busca antimateria contra el Cáncer

Evaluando la fracción de células supervivientes después de la irradiación con el haz de antiprotones, el experimento ACE ha encontrado que a eficiencia de éstos es unas cuatro veces mayor que la de los protones, mientras que el daño producido a las células situadas antes del blanco era básicamente el mismo. De acuerdo con Michael Holzscheiter, portavoz del experimento ACE, este hecho podría ser extremadamente importante para el tratamiento de casos de cáncer recurrente, donde este tipo de propiedad es vital. La tecnología desarrollada previamente en el CERN para la obtención de haces de antiprotones de buena calidad a la energía apropiada es esencial para este prometedor experimento, que difícilmente podría haberse realizado en ningún otro laboratorio. Éste es por tanto un magnífico ejemplo de cómo la investigación en física de partículas desarrollada en el CERN puede generar soluciones innovadores con excelentes beneficios médicos potenciales.

Los investigadores de ACE, en colaboración con otras instituciones de todo el mundo, están realizando en la actualidad nuevos tests para comprobar la eficacia de este método en el caso de tumores situados a mayor profundidad, y comparando sus resultados con los de otros métodos más convencionales como la irradiación mediante iones de carbono. Si todo sale como se espera, los beneficios clínicos de esta nueva técnica podrían empezar a producirse dentro de la próxima década.

Otro ejemplo importante de tecnología creada en el CERN con aplicaciones a la terapia del cáncer es el Neutron Driven Element Trasmuter. Se trata de un sistema de producción de radioisótopos específicos específicos a partir de un acelerador de protones cuyo desarrollo fue liderado por Carlo Rubbia, Premio Nobel de Física en 1984 por el descubrimiento de los bosones W y Z y ex director general del CERN. La idea es utilizar el haz de protones para producir neutrones los cuales provocan reacciones en un ambiente apropiado donde ciertos elementos son convertidos en los isótopos deseados.

La diferencia principal entre este método, seguro y barato, y el método más tradicional de utilizar los neutrones provenientes de un reactor nuclear, es que no requiere el uso de material fisionable ni funciona críticamente, es decir las reacciones se detienen en el momento en el que el acelerador es apagado. Más aún, el método tiene la ventaja de que sólo se producen los isótopos requeridos, lo que redunda en una importante reducción de impacto ambiental. Normalmente, el blanco utilizado es plomo, elemento idóneo por presentar el menor ritmo de captura de neutrones. Los neutrones se producen por espalación a partir del haz de protones y permanecen en el interior del blanco de plomo, que está rodeado de un deflector de grafito, hasta que su espectro se suaviza suficientemente para cubrir un gran rango de energías que permiten su utilización para la transmutación de los elementos necesarios para la obtención de los isótopos deseados.

El Neutron Driven Element Trasmuter ha permitido, entre otras cosas, la producción de radioisótopos beta emisores como el 166Ho, 186 Re o el 188Re que son de gran importancia en braquiterapia. Dicha técnica, muy utilizada en el tratamiento de cánceres ginecológicos y en el de cáncer de próstata, es un tipo de radioterapia de proximidad donde la fuente radiactiva se sitúa dentro o muy cerca de los tejidos que requieren irradiación. Típicamente, la fuente radiactiva, de alta actividad y corta vida media, se encapsula en una semilla, filamento o tubo y se implanta en quirófano en la zona deseada. Las diferentes dosis requeridas en cada caso hacen que sea fundamental disponer del mayor muestrario posible de radioisótopos con la actividad y vida media apropiadas, lo cual convierte al Neutron Driven Element Trasmuter en una herramienta valiosísima para el futuro de este tipo de técnica terapéutica.

Información y computación sin fronteras

CERN, … where the web was born; éste es uno de los reclamos publicitarios que suelen utilizarse para hacer ver al público la importancia de los retornos tecnológicos que en este laboratorio tienen lugar. Y en efecto, fue a finales de los ochenta cuando Tim Berners-Lee desarrolló estándar de Hyper Text Transfer Protocol (HTTP) e implementó los primeros servidores web en el CERN. Su esfuerzo permitió la comunicación fácil y segura y el intercambio de todo tipo de información entre todos los ordenadores del mundo conectados a internet, dando lugar de esta forma a una de las revoluciones tecnológicas más importantes de las últimas décadas. Las repercusiones científicas, tecnológicas, culturales, comerciales y de ocio de la web son ya tan conocidas que apenas merecen comentario alguno.

El término Grid fue acuñado por Ian Foster and Carl Kesselman en su libro The Grid, Blueprint for new Computing Infraestructure (Morgan Kaufman, 1998), aunque las ideas básicas habían sido consideradas con anterioridad. No existe un acuerdo general sobre cual debería ser la definición precisa de las tecnologías Grid, pero hay un amplio concenso en que esta debería contener elementos tales como recursos compartidos, virtualización, abstracción del acceso a los recursos y estandarización. La filosofía Grid consistería, no sólo en compartir información entre diferentes usuarios, sino también recursos, como por ejemplo, procesadores, tiempo de CPU, unidades de almacenamiento, así como otros aparatos e instrumentos, de tal forma que eventualmente cada usuario tendría acceso virtual, por ejemplo, a la capacidad de cálculo de todos los demás usuarios de esa Grid. En los primeros tiempos de esta tecnología de la información se llegó a hablar de la Grid, refiriéndose a la posibilidad de existencia de una única World Wide Grid.

Todo surgió del CERN

Hasta el momento,, sin embargo, este concepto no es una realidad y más bien lo que se encuentra es que diferentes grupos de proyectos crean su propia Grid usando sus propias implementaciones, estándares y protocolos y dando acceso restringido solamente a una cierta comunidad de usuarios autorizados. Así, aunque se siguen realizando importantes esfuerzos en cuanto a la estandarización de los protocolos, no está claro cual será el camino que este tipo de tecnología seguirá en el futuro en lo que se refiere a la futura existencia de un única Grid.

En cualquier caso es importante resaltar que una vez más el CERN ha sido pionero en este tipo de tecnología. Los detectores que se están instalando (a estas alturas, todos instalados y en marcha) en el LHC (ATLAS, CMS, ALICE, LHCb, SUSY, etc.), son tan complejos, que han requerido cada uno de ellos el concurso de muchas instituciones de todo el mundo para su construcción, y lo seguirán requiriendo para su mantenimiento cuando el acelerador empiece a funcionar (ya está en marcha), y, como no, para el análisis de los datos que se obtengan. Para hacerse una idea de la dimensión y complejidad de estos análisis baste mencionar que el compact Muon Selenoid (CMS), una vez pasado su primer filtro, deberá almacenar información sobre el resultado de las colisiones producidas en su interior a un ritmo del orden de 100 a 200 MB por segundo durante un tiempo esperado de unos cien días por año. Resulta obvio que sólo una tecnología tipo Grid puede afrontar con posibilidades de éxito un reto semejante y de hecho el CERN ha inspirado varios proyectos Grid multinacionales por este motivo. Posiblemente, el más grande de ellos hasta la fecha sea el EGEE (Enablinbg Grids for E-Science), que conecta más de 150 paises y ofrece 20 000 CPUs y más de 10 Petabytes de memoria.

De manera análoga a como ocurrió con las tecnologías de la detección y aceleración, las tecnologías Grid tendrán, y de hecho ya empiezan a tener, un fuerte impacto en las ciencias de la vida y de la salud. En este sentido, uno de los campos obvios de aplicación es la bioinformática. Gracias a los espectaculares avances llevados a cabo en los últimos años en el campo de la biología molecular, se dispone hoy en día de cantidades crecientes de información genética de diferentes especies e individuos. Dicha información codificada en el ADN en forma de secuencia de tripletes o codones de ácidos nucleicos, que constituyen los genes que contienen la estructura primaria de las diferentes proteínas, ha sido y está siendo obtenida por centenares de grupos diferentes distribuidos por todo el mundo y debe almacenarse en gigantescas bases de datos de forma eficiente para su compartición, contrastación y análisis.

Ejemplos típicos serían la búsqueda de determinadas secuencias, comparaciones, búsqueda de determinadas mutaciones o alelos, etc. Resulta evidente que esta ingente labor puede verse enormemente beneficiada por el uso de tecnologías Grid. De hecho, la Bioinformática, y en particular sus aplicaciones biomédicas, han sido una parte importante del proyecto EGEE desde el comienzo del mismo.

Finalmente, y como última muestra de cómo puede revertir en la sociedad las tecnologías de la información y la computación provenientes de la física de partículas, es interesante mencionar el Proyecto Mammogrid y su continuación Mammogrid Plus. Liderado por el CERN, dicho proyecto de la UE utiliza la tecnología Grid para crear una base de datos de mamografías que pueda ser usada para investigar un gran conjunto de datos e imágenes que, aparte de otras aplicaciones sanitarias, sea útil para estudiar el potencial de esta tecnología para servir de soporte a la colaboración entre los profesionales de la salud de la UE.

Ciencia, Tecnología y Sociedad

A estas alturas debería haber quedado claro que los centros científicos de élite internacionales como el CERN, no sólo nos proporcionan un conocimiento más profundo de la naturaleza, sino que las tecnologías de punta que en ellos se desarrollan acaban permeando a la Sociedad y se incorporan a nuestras vidas cotidianas. El autor del artículo, Antonio Dobado, del Departamento de Física Teórica I de la Universidad Complutense de Madrid, ha pretendido ilustrar el hecho innegable de la conexión existente entre temas tan aparentemente dispares como el de la Física de Partículas y la Biomedicina, pero ejemplos semejantes podrían haberse encontrado en prácticamente cualquier área de la actividad humana.

La Sociedad no puede permanecer por más tiempo ajena a la Ciencia y a todo lo que trae consigo. Precisamente por eso la RSEF dedica un gran esfuerzo a la difícil tarea de convencer al público de la importancia de la Física como valor científico, cultural y social, como una forma rigurosa y profunda del acercamiento al conocimiento de la naturaleza, y a la vez como generadora de nuevas tecnologías. En este sentido, es una espléndida noticia la inminente creación de un nuevo Grupo especializado en el seno de la RSEF denominado Física Médica. Y, desde aquí, aprovechamos la oportunidad para darles la bienvenida y desearles el mayor éxito en sus futuras andaduras en la búsqueda de la verdad científica.

Fuente: Revista Española de FÍSICA.

Publicada por la RSEF con el Nº 3 Volumen 21 de 2007

La presente transcripción es de: Emilio Silvera

Miembro numerario de la RSEF y adscrito a los Grupos Especializados de Física Teórica y Astrofísica.

Jun

20

¡La Mecánica cuántica!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

LA MARAVILLA DE LOS CUANTOS

Aunque la semilla la puso Planck en 1900, fue a partir de 1930 cuando la mecánica cuántica se aplicó con mucho éxito a problemas relacionados con núcleos atómicos, moléculas y materia en estado sólido. La mecánica cuántica hizo posible comprender un extenso conjunto de datos, de otra manera enigmáticos. Sus predicciones han sido de una exactitud notable. Ejemplo de ésto último es la increíble precisión de diesciciete cifras significativas del momento magnético del electrón calculadas por la EDC (Electrodinámica Cuántica) comparadas con el experimento.

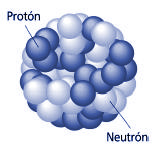

Si viajamos hacia lo muy pequeño tendremos que ir más allá de los átomos, que son objetos voluminosos y frágiles comparados con lo que nos ocupará a continuación: el núcleo atómico y lo que allí se encuentra. Los electrones, que ahora vemos “a gran distancia” dando vueltas alrededor del núcleo, son muy pequeños y extremadamente robustos. El núcleo está constituido por dos especies de bloques: protones y neutrones. El protón (del griego πρώτος, primero) debe su nombre al hecho de que el núcleo atómico más sencillo, que es el hidrógeno, está formado por un solo protón. Tiene una unidad de carga positiva. El neutrón recuerda al protón como si fuera su hermano gemelo: su masa es prácticamente la misma, su espín es el mismo, pero en el neutrón, como su propio nombre da a entender, no hay carga eléctrica; es neutro.

La masa de estas partículas se expresa en una unidad llamada mega-electrón-voltio o MeV, para abreviar. Un MeV, que equivale a 106 electrón-voltios, es la cantidad de energía de movimiento que adquiere una partícula con una unidad de carga (tal como un electrón o un protón) cuando atraviesa una diferencia de potencial de 106 (1.000.000) voltios. Como esta energía se transforma en masa, el MeV es una unidad útil de masa para las partículas elementales.

La mayoría de los núcleos atómicos contienen más neutrones que protones. Los protones se encuentran tan juntos en el interior de un núcleo tan pequeño que se deberían repeles entre sí fuertemente, debido a que tienen cargas eléctricas del mismo signo. Sin embargo, hay una fuerza que los mantiene unidos estrechamente y que es mucho más potente e intensa que la fuerza electromagnética: la fuerza o interacción nuclear fuerte, unas 102 veces mayor que la electromagnética, y aparece sólo entre hadrones para mantener a los nucleones confinados dentro del núcleo. Actúa a una distancia tan corta como 10–15 metros, o lo que es lo mismo, 0’000000000000001 metros.

La interacción fuerte está mediada por el intercambio de mesones virtuales, 8 gluones que, como su mismo nombre indica (glue en inglés es pegamento), mantiene a los protones y neutrones bien sujetos en el núcleo, y cuanto más se tratan de separar, más aumenta la fuerza que los retiene, que crece con la distancia, al contrario que ocurre con las otras fuerzas.

La luz es una manifestación del fenómeno electromagnético y está cuantizada en “fotones”, que se comportan generalmente como los mensajeros de todas las interacciones electromagnéticas. Así mismo, como hemos dejado reseñado en el párrafo anterior, la interacción fuerte también tiene sus cuantos (los gluones). El físico japonés Hideki Yukawa (1907 – 1981) predijo la propiedad de las partículas cuánticas asociadas a la interacción fuerte, que más tarde se llamarían piones. Hay una diferencia muy importante entre los piones y los fotones: un pión es un trozo de materia con una cierta cantidad de “masa”. Si esta partícula está en reposo, su masa es siempre la misma, aproximadamente 140 MeV, y si se mueve muy rápidamente, su masa parece aumentar en función E = mc2. Por el contrario, se dice que la masa del fotón en reposo es nula. Con esto no decimos que el fotón tenga masa nula, sino que el fotón no puede estar en reposo. Como todas las partículas de masa nula, el fotón se mueve exclusivamente con la velocidad de la luz, 299.792’458 Km/s, una velocidad que el pión nunca puede alcanzar porque requeriría una cantidad infinita de energía cinética. Para el fotón, toda su masa se debe a su energía cinética.

La Física del siglo XX empezó exactamente en el año 1900, cuando el físico alemán Max Planck propuso una posible solución a un problema que había estado intrigando a los físicos durante años. Es el problema de la luz que emiten los cuerpos calentados a una cierta temperatura, y también la radiación infrarroja emitida, con menos intensidad, por los objetos más fríos.

Estaba bien aceptado entonces que esta radiación tenía un origen electromagnético y que se conocían las leyes de la naturaleza que regían estas ondas electromagnéticas. También se conocían las leyes para el frío y el calor, la así llamada “termodinámica”, o al menos eso parecía.

Pero si usamos las leyes de la termodinámica para calcular la intensidad de la radiación, el resultado no tiene ningún sentido. Los cálculos nos dicen que se emitiría una cantidad infinita de radiación en el ultravioleta más lejano, y, desde luego, esto no es lo que sucede. Lo que se observa es que la intensidad de la radiación muestra un pico o una cierta longitud de onda característica, y que la intensidad disminuye tanto para longitudes mayores como para longitudes menores. Esta longitud característica es inversamente proporcional a la temperatura absoluta del objeto radiante (la temperatura absoluta se define por una escala de temperatura que empieza a 273 ºC bajo cero). Cuando a 1.000 ºC un objeto se pone al “rojo vivo”, el objeto está radiando en la zona de la luz visible.

Poco a poco vamos avanzando y llegará el momento en el que, los más profundos secretos de la Naturaleza hayan sido desvelados

Lo que Planck propuso fue simplemente que la radiación sólo podía ser emitida en paquetes de un tamaño dado. La cantidad de energía de uno de esos paquetes, o cuantos, es inversamente proporcional a la longitud de onda y, por lo tanto, proporcional a la frecuencia de la radiación emitida. La fórmula es:

E = h x v

Donde E es la energía del paquete, v es la frecuencia y h es una nueva constante fundamental de la naturaleza, la constante de Planck. Cuando Planck calculó la intensidad de la radiación térmica imponiendo esta nueva condición, el resultado coincidió perfectamente con las observaciones.

Poco tiempo después, en 1905, Einstein formuló esta teoría de una manera mucho más tajante: el sugirió que los objetos calientes no son los únicos que emiten radiación en paquetes de energía, sino que toda la radiación consiste en múltiplos del paquete de energía de Planck.

El príncipe francés Louis Victor de Broglie, dándole otra vuelta a la teoría, que no sólo cualquier cosa que oscila tiene una energía, sino que cualquier cosa con energía se debe comportar como una “onda” que se extiende en una cierta dirección del espacio, y que la frecuencia, v, de la oscilación verifica la ecuación de Planck. Por lo tanto, los cuantos asociados con los rayos de luz deberían verse como una clase de partículas elementales: el fotón. Todas las demás clases de partículas llevan asociadas diferentes ondas oscilatorias de campos de fuerza.

Es curioso el comportamiento de los electrones en el interior del átomo, descubierto y explicado por el famoso físico danés Niels Bohr, se pudo atribuir a las ondas de De Broglie. Poco después, en 1926, Edwin Schrödinger descubrió como escribir la teoría ondulatoria de De Broglie con ecuaciones matemáticas exactas. La precisión con la cual se podían realizar los cálculos era asombrosa, y pronto quedó claro que el comportamiento de todos los objetos pequeños quedaba exactamente determinado por las recién descubiertas “ecuaciones de onda cuántica”.

No hay duda de que la Mecánica Cuántica funciona maravillosamente bien. Sin embargo, surge una pregunta muy formal: ¿qué significan realmente esas ecuaciones?, ¿qué es lo que están describiendo? Cuando Isaac Newton, allá por el año 1687, formuló cómo debían moverse los planetas alrededor del Sol, estaba claro para todo el mundo lo que significaban sus ecuaciones: que los planetas están siempre en una posición bien definida en el espacio y que sus posiciones y sus velocidades en un momento concreto determinan inequívocamente cómo evolucionarán las posiciones y las velocidades con el tiempo.

Pero para los electrones todo esto es muy diferente. Su comportamiento parece estar envuelto en la bruma. Es como si pudieran “existir” en diferentes lugares simultáneamente, como si fueran una nube o una onda, y esto no es un efecto pequeño. Si se realizan experimentos con suficiente precisión, se puede determinar que el electrón parece capaz de moverse simultáneamente a lo largo de trayectorias muy separadas unas de otras. ¿Qué puede significar todo esto?

Niels Bohr consiguió responder a esta pregunta de forma tal que con su explicación se pudo seguir trabajando y muchos físicos siguen considerando su respuesta satisfactoria. Se conoce como la “interpretación de Copenhague” de la Mecánica Cuántica. En vez de decir que el electrón se encuentra en el punto x o en el punto y, nosotros hablamos del estado del electrón. Ahora no tenemos el estado “x” o el estado “y”, sino estados “parcialmente x” o “parcialmente y. Un único electrón puede encontrarse, por lo tanto, en varios lugares simultáneamente. Precisamente lo que nos dice la Mecánica Cuántica es como cambia el estado del electrón según transcurre el tiempo.

El detector ATLAS funcionó, y rastrearon las partículas subatómicas…

Un “detector” es un aparato con el cual se puede determinar si una partícula está o no presente en algún lugar pero, si una partícula se encuentra con el detector su estado se verá perturbado, de manera que sólo podemos utilizarlo si no queremos estudiar la evolución posterior del estado de la partícula. Si conocemos cuál es el estado, podemos calcular la probabilidad de que el detector registre la partícula en el punto x.

Las leyes de la Mecánica Cuántica se han formulado con mucha precisión. Sabemos exactamente como calcular cualquier cosa que queramos saber. Pero si queremos “interpretar” el resultado, nos encontramos con una curiosa incertidumbre fundamental: que varias propiedades de las partículas pequeñas no pueden estar bien definidas simultáneamente. Por ejemplo, podemos determinar la velocidad de una partícula con mucha exactitud, pero entonces no sabremos exactamente dónde se encuentra; o, a la inversa. Si una partícula tiene “espín” (rotación alrededor de su eje), la dirección alrededor de la cual está rotando (la orientación del eje) no puede ser definida con gran precisión.

Explorar el misterio del espín de los protones ha sido uno de los objetivos clave de la investigación científica en el RHIC

No es fácil explicar con sencillez de dónde viene esta incertidumbre, pero hay ejemplos en la vida cotidiana que tienen algo parecido. La altura de un tono y la duración en el tiempo durante el cual oímos el tono tienen una incertidumbre mutua similar.

Para que las reglas de la Mecánica Cuántica funcionen, es necesario que todos los fenómenos naturales en el mundo de las cosas pequeñas estén regidos por las mismas reglas. Esto incluye a los virus, bacterias e incluso a las personas. Sin embargo, cuanto más grande y más pesado es un objeto más difícil es observar las desviaciones de las leyes del movimiento “clásicas” debidas a la mecánica cuántica.

Me gustaría referirme a esta exigencia tan importante y tan peculiar de la teoría con la palabra “holismo”. Esto no es exactamente lo mismo que entienden algunos filósofos por “holismo”, y que se podría definir como “el todo es más que la suma de las partes”.

Bien, si la Física nos ha enseñado algo, es justamente lo contrario: un objeto compuesto de un gran número de partículas puede ser entendido exactamente si se conocen las propiedades de sus partes (las partículas): basta que uno sepa sumar correctamente (¡y esto no es nada fácil en mecánica cuántica!). Lo que yo entiendo por holismo es que, efectivamente, el todo es la suma de las partes, pero sólo se puede hacer la suma si todas las partes obedecen a las mismas leyes.

Por ejemplo, la constante de Planck, h = 6,626075…x 10 exp. -34 julios segundo, debe ser exactamente la misma para cualquier objeto en cualquier sitio, es decir, debe ser una constante universal.

Las reglas de la mecánica cuántica funcionan tan bien que refutarlas resulta realmente difícil. Los trucos ingeniosos descubiertos por Werner Heisenberg, Paul Dirac y muchos otros mejoraron y completaron las reglas generales. Pero Einstein y otros pioneros tales como Edwin Schrödinger, siempre presentaron serias objeciones a esta interpretación.

¡Y pensar que todo esto está formado por pequeñas partículas infinitesimales!

Quizá funcione bien, pero ¿dónde está exactamente el electrón, en el punto x o en el punto y? Em pocas palabras, ¿dónde está en realidad?, ¿cuál es la realidad que hay detrás de nuestras fórmulas? Si tenemos que creer a Bohr, no tiene sentido buscar tal realidad. Las reglas de la mecánica cuántica, por sí mismas, y las observaciones realizadas con detectores son las únicas realidades de las que podemos hablar.

Hasta hoy, muchos investigadores coinciden con la actitud pragmática de Bohr. Los libros de historia dicen que Bohr demostró que Einstein estaba equivocado. Pero no son pocos, incluyéndome a mí, los que sospechamos que a largo plazo el punto de vista de Einstein volverá: que falta algo en la interpretación de Copenhague. Las objeciones originales de Einstein pueden superarse, pero aún surgen problemas cuando uno trata de formular la mecánica cuántica para todo el Universo (donde las medidas no se pueden repetir) y cuando se trata de reconciliar las leyes de la mecánica cuántica con las de la Gravitación.

La mecánica cuántica y sus secretos han dado lugar a grandes controversias, y la cantidad de disparates que ha sugerido es tan grande que los físicos serios ni siquiera sabrían por donde empezar a refutarlos. Algunos dicen que “la vida sobre la Tierra comenzó con un salto cuántico”, que el “libre albedrío” y la “conciencia” se deben a la mecánica cuántica: incluso fenómenos paranormales han sido descritos como efectos mecanocuánticos.

Yo sospecho que todo esto es un intento de atribuir fenómenos “ininteligibles” a causas también “ininteligibles” (como la mecánica cuántica) dónde el resultado de cualquier cálculo es siempre una probabilidad, nunca una certeza.

Claro que, ahí están esas teorías más avanzadas y modernas que vienen abriendo los nuevos caminos de la Física y que, a mi no me cabe la menor duda, más tarde o más temprano, podrá explicar con claridad esas zonas de oscuridad que ahora tienen algunas teorías y que Einstein señalaba con acierto.

¿No es curioso que, cuando se formula la moderna Teoría M, surjan, como por encanto, las ecuaciones de Einstein de la Relatividad General? ¿Por qué están ahí? ¿Quiere eso decir que la Teoría de Einstein y la Mecánica Cuántica podrán al fin unirse en pacifico matrimonio sin que aparezcan los dichosos infinitos?

Bueno, eso será el origen de otro comentario que también, cualquier día de estos, dejaré aquí para todos ustedes.

emilio silvera

Totales: 83.854.191

Totales: 83.854.191 Conectados: 53

Conectados: 53