Jul

31

¡La Luz! Esa maravilla

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

Grandes pensadores quisieron explicar la naturaleza de la luz

Está claro que, los estudiosos de la época antigua y medieval estaban por completo a oscuras acerca de la naturaleza de la luz. Especulaban sobre que consistía en partículas emitidas por objetos relucientes o tal vez por el mismo ojo. Establecieron el hecho de que la luz viajaba en línea recta, que se reflejaba en un espejo con un ángulo igual a aquel con el que el rayo choca con el espejo, y que un rayo de luz se inclina (se refracta) cuando pasa del aire al cristal, al agua o a cualquier otra sustancia transparente.

Cuando la luz entra en un cristal, o en alguna sustancia transparente, de una forma oblicua (es decir, en un ángulo respecto de la vertical), siempre se refracta en una dirección que forma un ángulo menor respecto de la vertical. La exacta relación entre el ángulo original y el ángulo reflejado fue elaborada por primera vez en 1.621 por el físico neerlandés Willerbrord Snell. No publicó sus hallazgos y el filósofo francés René Descartes descubrió la ley, independientemente, en 1.637.

Siempre nos gustó hacer experimentos con la luz

Los primeros experimentos importantes acerca de la naturaleza de la luz fueron llevados a cabo por Isaac Newton en 1.666, al permitir que un rayo de luz entrase en una habitación oscura a través de una grieta e las persianas, cayendo oblicuamente sobre una cara de un prisma de cristal triangular. El rayo se refracta cuando entra en el cristal y se refracta aún más en la misma dirección cuando sale por una segunda cara del prisma. (Las dos refracciones en la misma dirección se originan por que los dos lados del prisma de se encuentran en ángulo en vez de en forma paralela, como sería el caso en una lámina ordinaria de cristal.)

Newton atrapó el rayo emergente sobre una pantalla blanca para ver el efecto de la refracción reforzada. Descubrió que, en vez de formar una mancha de luz blanca, el rayo se extendía en una gama de colores: rojo, anaranjado, amarillo, verde, azul, y violeta, en este orden.

Newton dedujo de ello que la luz blanca corriente era una mezcla de varias luces que excitaban por separado nuestros ojos para producir las diversas sensaciones de colores. La amplia banda de sus componentes se denominó spectrum (palabra latina que significa “espectro”, “fantasma”).

Newton llegó a la conclusión de que la luz se componía de diminutas partículas (“corpúsculos”), que viajaban a enormes velocidades.

Le surgieron y se planteó algunas inquietudes cuestiones. ¿Por qué se refractaban las partículas de luz verde más que los de luz amarilla? ¿Cómo se explicaba que dos rayos de luz se cruzaran sin perturbase mutuamente, es decir, sin que se produjeran colisiones entre partículas?

Titán, la luna de Saturno, contempla la sonda que lleva su nombre

En 1.678, el físico neerlandés Christian Huyghens (un científico polifacético que había construido el primer reloj de péndulo y realizado importantes trabajos astronómicos) propuso una teoría opuesta: la de que la luz se componía de minúsculas ondas. Y si sus componentes fueran ondas, no sería difícil explicar los diversos difracciones de los diferentes tipos de luz a través de un medio refractante, siempre y cuando se aceptara que la luz se movía más despacio en ese medio refractante que en el aire. La cantidad de refracción variaría con la longitud de las ondas: cuanto más corta fuese tal longitud, tanto mayor sería la refracción. Ello significaba que la luz violeta (la más sensible a este fenómeno) debía de tener una longitud de onda mas corta que la luz azul, ésta, más corta que la verde, y así sucesivamente.

Lo que permitía al ojo distinguir los colores eran esas diferencias entre longitudes de onda. Y, como es natural, si la luz estaba integrada por ondas, dos rayos podrían cruzarse sin dificultad alguna. (Las ondas sonoras y las del agua se cruzan continuamente sin perder sus respectivas identidades.)

Peor la teoría de Huyqhens sobre las ondas tampoco fue muy satisfactoria. No explicaba por qué se movían en línea recta los rayos luminosos; ni por qué proyectaban sombras recortadas; ni aclaraba por qué las ondas luminosas no podían rodear los obstáculos, del mismo modo que pueden hacerlo las ondas sonoras y de agua. Por añadidura, se objetaba que si la luz consistía en ondas, ¿cómo podía viajar por el vacío, ya que cruzaba el espacio desde el Sol y las Estrellas? ¿cuál era esa mecánica ondulatoria?

Interferencia: Sonido más sonido en algunos casos puede producir silencio. Esto sucede cuando dos ondas de sonido se superponen destructivamente, igual como se observa en las zonas nodales de una cuerda en vibración. ¿Será posible que en algún caso luz más luz produzca oscuridad? La respuesta es afirmativa. Quien lo demostrara en 1803, en un famoso experimento, fue Thomas Young (1773-1829). Éste consistió en hacer llegar un haz de luz simultáneamente a dos rendijas muy delgadas y muy cercanas, según se ilustra en el siguiente esquema.

Aproximadamente durante un siglo, contendieron entre sí estas teorías. La teoría corpuscular, de Newton, fue, con mucho, la más popular, en parte, porque la respaldó el famoso nombre de su autor. Pero hacia 1.801, un físico y médico ingles, de nombre Thomas Young, llevó a cabo un experimento que arrastró la opinión pública al campo opuesto. Proyectó un fino rayo luminoso sobre una pantalla, haciéndolo pasar antes por dos orificios casi juntos. Si la luz estuviera compuesta por partículas, cuando los dos rayos emergieran de ambos orificios, formarían presuntamente en la pantalla una región más luminosa donde se superpusieran, y regiones menos brillantes, donde no se diera tal superposición. Pero no fue esto lo que descubrió Young. La pantalla mostró una serie de bandas luminosas, separadas entre sí por bandas oscuras. Pareció incluso que, en esos intervalos de sombra, la luz de ambos rayos contribuía a intensificar la oscuridad.

Sería fácil explicarlo mediante la teoría ondulatoria. La banda luminosa representaba el refuerzo presado por las ondas de un rayo a las ondas del otro. Dicho de otra manera: Entraba “en fase” dos trenes de ondas, es decir, ambos nodos, al unirse, se fortalecían el uno al otro. Por otra parte, las bandas oscuras representaban puntos en que las ondas estaban “desfasadas” porque el vientre de una neutralizaba el nodo de la otra. En vez de aunar sus fuerzas, las ondas se interferían mutuamente, reduciendo la energía luminosa neta a las proximidades del punto cero.

Considerando la anchura de las bandas y la distancia entre los dos edificios por los que surgen ambos rayos, se pudo calcular la longitud de las ondas luminosas, por ejemplo, de la luz roja a la violeta o los colores intermedios. Las longitudes de onda resultaron ser muy pequeñas. Así, la de la luz roja era de unos 0’000075 cm. (Hoy se expresan las longitudes de las ondas luminosas mediante una unidad muy práctica ideada por Angströn. Esta unidad, denominada, en honor a su autor Ángstrom (Á), es la cienmillonésima parte de un centímetro. Así, pues, la longitud de onda de la luz roja equivale más o menos a 7.500 Á, y la de la luz violeta, a 3.900 Å, mientras que las de colores visibles en el espectro oscilan entre ambas cifras.)

La cortedad de estas ondas es muy importante. La razón de que las ondas luminosas se desplacen en línea recta y proyecten sombras recortadas se debe a que todas son incomparablemente más pequeñas que cualquier objeto; pueden contornear un obstáculo sólo si éste no es mucho mayor que la longitud de onda. Hasta las bacterias, por ejemplo, tienen un volumen muy superior de una onda luminosa y, por tanto, la luz puede definir claramente sus contornos bajo el microscopio. Sólo los objetos cuyas dimensiones se asemejan a la longitud de la onda luminosa (por ejemplo, los virus y otras partículas submicroscópicas) son lo suficientemente pequeños como para que puedan ser contorneados por las ondas luminosas.

Augustin Jean Fresnel (1788 – 1827)

Photo: German Museum Munich

Un físico francés, Augustin-Jean Fresnel, fue quien demostró por vez primera, en 1.818, que si un objeto es lo suficientemente pequeño, la onda luminosa lo contorneará sin dificultad. En tal caso, la luz determina el llamado fenómeno de “difracción”. Por ejemplo, las finísimas líneas paralelas de una “reja de disfracción” actúan como una serie de minúsculos obtáculos, que se refuerzan entre si. Puesto que la magnitud de la difracción va asociada a la longitud de onda, se produce el espectro. A la inversa, se puede calcular la longitud de onda midiendo la difracción de cualquier color o porción del espectro, así como la separación de las marcas sobre el cristal.

Fraunhofer exploró dicha reja de difracción con objeto de averiguar sus finalidades prácticas, progreso que suele olvidarse, pues queda eclipsado por su descubrimiento más famoso: los rayos espectrales. El físico americano Henry Augustus Rowlane ideó la reja cóncava y desarrolló técnicas para regularlas de acuerdo con 20.000 líneas por pulgada. Ello hizo posible la sustitución del prisma por el espectroscopio.

Ante tales hallazgos experimentales, más el desarrollo metódico y matemático del movimiento ondulatorio, debido a Fresnel, pareció que la teoría ondulatoria de la luz había arraigado definitivamente, desplazando y relegando para siempre a la teoría corpuscular.

Jacques Babinet

No sólo se aceptó las existencias de ondas luminosas, sino que también se midió su longitud con una precisión cada vez mayor. Hacia 1.827, el físico francés Jacques Babinet sugirió que se empleara la longitud de onda luminosa (una cantidad física inalterable) como unidad para medir tales longitudes, en vez de las muy diversas unidades ideadas y empleadas por el hombre. Sin embargo, tal sugerencia no se llevó a la práctica hasta 1.880 cuando el físico germano-americano Albert Abraham Michelson inventó un instrumento, denominado “interferómetro”, que podía medir las longitudes de ondas luminosas con una exactitud sin precedentes. En 1.893, Michelson midió la onda de la raya roja en el espectro del cadmio y determinó que su longitud era de 1/1.553.164 m.

Pero la incertidumbre reapareció al descubrirse que los elementos estaban compuestos por isótopos diferentes, cada uno de los cuáles aportaba una raya cuya longitud de onda difería ligeramente de las restantes. En la década de 1.930 se midieron las rayas del criptón 86. Como quiera que este isótopo fuera gaseoso, se podía abordar con bajas temperaturas, para frenar el movimiento atómico y reducir el consecutivo engrosamiento de la raya.

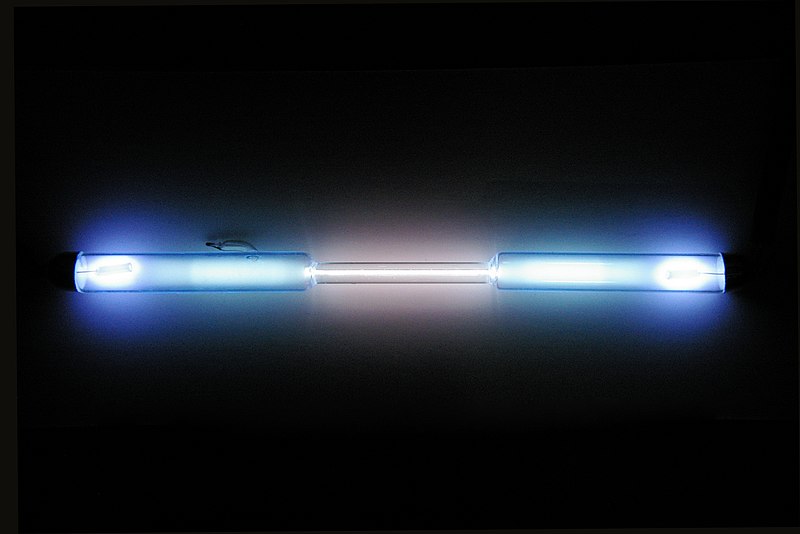

Tubo de descarga lleno de kriptón puro

En 1.960, el Comité Internacional de Pesos y Medidas adoptó la raya del criptón 86 como unidad fundamental de longitud. Entonces se restableció la longitud de metro como 1.650.763’73 veces la longitud de onda de dicha raya espectral. Ello aumento mil veces la precisión de las medidas de longitud. Hasta entonces se había medido el antiguo metro patrón con un margen de error equivalente a una millonésima, mientras que en lo sucesivo se pudo medir la longitud de onda con un margen de error equivalente a una milmillonésima.

Ahora, después de todo esto, sabemos algo más sobre la luz. Pero…, ¿qué pasa con su velocidad?

¡Veámoslo!

La velocidad de la luz, desde hace mucho tiempo, fue un misterio que los estudiosos de la física de la Naturaleza querían desvelar

Está claro que, la luz se desplaza a enormes velocidades. Si pulsamos el interruptor de apagado de la lámpara de nuestro salón, todo queda a oscuras de manera instantánea y, de la misma manera e inmediata, todo se inunda de luz si con una potente linterna encendida, apuntamos hacia un rincón oscuro.

La velocidad del sonido es más lenta, por ejemplo, si vemos a un leñador que está cortando leña en un lugar alejado de nosotros, sólo oiremos los golpes momentos después de que caiga el hacha. Así, pues, el sonido tarda cierto tiempo en llegar a nuestros oídos. En realidad es fácil medir la velocidad de su desplazamiento: unos 1.206 km/h en el aire y a nivel del mar.

Galileo fue el primero en intentar medir la velocidad de la luz. Se colocó en lo alto de una colina, mientras que su ayudante, se situaba en otro lugar alto de la colina vecina; luego sacó una linterna encendida: tan pronto como su ayudante vió la luz, hizo una señal con otra linterna. Galileo repitió el experimento a distancias cada vez mayores, suponiendo que el tiempo requerido por su ayudante para responder mantendría una uniformidad constante, por lo cual, el intervalo entre la señal de su propia linterna y la de su ayudante representaría el tiempo empleado por la luz para recorrer cada distancia. Aunque la idea era lógica, la luz viajaba demasiado aprisa como para que Galileo pudiera percibir las sutiles diferencias con un método tan rudimentario.

En 1.676, el astrónomo danés Olau Roemer logró cronometrar la velocidad de la luz a escala de distancias astronómicas. Estudiando los eclipses de Júpiter en sus cuatro grandes satélites, Roemer observó que el intervalo entre eclipses consecutivos era más largo cuando la Tierra se alejaba de Júpiter, y más corto cuado se movía en su órbita hacía dicho astro. Al parecer, la diferencia entre las duraciones del eclipse reflejaba la diferencia de distancias entre la Tierra y Júpiter. Y trataba, pues, de medir la distancia partiendo del tiempo empleado por la luz para trasladarse desde Júpiter hasta la Tierra. Calculando aproximadamente el tamaño de la órbita terrestre y observando la máxima discrepancia en las duraciones del eclipse que, según Roemer, representaba el tiempo que necesitaba la luz para atravesar el eje de al órbita terrestre, dicho astrónomo computó la velocidad de la luz. Su resultado, de 225.000 km/s., parece excelente si se considera que fue el primer intento, y resultó bastante asombroso como para provocar la incredulidad de sus coetáneos.

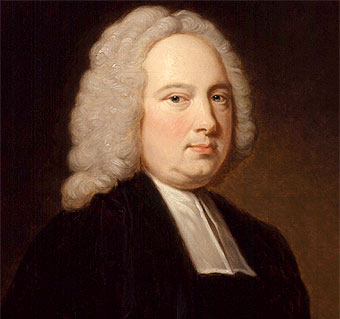

Sin embargo, medio siglo después se confirmaron los cálculos de Roemer en un campo totalmente distinto. Allá por 1.728, el astrónomo británico James Bradley descubrió que las estrellas parecían cambiar de posición con los movimientos terrestres; y no por el paralaje, sino porque la traslación terrestre alrededor del Sol era una fracción mensurable (aunque pequeña) de la velocidad de la luz. La analogía empleada usualmente es la de un hombre que camina con el paraguas abierto bajo un temporal. Aun cuando las gotas caigan verticalmente, el hombre debe inclinar hacia delante el paraguas, porque ha de abrirse paso entre las gotas.

James Bradley descubrió la aberración estelar

Cuanto más acelere su paso, tanto más deberá inclinar el paraguas. De manera semejante la Tierra avanza entre los ligeros rayos que caen desde las estrellas, y el astrónomo debe inclinar un poco su telescopio y hacerlo en varias direcciones, de acuerdo con los cambios de la trayectoria terrestre (no olvidemos que nuestro planeta Tierra, es como una enorme nave espacial que nos lleva en un viaje eterno, alrededor del Sol, a la velocidad de 30 km/s. + -) Mediante ese desvío aparente de los astros (“aberración de la luz”), Bradley pudo evaluar la velocidad de la luz y calcularla con gran precisión.

Sus cálculos fueron de 285.000 km/s, bastante más exacto que los de Roemer, pero aún un 5’5% más bajos. Poco a poco, con medios tecnológicos más sofisticados y más conocimientos matemáticos, los científicos fueron obteniendo medidas más exactas aún, conforme se fue perfeccionando la idea original de Galileo y sus sucesores.

En 1.849, el físico francés Armand-Hippolyte-Louis Fizeau ideó un artificio mediante el cual se proyectaba la luz sobre un espejo situado a 8 km de distancia, que devolvía el reflejo al observador. El tiempo empleado por la luz en su viaje de ida y vuelta no rebasó apenas la 1/20.000 de segundo, por Fizeau logró medirlo colocando una rueda dentada giratoria en la trayectoria del rayo luminoso. Cuando dicha rueda giraba a cierta velocidad, regulada, la luz pasaba entre los dientes y se proyectaba contra el siguiente, al ser devuelta por el espejo; así, Fizeau, colocado tras la rueda, no pudo verla. Entonces se dio más velocidad a la rueda, y el reflejo pasó por la siguiente muesca entre los dientes, sin intercepción alguna. De esa forma, regulando y midiendo la velocidad de la rueda giratoria, Fizeau pudo calcular el tiempo transcurrido y, por consiguiente, la velocidad a que se movía el rayo de luz.

Un año más tarde, Jean Foucault (quien realizaría poco después su experimento con los péndulos) precisó más estas medidas empleando un espejo giratorio en ve de una rueda dentada. Entonces se midió el tiempo transcurrido desviando ligeramente el ángulo de reflexión mediante el veloz espejo giratorio. Foucault obtuvo un valor de la velocidad de la luz de 300.883 km/s. También, el físico francés utilizó su método para determinar la velocidad de la luz a través de varios líquidos. Averiguó que era notablemente inferior a la alcanzada en el aire. Esto concordaba también con la teoría ondulatoria de Huyghens.

Michelson fue más preciso aún en sus medidas. Este autor, durante cuarenta años largos, a partir de 1.879, fue aplicando el sistema Fizeau-Foucault cada vez con mayor refinamiento, para medir la velocidad de la luz. Cuando se creyó lo suficientemente informado, proyectó la luz a través de vacío, en vez de hacerlo a través del aire, pues este frena ligeramente su velocidad, y, empleó para ello tuberías de acero cuya longitud era superior a 1’5 km. Según sus medidas, la velocidad de la luz en el vacío era de 299.730 km(seg. (sólo un 0’006% más bajo). Demostraría también que todas las longitudes de ondas luminosas viajan a la misma velocidad en el vacío.

En 1.972, un equipo de investigadores bajo la dirección de Kenneth M. Eveson efectuó unas mediciones aún más exactas y vio que la velocidad de la luz era de 299.727’74 km/seg. Una vez se conoció la velocidad de la luz con semejante precisión, se hizo posible usar la luz, o por lo menos formas de ella, para medir distancias.

Aunque para algunos resulte alto tedioso el tema anterior, no he podido resistirme a la tentación de exponerlo, así podrá saber algo más sobre la luz y, habrán conocido a personajes que hicieron posible el que ahora nosotros, la conozcamos mejor.

Podría continuar, hasta el final de este trabajo, hablando de la luz y sus distintas formas o aplicaciones: ondas de luz a través del espacio, de cómo se transmite la luz en el “vacío”, nos llega a través del espacio desde Galaxias situadas a miles de millones de años luz; las líneas de fuerzas electromagnéticas de Faraday y Maxwell de campos eléctricos y magnéticos cambiantes (todo ello explicado en un simple conjunto de cuatro ecuaciones, que describían casi todos los fenómenos referentes a esta materia electromagnética), o de los enigmas aún por descubrir (aunque predichos).

Ahora, en Física, se dice que la luz es una forma de radiación electromagnética a la que el ojo humano es sensible y sobre la cual depende nuestra consciencia visual del universo y sus contenidos.

Aparte de todo lo que antes hemos explicado, no sería justo finalizar el trabajo sin exponer aquí que, en 1905, Albert Einstein, inspirado en el cuanto de Planck, realizó un importante avance en el conocimiento de lo que es la luz. Demostró que el Efecto fotoeléstrico sólo podía ser explicado con la hipótesis de que la luz consiste en un chorro de fotones de energía electromagnética discretos. Aquello le valió el Nobel de Física y… ¡Le hurtaron otros dos por las dos partes de su teoría de la relatividad! Una revolución que lo cambió todo y que nunca podremos pagarle.

El conflicto entre la teoría ondulatoria y corpuscular de la luz fue resuelto con la evolución de la teoría cuántica y la mecánica ondulatoria que ha dejado claro que, los electrones y las otras partículas elementales tienen propiedades duales de partículas y onda.

sería mucho más largo, pero creo que está bien con lo dicho.

emilio silvera

Jul

26

Conjeturar… ¡Tratando de saber!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (3)

Comments (3)

¡El Universo! ¿Sabía que nosotros ibamos a venir?

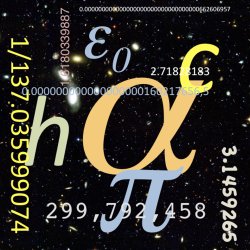

Parece conveniente hacer una pequeña reseña que nos explique que es un principio en virtud del cual la presencia de la vida humana está relacionada con las propiedades del Universo. Como antes hemos comentado de pasada, existen varias versiones del principio antrópico. La menos controvertida es el principio antrópico débil, de acuerdo con el cual la vida humana ocupa un lugar especial en el Universo porque puede evolucionar solamente donde y cuando se den las condiciones ademadas para ello. Este efecto de selección debe tenerse en cuenta cuando se estudian las propiedades del Universo.

Una versión más especulativa, el principio antrópico fuerte, asegura que las leyes de la física deben tener propiedades que permitan evolucionar la vida. La implicación de que el Universo fue de alguna manera diseñado para hacer posible la vida humana hace que el principio antrópico fuerte sea muy controvertido, ya que, nos quiere adentrar en dominios divinos que, en realidad, es un ámbito incompatible con la certeza comprobada de los hechos a que se atiene la ciencia, en la que la fe, no parece tener cabida. Sin embargo, algunos han tratado de hacer ver lo imposible.

“Basado en las propuestas del premio Nobel de física Paul Dirac sobre los ajustados, sincronizados y muy precisos valores de las constantes de la naturaleza, los físicos actuales comienzan a valorar aquello que han denominado el “principio antrópico¨, es decir, poco a poco, a lo largo de los años han entendido que siempre quedará un espacio de información faltante cuando intentamos teorizar o conceptualizar los inicios del universo supeditados exclusivamente sobre la capacidad contenida en las leyes de la física para explicar dichos inicios.”

El principio antrópico nos invita al juego mental de probar a “cambiar” las constantes de la Naturaleza y entrar en el juego virtual de ¿Qué hubiera pasado si…? Especulamos con lo que podría haber sucedido si algunos sucesos no hubieran ocurrido de tal a cual manera para ocurrir de ésta otra. ¿Qué hubiera pasado en el planeta Tierra si no aconteciera en el pasado la caída del meteorito que acabó con los dinosaurios? ¿Habríamos podido estar aquí hoy nosotros? ¿Fue ese cataclismo una bendición para la Humanidad y nos quitó de encima a unos terribles rivales?

Fantasean con lo que pudo ser…. Es un ejercicio bastante habitual, solo tenemos que cambiar la realidad de la historia o de los sucesos verdaderos para pretender fabricar un presente distinto. Cambiar el futuro puede resultar más fácil, nadie lo conoce y no pueden rebatirlo con certeza ¿Quién sabe lo que pasará mañana?

El problema de si las constantes físicas son constantes se las trae. Aparte del trabalenguas terminológico arrastra tras de sí unas profundas consecuencias conceptuales. Lo primero, uno de los pilares fundamentales de la relatividad especial es el postulado de que las leyes de la física son las mismas con independencia del observador. Esto fue una generalización de lo que ya se sabía cuando se comenzó a estudiar el campo electromagnético, pero todo lo que sabemos en la actualidad nos lleva a concluir que este postulado es bastante razonable.

Lo que ocurra en la Naturaleza del Universo está en el destino de la propia Naturaleza del Cosmos, de las leyes que la rigen y de las fuerzas que gobiernan sus mecanismos sometidos a principios y energías que, en la mayoría de los casos, se pueden escapar a nuestro actual conocimiento.

Lo que le pueda ocurrir a nuestra civilización además de estar supeditado al destino de nuestro planeta, de nuestro Sol y de nuestro Sistema Solar y la galaxia, también está en manos de los propios individuos que forman esa civilización y que, con sensibilidades distintas y muchas veces dispares, hace impredecibles los acontecimientos que puedan provocar individuos que participan con el poder individual, es decir, esa parcial disposición que tenemo0s del “libre albedrío”.

¿Cómo sería nuestro mundo si las constantes universales fueran diferentes?

Siempre hemos sabido especular con lo que pudo ser o con lo que podrá ser si…., lo que, la mayoría de las veces, es el signo de cómo queremos ocultar nuestra ignorancia. Bien es cierto que sabemos muchas cosas pero, también es cierto que son más numerosas las que no sabemos.

Sabiendo que el destino irremediable de nuestro mundo, el planeta Tierra, es de ser calcinado por una estrella gigante roja en la que se convertirá el Sol cuando agote la fusión de su combustible de Hidrógeno, Helio, Carbono, etc., para que sus capas exteriores de materia exploten y salgan disparadas al espacio exterior, mientras que, el resto de su masa se contraerá hacia su núcleo bajo su propio peso, a merced de la Gravedad, convirtiéndose en una estrella enana blanca de enorme densidad y de reducido diámetro. Sabiendo eso, el hombre está poniendo los medios para que, antes de que llegue ese momento (dentro de algunos miles de millones de años), poder escapar y dar el salto hacia otros mundos lejanos que, como la Tierra ahora, reúna las condiciones físicas y químicas, la atmósfera y la temperatura adecuadas para acogernos.

El Sol será una Gigante roja y, cuando eso llegue, la Tierra…

Pero el problema no es tan fácil y, se extiende a la totalidad del Universo que, aunque mucho más tarde, también está abocado a la muerte térmica, el frío absoluto si se expande para siempre como un Universo abierto y eterno. A estas alturas se ha descartado el Big Chunch y se saber que la expansión del Universo es imparable y que con el paso del tiempo las galaxias estarán más alejadas las unas de las otras hasta que, la energía, las temperaturas sean -273 ºC, un ámbito de muerte, allí nada -ni siguiera los átomos-, absolutamente nada se mueve.

Nuevos cálculos sugieren que el cosmos puede estar un poco más cerca a una muerte térmica.

Para tener todo ese tumulto — estrellas en erupción, galaxias chocantes, agujeros negros que colapsan – el cosmos es un lugar sorprendentemente ordenado. Los cálculos teóricos han demostrado desde hace mucho que la entropía del universo – una medida de su desorden – no es más que una diminuta fracción de la cantidad máxima permitida.

Un nuevo cálculo de la entropía mantiene este resultado general pero sugiere que el universo está más desordenador de lo que los científicos habían pensado — y ha llegado ligeramente más lejos en su gradual camino hacia la muerte, según concluyen dos cosmólogos australianos.

Un análisis de Chas Egan de la Universidad Nacional Australiana en Canberra y Charles Lineweaver de la Universidad de Nueva Gales del Sur en Sydney indica que la entropía colectiva de todos los agujeros negros supermasivos en el centro de las galaxias es unas 100 veces mayor de lo anteriormente calculado. Debido a que los agujeros negros supermasivos son los mayores contribuyentes a la entropía cósmica, el hallazgo sugiere que la entropía del universo también es 100 veces mayor que la anterior estimación, según informaban los científicos el 23 de septiembre en ArXiv.org.” (fuente: Ciencia Kanija)

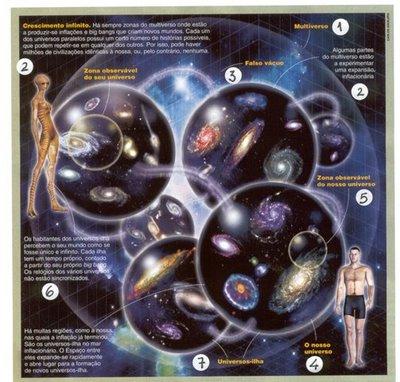

El irreversible final está entre los tres modelos que se han podido construir para el futuro del Universo, de todas las formas que lo miremos es negativo para la Humanidad -si es que puede llegar tan lejos-. En tal situación, algunos ya están buscando la manera de escapar. Stephen Hawking ha llegado a la conclusión de que estamos inmersos en un multiuniverso. Como algunos otros él dice que existen múltiples universos conectados los unos a los otros. Unos tienen constantes de la Naturaleza que permiten vida igual o parecida a la nuestra, otros posibilitan formas de vida muy distintas y otros muchos no permiten ninguna clase de vida.

Este sistema de inflación autorreproductora nos viene a decir que cuando el Universo se expande (se infla) a su vez, esa burbuja crea otras burbujas que se inflan y a su vez continúan creando otras nuevas más allá de nuestro horizonte visible. Cada burbuja será un nuevo Universo, o mini-universo en los que reinarán escenarios diferentes o diferentes constantes y fuerzas.

El escenario que describe la imagen, ha sido explorado y el resultado hallado es que en cada uno de esos universos, como hemos dicho ya, pueden haber muchas cosas diferentes, pueden terminar con diferentes números de dimensiones espaciales o diferentes constantes y fuerzas de la Naturaleza, pudiendo unos albergar la vida y otros no. Claro que, sólo son pensamientos y conjeturas de lo que podría ser.

El reto que queda para los cosmólogos es calcular las probabilidades de que emerjan diferentes universos a partir de esta complejidad inflacionaria ¿Son comunes o raros los universos como el nuestro? Existen, como para todos los problemas planteados diversas conjeturas y consideraciones que influyen en la interpretación de cualquier teoría cosmológica futura cuántico-relativista. Hasta que no seamos capaces de exponer una teoría que incluya la relatividad general de Einstein (la Gravedad-Cosmos y la Mecánica Cuántica-Átomo, no será posible contestar a ciertas preguntas.

Existen en realidad, en nuestro Universo las cuerdas vibrantes de la Teoría M, o, simplemente se trata de un ejercicio mental complejo

Todas las soluciones que buscamos parecen estar situadas en teorías más avanzadas que, al parecer, solo son posibles en dimensiones superiores, como es el caso de la teoría de supercuerdas situada en 10 ó 26 dimensiones, allí, si son compatibles la relatividad y la mecánica cuántica, hay espacio más que suficiente para dar cabida a las partículas elementales, las fuerzas gauge de Yang-Mill, el electromagnetismo de Maxwell y, en definitiva, al espacio-tiempo y la materia, la descripción verdadera del Universo y de las fuerzas que en el actúan.

Científicamente, la teoría del Hiperespacio lleva los nombres de teoría de Kaluza-Klein y súper gravedad. Pero en su formulación más avanzada se denomina teoría de supercuerdas, una teoría que desarrolla su potencial en nueve dimensiones espaciales y una de tiempo, diez dimensiones. Así pues, trabajando en dimensiones más altas, esta teoría del Hiperespacio puede ser la culminación que conoce dos milenios de investigación científica: la unificación de todas las fuerzas físicas conocidas. Como el Santo Grial de la Física, la “teoría de todo” que esquivó a Einstein que la buscó los últimos 30 años de su vida.

Parece que algo no va, algunos parámetros se presentan difusos, la Gravedad no acabamos de entenderla, el mundo infinitesimal… es raro

Durante el último medio siglo, los científicos se han sentido intrigados por la aparente diferencia entre las fuerzas básicas que mantienen unido al al Universo: la Gravedad, el electromagnetismo y las fuerzas nucleares fuerte y débil. Los intentos por parte de las mejores mentes del siglo XX para proporcionar una imagen unificadora de todas las fuerzas conocidas han fracasado. Sin embargo, la teoría del Hiperespacio permite la posibilidad de explicar todas las fuerzas de la Naturaleza y también la aparentemente aleatoria colección de partículas subatómicas, de una forma verdaderamente elegante. En esta teoría del Hiperespacio, la “materia” puede verse también como las vibraciones que rizan el tejido del espacio y del tiempo. De ello se sigue la fascinante posibilidad de que todo lo que vemos a nuestro alrededor, desde los árboles y las montañas a las propias estrellas, no son sino vibraciones del Hiperespacio.

No, no será fácil llegar a las respuestas de éstas difíciles preguntas que la física tiene planteadas. Y, sin embargo, ¿cómo podríamos describir lo que en estas teorías han llegado a causar tanta pasión en esos físicos que llevan años luchando con ellas? Recuerdo haber leído aquella conferencia apasionante que dio E. Witten en el Fermilab. Su pasión y forma de encausar los problemas, sus explicaciones, llevaron a todos los presentes a hacerse fervientes y apasionados fans de aquella maravillosa teoría, la que llaman M. Todos hablaban subyugados mucho después de que el evento hubiera terminado. Según contó León Lederman, que asistió a aquella conferencia: “Yo nunca había visto nada igual, cuando Witten concluyó su charla, hubo muchos segundos de silencio, antes de los aplausos y, tal hecho, es muy significativo.

Claro que, a medida que la teoría ha ido topándose con unas matemáticas cada vez más difíciles y una proliferación de direcciones posibles, el progreso y la intensidad que rodeaban a las supercuerdas disminuyeron hasta un nivel más sensato, y ahora, sólo podemos seguir insistiendo y esperar para observar que nos puede traer el futuro de esta teoría que, es posible (y digo sólo posible) que se pueda beneficiar, de alguna manera, de las actividades del LHC que, en algunas de sus incursiones a ese mundo fantasmagórico de lo infinitesimal, podría -y digo podría- atisbar las sombras que puedan producir las supercuerdas.

No son pocos los físicos capaces que están empeñados en demostrar esa teoría. Por ejemplo, Físicos de SLAC desarrollan una prueba de marco de trabajo dependiente para la Teoría de Cuerdas Crítica. La Teoría de Cuerdas resuelve muchas de las cuestiones que arruinan la mente de los físicos, pero tiene un problema importante — no hay actualmente ningún método conocido para comprobarla y, si las energías requeridas para ello, es la de Planck (1019 GeV), la cosa se pone fea.

Está claro que, al tratar todas estas hipotéticas teorías, no pocos, han pensado que, algún día, se podría realizar el sueño de viajar por el Hiperespacio y, de esa manera, se habría logrado el medio para escapar de la Tierra cuando el momento fatídico, en el cual el Sol se convierta en gigante roja, no podamos seguir aquí.

Aunque muchas consecuencias de esta discusión son puramente teóricas, el viaje en el Hiperespacio (El Hiperespacio en ciencia ficción es una especie de región conectada con nuestro universo gracias a los agujeros de gusano, y a menudo sirve como atajo en los viajes interestelares para viajar más rápido que la luz), si llegara a ser posible, podría proporcionar eventualmente la aplicación más práctica de todas: salvar la vida inteligente, incluso a nosotros mismos de la muerte de este Universo cuando al final llegue el frío o el calor.

También en la teoría de supercuerdas está incluída ¡la Gravedad-Cuántica! Otra Ilusión

Esta nueva teoría de supercuerdas, tan prometedora del hiperespacio es un cuerpo bien definido de ecuaciones matemáticas, podemos calcular la energía exacta necesaria para doblar el espacio y el tiempo o para cerrar agujeros de Gusano que unan partes distantes de nuestro Universo. Por desgracia, los resultados son desalentadores. La energía requerida excede con mucho cualquier cosa que pueda existir en nuestro planeta. De hecho, la energía es mil billones de veces mayor que la energía de nuestros mayores colisionadores de átomos. Debemos esperar siglos, o quizás milenios, hasta que nuestra civilización desarrolle la capacidad técnica de manipular el espacio-tiempo utilizando la energía infinita que podría proporcionar un agujero negro para de esta forma poder dominar el Hiperespacio que, al parecer, es la única posibilidad que tendremos para escapar del lejano fin que se avecina. ¿Qué aún tardará mucho? Sí, pero el tiempo es inexorable y…., la debacle llegará.

Sí, hemos logrado mucho. Arriba tenemos la imagen de la emisión en radio de un magnetar

No existen dudas al respecto, la tarea que nos hemos impuesto es descomunal, imposible para nuestra civilización de hoy pero, ¿y la de mañana, no habrá vencido todas las barreras? Creo que, el hombre es capaz de plasmar en hechos ciertos todos sus pensamientos e ideas, solo necesita tiempo y, como nos ha demostrado DA14 en el presente, ese tiempo que necesitamos, está en manos de la Naturaleza y, nosotros, nada podemos hacer si ella, no nos lo concede. Y, si por desventura es así, todo habrá podido ser, un inmenso sueño ilusionantede lo que podría haber sido si…

¿Dónde estará el límite? ¡No hay límites!

emilio silvera

Jul

25

Los misterios de la Física cuántica, las partículas subatómicas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (6)

Comments (6)

Cuando hablamos del tiempo de vida de una partícula nos estamos refiriendo al tiempo de vida medio, una partícula que no sea absolutamente estable tiene, en cada momento de su vida, la misma probabilidad de desintegrarse. Algunas partículas viven más que otras, pero la vida media es una característica de cada familia de partículas.

También podríamos utilizar el concepto de “semivida”. Si tenemos un gran número de partículas idénticas, la semivida es el tiempo que tardan en desintegrarse la mitad de ese grupo de partículas. La semivida es 0,693 veces la vida media.

Si miramos una tabla de las partículas más conocidas y familiares (fotón, electrón muón tau, la serie de neutrinos, los mesones con sus piones, kaones, etc., y, los Hadrones bariones como el protón, neutrón, lambda, sigma, ksi y omega, en la que nos expliquen sus propiedades de masa, carga, espín, vida media (en segundos) y sus principales manera de desintegración, veríamos como difieren las unas de las otras.

Algunas partículas tienen una vida media mucho más larga que otras. De hecho, la vida media difiere enormemente. Un neutrón por ejemplo, vive 10¹³ veces más que una partícula Sigma⁺, y ésta tiene una vida 10⁹ veces más larga que la partícula sigma cero. Pero si uno se da cuenta de que la escala de tiempo “natural” para una partícula elemental (que es el tiempo que tarda su estado mecánico-cuántico, o función de ondas, en evolucionar u oscilar) es aproximadamente 10ˉ²⁴ segundos, se puede decir con seguridad que todas las partículas son bastantes estables. En la jerga profesional de los físicos dicen que son “partículas estables”.

Lo que resulta de una colisión de haces de partículas en el LHC

¿Cómo se determina la vida media de una partícula? Las partículas de vida larga, tales como el neutrón y el muón, tienen que ser capturadas, preferiblemente en grandes cantidades, y después se mide electrónicamente su desintegración. Las partículas comprendidas entre 10ˉ¹⁰ y 10ˉ⁸ segundos solían registrarse con una cámara de burbujas, pero actualmente se utiliza con más frecuencia la cámara de chispas. Una partícula que se mueve a través de una cámara de burbujas deja un rastro de pequeñas burbujas que puede ser fotografiado. La Cámara de chispas contiene varios grupos de de un gran número de alambres finos entrecruzados entre los que se aplica un alto voltaje. Una partícula cargada que pasa cerca de los cables produce una serie de descargas (chispas) que son registradas electrónicamente. La ventaja de esta técnica respecto a la cámara de burbujas es que la señal se puede enviar directamente a una computadora que la registra de manera muy exacta.

Una partícula eléctricamente neutra nunca deja una traza directamente, pero si sufre algún tipo de interacción que involucre partículas cargadas (bien porque colisionen con un átomo en el detector o porque se desintegren en otras partículas), entonces desde luego que pueden ser registradas. Además, realmente se coloca el aparato entre los polos de un fuerte imán. Esto hace que la trayectoria de las partículas se curve y de aquí se puede medir la velocidad de las partículas. Sin embargo, como la curva también depende de la masa de la partícula, es conveniente a veces medir también la velocidad de una forma diferente.

En un experimento de altas energías, la mayoría de las partículas no se mueven mucho más despacio que la velocidad de la luz. Durante su carta vida pueden llegar a viajar algunos centímetros y a partir de la longitud media de sus trazas se puede calcular su vida. Aunque las vidas comprendidas entre 10ˉ¹³ y 10ˉ²⁰ segundos son muy difíciles de medir directamente, se pueden determinar indirectamente midiendo las fuerzas por las que las partículas se pueden transformar en otras. Estas fuerzas son las responsables de la desintegración y, por lo tanto, conociéndolas se puede calcular la vida de las partículas, Así, con una pericia ilimitada los experimentadores han desarrollado todo un arsenal de técnicas para deducir hasta donde sea posible todas las propiedades de las partículas. En algunos de estos procedimientos ha sido extremadamente difícil alcanzar una precisión alta. Y, los datos y números que actualmente tenemos de cada una de las partículas conocidas, son los resultados acumulados durante muchísimos años de medidas experimentales y de esa manera, se puede presentar una información que, si se valorara en horas de trabajo y coste de los proyectos, alcanzaría un precio descomunal pero, esa era, la única manera de ir conociendo las propiedades de los pequeños componentes de la materia.

Que la mayoría de las partículas tenga una vida media de 10ˉ⁸ segundos significa que son ¡extremadamente estables! La función de onda interna oscila más de 10²² veces/segundo. Este es el “latido natural de su corazón” con el cual se compara su vida. Estas ondas cuánticas pueden oscilar 10ˉ⁸ x 10²², que es 1¹⁴ o 100.000.000.000.000 veces antes de desintegrarse de una u otra manera. Podemos decir con toda la seguridad que la interacción responsable de tal desintegración es extremadamente débil.

Aunque la vida de un neutrón sea mucho más larga (en promedio un cuarto de hora), su desintegración también se puede atribuir a la interacción débil. A propósito, algunos núcleos atómicos radiactivos también se desintegran por interacción débil, pero pueden necesitar millones e incluso miles de millones de años para ello. Esta amplia variación de vidas medias se puede explicar considerando la cantidad de energía que se libera en la desintegración. La energía se almacena en las masas de las partículas según la bien conocida fórmula de Einstein E = Mc². Una desintegración sólo puede tener lugar si la masa total de todos los productos resultantes es menor que la masa de la partícula original. La diferencia entre ambas masas se invierte en energía de movimiento. Si la diferencia es grande, el proceso puede producirse muy rápidamente, pero a menudo la diferencia es tan pequeña que la desintegración puede durar minutos o incluso millones de años. Así, lo que determina la velocidad con la que las partículas se desintegran no es sólo la intensidad de la fuerza, sino también la cantidad de energía disponible.

Si no existiera la interacción débil, la mayoría de las partículas serían perfectamente estables. Sin embargo, la interacción por la que se desintegran las partículas π°, η y Σ° es la electromagnética. Se observará que estas partículas tienen una vida media mucho más corta, aparentemente, la interacción electromagnética es mucho más fuerte que la interacción débil.

Durante la década de 1950 y 1960 aparecieron tal enjambre de partículas que dio lugar a esa famosa anécdota de Fermi cuando dijo: “Si llego a adivinar esto me hubiera dedicado a la botánica.”

Si la vida de una partícula es tan corta como 10ˉ²³ segundos, el proceso de desintegración tiene un efecto en la energía necesaria para producir las partículas ante de que se desintegre. Para explicar esto, comparemos la partícula con un diapasón que vibra en un determinado modo. Si la “fuerza de fricción” que tiende a eliminar este modo de vibración es fuerte, ésta puede afectar a la forma en la que el diapasón oscila, porque la altura, o la frecuencia de oscilación, está peor definida. Para una partícula elemental, esta frecuencia corresponde a su energía. El diapasón resonará con menor precisión; se ensancha su curva de resonancia. Dado que para esas partículas extremadamente inestable se miden curvas parecidas, a medida se las denomina resonancias. Sus vidas medias se pueden deducir directamente de la forma de sus curvas de resonancia.

Un ejemplo típico de una resonancia es la delta (∆), de la cual hay cuatro especies ∆ˉ, ∆⁰, ∆⁺ y ∆⁺⁺(esta última tiene doble carga eléctrica). Las masas de las deltas son casi iguales 1.230 MeV. Se desintegran por la interacción fuerte en un protón o un neutrón y un pión.

Existen tanto resonancias mesónicas como bariónicas . Las resonancias deltas son bariónicas. Las resonancias deltas son bariónicas. (También están las resonancias mesónicas rho, P).

Las resonancias parecen ser solamente una especie de versión excitada de los Hadrones estable. Son réplicas que rotan más rápidamente de lo normal o que vibran de diferente manera. Análogamente a lo que sucede cuando golpeamos un gong, que emite sonido mientras pierde energía hasta que finalmente cesa de vibrar, una resonancia termina su existencia emitiendo piones, según se transforma en una forma más estable de materia.

Por ejemplo, la desintegración de una resonancia ∆ (delta) que se desintegra por una interacción fuerte en un protón o neutrón y un pión, por ejemplo:

∆⁺⁺→р + π⁺; ∆⁰→р + πˉ; o п+π⁰

En la desintegración de un neutrón, el exceso de energía-masa es sólo 0,7 MeV, que se puede invertir en poner en movimiento un protón, un electrón y un neutrino. Un Núcleo radiactivo generalmente tiene mucha menos energía a su disposición.

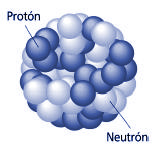

Masa atómica

Una de las formas como los científicos miden el tamaño de algo es a través de su masa. Los científicos pueden incluso medir cosas muy minúsculas como los átomos. Una medida del tamaño de un átomo es su “masa atómica”. Casi toda la masa de un átomo (más del 99%) está en su núcleo, de manera que la “masa atómica” es realmente una medida del tamaño del núcleo de un átomo.

Los protones son practicamente del mismo tamaño que los neutrones, y ambos son mucho más grandes que los electrones. Un protón tiene una masa aproximadamente 1.836 veces mayor que la masa del electrón, pero las masas de los protones y neutrones se diferencian menos de uno por ciento. Un protón tiene una masa de 1.6726 x 10-24gramos. Los protones tienen una carga eléctrica positiva, conocida a veces como carga elemental, carga fundamental o carga de +1. Los electrones tienen una carga del mismo valor pero de polaridad opuesta, -1. La carga fundamental tiene un valor de 1.602 x 10-19 coulombios.

Núcleo atómico

El núcleo de un átomo contiene protones y neutrones. Cada elemento (como el carbono, oxígeno o el oro) tiene diferente número de protones en sus átomos. Los científicos tienen un nombre especial para el número de protones en un átomo. Lo llaman “número atómico”.

¿Por qué es importante el número atómico? Los átomos normales tienen el mismo número de electrones que protones. El número de electrones es lo que hace que cada elemento se comporte de cierta manera en reacciones químicas. De manera que el número atómico, que es el número de protones y electrones, es lo que hace que un elemento sea diferente a otro.

Hace algunos años ya que los físicos se preguntaban: ¿Podrían los protones ser puntos? Y, tratándo de saberlo, comenzaron a golpear los protones con otros protones de una energía muy baja (al principio) con el objeto de explorar la fuerza electromagnética entre los dos objetos cargados.

El Acelerador Lineal de Stanford. El SLAC, ubicado al sur de San Francisco, acelera electrones y positrones a lo largo de sus 2 millas de longitud (algo mas de tres kilómetros), hacia varios blancos, anillos y detectores ubicados en su finalización. Este acelerador hace colisionar electrones y positrones, estudiando las partículas resultantes de estas colisiones. Construido originalmente en 1962, se ha ido ampliando y mejorando para seguir siendo uno de los centros de investigación de física de partículas mas avanzados del mundo. El Centro ha ganado el premio Nobel en tres ocasiones.

El estudio de los componentes de la materia tiene una larga historia en su haber, y, muchos son los logros conseguidos y muchos más los que nos quedan por conseguir, ya que, nuestros conocimientos de la masa y de la energía (materia), es aún limitado.

Generalmente las llamamos partículas elementales pero, lo cierto es que, algunas son más elementales que otras. Los físicos experimentadores hicieron un buen trabajo en aquellos antiguos aceleradores de partículas por despejar la incognita y saber, de una vez por todas, de qué estava hecha la materia.

Los núcleos de los átomos están formados por protones y neutrones, alrededor de los cuales orbitan los electrones. Estos tres elementos (protones, neutrones y electrones) constituyen prácticamente toda la materia de la Tierra. Mientras que el electrón se considera como una partícula “sin tamaño”, el protón, que está compuesto de quarks, es un objeto con tamaño específico. Hasta ahora, sólo dos métodos se han utilizado para medir su radio. Basándose en el estudio de las interacciones entre un protón y un electrón, ambos métodos se centran en las colisiones entre uno y otro o sobre el átomo de hidrógeno (constituido por un electrón y un protón). El valor obtenido y que es el utilizado por los físicos, es 0,877 (+ / – 0,007) femtómetros.

Si los físicos experimentales de la década de los 60 hubieran podido tener a su disposición el moderno LHC… ¿Dónde estaríamos ahora?

La interacción fuerte es cien veces más intensa que la fuerza eléctrica de Coulomb, pero, al contrario que ésta, su alcance no es en absoluto infinito. Se extiende sólo hasta una distancia de unos 10-13 centímetros, y luego cae deprisa a cero. Al incrementar la energía de colisión, los experimentos desenterraron más y más detalles desconocidos de la interacción fuerte. A medida que aumenta la energía, la longitud de onda de los protones (acordémonos de De Broglie y Schrödinger) se encoge. Y, como se pudo ver, cuanto menor sea la longitud de onda , más detalles cabe discernir en la partícula que se estudie.

Robert Hofstadter, de la Universidad de Stantanford, tomó en los años cincuenta algunas de las mejores “imágenes” del protón. En vez de un haz de protones, la “luz” que utilizó fue un haz de electrones de 800 MeV que apuntó a un pequeño recipiente de hidrógeno líquido. Los electrones bombardearon los protones del hidrógeno y el resultado fue un patrón de dispersión, el de los electrones que salían en una variedad de direcciones con respecto a su movimiento original. No era muy diferente a lo que hizo Rutherford. Al contrario que el protón, el electrón no responde a la interacción nuclear fuerte. Responde sólo a la carga eléctrica del protón, y por ello los científicos de Stanford pudieron explorar la forma de la distribución de carga del protón. Y esto, de hecho, reveló el tamaño del protón. Claramente no era un punto.

Se midió que el radio del protón era de 2,8 x 10-13 centímetros; la carga se acumula en el centro, y se desvanece en los bordes de lo que llamamos el protón. Los experimentos se repitieron muchas veces y los resultados, siempre fueron parecidos al hacerlos con haces de muones, que también ignoran la interacción fuerte al ser leptones como los electrones. (Medidas más precisas llevadas a cabo en nuestro tiempo, han podido detectar, diminutos cambios en el radio del protón que tienen enormes implicaciones. El protón parece ser 0,00000000000003 milímetros más pequeño de lo que los investigadores habían pensado anteriormente, de hecho, y según han comentados los físicos del equipo que hizo el trabajo, las nuevas medidas podrían indicar que hay un hueco en las teorías existentes de la mecánica cuántica y algo falla en alguna parte.)

La imágen tomada en el SLAC, nos choca, todos tenemos en la mente las del LHC

Pero sigamos con la historia. Hallá por el año 1968, los físicos del Centro del Acelerador Lineal Stanford (SLAC), bombarderon los protones con electrones de mucha energía -de 8 a 15 GeV- y obtuvieron un conjunto muy diferente de patrones de dispersión. A esta “luz dura”, el protón presentaba un aspecto completamente distinto. Los electrones de energía relativamente baja que empleó Hofstadter podían ver sólo un protón “borroso”, una distribución regular de carga que hacía que el electrón pareciése una bolita musgosa. Los electrones del SLAC pudieron sondear con mayor dureza y dieron con algunos “personajillos” que “correteaban” dentro del protón. Aquella fue la primera indicación de la existencia real de los Quarks.

Hablando de partículas y de física cuántica nos podríamos llevar muchos días, meses y años y escribir todo lo que hasta el momento se ha descubierto en este campo sería una tarea imposible en un lugar como éste en el que los trabajos, son indicativos y particularmente sencillos para que, los lectores visitantes, tengan una sencilla idea de los temas que se comentan, así que, en relaciòn a éste, aquí lo dejamos.

emilio silvera

Jul

25

¡La Materia! ¿Qué será en realidad? Algunos apuntan a las...

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (1)

Comments (1)

Aunque de extraña y atípica figura, también, esta galaxia, está hecha de materia

Tiene y encierra tantos misterios la materia que estamos aún y años-luz de saber y conocer sobre su verdadera naturaleza. Es algo que vemos en sus distintas formas materiales que configuran y conforman todo lo material desde las partículas elementales hasta las montañas y los océanos. Unas veces está en estado “inerte” y otras, se eleva hasta la vida que, incluso en ocasiones, alcanza la consciencia de SER.

Nos podríamos preguntar miles de cosas que no sabríamos contestar. Nos maravillan y asombran fenómenos naturales que ocurren ante nuestros ojos pero que tampoco sabemos, en realidad, a que son debidos. Si, sabemos ponerles etiquetas como, por ejemplo, la fuerza nuclear débil, la fisión espontánea que tiene lugar en algunos elementos como el protactinio o el torio y, con mayor frecuencia, en los elementos que conocemos como transuránicos.

A medida que los núcleos se hacen más grandes, la probabilidad de una fisión espontánea aumenta. En los elementos más pesados de todos (einstenio, fermio y mendelevio), esto se convierte en el método más importante de ruptura, sobrepasando a la emisión de partículas alfa.

¡Parece que la materia está viva!

Son muchas las cosas que desconocemos y, nuestra curiosidad nos empuja continuamente a buscar esas respuestas.

El electrón y el positrón son notables por sus pequeñas masas (sólo 1/1.836 de la del protón, el neutrón, el antiprotón o antineutrón), y, por lo tanto, han sido denominados leptones (de la voz griega lepto que significa “delgado”).

Aunque el electrón fue descubierto en 1.897 por el físico británico Josepth John Thomson (1856-1940), el problema de su estructura, si la hay, no está resuelto. Conocemos su masa y su carga negativa que responden a 9,1093897 (54)x10-31kg la primera y, 1,602 177 33 (49)x10-19 culombios, la segunda, y también su radio clásico. No se ha descubierto aún ninguna partícula que sea menos masiva que el electrón (o positrón) y que lleve una carga eléctrica, sea lo que fuese (sabemos como actúa y cómo medir sus propiedades, pero aun no sabemos qué es), tenga asociada un mínimo de masa, y que esta es la que se muestra en el electrón.

Josepth John Thomson

Lo cierto es que, el electrón, es una maravilla en sí mismo. El Universo no sería como lo conocemos si el electrón (esa cosita “insignificante”), fuese distinto a como es, bastaría un cambio infinitesimal para que, por ejemplo, nosotros no pudiéramos estar aquí ahora.

(“Aunque no se trata propiamente de la imagen real de un electrón, un equipo de siete científicos suecos de la Facultad de Ingeniería de la Universidad de Lund consiguieron captar en vídeo por primera vez el movimiento o la distribución energética de un electrón sobre una onda de luz, tras ser desprendido previamente del átomo correspondiente.

Previamente dos físicos de la Universidad Brown habían mostrado películas de electrones que se movían a través de helio líquido en el International Symposium on Quantum Fluids and Solids del 2006. Dichas imágenes, que mostraban puntos de luz que bajaban por la pantalla fueron publicadas en línea el 31 de mayo de 2007, en el Journal of Low Temperature Physics.

En el experimento que ahora nos ocupa y dada la altísima velocidad de los electrones el equipo de investigadores ha tenido que usar una nueva tecnología que genera pulsos cortos de láser de luz intensa (“Attoseconds Pulses”), habida cuenta que un attosegundo equivalente a la trillonésima parte de un segundo”.)

¡No por pequeño, se es insignificante!

Recordémoslo, todo lo grande está hecho de cosas pequeñas.

Louis de Broglie

En realidad, existen partículas que no tienen en absoluto asociada en ellas ninguna masa (es decir, ninguna masa en reposo). Por ejemplo, las ondas de luz y otras formas de radiación electromagnéticas se comportan como partículas (Einstein en su efecto fotoeléctrico y De Broglie en la difracción de electrones.)

Imagen ilustrativa de la dualidad onda-partícula, en el cual se puede ver cómo un mismo fenómeno puede tener dos percepciones distintas. Esta manifestación en forma de partículas de lo que, de ordinario, concebimos como una onda se denomina fotón, de la palabra griega que significa “luz”.

El fotón tiene una masa de 1, una carga eléctrica de 0, pero posee un espín de 1, por lo que es un bosón. ¿Cómo se puede definir lo que es el espín? Los fotones toman parte en las reacciones nucleares, pero el espín total de las partículas implicadas antes y después de la reacción deben permanecer inmutadas (conservación del espín). La única forma que esto suceda en las reacciones nucleares que implican a los fotones radica en suponer que el fotón tiene un espín de 1. El fotón no se considera un leptón, puesto que este termino se reserva para la familia formada por el electrón, el muón y la partícula Tau con sus correspondientes neutrinos: Ve, Vu y VT.

Existen razones teóricas para suponer que, cuando las masas se aceleran (como cuando se mueven en órbitas elípticas en torno a otra masa o llevan a cabo un colapso gravitacional), emiten energía en forma de ondas gravitacionales. Esas ondas pueden así mismo poseer aspecto de partícula, por lo que toda partícula gravitacional recibe el nombre de gravitón.

La fuerza gravitatoria es mucho, mucho más débil que la fuerza electromagnética. Un protón y un electrón se atraen gravitacionalmente con sólo 1/1039 de la fuerza en que se atraen electromagnéticamente. El gravitón (aún sin descubrir) debe poseer, correspondientemente, menos energía que el fotón y, por tanto, ha de ser inimaginablemente difícil de detectar.

De todos modos, el físico norteamericano Joseph Weber emprendió en 1.957 la formidable tarea de detectar el gravitón. Llegó a emplear un par de cilindros de aluminio de 153 cm. De longitud y 66 de anchura, suspendidos de un cable en una cámara de vacío. Los gravitones (que serían detectados en forma de ondas), desplazarían levemente esos cilindros, y se empleó un sistema para detectar el desplazamiento que llegare a captar la cienmillonésima parte de un centímetro.

Joseph Weber

El interferómetro funciona enviando un haz de luz que se separa en dos haces; éstos se envían en direcciones diferentes a unos espejos donde se reflejan de regreso, entonces los haces al combinarse presentarán interferencia.

Las débiles ondas de los gravitones, que producen del espacio profundo, deberían chocar contra todo el planeta, y los cilindros separados por grandes distancias se verán afectados de forma simultánea. En 1.969, Weber anunció haber detectado los efectos de las ondas gravitatorias. Aquello produjo una enorme excitación, puesto que apoyaba una teoría particularmente importante (la teoría de Einstein de la relatividad general). Desgraciadamente, nunca se pudo comprobar mediante las pruebas realizadas por otros equipos de científicos que duplicaran el hallazgo de Weber.

De todas formas, no creo que, a estas alturas, nadie pueda dudar de la existencia de los gravitones, el bosón mediador de la fuerza gravitatoria. La masa del gravitón es 0, su carga es 0, y su espín de 2. Como el fotón, no tiene antipartícula, ellos mismos hacen las dos versiones.

Tenemos que volver a los que posiblemente son los objetos más misteriosos de nuestro Universo: Los agujeros negros. Si estos objetos son lo que se dice (no parece que se pueda objetar nada en contrario), seguramente serán ellos los que, finalmente, nos faciliten las respuestas sobre las ondas gravitacionales y el esquivo gravitón.

Imagen de un agujero negro en el núcleo de una galaxia arrasando otra próxima- NASA

La onda gravitacional emitida por el agujero negro produce una ondulación en la curvatura del espacio-temporal que viaja a la velocidad de la luz transportada por los gravitones.

¿Espuma cuántica? Si profundizamos mucho en la materia…

Hay aspectos de la física que me dejan totalmente sin habla, me obligan a pensar y me transporta de este mundo material nuestro a otro fascinante donde residen las maravillas del Universo. Hay magnitudes asociadas con las leyes de la gravedad cuántica. La longitud de Planck-Wheeler, ![]() es la escala de longitud por debajo de la cual el espacio tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro.

es la escala de longitud por debajo de la cual el espacio tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro.

“Una investigación ha llevado a pensar que, la materia se construye sobre fundamentos frágiles. Los físicos acaban de confirmar que la materia, aparentemente sustancial, es en realidad nada más que fluctuaciones en el vació cuántico. Los investigadores simularon la frenética actividad que sucede en el interior de los protones y neutrones, que como sabéis son las partículas que aportan casi la totalidad de la masa a la materia común.

Eso permitirá a los físicos someter a prueba a la QCD y buscar sus efectos más allá de la física conocida. Por ahora, los cálculos demuestran que la QCD describe partículas basadas en quarks de forma precisa, y que la mayor parte de nuestra masa viene de quarks virtuales y gluones que burbujean en el vacío cuántico.

Se cree que el campo de Higgs hace también su pequeña contribución, dando masa a los quarks individuales, así como a los electrones y a otras varias partículas. El campo de Higgs también crea masa a partir del vacío cuántico, en forma de bosones virtuales de Higgs. De modo que si el LHC confirma la existencia del bosón de Higgs, eso significará que toda la realidad es virtual.”

De todo lo anterior, no poemos obtener una respuesta cierta y científicamente probada de que todo eso sea así, más bien, los resultados indican que todo eso “podría ser así”, lo que ocurre es que, los científicos, a veces se dejan llevar por las emociones.

Ya nos gustaría saber cómo es, ese vacío cuántico y qué pasa allí

Me llama poderosamente la atención lo que conocemos como las fluctuaciones de vacío, esas oscilaciones aleatorias, impredecibles e ineliminables de un campo (electromagnético o gravitatorio), que son debidas a un tira y afloja en el que pequeñas regiones del espacio toman prestada momentáneamente energía de regiones adyacentes y luego la devuelven. Hace un par de días que hablamos de ello.

Ordinariamente, definimos el vacío como el espacio en el que hay una baja presión de un gas, es decir, relativamente pocos átomos o moléculas. En ese sentido, un vacío perfecto no contendría ningún átomo o molécula, pero no se puede obtener, ya que todos los materiales que rodean ese espacio tienen una presión de vapor finita. En un bajo vacío, la presión se reduce hasta 10-2 pascales, mientras que un alto vacío tiene una presión de 10-2-10-7 pascales. Por debajo de 10-7 pascales se conoce como un vacío ultraalto.

No puedo dejar de referirme al vaciotheta (vació θ) que, es el estado de vacío de un campo gauge no abeliano (en ausencia de campos fermiónicos y campos de Higgs). En el vacío theta hay un número infinito de estados degenerados con efecto túnel entre estos estados. Esto significa que el vacío theta es análogo a una funciónn de Bloch en un cristal.

Se puede derivar tanto como un resultado general o bien usando técnicas de instantón. Cuando hay un fermión sin masa, el efecto túnel entre estados queda completamente suprimido.

Cuando hay campos fermiónicos con masa pequeña, el efecto túnel es mucho menor que para campos gauge puros, pero no está completamente suprimido.

emilio silvera

* Dualidad onda partícula en el comportamiento del electrón, por ejemplo.

* Teorema de Bloch: relativo a la M.C. de los Cristales, que estable que la función de ondas Ψ (π)=exp (ik’π) U (π).

Jul

24

¡Hacia el futuro! Pero… despacito.

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (4)

Comments (4)

Los ordenadores cuánticos serán «los más seguros» del mercado

El premio Príncipe de Asturias, Ignacio Cirac, cree que podrán comercializarse en un plazo entre 10 y 50 años

Las investigaciones teóricas sobre física cuántica van por buen camino, pero todavía están muy lejos de traducirse en aplicaciones prácticas en el campo de la informática. La comunidad científica ha depositado grandes esperanzas en los ordenadores cuánticos, que permitirán realizar cálculos que no pueden resolverse con los ordenadores actuales –los que trabajan según las leyes clásicas de los ceros y unos-. Sin embargo, su comercialización podría tardar entre diez y cincuenta años. «Estoy convencido de que va a suceder, lo que no sé es si voy a vivir para verlo», añade Ignacio Cirac, director de la División Teórica Max-Plank de Óptica Cuántica de Garching (Alemania).

Así lo defendió en el marco de la 34 Bienal de la Real Sociedad de Física Española, que se celebra estos días en Valencia. Renuente a lanzar promesas cortoplacistas de difícil cumplimiento, este científico recordó que los avances en esta matería están todavía «a un nivel muy fundamental».

Uno de los aspectos más interesantes de los sistemas de compuitación basados en mecánica cuántica es la seguridad. «La física cuántica permite codificar la información de manera que se destruya en el momento en que cualquier persona no autorizada quiera leer el mensaje», explica. La diferencia con respecto a los sistemas actuales es que la información no puede interceptarse porque no pasa por ningún lugar. «Desaparece una vez lo envía el emisor y aparece de nuevo en el aparato del receptor, como por arte de magia». Se abre por tanto un nuevo reto para los «hackers».

Totales: 83.830.196

Totales: 83.830.196 Conectados: 52

Conectados: 52