Ago

29

De la vida y la muerte de las partículas y…otros aspectos

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Por aquel tiempo pudimos leer en la prensa de todo el mundo: ESTOCOLMO, Suecia.- El premio Nobel de Física (2.008) fue atribuido hoy al norteamericano Yoichiro Nambu y a los japoneses Makoto Kobayashi y Toshihide Maskawa por sus trabajos separados sobre la física de las partículas que mejoraron la comprensión de la materia, Demos un repaso hoy aquí a esos componentes de la materia, y, profundicemos en sus propiedades., en sus “vidas”.

Cuando hablamos del tiempo de vida de una partícula nos estamos refiriendo al tiempo de vida media, una partícula que no sea absolutamente estable tiene, en cada momento de su vida, la misma probabilidad de desintegrarse. Algunas partículas viven más que otras, pero la vida media es una característica de cada familia de partículas.

También podríamos utilizar el concepto de “semivida”. Si tenemos un gran número de partículas idénticas, la semivida es el tiempo que tardan en desintegrarse la mitad de ese grupo de partículas. La semivida es 0,693 veces la vida media.

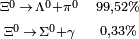

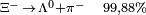

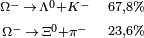

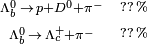

Si miramos una tabla de las partículas más conocidas y familiares (fotón, electrón muón tau, la serie de neutrinos, los mesones con sus piones, kaones, etc., y, los Hadrones bariones como el protón, neutrón, lambda, sigma, ksi y omega, en la que nos expliquen sus propiedades de masa, carga, espín, vida media (en segundos) y sus principales manera de desintegración, veríamos como difieren las unas de las otras.

| Quarks | Antiquarks | ||||||||

|---|---|---|---|---|---|---|---|---|---|

| Nombre | Símbolo[1] | Generación | Carga eléctrica (e) |

Masa en reposo (MeV/c²) |

Nombre | Símbolo | Generación | Carga eléctrica (e) |

Masa en reposo (MeV/c²) |

| Arriba |  |

Primera |  |

— | Antiarriba |  |

Primera |  |

— |

| Abajo |  |

Primera |  |

— | Antiabajo |  |

Primera |  |

— |

| Encanto |  |

Segunda |  |

— | Antiencanto |  |

Segunda |  |

— |

| Extraño |  |

Segunda |  |

— | Antiextraño |  |

Segunda |  |

— |

| Cima |  |

Tercera |  |

— | Anticima |  |

Tercera |  |

— |

| Fondo |  |

Tercera |  |

— | Antifondo |  |

Tercera |  |

— |

- Las iniciales de los símbolos los toma del inglés: u: up, arriba; d: down, abajo; c: charmed, encantado; s: strange, extraño; t: top, alto, superior, cima; b: bottom bajo, fondo.

Algunas partículas tienen una vida media mucho más larga que otras. De hecho, la vida media difiere enormemente. Un neutrón por ejemplo, vive 10¹³ veces más que una partícula Sigma⁺, y ésta tiene una vida 10⁹ veces más larga que la partícula sigma cero. Pero si uno se da cuenta de que la escala de tiempo “natural” para una partícula elemental (que es el tiempo que tarda su estado mecánico-cuántico, o función de ondas, en evolucionar u oscilar) es aproximadamente 10ˉ²⁴ segundos, se puede decir con seguridad que todas las partículas son bastantes estables. En la jerga profesional de los físicos dicen que son “partículas estables”.

Todas las partículas elementales vistas hasta ahora en esta serie, incluido el neutrino. Claro que, aquí no está todavía el Bosón de Higgs que será confirmado en breve…al parecer. Esas son las últimas noticias, el Bosón de Higgs está “casi” localizado y sólo está a la espera de confirmar el hallazgo no una, sino miles de veces.

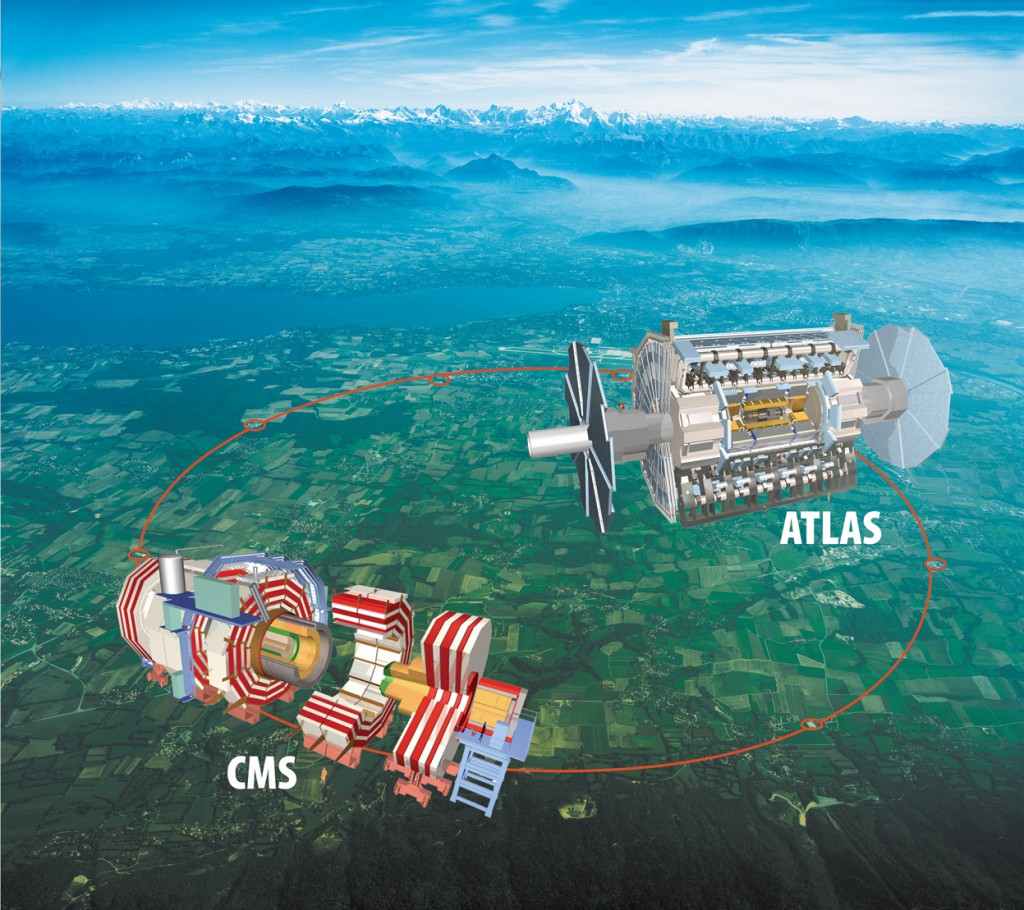

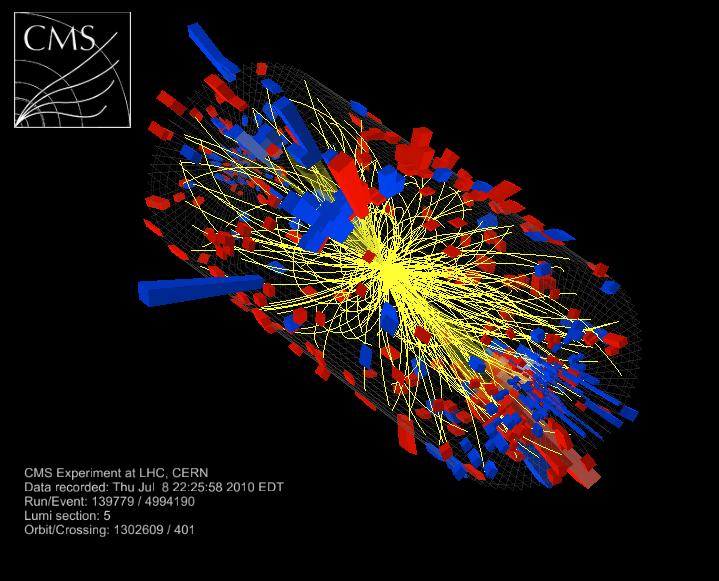

Por fin, los físicos empiezan a recoger los frutos de una búsqueda que dura ya casi cincuenta años. Dos de los principales detectores del LHC, el gran acelerador europeo de partículas (el Atlas y el CMS) han encontrado señales que podrían delatar la presencia del esquivo bosón de Higgs, la última particula subatómica que queda por descubrir para completar el Modelo Estandar de la Física y la que encierra, además, el secreto de por qué las demás partículas tienen masa.

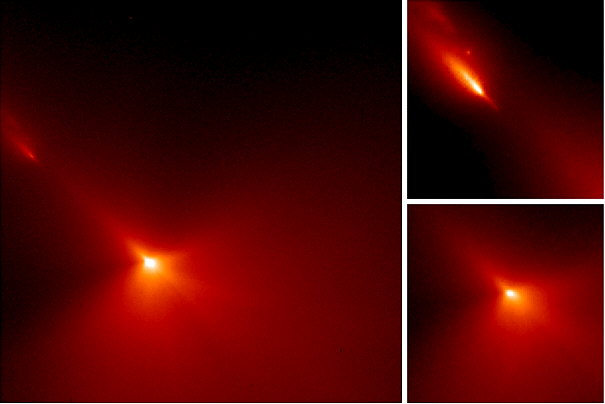

Pero sigamos. ¿Cómo se determina la vida media de una partícula? Las partículas de vida larga, tales como el neutrón y el muón, tienen que ser capturadas, preferiblemente en grandes cantidades, y después se mide electrónicamente su desintegración. Las partículas comprendidas entre 10ˉ¹⁰ y 10ˉ⁸ segundos solían registrarse con una cámara de burbujas, pero actualmente se utiliza con más frecuencia la cámara de chispas. Una partícula que se mueve a través de una cámara de burbujas deja un rastro de pequeñas burbujas que puede ser fotografiado. La Cámara de chispas contiene varios grupos de de un gran número de alambres finos entrecruzados entre los que se aplica un alto voltaje. Una partícula cargada que pasa cerca de los cables produce una serie de descargas (chispas) que son registradas electrónicamente. La ventaja de esta técnica respecto a la cámara de burbujas es que la señal se puede enviar directamente a una computadora que la registra de manera muy exacta.

Una colisión entre un prtón y un antiprotón registrada mediante una cámara de chispas del experimento UA5 del CERN.

Una partícula eléctricamente neutra nunca deja una traza directamente, pero si sufre algún tipo de interacción que involucre partículas cargadas (bien porque colisionen con un átomo en el detector o porque se desintegren en otras partículas), entonces desde luego que pueden ser registradas. Además, realmente se coloca el aparato entre los polos de un fuerte imán. Esto hace que la trayectoria de las partículas se curve y de aquí se puede medir la velocidad de las partículas. Sin embargo, como la curva también depende de la masa de la partícula, es conveniente a veces medir también la velocidad de una forma diferente.

| Leptones cargados | Neutrinos | |||||||

|---|---|---|---|---|---|---|---|---|

| Nombre | Símbolo | Carga | Masa en reposo | Nombre | Símbolo | Carga | Masa en reposo | |

| 1ª generación | Electrón |  |

−1 | 0,511 |  |

0 | < 3·10−6 | |

| Positrón |  |

+1 | Neutrino electrónico |

|

0 | |||

| 2ª generación | Muón |  |

−1 | 105,658 | Neutrino muónico |  |

0 | < 0,19 |

| Antimuón |  |

+1 | Antineutrino muónico |  |

0 | |||

| 3ª generación | Tauón |  |

−1 | 1776,99 | Neutrino tauónico |  |

0 | < 18,2 |

| Antitauón |  |

+1 | Antineutrino tauónico |  |

0 | |||

En un experimento de altas energías, la mayoría de las partículas no se mueven mucho más despacio que la velocidad de la luz. Durante su carta vida pueden llegar a viajar algunos centímetros y a partir de la longitud media de sus trazas se puede calcular su vida. Aunque las vidas comprendidas entre 10ˉ¹³ y 10ˉ²⁰ segundos son muy difíciles de medir directamente, se pueden determinar indirectamente midiendo las fuerzas por las que las partículas se pueden transformar en otras. Estas fuerzas son las responsables de la desintegración y, por lo tanto, conociéndolas se puede calcular la vida de las partículas, Así, con una pericia ilimitada los experimentadores han desarrollado todo un arsenal de técnicas para deducir hasta donde sea posible todas las propiedades de las partículas. En algunos de estos procedimientos ha sido extremadamente difícil alcanzar una precisión alta. Y, los datos y números que actualmente tenemos de cada una de las partículas conocidas, son los resultados acumulados durante muchísimos años de medidas experimentales y de esa manera, se puede presentar una información que, si se valorara en horas de trabajo y coste de los proyectos, alcanzaría un precio descomunal pero, esa era, la única manera de ir conociendo las propiedades de los pequeños componentes de la materia.

Que la mayoría de las partículas tenga una vida media de 10ˉ⁸ segundos significa que son ¡extremadamente estables! La función de onda interna oscila más de 10²² veces/segundo. Este es el “latido natural de su corazón” con el cual se compara su vida. Estas ondas cuánticas pueden oscilar 10ˉ⁸ x 10²², que es 1¹⁴ o 100.000.000.000.000 veces antes de desintegrarse de una u otra manera. Podemos decir con toda la seguridad que la interacción responsable de tal desintegración es extremadamente débil.

Bariones

| Partícula | Símbolo[1] | Quarks[2] | Spin | Masa en reposo (MeV/c²) |

S | C | B | Vida media (s) |

Desintegraciones más importantes |

|---|---|---|---|---|---|---|---|---|---|

| Protón |  |

|

|

938,27 | 0 | 0 | 0 | Estable [3] | — |

| Neutrón |  |

|

|

939,56 | 0 | 0 | 0 | 885,7 [4] |  |

| Delta doble positiva |  |

|

|

≈1.232 | 0 | 0 | 0 | 6·10-24 |  |

| Delta positiva |  |

|

|

≈1.232 | 0 | 0 | 0 | 6·10-24 |  |

| Delta neutra |  |

|

|

≈1.232 | 0 | 0 | 0 | 6·10-24 |  |

| Delta negativa |  |

|

|

≈1.232 | 0 | 0 | 0 | 6·10-24 |  |

| Lambda neutra |  |

|

|

1.115,68 | −1 | 0 | 0 | 2,63·10-10 |  |

| Sigma positiva |  |

|

|

1.189,37 | −1 | 0 | 0 | 8,01·10-11 |  |

| Sigma neutra |  |

|

|

1.192,64 | −1 | 0 | 0 | 7,4·10-20 |  |

| Sigma negativa |  |

|

|

1.197,45 | −1 | 0 | 0 | 1,48·10-10 |  |

| Xi neutra |  |

|

|

1.314,83 | −2 | 0 | 0 | 2,90·10-10 |  |

| Xi negativa |  |

|

|

1.321,31 | −2 | 0 | 0 | 1,64·10-10 |  |

| Omega |  |

|

|

1.672,45 | −3 | 0 | 0 | 8,21·10-11 |  |

| Omega encantada |  |

|

|

2.697,5 | −2 | +1 | 0 | 6,90·10-14 |  |

| Xi positiva encantada |  |

|

|

2.468 | −1 | +1 | 0 | 4,42·10-13 |  |

| Xi neutra encantada |  |

|

|

2.471 | −1 | +1 | 0 | 1,12·10-13 |  |

| Lambda encantada |  |

|

|

2.284,9 | 0 | +1 | 0 | 2,00·10-13 |  |

| Xi doble encantada |  |

|

|

3.519 | 0 | +2 | 0 | <3,30·10-14 | — |

| Lambda inferior |  |

|

|

5.624 | 0 | 0 | −1 | 1,23·10-12 |  |

- [1] El símbolo de los antibariones es el mismo pero con una barra superpuesta.

- [2] Los antibariones están formados por los respectivos antiquarks.

- [3] Debe ser superior a 1030 años.

- [4] Vida media de los neutrones libres. En los núcleos atómicos son estables.

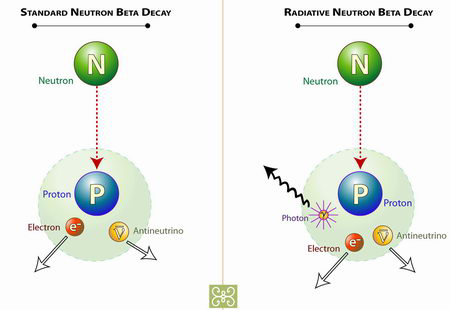

- Se ha conseguido observar por primera vez la desintegración radiactiva del neutrón. Dentro de los núcleos de los átomos hay neutrones y protones. En condiciones normales y mientras que están ahí los neutrones son estables. Sin embargo los neutrones libres son inestables, tienen una vida media de unos 10 minutos, y se desintegran produciendo un protón un electrón y un antineutrino. Pero los físicos nucleares teóricos predijeron que una de cada mil veces los neutrones decaerían en todas esas partículas y además en un fotón.

Aunque la vida de un neutrón sea mucho más larga (en promedio un cuarto de hora), su desintegración también se puede atribuir a la interacción débil. A propósito, algunos núcleos atómicos radiactivos también se desintegran por interacción débil, pero pueden necesitar millones e incluso miles de millones de años para ello. Esta amplia variación de vidas medias se puede explicar considerando la cantidad de energía que se libera en la desintegración. La energía se almacena en las masas de las partículas según la bien conocida fórmula de Einstein E = Mc². Una desintegración sólo puede tener lugar si la masa total de todos los productos resultantes es menor que la masa de la partícula original. La diferencia entre ambas masas se invierte en energía de movimiento. Si la diferencia es grande, el proceso puede producirse muy rápidamente, pero a menudo la diferencia es tan pequeña que la desintegración puede durar minutos o incluso millones de años. Así, lo que determina la velocidad con la que las partículas se desintegran no es sólo la intensidad de la fuerza, sino también la cantidad de energía disponible.

Si no existiera la interacción débil, la mayoría de las partículas serían perfectamente estables. Sin embargo, la interacción por la que se desintegran las partículas π°, η y Σ° es la electromagnética. Se observará que estas partículas tienen una vida media mucho más corta, aparentemente, la interacción electromagnética es mucho más fuerte que la interacción débil.

Bosones

| Nombre | Símbolo | Carga eléctrica (e) |

Carga de color | Spin | Masa en reposo (GeV/c²) |

Existencia | Vida media | Desintegraciones más importantes |

|---|---|---|---|---|---|---|---|---|

| Fotón |  |

Neutra | Neutra | 1 | Nula | Confirmada | Estable | — |

| Bosón W |  |

± 1 | Neutra | 1 | 80,425 | Confirmada | 3·10-25 |  [1] [1] |

| Bosón Z |  |

Neutra | Neutra | 1 | 91,187 | Confirmada | 3·10-25 | — |

| Gluón |  |

Neutra | Color + Anticolor | 1 | Nula | Confirmada | Estable | — |

| Gravitón |  |

Neutra | Neutra | 2 | Nula | Hipotética | Estable | — |

| Bosón de Higgs |  |

Neutra | Neutra | 0 | > 114 | Hipotética | Inestable |  |

Durante la década de 1950 y 1960 aparecieron tal enjambre de partículas que dio lugar a esa famosa anécdota de Fermi cuando dijo: “Si llego a adivinar esto me hubiera dedicado a la botánica.”

Típicamente el neutrón decae en un protón, un antineutrino y un electrón. Muy raramente lo hace radiativamente emitiendo además un fotón. Diagrama: Zina Deretsky, National Science Foundation. Fue difícil observar los fotones porque el haz está contaminado con fotones que fondo que producen mucho “ruido” en las medidas, por lo que era como buscar una aguja en un pajar. El decaimiento radiativo del neutrón es importante porque conecta directamente con el modelo estándar de partículas.

Si la vida de una partícula es tan corta como 10ˉ²³ segundos, el proceso de desintegración tiene un efecto en la energía necesaria para producir las partículas ante de que se desintegre. Para explicar esto, comparemos la partícula con un diapasón que vibra en un determinado modo. Si la “fuerza de fricción” que tiende a eliminar este modo de vibración es fuerte, ésta puede afectar a la forma en la que el diapasón oscila, porque la altura, o la frecuencia de oscilación, está peor definida. Para una partícula elemental, esta frecuencia corresponde a su energía. El diapasón resonará con menor precisión; se ensancha su curva de resonancia. Dado que para esas partículas extremadamente inestable se miden curvas parecidas, a medida se las denomina resonancias. Sus vidas medias se pueden deducir directamente de la forma de sus curvas de resonancia.

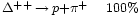

Un ejemplo típico de una resonancia es la delta (∆), de la cual hay cuatro especies ∆ˉ, ∆⁰, ∆⁺ y ∆⁺⁺(esta última tiene doble carga eléctrica). Las masas de las deltas son casi iguales 1.230 MeV. Se desintegran por la interacción fuerte en un protón o un neutrón y un pión.

Existen tanto resonancias mesónicas como bariónicas . Las resonancias deltas son bariónicas. Las resonancias deltas son bariónicas. (También están las resonancias mesónicas rho, P).

En el Universo existen muchas clases de resonancias…inesperadas

Las resonancias parecen ser solamente una especie de versión excitada de los Hadrones estable. Son réplicas que rotan más rápidamente de lo normal o que vibran de diferente manera. Análogamente a lo que sucede cuando golpeamos un gong, que emite sonido mientras pierde energía hasta que finalmente cesa de vibrar, una resonancia termina su existencia emitiendo piones, según se transforma en una forma más estable de materia.

Por ejemplo, la desintegración de una resonancia ∆ (delta) que se desintegra por una interacción fuerte en un protón o neutrón y un pión, por ejemplo:

∆⁺⁺→р + π⁺; ∆⁰→р + πˉ; o п+π⁰

En la desintegración de un neutrón, el exceso de energía-masa es sólo 0,7 MeV, que se puede invertir en poner en movimiento un protón, un electrón y un neutrino. Un Núcleo radiactivo generalmente tiene mucha menos energía a su disposición.

El estudio de los componentes de la materia tiene una larga historia en su haber, y, muchos son los logros conseguidos y muchos más los que nos quedan por conseguir, ya que, nuestros conocimientos de la masa y de la energía (materia), es aún limitado. Los cuadros que aparecen arriba, están referidos a las partículas más usuales como los Quarks y los Leptones (verdaderos componentes de la materia) que a su vez, son: Los Quarks los que forman a los Hadrones y los Leptones los que completan el núcleo atómico de la materia para conformar los átomos. He dejado a los mesones y a las supuestas partículas supersimétricas centrándome en las que me parecen principales en la conformación de la materia.

emilio silvera

Ago

29

La Física y el Tiempo

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (5)

Comments (5)

Para el topólogo, un nudo es una curva continua, cerrada y sin puntos dobles. Esta curva está situada en un espacio de tres dimensiones y se admite que pueda ser deformada, estirada, comprimida, aunque está “prohibido” hacerle cortes. Cuando se puede, a través de diversas manipulaciones, se pasa de un nudo a otro y se dice que son equivalentes. Claro que, algunos se abstraen en cuestiones con otras, al parecer, no relacionadas.

Un viejo amigo bromeaba diciendo que el Andante en do menor de la Sinfonía Concertante de Mozart conseguía devolverle a su intimidad anímica de partida, y que por eso, en su opinión, plasmaba de forma inefable el tiempo cíclico, o mejor aún, una CTC (“curva de género de tiempo cerrada”). Y transcurridos los doce minutos que dura ese movimiento, volvíamos a escucharlo una vez más. Mientras, discutíamossin cesar sobre el tiempo.

No es bueno perder la perspectiva

Hay un tiempo para cada cosa. Un tiempo para soñar, inconmensurable, un tiempo para vivir, siempre corto, un tiempo para filosofar, misterioso,…, y un tiempo para la ciencia, sujeto a número.

Me gustaría empezar definiendo el tiempo, pero no sé. Sesudos pensadores, como Platón y Aristóteles, lo ensayaron con brillantez. El tiempo es una imagen móvil de la eternidad. Esta imagen es eterna, pero se mueve según número, dirá Platón en el TIMEO. El tiempo es el número de movimiento según el antes y el después…El tiempo no es movimiento, sino movimiento en tanto en cuanto admite enumeración. El tiempo es una especie de número. El tiempo es obviamente aquello que se cuenta, no aquello con lo cual contamos, escribirá Aristóteles en su FÍSICA.

Alguna vez, en simbiosis con la Naturaleza, podemos sentir como se ha parado el tiempo

Son definiciones muy sugestivas, aunque teñidas de circularidad: movimiento en el tiempo, tiempo a través del movimiento. Agustín de Hipona vio esto claramente. Célebre es asimismo su declaración: Si nemo a me quaerat, scio; si quaerenti explicari velim, nescio (CONFESIONES). En uno de los análisis más penetrantes del tema, sugirió Agustín la mente como fuente de tiempo: En ti es, mente mía, donde mido los tiempos.

Time is what happens when nothing else happens, afirma Feynman; para a continuación advertir que toda definición del tiempo es necesariamente circular, y que lo importante no es decir qué es el tiempo, sino decir cómo se mide lo que llamamos tiempo. En su enciclopédico tratado sobre la gravitación, Misner, Thorne y Wheeler nos recuerdan de forma sencilla y profunda lo que toda medida del tiempo físico debe cumplir: Time is defined so that motion looks simple.

El tiempo es un concepto inventado por el hombre para ordenar, primero, sus sensaciones y actos, y luego, los fenómenos. Decían los escolásticos: Tempus est ens rationis cum fundamento in re. La primera unidad natural debió ser el día, por la ciclidad conspicua de las salidas del Sol. Los grandes avances científicos y tecnológicos a lo largo de los siglos han estado vinculados a los adelantos en la precisión con que se ha ido midiendo el tiempo. Hoy disponemos de relojes que aseguran un segundo en 20 millones de años, y el paso de la femtoquímica a la attofísica empieza a ser una realidad.

No pocas veces nos podemos ver perdidos en la vorágina de lo que llamamos tiempo, algo tan enorme que, en realidad, no sabemos lo que es. No lo hemos llegado a comprender, y, por si fuero poco, tampoco sabemos, si en realidad existe.

El tiempo antes de Einstein.

La física nació en torno al tiempo. Las regularidades en los ciclos astrales permitieron al acierto en las predicciones apoyadas en esta periodicidad, y con ello despertó sin duda la confianza del hombre en la racionalidad, inclinándole a escoger el cosmos frente al caos.

Breve historia de la medida del tiempo

La longitud de las sombras fue uno de los primeros métodos usados para fijar las horas. En el Museo Egipcio de Berlín hay un fragmento de piedra que posiblemente sea de un reloj de sol de alrededor de 1500 a.C. Los babilonios desarrollaron los relojes de sol, y se dice que el astrónomo Anaximandro de Mileto los introdujo en Grecia en el siglo VI a.C.

En el siglo II a C, Eratóstenes, de la biblioteca de Alejandría, concibió y llevó a cabo la primera medida de las dimensiones de la Tierra de la que se tiene noticia. En el Año Internacional de la Astronomía, una de las actividades que se llevaron a cabo fue, precisamente averiguar el radio terrestre por el mismo método.

Aparte de relojes de sol, en la antigüedad se usaron también relojes de arena, de agua, cirios y lámparas de aceite graduadas.

En la segunda mitad del siglo XIII aparecen los primeros relojes mecánicos. Su precisión era muy baja (10-20%). En el XIV se mejoran, con el invento del escape de rueda catalina, y ya se alcanzan precisiones de 20 a 30 minutos por día (1-2%). Por allá al año 1345 se empieza a dividir las horas en minutos y segundos.

El tiempo físico asoma en el siglo XIV, en el Merton College Oxford y luego en la Universidad de París, con Oresme. Se representa en una línea horizontal, mientras en vertical se disponen las cualidades variables. Son los primeros gráficos de función (en este caso, función del tiempo). La cinemática celeste brinda un buen reloj a través de la segunda ley de Kepler, midiendo tiempos mediante áreas. La ley armónica de Kepler permitirá medirlos a través de longitudes. Galileo desarrolló la cinemática terrestre, y sugirió el reloj de péndulo. A Huygens debemos la técnica de medida del tiempo que ha llegado a nuestros días, y que suministró relojes más precisos y transportables mediante volantes oscilatorios acoplados a resortes de calidad.

Diseño del reloj de péndulo de Huygens, 1656 (imagen de dominio público).

La importancia, no sólo científica sino económica, de disponer de relojes precisos y estables, queda reflejada en el premio ofrecido por el gobierno inglés de la reina Ana en 1714, que dispuso that a reward be settled by Parliament upon such person o persons as shall discover a more certain and practicable method of ascertainig longitude that any yet in practice. La recompensa era de 20, 000 libras para el que presentara un cronómetro capaz de determinar la longitud con error menor de 30´ de arco al término de un viaje a las Indias occidentales, equivalente a mantener el tiempo con error menor de 2 minutos tras seis semanas de viaje. Se la llevó casi medio siglo después el relojero británico John Harrison (1693-1776), con un reloj, conocido como H4, que incorporaba correcciones por variación en la temperatura, y que en un primer viaje de 81 días desde Porstmouth a Puerto Real (Jamaica) en 1761-62 se retrasó 5 s, esto es, de precisión 10⁻⁶ (10; 44).

Después se pasó a los de diapasón, de aquí a los de cuarzo, y hoy los atómicos ofrecen precisiones desde 10⁻¹² – 10⁻¹⁵ (Cs) hasta 10⁻¹⁶ (máser de H).

Una red de relojes atómicos de cesio, sincronizados mediante ondas de radio, velan actualmente por la exactitud de la hora sobre el planeta. Como señala Davies (10), ya no nos sirve como cronómetro el giro de la Tierra alrededor de su eje. Aunque durante siglos ha sido este viejo trompo un magnífico reloj de referencia, la falta de uniformidad de su giro (las mareas, por ejemplo, lo frenan incesantemente y alargan con ello el día en un par de milésimas de segundo por siglo, perceptible para los finos cronómetros actuales), y otras desviaciones estacionales, cuantitativamente similares a estos retrasos seculares, pero irregulares y de signo variable, son circunstancias que en conjunto obligan a añadir al tiempo civil un segundo intercalar cada uno o dos años (el último lo fue el 1 de enero de 1999, a las 0 horas) con el fin de remediar la asincronía entre los tiempos atómicos y los días astronómicos. El día no tiene 86 400 s justos (donde el segundo se define como la duración de 9 192 631 770 períodos de una determinada vibración de los átomos de Cs. Hoy la tecnología alcanza precisiones fabulosas: relojes que en treinta millones de años se desviarían a lo sumo en un diminuto segundo, como el NIST-F1 (Boulder, Colorado).

Por norma general y para mayor exactitud del sistema, dentro del campo visual de cualquier receptor GPS siempre hay por lo menos 8 satélites presentes. Cada uno de esos satélites mide 5 m de largo y pesa 860 kg . La energía eléctrica que requieren para su funcionamiento la adquieren a partir de dos paneles compuestos de celdas solares adosadas a sus costados. Están equipados con un transmisor de señales codificadas de alta frecuencia, un sistema de computación y un reloj atómico de cesio, tan exacto que solamente se atrasa un segundo cada 30 mil años.

La posición que ocupan los satélites en sus respectivas órbitas facilita que el receptor GPS reciba, de forma constante y simultánea, las señales de por lo menos 6 u 8 de ellos, independientemente del sitio donde nos encontremos situado. Mientras más señales capte el receptor GPS, más precisión tendrá para determinar las coordenadas donde se encuentra situado.

Incluso hay relojes de pulsera comerciales (receptores de señales de radio) con precisión de un segundo por millón de años garantizada por un reloj atómico en una lejana estación. La naturaleza de altísima precisión: la estabilidad del púlsar binario b1855+09 puede ser de unas partes en 10¹⁵ o incluso mejor.

El tiempo en Newton:

En los PRINCIPIA, Newton empieza con una renuncia a definir el tiempo: El tiempo, el espacio, el lugar y el movimiento son de todos bien conocidos. Y no los defino. Pero digo que el vulgo no concibe esas cantidades más que por su relación a cosas sensibles. Para evitar ciertos prejuicios que de aquí se originan, es conveniente distinguirlas en absolutas y relativas, verdaderas y aparentes, matemáticas y vulgares.

Isaac Newton en 1702 por Geoffrey Kneller

A continuación, sin embargo, Newton se arrepiente de su primer impulso y aclara: El tiempo absoluto, verdadero y matemático, de suyo y por su propia naturaleza fluye uniformemente sin relación a nada externo y se llama también duración: el tiempo relativo, aparente y vulgar es cualquier medida sensible y externa (exacta o no uniforme) de la duración por medio del movimiento y se usa vulgarmente en lugar del tiempo verdadero: tal como la hora, el día, el mes, el año.

¿Qué significa que el tiempo fluye? ¿Qué el tiempo “se mueve en el tiempo”? De nuevo la pescadilla mordiéndose la cola. El absolutismo del tiempo newtoniano recibió encendidas críticas. Leibniz opuso su idea de espacio y tiempos puramente relativos, el primero como un orden de coexistencia, el segundo como un orden de sucesiones de las cosas; ambos, espacio y tiempo, son phœnomena bene fundata. Los argumentos dinámicos con que Newton arropa su tesis de la naturaleza absoluta de la rotación y con ello la de un espacio absoluto, apoyo posterior para el tiempo absoluto, también hallan fuertes objeciones. Para Berkeley esas razones de Newton lo único que muestran es la importancia del giro respecto de las masas lejanas del Universo y no respecto de un espacio absoluto, que él no acepta. Ernst Mach, en la segunda mitad del XIX, insistirá decididamente en este punto de vista, y desde su positivismo acosará los absolutos newtonianos. De “medieval”, “no científico”, “metafísico”, tilda Mach a Newton: No tenemos derecho a hablar de un tiempo “absoluto”: de un tiempo independiente de todo cambio. Tal tiempo absoluto no puede medirse por comparación con ningún movimiento; por tanto no tiene valor práctico ni científico, y nadie tiene derecho a decir que sabe algo de él. Es una concepción metafísica vana.

El tiempo en Einstein:

El tiempo newtoniano, absoluto, el nos es familiar, tuvo que dejar paso al tiempo einsteniano, mutable y relativo, con tantos “ahora” por suceso cuantos estados de movimiento mutuo imaginemos.

El tercero de los trabajo enviados por Albert Einstein (AE) en su Annus Mirabilis de 1905 a Annalen der Physik lleva por título “Zur Elektrodynamik Bewegter Körper” (“Sobre la electrodinámica de los cuerpos en movimiento”). Junto con el quinto, titulado “Ist der Trägheit eines Körpers von seinem Energieinhalt abhängig?” (“¿Depende la inercia de un cuerpo de su contenido de energía?”), constituyen lo que hoy se llama TEORÍA ESPECIAL DE LA RELATIVIDAD.

Da A.E. un par de razones para justificar su tercer trabajo:

- La insatisfacción que le produce la asimetría en la descripción maxwelliana de los fenómenos electromagnéticos: la acción entre un conductor y un imán depende solo del movimiento relativo entre ambos, pero la teoría de Maxwell distingue entre el caso de conductor en reposo y el caso de imán en reposo: a) En el primer caso el campo magnético móvil engendra un campo eléctrico, con una energía determinada, que a su vez produce corrientes en el conductor en reposo. b) En el segundo caso, no se produce ningún campo electrónico, sino una fuerza electromotriz en el conductor, sin energía asociada, que engendra una corriente como en el caso anterior.

- La incapacidad de la óptica y del electromagnetismo (EM) para detectar el movimiento respecto del lichtmedium, es decir, de un inercial privilegiado. Esto le sugiere que la óptica y el EM tienen las mismas ecuaciones en todos los inerciales (sistemas en los que las leyes de la mecánica de Newton son las mismas). Y AE eleva esto a un principio, que llama “Prinzip der Relativität”, y le añade un compañero, aparentemente incompatible con él: “La velocidad de la luz en vacío es siempre la misma, con independencia del estado de movimiento del cuerpo emisor”.

¿Será ese de arriba el rayo de luz de Einstein, o, por el contrario, será un asteroide que se nos viene encima?

Siendo todavía muy joven, en 1895-1896, ya le preocupaba el EM y la luz, como recordaba en 1955: “Si persiguiéramos a la velocidad de la luz un rayo de luz, veríamos una onda independiente del tiempo. ¡Tal cosa, sin embargo, no existe! Este fue el primer experimento mental, infantil, en relación con la teoría especial de la relatividad”.

Este tercer trabajo de Einstein en 1905 no contiene ninguna referencia a otros trabajos, ni suyos ni de otros (como Lorentz o Poincaré).

Consciente de que su postulado de la constancia de la velocidad de la luz choca frontalmente con la ley galileana de adición de velocidades, Albert Einstein revisa los cimientos de la Física, empezando por definir físicamente y con sumo cuidado el concepto de Gleichzeitigkeit o simultaneidad entre sucesos. Considera un sistema inercial, para el que supone válida la geometría euclidiana para calcular distancias entre objetos estacionarios a través de sus coordenadas respecto de sus ejes cartesianos. Si A, B son dos observadores estacionarios, provistos de relojes iguales, y A (B) manda una señal luminosa a B (A), quien la devuelve sin tardanza a A (B), diremos que el reloj de A está sincronizado con el reloj de B si

t(B) – t(A) = t’(A) – t(B),

donde t(A) es el tiempo marcado por el reloj de A cuando envía la señal a B, t(B) lo que marca el reloj de B al llegarle la señal de A y reemitirla, y t’(A) la lectura del reloj de A al recibir la devolución de B.

No parece el mejor método para medir la velocidad de la luz, el empleado por Galileo. Claro que, en aquellos tiempos…¿Qué se podía hacer?

Supone Albert Einstein que esta definición no lleva a contradicciones, que es en principio posible entre cualquier par de observadores estacionarios en el inercial, y que la relación de sincronización anterior es de equivalencia: Si A está sincronizada con B, también B lo está con A, y si además B lo está con C, también A y C lo están. A esto le siguen ecuaciones que quiero obviar para no dar complejidad al trabajo.

No existe “el” presente

Pasa Albert Einstein a enunciar con precisión el principio de relatividad y el postulado de la constancia de la velocidad de la luz en el vacío:

- Las leyes que rigen los cambios de los sistemas físicos son las mismas en todos los inerciales.

- Todo rayo de luz se mueve en cualquier inercial con una misma velocidad, c, independientemente del movimiento de su fuente.

Como consecuencia, demuestra que el concepto de sincronía, y por ende de simultaneidad, es relativo, no absoluto. La noción de “presente”, “ahora” o cualquier instante determinado depende del referencial inercial.

Algunos incluso hablaron de ernegía taquiónica

¿Más rápido que la luz?

¿Existen partículas que se muevan con velocidad superior a la de la luz? Sí; por ejemplo, cualquier partícula que lleve en agua, a temperatura entre 0 y 50 ºC, una velocidad ν > c / n, n = 1.3, irá más deprisa en ese medio que los fotones del espectro visible. Lo mismo ocurre con la mayoría de los rayos cósmicos que llegan a la atmósfera; son superlumínicos en relación con la velocidad de la luz en el aire. Precisamente en esta posibilidad de rebasar la velocidad de la luz en un medio reside el efecto Cerenkov.

Lo que no se conocen son taquiones, o partículas que se muevan más deprisa que la luz en el vacío. Si existieran, podrían utilizarse para mandar información al pasado. Violando el orden causa-efecto. Por ello se “decreta” su inexistencia.

En fin, que la velocidad de la luz en el vacío, al menos que sepamos, es infranqueable. Es un límite impuesto por la Naturaleza al que habrá que vencer, no superándolo (que no se puede), sino mediante una artimaña física inteligente que logre burlar dicho límite.

Aparte de algún que otro añadido, el artículo (parcialmente expuesto aquí -se obviaron partes complejas), es del Físico de la Universidad Complutense D. Alberto Galindo Tixaire. Fue publicado en el Volumen 19, número 1 de la Revista Española de Física en 2005 Año Mundial de la Física

En realidad, un Homenaje a Einstein por haber pasado más de un siglo desde aquel acontecimiento memorable de la Relatividad Especial en el año 1.905 y estar a punto de cumplirse otro siglo desde su relatividad general de 1905. Dos acontecimientos que marcaron el camino de la Física y la Cosmología.

emilio silvera

Ago

28

Física, la era cuántica y otros fascinantes conceptos

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (1)

Comments (1)

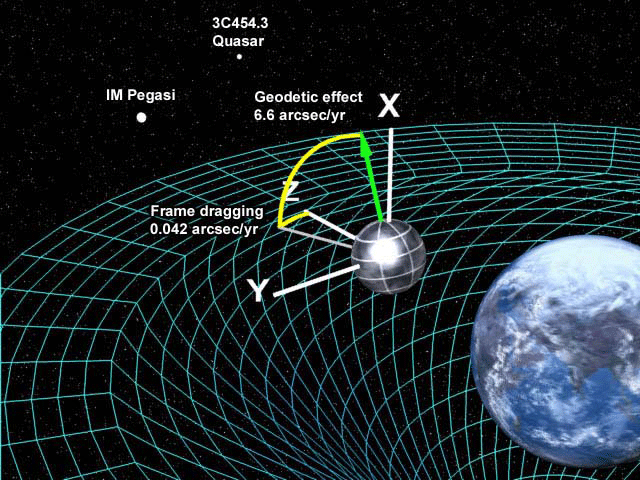

Los científicos para lograr conocer la estructura del universo a su escala más grande, deben retroceder en el tiempo, centrando sus teorías en el momento en que todo comenzó. Para ello, como todos sabeis, se han formulado distintas teorías unificadoras de las cuatro fuerzas de la naturaleza, con las cuales se han modelado acontecimiento y condiciones en el universo primitivo casi a todo lo largo del camino hasta el principio. Pero cómo se supone que debió haber habido un «antes», aparece una barrera que impide ir más allá de una frontera que se halla fijada a los 10-43 [s] después del Big Bang, un instante conocido como «momento de Planck», en homenaje al físico alemán Max Planck.

Esta barrera existe debido a que antes del momento de Planck, durante el período llamado la «era de Planck o cuántica», se supone que las cuatro fuerza fundamentales conocidas de la naturaleza eran indistinguibles o se hallaban unificadas , que era una sola fuerza. Aunque los físicos han diseñado teorías cuánticas que unen tres de las fuerzas, una por una, a través de eras que se remontan al momento de Planck, hasta ahora les ha sido prácticamente imposible armonizar las leyes de la teoría cuántica con la gravedad de la relatividad general de Einstein, en un sólo modelo teórico ampliamente convincente y con posibilidades claras de ser contrastado en experimentos de laboratorio y, mucho menos, con observaciones.

Si hablamos de singularidades en agujeros negros, debemos dejar la R.G. y acudir a la M.C. “…según las leyes de la Relatividad, el eje más horizontal siempre es espacio, mientras que el más vertical siempre es tiempo. Por tanto, al cruzar el horizonte lo que nosotros entendemos por tiempo y espacio ¡habrán intercambiado sus papeles! Puede sonar raro y, definitivamente, es algo completamente anti intuitivo, pero es la clave de que los agujeros negros sean como son y jueguen el papel tan importante que juegan en la física teórica actual. Al fin y al cabo, dentro no es lo mismo que fuera…”

Si ahora queremos cuantizar, es decir encontrar la versión cuántica, la gravedad escrita como RG lo que tenemos que hacer es encontrar la teoría cuántica para la métrica. Sin embargo, esto no conduce a una teoría apropiada, surgen muchos problemas para dar sentido a esta teoría, aparecen infinitos y peor que eso, muchos cálculos no tienen ni tan siquiera un sentido claro. Así que hay que buscar otra forma de intentar llegar a la teoría cuántica.

Como tantas veces hemos comentado, los trabajos que se han realizado sobre poder construir una teoría cuántica de la gravedad nos llevan a un número sorprendente de implicaciones. Por un lado, sólo se ha podido conceptuar a la gravedad cuántica, siempre y cuando, el universo tenga más de cuatro dimensiones. Además, se llega a considerar que en la era de Planck, tanto el universo como la gravedad pudieron ser una sola cosa compacta estructurada por objetos cuánticos infinitamente diminutos, como los que suponemos que conforman las supercuerdas. A esta escala, el mismísimo espaciotiempo estaría sometido a imprescindibles fluctuaciones muy semejantes a las que causan las partículas al nacer y desaparecer de la existencia en el espaciotiempo ordinario. Esta noción ha conducido a los teóricos a describir el universo de la era cuántica como una especie de extremadamente densa y agitada espuma que pudo haber contenido las vibrantes cuerdecillas que propugnan los cosmólogos cuerdistas.

Los físicos especulan que el cosmos ha crecido a desde una «nada» primigenia que al nacer comenzó el principio del tiempo y que, en ese parto, contenía toda la materia y toda la energía.

Según los primeros trabajos sobre la teoría cuántica de la gravedad, el propio espaciotiempo varió en su topografía, dependiendo de las dimensiones del universo niño. Cuando el universo era del tamaño de un núcleo atómico (ver imagen de abajo), las condiciones eran relativamente lisas y uniformes; a los 10-30 cm (centro) es evidente una cierta granulidad; y a la llamada longitud de Planck, todavía unas 1.000 veces más pequeño (abajo), el espacio tiempo fluctúa violentamente.

Los físicos han intentado con denuedo elaborar una teoría completa de la gravedad que incluya la mecánica cuántica. Los cálculos de la mayoría de las teorías propuesta de la «gravedad cuántica» arrojan numerosos infinitos. Los físicos no están seguros si el problema es técnico o conceptual. No obstante, incluso prescindiendo de una teoría completa de gravedad cuántica, se puede deducir que los efectos de la teoría cuántica, habrían sido cruciales durante los primeros 10-43 segundos del inicio del universo, cuando éste tenía una densidad de 1093 gramos por centímetro cúbico y mayor. (El plomo sólido tiene una densidad de aproximadamente diez gramos por centímetro cúbico.) Este período, que es el que corresponde a la era de Planck, y a su estudio se le llama cosmología cuántica. Como el universo en su totalidad habría estado sujeto a grandes incertidumbres y fluctuaciones durante la era de Planck o era cuántica, con la materia y la energía apareciendo y desapareciendo de un vacío en grandes cantidades, el concepto de un principio del universo podría no tener un significado bien definido. En todo caso, la densidad del universo durante este período es de tal magnitud que escapa a nuestra comprensión. Para propósitos prácticos, la era cuántica podría considerarse el estado inicial, o principio, del universo. En consecuencia, los procesos cuánticos ocurridos durante este período, cualquiera sea su naturaleza, determinaron las condiciones iniciales del universo.

El universo estaba a 3.000° K hace doce mil quinientos millones de años; a 10 mil millones de grados (1010° K) un millón de años antes, y, tal vez, a 1028° K un par de millones más temprano. Pero, y antes de ese tiempo ¿qué pasaba? Los fósiles no faltan, pero no sabemos interpretarlos. Mientras más elevada se va haciendo la temperatura del universo primigenio, la situación se va complicando para los científicos. En la barrera fatídica de los 1033° K –la temperatura de Planck–, nada funciona. Nuestros actuales conocimientos de la física dejan de ser útiles. El comportamiento de la materia en estas condiciones tan extremas deja de estar a nuestro alcance de juicio. Peor aún, hasta nuestras nociones tradicionales pierden su valor. Es una barrera infranqueable para el saber de la física contemporánea. Por eso, lo que se suele decir cómo era el universo inicial en esos tempranos períodos, no deja de tener visos de especulación.

Los progresos que se han obtenido en física teórica se manifiestan a menudo en términos de síntesis de campos diferentes. Varios son los ejemplos que de ello encontramos en diversos estudios especializados, que hablan de la unificación de las fuerzas fundamentales de la naturaleza.

En física se cuentan con dos grandes teorías de éxito: la cuántica y la teoría de la relatividad general.

Cada una de ellas ha demostrado ser muy eficiente en aplicaciones dentro de los límites de su ámbito propio. La teoría cuántica ha otorgado resultados más que satisfactorios en el estudio de las radiaciones, de los átomos y de sus interacciones. La ciencia contemporánea se presenta como un conjunto de teorías de campos, aplicables a tres de las grandes interacciones: electromagnética, nuclear fuerte, nuclear débil. Su poder predictivo es bastante elocuente, pero no universal. Esta teoría es, por ahora, incapaz de describir el comportamiento de partículas inmersas en un campo de gravedad intensa. Ahora, no sabemos si esos fallos se deben a un problema conceptual de fondo o falta de capacidad matemática para encontrar las ecuaciones precisas que permitan la estimación del comportamiento de las partículas en esos ambientes.

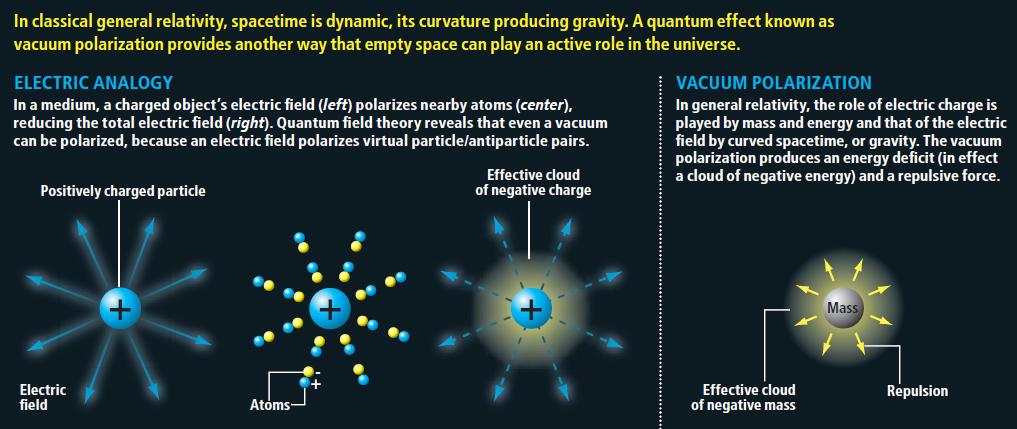

La teoría de la relatividad general, a la inversa, describe con gran precisión el efecto de los campos de gravedad sobre el comportamiento de la materia, pero no sabe explicar el ámbito de la mecánica cuántica. Ignora todo acerca de los campos y de la dualidad onda-partícula, y en ella el «vacío» es verdaderamente vacío, mientras que para la física cuántica hasta la «nada» es «algo»…

Nada está vacío, ya que, de donde surge es porque había

Claro está, que esas limitaciones representativas de ambas teorías no suelen tener mucha importancia práctica. Sin embargo, en algunos casos, esas limitantes se hacen sentir con agresividad frustrando a los físicos. Los primeros instantes del universo son el ejemplo más elocuente.

El científico investigador, al requerir estudiar la temperatura de Planck, se encuentra con un cuadro de densidades y gravedades extraordinariamente elevadas. ¿Cómo se comporta la materia en esas condiciones? Ambas teorías, no dicen mucho al respecto, y entran en serias contradicciones e incompatibilidades. De ahí la resistencia de estas dos teorías a unirse en una sólo teoría de Gravedad-Cuantíca, ya que, cada una de ellas reina en un universo diferente, el de lo muy grande y el de lo muy pequeño.

Todo se desenvuelve alrededor de la noción de localización. La teoría cuántica limita nuestra aptitud para asignar a los objetos una posición exacta. A cada partícula le impone un volumen mínimo de localización. La localización de un electrón, por ejemplo, sólo puede definirse alrededor de trescientos fermis (más o menos un centésimo de radio del átomo de hidrógeno). Ahora, si el objeto en cuestión es de una mayor contextura másica, más débiles son la dimensión de este volumen mínimo. Se puede localizar un protón en una esfera de un décimo de fermi, pero no mejor que eso. Para una pelota de ping-pong, la longitud correspondiente sería de unos 10-15 cm, o sea, bastante insignificante.La física cuántica, a toda partícula de masa m le asigna una longitud de onda Compton: lc = h / 2p mc

Por su parte, la relatividad general igualmente se focaliza en la problemática del lugar que ocupan los objetos. La gravedad que ejerce un cuerpo sobre sí mismo tiende a confinarlo en un espacio restringido. El caso límite es aquel del agujero negro, que posee un campo de gravedad tan intenso que, salvo la radiación térmica, nada, ni siquiera la luz, puede escapársele. La masa que lo constituye está, según esta teoría, irremediablemente confinada en su interior.

En lo que hemos inmediatamente descrito, es donde se visualizan las diferencias entre esos dos campos del conocimiento. Uno alocaliza, el otro localiza. En general, esta diferencia no presenta problemas: la física cuántica se interesa sobre todo en los microobjetos y la relatividad en los macroobjetos. Cada cual en su terreno.

Sin embargo, ambas teorías tienen una frontera común para entrar en dificultades. Se encuentran objetos teóricos de masa intermedia entre aquella de los microobjetos como los átomos y aquella de los macroobjetos como los astros: las partículas de Planck. Su masa es más o menos la de un grano de sal: 20 microgramos. Equivale a una energía de 1028 eV o, más aún, a una temperatura de 1033° K. Es la «temperatura de Planck».

Ahora bien, si queremos estimar cuál debería ser el radio en que se debe confinar la masita de sal para que se vuelva un agujero negro, con la relatividad general la respuesta que se logra encontrar es de que sería de 10-33 cm, o sea ¡una cien mil millonésima de mil millonésima de la dimensión del protón! Esta dimensión lleva el nombre de «radio de Planck». La densidad sería de ¡1094 g/cm3! De un objeto así, comprimido en un radio tan, pero tan diminuto, la relatividad general sólo nos señala que tampoco nada puede escapar de ahí. No es mucha la información.

Si recurrimos a la física cuántica para estimar cuál sería el radio mínimo de localización para un objeto semejante al granito de sal, la respuesta que encontramos es de un radio de 10-33 cm. Según esta teoría, en una hipotética experiencia se lo encontrará frecuentemente fuera de ese volumen. ¡Ambos discursos no son coincidentes! Se trata de discrepancias que necesitan ser conciliadas para poder progresar en el conocimiento del universo. ¿Se trata de entrar en procesos de revisión de ambas teoría, o será necesaria una absolutamente nueva? Interrogantes que solamente el devenir de la evolución de la física teórica las podrá responder en el futuro.

De todas las maneras, en lo que se refiere a una Teoría cuántica de la Gravedad, tendremos que esperar a que se confirmen las teorías de supergravedad, supersimetría, cuerdas, la cuerda heterótica, supercuerdas y, la compendiada por Witten Teoría M. Aquí, en estas teorías (que dicen ser del futuro), sí que están apasiblemente unidas las dos irreconcialbles teorías: la cuántica y la relativista, no sólo no se rechazan ni emiten infinitos, sino que, se necesitan y complementan para formar un todo armónico y unificador.

¡Si pudiéramos verificarla!

Pero, contar con la energía de Planck (1019 GeV), no parece que, al menos de momento, sea de este mundo. Ni todos los aceleradores de partículas del mundo unidos, podrían llegar a conformar una energía semejante.

Aunque de extraña y atípica figura, también, esta galaxia, está hecha de materia

Tiene y encierra tantos misterios la materia que estamos aún q años-luz de saber y conocer sobre su verdadera naturaleza. Es algo que vemos en sus distintas formas materiales que configuran y conforman todo lo material desde las partículas elementales hasta las montañas y los océanos. Unas veces está en estado “inerte” y otras, se eleva hasta la vida que incluso, en ocasiones, alcanza la consciencia de SER. Sin embargo, no acabamos de dilucidar de dónde viene su verdadero origen y que era antes de “ser” materia. ¿Existe acaso una especie de sustancia cósmica anterior a la materia? Y, si realmente existe esa sustancia… ¿Dónde está? Aristóteles la llamaba Ylem, la sustancia o materia cósmica antes de la materia, a partir del Ylem llegaría la materia bariónica, la ue conocemos y de la que todo está hecho.

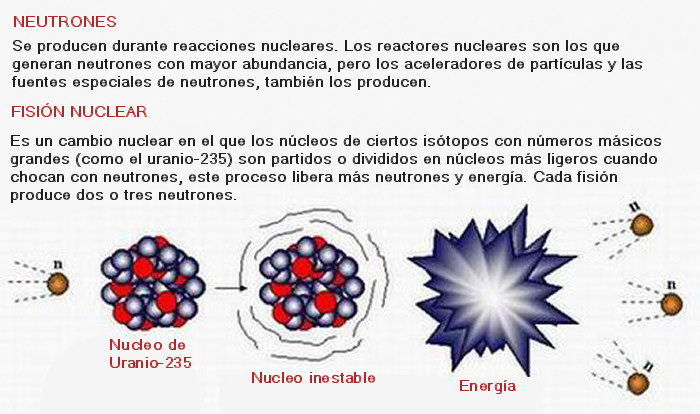

Nos podríamos preguntar miles de cosas que no sabríamos contestar. Nos maravillan y asombran fenómenos naturales que ocurren ante nuestros ojos pero que tampoco sabemos, en realidad, a que son debidos. Sí, sabemos ponerles etiquetas como, por ejemplo, la fuerza nuclear débil, la fisión espontánea que tiene lugar en algunos elementos como el protactinio o el torio y, con mayor frecuencia, en los elementos que conocemos como transuránicos.

A medida que los núcleos se hacen más grandes, la probabilidad de una fisión espontánea aumenta. En los elementos más pesados de todos (einstenio, fermio y mendelevio), esto se convierte en el método más importante de ruptura, sobrepasando a la emisión de partículas alfa.

¡Parece que la materia está viva!

Son muchas las cosas que desconocemos y, nuestra curiosidad nos empuja continuamente a buscar esas respuestas.

El electrón y el positrón son notables por sus pequeñas masas (sólo 1/1.836 de la del protón, el neutrón, el antiprotón o antineutrón), y, por lo tanto, han sido denominados leptones (de la voz griega lepto que significa “delgado”).

Aunque el electrón fue descubierto en 1.897 por el físico británico Josepth John Thomson (1856-1940), el problema de su estructura, si la hay, no está resuelto. Conocemos su masa y su carga negativa que responden a 9,1093897 (54)x10-31kg la primera y, 1,602 177 33 (49)x10-19 culombios, la segunda, y también su radio clásico. No se ha descubierto aún ninguna partícula que sea menos masiva que el electrón (o positrón) y que lleve una carga eléctrica, sea lo que fuese (sabemos como actúa y cómo medir sus propiedades, pero aun no sabemos qué es), tenga asociada un mínimo de masa, y que esta es la que se muestra en el electrón.

Josepth John Thomson

Lo cierto es que, el electrón, es una maravilla en sí mismo. El Universo no sería como lo conocemos si el electrón (esa cosita “insignificante”), fuese distinto a como es, bastaría un cambio infinitesimal para que, por ejemplo, nosotros no pudiéramos estar aquí ahora.

(“Aunque no se trata propiamente de la imagen real de un electrón, un equipo de siete científicos suecos de la Facultad de Ingeniería de la Universidad de Lund consiguieron captar en vídeo por primera vez el movimiento o la distribución energética de un electrón sobre una onda de luz, tras ser desprendido previamente del átomo correspondiente.

Previamente dos físicos de la Universidad Brown habían mostrado películas de electrones que se movían a través de helio líquido en el International Symposium on Quantum Fluids and Solids del 2006. Dichas imágenes, que mostraban puntos de luz que bajaban por la pantalla fueron publicadas en línea el 31 de mayo de 2007, en el Journal of Low Temperature Physics.

En el experimento que ahora nos ocupa y dada la altísima velocidad de los electrones el equipo de investigadores ha tenido que usar una nueva tecnología que genera pulsos cortos de láser de luz intensa (“Attoseconds Pulses”), habida cuenta que un attosegundo equivalente a la trillonésima parte de un segundo”.)

¡No por pequeño, se es insignificante! Recordémoslo, todo lo grande está hecho de cosas pequeñas.

Louis de Broglie

En realidad, existen partículas que no tienen en absoluto asociada en ellas ninguna masa (es decir, ninguna masa en reposo). Por ejemplo, las ondas de luz y otras formas de radiación electromagnéticas se comportan como partículas (Einstein en su efecto fotoeléctrico y De Broglie en la difracción de electrones.)

Imagen ilustrativa de la dualidad onda-partícula, en el cual se puede ver cómo un mismo fenómeno puede tener dos percepciones distintas. Esta manifestación en forma de partículas de lo que, de ordinario, concebimos como una onda se denomina fotón, de la palabra griega que significa “luz”.

El fotón tiene una masa de 1, una carga eléctrica de 0, pero posee un espín de 1, por lo que es un bosón. ¿Cómo se puede definir lo que es el espín? Los fotones toman parte en las reacciones nucleares, pero el espín total de las partículas implicadas antes y después de la reacción deben permanecer inmutadas (conservación del espín). La única forma que esto suceda en las reacciones nucleares que implican a los fotones radica en suponer que el fotón tiene un espín de 1. El fotón no se considera un leptón, puesto que este termino se reserva para la familia formada por el electrón, el muón y la partícula Tau con sus correspondientes neutrinos: Ve, Vu y VT.

Existen razones teóricas para suponer que, cuando las masas se aceleran (como cuando se mueven en órbitas elípticas en torno a otra masa o llevan a cabo un colapso gravitacional), emiten energía en forma de ondas gravitacionales. Esas ondas pueden así mismo poseer aspecto de partícula, por lo que toda partícula gravitacional recibe el nombre de gravitón.

La fuerza gravitatoria es mucho, mucho más débil que la fuerza electromagnética. Un protón y un electrón se atraen gravitacionalmente con sólo 1/1039 de la fuerza en que se atraen electromagnéticamente. El gravitón (aún sin descubrir) debe poseer, correspondientemente, menos energía que el fotón y, por tanto, ha de ser inimaginablemente difícil de detectar.

De todos modos, el físico norteamericano Joseph Weber emprendió en 1.957 la formidable tarea de detectar el gravitón. Llegó a emplear un par de cilindros de aluminio de 153 cm. De longitud y 66 de anchura, suspendidos de un cable en una cámara de vacío. Los gravitones (que serían detectados en forma de ondas), desplazarían levemente esos cilindros, y se empleó un sistema para detectar el desplazamiento que llegare a captar la cienmillonésima parte de un centímetro.

Joseph Weber

El interferómetro funciona enviando un haz de luz que se separa en dos haces; éstos se envían en direcciones diferentes a unos espejos donde se reflejan de regreso, entonces los haces al combinarse presentarán interferencia.

Las débiles ondas de los gravitones, que producen del espacio profundo, deberían chocar contra todo el planeta, y los cilindros separados por grandes distancias se verán afectados de forma simultánea. En 1.969, Weber anunció haber detectado los efectos de las ondas gravitatorias. Aquello produjo una enorme excitación, puesto que apoyaba una teoría particularmente importante (la teoría de Einstein de la relatividad general). Desgraciadamente, nunca se pudo comprobar mediante las pruebas realizadas por otros equipos de científicos que duplicaran el hallazgo de Weber.

De todas formas, no creo que, a estas alturas, nadie pueda dudar de la existencia de los gravitones, el bosón mediador de la fuerza gravitatoria. La masa del gravitón es cero, su carga es cero, y su espín de 2. Como el fotón, no tiene antipartícula, ellos mismos hacen las dos versiones.

Tenemos que volver a los que posiblemente son los objetos más misteriosos de nuestro Universo: Los agujeros negros. Si estos objetos son lo que se dice (no parece que se pueda objetar nada en contrario), seguramente serán ellos los que, finalmente, nos faciliten las respuestas sobre las ondas gravitacionales y el esquivo gravitón.

Imagen de un agujero negro en el núcleo de una galaxia arrasando otra próxima- NASA

La onda gravitacional emitida por el agujero negro produce una ondulación en la curvatura del espacio-temporal que viaja a la velocidad de la luz transportada por los gravitones. Tenemos varios proyectos en marcha de la NASA y otros Organismos oficiales que buscan las ondas gravitatorias de los agujeros negros, de colisiones entre estrellas de neutrones y de otras fuentes análogas que, según se cree, nos hablará de “otro universo”, es decir, nos dará información desconocida hasta ahora y sabremos “ver” un universo distinto al reflejado por las ondas elecromagnéticas que es el que ahora conocemos.

¿Espuma cuántica? Si profundizamos mucho en la materia…

Hay aspectos de la física que me dejan totalmente sin habla, me obligan a pensar y me transporta de este mundo material nuestro a otro fascinante donde residen las maravillas del Universo. Hay magnitudes asociadas con las leyes de la gravedad cuántica. La longitud de Planck-Wheeler, ![]() es la escala de longitud por debajo de la cual el espacio tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro.

es la escala de longitud por debajo de la cual el espacio tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro.

“Una investigación ha llevado a pensar que, la materia se construye sobre fundamentos frágiles. Los físicos acaban de confirmar que la materia, aparentemente sustancial, es en realidad nada más que fluctuaciones en el vació cuántico. Los investigadores simularon la frenética actividad que sucede en el interior de los protones y neutrones, que como sabéis son las partículas que aportan casi la totalidad de la masa a la materia común. Estas dos partículas, protones y neutrones, se comportan como si en su interior, los quarks de los que están hechas ambas partículas, lucharan por escapar del confinamiento a que se ven sometidos por la fuerza nuclear fuerte por medio de los Gluones que forman un océano en el que se ven confinados sin remedio. De hecho, nunca nadie ha podido ver a un quark libre.

Así que, si estudiamos el vacío cuántico, parece que eso permitirá a los físicos someter a prueba a la Cromo Dinámica Cuántica y buscar sus efectos más allá de la física conocida. Por ahora, los cálculos demuestran que la QCD describe partículas basadas en quarks de forma precisa, y que la mayor parte de nuestra masa viene de quarks virtuales y gluones que burbujean en el vacío cuántico.

Se cree que el campo de Higgs hace también su pequeña contribución, dando masa a los quarks individuales, así como a los electrones y a otras varias partículas. El campo de Higgs también crea masa a partir del vacío cuántico, en forma de bosones virtuales de Higgs. De modo que si el LHC confirma la existencia del bosón de Higgs, eso significará que toda la realidad es virtual, es menos virtual de lo que se pensaba. No creo que hasta el momento, y, a pesar de las declaraciones salidas desde el CERN, se tenga la seguridad de haber detectado el Bosón de Higgs.

De todo lo anterior, no podemos obtener una respuesta cierta y científicamente probada de que todo eso sea así, más bien, los resultados indican que todo eso “podría ser así”, lo que ocurre es que, los científicos, a veces se dejan llevar por las emociones. Al fin y al cabo, ellos como el común de los mortales, también son humanos.

Ya nos gustaría saber cómo es, ese vacío cuántico y qué pasa allí

Me llama poderosamente la atención lo que conocemos como las fluctuaciones de vacío, esas oscilaciones aleatorias, impredecibles e ineliminables de un campo (electromagnético o gravitatorio), que son debidas a un tira y afloja en el que pequeñas regiones del espacio toman prestada momentáneamente energía de regiones adyacentes y luego la devuelven. Hace un par de días que hablamos de ello.

Ordinariamente, definimos el vacío como el espacio en el que hay una baja presión de un gas, es decir, relativamente pocos átomos o moléculas. En ese sentido, un vacío perfecto no contendría ningún átomo o molécula, pero no se puede obtener, ya que todos los materiales que rodean ese espacio tienen una presión de vapor finita. En un bajo vacío, la presión se reduce hasta 10-2 pascales, mientras que un alto vacío tiene una presión de 10-2-10-7 pascales. Por debajo de 10-7 pascales se conoce como un vacío ultraalto.

No puedo dejar de referirme al vaciotheta (vació θ) que, es el estado de vacío de un campo gauge no abeliano (en ausencia de campos fermiónicos y campos de Higgs). En el vacío theta hay un número infinito de estados degenerados con efecto túnel entre estos estados. Esto significa que el vacío theta es análogo a una funciónn de Bloch en un cristal.

Se puede derivar tanto como un resultado general o bien usando técnicas de instantón. Cuando hay un fermión sin masa, el efecto túnel entre estados queda completamente suprimido. Cuando hay campos fermiónicos con masa pequeña, el efecto túnel es mucho menor que para campos gauge puros, pero no está completamente suprimido.

¡Es tánto lo que hay pero que no podemos ver!

Si buscamos por ahí podremos leer explicaciones como esta: “En la Teoría cuántica de campos, el vacío cuántico (también llamado el vacío) es el estado cuántico con la menor energía posible. Generalmente no contiene partículas físicas. El término “Energía de punto cero” es usado ocasionalmente como sinónimo para el vacío cuántico de un determinado campo cuántico.

De acuerdo a lo que se entiende actualmente por vacío cuántico o “estado de vacío”, este “no es desde ningún punto de vista un simple espacio vacío” , y otra vez: “es un error pensar en cualquier vacío físico como un absoluto espacio vacío.” De acuerdo con la mecánica cuántica, el vacío cuántico no está verdaderamente vacío sino que contiene ondas electromagnéticas fluctuantes y partículas que saltan adentro y fuera de la existencia.

Según las modernas teorías de las partículas elementales, el vacío es un objeto físico, se puede cargar de energía y se puede convertir en varios estados distintos. Dentro de su terminología, los físicos hablan de vacíos diferentes. El tipo de partículas elementales, su masa y sus interacciones están determinados por el vacío subyacente. La relación entre las partículas y el vacío es similar a la relación entre las ondas del sonido y la materia por la que se propagan. Los tipos de ondas y la velocidad a la que viajan varía dependiendo del material.”

Como nos dicen en este anuncio del Kybalion, nada es estático en el Universo y, todo está en continuo movimiento o vibración. Habreis oido hablar de la energía de punto cero que permanerce en una sustancia en el cero absoluto (cero K). Está de acuerdo con la teoría cuántica, según la cual, una partícula oscilando con un movimiento armónico simple no tiene estado estacionario de energía cinética nula. Es más, el Principio de Incertidumbre no permite que esta partícula esté en reposo en el punto central exacto de sus oscilaciones. Del vacío surgen sin cesar partículas virtuales que desaparecen en fracciones de segundo, y, ya conoceis, por ejemplo, el Efecto Casimir en el que dos placas pueden producir energía negativa surgidas del vacío.

De todas las maneras, en este momento sabemos tanto de la espuma cuántica como de nuestra presencia en el Universo, es decir, nada. Todo son conjeturas, suposiciones e hipótesis que nos hacen imaginar lo que pueda existir a la distancia de Planck. Claro que en una longitud de 10-35 metros, sí que es fácil imaginar que lo que podamos ver allí sería simplemete una especie de espuma cuántica asociada a lo que estimamos que sería la gravedad cuántica.

emilio silvera

Ago

26

¡La Física! compleja realidad del mundo

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (10)

Comments (10)

Un día de 1.900, se publicó un artículo de ocho páginas que sentaron las bases de la Mecánica Cuántica. Su autor, Max Planck, cambió conceptos clásicos para traernos una nueva visión del universo infinitesimal (10-35 m.)a una distancia conocida como límite de Planck, más allá de donde los Quarks están confinados en tripletes formando protones y neutrones y la fuerza nuclear fuerte tiene su dominio y se deja sentir a través de los bosones portadores, los Gluones.

Planck, nos habló del “cuanto” de acción h, y nos dijo que la energía se transmite en paquetes de manera discontinua. Aquello, asombró al mundo y el mismo Planck fue consciente de que, sus creencias sobre la Física, a partir de ese momento, serían otras.

Inspirado en el trabajo de Planck, Albert Einstein desarrollo un trabajo sobre el “Efecto Fotoeléctrico ” – que le valió el Nobel de Física de 1.921 – y, contribuyó de manera activa al desarrollo de la Mecánica Cuántica que, más tarde, combatió.

Hoy los grandes aceleradores como el LHC y el Fermilab, llegan hasta las entrañas de la materia

Llegaron nuevos Físicos como Werner Heisenberg, Schrödinger, Dirac, Feynman y otros que, desarrollaron lo que hoy conocemos como Mecánica Cuántica. Heisenberg con su Principio de Incertidumbre nos demostró que no podíamos saberlo todo al mismo tiempo. Si queremos conocer la situación de un electrón y para ello utilizamos un microscopio electrónico, el mismo hecho de su utilización transformará el medio observado, ya que, los fotones enviados por el microscopio cambiarán la dirección de dicho electrón. De esta manera, podemos saber dónde está, pero no sabremos a donde se dirige.

Ago

26

Antipartículas, fuerzas…

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (12)

Comments (12)

Bajo la “definición basada en quarks y leptones”, las partículas elementales y compuestas formados de quarks (en púrpura) y leptones (en verde) serían la “materia”; mientras los bosones “izquierda” (en rojo) no serían materia. Sin embargo, la energía de interacción inherente a partículas compuestas (por ejemplo, gluones, que implica a los neutrones y los protones) contribuye a la masa de la materia ordinaria.

Ya hemos descrito en trabajos anteriores las dos familias de partículas elementales: Quarks y Leptones. Pero hasta ahí, no se limita la sociedad del universo infinitesimal. Existen además las antifamilias. A quarks y electrones se asocian, por ejemplo, antiquarks y antielectrones. A cada partícula, una antipartícula.

Uno de los primeros éxitos de la teoría relativista del campo cuántico fue la predicción de las antipartículas: nuevos cuantos que eran la imagen especular de las partículas ordinarias. Las antipartículas tienen la misma masa y el mismo spin que sus compañeras las partículas ordinarias, pero cargas inversas. La antipartícula del electrón es el positrón, y tiene, por tanto, carga eléctrica opuesta a la del electrón. Si electrones y positrones se colocan juntos, se aniquilan, liberando la energía inmensa de su masa según la equivalencia masa-energía einstiana.

¿Cómo predijeron los físicos la existencia de antipartículas? Bueno, por la «interpretación estadística» implicaba que la intensidad de un campo determinaba la probabilidad de hallar sus partículas correspondientes. Así pues, podemos imaginar un campo en un punto del espacio describiendo la creación o aniquilación de sus partículas cuánticas con una probabilidad concreta. Si esta descripción matemática de la creación y aniquilación de partículas cuánticas se inserta en el marco de la teoría relativista del campo cuántico, no podemos contar con la posibilidad de crear una partícula cuántica sin tener también la de crear un nuevo género de partícula: su antipartícula. La existencia de antimateria es imprescindible para una descripción matemáticamente coherente del proceso de creación y aniquilación según la teoría de la relatividad y la teoría cuántica.

Totales: 83.817.023

Totales: 83.817.023 Conectados: 48

Conectados: 48