Sep

26

Más allá del Modelo Estándar ¿Qué habrá?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

“… el Modelo Estándar es, en la historia, la más sofisticada teoría matemática sobre la naturaleza. A pesar de la palabra “modelo” en su nombre, el Modelo Estándar es una teoría comprensiva que identifica las partículas básicas y especifica cómo interactúan. Todo lo que pasa en nuestro mundo (excepto los efectos de la gravedad) es resultado de las partículas del Modelo Estándar interactuando de acuerdo con sus reglas y ecuaciones.”

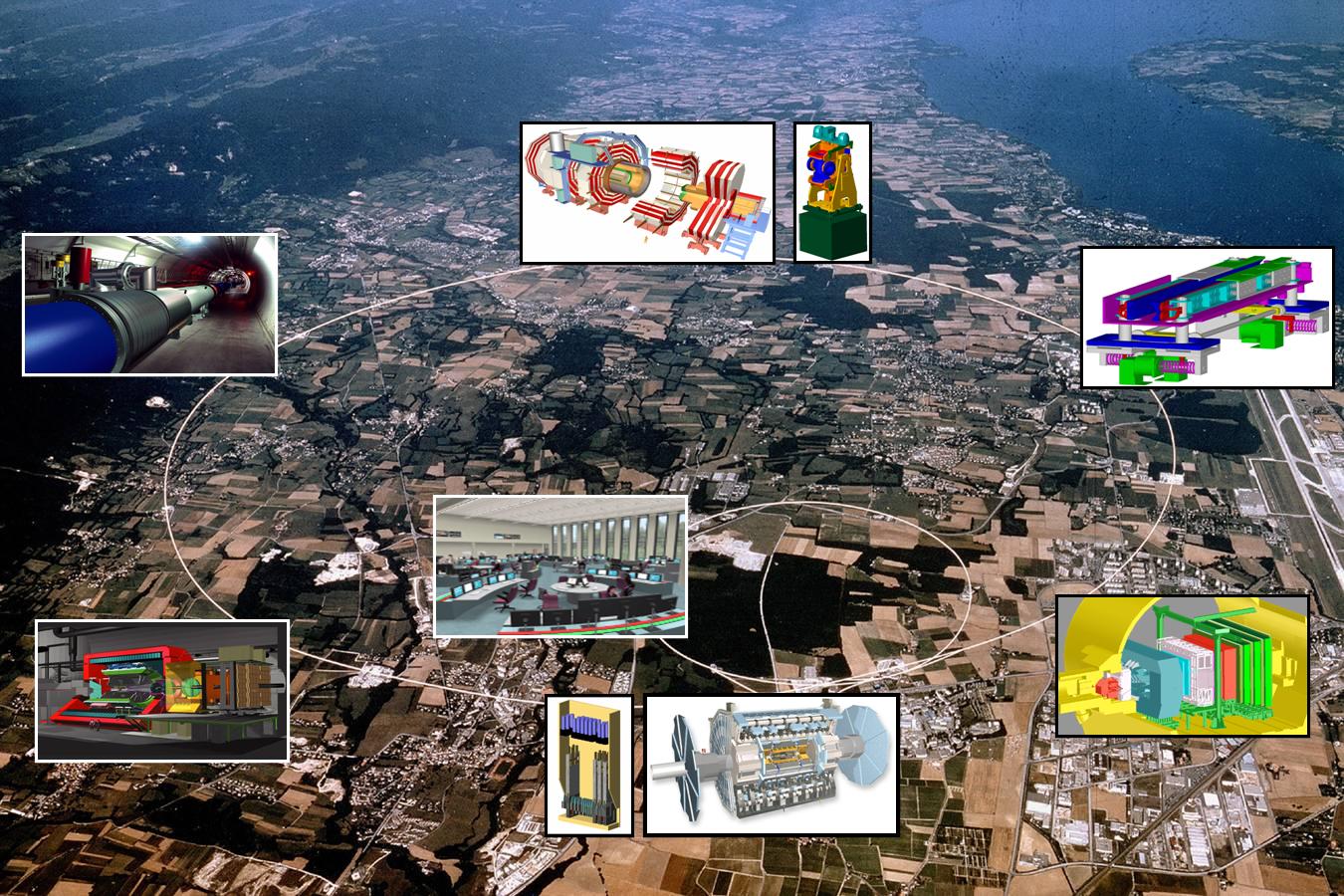

El modelo estándar es una poderosa herramienta pero no cumple todas las expectativas; no es un modelo perfecto. En primer lugar, podríamos empezar por criticar que el modelo tiene casi veinte constantes que no se pueden calcular. Desde luego, se han sugerido numerosas ideas para explicar el origen de todos estos parámetros o números inexplicables y sus valores, pero el problema de todas estas teorías es que los argumentos que dan nunca han sido enteramente convincentes. ¿Por qué se iba a preocupar la naturaleza de una fórmula mágica si en ausencia de tal fórmula no hubiera contradicciones? Lo que realmente necesitamos es algún principio fundamental nuevo, tal como el principio de la relatividad, pero no queremos abandonar todos los demás principios que ya conocemos. Ésos, después de todo, han sido enormemente útiles en el descubrimiento del modelo estándar. El mejor lugar para buscar un nuevo principio es precisamente donde se encuentran los puntos débiles de la presente teoría y, construímos máquinas como el LHC para que nos diga lo que no sabemos.

Una regla universal en la física de partículas es que para partículas con energías cada vez mayores, los efectos de las colisiones están determinados por estructuras cada vez más pequeñas en el espacio y en el tiempo. El modelo estándar es una construcción matemática que predice sin ambigüedad cómo debe ser el mundo de las estructuras aún más pequeñas. Pero existen varias razones para sospechar que sus predicciones pueden, finalmente (cuando podamos emplear más energía en un nivel más alto), resultar equivocadas.

Vistas a través del microscopio, las constantes de la naturaleza parecen estar cuidadosamente ajustadas sin ninguna otra razón aparente que hacer que las partículas parezcan lo que son. Hay algo muy erróneo aquí. Desde un punto de vista matemático no hay nada que objetar, pero la credibilidad del modelo estándar se desploma cuando se mira a escalas de tiempo y longitud extremadamente pequeñas, o lo que es lo mismo, si calculamos lo que pasaría cuando las partículas colisionan con energías extremadamente altas. ¿Y por qué debería ser el modelo válido hasta aquí? Podrían existir muchas clases de partículas súper pesadas que no han nacido porque se necesitan energías aún inalcanzables. ¿Dónde está la partícula de Higgs? ¿Cómo se esconde de nosotros el gravitón?

Parece que el Modelo estándar no admite la cuarta fuerza y tendremos que buscar más profundamente, en otras teorías que nos hablen y describan además de las partículas conocidas de otras nuevas que están por nacer y que no excluya la Gravedad. Ese es el Modelo que necesitamos para conocer mejor la Naturaleza.

Claro que las cosas no son tan sencilla y si deseamos evitar la necesidad de un delicado ajuste de las constantes de la naturaleza, creamos un nuevo problema: ¿cómo podemos modificar el modelo estándar de tal manera que el ajuste fino no sea necesario? Está claro que las modificaciones son necesarias, lo que implica que muy probablemente haya un límite más allá del cual el modelo tal como está deja de ser válido. El modelo estándar no será nada más que una aproximación matemática que hemos sido capaces de crear, de forma que todos los fenómenos que hemos observado hasta el presente están reflejados en él, pero cada vez que se pone en marcha un aparato más poderoso, tenemos que estar dispuestos a admitir que puedan ser necesarias algunas modificaciones del modelo para incluir nuevos datos que antes ignorábamos.

Más allá del modelo estándar habrá otras respuestas que nos lleven a poder hacer otras preguntas que en este momento, no sabemos ni plantear por falta de conocimientos. Si no conociéramos que los protones están formados por Quarks, ¿cómo nos podríamos preguntar si habrá algo más allá de los Quarks?

El gobierno de Estados Unidos, después de llevar gastados miles de millones de dólares, suspendió la construcción del supercolisionador superconductor de partículas asestando un duro golpe a la física de altas energías, y se esfumó la oportunidad para obtener nuevos datos de vital importancia para el avance de este modelo, que de momento es lo mejor que tenemos.

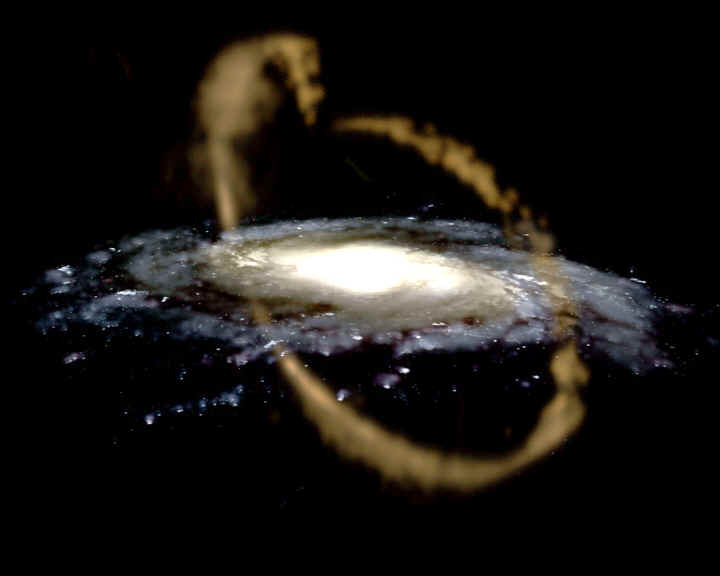

Se han estado inventando nuevas ideas, como la supersimetría y el technicolor. Los astrofísicos estarán interesados en tales ideas porque predicen una gran cantidad de nuevas partículas superpesadas, y también varios tipos de partículas que interaccionan ultradébilmente, los technipiones. Éstas podrían ser las WIMP’s (Weakly Interacting Massive Particles, o Partículas Masivas Débilmente Interactivas) que pueblan los huecos entre las galaxias, y serían así las responsables de la masa perdida que los astrofísicos siguen buscando y llaman “materia oscura”.

Que aparezcan “cosas” nuevas y además, imaginarlas antes, no es fácil. Recordemos cómo Paul Dirac se sintió muy incómodo cuando en 1931 dedujo, a partir de su ecuación del electrón, que debería existir una partícula con carga eléctrica opuesta. Esa partícula no había sido descubierta y le daba reparo perturbar la paz reinante en la comunidad científica con una idea tan revolucionaria, así que disfrazó un poco la noticia: “Quizá esta partícula cargada positivamente, tan extraña, sea simplemente el protón”, sugirió. Cuando poco después se identificó la auténtica antipartícula del electrón (el positrón) se sorprendió tanto que exclamó: “¡Mi ecuación es más inteligente que su inventor!”. Este último comentario es para poner un ejemplo de cómo los físicos trabajan y buscan caminos matemáticos mediante ecuaciones de las que, en cualquier momento (si están bien planteadas), surgen nuevas ideas y descubrimientos que ni se podían pensar. Así pasó también con las ecuaciones de Einstein de la relatividad general, donde Schwarzschild dedujo la existencia de los agujeros negros.

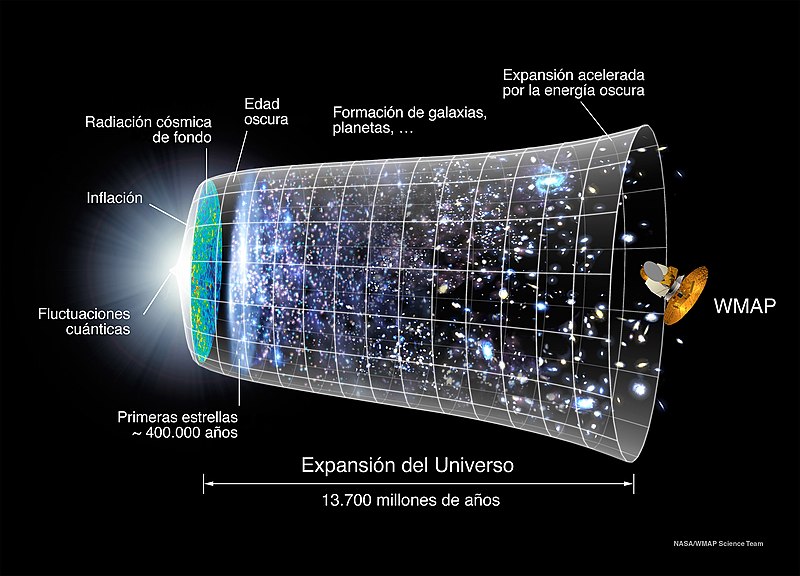

Se piensa que al principio del comienzo del tiempo, cuando surgió el Big Bang, las energías eran tan altas que allí reinaba la simetría total; sólo había una sola fuerza que todo lo englobaba. Más tarde, a medida que el universo se fue expandiendo y enfriando, surgieron las cuatro fuerzas que ahora conocemos y que todo lo rigen. Tenemos los medios, en los supercolisionadores de partículas, para viajar comenzando por 1.000 MeV, hasta finalizar en cerca de 1019 MeV, que corresponde a una escala de longitudes de aproximadamente 10–30 cm. Howard Georgi, Helen Quinn y Steven Weinberg descubrieron que ésta es la región donde las tres constantes de acoplamiento gauge se hacen iguales (U(1), SU(2) y SU(3)); resultan ser lo mismo. ¿Es una coincidencia que las tres se hagan iguales simultáneamente? ¿Es también una coincidencia que esto suceda precisamente en esa escala de longitud? Faltan sólo tres ceros más para alcanzar un punto de retorno. Howard Georgi y Sheldon Glashow descubrieron un modelo genuinamente unificado en el dominio de energías de 1019 MeV tal que, cuando se regresa de allí, espontáneamente surgen las tres fuerzas gauge tal como las conocemos. De hecho, ellos encontraron el modelo; la fórmula sería SU(5), que significa que el multiplote más pequeño debe tener cinco miembros.

Materia y Energía Oscura… Un Misterio…Sin resolver.

Y, a todo esto, ¿dónde está esa energía oculta? ¿Y donde la materia? Podemos suponer que la primera materia que se creo en el Universo fue la que llamamos (algún nom,bre había que ponerle) “Materia Oscura”, esa clase de Ilem o sustancia primera del Universo que mejor sería llamarla invisible, ya que, de no ser así, difícil sería explicar cómo se pudieron formar las primeras estrellas y galaxias de nuestro Universo, ¿dónde está el origen de la fuerza de Gravedad que lo hizo posible, sino en esa materia escondida?

¡Lo dicho! Necesitamos saber, y, deseo que de una vez por todas, se cumpla lo que dejó dicho Hilbert en su tumba de Gotinga (Alemania): “Tenemos que saber, ¡sabremos!. Pero…

¡Que sea pronto!

emilio silvera

Sep

25

El “universo” fascinante de lo muy pequeño

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (3)

Comments (3)

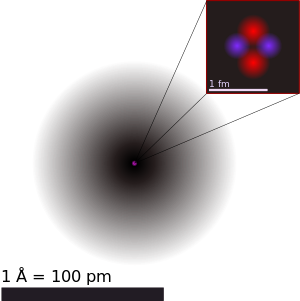

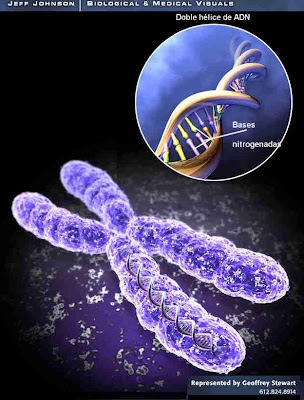

Muchas veces hemos hablado del electrón que rodea el núcleo, de su carga eléctrica negativa que complementa la positiva de los protones y hace estable al átomo; tiene una masa de solamente 1/1.836 de la del núcleo más ligero (el del hidrógeno). La importancia del electrón es vital en el universo.

El núcleo atómico es la parte central de un átomo tiene carga positiva, y concentra más del 99.99% de la masa total del átomo. Esta fuerza es la responsable de mantener unidos a los nucleones (protón y neutrón) que coexisten en el núcleo atómico venciendo a la repulsión electromagnética entre los protones que poseen carga eléctrica del mismo signo (positiva) y haciendo que los neutrones, que no tienen carga eléctrica, permanezcan unidos entre sí y también a los protones.

Hasta ahí, lo que es el nucleo. Sin embargo, la existencia de los átomos que forman las moléculas y los cuerpos -grandes y pequeños- que conforman los objetos del universo, es posible gracias a los electrones que, rodean el núcleo atómico y, al tener carga negativa similar a la positiva de los protones, crean la estabilidad necesaria para que todo nuestro mundo sea como lo podemos observar.

Los cuantos forman cosas bellas y útiles como el ozono atmosférico

Pero busquemos los “cuantos”. La física del siglo XX empezó exactamente en el año 1900, cuando el físico alemán Max Planck propuso una posible solución a un problema que había estado intrigando a los físicos durante años. Es el problema de la luz que emiten los cuerpos calentados a una cierta temperatura, y también la radiación infrarroja emitida, con menor intensidad, por los objetos más fríos (radiación de cuerpo negro).

Según la física clásica, la energía radiada debería ser igual para todas las longitudes de onda, y al aumentar la temperatura, la radiación debería ser uniformemente más intensa. Para explicar esto, Planck supuso que cada una de las partículas que constituyen la materia, está oscilando y emitiendo energía en forma de radiación electromagnética; esta energía emitida no puede tomar un valor cualquiera, sino que debe ser múltiplo entero de un valor mínimo llamado cuanto o paquete de energía.

Estaba bien aceptado entonces que esta radiación tenía un origen electromagnético y que se conocían las leyes de la naturaleza que regían estas ondas electromagnéticas. También se conocían las leyes para el frío y el calor, la así llamada “termodinámica”, o al menos eso parecía. Pero si utilizamos las leyes de la termodinámica para calcular la intensidad de una radiación, el resultado no tiene ningún sentido. Los cálculos nos dicen que se emitiría una cantidad infinita de radiación en el ultravioleta más lejano y, desde luego, esto no es lo que sucede. Lo que se observa es que la intensidad de la radiación muestra un pico a una cierta longitud de onda característica, y que la intensidad disminuye tanto para longitudes mayores como para menores. Esta longitud de onda característica es inversamente proporcional a la temperatura absoluta de objeto radiante (la temperatura absoluta se define por una escala de temperatura que empieza a 273º bajo cero). Cuando a 1.000º C un objeto se pone al “rojo vivo”, el objeto está radiando en la zona de luz visible.

Lo que Planck propuso fue simplemente que la radiación sólo podía ser emitida en paquetes de un tamaño dado. La cantidad de energía de uno de esos paquetes, o cuantos, es inversamente proporcional a la longitud de onda, y por tanto, proporcional a la frecuencia de radiación emitida. La fórmula es E = hν, donde E es la energía del paquete, ν es la frecuencia y h es una nueva constante fundamental de la naturaleza, la constante de Planck. Cuando Planck calculó la intensidad de la radiación térmica imponiendo esta nueva condición, el resultado coincidió perfectamente con las observaciones.

Poco tiempo después, en 1905, Einstein formuló esta teoría de una manera mucho más tajante: él sugirió que los objetos calientes no son los únicos que emiten radiación en paquetes de energía, sino que toda la radiación consiste en múltiplos del paquete de energía de Planck. El príncipe francés Louis-Victor de Broglie, dándole otra vuelta a la teoría, propuso que no sólo cualquier cosa que oscila tiene energía, sino que cualquier cosa con energía se debe comportar como una “onda” que se extiende en una cierta región del espacio, y que la frecuencia ν de la oscilación verifica la ecuación de Planck. Por lo tanto, los cuantos asociados con los rayos de luz deberían verse como una clase de partículas elementales: el fotón. Todas las demás clases de partículas llevan asociadas diferentes ondas oscilantes de campos de fuerza.

También en el movimiento de los átomos dentro del núcleo, está presente la simetría y la belleza de la Naturaleza.

El curioso comportamiento de los electrones en el interior del átomo, descubierto y explicado por el famoso físico danés Niels Bohr, se pudo atribuir a las ondas de de Broglie. Poco después, en 1926, Edwin Schrödinger descubrió cómo escribir la teoría ondulatoria de de Broglie con ecuaciones matemáticas exactas. La precisión con la cual se podían realizar cálculos era asombrosa, y pronto quedó claro que el comportamiento de todos los objetos pequeños quedaba exactamente determinado por las recién descubiertas “ecuaciones de ondas cuánticas”.

Está bien comprobado que la mecánica cuántica funciona de maravilla…, pero, sin embargo, surge una pregunta muy formal: ¿qué significan realmente estas ecuaciones?, ¿qué es lo que están describiendo? Cuando Isaac Newton, allá en 1867 formuló cómo debían moverse los planetas alrededor del Sol, estaba claro para todo el mundo qué significaban sus ecuaciones: que los planetas estaban siempre en una posición bien definida des espacio y que sus posiciones y sus velocidades en un momento concreto determinan inequívocamente cómo evolucionarán las posiciones y las velocidades en el tiempo.

Pero para los electrones todo es diferente. Su comportamiento parece estar envuelto en misterio. Es como si pudieran “existir” en diferentes lugares simultáneamente, como si fueran una nube o una onda, y esto no es un efecto pequeño. Si se realizan experimentos con suficiente precisión, se puede determinar que el electrón parece capaz de moverse simultáneamente a lo largo de trayectorias muy separadas unas de otras. ¿Qué puede significar todo esto?

Niels Bohr consiguió responder a esta pregunta de forma tal que con su explicación se pudo seguir trabajando, y muchos físicos siguen considerando su respuesta satisfactoria. Se conoce como la interpretación de Copenhague de la mecánica cuántica que, dicho sea de paso, con la que no todos están de acuerdo.

Las leyes de la mecánica cuántica han sido establecidas con mucha precisión; permite cómo calcular cualquier cosa que queramos saber. Pero si queremos “interpretar” el resultado, nos encontramos con una curiosa incertidumbre fundamental: que varias propiedades de las partículas pequeñas no pueden estar bien definidas de manera simultánea. Por ejemplo, podemos determinar la velocidad de una partícula con mucha precisión, pero entonces no sabremos exactamente dónde se encuentra; o a la inversa, podemos determinar la posición con precisión, pero entonces su velocidad queda mal definida. Si una partícula tiene espín (rotación alrededor de su eje), la dirección alrededor de la cual está rotando (la orientación del eje) no puede ser definida con gran precisión.

No es fácil explicar de forma sencilla de dónde viene esta incertidumbre, pero existen ejemplos en la vida cotidiana que tienen algo parecido. La altura de un tono y la duración en el tiempo durante el cual oímos el tono tienen una incertidumbre mutua similar. Para afinar un instrumento musical se debe escuchar una nota durante un cierto intervalo de tiempo y compararla, por ejemplo, con un diapasón que debe vibrar también durante un tiempo. Notas muy breves no tienen bien definido el tono.

Para que las reglas de la mecánica cuántica funcionen, es necesario que todos los fenómenos naturales en el mundo de las cosas pequeñas estén regidos por las mismas reglas. Esto incluye a los virus, bacterias e incluso a las personas. Sin embargo, cuando más grande y más pesado es un objeto, más difícil es observar las desviaciones de las leyes del movimiento “clásicas” debidas a la mecánica cuántica. Me gustaría referirme a esta exigencia tan importante y tan peculiar de la teoría con la palabra “holismo”. Esto no es exactamente lo mismo que entienden algunos filósofos por holismo, y que podría definir como “el todo es más que la suma de sus partes”. Si la física nos ha enseñado algo es justo lo contrario. Un objeto compuesto de un gran número de partículas puede ser entendido exactamente si se conocen las propiedades de sus partes (partículas); basta que sepamos sumar correctamente (¡y esto no es nada fácil en mecánica cuántica!). Lo que entiendo por holismo es que, efectivamente, el todo es la suma de las partes, pero sólo se puede hacer la suma si todas las partes obedecen a las mismas leyes. Por ejemplo, la constante de Planck, h, que es igual a 6’626075… × 10-34 Julios segundo, debe ser exactamente la misma para cualquier objeto en cualquier sitio, es decir, debe ser una constante universal, no importa en qué galaxia la podamos medir.

Einstein y otros pioneros de la M.C., tales como Edwin Schrödinger…, creían que hay más de lo que se ve

Las reglas de la mecánica cuántica funcionan tan bien que refutarlas resulta realmente difícil. Los trucos ingeniosos descubiertos por Werner Heisemberg, Paul Dirac y muchos otros mejoraron y completaron las reglas generales. Pero Einstein y otros pioneros como Erwin Schrödinger siempre presentaron serias objeciones a esta interpretación. Quizá funcione bien, pero ¿dónde está exactamente el electrón?, ¿en el punto x o en el punto y? En pocas palabras, ¿dónde está en realidad?, y ¿cuál es la realidad que hay detrás de nuestras fórmulas? Si tenemos que creer a Bohr, no tiene sentido buscar tal realidad. Las reglas de la mecánica cuántica, por sí mismas, y las observaciones realizadas con detectores son las únicas realidades de las que podemos hablar.

La mecánica cuántica puede ser definida o resumida así: en principio, con las leyes de la naturaleza que conocemos ahora se puede predecir el resultado de cualquier experimento, en el sentido que la predicción consiste en dos factores: el primer factor es un cálculo definido con exactitud del efecto de las fuerzas y estructuras, tan riguroso como las leyes de Isaac Newton para el movimiento de los planetas en el Sistema Solar; el segundo factor es una arbitrariedad estadística e incontrolable definida matemáticamente de forma estricta. Las partículas seguirán una distribución de probabilidades dadas, primero de una forma y luego de otra. Las probabilidades se pueden calcular utilizando la ecuación de Schrödinger de función de onda (Ψ) que, con muchas probabilidades nos indicará el lugar probable donde se encuentra una partícula en un momento dado.

Muchos estiman que esta teoría de las probabilidades desaparecerá cuando se consiga la teoría que explique, de forma completa, todas las fuerzas; la buscada teoría del todo, lo que implica que nuestra descripción actual incluye variables y fuerzas que (aún) no conocemos o no entendemos. Esta interpretación se conoce como hipótesis de las variables ocultas.

Albert Einstein, Nathan Rosen y Boris Podolski idearon un “Gedankenexperiment”, un experimento hipotético, realizado sobre el papel, para el cual la mecánica cuántica predecía como resultado algo que es imposible de reproducir en ninguna teoría razonable de variables ocultas. Más tarde, el físico irlandés John Stewar Bell consiguió convertir este resultado en un teorema matemático; el teorema de imposibilidad.

emilio silvera

Sep

22

La Cuántica misteriosa

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (2)

Comments (2)

Algunos se empeñan en que, las leyes de la física se simplifican en dimensiones más altas. Y, lo cierto es que, al no haberlas visto nunca -no están en nuestro plano de universo-, nos inventamos mil y una imagen pretendiendo que las representen pero, en realidad, no lo hace, Simplemente son figuras extrañas y espacios curvos de Riemann de enrevesado diseño que son…, otra cosa.

En una de las teorías de cuerdas, la conocida como la, se tiene que desarrollar en el espacio 26–dimensional de las vibraciones de sentido contrario a las agujas del reloj de la cuerda heterótica que tiene espacio suficiente para explicar todas las simetrías encontradas en la teoría de Einstein y en la teoría cuántica. Así, por primera vez, la geometría pura ha dado una simple explicación de por qué el mundo subatómico debería exhibir necesariamente ciertas simetrías que emergen del enrollamiento del espacio de más dimensiones: Las simetrías del dominio subatómico no son sino remanentes de la simetría del espacio de más dimensiones.

Las galaxias, las estrellas y los mundos… Y muchas más cosas, respetan patrónes simétricos que hacen de cada una de sus figuras, una misma estructuración que las hacen similares en un plano general, independientemente de que cada objeto tenga sus propias peculiaridades.

Esto significa que la belleza y simetrías encontradas en la naturaleza pueden ser rastreadas en última instancia hasta el espacio multidimensional. Por ejemplo, los copos de nieve crean bellas figuras hexagonales, ninguna de las cuales es exactamente igual a otra, han heredado sus estructuras de las formas en que sus moléculas han sido dispuestas geométricamente, determinada básicamente por las cortezas electrónicas de estas moléculas, que a su vez nos llevan de nuevo a las simetrías rotacionales de la teoría cuántica, dadas por O (3).

Del bonito arcoiris ?quién no tiene la experiencia de contemplarlo? También aquí hay una bella simetría

No hay dos cristales de nieve iguales pero la simetría de todos es la misma (de aspecto exagonal aunque desde el punto de vista estrictamente cristalográfico, trigonal. La razón se encuentra en la estructura cristalina del hielo (mostrada en color en el centro) que tiene exactamente la misma simetría y la transmite a los cristales.

Podemos concluir diciendo que las simetrías que vemos a nuestro alrededor, desde un arco iris a las flores y a los cristales, pueden considerarse en última instancia como manifestaciones de fragmentos de la teoría decadimensional original. Riemann y Einstein habían confiado en llegar a una comprensión geométrica de por qué las fuerzas pueden determinar el movimiento y la naturaleza de la materia.

Dado el enorme poder de sus simetrías, no es sorprendente que la teoría de supercuerdas sea radicalmente diferente de cualquier otro tipo de física. De hecho, fue descubierta casi por casualidad. Muchos físicos han comentado que si este accidente fortuito no hubiese ocurrido, entonces la teoría no se hubiese descubierto hasta bien entrado el siglo XXI. Esto es así porque supone una neta desviación de todas las ideas ensayadas en el pasado siglo XX. No es una extensión natural de tendencias y teorías populares en este siglo que ha pasado; permanece aparte.

Las supercuerdas van más lejos que todo esto

Por el contrario, la teoría de la relatividad general de Einstein tuvo una evolución normal y lógica. En primer lugar, su autor, postula el principio de equivalencia. Luego reformuló este principio físico en las matemáticas de una teoría de campos de la gravitación basada en los campos de Faraday y en el tensor métrico de Riemann. Más tarde llegaron las “soluciones clásicas”, tales como el agujero negro y el Big Bang. Finalmente, la última etapa es el intento actual de formular una teoría cuántica de la gravedad. Por lo tanto, la relatividad general siguió una progresión lógica, desde un principio físico a una teoría cuántica.

Geometría → teoría de campos → teoría clásica → teoría cuántica.

Contrariamente, la teoría de supercuerdas ha estado evolucionando hacia atrás desde su descubrimiento accidental en 1.968. Esta es la razón de que nos parezca extraña y poco familiar, estamos aún buscando un principio físico subyacente, la contrapartida del principio de equivalencia de Einstein.

Suponemos que las cuerdas están más allá de los Quarks

Uno de los secretos más profundos de la teoría de cuerdas, que aún no es bien comprendido, es por qué está definida solo en diez , once y veintiséis dimensiones. De todas las maneras, como nos dice Michiu Kaku, ese Físico que mira hacia el futuro, habría que tener presente las funciones modulares del Ramanujan para ver sí, dentro de ellas, están las respuestas de esas preguntas que, por ahora, nadie ha sabido contestar.

Gran parte de este trabajo es original del libro Hiperespacio de Michio Kaku, y, desde luego, como él nos anuncia, la Física tiene muchas de las respuestas que buscamos, sin embargo, también como nos dice la misma Física, algunas veces esas respuestas están situadas en la parte más simple de lo que estamos estudiando y, sin embargo, nos empeñamos en ahondar, de manera innecesaria hacia lo más profundo e incomprensible para buscar lo que tenemos delante de nuestras propias narices.

Si el límite de todas las teorías están marcados por las unidades de Planck, ya sabemos hasta dónde podemos llegar y, desde luego, la verificación de la Teoría de cuerdas, si como dicen los expertos necesita de la energía de Planck (1019 GeV) para ser verificada, entonces, nos queda mucho que esperar porque, ¿cuándo podrán tener los humanos esa energía a su disposición?

Existen límites a los que aún no han podido llegar nuestras teorías, y, el Límite de Planck es el que marca las fronteras de las teorías actuales que, nunca han podido llegar tan lejos como lo que nos dice esta simple ecuación:

Gabriele Veneziano es un físico italiano Mahiko Suzuki

La teoría nació casi por casualidad en 1.968 cuando dos jóvenes físicos teóricos, Gabriel Veneziano y Mahiko Suzuki, estaban hojeando independientemente libros de matemáticas. Figúrense ustedes que estaban buscando funciones matemáticas que describieran las interacciones de partículas fuertemente interactivas. Mientras estudiaban en el CERN, el Centro Europeo de Física Teórica en Ginebra, Suiza, tropezaron independientemente con la función beta de Euler, una función matemática desarrollada en el S. XIX por el matemático Leonhard Euler. Se quedaron sorprendidos al descubrir que la función beta de Euler ajustaba casi todas las propiedades requeridas para describir interacciones fuertes de partículas elementales.

Según he leído, durante un almuerzo en el Lawrence Berkeley Laboratory en California, con una espectacular vista del Sol brillando sobre el puerto de San Francisco, Suzuki le explicó a Michio Kaku mientras almorzaban la excitación de descubrir, prácticamente por casualidad, un resultado parcialmente importante. No se suponía que la física se pudiera hacer de ese modo casual.

Tras el descubrimiento, Suzuki, muy excitado, mostró el hallazgo a un físico veterano del CERN. Tras oír a Suzuki, el físico veterano no se impresionó. De hecho le dijo a Suzuki que otro físico joven (Veneziano) había descubierto la misma función unas semanas antes. Disuadió a Suzuki de publicar su resultado. Hoy, esta función beta se conoce con el nombre de modelo Veneziano, que ha inspirado miles de artículos de investigación iniciando una importante escuela de física y actualmente pretende unificar todas las leyes de la física.

En 1970, el Modelo de Veneziano-Suzuki (que contenía un misterio), fue parcialmente explicado cuando Yoichiro Nambu, de la Universidad de Chicago, y Tetsuo Goto, de la Nihon University, descubrieron que una cuerda vibrante yace detrás de sus maravillosas propiedades.

Así que, como la teoría de cuerdas fue descubierta hacia atrás y por casualidad, los físicos aún no conocen el principio físico que subyace en la teoría de cuerdas vibrantes y sus maravillosas propiedades.

El último paso en la evolución de la teoría de cuerdas (y el primer paso en la evolución de la relatividad general) aún está pendiente de que alguien sea capaz de darlo.

Así, Witten dice:

“Los seres humanos en el planeta tierra nunca dispusieron del marco conceptual que les llevara a concebir la teoría de supercuerdas de manera intencionada, surgió por razones del azar, por un feliz accidente. Por sus propios méritos, los físicos del siglo XX no deberían haber tenido el privilegio de estudiar esta teoría muy avanzada a su tiempo y a su conocimiento. No tenían (ni tenemos ahora mismo) los conocimientos y los prerrequisitos necesarios para desarrollar dicha teoría, no tenemos los conceptos correctos y necesarios.”

Actualmente, Edwar Witten es el físico teórico que, al frente de un equipo de físicos de Princeton, lleva la bandera de la teoría de supercuerdas con aportaciones muy importantes en el desarrollo de la misma. De todas las maneras, aunque los resultados y avances son prometedores, el camino por andar es largo y la teoría de supercuerdas en su conjunto es un edificio con muchas puertas cerradas de las que no tenemos las llaves para acceder a su interior y mirar lo que allí nos aguarda.

Ni con esta colección podremos abrir la puerta que nos lleve a la Teoría cuántica de la gravedad que, según dicen, subyace en la teoría M

El problema está en que nadie es lo suficientemente inteligente para resolver la teoría de campos de cuerdas o cualquier otro enfoque no perturbativo de esta teoría. Se requieren técnicas que están actualmente más allá de nuestras capacidades. Para encontrar la solución deben ser empleadas técnicas no perturbativas, que son terriblemente difíciles. Puesto que el 99 por ciento de lo que conocemos sobre física de altas energías se basa en la teoría de perturbaciones, esto significa que estamos totalmente perdidos a la hora de encontrar la verdadera solución de la teoría.

Nosotros, como el gato, estamos ante un enredo que no sabemos como solucionar. Nos faltan los conocimientos para ello. Y, como nuestras mentes evolucionan al ritmo que tiene impuesto el Universo, tendremos esas respuestas cuando llegue el momento, cuando estémos preparados para ello. Sobre todo, el conocimiento necesario para manejar las implicaciones que de tales conocimientos se pueden derivar.

¿Por qué diez dimensiones?

Uno de los secretos más profundos de la teoría de cuerdas, que aún no es bien comprendido, es por qué está definida sólo en diez, once y veintiséis dimensiones. Si calculamos cómo se rompen y se vuelven a juntar las cuerdas en el espacio N-dimensional, constantemente descubrimos que pululan términos absurdos que destruyen las maravillosas propiedades de la teoría. Afortunadamente, estos términos indeseados aparecen multiplicados por (N-10). Por consiguiente, para hacer que desaparezcan estas anomalías, no tenemos otra elección cuántica que fijar N = 10. La teoría de cuerdas, de hecho, es la única teoría cuántica conocida que exige completamente que la dimensión del espacio-tiempo esté fijada en un número único, el diez.

Por desgracia, los teóricos de cuerdas están, por el momento, completamente perdidos para explicar por qué se discriminan las diez dimensiones. La respuesta está en las profundidades de las matemáticas, en un área denominada funciones modulares.

Al manipular los diagramas de lazos de Kikkawa, Sakita y Virasoro creados por cuerdas en interacción, allí están esas extrañas funciones modulares en las que el número 10 aparecen en los lugares más extraños.

Estas funciones modulares son tan misteriosas como el hombre que las investigó, el místico del este. Quizá si entendiéramos mejor el trabajo de este genio indio, comprenderíamos por qué vivimos en nuestro universo actual.

El misterio de las funciones modulares podría ser explicado por quien ya no existe, Srinivasa Ramanujan, el hombre más extraño del mundo de los matemáticos. Igual que Riemann, murió antes de cumplir cuarenta años, y como Riemann antes que él, trabajó en total aislamiento en su universo particular de números y fue capaz de reinventar por sí mismo lo más valioso de cien años de matemáticas occidentales que, al estar aislado del mundo en las corrientes principales de los matemáticos, le eran totalmente desconocidos, así que los buscó sin conocerlos. Perdió muchos años de su vida en redescubrir matemáticas conocidas.

Dispersas entre oscuras ecuaciones en sus cuadernos están estas funciones modulares, que figuran entre las más extrañas jamás encontradas en matemáticas. Ellas reaparecen en las ramas más distantes e inconexas de las matemáticas. Una función que aparece una y otra vez en la teoría de las funciones modulares se denomina (como ya he dicho otras veces) hoy día “función de Ramanujan” en su honor. Esta extraña función contiene un término elevado a la potencia veinticuatro.

El número 24 aparece repetidamente en la obra de Ramanujan. Este es un ejemplo de lo que las matemáticas llaman números mágicos, que aparecen continuamente donde menos se esperan por razones que nadie entiende. Milagrosamente, la función de Ramanujan aparece también en la teoría de cuerdas. El número 24 que aparece en la función de Ramanujan es también el origen de las cancelaciones milagrosas que se dan en la teoría de cuerdas. En la teoría de cuerdas, cada uno de los veinticuatro modos de la función de Ramanujan corresponde a una vibración física de la cuerda. Cuando quiera que la cuerda ejecuta sus movimientos complejos en el espacio-tiempo dividiéndose y recombinándose, deben satisfacerse un gran número de identidades matemáticas altamente perfeccionadas. Estas son precisamente las entidades matemáticas descubiertas por Ramanujan. Puesto que los físicos añaden dos dimensiones más cuando cuentan el número total de vibraciones que aparecen en una teoría relativista, ello significa que el espacio-tiempo debe tener 24 + 2 = 26 dimensiones espacio-temporales.

Reflejos de luz polarizada sobre una superficie de un disco

Para comprender este misterioso factor de dos (que añaden los físicos), consideramos un rayo de luz que tiene dos modos físicos de vibración. La luz polarizada puede vibrar, por ejemplo, o bien horizontal o bien verticalmente. Sin embargo, un campo de Maxwell relativista Aµ tiene cuatro componentes, donde µ = 1, 2, 3, 4. Se nos permite sustraer dos de estas cuatro componentes utilizando la simetría gauge de las ecuaciones de Maxwell. Puesto que 4 – 2 = 2, los cuatro campos de Maxwell originales se han reducido a dos. Análogamente, una cuerda relativista vibra en 26 dimensiones. Sin embargo, dos de estos modos vibracionales pueden ser eliminados cuando rompemos la simetría de la cuerda, quedándonos con 24 modos vibracionales que son las que aparecen en la función de Ramanujan.

Es posible que, en las matemáticas de Ramanujan estén algunas respuestas

Cuando se generaliza la función de Ramanujan, el 24 queda reemplazado por el número 8. Por lo tanto, el número crítico para la supercuerda es 8+2=10. Este es el origen de la décima dimensión que exige la teoría. La cuerda vibra en diez dimensiones porque requiere estas funciones de Ramanujan generalizadas para permanecer auto consistente. Dicho de otra manera, los físicos no tienen la menor idea de por qué 10 y 26 dimensiones se seleccionan como dimensión de la cuerda. Es como si hubiera algún tipo de numerología profunda que se manifestara en estas funciones que nadie comprende. Son precisamente estos números mágicos que aparecen en las funciones modulares elípticas los que determinan que la dimensión del espacio-tiempo sea diez.

En el análisis final, el origen de la teoría decadimensional es tan misterioso como el propio Ramanujan. Si alguien preguntara a cualquier físico del mundo por qué la naturaleza debería existir en diez dimensiones, estaría obligado a responder “no lo sé”. Se sabe en términos difusos, por qué debe seleccionarse alguna dimensión del espacio tiempo (de lo contrario la cuerda no puede vibrar de una forma cuánticamente autoconsistente), pero no sabemos por qué se seleccionan estos números concretos.

¡Son tantas las cosas que no sabemos!

Publica: emilio silvera

PD. Le damos las gracias a Michio Kaku por sus ideas y su manera futurista de ver la Física.

Sep

21

El mundo que nos rodea

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (4)

Comments (4)

No siempre sabemos ver el mundo que nos rodea. El que miremos no significa que estemos viendo lo que realmente hay delante de nuestros ojos y, muchas veces, no son los ojos los únicos que pueden “ver” lo que hay más allá de lo que la vista puede alcanzar. Anoche, hasta una hora avanzada, estuve releyendo el Libro “Así de Simple” de John Gribbin, y, pareciéndome interesante os saqué un pequeño resumen del comienzo. Aquí os lo dejo.

El mundo que nos rodea parece ser un lugar complicado. Aunque hay algunas verdades sencillas que parecen eternas (las manzanas caen siempre hacia el suelo y no hacia el cielo; el Sol se levanta por el este, nunca por el oeste), nuestras vidas, a pesar de las modernas tecnologías, están todavía, con demasiada frecuencia, a merced de los complicados procesos que producen cambios drásticos y repentinos. La predicción del tiempo atmosférico tiene todavía más de arte adivinatorio que de ciencia; los terremotos y las erupciones volcánicas se producen de manera impredecible y aparentemente aleatorias; las fluctuaciones de la economía siguen ocasionando la bancarrota de muchos y la fortuna de unos pocos.

Sobre la posición de la salida del sol

Desde la época de Galileo (más o menos, a comienzos del siglo XVII) la ciencia ha hecho progresos –enormes-, ignorando en gran medida estas complejidades y centrándose en cuestiones sencillas, intentando explicar por qué las manzanas caen al suelo y por qué el Sol se levanta por el este. Los avances fueron de hecho tan espectaculares que hacia mediados del siglo XX ya se había dado respuesta a todas las cuestiones sencillas. Conceptos tales como la teoría general de la relatividad y la mecánica cuántica explicaron el funcionamiento global del universo a escalas muy grandes y muy pequeñas respectivamente, mientras el descubrimiento de la estructura del ADN y el modo en que éste se copia de una generación a otra hizo que la propia vida, así como la evolución, parecieran sencillas a nivel molecular. Sin embargo, persistió la complejidad del mundo a nivel humano –al nivel de la vida-. La cuestión más interesante de todas, la que planteaba cómo la vida pudo haber surgido a partir de la materia inerte, siguió sin respuesta.

Un descubrimiento así no podía dejar al mundo indiferente. En unos años el mundo científico se puso al día y la revolución genética cambió los paradigmas establecidos. Mucha gente aún no está preparada para aceptar el comienzo de una era poderosa en la que el ser humano tiene un control de sí mismo mayor al habitual. Había nacido la Ingeniería genética.

No debe extrañarnos que sea precisamente a escala humana donde se den las características más complejas del universo. Las que se resisten más a rendirse ante los métodos tradicionales de la investigación científica. Realmente, es posible que seamos lo más complejo que existe en el universo. La razón es que, a escalas más reducidas, entidades tales como los átomos se comportan individualmente de un modo relativamente sencillo en sus interacciones mutuas, y que las cosas complicadas e interesantes surgen, cuando se unen muchos átomos de maneras complicadas e interesantes, para formar organismos tales como los seres humanos.

Pero este proceso no puede continuar indefinidamente, ya que, si se unen cada vez más átomos, su masa total aumenta hasta tal punto que la Gravedad aplasta toda la estructura importante y la aniquila. Un átomo, o incluso una molécula tan simple como la del agua, es algo más sencillo que un ser humano, porque tiene poca estructura interna; una estrella, o el interior de un planeta, es también algo más sencillo que un ser humano porque la gravedad aplasta cualquier estructura hasta aniquilarla. Esta es la razón por la cual la ciencia puede decirnos más sobre el comportamiento de los átomos y el funcionamiento interno de las estrellas o los planetas que sobre el modo en que las personas nos comportamos.

Sí, hemos podido llegar a conocer lo que ocurre en el Sol, y sabemos de sus procesos interiores y exteriores, de las ráfagas de partículas que en sus épocas activas, nos envía continuamente hacía la superficie del planeta y, que no sólo provoca esas bonitas Auroras, sino que, su intensa radiación y magnetismo incide en todos los atilugios que tenemos para leer los datos de… ¡tántas cosas!

Cuando los problemas sencillos se rindieron ante el empuje de la investigación, fue algo natural que los científicos abordaran rompecabezas más complicados que iban asociados con sistemas complejos, para que por fin fuera posible comenzar a comprender el funcionamiento del mundo a una escala más humana compleja y, para ello, hubo que esperar hasta la década de 1960, que fue cuando aparecieron los poderosos y rápidos (para lo que se estilaba en aquella época) ordenadores electrónicos. Estos nuevos inventos empezaron a ser conocidos por un público más amplio entre mediados y finales de la década de 1980, primero con la publicación del libro, ahora convertido en un clásico, Order out of Chaos, de Ilya Prigogine e Isabelle Stergers, y luego, con Chaos, de James Gleick.

Las personas sencillas que, aunque tengan una educación aceptable, no están inmersas en el ámbito de la ciencia, cuando oyen hablar de Complejidad y Caos en esas áreas, sienten, de primeras, una especie de rechazo por aquello que (ellos creen) no van a comprender. Sin embargo, la cuestión no es tan difícil como a primera vista pudiera parecer, todo consiste en tener la posibilidad de que alguien, de manera “sencilla” (dentro de lo posible), nos explique las cosas dejando a un lado las matemáticas que, aunque describen de manera más amplia y pura aquellos conceptos que tratamos, también es verdad que, no siempre, están al alcance de todos. Un conocimiento básico de las cosas más complicadas, es posible. También la relatividad general y la mecánica cuántica, se consideraron, cuando eran nuevas, como unas ideas demasiado difíciles para que cualquiera las entendiera, salvo los expertos –pero ambas se basan en conceptos sencillos que son inteligibles para cualquier persona lega en la materia, siempre que esté dispuesta a aceptar su parte matemática con los ojos cerrados-. E la misma manera, el Caos y la Complejidad, también pueden ser entendidos y, si tenemos la suerte de tener un buen interlocutor que nos sepa explicar, aquellos conceptos básicos sobre los que se asientan tanto el Caos como la Complejidad, veremos maravillados como, de manera natural, la luz se hace en nosotros y podemos entender lo que antes nos parecía inalcanzable.

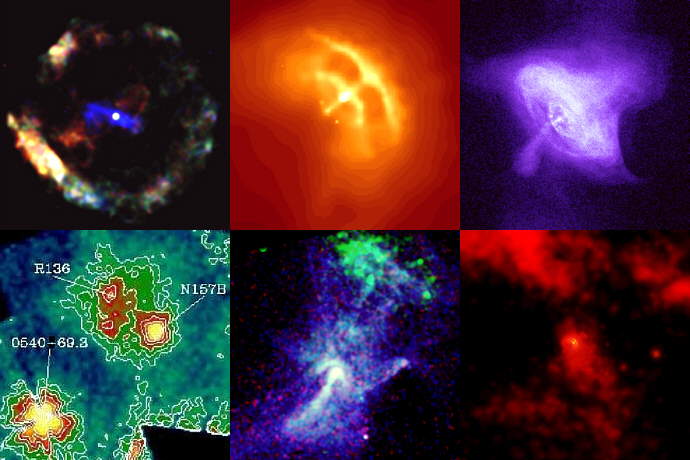

Se cree que las galaxias se han formado por la acumulación gravitacional de gas, algún tiempo después de la época de la recombinación. Las nubes de gas podrían haber comenzado a formar estrellas, quizás como resultado de las colisiones mutuas. El tipo de galaxia generado podría depender del ritmo al que el gas era transformado en estrellas, formándose las elípticas cuando el gas se convertía rápidamente en estrellas, y las espirales si la transformación de estrellas era lo suficientemente lenta como para permitir crecer de forma significativa un disco de gas.

Nubes moleculares en Orión que son los materiales primigenios para complejidades futuras

Las galaxias evolucionan al convertir progresivamente su gas remanente en estrellas, si bien no existe probablemente una evolución entre las diferentes tipos de la clasificación del conocido sistema de Hubble. No obstante, algunas galaxias elípticas pudieron haberse creado por la colisión y posterior fusión de dos galaxias espirales.

NGC 5426 y NGC 5427 son dos galaxias espirales de tamaños similares involucradas en una danza espectacular. No es seguro que esta interacción culmine en una colisión y a la larga en la fusión de las dos galaxias, aunque éstas ya han sido ya afectadas. Conocidas ambas con el nombre de Arp 271, su danza perdurará por decenas de millones de años, creando nuevas estrellas como resultado de la mutua atracción gravitacional entre las galaxias, un tirón observable en el borde de las estrellas que ya conectan a ambas. Ubicada a 90 millones de años-luz de distancia hacia la constelación de Virgo (la Virgen), el par Arp 271 tiene unos 130.000 años-luz de extensión. Fue descubierta originalmente en 1785 por William Herschel. Muy posiblemente nuestra Vía Láctea sufrirá una colisión similar en unos cinco mil millones de años más con la galaxia vecina Andrómeda, que ahora está ubicada a cerca de 2,6 millones de años-luz de la Vía Láctea.

Sí, mirando las imagenes nos da la sensación de cierto Caos y Complejidad

Tenemos que entender que, algunos sistemas (“sistema” no es más que una palabra de la jerga científica para asignar cualquier cosa, como un péndulo que oscila, o el sistema solar, o el agua que gotea de un grifo) son muy sensibles a sus condiciones de partida, de tal modo que una diferencia mínima en el “impulso” inicial que les damos ocasiona una gran diferencia en cómo van a acabar, y existe una retroalimentación, de manera que lo que un sistema hace afecta a su propio comportamiento. Así, a primera vista, parece que la guía es sencilla y, nos puede parecer mentira que así sea. Sin embargo, esa es la premisa que debemos tener en cuenta. Nos podríamos preguntar: ¿Es realmente verdad, que todo este asunto del Caos y de la Complejidad se basaba en dos ideas sencillas –la sensibilidad de un sistema a sus condiciones de partida, y la retroalimentación-¿ La respuesta es que sí.

La mayor parte de los objetos que pueden verse en el cielo nocturno son estrellas, unos pocos centenares son visibles a simple vista. Una estrella es una bola caliente principalmente compuesta por hidrógeno gaseoso. El Sol es un ejemplo de una estrella típica y común. La gravedad impide que el gas se evapore en el espacio y la presión, debida a la alta temperatura de la estrella, y la densidad impiden que la bola encoja. En el corazón de la estrella, la temperatura y la densidad son lo suficientemente altas para sustentar a las reacciones de fusión nuclear, y la energía, producida por estas reacciones, hace su camino a la superficie y la irradia al espacio en forma de calor y luz. Cuando se agota el combustible de las reacciones de fusión, la estructura de la estrella cambia. El proceso de producir elementos, cada vez más pesados, a partir de los más livianos y de ajustar la estructura interna para balancear gravedad y presión, es llamado evolución estelar.

La mayor parte de los objetos que pueden verse en el cielo nocturno son estrellas, unos pocos centenares son visibles a simple vista. Una estrella es una bola caliente principalmente compuesta por hidrógeno gaseoso. El Sol es un ejemplo de una estrella típica y común. La gravedad impide que el gas se evapore en el espacio y la presión, debida a la alta temperatura de la estrella, y la densidad impiden que la bola encoja. En el corazón de la estrella, la temperatura y la densidad son lo suficientemente altas para sustentar a las reacciones de fusión nuclear, y la energía, producida por estas reacciones, hace su camino a la superficie y la irradia al espacio en forma de calor y luz. Cuando se agota el combustible de las reacciones de fusión, la estructura de la estrella cambia. El proceso de producir elementos, cada vez más pesados, a partir de los más livianos y de ajustar la estructura interna para balancear gravedad y presión, es llamado evolución estelar.

Observar una estrella a través del telescopio permite conocer muchas de sus importantes propiedades. El color de una estrella es un indicador de su temperatura y ésta, a su vez, depende de una combinación entre la masa de la estrella y su fase evolutiva. Usualmente, las observaciones también permiten encontrar la luminosidad de la estrella o la tasa con la cual ella irradia energía, en forma de calor y luz.

Todas las estrellas visibles a simple vista forman parte de nuestra galaxia, la Vía Láctea. La Vía Láctea es un sistema compuesto por unos cien mil millones de estrellas, junto con una considerable cantidad de material interestelar. La galaxia tiene forma de un disco chato sumergido en un halo débil y esférico. La gravedad impide que las estrellas se escapen y, sus movimientos, hacen que el sistema no colapse. La Vía Láctea no posee un límite definido, la distribución de las estrellas decrece gradualmente con distancias crecientes del centro. El SDSS detecta estrellas más de un millón de veces más débiles que las que podemos ver a simple vista, lo suficientemente lejos para ver la estructura de la Vía Láctea.

De algún modo, esto es como decir que “todo lo que hay” sobre la teoría especial de la relatividad es que la velocidad de la luz es la misma para todos los observadores. Sin embargo, la complejidad de la estructura que se levanta sobre este hecho sencillo resulta asombrosa y requiere algunos conocimientos matemáticos para poder apreciarla plenamente. Claro que, eso no quita para que, un buen comunicador le pueda transmitir a otras personas mediante explicaciones sencillas lo esencial de la relatividad especial y general y también, sobre la esencia de la mecánica cuántica, y, de la misma manera, podríamos hablar del Caos y de la Complejidad. Debemos ser conscientes de que, el Caos, puede surgir a partir del Orden y que, la Complejidad, siempre llega a través de la sencillez de un comienzo. Podemos estar al borde del Caos y, de manera milagrosa ver que, también a partir de él surge la normalidad y lo nuevo que, no en pocas ocasiones pueden ser nuevas formas de vida. De la misma manera, las transformaciones de los elementos sencillos, bajo ciertas condiciones, llegan a adquirir una complejidad inusitada que, de alguna manera, es necesaria para que, en este mundo que nos rodea, existan seres que, como nosotros, sean el ejemplo más real y de más alto nivel que está presente en el Universo. Y, de la misma manera que nosotros estamos aquí, en un minúsculo sistema solar habitando un pequeño planeta que reúne todas las condiciones necesarias para la vida, de la misma forma digo, estarán poblados otros muchos planetas de otros muchos sistemas solares repartidos por nuestra Galaxia y por las otras que, a cientos de miles pululan por el Universo, y, todos esos seres “racionales”, se preguntaran las mismas cosas que nosotros y estarán interesados en descubrir los mismos misterios, los mismos secretos de la Naturaleza que, presintiendo que existen, tienen la intuición de que serán las respuestas esperadas para solucionar muchos de los problemas e inseguridades que ahora, en nuestro tiempo, nos aquejan.

Claro que, la mente nunca descansa. Acordaos de Aristarco de Samos que, en el siglo III a. C., ya anunció que la Tierra orbitaba alrededor del Sol y, Copérnico, que se llevó el premio, no lo dijo hasta el año 1543. Esto nos viene a demostrar que, a pesar de la complejidad del mundo, lo realmente complejo está en nosotros, en nuestras mentes que, presienten lo que pueda ser, intuyen el por qué de las cosas, fabrican pensamientos que, mucho más rápidos que la luz, llegan a las galaxias lejanas y, con los ojos de la mente pueden, atisbar aquellas cosas de las que, en silencio, ha oído hablar a su intuición dentro de su mente siempre atenta a todo aquello que puede ser una novedad, una explicación, un descubrimiento.

Vista de la Tierra y el Sol de la órbita (la imagen de la tierra tomada de http://visibleearth.nasa.gov)

Ahora estamos centrados en el futuro aquí en la Tierra pero, sin dejar de la mano ese futuro que nos espera en el espacio exterior. Es pronto aún para que el hombre vaya a las estrellas pero, algún día, ese será su destino y, desde ya, debe ir preparándose para esa aventura que sólo está a la espera de tener los medios tecnológicos necesarios para hacerla posible. Mientras tanto, jugamos con las sondas espaciales que enviamos a planetas vecinos para que, nos vayan informando de lo que están hechos aquellos mundos –grandes y pequeños- que, en relativamente poco tiempo, serán visitados por nuestra especie para preparar el salto mayor.

emilio silvera

Sep

21

El núcleo antes que el átomo

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (2)

Comments (2)

El núcleo atómico

El propio Rutherford empezó a vislumbrar la respuesta. Entre 1906 y 1908 (hace ahora un siglo) realizó constantes experimentos disparando partículas alfa contra una lámina sutil de metal (como oro o platino), para analizar sus átomos. La mayor parte de los proyectiles atravesaron la barrera sin desviarse (como balas a través de las hojas de un árbol), pero no todos. En la placa fotográfica que le sirvió de blanco tras el metal, Rutherford descubrió varios impactos dispersos e insospechados alrededor del punto central. Comprobó que algunas partículas habían rebotado. Era como si en vez de atravesar las hojas, algunos proyectiles hubiesen chocado contra algo más sólido. Rutherford supuso que aquella “balas” habían chocado contra una especie de núcleo denso, que ocupaba sólo una parte mínima del volumen atómico y ese núcleo de intensa densidad desviaban los proyectiles que acertaban a chocar contra él. Ello ocurría en muy raras ocasiones, lo cual demostraba que los núcleos atómicos debían ser realmente ínfimos, porque un proyectil había de encontrar por fuerza muchos millones de átomos al atravesar la lámina metálica.

Era lógico suponer, pues, que los protones constituían ese núcleo duro. Rutherford representó los protones atómicos como elementos apiñados alrededor de un minúsculo “núcleo atómico” que servía de centro (después de todo eso, hemos podido saber que el diámetro de ese núcleo equivale a algo más de una cienmilésima del volumen total del átomo).

En 1908 se concedió a Rutherford el premio Nobel de Química por su extraordinaria labor de investigación sobre la naturaleza de la materia. Él fue el responsable de importantes descubrimientos que permitieron conocer la estructura de los átomos en esa primera avanzadilla.

Desde entonces se pueden describir con términos más concretos los átomos específicos y sus diversos comportamientos. Por ejemplo, el átomo de hidrógeno posee un solo electrón. Si se elimina, el protón restante se asocia inmediatamente a alguna molécula vecina; y cuando el núcleo desnudo de hidrógeno no encuentra por este medio un electrón que participe, actúa como un protón (es decir, una partícula subatómica), lo cual le permite penetrar en la materia y reaccionar con otros núcleos si conserva la suficiente energía.

El helio, que posee dos electrones, no cede uno con tanta facilidad. Sus dos electrones forman un caparazón hermético, por lo cual el átomo es inerte. No obstante, si se despoja al helio de ambos electrones, se convierte en una partícula alfa, es decir, una partícula subatómica portadora de dos unidades de carga positiva.

Totales: 83.808.903

Totales: 83.808.903 Conectados: 47

Conectados: 47