Ene

13

¿La Física? ¡Una maravilla!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Cuando llegamos a los seres unicelulares, se ve que ellos no hay distinción entre arriba y abajo. Para ellos, la tensión superficial del agua es mucho más importante que la fuerza de la gravedad a esa escala.

La tensión superficial es una consecuencia de que todas las moléculas y los átomos se atraen unos a otros con una fuerza que nosotros llamamos de Van der Waals. fuerza tiene un alcance muy corto; para ser precisos, diremos que la intensidad de esta fuerza a una distancia r es aproximadamente 1/r7. Esto significa que si se reduce la distancia dos átomos a la mitad de la fuerza de Van der Waals con la que se atraen uno a otro se hace 2 × 2 × 2 × 2 × 2 × 2 × 2 = 128 veces más intensa. Cuando los átomos y las moléculas se acercan mucho unos a otros quedan unidos muy fuertemente a través de esta fuerza. El conocimiento de esta fuerza se debe a Johannes Diderik Van der Waals (1837 – 1923) con su tesis sobre la continuidad del líquido y gaseoso que le haría famoso, ya que en esa época (1873), la existencia de las moléculas y los átomos no estaba completamente aceptado.

La tensión superficial del agua, es el efecto físico (energía de atracción entre las moléculas) que “endurece” la capa superficial del agua en reposo y permite a algunos insectos, como el mosquito y otros desplazarse por la superficie del agua sin hundirse.

El famoso físico inglés James Clerk Maxwell, que formuló la teoría del electromagnetismo de Faraday, quedó muy impresionado por este de Van der Waals.

Los tamaños de los seres uniceculares, animales y vegetales, se miden en micrómetros o “micras”, donde 1 micra es 1/1.000 de milímetro, aproximadamente el tamaño de los detalles más pequeños que se pueden observar con un microscopio ordinario. El mundo de los microbios es fascinante, pero no es el objeto de este trabajo, y continuaremos el viaje emprendido las partículas elementales que forman núcleos, átomos, células y materia, así como las fuerzas que intervienen en las interacciones fundamentales del universo y que afecta a todo lo que existe.

Hemos hablado del electrón que rodea el núcleo, de su carga eléctrica negativa que complementa la positiva de los protones y hace estable al átomo; una masa de solamente 1/1.836 de la del núcleo más ligero (el del hidrógeno). La importancia del electrón es vital en el universo.

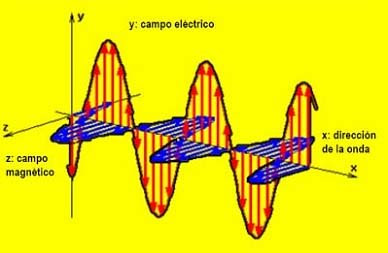

Pero busquemos los “cuantos”. La física del siglo XX empezó exactamente en el año 1900, cuando el físico alemán Max Planck propuso una posible solución a un problema que había intrigando a los físicos durante años. Es el problema de la luz que emiten los cuerpos calentados a una cierta temperatura, y también la radiación infrarroja emitida, con menor intensidad, por los objetos más fríos (radiación de cuerpo negro).

Estaba bien aceptado entonces que esta radiación tenía un origen electromagnético y que se conocían las leyes de la naturaleza que regían estas ondas electromagnéticas. También se conocían las leyes para el frío y el calor, la así llamada “termodinámica”, o al menos eso parecía. Pero si utilizamos las leyes de la termodinámica para calcular la intensidad de una radiación, el resultado no tiene ningún sentido. Los cálculos nos dicen que se emitiría una cantidad infinita de radiación en el ultravioleta más lejano y, luego, esto no es lo que sucede. Lo que se observa es que la intensidad de la radiación muestra un pico a una cierta longitud de onda característica, y que la intensidad disminuye tanto para longitudes mayores como para menores. Esta longitud de onda característica es inversamente proporcional a la temperatura absoluta de objeto radiante (la temperatura absoluta se define por una escala de temperatura que empieza a 273º bajo cero). Cuando a 1.000º C un objeto se pone al “rojo vivo”, el objeto está radiando en la zona de luz visible.

Radiación de Cuerpo Negro

Un cuerpo negro es un objeto teórico o ideal que absorbe toda la luz y toda la energía radiante que incide sobre él. Nada de la radiación incidente se refleja o pasa a través del cuerpo negro. A pesar de su , el cuerpo negro emite luz y constituye un modelo ideal físico para el estudio de la emisión de radiación electromagnética. El nombre Cuerpo negro fue introducido por Gustav Kirchhoff en 1862.

La luz emitida por un cuerpo negro se denomina radiación de cuerpo negro. Todo cuerpo emite energía en de ondas electromagnéticas, siendo esta radiación, que se emite incluso en el vacío, tanto más intensa cuando más elevada es la temperatura del emisor. La energía radiante emitida por un cuerpo a temperatura ambiente es escasa y corresponde a longitudes de onda superiores a las de la luz visible (es decir, de menor frecuencia). Al elevar la temperatura no sólo aumenta la energía emitida sino que lo hace a longitudes de onda más cortas; a esto se debe el cambio de color de un cuerpo cuando se calienta. Los cuerpos no emiten con igual intensidad a todas las frecuencias o longitudes de onda, sino que siguen la ley de Planck.

Lo que Planck propuso fue simplemente que la radiación sólo podía ser emitida en paquetes de un tamaño dado. La cantidad de energía de uno de esos paquetes, o cuantos, es inversamente proporcional a la longitud de onda, y por tanto, proporcional a la frecuencia de radiación emitida. La fórmula es E = hν, donde E es la energía del paquete, ν es la frecuencia y h es una nueva constante fundamental de la naturaleza, la constante de Planck. Cuando Planck calculó la intensidad de la radiación térmica imponiendo nueva condición, el resultado coincidió perfectamente con las observaciones.

Poco tiempo después, en 1905, Einstein formuló esta teoría de una manera mucho más tajante: él sugirió que los objetos calientes no son los únicos que emiten radiación en paquetes de energía, sino que toda la radiación consiste en múltiplos del paquete de energía de Planck. El príncipe francés Louis-Victor de Broglie, dándole otra vuelta a la teoría, propuso que no sólo cualquier cosa que oscila tiene energía, sino que cualquier cosa con energía se debe comportar una “onda” que se extiende en una cierta región del espacio, y que la frecuencia ν de la oscilación verifica la ecuación de Planck. Por lo tanto, los cuantos asociados con los rayos de luz deberían verse una clase de partículas elementales: el fotón. Todas las demás clases de partículas llevan asociadas diferentes ondas oscilantes de campos de fuerza, esto lo veremos más adelante.

El curioso comportamiento de los electrones en el interior del átomo, descubierto y explicado por el famoso físico danés Niels Bohr, se pudo atribuir a las ondas de de Broglie. Poco después, en 1926, Edwin Schrödinger descubrió cómo escribir la teoría ondulatoria de de Broglie con ecuaciones matemáticas exactas. La precisión con la cual se podían realizar cálculos era asombrosa, y pronto quedó claro que el comportamiento de todos los objetos pequeños quedaba exactamente determinado por las recién descubiertas “ecuaciones de ondas cuánticas”.

Está bien comprobado que la mecánica cuántica funciona de maravilla…, pero, sin embargo, surge una pregunta muy formal: ¿qué significan realmente estas ecuaciones?, ¿qué es lo que están describiendo? Isaac Newton, allá en 1867 formuló cómo debían moverse los planetas alrededor del Sol, estaba claro todo el mundo qué significaban sus ecuaciones: que los planetas estaban siempre en una posición bien definida des espacio y que sus posiciones y sus velocidades en un momento concreto determinan inequívocamente cómo evolucionarán las posiciones y las velocidades en el tiempo.

Pero los electrones todo es diferente. Su comportamiento parece estar envuelto en misterio. Es como si pudieran “existir” en diferentes lugares simultáneamente, como si fueran una nube o una onda, y esto no es un efecto pequeño. Si se realizan experimentos con suficiente precisión, se puede determinar que el electrón parece capaz de moverse simultáneamente a lo largo de trayectorias muy separadas unas de otras. ¿Qué puede significar todo esto?

Niels Bohr consiguió responder a esta pregunta de tal que con su explicación se pudo seguir trabajando, y muchos físicos siguen considerando su respuesta satisfactoria. Se conoce como la interpretación de Copenhague de la mecánica cuántica.

Si la mecánica cuántica tiene cosas extrañas y el espín es una de ellas. Y si uno piensa que la intuición le ayudará a comprender todo esto, pues no lo hará, o es poco probable que lo haga. Las partículas tienen un espín fundamental. Al igual que la carga eléctrica o la masa, el espín ayuda a definir que de partícula es cada una.

Las leyes de la mecánica cuántica han sido establecidas con mucha precisión; permite cómo calcular cualquier cosa que queramos saber. Pero si queremos “interpretar” el resultado, nos encontramos con una curiosa incertidumbre fundamental: que varias propiedades de las partículas pequeñas no pueden estar bien definidas de manera simultánea. Por ejemplo, podemos determinar la velocidad de una partícula con mucha precisión, pero entonces no sabremos exactamente dónde se encuentra; o a la inversa, podemos determinar la posición con precisión, pero entonces su velocidad queda mal definida. Si una partícula tiene espín (rotación alrededor de su eje), la dirección alrededor de la cual está rotando (la orientación del eje) no puede ser definida con gran precisión.

La posición y el momento de una partícula nunca lo podremos saber con precisión ilimitada.

No es fácil explicar de forma sencilla de dónde viene esta incertidumbre, pero existen ejemplos en la vida cotidiana que tienen algo parecido. La altura de un tono y la duración en el tiempo durante el cual oímos el tono tienen una incertidumbre mutua similar. Para afinar un instrumento se debe escuchar una nota durante un cierto intervalo de tiempo y compararla, por ejemplo, con un diapasón que debe vibrar también durante un tiempo. Notas muy breves no tienen bien definido el tono.

El principio de incertidumbre de Heisenberg representa uno de los pilares fundamentales de la mecánica cuántica, también lo es el prinicpio de exclusión de Pauli que explica como los fermiones se comportan y hacen posible que existan estrellas enanas blancas y de neutrones, otros principios de Física nos hablan del por qué, la materia se comporta como lo hace allá, en lo más profundo de su “ser”. Los físicos ven mucho más profundamente de lo que a primera vista podemos ver la gente normal, ellos son privilegiados que saben, del mundo, de la Naturaleza y del Universo, ellos comprender la dinámica oculta en ese “universo” de lo infinitesimal.

Para que las reglas de la mecánica cuántica funcionen, es necesario que todos los fenómenos naturales en el mundo de las cosas pequeñas estén regidos por las mismas reglas. Esto incluye a los virus, bacterias e incluso a las personas. Sin embargo, cuando más grande y más pesado es un objeto, más difícil es observar las desviaciones de las leyes del movimiento “clásicas” debidas a la mecánica cuántica. Me gustaría referirme a exigencia tan importante y tan peculiar de la teoría con la palabra “holismo”. Esto no es exactamente lo mismo que entienden algunos filósofos por holismo, y que podría definir como “el todo es más que la suma de sus partes”. Si la física nos ha enseñado algo es justo lo contrario. Un objeto compuesto de un gran de partículas puede ser entendido exactamente si se conocen las propiedades de sus partes (partículas); basta que sepamos sumar correctamente (¡y esto no es nada fácil en mecánica cuántica!). Lo que entiendo por holismo es que, efectivamente, el todo es la suma de las partes, pero sólo se puede hacer la suma si todas las partes obedecen a las mismas leyes. Por ejemplo, la constante de Planck, h, que es igual a 6’626075… × 10-34 Julios segundo, debe ser exactamente la misma para cualquier objeto en cualquier sitio, es decir, debe ser una constante universal.

La mecánica cuántica es muy extraña a nuestro “sentido común”, sabemos que se desenvuelve en ese “universo” de lo muy pequeño, alejado de nuestra vida cotidiana en el macrocosmos tetradimensional que, no siempre coincide con lo que, en aquel otro ininitesimal acontece.

Las reglas de la mecánica cuántica funcionan tan bien que refutarlas resulta realmente difícil. Los trucos ingeniosos descubiertos por Werner Heisemberg, Paul Dirac y muchos otros mejoraron y completaron las reglas generales. Pero Einstein y otros pioneros como Erwin Schrödinger siempre presentaron serias objeciones a interpretación. Quizá funcione bien, pero ¿dónde está exactamente el electrón?, ¿en el punto x o en el punto y? En pocas palabras, ¿dónde está en realidad?, y ¿cuál es la realidad que hay detrás de nuestras fórmulas? Si tenemos que creer a Bohr, no tiene sentido buscar tal realidad. Las reglas de la mecánica cuántica, por sí mismas, y las observaciones realizadas con detectores son las únicas realidades de las que podemos hablar.

Es cierto que, existe otro universo dentro de nuestro del que, aún, nos queda mucho por aprender.

La mecánica cuántica puede ser definida o resumida así: en principio, con las leyes de la naturaleza que conocemos se puede predecir el resultado de cualquier experimento, en el sentido que la predicción consiste en dos factores: el primer factor es un cálculo definido con exactitud del efecto de las fuerzas y estructuras, tan riguroso como las leyes de Isaac Newton para el movimiento de los planetas en el Sistema Solar; el segundo factor es una arbitrariedad estadística e incontrolable definida matemáticamente de estricta. Las partículas seguirán una distribución de probabilidades dadas, primero de una forma y luego de otra. Las probabilidades se pueden calcular utilizando la ecuación de Schrödinger de función de onda (Ψ) que, con muchas probabilidades nos indicará el lugar probable donde se encuentra una partícula en un dado.

Muchos estiman que esta teoría de las probabilidades desaparecerá cuando se consiga la teoría que explique, de forma completa, todas las fuerzas; la buscada teoría del todo, lo que implica que nuestra descripción actual incluye variables y fuerzas que (aún) no conocemos o no entendemos. Esta interpretación se conoce como hipótesis de las variables ocultas.”

Publica: emilio silvera

Ene

10

Es importante saber medir y elegir las unidades para ello

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (1)

Comments (1)

Extraños mundos de personajes imposibles que nos visitan en sueños y, a veces, en la Imaginación ilimitada de nuestras mentes. Los Humanos, desde que pudimos evolucionar y ser conscientes del lugar en el que estábamos ubicado dentro del contexto del Universo, no hemos dejado nunca de representar mundos de escenarios ¿imposibles? aunque sólo fuese en sueños.

Historias como el Señor de los anillos, las aventuras narradas por Julio Verne, o, incluso aquellas contadas por Asimav, Ursula Leguin y tantos otros, nos hablan de una imaginación casi tan grande como el propio universo.

¿Os acordais de la Mars Climater Orbiter? Allá por el mes de Septiembre de 1998, la NASA preparaba a bombo y platillo la gran noticia que sacudiría el “mundo” de la Prensa y las televisiones y revistas especializadas con una gran noticia. En breve (dijeron), saldría para el planeta Marte la nueva misión comocida como la Mars Climater Orbiter, diseñada para estudiar la atmósfera superior de Marte y, estaba acondicionada para poder enviarnos importantes datos sobre el clima y la atmósfera marciana. En lugar de ello, simplemente se estrelló contra la superficie marciana.

La distancia entre la nave espacial y la superficie del planeta Marte era de 96,6 kilómetros inferior de lo que pensaban los controladores de la misión, y 125 millones de dolares desaparecieron en el rojo polvo de la superficie Marte. La pérdida ya era suficientemente desastrosa, pero aún, hubo que morder más el polvo cuando se descubrió la causa: Lockheed-Martin, la empresa que controlaba el funcionamiento diario de la nave espacial, estaba enviando datos al control de la misión en unidades imperiales -millas, pies y libras de fuerza- mientras que el equipo de investigación de la NASA estaba suponiendo, como el resto del mundo científico internacional, que recibián las instrucciones en unidades métricas. La diferencia entre millas y kilómetros fue lo suficiente para desviar la nave unas 60 millas del curso previsto y llevarla a una órbita suicida hacia la suprficie marciana, en la que quedó chafada e inservible dando al traste, no ya con el objetivo propuesto (que también) sino con un montón de ilusionados componentes del equipo que esperaban grandes acontecimientos del Proyecto.

La lección que podemos obtener de catástrofe está muy clara: ¡Las Unidades de medida son importantes!

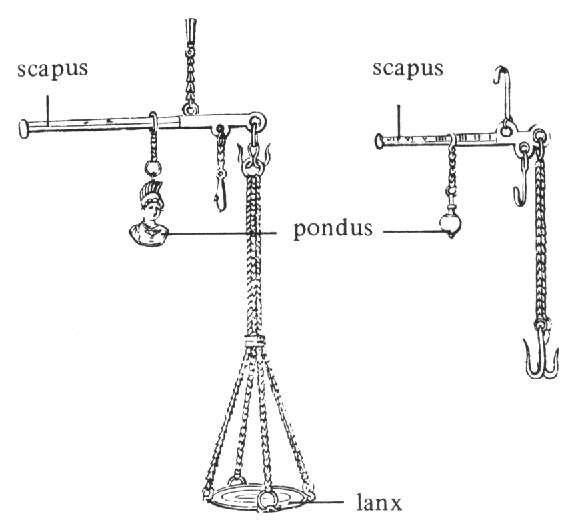

Unidades de medidas de peso

Rústica unidades de medida de líquidos

Nuestros predecesores nos han legado incontables unidades de medida de uso cotidiano que tendemos a utilizar en situaciones diferentes por razones de conveniencia. Compramos huevos por docenas, pujamos en la subasta en guineas, medimos las carreras de caballos en estadios, las profundidades oceánicas en brazas, el trigo en fanegas, el petróleo en barriles, la vida en y el peso de las piedras preciosas en quilates. Las explicaciones de todos los patrones de medida existentes en el pasado y en el presente llenan cientos de volúmenes.

Todo era plenamente satisfactorio mientras el comercio era local y sencillo. Pero cuando se inició el comercio internacional en tiempos antiguos, se empezaron a encontrar otras formas e contar. Las cantidades se median de diferente de un pais a otro y se necesitaban factores de conversión, igual que hoy cambiamos la moneda cuando viajamos al extranjero a un pais no comunitario. Esto cobró mayor importancia una vez que se inició la colaboración internacional de proyectos técnicos. La Ingenieria de precisión requiere una intercomparación de patrones exacta. Está muy bien decir a tus colaboradores en el otro lado del mundo que tienen que fabricar un componente de un avión que sea exactamente de un metro de longitud, pero ¿cómo sabes que su metro es el mismo que el tuyo?

No todas las medidas se regían por los mismos patrones

En origen, los patrones de medidas eran completamente locales y antropométricos. Las longitudes se derivaban de la longitud del brazo del rey o de la palma de la mano. Las distancias reflejaban el recorrido de un día de viaje. El Tiempo segúi las variaciones astronómicas de la Tierra y la Luna. Los pesos eran cantidades convenientes que podían llevarse en la mano o a la espalda.

Muchas de esas medidas fueron sabiamente escogidas y aún siguen con nostros hoy a pesar de la ubicuidad oficial del sistema decimal. Ninguna es sacrosanta. una está diseñada por conveniencia en circunstancias concretas.Muchas medidas de distancia se derivan antropomórficamente de las dimensiones de la anatomía humana:

El “pie” es la unidad más obvia dentro de esta categoría. Otras ya no resultan tan familiares. La “yarda” era la longitud de una cinta tendida desde la punta de la nariz de un hombre a la punta del dedo más lejano de su brazo cuando se extendía horizontalmente un lado. El “codo” era la distancia del codo de un hombre a la punta del dedo más lejano de su mano estirada, y varía entre los 44 y los 64 cm (unas 17 y 25 pulgadas) en las diferentes culturas antiguas que lo utilizaban.

La unidad náutica de longitud, la “braza” era la mayor unidad de distanciadefinida a partir de la anatomóa humana, y se definía como la máxima distancia las puntas de los dedos de un hombre con los brazos abiertos en cruz.

El movimiento de Mercaderes y Comerciantes por la región mediterránea en tiempos antiguos habría puesto de manifiesto las diferentes medidas de una misma distancia anatómica. Esto habría hecho difícil mantener cualquier conjunto único de unidades. la tradición y los hábitos nacionales era una poderosa fuerza que se resistía a la adopción de patrones extranjeros.

El problema más evidente de tales unidades es la existencia de hombres y mujeres de diferentes tamaños. ¿A quién se mide patrón? El rey o la reina son los candidatos obvios. Claro que, había que recalibrar cada vez que, el titular del trono cambiaba por diversos motivos.

La depuración de patrones de medidas comenzó de decisiva en Francia en la época de la Revolución Francesa, a finales del siglo XVIII. La introducción de nuevos pesos y medidas conlleva una cierta comvulsión en la Sociedad y raramente es recibida con entusiamo por el pueblo. Así, dos años más tarde, se introdujo el “metro” como patrón de longitud, definido como la diezmillonésima de un cuadrante de meridiano terrestre. Aunque esta es una forma plausible de identificar un patrón de longitud, es evidente que no resulta práctica a efectos de comparación cotidiana. Consecuentemente, en 1795 las unidades fueron referidas directamente a objetos hechos de forma especial.

Siempre hemos tratado de medirlo todo, hasta las distancias que nos separan de las estrellas

Sí, siempre hemos tenido que medirlo todo. Al principio, unidad de masa se tomó el gramo, definido como la masa de un centímetro cúbico de agua a cero grados centígrados. Más tarde fue sustituido por el kilogramo (mil gramos), definido como la masa de mil centímetos cúbicos de agua… Finalmente, en 1799 se construyó una barra de metro prototipo junto con una masa kilogramo patrón, que fueron depositadas en los Archivos de la nueva República Francesa. Incluso hoy, la masa kilogramo de referencia se conoce como el “Kilogramme des Archives”.

Contar la historia aquí de todas las vicisitudes por las que han pasado los patrones de pesos y medidas en todos los paises, sería demasiado largo y tedioso. Sabemos que en Francia, en 1870, cuando se creo y reunió por primera vez en Paris la Comisión Internacional del Metro, con el fin de coordinar los patrones y supervisar la construcción de nuevas masas y longitudes patrón. El Kilogramo era la masa de un cilindro especial, de 39 milímetros de altura y de diámetro, hecho de una aleación de platino e iridio, protegido bajo tres campanas de cristal y guardado en una cámara de la Oficina Internacional de Patrones en Sèvres, cerca de Paris. Su definición es simple:

El kilogrtamo es la unidad de masa: es igual a la masa del prototipo internacional del kilogramo.

tendencia hacia la estándarización vio el establecimiento de unidades científicas de medidas. Como resultado medimos habitualmente las longitudes, masas y tiempos en múltiplos de metro, kilográmo y segundos. Cada unidad da una cantidad familiar fácil de imaginar: un metro de tela, un kilogramo de patatas. esta conveniencia de tamaño testimonia inmediatamente su pedigrí antropocéntrico. Pero sus ventajas también se hacen patentes cuando empezamos a utilizar dichas unidades para describir cantidades que corresponden a una escala superior o inferior a la humana:

Los átomos son diez millones de veces más pequeños que un metro. El Sol una masa de más de 1030 kilogramos. Y, de esa manera, los humanos hemos ido avanzando en la creación, odeando patrones todos y, no digamos en la medida de las distancias astronómicas en las que, el año-luz, la Unidad Astronómica, el Parsec, el Kiloparsec o el Megaparsec nos permiten medir las distancias de galaxias muy lejanas.

Lo que decimos siempre: Nuestra curiosidad nunca dejará de querer saber el por qué de las cosas y, siempre tratará de racionalizarlo todo para hacernos fácil nuestras interacciones con el mundo que nos rodea. Y, aunque algunas cosas al principio nos puedan parecer mágicas e ilusorias, finalmente, si nuestras mentes la pensaron… ¡Pueden llegar a convertirse en realidad!

emilio silvera

Ene

8

¡Cuántas maravillas!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

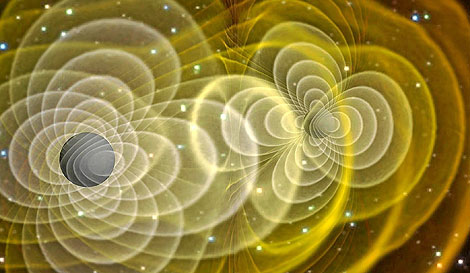

No sería descabellado decir que las simetrías que vemos a nuestro alrededor, un arco iris a las flores y a los cristales, pueden considerarse en última instancia como manifestaciones de fragmentos de la teoría decadimensional original. Riemann y Einstein habían confiado en llegar a una comprensión geométrica de por qué las fuerzas pueden determinar el movimiento y la naturaleza de la materia. Por ejemplo, la fuerza de Gravedad generada por la presencia de la materia, determina la geometría del espacio-tiempo.

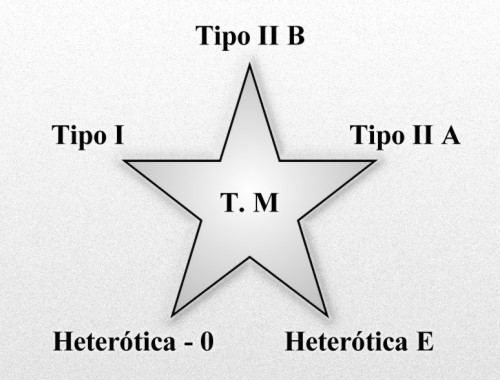

Dado el enorme poder de sus simetrías, no es sorprendente que la teoría de supercuerdas sea radicalmente diferente de cualquier otro de física. De hecho, fue descubierta casi por casualidad. Muchos físicos han comentado que si este accidente fortuito no hubiese ocurrido, entonces la teoría no se hubiese descubierto hasta bien entrado el siglo XXI. Esto es así porque supone una neta desviación de todas las ideas ensayadas en este siglo. No es una extensión natural de tendencias y teorías populares en este siglo que ha pasado; permanece aparte.

Por el contrario, la teoría de la relatividad general de Einstein tuvo una evolución normal y lógica. En primer lugar, su autor, postula el principio de equivalencia. Luego reformuló principio físico en las matemáticas de una teoría de campos de la gravitación basada en los campos de Faraday y en el tensor métrico de Riemann. Más tarde llegaron las “soluciones clásicas”, tales el agujero negro y el Big Bang. Finalmente, la última etapa es el intento actual de formular una teoría cuántica de la gravedad. Por lo tanto, la relatividad general siguió una progresión lógica, un principio físico a una teoría cuántica.

Geometría → teoría de campos → teoría clásica → teoría cuántica.

Contrariamente, la teoría de supercuerdas ha evolucionando hacia atrás desde su descubrimiento accidental en 1.968. Esta es la razón de que nos parezca extraña y poco familiar, estamos aún buscando un principio físico subyacente, la contrapartida del principio de equivalencia de Einstein.

La teoría nació casi por casualidad en 1.968 cuando dos jóvenes físicos teóricos, Gabriel Veneziano y Mahiko Suzuki, estaban hojeando independientemente libros de matemáticas. Figúrense ustedes que estaban buscando funciones matemáticas que describieran las interacciones de partículas fuertemente interactivas. Mientras estudiaban en el CERN, el Centro Europeo de Física Teórica en Ginebra, Suiza, tropezaron independientemente con la función beta de Euler, una función matemática desarrollada en el S. XIX por el matemático Leonhard Euler. Se quedaron sorprendidos al que la función beta de Euler ajustaba casi todas las propiedades requeridas para describir interacciones fuertes de partículas elementales.

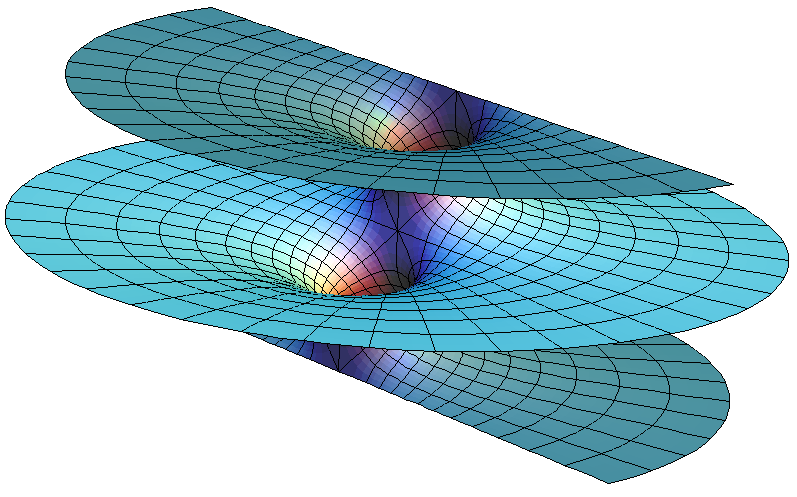

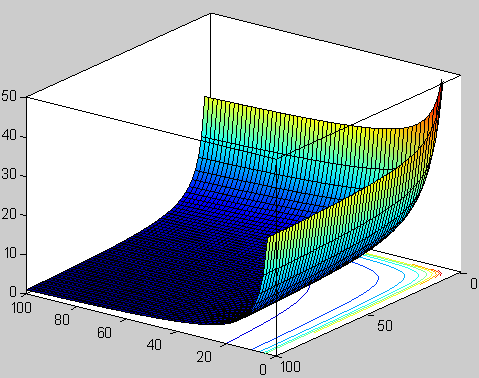

Función beta. Representación de la función valores reales positivos de x e y.

Según he leído, durante un almuerzo en el Lawrence Berkeley Laboratory en California, con una espectacular vista del Sol brillando sobre el puerto de San Francisco, Suzuki le explicó a Michio Kaku mientras almorzaban la excitación de descubrir, prácticamente por casualidad, un resultado parcialmente importante. No se suponía que la física se pudiera hacer de ese modo casual.

Tras el descubrimiento, Suzuki, muy excitado, mostró el hallazgo a un físico veterano del CERN. Tras oír a Suzuki, el físico veterano no se impresionó. De hecho le dijo a Suzuki que otro físico joven (Veneziano) había descubierto la misma función unas semanas antes. Disuadió a Suzuki de publicar su resultado. Hoy, esta función beta se conoce con el de modelo Veneziano, que ha inspirado miles de artículos de investigación iniciando una importante escuela de física y actualmente pretende unificar todas las leyes de la física.

Gabriele Veneziano es un físico italiano

En 1.970, el Modelo de Veneziano-Suzuki (que contenía un misterio), fue parcialmente explicado cuando Yoichiro Nambu, de la Universidad de Chicago, y Tetsuo Goto, de la Nihon University, descubrieron que una cuerda vibrante yace detrás de sus maravillosas propiedades. Así que, la teoría de cuerdas fue descubierta hacia atrás y por casualidad, los físicos aún no conocen el principio físico que subyace en la teoría de cuerdas vibrantes y sus maravillosas propiedades. El último paso en la evolución de la teoría de cuerdas (y el primer paso en la evolución de la relatividad general) aún está pendiente de que alguien sea capaz de darlo.

Así, Witten dice:

“Los seres humanos en el planeta tierra nunca dispusieron del marco conceptual que les llevara a concebir la teoría de supercuerdas de manera intencionada, surgió por razones del azar, por un feliz accidente. Por sus propios méritos, los físicos c del siglo XX no deberían haber tenido el privilegio de estudiar teoría muy avanzada a su tiempo y a su conocimiento. No tenían (ni tenemos ahora mismo) los conocimientos y los prerrequisitos necesarios para desarrollar dicha teoría, no tenemos los conceptos correctos y necesarios.”

Actualmente, como ha quedado dicho en este mismo , Edwar Witten es el físico teórico que, al frente de un equipo de físicos de Princeton, lleva la bandera de la teoría de supercuerdas con aportaciones muy importantes en el desarrollo de la misma. De todas las maneras, aunque los resultados y avances son prometedores, el camino por andar es largo y la teoría de supercuerdas en su conjunto es un edificio con muchas puertas cerradas de las que no tenemos las llaves acceder a su interior y mirar lo que allí nos aguarda.

Ni con colección de llaves podremos abrir la puerta que nos lleve a la Teoría cuántica de la gravedad que, según dicen, subyace en la Teoría M, la más moderna versión de la cuerdas expuesta por E. Witten y que, según contaron los que estuvieron presentes en su presentación, Witten les introdujo en un “universo” fascinante de inmensa belleza que, sin embargo, no puede ser verificado por el experimento.

El problema está en que nadie es lo suficientemente inteligente para resolver la teoría de campos de cuerdas o cualquier otro enfoque no perturbativo de esta teoría. Se requieren técnicas que están actualmente más allá de nuestras capacidades. Para encontrar la solución deben ser empleadas técnicas no perturbativas, que son terriblemente difíciles. Puesto que el 99 por ciento de lo que conocemos sobre física de altas energías se basa en la teoría de perturbaciones, esto significa que estamos totalmente perdidos a la hora de encontrar la verdadera solución de la teoría.

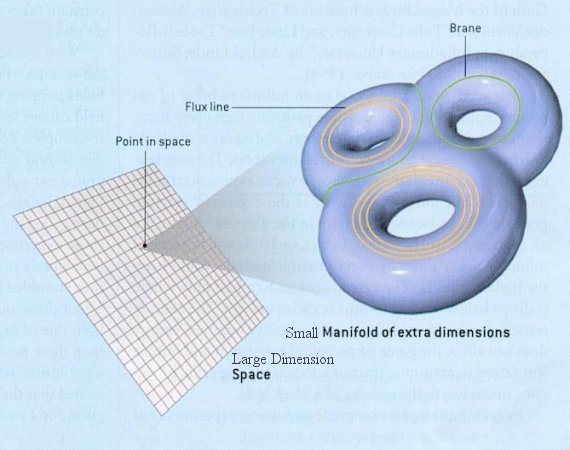

¿Por qué diez dimensiones?

Uno de los secretos más profundos de la teoría de cuerdas, que aún no es comprendido, es por qué está definida sólo en diez, once y veintiséis dimensiones. Si calculamos cómo se rompen y se vuelven a juntar las cuerdas en el espacio N-dimensional, constantemente descubrimos que pululan términos absurdos que destruyen las maravillosas propiedades de la teoría. Afortunadamente, estos términos indeseados aparecen multiplicados por (N-10). Por consiguiente, para hacer que desaparezcan estas anomalías, no tenemos otra elección cuántica que fijar N = 10. La teoría de cuerdas, de hecho, es la única teoría cuántica conocida que exige completamente que la dimensión del espacio-tiempo esté fijada en un número único, el diez.

Por desgracia, los teóricos de cuerdas están, por el , completamente perdidos para explicar por qué se discriminan las diez dimensiones. La respuesta está en las profundidades de las matemáticas, en un área denominada funciones modulares.

Al manipular los diagramas de lazos1 de Kikkawa, Sakita y Virasoro creados por cuerdas en interacción, allí están esas extrañas funciones modulares en las que el 10 aparecen en los lugares más extraños. Estas funciones modulares son tan misteriosas como el hombre que las investigó, el místico del este. Quizá si entendiéramos mejor el trabajo de este genio indio, comprenderíamos por qué vivimos en nuestro universo actual.

nos asomamos a la Teoría de cuerdas, entramos en un “mundo” lleno de sombras en los que podemos ver brillar, a lo lejos, un resplandor cegador. Todos los físicos coinciden en el hecho de que es una teoría muy prometedora y de la que parece se podrán obtener buenos rendimientos en el futuro pero, de momento, es imposible verificarla.

El misterio de las funciones modulares podría ser explicado por quien ya no existe, Srinivasa Ramanujan, el hombre más extraño del mundo de los matemáticos. Igual que Riemann, murió de cumplir cuarenta años, y como Riemann antes que él, trabajó en total aislamiento en su universo particular de números y fue capaz de reinventar por sí mismo lo más valioso de cien años de matemáticas occidentales que, al estar aislado del mundo en las corrientes principales de los matemáticos, le eran totalmente desconocidos, así que los buscó sin conocerlos. Perdió muchos años de su vida en redescubrir matemáticas conocidas.

Dispersas oscuras ecuaciones en sus cuadernos están estas funciones modulares, que figuran entre las más extrañas jamás encontradas en matemáticas. Ellas reaparecen en las ramas más distantes e inconexas de las matemáticas. Una función que aparece una y otra vez en la teoría de las funciones modulares se denomina (como ya he dicho otras veces) hoy día “función de Ramanujan” en su honor. Esta extraña función contiene un término elevado a la potencia veinticuatro.

La magia esconde una realidad

El 24 aparece repetidamente en la obra de Ramanujan. Este es un ejemplo de lo que las matemáticas llaman números mágicos, que aparecen continuamente donde menos se esperan por razones que nadie entiende. Milagrosamente, la función de Ramanujan aparece también en la teoría de cuerdas. El número 24 que aparece en la función de Ramanujan es también el origen de las cancelaciones milagrosas que se dan en la teoría de cuerdas. En la teoría de cuerdas, cada uno de los veinticuatro modos de la función de Ramanujan corresponde a una vibración física de la cuerda. Cuando quiera que la cuerda ejecuta sus movimientos complejos en el espacio-tiempo dividiéndose y recombinándose, deben satisfacerse un gran número de identidades matemáticas altamente perfeccionadas. Estas son precisamente las entidades matemáticas descubiertas por Ramanujan. Puesto que los físicos añaden dos dimensiones más cuando cuentan el número total de vibraciones que aparecen en una teoría relativista, ello significa que el espacio-tiempo debe tener 24 + 2 = 26 dimensiones espacio-temporales.

Para comprender este misterioso factor de dos (que añaden los físicos), consideramos un rayo de luz que tiene dos modos físicos de vibración. La luz polarizada vibrar, por ejemplo, o bien horizontal o bien verticalmente. Sin embargo, un campo de Maxwell relativista Aµ cuatro componentes, donde µ = 1, 2, 3, 4. Se nos permite sustraer dos de estas cuatro componentes utilizando la simetría gauge de las ecuaciones de Maxwell. Puesto que 4 – 2 = 2, los cuatro campos de Maxwell originales se han reducido a dos. Análogamente, una cuerda relativista vibra en 26 dimensiones. Sin embargo, dos de estos modos vibracionales pueden ser eliminados rompemos la simetría de la cuerda, quedándonos con 24 modos vibracionales que son las que aparecen en la función de Ramanujan.

Cuando se generaliza la función de Ramanujan, el 24 queda reemplazado por el 8. Por lo tanto, el número crítico para la supercuerda es 8+2=10. Este es el origen de la décima dimensión que exige la teoría. La cuerda vibra en diez dimensiones porque requiere estas funciones de Ramanujan generalizadas para permanecer auto consistente. Dicho de otra manera, los físicos no tienen la menor idea de por qué 10 y 26 dimensiones se seleccionan como dimensión de la cuerda. Es como si hubiera algún tipo de numerología profunda que se manifestara en estas funciones que nadie comprende. Son precisamente estos números mágicos que aparecen en las funciones modulares elípticas los que determinan que la dimensión del espacio-tiempo sea diez.

En el análisis final, el origen de la teoría decadimensional es tan misterioso como el propio Ramanujan. Si alguien preguntara a cualquier físico del mundo por qué la naturaleza debería existir en diez dimensiones, estaría obligado a responder “no lo sé”. Se sabe en términos difusos, por qué debe seleccionarse alguna dimensión del espacio tiempo (de lo contrario la cuerda no puede vibrar de una cuánticamente autoconsistente), pero no sabemos por qué se seleccionan estos números concretos.

Godfrey Harold Hardy

G. H. Hardy, el mentor de Ramanujan, trató de estimar la capacidad matemática que poseía Ramanujan. Concedió a David Hilbert, universalmente conocido y reconocido uno de los mayores matemáticos occidentales del siglo XIX, una puntuación de 80. A Ramanujan le asignó una puntuación de 100. Así mismo, Hardy se concedió un 25.

Por desgracia, ni Hardy ni Ramanujan parecían interesados en la psicología a los procesos de pensamiento mediante los cuales Ramanujan descubría estos increíbles teoremas, especialmente cuando diluvio material brotaba de sus sueños con semejante frecuencia. Hardy señaló:

“Parecía ridículo importunarle sobre como había descubierto este o ese teorema conocido, cuando él me estaba mostrando media docena día, de nuevos teoremas”.

Ramanujan

Hardy recordaba vivamente:

-”Recuerdo una vez que fui a visitarle cuando estaba enfermo en Putney. Yo había tomado el taxi 1.729, y comenté que el numero me parecía bastante feo, y que esperaba que no fuese mal presagio.”

– No. -Replicó Ramanujan postrado en su cama-. Es un número muy interesante; es el número más pequeño expresable como una suma de dos cubos en dos formas diferentes.

(Es la suma de 1 x 1 x 1 y 12 x 12 x 12, y la suma de 9 x 9 x 9 y 10 x 10 x 10).

Era capaz de recitar en el acto teoremas complejos de aritmética cuya demostración requeriría un ordenador moderno.

En 1.919 volvió a casa, en la India, donde un año más tarde murió enfermo.

El legado de Ramanujan es su obra, que consta de 4.000 fórmulas en cuatrocientas páginas que llenan tres volúmenes de notas, todas densamente llenas de teoremas de increíble fuerza pero sin ningún comentario o, lo que es más frustrante, sin ninguna demostración. En 1.976, sin embargo, se hizo un nuevo descubrimiento. Ciento treinta páginas de borradores, que contenían los resultados del último año de su vida, fueron descubiertas por casualidad en una caja en el Trinity Collage. Esto se conoce ahora con el de “Cuaderno Perdido” de Ramanujan.

Comentando cuaderno perdido, el matemático Richard Askey dice:

“El de este año, mientras se estaba muriendo, era el equivalente a una vida entera de un matemático muy grande”. Lo que él consiguió era increíble. Los matemáticos Jonathan Borwien y Meter Borwein, en relación a la dificultad y la ardua tarea de descifrar los cuadernos perdidos, dijeron: “Que nosotros sepamos nunca se ha intentado una redacción matemática de este alcance o dificultad”.

Por mi creo que, Ramanujan, fue un genio matemático muy adelantado a su tiempo y que pasaran algunos años hasta que podamos descifrar al cien por ciento sus trabajos, especialmente, sus funciones modulares que guardan el secreto de la teoría más avanzada de la física moderna, la única capaz de unir la mecánica quántica y la Gravedad.

Fórmula de Ramanujan determinar los decimales de pi

Las matemáticas de Ramanujan son como una sinfonía, la progresión de sus ecuaciones era algo nunca vísto, él trabajaba otro nivel, los números se combinaban y fluían de su cabeza a velocidad de vértigo y con precisión nunca antes conseguida por nadie. Tenía tal intuición de las cosas que éstas simplemente fluían de su cerebro. Quizá no los veía de una manera que sea traducible y el único lenguaje eran los números.

saben los físicos, los “accidentes” no aparecen sin ninguna razón. Cuando están realizando un cálculo largo y difícil, y entonces resulta de repente que miles de términos indeseados suman milagrosamente cero, los físicos saben que esto no sucede sin una razón más profunda subyacente. Hoy, los físicos conocen que estos “accidentes” son una indicación de que hay una simetría en juego. Para las cuerdas, la simetría se denomina simetría conforme, la simetría de estirar y deformar la hoja del Universo de la cuerda.

Nuestro mundo asimétrico hermosas simetrias

Aquí es precisamente donde entra el trabajo de Ramanujan. Para proteger la simetría conforme original contra su destrucción por la teoría cuántica, deben ser milagrosamente satisfechas cierto número de identidades matemáticas que, son precisamente las identidades de la función modular de Ramanujan. ¡Increíble , cierto.

Aunque el perfeccionamiento matemático introducido por la teoría de cuerdas ha alcanzado alturas de vértigo y ha sorprendido a los matemáticos, los críticos de la teoría aún la señalan su punto más débil. Cualquier teoría, afirman, debe ser verificable. Puesto que ninguna teoría definida a la energía de Planck de 1019 miles de millones de eV es verificable, ¡La teoría de cuerdas no es realmente una teoría!

El principal problema, es teórico más que experimental. Si fuéramos suficientemente inteligentes, podríamos resolver exactamente la teoría y encontrar la verdadera solución no perturbativa de la teoría. Sin embargo, esto no nos excusa de encontrar algún medio por el que verificar experimentalmente la teoría, debemos esperar señales de la décima dimensión.

Volviendo a Ramanujan…

Es innegable lo sorprendente de su historia, un muchacho pobre con escasa preparación y arraigado pocos a sus creencias y tradiciones, es considerado como una de los mayores genios de las matemáticas del siglo XX. Su legado a la teoría de números, a la teoría de las funciones theta y a las series hipergeométricas, además de ser invaluable aún sigue estudiándose por muchos prominentes matemáticos de todo el mundo. Una de sus fórmulas más famosas es

utilizada realizar aproximaciones del número Pi con más de dos millones de cifras decimales. Otra de las sorprendentes fórmulas descubiertas por Ramanujan es un igualdad en que era “casi” un entero (la diferencia era de milmillonésimas). De hecho, durante un tiempo se llegó a sospechar que el número era efectivamente entero. No lo es, pero este hallazgo sirvió de base para la teoría de los “Cuasi enteros”. A veces nos tenemos que sorprender al comprobar hasta donde puede llegar la mente humana que, prácticamente de “la nada”, es capaz de sondear los misterios de la Naturaleza para dejarlos al descubierto ante nuestros asombros ojos que, se abren como platos ante tales maravillas.

Publica: emilio silvera

”Algunas personas buscan un significado a la vida a través del beneficio , a través de las relaciones personales, o a través de experiencias propias. Sin embargo, creo que el estar bendecido con el intelecto para adivinar los últimos secretos de la naturaleza da significado suficiente a la vida”.

Ene

8

Físicos y Cosmólogos: Buscando conocer el Universo

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

Sí, aunque a veces nos podamos creer el centro del mundo, aunque nuestras mentes se alejen de nuestro cuerpo material para volar hacia regiones etéreas, aunque a veces tendamos a magnificar la vida, Shelley nos decía: “La vida, como una cúpula de vidrio multicolor, mancha el blanco resplandor de la Eternidad.” Los sueños siempre han estado con nosotros y, los poetas, han escenificado el mundo bajo el prisma de sus mágicos mundos que, no siempre, coinciden con la realidad del “mundo”.

A finales de los años 70, los físicos de partículas decidieron acudir a los seminarios de cosmología para escuchar los que los cosmólogos tenían que decir sobre las galaxias y los quásar y, los cosmólogos (para no ser menor), alquilaron máquinas del CERN y el FERMILAB para trabajar en física de de altas energías en instalaciones subterráneas desde donde no se podían ver las estrellas.

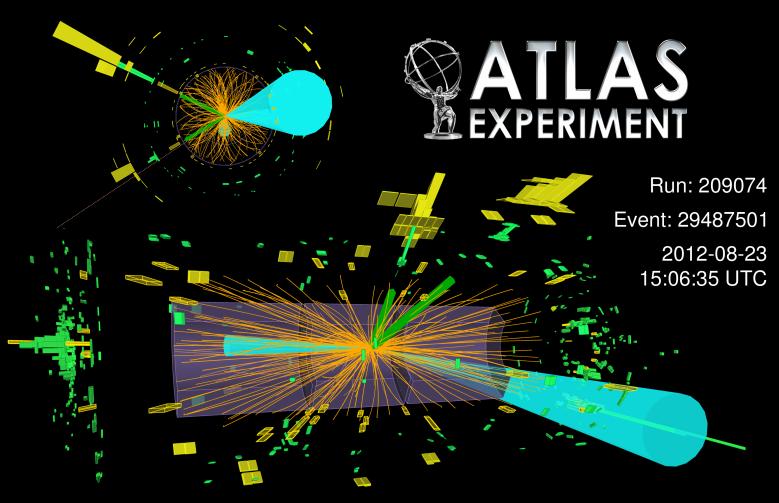

Los experimentos que se producen en tan descomunales máquinas, llevan sus resultados hasta las pantallas de los ordenadores provistos de programas bien elaborados que regogen todos y cada uno de los sucesos del acontecimiento allí ocurrido cuando dos haces de muones, por ejemplo, chocan lanzados en direcciones opuestas a velocidades cercanas a la de la luz, y, en el choque, las partículas dan lugar a otras más elementales que están ocultas en el corazón de la materia y, con esta fórmula de altas energías, pueden salir a la luz para que las podamos conocer.

“La Física de partículas elementales y el estudio del Universo primitivo, las dos ramas fundamentales de la ciencia de la Naturaleza, se habían fundido esencialmente.” Declaró Gell-Mann, cuando físicos y cosmólogos unieron sus conocimientos para saber sobre el todo desde lo puy pequño hasta lo muy grande: El átomo y la Galaxia.

Encierran y tienen tántos secretos las galaxias que, existen multitud de familias, de formas y colores, y, todas ellas, son portadoras de la esencia del Universo, las galaxias, son retazos del Universo en las que están presentes todos los elementos y objetos que son son, también allí residen las fuerzas y las constantes y, para que no falte de nada, podríamos suponer que también, está la vida presente.

En encuentra que buscaron físicos y cosmólogos fue el big bang. Loa físicos habían identificaron simetrías en la Naturaleza que hoy están rotas pero que estuvieron intactas en el entorno de las inmensas energías, en el entorno de aquellos primeros momentos en los que se cree nacio el universo. Los cosmólogos informaron de que el universo estuvo entonces en tal estado de alta energía, durante las etapas iniciales del big bang. Unidas ambas cosas, aparece el cuadro de un universo perfectamente simétrico y cuyas simetrías se quebraron a medida que se expandió y se enfrió, creando las partículas de materia y energía que encontramos hoy a nuestro alrededor y estampándoles las pruebas de su genealogía.

Gráfica de la ruptura de simetría espontánea de la función

En el modelo estándar, la ruptura espontánea de simetría se complementa por el uso del bosón de Hihhs, que es responsable de las masas de los bosones W y Z. Todo esto puede verse de forma más técnica en la interacción de Yucawa donde se muestra cómo obtienen masa los fermiones mediante la ruptura de simetría. Este mecanismo se aplica al caso de una ruptura de simetría gauge local local.

El toro es un ejemplo de grupo de Lie homeomorfo a  .

.

En física la ruptura espontánea de la simetría ocurre cuando un sistema definido por una lagrangiana simétrica respecto a un grupo de simetría cae en un estado vacío que no es simétrico. Cuando eso sucede el sistema no se comporta más de forma simétrica.

El grupo de simetría puede ser discreto como el grupo espacial de un cristal, o continuo como un grupo de Lie, como la simetría rotacional del espacio. Sin embargo, si el sistema solo tiene una dimensión espacial entonces solo las simetrías discretas pueden romperse en un estado vacío de la teoría cuántica, aunque también una solución clásica puede romper una simetría continua.

La ruptura de la simetría conlleva la aparición de nuevas partículas (asociados a nuevos términos de masas en el nuevo lagrangiano como los bosones de Nambu-Goldstone o los bosones de Higss) y la aparición de términos de masas de partículas ya existentes en el lagrangiano. Claro que la teoría electrodébil se describió por Steven Weinberg unificada en términos de su relación con el universo primitivo.

Lo que resulta tan especial en la Teoría electrodébil es que las partículas (portadoras de la fuerza) forman una familia estrechamente unida, con cuatro miembros: la W+, la W– , la Z neutra, y el cuarto miembro es nuestro viejo amigo el Fotón, portador del electromagnetismo. Son todas hermanas, estrechamente relacionadas por el principio de simetría que nos dice que son, todas las misma cosa pero, que la simetría se ha roto. La simetría está allí, en las ecuaciones subyacentes de la teoríam, pero no es evidente en las partículas mismas. Por eso las W y la Z son mucho más pesadas que el fotón.

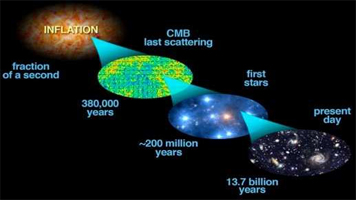

El Universo temprano

Hubo un tiempo, en el universo temprano, en que la temperatura estaba por encima de algunos cientos de veces de la masa del protón, cuando la simetría aún no se había roto, y la fuerza débil y la electromagnética, no sólo eran la misma matemáticamente, sino realmente la misma. Un físico que hubiera podido estar allí por aquel entonces, lo que no es fácil de imaginar, no habría contemplado ninguna diferencia real entre las fuerzas producidas por el intercambio de estas cuatro partículas: las W, la Z y el Fotón.

De la misma manera, aunque menos clara, las nacientes teorías ee la supersimetría conjeturan que las cuatro fuerzas tal vez estaban ligadas por una simetría que se manifestaba en aquellos niveles de energías aún mayores que caracterizaban al universo incluso ya antes del big bang.

La introducción de un eje de tiempo histórico en la cosmolo´gia y la física de partículas, benefició a ambos campos. Los físicos proporcionaron a los cosmólogos una serie de herramientas útiles para saber como se desarrolló el universo. Evidentemente, el big bang no fue la muralla de fuego de la que se burló Hoyle, sino un ámbito de susceos de altas energías que muy posiblemente pueden ser comprensibles en términos de la teoría de campo relativista y cuántica.

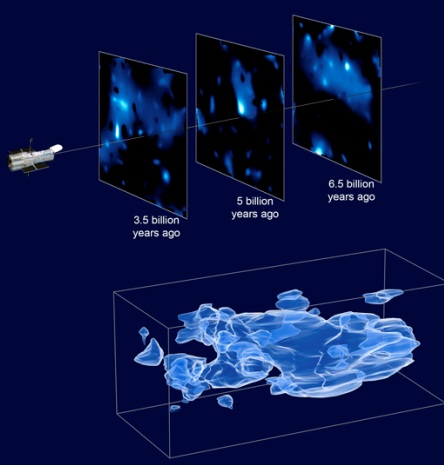

La cosmología por su parte, le dio un tinte de realidad histórica a las teorías unificadas. Aunque ningún Acelerador concebible podría alcanzar las titánicas energías supuestas por las grandes teorías unificadas y la supersimetría, esas exóticas ideas aún pueden ser puestas a prueba, investigando su las partículas constituyentes del universo actual son compatibles con el tipo de historia primitiva que implican las teorías.

“Las partículas elementales aparentemente proporcionan la clave de algunos de los misterios fundamentales de la cosmología temprana… y, resulta que la cosmología nos brinda una especie de terreno de prueba para alguna de las ideas de la física de partículas elementales.”

A pesar de todo, de lo mucho que hemos avanzado y de los descubrimientos ciertos que se han podido conquistar y que están debidamente contrastados una y mul veces para estar seguros de que, todo eso es así. A pesar de ello, digo, no creo que aún sepamos, a ciencia cierta, lo que las fuerzas son, y, nos quedan algunos flecos que añadir a “ese traje” para que, la niña (en este caso la Naturaleza), se nos pueda mostrar con toda su belleza y esplendor.

¿Qué son las fuerzas?

Sí, más o menos, aunque con ciertas carencias y faltas de completitud, podemos dar una idea de lo que las fuerzas son y, para andar por casa, podría ser una explicación suficiente pero, si queremos dar un paseo más largo, y llegar hasta los confirnes de la Galaxia, entonces, no podemos confiar en esta exigua explicación a la que, como antes decía, le faltan esos flecos que la adornan y completan y las acercarían a nuestra total comprensión.

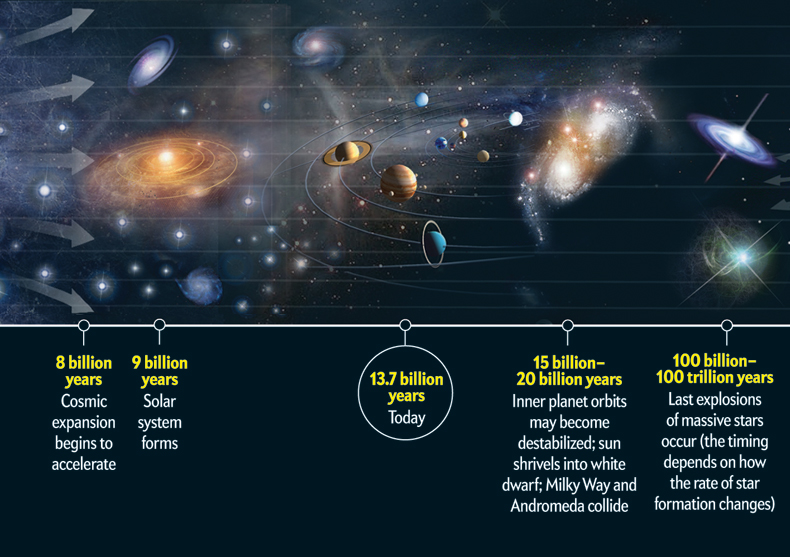

Sabemos del nacimiento de las estrellas, la acumulación de estas en galaxias, que a la vez se agrupan en cúmulos y por si fuera poco, esparciéndose en forma uniforme mientras el Universo sigue y sigue expandiéndose. La formación de nebulosas en todas partes, de ellas las nacientes estrellas, blancas, azules, rojas y amarillas, y a su alrededor la formación de planetas. Todo un ciclo que se repite y se repite por miles de millones de años, entregándonos un formato claro y que podemos aventurarnos a predecir sin temor a fallar y, sabemos que, todo eso es posible gracias a que, las cuatro fuerzas fundam,entales del universo están presentes y, el ritmo que imponen, hacen posible que las cosas sean tal como las podemos contemplar.

Quarks que se unen para formar nucleones, estos que conforman los núcleos, la llegada de los electrones atraídos por la carga eléctrica positiva de los núcleos hacen que se formen los átomos del universo que, unidos forman moléculas que, a su vez, se unen para formar cuerpos como las estrellas y los mundos que las rodean, grupos de estrellas que dan lugar a enormes galaxias y estas, reúnidas, forman cúmulos que son las estructuras más grandes del universo y, todo ello, es posible gracias a esas fuerazas y a esas “onsignificantes” partículas que conforman la materia.

Ahí los tenéis y aunque pueda parecer sencillo, el lidiar con estas tres familias de partículas que son, enn realidad las que conforman todo lo que existe en el mundo (entendiéndose por el mundo el universo entero), no es fácil y de ellas, surgen muchas implicaciones, algunas que no hemos podido llegar a entender aunque, en honor a la verdad tendremos que decir que, en lo más básico, podemos formular hipótesis y teorías que las implican y que están acordes con la realidad observada en el laboratorio experimental. Sin embargo, muchos son, todavíoa, los secretos que nos esconden y al que nuestro intelecto no ha podido llegar aún. Sin embargo, si nos dan más tiempo, todo llegará.

Y, a todo esto, no debemos olvidar que, aparte de las propiedades que dichas partículas pueden tener de manera individual, todas tienen que convivir con las cuatro fuerzas fundamentales de la Naturaleza que, de alguna manera, inciden en ellas de mil maneras diferentes.

No sólo toda la materia del Universo, nosotros también, supeditamos nuestros comportamientos a lo que rige la norma que establen esas cuatro fuerzas fundamentales del Universo que, junto con las constantes universales, hacen de nuestro universo lo que es y permite, que la vida esté presente para observar todas estas maravillas.

Ayer por la tarde (como hago tantas veces por estas fechas), acompañado de mi inseparable esposa, me di una vueltecita por todos estos parajes y, nos paramos en un “chiringuito” situado en un lugar solitiario ya en estas fechas en la que los tuiristas se han marchado. Ella, mu mujer, después de tomarnos un café, se marcha un rato a la playa a tomar un baño y echarse en la fina arena a tomar el Sol, y, mientras tanto, saco mi libreta (que siempre me acompaña) y, mirando ese inmenso horizonte escribo de todo esto que antes habéis podido leer.

Realmente, cuando te acercas a la Naturaleza, las cosas se ven diferentes, te siemntes más cerca de lo verdadero y puedes llegar a comprender algunas cosas que, la simbiosis del momento te acercan a la comprensión. Recordé que desede estos mismos lugares partíó Colón para “las Américas” lo que después llamamos el nuevo mundo, y, aunque él creía que se dirigçia a Cipango, el pais del Sol descrito por Marco Polo, el hombre llegó a ese nuevo Mundo que ahora (a pesar de todo), sentimos hermanos.

¿Cuándo llegaremos a comprender? ¿Entenderemos alguna vez por qué hicimos las cosas? ¿Sabremos perdonar? y, sobre todo, comprenderemos de una vez por todas que todos somos uno… ¡falta mucho para que eso sea una realidad!

emilio silvera

Dic

19

La Física es la llave del futuro

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (1)

Comments (1)

Alguna vez he leído alguna historia en las que había hadas en el frondoso jardín. Es cierto, no existen pruebas de que así pudiera ser. Sin embargo, tampoco las hay de que no las haya, y, el hecho cierto de que nosotros, los humanos, no la hayamos podido ver, no es prueba de su inexistencia. Hay que tener una imaginación abierta a todo y, de esa manera, evitamos sobresaltos y sorpresas inesperadas que, dicho sea de paso, pueden estar a cada paso que damos. El Universo es eso, un océano de maravillosas sorpresas que nos habla del comportamiento de las grandes energías y de la materia, unas veces disfrazada de estrella, otras de emisiones gamma y no en pocas ocasiones de agujeros negros y púlsares.

El modelo estándar de partículas fundamentales y sus interacciones

Esta imagen representa todo lo que conocemos, y que se ha podido verificar experimentalmente, sobre la estructura de la materia de la que estamos hechos nosotros y todo lo que hasta ahora hemos observado en el universo, con el nivel de precisión que podemos alcanzar utilizando los instrumentos que tenemos.

Equilibrio, estabilidad: el resultado de dos fuerzas contrapuestas que en el átomo están presentes

Por ahí deambula uno de mis trabajos sobre este mismo tema que titulé ¡La perfección imperfecta! En referencia al Modelo Estándar que no incorpora la Gravedad, y, se ha construido un edificio que nos habla de cómo funciona el universo y, sin embargo, le falta uno de sus pilares, precisamente, ese que nos dice como es su geometría espacial en presencia de grandes masas.

“Colisión del Bosón de Higgs desintegrándose en fermiones”. Primeras evidencias de un nuevo modo de desintegración del bosón de Higgs. Las primeras evidencias de la desintegración del recién descubierto bosón de Higgs en dos partículas denominadas tau, pertenecientes a la familia de partículas que compone la materia que vemos en el Universo. Hasta ahora los experimentos del LHC habían detectado la partícula de Higgs mediante su desintegración en otro tipo de partículas denominadas bosones, portadoras de las fuerzas que actúan en la Naturaleza, mientras las evidencias de desintegraciones en fermiones no eran concluyentes. Esta es la primera evidencia clara de este nuevo modo de desintegración del bosón de Higgs.”

La regla universal en la física de partículas es que cuando las partículas chocan con energías cada vez mayores, los efectos de las colisiones están determinados por estructurtas cada vez menores, más pequeñas en el espacio y en el tiempo. Supongamos por un momento que tenemos a nuestra disposición un Acelerador de Partículas 10.000 veces más potente que el LHC, donde las partículas pueden adquirir esas tantas veces más energías de las alcanzadas actualmente. Las colisiones que tendrían lugar nos dirían algo acerca de los detalles estructurales de esas partículas que ahora no conocemos, que serían mucho más pequeñas que las que ahora podemos contemplar.

Ahora el LHC se prepara para nuevas aventuras y experimentos mayores, con mayores energías. ¿Podeis imaginar conseguir colisiones a 70.000 TeV? ¿Que podríamos ver? Y, entonces, seguramente, podríamos oir en los medios la algarada de las protestas de algunos grupos: “Ese monstruo creado por el hombre puede abrir en el espacio tiempo agujeros de gusano que se tragará el mundo y nos llevará hacia otros universos”

¿Justifica el querer detectar las partículas que conforman la “materia oscura”, o, verificar si al menos, podemos vislumbrar la sombra de las “cuerdas” vibrantes de esa Teoria del Todo, el que se gasten ingentes cantidades de dinero en esos artilugios descomunales? Bueno, a pesar de todos los pesares, la respuesta es que SÍ, el rendimiento y el beneficio que hemos podido recibir de los aceleradores de partículas, justifica de manera amplia todo el esfuerzo realizado, toda vez que, no solo nos ha llevado a conocer muchos secretos que la Naturaleza celosamente guardaba, sino que, de sus actividades hemos tenido beneficios muy directos en ámbitos como la medicina, las comunicaciones y otros que la gente corriente desconocen.

¿Implica el ajuste fino un diseño con propósito? ¿Hay tantos parámetros que deben tener un ajuste fino y el grado de ajuste fino es tan alto, que no parece posible ninguna otra conclusión?

Hoy, el Modelo estándar es una construcción matemática que predice sin ambigüedad cómo debe ser el mundo de las estructuras aún más pequeñas. Pero tenemos algunas razones para sospechar que tales predicciones resultan estar muy alejadas de la realidad, o, incluso, ser completamente falsas. Cuando tenemos la posibilidad de llegar más lejos, con sorpresa podemos descubrir que aquello en lo que habíamos creído durante años, era totalmente diferente. El “mundo” cambia a medida que nos alejamos más y más de lo grande y nos sumergimos en ese otro “mundo” de lo muy pequeño, allí donde habitan los minúsculos objetos que conforman la materia desde los cimientos mismos de la creación.

Así el modelo que tenenos de la física de partículas se llama Modelo Estándard y, nos habla de las interacciones entre partículas y las fuerzas o interraciones que están presentes, las leyes que rigen el Universo físico y que, no hemos podido completar al no poder incluir una de las fuerzas: La Gravedad. Claro que, no es esa la única carencia del Modelo, tiene algunas más y, a estas alturas, se va necesitando un nuevo Modelo, más completo y audaz, que incluya a todas las fuerzas y que no tengá parámetros aleatorios allí donde nuestros conocimientos no llegan.

La fealdad del Modelo Estándar puede contrastarse con la simplicidad de las ecuaciones de Einstein, en las que todo se deducía de primeros principios. Para comprender el contraste estético entre el Modelo Estándar y la teoría de la relatividad general de Einstein debemos comprender que, cuando los físicos hablan de “belleza” en sus teorías, realmente quieren decir que estas “bellas” teorías deben poseer al menos dos características esenciales:

- Una simetría unificadora.

- La capacidad de explicar grandes cantidades de datos experimentales con las expresiones matemáticas más económicas.

E = mc2 . Esta es la mejor prueba de lo que decimos arriba.

El Modelo Estándar falla en ambos aspectos, mientras que la relatividad general los exhibe, ambos, de manera bien patente. Nunca una teoría dijo tanto con tan poco; su sencillez es asombrosa y su profundidad increíble.De hecho, desde que se publicó en 1.915, no ha dejado de dar frutas, y aún no se han obtenido de ella todos los mensajes que contiene.

El principio director del modelo estándar dicta que sus ecuaciones son simétricas. De igual modo que una esfera ofrece el mismo aspecto desde cualquier punto de vista, las ecuaciones del modelo estándar subsisten sin variación al cambiar la perspectiva desde la que son definidas. Las ecuaciones permanecen invariables, además, cuando esta perspectiva se desplaza en distinta magnitud a diferentes puntos del espacio y el tiempo.

Al contrario de la relatividad general, la simetría del Modelo Estándar, está realmente formada empalmando tres simetrías más pequeñas, una por cada una de las fuerzas; el modelo es espeso e incómodo en su forma. Ciertamente no es económica en modo alguno. Por ejemplo, las ecuaciones de Einstein, escritas en su totalidad, sólo ocupan unos centímetros y ni siquiera llenaría una línea de esta página. A partir de esta escasa línea de ecuaciones, podemos ir más allá de las leyes de Newton y derivar la distorsión del espacio, el Big Bang y otros fenómenos astronómicos importantes como los agujeros negros. Por el contrario, sólo escribir el Modelo Estándar en su totalidad requeriría, siendo escueto, un par de páginas y parecería un galimatías de símbolos complejos sólo entendibles por expertos.

Los científicos quieren creer que la naturaleza prefiere la economía en sus creaciones y que siempre parece evitar redundancias innecesarias al crear estructuras físicas, biológicas y químicas.

La luz antigua absorbida por átomos de hidrógeno neutro podría usarse para probar ciertas predicciones de la Teoría de Cuerdas, dicen los cosmólogos de la Universidad de Illinois. Realizar tales medidas, sin embargo, requeriría que se construyese un gigantesco conjunto de radio telescopios en la Tierra, el espacio, o la Luna.

El matemático francés Henri Poincaré lo expresó de forma aún más franca cuando escribió: “El científico no estudia la Naturaleza porque es útil; la estudia porque disfruta con ello, y disfruta con ello porque es bella”

E. Rutherford, quien descubrió el núcleo del átomo (entre otras muchas cosas), dijo una vez: “Toda ciencia es o física o coleccionar sello”.Se refería a la enorme importancia que tiene la física para la ciencia, aunque se le olvidó mencionar que la física está sostenida por las matemáticas que la explica.

Pero, a pesar de todos sus inconvenientes, el Modelo Estándar, desde su implantación, ha cosechado un éxito tras otro, con sus inconvenientes y sus diecinueve parámetros aleatorios, lo cierto es que es lo mejor que tenemos por el momento para explicar las familias de partículas que conforman la materia y cómo actúan las fuerzas de la naturaleza, todas las fuerzas menos la gravedad; esa nos la explica a la perfección y sin fisuras las ecuaciones de Einstein de la relatividad general.

Hace tiempo que los físicos tratan de mejorar el Modelo Estándar con otras teorías más avanzadas y modernas que puedan explicar la materia y el espacio-tiempo con mayor amplitud y, sobre todo, incluyendo la gravedad.Así que retomando la teoría de Kaluza de la quinta dimensión, se propuso la teoría de supergravedad en 1.976 por los físicos Daniel Freedman, Sergio Ferrara y Peter van Nieuwenhuizen, de la Universidad del Estado de Nueva York en Stoney Brook que desarrollaron esta nueva teoría en un espacio de once dimensiones.

Para desarrollar la superteoría de Kaluza-Klein en once dimensiones, uno tiene que incrementarenormemente las componentes del interior del Tensor métrico de Riemann (que Einstein utilizó en cuatro dimensiones, tres de espacio y una de tiempo para su relatividad general y más tarde, Kaluza, añadiendo otra dimensión de espacio, la llevó hasta la quinta dimensión haciendo así posible unir la teoría de Einstein de la gravedad, con la teoría de Maxwell del electromagnetismo), que ahora se convierte en el supertensor métrico de Riemann.

Hasta hoy, no se ha logrado, ni mucho menos, inventar una teoría de campo consistente totalmente unificadora que incluya la gravedad. Se han dado grandes pasos, pero las brechas «científicounificantes» siguen siendo amplias. El punto de partida ha sido siempre la teoría de la relatividad general y conceptos con ella relacionados, por la excelencia que manifiesta esa teoría para explicar la física gravitatoria macrocósmica. El problema que se presenta surge de la necesidad de modificar esta teoría sin perder por ello las predicciones ya probadas de la gravedad a gran escala y resolver al mismo tiempo los problemas de la gravedad cuántica en distancias cortas y de la unificación de la gravedad con las otras fuerzas de la naturaleza.

Su tensor métrico es un tensor de rango 2 que se utiliza para definir … Sin embargo, en otras teorías se ha elevado el rango y se pueden definir múltiples universos de dimensiones más altas.

El tensor métrico se podría adaptar a las necesidades de la búsqueda estableciendo la multiplicidad de dimensiones que la teoría exigía para su desarrollo.

Más allá de lo que nos permiten captar nuestros sentidos físicos, hay que tener nuestra mente abierta a la posibilidad de que puedan existir otras realidades diferentes a lo que nos dicta nuestra experiencia, realidades capaces de ser descubiertas por la fuerza del intelecto cuando nos atrevemos a cuestionar aquello que creíamos como absoluto.

Esta nueva teoría de supergravedad pretendía la unificación de todas las fuerzas conocidas con la materia, y, como en un rompecabezas, encajarlas en el Tensor de Riemann tan solo con elevar el número de dimensiones que exigía más componentes y nos daba el espacio necesario para poder ubicar en sus apartados correspondientes, todas las fuerzas fundamentales y también la materia, la que podía satisfacer, casi en su totalidad, el sueño de Einstein.

A partir de aquí, de estas ecuaciones, surgió todo. Este fue el puerto de donde salió el bajel de la de Kaluza-Gleim, la supergravedad y supersimetría, la cuerda heterótica y la Teoría de cuerdas, todo ello, rematado con la finalmente expuesta, teoría M.

La supergravedad casi consigue satisfacer el sueño de Einstein de dar una derivación puramente geométrica de todas las fuerzas y partículas del universo. Al añadir la supersimetría al Tensor métrico de Riemann, la métrica se duplica en tamaño, dándonos la supersimetría de Riemann. Las nuevas componentes del súper tensor de Riemann corresponden a quarks y leptones, casi todas las partículas y fuerzas fundamentales de la naturaleza: la teoría de la gravedad de Einstein, los campos de Yang-Mills y de Maxwell y los quarks y leptones. Pero el hecho de que ciertas partículas no estén en esta imagen nos obliga a buscar un formalismo más potente:

La materia con todas las fuerzas fundamentales de la naturaleza. Los bosones intermediarios o partículas portadoras de las fuerzas como el fotón para el electromagnetismo, los gluones para la fuerza nuclear fuerte, las partículas W y Z para la nuclear débil y, en la partícula portadora de la gravedad, el gravitón, ponemos el signo de interrogación, ya que se sabe que esta ahí en algún sitio pero hasta la fecha no ha sido detectado.

Antes de continuar con la teoría de súper cuerdas, o con su versión más avanzada la teoría M, parece conveniente recordar que hasta el momento los ladrillos del universo eran los quarks, las partículas más pequeñas detectadas en los aceleradores del CERN y FERMILAB. Pero ¿están hechos de cosas más pequeñas?, eso no lo sabemos. El Modelo Estándar, menos avanzado que las otras teorías, nos dice que los quarks son las partículas más pequeñas y forman protones y neutrones constituyendo la formación interna del átomo, el núcleo. En la actualidad, nuestros aceleradores de partículas no tienen capacidad para ahondar más allá de los quarks y averiguar si a su vez, éstos están formados por partículas aún más pequeñas.

No podemos saber (aún) que es lo que pueda haber (si es que lo hay) más allá de los Quarks, los constituyentes de la materia más pequeños conocidos hasta el momento actual. Sin embargo, no se descarta que puedan existir partículas más simples dentro de los Quarks que, al fin y al cabo, no serían tan elementales.

Por otro lado, los físicos están casi seguros de que los leptones no están compuestos de partículas más pequeñas. Sin embargo, esta sospecha no se tiene en el caso de los quarks; no se sabe qué puede haber detrás de ellos. Tan sólo se ha llegado a desconfinarlos junto con los gluones y por un breve periodo de tiempo de los protones y neutrones que los mantenían aprisionados, formando – en esos breves instantes – una materia plasmosa. No es raro oir dentro de la comunidad científica a los físicos teóricos hablando de prequarks.

Como antes hemos comentado de pasada, el Modelo Estándar agrupa las partículas en familias:

Fermiones y Bosones

Cada leptón grande, es decir, el electrón, el muón y el tau, tiene un primo pequeño. Así el electrón tiene un neutrino electrónico, el muón un neutrino muónico y el tau un neutrino tau. Como se puede ver en la tabla anterior la única diferencia entre el electrón, el muón y el tau es la masa, que va creciendo. Todos tienen carga eléctrica negativa. Los neutrinos en cambio no tienen carga y tienen una masa muy pequeña (pero tienen y es una de las razones por la que se dice que los neutrinos cambian de sabor, es decir cuando salen, por ejemplo, del sol salen en forma de neutrinos electrónicos pero cuando los detectamos en la tierra, vemos que llegan menos neutrinos electrónicos de los que deberían, porque durante el viaje han cambiado de sabor y se han convertido en neutrinos muónicos o tau).

Los bariones se componen de tres quarks o tres antiquarks. En este último caso se denominan antibariones.

Los mesones se componen de dos quarks y obligatoriamente uno es un quark y el otro un antiquark.

Claro, son muchos más. Además de los Bariones, también forman parte de la familia hadrónica los mesones y la lista de unos y otros es larga y cada individuo, como es natural, tiene sus propias características que lo hacen único.

Se llaman bosones porque, al contrario que los fermiones, éstos obedecen la estadística de Bose-Einstein que dice que pueden existir en el mismo estado cuántico muchas bosones al mismo tiempo (recordad que en el caso de los fermiones sólo podía haber dos en el mismo estado cuántico). Algunos bosones tienen la peculiaridad de que son los portadores de las fuerzas fundamentales de la naturaleza, es decir, cada vez que ocurre una interacción entre dos partículas, lo que realmente ocurre es que intercambian un bosón. Estas fuerzas son el electromagnetismo, la fuerza débil y la fuerza fuerte (vienen a continuación). Existe otro bosón, aunque sólo a nivel teórico, conocido como el gravitón que sería el responsable de la fuerza gravitatoria. La fuerza gravitatoria no está explicada por el modelo estándar y por lo tanto el gravitón, no forma parte del mismo.

La fuerza débil es la responsable de las desintegraciones radiactivas, es decir, que una partícula se convierta en otra a través de la emisión de una o más partículas adicionales. Esta interacción es mediada por los bosones W+, W- y Z0. Estos bosones tienen la particularidad de que tienen masa, al contrario que el resto de bosones.

La fuerza fuerte hace que los quarks que componen los núcleos atómicos se mantengan unidos y no se rompan espontáneamente. El bosón encargado de hacer esto es el gluón.

La fuerza electromagnética es la que más conocemos todos, ya que se compone de la fuerza eléctrica y la fuerza magnética (en realidad es una única fuerza que se manifiesta de dos maneras diferentes, de ahí que reciba el nombre de fuerza electromagnética). El bosón portador de esta fuerza es el fotón. Nuestra experiencia diaria se basa principalmente en sufrir los efectos de esta fuerza y cada vez que vemos la luz, sentimos calor, calentamos la comida en el microondas, etc., lo que estamos haciendo es interaccionar con fotones de diversas energías.

Interacciones entre partículas

En la imagen de la izquierda se representa como un neutrón se desintegra para dar un protón, un electrón y un antineutrino electrónico. Esta desintegración es conocida como desintegración beta.

En la imagen central se muestra la colisión entre un electrón y un positrón que da lugar a una desintegración de materia en energía pura, otra vez a través de la ecuación de Einstein E=mc2. La energía se convierte, por la misma ecuación, otra vez en otras partículas diferentes. En este caso se forma un mesón B0 y un antimesón B0.

Por último, en la imagen de la derecha aparece la colisión de dos protones (como los que ocurren en el LHC del CERN) para dar lugar a dos bosones Z0 y varios hadrones, es decir, varias partículas compuestas de diferentes quarks (mesones y bariones).

… Han dejado fuera del Modelo estándar a la Gravedad que se resiste a estar junto a las otras tres fuerzas. Así, continúan persiguiendo ese sueño llamado… ¡Teoría cuántica de la gravedad o Gravedad cuántica!

Y describe las interacciones que estas partículas tienen con las cuatro fuerzas fundamentales de la naturaleza, sobre todo con las nucleares fuerte y débil y la electromagnética; la gravedad se queda aparte del Modelo Estándar, ya que su incidencia con las partículas elementales es inapreciable como consecuencia de las infinitesimales masas de éstas, y ya sabemos que la gravedad se deja sentir y se hace presente cuando aparecen las grandes masas como planetas, estrellas y galaxias.

Grandes estructuras que vienen a ser como pequeños ”universos islas” en los que podemos estudiar, a menos tamaño, todo lo que en el Gran Universo puede pasar. Partiendo de la base de que las leyes del universo son las mismas en todas partes, podemos tomar cualquier región del mismo y ver que, allí está ocurriendo lo mismo que aquí ocurre, es decir, están presentes las fuerzas fundamentales: nucleares débiles y fuertes, electromagnetismo y Gravedad y, todo, absolutamente todo, funciona al ritmo que dichas leyes nos marcan.

Como el Modelo Estándar es limitado, los físicos buscan desesperadamente nuevas teorías que puedan corregir y perfeccionar este modelo. Así aparecieron las teorías de súper simetría, súper gravedad, súper cuerdas, y ahora por último, la teoría M propuesta por Edward Witten en 1.995 y que nos quiere explicar, de manera más perfecta, el universo desde su origen, cómo y por qué está conformado ese universo, las fuerzas que lo rigen, las constantes de la naturaleza que establecen las reglas, y todo ello, a partir de pequeños objetos infinitesimales, las cuerdas, que sustituyen a las partículas del modelo estándar que creíamos elementales.

Esas partículas súper simétricas que pronostican algunas teorías, aún no han sido observadas y se espera que en el LHC puedan aparecer algunas que, desde luego, si así ocurre, sería un buen adelanto para conocer el mundo que nos acoge y la Naturaleza del Universo.

Esta nueva teoría, permite además, unificar o incluir la gravedad con las otras fuerzas, como teoría cuántica de la gravedad, todo ello mediante una teoría estructurada y fundamentada con originalidad y compactificación de las cuatro fuerzas de la naturaleza y dejando un gran espacio matemático para eliminar anomalías o perturbaciones, y se propugna con coherencia quela cuerda es el elemento más básico de la estructura de la materia; lo que estaría bajo los quarks serían unas diminutos círculos semejantes a una membrana vibrante circular y de diferentes conformaciones.

Universos Paralelos, Teorías de Cuerdas, Súper gravedad, La Teoría M, y ¿Los pensamientos de la Mente, podrán dar para tanto?

Una vez se escucha sobre los fundamentos de la teoría cuántica uno no puede mas que sobrecogerse, ampliar la mente y galopar entre las múltiples posibilidades acerca de lo real e imaginario que por momentos y depende que conceptos se entrelazan intercambiables. Lo que llama la atención es que por mucho que hayan sido los físicos cuánticos más prestigiosos entre la sociedad científica los que hayan puesto sobre la mesa conceptos cuanto menos rimbombantes e inverosímiles como las multi-dimensiones, los universos paralelos, los efectos túneles y demás, sean los propios miembros de la academia los que grandilocuentemente se ofenden cuando se hace alusión al paralelismo evidente del comportamiento y extensión de la energía en referencia al universo preconizado por los místicos de muchas culturas. No tenemos los conocimientos necesarios para poder decir que no a esto o aquello, cada cosa tiene su lugar y tendremos que analizarlas muy a fondo y adentrarnos en esos mundos de misterio para poder decidir lo que es y lo que no puede ser.

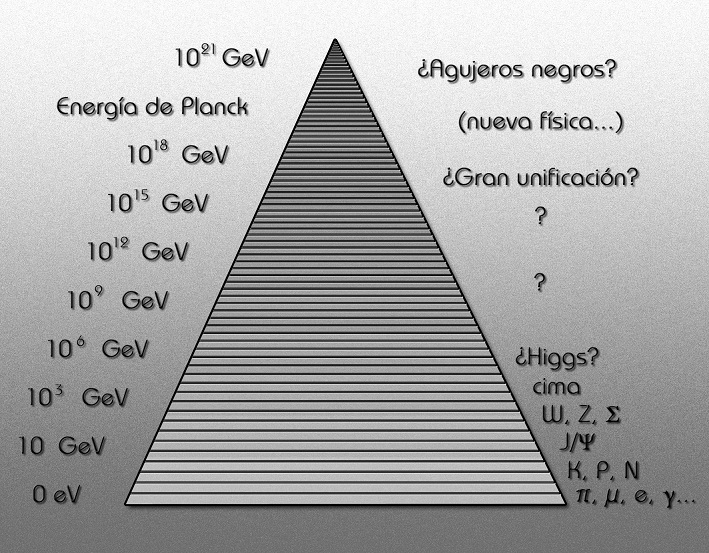

Aquí hemos llegado a una región de la Física de las partículas donde la energía (por partícula) es mucho mayor de la que actualmente podemos estudiar en nuestros laboratorios. Claro que especulamos, pero con los datos de los que disponemos, la realidad estará muy cerca de la expuesta en el gráfico, y, en él se señalan energía que no están a nuestro alcance para conseguir lo que se quiere saber.