Feb

18

¡La misteriosa Mecánica cuántica! y, “sus alrededores”

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

¡Qué maravilla! Poder imaginar…y comprobar

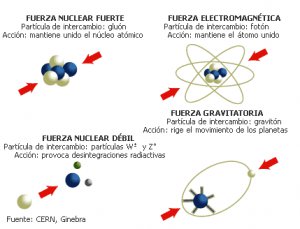

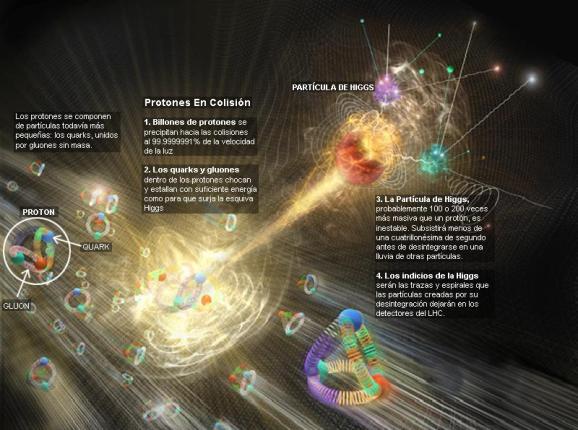

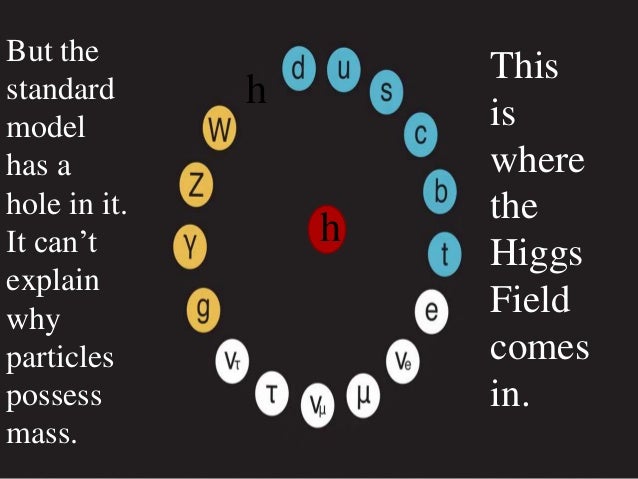

El modelo estándar de la física de partículas es una teoría que describe las relaciones entre las interacciones fundamentales conocidas y las partículas elementales que componen toda la materia. Es una teoría cuántica de campos desarrollada entre 1970 y 1973 que es consistente con la mecánica cuántica y la relatividad especial. Hasta la fecha, casi todas las pruebas experimentales de las tres fuerzas descritas por el modelo estándar están de acuerdo con sus predicciones. Sin embargo, el modelo estándar no alcanza a ser una teoría completa de las interacciones fundamentales debido a que no incluye la gravedad, la cuarta interacción fundamental conocida, y debido también al número elevado de parámetros numéricos (tales como masas y constantes que se juntan) que se deben poner a mano en la teoría (en vez de derivarse a partir de primeros principios).

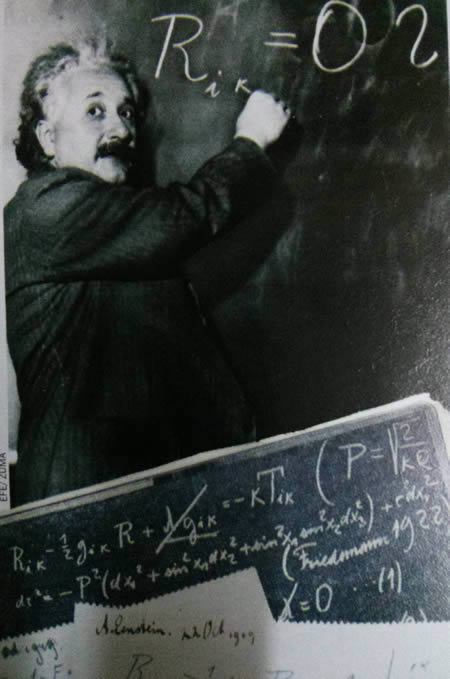

Se que una vez Albert Einstein alagó al actor Charles Chaplin diciéndole: “Lo que siempre he admirado de usted es que su arte es universal, todo el mundo le comprende y admira”. A esto Chaplin respondió a Einstein: “Lo suyo es mucho más digno de respeto, todo el mundo le admira y prácticamente nadie le comprende”.

Es cierto lo que Chaplin decía, todos admiraban a Einstein y pocos comprendían sus postulados. De hecho, cuando estaba buscando la teoría de Todo, la gente se amontonaban, literalmente, ante los escaparates de la Quinta Avenida para ver las Ecuaciones que pocos entendían…¡Así somos los Humanos! Lo que no comprendemos nos produce temor o admiración, o, las dos cosas a la vez.

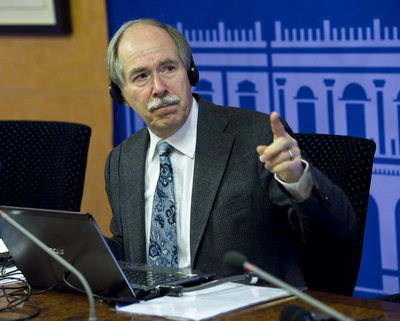

Gerad ´t Hooft

Hace algún tiempo, me desplace a Madrid invitado asistir a una Conferencia que sobre el LHC y el Bosón de Higgs impartía el físico y premio Nobel de Física Gerad ´t Hooft. La charla de ‘t Hooft se inscribía en el ciclo La ciencia y el cosmos, y, entre otras cosas nos decía a los presentes que, La física, en concreto la física de partículas, ha sido siempre su gran pasión. “cuando era joven, la física estaba cambiando el mundo radicalmente: la energía nuclear, la televisión, los ordenadores, las primeras misiones espaciales…. yo quería formar parte de todo eso”. Y las partículas elementales “eran el mayor misterio de todos”, añade. “En cierto modo aún lo son, aunque sabemos de ellas muchísimo más que entonces. Hoy los ordenadores siguen siendo emocionantes, la biología y el código del ADN, la astronomía y los vuelos espaciales… Sigue habiendo muchas cosas capaces de estimular la imaginación de jóvenes deseosos de aprender cosas nuevas impulsados por el deseo de estar ahí, en el momento en que se están haciendo los descubrimientos que cambian el mundo”.

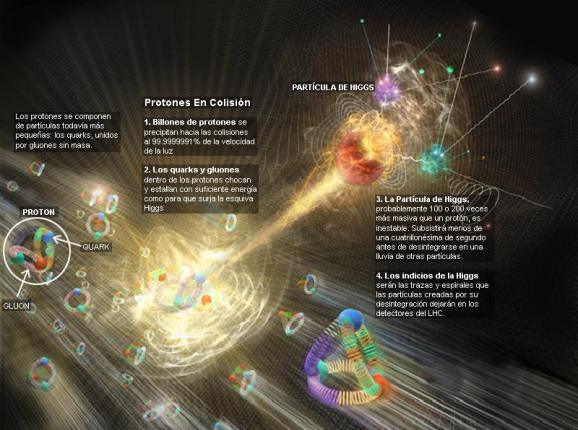

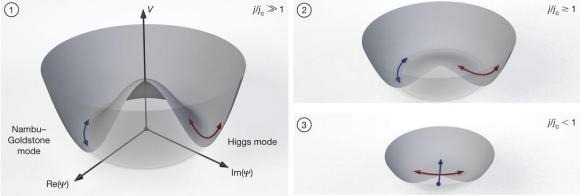

Gerard ‘t Hooft explicó lo que significa, en los modelos teóricos, el famoso bosón: “El campo de la partícula de Higgs actúa como una especie de árbitro; proyectado contra otras partículas, este campo determina su comportamiento, si tienen carga o masa y hasta qué punto se diferencian de otras partículas. Si no encontramos el Higgs, si realmente no está, necesitaremos algo más que haga ese papel de árbitro”. Eso significaría, continuaba el Nobel, que “nuestras teorías ya no funcionan, y han funcionado tan bien hasta que eso es difícil de imaginar”.

Claro que, después de aquello se encontró el Bosón de Higgs y todos contentos. Ahora se busca el Fotón oscuro en el LHC.

Sí al LHC se le resiste el Bosón de Higgs…, bueno, si es que anda por ahí

Fue en 199 cuando ‘t Hooft recibió el premio Nobel de Física 1999 (junto con su colega y director de tesis Martinus Veltman), por “dilucidar la estructura cuántica de las interacciones electrodébiles” -según palabras de la Academia sueca- de la física de las partículas elementales.

Acera del Gran Colisionador de Hadrones (el acelerador LHC situado en el Laboratorio Europeo de Física de partículas, CERN, junto a Ginebra), el científico holandés explica que se trata “de una máquina única en el mundo” y continúa: “Esperamos descubrir nuevas cosas con él y poner a prueba teorías que, hasta donde hemos podido comprobar hasta , funcionan muy bien, pero necesitamos ir más allá”.

El descubrimiento de la partícula de Higgs, o bosón de Higgs, era el objetivo número uno del LHC, y tras un largo período de funcionamiento del acelerador, los miles de físicos que trabajan en los detectores, han logrado acotar el terreno de búsqueda, aunque, insisten, seguramente necesitarán tomar muchos más para descubrirlo. O tal vez descubrir que no existe, lo que supondría una revolución en la física de partículas, al obligar a replantear el llamado Modelo Estándar, que describe todas las partículas elementales y sus interacciones, y que hasta ahora funciona con altísima precisión aunque, dicen los expertos, está incompleto.

Al fin, tras largo búsqueda y trabajo, nos hicieron partícipe del esperado descubrimiento que viene a refrendar el Modelo Estándar que, incompleto aún, con el dichoso Bosón queda mejor conformado al desaparecer uno de los casi veinte parámetros aleatorios que en él están presentes.

Gerard ‘t Hooft, uno de los grandes físicos teóricos de partículas elementales, considera que será muy difícil desarrollar una teoría del todo, un cuerpo teórico capaz de explicar todas las fuerzas que actúan en la naturaleza aunando la Relatividad General de Einstein y la Mecánica Cuántica, tan eficaces por separado en la descripción del macrocosmos y el microcosmos, respectivamente. “Mi impresión es que esta teoría unificadora, una teoría del todo, aún requerirá el trabajo de muchas nuevas generaciones de investigadores jóvenes y listos”, afirma. “No llegaremos a ella de un momento a otro por la simple razón de que el universo es demasiado complejo para que una única teoría lo abarque todo. Vale, no digo que sea imposible, pero me parece muy improbable. Y mientras llega, queda mucho por , incluso hallazgos espectaculares”.

El CERN, a la caza del misterioso Fotón oscuro

Por otra parte, el científico holandés ha señalado que el LHC realiza más actividades que intentar encontrar el bosón de Higgs. En este sentido, ha destacado que se buscan también partículas que podrían construir la materia oscura, un de materia de la que los físicos tienen la certeza de que es cinco veces más abundante que el universo que la materia ‘normal’, pero que no absorbe, refleja ni emite luz, lo que hace muy difícil su detección y, por tanto, estudiar su naturaleza. Del mismo modo, también se está desarrollando una teoría capaz de unificar la teoría de la relatividad general de Einstein y la mecánica cuántica que, según ha explicado Hooft, “permitiría lo que ocurre dentro de los átomos”.

Recuerdo un pasaje escrito por él al principio de su interesante e instructivo libro “Partículas Elemetales”, que decía:

“Mi intención es narrar los últimos 25 años de investigación sobre las partículas más pequeñas que constituyen la materia. Durante esos 25 años, yo empecé a ver la Naturaleza como un test de inteligencia para toda la humanidad en su conjunto, como un gigantesco con el que podemos jugar. Una y otra vez, nos tropezamos con nuevas piezas, grandes y pequeñas, que encajan maravillosamente con las que ya tenemos. Yo quiero compartir con ustedes la sensación de triunfo que sentimos en esos momentos.”

Tenía la intención (si se presentaba la oportunidad), de preguntarle sobre “su Principio Holográfico” pero, no pudo ser. Sólo pude saludarlo e intercambiar unas breves palabras junto con Ignacio Cirac presente en el evento.

Publicó el principio holográfico, el cual explica que la información de una dimensión extra es visible una curvatura del espacio tiempo con una menos dimensiones. Por ejemplo, los hologramas son imágenes de 3 dimensiones colocadas en una superficie de 2 dimensiones, el cual da a la imagen una curvatura cuando el observador se mueve. Similarmente, en relatividad general, la cuarta dimensión manifestada en 3 dimensiones observables como la curvatura de un sendero de un movimiento de partícula (criterio) infinitesimal. Hooft ha especulado que la quinta dimensión es realmente la fábrica del espacio-tiempo.

Acordaos de que, a mediados del año 2,003 apareció la noticia de que la “información sería el componente fundamental de la naturaleza” postulada por un grupo de físicos entre los que se incluyen el Premio Nóbel danés Gerard t´Hooft y el físico de la Universidad de California Raphael Bousso, basadas en el “Principio Holográfico”. teoría, por singular y chocante que pareciese en su momento ha tenido a lo largo de estos siete años una influencia notable tanto en la sociedad científica como en los círculos alternativos.

Personajes tan influyentes Deepak Chopra sin ir más lejos habla del ámbito cuántico como el campo de información de donde todo lo conocido, materia, emociones, pensamientos. El controvertido joven físico Nassam Haramein defiende un universo basado en el holograma. Científicos japoneses -al igual que del resto del mundo- investigan con hologramas creando imágenes 3D o explican el funcionamiento del mundo físico basado en los campos de energía e información. Hay hasta “farmacología holográfica” a cargo de empresas farmaceúticas. El año pasado el físico Craig Hogan tras la detección de un extraño ruido en el detector de ondas gravitacionalesel GEO 600, afirma que podría probar que, efectivamente, vivimos en un holograma.

La información sería el componente fundamental de la naturaleza. Es la que especifica el cuándo, dónde, cómo y cuánto del espacio, del tiempo y de la materia. El Big Bang que dio lugar al nacimiento del Universo tendría más que ver con una gigantesca “bajada” de bytes de información por parte de un superordenador, que con una explosión masiva de materia, según una nueva teoría que establece que en su origen la naturaleza está formada únicamente por pequeños paquetes de información pura que son los que especifican el cuándo, dónde, cómo y cuánto del espacio, del tiempo y de la materia.

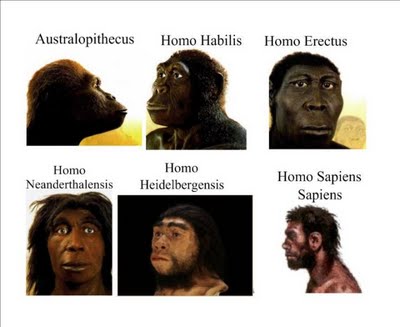

Mucho antes de que todos estos seres existieran ocurrieron muchas cosas que no sabemos. Nuestro origen no está en ninguno de ellos, sino que, partiendo de células replicantes que evolucionaron durante algunos millones de años, pudimos llegar a “SER”.

El Ser humano continúa con su carrera particular para lo que siempre ha querido saber: quiénes somos y de dónde venimos. Esas dos preguntas esenciales son, en realidad, el motor gracias al cual se mueve gran parte de la investigación científica de todos los tiempos.

En carrera por buscar certezas, cosas tan inquebrantables para explicar el origen del mundo como son los átomos o los quarks están quedando relegados a segundo término para dar paso a nuevas teorías.

Una de las más interesantes, postulada por un grupo de físicos entre los que se incluyen el Premio Nóbel danés Gerard t´Hooft y el físico de la Universidad de California Raphael Bousso, afirma que en el origen de la naturaleza podría haber únicamente ultrapequeños paquetes de información pura.

Aunque parezca raro la información no viaja en un bloque como lo haría una carta, sino que se divide en pequeños paquetes de información, viajando a través de los diferentes canales de la red y llegando todos al mismo punto. Para esto es preciso que todos los ordenadores hablen el mismo idioma, o lo que es decir el Protocolo TCP/IP, (que es el idioma) que en un principio empezó a usarse en 1983 para dirigir el tráfico de los paquetes de información por Arpanet, garantizando así que todos lleguen a su destino.

La @ que parece que nació a partir de internet se utilizaba en la antigüedad, como unidad de peso o incluso para decir a cuanto costaba algo en libros de contabilidad. Sin embargo se puso de moda gracias al ingeniero estadounidense Ray Tomilson, que diseñaba un sistema de correo electrónico para Arpanet, simplemente bajo los ojos al teclado y eligió un signo que no se utilizara en los nombres de usuario.

Según explica al respecto Newsfactor, teoría, basada en el “Principio holográfico”, establece que la información (“información” en este caso significa bits fundamentales de materia y las leyes físicas que los gobiernan) especifica el cuándo, dónde, cómo y cuánto del espacio, del tiempo y de la materia. La información sería pues, una variable para llegar a una “teoría del todo”.

Y, más allá de las cuerdas…

Según la teoría cuerdas, el espacio está descrito por la vibración, en miles de maneras, de diminutas cuerdas de una dimensión. Una cuerda vibrando arriba y abajo a cierta frecuencia podría crear un átomo de helio o una ola gravitacional, tal y las cuerdas de una guitarra crean diferentes sonidos a diferentes frecuencias.

Los teóricos de teoría han mantenido hace mucho tiempo que estas cuerdas son el componente fundamental de la naturaleza. El “Principio Holográfico”, sin embargo, cambia esta noción y mantiene que, mirando más de cerca una cuerda, se ven bits cuánticos, llamados “baldosas de Planck”, que, engarzados, dicen a las cuerdas como tienen que vibrar.

Una de las más interesentes, postulada por un grupo de físicos entre los que se incluyen el Premio Nóbel danés Gerard t´Hooft y el físico de la Universidad de California Raphael Bousso, afirma que en el origen de la naturaleza podría haber únicamente ultrapequeños paquetes de información pura.

Estas “baldosas de Planck” son bits cuadrados que delimitan un “área de Planck”, o lo que es lo mismo, un trillón de un trillón, de un trillón de un trillón de un trillón de un trillón de un centímetro cuadrado. Una cuerda de baldosas de Plank sería la versión natural de un byte.

El “Principio Holográfico”, descrito por Gerard t´Hooft y Leonard Susskind y refinado por Bousso, nos permite saber cuántos (bits y bytes) son necesarios para decirnos en detalle cada cosa que ocurre en cualquier región del espacio.

¡Por imaginación que no quede!

emilio silvera

Feb

12

¡La Física! Siempre presente

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

“¿Vas a la feria de Scarborough? Perejil, salvia, romero y tomillo. Dale recuerdos a alguien que vive allí, a aquella que fue mi amor verdadero. (…) Si dices que no puedes, entonces te responderé: Perejil, salvia, romero y tomillo. Oh, hazme saber que al menos lo intentarás, o nunca serás mi amor verdadero”

¿Que es la Vida?

¿Cómo podríamos ensamblar una explicación científica de la génesis de la vida? A simple vista nos puede parecer una tarea sin esperanzas. No creo que buscar fósiles en las rocas más antiguas sea suficiente y nos ofrezca todas las claves necesarias. La mayoría de las delicadas moléculas prebióticas que dieron lugar a la vida habrán sido erradicadas por el inexorable paso del tiempo y la destructora entropía que todo en polvo lo convierte. Es posible, que podamos esperar el hallazgo de algún residuo químico ya degradado de aquellos organismos ancestrales a partir de los cuales evolucionó la vida celular que conocemos.

Claro que, aparte de los fósiles que podamos encontrar en las rocas, existe otra línea de evidencia que, de la misma manera, se remonta al pasado lejano y oscuro, pero que existe aquí y ahora, dentro de las formas de la vida presente. Los biólogos están convencidos de que ciertas reliquias de organismos antiguos siguen viviendo en las estructuras y procesos bioquímicos de sus descendientes, incluyéndonos a nosotros, los seres humanos.

Todas estas imágenes que arriba contemplamos, no fueron siempre los objetos que ahora representan, antes, hace millones de años, fueron otras “cosas” la materia que las conforma estaba estructurada de otra manera y, si las pudiéramos ver ahora, seguramente, nos asombraría.

Todo comienza siendo una cosa y con el tiempo, se transforma en otra diferente: Evolución por la energía. En el universo en que vivimos, nada desaparece; con el tiempo se cumplen los ciclos de las cosas y se convierten en otra distinta, es un proceso irreversible que podemos contemplar a nuestro alrededor con el paso del tiempo se van cumpliendo las fases, y, no necesarimente siempre son de desgaste y envejecimiento, sino que, otras son de creación y resurgimiento. Cuando las estrellas masivas viejas esplotan en Supernovas, el espacio interetelar queda ocupado, en grandes regiones, por una nube enorme que, a veces, abarca varios años luz. El tiempo transcurre y, de esos restos de estrella “muerta”, con ayuda de la gravedad, nacen nuevas estrellas. Es la entropía negativa que lucha contra aquella otra que todo lo quiere destruir. Nosotros, de alguna manera, hacemos lo mismo con la descendencia.

El gas y el polvo se transforma en una brillante estrella que vive diez mil millones de años y termina en Nebulosa planeta con una enana blanca en el centro. Entonces la estrella que tenía un diámetro de 1.500 km, se reduce hasta unas pocas decenas, 20 0 30 Km y, su densidad, es inmensa, emitiendo radiación ultravioleta durante mucjho tiempo hasta que se enfría y se convierte en un cadáver estelar.

En lo concerniente a cambios y transformaciones, el que más me ha llamado siempre la atención es el de las estrellas que se forman a partir de gas y polvo cósmico. Nubes enormes de gas y polvo se van juntando. Sus moléculas cada vez más apretadas se rozan, se ionizan y se calientan hasta que en el núcleo central de esa bola de gas caliente, la temperatura alcanza millones de grados. La enorme temperatura posible la fusión de los protones y, en ese instante, nace la estrella que brillará miles de millones de años y dará luz y calor. Su ciclo de vida estará supeditado a su masa. Si la estrella es supermasiva, varias masas solares, su vida será más corta, ya que consumirá el combustible nuclear de fusión (hidrógeno, helio, litio, oxígeno, etc) con más voracidad que una estrella mediana como nuestro Sol, de vida más duradera.

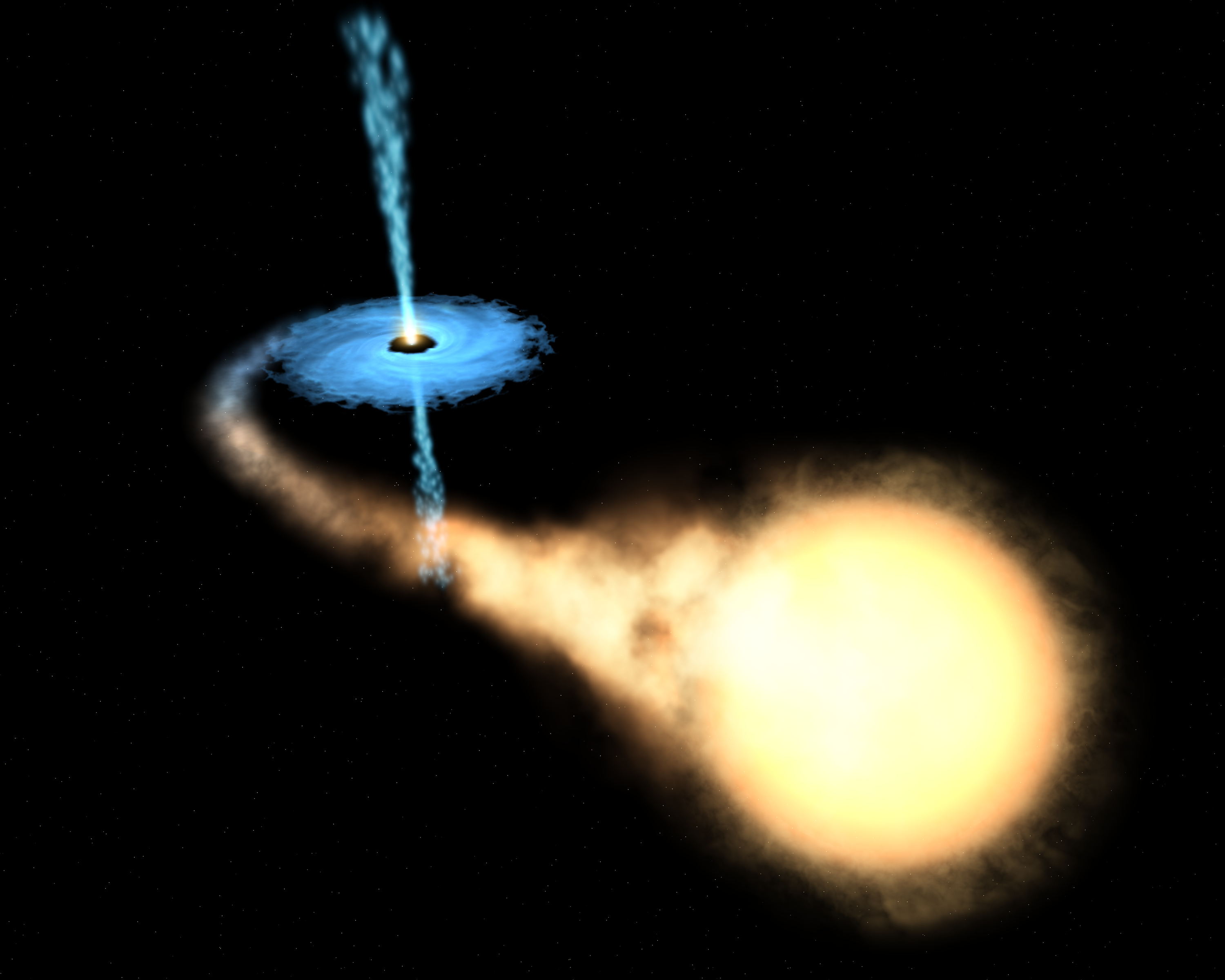

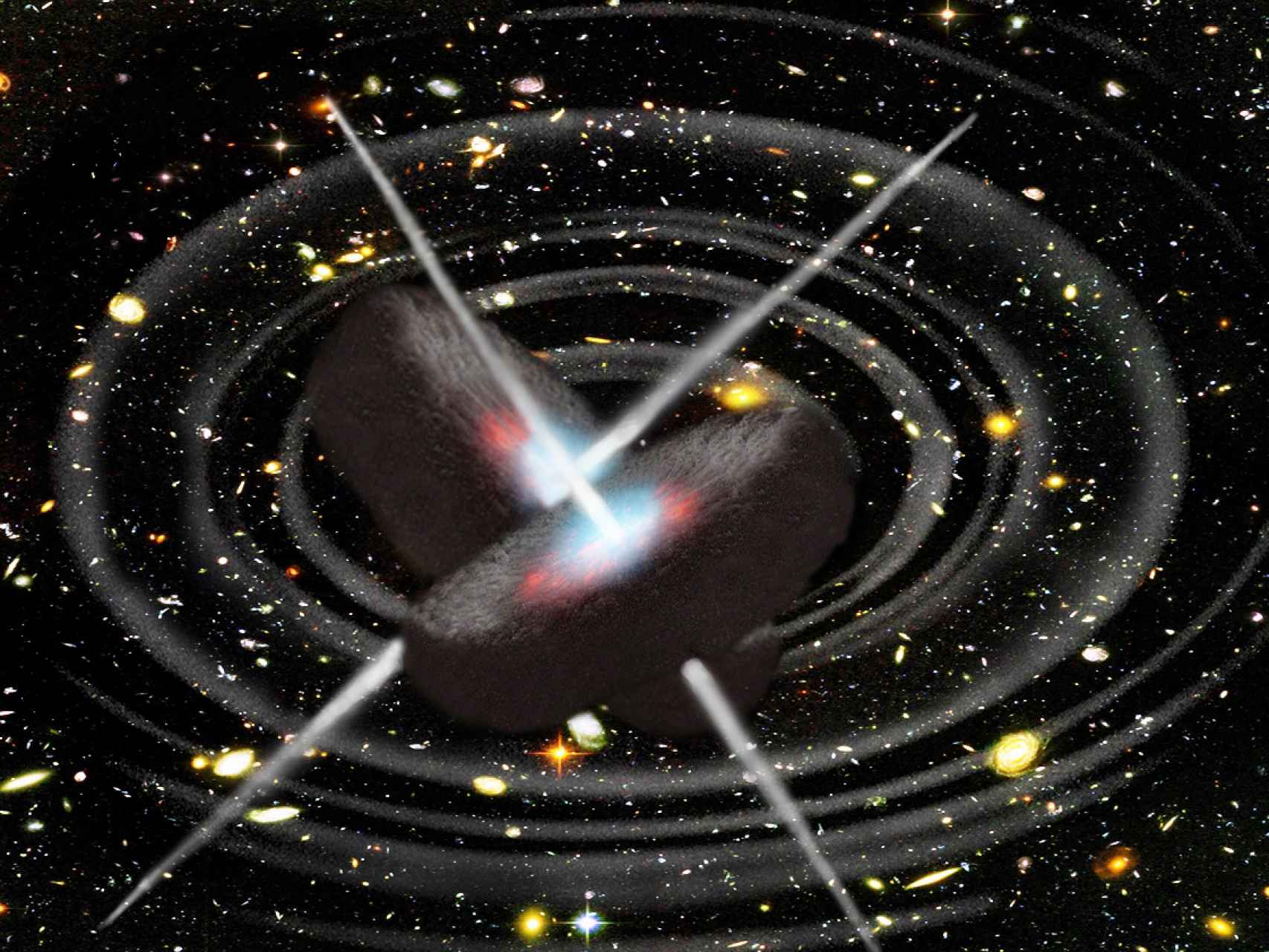

Una estrella, como todo en el universo, está sostenida por el equilibrio de dos fuerzas contrapuestas; en caso, la fuerza que tiende a expandir la estrella (la energía termonuclear de la fusión) y la fuerza que tiende a contraerla (la fuerza gravitatoria de su propia masa). Cuando finalmente el proceso de fusión se detiene por agotamiento del combustible de fusión, la estrella pierde la fuerza de expansión y queda a merced de la fuerza de gravedad; se hunde bajo el peso de su propia masa, se contrae más y más, y en el caso de estrellas súper masivas, se convierten en una singularidad, una masa que se ha comprimido a tal extremo que acaba poseyendo una fuerza de gravedad de una magnitud difícil de imaginar el común de los mortales.

La singularidad con su inmensa fuerza gravitatoria atrae a la estrella vecina

La Tierra, un objeto minúsculo en comparación con esos objetos súper masivos estelares, genera una fuerza de gravedad que, para escapar de ella, una nave o cohete espacial tiene que salir disparado la superficie terrestre a una velocidad de 11’18 km/s; el sol exige 617’3 km/s. Es lo que se conoce como velocidad de escape, que es la velocidad mínima requerida escapar de un campo gravitacional que, lógicamente, aumenta en función de la masa del objeto que la produce. El objeto que escapa puede ser una cosa cualquiera, desde una molécula de gas a una nave espacial. La velocidad de escape de un cuerpo está dada por , donde G es la constante gravitacional, M es la masa del cuerpo y R es la distancia del objeto que escapa del centro del cuerpo. Un objeto que se mueva con una velocidad menor que la de escape entra en una órbita elíptica; si se mueve a una velocidad exactamente igual a la de escape, sigue una órbita , y si el objeto supera la velocidad de escape, se mueve en una trayectoria hiperbólica y rompe la atadura en que la mantenía sujeto al planeta, la estrella o el objeto que emite la fuerza gravitatoria.

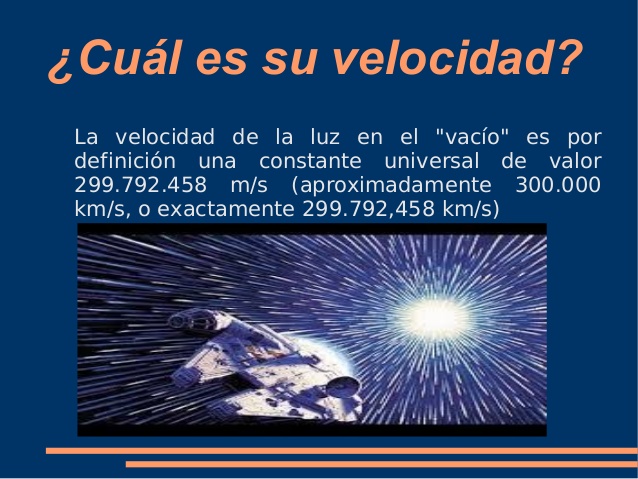

La mayor velocidad que es posible alcanzar en nuestro universo es la de la luz, c, velocidad que la luz alcanza en el vacío y que es de 299.793’458 km/s.

Sí, se pudo confirmar que los neutrinos respetan la supremacía el fotón, y la luz, sigue siendo la más rápida del Universo. Y sin embargo, no escapar de la atracción de un A.N.

Pues bien, es tal la fuerza de gravedad de un agujero negro que ni la luz puede escapar de allí; la singularidad la absorbe, la luz desaparece en su interior, de ahí su nombre de , agujero negro, la estrella supermasiva se contrae, llega a un punto que desaparece de nuestra vista. De acuerdo con la relatividad general, cabe la posibilidad de que una masa se comprima y reduzca sin límites su tamaño y se auto confine en un espacio infinitamente pequeño que encierre una densidad y una energía infinitos. Allí, el espacio y el tiempo dejan de existir.

Las singularidades ocurren en el Big Bang, en los agujeros negros y en el Big Crunch (que se podría considerar una reunión de todos los agujeros negros generados por el paso del tiempo en el universo y que nos llevará a un fin que será el comienzo).

Las singularidades de los agujeros negros están rodeados por una circunferencia invisible a su alrededor que marca el límite de su influencia. El objeto que traspasa ese límite es atraído, irremisiblemente, la singularidad que lo engulle, sea una estrella, una nube de gas o cualquier otro objeto cósmico que ose traspasar la línea que se conoce como horizonte de sucesos del agujero negro.

La existencia de los agujeros negros fue deducida por Schwarzschild, en el año 1.916, a partir de las ecuaciones de Einstein de la relatividad general. Este astrónomo alemán predijo su existencia, pero el de agujero negro se debe a John Archibald Wheeler.

Señalamos la singularidad del Big Bang pero… ¿fue así?

Así, el conocimiento de la singularidad está dado por las matemáticas de Einstein y más tarde por la observación de las señales que la presencia del agujero generan. Es una fuente emisora de rayos X que se producen al engullir materia que traspasa el horizonte de sucesos y es atrapada la singularidad, donde desaparece siempre sumándose a la masa del agujero cada vez mayor.

En el centro de nuestra galaxia, la Vía Láctea, ha sido detectado un enorme agujero negro, ya muy famoso, llamado Cygnus X-1.

Después de todo, la velocidad de la luz, la máxima del universo, no vencer la fuerza de gravedad del agujero negro que la tiene confinada para siempre.

En nuestra galaxia, con cien mil años luz de diámetro y unos doscientos mil millones de estrellas, ¿cuántos agujeros negros habrá?

Para mí, la cosa está clara: el tiempo es imparable, el reloj cósmico sigue y sigue andando sin que nada lo pare, miles o cientos de miles, millones y millones de estrellas súper masivas explotarán en brillantes supernovas para convertirse en temibles agujeros negros.

Llegará un momento que el de agujeros negros en las galaxias será de tal magnitud que comenzarán a fusionarse unos con otros que todo el universo se convierta en un inmenso agujero negro, una enorme singularidad, lo único que allí estará presente: la gravedad.

Esa fuerza de la naturaleza que está sola, no se puede juntar con las otras fuerzas que, como se ha dicho, tienen sus dominios en la mecánica cuántica, mientras que la gravitación residen en la inmensidad del cosmos; las unas ejercen su dominio en los confines microscópicos del átomo, mientras que la otra sólo aparece de manera significativa en presencia de grandes masas estelares. Allí, a su alrededor, se aposenta curvando el espacio y distorsionando el tiempo.

Esa reunión final de agujeros negros será la causa de que la Densidad Crítica sea superior a la ideal. La gravedad generada por el inmenso agujero negro que se irá formando en cada galaxia tendrá la consecuencia de parar la expansión actual del universo. Todas las galaxias que ahora están separándose las unas de las otras se irán frenando parar y, despacio al principio pero más rápido después, comenzarán a recorrer el camino hacia atrás. Finalmente, toda la materia será encontrada en un punto común donde chocará violentamente formando una enorme bola de fuego, el Big Crunch, que como sabéis, es sólo una de las variadas teorías del final del universo.

Claro que, antes de que eso llegue, tendremos que resolver el primer problema: La visita de Andrómeda, la salida de la Tierra de la Zona habitable, o, la muerte del Sol que se convertirá en una gigante roja primero y en una nebulosa planetaria con una estrella enana blanca en el centro después.

Los científicos se han preguntado a veces qué sucederá eventualmente a los átomos de nuestros cuerpos mucho tiempo después de que hayamos muerto. La posibilidad más probable es que nuestras moléculas vuelvan al Sol. En páginas anteriores he explicado el destino del Sol: se agotará su combustible de hidrógeno y fusionará helio; se hinchará en gigante roja y su órbita es probable que sobrepase la Tierra y la calcine; las moléculas que hoy constituyen nuestros cuerpos serán consumidas por la atmósfera solar.

Carl Sagan pinta el cuadro siguiente:

“Dentro de miles de millones de años a partir de , habrá un último día perfecto en la Tierra… Las capas de hielo Ártica y Antártica se fundirán, inundando las costas del mundo. Las altas temperaturas oceánicas liberarán más vapor de agua al aire, incrementando la nubosidad y escondiendo a la Tierra de la luz solar retrasando el final. Pero la evolución solar es inexorable. Finalmente los océanos hervirán, la atmósfera se evaporará en el espacio y nuestro planeta será destruido por una catástrofe de proporciones que ni podemos imaginar.”

En una escala de tiempo de varios miles de millones de años, debemos enfrentarnos al hecho de que la Vía Láctea, en la que vivimos, morirá. Más exactamente, vivimos en el brazo espiral Orión de la Vía Láctea. miramos al cielo nocturno y nos sentimos reducidos, empequeñecidos por la inmensidad de las luces celestes que puntúan en el cielo, estamos mirando realmente una minúscula porción de las estrellas localizadas en el brazo de Orión. El resto de los 200 mil millones de estrellas de la Vía Láctea están tan lejanas que apenas pueden ser vistas como una cinta lechosa que cruza el cielo nocturno.

Aproximadamente a dos millones de años luz de la Vía Láctea está nuestra galaxia vecina más cercana, la gran galaxia Andrómeda, dos o tres veces mayor que nuestra galaxia. Las dos galaxias se están aproximando a unos 500 km/s, y chocarán en un periodo de entre 3 y 4 mil millones de años. Como ha dicho el astrónomo Lars Hernquist de la California en Santa Cruz, esta colisión será “parecida a un asalto. Nuestra galaxia será literalmente consumida y destruida“. Aunque, lo cierto es que aunque en el choque algo se detruya, lo cierto es que todo quedará en forma de una galaxia mucho mayor.

Así las cosas, no parece que la Humanidad del futuro lo tenga nada fácil. Primero tendrá que escapar, dentro de unos 4.000 millones de años del gigante rojo en que se convertirá el Sol que calcinará al planeta Tierra. Segundo, en unos 10.000 millones de años, la escapada tendrá que ser aún más lejana; la destrucción será de la propia galaxia que se fusionará con otra mayor sembrando el caos cósmico del que difícilmente se podría escapar quedándonos aquí. Por último, el final anunciado, aunque más largo tiempo, es el del propio universo que, por congelación o fuego, tiene los eones contados.

Por todas estas catástrofes anunciadas por la ciencia, científicos como Kip S. Thorne y Stephen Hawking sugieren a otros universos paralelos a través de agujeros de gusano en el hiperespacio. Sería la única puerta de salida para que la Humanidad no se destruyera.

Si lo alcanzaremos o no, es imposible de contestar, no tenemos los necesarios para ello. Incluso se podría decir que aparte de estas catástrofes futuras que sabemos a ciencia cierta que ocurrirán, seguramente existan otras que están ahí latentes en la incertidumbre de si finalmente ocurren o no, sólo pendiente de decidir lo uno o lo otro por parámetros ocultos que no sabemos ni que puedan existir.

En esta situación de impotencia, de incapacidad física e intelectual, nos tenemos que dar y admitir que, verdaderamente, comparados con el universo y las fuerzas que lo rigen, somos insignificantes, menos que una mota de polvo flotando en el haz de luz que entra, imparable, por la ventana entre-abierta de la habitación.

Sin embargo, tampoco es así. Que se sepa, no existe ningún otro grupo inteligente que esté capacitado tratar de todas estas cuestiones. Que la especie humana sea consciente de dónde vino y hacia dónde va, en verdad tiene bastante mérito, y más, si consideramos que nuestro origen está a partir de materia inerte evolucionada y compleja que, un día, hace probablemente miles de millones de años, se fraguó en estrellas muy lejanas.

A finales de los 60, un joven físico italiano, Gabriele Veneziano, buscaba un grupo de ecuaciones que explicara la fuerza nuclear fuerte. Este pegamento tan fuerte que mantenía unidos los protones y neutrones del núcleo de cada átomo. Parece ser que por casualidad se encontró con un libro antiguo de matemáticas y en su interior encontró una ecuación de más de 200 años de antigüedad creada por un matemático suizo llamado Leonhard Euler. Veneziano descubrió con asombro que las ecuaciones de Euler, consideradas desde siempre una simple curiosidad matemática, parecían describir la fuerza nuclear fuerte. Después de un año de de profundos estudios, experimentos, intuición e imaginación, se podría decir que elaboraron la Teoría de Cuerdas de manera fortuita.

Tras circular entre compañeros, la ecuación de Euler acabó escrita frente a Leonard Susskind, quien se retiro a su ático para investigar. Creía que aquella antigua fórmula describía matemáticamente la fuerza nuclear fuerte, pero descubrió algo nuevo. Lo primero que descubrió fue que describía una especie de partícula con una estructura interna que vibraba y que mostraba un comportamiento que no se limitaba al de una partícula puntual. Dedujo que se trataba de una cuerda, un hilo elástico, como una goma cortada por la mitad. Esta cuerda se estiraba y contraía además de ondear y coincidía exactamente con la fórmula. Susskind redactó un artículo donde explicaba el descubrimiento de las cuerdas, pero nunca llegó a publicarse.

Muchos buscaron la 5ª dimensión… ¡sin fortuna! Aquí sólo hay tres y el espacio.

Claro que, ya he comentado otras veces que la teoría de cuerdas tiene un origen real en las ecuaciones de Einstein en las que se inspiro Kaluza para añadir la quinta dimensión y perfeccionó Klein (teoría Kaluza-Klein). La teoría de cuerdas surgió a partir de su descubrimiento accidental por Veneziano y , y a partir de ahí, la versión de más éxito es la creada por los físicos de Princeton David Gross, Emil Martinec, Jeffrey Harvey y Ryan Rohm; ellos son conocidos en ese mundillo de la física teórica como “el cuarteto de cuerdas”. Ellos han propuesto la cuerda heterótica (híbrida) y están seguros de que la teoría de cuerdas resuelve el problema de “construir la propia materia a partir de la pura geometría: eso es lo que en cierto sentido hace la teoría de cuerdas, especialmente en su versión de cuerda heterótica, que es inherentemente una teoría de la gravedad en la que las partículas de materia, tanto las otras fuerzas de la naturaleza, emergen del mismo modo que la gravedad emerge de la geometría“.

La Gravedad cuántica está en algunas mentes , ¿Estará en la Naturaleza?

La característica más notable de la teoría de cuerdas ( ya he señalado), es que la teoría de la gravedad de Einstein está contenida automáticamente en ella. De hecho, el gravitón (el cuanto de gravedad) emerge como la vibración más pequeña de la cuerda cerrada, es más, si simplemente abandonamos la teoría de la gravedad de Einstein como una vibración de la cuerda, entonces la teoría se vuelve inconsistente e inútil. , de hecho, es la razón por la que Witten se sintió inicialmente atraído hacia la teoría de cuerdas.

Witten está plenamente convencido de que “todas las ideas realmente grandes en la física, están incluidas en la teoría de cuerdas“.

No entro aquí a describir el modelo de la teoría de cuerdas que está referido a la “cuerda heterótica”, ya que su complejidad y profundidad de detalles podría confundir al lector no iniciado. Sin embargo, parece justo que deje constancia de que consiste en una cuerda cerrada que tiene dos tipos de vibraciones, en el sentido de las agujas del reloj y en el sentido contrario, que son tratadas de diferente.

Las vibraciones en el sentido de las agujas de reloj viven en un espacio de diez dimensiones. Las vibraciones de sentido contrario viven en un espacio de veintiséis dimensiones, de las que dieciséis han sido compactificadas (recordemos que en la teoría pentadimensional Kaluza-Klein, la quinta dimensión se compactificaba curvándose en un circulo). La cuerda heterótica debe su al hecho de que las vibraciones en el sentido de las agujas de reloj y en el sentido contrario viven en dos dimensiones diferentes pero se combinan para producir una sola teoría de supercuerdas. Esta es la razón de que se denomine según la palabra griega heterosis, que significa “vigor híbrido”.

En conclusión, las simetrías que vemos a nuestro alrededor, el arcoiris a las flores y a los cristales, pueden considerarse en última instancia como manifestaciones de fragmentos de la teoría decadimensional original. Riemann y Einstein habían confiado en llegar a una comprensión geométrica de por qué las fuerzas pueden determinar el movimiento y la naturaleza de la materia.

La teoría de cuerdas, a partir del descubrimiento Veneziano-Suzuki, estaba evolucionando atrás buscando las huellas de Faraday, Riemann, Maxwell y Einstein poder construir una teoría de campos de cuerdas. De hecho, toda la física de partículas estaba basada en teoría de campos. La única teoría no basada en teoría de campos era la teoría de cuerdas.

De la teoría de cuerdas combinada con la supersimetría dio lugar a la teoría de supercuerdas. La cuerda es un objeto unidimensional que en nueva teoría se utiliza remplazando la idea de la partícula puntual de la teoría cuántica de campos. La cuerda se utiliza en la teoría de partículas elementales y en cosmología y se representa por una línea o lazo (una cuerda cerrada). Los estados de una partícula pueden ser producidos por ondas estacionarias a lo largo de esta cuerda.

En teoría se trata de unificar a todas las fuerzas fundamentales incorporando simetría y en la que los objetos básicos son objetos unidimensionales que tienen una escala de 10-35 metros y, como distancias muy cortas están asociadas a energías muy altas, este caso la escala de energía requerida es del orden de 1019 GeV, que está muy por encima de la que hoy en día pueda alcanzar cualquier acelerador de partículas.

Antes expliqué, las cuerdas asociadas con los bosones sólo son consistentes como teorías cuánticas en un espacio-tiempo de 26 dimensiones; aquella asociadas con los fermiones sólo lo son en un espacio tiempo de 10 dimensiones. Ya se ha explicado que las dimensiones extras, además de las normales que podemos constatar, tres de espacio y una de tiempo, como la teoría de Kaluza-Klein, están enrolladas en una distancia de Planck. De , inalcanzables.

Una de las características más atractivas de la teoría de supercuerdas es que dan lugar a partículas de espín 2, que son identificadas con los gravitones (las partículas que transportan la gravedad y que aún no se han podido localizar). Por tanto, una teoría de supercuerdas automáticamente contiene una teoría cuántica de la interacción gravitacional. Se piensa que las supercuerdas, al contrario que ocurre con otras teorías ( ellas el Modelo Estándar), están libres de infinitos que no pueden ser eliminados por renormalización, que plagan todos los intentos de construir una teoría cuántica de campos que incorpore la gravedad. Hay algunas evidencias de que la teoría de supercuerdas está libre de infinitos, pero se está a la búsqueda de la prueba definitiva.

Aunque no hay evidencia directa de las supercuerdas, algunas características de las supercuerdas son compatibles con los hechos experimentales observados en las partículas elementales, como la posibilidad de que las partículas no respeten paridad, lo que en efecto ocurre en las interacciones débiles.

Extrañas configuraciones a las que, algunos físicos le quieren sacar lo que seguramente no se encuentra en ellas

Estoy convencido de que la teoría de supercuerdas será finalmente corroborada por los hechos y, ello, se necesitará algún tiempo; no se puede aún comprobar ciertos parámetros teóricos que esas complejas matemáticas a las que llaman topología nos dicen que son así.

Habrá que tener siempre a mano las ecuaciones de Einstein, las funciones modulares de Ramanujan y el Supertensor métrico de ese genio matemático que, al igual que Ramanujan, fue un visionario llamado Riemann.

Las historias de estos dos personajes, en cierto modo, son muy parecidas. Tanto Riemann como Ramanujan murieron antes de cumplir los 40 años y, también en ambos casos, en difíciles. Estos personajes desarrollaron una actividad matemática sólo comparable al trabajo de toda la vida de muchos buenos matemáticos.

usto de Ramanujan en el jardín del Birla Industrial & Technological Museum.

¿Cómo es posible que, para proteger la simetría conforme original por su destrucción por la teoría cuántica, deben ser milagrosamente satisfechas cierto de identidades matemáticas, que precisamente son las identidades de la función modular de Ramanujan?

En este he expresado que las leyes de la naturaleza se simplifican cuando se expresan en dimensiones más altas. Sin embargo, a la luz de la teoría cuántica, debo corregir algo esta afirmación, y para decirlo correctamente debería decir: las leyes de la naturaleza se simplifican cuando se expresan coherentemente en dimensiones más altas. Al añadir la palabra coherentemente hemos señalado un punto crucial. ligadura nos obliga a utilizar las funciones modulares de Ramanujan, que fijan en diez de dimensiones del espacio-tiempo. Esto a su vez, puede facilitarnos la clave decisiva para explicar el origen del universo.

emilio silvera

Feb

11

Siempre buscaremos nuevas teorías de la Física del Universo

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

Una nueva clase de reacción de fisión nuclear observada en el CERN ha mostrado importantes puntos débiles en nuestro entendimiento actual del núcleo atómico. La fisión del mercurio-180 se suponía una reacción “simétrica” que daría lugar a dos fragmentos iguales, pero en lugar de ello ha producido dos núcleos con masas bastante diferentes, una reacción “asimétrica” que plantea un serio desafío a los teóricos.

Una reacción nuclear “desafiante”

La Ciencia no duerme. En todo el mundo (ahora también fuera de él -en el espacio), son muchos los Científicos que trabajan de manera tenaz para buscar nuevas formas de alcanzar lo ahora inalcanzable y, para ello, se emplean las más sofisticadas estructuras técnicas de avanzados sistemas tecnológicos que hacen posible llegar allí donde nunca nadie había llegado.

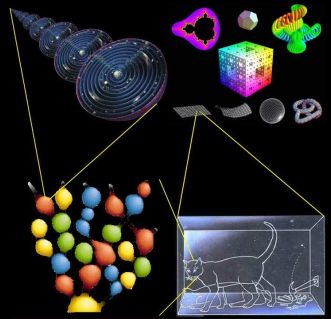

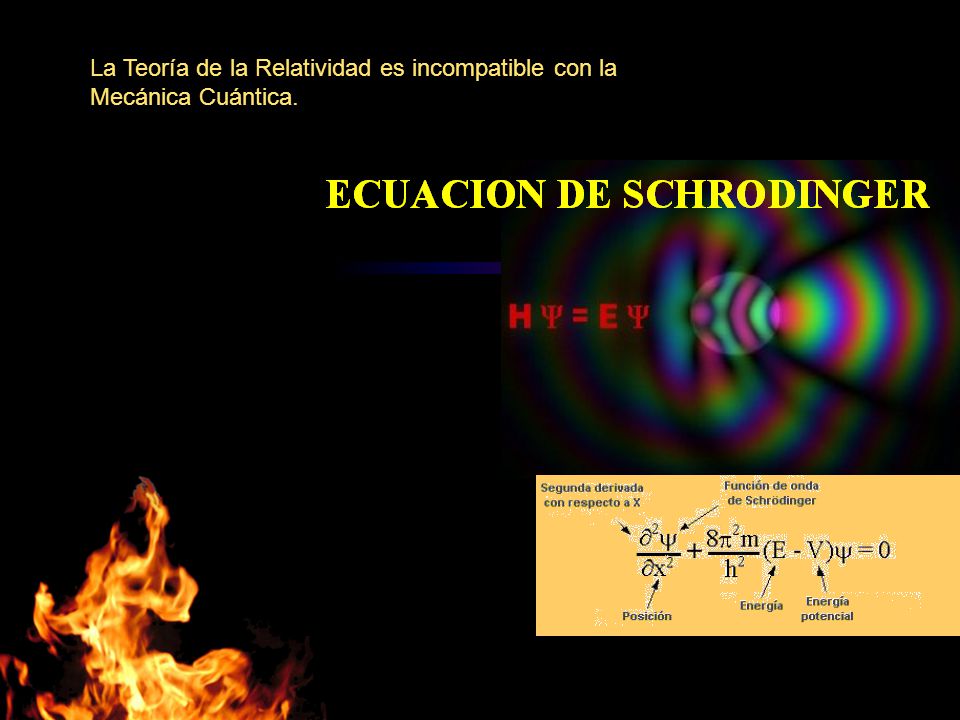

Entre los teóricos, el casamiento de la relatividad general y la teoría cuántica es el problema central de la física moderna. A los esfuerzos teóricos que se realizan con ese propósito se les llama “supergravedad”, “súpersimetría”, “supercuerdas” “teoría M” o, en último caso, “teoría de todo o gran teoría unificada”.

Vista hemisférica de Venus. (Cortesía de NASA)

El segundo planeta a partir del Sol. Tiene la órbita más circular de todos los planetas. Su albedo geométrico medio, 0,65, es el mayor de todos los planetas, como resultado de su cubierta de nubes blancas sin fracturas. En su máximo alcanza magnitud -4,7, mucho más brillante que cualquier otro planeta. Su eje de rotación está inclinado casi 180º con respecto a la vertical, de manera que su rotación es retrógrada. Rota alrededor de su eje cada 243 días, y, por tanto, muestra siempre la misma cara hacia la Tierra cuando los dos planetas se encuentran en su máxima aproximación.

La atmósfera de Venus es en un 96,5% de dióxido de carbono y un 3,5 de nitrógeno, con trazas de dióxido de azufre, vapor de agua, argón, hidrógeno y monóxido de carbono. La presión en la superficie es de 92 bares (es decir, 92 veces la presión a nivel del mar en la Tierra). La temperatura superficial promedio es de 460 ºC debido al “efecto invernadero” en la atmósfera del planeta. Los rayos son muy frecuentes. Existe una densa capa de nubes a una altitud de unos 45/65 Km. compuesta de ácido sulfúrico y gotitas de agua.

VENUS: El Planeta Imposible

Mundos inimaginables que tendrán, como en el nuestro, formas de vida de una rica diversidad que ni podemos imaginar. Y, según creo, basado en que todas las leyes del Universo funcionan de la misma manera en todas partes, esas vidas, también, estarán basadas en el Carbono. Otra cosa será sus morfologías.

Nuestros sueños de visitar mundos remotos, y, en ellos, encontrar otras clases de vida, otras inteligencias, es un sueño largamente acariaciado por nuestras mentes que, se resisten a estar sólas en un vasto Universo que, poseyendo miles de millones de mundos, también debe estar abarrotado de una diversidad de clases de vida que, al igual que ocurre aquí en la Tierra, pudieran (algunas de ellas) estar haciéndose la misma pregunta: ¿Estaremos sólos en tan inmenso Universo.

Hace algún tiempo que los medios publicaron la noticias:

“Físicos británicos creen que el bosón de Higgs y su relación con la gravedad puede ser la clave para crear una ecuación única que explique el Universo entero.”

“La teoría del todo, también conocida como teoría unificada, fue el sueño que Einstein nunca pudo cumplir. Consiste en una teoría definitiva, una ecuación única que explique todos los fenómenos físicos conocidos y dé respuesta a las preguntas fundamentales del Universo. Esa teoría unificaría la mecánica cuántica y la relatividad general, dos conocimientos aceptados pero que describen el Cosmos de forma muy diferente. Albert Einstein no consiguió formularla. Tampoco nadie después de él, pero sigue siendo la ambición de muchos científicos. En este empeño, físicos de la británica Universidad de Sussex han dado un nuevo paso para probar que solo hay una fuerza fundamental en la naturaleza. Creen haber observado como el campo de Higgs interactúa con la Gravedad.”

Si hablamos de nuestra Galaxia, la Vía Láctea, lo havcemos de algo que tiene 100.000 millones de años-luz de diámetro y más de ciento cincuenta mil millones de estrellas, no digamos de mundos y otra infinidad de objetos de exótica estructura e increíbles conformaciones que, como los púlñsares, los agujeros negros o los manétares, no dejan de asombrarnos. Somos, una especie viviente que ha llegado a poder generar pensamientos y crear teorías encaminadas a descubrir la verdad de la Naturaleza, y, nuestra aparente “insignificante presencia”, podría ser un signo de que, el universo “ha permitido” observadores para que lo expliquen y se pueda comprender.

Tenemos el Universo dentro de nuestras mentes

El universo es un lugar tan maravilloso, rico y complejo que el descubrimiento de una teoría final, en el sentido en el que está planteada la teoría de supercuerdas, no supondría de modo alguno el fin de la ciencia ni podríamos decir que ya lo sabemos todo y para todo tendremos respuestas. Más bien será, cuando llegue, todo lo contrario: el hallazgo de esa teoría de Todo (la explicación completa del universo en su nivel más microscópico, una teoría que no estaría basada en ninguna explicación más profunda) nos aportaría un fundamento mucho más firme sobre el que podríamos construir nuestra comprensión del mundo y, a través de estos nuevos conocimientos, estaríamos preparados para comenzar nuevas empresas de metas que, en este momento, nuestra ignorancia no nos dejan ni vislumbrar. La nueva teoría de Todo nos proporcionaría un pilar inmutable y coherente que nos daría la llave para seguir explorando un universo más comprensible y por lo tanto, más seguro, ya que el peligro siempre llega de lo imprevisto, de lo desconocido que surge sin aviso previo; cuando conocemos bien lo que puede ocurrir nos preparamos para evitar daños.

Algunos dicen que para cuando tengamos una Teoría de Todo, el mundo habrá cambiado, habrá pasado tanto tiempo que, para entonces, la teoría habrá quedado vieja y se necesitará otra nueva teoría más avanzada. Eso significa, si es así, que nunca tendremos una explicación de todo y siempre quedarán cuestiones enigmáticas que tendremos que tesolver. ¡Menos mal!

La búsqueda de esa teoría final que nos diga cómo es el Universo, el Tiempo y el Espacio, la Materia y los elementos que la conforman, las Fuerzas fundamentales que interaccionan con ella, las constantes universales y en definitiva, una formulación matemática o conjunto de ecuaciones de las que podamos obtener todas las respuestas, es una empresa nada fácil y sumamente complicada; la teoría de cuerdas es una estructura teórica tan profunda y complicada que incluso con los considerables progresos que se han realizado durante las últimas décadas, aún nos queda un largo camino antes de que podamos afirmar que hemos logrado dominarla completamente. Se podría dar el caso de que el matemático que encuentre las matemáticas necesarias para llegar al final del camino, aún no sepa ni multiplicar y esté en primaria en cualquier escuela del mundo civilizado. Por otra parte, siempre andamos inventando ecuaciones para todo, que expliquen este o aquel enigma que deseamos conocer.

Lo cierto es que, no conocemos el futuro que le espera a la Humanidad pero, tal desconocimiento no incide en el hecho cierto de que siempre estemos tratando de saber el por qué de las cosas y, seguramente, si Einstein hubiera conocido la existencia de las cuatro fuerzas fundamentales, habría podido avanzar algo más, en su intento de lograr esa ecuación maravillosa que “todo” lo pudiera explicar.

Muchos de los grandes científicos del mundo (Einstein entre ellos), aportaron su trabajo y conocimientos en la búsqueda de esta teoría, no consiguieron su objetivo pero sí dejaron sus ideas para que otros continuaran la carrera hasta la meta final. Por lo tanto, hay que considerar que la teoría de cuerdas es un trabajo iniciado a partir de las ecuaciones de campo de la relatividad general de Einstein, de la mecánica cuántica de Planck, de las teorías gauge de campos, de la teoría de Kaluza-Klein, de las teorías de… hasta llegar al punto en el que ahora estamos.

La armoniosa combinación de la relatividad general y la mecánica cuántica es un éxito muy importante. Además, a diferencia de lo que sucedía con teorías anteriores, la teoría de cuerdas tiene la capacidad de responder a cuestiones primordiales que tienen relación con las fuerzas y los componentes fundamentales de la naturaleza. Allí, en sus ecuaciones, aparece el esquivo gravitón implicándo con ello que la teoría contiene implicitamente una teoría cuántica de la Gravedad.

Ahora, en la nueva etapa del LHC, tratarán de buscar partículas supersimétricas

Igualmente importante, aunque algo más difícil de expresar, es la notable elegancia tanto de las respuestas que propone la teoría de cuerdas, como del marco en que se generan dichas respuestas. Por ejemplo, en la teoría de cuerdas muchos aspectos de la Naturaleza que podrían parecer detalles técnicos arbitrarios (como el número de partículas fundamentales distintas y sus propiedades respectivas) surgen a partir de aspectos esenciales y tangibles de la geometría del universo. Si la teoría de cuerdas es correcta, la estructura microscópica de nuestro universo es un laberinto multidimensional ricamente entrelazado, dentro del cual las cuerdas del universo se retuercen y vibran en un movimiento infinito, marcando el ritmo de las leyes del cosmos.

Lejos de ser unos detalles accidentales, las propiedades de los bloques básicos que construyen la naturaleza están profundamente entrelazadas con la estructura del espacio-tiempo. En nuestro Universo, aunque no pueda dar esa sensación a primera vista, cuando se profundiza, podemos observar que, de alguna manera, todo está conectado, de la misma manera, nuestras mentes son parte del universo y, en ellas, están todas las respuestas.

Claro que, siendo todos los indicios muy buenos, para ser serios, no podemos decir aún que las predicciones sean definitivas y comprobables para estar seguros de que la teoría de cuerdas ha levantado realmente el velo de misterio que nos impide ver las verdades más profundas del universo, sino que con propiedad se podría afirmar que se ha levantado uno de los picos de ese velo y nos permite vislumbrar algo de lo que nos podríamos encontrar, a través de esa fisura parece que se escapa la luz de la comprensión que, en su momento, se podría alcanzar.

Muchos sueñan con encontrar esa Teoría del Todo

Mientras que la soñada teoría llega, nosotros estaremos tratando de construir ingenios que como el GEO600, el más sensible detector de ondas gravitacionales que existe ( capaz de detectar ínfimas ondulaciones en la estructura del espacio-tiempo ), nos pueda hablar de otra clase de universo. Hasta el momento el universo conocido es el que nos muestran las ondas electromagnéticas de la luz pero, no sabemos que podríamos contemplar si pudiéramos ver ese otro universo que nos hablan de la colisión de agujeros negros…por ejemplo.

GEO 600

La teoría de cuerdas, aunque en proceso de elaboración, ya ha contribuido con algunos logros importantes y ha resuelto algún que otro problema primordial como por ejemplo, uno relativo a los agujeros negros, asociado con la llamada entropía de Bekenstein-Hawking, que se había resistido pertinazmente durante más de veinticinco años a ser solucionada con medios más convencionales. Este éxito ha convencido a muchos de que la teoría de cuerdas está en el camino correcto para proporcionarnos la comprensión más profunda posible sobre la forma de funcionamiento del universo, que nos abriría las puertas para penetrar en espacios de increíble “belleza” y de logros y avances tecnológicos que ahora ni podemos imaginar.

Como he podido comentar en otras oportunidades, Edward Witten, uno de los pioneros y más destacados experto en la teoría de cuerdas, autor de la versión más avanzada y certera, conocida como teoría M, resume la situación diciendo que: “la teoría de cuerdas es una parte de la física que surgió casualmente en el siglo XX, pero que en realidad era la física del siglo XXI“.

Witten, un físico-matemático de mucho talento, máximo exponente y punta de lanza de la teoría de cuerdas, reconoce que el camino que está por recorrer es difícil y complicado. Habrá que desvelar conceptos que aún no sabemos que existen.

Ellos nos legaron parte de las teorías que hoy manejamos en el mundo para tratar de conocer el Universo pero, sigue siendo insuficientes… ¡Necesitamos Nuevas Teorías! que nos lleven al conocimientos más profundos de la realidad en que se mueve la Naturaleza, sólo de esa manera, podremos seguir avanzando.

El hecho de que nuestro actual nivel de conocimiento nos haya permitido obtener nuevas perspectivas impactantes en relación con el funcionamiento del universo es ya en sí mismo muy revelador y nos indica que podemos estar en el buen camino al comprobar que las ecuaciones topológicas complejas de la nueva teoría nos habla de la rica naturaleza de la teoría de cuerdas y de su largo alcance. Lo que la teoría nos promete obtener es un premio demasiado grande como para no insistir en la búsqueda de su conformación final.

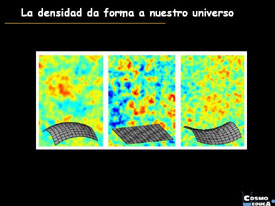

La expansión del universo se ha estudiado de varias maneras diferentes, pero la misión WMAP completada en 2003, representa un paso importante en la precisión y los resultados presentados hasta el momento con mayor precisión para saber, en qué clase de Universo estamos, cómo pudo comenzar y, cuál podría ser su posible final. Todo ello, es un apartado más de ese todo que tratamos de buscar para saber, en qué Universo estamos, cómo funcionan las cosas y por qué lo hacen de esa determinada manera y no de otra diferente.

La relatividad general nos dijo cómo es la geometría del Universo

El universo, la cosmología moderna que hoy tenemos, es debida a la teoría de Einstein de la relatividad general y las consecuencias obtenidas posteriormente por Alexandre Friedmann. El Big Bang, la expansión del universo, el universo plano y abierto o curvo y cerrado, la densidad crítica y el posible Big Crunch.

Un comienzo y un final que abarcará miles y miles de millones de años de sucesos universales a escalas cosmológicas que, claro está, nos afectará a nosotros, insignificantes mortales habitantes de un insignificante planeta, en un insignificante sistema solar creado por una insignificante y común estrella.

Pero… ¿somos en verdad tan insignificantes?

Los logros alcanzados hasta el momento parecen desmentir tal afirmación, el camino recorrido por la humanidad no ha sido nada fácil, los inconvenientes y dificultades vencidas, las luchas, la supervivencia, el aprendizaje por la experiencia primero y por el estudio después, el proceso de humanización (aún no finalizado), todo eso y más nos dice que a lo mejor, es posible, pudiera ser que finalmente, esta especie nuestra pudiera tener un papel importante en el conjunto del universo. De momento y por lo pronto ya es un gran triunfo el que estemos buscando respuestas escondidas en lo más profundo de las entrañas del cosmos.

Tengo la sensación muy particular, una vez dentro de mi cabeza, un mensaje que no sé de dónde pero que llega a mi mente que me dice de manera persistente y clara que no conseguiremos descubrir plenamente esa ansiada teoría del todo, hasta tanto no consigamos dominar la energía de Planck que hoy por hoy, es inalcanzable y sólo un sueño.

Sus buenas aportaciones a la Física fueron bien recompensadas de muchas maneras.

En mecánica cuántica es corriente trabajar con la constante de Planck racionalizada, (ħ = h/2p = 1’054589×10-34 Julios/segundo), con su ley de radiación (Iv = 2hc-2v3/[exp(hv/KT)-1]), con la longitud de Planck , con la masa de Planck, y otras muchas ecuaciones fundamentales para llegar a lugares recónditos que, de otra manera, nunca podríamos alcanzar.

Todo lo anterior son herramientas de la mecánica cuántica que en su conjunto son conocidas como unidades de Planck, que como su mismo nombre indica son un conjunto de unidades, usado principalmente en teorías cuánticas de la gravedad, en que longitud, masa y tiempo son expresadas en múltiplos de la longitud, masa y tiempo de Planck, respectivamente. Esto es equivalente a fijar la constante gravitacional (G), como la velocidad de la luz (c), y la constante de Planck racionalizada (ħ) iguales todas a la unidad. Todas las cantidades que tienen dimensiones de longitud, masa y tiempo se vuelven adimensionales en unidades de Planck. Debido a que en el contexto donde las unidades de Planck son usadas es normal emplear unidades gaussianas o unidades de Heaviside-Lorentz para las cantidades electromagnéticas, éstas también se vuelven adimensionales, lo que por otra parte ocurre con todas las unidades naturales. Un ejemplo de esta curiosidad de adimiensionalidad, está presente en la constante de estructura fina (2pe2/hc) de valor 137 (número adimensional) y cuyo símbolo es la letra griega a (alfa).

Estas unidades de Planck nos llevan a la cosmología del nacimiento del universo y nos proporciona un marco elegante, coherente y manejable mediante cálculos para conocer el universo remontándonos a los primeros momentos más breves posteriores a la explosión o Big Bang. El tiempo de Planck por ejemplo, expresado por , tiene un valor del orden de 10-43 segundos, o lo que es lo mismo, el tiempo que pasó desde la explosión hasta el tiempo de Planck fue de: 0,000.000.000.000.000.000.000.000.000.000.000.000.000.001 de 1 segundo. En la fórmula, G es la constante universal de Newton, ħ es la constante de Planck racionalizada y c es la velocidad de la luz.

Es una unidad de tiempo infinitesimal, como lo es el límite de Planck que se refiere al espacio recorrido por un fotón (que viaja a la velocidad de la luz) durante una fracción de tiempo de ínfima duración y que es de 0,000.000.000.000.000.000.000.000.000.000.001 de cm.

Hasta tal punto llegan los físicos en sus cálculos para tratar de adecuar los conocimientos a la realidad por medio del experimento. Buscamos incansables…¡las respuestas! Hasta que no podamos tocar con nuestras propias manos esa partícula final…

Sin embargo, cuando hablamos de estas unidades tan pequeñas, no debemos engañarnos. Precisamente, para tratar de llegar hasta esos límites tan profundos se necesitan máquinas que desarrollan inmensas energías: los aceleradores de partículas, que como el Fermilab o el LHC en el CERN, han facilitado a los físicos experimentadores entrar en las entrañas de la materia y descubrir muchos de los secretos antes tan bien guardados. Ahora, disponiendo de 14 TeV, tratán de nbuscar partículas supersimñétricas y el origen de la “materia oscurta”.

Desgraciadamente, el hallazgo del Bosón de Higgs no ha podido completar el Modelo Estándar de la Física de Partículas, ya que, aún tiene 19 parámetros aleatorios que no podemos explicar. Y, por supuesto, más lejos queda la posibilidad de que podamos construir un acelerador que pudiera alcanzar la energía de Planck, del orden de 1019 eV (1 eV = 10-19 julios) = 1’60210×10-19. Hoy por hoy, ni nuestra tecnología ni todos los recursos que tenemos disponibles si empleáramos todo el presupuesto bruto de todos los países del globo unidos, ni así digo, podríamos alcanzar esta energía necesaria para comprobar experimentalmente la existencia de “cuerdas” vibrantes que confirmen la teoría de Todo.

Claro que, pudiera ser que, todo se pudiera alcanzar de manera mucho más simple y que, teniéndolo a la vista, no hemos sabido ver. Habrá que agudizar el ingenio para resolver estas y otras cuestiones que, como la de la Velocidad de la Luz, nos tienem atados y bien atados a este granito de arena inmerso en un vasto universo y que, nosotros, llamamos mundo.

emilio silvera

Feb

6

Entrelazamiento cuántico

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (4)

Comments (4)

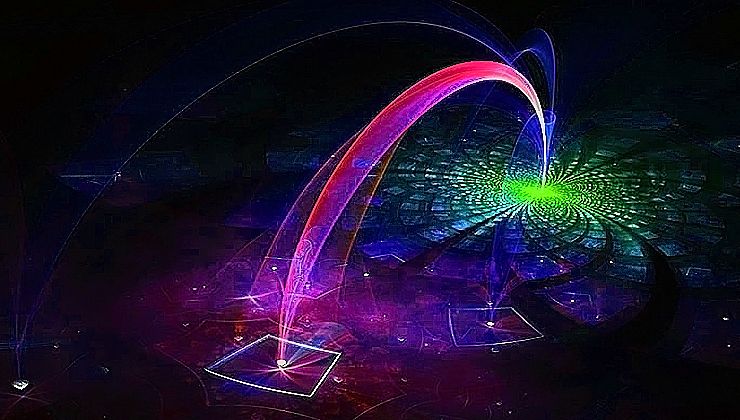

En 1935 un molesto Albert Einstein, junto con sus colegas Podolsky y Rosen, presentaron la llamada “paradoja EPR”, por sus iniciales. Esta quería servir de ejemplo para decir que la mecánica cuántica era una “teoría” incompleta y fallida. Que necesitaba de una profunda revisión. ¿Y por qué? Porque, según el propio Einstein, este conjunto de hipótesis violaba el universo tal y como lo conocemos. Por lo tanto, tenía que estar mal en algún punto. Sin embargo, lo que no sabía Einstein es que la paradoja presentada es en realidad una manifestación real de lo que ocurre en la naturaleza. Efectivamente, en los tiempos que corren hemos podido comprobar un fenómeno inquietante y extraordinario que permite que dos partículas separadas entre sí por una distancia monstruosa sean capaces de “comunicarse” sin que exista nada, ningún canal de transmisión, entre las dos. A este extraño fenómeno, que rompe por completo nuestra manera de entender el mundo, lo llamamos entrelazamiento cuántico.

Científicos del Instituto de Óptica Cuántica e Información Cuántica (IQOQI) de la Academia Austríaca de Ciencias, de la Universidad de Viena y de la Universidad Autónoma de Barcelona (UAB) han conseguido por primera vez entrelazar tres partículas de luz o fotones utilizando una propiedad cuántica relacionada con el retorcimiento (twist) de la estructura de sus frentes de onda.

De la misma manera que el famoso gato de Schrödinger está simultáneamente vivo y muerto, todas las demostraciones experimentales realizadas hasta ahora de entrelazamiento de varias partículas han sido llevadas a cabo con objetos cuánticos en dos dimensiones, dos niveles discretos posibles. Los fotones retorcidos utilizados en el experimento de Viena no tienen ese límite bidimensional y pueden existir en tres o más estados cuánticos vez.

El estado de entrelazamiento entre tres fotones creado por el grupo de Viena bate el récord previo de dimensionalidad, y da luz a una nueva forma de entrelazamiento asimétrico que nunca ha sido observado hasta ahora. Los resultados aparecen esta semana publicados en Nature Photonics.

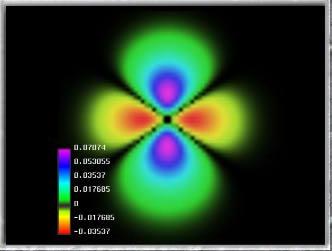

![]()

![]()

El entrelazamiento es una propiedad antiintuitiva de la física cuántica que siempre ha desconcertado a los científicos y los filósofos. Los cuantos de luz entrelazados parecen ejercer una influencia entre ellos, no importa la distancia a la que se encuentren. De manera metafórica puede considerarse un patinador de hielo con la asombrosa habilidad de girar sobre sí mismo tanto en el sentido de las agujas del reloj como en el sentido contrario, al mismo tiempo.

Un par de patinadores entrelazados alejándose entre ellos mientras hacen este sorprendente giro tendrán las direcciones de giro perfectamente correlacionadas: si en un instante el primero gira en un sentido, también lo hace el otro, aunque estén tan lejos que terminen en pistas en continentes diferentes.

“Los fotones entrelazados de nuestro experimento se pueden ilustrar no con dos, sino con tres patinadores, danzando una coreografía cuántica pefectamente sincronizada”, explica Mehul Malik, el primer autor del artículo. “Su danza es un poco más compleja, con dos de los patinadores mostrando, además, otro movimiento correlacionado, además del giro mencionado. De hecho, somos los primeros que hemos conseguido este tipo de entrelazamiento cuántico asimétrico en el laboratorio”, continúa Malik.

Los investigadores han creado el estado de entrelazamiento entre tres fotones utilizando otro artificio cuántico: han combinado dos pares de fotones con entrelazamiento de alta dimensión de tal manera que era imposible saber de dónde procedía cada uno de los fotones. Aparte de servir como campo de pruebas para estudiar muchos conceptos fundamentales de la mecància cuántica, los estados de entrelazamiento de varios fotones vez, como este, tienen aplicaciones que van desde la computación cuántica hasta la encriptación cuántica.

En esta línea, los autores de la investigación proponen un nuevo tipo de protocolo de criptografía cuántica, basado en este estado de entrelazamiento asimétrico, que permite que diferentes capas de información se compartan de forma asimétrica entre varios emisores y destinatarios con total seguridad.

Los científicos consideran que, aunque todavía habrá que solventar muchos obstáculos técnicos antes de que este protocolo se pueda utilizar en la práctica, el rápido progreso de la tecnología cuántica hace que sea sólo cuestión de tiempo que esta tecnología encuentre su lugar en las redes cuánticas del futuro. “El experimento abre las puertas a un futuro Internet cuántico, con más de dos interlocutores, que permitiría una comunicación de más de dos bits por fotón”, añade Zeilinger.

En la investigación ha participado Mehul Malik, Manuel Erhard, Mario Krenn, Robert Fickler, Anton Zeilinger, del Instituto de Óptica Cuántica e Información Cuántica de la Academia Austríaca de Ciencia (IQOQI) y el investigador del Grupo de información y de Fenómenos Cuánticos del Departamento de Física de la UAB Marcus Huber, físico teórico que ha inventado las técnicas necesarias para analizar el experiemento. La investigación ha sido financiada por la Comisión Europea, el Consejo Europeo de Investigación (ERC) y la Austrian Science Fund (FWF). (Fuente: UAB)

Feb

5

Teorías, masas, partículas, dimensiones…

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Las Teorías:

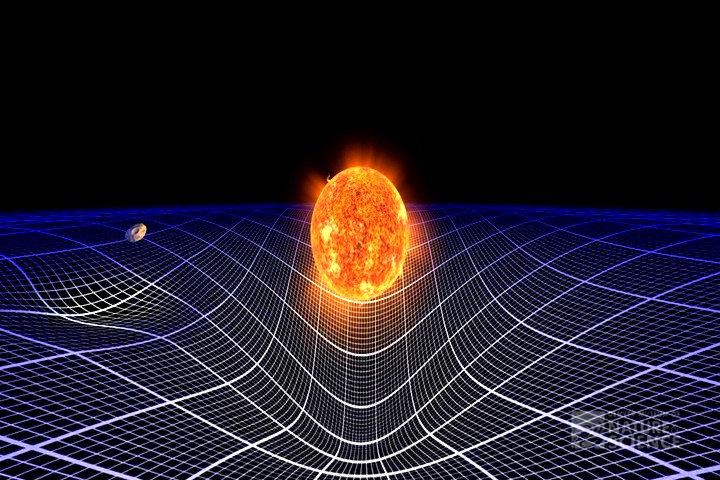

Una nos habla del Cosmos y de como el espacio se curva ante la presencia de masas, la otra, nos habla de funciones de ondas, entrelazamientos cuánticos, de diminutos objetos que conforman la materia y hacen posibles los átomos y la vida.

Entre los teóricos, el casamiento de la relatividad general y la teoría cuántica es el problema central de la física moderna. A los esfuerzos teóricos que se realizan con ese propósito se les llama “supergravedad”, “súpersimetría”, “supercuerdas” “teoría M” o, en último caso, “teoría de todo o gran teoría unificada”.

Ahí tenemos unas matemáticas exóticas que ponen de punta hasta los pelos de las cejas de algunos de los mejores matemáticos del mundo (¿y Perelman? ¿Por qué nos se ha implicado?). Hablan de 10, 11 y 26 dimensiones, siempre, todas ellas espaciales menos una que es la temporal. Vivimos en cuatro: tres de espacio (este-oeste, norte-sur y arriba-abajo) y una temporal. No podemos, ni sabemos o no es posible instruir, en nuestro cerebro (también tridimensional), ver más dimensiones. Pero llegaron Kaluza y Klein y compactaron, en la longitud de Planck las dimensiones que no podíamos ver. ¡Problema solucionado!

La longitud de Planck (ℓP) u hodón (término acuñado en 1926 por Robert Lévi) es la distancia o escala de longitud por debajo de la cual se espera que el espacio deje de tener una geometría clásica. Una medida inferior previsiblemente no puede ser tratada adecuadamente en los modelos de física actuales debido a la aparición de efectos de Gravedad Cuántica.

¿Quién puede ir a la longitud de Planck para verla? A distancias comparables con la longitud de Planck, se cree que están sucediendo cosas muy curiosas que rebasan ampliamente los límites de nuestra imaginación. A diferencia de la filosofía reduccionista que propone que lo más complejo está elaborado -axiomáticamente- a partir de lo más elemental, lo que está sucediendo en la escala de Planck no parece tener nada de elemental o sencillo. Se cree que a esta escala la continuidad del espacio-tiempo en vez de ir marchando sincronizadamente al parejo con lo que vemos en el macrocosmos de hecho stá variando a grado tal que a nivel ultra-microscópico el tiempo no sólo avanza o se detiene aleatoriamente sino inclusive marcha hacia atrás, una especie de verdadera máquina del tiempo. Las limitaciones de nuestros conocimientos sobre las rarezas que puedan estar ocurriendo en esta escala en el orden de los 10-35 metros, la longitud de Planck, ha llevado a la proposición de modelos tan imaginativos y tan exóticos como la teoría de la espuma cuántica que supuestamente veríamos aún en la ausencia de materia-energía si fuésemos ampliando sucesivamente una porción del espacio-tiempo plano.

La puerta de las dimensiones más altas quedó abierta y, a los teóricos, se les regaló una herramienta maravillosa. En el Hiperespacio, todo es posible. Hasta el matrimonio de la relatividad general y la mecánica cuántica, allí si es posible encontrar esa soñada teoría de la Gravedad cuántica.

Así que, los teóricos, se han embarcado a la búsqueda de un objetivo audaz: buscan una teoría que describa la simplicidad primigenia que reinaba en el intenso calor del universo en sus primeros tiempos, una teoría carente de parámetros, donde estén presentes todas las respuestas. Todo debe ser contestado a partir de una ecuación básica.

¿Dónde radica el problema?

El problema está en que la única teoría candidata no tiene conexión directa con el mundo de la observación, o no lo tiene todavía si queremos expresarnos con propiedad. La energía necesaria para ello, no la tiene ni el nuevo acelerador de partículas LHC que mencioné en páginas anteriores.

La verdad es que, la teoría que ahora tenemos, el Modelo Estándar, concuerda de manera exacta con todos los datos a bajas energías y contesta cosas sin sentido a altas energías.

¡Necesitamos algo más avanzado!

Cada partícula tiene encomendada una misión

Se ha dicho que la función de la partícula de Higgs es la de dar masa a las demás partículas. Cuando su autor lanzó la idea al mundo, resultó además de nueva muy extraña. El secreto de todo radica en conseguir la simplicidad: el átomo resulto ser complejo lleno de esas infinitesimales partículas electromagnéticas que bautizamos con el nombre de electrones, resultó que tenía un núcleo que contenía, a pesar de ser tan pequeño, casi toda la masa del átomo. El núcleo, tan pequeño, estaba compuesto de otros objetos más pequeños aún, los quarks que estaban instalados en nubes de otras partículas llamadas gluones y, ahora, queremos continuar profundizando, sospechamos, que después de los quarks puede haber algo más.

Bueno, la idea nueva que surgió es que el espacio entero contiene un campo, el campo de Higgs, que impregna el vacío y es el mismo en todas partes. Es decir, que si miramos a las estrellas en una noche clara estamos mirando el campo de Higgs. Las partículas influidas por este campo, toman masa. Esto no es por sí mismo destacable, pues las partículas pueden tomar energía de los campos (gauge) de los que hemos comentado, del campo gravitatorio o del electromagnético. Si llevamos un bloque de plomo a lo alto de la Torre Eiffel, el bloque adquiriría energía potencial a causa de la alteración de su posición en el campo gravitatorio de la Tierra.

Cuando los físicos hablan de la belleza de algunas ecuaciones, se refieren a las que, como ésta, dicen mucho con muy pocos caracteres. De hecho, puede que ésta sea la ecuación más famosa conocida en nuestro mundo.

Como E=mc2, ese aumento de la energía potencial equivale a un aumento de la masa, en este caso la masa del Sistema Tierra-bloque de plomo. Aquí hemos de añadirle amablemente un poco de complejidad a la venerable ecuación de Einstein. La masa, m, tiene en realidad dos partes. Una es la masa en reposo, m0, la que se mide en el laboratorio cuando la partícula está en reposo. La partícula adquiere la otra parte de la masa en virtud de su movimiento (como los protones en el acelerador de partículas, o los muones, que aumentan varias veces su masa cuando son lanzados a velocidades cercanas a c) o en virtud de su energía potencial de campo. Vemos una dinámica similar en los núcleos atómicos. Por ejemplo, si separamos el protón y el neutrón que componen un núcleo de deuterio, la suma de las masas aumenta.

Pero la energía potencial tomada del campo de Higgs difiere en varios aspectos de la acción de los campos familiares. La masa tomada de Higgs es en realidad masa en reposo. De hecho, en la que quizá sea la versión más apasionante de la teoría del campo de Higgs, éste genera toda la masa en reposo. Otra diferencia es que la cantidad de masa que se traga del campo es distinta para las distintas partículas.

Los teóricos dicen que las masas de las partículas de nuestro modelo estándar miden con qué intensidad se acoplan éstas al campo de Higgs.

La influencia de Higgs en las masas de los quarks y de los leptones, nos recuerda el descubrimiento por Pieter Zeeman, en 1.896, de la división de los niveles de energía de un electrón cuando se aplica un campo magnético al átomo. El campo (que representa metafóricamente el papel de Higgs) rompe la simetría del espacio de la que el electrón disfrutaba.

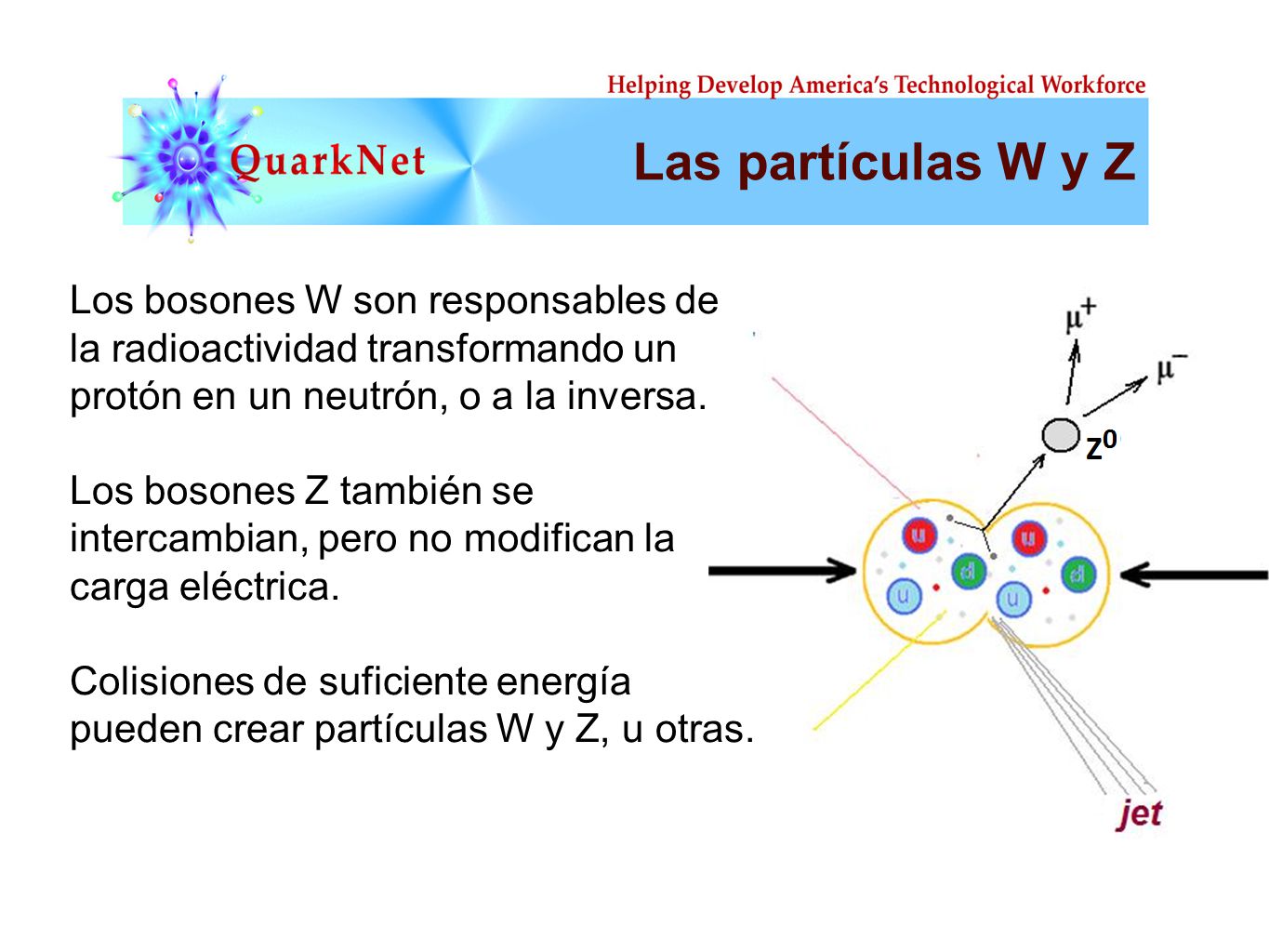

Hasta hace bien poco no teniamos ni idea de que reglas controlan los incrementos de masa generados por el Higgs (de ahí la expectación creada por el nuevo acelerador de partículas LHC cuando la buscaba). Pero el problema es irritante: ¿por qué sólo esas masas -Las masas de los W+, W–, y Zº, y el up, el down, el encanto, el extraño, el top y el bottom, así como los leptones – que no forman ningún patrón obvio?

Las masas van de la del electrón 0’0005 GeV, a la del top, que tiene que ser mayor que 91 GeV. Deberíamos recordar que esta extraña idea (el Higgs) se empleó con mucho éxito para formular la teoría electrodébil (Weinberg-salam). Allí se propuso el campo de Higgs como una forma de ocultar la unidad de las fuerzas electromagnéticas y débiles. En la unidad hay cuatro partículas mensajeras sin masa -los W+, W–, Zº y fotón que llevan la fuerza electrodébil. Además está el campo de Higgs, y, rápidamente, los W y Z chupan la esencia de Higgs y se hacen pesados; el fotón permanece intacto. La fuerza electrodébil se fragmenta en la débil (débil porque los mensajeros son muy gordos) y la electromagnética, cuyas propiedades determina el fotón, carente de masa. La simetría se rompe espontáneamente, dicen los teóricos. Prefiero la descripción según la cual el Higgs oculta la simetría con su poder dador de masa.

Las masas de los W y el Z se predijeron con éxito a partir de los parámetros de la teoría electrodébil. Y las relajadas sonrisas de los físicos teóricos nos recuerdan que Gerard ^t Hooft y Veltman dejaron sentado que la teoría entera esta libre de infinitos.

Pero, encierra tantos misterios la materia que, a veces me hace pensar en que la podríamos denominar de cualuquier manera menos de inerte ¡Parece que la materia está viva!

Son muchas las cosas que desconocemos y, nuestra curiosidad nos empuja continuamente a buscar esas respuestas.

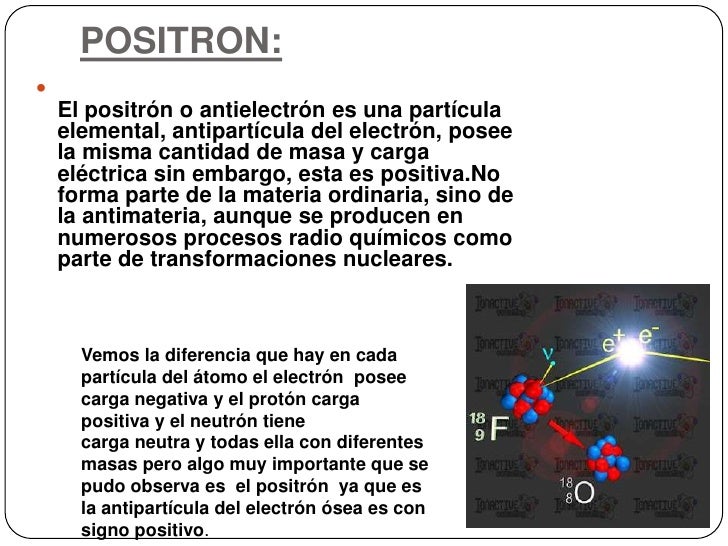

El electrón y el positrón son notables por sus pequeñas masas (sólo 1/1.836 de la del protón, el neutrón, el antiprotón o antineutrón), y, por lo tanto, han sido denominados leptones (de la voz griega lentos, que significa “delgado”).

Aunque el electrón fue descubierto en 1.897 por el físico británico Josepth John Thomson (1856-1940), el problema de su estructura, si la hay, no está resuelto. Conocemos su masa y su carga negativa que responden a 9,1093897 (54) x 10-31 Kg la primera y, 1,602 177 33 (49) x 10-19 culombios, la segunda, y también su radio clásico: r0 = e2/mc2 = 2’82 x 10-13 m. No se ha descubierto aún ninguna partícula que sea menos cursiva que el electrón (o positrón) y que lleve una carga eléctrica, sea lo que fuese (sabemos como actúa y cómo medir sus propiedades, pero aun no sabemos qué es), tenga asociada un mínimo de masa, y que esta es la que se muestra en el electrón.

Lo cierto es que, el electrón, es una maravilla en sí mismo. El Universo no sería como lo conocemos si el electrón (esa cosita “insignificante”), fuese distinto a como es, bastaría un cambio infinitesimal para que, por ejemplo, nosotros no pudiéramos estar aquí ahora.

¡No por pequeño, se es insignificante!

Recordémoslo, todo lo grande está hecho de cosas pequeñas.

En realidad, existen partículas que no tienen en absoluto asociada en ellas ninguna masa (es decir, ninguna masa en reposo). Por ejemplo, las ondas de luz y otras formas de radiación electromagnéticas se comportan como partículas (Einstein en su efecto fotoeléctrico y De Broglie en la difracción de electrones*.

Esta manifestación en forma de partículas de lo que, de ordinario, concebimos como una onda se denomina fotón, de la palabra griega que significa “luz”.

El fotón tiene una masa de 1, una carga eléctrica de o, pero posee un espín de 1, por lo que es un bosón. ¿Cómo se puede definir lo que es el espín? Los fotones toman parte en las reacciones nucleares, pero el espín total de las partículas implicadas antes y después de la reacción deben permanecer inmutadas (conservación del espín). La única forma que esto suceda en las reacciones nucleares que implican a los fotones radica en suponer que el fotón tiene un espín de 1. El fotón no se considera un leptón, puesto que este termino se reserva para la familia formada por el electrón, el muón y la partícula Tau con sus correspondientes neutrinos: Ve, Vu y VT.

Existen razones teóricas para suponer que, cuando las masas se aceleran (como cuando se mueven en órbitas elípticas en torno a otra masa o llevan a cabo un colapso gravitacional), emiten energía en forma de ondas gravitacionales. Esas ondas pueden así mismo poseer aspecto de partícula, por lo que toda partícula gravitacional recibe el nombre de gravitón.

La fuerza gravitatoria es mucho, mucho más débil que la fuerza electromagnética. Un protón y un electrón se atraen gravitacionalmente con sólo 1/1039 de la fuerza en que se atraen electromagnéticamente. El gravitón (aún sin descubrir) debe poseer, correspondientemente, menos energía que el fotón y, por tanto, ha de ser inimaginablemente difícil de detectar.

De todos modos, el físico norteamericano Joseph Weber emprendió en 1.957 la formidable tarea de detectar el gravitón. Llegó a emplear un par de cilindros de aluminio de 153 cm. De longitud y 66 de anchura, suspendidos de un cable en una cámara de vacío. Los gravitones (que serían detectados en forma de ondas), desplazarían levemente esos cilindros, y se empleó un sistema para detectar el desplazamiento que llegare a captar la cienmillonésima parte de un centímetro.

Han llevado años captarlas, las ondas gravitatorias llevadas por el gravitón son débiles

Las débiles ondas de los gravitones, que producen del espacio profundo, deberían chocar contra todo el planeta, y los cilindros separados por grandes distancias se verán afectados de forma simultánea. En 1.969, Weber anunció haber detectado los efectos de las ondas gravitatorias. Aquello produjo una enorme excitación, puesto que apoyaba una teoría particularmente importante (la teoría de Einstein de la relatividad general). Desgraciadamente, nunca se pudo comprobar mediante las pruebas realizadas por otros equipos de científicos que duplicaran el hallazgo de Weber.

De todas formas, no creo que, a estas alturas, nadie pueda dudar de la existencia de los gravitones, el bosón mediador de la fuerza gravitatoria. La masa del gravitón es o, su carga es o, y su espín de 2. Como el fotón, no tiene antipartícula, ellos mismos hacen las dos versiones.

Tenemos que volver a los que posiblemente son los objetos más misteriosos de nuestro Universo: Los agujeros negros. Si estos objetos son lo que se dice (no parece que se pueda objetar nada en contrario), seguramente serán ellos los que, finalmente, nos faciliten las respuestas sobre las ondas gravitacionales y el esquivo gravitón.

La onda gravitacional emitida por el agujero negro produce una ondulación en la curvatura del espacio-temporal que viaja a la velocidad de la luz transportada por los gravitones.