Jul

4

Los secretos de la Naturaleza ¿Los podremos desvelar?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (1)

Comments (1)

El psicólogo Eric Ericsson llegó a proponer una teoría de estadios psicológicos del desarrollo. Un conflicto fundamental caracteriza cada fase. Si este conflicto no queda resuelto, puede enconarse e incluso provocar una regresión a un periodo anterior. Análogamente, el psiicólogo Jean Piaget demostró que el desarrollo mental de la primera infancia tampoco es un desarrollo continuo de aprendizaje, sino que está realmente caracterizado por estadios discontinuos en la capacidad de conceptualización de un niño. En un mes, un niño puede dejar de buscar una pelota una vez que ha rodado fuera de su campo de visión, sin comprender que la pelota existe aunque no la vea. Al mes siguiente, esto resultará obvio para el niño.

Los procesos siguen, las cosas cambian, el Tiempo inexorable transcurre, si hay vida vendrá la muerte, lo que es hoy mañana no será.

Esta es la esencia de la dialéctica. Según esta filosofía, todos los objetos (personas, gases, estrellas, el propio universo) pasan por una serie de estadios. Cada estadio está caracterizado por un conflicto entre dos fuerzas opuestas. La naturaleza de dicho conflicto determina, de hecho, la naturaleza del estadio. Cuando el conflicto se resuelve, el objeto pasa a un objetivo o estadio superior, llamado síntesis, donde empieza una nueva contradicción, y el proceso pasa de nuevo a un nivel superior.

Los filósofos llaman a esto transición de la “cantidad” a la “cualidad”. Pequeños cambios cuantitativos se acumulan hasta que, eventualmente, se produce una ruptura cualitativa con el pasado. Esta teoría se aplica también a las sociedades o culturas. Las tensiones en una sociedad pueden crecer espectacularmente, como la hicieron en Francia a finales del siglo XVIII. Los campesinos se enfrenaban al hambre, se produjeron motines espontáneos y la aristocracia se retiró a sus fortalezas. Cuando las tensiones alcanzaron su punto de ruptura, ocurrió una transición de fase de lo cuantitativo a lo cualitativo: los campesinos tomaron las armas, tomaron París y asaltaron la Bastilla. ¿No pasará aquí lo mismo con los políticos y los ciudadanos? Ellos tienen muchos privilegios a costa de quitarnos derechos a los demás.

Las transiciones de fases pueden ser también asuntos bastante explosivos. Por ejemplo, pensemos en un río que ha sido represado. Tras la presa se rápidamente un embalse con agua a enorme presión. Puesto que es inestable, el embalse está en el falso vacío. El agua preferiría estar en su verdadero vacío, significando esto que preferiría reventar la presa y correr aguas abajo, hacia un estado de menor energía. Así pues, una transición de fase implicaría un estallido de la presa, que tendría consecuencias desastrosas.

También podría poner aquí el ejemplo más explosivo de una bomba atómica, donde el falso vacío corresponde al núcleo inestable de uranio donde residen atrapadas enormes energías explosivas que son un millón de veces más poderosas, para masas iguales, que para un explosivo químico. De vez en cuando, el núcleo pasa por efecto túnel a un estado más bajo, lo que significa que el núcleo se rompe espontáneamente. Esto se denomina desintegración radiactiva. Sin embargo, disparando neutrones contra los núcleos de uranio, es posible liberar de golpe esta energía encerrada según la formula de Einstein E = mc2. Por supuesto, dicha liberación es una explosión atómica; ¡menuda transición de fase! De nefasto recuerdo por cierto.

Las transiciones de fase no son nada nuevo. Traslademosló a nuestras propias vidas. En un libro llamado Pasajes, el autor, Gail Sheehy, destaca que la vida no es un flujo continuo de experiencias, como parece, sino que realmente pasa por varios estadios, caracterizados por conflictos específicos que debemos resolver y por objetivos que debemos cumplir.

Los contornos recubiertos muestran la estructura de la galaxia al ser reconstruida desde las observaciones hechas bajo el fenómeno de lente gravitatorio con el radiotelescopio Submillimeter Array. La formación de nuevas estrellas en el Universo es imparable y, la materia más sencilla se constituye en una estructura que la transformará en más compleja, más activa, más dispuesta para que, la vida, también pueda surgir en mundos ignotos situados muy lejos del nuestro.

Sí, todo cambia y nada permanece: transiciones de fases hacia la complejidad

Las nuevas características descubiertas por los científicos en las transiciones de fases es que normalmente van acompañadas de una ruptura de simetría. Al premio Nobel Abdus Salam le gusta la ilustración siguiente: consideremos una mesa de banquete circular, donde todos los comensales están sentados con una copa de champán a cada lado. Aquí existe simetría. Mirando la mesa del banquete reflejada en un espejo, vemos lo mismo: cada comensal sentado en torno a la mesa, con copas de champán a cada lado. Asimismo, podemos girar la mesa de banquete circular y la disposición sigue siendo la misma.

Rompamos ahora la simetría. Supongamos ahora que el primer comensal toma la copa que hay a su derecha. Siguiendo la pauta, todos los demás comensales tomaran la copa de champán de su derecha. Nótese que la imagen de la mesa del banquete vista en el espejo produce la situación opuesta. Cada comensal ha tomado la copa izquierda. De este modo, la simetría izquierda-derecha se ha roto.

El niño del espejo le da a su “amiguito” reflejado la mano derecha y aquel, le saluda, con la izquierda. ¡La simetría especular…! Así pues, el estado de máxima simetría es con frecuencia también un estado inestable, y por lo tanto corresponde a un falso vacío.

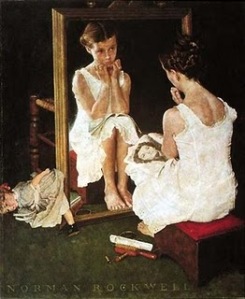

Con respecto a la teoría de supercuerdas, los físicos suponen (aunque todavía no lo puedan demostrar) que el universo decadimensional original era inestable y pasó por efecto túnel a un universo de cuatro y otro de seis dimensiones. Así pues, el universo original estaba en un estado de falso vacío, el estado de máxima simetría, mientras que hoy estamos en el estado roto del verdadero vacío.

Al principio, cuando el universo era simétrico, sólo existía una sola fuerza que unificaba a todas las que ahora conocemos, la gravedad, las fuerzas electromagnéticas y las nucleares débil y fuerte, todas emergían de aquel plasma opaco de alta energía que lo inundaba todo. Más tarde, cuando el universo comenzó a enfriarse, se hizo transparente y apareció la luz, las fuerzas se separaron en las cuatro conocidas, emergieron las primeras quarks para unirse y formar protones y neutrones, los primeros núcleos aparecieron para atraer a los electrones que formaron aquellos primeros átomos. Doscientos millones de años más tarde, se formaron las primeras estrellas y galaxias. Con el paso del tiempo, las estrellas sintetizaron los elementos pesados de nuestros cuerpos, fabricados en supernovas que estallaron, incluso antes de que se formase el Sol. Podemos decir, sin temor a equivocarnos, que una supernova anónima explotó hace miles de millones de años y sembró la nube de gas que dio lugar a nuestro sistema solar, poniendo allí los materiales complejos y necesarios para que algunos miles de millones de años más tarde, tras la evolución, apareciéramos nosotros.

En las estrellas se tiene que producir el proceso triple alfa para que exista el Carbono

Las estrellas evolucionan desde que en su núcleo se comienza a fusionar hidrógeno en helio, de los elementos más ligeros a los más pesados. Avanza creando en el hornotermonuclear, cada vez, metales y elementos más pesados. Cuando llega al hierro y explosiona en la forma explosiva de una supernova. Luego, cuando este material estelar es otra vez recogido en una nueva estrella rica en hidrógeno, al ser de segunda generación (como nuestro Sol), comienza de nuevo el proceso de fusión llevando consigo materiales complejos de aquella supernova.

Puesto que el peso promedio de los protones en los productos de fisión, como el cesio y el kriptón, es menor que el peso promedio de los protones de uranio, el exceso de masa se ha transformado en energía mediante la conocida fórmula E = mc2. Esta es la fuente de energía que también subyace en la bomba atómica. Es decir, convertir materia en energía.

Así pues, la curva de energía de enlace no sólo explica el nacimiento y muerte de las estrellas y la creación de elementos complejos que también hicieron posible que nosotros estemos ahora aquí y, muy posiblemente, será también el factor determinante para que, lejos de aquí, en otros sistemas solares a muchos años luz de distancia, puedan florecer otras especies inteligentes que, al igual que la especie humana, se pregunten por su origen y estudien los fenómenos de las fuerzas fundamentales del universo, los componentes de la materia y, como nosotros, se interesen por el destino que nos espera en el futuro.

Cuando alguien oye por vez primera la historia de la vida de las estrellas, generalmente (lo sé por experiencia), no dice nada, pero su rostro refleja escepticismo. ¿Cómo puedo vivir una estrella 10.000 millones de años? Después de todo, nadie ha vivido tanto tiempo como para ser testigo de su evolución y poder contarlo.

Hay cosas que, cambiando… ¡Nunca cambian! La entropía se encarga de ello

Pero volviendo a las cosas de la Naturaleza y de la larga vida de las estrellas, sí, tenemos los medios técnicos y científicos para saber la edad que tiene, por ejemplo, el Sol. Nuestro Sol, la estrella alrededor de la que giran todos los planetas de nuestro Sistema Solar, la estrella más cercana a la Tierra (150 millones de Km = 1 UA), con un diámetro de 1.392.530 Km, tiene una edad de 4.500 millones de años, y, como todo en el Universo, su discurrir la va desgantando, evoluciona hacia su imparable destino como gigante roja primero y enana blanca después.

Una gigante roja engulle a un planeta cercano

Cuando ese momento llegue, ¿dónde estaremos? Pues nosotros, si es que estamos, contemplaremos el acontecimiento desde otros mundos. La Humanidad habrá dado el gran salto hacia las estrellas y, colonizando otros planetas se habrá extendido por regiones lejanas de la Galaxia.

El Universo siempre nos pareció inmenso, y, al principio, aquellos que empezaron a preguntarse cómo sería, lo imaginaron como una esfera cristalina que dentro contenía unos pocos mundos y algunas estrellas, hoy, hemos llegado a saber un poco más sobre él. Sin embargo, dentro de unos cuantos siglos, los que detrás de nosotros llegaran, hablarán de universos en plural, y, cuando pasen algunos eones, estaremos de visita de un universo a otro como vamos de una ciudad a otra.

¡Quién pudiera estar allí!

¡Es todo tan extraño! ¡Es todo tan complejo! y, sobre todo…¡sabemos tan poco!

Todo lo grande está hecho de cosas pequeñas

Según lo que podemos entender y hasta donde han podido llegar nuestros conocimientos actuales, ahora sabemos donde están las fronteras: donde las masas o las energías superan 1019 veces la masa del protón, y esto implica que estamos mirando a estructuras con un tamaño de 10-33 centímetros.

Esta ecuación nos habla de lo que se conoce como masa de Planck y a la distancia correspondiente la llamamos distancia de Planck. La masa de Planck expresada en gramos es de 22 microgramos, que es la masa de un grano muy pequeño de azúcar (que, por otra parte, es el único número de Planck que parece más o menos razonable, ¡los otros números son totalmente extravagantes!).

Esto significa que tratamos de localizar una partícula con la precisión de una Longitud de Planck, las fluctuaciones cuánticas darán tanta energía que su masa será tan grande como la masa de Planck, y los efectos de la fuerza gravitatoria entre partículas, así, sobrepasarán los de cualquier otra fuerza. Es decir, para estas partículas la gravedad es una interacción fuerte.

Lo cierto es que, esas unidades tan pequeñas, tan lejanas en las distancias más allá de los átomos, son las que marcan nuestros límites, los límites de nuestras teorías actuales que, mientras que no puedan llegar a esas distancias… No podrán avanzar en el conocimiento de la Naturaleza y, tampoco, como es natural, en la teoría de supercuerdas o en poder saber, lo que pasó en el primer momento del supuesto big bang, hasta esos lugares, nunca hemos podido llegar.

emilio silvera

Jul

2

Hablando de Teorías

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (1)

Comments (1)

Como Gauss, Riemann, Hamilton, Euler, Ramanujan y tantos otros antes, y ahora Perelman, pronto aparecerán otros que, seguramente, nos darán las respuestas que aún están pendientes, para que podamos plantear la definitiva teoría decadimensional y tengamos las respuestas a tantas preguntas que no han sido contestadas.

Un día Einstein fue conducido a postular la teoría de la relatividad general partiendo de un principio físico, el principio de equivalencia (que la masa gravitatoria y la masa inerte de un objeto son iguales, de modo que todos los cuerpos, por muy grande que sean, caen en la Tierra a la misma velocidad). Sin embargo, no se ha encontrado todavía la contrapartida del principio de equivalencia para la teoría de cuerdas.

Está claro, como dice Witten, que la teoría de cuerdas proporciona, de hecho, un marco lógicamente consistente que engloba la gravedad y la mecánica cuántica, pero el principio análogo al de equivalencia que Einstein encontró para su teoría no ha sido aún encontrado para la teoría de cuerdas.

¿Tendremos que esperar (como para la solución de la conjetura de Poincaré) cien años para resolver la teoría de supercuerdas?

¡Quién sabe! El problema es muy complejo y encierra muchas cuestiones teóricas que, experimentalmente, no estamos capacitados ni tenemos los medios para poder comprobar.

Perelman, un extraño personaje ruso que, desveló el misterio de la Conjetura de Poincaré después de 100 años, y, no acudió a recoger ni la Medalla Field ni el Premio de un millón de dolores. Vive en un pueblecito de Rusia con su madre, en un piso de 60 metros cuadrados y, sale al campo con un canasto y un pincho para buscar setas. Él dice que el mundo no comprende lo que hace.

No debemos desanimarnos, el sino de la humanidad, a lo largo de toda su historia, siempre ha sido una constante de ir salvando obstáculos que cuando se presentaban parecían insalvables.

Ahora nuestra esperanza media de vida ronda los 80 años y el tiempo que tenemos por delante (me refiero al tiempo del universo) es muy largo. ¿Qué no seremos capaces de conseguir?

Basta repasar los logros de los últimos 150 años en las distintas ramas del saber humano para asombrarnos de la enorme capacidad de trabajo, sacrificio, inventiva e ingenio de nuestra especie que, sobre todo, tiene ¡¡curiosidad!!

Espero que sigamos así, con esta curiosidad inanta que nos empuja a saber.

Hay seres humanos que, desgraciadamente, por su lugar de nacimiento, su entorno, sus genes, e incluso en muchas ocasiones porque así les interesa a quienes les explotan, se pasan la vida sin tener el más elemental conocimiento de las cuestiones importantes del mundo en el que habitan, de las fuerzas de la naturaleza que rigen en el universo del que, cual mota de polvo, forman parte.

Su ignorancia es su felicidad. Trabajan, comen y duermen, como auténticos animales, sin gozar de esos momentos inigualables en los que, en posesión del conocimiento de las cosas, de las leyes de la naturaleza, sentimos con fuerza la conciencia de “SER”, ese pensamiento que nos lleva a un nivel superior, un nivel inmaterial y sublime al que hemos llamado alma y que en realidad es el don de la sabiduría, el saber buscar y encontrar el por qué de las cosas.

Desde que atemorizados mirábamos, en la tormenta, caer los rayos del cielo, oíamos los truenos que seguían a los relámpagos y, hacinados en una cueva oscura y húmeda nos resguardábamos del frío y de los peligros de la noche, desde entonces digo, muchas cosas han cambiado para nosotros.

Será mejor que no perdamos el interés por saber…

¿Qué es…?

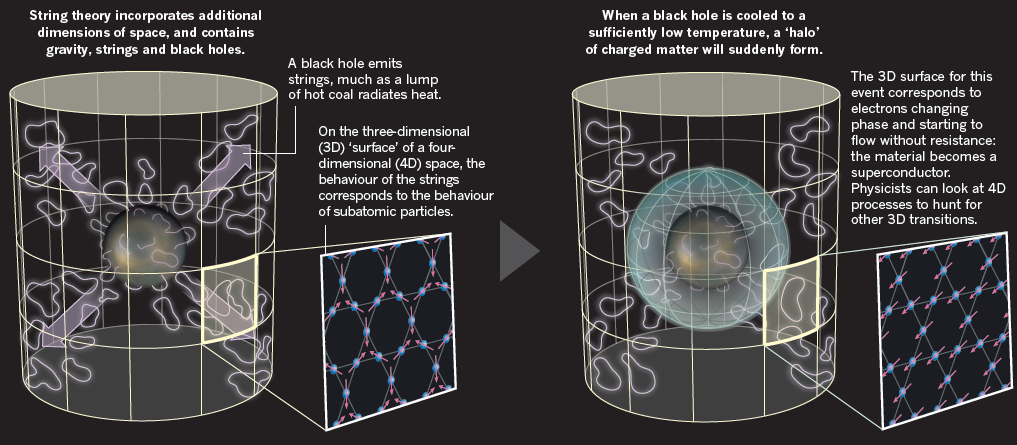

La geometría del Universo está determinada por los cuerpos que ocupan el Espacio-Tiempo

Curvatura del espacio-tiempo, relatividad, relatividad especial, relatividad general, teoría cuántica, partícula elemental y partícula virtual, densidad crítica y densidad media de materia, estrella de neutrones, agujero negro, el Big Bang, el Big Crunch, el universo plano, abierto o cerrado, la materia oscura; y, en fin, mil preguntas más que la mayoría de la gente no se las han planteado nunca y si oyeron hablar de ellas no saben a qué se refieren.

Así que en el presente comentario (como es mi costumbre), vamos a explicar una serie de cosas que ocurren y están aquí con nosotros en el universo, e incluso forman parte de nosotros mismos o hace posible que nosotros podamos estar aquí.

¿Qué haríamos, por ejemplo, sin la gravedad que nos mantiene bien unidos a la superficie del planeta? Lo que vemos en la imagen… ¡Saldríamos flotando!

¿Por qué la velocidad de la luz es el límite que impone el universo a la materia para moverse?

El comienzo de este trabajo, la primera media página, está lleno de preguntas y podríamos llenar toda la libreta preguntando algunas de las cosas que no sabemos.

Fue Popper el que dijo:

“Cuánto más sé y más profundizo en el conocimiento de las cosas, más consciente soy de lo poco que sé. Mi conocimiento es limitado, mi ignorancia…, infinita.”

Procuremos reducir esa ignorancia, al menos para que no sea infinita con el conocimiento de algunas cuestiones. Empezaré por explicar lo que se entiende por…

Curvatura del Espacio-Tiempo

El Espacio se curva en presencia de grandes masas y, el Tiempo, se distorsiona

Hay que entender que el espacio-tiempo es la descripción en cuatro dimensiones del universo en la que la posición de un objeto se especifica por tres coordenadas en el espacio y una en el tiempo.

De acuerdo con la relatividad especial, no existe un tiempo absoluto que pueda ser medido con independencia del observador, de manera que eventos simultáneos para un observador ocurren en instantes diferentes vistos desde otro lugar. El tiempo puede ser medido, por tanto, de manera relativa, como lo son las posiciones en el espacio (Euclides) tridimensional, y esto puede conseguirse mediante el concepto de espacio-tiempo. La trayectoria de un objeto en el espacio-tiempo se denomina por el nombre de línea de universo. La relatividad general nos explica lo que es un espacio-tiempo curvo con las posiciones y movimientos de las partículas de materia.

La curvatura del espacio-tiempo es la propiedad del espacio-tiempo en la que las leyes familiares de la geometría no son aplicables en regiones donde los campos gravitatorios son intensos. La relatividad general de Einstein, nos explica y demuestra que el espacio-tiempo está íntimamente relacionado con la distribución de materia en el universo, y nos dice que el espacio se curva en presencia de masas considerables como planetas, estrellas o galaxias (entre otros).

En un espacio de sólo dos dimensiones, como una lámina de goma plana, la geometría de Euclides se aplica de manera que la suma de los ángulos internos de un triángulo en la lámina es de 180°. Si colocamos un objeto masivo sobre la lámina de goma, la lámina se distorsionará y los caminos de los objetos que se muevan sobre ella se curvaran. Esto es, en esencia, lo que ocurre en relatividad general.

En los modelos cosmológicos más sencillos basados en los modelos de Friedmann, la curvatura de espacio-tiempo está relacionada simplemente con la densidad media de la materia, y se describe por una función matemática denominada métrica de Robertson-Walker. Si un universo tiene una densidad mayor que la densidad crítica, se dice que tiene curvatura positiva, queriendo decir que el espacio-tiempo está curvado sobre sí mismo, como la superficie de una esfera; la suma de los ángulos de un triángulo que se dibuje sobre la esfera es entonces mayor que 180°. Dicho universo sería infinito y se expandiría para siempre, es el universo abierto. Un universo de Einstein-de Sitter tiene densidad crítica exacta y es, por consiguiente, espacialmente plano (euclideo) infinito en el espacio y en el tiempo.

Hay otros modelos de universos que son distintos, sin embargo, como en realidad no podemos saber en el universo que nos encontramos hasta que no tengamos la certeza de la Densidad de la Materia que el universo contiene, lo dejaré aquí por hoy.

emilio silvera.

Jul

2

El “universo” de las partículas I

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

¿Qué no será capaz de inventar el hombre para descubrir los misterios de la naturaleza?

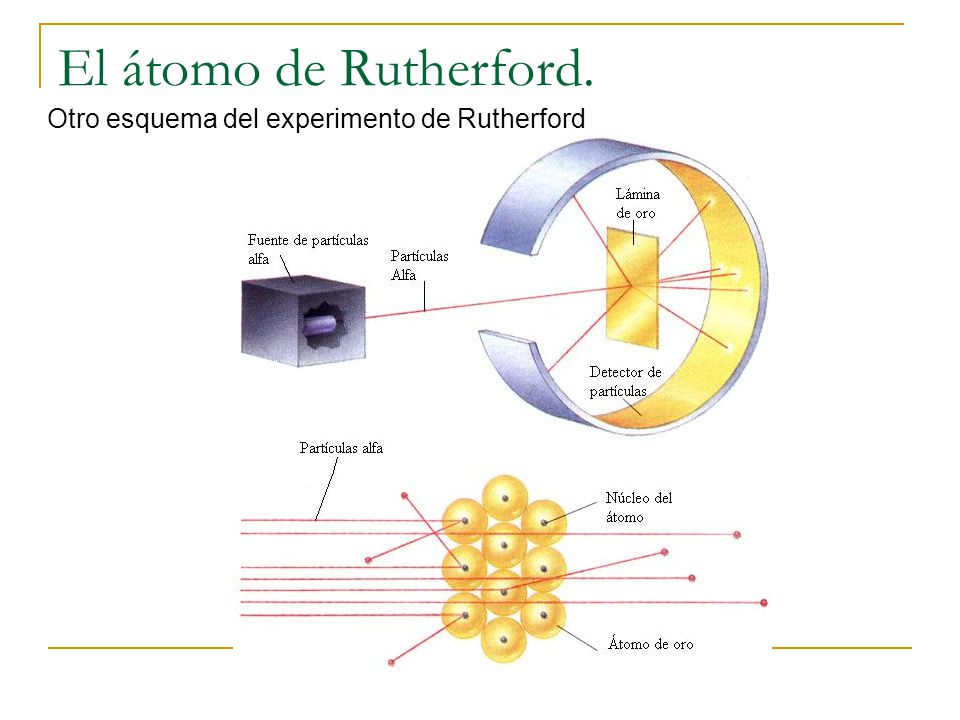

Ha pasado mucho tiempo desde que Rutherford identificara la primera partícula nuclear (la partícula alfa). El camino ha sido largo y muy duro, con muchos intentos fallidos antes de ir consiguiendo los triunfos (los únicos que suenan), y muchos han sido los nombres que contribuyen para conseguir llegar al conocimiento que actualmente tenemos del átomo y del núcleo; los electrones circulando alrededor del núcleo, en sus diferentes niveles, con un núcleo compuesto de protones y neutrones que, a su vez, son constituidos por los quarks allí confinados por los gluones, las partículas mediadoras de la fuerza nuclear fuerte. Pero, ¿qué habrá más allá de los quarks?, ¿las supercuerdas vibrantes? Algún día se sabrá.

Partículas

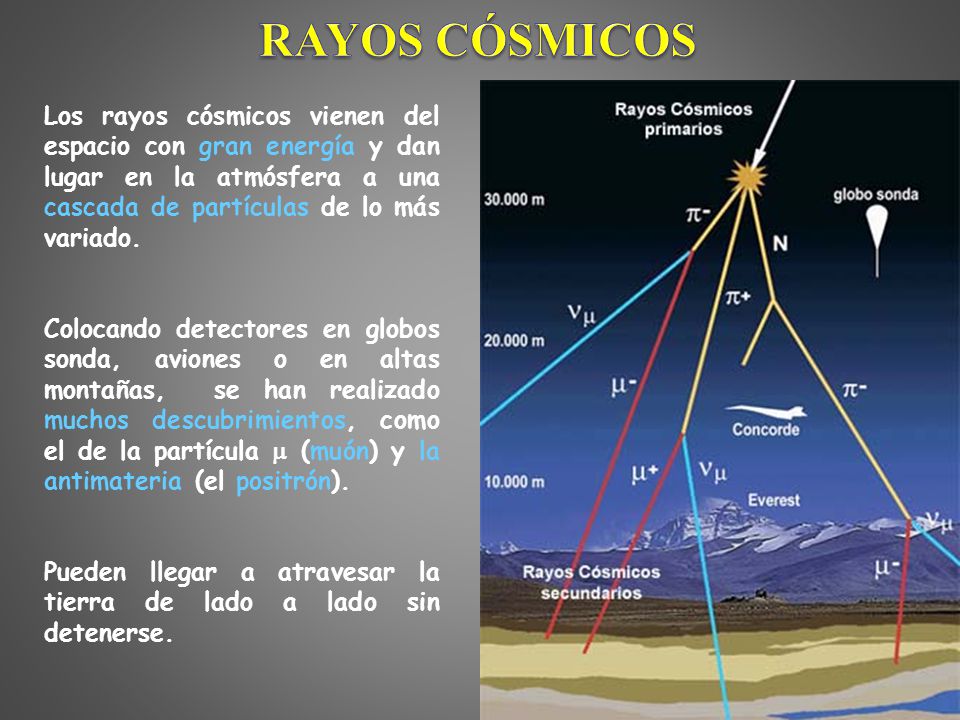

El universo de las partículas es fascinante. Cuando las partículas primarias chocan con átomos y moléculas en el aire, aplastan sus núcleos y producen toda clase de partículas secundarias. En esta radiación secundaria (aún muy energética) la que detectamos cerca de la Tierra, por los globos enviados a la atmósfera superior, han registrado la radiación primaria.

El físico estadounidense Robert Andrews Millikan, que recogió una gran cantidad de información acerca de esta radiación (y que le dio el nombre de rayos cósmicos), decidió que debería haber una clase de radiación electromagnética. Su poder de penetración era tal que, parte del mismo, atravesaba muchos centímetros de plomo. Para Millikan, esto sugería que la radiación se parecía a la de los penetrantes rayos gamma, pero con una longitud de onda más corta.

Otros, sobre todo el físico norteamericano Holly Compton, no estaban de acuerdo en que los rayos cósmicos fuesen partículas. Había un medio para investigar este asunto; si se trataba de partículas cargadas, deberían ser rechazadas por el campo magnético de la Tierra al aproximarse a nuestro planeta desde el espacio exterior. Compton estudió las mediciones de la radiación cósmica en varias latitudes y descubrió que en realidad se curvaban con el campo magnético: era más débil cera del ecuador magnético y más fuerte cerca de los polos, donde las líneas de fuerza magnética se hundían más en la Tierra.

Las partículas cósmicas primarias, cuando entran en nuestra atmósfera, llevan consigo unas energías fantásticas, muy elevadas. En general, cuanto más pesado es el núcleo, más raro resulta entre las partículas cósmicas. Núcleos tan complejos como los que forman los átomos de hierro se detectaron con rapidez; en 1.968, otros núcleos como el del uranio. Los núcleos de uranio constituyen sólo una partícula entre 10 millones. También se incluirán aquí electrones de muy elevada energía.

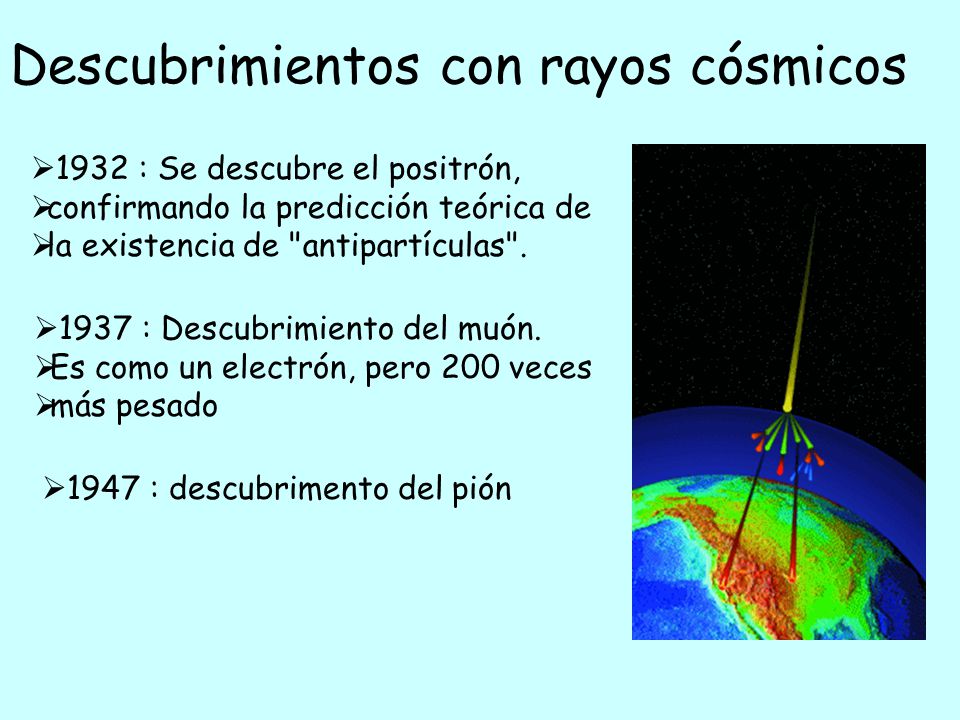

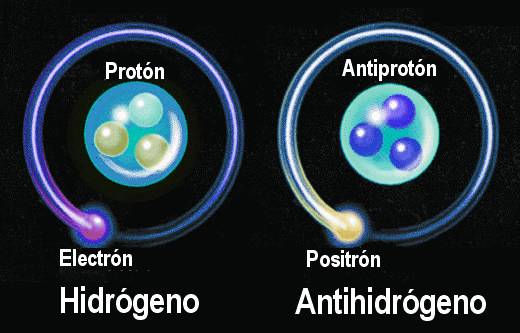

Ahora bien, la siguiente partícula inédita (después del neutrón) se descubrió en los rayos cósmicos. A decir verdad, cierto físico teórico había predicho ya este descubrimiento. Paul Adrien Dirac había aducido, fundándose en un análisis matemático de las propiedades inherentes a las partículas subatómicas, que cada partícula debería tener su antipartícula (los científicos desean no sólo que la naturaleza sea simple, sino también simétrica). Así pues, debería haber un antielectrón, salvo por su carga que sería positiva y no negativa, idéntico al electrón; y un antiprotón, con carga negativa en vez de positiva.

En 1.930, cuando Dirac expuso su teoría, no llamó demasiado la atención en el mundo de la ciencia. Pero, fiel a la cita, dos años después apareció el antielectrón. Por entonces, el físico americano Carl David Anderson trabajaba con Millikan en un intento por averiguar si los rayos cósmicos eran radiación electromagnética o partículas. Por aquellas fechas, casi todo el mundo estaba dispuesto a aceptar las pruebas presentadas por Compton, según las cuales, se trataría de partículas cargadas; pero Millikan no acababa de darse por satisfecho con tal solución.

Anderson se propuso averiguar si los rayos cósmicos que penetraban en una cámara de ionización se curvaban bajo la acción de un potente campo magnético. Al objeto de frenar dichos rayos lo suficiente como para detectar la curvatura, si la había, puso en la cámara una barrera de plomo de 6’35 mm de espesor. Descubrió que, cuando cruzaba el plomo, la radiación cósmica trazaba una estela curva a través de la cámara; y descubrió algo más. A su paso por el plomo, los rayos cósmicos energéticos arrancaban partículas de los átomos de plomo. Una de esas partículas dejó una estela similar a la del electrón. ¡Allí estaba, pues, el antielectrón de Dirac! Anderson le dio el nombre de positrón. Tenemos aquí un ejemplo de radiación secundaria producida por rayos cósmicos. Pero aún había más, pues en 1.963 se descubrió que los positrones figuraban también entre las radiaciones primarias.

Abandonado a sus propios medios, el positrón es tan estable como el electrón (¿y por qué no habría de serlo si el idéntico al electrón, excepto en su carga eléctrica?). Además, su existencia puede ser indefinida. Ahora bien, en realidad no queda abandonado nunca a sus propios medios, ya que se mueve en un universo repleto de electrones. Apenas inicia su veloz carrera (cuya duración ronda la millonésima de segundo), se encuentra ya con uno.

Así, durante un momento relampagueante quedaron asociados el electrón y el positrón; ambas partículas girarán en torno a un centro de fuerza común. En 1.945, el físico americano Arthur Edwed Ruark sugirió que se diera el nombre de positronio a este sistema de dos partículas, y en 1.951, el físico americano de origen austriaco Martin Deutsch consiguió detectarlo guiándose por los rayos gamma característicos del conjunto.

Pero no nos confundamos, aunque se forme un sistema positronio, su existencia durará, como máximo, una diezmillonésima de segundo. El encuentro del electrón-positrón provoca un aniquilamiento mutuo; sólo queda energía en forma de radiación gamma. Ocurre pues, tal como había sugerido Einstein: la materia puede convertirse en energía y viceversa. Por cierto, que Anderson consiguió detectar muy pronto el fenómeno inverso: desaparición súbita de rayos gamma para dar origen a una pareja electrón-positrón. Este fenómeno se llama producción en pareja. Anderson compartió con Hess el premio Nobel de Física de 1.936.

Poco después, los Joliot-Curie detectaron el positrón por otros medios, y al hacerlo así realizaron, de paso, un importante descubrimiento. Al bombardear los átomos de aluminio con partículas alfa, descubrieron que con tal sistema no sólo se obtenían protones, sino también positrones. Cuando suspendieron el bombardeo, el aluminio siguió emitiendo positrones, emisión que sólo con el tiempo se debilitó. Aparentemente habían creado, sin proponérselo, una nueva sustancia radiactiva. He aquí la interpretación de lo ocurrido según los Joliot-Curie: cuando un núcleo de aluminio absorbe una partícula alfa, la adición de los dos protones transforma el aluminio (número atómico 13) en fósforo (número atómico 15). Puesto que las partículas alfa contienen cuatro nucleones en total, el número masivo se eleva 4 unidades, es decir, del aluminio 27 al fósforo 31. Ahora bien, si al reaccionar se expulsa un protón de ese núcleo, la reducción en una unidad de sus números atómicos y masivos hará surgir otro elemento, o sea, el silicio 30.

Puesto que la partícula alfa es el núcleo del helio, y un protón es el núcleo del hidrógeno, podemos escribir la siguiente ecuación de esta reacción nuclear:

aluminio 27 + helio 4 = silicio 30 + hidrógeno 1

Nótese que los números másicos se equilibran:

27 + 4 = 30 + 1

Adentrarse en el universo de las partículas que componen los elementos de la tabla periódica, y en definitiva, la materia conocida, es verdaderamente fantástico.

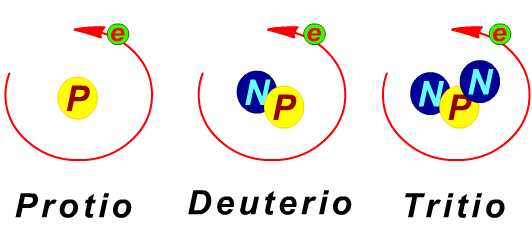

Tan pronto como los Joliot-Curie crearon el primer isótopo radiactivo artificial, los físicos se lanzaron en tropel a producir tribus enteras de ellas. En realidad, las variedades radiactivas de cada elemento en la tabla periódica son producto de laboratorio. En la moderna tabla periódica, cada elemento es una familia con miembros estables e inestables, algunos procedentes de la naturaleza, otros sólo del laboratorio. Por ejemplo, el hidrógeno presenta tres variedades: en primer lugar, el corriente, que tienen un solo protón. En 1.932, el químico Harold Urey logró aislar el segundo. Lo consiguió sometiendo a lenta evaporación una gran cantidad de agua, de acuerdo con la teoría de que los residuos representarían una concentración de la forma más pesada del hidrógeno que se conocía, y, en efecto, cuando se examinaron al espectroscopio las últimas gotas de agua no evaporadas, se descubrió en el espectro una leve línea cuya posición matemática revelaba la presencia de hidrógeno pesado.

El núcleo de hidrógeno pesado está constituido por un protón y un neutrón. Como tiene un número másico de 2, el isótopo es hidrógeno. Urey llamó a este átomo deuterio (de la voz griega deutoros, “segundo”), y el núcleo deuterón. Una molécula de agua que contenga deuterio se denomina agua pesada, que tiene puntos de ebullición y congelación superiores al agua ordinaria, ya que la masa del deuterio es dos veces mayor que la del hidrógeno corriente. Mientras que ésta hierve a 100º C y se congela a 0º C, el agua pesada hierve a 101’42º C y se congela a 3’79º C. El punto de ebullición del deuterio es de -23’7º K, frente a los 20’4º K del hidrógeno corriente. El deuterio se presenta en la naturaleza en la proporción de una parte por cada 6.000 partes de hidrógeno corriente. En 1.934 se otorgó a Urey el premio Nobel de Química por su descubrimiento del deuterio.

El deuterio resultó ser una partícula muy valiosa para bombardear los núcleos. En 1.934, el físico australiano Marcus Lawrence Edwin Oliphant y el austriaco P. Harteck atacaron el deuterio con deuterones y produjeron una tercera forma de hidrógeno, constituido por un protón y dos neutrones. La reacción se planteó así:

hidrógeno 2 + hidrógeno 2 = hidrógeno 3 + hidrógeno 1

Este nuevo hidrógeno superpesado se denominó tritio (del griego tritos, “tercero”); su ebullición a 25º K y su fusión a 20’5º K.

Como es mi costumbre, me desvío del tema y sin poderlo evitar, mis ideas (que parecen tener vida propia), cogen los caminos más diversos. Basta con que se cruce en el camino del trabajo que realizo un fugaz recuerdo; lo sigo y me lleva a destinos distintos de los que me propuse al comenzar. Así, en este caso, me pasé a la química, que también me gusta mucho y está directamente relacionada con la física; de hecho son hermanas: la madre, las matemáticas, la única que finalmente lo podrá explicar todo.

emilio silvera

Jul

2

El “universo” de las Partículas II

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

Estamos hablando de las partículas y no podemos dejar a un lado el tema del movimiento rotatorio de las mismas. Usualmente se ve cómo la partícula gira sobre su eje, a semejanza de un trompo, o como la Tierra o el Sol, o nuestra galaxia o, si se me permite decirlo, como el propio universo. En 1.925, los físicos holandeses George Eugene Uhlenbeck y Samuel Abraham Goudsmit aludieron por primera vez a esa rotación de las partículas. Éstas, al girar, generan un minúsculo campo electromagnético; tales campos han sido objeto de medidas y exploraciones, principalmente por parte del físico alemán Otto Stern y el físico norteamericano Isaac Rabi, quienes recibieron los premios Nobel de Física en 1.943 y 1.944 respectivamente, por sus trabajos sobre dicho fenómeno.

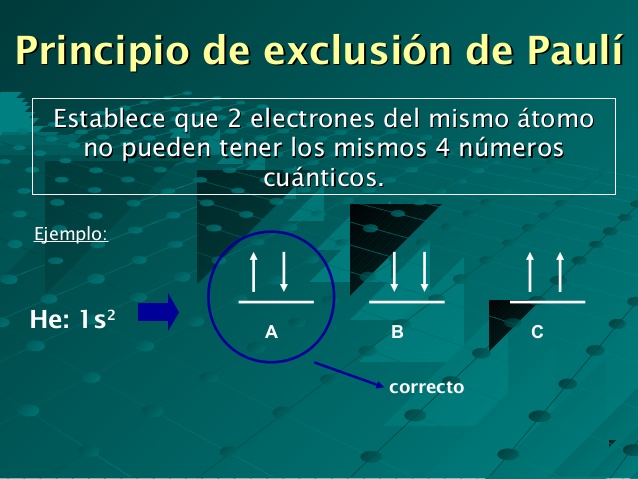

Esas partículas (al igual que el protón, el neutrón y el electrón), que poseen espines que pueden medirse en números mitad, se consideran según un sistema de reglas elaboradas independientemente, en 1.926, por Fermi y Dirac; por ello, se las llama y conoce como estadísticas Fermi-dirac. Las partículas que obedecen a las mismas se denominan fermiones, por lo cual el protón, el electrón y el neutrón son todos fermiones.

Hay también partículas cuya rotación, al duplicarse, resulta igual a un número par. Para manipular sus energías hay otra serie de reglas, ideadas por Einstein y el físico indio S. N. Bose. Las partículas que se adaptan a la estadística Bose-Einstein son bosones, como por ejemplo la partícula alfa.

Las reglas de la mecánica cuántica tienen que ser aplicadas si queremos describir estadísticamente un sistema de partículas que obedece a reglas de esta teoría en vez de los de la mecánica clásica. En estadística cuántica, los estados de energía se considera que están cuantizados. La estadística de Bose-Einstein se aplica si cualquier número de partículas puede ocupar un estado cuántico dad. Dichas partículas (como dije antes) son bosones, que tienden a juntarse.

Los bosones tienen un momento angular nh/2π, donde n es 0 o un entero, y h es la constante de Planck. Para bosones idénticos, la función de ondas es siempre simétrica. Si sólo una partícula puede ocupar un estado cuántico, tenemos que aplicar la estadística Fermi-Dirac y las partículas (como también antes dije) son los fermiones que tienen momento angular (n + ½)h / 2π y cualquier función de ondas de fermiones idénticos es siempre antisimétrica. La relación entre el espín y la estadística de las partículas está demostrada por el teorema espín-estadística.

En un espacio de dos dimensiones es posible que haya partículas (o cuasipartículas) con estadística intermedia entre bosones y fermiones. Estas partículas se conocen con el nombre de aniones; para aniones idénticos, la función de ondas no es simétrica (un cambio de fase de +1) o antisimétrica (un cambio de fase de -1), sino que interpola continuamente entre +1 y -1. Los aniones pueden ser importantes en el análisis del efecto Hall cuántico fraccional y han sido sugeridos como un mecanismo para la superconductividad de alta temperatura.

Debido al principio de exclusión de Pauli, es imposible que dos fermiones ocupen el mismo estado cuántico (al contrario de lo que ocurre con los bosones). La condensación Bose-Einstein es de importancia fundamental para explicar el fenómeno de la superfluidez. A temperaturas muy bajas (del orden de 2×10-7K) se puede formar un condensado de Bose-Einstein, en el que varios miles de átomos dorman una única entidad (un superátomo). Este efecto ha sido observado con átomos de rubidio y litio. Como ha habréis podido suponer, la condensación Bose-Einstein es llamada así en honor al físico Satyendra Nath Bose (1.894 – 1.974) y a Albert Einstein. Así que, el principio de exclusión de Pauli tiene aplicación no sólo a los electrones, sino también a los fermiones; pero no a los bosones.

Si nos fijamos en todo lo que estamos hablando aquí, es fácil comprender cómo forma un campo magnético la partícula cargada que gira, pero ya no resulta tan fácil saber por qué ha de hacer lo mismo un neutrón descargado. Lo cierto es que cuando un rayo de neutrones incide sobre un hierro magnetizado, no se comporta de la misma forma que lo haría si el hierro no estuviese magnetizado. El magnetismo del neutrón sigue siendo un misterio; los físicos sospechan que contiene cargas positivas y negativas equivalente a cero, aunque por alguna razón desconocida, logran crear un campo magnético cuando gira la partícula.

Particularmente creo que, si el neutrón tiene masa, si la masa es energía (E = mc2), y si la energía es electricidad y magnetismo (según Maxwell), el magnetismo del neutrón no es tan extraño, sino que es un aspecto de lo que en realidad es materia. La materia es la luz, la energía, el magnetismo, en definitiva, la fuerza que reina en el universo y que está presente de una u otra forma en todas partes (aunque no podamos verla).

Sea como fuere, la rotación del neutrón nos da la respuesta a esas preguntas:

¿Qué es el antineutrón? Pues, simplemente, un neutrón cuyo movimiento rotatorio se ha invertido; su polo sur magnético, por decirlo así, está arriba y no abajo. En realidad, el protón y el antiprotón, el electrón y el positrón, muestran exactamente el mismo fenómeno de los polos invertidos.

Es indudable que las antipartículas pueden combinarse para formar la antimateria, de la misma forma que las partículas corrientes forman la materia ordinaria.

La primera demostración efectiva de antimateria se tuvo en Brookhaven en 1.965, donde fue bombardeado un blanco de berilio con 7 protones BeV y se produjeron combinaciones de antiprotones y antineutrones, o sea, un antideuterón. Desde entonces se ha producido el antihelio 3, y no cabe duda de que se podría crear otros antinúcleos más complicados aún si se abordara el problema con más interés.

Pero, ¿existe en realidad la antimateria? ¿Hay masas de antimateria en el universo? Si las hubiera, no revelarían su presencia a cierta distancia. Sus efectos gravitatorios y la luz que produjeran serían idénticos a los de la materia corriente. Sin embargo, cuando se encontrasen las masas de las distintas materias, deberían ser claramente perceptibles las reacciones masivas del aniquilamiento mutuo resultante del encuentro. Así pues, los astrónomos observan especulativamente las galaxias, para tratar de encontrar alguna actividad inusual que delate interacciones materia-antimateria.

No parece que dichas observaciones fuesen un éxito. ¿Es posible que el universo esté formado casi enteramente por materia, con muy poca o ninguna antimateria? Y si es así, ¿por qué? Dado que la materia y la antimateria son equivalente en todos los aspectos, excepto en su oposición electromagnética, cualquier fuerza que crease una originaría la otra, y el universo debería estar compuesto de iguales cantidades de la una y de la otra.

Aquí detectaron lograron encontrar la anti-materia por primera vez

Este es el dilema. La teoría nos dice que debería haber allí antimateria, pero las observaciones lo niegan, no lo respaldan. ¿Es la observación la que falla? ¿Y qué ocurre con los núcleos de las galaxias activas, e incluso más aún, con los quásares? ¿Deberían ser estos fenómenos energéticos el resultado de una aniquilación materia-antimateria? ¡No creo! Ni siquiera ese aniquilamiento parece ser suficiente, y los astrónomos prefieren aceptar la noción de colapso gravitatorio y fenómenos de agujeros negros, como el único mecanismo conocido para producir la energía requerida.

Con esto de la antimateria me ocurre igual que con el hecho, algunas veces planteado, de la composición de la materia en lugares lejanos del universo. “Ha caído una nave extraterrestre y nuestros científicos han comprobado que está hecha de un material desconocido, casi indestructible”. Este comentario se ha podido oír en alguna película de ciencia ficción. Podría ser verdad (un material desconocido), sin embargo, no porque la nave esté construida por una materia distinta, sino porque la aleación es distinta y más avanzada a partir de los materiales conocidos del universo. En cualquier parte del universo, por muy lejana que pueda estar, rigen los mismos principios y las mismas fuerzas: la materia y la energía son las mismas en cualquier parte. Lo único que puede diferir es la forma en que se utilice, el tratamiento que se le pueda dar, y sobre todo, el poseer el conocimiento y la tecnología necesarios para poder obtener el máximo resultado de las propiedades que dicha materia encierra, porque, en última instancia, ¿es en verdad inerte la materia?

Todo lo que podemos ver en el Universo, sin excepción, está hecho de materia

Tiene y encierra tantos misterios la materia que estamos aún a años luz de saber y conocer sobre su verdadera naturaleza. Nos podríamos preguntar miles de cosas que no sabríamos contestar. Nos maravillan y asombran fenómenos naturales que ocurren ante nuestros ojos, pero que tampoco sabemos, en realidad, a qué son debidas. Sí, sabemos ponerles etiquetas como la fuerza nuclear débil, la fisión espontánea que tiene lugar en algunos elementos como el protactinio o el torio, y con mayor frecuencia, en los elementos que conocemos como transuránidos.

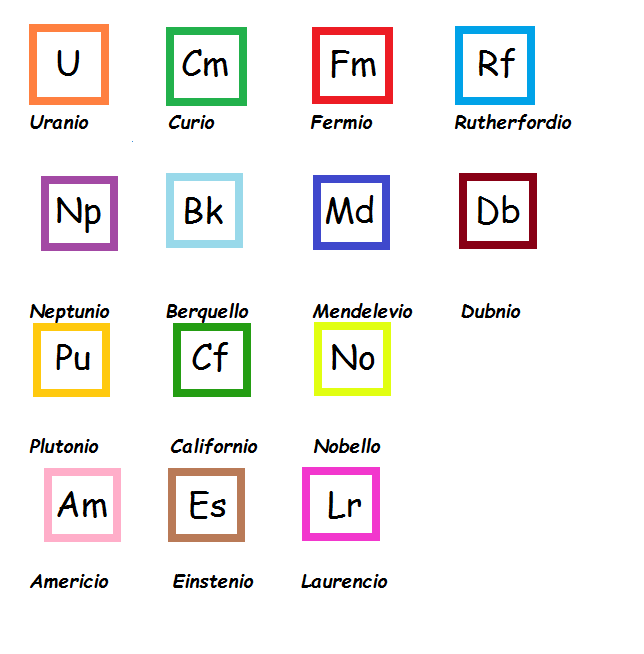

A medida que los núcleos se hacen más grandes, la probabilidad de una fisión espontánea aumenta. En los elementos más pesados de todos (einstenio, fermio y mendelevio), esto se convierte en el método más importante de su ruptura, sobrepasando a la emisión de partículas alfa. ¡Parece que la materia está viva! Son muchas las cosas que desconocemos, y nuestra curiosidad nos empuja continuamente a buscar esas respuestas.

El electrón y el positrón son notables por sus pequeñas masas (sólo 1/1.836 de la del protón, el neutrón, el antiprotón o el antineutrón), y por lo tanto, han sido denominados leptones (de la voz griega leptos, que dignifica “delgado”).

Aunque el electrón fue descubierto en 1.897 por el físico británico Joseph John Thomson (1.856 – 1.940), el problema de su estructura, si la hay, aún no está resuelto. Conocemos su masa y su carga negativa que responden a 9’1093897 (54) × 10-31 Kg la primera, y 1’60217733 (49) × 10-19 culombios la segunda, y también su radio clásico r0 igual a e2/(mc2) = 2’82 × 10-13 cm. No se ha descubierto aún ninguna partícula que sea menos masiva que el electrón (o positrón) y que lleve una carga eléctrica, sea la que fuese (sabemos cómo actúa y cómo medir sus propiedades, pero aún no sabemos qué es), que tenga asociada un mínimo de masa.

Lo cierto es que el electrón es una maravilla en sí mismo. El universo no sería como lo conocemos si el electrón fuese distinto a como es; bastaría un cambio infinitesimal para que, por ejemplo, nosotros no pudiéramos estar aquí ahora.

Muchos granos de arena conforman la inmensa playa

¡No por pequeño se el insignificante!

Recordémoslo, todo lo grande está hecho de cosas pequeñas. En realidad, existen partículas que no tiene asociada ninguna masa en absoluto, es decir, ninguna masa en reposo. Por ejemplo, las ondas de luz y otras formas de radiación electromagnética se comportan como partículas (Einstein en su efecto fotoeléctrico y De Broglie en la difracción de electrones*). Esta manifestación en forma de partículas de lo que, de ordinario, concebimos como una onda, se denomina fotón, de la palabra griega que significa “luz”.

El fotón tiene una masa de 1, una carga eléctrica de 0, pero posee un espín de 1, por lo que es un bosón. ¿Cómo se puede definir lo que es el espín? Los fotones toman parte en las reacciones nucleares, pero el espín total de las partículas implicadas antes y después de la reacción deben permanecer inmutadas (conservación del espín). La única forma de que esto suceda en las reacciones nucleares que implican a los fotones radica en suponer que el fotón tiene un espín de 1. El fotón no se considera un leptón, puesto que este término se reserva para la familia formada por el electrón, el muón y la partícula tau, con sus correspondiente neutrinos: υe, υμ y υτ.

Existen razones teóricas para suponer que cuando las masas se aceleran (como cuando se mueven en órbitas elípticas en torno a otra masa o llevan a cabo un colapso gravitacional), emiten energía en forma de ondas gravitaciones. Esas ondas pueden, así mismo, poseer aspecto de partícula, por lo que toda partícula gravitacional recibe el nombre de gravitón.

La forma gravitatoria es mucho, mucho más débil que la fuerza electromagnética. Un protón y un electrón se atraen gravitacionalmente con sólo 1/1039 de la fuerza en que se atraen electromagnéticamente. El gravitón (aún sin descubrir) debe poseer, correspondientemente, menos energía que el fotón, y por tanto, ha de ser inimaginablemente difícil de detectar.

No será fácil detectar gravitones

De todos modos, el físico norteamericano Joseph Weber emprendió en 1.957 la formidable tarea de detectar el gravitón. Llegó a emplear un par de cilindros de aluminio de 153 cm de longitud y 66 de anchura, suspendidos de un cable en una cámara de vacío. Los gravitones (que serían detectados en forma de ondas) desplazarían levemente esos cilindros, y se empleó un sistema para detectar el desplazamiento que llegase a captar la cienbillonésima parte de un centímetro. Las débiles ondas de los gravitones, que proceden del espacio profundo, deberían chocar contra todo el planeta, y los cilindros separados por grandes distancias se verán afectados de forma simultánea. En 1.969, Weber anunció haber detectado los efectos de las ondas gravitacionales. Aquello produjo una enorme excitación, puesto que apoyaba una teoría particularmente importante (la teoría de Einstein de la relatividad general). Desgraciadamente, nunca se pudo comprobar mediante las pruebas realizadas por otros equipos de científicos que duplicaron el hallazgo de Weber.

En cualquier caso, no creo que a estas alturas alguien pueda dudar de la existencia de los gravitones, el bosón mediador de la fuerza gravitatoria. La masa del gravitón es 0, su carga es 0, y su espín es 2. Como el fotón, no tiene antipartícula; ellos mismos hacen las dos versiones.

emilio silvera

Jun

27

¿La Física? ¡Una maravilla! Nos dice cómo funciona la Naturaleza

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

Ylia Prigogine haciendo lo que sólo unos privilegiados pueden hacer: desvelando los principios del mundo. Enn la pizarra, la entropía. La irreversibilidad del tiempo trae el orden al caos, decía. De alguna manera pretendía explicar que nada permanece y todo cambia bajo los efectos del inexorable paso del Tiempo.

“En el mundo de los seres vivos, la escala o tamaño crea importantes diferencias. En muchos aspectos, la anatomía de un ratón es una copia de la de un elefante, pero mientras que un ratón trepar por una pared prácticamente vertical sin mucha dificultad (y se puede caer desde una altura varias veces mayor que su propio tamaño sin hacerse daño), un elefante no sería capaz de realizar tal hazaña. Con bastante generalidad se puede afirmar que los efectos de la gravedad son menos importantes cuanto menores sean los objetos que consideremos (sean vivos o inanimados).

Cuando llegamos a los seres unicelulares, se ve que ellos no hay distinción entre arriba y abajo. Para ellos, la tensión superficial del agua es mucho más importante que la fuerza de la gravedad a esa escala. Tranquilamente se pueden mover y desplazar por encima de una superficie acuática. Los pluricelulares no pueden hacer tal cosa.

La tensión superficial es una consecuencia de que todas las moléculas y los átomos se atraen unos a otros con una fuerza que nosotros llamamos de Van der Waals. fuerza tiene un alcance muy corto; para ser precisos, diremos que la intensidad de esta fuerza a una distancia r es aproximadamente 1/r7. Esto significa que si se reduce la distancia dos átomos a la mitad de la fuerza de Van der Waals con la que se atraen uno a otro se hace 2 × 2 × 2 × 2 × 2 × 2 × 2 = 128 veces más intensa. Cuando los átomos y las moléculas se acercan mucho unos a otros quedan unidos muy fuertemente a través de esta fuerza. El conocimiento de esta fuerza se debe a Johannes Diderik Van der Waals (1837 – 1923) con su tesis sobre la continuidad del líquido y gaseoso que le haría famoso, ya que en esa época (1873), la existencia de las moléculas y los átomos no estaba completamente aceptado.

La tensión superficial del agua, es el efecto físico (energía de atracción entre las moléculas) que “endurece” la capa superficial del agua en reposo y permite a algunos insectos, como el mosquito y otros desplazarse por la superficie del agua sin hundirse.

El famoso físico inglés James Clerk Maxwell, que formuló la teoría del electromagnetismo de Faraday, quedó muy impresionado por este de Van der Waals.

Los tamaños de los seres uniceculares, animales y vegetales, se miden en micrómetros o “micras”, donde 1 micra es 1/1.000 de milímetro, aproximadamente el tamaño de los detalles más pequeños que se pueden observar con un microscopio ordinario. El mundo de los microbios es fascinante, pero no es el objeto de este trabajo, y continuaremos el viaje emprendido las partículas elementales que forman núcleos, átomos, células y materia, así como las fuerzas que intervienen en las interacciones fundamentales del universo y que afecta a todo lo que existe.

Hemos hablado del electrón que rodea el núcleo, de su carga eléctrica negativa que complementa la positiva de los protones y hace estable al átomo; una masa de solamente 1/1.836 de la del núcleo más ligero (el del hidrógeno). La importancia del electrón es vital en el universo.

Pero busquemos los “cuantos”. La física del siglo XX empezó exactamente en el año 1900, cuando el físico alemán Max Planck propuso una posible solución a un problema que había intrigando a los físicos durante años. Es el problema de la luz que emiten los cuerpos calentados a una cierta temperatura, y también la radiación infrarroja emitida, con menor intensidad, por los objetos más fríos (radiación de cuerpo negro).

Estaba bien aceptado entonces que esta radiación tenía un origen electromagnético y que se conocían las leyes de la naturaleza que regían estas ondas electromagnéticas. También se conocían las leyes para el frío y el calor, la así llamada “termodinámica”, o al menos eso parecía. Pero si utilizamos las leyes de la termodinámica para calcular la intensidad de una radiación, el resultado no tiene ningún sentido. Los cálculos nos dicen que se emitiría una cantidad infinita de radiación en el ultravioleta más lejano y, luego, esto no es lo que sucede. Lo que se observa es que la intensidad de la radiación muestra un pico a una cierta longitud de onda característica, y que la intensidad disminuye tanto para longitudes mayores como para menores. Esta longitud de onda característica es inversamente proporcional a la temperatura absoluta de objeto radiante (la temperatura absoluta se define por una escala de temperatura que empieza a 273º bajo cero). Cuando a 1.000º C un objeto se pone al “rojo vivo”, el objeto está radiando en la zona de luz visible.

Radiación de Cuerpo Negro

Un cuerpo negro es un objeto teórico o ideal que absorbe toda la luz y toda la energía radiante que incide sobre él. Nada de la radiación incidente se refleja o pasa a través del cuerpo negro. A pesar de su , el cuerpo negro emite luz y constituye un modelo ideal físico para el estudio de la emisión de radiación electromagnética. El nombre Cuerpo negro fue introducido por Gustav Kirchhoff en 1862.

La luz emitida por un cuerpo negro se denomina radiación de cuerpo negro. Todo cuerpo emite energía en de ondas electromagnéticas, siendo esta radiación, que se emite incluso en el vacío, tanto más intensa cuando más elevada es la temperatura del emisor. La energía radiante emitida por un cuerpo a temperatura ambiente es escasa y corresponde a longitudes de onda superiores a las de la luz visible (es decir, de menor frecuencia). Al elevar la temperatura no sólo aumenta la energía emitida sino que lo hace a longitudes de onda más cortas; a esto se debe el cambio de color de un cuerpo cuando se calienta. Los cuerpos no emiten con igual intensidad a todas las frecuencias o longitudes de onda, sino que siguen la ley de Planck.

Lo que Planck propuso fue simplemente que la radiación sólo podía ser emitida en paquetes de un tamaño dado. La cantidad de energía de uno de esos paquetes, o cuantos, es inversamente proporcional a la longitud de onda, y por tanto, proporcional a la frecuencia de radiación emitida. La fórmula es E = hν, donde E es la energía del paquete, ν es la frecuencia y h es una nueva constante fundamental de la naturaleza, la constante de Planck. Cuando Planck calculó la intensidad de la radiación térmica imponiendo nueva condición, el resultado coincidió perfectamente con las observaciones.

Poco tiempo después, en 1905, Einstein formuló esta teoría de una manera mucho más tajante: él sugirió que los objetos calientes no son los únicos que emiten radiación en paquetes de energía, sino que toda la radiación consiste en múltiplos del paquete de energía de Planck. El príncipe francés Louis-Victor de Broglie, dándole otra vuelta a la teoría, propuso que no sólo cualquier cosa que oscila tiene energía, sino que cualquier cosa con energía se debe comportar una “onda” que se extiende en una cierta región del espacio, y que la frecuencia ν de la oscilación verifica la ecuación de Planck. Por lo tanto, los cuantos asociados con los rayos de luz deberían verse una clase de partículas elementales: el fotón. Todas las demás clases de partículas llevan asociadas diferentes ondas oscilantes de campos de fuerza, esto lo veremos más adelante.

El curioso comportamiento de los electrones en el interior del átomo, descubierto y explicado por el famoso físico danés Niels Bohr, se pudo atribuir a las ondas de de Broglie. Poco después, en 1926, Edwin Schrödinger descubrió cómo escribir la teoría ondulatoria de de Broglie con ecuaciones matemáticas exactas. La precisión con la cual se podían realizar cálculos era asombrosa, y pronto quedó claro que el comportamiento de todos los objetos pequeños quedaba exactamente determinado por las recién descubiertas “ecuaciones de ondas cuánticas”.

Está bien comprobado que la mecánica cuántica funciona de maravilla…, pero, sin embargo, surge una pregunta muy formal: ¿qué significan realmente estas ecuaciones?, ¿qué es lo que están describiendo? Isaac Newton, allá en 1867 formuló cómo debían moverse los planetas alrededor del Sol, estaba claro todo el mundo qué significaban sus ecuaciones: que los planetas estaban siempre en una posición bien definida des espacio y que sus posiciones y sus velocidades en un momento concreto determinan inequívocamente cómo evolucionarán las posiciones y las velocidades en el tiempo.

Pero los electrones todo es diferente. Su comportamiento parece estar envuelto en misterio. Es como si pudieran “existir” en diferentes lugares simultáneamente, como si fueran una nube o una onda, y esto no es un efecto pequeño. Si se realizan experimentos con suficiente precisión, se puede determinar que el electrón parece capaz de moverse simultáneamente a lo largo de trayectorias muy separadas unas de otras. ¿Qué puede significar todo esto?

Niels Bohr consiguió responder a esta pregunta de tal que con su explicación se pudo seguir trabajando, y muchos físicos siguen considerando su respuesta satisfactoria. Se conoce como la interpretación de Copenhague de la mecánica cuántica.

Si la mecánica cuántica tiene cosas extrañas y el espín es una de ellas. Y si uno piensa que la intuición le ayudará a comprender todo esto, pues no lo hará, o es poco probable que lo haga. Las partículas tienen un espín fundamental. Al igual que la carga eléctrica o la masa, el espín ayuda a definir que de partícula es cada una.

Las leyes de la mecánica cuántica han sido establecidas con mucha precisión; permite cómo calcular cualquier cosa que queramos saber. Pero si queremos “interpretar” el resultado, nos encontramos con una curiosa incertidumbre fundamental: que varias propiedades de las partículas pequeñas no pueden estar bien definidas de manera simultánea. Por ejemplo, podemos determinar la velocidad de una partícula con mucha precisión, pero entonces no sabremos exactamente dónde se encuentra; o a la inversa, podemos determinar la posición con precisión, pero entonces su velocidad queda mal definida. Si una partícula tiene espín (rotación alrededor de su eje), la dirección alrededor de la cual está rotando (la orientación del eje) no puede ser definida con gran precisión.

La posición y el momento de una partícula nunca lo podremos saber con precisión ilimitada.

No es fácil explicar de forma sencilla de dónde viene esta incertidumbre, pero existen ejemplos en la vida cotidiana que tienen algo parecido. La altura de un tono y la duración en el tiempo durante el cual oímos el tono tienen una incertidumbre mutua similar. Para afinar un instrumento se debe escuchar una nota durante un cierto intervalo de tiempo y compararla, por ejemplo, con un diapasón que debe vibrar también durante un tiempo. Notas muy breves no tienen bien definido el tono.

Para que las reglas de la mecánica cuántica funcionen, es necesario que todos los fenómenos naturales en el mundo de las cosas pequeñas estén regidos por las mismas reglas. Esto incluye a los virus, bacterias e incluso a las personas. Sin embargo, cuando más grande y más pesado es un objeto, más difícil es observar las desviaciones de las leyes del movimiento “clásicas” debidas a la mecánica cuántica. Me gustaría referirme a exigencia tan importante y tan peculiar de la teoría con la palabra “holismo”. Esto no es exactamente lo mismo que entienden algunos filósofos por holismo, y que podría definir como “el todo es más que la suma de sus partes”. Si la física nos ha enseñado algo es justo lo contrario. Un objeto compuesto de un gran de partículas puede ser entendido exactamente si se conocen las propiedades de sus partes (partículas); basta que sepamos sumar correctamente (¡y esto no es nada fácil en mecánica cuántica!). Lo que entiendo por holismo es que, efectivamente, el todo es la suma de las partes, pero sólo se puede hacer la suma si todas las partes obedecen a las mismas leyes. Por ejemplo, la constante de Planck, h, que es igual a 6’626075… × 10-34 Julios segundo, debe ser exactamente la misma para cualquier objeto en cualquier sitio, es decir, debe ser una constante universal.

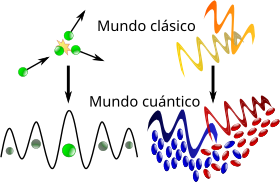

La mecánica cuántica es muy extraña a nuestro “sentido común”, sabemos que se desenvuelve en ese “universo” de lo muy pequeño, alejado de nuestra vida cotidiana en el macrocosmos tetradimensional que, no siempre coincide con lo que, en aquel otro ininitesimal acontece.

Las reglas de la mecánica cuántica funcionan tan bien que refutarlas resulta realmente difícil. Los trucos ingeniosos descubiertos por Werner Heisemberg, Paul Dirac y muchos otros mejoraron y completaron las reglas generales. Pero Einstein y otros pioneros como Erwin Schrödinger siempre presentaron serias objeciones a interpretación. Quizá funcione bien, pero ¿dónde está exactamente el electrón?, ¿en el punto x o en el punto y? En pocas palabras, ¿dónde está en realidad?, y ¿cuál es la realidad que hay detrás de nuestras fórmulas? Si tenemos que creer a Bohr, no tiene sentido buscar tal realidad. Las reglas de la mecánica cuántica, por sí mismas, y las observaciones realizadas con detectores son las únicas realidades de las que podemos hablar.

Es cierto que, existe otro universo dentro de nuestro del que, aún, nos queda mucho por aprender.

La mecánica cuántica puede ser definida o resumida así: en principio, con las leyes de la naturaleza que conocemos se puede predecir el resultado de cualquier experimento, en el sentido que la predicción consiste en dos factores: el primer factor es un cálculo definido con exactitud del efecto de las fuerzas y estructuras, tan riguroso como las leyes de Isaac Newton para el movimiento de los planetas en el Sistema Solar; el segundo factor es una arbitrariedad estadística e incontrolable definida matemáticamente de estricta. Las partículas seguirán una distribución de probabilidades dadas, primero de una forma y luego de otra. Las probabilidades se pueden calcular utilizando la ecuación de Schrödinger de función de onda (Ψ) que, con muchas probabilidades nos indicará el lugar probable donde se encuentra una partícula en un dado.

Muchos estiman que esta teoría de las probabilidades desaparecerá cuando se consiga la teoría que explique, de forma completa, todas las fuerzas; la buscada teoría del todo, lo que implica que nuestra descripción actual incluye variables y fuerzas que (aún) no conocemos o no entendemos. Esta interpretación se conoce como hipótesis de las variables ocultas.”

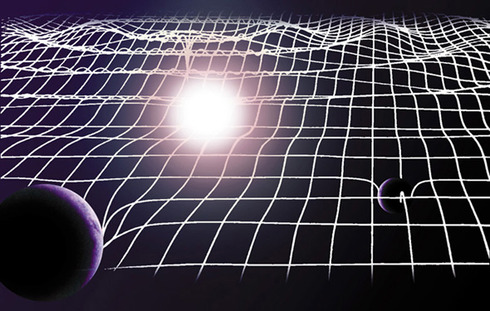

También Gerard ‘t Hooft es el autor de lo que han dado en llamar l principio holográfico es una conjetura especulativa acerca de las teorías de la Gravedad Cuántica propuesta en 1993 por este autor, y mejorada y promovida por Leonard Susskin en 1995. Postula que toda la información contenida en cierto volumen de un espacio concreto se puede conocer a partir de la información codificable sobre la frontera de dicha región. Una importante consecuencia es que la cantidad máxima de información que puede contener una determinada región de espacio rodeada por una superficie diferenciable está limitada por el área total de dicha superficie.

Por ejemplo, se pueden modelar todos los eventos que ocurran en un cuarto o una habitación creando una teoría en la que sólo tome en cuenta lo que suceda en sus paredes. En el principio holográfico también se afirma que por cada cuatro Unidades de Planck existe al menos un grado de libertad (o una unidad constante de Bolttzmann k de máxima entropía). Esto se conoce como frontera de Bekenstein:

donde S es la entropía y A es la unidad de mensura considerada. En unidades convencionales la fórmula anterior se escribe:

donde:

, es la constante de Boltzmann.

, es la constante de Boltzmann.

, es la vecolcidad de la luz.

, es la vecolcidad de la luz.

, es la constante gravitacional universal.

, es la constante gravitacional universal.

, es la constante de Planck racionalizada.

, es la constante de Planck racionalizada. , es la longitud de Planck.

, es la longitud de Planck.

Claro que esta… ¡Es otra Historia!

emilio silvera

Totales: 87.027.595

Totales: 87.027.595 Conectados: 46

Conectados: 46