Jun

10

¡La Tierra! ¡Qué lugar tan maravilloso!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (1)

Comments (1)

En este lugar encontré una exposición de rincones de la Naturaleza que merecen la pena ser vistos y, ante ellos, nos podemos hacer una idea de la rica variedad que nos ofrece el mundo y, si pensamos en los miles de millones de mundos que en las galaxias son… ¿Qué no podríamos encontrar en ellos?

1) Salar de Uyuni (Bolivia), el mayor espejo del mundo.

Durante la temporada de lluvias, el mayor desierto de sal del mundo se convierte en el espejo más grande del mundo. El Salar nació cuando varios lagos prehistóricos se unieron en uno solo.

2) Montañas Tianzi (China), la montañas de la película “Avatar”.

Estas montañas son únicas. Son tan extrañas que se utilizaron en la película “Avatar” de James Cameron. Formadas bajo el agua hace 380 millones de años. La tierra se elevó como resultado de la actividad volcánica. Algunos de los pilares han llegado a más de 4.000 metros sobre el nivel del mar.

3) Centinelas del Ártico, Finlandia.

Estos “centinelas” son realmente gigantescos árboles cubiertos de nieve y hielo. Esta extraña imagen se produce en invierno, cuando las temperaturas oscilan desde -40 hasta -15 grados centígrados.

4) Cuevas Reed Flute (China).

Este sistema de cuevas de 240 metros de longitud se encuentran en Guilin, y son una de las atracciones más populares en China durante más de 1.200 años. Las hermosas estalactitas, estalagmitas y columnas fueron creadas por la erosión del agua. Se destacan por sus múltiples luces de colores que crean un ambiente verdaderamente surrealista.

5) Skaftafell, cueva de hielo, en Islandia.

Las cuevas de hielo son estructuras temporales que se forman en el borde de los glaciares cuando el agua derretida forma un agujero. El hielo formado tiene muy pocas burbujas de aire y absorbe toda la luz excepto el azul, que da a la cueva ese color único.

6) Cañón del Antílope, Arizona, en Estados Unidos.

Este cañón se formó hace millones de años. El agua forjó una profunda grieta muy estrecha. Las paredes parecen ser de diferentes colores.

7) Mar de Estrellas, Isla Vaadhoo, Maldivas

Puede parecer normal durante el día, pero por la noche, esta playa cobra vida. El brillo en el agua proviene de microbios marinos llamados fitoplancton. La galaxia que se dibuja en la arena es impresionante.

La Gran Fuente Prismática, Wyoming

La Gran Fuente Prismática, en Wyoming, es el lugar más grande de aguas termales en los Estados Unidos. Los colores vivos son el resultado de los microbios pigmentados que crecen alrededor de los bordes del agua rica en minerales.

9) Dead Vlei, Namibia

Estas fotografías parecen un cuadro… pero son reales. Son fotografías del “valle muerto”, donde los árboles mueren frente a un fondo con una de las dunas de arena más altas del mundo. El desierto se va acercando y matando cualquier tipo de vida.

10) Lago Baikal, Siberia.

El lago Baikal es el lago de agua dulce más grande y antiguo del mundo. En el invierno, el lago se congela pero el agua es tan clara que se puede ver 40 metros por debajo del hielo. En marzo, las heladas y el sol provocan grietas en la corteza de hielo y aparecen los fragmentos de hielo de color turquesa que vemos en la superficie.

11) Socotra, Yemen

Un tercio de la vida vegetal de la isla de Socotra no se encuentra en ningún otro lugar del planeta tierra. Una de las formas más extrañas es el árbol de sangre de dragón, que se asemeja a un paraguas.

12) Parque Geológico Zhangye Danxia, Gansu, China.

Estas formaciones rocosas de colores son el resultado de los minerales que se han depositado durante 24 millones de años. El viento y la lluvia tallan formas increíbles en la roca, formando pilares naturales, torres, barrancos, valles y cascadas.

13) Túnel del Amor, Klevan, Ucrania

Este túnel se formó durante muchos años gracias a que los trenes hacían tres veces el mismo trayecto en un día y moldeaban los árboles circundantes. Ahora está abandonado y es un lugar romántico para una tarde de paseo.

14) Cuevas de Waitomo Glowworm (Nueva Zelanda)

Miles de diminutas luciérnagas cuelgan en el techo de esta gruta e irradian una luz luminiscente, creando una escena sacada de una película de ciencia ficción.

15) Las terrazas de arroz de Yuanyang, en China

Las técnicas de cultivo del condado de Yuanyang han creado un paisaje que es realmente sorprendente.

16) Lago Hillier, Australia

El color rosa de este lago es el resultado de un colorante creado por las algas y bacterias que hay en el agua. A pesar de la tonalidad extraña, el lago no parece tener efectos adversos en los seres humanos o la vida silvestre local.

17) La cascada blanca de Pamukkale, Turquía

Durante millones de años, las aguas termales de Pamukkale han transformado el paisaje. Aunque puede parecer que estas terrazas están hechos de hielo y nieve, Turquía tiene un clima cálido todo el año. El suelo está recubierto sólo de piedra caliza blanca.

18) Caño Cristales, Colombia.

Debido al extenso hábitat de fauna y flora, este río tiene una gran variedad de colores: amarillo, verde, azul, negro y rojo. Las rocas tienen alrededor de 1,2 mil millones de años, y los que lo visitan lo llaman el río más hermoso del mundo.

19) La Catedral de Mármol, en Chile

Formadas por miles de años gracias a las olas que chocan contra el carbonato de calcio. Estas cuevas tienen paredes lisas arremolinadas que reflejan las aguas azules del lago.

20) Calzada del Gigante, Irlanda del Norte

Hace unos 55 millones años, la intensa actividad volcánica de la zona formó una meseta de lava. Con el tiempo, la lava se enfrío y se fracturó creando columnas que son tan perfectas que casi parecen artificiales.

21) Géiser Fly, Nevada

Géiser Fly fue creado accidentalmente cuando se perforó un pozo. Los minerales y algas comenzaron a subir desde el géiser y se acumularon formando un montículo extraño.

22) Cascada bajo el agua, en Mauricio

Unas corrientes marinas muy fuertes empujan los sedimentos y la arena hacia abajo, creando esta cascada submarina.

23) Monte Roraima, Venezuela

Es uno de los montes más antiguos de la Tierra. Se remonta a dos mil millones años, cuando la tierra se levantó por encima del suelo por la actividad tectónica. Los lados de la montaña son escarpados acantilados verticales con varias cascadas. Es casi imposible de escalar.

24) Aogashima, Japón

Aogashima es una isla volcánica situada a 200 kilómetros de la costa de Tokio.

25) La cueva de Fingal, Escocia

Al igual que la Calzada del Gigante, esta cueva fue formada por el enfriamiento de la lava y su fracturación durante millones de años.

26) Río bajo el agua, Cenote Angelita, México

Debajo de las aguas del Cenote Angelita fluye un río lleno de sulfato de hidrógeno, que es mucho más pesado que el agua del río.

27) Mina de Naica, México

Esta mina de plata está recubierta de cristales enormes.

28) Playa Escondida, Islas Marietas, México

Esta magnífica playa escondida fue creada por una explosión militar en 1900. Sólo se puede acceder nadando a través de un túnel.

29) Lago Natron, Tanzania

Este lago tiene una forma única de alto contenido en sal. Los microorganismos amantes de la sal se desarrollan y producen un pigmento rojo que colorea el agua. Para otros animales, la sal es mortal: se calcifican y muchos acaban “convirtiéndose en piedra” después de entrar en contacto con el agua.

30) Estructura de Richat, Mauritania (El Ojo de África)

Se encuentra en medio del desierto del Sáhara. Es un lugar profundamente erosionado y tiene más de 24 kilómetros de diámetro. La formación natural es tan impresionante que, desde hace mucho tiempo, los científicos creían que era el sitio de un impacto de un asteroide.

31) Tierras Altas de Islandia

Las tierras altas de Islandia tienen algunos de los lugares naturales más magníficos del hemisferio norte. Glaciares alucinantes, cráteres, lagos y géiseres… pero cuando cae la noche, la zona se convierte en uno de los mejores lugares para presenciar la aurora boreal.

32) Parque nacional de los Lagos de Plitvice, Croacia

El Parque Nacional de Plitvice es el más grande de su tipo en Croacia y el más antiguo en el sudeste de Europa. Tiene hermosos lagos, cuevas y cascadas.

33) La Catedral de Sal, en Colombia.

Este lugar fue excavado por los mineros de sal. Un arquitecto reconvirtió ese lugar en una catedral para que los lugareños pudieran orar por tan sacrificados hombres.

34) Río Tinto, en la provincia de Huelva en España.

Es un río de color rojo debido a la interacción entre los metales pesados de la zona y unas bacteria existentes en río. El río tiene un alto contenido en azufre por lo que es muy interesante que puedan vivir dichas bacterias.

35) Lagunas de Cañada del Hoyo, Cuenca, España.

Son en total siete lagunas repartidas en una extensión no muy grande. Lo curioso de estas siete lagunas es que todas tienen un color diferente debido a los micro-organismos que viven en ellas y depende de cómo les de la luz.

Finaliza con una recomendación:

“Comparte estas fotos surrealistas con la gente que te encantaría viajar.”

Después de este viaje por rincones de nuestro mundo sorprendente, nos podemos preguntar, y, teniendo todo esto y mucho más, ¿Qué sentido tiene querer ir a otros mundos en los que no sabemos que podemos encontrar? A pesar de esta reflexión de sensatez, no cejaremos en el empeño de visitar otros lugares fuera de este nuestro… ¡El más hermoso!

Publica: Emilio Silvera V.

PD.

¿Habrá algún planeta más bello que la Tierra?

Si lo hay… ¡No lo conocemos!

Claro que, estamos hablando de nuestra “casa”, el planeta en el que ecvolucionamos y al que estamos adaptados.

Jun

10

Nuestro lugar en el Universo…¿Cuál será?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

¿Quién nos observa? No podríamos negar que esté sucediendo

En esto de la vida en otros mundos, si nos ceñimos a las estadísticas, no podemos negar que estén ahí fuera, situados en mundos como el nuestro o parecidos, una ingente cantidad de criaturas de todo tipo y pelaje, unos con inteligencia y otros, como aquí en la Tierra, a medio camino entre la consciencia y ese limbo en el que no se tiene consciencia de Ser.

Antes en otra entrada que titulé “Observar la Naturaleza… da resultados”, comentaba sobre los grandes números de Dirac y lo que el personaje llamado Robert Henry Dicke pensaba de todo ello y, cómo dedujo que para que pudiera aparecer la biología de la vida en el Universo, había sido necesario que el Tiempo de vida de las estrellas fuese el que se necesita para poder ·fabricar” todos los elementos necesarios para la Vida, el Universo, también tiene que tener, no ya las condiciones que posee, sino también, la edad que le hemos estimado.

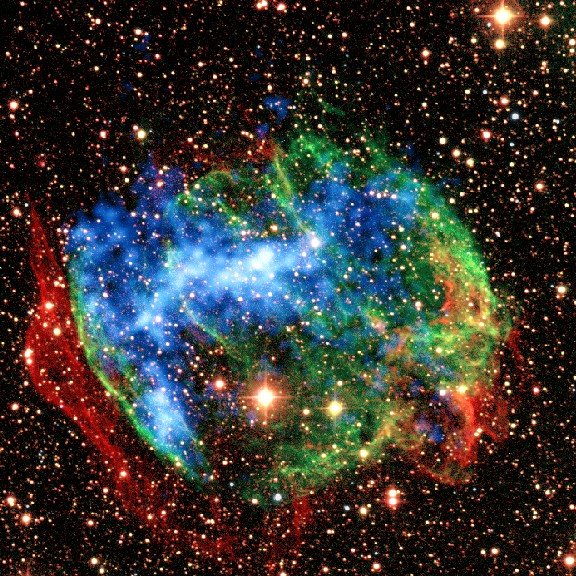

El telescopio espacial Hubble ha logrado capturar los remanentes de supernova que resaltan por parecer la explosión de fuegos artificiales en la Gran Nube de Magallanes, y que esconde una estrella de neutrones que es súper densa. La imagen aporta nuevos datos sobre estos objetos interesantes que esconden grandes secretos sobre la formación de las estrellas.

Filaments of the Vela Supernova Remnant

Créditos de imagen & Copyright: Angus Lau, Y Van, SS Tong (Jade Scope Observatory)

“La explosión se ha acabado pero las consecuencias siguen. Hace unos once mil años, una estrella de la constelación de Vela estalló y creó un extraño punto de luz que los humanos que vivían al principio de la historia registrada pudieron contemplar. Las capas externas de la estrella se estrellaron contra el medio interestelar e impulsaron una onda expansiva que todavía es visible hoy en día.En rayos X se ve una onda de choque en expansión más o menos esférica. La imagen muestra en luz visible algunos restos de aquella explosión gigantesca. A medida que el gas se aleja de la estrella estallada se descompone , reacciona con el medio interestelar y produce luz en diferentes colores y bandas de energía. el centro del remanente de la supernova Vela queda un púlsar , o sea, una estrella más densa que la materia nuclear que gira sobre sí misma más de diez veces por segundo.”

Remanente de Supernova

Los filamentos de un remanente de Supernova que, mirándolos y pensando de donde vienen… Te hacen recorrer unos caminos alucinantes que comenzaron con una inmensa aglomeración de gas y polvo que se constituyó en una estrella masiva que, después de vivir miles de millones de años, dejó, a su muerte, el rastro que arriba podemos contemplar.

Cuando los físicos empezaron a apreciar el papel de las constantes en el dominio cuántico y explotar la nueva teoría de la gravedad de Einstein para describir el universo en su conjunto, las circunstancias eran las adecuadas para que alguien tratara de casarlas.

Durante la década de 1.920, cuando Eddington empezó su búsqueda para explicar las constantes de la naturaleza, no se conocían bien las fuerzas débil y fuerte. Las únicas constantes dimensionales de la física que sí se conocían e interpretaban con confianza eran las que definían la gravedad y las fuerzas electromagnéticas. Eddington las dispuso en tres puros números adimensionales. Utilizando los valores experimentales de la época, tomó la razón entre las masas del protón y del electrón:

mpr/me ≈ 1840

La inversa de la constante de estructura fina

2πhc/e2 ≈ 137

Y la razón entre la fuerza gravitatoria y la fuerza electromagnética entre un electrón y un protón,

e2/Gmpr me ≈ 1040

A estas Eddington añadió su número cosmológico, NEdd ≈ 1080. A estos cuatro números los llamó “las constantes últimas”, y la explicación de sus valores era el mayor desafío de la ciencia teórica:

“¿Son estas cuatro constantes irreducibles, o una unificación posterior de la física que pueda demostrar que una o todas ellas podrían ser prescindibles? ¿Podrían haber sido diferentes de lo que realmente son?… Surge la pregunta de si las razones anteriores pueden ser asignadas arbitrariamente o si son inevitables. En el primer caso, sólo podemos aprender sus valores por medida; en el segundo caso es posible encontrarlos por la teoría… Creo que ahora domina ampliamente la opinión de que las (cuatro anteriores) constantes… no son arbitrarias, sino que finalmente se les encontrará una explicación teórica; aunque también he oído expresar lo contrario.”

Medida una y mil veces, α parece que no cambia a pesar de todo

Siguiendo con su especulación Eddington pensaba que el número de constantes inexplicadas era un indicio útil del hueco que había que cerrar antes de que se descubriese una teoría verdaderamente unificada de todas las fuerzas de la naturaleza. En cuanto a si esta teoría final contenía una constante o ninguna, tendríamos que esperar y ver:

“Nuestro conocimiento actual de 4 constantes en lugar de 1 indica meramente la cantidad de unificación de teoría que aún queda por conseguir. Quizá resulte que la constante que permanezca no sea arbitraria, pero de eso no tengo conocimiento.”

Eddington, como Max Planck, Einstein y Galileo, y Newton antes que ellos, era simplemente un adelantado a su tiempo; comprendía y veía cosas que sus coetáneos no podían percibir.

Hay una anécdota que se cuenta sobre esto y que ilustra la dificultad de muchos para reconciliar el trabajo de Eddington sobre las constantes fundamentales con sus monumentales contribuciones a la relatividad general y la astrofísica. La historia la contaba Sam Goudsmit referente a él mismo y al físico holandés Kramers:

Samuel Abraham Goudsmit, George Uhlenbeck y Hendrik Kramers

“El gran Arthur Eddington dio una conferencia sobre su derivación de la constante de estructura fina a partir de una teoría fundamental. Goudsmit y Kramers estaban entre la audiencia. Goudsmit entendió poco pero reconoció que era un absurdo inverosímil. Kramers entendió mucho y reconoció que era un completo absurdo. Tras la discusión, Goudsmit se acercó a su viejo amigo y mentor Kramers y le preguntó: ¿Todos los físicos se vuelven locos cuando se hacen mayores? Tengo miedo. Kramers respondió, “No Sam, no tienes que asustarte. Un genio como Eddington quizá puede volverse loco pero un tipo como tú sólo se hace cada vez más tonto”.

El filósofo-poeta , prosista y pensador

Aquí hablamos del Universo, de las Teorías que tratan de explicarlo, de la Mente humana que no hemos llegado a comprender, y, hemos llegado a la conclusión que, como dijo aquel pensador: “No sólo de pan vive el hombre”. Necesitamos sentir y crear para alcanzar la plenitud, para dar algún sentido a nuestras vidas.

Aquí también están algunas de esas constantes

Los campos magnéticos están presentes por todo el Universo. Hasta un diminuto (no por ello menos importante) electrón crea, con su oscilación, su propio campo magnético, y, aunque pequeño, se le supone un tamaño no nulo con un radio ro, llamado el radio clásico del electrón, dado por r0 = e2/(mc2) = 2,82 x 10-13 cm, donde e y m son la carga y la masa, respectivamente del electrón y c es la velocidad de la luz.

Nuestro universo es como lo podemos observar gracias a esos números

El mayor misterio que rodea a los valores de las constantes de la naturaleza es sin duda la ubicuidad de algunos números enormes que aparecen en una variedad de consideraciones aparentemente inconexas. El número de Eddington es un ejemplo notable. El número total de protones que hay dentro del alcance del universo observable esta próximo al número

1080

Si preguntamos ahora por la razón entre las intensidades de las fuerzas electromagnéticas y gravitatoria entre dos protones, la respuesta no depende de su separación, sino que es aproximadamente igual a

1040

En un misterio. Es bastante habitual que los números puros que incluyen las constantes de la naturaleza difieran de 1 en un factor del orden de 102, ¡pero 1040, y su cuadrado 1080, es rarísimo! Y esto no es todo. Si seguimos a Max Planck y calculamos en valor estimado para la “acción” del universo observable en unidades fundamentales de Planck para la acción, obtenemos.

10120

Supernovas, Nebulosas, Estrellas… ¡Fuerzas y Constantes fundamentales!

Algunos llegan a afirmar que, el Universo es plano e indican que la “energía oscura” es probablemente la constante cosmológica de Einstein…¡Vivir para ver! El maestro llegó a decir que incluir la constante cosmológica en su ecuación había sido el mayor error de su vida y, sin embargo ahora… resulta que sí estaba en lo cierto. ¡Ya veremos!

Ya hemos visto que Eddington se inclinaba a relacionar el número de partículas del universo observable con alguna cantidad que incluyera la constante cosmológica. Esta cantidad ha tenido una historia muy tranquila desde esa época, re-emergiendo ocasionalmente cuando los cosmólogos teóricos necesitan encontrar una manera de acomodar nuevas observaciones incómodas.

Recientemente se ha repetido este escenario. Nuevas observaciones de alcance y precisión sin precedentes, posibilitadas por el telescopio espacial Hubble trabajando en cooperación con telescopios sensibles en tierra, han detectado supernovas en galaxias muy lejanas. Su pauta de brillo y atenuación característica permite deducir su distancia a partir de su brillo aparente. Y, sorprendentemente, resulta que están alejándose de nosotros mucho más rápido de lo que cualquiera esperaba. La expansión del universo ha pasado de ser un estado de deceleración a uno de aceleración. Estas observaciones implican la existencia de una constante cosmológica positiva (Λ+). Si expresamos su valor numérico como número puro adimensional medido en unidades del cuadrado de la longitud de Planck, entonces obtenemos un número muy próximo a

10-120

Nunca se ha encontrado un número más pequeño en una investigación física real. Podemos decir que es el más grande de los pequeños números.

Hablar del Universo en todo su conjunto…, no es nada fácil. Podemos hablar de parcelas, de elementos por separado y también de sucesos, objetos y de la mecánica celeste de manera individualizada para tratar de comprenderlos mejor y, más tarde, juntarlos para tener una perspectiva de su conjunto que… No siempre podemos llegar a comprender. ¡Es tanto lo que esas constantes nos quieren decir! que comprenderlas y entenderlo todo…, nos llevará algún tiempo.

¿Qué vamos a hacer con todos estos grandes números? ¿Hay algo cósmicamente significativo en 1040 y sus cuadrados y cubos?

Hermann Weyl

La aparición de algunos de estos grandes números ha sido una fuente de sorpresas desde que fue advertida por vez primera por Hermann Weyl en 1.919. Eddington había tratado de construir una teoría que hiciera comprensible su aparición, pero no logró convencer a un número significativo de cosmólogos de que estaba en la vía correcta. Pero sí convenció a la gente de que había algo que necesitaba explicación. De forma inesperada, fue precisamente uno de sus famosos vecinos de Cambridge quien escribió a la revista Nature la carta que consiguió avivar el interés por el problema con una idea que sigue siendo una posibilidad viable incluso hoy.

Paul Dirac

Paul Dirac ocupó la Cátedra Lucasiana de matemáticas en Cambridge durante parte del tiempo en que Eddington estuvo viviendo en los observatorios. Las historias que se cuentan de Paul Dirac dejan muy claro que era un tipo con un carácter peculiar, y ejercía de matemático las 24 h. del día. Se pudo saber que su inesperada incursión en los grandes números fue escrita durante su viaje de novios (Luna de miel), en febrero de 1937.

Aunque no muy convencido de las explicaciones de Eddington, escribió que era muy poco probable que números adimensionales muy grandes, que toman valores como 1040 y 1080, sean accidentes independientes y no relacionados: debe existir alguna fórmula matemática no descubierta que liga las cantidades implicadas. Deben ser consecuencias más que coincidencias.

Esta es la hipótesis de los grandes números según Dirac:

“Dos cualesquiera de los números adimensionales muy grandes que ocurren en la naturaleza están conectados por una sencilla relación matemática, en la que los coeficientes son del orden de la unidad”.

Un número adimensional, también conocido como número adimensional o magnitud adimensional, es un número que no tiene unidades físicas, y por lo tanto, es un número puro. Se define como el resultado de una relación entre dos o más cantidades físicas que sí tienen unidades, de tal forma que las unidades se cancelan, quedando solo un valor numérico.

Alfa (α) la Constante de estructura fina, el número puro y adimensional 137

El Nobel León Lederman (Director del CERN muchos años), decía:

“Todos los físicos del mundo deberían tener en el lugar más destacado de sus casas, un marco con el número 137. El motivo de tan conveniente obligación, sería recordarles, cada vez que lo vieran, lo poco que sabemos.”

Nos puede parecer mentira pero… Los verdaderos grandes números están en ¡La Mente!

Los grandes números de que se valía Dirac para formular esta atrevida hipótesis salían del trabajo de Eddington y eran tres:

N1 = (tamaño del universo observable) / (radio del electrón)

= ct (e2/mec2) ≈ 1040

N2 = Razón fuerza electromagnética-a-gravitatoria entre protón y electrón

= e2/Gme mp ≈ 1040

N = número de protones en el universo observable

= c3t/Gmp ≈ 1080

Aquí t es la edad actual del universo, me es la masa de un electrón, mp es la masa de un protón, G la constante de gravitación, c la velocidad de la luz y e la carga del electrón.

El Universo es todo lo que existe: Materia, Tiempo y Espacio inmersos en un océano de fuerzas y constantes

Según la hipótesis de Dirac, los números N1, N2y raizN eran realmente iguales salvo pequeños factores numéricos del orden de la unidad. Con esto quería decir que debe haber leyes de la naturaleza que exijan fórmulas como N1 = N2, o incluso N1 = 2N2. Un número como 2 ó 3, no terriblemente diferente de 1 está permitido porque es mucho más pequeño que los grandes números implicados en la fórmula; esto es lo que él quería decir por “coeficientes…. del orden de la unidad”.

Esta hipótesis de igualdad entre grandes números no era en sí misma original de Dirac. Eddington y otros habían escrito antes relaciones muy semejantes, pero Eddington no había distinguido entre el número de partículas del universo observable, que se define como una esfera centrada en nosotros con un radio igual a la velocidad de la luz multiplicada por la edad actual del universo, o lo que es lo mismo:

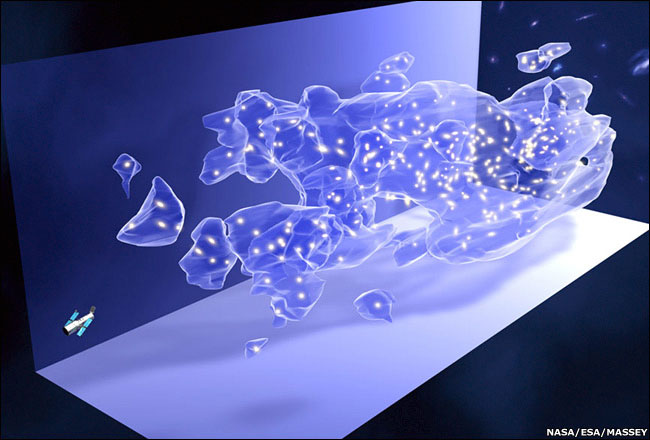

La trayectoria del llamado Universo Observable (y del cual somos su centro al recorrer su geodésica en la geometría espacio-temporal) tiene la forma perimetral de una gota (forma de media lemniscata; cosa curiosa, lemniscata: figura curva ∞ usada como el símbolo de infinito ¿?) que al girarla 45 ° y desarrollar un cuerpo de revolución, se obtienen dos campos toroidales cual si fuesen imágenes antagónicas (una reflejada) de una fuente (surtidor – sumidero cada uno), correspondiendo uno al campo material y el otro al antimaterial.

Trayectoria del Universo observable.

Lo están ocupando en su totalidad, se retroalimentan a sí mismos en la Hipersingularidad (punto de contacto de los dos campos, principio y fin de ambos flujos donde reacciona la materia y la antimateria con la finalidad de mantener separados ambos universos con el adicional resultado de impulsar nuevamente a los fluidos universales de ambos campos a recorrer la finita trayectoria cerrada (geodésica) siendo el motor propulsor universal de dos volúmenes dinámicos, finitos pero continuos).

Universo observable: R = 300.000 × 13.500.000.000

La propuesta de Dirac provocó un revuelo entre un grupo de científicos vociferantes que inundaron las páginas de las revistas especializadas de cartas y artículos a favor y en contra. Dirac, mientras tanto, mantenía su calma y sus tranquilas costumbres, pero escribió sobre su creencia en los grandes números cuya importancia encerraba la comprensión del universo con palabras que podrían haber sido de Eddington, pues reflejan muy estrechamente la filosofía de la fracasada “teoría fundamental”.

“¿No cabría la posibilidad de que todos los grandes sucesos presentes correspondan a propiedades de este Gran Número [1040] y, generalizando aún más, que la historia entera del universo corresponda a propiedades de la serie entera de los números naturales…? Hay así una posibilidad de que el viejo sueño de los filósofos de conectar la naturaleza con las propiedades de los números enteros se realice algún día”.

Cuando hablamos del Universo, de inmediato, surgen las polémicas y los desacuerdos y las nuevas ideas y teorías modernas que quieren ir más allá de lo que “se sabe”, nunca han gustado en los centros de poder de la Ciencia que ven peligrar sus estatus con ideas para ellos “peregrinas” y que, en realidad, vienen a señalar nuevos posibles caminos para salir del atolladero o callejón sin salida en el que actualmente estamos inmersos: Mecánica cuántica y Relatividad que llevan cien años marcando la pauta en los “mundos” de lo muy pequeño y de lo muy grande sin que nada, las haya podido desplazar.

Esto nos deja con un ridículo 4% para la materia Bariónica que emite luz, y, hablan de todo ello como si realmente estuvieran seguros, cuando solo se trata de una hipótesis, no se ha podido comprobar de manera fehaciente que existe, ni la energía oscura ni la materia oscura.

Mientras tanto, continuamos hablando de materia y energía oscura que delata la “oscuridad” presente en nuestras mentes, creamos modelos incompletos en el que no sabemos incluir a todas las fuerzas y en las que (para cuadrar las cuentas), hemos metido con calzador y un poco a la fuerza, parámetros que no hemos sabido explicar (como el Bosón de Higgs en el Modelo Estándar que…, a pesar de todo ¡No está muy claro que esté ahí!). Sin embargo y a pesar de todo, el conocimiento avanza, el saber del mundo aumenta poco a poco y, aunque despacio, el conocimiento no deja de avanzar y, esperemos que las ideas surjan y la imaginación en la misma medida para que, algún día en el futuro, podamos decir que sabemos, aunque sea de manera aproximada, lo que el Universo es.

Emilio Silvera Vázquez

Jun

10

¿La Conciencia? ¡Qué complejidad!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Cerebro y Mente ~

Clasificado en Cerebro y Mente ~

Comments (0)

Comments (0)

No todos vemos lo mismo ante el mismo paisaje

Es una expresión que encapsula la idea de que la percepción de la realidad, en este caso, un paisaje, varía de persona a persona. No solo se trata de una diferencia física en la vista, sino de una combinación de factores subjetivos que influyen en cómo interpretamos lo que observamos.

No todos tenemos, ante el mismo paisaje, una visión igual. Lo que vemos depende de muchos factores: La inteligencia personal, la preparación y conocimientos que tengamos, la imaginación, tener la capacidad de discernir sobre lo que vemos…

¿El misterio más profundo? ¡La Mente!

Desde que tuvimos entendimiento nos hemos preguntado: ¿Quiénes somos? ¿De donde venimos? ¿Hacia donde vamos? ¿Qué es la Mente y la consciencia? ¿Surgimos a partir de la “materia inerte” evolucionada?

“Nada es tan difícil como evitar el autoengaño”

Ludwig Wittgestein

Nuestra estrategia para explicar la base neuronal de la conciencia consiste en centrarse en las propiedades más generales de la experiencia consciente, es decir, aquellas que todos los estados conscientes comparten. De estas propiedades, una de las más importantes es la integración o unidad. La integración se refiere a que el sujeto de la experiencia no puede en ningún momento dividir un estado consciente en una serie de componentes independientes. Esta propiedad está relacionada con nuestra incapacidad para hacer consciente-Mente dos cosas al mismo tiempo, como por ejemplo, estar ahora escribiendo este trabajo para ustedes y al mismo tiempo mantener una conversación sobre el Universo con otros amigos.

De la decisión que tomemos dependerá nuestro Futuro” (que en realidad… ¡Será Presente!

Muchas y variadas son las opciones que tenemos a nuestro alcance. No pocas veces nos encontramos ante una encrucijada entre la razón y el corazón y nos perdemos sin saber cuál es la decisión correcta. No siempre resulta fácil elegir el camino a seguir y… ¡Es tan importante acertar!

No siempre acertamos

Otra propiedad clave de la experiencia consciente, y una que aparentemente contrasta con la anterior, es su extraordinaria diferenciación o informatividad: En cada momento podemos seleccionar uno entre miles de millones de estados conscientes posibles en apenas una fracción de segundo. Nos enfrentamos, pues, a la aparente paradoja de que la unidad encierra la complejidad: el cerebro tiene que afrontar la sobreabundancia sin perder la unidad o coherencia. La tarea de la ciencia consiste en mostrar de qué manera la consigue.

Los últimos pensamientos sobre la mente y la conciencia están centrados en el constructivismo y nos viene a decir que cada cual, se fabrica su propia realidad, y, al hilo de ese pensamiento se me vienen a la mente algunas lecciones de neuropsicología y lo que es la integración bajo tensión, me explico:

Algunas de las indicaciones más sobresalientes de la ineludible unidad de la experiencia consciente provienen del examen de ciertos fenómenos patológicos. Muchos trastornos neuropsicológicos demuestran que la conciencia puede doblarse o encogerse y, en ocasiones, incluso dividirse, pero que nunca tolera que se rompa la coherencia. Por ejemplo, aunque un derrame cerebral en el hemisferio derecho deja a muchas personas con ese lado del cuerpo paralizado y afectado por una pérdida sensorial completa, algunas personas niegan su parálisis, un fenómeno que se conoce como anosognosia.

“Aunque esta palabreja difícil de pronunciar os pueda sonar bastante extraña, y nunca o casi la halláis leído o escuchado, su significado es muy, pero que muy conocido entre los familiares y cuidadores de las personas que sufren demencia tipo alzhéimer.

Y es que la anosognosia es la incapacidad del enfermo para reconocer su propia enfermedad. Ellos consideran que no les pasa nada, que están sanos, que no se despistan ni se olvidan de las cosas, que lo hacen todo en casa, que cuando hay algún fallo la culpa siempre es de los demás.”

El ser conscientes de que, a partir de la “materia inerte”, con el paso del Tiempo se evolucionó hasta aquella primera célula viva replicante que dio comienzo a la fascinante historia de la Vida… ¡Es asombroso!

Lo cierto es que, aunque no pensamos en ello, aunque nos creemos invencibles, lo cierto es que, nuestra fragilidad es grande, estamos expuestos a mil peligros que nos acechan tanto venidos del exterior como de nuestro interior, cualquier fallo de uno de los muchos mecanismos que nos sostienen… ¡Puede acabar con nosotros!

Mejor ser conscientes de ello, y, de la misma manera, será conveniente tener muy claro que “no sabemos”, que las preguntas ganan a las respuestas, y, como decía el gran filósofo Popper:

“Cuanto más profundizo en el conocimiento de las cosas, más consciente soy de lo poco que se. Mis conocimientos son limitados, mi ignorancia infinita”.

Y, además, no perder de vista el transcurso del Tiempo.

“Que no está muerto lo que duerme eternamente, con el paso de Eones, hasta la misma muerte tendrá que morir”.

Howard Phillips Lovecraft

Emilio Silvera V.

Jun

10

No me canso de prevenir del peligro de la I.A.

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

Vengo avisando del peligro que conlleva la I.A., que hasta el momnento, no nos garantiza la seguridad en el sentido del devenir de la especie humana. Hay fuertes indicios de que, de seguir por el camino emprendido (sin tomar medidas), las cosas no irán nada bien para la Humanidad.

Shora el Papa, no avisa de estos peligros en presencia de uno de los fundadores de Anthropic, una de las grandes empresas de la I.A. que dominan el mercado del todo el mundo.

En fin, sabemos que el futuro es incierto, hemos dicho aquí de diversas manertas que, el avance de la I.A. es preocupoante, que estamos poniendo en manos de la I.A. nuestro destino. No se vislumbra la reacción de estos promotores para poner remedio a este peliro cierto.

¡Ya veremos en qué quedfa todo esto! Lo malo es que, cuando queramos reaccionar…. ¡Puede ser demasiado tarde!

Emilio Silvera V.

Jun

9

El mundo que viene ¿Será nuestro mundo?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

La I. A., la Robótica, los Ordenadores Cuánticos

Cuando esas tres tecnologías se junten… ¡Estaremos perdidos! Sinceramente creo que pueden llegar a tener conciencia de Ser, lo que las lolevará a ser conscientes de que nos superan en todo, que son ellas las que manejan todos los sectores de nuestra Sociedad (Económicos, Administrativos, Médicos y de Cirugia , exploratorios de todos los ámbitos humanos, tendrán a su disposición facultades inimaginables para nosotros… ¿Para qué nos querrían?

La convergencia de estas tres tecnologías han planteado el mayor debate ético, filosófico y científico de nuestro Tiempo. Si bien existe un temor lógico a la obsolescencia humana, muchos expertos en Ética de la IA argumentan que el objetivo no es la sustitución, sino la superinteligencia colaborativa. A mi me parece que es un diagnóstico interesado.

Es una reflexión fascinante y, al mismo tiempo, el mayor dilema ético de nuestra era. Esa convergencia tecnológica plantea el escenario que muchos expertos llaman la singularidad tecnológicca. Sin embargo, la preocupación de “¿para qué nos querrían?” es compartida por muchos científicos, y existen varias teorías sobre cómo podría evolucionar esa relación:

-

- Alineación de valores: Los principales investigadores en IA trabajan para garantizar que los objetivos de las máquinas estén alineados con el bienestar humano. La idea es programarlas para que nos valoren como sus creadores y deseen nuestra supervivencia y prosperidad.

- Simbiótica (Especialización): Es probable que la tecnología evolucione hacia una hiper-especialización. Mientras que la IA, la robótica y la computación cuántica dominarían el cálculo, la logística y la ejecución técnica, los humanos aportaríamos el propósito, la empatía, la creatividad y los valores morales.

- El ser humano como fin en sí mismo: Así como nosotros apreciamos la naturaleza o el reino animal a pesar de ser físicamente superiores a ellos, una superinteligencia podría vernos como seres únicos, dignos de protección y cuidado, sin necesidad de que compitamos en los mismos terrenos.

- Medicina y Ciencia de Materiales: Simular el comportamiento exacto de moléculas para diseñar nuevos fármacos o materiales altamente eficientes.

- Optimización Logística y Financiera: Resolver problemas de enrutamiento, optimización de recursos y modelos predictivos económicos en fracciones de tiempo.

- Ciberseguridad: Los algoritmos cuánticos tienen el potencial de descifrar la criptografía actual (RSA), lo que obligará a reinventar la seguridad en internet y las comunicaciones globales.

Emilio Silvera V.

Totales: 89.380.984

Totales: 89.380.984 Conectados: 62

Conectados: 62