Feb

27

Algunas consideraciones sobre la Luz

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (2)

Comments (2)

Está claro que, los estudiosos de la época antigua estaban por completo a oscuras acerca de la naturaleza de la luz. Especulaban sobre que consistía en partículas emitidas por objetos relucientes o tal vez por el mismo ojo. Establecieron el hecho de que la luz viajaba en línea recta, que se reflejaba en un espejo con un ángulo igual a aquel con el que el rayo choca con el espejo, y que un rayo de luz se inclina (se refracta) cuando pasa del aire al cristal, al agua o a cualquier otra sustancia transparente.

Cuando la luz entra en un cristal, o en alguna sustancia transparente, de una forma oblicua (es decir, en un ángulo respecto de la vertical), siempre se refracta en una dirección que forma un ángulo menor respecto de la vertical. La exacta relación entre el ángulo original y el ángulo reflejado fue elaborada por primera vez en 1621 por el físico neerlandés Willerbrord Snell. No publicó sus hallazgos y el filósofo francés René Descartes descubrió la ley, independientemente, en 1637.

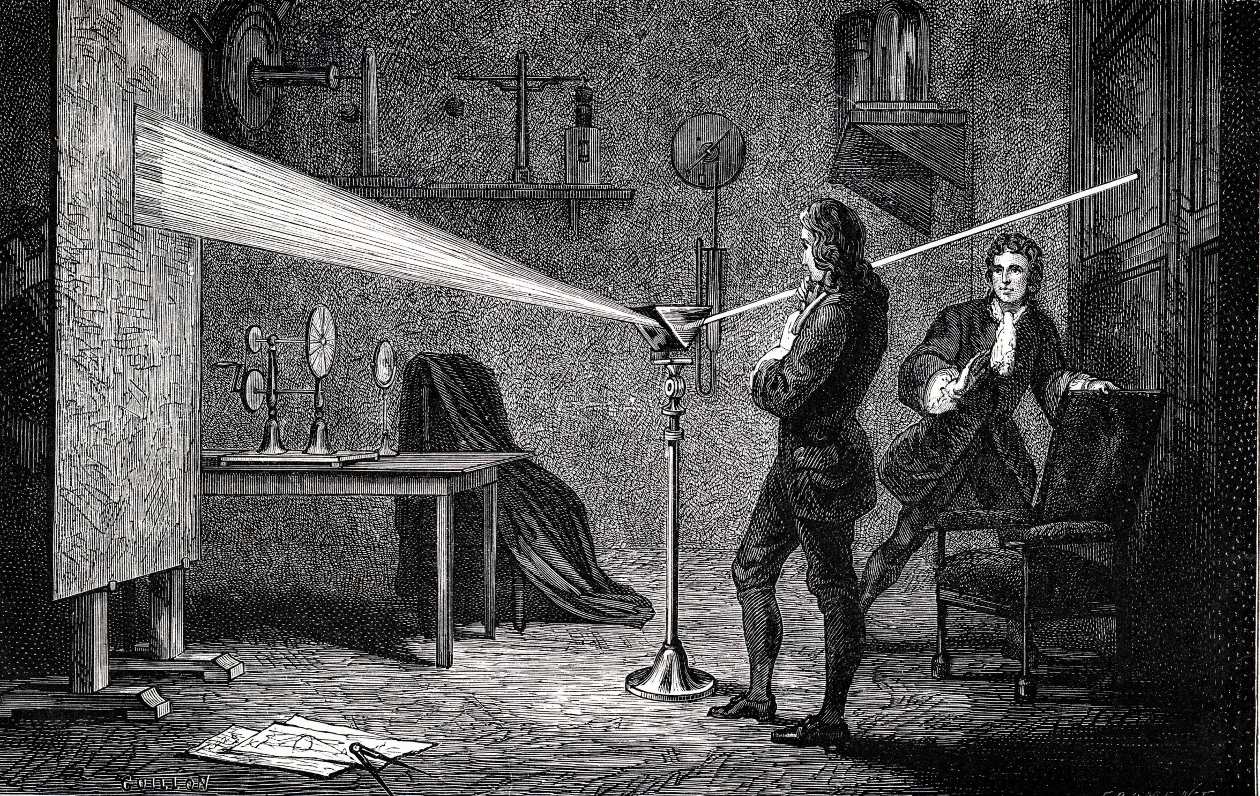

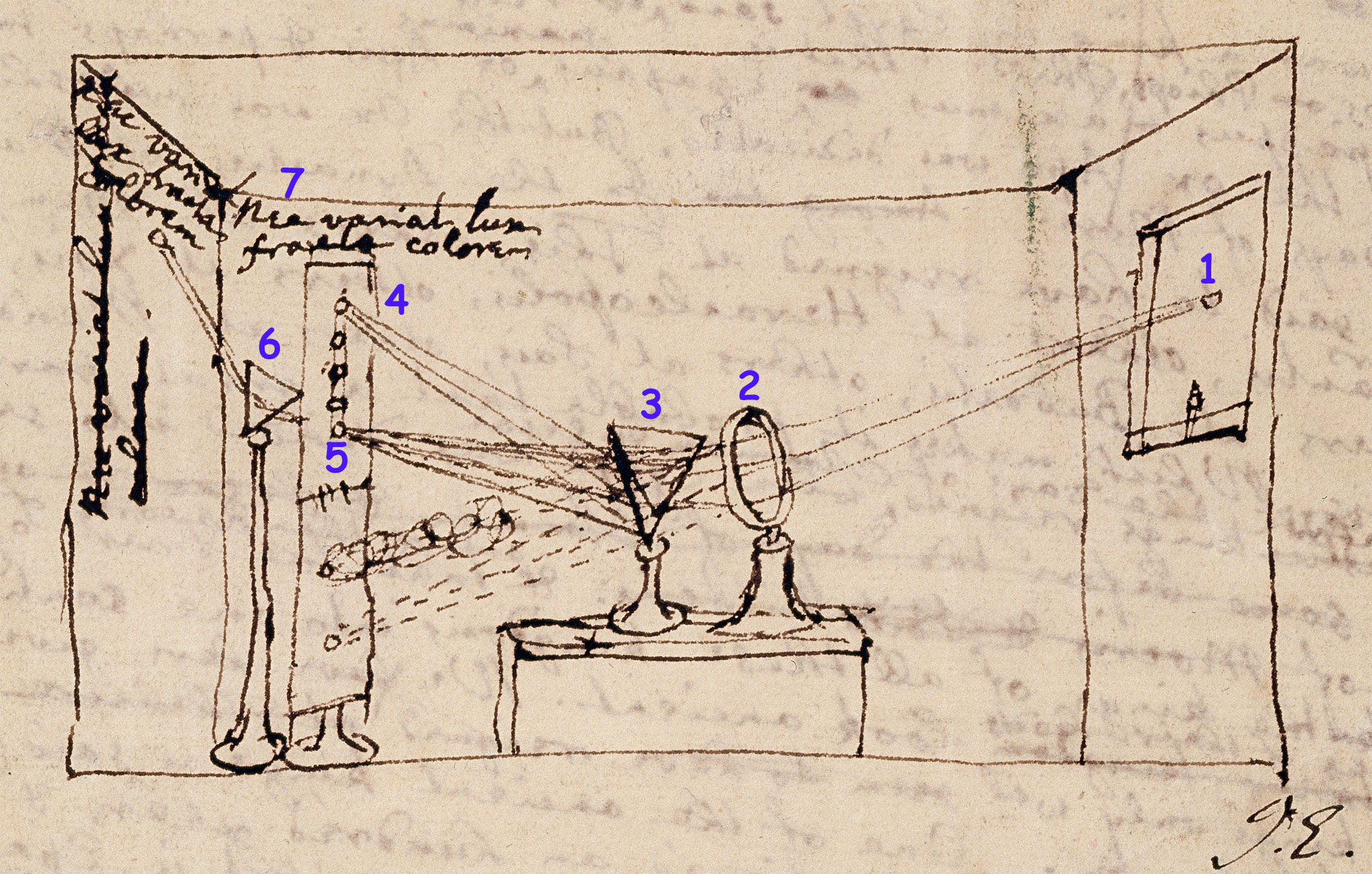

Los primeros experimentos importantes acerca de la naturaleza de la luz fueron llevados a cabo por Isaac Newton en 1666, al permitir que un rayo de luz entrase en una habitación oscura a través de una grieta e las persianas, cayendo oblicuamente sobre una cara de un prisma de cristal triangular. El rayo se refracta cuando entra en el cristal y se refracta aún más en la misma dirección cuando sale por una segunda cara del prisma. (Las dos refracciones en la misma dirección se originan por que los dos lados del prisma de se encuentran en ángulo en vez de en forma paralela, como sería el caso en una lámina ordinaria de cristal.)

Newton atrapó el rayo emergente sobre una pantalla blanca para ver el efecto de la refracción reforzada. Descubrió que, en vez de formar una mancha de luz blanca, el rayo se extendía en una gama de colores: rojo, anaranjado, amarillo, verde, azul, y violeta, en este orden.

Newton dedujo de ello que la luz blanca corriente era una mezcla de varias luces que excitaban por separado nuestros ojos para producir las diversas sensaciones de colores. La amplia banda de sus componentes se denominó spectrum (palabra latina que significa “espectro” “fantasma!.

Newton llegó a la conclusión de que la luz se componía de diminutas partículas (“corpúsculos”), que viajaban a enormes velocidades.

Le surgieron y se planteó algunas inquietudes cuestiones. ¿Por qué se refractaban las partículas de luz verde más que los de luz amarilla? ¿Cómo se explicaba que dos rayos de luz se cruzaran sin perturbase mutuamente, es decir, sin que se produjeran colisiones entre partículas?

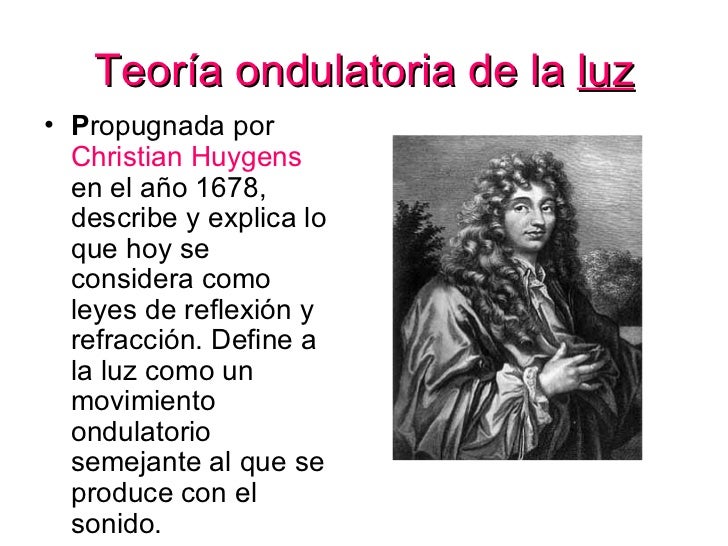

En 1678, el físico neerlandés Christian Huyghens (un científico polifacético que había construido el primer reloj de péndulo y realizado importantes trabajos astronómicos) propuso una teoría opuesta: la de que la luz se componía de minúsculas ondas. Y si sus componentes fueran ondas, no sería difícil explicar los diversos difracciones de los diferentes tipos de luz a través de un medio refractante, siempre y cuando se aceptara que la luz se movía más despacio en ese medio refractante que en el aire. La cantidad de refracción variaría con la longitud de las ondas: cuanto más corta fuese tal longitud, tanto mayor sería la refracción. Ello significaba que la luz violeta (la más sensible a este fenómeno) debía de tener una longitud de onda mas corta que la luz azul, ésta, más corta que la verde, y así sucesivamente.

Lo que permitía al ojo distinguir los colores eran esas diferencias entre longitudes de onda. Y, como es natural, si la luz estaba integrada por ondas, dos rayos podrían cruzarse sin dificultad alguna. (Las ondas sonoras y las del agua se cruzan continuamente sin perder sus respectivas identidades.)

Peor la teoría de Huyqhens sobre las ondas tampoco fue muy satisfactoria. No explicaba por qué se movían en línea recta los rayos luminosos; ni por qué proyectaban sobras recortadas; ni aclaraba por qué las ondas luminosas no podían rodear los obstáculos, del mismo modo que pueden hacerlo las ondas sonoras y de agua. Por añadidura, se objetaba que si la luz consistía en ondas, ¿cómo podía viajar por el vacío, ya que cruzaba el espacio desde el Sol y las Estrellas? ¿cuál era esa mecánica ondulatoria?

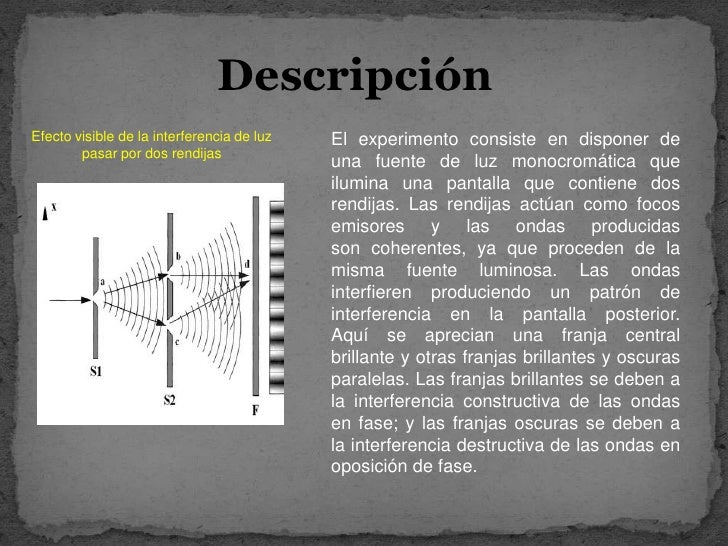

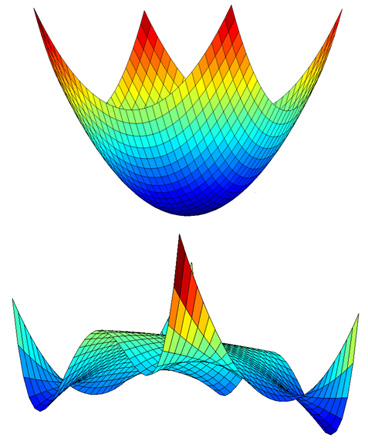

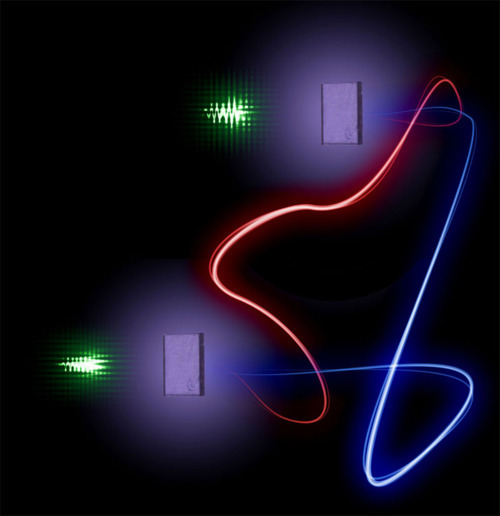

Aproximadamente durante un siglo, contendieron entre sí estas teorías. La teoría corpuscular, de Newton, fue, con mucho, la más popular, en parte, porque la respaldó el famoso nombre de su autor. Pero hacia 1801, un físico y médico ingles, de nombre Thomas Young, llevó a cabo un experimento que arrastró la opinión pública al campo opuesto. Proyectó un fino rayo luminoso sobre una pantalla, haciéndolo pasar antes por dos orificios casi juntos. Si la luz estuviera compuesta por partículas, cuando los dos rayos emergieran de ambos orificios, formarían presuntamente en la pantalla una región más luminosa donde se superpusieran, y regiones menos brillantes, donde no se diera tal superposición. Pero no fue esto lo que descubrió Young. La pantalla mostró una serie de bandas luminosas, separadas entre sí por bandas oscuras. Pareció incluso que, en esos intervalos de sombra, la luz de ambos rayos contribuía a intensificar la oscuridad.

Sería fácil explicarlo mediante la teoría ondulatoria. La banda luminosa representaba el refuerzo presado por las ondas de un rayo a las ondas del otro. Dicho de otra manera: Entraba “en fase” dos trenes de ondas, es decir, ambos nodos, al unirse, se fortalecían el uno al otro. Por otra parte, las bandas oscuras representaban puntos en que las ondas estaban “desfasadas” porque el vientre de una neutralizaba el nodo de la otra. En vez de aunar sus fuerzas, las ondas se interferían mutuamente, reduciendo la energía luminosa neta a las proximidades del punto cero.

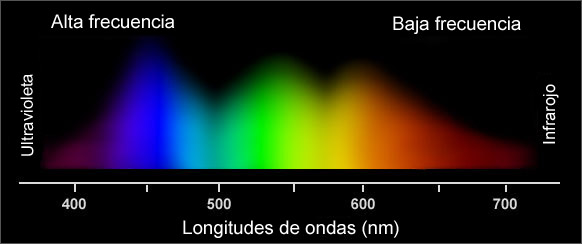

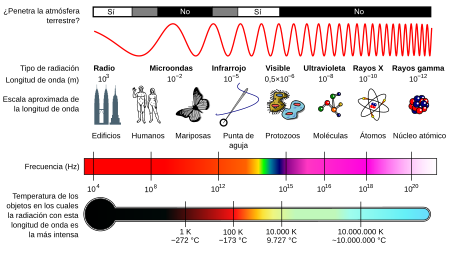

Considerando la anchura de las bandas y la distancia entre los dos edificios por los que surgen ambos rayos, se pudo calcular la longitud de las ondas luminosas, por ejemplo, de la luz roja a la violeta o los colores intermedios. Las longitudes de onda resultaron ser muy pequeñas. Así, la de la luz roja era de unos 0’000075 cm. (Hoy se expresan las longitudes de las ondas luminosas mediante una unidad muy práctica ideada por Angströn. Esta unidad, denominada, en honor a su autor Ángstrom (Á), es la cienmillonésima parte de un centímetro. Así, pues, la longitud de onda de la luz roja equivale más o menos a 7.500 Á, y la de la luz violeta, a 3.900 Å, mientras que las de colores visibles en el espectro oscilan entre ambas cifras.)

La cortedad de estas ondas es muy importante. La razón de que las ondas luminosas se desplacen en línea recta y proyecten sombras recortadas se debe a que todas son incomparablemente más pequeñas que cualquier objeto; pueden contornear un obstáculo sólo si éste no es mucho mayor que la longitud de onda. Hasta las bacterias, por ejemplo, tienen un volumen muy superior de una onda luminosa y, por tanto, la luz puede definir claramente sus contornos bajo el microscopio. Sólo los objetos cuyas dimensiones se asemejan a la longitud de la onda luminosa (por ejemplo, los virus y otras partículas submicroscópicas) son lo suficientemente pequeños como para que puedan ser contorneados por las ondas luminosas.

Thomas Young Augustin Fresnel

Un físico francés, Augustin-Jean Fresnel, fue quien demostró por vez primera, en 1818, que si un objeto es lo suficientemente pequeño, la onda luminosa lo contorneará sin dificultad. En tal caso, la luz determina el llamado fenómeno de “difracción”. Por ejemplo, las finísimas líneas paralelas de una “reja de disfracción” actúan como una serie de minúsculos obtáculos, que se refuerzan entre si. Puesto que la magnitud de la difracción va asociada a la longitud de onda, se produce el espectro. A la inversa, se puede calcular la longitud de onda midiendo la difracción de cualquier color o porción del espectro, así como la separación de las marcas sobre el cristal.

Espectro solar con las líneas de Fraunhofer como aparecen visualmente.

Fraunhofer exploró dicha reja de difracción con objeto de averiguar sus finalidades prácticas, progreso que suele olvidarse, pues queda eclipsado por su descubrimiento más famoso: los rayos espectrales. El físico americano Henry Augustus Rowlane ideó la reja cóncava y desarrolló técnicas para regularlas de acuerdo con 20.000 líneas por pulgada. Ello hizo posible la sustitución del prisma por el espectroscopio.

Ante tales hallazgos experimentales, más el desarrollo metódico y matemático del movimiento ondulatorio, debido a Fresnel, pareció que la teoría ondulatoria de la luz había arraigado definitivamente, desplazando y relegando para siempre a la teoría corpuscular.

No sólo se aceptó las existencias de ondas luminosas, sino que también se midió su longitud con una precisión cada vez mayor. Hacia 1.827, el físico francés Jacques Babinet sugirió que se empleara la longitud de onda luminosa (una cantidad física inalterable) como unidad para medir tales longitudes, en vez de las muy diversas unidades ideadas y empleadas por el hombre. Sin embargo, tal sugerencia no se llevó a la práctica hasta 1.880 cuando el físico germano-americano Albert Abraham Michelson inventó un instrumento, denominado “interferómetro”, que podía medir las longitudes de ondas luminosas con una exactitud sin precedentes. En 1893, Michelson midió la onda de la raya roja en el espectro del cadmio y determinó que su longitud era de 1/1.553.164 m.

Pero la incertidumbre reapareció al descubrirse que los elementos estaban compuestos por isótopos diferentes, cada uno de los cuáles aportaba una raya cuya longitud de onda difería ligeramente de las restantes. En la década de 1.930 se midieron las rayas del criptón 86. Como quiera que este isótopo fuera gaseoso, se podía abordar con bajas temperaturas, para frenar el movimiento atómico y reducir el consecutivo engrosamiento de la raya.

En 1960, el Comité Internacional de Pesos y Medidas adoptó la raya del criptón 86 como unidad fundamental de longitud. Entonces se restableció la longitud de metro como 1.650.763’73 veces la longitud de onda de dicha raya espectral. Ello aumento mil veces la precisión de las medidas de longitud. Hasta entonces se había medido el antiguo metro patrón con un margen de error equivalente a una millonésima, mientras que en lo sucesivo se pudo medir la longitud de onda con un margen de error equivalente a una milmillonésima.

Ahora, después de todo esto, sabemos algo más sobre la luz.

Pero ¿Qué pasa con su velocidad?

¡Veámoslo!

LA VELOCIDAD DE LA LUZ

Está claro que, la luz se desplaza a enormes velocidades. Si pulsamos el interruptor de apagado de la lámpara de nuestro salón, todo queda a oscuras de manera instantánea.

La velocidad del sonido es más lenta, por ejemplo, si vemos a un leñador que está cortando leña en un lugar alejado de nosotros, sólo oiremos los golpes momentos después de que caiga el hacha. Así, pues, el sonido tarda cierto tiempo en llegar a nuestros oídos. En realidad es fácil medir la velocidad de su desplazamiento: unos 1.206 km/h en el aire y a nivel del mar.

Poca seguridad podía dar aquel rústico medio

Galileo fue el primero en intentar medir la velocidad de la luz. Se colocó en lo alto de una colina, mientras que su ayudante, se situaba en otro lugar alto de la colina vecina; luego sacó una linterna encendida: tan pronto como su ayudante vió la luz, hizo una señal con otra linterna. Galileo repitió el experimento a distancias cada vez mayores, suponiendo que el tiempo requerido por su ayudante para responder mantendría una uniformidad constante, por lo cual, el intervalo entre la señal de su propia linterna y la de su ayudante representaría el tiempo empleado por la luz para recorrer cada distancia. Aunque la idea era lógica, la luz viajaba demasiado aprisa como para que Galileo pudiera percibir las sutiles diferencias con un método tan rudimentario.

Esta es la distancia que recorre la luz desde el Sol hasta la Tierra… ¡150.000.000 Km.!

En 1676, el astrónomo danés Olau Roemer logró cronometrar la velocidad de la luz a escala de distancias astronómicas. Estudiando los eclipses de Júpiter en sus cuatro grandes satélites, Roemer observó que el intervalo entre eclipses consecutivos era más largo cuando la Tierra se alejaba de Júpiter, y más corto cuado se movía en su órbita hacía dicho astro. Al parecer, la diferencia entre las duraciones del eclipse reflejaba la diferencia de distancias entre la Tierra y Júpiter. Y trataba, pues, de medir la distancia partiendo del tiempo empleado por la luz para trasladarse desde Júpiter hasta la Tierra. Calculando aproximadamente el tamaño de la órbita terrestre y observando la máxima discrepancia en las duraciones del eclipse que, según Roemer, representaba el tiempo que necesitaba la luz para atravesar el eje de al órbita terrestre, dicho astrónomo computó la velocidad de la luz. Su resultado, de 225.000 km/s., parece excelente si se considera que fue el primer intento, y resultó bastante asombroso como para provocar la incredulidad de sus coetáneos.

Sin embargo, medio siglo después se confirmaron los cálculos de Roemer en un campo totalmente distinto. Allá por 1728, el astrónomo británico James Bradley descubrió que las estrellas parecían cambiar de posición con los movimientos terrestres; y no por el paralaje, sino porque la traslación terrestre alrededor del Sol era una fracción mensurable (aunque pequeña) de la velocidad de la luz. La analogía empleada usualmente es la de un hombre que camina con el paraguas abierto bajo un temporal. Aun cuando las gotas caigan verticalmente, el hombre debe inclinar hacia delante el paraguas, porque ha de abrirse paso entre las gotas.

Cuanto más acelere su paso, tanto más deberá inclinar el paraguas. De manera semejante la Tierra avanza entre los ligeros rayos que caen desde las estrellas, y el astrónomo debe inclinar un poco su telescopio y hacerlo en varias direcciones, de acuerdo con los cambios de la trayectoria terrestre (no olvidemos que nuestro planeta Tierra, es como una enorme nave espacial que nos lleva en un viaje eterno, alrededor del Sol, a la velocidad de 30 km/s. + -) Mediante ese desvío aparente de los astros (“aberración de la luz”), Bradley pudo evaluar la velocidad de la luz y calcularla con gran precisión.

Sus cálculos fueron de 285.000 km/s, bastante más exacto que los de Roemer, pero aún un 5’5% más bajos.

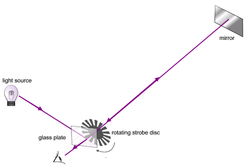

Poco a poco, con medios tecnológicos más sofisticados y más conocimientos matemáticos, los científicos fueron obteniendo medidas más exactas aún, conforme se fue perfeccionando la idea original de Galileo y sus sucesores.

En 1849, el físico francés Armand-Hippolyte-Louis Eizeau ideó un artificio mediante el cual se proyectaba la luz sobre un espejo situado a 8 km de distancia, que devolvía el reflejo al observador. El tiempo empleado por la luz en su viaje de ida y vuelta no rebasó apenas la 1/20.000 de segundo, por Fizeau logró medirlo colocando una rueda dentada giratoria en la trayectoria del rayo luminoso. Cuando dicha rueda giraba a cierta velocidad, regulada, la luz pasaba entre los dientes y se proyectaba contra el siguiente, al ser devuelta por el espejo; así, Fizeau, colocado tras la rueda, no pudo verla. Entonces se dio más velocidad a la rueda, y el reflejo pasó por la siguiente muesca entre los dientes, sin intercepción alguna. De esa forma, regulando y midiendo la velocidad de la rueda giratoria, Fizeau pudo calcular el tiempo transcurrido y, por consiguiente, la velocidad a que se movía el rayo de luz.

Animación del Péndulo de Foucault oscilando en el hemisferio sur

Un año más tarde, Jean Foucault (quien realizaría poco después su experimento con los péndulos) precisó más estas medidas empleando un espejo giratorio en ve de una rueda dentada. Entonces se midió el tiempo transcurrido desviando ligeramente el ángulo de reflexión mediante el veloz espejo giratorio. Foucault obtuvo un valor de la velocidad de la luz de 300.883 km/s. También, el físico francés utilizó su método para determinar la velocidad de la luz a través de varios líquidos. Averiguó que era notablemente inferior a la alcanzada en el aire. Esto concordaba también con la teoría ondulatoria de Huyghens.

Interferómetro de Michelson:

A – Fuente de luz monocromática

B – Espejo semi-reflectante

C – Espejos

D – Diferencia de camino.

Michelson fue más preciso aún en sus medidas. Este autor, durante cuarenta años largos, a partir de 1879, fue aplicando el sistema Fizeau-Foucault cada vez con mayor refinamiento, para medir la velocidad de la luz. Cuando se creyó lo suficientemente informado, proyectó la luz a través de vacío, en vez de hacerlo a través del aire, pues este frena ligeramente su velocidad, y, empleó para ello tuberías de acero cuya longitud era superior a 1’5 km. Según sus medidas, la velocidad de la luz en el vacío era de 299.730 km(seg. (sólo un 0’006% más bajo). Demostraría también que todas las longitudes de ondas luminosas viajan a la misma velocidad en el vacío.

Desde Galileo con sus lámparas, cada vez se han utilizado aparatos más sofisticados para medir la velocidad de la luz, y, finalmente, se consiguió medirla …

En 1972, un equipo de investigadores bajo la dirección de Kenneth M. Eveson efectuó unas mediciones aún más exactas y vio que la velocidad de la luz era de 299.727’74 km/seg. Una vez se conoció la velocidad de la luz con semejante precisión, se hizo posible usar la luz, o por lo menos formas de ella, para medir distancias.

Aunque para algunos resulte alto tedioso el tema anterior, no he podido resistirme a la tentación de exponerlo, así podrá saber algo más sobre la luz y, habrán conocido a personajes que hicieron posible el que ahora nosotros, la conozcamos mejor.

La luz es tan importante para todos como el aire y el agua

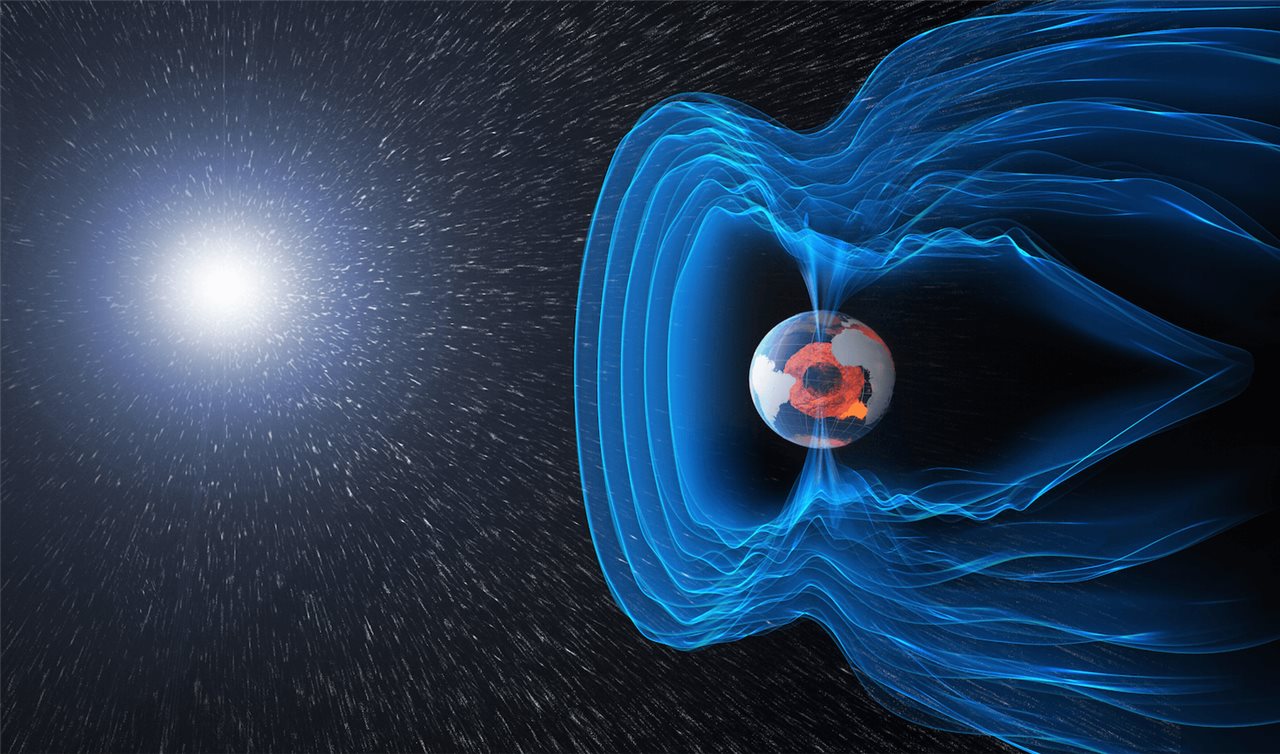

Podría continuar, hasta el final de este trabajo, hablando de la luz y sus distintas formas o aplicaciones: ondas de luz a través del espacio, de cómo se transmite la luz en el “vacío”, nos llega a través del espacio desde Galaxias situadas a miles de millones de años luz; las líneas de fuerzas electromagnéticas de Faraday y Maxwell de campos eléctricos y magnéticos cambiantes (todo ello explicado en un simple conjunto de cuatro ecuaciones, que describían casi todos los fenómenos referentes a esta materia electromagnética), o de los enigmas aún por descubrir (aunque predichos).

Este comentario ya se hizo algo largo y, desde luego, mi último deseo es aburrir al lector, así que dejaremos para otro día una continuación sobre lo que es la luz, aunque, eso sí, no me quiero despedir sin dejar claro que, también todos nosotros somos… ¡LUZ!

Emilio Silvera V.

Feb

26

¡Qué maravilla! Poder imaginar…y comprobar

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (1)

Comments (1)

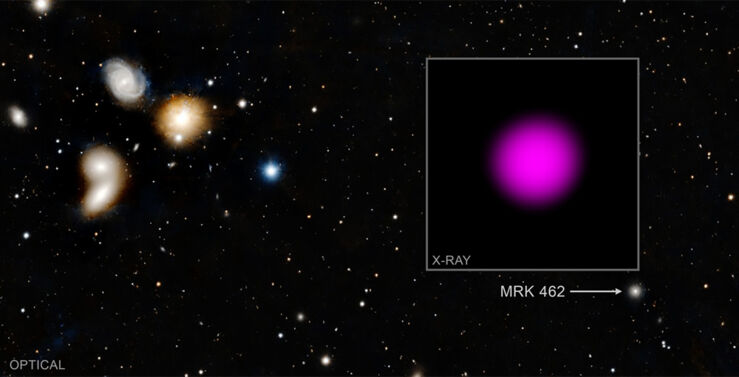

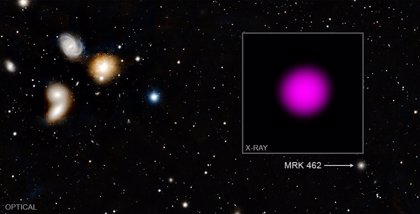

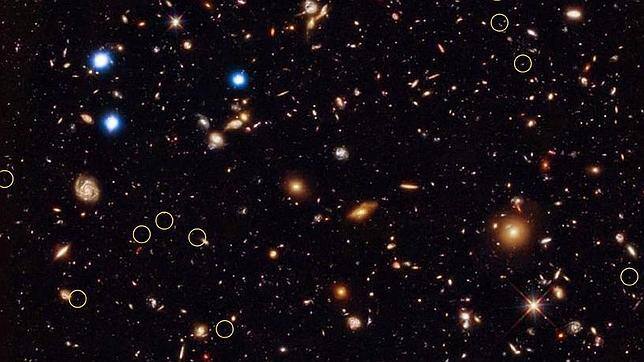

¿Mini agujeros negros que atraviesan la Tierra a diario?

Algunos consideran que unos 400 mini agujeros negros podrían atravesar la Tierra cada año. Además, podrían ser detectables por sus fuertes emisiones electromagnéticas. Quizás ha llegado la hora de buscarlas. Cosas como esta se leen de vez en cuando y también otras que…

“Como si de fantasmas cósmicos se tratase, es posible que agujeros negros en miniatura atraviesen la Tierra diariamente sin crear ningún peligro, como sugiere un estudio reciente.”

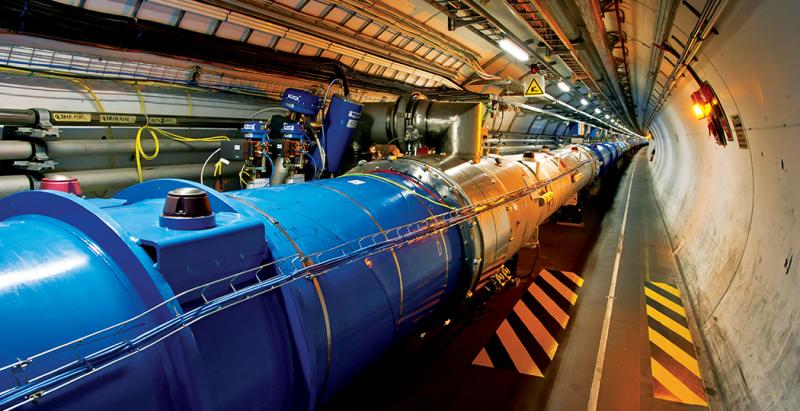

Esta nueva teoría pone fin al temor de que poderosas máquinas como el Gran Colisionador de Hadrones puedan crear agujeros negros capaces de tragarse el planeta.

Los autores del estudio creen que estos minúsculos agujeros negros tienen un comportamiento completamente distinto al de sus hermanos mayores, llamados agujeros negros astrofísicos o de masa estelar.

“Los micro-agujeros negros son objetos hipotéticos subatómicos extremadamente pequeños, con masas inferiores a la estelar, de donde la mecánica cuántica es crucial. Propuestos teóricamente, podrían haberse formado tras el Big Bang. Se cree que se evaporan instantáneamente a través de la radiación de Hawking.”

” los micro-agujeros es diferente en ese aspecto, puesto que la pequeña masa de un micro-agujero negro podría ser del orden de la masa de Planck, que es aproximadamente 2 × 10−8 kg o 1,1 × 1019 GeV. A esta escala, la fórmula de la termodinámica del agujero negro predice que el miniagujero negro podría tener una entropía de sólo 4π nats; una temperatura Hawking de, requiriendo energía térmica cuántica comparable aproximadamente a la masa del mini-agujero negro completo; y una longitud de onda Compton equivalente al radio de Schwarzschild del agujero negro (esta distancia siendo equivalente a la longitud de Planck). Este es el punto donde la descripción gravitacional clásica del objeto no es válida.”

A pesar de tener la masa de aproximadamente mil coches, un mini agujero negro es más pequeño que un átomo. Con ese tamaño un agujero negro no podría atraer mucha materia y en su lugar atraparía átomos y algunas moléculas más grandes a órbitas circulares, al igual que los protones atraen a los electrones en los átomos.

Así, los autores del estudio llaman a los mini agujeros negros que atraen materia a las órbitas «equivalentes gravitatorios de los átomos».”

¿Os acordáis? Tanto miedo a que el Gran Colisionador de Hadrones (LHC) de Ginebra formara un agujero negro que podría haber atraído toda la materia a su alrededor y que pudiera haber destruido el planeta y resulta que, según un grupo de investigadores, es posible que este tipo de fenómenos, al menos los que son muy diminutos, atraviesen la Tierra cada día sin que ocurra absolutamente nada, son inofensivos y su ínfimo tamaño los hace inofensivos. Y esto, según un atrevido estudio publicado por una pareja de físicos en arXiv. org, porque quizás interactúen con la materia de forma muy diferente a como se creía hasta ahora.

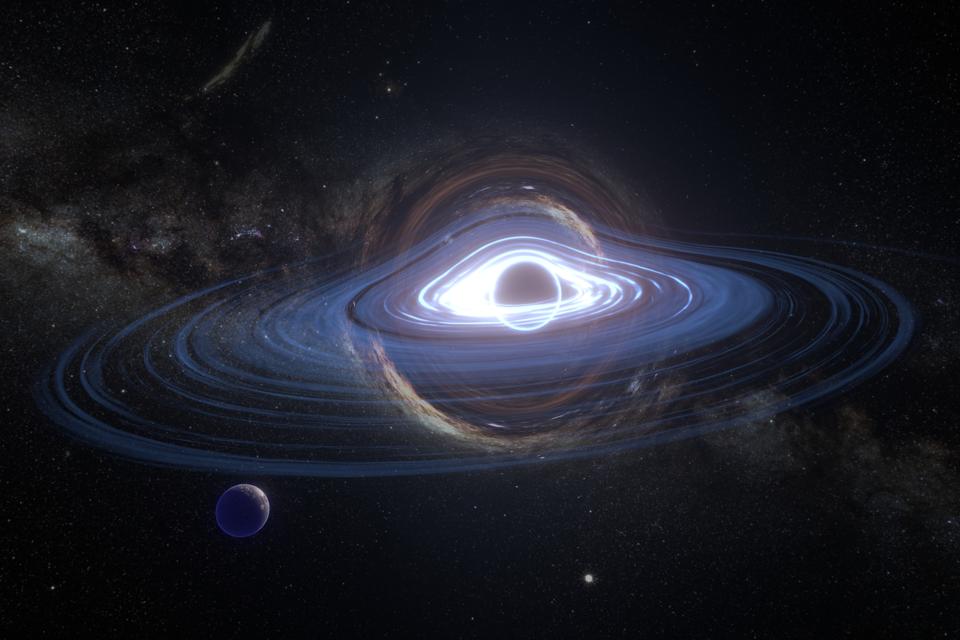

Los mini agujeros negros (si realmente existen) podrían ser diferentes a los gigantes que nos ha enseñado la astrofísica y cuya imagen todos tenemos en la cabeza. Los agujeros astrofísicos se originan cuando se colapsan las grandes estrellas para crear una región en el espacio cuya gravedad es tan potente que nada puede escapar a su atracción. Sus dimensiones son monstruosas. El que se encuentra en el centro de nuestra galaxia tiene 4 millones de veces la masa del Sol.

Si alguna vez existieron nunca ningún ingenio tecnológico lo pudo captar

“Las unidades de Planck o unidades naturales son un sistema de unidades propuesto por primera vez en 1899 por Max Planck. El sistema mide varias de las magnitudes fundamentales del universo: tiempo, longitud, masa, carga eléctrica y temperatura. El sistema se define haciendo que las cinco constantes físicas universales de la tabla tomen el valor 1 cuando se expresen ecuaciones y cálculos en dicho sistema.”

Todo esto me recuerda lecturas en las que, un gran físico, Gerard ´t Hooft, nos contaba como había dedicado gran parte de su tiempo al estudio y la investigación del comportamiento de los agujeros negros y de cómo las consideraciones obtenidas le llevaron a ese alto nivel sobre las leyes últimas de la física. Él suponía tener un pequeño agujero negro que obedecía tanto a las leyes de la mecánica cuántica como a las de la gravedad y, se preguntaba: ¿Cómo se debería describir su comportamiento?

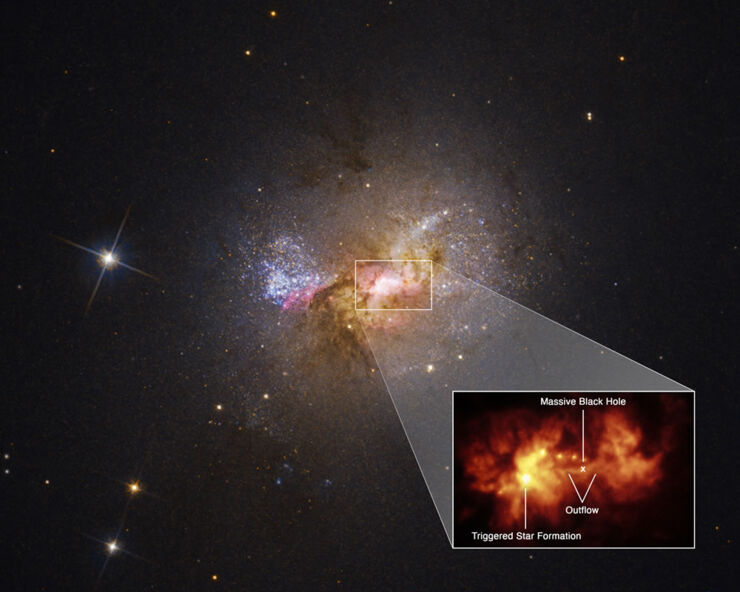

El enorme agujero negro que habita en el centro de la Galaxia

El enorme objeto situado en el centro de la galaxia es invisible. Pero la imagen obtenida este año del remolino de plasma que rodea sus bordes ayudará a revelar más sobre la historia y la evolución de la galaxia.

¿Se comportaría ese agujero negro como si fuera un átomo o molécula que obedece las leyes de la mecánica cuántica? No todo el mundo está de acuerdo con ese punto de vista. Algunos dicen que los agujeros negros son algo totalmente diferentes. ¿Pero que es tan diferente en ellos? Los agujeros negros emiten partículas, igual que hacen los átomos radiactivos. Entonces, ¿por qué no deberían seguir las mismas reglas? Para decirlo de otra manera más clara, ´t Hooft creía que ellos tenían que obedecer absolutamente esas leyes si tenemos que creer en alguna clase de “ley y orden” a escala de la longitud de Planck.

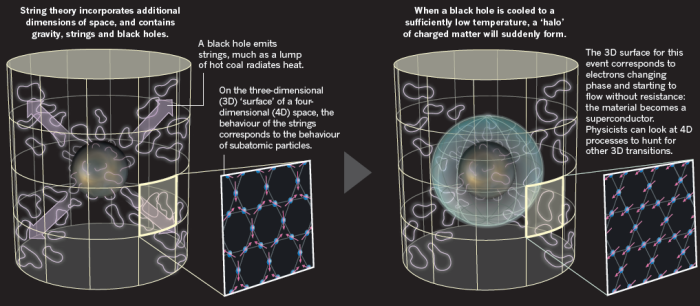

Uno de los resultados de sus cálculos le produjo una enorme sorpresa. ¡Se encontró prácticamente con las mismas expresiones matemáticas que las de la Teoría de cuerdas! La fórmula para la captura y emisión de partículas por un agujero negro es exactamente igual a la fórmula de Veneziano. Aquello era extraño ya que no era un tema de cuerdas.

Muchas son las sorpresas que nos darán todavía los agujeros negros que esconden muchos secretos sin desvelar. No sabemos de que clase de materia está hecha la singularidad.

Claro que la teoría de cuerdas está por acabar y es difícil predecir si finalmente será compatible con la teoría de la Gravedad. En cualquier caso, ambas teorías están incompletas y tienen mucho más que decir…en el futuro. Seguramente serán simplemente los comienzos de algo mucho más profundo y bello que, de una vez por todas nos explique como es, en realidad, el Universo que habitamos.

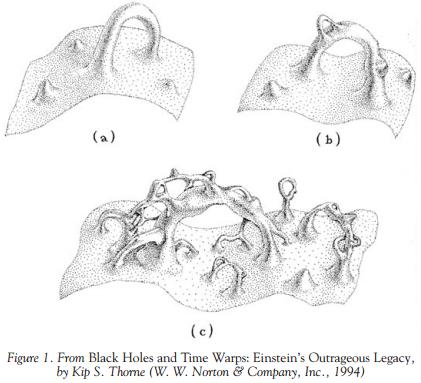

La deformación del espacio-tiempo, de la materia, las transiciones de fase aún no comprendidas, lo que hay más allá de los Quarks, esas cuerdas vibrantes que se suponen…serán el primer estadio de la materia. Si creemos a Stephen Hawking, los agujeros negros son sólo el principio de algo más profundo, de una deformación mucho más seria del “espacio-tiempo espumoso”.

Allí donde está presente la espuma cuántica de la que hablaban Wheeler y Planck. Y eso no es todo. Algunos como el mismo Hawking y sobre todo Sydney Coleman de Harvard, especulan con el papel que en todo esto juegan los “agujeros de gusano”, esos conductos del espacio-tiempo que nos podrían llevar hacia otras latitudes muy lejanas e incluso, hacia otras galaxias. Tales rarezas son admitidas por la teoría de Einstein y, como nuestra imaginación es imparable… Pasa lo mismo que ocurre en la mecánica cuántica, en la que todo lo que está permitido sucede obligatoriamente, es decir, si alguna configuración es posible, ésta tiene una probabilidad de que realmente ocurra.

Claro que, seguramente y al final del camino, los agujeros de gusano sólo serían una semilla que daría lugar al nacimiento de una teoría mejor, más avanzada y fiable que nos marcara el verdadero camino para burlar el muro que supone la velocidad de la luz sin tener que violar esa constante.

¡Nuestra curiosidad! Siempre buscando respuestas

Muchas son las cosas que aún nos resultan misteriosas pero, ¿Qué alcanzaremos en el futuro? ¿Podremos realmente dominar y disponer de la energía de Planck que nos lleve hasta lugares inimaginables? ¿Serán nuestras mentes capaces de evolucionar hasta el extremo de que, algún día muy lejano en el futuro pudiéramos estar conectados con el ritmo vital del Universo, la energía pura que todo lo rige? Manejar esas potentes energías sería manejar los mundos, el espacio y, sobre todo, el Tiempo tan vital para nosotros.

¡Atravesar la pared y salir por el otro lado! El principio de incertidumbre da lugar también a un efecto curioso conocido como efecto túnel: si se dispara un perdigón de plástico contra un muro el perdigón rebotará, porque no tiene energía suficiente para penetrarlo, pero a nivel de partículas fundamentales, la mecánica cuántica muestra inequívocamente que las funciones de onda de las partículas que constituyen el perdigón tienen todas ellas una parte diminuta que SÍ SALE a través del muro. ¿

Está claro que si nos dejamos llevar por nuestras elucubraciones, sin querer, nos metemos en terrenos donde las ideas comienzan a ser extravagantes, entramos en el ámbito de la filosofía y, ¿por qué no? en el de la ciencia ficción pensando en lo que podría ser. Comenzamos a imaginar como viajerémos en el futuro imitando a los electrones cuando dan su “salto cuántico” y, de esa manera, iremos tan ricamente de un universo a otro al dominar esa cosmología cuántica que nos permitirá realizar ¡tántas maravillas!

Así, las partículas microscópicas pueden tomar prestada energía suficiente para hacer lo que es imposible desde el punto de vista de la física clásica, es decir abrirse camino, como por un túnel, a través del muro ( aunque dado la enorme cantidad de partículas que posee el muro el efecto túnel se vuelve muy improbable pues todas y cada una de las partículas tendrían que tener la suerte de poder abrirse camino juntas

Esta escena que la hemos visto en muchas películas, sólo podría ser posible si no estuvieran los electrones rodeando a los átomos que conforman la pared. Cuando batimos palmas, por ejemplo, nuestras manos no pasan la una a través de la otra precisamente por eso, porque los electrones lo impiden y forman un caparazón electromagnético alrededor de todos los átomos que componen nuestras manos que, al batirlas chocan entre sí.

Quién no ha penado alguna vez lo que haría si pudiera viajar en el Tiempo

Cuando dejamos volar nuestra imaginación ayudada por los pocos conocimientos que de las cosas tenemos, podemos llegar a conclusiones realmente curiosas.

Emilio Silvera V.

Feb

22

Simetría CP y otros aspectos de la Física

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

Han observado la rotura de simetría de la inversión temporal en un superconductor de fermiones pesados.

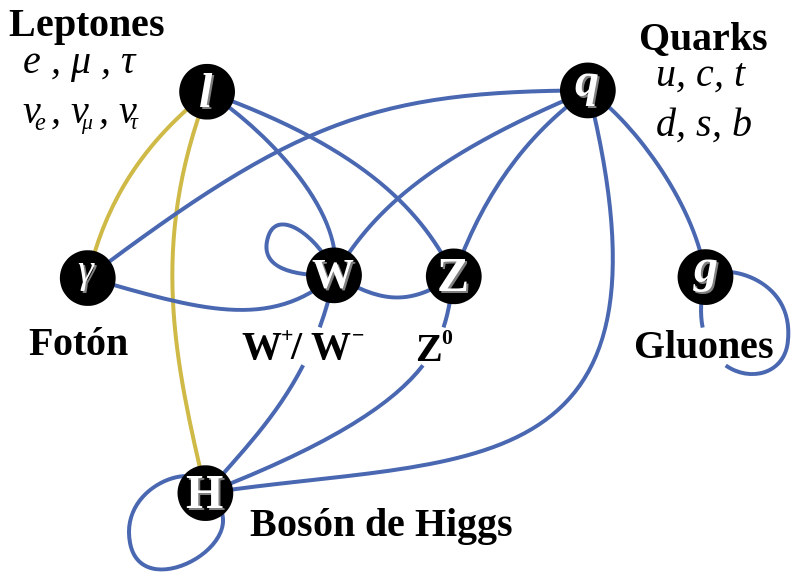

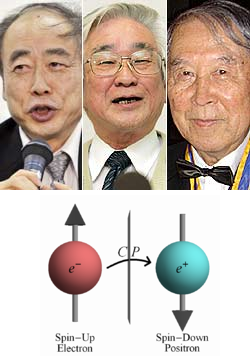

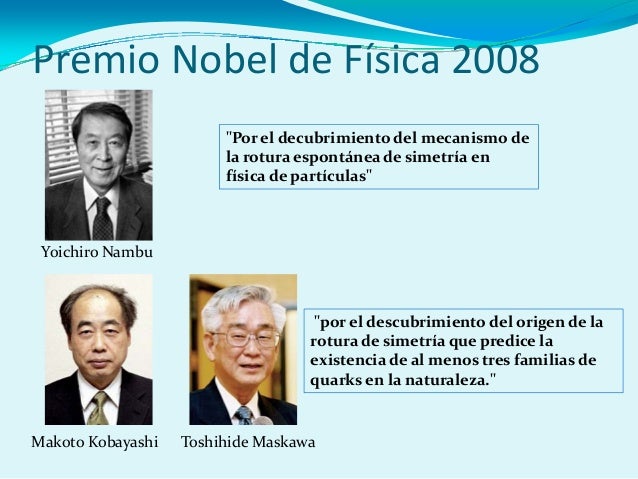

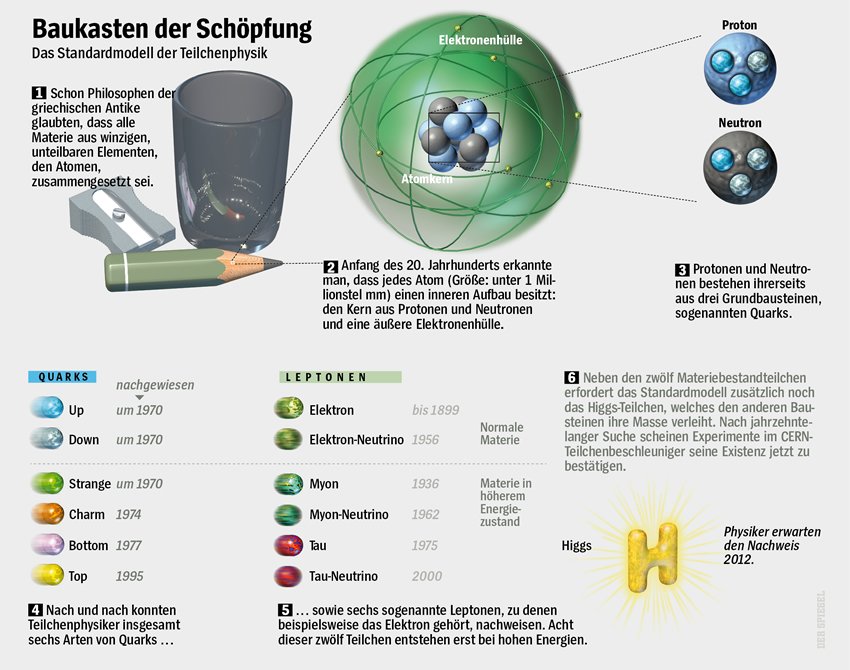

Hace algunos años de la finalización del LHC del CERN, el año del inicio de la búsqueda del bosón de Higgs y los premios Nóbel de Física no podían estar fuera de esta tormenta mediática. ¿A quién premiar? Obviamente a investigadores relacionados con la ruptura espontánea de la simetría (el bosón de Higgs es resultado de este proceso) y con la generación de masas a las partículas elementales como los quarks («algún» bosón de Higgs se cree que es responsable de este proceso).”

La Física de la Mula Francis

La Simetría CP en el ojo del Huracán

“Los quarks al otro lado del espejo. Científicos del Laboratorio Nacional Jefferson Lab (EEUU) han verificado la rotura de la simetría de paridad (también llamada simetría del espejo) en los quarks mediante el bombardeo de núcleos de deuterio con electrones de alta energía. Los núcleos de deuterio están formados por un protón y un neutrón, es decir, por tres quarks arriba y tres quarks abajo. La dispersión inelástica entre un electrón y un quark, es decir, su colisión, está mediada por la interacción electrodébil, tanto por la fuerza electromagnética como por la fuerza débil. Esta última es la única interacción fundamental que viola la simetría de paridad.”

Tenemos que saber cómo la violación de la simetría CP (el proceso que originó la materia) aparece, y, lo que es más importante, hemos de introducir un nuevo fenómeno, al que llamamos campo de Higgs, para preservar la coherencia matemática del modelo estándar. La idea de Higgs, y su partícula asociada, el bosón de Higgs, cuenta en todos los problemas que he mencionado antes. Parece, con tantos parámetros imprecisos (19) que, el modelo estándar se mueve bajo nuestros pies.

Como un apunte intermedio digamos que; “El Modelo Estándar tiene simetrías locales que dan lugar a las cuatro interacciones fundamentales: gravitatoria, electromagnética, fuerte y débil. Pero estas simetrías prohíben en principio que las partículas tengan masa. El problema se resuelve cuando (algunas de) esas simetrías se rompen espontáneamente (se camuflan), gracias al valor en el vacío de un nuevo campo, el campo de Higgs.”

Parece que la Relatividad y la Teoría cuántica no quieren llevarse bien, habitan en “universos” diferentes

Entre los teóricos, el casamiento de la relatividad general y la teoría cuántica es el problema central de la física moderna. A los esfuerzos teóricos que se realizan con ese propósito se les llama “supergravedad”, “súpersimetría”, “supercuerdas” “teoría M” o, en último caso, “teoría de todo o gran teoría unificada”.

La Física nos lleva de vez en cuando a realizar viajes alucinantes. Se ha conseguido relacionar y vibrar a dos diamantes en el proceso conocido como entrelazamiento cuántico. El misterioso proceso, al que el propio Eisntein no supo darle comprensión completa, supone el mayor avance la fecha y abre las puertas de la computación cuántica. que nos hagamos una idea del hallazgo, en 1935 Einstein lo llegó a denominar la “acción fantasmal a distancia”. Un efecto extraño en donde se conecta un objeto con otro de manera que incluso si están separados por grandes distancias, una acción realizada en uno de los objetos afecta al otro.

Ahí tenemos unas matemáticas exóticas que ponen de punta hasta los pelos de las cejas de algunos de los mejores matemáticos del mundo (¿y Perelman? ¿Por qué nos se ha implicado?). Hablan de 10, 11 y 26 dimensiones, siempre, todas ellas espaciales menos una que es la temporal. Vivimos en cuatro: tres de espacio (este-oeste, norte-sur y arriba-abajo) y una temporal. No podemos, ni sabemos o no es posible instruir, en nuestro cerebro (también tridimensional), ver más dimensiones. Pero llegaron Kaluza y Klein y compactaron, en la longitud de Planck las dimensiones que no podíamos ver. ¡Problema solucionado! Pero se sigue hablando de partículas supersimétricas.

¿Quién puede ir a la longitud de Planck para verlas?

La puerta de las dimensiones más altas quedó abierta y, a los teóricos, se les regaló una herramienta maravillosa. En el Hiperespacio, todo es posible. Hasta el matrimonio de la relatividad general y la mecánica cuántica, allí si es posible encontrar esa soñada teoría de la Gravedad cuántica.

Así que, los teóricos, se han embarcado a la búsqueda de un objetivo audaz: buscan una teoría que describa la simplicidad primigenia que reinaba en el intento calor del universo en sus primeros tiempos, una teoría carente de parámetros, donde estén presentes todas las respuestas. Todo debe ser contestado a partir de una ecuación básica.

¿Dónde radica el problema?

Llegar a la “escala de cuerdas” (o escala de Planck), que se estima en torno a los (1019 GeV (1028 eV), es uno de los mayores desafíos científicos teóricos y experimentales. Esta energía es necesaria para observar las cuerdas fundamentales de la teoría de supercuerdas, ya que se cree que operan a distancias increíblemente pequeñas, del orden de metros.

El problema está en que la única teoría candidata no tiene conexión directa con el mundo de la observación, o no lo tiene todavía si queremos expresarnos con propiedad. La energía necesaria (como decíamos antes) sería de (1019 GeV), no la tiene ni la nueva capacidad energético del acelerador de partículas LHC . Ni sumando todos los aceleradores de partículas de nuestro mundo, podríamos lograr una energía de Planck (1019 GeV), que sería necesaria para poder llegar hasta las cuerdas vibrantes de la Teoría. Ni en las próximas generaciones seremos capaces de poder utilizar tal energía.

La verdad es que, la teoría que ahora tenemos, el Modelo Estándar, concuerda de manera exacta con todos los datos a bajas energías y contesta cosas sin sentido a altas energías. Sabemos sobre las partículas elementales que conforman la materia bariónica, es decir, los átomos que se juntan para formar moléculas, sustancias y cuerpos… ¡La materia! Pero, no sabemos si, pudiera haber algo más elemental aún más allá de los Quarks y, ese algo, pudieran ser esas cuerdas vibrantes que no tenemos capacidad de alcanzar.

¡Necesitamos algo más avanzado!

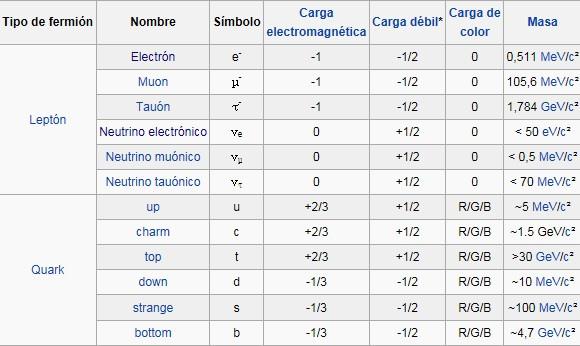

Se ha dicho que la función de la partícula de Higgs es la de dar masa a las Cuando su autor lanzó la idea al mundo, resultó además de nueva muy extraña. El secreto de todo radica en conseguir la simplicidad: el átomo resulto ser complejo lleno de esas infinitesimales partículas electromagnéticas que bautizamos con el nombre de electrones, resultó que tenía un núcleo que contenía, a pesar de ser tan pequeño, casi toda la masa del átomo. El núcleo, tan pequeño, estaba compuesto de otros objetos más pequeños aún, los quarks que estaban instalados en nubes de otras partículas llamadas gluones y, ahora, queremos continuar profundizando, sospechamos, que después de los quarks puede haber algo más.

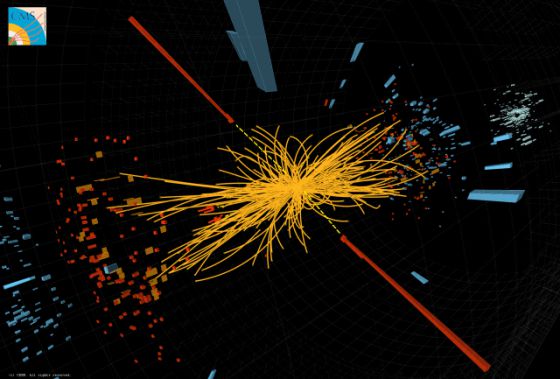

Con 7 TeV ha sido suficiente para encontrar la famosa partícula de Higgs pero…

Bueno, la idea nueva que surgió es que el espacio entero contiene un campo, el campo de Higgs, que impregna el vacío y es el mismo en todas partes. Es decir, que si miramos a las estrellas en una noche clara estamos mirando el campo de Higgs. Las partículas influidas por este campo, toman masa. Esto no es por sí mismo destacable, pues las partículas pueden tomar energía de los campos (gauge) de los que hemos comentado, del campo gravitatorio o del electromagnético. Si llevamos un bloque de plomo a lo alto de la Torre Eiffel, el bloque adquiriría energía potencial a causa de la alteración de su posición en el campo gravitatorio de la Tierra.

Como E=mc2, ese aumento de la energía potencial equivale a un aumento de la masa, en este caso la masa del Sistema Tierra-bloque de plomo. Aquí hemos de añadirle amablemente un poco de complejidad a la venerable ecuación de Einstein. La masa, m, tiene en realidad dos partes. Una es la masa en reposo, m0, la que se mide en el laboratorio cuando la partícula está en reposo. La partícula adquiere la otra parte de la masa en virtud de su movimiento (como los protones en el acelerador de partículas, o los muones, que aumentan varias veces su masa cuando son lanzados a velocidades cercanas a c) o en virtud de su energía potencial de campo. Vemos una dinámica similar en los núcleos atómicos. Por ejemplo, si separamos el protón y el neutrón que componen un núcleo de deuterio, la suma de las masas aumenta.

Peor la energía potencial tomada del campo de Higgs difiere en varios aspectos de la acción de los campos familiares. La masa tomada de Higgs es en realidad masa en reposo. De hecho, en la que quizá sea la versión más apasionante de la teoría del campo de Higgs, éste genera toda la masa en reposo. Otra diferencia es que la cantidad de masa que se traga del campo es distinta para las distintas partículas.

Los teóricos dicen que las masas de las partículas de nuestro modelo estándar miden con qué intensidad se acoplan éstas al campo de Higgs.

La influencia de Higgs en las masas de los quarks y de los leptones, nos recuerda el descubrimiento por Pieter Zeeman, en 1.896, de la división de los niveles de energía de un electrón cuando se aplica un campo magnético al átomo. El campo (que representa metafóricamente el papel de Higgs) rompe la simetría del espacio de la que el electrón disfrutaba.

Hasta ahora no tenemos ni idea de que reglas controlan los incrementos de masa generados por el Higgs (de ahí la expectación creada por las nuevas energías del acelerador de partículas LHC). Pero el problema es irritante: ¿por qué sólo esas masas -Las masas de los W+, W–, y Zº, y el up, el down, el encanto, el extraño, el top y el bottom, así como los leptones – que no forman ningún patrón obvio?

Las masas van de la del electrón 0’0005 GeV, a la del top, que tiene que ser mayor que 91 GeV. Deberíamos recordar que esta extraña idea (el Higgs) se empleó con mucho éxito para formular la teoría electrodébil (Weinberg-Salam). Allí se propuso el campo de Higgs como una forma de ocultar la unidad de las fuerzas electromagnéticas y débiles. En la unidad hay cuatro partículas mensajeras sin masa -los W+, W–, Zº y fotón que llevan la fuerza electrodébil. Además está el campo de Higgs, y, rápidamente, los W y Z chupan la esencia de Higgs y se hacen pesados; el fotón permanece intacto. La fuerza electrodébil se fragmenta en la débil (débil porque los mensajeros son muy gordos) y la electromagnética, cuyas propiedades determina el fotón, carente de masa. La simetría se rompe espontáneamente, dicen los teóricos. Prefiero la descripción según la cual el Higgs oculta la simetría con su poder dador de masa.

Las masas de los W y el Z se predijeron con éxito a partir de los parámetros de la teoría electrodébil. Y las relajadas sonrisas de los físicos teóricos nos recuerdan que ^t Hooft y Veltman dejaron sentado que la teoría entera esta libre de infinitos.

Todos los intentos y los esfuerzos por hallar una pista del cuál era el origen de la masa fallaron. Feynman escribió su famosa pregunta: “¿Por qué pesa el muón?”. Ahora, por lo menos, tenemos una respuesta parcial, en absoluto completa. Una vez potente y segura nos dice: “!Higgs¡” Durante más de 60 años los físicos experimentadores se rompieron la cabeza con el origen de la masa, y ahora el campo Higgs presenta el problema en un contexto nuevo; no se trata sólo del muón. Proporciona, por lo menos, una fuente común para todas las masas. La nueva pregunta feynmariana podría ser: ¿Cómo determina el campo de Higgs la secuencia de masas, aparentemente sin patrón, que da a las partículas de la materia?

La variación de la masa con el estado de movimiento, el cambio de masa con la configuración del sistema y el que algunas partículas (el fotón seguramente y los neutrinos posiblemente) tengan masa en reposo nula son tres hechos que ponen entre dicho que el concepto de masa sea una tributo fundamental de la materia. Habrá que recordar aquel cálculo de la masa que daba infinito y nunca pudimos resolver; los físicos sólo se deshicieron del “re-normalizándolo”, ese truco matemático que emplean cuando no saben hacerlo bien.

Ese es el problema de trasfondo con el que tenemos que encarar el problema de los quarks, los leptones y los vehículos de las fuerzas, que se diferencian por sus masas. Hace que la historia de Higgs se tenga en pie: la masa no es una propiedad intrinseca de las partículas, sino una propiedad adquirida por la interacción de las partículas y su entorno.

La idea de que la masa no es intrinseca como la carga o el espín resulta aún más plausible por la idílica idea de que todos los quarks y fotones tendrían masa cero. En ese caso, obedecerían a una simetría satisfactoria, la quiral, en laque los espines estarían asociados para siempre con su dirección de movimiento. Pero ese idilio queda oculto por el fenómeno de Higgs.

¡Ah, una cosa más! Hemos hablado de los bosones gauge y de su espín de una unidad; hemos comentado también las partículas fermiónicas de la materia (espin de media unidad). ¿Cuál es el pelaje de Higgs? Es un bosón de espin cero. El espín supone una direccionalidad en el espacio, pero el campo de Higgs de masa a los objetos dondequiera que estén y sin direccionalidad. Al Higgs se le llama a veces “bosón escalar” [sin dirección] por esa razón.

Pues justamente esto es lo que ocurre en la naturaleza cuando entra en acción la fuerza nuclear débil. Un quark tipo u cambia a uno tipo d por medio de la interacción débil así…

Las otras dos partículas que salen son un anti-electrón y un neutrino. Este mismo proceso es el responsable del decaimiento radiactivo de algunos núcleos atómicos. Cuando un neutrón se convierte en un protón en el decaimiento radiactivo de un núcleo, aparece un electrón y un neutrino. Este es el origen de la radiación beta (electrones).

La interacción débil, recordareis, fue inventada por E. Fermi para describir la desintegración radiactiva de los núcleos, que era básicamente un fenómeno de poca energía, y a medida que la teoría de Fermi se desarrolló, llegó a ser muy precisa a la hora de predecir un enorme número de procesos en el dominio de energía de los 100 MeV. Así que ahora, con las nuevas tecnologías y energías del LHC, las esperanzas son enormes para, por fin, encontrar el bosón Higgs origen de la masa… y algunas cosas más.

Hay que responder montones de preguntas. ¿Cuáles son las propiedades de las partículas de Higgs y, lo que es más importante, cuál es su masa? ¿Cómo reconoceremos una si nos la encontramos en una colisión de LHC? ¿Cuántos tipos hay? ¿Genera el Higgs todas las masas, o solo las hace incrementarse? ¿Y, cómo podemos saber más al respecto? Como s su partícula, nos cabe esperar que la veamos ahora después de gastar más de 50.000 millones de euros en los elementos necesarios para ello.

También a los cosmólogos les fascina la idea de Higgs, pues casi se dieron de bruces con la necesidad de tener campos escalares que participasen en el complejo proceso de la expansión del Universo, añadiendo, pues, un peso más a la carga que ha de soportar el Higgs.

El campo de Higgs, tal y como se lo concibe ahora, se puede destruir con una energía grande, o temperaturas altas. Estas generan fluctuaciones cuánticas que neutralizan el campo de Higgs. Por lo tanto, el cuadro que las partículas y la cosmología pintan juntas de un universo primitivo puso y de resplandeciente simetría es demasiado caliente para Higgs. Pero cuando la temperatura cae bajo los 10′5 grados kelvin o 100 GeV, el Higgs empieza a actuar y hace su generación de masas. Así por ejemplo, antes de Higgs teníamos unos W, Z y fotones sin masa y la fuerza electrodébil unificada.

El Universo se expande y se enfría, y entonces viene el Higgs (que engorda los W y Z, y por alguna razón ignora el fotón) y de ello resulta que la simetría electrodébil se rompe.

Tenemos entonces una interacción débil, transportada por los vehículos de la fuerza W+, W–, Z0, y por otra parte una interacción electromagnética, llevada por los fotones. Es como si para algunas partículas del campo de Higgs fuera una especie de aceite pesado a través del que se moviera con dificultad y que las hiciera parecer que tienen mucha masa. Para otras partículas, el Higgs es como el agua, y para otras, los fotones y quizá los neutrinos, es invisible.

De todas las maneras, era tanta la ignorancia que teniamos sobre el origen de la masa que, nos agarrabamos como a un clavo ardiendo el que se ahoga, en este caso, a la partícula de Higgs que, algunos, llegaron a llamar, de manera un poco exagerada:

¡La partícula Divina!

¡Ya veremos en que termina todo esto! Y que explicación se nos va ofreciendo desde el CERN en cuanto al auténtico escenario que según ellos, existe en el Universo para que sea posible que las partículas tomen su masa de ese oceáno de Higgs, en el que, según nuestro amigo Ramón Márquez, las partículas se frenan al interaccionar con el mismo y toman su masa, el lo llama el “efecto frenado”.

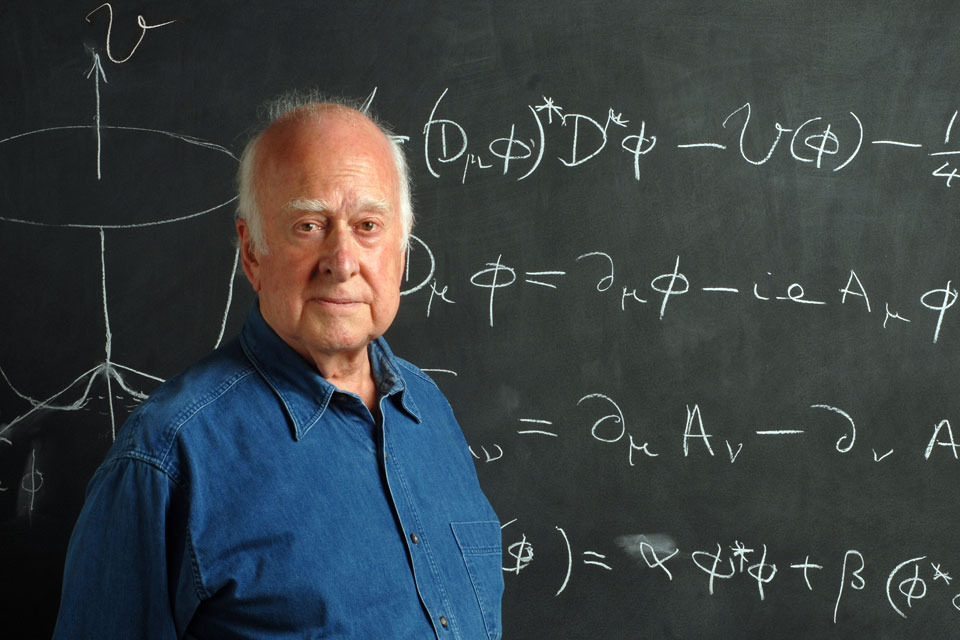

Peter Higgs, de la Universidad de Edimburgo, introdujo la idea en la física de partículas. La utilizaron los teóricos Steven Weinberg y Abdus Salam, que trabajaban por separado, para comprender como se convertía la unificada y simétrica fuerza electrodébil, transmitida por una feliz familia de cuatro partículas mensajeras de masa nula, en dos fuerzas muy diferentes: la QED con un fotón carente de masa y la interacción débil con sus W+, W– y Z0 de masa grande. Weinberg y Salam se apoyaron en los trabajos previos de Sheldon Glasgow, quien tras los pasos de Julian Schwinger, sabía sólo que había una teoría electrodébil unificada, coherente, pero no unió todos los detalles. Y estaban Jeffrey Goldstone y Martines Veltman y Gerard’t Hooft. También hay otras a los que había que mencionar, pero lo que siempre pasa, quedan en el olvido de manera muy injusta. Además, ¿Cuántos teóricos hacen falta para encender una bombilla?

La verdad es que, casi siempre, han hecho falta muchos. Recordemos el largo recorrido de los múltiples detalle sueltos y físicos que prepararon el terreno para que, llegara Einstein y pudiera, uniéndolo todos, exponer su teoría relativista. (Mach, Maxwell, Lorentz… y otros).

Sobre la idea de Peter Higgs, Veltman, uno de sus arquitectos, decía que era una alfombra bajo la que barríamos nuestra ignorancia. Glasgow era menos amable y lo llamó retrete donde echamos las incoherencias de nuestras teorías actuales. La objeción principal: que no teníamos la menor prueba experimental parece que se esfumó en 2012 cuando “encontraron” la dichosa partícula.

Ahora, por fin la tenemos con el LHC, y ésta pega, se la traspasamos directamente a la teoría de supercuerdas y a la materia oscura que, de momento, están en la sombra y no brillan con luz propia, toda vez que ninguna de ellas ha podido ser verificada, es decir, no sabemos si el Universo atiende a lo que en ellas se predice.

El modelo estándar es lo bastante fuerte para decirnos que la partícula de Higgs de menor masa (podría haber muchas) debe “pesar” menos de 1 TeV. ¿Por qué? Si tiene más de 1 TeV, el modelo estándar se vuelve incoherente y tenemos la crisis de la unitariedad.

Después de todo esto, llego a la conclusión de que, el campo de Higgs, el modelo estándar y nuestra idea de cómo pudo surgir el Universo dependen de que se encuentre el bosón de Higgs, Se averigüe si realmente existe la materia oscura, Sepamos llegar al fondo de la Teoría de Cuerdas y confirmarla, Poder crear esa Teoría cuántica de la Gravedad…Y, en fín, seguir descubriendo los muchos misterios que no nos dejan saber lo que el Universo es. Ahora, por fin, tenemos grandes aceleradores y Telescopios con la energía necesaria y las condiciones tecnológicas suficientes para que nos muestre todo eso que queremos saber y nos digan dónde reside esa verdad que incansables perseguimos.

¡La confianza en nosotros mismos, no tiene límites! Pero, no siempre ha estado justificada.

Emilio Silvera V.

Feb

19

¡La curiosidad humana! Siempre queriéndo saber

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

Fuerzas y Constantes…¡El Universo!

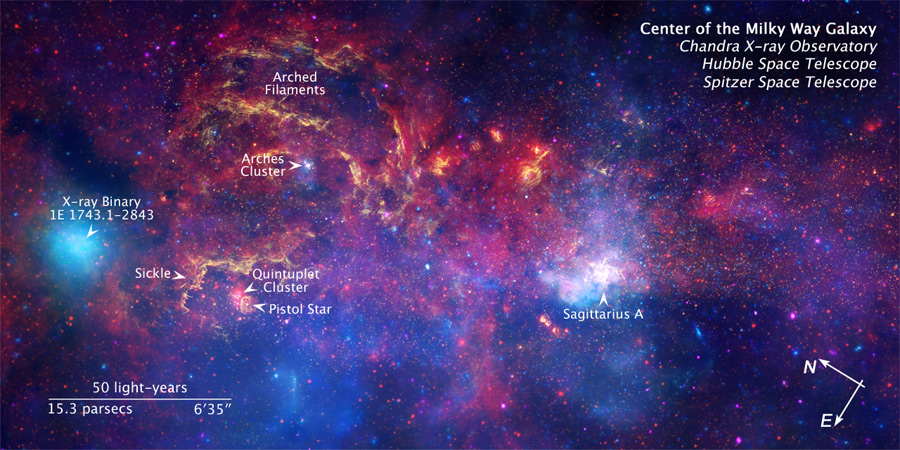

Sagitario A es una poderosa fuente de ondas de radio situada en el corazón mismo de la Vía Láctea, nuestra Galaxia, y ubicada en la Constelación de …

Hubo que descubrir la historia y tratar de explorarla. Los mensajes del pasado se transmitían primero a través de las habilidades de la memoria, luego de la escritura y, finalmente, de modo explosivo, en los libros. El insospechado tesoro de reliquias que guardaba la tierra se remontaba a la prehistoria. El pasado se convirtió en algo más que un almacén de mitos y leyendas o un catálogo de lo familiar. Todavía, en algunos rincones antiguos de nuestras ciudades se pueden encontrar vestigios del pasado.

Calles y edificios del casco antiguo de Avilés (uno de los más importantes del norte de España) están declarados Conjunto Histórico Artístico por el Estado Español – La ciudad conserva importantes vestigios del pasado, algunos de ellos realmente notables. Lo mismo ocurre en otras muchas ciudades repartidas por todo el mundo y que nos recuerda lo que se fue.

Algunos mensajes que todavía podemos leer en algunos perdidos lugares de la geografía española, ¡son tan inocentes! que nos remontan a otros tiempos, a otro mundo que, aunque nos parezca mentira, es el mundo nuestro, el mismo que habitamos y la diferencia está marcada por el paso del tiempo y la evolución. Es fácil pasar de lo cotidiano y entrañable al átomo invisible que está, sin estar, presente en todo y en todos. En relación al átomo se podría decir, sin temor a equivocarnos que, es lo invisible siempre presente.

Nuevos mundos terrestres y marinos, riquezas de continentes remotos, relatos de viajeros aventureros que nos traían otras formas de vida de pueblos ignotos y lejanos, abrieron perspectivas de progreso y novedad. La sociedad, la vida diaria del hombre en comunidad, se convirtió en un y cambiante escenarios de descubrimientos. Muy atrás quedaron aquellos tiempos en que la vida que pululaba por el planeta era rudimentaria, sin consciencia. El nacimiento de la Humanidad, lleno el mundo de pensamientos.

Cuando en el Neolítico se descubrió la rueda y el arado, ¿qué salto hacia el futuro no daría la Humanidad?

Aquí, como sería imposible hacer un recorrido por el ámbito de todos los descubrimientos de la Humanidad, me circunscribo al ámbito de la física, y, hago un recorrido breve por el mundo del átomo que es el tema de hoy, sin embargo, sin dejar de mirar al hecho cierto de que, TODA LA HUMANIDAD ES UNA, y, luego, teniendo muy presente que, todo lo que conocemos es finito y lo que no conocemos infinito. Es bueno tener presente que intelectualmente nos encontramos en medio de un océano ilimitado de lo inexplicable. La tarea de cada generación es reclamar un poco más de terreno, añadir algo a la extensión y solidez de nuestras posesiones del saber (eso nos aconseja Wheeler).

Como decía Einstein: “El eterno misterio del mundo es su comprensibilidad.”

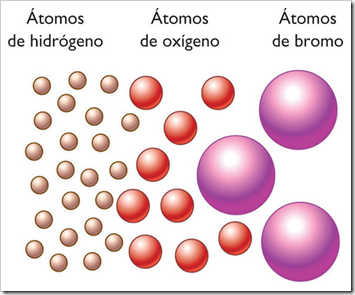

Ahora amigos, hablemos del átomo. Veamos, para comenzar como es, la imagen de un átomo en movimiento (aunque aquí lo veamos estático, utilizad la imaginación).

“Ha supuesto un gran avance en el campo de la Física. Científicos de la Universidad de Otago, en Nueva Zelanda, desarrollaron una técnica para aislar sistemáticamente y capturar un átomo en rápido movimiento neutral, y también han conseguido en primicia ver y fotografiar este átomo por primera vez, lo que han denominado la universidad como el “sueño de los científicos.

La captura del átomo de rubidio 85 es el resultado de un proyecto de investigación de tres años de duración financiado por la Fundación para la Investigación, Ciencia y Tecnología, y ha suscitado el interés en la comunidad científica internacional por las nuevas investigaciones que podrán surgir de este hito.”

La Tierra vista desde el Espacio

¡Hay tantos mundos dentro de este nuestro! Sí, dentro de cada Mente existe un mundo… ¡Tan diferentes!

De lo Grande a lo Pequeño

El 6 de Agosto de 1945 el mundo recibió estupefacto desde Hiroshima la noticia de que el hombre había desembarcado en el oscuro continente del átomo. Sus misterios habrían de obsesionar al siglo XX. Sin embargo, el “átomo” había sido más de dos mil años una de las más antiguas preocupaciones de los filósofos naturales. La palabra griega átomo significa unidad mínima de materia, que se suponía era indestructible. el átomo era un término de uso corriente, una amenaza y una promesa sin precedentes.

Leucipo (c. 450-370 a.C.), filósofo griego. Es reconocido como creador de la teoría atómica de la materia, más tarde desarrollada por su discípulo, el filósofo griego Demócrito. Según teoría, toda materia está formada por partículas idénticas e indivisibles llamadas átomos.

Leucipo fue un griego legendario. Sin embargo, fue su discípulo Demócrito el que dio al atomismo su clásica como filosofía: “la parte invisible e indivisible de la materia”, se divertía tanto con la locura de los hombres que era conocido como “el filósofo risueño” o “el filósofo que ríe”. No obstante fue uno de los primeros en oponerse a la idea de la decadencia de la Humanidad a partir de una Edad de Oro mítica, y predicó sobre una base de progreso. Si todo el Universo estaba compuesto solamente por átomos y vacío, no sólo no era infinitamente complejo, sino que, de un modo u otro, era inteligible, y seguramente el poder del hombre no tenía límite.

¿Podremos nosotros escribir en el lo que pasará? No, el futuro siempre será incierto, así lo dispuso la Naturaleza, y por algo será. No creo que sea bueno que podamos conocer lo que nos espera el día del mañana. ¿Cuántas locuras haríamos? Y, además, no podemos dejar de lado, que lo imprevisto, el Azar, puede destruir el principio de causalidad. Nunca será conocido el mañana.

Lo cierto es que, nuestro futuro es un libro en blanco y, lo que se pueda leer en él, aún no está escrito … ¿dependerá de nosotros?

Lucrecio (c. 95 a.C. -c. 55 a.C.) perpetuó en De rerum natura (De la naturaleza de las cosas) uno de los más importantes poemas latinos, al atomismo antiguo. Con la intención de liberar al pueblo del temor a los dioses, el poeta demostró que el mundo entero estaba constituido por vacío y átomos, los cuales se movían según sus leyes propias; que el alma moría con el cuerpo y que por consiguiente no había razón temer a la muerte o a los poderes sobrenaturales.

Lucrecio decía que comprender la Naturaleza era el único modo de hallar la paz de espíritu, y, como era de esperar, los padres de la Iglesia que pregonaban la vida eterna, atacaron sin piedad a Lucrecio y fue ignorado y olvidado durante toda la Edad Media que, como sabéis, fue la culpable de la paralización del saber de la Humanidad. Sin embargo, Lucrecio fue, una de las figuras más influyentes del Renacimiento.

Así pues, en un principio el atomismo vino al mundo sistema filosófico. Del mismo modo que la simetría pitagórica había proporcionado un marco a Copérnico, la geometría había seducido a Kepler y el círculo perfecto aristotélico hechizo a Harvey, así los “indestructibles” átomos de los filósofos atrajeron a los físicos y a los químicos. Francis Bacon observó que “la teoría de Demócrito referida a los átomos es, si no cierta, al menos aplicable con excelentes resultados al análisis de la Naturaleza”.

Descartes

Descartes (1596-1650) inventó su propia noción de partículas infinitamente pequeñas que se movían en un medio que llamó éter. Otro filósofo francés, Pierre Gassendi (1592-1655), pareció confirmar la teoría de Demócrito y presentó otra versión más del atomismo, que Robert Boyle (1627-1691) adaptó a la química demostrando que los “elementos clásicos -tierra, aire, fuego y agua- no eran en absoluto elementales.

Las proféticas intuiciones de un matemático jesuita, R.G. Boscovich (1711-1787) trazaron los caminos una nueva ciencia, la física atómica. Su atrevido concepto de “los puntos centrales” abandonaba la antigua idea de una variedad de átomos sólidos diferentes. Las partículas fundamentales de la materia, sugería Boscovich, eran todas idénticas, y las relaciones espaciales alrededor de esos puntos centrales constituían la materia… Boscovich que había llegado a estas conclusiones a partir de sus conocimientos de matemáticas y astronomía, anunció la íntima conexión entre la estructura del átomo y la del Universo, entre lo infinitesimal y lo infinito.

John Dalton

El camino experimental hacia el átomo fue trazado por John Dalton (1766-1844). Era este un científico aficionado cuáquero y autodidacta que recogió un sugestivo concepto de Lavoisier (1743-1794). Considerado una de los fundadores de la química moderna, Lavoisier, cuando definió un “elemento” como una sustancia que no ser descompuesta en otras sustancias por medio de ningún método conocido, hizo del átomo un útil concepto de laboratorio y trajo la teoría atómica a la realidad.

Dalton había nacido en el seno de una familia de tejedores de Cumberland, localidad inglesa situada en la región de los lagos, y estuvo marcada toda su vida por su origen humilde. A los doce ya se encontraba a cargo de la escuela cuáquera de su pueblo. Después, comenzó a ejercer la enseñanza en la vecina Kendal, y en la biblioteca del colegio encontró ejemplares de los Principia de Newton, de las Obras de la Historia Natural de Buffón, así un telescopio reflectante de unos setenta centímetros y un microscopio doble. Dalton recibió allí la influencia de John Gough, un notable filósofo natural ciego.

Dalton escribió a un amigo, “entiende muy bien todas las diferentes ramas de las matemáticas…Conoce por el tacto, el sabor y el olor de casi todas las plantas que crecen a casi treinta kilómetros a la redonda”. También Wordsworth elogia a Gough en su Excursión. Dalton recibió del filósofo ciego una educación básica en latín, griego y francés, y fue introducido en las matemáticas, la astronomía y todas las ciencias “de la observación”. Siguiendo el ejemplo de Gough, Dalton comenzó a llevar un meteorológico diario, que continuó hasta el día de su muerte.

Cuando los “disidentes” fundaron su colegio propio en Manchester, Dalton fue designado profesor de matemáticas y de filosofía natural. Halló una audiencia muy receptiva para sus experimentos en la Sociedad Literaria y Filosófica de Manchester, y presentó allí sus Hechos extraordinarios concernientes a la visión de los colores, que probablemente fue el primer sistemático sobre la imposibilidad de percibir los colores, o daltonismo, enfermedad que padecían tanto John Dalton como su hermano Jonathan. “He errado tantas veces el camino por aceptar los resultados de otros que he decidido escribir lo menos posible y solamente lo que pueda afirmar por mi propia experiencia”.

Al final del túnel oscuro de la ignorancia, siempre nos aguarda la luz del saber pero, hay que recorrer la distancia alcanzar el resplandor el saber.

Dalton observó la aurora boreal, sugirió el probable origen de los vientos alisios, las causas de la formación de nubes y de la lluvia y, sin habérselo propuesto, introdujo mejoras en los pluviómetros, los barómetros, los termómetros y los higrómetros. Su interés por la atmósfera le proporcionó una visión de la química que lo condujo al átomo.

Newton había confiado en que los cuerpos visibles más pequeños siguieran las leyes cuantitativas que gobernaban los cuerpos celestes de mayor tamaño. La química sería una recapitulación de la Astronomía. , ¿Cómo podía el hombre observar y medir los movimientos y la atracción mutua de estas partículas invisibles? En los Principios Newton había conjeturado que los fenómenos de la Naturaleza no descritos en este libro podrían “depender todos de ciertas fuerzas por las cuales las partículas de los cuerpos, debido a causas hasta desconocidas, se impulsan mutuamente unas hacia otras y se unen formando figuras regulares, o bien se repelen y se apartan unas de otras.”

Dalton se lanzó a la búsqueda de “estas partículas primitivas” tratando de encontrar algún medio experimental que le permitiera incluirlas en un sistema cuantitativo. Puesto que los gases eran la de materia más fluida, más móvil, Dalton centró su estudio en la atmósfera, la mezcla de gases que componen el aire, el cual constituyó el punto de partida de toda su reflexión sobre los átomos.

“¿Por qué el agua no admite un volumen similar de gas?, preguntó Dalton a sus colegas de la Sociedad Literaria y Filosófica de Manchester en 1803. “Estoy casi seguro de que la circunstancia depende del peso y el número de las partículas últimas de los diversos gases; aquellos cuyas partículas son más ligeras y simples se absorben con más dificultad, y los demás con mayor facilidad, según vayan aumentando en peso y en complejidad.”

Teoría cinética de los Gases: La termodinámica se ocupa solo de variables microscópicas, como la presión, la temperatura y el volumen. Sus leyes básicas, expresadas en términos de dichas cantidades, no se ocupan para nada de que la materia formada por átomos. Sin embargo, la mecánica estadística, que estudia las mismas áreas de la ciencia que la termodinámica, presupone la existencia de los átomos. Sus leyes básicas son las leyes de la mecánica, las que se aplican en los átomos que forman el sistema.

Dalton había descubierto que, contrariamente a la idea dominante, el aire no era un vasto disolvente químico único sino una mezcla de gases, uno de los cuales conservaban su identidad y actuaba de manera independiente. El producto de sus experimentos fue recogido en la trascendental TABLE: Of the Relative Weights of Ultimate Particles of Gaseous and Other Bodies (“Tabla de los pesos relativos de las partículas últimas de los cuerpos gaseosos y de otros cuerpos”).

En las reacciones químicas, los átomos no se crean ni se destruyen, solamente cambian de distribución.

Mucho hemos avanzado desde aquellos primeros elementos que, según Empédocles, lo conformaban todo mezclados en la debida proporción. Él decía que la tierra, el agua, el aire y el fuego eran todos los elemetos del mundo físico y que todo estaba hecho de a partir de ellos. No hay que quitarle mérito a la idea germinal que nos trajo muy lejos, hasta la Tabla periódica con sus 92 elementos naturales.

Finalmente trazará un programa de investigación que él mismo resume así: Es objetivo principal de este trabajo mostrar las ventajas que reporta la determinación precisa de los pesos relativos de las partículas últimas, tanto de los cuerpos simples como de los compuestos, determinar el de partículas simples elementales que constituyen una partícula compuesta y el número mínimo de partículas compuestas que entran en la formación de una nueva partícula compuesta.

Tomando al Hidrógeno como número uno, Dalton detalló en esta obra sustancias. Describió las invisibles “partículas últimas” como diminutas bolitas sólidas, similares a balas pero mucho más pequeñas, y propuso que se les aplicaran las leyes newtonianas de las fuerzas de atracción de la materia. Dalton se proponía lograr “una nueva perspectiva de los primeros principios de los elementos de los cuerpos y sus combinaciones”, que “sin duda…con el tiempo, producirá importantísimos cambios en el sistema de la química y la reducirá a una ciencia de gran simplicidad, inteligible hasta para los intelectos menos dotados”. Cuando Dalton mostró una “partícula de aire que descansa sobre cuatro partículas de agua como una ordenada pila de metralla” donde cada pequeño globo está en contacto con sus vecinos, proporcionó el modelo de esferas y radio de la química del siglo siguiente.

Dalton inventó unas “señales arbitrarias como signos elegidos para representar los diversos elementos químicos o partículas últimas”, organizadas en una tabla de pesos atómicos que utilizaba en sus populares conferencias. Naturalmente, Dalton no fue el primero en emplear una escritura abreviada para representar las sustancias químicas, pues los alquimistas también tenían su código. Pero él fue probablemente el primero que utilizó este tipo de simbolismo en un sistema cuantitativo de “partículas últimas”. Dalton tomó como unidad el átomo de Hidrógeno, y a partir de él calculó el peso de las moléculas como la suma de los pesos de los átomos que la componían, creando así una sintaxis moderna para la química. Las abreviaturas actuales que utilizan la primera letra del latino (por ejemplo H2O) fueron ideadas por el químico sueco Berzelius (1779-1848).

Habiendo cumplido más de 350 años, la Institución que presidiera Newton “Real Sociedad de Londres para el Avance de la Ciencia Natural” más conocida como “Royal Society”, sigue en plena y ostenta el respetado título de Sociedad más Antigua. ¡Si nos pudiera contar todo lo que allí se vivió”.

La teoría del átomo de Dalton no fue recibida en un principio con entusiasmo. El gran sir Humphry Davy desestimó inmediatamente sus ideas tachándolas de “más ingeniosas que importantes”. Pero las nociones de Dalton, desarrolladas en A New System of Chemical Philosophy (1808), eran tan convincentes que en 1826 le fue concedida la medalla real. Como Dalton no olvidó nunca su origen plebeyo, permaneció siempre apartado de la Royal Society de Londres, pero fue elegido miembro, sin su consentimiento, en 1822. Receloso del tono aristocrático y poco profesional de la Sociedad, él se encontraba más a gusto en Manchester, donde realizó la mayor parte de su obra, colaboró con Charles Babage y contribuyó a fundar la Asociación Británica el Progreso de la Ciencia, cuyo objetivo era llevar la ciencia hasta el pueblo. Los newtonianos partidarios de la ortodoxia religiosa no creían que Dios hubiera hecho necesariamente sus invisibles “partículas últimas” invariables e indestructibles. Compartían con Isaac Newton la sospecha de que Dios había utilizado su poder “ variar las leyes de la Naturaleza y crear mundos diversos en distintos lugares del Universo”.

Las verdaderas investigaciones sobre el átomo comenzaron en el siglo XVII, cuando los experimentos de Robert Boyle dieron impulso a la investigación de las intimidades de la materia. En 1803, el científico inglés John Dalton propuso por primera vez, la teoría de que cada elemento tiene un tipo particular de átomo y que cualquier cantidad de un mismo elemento está formada por átomos idénticos. Lo que distingue a un elemento de otro es la naturaleza de sus átomos.

El átomo indestructible de Dalton se convirtió en el fundamento de una naciente ciencia de la química, proporcionando los principios elementales, las leyes de composición constante y de proporciones múltiples y la combinación de elementos químicos en razón de su peso atómico. “El análisis y la síntesis química no van más allá de la separación de unas partículas de otras y su reunión”, insistió Dalton. “La creación o la destrucción de la materia no está al alcance de ningún agente químico. Sería lo mismo tratar de introducir un planeta en el Sistema Solar o aniquilar uno de los ya existentes que crear o destruir una partícula de Hidrógeno.” Dalton continuó usando las leyes de los cuerpos celestes visibles como indicios del Universo infinitesimal. El profético sir Humphry Davy, sin embargo, no se convencía, “no hay razón para suponer que ha sido descubierto un principio real indestructible”, afirmó escéptico.

Gay-Lussac

Dalton no era más que un Colón. “Los Vespucios” aún no habían llegado, y cuando lo hicieron trajeron consigo algunas sorpresas muy agradables y conmociones aterradoras. Entretanto, y durante medio siglo, el sólido e indestructible átomo de Dalton fue muy útil para los químicos, y dio lugar a prácticas elaboraciones. Un científico francés, Gay-Lussac, demostró que cuando los átomos se combinaban no lo hacían necesariamente de dos en dos, como había indicado Dalton, sino que podían agruparse en asociaciones distintas de unidades enteras. Un químico italiano, Avogadro (1776-1856), demostró que volúmenes iguales de gases a la misma temperatura y presión contenían el mismo de moléculas. Un químico ruso Dmitri Mendeléiev, nos trajo la Tabla Periódica de los elementos, propuso una sugestiva “Ley periódica” de los elementos. Si los elementos estaban dispuestos en orden según su creciente peso atómico entonces grupos de elementos de características similares se repetirían periódicamente.

Dmitri Mendeléiev

Más tarde se trasladó a Alemania, ampliar estudios en Heidelberg, donde conoció a los químicos más destacados de la época. A su regreso a Rusia fue nombrado profesor del Instituto Tecnológico de San Petersburgo (1864) y profesor de la universidad (1867), cargo que se vería forzado a abandonar en 1890 por motivos políticos, si bien se le concedió la dirección de la Oficina de Pesos y Medidas (1893).

Entre sus trabajos destacan los estudios acerca de la expansión térmica de los líquidos, el descubrimiento del punto crítico, el estudio de las desviaciones de los gases reales respecto de lo enunciado en la ley de Boyle-Mariotte y una formulación más exacta de la ecuación de . En el campo práctico destacan sus grandes contribuciones a las industrias de la sosa y el petróleo de Rusia.

Todos recordamos cuán difícil era memorizar la tabla periódica en el colegio. Más todavía que memorizar la tabla de multiplicar. Porque, además, la tabla periódica estaba compuesta por nombres y valores extraños, poco útiles la vida diaria. Sin embargo, algunos profesores de vocación, se valían de mil triquiñuelas para que, los niños la pudieran memorizar.

Con todo, su principal logro investigador fue el establecimiento del llamado sistema periódico de los elementos químicos, o tabla periódica, gracias al cual culminó una clasificación definitiva de los citados elementos (1869) y abrió el paso a los grandes avances experimentados por la química en el siglo XX.

Aunque su sistema de clasificación no era el primero que se basaba en propiedades de los elementos químicos, como su valencia, sí incorporaba notables mejoras, como la combinación de los pesos atómicos y las semejanzas entre elementos, o el hecho de reservar espacios en blanco correspondientes a elementos aún no descubiertos como el eka-aluminio o galio (descubierto por Boisbaudran, en 1875), el eka-boro o escandio (Nilson, 1879) y el eka-silicio o germanio (Winkler, 1886).

Mendeléiev demostró, en controversia con químicos de la talla de Chandcourtois, Newlands y L. Meyer, que las propiedades de los elementos químicos son funciones periódicas de sus pesos atómicos. Dio a conocer una primera versión de dicha clasificación en marzo de 1869 y publicó la que sería la definitiva a comienzos de 1871. Mediante la clasificación de los elementos químicos conocidos en su época en función de sus pesos atómicos crecientes, consiguió que aquellos elementos de comportamiento químico similar estuvieran situados en una misma columna vertical, formando un grupo. Además, en sistema periódico hay menos de diez elementos que ocupan una misma línea horizontal de la tabla. Tal como se evidenciaría más adelante, su tabla se basaba, en efecto, en las propiedades más profundas de la estructura atómica de la materia, ya que las propiedades químicas de los elementos vienen determinadas por los electrones de sus capas externas.

Tabla de elementos de Dalton, siglo XIX

Convencido de la validez de su clasificación, y a fin de lograr que algunos elementos encontrasen acomodo adecuado en la tabla, Mendeléiev «alteró» el valor de su peso atómico considerado correcto hasta entonces, modificaciones que la experimentación confirmó con posterioridad. A tenor de mismo patrón, predijo la existencia de una serie de elementos, desconocidos en su época, a los que asignó lugares concretos en la tabla.

Pocos después (1894), con el descubrimiento de ciertos gases nobles (neón, criptón, etc.) en la atmósfera, efectuado por el químico británico William Ramsay (1852-1816), la tabla de Mendeléiev experimentó la última ampliación en una columna, tras lo cual quedó definitivamente establecida.

La sustancia más caliente de todas se creó al colisionar átomos de oro entre sí a velocidades cercanas a las de la luz. Es llamada “sopa de quarks y gluones” y alcanza unos humildes 4 trillones grados centígrados, lo que equivale a una temperatura de 250 mil veces más caliente que el interior del sol.

La disolución del indestructible átomo sólido provendría de dos fuentes, una conocida y la otra bastante nueva: el estudio de la luz y el descubrimiento de la electricidad. El propio Einstein describió este histórico movimiento como la decadencia de una perspectiva “mecánica” y el nacimiento de una perspectiva “de campo” del mundo físico, que le ayudó a encontrar su propio camino la relatividad, explicaciones y misterios nuevos.

Albert Einstein tenía en la pared de su estudio un retrato de Michael Faraday (1791-1867), y ningún otro hubiera podido ser más apropiado, pues Faraday fue el pionero y el profeta de la gran revisión que hizo posible la obra de Einstein. El mundo ya no sería un escenario newtoniano de “fuerzas a distancias”, objetos mutuamente atraídos por la fuerza de la Gravedad inversamente proporcional al cuadrado de la distancia que hay entre ellos. El mundo material se convertiría en una tentadora escena de sutiles y omnipresentes “campos de fuerzas”. idea era tan radical como la revolución newtoniana, e incluso más difícil de comprender para los legos en la materia

Emilio Silvera V.

Feb

18

Algunos desarrollos de la Física Teórica…Son notables

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (1)

Comments (1)

El epitafio en la tumba del famoso matemático alemán David Hilbert (1862-1943), situada en el cementerio Stadtfriedhof de Gotinga, es una famosa frase que resume su inquebrantable fe en la capacidad humana para descubrir los secretos de las matemáticas y la ciencia.

“Wir müssen wissen. Wir werden wissen.”

“Debemos saber. Sabremos.”)

“…En alguna pequeña charca caliente, tendrían la oportunidad de hacer el trabajo y organizarse en sistemas vivos…”

Algunos desarrollos de la Física Teórica…Son notables

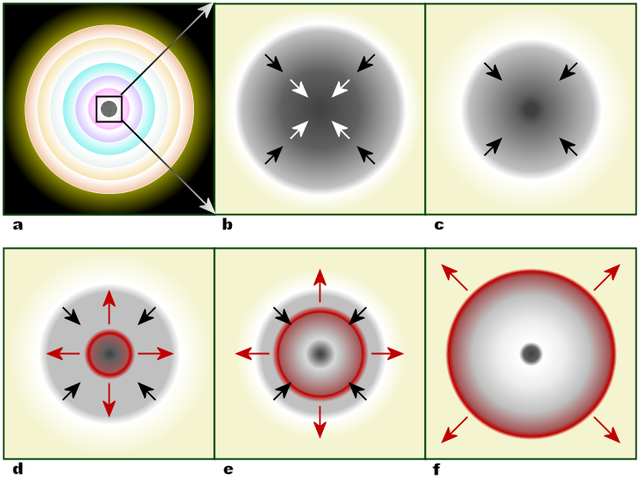

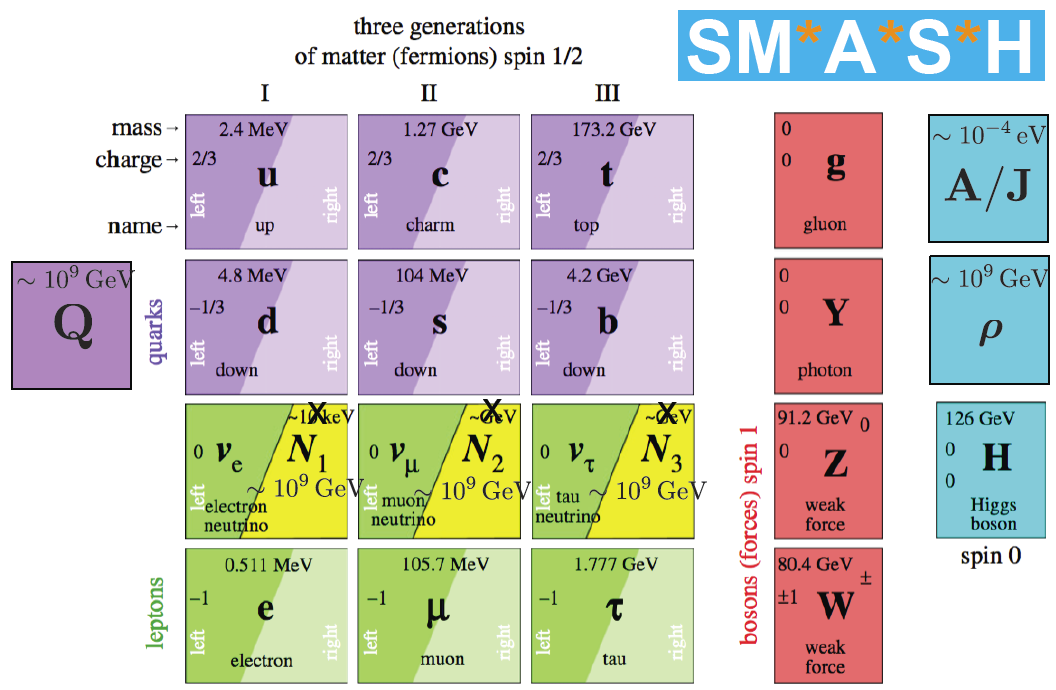

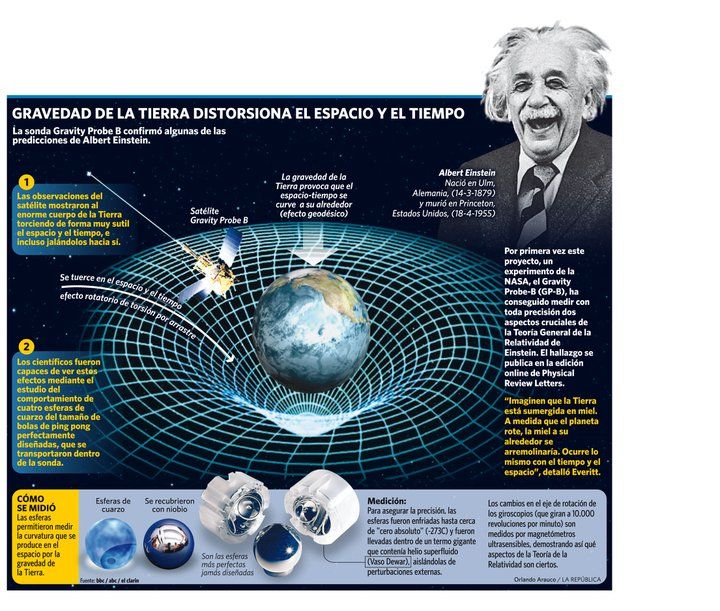

Hasta hace muy pocos años la Gravitación y la Mecánica Cuántica eran dos campos de la Física Teórica que utilizaban metodologías muy distintas y que estaban prácticamente desconectados entre sí. Por una parte, la interacción gravitatoria está descrita por la Teoría de la Relatividad General de Einstein, que es una teoría clásica (es decir, no cuántica) en la que la Gravedad se representa como una propiedad geométrica del espacio y del tiempo. Por otro lado, gobierna el mundo de las partículas atómicas y subatómicas. Su generalización relativista (la Teoría Cuántica de Campos) incorpora los principios de la Teoría Especial Relativista y, junto con el principio gauge, ha permitido construir con extraordinario éxito el llamado Modelo Estándar de la Física de las Partículas Elementales.

Con sus 20 parámetros aleatorios (parece que uno de ellos ha sido hallado -el bosón de Higgs-), el Modelo estándar de la física de partículas que incluye … sólo tres de las cuatro fuerzas fundamentales. La Gravedad se niega a juntarse con las otras fuerzas.

La interacción electromagnética, por ejemplo, es la responsable de las fuerzas que controlan la estructura atómica, reacciones químicas y todos los fenómenos electromagnéticos. Puede explicar las fuerzas entre las partículas cargadas, pero al contrario que las interacciones gravitacionales, pueden ser tanto atractivas como repulsivas. Algunas partículas neutras se desintegran por interacciones electromagnéticas. La interacción se puede interpretar tanto como un modelo clásico de fuerzas (ley de Coulomb) como por el intercambio de unos fotones virtuales. Igual que en las interacciones gravitatorias, el hecho de que las interacciones electromagnéticas sean de largo alcance significa que tiene una teoría clásica bien definida dadas por las ecuaciones de Maxwell. La teoría cuántica de las interacciones electromagnéticas se describe con la electrodinámica cuántica, que es una forma sencilla de teoría gauge.

El electromagnetismo está presente por todo el Universo

La interacción fuerte es unas 102 veces mayor que la interacción electromagnética y, como ya se dijo antes, aparece sólo entre los hadrones y es la responsable de las fuerzas entre nucleones que confiere a los núcleos de los átomos su gran estabilidad. Actúa a muy corta distancia dentro del núcleo (10-15 metros) y se puede interpretar como una interacción mediada por el intercambio de mesones virtuales llamados Gluones. Está descrita por una teoría gauge llamada Cromodinámica cuántica.

Las teorías gauge explican satisfactoriamente la dinámica de las interacciones electromagnéticas, fuertes y débiles en un gran rango de distancias. Sin embargo, a pesar que la Teoría General de la Relatividad puede formularse como una teoría gauge, todos los intentos de introducir en ella de manera completamente satisfactoria los principios de la Mecánica Cuántica, han fracasado. No obstante, los desarrollos realizados en el marco de la Teoría de Cuerdas en los últimos años han dado lugar a una convergencia, al menos metodológica, entre estos dos campos de la Física Fundamental.

Lo cierto es que buscamos incansables para saber de qué está hecho el “mundo”