Ene

15

¿El núcleo del átomo? ¡Una maravilla de la Naturaleza!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

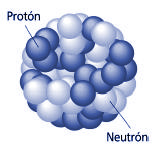

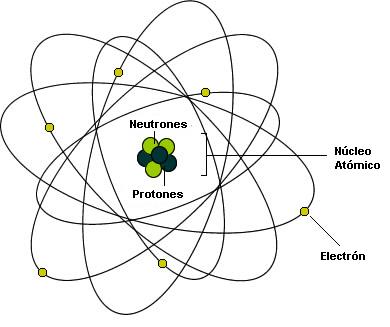

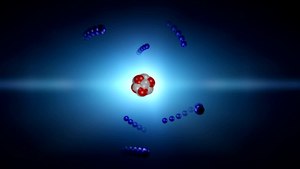

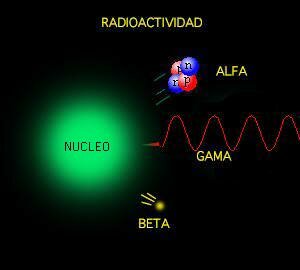

Las partículas del núcleo atómico. Protón y neutrón.

En 1920 (Rutherford) descdubrió las partículas positivas que forman los átomos, los protones.

Por lo tanto en los núcleos de los átomos hay unas partículas positivas que se llaman protones. En el hidrógeno solo hay una partícula ya que recordemos su masa era casi la misma.

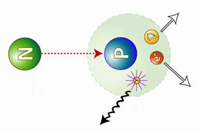

Se comprobó que el número de protones es una característica especial de cada elemento químico, ya que todos los átomos del mismo elemento tienen el mismo número de protones. Se llama número atómico (Z) al número de protones que tienen los átomos de un elemento químico. A cada elemento químico le corresponde un número atómico desde 1 hasta 106.

Todavía tenemos que buscar otras partículas en el núcleo atómico. La masa de los protones de un núcleo es mucho menor que la masa del núcleo.

Cada elemento químico se caracteriza por el número de protones de su núcleo, que se denomina número atómico (Z). Así, el hidrógeno ( 1H) tiene un protón, el carbono ( 6C) tiene 6 protones y el oxígeno ( 8O) tiene 8 protones en el núcleo.

El número de neutrones del núcleo puede variar. Casi siempre hay tantos o más neutrones que protones. La masa atómica(A) se obtiene sumando el número de protones y de neutrones de un núcleo determinado.

Un mismo elemento químico puede estar constituído por átomos diferentes, es decir, sus números atómicos son iguales, pero el número de neutrones es distinto. Estos átomos se denominan isótopos del elemento en cuestión. Isótopos significa “mismo lugar“, es decir, que como todos los isótopos de un elemento tienen el mismo número atómico, ocupan el mismo lugar en la Tabla Periódica.

isótopos del Hidrógeno

Isótopos del Carbono

Desde 1918 estaba probado que existían los isótopos. Estos, eran átomos que tenían propiedades químicas iguales (parecían elementos iguales, por tanto), tenían el mismo número atómico, pero sus masas atómicas eran diferentes. En el núcleo debían existir partículas neutras que contribuyeran a la masa pero no tuvieran carga eléctrica.

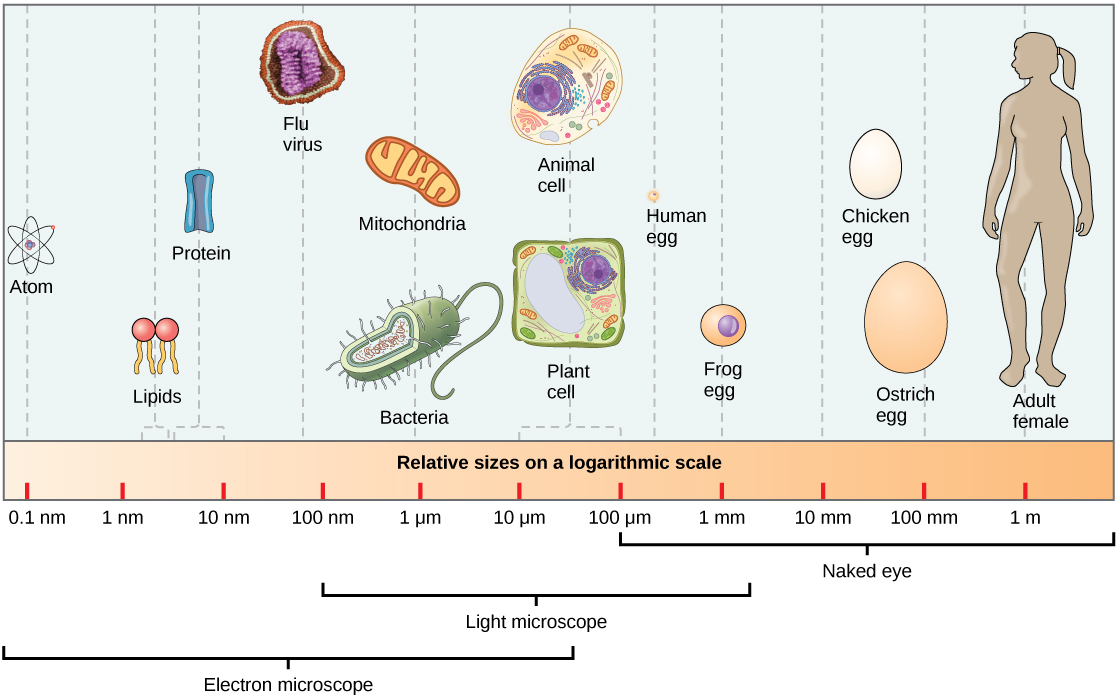

La curiosidad acerca del tamaño y masa del átomo atrajo a cientos de científicos durante un largo período en el que la falta de instrumentos y técnicas apropiadas impidió lograr respuestas satisfactorias. Con posterioridad se diseñaron numerosos experimentos ingeniosos para determinar el tamaño y peso de los diferentes átomos.

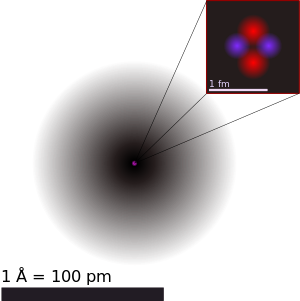

El átomo más ligero, el de hidrógeno, tiene un diámetro de aproximadamente 10-10 m (0,0000000001 m) y una masa alrededor de 1,7 x 10-27 kg (la fracción de un kilogramo representada por 17 precedido de 26 ceros y una coma decimal).

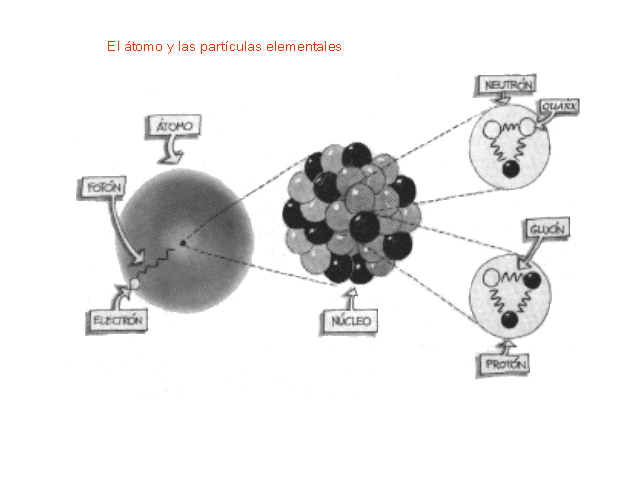

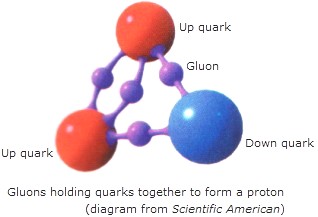

Como no es el objeto del trabao, no hablaremos hoy de los Quarks, y, simplemente diremos que en la naturaleza no se encuentran quarks aislados. Estos siempre se encuentran en grupos, llamados Hadrones. de dos o tres quarks, conocidos como mesones y bariones respectivamente. Esto es una consecuencia directa del confinamiento de color. En el año 2003 se encontró evidencia experimental de una nueva asociación de cinco quarks, los Pentaquarks, cuya evidencia, en principio controvertida , fue demostrada gracias al Colisionador de Partículas LHC en el pasado Julio de 2.015.

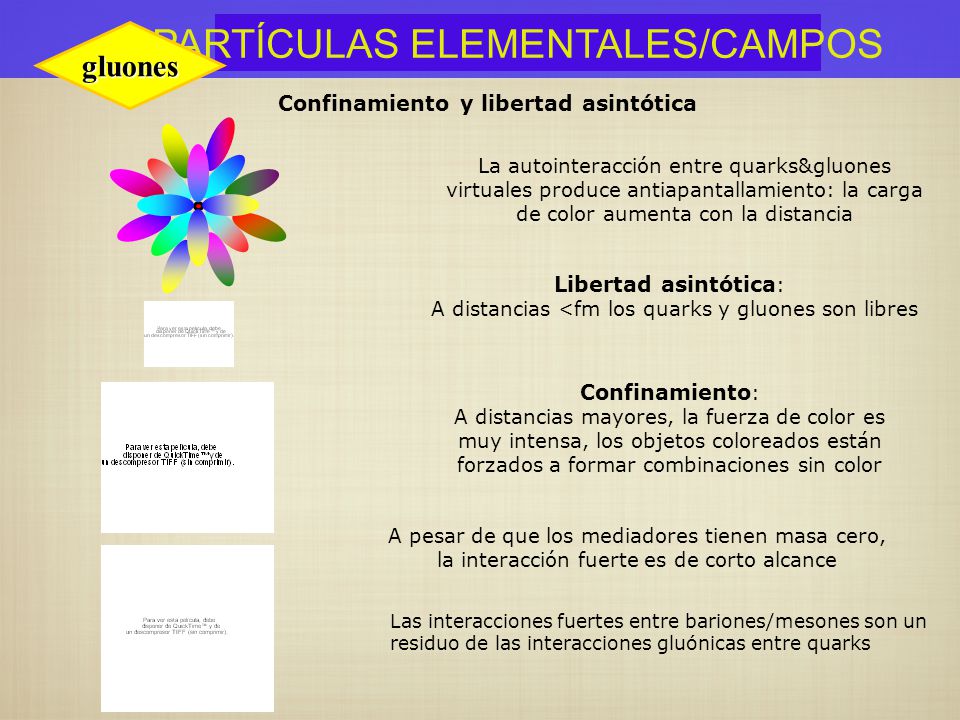

Pero sigamos con lo que nos ocupa y veámos que los Quarks están confinados dentro de los nucleones (protones y neutrones) donde la fuerza fuerte les retiene y nos los deja que se vayan alejando más de lo debido como se explica en el cuadro de arriba.

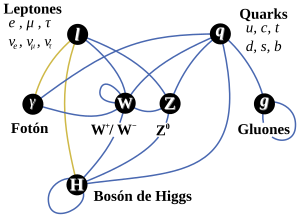

Dentro del nucleo se desatan las fuerzas de la Naturaleza, la que conocemos como fuerza nuclear fuerte, la más potente de las cuatro fuerzas fundamentales que, intermediada por otras partículas de la familia de los Bosones, los Gluones, no dejan que los Quarks se alejen y son retenidos allí, dentro de los nucleones donde tienen su función de conformar los hadrones másicos del núcleo que le aporta la materia al átomo.

Los Gluones, son las partículas intermediarias de la fuerza fuerte, y, de la misma manera, existen otros Bosones encargados de mediar en las otras fuerzas conocidas de la Naturaleza: El Fotón para los fenómenos electromagnéticos, el Gravitón (no encontrado aún) para la fuerza de Gravedad, y, los W+, W–y Zº para la fuerza nuclear débil.

Este acontecimiento se está dando continuamente en el interior de estrellas como el Sol, y es de esperar que se pueda reproducir algún día cercano para obtener energía barata y limpia mediante fusión nuclear.

El protón y el neutrón son Hadrones de la rama bariónica, y, el electrón, es un Leptón. Todos están presentes en el átomo, los primeros en el núcleo y el segundo formando la parte electrónica de espacios magnéticos que forman en su deambular a su alrededor.

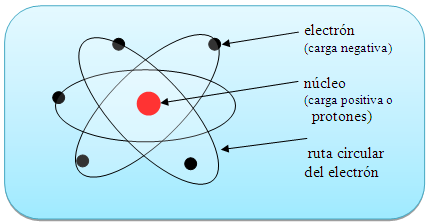

Lo cierto es que, el núcleo atómico está cargado positivamente y, tal carga, hace la llamada para que, un enjambre de electrones, con cargas negativas, vengan a rodear el núcleo atómico y, de esa manera, queda estabilidado el átomo, ese pequeño objeto que conforma todas las cosas hechas de materia.

Así, los electrones que rodea el núcleo, con su carga eléctrica negativa que complementa la positiva de los protones y hace estable al átomo; una masa de solamente 1/1.836 de la del núcleo más ligero (el del hidrógeno). Y, sin embargo, la importancia del electrón es vital en el universo.

Repasando todo esto, no puedo dejar de recordar aquellas palabras que el físico Freeman Dyson escribió:

“Cuando miramos en el universo e identificamos los muchos accidentes de la física y la astronomía que han colaborado en nuestro beneficio, casi parece que el universo debe haber sabido, en cierto sentido, que nosotros íbamos a venir“.

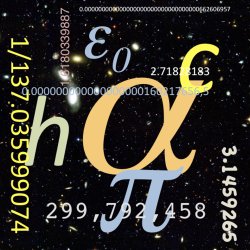

α es la constante de estructura fina, si variara con el paso del tiempo… … la vida no podría existir. Esas constantes hacen posible nuestra presencia aquí.

Fijaros en el hecho cierto de que, si la carga del electrón, o, la masa del protón, variaran aunque sólo fuese una diezmillonésima parte… ¡La vida no podría existir en el Universo! Estamos hechos de átomos y, con tal cambio, éstos nunca se habrían podido conformar.

emilio silvera.

Ene

13

Más lejos, más profundo, más simple

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

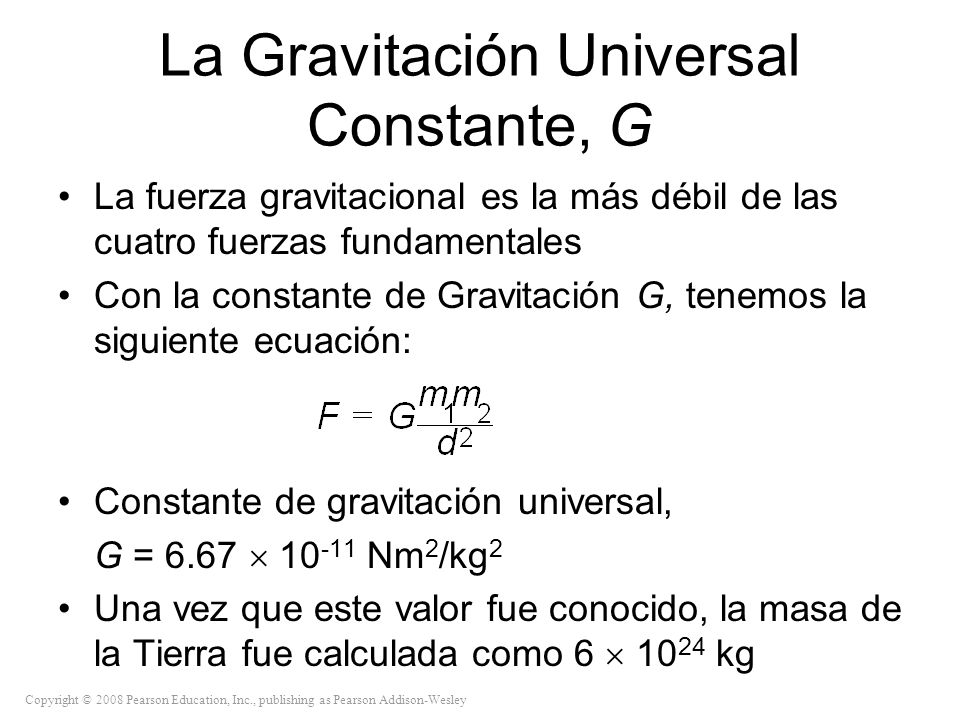

Las teorías de Newton sobre el movimiento y la gravedad, con sus trescientos años de edad siguen proporcionando reglas que son maravillosamente precisas para entender y predecir la forma en que se mueven las cosas a velocidades muhco menores que la de la luz cuando la gravedad es muy débil. En los quince primeros años del siglo XX, Einstein dio con una teoría más profunda que podía tratar con el movimiento rápido y la gravedad intensa cuando la teoría de Newton fallaba. Pero, y esto es crucial, la teoría más ampliam y más profunda de Einstein se convierte en la de Newton cuando los movimientos son lentos y la Gravedad es débil.

Teoría cuántica, o, ¿universos paralelos?

Pasó lo mismo con las teorías cuánticas revolucionarias que se descubrieron en el primer cuarto del siglo XX cuando todos los físicos siguieron el rastro dejado por la semilla dejada por Planck a la que llamó “cuanto” y se simnolizó con la letra h. Aquella nueva teoría ofrecía una descripción más completa que la de Newton del funcionamiento del mundo cuando sondeamos el dominio de lo muy pequeño. Sus predicciones sobre el micromundo no-newtoniano son tremendamente precisas.

Pero una vez más, cuando trabajan con objetos grandes se hacen cada vez más parecidas a la descripción newtoniana. Así es como el núcleo de verdad dentro de una teoría pasada puede permanecer como una parte restrictiva de una teoría nueva y mejor. No parece que vaya a haber más revoluciones cintíficas (que las habrá).

Si consideramos nuestro “almacen” de teorías, podemos ver las interrelaciones entre las viejas y las nuevas. Consioderemos nuestro caso, en el que la mecánica cuántica se convierte en la mecánica newroniana cuando h se aproxima a cero. Este límite corresponde a una situación en la que los aspectos ondulatorios cuánticos de las partículas se hacen despreciables. Por esto podemos confiar plenamente en que la tricentenaria teoría de Newton del movimiento y de la gravedad se enseñaran y se urtilizaran dentro de mil años con la misma eficacia que lo hacemos hoy. Cualquiera que resulte ser la Teoría de Todo final, tendrá una forma restrictiva que describa el movimiento a velocidades mucho menores que la de la luz y, entonces, ahí estará Newton y, de la misma manera, cuando esos movimientos sean cercanos a c, Einstein también se hará presernte. Es decir, en la futura teoría subyacen las ideas de Newton y de Einstein como cimientis de esa nueva teoría que vendrá.

Fotografía del Congreso en el Hotel Metropole. Sentados, de izquierda a derecha: W. Nernst, M. Brillouin, E. Solvay (mecenas), H. Lorentz, E. Warburg, J. Perrin, W. Wien, M. Curie y H. Poincaré. De pie, de izquierda a derecha: R. Goldschmidt, M. Planck, H. Rubens,A. Sommerfeld, F. Lindemann (secretario), M. de Broglie (secretario), M. Knudsen, F. Hasenöhrl, G. Hostelet, E. Herzen, J.H. Jeans, E. Rutherford, H. Kamerlingh Onnes, A. Einstein y P. Langevin. En esta situación llegó el histórico Congreso Solvay.

Se cuenta que en un descanso del aquel famoso Congreso Solvay, Einstein y Henri Poincaré se encontraron un momento sólos y, se entabló entre ellos, la conversación siguiente:

Einstein: Sabe usted, Henri, en un tiempo estudié matemáticas, pero lo dejé por la Física.

Poincaré: Oh, ¿de verdad Albert? ¿Y por qué?

Einstein: Porque aunque podía distinguir los enunciados verdaderos de los falsos, no podía distinguir que hechos eran importantes.

Poincaré: Eso es muy interesante, Albert, Porque originalmente yo estudié Física, pero la dejé por las matemáticas.

Einstein: ¿De verdad? ¿Por qué?

Poncaré: Porque no podía distinguir cuáles de los hechos importantes eran verdaderos.

Podeis sacar una conclusión.

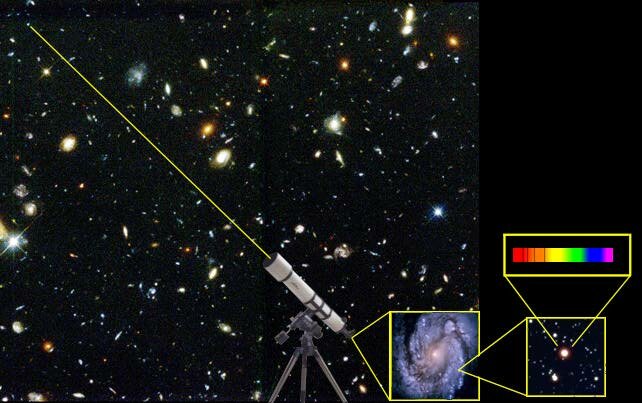

Donde esté presente la materia…, lo estará la Gravedad

Aquí la gravedad está presente y es la respondable de mantener unidos todos los objetos que en la imagen podemos contemplar, sus masas titan las unas de las otras y todo se mantiene unido. La fuerza de la gravedad tiene su mayor potencia, proximo al elemento que la origina, ya sea un atomo o un planeta, pero sus lineas de fuerza, aunque van disminuyendo con la distancia son infinitas, que no por debiles se deben despreciar. Lo que ocurre en el universo es que cualquier fuerza de gravedad mas fuerte, aparentemente anula las fuerzas debiles pero si el universo estuviera vacio de materia y de energia, dos átomos en ambos extremos del universo terminarian por atraerse. La fuerza de gravedad de un elemento viene determinado por el conjunto de atomos que lo forman comportandose como un solo elemento.

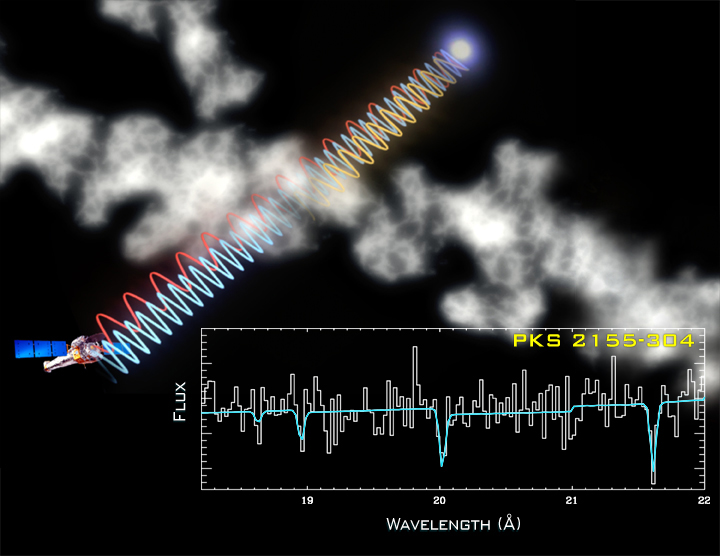

La principal sospechosa de variaciones minúsculas ha sido siempre la constante Gravitatoria, G. La Gravedad es con mucho la fuerza la fuerza más débil de la Naturaleza y la menos estrechamente sondeada por el experimento. Si se buscan los valores conocidos de las constantes principales en la contraportada de un libro de texto de Física podemos descubrir que G aparece especificada con muchas menos cifras decimales que c, h, o e. Aunque G a soportado asaltos a su constancia durante mucho tiempo, los ataques más rcientes han sido lanzados sobre α (alfa), la constante de estructura fina de la que hablamos ayer. está ahora de mucha actualidad debido a unos experimentos que se han hecho observando y midiendo la luz de unos quásares lejanos. Y, como ayer os decía, la constante de estructura fina liga la velocidad de la luz, la constante de Planck y la carga del electrón. Y, todo ello hace que, si varía en una pequerña proporción, el Universo cambiaría.

¿Quién será el que resuelve este misterio?

emilio silvera

Ene

13

¡Fluctuaciones de vacío! ¿Que son?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Un fuerte campo gravitatorio puede inducir un efecto desbocado en las fluctuaciones cuánticas que se producen en el espacio, aparentemente vacío, …

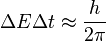

En física cuántica, la fluctuación cuántica es un cambio temporal en la cantidad de energía en un punto en el espacio como resultado del Principio de Incertidumbre que imaginó Werner Heisenberg. De acuerdo a una formulación de este principio energía y tiempo se relacionan de la siguiente forma:

Esto significa que la conservación de la energía puede parecer violada, pero sólo por breves lapsos. Esto permite la creación de pares partícula-antipartícula de partículas virtuales. El efecto de esas partículas es medible, por ejemplo, en la carga efectiva del electrón, diferente de su carga “desnuda”. En una formulación actual, la energía siempre se conserva, pero los estados propios del Hamiltoniano no son los mismos que los del operador del número de partículas, esto es, si está bien definida la energía del sistema no está bien definido el número de partículas del mismo, y viceversa, ya que estos dos operadores no conmutan.

Las fluctuaciones del vacío entre una esfera y una superficie plana

En un estudio realizado por un equipo de físicos con avanzados aparatos, han hallado un resultado del que nos dicen:

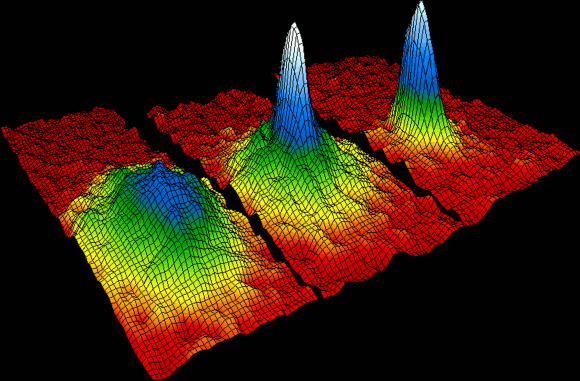

La materia se construye sobre fundamentos frágiles. Los físicos acaban de confirmar que la materia, aparentemente sustancial, es en realidad nada más que fluctuaciones en el vació cuántico. Los investigadores simularon la frenética actividad que sucede en el interios de los protones y neutrones, que como sabéis son las partículas que aportan casi la totalidad de la masa a la materia común.

Cada protón (o neutrón) se compone de tres quarks – véase ilustración – pero las masas individuales de estos quarks apenas comprenden el 1% del total de la masa del protón¿Entonces de dónde sale el resto? La teoría sostiene que esta masa es creada por la fuerza que mantiene pegados a los quarks, y que se conoce como fuerza nuclear fuerte. En términos cuánticos, la fuerza fuerte es contenida por un campo de partículas virtuales llamadas gluones, las cuales irrumpen aleatoriamente en la existencia para desaparecer de nuevo. La energía de estas fluctuaciones del vacío debe sumarse a la masa total del neutróny del protón.

En nuestras mentes se acumulan signos y fórmulas que quieren ser los exponentes de la verdadera razón y origen de la materia pero… ¡Estaremos acertando!

Tiene y encierra tantos misterios la materia que estamos aún y años-luz de y conocer sobre su verdadera naturaleza. Es algo que vemos en sus distintas formas materiales que configuran y conforman todo lo material desde las partículas elementales hasta las montañas y los océanos. Unas veces está en estado “inerte” y otras, se eleva hasta la vida que incluso, en ocasiones, alcanza la consciencia de SER. Sin embargo, no acabamos de dilucidar de dónde viene su verdadero origen, su esencia, lo que era antes de “ser” materia. ¿Existe acaso una especie de sustancia cósmica anterior a la materia? Y, si realmente existe esa sustancia… ¿Dónde está?

Claro que hemos llegado a saber que las llamadas fluctuaciones del vacío son oscilaciones aleatorias, impredecibles e ineliminables de un campo de fuerza (electromagnético o gravitatorio) que son debidas a un “tira y afloja” en el que pequeñas regiones del espacio toman prestada, momentáneamente, energía de regiones adyacentes y luego las devuelven. Pero…

– ¿Qué regiones adyacentes?

Acaso universos paralelos, acaso defomraciones del espacio-tiempo a escalas microscópicas, micros agujeros negros que pasan a ser agujeros blancos salidos de estas regiones o campos de fuerza que no podemos ver pero sí sentir, y, en última instancia, ¿por qué se forman esas partículas virtuales que de inmediato se aniquilan y desaparecen antes de que puedan ser capturadas? ¿Qué sentido tiene todo eso?

Las consecuencias de la existencia del cuanto mínimo de acción fueron revolucionarios para la comprensión del vacío. Mientras la continuidad de la acción clásica suponía un vacío plano, estable y “realmente” vacío, la discontinuidad que supone el cuanto nos dibuja un vacío inestable, en continuo cambio y muy lejos de poder ser considerado plano en las distancias atómicas y menores. El vacío cuántico es de todo menos vacío, en él la energía nunca puede quedar estabilizada en valor cero, está fluctuando sobre ese valor, continuamente se están creando y aniquilando todo tipo de partículas, llamadas por eso virtuales, en las que el producto de su energía por el tiempo de su existencia efímera es menor que el cuanto de acción. Se llaman fluctuaciones cuánticas del vacío y son las responsables de que exista un que lo inunda todo llamado campo de punto cero.

Pero volvamos de nuevo a las fluctuaciones de vacío, que al igual que las ondas “reales” de energía positiva, están sujetas a las leyes de la dualidad onda/partícula; es decir, tienen tanto aspectos de onda como aspectos de partícula.

Las ondas fluctúan de forma aleatoria e impredecible, con energía positiva momentáneamente aquí, energía negativa momentáneamente allí, y energía cero en promedio. El aspecto de partícula está incorporado en el concepto de partículas virtuales, es decir, partículas que pueden nacer en pares (dos partículas a un tiempo), viviendo temporalmente de la energía fluctuacional tomada prestada de regiones “vecinas” del , y que luego se aniquilan y desaparecen, devolviendo la energía a esas regiones “vecinas”. Si hablamos de fluctuaciones electromagnéticas del vacío, las partículas virtuales son fotones virtuales; en el caso de fluctuaciones de la gravedad en el vacío, son gravitones virtuales.

De las llamadas fluctuaciones de vacío pueden surgir, partículas virtuales y quién sabe que cosas más… Hasta un nuevo Universo.

Son muchas las preguntas que no tienen respuestas

Parece que las fluctiuaciones ocurren en cualquier lugar, pero que, son tan minúsculas que ningún observador o experimentador las ha detectado de una manera franca hasta la fecha y, se sabe que están ahí por experimentos que lo han confirmado. Estas fluctuaciones son más poderosas cuanto menos escala se considera en el espacio y, por debajo de la longitud de Planck-Wheeler las fluctuaciones de vacío son tan enormes que el espacio tal como lo conocemos “pareciera estar hirviendo” para convertirse en una especie de espuma cuántica que parece que en realidad, cubre todo el espacio “vacío cuántico” que sabemos que está ahí y es el campo del que surgen esas partículas virtuales que antes menccionaba.

¿Espuma cuántica? Si profundizamos mucho en la materia… Podríamos ver otro universo distinto al nuestro. Las cosas miles de millones de veces más pequeñas que en nuestro mundo cotidiano, no parecen las mismas cosas.

Hay magnitudes asociadas con las leyes de la gravedad cuántica. La longitud de Planck-Wheeler, ![]() es la escala de longitud por debajo de la cual el tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro. ¡Qué locura!

es la escala de longitud por debajo de la cual el tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro. ¡Qué locura!

En el complejo general, por ahí, en alguna parte, permanece oculta esa teoría cuántica de la gravedad que incansables (pero sin ningún éxito hasta el momento) buscamos. Cuando sepamos unir las dos teorías de lo pequeño y lo grande, lo tendremos todo.

Como tantas veces hemos comentado, los trabajos que se han realizado sobre poder construir una teoría cuántica de la gravedad nos llevan a un sorprendente de implicaciones. Por un lado, sólo se ha podido conceptuar a la gravedad cuántica, siempre y cuando, el universo tenga más de cuatro dimensiones. Además, se llega a considerar que en la era de Planck, tanto el universo como la gravedad pudieron ser una sola cosa compacta estructurada por objetos cuánticos infinitamente diminutos, como los que suponemos que conforman las supercuerdas. A esta escala, el mismísimo espaciotiempo estaría sometido a imprescindibles fluctuaciones muy semejantes a las que causan las partículas al nacer y desaparecer de la existencia en el espaciotiempo ordinario. Esta noción ha conducido a los teóricos a describir el universo de la era cuántica como una especie de extremadamente densa y agitada espuma que pudo haber contenido las vibrantes cuerdecillas que propugnan los cosmólogos cuerdistas.

Los físicos especulan que el cosmos ha crecido a desde una «nada» primigenia que al nacer comenzó el principio del tiempo y que, en ese parto, contenía toda la materia y toda la energía.

En física como en todas las demás disciplinas científicas, los conocimientos avanzan y las teorías que sostuvieron los cimientos de nuestros conocimientos se van haciendo viejas y van teniendo que ser reforzadas con las nuevas y más poderosas “vigas” de las nuevas ideas y los nuevos hallazgos científicos que hacen posible ir perfeccionando lo que ya teníamos.

Recientemente se han alzado algunas voces contra el Principio de Incertidumbre de Heisenberg. He podido leer en un artíoculo de la prestigiosa Revista Nature, un artículo del premio Nobel de Física Gerald ´t Hoofft, en el que propone que la naturaleza probabilistica de la mecánica cuántica, desaparecería a la escala de Planck, en la que el comportamiento de la materia sería determinista; a longitudes mayores, energías más pequeñas.

El mundo de lo muy pequeño (el micro espacio), a nivel atómico y subatómico, es el dominio de la física cuántica, así nunca podríamos saber, de acuerdo m con el principio de incertidumbre, y, en un momento determinado, la posición y el estado de una partícula. Este estado podría ser una función de la escala espacio-temporal. A esta escala tamaños todo sucede demasiado deprisa para nosotros.

El “universo cuántico” nada es lo que parece a primera vista, allí entramos en otro mundo que en nada, se parece al nuestro

Cuando hablamos de la mecánica cuántica, tenemos mirar un poco hacia atrás en el tiempo y podremos darnos del gran impacto que tuvo en el devenir del mundo desde que, en nuestras vidas, apareció el átomo y, más tarde, sus contenidos. Los nombres de Planck, Einstein, Bohr, Heisenberg, Schrödinger, Pauli, Bardeen, Roentgen, Dirac y muchos otros, se pudieron a la cabeza de la lista de las personas más famosas. Aquel primer premio Nobel de Física otorgado en 1900 a Roentgen por descubrir los rayos X, en el mismo año llegaría el ¡cuanto! De Planck que inspiró a Einstein para su trabajo sobre el Efecto fotoeléctrico que también, le valdría el Nobel, y, a partir de ese momento, se desencadenó una especie de alucinante por saber sobre el átomo, sus contenidos, y, de qué estaba hecha la materia.

La conocida como Paradoja EPR y los conceptos de Tiempo y , presente, pasado y futuro.

“Nadie ha resuelto la paradoja del gato de Schroedinger, ni la paradoja de Einstein-Podolsky-Rosen. El principio de incertidumbre no se ha explicado y se asume como un dogma, lo mismo pasa con el spin. El spin no es un giro pero es un giro. Aquí hay un desafío al pensamiento humano. ¡Aquí hay una aventura del pensamiento!”

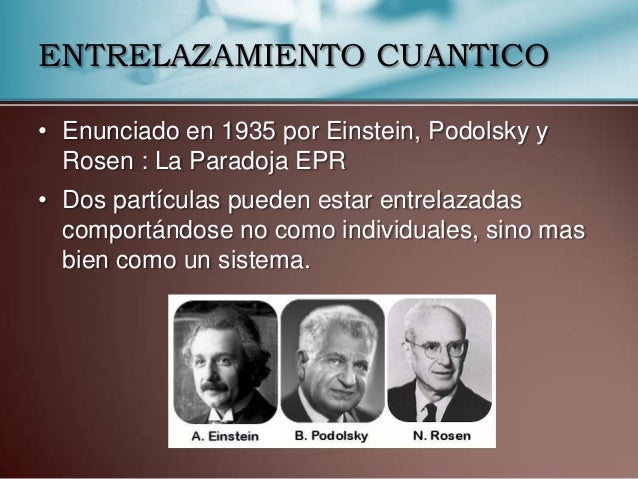

Fueron muchas las polémicas desatadas a cuenta de las aparentes incongruencias de la moderna Mecánica Cuántica. La paradoja de Einstein-Podolsky-Rosen, denominada “Paradoja EPR”, trata de un experimento mental propuesto por Albert Einstein, Boris Podolsky y Nathan Rosen en 1935. Es relevante, pues pone de manifiesto un problema aparente de la mecánica cuántica, y en las décadas siguientes se dedicaron múltiples esfuerzos a desarrollarla y resolverla.

A Einstein (y a muchos otros científicos), la idea del entrelazamiento cuántico le resultaba extremadamente perturbadora. Esta particular característica de la mecánica cuántica permite preparar estados de dos o más partículas en los cuales es imposible obtener útil sobre el estado total del sistema haciendo sólo mediciones sobre una de las partículas.

Por otro lado, en un entrelazado, manipulando una de las partículas, se puede modificar el estado total. Es decir, operando sobre una de las partículas se puede modificar el estado de la otra a distancia de manera instantánea. Esto habla de una correlación entre las dos partículas que no tiene paralaje en el mundo de nuestras experiencias cotidianas. Cabe enfatizar pues que cuando se mide el estado de una partícula, enseguida sabemos el estado de la otra, lo cual aparentemente es instantáneo, es decir, sin importar las distancias a las que se encuentren las partículas, una de la otra, ambas saben instantáneamente el estado de la otra.

El experimento planteado por EPR consiste en dos partículas que interactuaron en el pasado y que quedan en un estado entrelazado. Dos observadores reciben cada una de las partículas. Si un observador mide el momento de una de ellas, sabe cuál es el momento de la otra. Si mide la posición, gracias al entrelazamiento cuántico y al principio de incertidumbre, puede la posición de la otra partícula de forma instantánea, lo que contradice el sentido común.

Animación que muestra dos átomos de oxígeno fusionándose para formar una molécula de O2 en su estado cuántico fundamental. Las nubes de color representan los orbitales atómicos. Los orbitales 2s y 2p de cada átomo se combinan para formar los orbitales σ y π de la molécula, que la mantienen unida. Los orbitales 1s, más interiores, no se combinan y permiten distinguir a cada núcleo. Lo que ocurre a escalas tan pequeñas es fascienante.

Si nos pudiéramos convertir en electrones, por ejemplo, sabríamos dónde y cómo estamos en cada momento y podríamos ver asombrados, todo lo que estaba ocurriendo a nuestro alrededor que, entonces sí, veríamos transcurrir a un ritmo más lento del que podemos detectar en los electrones desde nuestro macroestado espacio temporal. El electrón, bajo nuestro punto de vista se mueve alrededor del núcleo atómico a una velocidad de 7 millones de km/h.

A medida que se asciende en la escala de tamaños, hasta el tiempo se va ajustando a esta escala, los objetos, a medida que se hacen mayores se mueven más despacio y, además, tienen más duración que los pequeños objetos infinitesimales del micro mundo cuántico. La vida media de un neutron es de unos 15 minutos, por ejemplo, mientras que la vida media de una estrellas se puede contar en miles de millones de años.

En nuestra macroescala, los acontecimientos y ,los objetos se mueven a velocidades que a nosotros nos parecen normales. Si se mueven con demasiada lentitud nos parece que no se mueven. Así hablamos de escala de tiempo geológico, para referirnos al tiempo y velocidad de la mayor parte de los acontecimientos geológicos que afectan a la Tierra, el tiempo transcurre aquí en millones de años y nosotros ni lo apreciamos; nos parece que todo está inmóvil. Nosotros, los humanos, funcionamos en la escala de años (tiempo biológico).

El Tiempo Cosmológico es aún mucho más dilatado y los objetos cósmicos (mundos, estrellas y galaxias), tienen una mayor duración aunque su movimiento puede ser muy rápido debido a la inmensidad del espacio universal en el que se mueven. La Tierra, por ejemplo, orbita alrededor del Sol a una velocidad media de 30 Km/s., y, el Sol, se desplaza por la Galaxia a una velocidad de 270 km/s. Y, además, se puede incrementar el tiempo y el espacio en su andadura al estar inmersos y ligados en una misma maya elñástica.

Así, el espacio dentro de un átomo, es muy pequeño; dentro de una célula, es algo mayor; dentro de un animal, mayor aún y así sucesivamente… hasta llegar a los enormes espaciosa que separan las estrellas y las galaxias en el Universo.

Distancias astronómicas separan a las estrellas entre sí, a las galaxias dentro del cúmulo, y a los cúmulos en los supercúmulos.

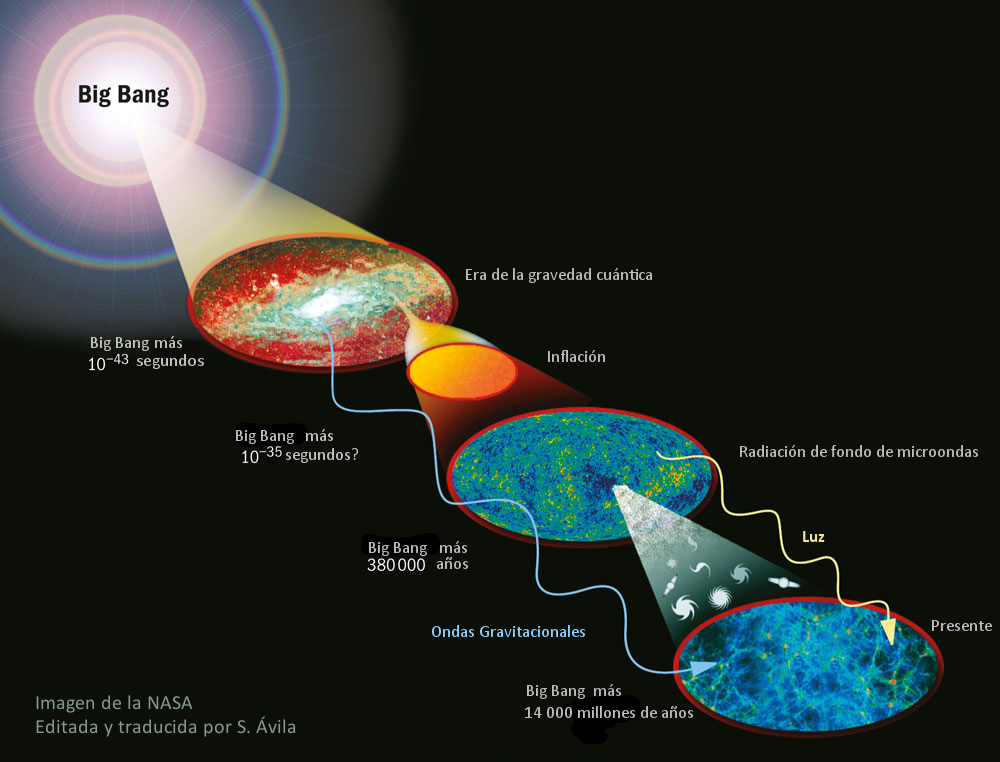

Las distancias que separan a los objetos del Cosmos se tienen que medir con unidades espaciales, tal es su inmensa magnitud que, nuestras mentes, aunque podamos hablar de ellas de manera cotidiana, en realidad, no han llegado a asimilarlas.Y, a todo ésto, los físicos han intentado con denuedo elaborar una teoría completa de la gravedad que incluya la mecánica cuántica. Los cálculos de la mayoría de las teorías propuesta de la «gravedad cuántica» arrojan numerosos infinitos. Los físicos no están seguros si el problema es técnico o conceptual. No obstante, incluso prescindiendo de una teoría completa de gravedad cuántica, se puede deducir que los efectos de la teoría cuántica, habrían cruciales durante los primeros 10-43 segundos del inicio del universo, cuando éste tenía una densidad de 1093 gramos por centímetro cúbico y mayor. (El plomo sólido tiene una densidad de aproximadamente diez gramos por centímetro cúbico.) Este período, que es el que corresponde a la era de Planck, y a su estudio se le llama cosmología cuántica. Como el universo en su totalidad habría estado sujeto a grandes incertidumbres y fluctuaciones durante la era de Planck o era cuántica, con la materia y la energía apareciendo y desapareciendo de un vacío en grandes cantidades, el concepto de un principio del universo podría no tener un significado bien definido. En todo caso, la densidad del universo durante este período es de tal magnitud que escapa a nuestra comprensión. Para propósitos prácticos, la era cuántica podría considerarse el estado inicial, o principio, del universo. En consecuencia, los procesos cuánticos ocurridos durante este período, cualquiera sea su naturaleza, determinaron las iniciales del universo.

Una cosa nos ha podido quedar clara: Los científicos para lograr conocer la estructura del universo a su escala más grande, deben retroceder en el tiempo, centrando sus teorías en el momento en que todo comenzó. Para ello, como todos sabéis, se han formulado distintas teorías unificadoras de las cuatro fuerzas de la naturaleza, con las cuales se han modelado acontecimiento y en el universo primitivo casi a todo lo largo del camino hasta el principio. Pero cómo se supone que debió haber habido un «antes», aparece una barrera que impide ir más allá de una frontera que se halla fijada a los 10-43 [s] después del Big Bang, un instante conocido como «momento de Planck», en homenaje al físico alemán Max Planck.

Esta barrera existe debido a que antes del momento de Planck, durante el período llamado la «era de Planck o cuántica», se supone que las cuatro fuerza fundamentales conocidas de la naturaleza eran indistinguibles o se hallaban unificadas , que era una sola fuerza. Aunque los físicos han diseñado teorías cuánticas que unen tres de las fuerzas, una por una, a través de eras que se remontan al momento de Planck, hasta ahora les ha prácticamente imposible armonizar las leyes de la teoría cuántica con la gravedad de la relatividad de Einstein, en un sólo modelo teórico ampliamente convincente y con posibilidades claras de ser contrastado en experimentos de laboratorio y, mucho menos, con observaciones.

Y después de todo ésto, sólo una caso me queda clara: ¡Lo poco que sabemos! A pesar de la mucha imaginación que ponemos en las cosas que creemos conocer.

emilio silvera

Ene

10

Cosas de la Mecánica Cuántica

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

¡La Física! Esa maravilla que está presente en todo lo que podemos ver y en aquello donde la vista no llega. La infinitud de las partículas elementales que forman todo cuanto existe en la Naturaleza, no siempre se dejan ver ni hacen posible que podamos observar las maravillas que pueden llevar a cabo,

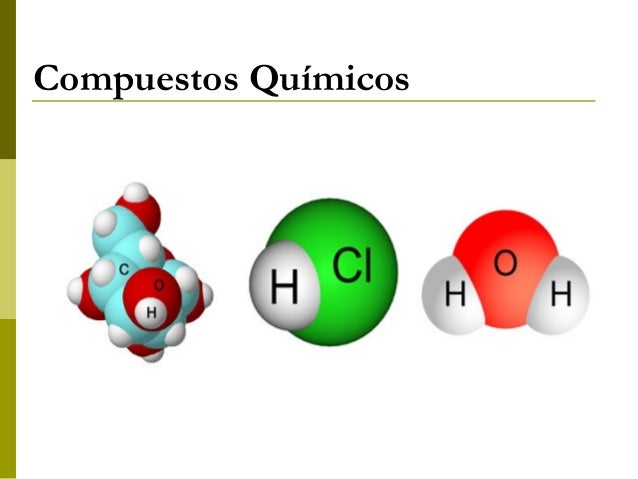

Las sustancias formadas por una sola clase de átomos se llaman elementos químicos, y, si está conformada por distintos átomos, son compuestos. La palabra “átomo” procede del griego ατομος, que significa “indivisible” y el uso de la palabra “elemento” sugiere que se ha llegado a los ladrillos básicos con los que está formada la materia. De hecho, esta es la imagen que se tenía a mediados del siglo XIX cuando se acuñaron estos términos. Sin embargo, hoy sabemos que todo esto es falso, que los átomos se pueden dividir y que, de esta manera, los elementos han dejado de ser verdaderamente elementales. Los físicos continúan con esta nomenclatura aunque sea formalmente incorrecta, ya que, la costumbre, como dicen los juristas, no pocas veces rigen la jerga de las leyes.

A todo esto y hablando de los átomos, por fuerza, nos tenemos que acordar del electrón que da al átomo su forma esférica. Son partículas cargadas eléctricamente que se mueven alegremente alrededor del núcleo. El electrón es muy ligero: su masa es solamente 1/1.8836 de la del núcleo más ligero (el hidrógeno). La carga eléctrica del electrón es de signo opuesto a la del núcleo, de manera que los electrones están fuertemente atraídos hacia el núcleo y se repelen mutuamente. Si la carga eléctrica total de los electrones en un átomo iguala a la del núcleo, para lo que generalmente se necesitan varios electrones, se dice que el átomo está en equilibrio o que es eléctricamente neutro.

Claro que, no debemos olvidarnos de que, ¡Todo lo grande está hecho de cosas pequeñas! Una inmensa galaxia se conforma de un conjunto inmenso de átomos inifinitesimales que juntos, hace ese gran todo.

La fuerza a la que obedecen los electrones, la denominada fuerza electrostática o de Coulomb, es matemáticamente bastante sencilla y, sin embargo, los electrones son los responsables de las importantes propiedades de los “enlaces químicos”. Esto se debe a que las leyes de movimiento de los electrones están regidas completamente por la “mecánica cuántica”, teoría que se completó a principios del siglo XX. Es una teoría paradójica y difícil de entender y explicar, pero al mismo tiempo es muy interesante, fantástica y revolucionaria. Cuando uno se introduce en las maravillas de la mecánica cuántica es como si hiciera un viaje a un universo que está situado fuera de este mundo nuestro, ya que, las cosas que allí se ven, desdicen todo lo que dicta nuestro sentido común de cómo tiene que ser el mundo que nos rodea.

La perfecta sincronía Está en la Naturaleza

No solamente los electrones, sino también los núcleos atómicos y los átomos en su conjunto obedecen y se rigen por la mecánica cuántica. La Física del siglo XX empezó exactamente en el año 1900, cuando el físico alemán Max Planck, escribió un artículo de ocho páginas y allí propuso una posible solución a un problema que había estado intrigando a los físicos durante años. Es el problema de la luz que emiten los cuerpos calentados a una cierta temperatura, y también la radiación infrarroja emitida, con menos intensidad, por los objetos más fríos.

Estaban bien aceptados entonces que esta radiación tenía un origen electromagnético y que se conocían las leyes de la naturaleza que regían estas ondas electromagnéticas. También se conocían las leyes para el frío y el calor, la así llamada “termodinámica”, o al menos eso parecía. Pero si usamos las leyes de la termodinámica para calcular la intensidad de la radiación, el resultado no tiene ningún sentido. Los cálculos nos dicen que se emitiría una cantidad infinita de radiación en el ultravioleta más lejano, y, desde luego, esto no es lo que sucede. Lo que se observa es que la intensidad de la radiación muestra un pico a una cierta longitud de onda característica, y que la intensidad disminuye tanto para las longitudes mayores como para las longitudes menores. Esta longitud característica es inversamente proporcional a la temperatura absoluta del objeto radiante (la temperatura absoluta se define por una escala de temperatura que empieza a 273 ºC bajo cero). Cuando a 1.000 ºC un objeto se pone al “rojo vivo”, el objeto está radiando en la zona de luz visible.

Lo que Planck propuso fue simplemente que la radiación sólo podía ser emitida en paquetes de un tamaño dado. La cantidad de energía de uno de esos paquetes, o cuantos, es inversamente proporcional a la longitud de la onda y, por lo tanto, proporcional a la frecuencia de la radiación emitida. La sencilla fórmula es:

E = h x v

Donde E es la energía del paquete, v la frecuencia y h es una nueva constante fundamental de la naturaleza, la constante de Planck. Cuando Planck calculó la intensidad de la radiación térmica imponiendo esta nueva condición, el resultado coincidió perfectamente con las observaciones.

Los cuantos de energía están presentes por todas partes y en todos los objetos

Poco tiempo después, en 1905, Einstein formuló esta teoría de una forma mucho más tajante: el sugirió que los objetos calientes no son los únicos que emiten radiación en paquetes de energía, sino que toda la radiación consiste en múltiplos de los paquetes de energía de Planck. El príncipe francés Louis-Victor de Broglie, dándole otra vuelta a la teoría, propuso que no sólo cualquier cosa que oscila tiene una energía, sino que cualquier cosa con energía se debe comportar como una “onda” que se extiende en una cierta región del espacio, y que la frecuencia, v, de la oscilación verifica la ecuación de Planck. Por lo tanto, los cuantos asociados con los rayos de luz deberían verse como una clase de partículas elementales: el fotón. Todas las demás clases de partículas llevan asociadas diferentes ondas oscilatorias de campos de fuerza.

El curioso comportamiento de los electrones en el interior del átomo, descubierto y explicado por el famoso físico danés Niels Bohr, se pudo atribuir a las ondas de De Broglie. Poco después, en 1926, Erwin Schrödinger descubrió como escribir la teoría ondulatoria de Debroglie con ecuaciones matemáticas exactas. La precisión con la cual se podían realizar cálculos era asombrosa, y pronto quedó claro que el comportamiento de todos los objetos pequeños estaban exactamente determinados por la recién descubiertas “ecuaciones de onda cuánticas”.

Pocas dudas nos pueden caber a estas alturas de que la mecánica cuántica (de Planck) y, la Relatividad –tanto especial como general- (de Einstein), además de ser las dos teorías más importantes de la Física de nuestro tiempo, funcionan de tal forma que uno, cuando profundiza en sus predicciones y las compara con lo que ocurre en el Universo, no puede por menos que, asombrarse, al comprobar como unas mentes humanas han sido capaces de llegar a estos profundos pensamientos que nos acerca a la realidad de la Naturaleza.

emilio silvera

Ene

9

¡La Luz! ¡La Mecánica Cuántica! Nuestro Universo

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Cuando en nuestro Universo quedaron libres los fotones… ¡Se hizo la Luz!

En alguna parte he podido leer que para comprender la realidad en sus niveles más elementales, basta con conocer el comportamiento de dos infinitesimales objetos: el electrón y el fotón. Todo el argumento de la QED [electrodinámica cuántica] gira en torno a un proceso fundamental: la emisión de un único fotón por un único electrón.

Cuando el movimiento de un electrón es alterado súbitamente, puede responder desprendiendo un fotón. La emisión de un fotón es el suceso básico de la mecánica cuántica:

Un equipo de científicos lograron filmar por primera vez un electrón en movimiento gracias a una tecnología reciente que genera pulsos cortos e intensos de luz láser.

Toda la luz visible que vemos, así como las ondas de radio, la radiación infrarroja y los rayos X, está compuesta de fotones que han sido emitidos por electrones, ya sea en el Sol, el filamento de una bombilla, una antena de radio o un aparato de rayos.

Los electrones no son las únicas partículas que pueden emitir fotones. Cualquier partícula eléctricamente cargada puede hacerlo, incluido el protón. Esto significa que los fotones pueden saltar entre dos protones o incluso entre un protón y un electrón. Este hecho es de enorme importancia para toda la ciencia y la vida en general. El intercambio continuo de fotones entre el núcleo y los electrones atómicos proporciona la fuerza que mantiene unido al átomo. Sin estos fotones saltarines, el átomo se desharía y toda la materia dejaría de existir.

|

Se ha conseguido observar por primera vez la desintegración radiativa del neutrón.

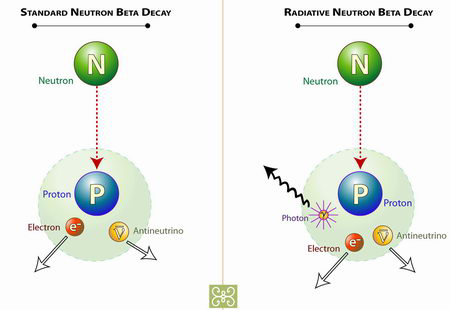

Dentro de los núcleos de los átomos hay neutrones y protones. En condiciones normales y mientras que están ahí los neutrones son estables. Sin embargo los neutrones libres son inestables, tienen una vida media de unos 10 minutos, y se desintegran produciendo un protón un electrón y un antineutrino. Pero los físicos nucleares teóricos predijeron que una de cada mil veces los neutrones decaerían en todas esas partículas y además en un fotón.

Típicamente el neutrón decae en un protón, un antineutrino y un electrón. Muy raramente lo hace radiativamente emitiendo además un fotón. Diagrama: Zina Deretsky, National Science Foundation.

Mientras que un electrón pertenece al grupo de partículas llamadas fermiones, los fotones pertenecen a la familia de los bosones. Intentemos comprender esta película que es la intermediaria de todas las formas de radiación electromagnética.

…protagonizada por bosones…

Los fermiones hacen posible la materia “al estilo tradicional”, mientras que los bosones son elementos muy raros desde la forma de pensar a que estamos acostumbrados el común de los mortales. Para no complicarnos, la tabla periódica de elementos existe porque los fermiones no pueden “ser iguales”: no pueden solaparse uno sobre otro y se repelen si los obligamos. Es lo que damos por hecho cuando hablamos de materia, que cada pedazo de ésta ocupa su lugar y tiene sus propias cualidades.

Toda la materia que conocemos, la que forma las estrellas y los mundos y las galaxias, esa que llamamos luminosa o bariónica, la que emite radiación, está hecha de Leptones y Quarks, partículas que son Fermiones, y, esas otras partículas intermediarias de las cuatro fuerzas fundamentales, son las que pertenecen a la familia de los Bosones, tales como el Fotón, las W+, W- y Zº, los Gluones y el Gravitón.

Los bosones carecen de este sentido de la individualidad que tienen los Fermiones, digamos que poseen “alma grupal” y, en su estado más puro, todos forman una misma “superpartícula”.

Para entenderlo mejor, conviene recordar que las partículas no son bolitas como nos siguen enseñando en la escuela, sino que más allá de esta imagen existen como ondas o, al menos, sus funciones se equiparan al comportamiento de una onda.

En la década de 1920, Albert Einstein y el hindú Satyendra Nath Bose pronosticaron un quinto estado de la materia: el condensado de Bose-Einstein (BEC), el cual fue conseguido en laboratorio en 1995, algo que le valió el premio Nobel de 2001 a los científicos que lo lograron.

Un condensado de Bose-Einstein es un estado de la materia que se da en ciertos materiales a muy baja temperatura. En este estado de la materia, todos los átomos que lo constituyen se encuentran en el nivel de mínima energía, denominado estado fundamental. Descubierto en 1924 para los fotones por el indio Bose y por Einstein, no fue obtenido en laboratorio hasta 1995 por Cornell y Wieman al enfriar átomos a pocos nanokelvin por encima del cero absoluto. El condensado de Bose-Einstein fue la “molécula del año” según la revista Science en 1995 ya que se trata de un sistema cuántico macroscópico similar a una molécula pero con millones de átomos. Un átomo en un gas se mueve a una velocidad de unos unos 1000 km/h (unos 300 m/s) pero un condensado de Bose-Einstein se mueve a sólo 1 cm/s. Un condensado de Bose-Einstein es respecto a la materia ordinaria, como la luz de un láser es respecto a la de una bombilla. Gracias a ello se puede fabricar un láser de átomos, que en lugar de producir un haz de luz como un láser óptico, produce un haz (coherente) de átomos. En 1997 Ketterle fabricó el primer láser de átomos que producía un haz de átomos de sodio.

Cuando ciertas formas de materia [bosones] se enfrían hasta casi el cero absoluto, sus átomos se ponen en el estado de energía más baja, de modo que todos sus átomos vibran al unísono y se hacen coherentes. Las funciones de onda de todos los átomos se solapan, de manera que, en cierto sentido, un BEC [condensado de Bose-Einstein] es como un “superátomo” gigante en donde todos los átomos individuales vibran al unísono.

Al enfriar los átomos, su velocidad disminuye hasta que las longitudes de onda de cada uno de ellos se vuelven casi planas, superponiéndose unas a otras para formar una única onda que los describe a todos.

Así que un BEC se forma cuando los átomos en un gas sufren la transición de comportarse como “bolas de billar” al estilo de la física clásica, a comportarse como una onda gigante de materia al estilo de mecánica cuántica:

Si creamos dos BECs y los colocamos juntos, no se mezclan como gases ordinarios ni rebotan como lo harían dos sólidos. Donde los dos BECs se superponen, ellos “interfieren” como las ondas: delgadas capas paralelas de materia son separadas por capas delgadas de espacio vacío. El patrón se forma porque las dos ondas se suman donde sus crestas coinciden, y se cancelan donde una cresta se encuentra con un valle — a lo cual llamamos interferencia “constructiva” y “destructiva” respectivamente. El efecto es similar al de dos ondas que se superponen cuando dos piedras son lanzadas a un lago.

…ambientada en: el vacío…

Y ahora, retrocedamos un poco más en este asunto del misterio que nos ocupa. Gracias a la tecnología láser, la física ha podido comprobar el extremo poder de la luz. Los láseres pueden hacer que las partículas virtuales se vuelvan reales. Pero, primero, aclaremos conceptos…

Las “Partículas virtuales”son partículas fundamentales que están constantemente surgiendo aparentemente de la nada y permanecen en el espacio-tiempo la friolera de una milésima de trillonésima de segundo –una cantidad que se forma poniendo una veintena de ceros a la derecha de la coma—. A pesar de denominarse “virtuales”, sus efectos son muy reales: la constante agitación de este burbujeo cuántico de partículas hace que el vacío tenga energía. Y esto es algo que afecta a la realidad, pues en ésta las fuerzas de atracción y repulsión dependen de la masa, y la masa no es sino energía expresada en unidades diferentes: E=mc².

Partículas virtuales que surgen de la NADA. Claro que, en la NADA no hay…¡Nada! Si surgió es porque había. La Nada no existe, siempre hay. Ni en el más sofisticado laboratorio se ha conseguido un vacío total.

En el uso corriente la palabra vacío significa espacio vacío, espacio del que se ha extraído todo el aire, vapor de agua u otro material. Eso es también lo que significa para un físico experimental que trabaja con tubos de vacío y bombas de vacío. Pero para un físico teórico, el término vacío tiene muchas más connotaciones. Significa una especie de fondo en el que tiene lugar el resto de la física. El vacío representa un potencial para todas las cosas que pueden suceder en ese fondo. Significa una lista de todas las partículas elementales tanto como de las constantes de la Naturaleza que se pondrían de manifiesto mediante experimentos en dicho vacío. En resumen, significa un ambiente en el que las leyes de la física toman una forma particular. Un vacío diferente significa leyes de la física diferentes; cada punto en el paisaje representa un conjunto de leyes que son, con toda probabilidad, muy diferentes de las nuestras pero que son, en cualquier caso, posibilidades consistentes. El modelo estándar es meramente un punto en el paisaje de posibilidades.

La energía del vacío es, por tanto, la suma total de las energías de todas las partículas posibles. Es la llamada “energía oscura” que hace que el universo se expanda, haciendo frente a la atracción de la gravedad, y que proporciona alrededor del 80% de la materia-energía al universo –un 26% es “materia oscura”, y sólo un 4% es la materia conocida hasta el momento—.

Pero, ¿cómo una partícula virtual se convierte en real? Es decir, ¿cómo queda “atrapada” en el espacio-tiempo de forma más estable?

¡Los fotones de Yang-Mills adquieren su masa y el principio gauge se sigue cumpliendo! Al principio esta visión no mereció la atención que merecía. Por una parte, la gente pensó que el modelo era feo. El principio gauge estaba ahí, pero ya no era el tema central. El “Campo de Higgs” había sido puesto ahí “a propósito” y la “partícula de Higgs”, en sí misma, no era una “partícula gauge”

La Teoría de la Sipersimetría establece que, por cada partícula de materia, nace una gemela de antimateria. La antimateria es igual que la materia, pero con carga opuesta. Por ejemplo, el electrón tiene carga negativa, y su partícula de antimateria, el positrón, positiva. Materia y antimateria se aniquilan mutuamente pero, por algún motivo aún no aclarado, la simetría se rompió en algún momento, surgiendo más materia que antimateria, de ahí que nuestro universo, materia, pueda existir.

Pero hay algo más en todo esto. Y para ello, la luz es la clave.

Controlar los estados cuánticos macroscópicos de osciladores micromecánicos no es fácil; hacerlo con luz (fotones) requiere el acoplamiento coherente entre …

Una de los modelos teóricos elaborados para superar la visión de la gravedad de Einstein indica que los fotones de los rayos gamma de alta energía viajarían algo más despacio que los de baja energía, lo que viola el axioma del sabio alemán acerca de que toda radiación electromagnética, desde las ondas radio hasta los rayos gamma, viajan en el vacío a la misma velocidad (la de la luz). Sin embargo, no ha sido verificado mediante experimento, con lo cual, Einstein sigue teniendo razón.

… protagonizada por la “luz” como la propia …

Ya en los años 30, los físicos predijeron que un campo eléctrico muy fuerte, que no es sino un espacio alterado por la actividad de un montón de fotones coordinados, podría impulsar a las partículas virtuales con carga opuesta en diferentes direcciones, impidiendo que la materia y la antimateria se aniquilen.

Según el efecto de creación de pares, un fotón con energía suficiente, lo que equivale a tener el doble de la energía que posee un electrón en reposo, da lugar a una pareja de electrón y positrón.

Aunque esto ya se consiguió en los años 90 a pequeña escala, gracias al desarrollo de la tecnología láser los científicos creen que estarán cerca de conseguir crear materia “en serie” mediante este proceso en unos pocos años.

Pero el problema no termina, sino que, el electrón formado por un rayo gama, no interactúa con este tipo de fotón (gama), sino uno de luz visible,

Por otra parte, una vez que existen las partículas, los fotones interactúan sin cesar con ellas, siendo absorbidos y emitidos por las mismas de manera ininterrumpida.

Y de ello nace el movimiento gracias al cual todo existe en el espacio-tiempo. Sin movimiento, nuestra realidad desaparecería.

La carencia de masa de un fotón está ligada a su movimiento. Para que un cuerpo alcance la velocidad de la luz, su masa ha de ser cero. Y, como Einstein explicó en su día, la luz se mueve siempre a la velocidad de la luz. Si pretendemos que un fotón se pare, en lugar de ralentizarse observaremos que desaparece. Y, como se ha dicho al principio, si estos “fotones saltarines” desaparecieran, toda la materia dejaría de existir.

Su esencia es el movimiento y su misión, según parece, hacer girar la rueda de la existencia.

Ello es así debido al impacto de los fotones sobre las partículas elementales. La energía transmitida por un fotón es inversamente proporcional a su longitud de onda. Cuanto menos longitud de onda, más energía. Así, un fotón de luz visible tiene la energía suficiente para hacer reaccionar a un bastón de la retina. Si nos movemos en el espectro electromagnético, los fotones con longitud de onda ultravioleta pueden expulsar a los electrones de los átomos. Más allá, los rayos gamma pueden romper protones y neutrones…

Y ahora, vayamos al meollo de la cuestión e indaguemos en la cita con que se iniciaba este artículo: ¿qué hace que los electrones absorban y emitan fotones? Esto, en otros términos, vendría a ser lo mismo que preguntarnos: ¿por qué existe nuestro universo?

…con un misterio: el 137…

¿Qué determina el momento exacto en que un electrón emite un fotón? La física cuántica dice que nada lo hace, pues la Naturaleza es caprichosa en sus niveles más elementales. Aunque no es caótica en extremo, sólo probabilística.

A diferencia de la física newtoniana, la mecánica cuántica nunca predice el futuro en función del pasado. En su lugar, ofrece reglas muy precisas para computar la probabilidad de varios resultados alternativos de un experimento.

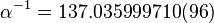

Y la probabilidad de que un electrón emita o absorba un fotón es la constante de estructura fina. El valor de esa constante es 1/137.

En otras palabras, sólo un afortunado electrón de cada 137 emite un fotón. Este es el significado de alfa: es la probabilidad de que un electrón, cuando se mueve a lo largo de su trayectoria, emita caprichosamente un fotón.

El inverso de la constante de estructura fina es 137. Desde su descubrimiento, éste número ha traído de cabeza a los grandes científicos.

No puedo recordar si fue Richard Feynman o León Lederman, quien sugirió que todos los físicos pusiesen un cartel en sus despachos o en sus casas que les recordara cuánto es lo que no sabemos. En el cartel no pondría nada más que esto: 137. Ciento treinta y siete es el inverso de algo que lleva el nombre de constante de estructura fina. Este número guarda relación con la probabilidad de que un electrón emita o absorba un fotón. La constante de estructura fina responde también al nombre de alfa, y sale de dividir el cuadrado de la carga del electrón por el producto de la velocidad de la luz y la constante de Planck. Tanta palabra no significa otra cosa sino que ese solo número, 137, encierra los meollos del electromagnetismo (el electrón), la relatividad (la velocidad de la luz) y la teoría cuántica (la constante de Planck). Menos perturbador sería que la relación entre todos estos importantes conceptos hubiera resultado ser un uno o un tres o quizás un múltiplo de pi. Pero ¿137?

![]()

denotada g, es un número que determina la fuerza de una interacción) y equivale a 1/137,03599911.

“Lo más notable de este notable número es su adimensionalidad. La velocidad de la luz es de unos 300.000 kilómetros por segundo. Abraham Lincoln medía 1,98 metros. La mayoría de los números vienen con dimensiones. Pero resulta que cuando uno combina las magnitudes que componen alfa, ¡se borran todas las unidades! El 137 está solo: se exhibe desnudo a donde va. Esto quiere decir que a los científicos de Marte, o a los del decimocuarto planeta de la estrella Sirio, aunque usen Dios sabe qué unidades para la carga y la velocidad y qué versión de la constante de Planck, también les saldrá 137. Es un número puro.”

(Leon Ledderman, La partícula divina)

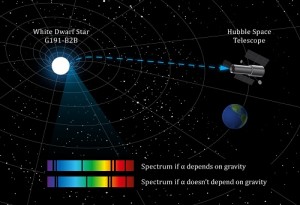

Físicos de la University of New Wales (UNSW) tienen una teoría cuando menos controvertida, y es la de que la constante de estructura fina, ? (alpha), en realidad no es constante. Y ahora, van a estudiar los alrededores de una enana blanca lejana, con una gravedad más de 30.000 veces mayor que la de la tierra, para comprobar su hipótesis.

Uno de los padres de la mecánica cuántica, Wolfgang Pauli, se obsesionó tanto con este número que dijo que, de poder hacerle una pregunta a Dios, sería esta: “¿Por qué 137?”

Gracias a su gran amistad con Carl G. Jung, Pauli conoció el mundo “alternativo” de los estudios sobre la psique y accedió a la tradición esotérica que ha acompañado al hombre desde el principio de los tiempos. Es así como supo que 137 se aproxima al valor correspondiente al ángulo áureo. Esto es, la versión circular del número áureo o φ (phi).

Sin fotones… ¡El Universo sería inestable, sería otro universo diferente!

En realidad, el ángulo de oro es, más o menos, 137,5º, y está presente en todo proceso natural donde se dé una combinación de espirales. Así, por ejemplo, las hojas de una planta surgen a lo largo del tallo cada 137,5º, pues así se logra la mayor eficiencia de espacio y de captación de la luz solar, ya que únicamente con éste ángulo es posible evitar que ninguna hoja obstaculice a las demás en la toma de luz sin que existan espacios muertos o vacíos.

Esta semejanza entre los valores de la constante de estructura fina y el ángulo áureo llevó a la doctora Raji Heyrovska a buscar el ángulo áureo en el universo atómico (véase versión en español de su estudio).

Que esto sea así no debería extrañarnos, pues si el número áureo es una constante en toda la Naturaleza, su versión angular es la apropiada para estar presente en el universo cuántico, donde, recordemos, los elementos básicos de la realidad se reducen a funciones de onda.

…y un final místico.

Los fotones no tienen masa ni carga eléctrica. Sin embargo, pueden “extraer” del vacío partículas con masa y carga, tanto negativa como positiva.

Más allá de la matería y la energía, del tiempo y del espacio, el concepto de función de onda nos introduce en una realidad abstracta de donde surge todo.Y si, como hemos dicho, a menor longitud de onda mayor energía, también es posible afirmar que, en eso que David Bohm llamaba “orden implicado”, cuanto menor es la longitud de una onda cuántica, mayor es la presencia de masa en el espacio-tiempo.

Para la física, las matemáticas se han mostrado como la realidad que subyace a la materia. Todo se puede reducir a números, entidades que forman y organizan el espacio-tiempo. En este nivel de realidad, ni la materia ni la energía existen como tales, sino que demuestran ser el resultado de la interacción de entidades abstractas.

En esta pasión por los números, no podemos evitar recordar la versión cabalística de la filosofía perenne. Para la Kabbalah, lo divino responde a la “Nada”, ya que lo trascendente no puede ser aprehendido desde nuestra posición en el mundo finito.

En el momento de la Creación, la luz infinita se habría divido, quedando encerrada en conductos que, al romperse, producen la materia y, en definitiva, la fractura de la unidad primordial de la luz.

Esta materia o qelippot, en el sentido de “conchas” o caparazones que “encierran” la luz y rompen la harmonía unitaria de la luz, es el origen del mundo, de su finitud y causa del mal en la realidad no-divina. El mundo creado es así una fractura de la harmonía de la luz que crea la diferenciación y la tensión entre unas cosas y otras: este es el origen del mal, de la falta de harmonía que debe recuperarse en el curso de la historia.

La Kabbalah enseña, según esto, el camino para desarrollar la Vasija interior donde recibir la Luz, la cual, según va llenando dicha vasija, nos acerca a la unidad del Espíritu. Es así que la Luz, al tiempo que “absorbida” por el alma, puede ser “proyectada” en el mundo mediante los actos del hombre trascendido.

Que la luz ha sido usada por todos los movimientos espirituales para referirse a lo divino es algo que a nadie se le escapa. La imagen que la Kabbalah ofrece aquí no es muy diferente de la que podríamos encontrar en textos rosacruces o en escritos orientales, entre otros.

Sin embargo, si esta vez he preferido usar el hermetismo hebreo es, como he mencionado, por su pasión hacia los números. Y es que el valor numérico para el término hebreo de “kabbalah” (cuya traducción es “recepción”) es…

como muchos ya sabrán…

Efectivamente…

137.

Ciencia y tradición hermética unidas por un número que, en ambas, define la interacción entre luz y materia.

Cosas…

Luz que, también en ambos casos, procede de la Nada.

Decía Jung que el espacio y el tiempo son conceptos hipostasiados, fenómenos que hemos decidido convertir en reales. La física teórica y la consolidación de la mecánica cuántica han dejado claro, a lo largo de las últimas décadas, que toda esta realidad por la que combatimos, matamos, morimos, odiamos, repudiamos, humillamos, codiciamos, envidiamos o ansiamos consiste, simplemente, en Nada.

Nada…

Una ilusión de la psique por la que renunciamos a indagar en el misterio de la Vida y nuestra experiencia momentánea en el espacio-tiempo se convierte en un vagar ausentes, asumiendo que todo es un sinsentido.

A veces, en momentos de bajón, me pregunto si no será por eso por lo que, casi cien años después, nos siguen diciendo que la física cuántica es muy complicada para que lleguemos a entenderla…

Lo más triste, sin embargo, es que lo aceptamos…

Todo esto lo he leido o aprendido de gente que son más sabios que yo, ideas que tienen sus fuentes en trabajos realizados con la misión y el propósito de desvelar los secretos de la Naturaleza para saber, como es el Universo.

Lo conseguiremos alguna ve?

emilio silvera

Totales: 87.042.844

Totales: 87.042.844 Conectados: 88

Conectados: 88