Ago

13

¡La misteriosa Mecánica cuántica!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

.

.¡Qué maravilla! Poder imaginar…y comprobar

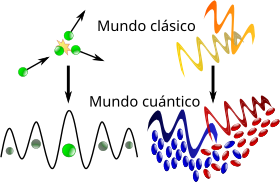

El modelo estándar de la física de partículas es una teoría que describe las relaciones entre las interacciones fundamentales conocidas y las partículas elementales que componen toda la materia. Es una teoría cuántica de campos desarrollada entre 1970 y 1973 que es consistente con la mecánica cuánticay la relatividad especial. Hasta la fecha, casi todas las pruebas experimentales de las tres fuerzas descritas por el modelo estándar están de acuerdo con sus predicciones. Sin embargo, el modelo estándar no alcanza a ser una teoría completa de las interacciones fundamentales debido a que no incluye la gravedad, la cuarta interacción fundamental conocida, y debido también al número elevado de parámetros numéricos (tales como masas y constantes que se juntan) que se deben poner a mano en la teoría (en vez de derivarse a partir de primeros principios).

Se que una vez Albert Einstein alagó al actor Charles Chaplin diciéndole: “Lo que siempre he admirado de usted es que su arte es universal, todo el mundo le comprende y admira”. A esto Chaplin respondió a Einstein: “Lo suyo es mucho más digno de respeto, todo el mundo le admira y prácticamente nadie le comprende”.

Es cierto lo que Chaplin decía, todos admiraban a Einstein y pocos comprendían sus postulados. De hecho, cuando estaba buscando la teoría de Todo, la gente se amontonaban, literalmente, ante los escaparates de la Quinta Avenida para ver las Ecuaciones que pocos entendían…¡Así somos los Humanos! Lo que no comprendemos nos produce temor o admiración, o, las dos cosas a la vez.

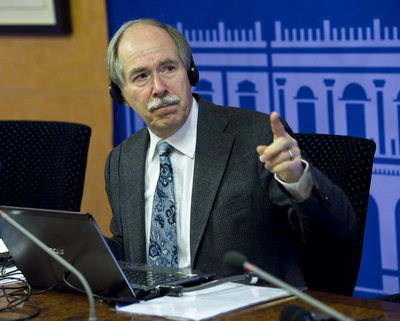

Gerad ´t Hooft

Hace algún tiempo, me desplace a Madrid invitado asistir a una Conferencia que sobre el LHC y el Bosón de Higgs impartía el físico y premio Nobel de Física Gerad ´t Hooft. La charla de ‘t Hooft se inscribía en el ciclo La ciencia y el cosmos, y, entre otras cosas nos decía a los presentes que, La física, en concreto la física de partículas, ha sido siempre su gran pasión. “cuando era joven, la física estaba cambiando el mundo radicalmente: la energía nuclear, la televisión, los ordenadores, las primeras misiones espaciales…. yo quería formar parte de todo eso”. Y las partículas elementales “eran el mayor misterio de todos”, añade. “En cierto modo aún lo son, aunque sabemos de ellas muchísimo más que entonces. Hoy los ordenadores siguen siendo emocionantes, la biología y el código del ADN, la astronomía y los vuelos espaciales… Sigue habiendo muchas cosas capaces de estimular la imaginación de jóvenes deseosos de aprender cosas nuevas impulsados por el deseo de estar ahí, en el momento en que se están haciendo los descubrimientos que cambian el mundo”.

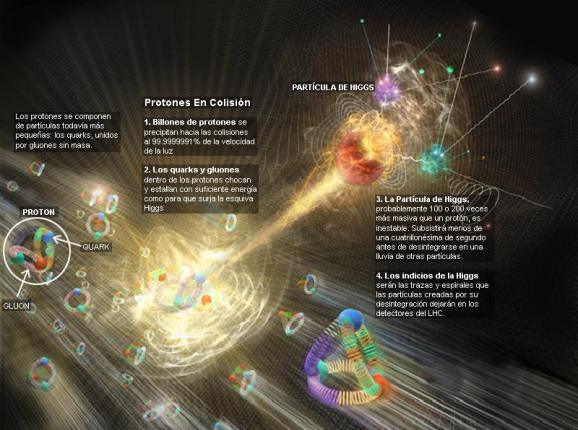

Gerard ‘t Hooft explicó lo que significa, en los modelos teóricos, el famoso bosón: “El campo de la partícula de Higgs actúa como una especie de árbitro; proyectado contra otras partículas, este campo determina su comportamiento, si tienen carga o masa y hasta qué punto se diferencian de otras partículas. Si no encontramos el Higgs, si realmente no está, necesitaremos algo más que haga ese papel de árbitro”. Eso significaría, continuaba el Nobel, que “nuestras teorías ya no funcionan, y han funcionado tan bien hasta que eso es difícil de imaginar”.

Claro que, después de aquello se encontró el Bosón de Higgs y todos contentos. Ahora se busca el Fotón oscuro en el LHC.

Sí, al LHC se le resiste el Gravitón, bueno, si es que anda por ahí

Fue en 199 cuando ‘t Hooft recibió el premio Nobel de Física 1999 (junto con su colega y director de tesis Martinus Veltman), por “dilucidar la estructura cuántica de las interacciones electrodébiles” -según palabras de la Academia sueca- de la física de las partículas elementales.

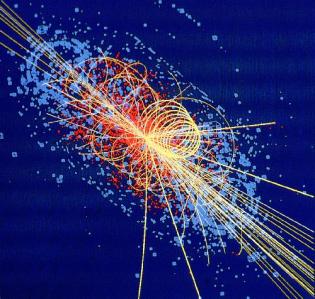

Acera del Gran Colisionador de Hadrones (el acelerador LHC situado en el Laboratorio Europeo de Física de partículas, CERN, junto a Ginebra), el científico holandés explica que se trata “de una máquina única en el mundo” y continúa: “Esperamos descubrir nuevas cosas con él y poner a prueba teorías que, hasta donde hemos podido comprobar, funcionan muy bien, pero necesitamos ir más allá”.

El descubrimiento de la partícula de Higgs, o bosón de Higgs, era el objetivo número uno del LHC, y tras un largo período de funcionamiento del acelerador, los miles de físicos que trabajan en los detectores, lograron acotar el terreno de búsqueda, aunque, hasta que la insistencia dio el resultado esperado. lo que supuso una revolución en la física de partículas, confirmando un parámetro aleatorio del llamado Modelo Estándar, que describe todas las partículas elementales y sus interacciones, y que hasta ahora funciona con altisima precisión aunque, dicen los expertos, está incompleto.

Al fin, tras largo búsqueda y trabajo, nos hicieron partícipe del esperado descubrimiento que viene a refrendar el Modelo Estándar que, incompleto aún, con el dichoso Bosón queda mejor conformado al desaparecer uno de los casi veinte parámetros aleatorios que en él estaban presentes. Ya sólo quedan diecinueve.

Gerard ‘t Hooft, uno de los grandes físicos teóricos de partículas elementales, considera que será muy difícil desarrollar una teoría del todo, un cuerpo teórico capaz de explicar todas las fuerzas que actúan en la naturaleza aunando la Relatividad General de Einstein y la Mecánica Cuántica, tan eficaces por separado en la descripción del macrocosmos y el microcosmos, respectivamente. “Mi impresión es que esta teoría unificadora, una teoría del todo, aún requerirá el trabajo de muchas nuevas generaciones de investigadores jóvenes y listos”, afirma. “No llegaremos a ella de un momento a otro por la simple razón de que el universo es demasiado complejo para que una única teoría lo abarque todo. Vale, no digo que sea imposible, pero me parece muy improbable. Y mientras llega, queda mucho por , incluso hallazgos espectaculares”.

El CERN, a la caza del misterioso Fotón oscuro

Por otra parte, el científico holandés ha señalado que el LHC realiza más actividades que intentar encontrar el bosón de Higgs. En este sentido, ha destacado que se buscan también partículas que podrían construir la materia oscura, un de materia de la que los físicos tienen la certeza de que es cinco veces más abundante que el universo que la materia ‘normal’, pero que no absorbe, refleja ni emite luz, lo que hace muy difícil su detección y, por tanto, estudiar su naturaleza. Del mismo modo, también se está desarrollando una teoría capaz de unificar la teoría de la relatividad general de Einstein y la mecánica cuántica que, según ha explicado Hooft, “permitiría lo que ocurre dentro de los átomos”.

Recuerdo un pasaje escrito por él al principio de su interesante e instructivo libro “Partículas Elemetales”, que decía:

“Mi intención es narrar los últimos 25 años de investigación sobre las partículas más pequeñas que constituyen la materia. Durante esos 25 años, yo empecé a ver la Naturaleza como un test de inteligencia para toda la humanidad en su conjunto, como un gigantesco puzle con el que podemos jugar. Una y otra vez, nos tropezamos con nuevas piezas, grandes y pequeñas, que encajan maravillosamente con las que ya tenemos. Yo quiero compartir con ustedes la sensación de triunfo que sentimos en esos momentos.”

Tenía la intención (si se presentaba la oportunidad), de preguntarle sobre “su Principio Holográfico” pero, no pudo ser. Sólo pude saludarlo e intercambiar unas breves palabras junto con Ignacio Cirac presente en el evento.

Publicó el principio holográfico, el cual explica que la información de una dimensión extra es visible una curvatura del espacio tiempo con una menos dimensiones. Por ejemplo, los hologramas son imágenes de 3 dimensiones colocadas en una superficie de 2 dimensiones, el cual da a la imagen una curvatura cuando el observador se mueve. Similarmente, en relatividad general, la cuarta dimensión manifestada en 3 dimensiones observables como la curvatura de un sendero de un movimiento de partícula (criterio) infinitesimal. Hooft ha especulado que la quinta dimensión es realmente la fábrica del espacio-tiempo.

Acordaos de que, a mediados del año 2,003 apareció la noticia de que la “información sería el componente fundamental de la naturaleza” postulada por un grupo de físicos entre los que se incluyen el Premio Nóbel danés Gerard t´Hooft y el físico de la Universidad de California Raphael Bousso, basadas en el “Principio Holográfico”. teoría, por singular y chocante que pareciese en su momento ha tenido a lo largo de estos siete años una influencia notable tanto en la sociedad científica como en los círculos alternativos.

Personajes tan influyentes Deepak Chopra sin ir más lejos habla del ámbito cuántico como el campo de información de donde todo lo conocido, materia, emociones, pensamientos. El controvertido joven físico Nassam Haramein defiende un universo basado en el holograma. Científicos japoneses -al igual que del resto del mundo- investigan con hologramas creando imágenes 3D o explican el funcionamiento del mundo físico basado en los campos de energía e información. Hay hasta “farmacología holográfica” a cargo de empresas farmaceúticas. El año pasado el físico Craig Hogan tras la detección de un extraño ruido en el detector de ondas gravitacionalesel GEO 600, afirma que podría probar que, efectivamente, vivimos en un holograma.

La información sería el componente fundamental de la naturaleza. Es la que especifica el cuándo, dónde, cómo y cuánto del espacio, del tiempo y de la materia. El Big Bang que dio lugar al nacimiento del Universo tendría más que ver con una gigantesca “bajada” de bytes de información por parte de un superordenador, que con una explosión masiva de materia, según una nueva teoría que establece que en su origen la naturaleza está formada únicamente por pequeños paquetes de información pura que son los que especifican el cuándo, dónde, cómo y cuánto del espacio, del tiempo y de la materia.

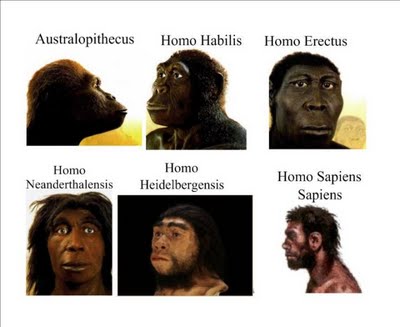

Mucho antes de que todos estos seres existieran ocurrieron muchas cosas que no sabemos. Nuestro origen no está en ninguno de ellos, sino que, partiendo de células replicantes que evolucionaron durante algunos millones de años, pudimos llegar a “SER”.

El Ser humano continúa con su carrera particular para lo que siempre ha querido saber: quiénes somos y de dónde venimos. Esas dos preguntas esenciales son, en realidad, el motor gracias al cual se mueve gran parte de la investigación científica de todos los tiempos.

En carrera por buscar certezas, cosas tan inquebrantables para explicar el origen del mundo como son los átomos o los quarks están quedando relegados a segundo término para dar paso a nuevas teorías.

Una de las más interesantes, postulada por un grupo de físicos entre los que se incluyen el Premio Nóbel danés Gerard t´Hooft y el físico de la Universidad de California Raphael Bousso, afirma que en el origen de la naturaleza podría haber únicamente ultrapequeños paquetes de información pura.

Aunque parezca raro la información no viaja en un bloque como lo haría una carta, sino que se divide en pequeños paquetes de información, viajando a través de los diferentes canales de la red y llegando todos al mismo punto. Para esto es preciso que todos los ordenadores hablen el mismo idioma, o lo que es decir el Protocolo TCP/IP, (que es el idioma) que en un principio empezó a usarse en 1983 para dirigir el tráfico de los paquetes de información por Arpanet, garantizando así que todos lleguen a su destino.

La @ que parece que nació a partir de internet se utilizaba en la antigüedad, como unidad de peso o incluso para decir a cuanto costaba algo en libros de contabilidad. Sin embargo se puso de moda gracias al ingeniero estadounidense Ray Tomilson, que diseñaba un sistema de correo electrónico para Arpanet, simplemente bajo los ojos al teclado y eligió un signo que no se utilizara en los nombres de usuario.

Según explica al respecto Newsfactor, teoría, basada en el “Principio holográfico”, establece que la información (“información” en este caso significa bits fundamentales de materia y las leyes físicas que los gobiernan) especifica el cuándo, dónde, cómo y cuánto del espacio, del tiempo y de la materia. La información sería pues, una variable para llegar a una “teoría del todo”.

Y, más allá de las cuerdas…

Según la teoría cuerdas, el espacio está descrito por la vibración, en miles de maneras, de diminutas cuerdas de una dimensión. Una cuerda vibrando arriba y abajo a cierta frecuencia podría crear un átomo de helio o una ola gravitacional, tal y las cuerdas de una guitarra crean diferentes sonidos a diferentes frecuencias.

Los teóricos de teoría han mantenido hace mucho tiempo que estas cuerdas son el componente fundamental de la naturaleza. El “Principio Holográfico”, sin embargo, cambia esta noción y mantiene que, mirando más de cerca una cuerda, se ven bits cuánticos, llamados “baldosas de Planck”, que, engarzados, dicen a las cuerdas como tienen que vibrar.

Una de las más interesentes, postulada por un grupo de físicos entre los que se incluyen el Premio Nóbel danés Gerard t´Hooft y el físico de la Universidad de California Raphael Bousso, afirma que en el origen de la naturaleza podría haber únicamente ultrapequeños paquetes de información pura.

Estas “baldosas de Planck” son bits cuadrados que delimitan un “área de Planck”, o lo que es lo mismo, un trillón de un trillón, de un trillón de un trillón de un trillón de un trillón de un centímetro cuadrado. Una cuerda de baldosas de Plank sería la versión natural de un byte.

El “Principio Holográfico”, descrito por Gerard t´Hooft y Leonard Susskind y refinado por Bousso, nos permite saber cuántos (bits y bytes) son necesarios para decirnos en detalle cada cosa que ocurre en cualquier región del espacio.

¡Por imaginación que no quede!

emilio silvera

Ago

13

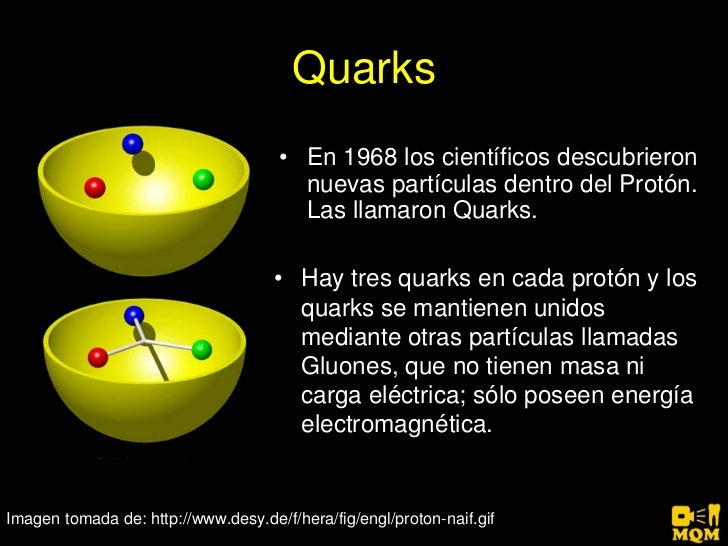

Los Quarks invisibles

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

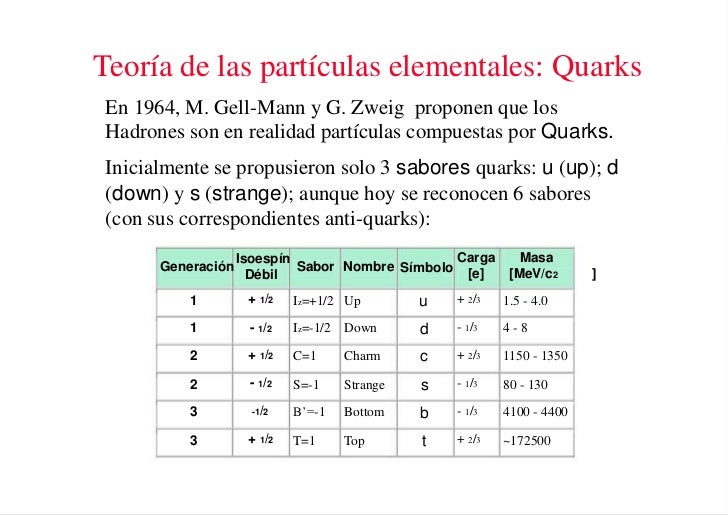

Una vez que se ha puesto orden entre las numerosas especies de partículas, se puede reconocer una pauta. Igual que Dimitri Ivanovich Mendeleev descubrió el sistema periódico de los elementos químicos en 1869, así también se hizo visible un sistema similar para las partículas. Esta pauta la encontraron independientemente el americano Murray Gell-Mann y el israelí Yuval Ne’eman. Ocho especies de mesones, todos con el mismo espín, u ocho especies de bariones, con el mismo espín, se podían reagrupar perfectamente en grupos que llamaremos multipletes. El esquema matemático correspondiente se llama SU(3). Grupletes de ocho elementos forman un octete “fundamental”. Por esta razón Gell-Mann llamó a esta teoría el “óctuplo camino”. Lo tomó prestado del budismo de acuerdo con el cual el camino hacia el nirvana es el camino óctuplo.

Pero las matemáticas SU(3) también admiten multipletes de diez miembros. Cuando se propuso este esquema se conocían nueve bariones con espín 3/2. Los esquemas SU(3) se obtienen al representar dos propiedades fundamentales de las partículas, la extrañeza S frente al isoespín I₃ , en una gráfica.

Imagen de trazas en la cámara de burbujas del primer evento observado incluyendo bariones Ω, en el Laboratorio Nacional Brookhaven.

De esta manera, Gell-Mann predijo un décimo barión, el omega-menos (Ω¯), y pudo estimar con bastante precisión su masa porque las masas de los otros nueve bariones variaban de una forma sistemática en el gráfico (también consiguió entender que las variaciones de la masa eran una consecuencia de una interacción simple). Sin embargo, estaba claro que la Ω¯, con una extrañeza S = -3, no tenía ninguna partícula en la que desintegrarse que no estuviera prohibida por las leyes de conservación de la interacción fuerte. De modo que, la Ω¯ sólo podía ser de tan sólo 10¯²³ segundos como los demás miembros del multiplete, sino que tenía que ser del orden de 10¯¹⁰ segundos. Consecuentemente, esta partícula debería viajar varios centímetros antes de desintegrarse y esto la haría fácilmente detectable. La Ω¯ fue encontrada en 1964 con exactamente las mismas propiedades que había predicho Gell-Mann.

Se identificaron estructuras multipletes para la mayoría de los demás bariones y mesones y Gell-Mann también consiguió explicarlas. Sugirió que los mesones, igual que los bariones, debían estar formados por elementos constitutivos “más fundamentales aún”. Gell-Mann trabajaba en el Instituto de Tecnología de California en Pasadena (CalTech), donde conversaba a menudo con Richard Feynman. Eran ambos físicos famosos pero con personalidades muy diferentes. Gell-Mann, por ejemplo, es conocido como un entusiasta observador de Pájaros, familiarizado con las artes y la literatura y orgulloso de su conocimiento de lenguas extranjeras. Feynman fue un hombre hecho a sí mismo, un analista riguroso que se reía de cualquier cosa que le recordara la autoridad establecida.

Hay una anécdota que parece no ser cierta de hecho, pero que me parece tan buena que no puedo evitar el contarla; podía haber sucedido de esta forma. Gell-Mann le dijo a Feynman que tenía un problema, que estaba sugiriendo un nuevo tipo de ladrillos constitutivos de la materia y que no sabía qué nombre darles. Indudablemente debía haber de haber pensado en utilizar terminología latina o griega, como ha sido costumbre siempre en la nomenclatura científica. “Absurdo”, le dijo Feynman; “tú estás hablando de cosas en las que nunc ase había pensado antes. Todas esas preciosas pero anticuadas palabras están fuera de lugar. ¿Por qué no los llamas simplemente “shrumpfs”, “quacks” o algo así?”.

Cuando algún tiempo después le pregunté a Gell-Mann, éste negó que tal conversación hubiera tenido lugar. Pero la palabra elegida fue quark, y la explicación de Gell-Mann fue que la palabra venía de una frase de Fynnegan’s Wake de James Joyce; “¡Tres quarks para Muster Mark!”. Y, efectivamente así es. A esas partículas les gusta estar las tres juntas. Todos los bariones están formados por tres quarks, mientras que los mesones están formados por un quark y un antiquark.

Los propios quarks forman un grupo SU(3) aún más sencillo. Los llamaremos “arriba (u)”, “abajo” (d), y “extraño” (s). Las partículas “ordinarias” contienen solamente quarks u y d. Los hadrones “extraños” contienen uno o más quarks s (o antiquarks ŝ).

La composición de quarks de espín 3/2 se puede ver en la tabla 5. La razón por la que los bariones de espín ½ sólo forman un octete es más difícil de explicar. Está relacionada con el hecho de que en estos estados, al menos dos de los quarks tienen que ser diferentes unos de otros.

Realmente, la idea de que los hadrones estuvieran formados por ladrillos fundamentales sencillos había sido también sugerida por otros. George Zweig, también en el CalTech, en Pasadena, había tenido la misma idea. Él había llamado a los bloques constitutivos “ases!, pero es la palabra “quark” la que ha prevalecido. La razón por la que algunos nombres científicos tienen más éxito que otros es a veces difícil de comprender.

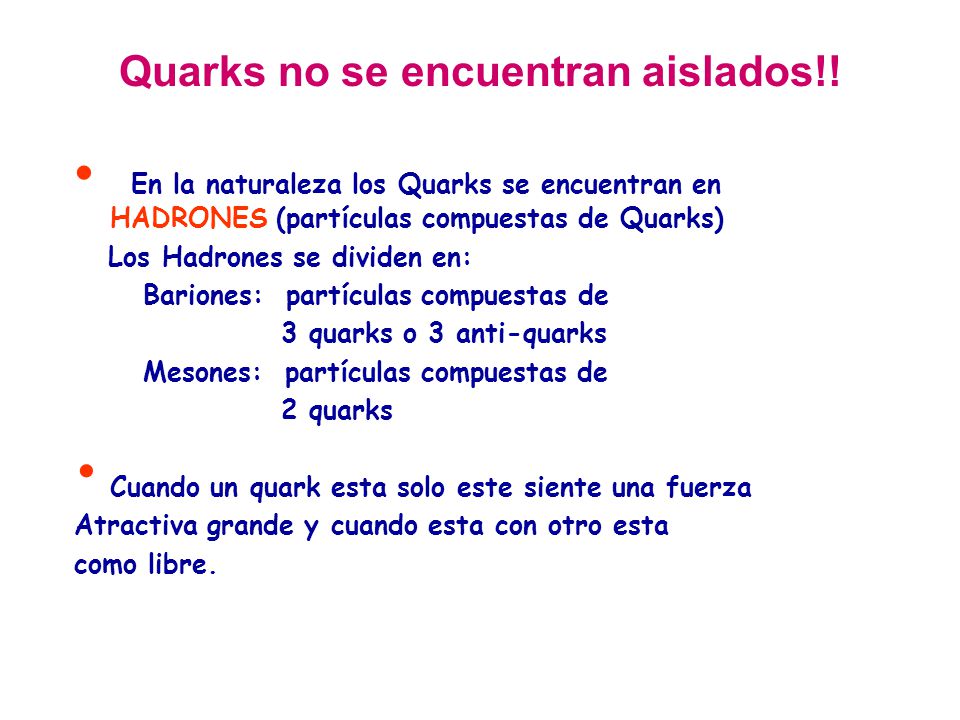

Pero en esta teoría había algunos aspectos raros. Aparentemente, los quarks (o ases) siempre existen en parejas o tríos y nunca se han visto solos. Los experimentadores habían intentado numerosas veces detectar un quark aislado en aparatos especialmente diseñados para ello, pero ninguno había tenido éxito.

Loa quarks –si se pudieran aislar- tendrían propiedades incluso más extrañas. Por ejemplo, ¿cuáles serían sus cargas eléctricas? Es razonable suponer que tanto los quarks u como los quarks s y d deban tener siempre la misma carga. La comparación de la tabla 5 con la tabla 2 sugiere claramente que los quarks d y s tienen carga eléctrica -1/3 y el quark u tiene carga +2/3. Pero nunca se han observado partículas que no tengan carga múltiplo de la del electrón o de la del protón. Si tales partículas existieran, sería posible detectarlas experimentalmente. Que esto haya sido imposible debe significar que las fuerzas que las mantienen unidas dentro del hadrón son necesariamente increíblemente eficientes.

Aunque con la llegada de los quarks se ha clarificado algo más la flora y la fauna de las partículas subatómicas, todavía forman un conjunto muy raro, aún cuando solamente unas pocas aparezcan en grandes cantidades en el universo (protones, neutrones, electrones y fotones). Como dijo una vez Sybren S. de Groot cuando estudiaba neutrinos, uno realmente se enamora de ellos. Mis estudiantes y yo amábamos esas partículas cuyo comportamiento era un gran misterio. Los leptones, por ser casi puntuales, son los más sencillos, y por tener espín se ven afectados por la interacción que actúa sobre ellos de forma muy complicada, pero la interacción débil estaba bastante bien documentada por entonces.

Los hadrones son mucho más misteriosos. Los procesos de choque entre ellos eran demasiado complicados para una teoría respetable. Si uno se los imagina como pequeñas esferas hachas de alguna clase de material, aún quedaba el problema de entender los quarks y encontrar la razón por la que se siguen resistiendo a los intentos de los experimentadores para aislarlos.

emilio silvera

Si queréis saber más sobre el tema, os recomiendo leer el libro Partículas de Gerard ´t Hooft

Ago

9

El “universo” de las partículas I

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

¿Qué no será capaz de inventar el hombre para descubrir los misterios de la naturaleza?

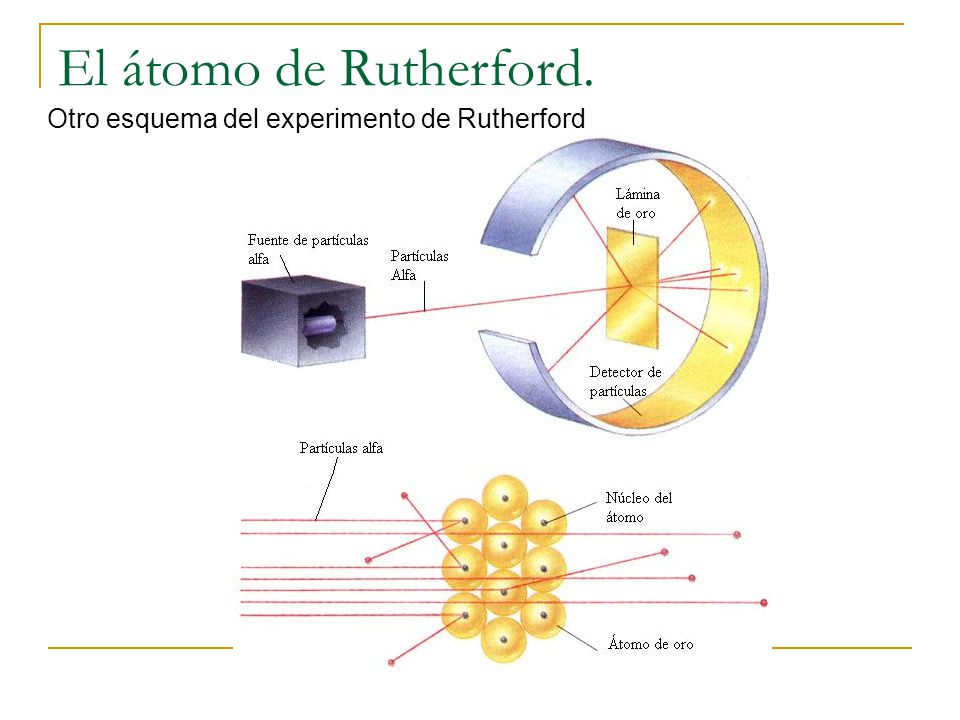

Ha pasado mucho tiempo desde que Rutherford identificara la primera partícula nuclear (la partícula alfa). El camino ha sido largo y muy duro, con muchos intentos fallidos antes de ir consiguiendo los triunfos (los únicos que suenan), y muchos han sido los nombres que contribuyen para conseguir llegar al conocimiento que actualmente tenemos del átomo y del núcleo; los electrones circulando alrededor del núcleo, en sus diferentes niveles, con un núcleo compuesto de protones y neutrones que, a su vez, son constituidos por los quarks allí confinados por los gluones, las partículas mediadoras de la fuerza nuclear fuerte. Pero, ¿qué habrá más allá de los quarks?, ¿las supercuerdas vibrantes? Algún día se sabrá.

Partículas

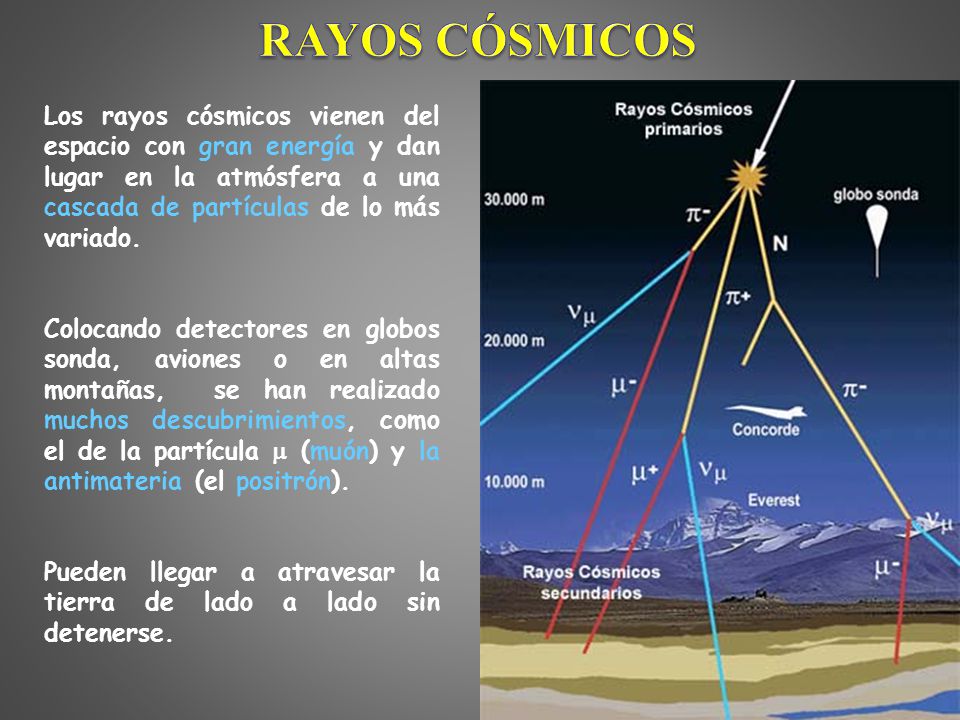

El universo de las partículas es fascinante. Cuando las partículas primarias chocan con átomos y moléculas en el aire, aplastan sus núcleos y producen toda clase de partículas secundarias. En esta radiación secundaria (aún muy energética) la que detectamos cerca de la Tierra, por los globos enviados a la atmósfera superior, han registrado la radiación primaria.

El físico estadounidense Robert Andrews Millikan, que recogió una gran cantidad de información acerca de esta radiación (y que le dio el nombre de rayos cósmicos), decidió que debería haber una clase de radiación electromagnética. Su poder de penetración era tal que, parte del mismo, atravesaba muchos centímetros de plomo. Para Millikan, esto sugería que la radiación se parecía a la de los penetrantes rayos gamma, pero con una longitud de onda más corta.

Otros, sobre todo el físico norteamericano Holly Compton, no estaban de acuerdo en que los rayos cósmicos fuesen partículas. Había un medio para investigar este asunto; si se trataba de partículas cargadas, deberían ser rechazadas por el campo magnético de la Tierra al aproximarse a nuestro planeta desde el espacio exterior. Compton estudió las mediciones de la radiación cósmica en varias latitudes y descubrió que en realidad se curvaban con el campo magnético: era más débil cera del ecuador magnético y más fuerte cerca de los polos, donde las líneas de fuerza magnética se hundían más en la Tierra.

Las partículas cósmicas primarias, cuando entran en nuestra atmósfera, llevan consigo unas energías fantásticas, muy elevadas. En general, cuanto más pesado es el núcleo, más raro resulta entre las partículas cósmicas. Núcleos tan complejos como los que forman los átomos de hierro se detectaron con rapidez; en 1.968, otros núcleos como el del uranio. Los núcleos de uranio constituyen sólo una partícula entre 10 millones. También se incluirán aquí electrones de muy elevada energía.

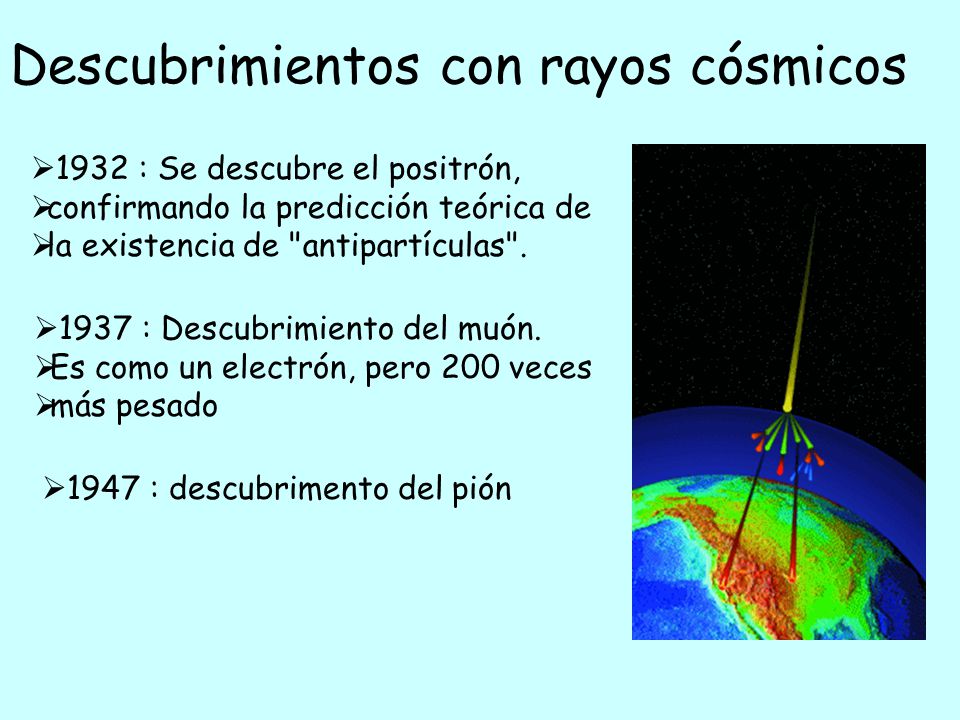

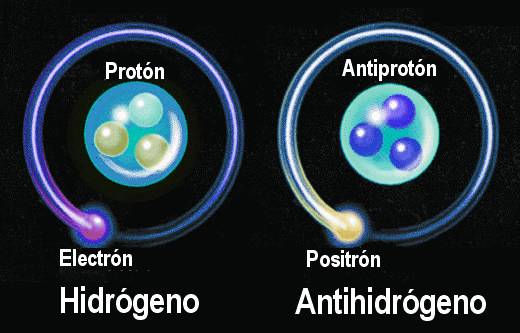

Ahora bien, la siguiente partícula inedita (después del neutrón) se descubrió en los rayos cósmicos. A decir verdad, cierto físico teórico había predicho ya este descubrimiento. Paul Adrien Dirac había aducido, fundándose en un análisis matemático de las propiedades inherentes a las partículas subatómicas, que cada partícula debería tener su antipartícula (los científicos desean no sólo que la naturaleza sea simple, sino también simétrica). Así pues, debería haber un antielectrón, salvo por su carga que sería positiva y no negativa, idéntico al electrón; y un antiprotón, con carga negativa en vez de positiva.

En 1.930, cuando Dirac expuso su teoría, no llamó demasiado la atención en el mundo de la ciencia. Pero, fiel a la cita, dos años después apareció el antielectrón. Por entonces, el físico americano Carl David Anderson trabajaba con Millikan en un intento por averiguar si los rayos cósmicos eran radiación electromagnética o partículas. Por aquellas fechas, casi todo el mundo estaba dispuesto a aceptar las pruebas presentadas por Compton, según las cuales, se trataría de partículas cargadas; pero Millikan no acababa de darse por satisfecho con tal solución.

Anderson se propuso averiguar si los rayos cósmicos que penetraban en una cámara de ionización se curvaban bajo la acción de un potente campo magnético. Al objeto de frenar dichos rayos lo suficiente como para detectar la curvatura, si la había, puso en la cámara una barrera de plomo de 6’35 mm de espesor. Descubrió que, cuando cruzaba el plomo, la radiación cósmica trazaba una estela curva a través de la cámara; y descubrió algo más. A su paso por el plomo, los rayos cósmicos energéticos arrancaban partículas de los átomos de plomo. Una de esas partículas dejó una estela similar a la del electrón. ¡Allí estaba, pues, el antielectrón de Dirac! Anderson le dio el nombre de positrón. Tenemos aquí un ejemplo de radiación secundaria producida por rayos cósmicos. Pero aún había más, pues en 1.963 se descubrió que los positrones figuraban también entre las radiaciones primarias.

Abandonado a sus propios medios, el positrón es tan estable como el electrón (¿y por qué no habría de serlo si el idéntico al electrón, excepto en su carga eléctrica?). Además, su existencia puede ser indefinida. Ahora bien, en realidad no queda abandonado nunca a sus propios medios, ya que se mueve en un universo repleto de electrones. Apenas inicia su veloz carrera (cuya duración ronda la millonésima de segundo), se encuentra ya con uno.

Así, durante un momento relampagueante quedaron asociados el electrón y el positrón; ambas partículas girarán en torno a un centro de fuerza común. En 1.945, el físico americano Arthur Edwed Ruark sugirió que se diera el nombre de positronio a este sistema de dos partículas, y en 1.951, el físico americano de origen austriaco Martin Deutsch consiguió detectarlo guiándose por los rayos gamma característicos del conjunto.

Pero no nos confundamos, aunque se forme un sistema positronio, su existencia durará, como máximo, una diezmillonésima de segundo. El encuentro del electrón-positrón provoca un aniquilamiento mutuo; sólo queda energía en forma de radiación gamma. Ocurre pues, tal como había sugerido Einstein: la materia puede convertirse en energía y viceversa. Por cierto, que Anderson consiguió detectar muy pronto el fenómeno inverso: desaparición súbita de rayos gamma para dar origen a una pareja electrón-positrón. Este fenómeno se llama producción en pareja. Anderson compartió con Hess el premio Nobel de Física de 1.936.

Poco después, los Joliot-Curie detectaron el positrón por otros medios, y al hacerlo así realizaron, de paso, un importante descubrimiento. Al bombardear los átomos de aluminio con partículas alfa, descubrieron que con tal sistema no sólo se obtenían protones, sino también positrones. Cuando suspendieron el bombardeo, el aluminio siguió emitiendo positrones, emisión que sólo con el tiempo se debilitó. Aparentemente habían creado, sin proponérselo, una nueva sustancia radiactiva. He aquí la interpretación de lo ocurrido según los Joliot-Curie: cuando un núcleo de aluminio absorbe una partícula alfa, la adición de los dos protones transforma el aluminio (número atómico 13) en fósforo (número atómico 15). Puesto que las partículas alfa contienen cuatro nucleones en total, el número masivo se eleva 4 unidades, es decir, del aluminio 27 al fósforo 31. Ahora bien, si al reaccionar se expulsa un protón de ese núcleo, la reducción en una unidad de sus números atómicos y masivos hará surgir otro elemento, o sea, el silicio 30.

Puesto que la partícula alfa es el núcleo del helio, y un protón es el núcleo del hidrógeno, podemos escribir la siguiente ecuación de esta reacción nuclear:

aluminio 27 + helio 4 = silicio 30 + hidrógeno 1

Nótese que los números másicos se equilibran:

27 + 4 = 30 + 1

Adentrarse en el universo de las partículas que componen los elementos de la tabla periódica, y en definitiva, la materia conocida, es verdaderamente fantástico.

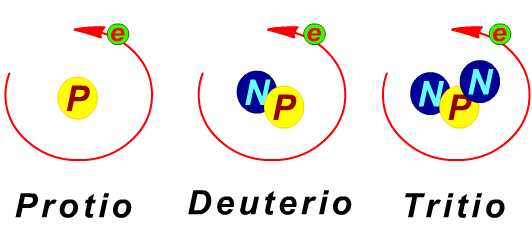

Tan pronto como los Joliot-Curie crearon el primer isótopo radiactivo artificial, los físicos se lanzaron en tropel a producir tribus enteras de ellas. En realidad, las variedades radiactivas de cada elemento en la tabla periódica son producto de laboratorio. En la moderna tabla periódica, cada elemento es una familia con miembros estables e inestables, algunos procedentes de la naturaleza, otros sólo del laboratorio. Por ejemplo, el hidrógeno presenta tres variedades: en primer lugar, el corriente, que tienen un solo protón. En 1.932, el químico Harold Urey logró aislar el segundo. Lo consiguió sometiendo a lenta evaporación una gran cantidad de agua, de acuerdo con la teoría de que los residuos representarían una concentración de la forma más pesada del hidrógeno que se conocía, y, en efecto, cuando se examinaron al espectroscopio las últimas gotas de agua no evaporadas, se descubrió en el espectro una leve línea cuya posición matemática revelaba la presencia de hidrógeno pesado.

El núcleo de hidrógeno pesado está constituido por un protón y un neutrón. Como tiene un número másico de 2, el isótopo es hidrógeno. Urey llamó a este átomo deuterio (de la voz griega deutoros, “segundo”), y el núcleo deuterón. Una molécula de agua que contenga deuterio se denomina agua pesada, que tiene puntos de ebullición y congelación superiores al agua ordinaria, ya que la masa del deuterio es dos veces mayor que la del hidrógeno corriente. Mientras que ésta hierve a 100º C y se congela a 0º C, el agua pesada hierve a 101’42º C y se congela a 3’79º C. El punto de ebullición del deuterio es de -23’7º K, frente a los 20’4º K del hidrógeno corriente. El deuterio se presenta en la naturaleza en la proporción de una parte por cada 6.000 partes de hidrógeno corriente. En 1.934 se otorgó a Urey el premio Nobel de Química por su descubrimiento del deuterio.

El deuterio resultó ser una partícula muy valiosa para bombardear los núcleos. En 1.934, el físico australiano Marcus Lawrence Edwin Oliphant y el austriaco P. Harteck atacaron el deuterio con deuterones y produjeron una tercera forma de hidrógeno, constituido por un protón y dos neutrones. La reacción se planteó así:

hidrógeno 2 + hidrógeno 2 = hidrógeno 3 + hidrógeno 1

Este nuevo hidrógeno superpesado se denominó tritio (del griego tritos, “tercero”); su ebullición a 25º K y su fusión a 20’5º K.

Como es mi costumbre, me desvío del tema y sin poderlo evitar, mis ideas (que parecen tener vida propia), cogen los caminos más diversos. Basta con que se cruce en el camino del trabajo que realizo un fugaz recuerdo; lo sigo y me lleva a destinos distintos de los que me propuse al comenzar. Así, en este caso, me pasé a la química, que también me gusta mucho y está directamente relacionada con la física; de hecho son hermanas: la madre, las matemáticas, la única que finalmente lo podrá explicar todo.

emilio silvera

Ago

9

El “universo” de las Partículas II

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (7)

Comments (7)

Estamos hablando de las partículas y no podemos dejar a un lado el tema del movimiento rotatorio de las mismas. Usualmente se ve cómo la partícula gira sobre su eje, a semejanza de un trompo, o como la Tierra o el Sol, o nuestra galaxia o, si se me permite decirlo, como el propio universo. En 1.925, los físicos holandeses George Eugene Uhlenbeck y Samuel Abraham Goudsmit aludieron por primera vez a esa rotación de las partículas. Éstas, al girar, generan un minúsculo campo electromagnético; tales campos han sido objeto de medidas y exploraciones, principalmente por parte del físico alemán Otto Stern y el físico norteamericano Isaac Rabi, quienes recibieron los premios Nobel de Física en 1.943 y 1.944 respectivamente, por sus trabajos sobre dicho fenómeno.

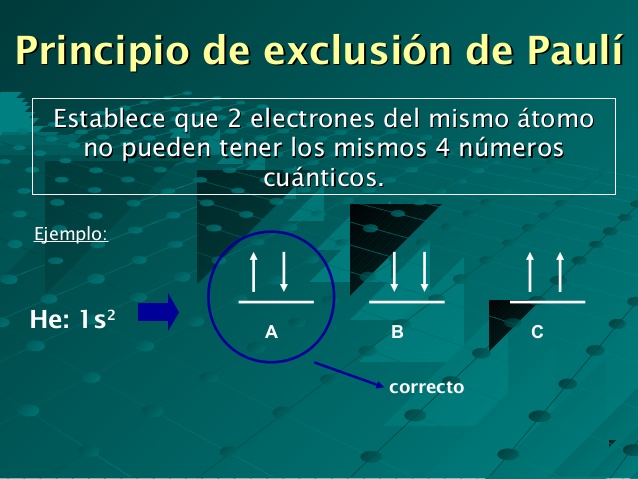

Esas partículas (al igual que el protón, el neutrón y el electrón), que poseen espines que pueden medirse en números mitad, se consideran según un sistema de reglas elaboradas independientemente, en 1.926, por Fermi y Dirac; por ello, se las llama y conoce como estadísticas Fermi-dirac. Las partículas que obedecen a las mismas se denominan fermiones, por lo cual el protón, el electrón y el neutrón son todos fermiones.

Hay también partículas cuya rotación, al duplicarse, resulta igual a un número par. Para manipular sus energías hay otra serie de reglas, ideadas por Einstein y el físico indio S. N. Bose. Las partículas que se adaptan a la estadística Bose-Einstein son bosones, como por ejemplo la partícula alfa.

Las reglas de la mecánica cuántica tienen que ser aplicadas si queremos describir estadísticamente un sistema de partículas que obedece a reglas de esta teoría en vez de los de la mecánica clásica. En estadística cuántica, los estados de energía se considera que están cuantizados. La estadística de Bose-Einstein se aplica si cualquier número de partículas puede ocupar un estado cuántico dad. Dichas partículas (como dije antes) son bosones, que tienden a juntarse.

Los bosones tienen un momento angular nh/2π, donde n es 0 o un entero, y h es la constante de Planck. Para bosones idénticos, la función de ondas es siempre simétrica. Si sólo una partícula puede ocupar un estado cuántico, tenemos que aplicar la estadística Fermi-Dirac y las partículas (como también antes dije) son los fermiones que tienen momento angular (n + ½)h / 2π y cualquier función de ondas de fermiones idénticos es siempre antisimétrica. La relación entre el espín y la estadística de las partículas está demostrada por el teorema espín-estadística.

En un espacio de dos dimensiones es posible que haya partículas (o cuasipartículas) con estadística intermedia entre bosones y fermiones. Estas partículas se conocen con el nombre de aniones; para aniones idénticos, la función de ondas no es simétrica (un cambio de fase de +1) o antisimétrica (un cambio de fase de -1), sino que interpola continuamente entre +1 y -1. Los aniones pueden ser importantes en el análisis del efecto Hall cuántico fraccional y han sido sugeridos como un mecanismo para la super-conductividad de alta temperatura.

Debido al principio de exclusión de Pauli, es imposible que dos fermiones ocupen el mismo estado cuántico (al contrario de lo que ocurre con los bosones). La condensación Bose-Einstein es de importancia fundamental para explicar el fenómeno de la superfluidez. A temperaturas muy bajas (del orden de 2×10-7K) se puede formar un condensado de Bose-Einstein, en el que varios miles de átomos dorman una única entidad (un superátomo). Este efecto ha sido observado con átomos de rubidio y litio. Como ha habréis podido suponer, la condensación Bose-Einstein es llamada así en honor al físico Satyendra Nath Bose (1.894 – 1.974) y a Albert Einstein. Así que, el principio de exclusión de Pauli tiene aplicación no sólo a los electrones, sino también a los fermiones; pero no a los bosones.

Si nos fijamos en todo lo que estamos hablando aquí, es fácil comprender cómo forma un campo magnético la partícula cargada que gira, pero ya no resulta tan fácil saber por qué ha de hacer lo mismo un neutrón descargado. Lo cierto es que cuando un rayo de neutrones incide sobre un hierro magnetizado, no se comporta de la misma forma que lo haría si el hierro no estuviese magnetizado. El magnetismo del neutrón sigue siendo un misterio; los físicos sospechan que contiene cargas positivas y negativas equivalente a cero, aunque por alguna razón desconocida, logran crear un campo magnético cuando gira la partícula.

Particularmente creo que, si el neutrón tiene masa, si la masa es energía (E = mc2), y si la energía es electricidad y magnetismo (según Maxwell), el magnetismo del neutrón no es tan extraño, sino que es un aspecto de lo que en realidad es materia. La materia es la luz, la energía, el magnetismo, en definitiva, la fuerza que reina en el universo y que está presente de una u otra forma en todas partes (aunque no podamos verla).

Sea como fuere, la rotación del neutrón nos da la respuesta a esas preguntas:

¿Qué es el antineutrón? Pues, simplemente, un neutrón cuyo movimiento rotatorio se ha invertido; su polo sur magnético, por decirlo así, está arriba y no abajo. En realidad, el protón y el antiprotón, el electrón y el positrón, muestran exactamente el mismo fenómeno de los polos invertidos.

Es indudable que las anti-partículas pueden combinarse para formar la anti-materia, de la misma forma que las partículas corrientes forman la materia ordinaria.

La primera demostración efectiva de antimateria se tuvo en Brookhaven en 1.965, donde fue bombardeado un blanco de berilio con 7 protones BeV y se produjeron combinaciones de anti-protones y anti-neutrones, o sea, un anti-deuterón. Desde entonces se ha producido el anti-helio 3, y no cabe duda de que se podría crear otros anti-núcleos más complicados aún si se abordara el problema con más interés.

Pero, ¿existe en realidad la anti-materia? ¿Hay masas de anti-materia en el universo? Si las hubiera, no revelarían su presencia a cierta distancia. Sus efectos gravitatorios y la luz que produjeran serían idénticos a los de la materia corriente. Sin embargo, cuando se encontrasen las masas de las distintas materias, deberían ser claramente perceptibles las reacciones masivas del aniquilamiento mutuo resultante del encuentro. Así pues, los astrónomos observan especulativamente las galaxias, para tratar de encontrar alguna actividad inusual que delate interacciones materia-anti-materia.

No parece que dichas observaciones fuesen un éxito. ¿Es posible que el universo esté formado casi enteramente por materia, con muy poca o ninguna anti-materia? Y si es así, ¿por qué? Dado que la materia y la anti-materia son equivalente en todos los aspectos, excepto en su oposición electromagnética, cualquier fuerza que crease una originaría la otra, y el universo debería estar compuesto de iguales cantidades de la una y de la otra.

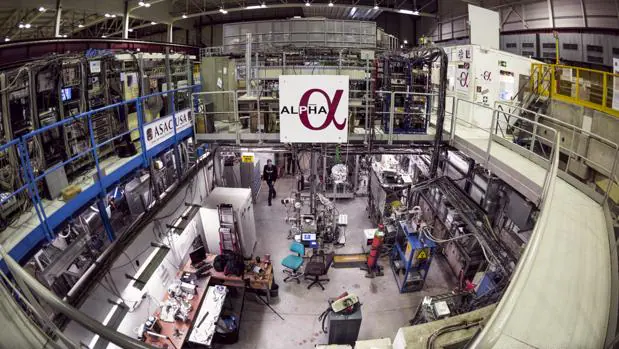

Aquí detectaron lograron encontrar la anti-materia por primera vez

Este es el dilema. La teoría nos dice que debería haber allí anti-materia, pero las observaciones lo niegan, no lo respaldan. ¿Es la observación la que falla? ¿Y qué ocurre con los núcleos de las galaxias activas, e incluso más aún, con los quásares? ¿Deberían ser estos fenómenos energéticos el resultado de una aniquilación materia-anti-materia? ¡No creo! Ni siquiera ese aniquilamiento parece ser suficiente, y los astrónomos prefieren aceptar la noción de colapso gravitatorio y fenómenos de agujeros negros, como el único mecanismo conocido para producir la energía requerida.

Con esto de la anti-materia me ocurre igual que con el hecho, algunas veces planteado, de la composición de la materia en lugares lejanos del universo. “Ha caído una nave extraterrestre y nuestros científicos han comprobado que está hecha de un material desconocido, casi indestructible”. Este comentario se ha podido oír en alguna película de ciencia ficción. Podría ser verdad (un material desconocido), sin embargo, no porque la nave esté construida por una materia distinta, sino porque la aleación es distinta y más avanzada a partir de los materiales conocidos del universo. En cualquier parte del universo, por muy lejana que pueda estar, rigen los mismos principios y las mismas fuerzas: la materia y la energía son las mismas en cualquier parte. Lo único que puede diferir es la forma en que se utilice, el tratamiento que se le pueda dar, y sobre todo, el poseer el conocimiento y la tecnología necesarios para poder obtener el máximo resultado de las propiedades que dicha materia encierra, porque, en última instancia, ¿es en verdad inerte la materia?

El experimento Alpha para el estudio de la anti-materia.

Todo lo que podemos ver en el Universo, sin excepción, está hecho de materia

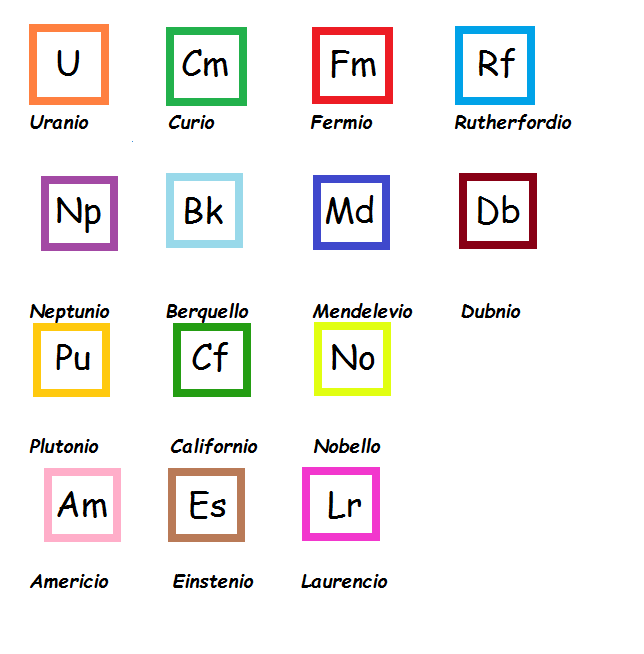

Tiene y encierra tantos misterios la materia que estamos aún a años luz de saber y conocer sobre su verdadera naturaleza. Nos podríamos preguntar miles de cosas que no sabríamos contestar. Nos maravillan y asombran fenómenos naturales que ocurren ante nuestros ojos, pero que tampoco sabemos, en realidad, a qué son debidas. Sí, sabemos ponerles etiquetas como la fuerza nuclear débil, la fisión espontánea que tiene lugar en algunos elementos como el protactinio o el torio, y con mayor frecuencia, en los elementos que conocemos como transuránidos.

A medida que los núcleos se hacen más grandes, la probabilidad de una fisión espontánea aumenta. En los elementos más pesados de todos (einstenio, fermio y mendelevio), esto se convierte en el método más importante de su ruptura, sobrepasando a la emisión de partículas alfa. ¡Parece que la materia está viva! Son muchas las cosas que desconocemos, y nuestra curiosidad nos empuja continuamente a buscar esas respuestas.

El electrón y el positrón son notables por sus pequeñas masas (sólo 1/1.836 de la del protón, el neutrón, el antiprotón o el antineutrón), y por lo tanto, han sido denominados leptones (de la voz griega leptos, que dignifica “delgado”).

Aunque el electrón fue descubierto en 1.897 por el físico británico Joseph John Thomson (1.856 – 1.940), el problema de su estructura, si la hay, aún no está resuelto. Conocemos su masa y su carga negativa que responden a 9’1093897 (54) × 10-31 Kg la primera, y 1’60217733 (49) × 10-19 culombios la segunda, y también su radio clásico r0 igual a e2/(mc2) = 2’82 × 10-13 cm. No se ha descubierto aún ninguna partícula que sea menos masiva que el electrón (o positrón) y que lleve una carga eléctrica, sea la que fuese (sabemos cómo actúa y cómo medir sus propiedades, pero aún no sabemos qué es), que tenga asociada un mínimo de masa.

Lo cierto es que el electrón es una maravilla en sí mismo. El universo no sería como lo conocemos si el electrón fuese distinto a como es; bastaría un cambio infinitesimal para que, por ejemplo, nosotros no pudiéramos estar aquí ahora.

Muchos granos de arena conforman la inmensa playa

¡No por pequeño se el insignificante!

Recordémoslo, todo lo grande está hecho de cosas pequeñas. En realidad, existen partículas que no tiene asociada ninguna masa en absoluto, es decir, ninguna masa en reposo. Por ejemplo, las ondas de luz y otras formas de radiación electromagnética se comportan como partículas (Einstein en su efecto fotoeléctrico y De Broglie en la difracción de electrones*). Esta manifestación en forma de partículas de lo que, de ordinario, concebimos como una onda, se denomina fotón, de la palabra griega que significa “luz”.

El fotón tiene una masa de 1, una carga eléctrica de 0, pero posee un espín de 1, por lo que es un bosón. ¿Cómo se puede definir lo que es el espín? Los fotones toman parte en las reacciones nucleares, pero el espín total de las partículas implicadas antes y después de la reacción deben permanecer inmutadas (conservación del espín). La única forma de que esto suceda en las reacciones nucleares que implican a los fotones radica en suponer que el fotón tiene un espín de 1. El fotón no se considera un leptón, puesto que este término se reserva para la familia formada por el electrón, el muón y la partícula tau, con sus correspondiente neutrinos: υe, υμ y υτ.

Existen razones teóricas para suponer que cuando las masas se aceleran (como cuando se mueven en órbitas elípticas en torno a otra masa o llevan a cabo un colapso gravitacional), emiten energía en forma de ondas gravitaciones. Esas ondas pueden, así mismo, poseer aspecto de partícula, por lo que toda partícula gravitacional recibe el nombre de gravitón.

La forma gravitatoria es mucho, mucho más débil que la fuerza electromagnética. Un protón y un electrón se atraen gravitacionalmente con sólo 1/1039 de la fuerza en que se atraen electromagnéticamente. El gravitón (aún sin descubrir) debe poseer, correspondientemente, menos energía que el fotón, y por tanto, ha de ser inimaginablemente difícil de detectar.

No será fácil detectar gravitones

De todos modos, el físico norteamericano Joseph Weber emprendió en 1.957 la formidable tarea de detectar el gravitón. Llegó a emplear un par de cilindros de aluminio de 153 cm de longitud y 66 de anchura, suspendidos de un cable en una cámara de vacío. Los gravitones (que serían detectados en forma de ondas) desplazarían levemente esos cilindros, y se empleó un sistema para detectar el desplazamiento que llegase a captar la cienbillonésima parte de un centímetro. Las débiles ondas de los gravitones, que proceden del espacio profundo, deberían chocar contra todo el planeta, y los cilindros separados por grandes distancias se verán afectados de forma simultánea. En 1.969, Weber anunció haber detectado los efectos de las ondas gravitacionales. Aquello produjo una enorme excitación, puesto que apoyaba una teoría particularmente importante (la teoría de Einstein de la relatividad general). Desgraciadamente, nunca se pudo comprobar mediante las pruebas realizadas por otros equipos de científicos que duplicaron el hallazgo de Weber.

En cualquier caso, no creo que a estas alturas alguien pueda dudar de la existencia de los gravitones, el bosón mediador de la fuerza gravitatoria. La masa del gravitón es 0, su carga es 0, y su espín es 2. Como el fotón, no tiene antipartícula; ellos mismos hacen las dos versiones.

emilio silvera

Ago

7

Creemos cosas que…, ¿serán ciertas?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (2)

Comments (2)

La verdadera Historia de la Teoría del Caos

Diagrama de la trayectoria del sistema de Lorenz para los valores r = 28, σ = 10, b = 8/3.

Teoría del caos es la denominación popular de la rama de las matemáticas, la física y otras disciplinas científicas que trata ciertos tipos de sistemas dinámicos muy sensibles a las variaciones en las condiciones iniciales. Pequeñas variaciones en dichas condiciones iniciales pueden implicar grandes diferencias en el comportamiento futuro, imposibilitando la predicción a largo plazo. Esto sucede aunque estos sistemas son en rigor determinísticos, es decir; su comportamiento puede ser completamente determinado conociendo sus condiciones iniciales.

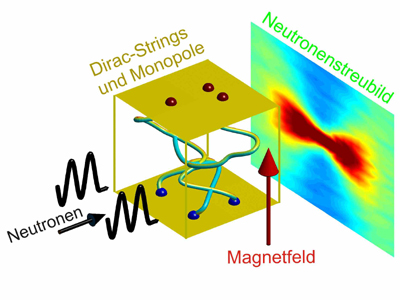

Montaje experimental. Foto: HZB, D.J.P. Morris y A. Tennant. Monopolos magneticos .

Hubo un tiempo, el el Universo muy temprano, en el que la temperatura estaba encima de algunos cientos de veces la masa del protón, cuando la simetría aún no se había roto, y la fuerza débil y electromagnética no sólo eran la misma matemáticamente, sino realmente la misma. Un físico que hibiera podido estar allí presente, en aquellos primeros momento, no habría podido observar ninguna diferencia real entre las fuerzas producidas por el intercambio de estas cuatro partículas: las W, la Z y el Fotón.

Muchas son las sorpresas que nos podríamos encontrar en el universo primitivo, hasta la presencia de agua ha sido detectada mediante la técnica de lentes gravitacionales en la galaxia denominada MG J0414+0534 que está situada en un tiempo en el que el Universo sólo tenía dos mil quinientos millones de años de edad. El equipo investigador pudo detectar el vapor de agua presente en los chorros de emisión de un agujero negro supermasivo. Este tipo de objeto es bastante raro en el universo actual. El agua fue observada en forma de mases, una emisión de radiación de microondas provocada por las moléculas (en este caso de agua) al ser amplificadas por una onda o un campo magnético.

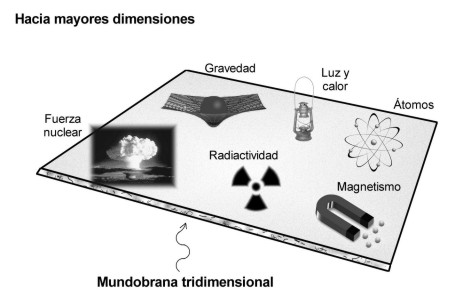

Siguiendo con el trabajo, dejemos la noticia de más arriba (sólo insertada por su curiosidad y rareza), y, sigamos con lo que hemos contado repetidas veces aquí de las fuerzas y la simetría antes de que, el universo se expandiera y enfriara para que, de una sóla, surgieran las cuatro fuerzas que ahora conocemos: Gravedad que campa sola y no quiere juntarse con las otras fuerzas del Modelo Estándar, el electromagnetismo y las nucleares débil y fuerte.

Las fuerzas de la naturaleza que gobiernan la electricidad, el magnetismo, la radiactividad y las reacciones nucleares están confinadas a un “mundobrana” tridimensional, mientras que la gravedad actúa en todas las dimensiones y es consecuentemente más débil. Seguramente ese será el motivo por el cual, encontrar al Bosón mediador de la fuerza, el Gravitón, resulta tan difícil.

De manera similar, aunque menos clara, las teorías de supersimetrías conjeturaban que las cuatro fuerzas tal vez estaban ligadas por una simitría que se manifestaba en los niveles de energía aún mayores que caracterizaban al universo ya antes del big bang. La intodución de un eje histórico en la cosmolo´gia y la física de particulas (como decía ayer en uno de los trabajos), beneficio a ambos campos. Los físicos proporcionaron a los cosmólogos una amplia gama de herramientas útiles para saber cómo se desarrolló el universo primitivo. Evidentemente, el Big Bang no fue una muralla de fuego de la que se burló Hoyle, sino un ámbito de suscesos de altas energías que muy posiblemente pueden ser comprensibles en términos de teoría de campo relativista y cuántica.

La cosmología, por su parte, dio un tinte de realidad histórica a las teorías unificadas. Aunque ningún acelerador concebible podrían alcanzar las titánicaqs energías supuestas por las grandes teorías unificadas y de la supersimetría, esas exóticas ideas aún pueden ser puestas a prueba, investigando su las partículas constituyentes del universo actual son compatibles con el tipo de historia primitiva que implican las teorías.

Gell-Mann, el premio Nobel de física, al respeto de todo esto decía: “Las partículas elementales aparentemente proporcionan las claves de algunos de los misterios fundamentales de la Cosmología temprana… y resulta que la Cosmología brinda una especia de terreno de prueba para alguna de las ideas de la física de partículas elementales.” Hemos podido llegar a descubrir grandes secretos de la naturaleza mediante los pensamientos que, surgidos de la mente desconocida y misteriosa de algunos seres humanos, han podido ser intuidos mediante ráfagas luminosas que nunca sabremos de dónde pudieron surgir )Lorentz, Planck, Einstein, Heisenmberg, Dirac, Eddigton, Feymann, Wheeler… Y, una larga lista de privilegiados que pudieron ver, lo que otros no podían.

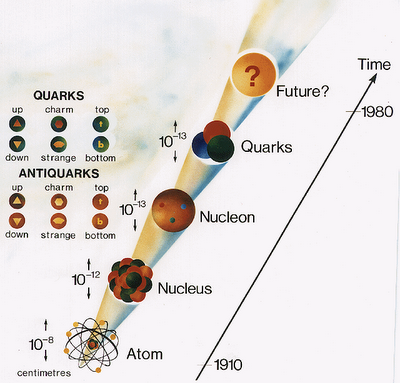

Moléculas, átomos y conexiones para formar pensamientos

Hemos llegado a poder discernir la relación directa que vincula el tamaño, la energía de unión y la edad de las estructuras fundamentales de la Naturaleza. Una molécula es mayor y más fácil de desmembrar que un átomo; lo mismo podemos decir de un átomo respecto al núcleo atómico, y de un núcleo con respecto a los quarks que contiene. La cosmología sugiere que esta relación resulta del curso de la historia cósmica, que los quarks se unieron primero en las energías extremadamente altas del big bang original y que a medida que el Universo se expandió, los protones y neutrones compuestos de quarks se unieron para formar núcleos de átomos, los cuales, cargados positivamente, atrajeron a los electrones cargados con electricidad negativa estableciéndose así como átomos completos, que al unirse formaron moléculas.

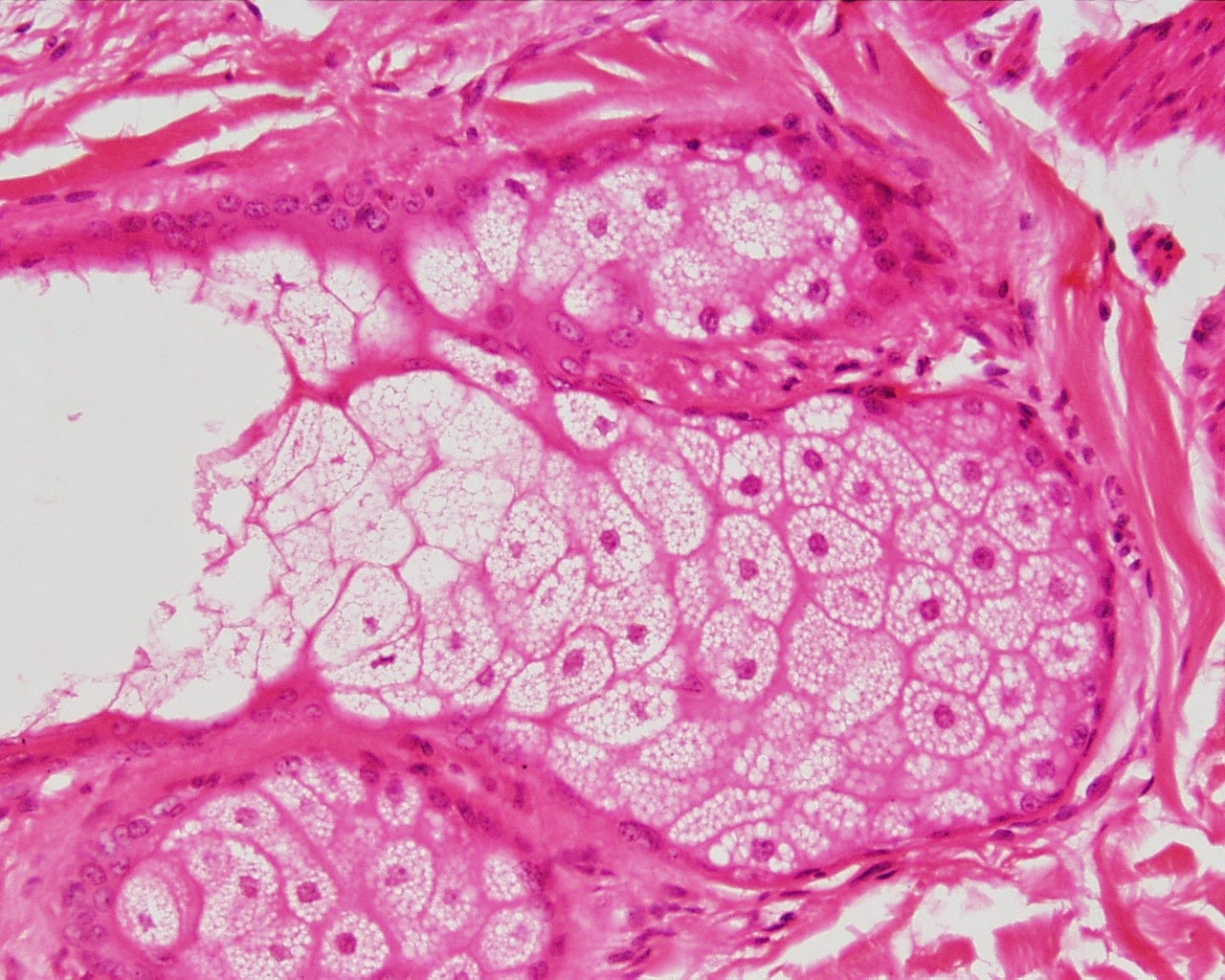

Si es así (que lo es), cuanto más íntimamente examinemos la Naturaleza, tanto más lejos hacia atrás vamos en el tiempo. Alguna vez he puesto el ejemplo de mirar algo que no es familiar, el dorso de la mano, por ejemplo, e imaginemos que podemos observarlo con cualquier aumento deseado.

Con un aumento relativamente pequeño, podemos ver las células de la piel, cada una con un aspecto tan grande y complejo como una ciudad, y con sus límites delineados por la pared celular. Si elevamos el aumento, veremos dentro de la célula una maraña de ribosomas serpenteando y mitocondrias ondulantes, lisosomas esféricos y centríolos, cuyos alrededores están llenos de complejos órganos dedicados a las funciones respiratorias, sanitarias y de producción de energía que mantienen a la célula.

Ya ahí tenemos pruebas de historia. Aunque esta célula particular solo tiene unos pocos años de antigüedad, su arquitectura se remonta a más de mil millones de años, a la época en que aparecieron en la Tierra las células eucariota o eucarióticas como la que hemos examinado.

Abajo vemos el dorso de la mano algo aumentado

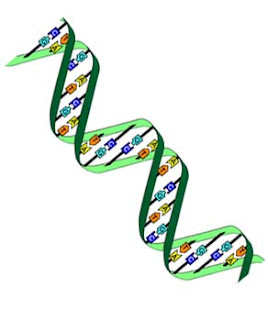

Para determinar dónde obtuvo la célula el esquema que le indicó como formarse, pasemos al núcleo y contemplemos los delgados contornos de las macromoléculas de ADN segregadas dentro de sus genes. Cada una contiene una rica información genética acumulada en el curso de unos cuatro mil millones de años de evolución.

Almacenado en un alfabeto de nucleótidos de cuatro “letras”- hecho de moléculas de azúcar y fosfatos, y llenos de signos de puntuación, reiteraciones para precaver contra el error, y cosas superfluas acumuladas en los callejones sin salida de la historia evolutiva-, su mensaje dice exactamente cómo hacer un ser humano, desde la piel y los huesos hasta las células cerebrales.

Si elevamos más el aumento veremos que la molécula de ADN está compuesta de muchos átomos, con sus capas electrónicas externas entrelazadas y festoneadas en una milagrosa variedad de formas, desde relojes de arena hasta espirales ascendentes como largos muelles y elipses grandes como escudos y fibras delgadas como puros. Algunos de esos electrones son recién llegados, recientemente arrancados a átomos vecinos; otros se incorporaron junto a sus núcleos atómicos hace más de cinco mil millones de años, en la nebulosa de la cual se formó la Tierra.

Una molécula es mayor y más fácil de desmembrar que un átomo; lo mismo podemos decir de un átomo respecto al núcleo atómico, y de un núcleo con respecto a los quarks que contiene. Sion embargo, nos queda la duda de: ¿qué podrá haber más allá de los Quarks?

¿Qué no podremos hacer cuando conozcamos la naturaleza real del átomo y de la luz? El fotón, ese cuánto de luz que parece tan insignificante, nos tiene que dar muchas satisfacciones y, en él, están escondidos secretos que, cuando sean revelados, cambiará el mundo. Esa imagen de arriba que está inmersa en nosotros en en todo el Universo, es la sencilles de la complejidad. A partir de ella, se forma todo: la muy pequeño y lo muy grande.

Si elevamos el aumento cien mil veces, el núcleo de un átomo de carbono se hinchará hasta llenar el campo de visión. Tales núcleos y átomos se formaron dentro de una estrella que estalló mucho antes de que naciera el Sol. Si podemos aumentar aún más, veremos los tríos de quarks que constituyen protonesy neutrones. Los quarks han estado unidos desde que el Universo sólo tenía unos pocos segundos de edad.

Al llegar a escalas cada vez menores, también hemos entrado en ámbitos de energías de unión cada vez mayores. Un átomo puede ser desposeído de su electrón aplicando sólo unos miles de electrón-voltios de energía. Sin embargo, para dispersar los nucleones que forman el núcleo atómico se requieren varios millones de electrón-voltios, y para liberar los quark que constituyen cada nucleón.

Uno de los misterios de la naturaza, están dentro de los protomes y netrones que, confromados por Quarks, resulta que, si estos fueran liberados, tendrían independientemente, más energía que el protónque conformaban. ¿cómo es posible eso?

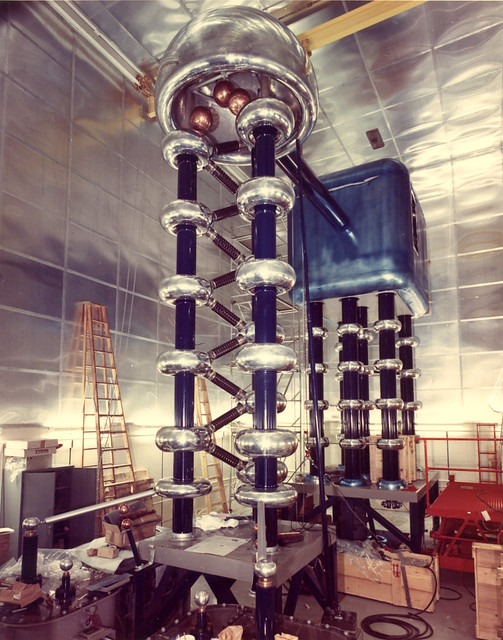

Introduciendo el eje de la historia, esta relación da testimonio del pasado de las partículas: las estructuras más pequeñas, más fundamentales están ligadas por niveles de energía mayores porque las estructuras mismas fueron forjadas en el calor del big bang. Esto implica que los aceleradores de partículas, como los telescopios, funcionen como máquinas del tiempo. Un telescopio penetra en el pasado en virtud del tiempo que tarda la luz en desplazarse entre las estrellas; un acelerador recrea, aunque sea fugazmente, las condiciones que prevalecían en el Universo primitivo. El acelerador de 200 Kev diseñado en los años veinte por Cockroft y Walton reproducía algunos de los sucesos que ocurrieron alrededor de un día después del comienzo del big bang. Los aceleradores construidos en los años cuarenta y cincuenta llegaron hasta la marca de un segundo. El Tevatrón del Fermilab llevó el límite a menos de una milmillonésima de segundo después del comienzo del Tiempo. El nuevo LHC proporcionara un atisbo del medio cósmico cuando el Universo tenía menos de una billonésima de segundo de edad.

Esta es una edad bastante temprana: una diez billonésima de segundo es menos que un pestañeo con los párpados en toda la historia humana registrada. A pesar de ello, extrañamente, la investigación de la evolución del Universo recién nacido indica que ocurrieron muchas cosas aún antes, durante la primera ínfima fracción de un segundo.

Todos los teóricos han tratado de elaborar una explicación coherente de los primeros momentos de la historia cósmica. Por supuesto, sus ideas fueron esquemáticas e incompletas, muchas de sus conjeturas, sin duda, se juzgaran deformadas o sencillamente erróneas, pero constituyeron una crónica mucho más esclarecedora del Universo primitivo que la que teníamos antes.

A los cien millones de años desde el comienzo del tiempo, aún no se habían formado las estrellas, si acaso, algunas más precoces. Aparte de sus escasas y humeantes almenaras, el Universo era una sopa oscura de gas hidrógeno y helio, arremolinándose aquí y allá para formar protogalaxias.

He aquí la primera imagen jamás obtenida de antimateria, específicamente un “anti-átomo” de anti-hidrógeno. Este experimento se realizó en el Aparato ALPHA de CERN, en donde los anti-átomos fueron retenidos por un récord de 170 milisegundos (se atraparon el 0.005% de los anti-átomos generados).

A la edad de mil millones de años, el Universo tiene un aspecto muy diferente. El núcleo de la joven Vía Láctea arde brillantemente, arrojando las sobras de cumulonimbos galácticos a través del oscuro disco; en su centro brilla un quasar blanco-azulado. El disco, aún en proceso de formación, es confuso y está lleno de polvo y gas; divide en dos partes un halo esférico que será oscuro en nuestros días, pero a la sazón corona la galaxia con un brillante conjunto de estrellas calientes de primera generación.

Para determinar dónde obtuvo la célula es esquema que le indicó como formarse, pasemos al núcleo y contemplemos los delgados contornos de las macromoléculas de ADN segregadas dentro de sus genes. Cada una contiene una rica información genética acumulada en el curso de unos cuatro mil millones de años de evolución.

Claro que, nuestra historia está relacionada con todo lo que antes de llegar la vida al Universo pudo pasar. ¡Aquella primera célula! Se replicó en la sopa primordial llamada Protoplasma vivo y, siguió evolucionando hasta conformar seres de diversos tipos y, algunos, llegaron a adquirir la conciencia.

Macromolécula

Almacenado en un alfabeto de nucleótidos de cuatro “letras”- hecho de moléculas de azúcar y fosfatos, y llenos de signos de puntuación, reiteraciones para precaver contra el error, y cosas superfluas acumuladas en los callejones sin salida de la historia evolutiva-, su mensaje dice exactamente cómo hacer un ser humano, desde la piel y los huesos hasta las células cerebrales.

célula cerebral

Si elevamos más el aumento veremos que la molécula de ADN está compuesta de muchos átomos, con sus capas electrónicas externas entrelazadas y festoneadas en una milagrosa variedad de formas de una rareza y de una incleible y extraña belleza que sólo la Naturaleza es capaz de conformar.

Molécula de ADN

Si elevamos el aumento cien mil veces, el núcleo de un átomo de carbono se hinchará hasta llenar el campo de visión. Tales núcleos átomos se formaron dentro de una estrella que estalló mucho antes de que naciera el Sol. Si podemos aumentar aún más, veremos los tríos de quarks que se constituyen en protones y neutrones.

Átomo de Carbono

Los quarks han estado unidos desde que el Universo sólo tenía unos pocos segundos de edad. Una vez que fueron eliminados los antiquarks, se unieron en tripletes para formar protones y neutrones que, al formar un núcleo cargado positivamente, atrayeron a los electrones que dieron lugar a formar los átomos que más tarde, conformaron la materia que podemos ver en nuestro unioverso.

Al llegar a escalas cada vez menores, también hemos entrado en ámbitos de energías de unión cada vez mayores. Un átomo puede ser desposeído de su electrón aplicando sólo unos miles de electrón-voltios de energía. Sin embargo, para dispersar los nucleaones que forman el núcleo atómico se requieren varios millones de electrón-voltios, y para liberar los quarks que constituyen cada nucleón se necesitaría cientos de veces más energía aún.

Los Quarks dentro del núcleo están sometidos a la Interacción fuerte, es decir, la más potente de las cuatro fuerzas fundamentales del Universo, la que mantiene a los Quarks confinados dentro del núcleo atómico por medio de los Gluones.

Introduciendo el eje de la historia, esta relación da testimonio del pasado de las partículas: las estructuras más pequeñas, más fundamentales están ligadas por niveles de energía mayores porque las estructuras mismas fueron forjadas en el calor del big bang.

Haces de protones que chocan cuando viajan a velocidad relativista en el LHC

Esto implica que los aceleradores de partículas, como los telescopios, funcionen como máquinas del tiempo. Un telescopio penetra en el pasado en virtud del tiempo que tarda la luz en desplazarse entre las estrellas; un acelerador recrea, aunque sea fugazmente, las condiciones que prevalecían en el Universo primitivo.

El acelerador de 200 kev diseñado en los años veinte por Cockroft y Walton reproducía algunos de los sucesos que ocurrieron alrededor de un día después del comienzo del big bang.

Aquel acelerador nada tenía que ver con el LHC de ahora, casi un siglo los separa

Los aceleradores construidos en los años cuarenta y cincuenta llegaron hasta la marca de un segundo. El Tevatrón del Fermilab llevó el límite a menos de una milmillonésima de segundo después del comienzo del Tiempo. El nuevo supercolisionador superconductor proporcionara un atisbo del medio cósmico cuando el Universo tenía menos de una billonésima de segundo de edad.

El Tevatrón del Fermilab ya estaba en el camino de la modernidad en los avances de la Física

Esta es una edad bastante temprana: una diez billonésima de segundo es menos que un pestañeo con los párpados en toda la historia humana registrada. A pesar de ello, extrañamente, la investigación de la evolución del Universo recién nacido indica que ocurrieron muchas cosas aún antes, durante la primera ínfima fracción de un segundo.

Todos los teóricos han tratado de elaborar una explicación coherente de los primeros momentos de la historia cósmica. Por supuesto, sus ideas fueron esquemáticas e incompletas, muchas de sus conjeturas, sin duda, se juzgaran deformadas o sencillamente erróneas, pero constituyeron una crónica mucho más aclaradora del Universo primitivo que la que teníamos antes.

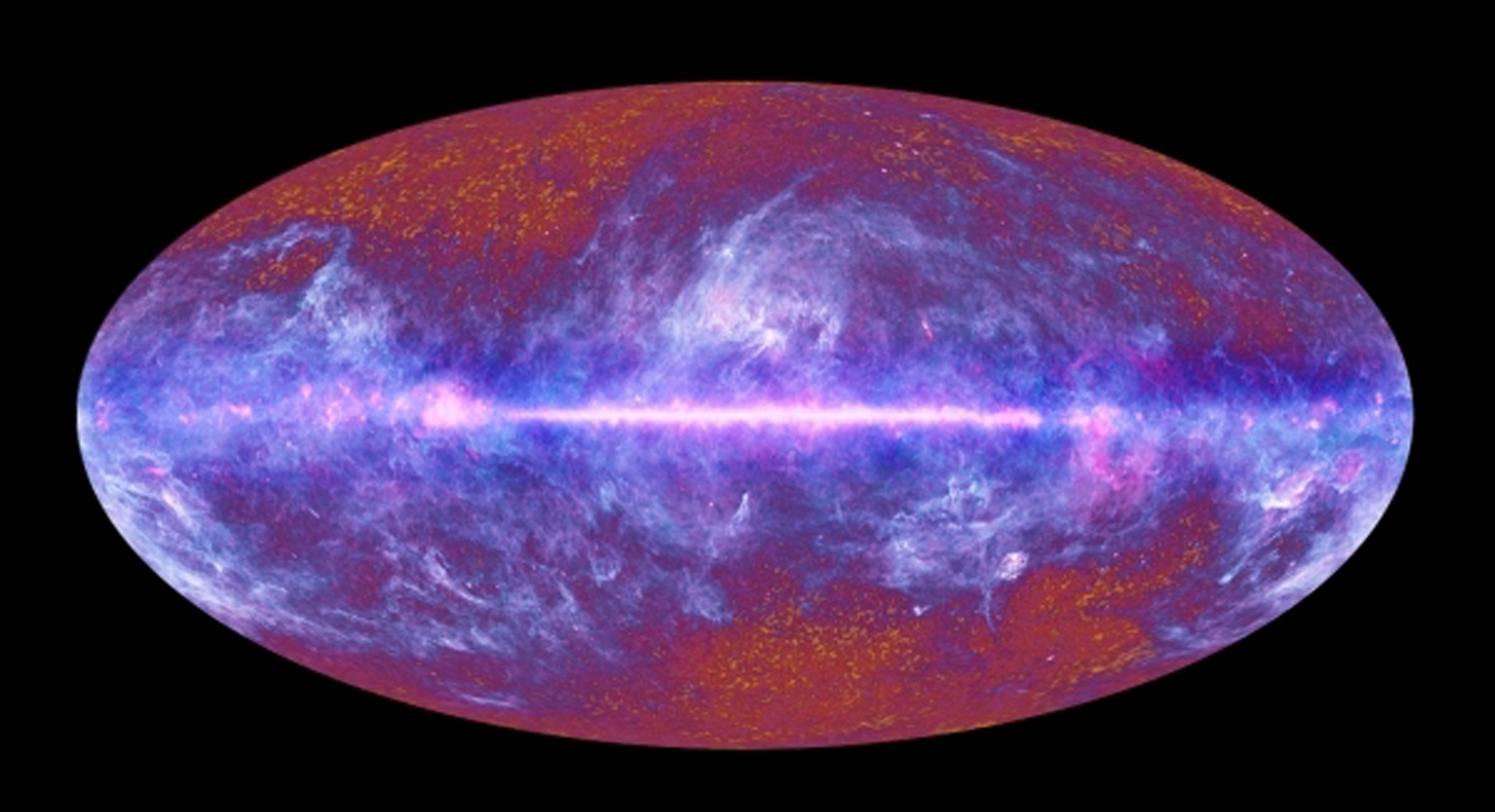

Recreación del Universo primitivo

Bueno amigos, el trabajo era algo más extenso y entrábamos a explicar otros aspectos y parámetros implicados en todo este complejo laberinto que abarca desde lo muy grande hasta la muy pequeño, esos dos mundos que, no por ser tan dispares, resultan ser antagónicos, porque el uno sin el otro no podría exisitir. Otro día, seguiremos abundando en el tema apasionante que aquí tratamos.

emilio silvera

Totales: 87.076.553

Totales: 87.076.553 Conectados: 7

Conectados: 7